Questa guida mostra come eseguire il deployment e la configurazione di un cluster Red Hat Enterprise Linux (RHEL) ad alta disponibilità (HA) per un sistema SAP HANA 1.0 SPS 12 o versioni successive scalabile verticalmente su Google Cloud.

Questa guida include i passaggi per:

- Configurazione di un bilanciatore del carico di rete passthrough interno per reindirizzare il traffico in caso di guasto

- Configurazione di un cluster Pacemaker su RHEL per gestire i sistemi SAP e altre risorse durante un failover

Questa guida include anche i passaggi per la configurazione della replica del sistema SAP HANA, ma consulta la documentazione di SAP per le istruzioni definitive.

Per eseguire il deployment di un sistema SAP HANA senza un cluster ad alta disponibilità Linux o un host di node di standby, consulta la guida al deployment di SAP HANA.

Per configurare un cluster ad alta disponibilità per SAP HANA su SUSE Linux Enterprise Server (SLES), consulta la guida alla configurazione del cluster ad alta disponibilità per lo scale-up di SAP HANA su SLES.

Questa guida è rivolta agli utenti SAP HANA esperti che hanno familiarità con le configurazioni ad alta disponibilità di Linux per SAP HANA.

Il sistema di cui questa guida descrive l'implementazione

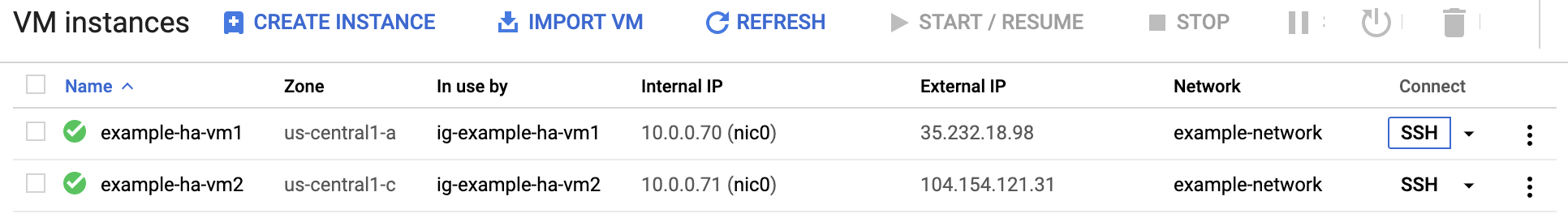

Seguendo questa guida, eseguirai il deployment di due istanze SAP HANA e configurerai un cluster ad alta disponibilità su RHEL. Esegui il deployment di ogni istanza SAP HANA su una VM Compute Engine in una zona diversa all'interno della stessa regione. Questa guida non tratta l'installazione di SAP NetWeaver con disponibilità elevata.

Il cluster di cui è stato eseguito il deployment include le seguenti funzioni e funzionalità:

- Due VM host, ciascuna con un'istanza di SAP HANA

- Replica del sistema SAP HANA sincrona.

- Il gestore delle risorse del cluster ad alta disponibilità Pacemaker.

- Un meccanismo di isolamento STONITH.

- Riavvio automatico dell'istanza non riuscita come nuova istanza secondaria.

Questa guida ti consente di utilizzare i modelli di Cloud Deployment Manager forniti da Google Cloud per eseguire il deployment delle macchine virtuali (VM) Compute Engine e delle istanze SAP HANA, in modo da garantire che le VM e i sistemi SAP HANA di base soddisfino i requisiti di supportabilità di SAP e siano conformi alle best practice attuali.

In questa guida, SAP HANA Studio viene utilizzato per testare la replica del sistema SAP HANA. Se preferisci, puoi utilizzare SAP HANA Cockpit. Per informazioni sull'installazione di SAP HANA Studio, consulta:

- Installazione di SAP HANA Studio su una VM Windows Compute Engine

- Guida all'installazione e all'aggiornamento di SAP HANA Studio

Prerequisiti

Prima di creare il cluster SAP HANA ad alta disponibilità, assicurati che siano soddisfatti i seguenti prerequisiti:

- Hai letto la guida alla pianificazione di SAP HANA e la guida alla pianificazione dell'alta disponibilità di SAP HANA.

- Tu o la tua organizzazione avete un Google Cloud account e avete creato un progetto per il deployment di SAP HANA. Per informazioni sulla creazione diGoogle Cloud account e progetti, consulta Configurare l'Account Google nella Guida all'implementazione di SAP HANA.

- Se vuoi che il tuo carico di lavoro SAP venga eseguito in conformità con la residenza dei dati, controllo dell'accesso, il personale di assistenza o i requisiti normativi, devi creare la cartella Assured Workloads richiesta. Per ulteriori informazioni, consulta Controlli di conformità e sovranità per SAP su Google Cloud.

I media di installazione di SAP HANA sono archiviati in un bucket Cloud Storage disponibile nel progetto e nella regione di deployment. Per informazioni su come caricare i media di installazione di SAP HANA in un bucket Cloud Storage, consulta Downloading SAP HANA (Download di SAP HANA) nella Guida al deployment di SAP HANA.

Se OS Login è abilitato nei metadati del progetto, devi disattivarlo temporaneamente fino al completamento del deployment. Ai fini del deployment, questa procedura configura le chiavi SSH nei metadati dell'istanza. Quando l'accesso al sistema operativo è abilitato, le configurazioni delle chiavi SSH basate su metadati vengono disabilitate e questo deployment non va a buon fine. Al termine del deployment, puoi riattivare l'accesso al sistema operativo.

Per ulteriori informazioni, vedi:

Se utilizzi il DNS interno della VPC, il valore della variabile

vmDnsSettingnei metadati del progetto deve essereGlobalOnlyoZonalPreferredper abilitare la risoluzione dei nomi dei nodi nelle varie zone. L'impostazione predefinita divmDnsSettingèZonalOnly. Per ulteriori informazioni, consulta:

Creare una rete

Per motivi di sicurezza, crea una nuova rete. Puoi controllare chi ha accesso aggiungendo regole firewall o utilizzando un altro metodo di controllo dell'accesso.

Se il progetto ha una rete VPC predefinita, non utilizzarla. Crea invece una tua rete VPC in modo che le uniche regole firewall in vigore siano quelle che crei esplicitamente.

Durante il deployment, le istanze Compute Engine in genere richiedono l'accesso a internet per scaricare l'agente per SAP di Google Cloud. Se utilizzi una delle immagini Linux certificate da SAP disponibili su Google Cloud, l'istanza di calcolo richiede anche l'accesso a internet per registrare la licenza e accedere ai repository del fornitore del sistema operativo. Una configurazione con un gateway NAT e con tag di rete VM supporta questo accesso, anche se le istanze di calcolo di destinazione non hanno IP esterni.

Per configurare la rete:

Console

- Nella Google Cloud console, vai alla pagina Reti VPC.

- Fai clic su Crea rete VPC.

- Inserisci un nome per la rete.

Il nome deve rispettare la convenzione di denominazione. Le reti VPC utilizzano la convenzione di denominazione di Compute Engine.

- In Modalità di creazione subnet, scegli Personalizzata.

- Nella sezione Nuova subnet, specifica i seguenti parametri di configurazione per una

subnet:

- Inserisci un nome per la subnet.

- Per Regione, seleziona la regione Compute Engine in cui vuoi creare la sottorete.

- In Tipo di stack IP, seleziona IPv4 (stack singolo) e poi inserisci un intervallo di indirizzi IP nel formato CIDR, ad esempio

10.1.0.0/24.Si tratta dell'intervallo IPv4 principale per la subnet. Se prevedi di aggiungere più di una subnet, assegni intervalli IP CIDR non sovrapposti per ogni subnet della rete. Tieni presente che ogni subnet e i relativi intervalli IP interni sono mappati a una singola regione.

- Fai clic su Fine.

- Per aggiungere altre subnet, fai clic su Aggiungi subnet e ripeti i passaggi precedenti. Puoi aggiungere altre subnet alla rete dopo averla creata.

- Fai clic su Crea.

gcloud

- Vai a Cloud Shell.

- Per creare una nuova rete in modalità di subnet personalizzate, esegui:

gcloud compute networks create NETWORK_NAME --subnet-mode custom

Sostituisci

NETWORK_NAMEcon il nome della nuova rete. Il nome deve rispettare la convenzione di denominazione. Le reti VPC utilizzano la convenzione di denominazione di Compute Engine.Specifica

--subnet-mode customper evitare di utilizzare la modalità automatica predefinita, che crea automaticamente una subnet in ogni regione Compute Engine. Per ulteriori informazioni, consulta la sezione Modalità di creazione subnet. - Crea una subnet e specifica la regione e l'intervallo IP:

gcloud compute networks subnets create SUBNETWORK_NAME \ --network NETWORK_NAME --region REGION --range RANGESostituisci quanto segue:

SUBNETWORK_NAME: il nome della nuova subnetNETWORK_NAME: il nome della rete creata nel passaggio precedenteREGION: la regione in cui vuoi la subnetRANGE: l'intervallo di indirizzi IP, specificato in formato CIDR, ad esempio10.1.0.0/24Se prevedi di aggiungere più di una subnet, assegna intervalli IP CIDR non sovrapposti per ogni subnet della rete. Tieni presente che ogni subnet e i relativi intervalli IP interni sono mappati a una singola regione.

- Se vuoi, ripeti il passaggio precedente e aggiungi altre sottoreti.

Configurazione di un gateway NAT

Se devi creare una o più VM senza indirizzi IP pubblici, devi utilizzare la Network Address Translation (NAT) per consentire alle VM di accedere a internet. Utilizza Cloud NAT, un Google Cloud servizio gestito software-defined distribuito che consente alle VM di inviare pacchetti in uscita a internet e di ricevere eventuali pacchetti di risposta in entrata stabiliti corrispondenti. In alternativa, puoi configurare una VM separata come gateway NAT.

Per creare un'istanza Cloud NAT per il tuo progetto, consulta Utilizzo di Cloud NAT.

Dopo aver configurato Cloud NAT per il progetto, le istanze VM possono accedere in sicurezza a internet senza un indirizzo IP pubblico.

aggiungi regole firewall

Per impostazione predefinita, una regola del firewall implicita blocca le connessioni in entrata dall'esterno della tua rete Virtual Private Cloud (VPC). Per consentire le connessioni in entrata, configura una regola firewall per la tua VM. Dopo aver stabilito una connessione in entrata con una VM, il traffico è consentito in entrambe le direzioni tramite la connessione.

Puoi anche creare una regola firewall per consentire l'accesso esterno a porte specifiche o per limitare l'accesso tra le VM sulla stessa rete. Se viene utilizzato il tipo di rete VPC default, vengono applicate anche alcune regole predefinite aggiuntive, come la regola default-allow-internal, che consente la connettività tra le VM sulla stessa rete su tutte le porte.

A seconda dei criteri IT applicabili al tuo ambiente, potresti dover isolare o limitare in altro modo la connettività all'host del database, cosa che puoi fare creando regole firewall.

A seconda dello scenario, puoi creare regole firewall per consentire l'accesso per:

- Le porte SAP predefinite elencate in TCP/IP di tutti i prodotti SAP.

- Connessioni dal tuo computer o dall'ambiente di rete aziendale all'istanza VM Compute Engine. Se hai dubbi su quale indirizzo IP utilizzare, rivolgiti all'amministratore di rete della tua azienda.

- Comunicazione tra le VM nella sottorete SAP HANA, inclusa la comunicazione tra i nodi di un sistema SAP HANA scalabile o tra il server di database e i server delle applicazioni in un'architettura a tre livelli. Puoi attivare la comunicazione tra le VM creando una regola firewall per consentire il traffico proveniente dalla sottorete.

Per creare una regola firewall:

Console

Nella Google Cloud console, vai alla pagina Firewall della rete VPC.

Nella parte superiore della pagina, fai clic su Crea regola firewall.

- Nel campo Rete, seleziona la rete in cui si trova la VM.

- Nel campo Destinazioni, specifica le risorse Google Cloud a cui si applica questa regola. Ad esempio, specifica Tutte le istanze nella rete. In alternativa, per limitare la regola a istanze specifiche Google Cloud, inserisci i tag in Tag target specificati.

- Nel campo Filtro origine, seleziona una delle seguenti opzioni:

- Intervalli IP per consentire il traffico in entrata da indirizzi IP specifici. Specifica l'intervallo di indirizzi IP nel campo Intervalli IP di origine.

- Subnet per consentire il traffico in entrata da una determinata subnet. Specifica il nome della sottorete nel seguente Subnet. Puoi utilizzare questa opzione per consentire l'accesso tra le VM in una configurazione a 3 livelli o scalabile.

- Nella sezione Protocolli e porte, seleziona Protocolli e porte specificati e inserisci

tcp:PORT_NUMBER.

Fai clic su Crea per creare la regola firewall.

gcloud

Crea una regola firewall utilizzando il seguente comando:

$ gcloud compute firewall-rules create FIREWALL_NAME

--direction=INGRESS --priority=1000 \

--network=NETWORK_NAME --action=ALLOW --rules=PROTOCOL:PORT \

--source-ranges IP_RANGE --target-tags=NETWORK_TAGSDeployment delle VM e di SAP HANA

Prima di iniziare a configurare il cluster ad alta disponibilità, devi definire ed eseguire il deployment delle istanze VM e dei sistemi SAP HANA che fungono da nodi principali e secondari nel cluster ad alta disponibilità.

Per definire ed eseguire il deployment dei sistemi, utilizza lo stesso modello Cloud Deployment Manager impiegato per eseguire il deployment di un sistema SAP HANA nella guida al deployment di SAP HANA.

Tuttavia, per eseguire il deployment di due sistemi anziché uno, devi aggiungere la definizione del secondo sistema al file di configurazione copiando e incollando la definizione del primo sistema. Dopo aver creato la seconda definizione, devi modificare i nomi della risorsa e dell'istanza nella seconda definizione. Per proteggerti da un errore zonale, specifica un'altra zona nella stessa regione. Tutti gli altri valori delle proprietà nelle due definizioni rimangono invariati.

Dopo aver eseguito correttamente il deployment dei sistemi SAP HANA, definisci e configura il cluster HA.

Le istruzioni riportate di seguito utilizzano Cloud Shell, ma sono applicabili in generale a Google Cloud CLI.

Verifica che le quote attuali per risorse come i dischi permanenti e le CPU siano sufficienti per i sistemi SAP HANA che stai per installare. Se le quote non sono sufficienti, il deployment non riesce. Per i requisiti relativi alle quote di SAP HANA, consulta Considerazioni su prezzi e quote per SAP HANA.

Apri Cloud Shell o, se hai installato gcloud CLI sulla tua workstation locale, apri un terminale.

Scarica il modello di file di configurazione

template.yamlper il cluster SAP HANA ad alta disponibilità nella tua directory di lavoro inserendo il seguente comando nella CLI Cloud Shell o gcloud:wget https://storage.googleapis.com/cloudsapdeploy/deploymentmanager/latest/dm-templates/sap_hana/template.yaml

Se vuoi, rinomina il file

template.yamlper identificare la configurazione che definisce.Apri il file

template.yamlnell'editor di codice Cloud Shell o, se utilizzi l'interfaccia alla gcloud CLI, nell'editor di testo che preferisci.Per aprire l'editor di codice di Cloud Shell, fai clic sull'icona a forma di matita nell'angolo in alto a destra della finestra del terminale di Cloud Shell.

Nel file

template.yaml, completa la definizione del sistema SAP HANA principale. Specifica i valori delle proprietà sostituendo le parentesi e i relativi contenuti con i valori per l'installazione. Le proprietà sono descritte nella tabella seguente.Per creare le istanze VM senza installare SAP HANA, elimina o commenta tutte le righe che iniziano con

sap_hana_.Proprietà Tipo di dati Descrizione tipo Stringa Specifica la posizione, il tipo e la versione del template Deployment Manager da utilizzare durante il deployment.

Il file YAML include due specifiche

type, una delle quali è commentata. La specificatypeattiva per impostazione predefinita specifica la versione del modello comelatest. La specificatypecommentata specifica una versione del modello specifica con un timestamp.Se vuoi che tutti i tuoi implementazioni utilizzino la stessa versione del modello, utilizza la specifica

typeche include il timestamp.instanceNameStringa Il nome dell'istanza VM attualmente in fase di definizione. Specifica nomi diversi nelle definizioni delle VM principali e secondarie. I nomi devono essere specificati con lettere minuscole, numeri o trattini. instanceTypeStringa Il tipo di macchina virtuale Compute Engine su cui devi eseguire SAP HANA. Se hai bisogno di un tipo di VM personalizzato, specifica un tipo di VM predefinito con un numero di vCPU più vicino a quello di cui hai bisogno, pur essendo più grande. Al termine del deployment, modifica il numero di vCPU e la quantità di memoria. zoneStringa La Google Cloud zona in cui eseguire il deployment dell'istanza VM che stai definendo. Specifica zone diverse nella stessa regione per le definizioni HANA principali e secondarie. Le zone devono trovarsi nella stessa regione selezionata per la subnet. subnetworkStringa Il nome della sottorete creata in un passaggio precedente. Se esegui il deployment in un VPC condiviso, specifica questo valore come [SHAREDVPC_PROJECT]/[SUBNETWORK]. Ad esempio,myproject/network1.linuxImageStringa Il nome dell'immagine o della famiglia di immagini del sistema operativo Linux che utilizzi con SAP HANA. Per specificare una famiglia di immagini, aggiungi il prefisso family/al nome della famiglia. Ad esempio,family/rhel-7-6-sap-ha. Per specificare un'immagine specifica, specifica solo il nome dell'immagine. Per l'elenco delle immagini e delle famiglie disponibili, consulta la pagina Immagini nella Google Cloud console.linuxImageProjectStringa Il Google Cloud progetto che contiene l'immagine che vuoi utilizzare. Questo progetto potrebbe essere il tuo progetto o un Google Cloud progetto di immagini, come rhel-sap-cloud. Per ulteriori informazioni sui Google Cloud progetti di immagini, consulta la pagina Immagini nella documentazione di Compute Engine.sap_hana_deployment_bucketStringa Il nome del Google Cloud bucket di archiviazione nel progetto che contiene i file di installazione e revisione di SAP HANA che hai caricato in un passaggio precedente. Eventuali file di revisione dell'upgrade nel bucket vengono applicati a SAP HANA durante la procedura di deployment. sap_hana_sidStringa L'ID sistema (SID) SAP HANA. L'ID deve essere composto da tre caratteri alfanumerici e deve iniziare con una lettera. Tutte le lettere devono essere maiuscole. sap_hana_instance_numberNumero intero Il numero di istanza, compreso tra 0 e 99, del sistema SAP HANA. Il valore predefinito è 0. sap_hana_sidadm_passwordStringa La password dell'amministratore del sistema operativo. Le password devono essere composte da almeno acht caratteri e includere almeno una lettera maiuscola, una lettera minuscola e un numero. sap_hana_system_passwordStringa La password del superutente del database. Le password devono essere composte da almeno 8 caratteri e includere almeno una lettera maiuscola, una lettera minuscola e un numero. sap_hana_sidadm_uidNumero intero Il valore predefinito per l'ID utente SID_LCadmè900per evitare che i gruppi creati dagli utenti entrino in conflitto con SAP HANA. Se necessario, puoi impostare un valore diverso.sap_hana_sapsys_gidNumero intero L'ID gruppo predefinito per sapsys è 79. Se specifichi un valore superiore, puoi sostituirlo con quello richiesto.sap_hana_scaleout_nodesNumero intero Specifica 0. Queste istruzioni riguardano solo i sistemi SAP HANA di scalabilità.networkTagStringa Un tag di rete che rappresenta l'istanza VM per scopi di firewall o routing. Se specifichi publicIP: Noe non specifichi un tag di rete, assicurati di fornire un altro mezzo di accesso a internet.nic_typeStringa Facoltativo, ma consigliato se disponibile per la macchina e la versione del sistema operativo di destinazione. Specifica l'interfaccia di rete da utilizzare con l'istanza VM. Puoi specificare il valore GVNICoVIRTIO_NET. Per utilizzare una Google Virtual NIC (gVNIC), devi specificare un'immagine del sistema operativo che supporti gVNIC come valore per la proprietàlinuxImage. Per l'elenco delle immagini del sistema operativo, vedi Dettagli del sistema operativo.Se non specifichi un valore per questa proprietà, l'interfaccia di rete viene selezionata automaticamente in base al tipo di macchina specificato per la proprietà

Questo argomento è disponibile nelle versioni dei modelli di Deployment ManagerinstanceType.202302060649o successive.publicIPBooleano Facoltativo. Determina se viene aggiunto un indirizzo IP pubblico alla tua istanza VM. Il valore predefinito è Yes.serviceAccountStringa Facoltativo. Specifica un account di servizio da utilizzare dalle VM host e dai programmi in esecuzione sulle VM host. Specifica l'indirizzo email dell'account di servizio. Ad esempio, svc-acct-name@project-id.. Per impostazione predefinita, viene utilizzato l'account di servizio predefinito di Compute Engine. Per ulteriori informazioni, consulta Gestione di identità e accessi per i programmi SAP su Google Cloud. Crea la definizione del sistema SAP HANA secondario copiando la definizione del sistema SAP HANA principale e incollando la copia dopo la definizione del sistema SAP HANA principale. Guarda l'esempio che segue questi passaggi.

Nella definizione del sistema SAP HANA secondario, specifica valori diversi per le seguenti proprietà rispetto a quelli specificati nella definizione del sistema SAP HANA principale:

nameinstanceNamezone

Crea le istanze:

gcloud deployment-manager deployments create DEPLOYMENT_NAME --config TEMPLATE_NAME.yaml

Il comando riportato sopra richiama Deployment Manager, che esegue il deployment delle VM, scarica il software SAP HANA dal bucket di archiviazione e installa SAP HANA, il tutto in base alle specifiche del file

template.yaml.L'elaborazione del deployment prevede due fasi. Nella prima fase, Deployment Manager scrive il proprio stato nella console. Nella seconda fase, gli script di deployment scrivono il loro stato in Cloud Logging.

Esempio di file di configurazione template.yaml completo

L'esempio seguente mostra un file di configurazione template.yaml completo che esegue il deployment di due istanze VM con un sistema SAP HANA installato.

Il file contiene le definizioni di due risorse da eseguire il deployment:

sap_hana_primary e sap_hana_secondary. Ogni definizione della risorsa contiene le definizioni di una VM e di un'istanza SAP HANA.

La definizione della risorsa sap_hana_secondary è stata creata copiando e incollando la prima definizione, quindi modificando i valori delle proprietà name, instanceName e zone. Tutti gli altri valori delle proprietà nelle due definizioni delle risorse sono uguali.

Le proprietà networkTag, serviceAccount, sap_hana_sidadm_uid e

sap_hana_sapsys_gid provengono dalla sezione Opzioni avanzate del

modello del file di configurazione. Le proprietà sap_hana_sidadm_uid e

sap_hana_sapsys_gid sono incluse per mostrare i relativi valori predefiniti, che vengono utilizzati

perché le proprietà sono commentate.

resources:

- name: sap_hana_primary

type: https://storage.googleapis.com/cloudsapdeploy/deploymentmanager/latest/dm-templates/sap_hana/sap_hana.py

#

# By default, this configuration file uses the latest release of the deployment

# scripts for SAP on Google Cloud. To fix your deployments to a specific release

# of the scripts, comment out the type property above and uncomment the type property below.

#

# type: https://storage.googleapis.com/cloudsapdeploy/deploymentmanager/yyyymmddhhmm/dm-templates/sap_hana/sap_hana.py

#

properties:

instanceName: hana-ha-vm-1

instanceType: n2-highmem-32

zone: us-central1-a

subnetwork: example-subnet-us-central1

linuxImage: family/rhel-8-1-sap-ha

linuxImageProject: rhel-sap-cloud

sap_hana_deployment_bucket: hana2-sp4-rev46

sap_hana_sid: HA1

sap_hana_instance_number: 22

sap_hana_sidadm_password: Tempa55word

sap_hana_system_password: Tempa55word

sap_hana_scaleout_nodes: 0

networkTag: cluster-ntwk-tag

serviceAccount: limited-roles@example-project-123456.

# sap_hana_sidadm_uid: 900

# sap_hana_sapsys_gid: 79

- name: sap_hana_secondary

type: https://storage.googleapis.com/cloudsapdeploy/deploymentmanager/latest/dm-templates/sap_hana/sap_hana.py

#

# By default, this configuration file uses the latest release of the deployment

# scripts for SAP on Google Cloud. To fix your deployments to a specific release

# of the scripts, comment out the type property above and uncomment the type property below.

#

# type: https://storage.googleapis.com/cloudsapdeploy/deploymentmanager/yyyymmddhhmm/dm-templates/sap_hana/sap_hana.py

#

properties:

instanceName: hana-ha-vm-2

instanceType: n2-highmem-32

zone: us-central1-c

subnetwork: example-subnet-us-central1

linuxImage: family/rhel-8-1-sap-ha

linuxImageProject: rhel-sap-cloud

sap_hana_deployment_bucket: hana2-sp4-rev46

sap_hana_sid: HA1

sap_hana_instance_number: 22

sap_hana_sidadm_password: Google123

sap_hana_system_password: Google123

sap_hana_scaleout_nodes: 0

networkTag: cluster-ntwk-tag

serviceAccount: limited-roles@example-project-123456.

# sap_hana_sidadm_uid: 900

# sap_hana_sapsys_gid: 79

Creare regole firewall che consentano l'accesso alle VM host

Se non l'hai già fatto, crea regole firewall che consentano l'accesso a ogni VM host dalle seguenti origini:

- A scopo di configurazione, la tua workstation locale, un bastion host o un server di jump

- Per l'accesso tra i nodi del cluster, le altre VM host nel cluster HA

Quando crei regole firewall VPC, specifichi i tag di rete che hai definito nel file di configurazione template.yaml per designare le VM host come target della regola.

Per verificare il deployment, definisci una regola per consentire le connessioni SSH sulla porta 22 da un bastion host o dalla tua workstation locale.

Per l'accesso tra i nodi del cluster, aggiungi una regola firewall che consenta tutti i tipi di connessione su qualsiasi porta da altre VM nella stessa sottorete.

Prima di procedere alla sezione successiva, assicurati che le regole del firewall per la verifica del deployment e per la comunicazione all'interno del cluster siano state create. Per istruzioni, vedi Aggiungere regole firewall.

Verifica del deployment delle VM e di SAP HANA

Per verificare il deployment, controlla i log di deployment in Cloud Logging e i dischi e i servizi sulle VM degli host principali e secondari.

Nella Google Cloud console, apri Cloud Logging per monitorare l'avanzamento dell'installazione e verificare la presenza di errori.

Filtra i log:

Esplora log

Nella pagina Esplora log, vai al riquadro Query.

Dal menu a discesa Risorsa, seleziona Globale e poi fai clic su Aggiungi.

Se non vedi l'opzione Globale, nell'editor di query inserisci la seguente query:

resource.type="global" "Deployment"Fai clic su Esegui query.

Visualizzatore log legacy

- Nella pagina Visualizzatore log legacy, seleziona Globale come risorsa di logging nel menu del selettore di base.

Analizza i log filtrati:

- Se viene visualizzato

"--- Finished", significa che l'elaborazione del deployment è completata e puoi procedere al passaggio successivo. Se viene visualizzato un errore relativo alla quota:

Nella pagina IAM e amministrazione Quote, aumenta le quote che non soddisfano i requisiti di SAP HANA elencati nella guida alla pianificazione di SAP HANA.

Nella pagina Deployment di Deployment Manager, elimina il deployment per ripulire le VM e i dischi permanenti dall'installazione non riuscita.

Esegui di nuovo il deployment.

- Se viene visualizzato

Controlla la configurazione delle VM e di SAP HANA

Dopo aver eseguito il deployment del sistema SAP HANA senza errori, connettiti a ogni VM utilizzando SSH. Nella pagina Istanze VM di Compute Engine, puoi fare clic sul pulsante SSH per ogni istanza VM oppure utilizzare il metodo SSH che preferisci.

Passa all'utente root.

$sudo su -Al prompt dei comandi, inserisci

df -h. Su ogni VM, assicurati di vedere le directory/hana, ad esempio/hana/data.Filesystem Size Used Avail Use% Mounted on /dev/sda2 30G 4.0G 26G 14% / devtmpfs 126G 0 126G 0% /dev tmpfs 126G 0 126G 0% /dev/shm tmpfs 126G 17M 126G 1% /run tmpfs 126G 0 126G 0% /sys/fs/cgroup /dev/sda1 200M 9.7M 191M 5% /boot/efi /dev/mapper/vg_hana-shared 251G 49G 203G 20% /hana/shared /dev/mapper/vg_hana-sap 32G 240M 32G 1% /usr/sap /dev/mapper/vg_hana-data 426G 7.0G 419G 2% /hana/data /dev/mapper/vg_hana-log 125G 4.2G 121G 4% /hana/log /dev/mapper/vg_hanabackup-backup 512G 33M 512G 1% /hanabackup tmpfs 26G 0 26G 0% /run/user/900 tmpfs 26G 0 26G 0% /run/user/899 tmpfs 26G 0 26G 0% /run/user/1000

Passa all'utente amministratore SAP sostituendo

SID_LCnel seguente comando con l'ID sistema specificato nel modello del file di configurazione. Utilizza le lettere minuscole.#su - SID_LCadmAssicurati che i servizi SAP HANA, come

hdbnameserver,hdbindexservere altri, siano in esecuzione nell'istanza inserendo il seguente comando:>HDB infoSe utilizzi RHEL per SAP 9.0 o versioni successive, assicurati che i pacchetti

chkconfigecompat-openssl11siano installati nell'istanza VM.Per ulteriori informazioni di SAP, consulta Nota SAP 3108316 - Red Hat Enterprise Linux 9.x: installazione e configurazione .

Convalida l'installazione dell'agente per SAP di Google Cloud

Dopo aver disegnato una VM e installato il sistema SAP, verifica che Agent per SAP diGoogle Cloudfunzioni correttamente.

Verifica che l'agente per SAP di Google Cloudsia in esecuzione

Per verificare che l'agente sia in esecuzione:

Stabilisci una connessione SSH con la tua istanza Compute Engine.

Esegui questo comando:

systemctl status google-cloud-sap-agent

Se l'agente funziona correttamente, l'output contiene

active (running). Ad esempio:google-cloud-sap-agent.service - Google Cloud Agent for SAP Loaded: loaded (/usr/lib/systemd/system/google-cloud-sap-agent.service; enabled; vendor preset: disabled) Active: active (running) since Fri 2022-12-02 07:21:42 UTC; 4 days ago Main PID: 1337673 (google-cloud-sa) Tasks: 9 (limit: 100427) Memory: 22.4 M (max: 1.0G limit: 1.0G) CGroup: /system.slice/google-cloud-sap-agent.service └─1337673 /usr/bin/google-cloud-sap-agent

Se l'agente non è in esecuzione, riavvialo.

Verificare che l'agente host SAP riceva le metriche

Per verificare che le metriche dell'infrastruttura vengano raccolte dall'agente diGoogle Cloudper SAP e inviate correttamente all'agente host SAP, segui questi passaggi:

- Nel sistema SAP, inserisci la transazione

ST06. Nel riquadro di panoramica, controlla la disponibilità e i contenuti dei seguenti campi per la configurazione end-to-end corretta dell'infrastruttura di monitoraggio di SAP e Google:

- Fornitore di servizi cloud:

Google Cloud Platform - Accesso al monitoraggio avanzato:

TRUE - Dettagli sul monitoraggio migliorati:

ACTIVE

- Fornitore di servizi cloud:

Configurare il monitoraggio per SAP HANA

Se vuoi, puoi monitorare le tue istanze SAP HANA utilizzando Agente per SAP diGoogle Cloud. Dalla versione 2.0, puoi configurare l'agente per raccogliere le metriche di monitoraggio di SAP HANA e inviarle a Cloud Monitoring. Cloud Monitoring ti consente di creare dashboard per visualizzare queste metriche, configurare avvisi in base alle soglie delle metriche e altro ancora.

Per ulteriori informazioni sulla raccolta delle metriche di monitoraggio di SAP HANA utilizzando Agente per SAP diGoogle Cloud, consulta la raccolta delle metriche di monitoraggio di SAP HANA.

Attivare il riavvio rapido di SAP HANA

Google Cloud Consiglia vivamente di attivare il riavvio rapido di SAP HANA per ogni istanza di SAP HANA, in particolare per le istanze più grandi. Il riavvio rapido di SAP HANA riduce il tempo di riavvio nel caso in cui SAP HANA si arresti, ma il sistema operativo rimanga in esecuzione.

Come configurato dagli script di automazione forniti,

le impostazioni del sistema operativo e del kernel supportano già il riavvio rapido di SAP HANA. Google Cloud

Devi definire il file system tmpfs e configurare SAP HANA.

Per definire il file system tmpfs e configurare SAP HANA, puoi seguire i passaggi manuali o utilizzare lo script di automazione fornito daGoogle Cloud per attivare il riavvio rapido di SAP HANA. Per ulteriori informazioni, consulta:

- Passaggi manuali: attivare il riavvio rapido di SAP HANA

- Passaggi automatici: attiva Fast Restart di SAP HANA

Per istruzioni autorevoli complete su SAP HANA Fast Restart, consulta la documentazione dell'opzione SAP HANA Fast Restart.

Procedura manuale

Configura il file system tmpfs

Dopo aver eseguito il deployment delle VM host e dei sistemi SAP HANA di base,

devi creare e montare le directory per i nodi NUMA nel file system tmpfs.

Mostra la topologia NUMA della VM

Prima di poter mappare il file system tmpfs richiesto, devi sapere quanti nodi NUMA sono presenti nella tua VM. Per visualizzare i nodi NUMA disponibili su una VM Compute Engine, inserisci il seguente comando:

lscpu | grep NUMA

Ad esempio, un tipo di VM m2-ultramem-208 ha quattro nodi NUMA,

numerati da 0 a 3, come mostrato nell'esempio seguente:

NUMA node(s): 4 NUMA node0 CPU(s): 0-25,104-129 NUMA node1 CPU(s): 26-51,130-155 NUMA node2 CPU(s): 52-77,156-181 NUMA node3 CPU(s): 78-103,182-207

Crea le directory dei nodi NUMA

Crea una directory per ogni nodo NUMA nella VM e imposta le autorizzazioni.

Ad esempio, per quattro nodi NUMA numerati da 0 a 3:

mkdir -pv /hana/tmpfs{0..3}/SID

chown -R SID_LCadm:sapsys /hana/tmpfs*/SID

chmod 777 -R /hana/tmpfs*/SIDMonta le directory dei nodi NUMA su tmpfs

Monta le directory del file system tmpfs e specifica

una preferenza per il nodo NUMA per ciascuna con mpol=prefer:

SID specifica il SID con lettere maiuscole.

mount tmpfsSID0 -t tmpfs -o mpol=prefer:0 /hana/tmpfs0/SID mount tmpfsSID1 -t tmpfs -o mpol=prefer:1 /hana/tmpfs1/SID mount tmpfsSID2 -t tmpfs -o mpol=prefer:2 /hana/tmpfs2/SID mount tmpfsSID3 -t tmpfs -o mpol=prefer:3 /hana/tmpfs3/SID

Aggiorna /etc/fstab

Per assicurarti che i punti di montaggio siano disponibili dopo il riavvio del sistema operativo, aggiungi voci alla tabella del file system, /etc/fstab:

tmpfsSID0 /hana/tmpfs0/SID tmpfs rw,nofail,relatime,mpol=prefer:0 tmpfsSID1 /hana/tmpfs1/SID tmpfs rw,nofail,relatime,mpol=prefer:1 tmpfsSID1 /hana/tmpfs2/SID tmpfs rw,nofail,relatime,mpol=prefer:2 tmpfsSID1 /hana/tmpfs3/SID tmpfs rw,nofail,relatime,mpol=prefer:3

(Facoltativo) Imposta limiti all'utilizzo della memoria

Il file system tmpfs può aumentare e diminuire dinamicamente.

Per limitare la memoria utilizzata dal file system tmpfs, puoi impostare un limite di dimensioni per un volume del nodo NUMA con l'opzione size.

Ad esempio:

mount tmpfsSID0 -t tmpfs -o mpol=prefer:0,size=250G /hana/tmpfs0/SID

Puoi anche limitare l'utilizzo complessivo della memoria tmpfs per tutti i nodi NUMA per

una determinata istanza SAP HANA e un determinato nodo del server impostando il

parametro persistent_memory_global_allocation_limit nella sezione [memorymanager]

del file global.ini.

Configurazione di SAP HANA per il riavvio rapido

Per configurare SAP HANA per il riavvio rapido, aggiorna il file global.ini

e specifica le tabelle da archiviare nella memoria persistente.

Aggiorna la sezione [persistence] nel file global.ini

Configura la sezione [persistence] nel file global.ini di SAP HANA

per fare riferimento alle località tmpfs. Separa ogni località tmpfs con un punto e virgola:

[persistence] basepath_datavolumes = /hana/data basepath_logvolumes = /hana/log basepath_persistent_memory_volumes = /hana/tmpfs0/SID;/hana/tmpfs1/SID;/hana/tmpfs2/SID;/hana/tmpfs3/SID

L'esempio precedente specifica quattro volumi di memoria per quattro nodi NUMA,

che corrispondono a m2-ultramem-208. Se esegui la tua esecuzione su m2-ultramem-416, devi configurare otto volumi di memoria (0-7).

Riavvia SAP HANA dopo aver modificato il file global.ini.

Ora SAP HANA può utilizzare la posizione tmpfs come spazio di memoria permanente.

Specifica le tabelle da archiviare nella memoria persistente

Specifica tabelle o partizioni di colonne specifiche da archiviare nella memoria persistente.

Ad esempio, per attivare la memoria persistente per una tabella esistente, esegui la query SQL:

ALTER TABLE exampletable persistent memory ON immediate CASCADE

Per modificare il valore predefinito per le nuove tabelle, aggiungi il parametro

table_default nel file indexserver.ini. Ad esempio:

[persistent_memory] table_default = ON

Per ulteriori informazioni su come controllare le colonne, le tabelle e le visualizzazioni di monitoraggio che forniscono informazioni dettagliate, consulta Memoria persistente SAP HANA.

Passaggi automatici

Lo script di automazione fornito Google Cloud per attivare il riavvio rapido di SAP HANA apporta modifiche alle directory /hana/tmpfs*, al file /etc/fstab e alla configurazione di SAP HANA. Quando esegui lo script, potresti dover eseguire passaggi aggiuntivi a seconda che si tratti del deployment iniziale del sistema SAP HANA o se stai ridimensionando la macchina a una dimensione NUMA diversa.

Per il deployment iniziale del sistema SAP HANA o per il ridimensionamento della macchina al fine di aumentare il numero di nodi NUMA, assicurati che SAP HANA sia in esecuzione durante l'esecuzione dello script di automazione fornito per attivare il riavvio rapido di SAP HANA. Google Cloud

Quando redimensioni la macchina per ridurre il numero di nodi NUMA, assicurati che SAP HANA sia interrotta durante l'esecuzione dello script di automazione che consente di attivare il riavvio rapido di SAP HANA. Google Cloud Dopo l'esecuzione dello script, devi aggiornare manualmente la configurazione di SAP HANA per completare la configurazione del riavvio rapido di SAP HANA. Per ulteriori informazioni, consulta la configurazione di SAP HANA per il riavvio rapido.

Per attivare il riavvio rapido di SAP HANA, segui questi passaggi:

Stabilisci una connessione SSH con la VM host.

Passa al root:

sudo su -

Scarica lo script

sap_lib_hdbfr.sh:wget https://storage.googleapis.com/cloudsapdeploy/terraform/latest/terraform/lib/sap_lib_hdbfr.sh

Rendi eseguibile il file:

chmod +x sap_lib_hdbfr.sh

Verifica che lo script non contenga errori:

vi sap_lib_hdbfr.sh ./sap_lib_hdbfr.sh -help

Se il comando restituisce un errore, contatta l'assistenza clienti Google Cloud. Per ulteriori informazioni su come contattare l'assistenza clienti, consulta Ricevere assistenza per SAP su Google Cloud.

Esegui lo script dopo aver sostituito l'ID sistema (SID) e la password di SAP HANA per l'utente SYSTEM del database SAP HANA. Per fornire la password in modo sicuro, ti consigliamo di utilizzare un secret in Secret Manager.

Esegui lo script utilizzando il nome di un secret in Secret Manager. Questo segreto deve esistere nel Google Cloud progetto che contiene l'istanza VM host.

sudo ./sap_lib_hdbfr.sh -h 'SID' -s SECRET_NAME

Sostituisci quanto segue:

SID: specifica l'SID con lettere maiuscole. Ad esempio,AHA.SECRET_NAME: specifica il nome del segreto corrispondente alla password per l'utente SYSTEM del database SAP HANA. Questo segreto deve esistere nel Google Cloud progetto che contiene l'istanza VM host.

In alternativa, puoi eseguire lo script utilizzando una password in testo normale. Dopo aver attivato il riavvio rapido di SAP HANA, assicurati di cambiare la password. L'utilizzo di una password in testo normale non è consigliato perché la password verrà registrata nella cronologia della riga di comando della VM.

sudo ./sap_lib_hdbfr.sh -h 'SID' -p 'PASSWORD'

Sostituisci quanto segue:

SID: specifica l'SID con lettere maiuscole. Ad esempio,AHA.PASSWORD: specifica la password per l'utente SYSTEM del database SAP HANA.

Se l'esecuzione iniziale è andata a buon fine, dovresti visualizzare un output simile al seguente:

INFO - Script is running in standalone mode

ls: cannot access '/hana/tmpfs*': No such file or directory

INFO - Setting up HANA Fast Restart for system 'TST/00'.

INFO - Number of NUMA nodes is 2

INFO - Number of directories /hana/tmpfs* is 0

INFO - HANA version 2.57

INFO - No directories /hana/tmpfs* exist. Assuming initial setup.

INFO - Creating 2 directories /hana/tmpfs* and mounting them

INFO - Adding /hana/tmpfs* entries to /etc/fstab. Copy is in /etc/fstab.20220625_030839

INFO - Updating the HANA configuration.

INFO - Running command: select * from dummy

DUMMY

"X"

1 row selected (overall time 4124 usec; server time 130 usec)

INFO - Running command: ALTER SYSTEM ALTER CONFIGURATION ('global.ini', 'SYSTEM') SET ('persistence', 'basepath_persistent_memory_volumes') = '/hana/tmpfs0/TST;/hana/tmpfs1/TST;'

0 rows affected (overall time 3570 usec; server time 2239 usec)

INFO - Running command: ALTER SYSTEM ALTER CONFIGURATION ('global.ini', 'SYSTEM') SET ('persistent_memory', 'table_unload_action') = 'retain';

0 rows affected (overall time 4308 usec; server time 2441 usec)

INFO - Running command: ALTER SYSTEM ALTER CONFIGURATION ('indexserver.ini', 'SYSTEM') SET ('persistent_memory', 'table_default') = 'ON';

0 rows affected (overall time 3422 usec; server time 2152 usec)

(Facoltativo) Configura le chiavi SSH nelle VM principali e secondarie

Le chiavi del secure store SAP HANA (SSFS) devono essere sincronizzate tra gli host del cluster HA. Per semplificare la sincronizzazione e consentire di copiare file come i backup tra gli host del cluster HA, queste istruzioni autorizzano le connessioni SSH dirette tra i due host.

La tua organizzazione ha probabilmente linee guida che regolano le comunicazioni della rete interna. Se necessario, al termine del deployment puoi rimuovere i metadati dalle VM e le chiavi dalla directory authorized_keys.

Se la configurazione di connessioni SSH dirette non è conforme alle linee guida della tua organizzazione, puoi sincronizzare le chiavi SSFS e trasferire i file utilizzando altri metodi, ad esempio:

- Trasferisci file di dimensioni ridotte tramite la tua workstation locale utilizzando le opzioni di menu Carica file e Scarica file di Cloud Shell. Consulta Gestire i file con Cloud Shell.

- Scambia file utilizzando un bucket Cloud Storage. Consulta la documentazione di Cloud Storage.

- Utilizza l'agente Backint di Cloud Storage per SAP HANA per eseguire il backup e il ripristino dei database HANA. Consulta Agente Backint di Cloud Storage per SAP HANA.

- Utilizza una soluzione di archiviazione file come Filestore o Google Cloud NetApp Volumes per creare una cartella condivisa. Per ulteriori informazioni, consulta Opzioni del file server.

Per abilitare le connessioni SSH tra le istanze principale e secondaria:

Nella VM host principale:

Accedi tramite SSH alla VM.

Genera una chiave SSH per l'utente che ha bisogno della connessione SSH da host a host. L'utente in genere sei tu.

$ssh-keygenQuando richiesto, accetta i valori predefiniti premendo Invio.

Aggiorna i metadati della VM principale con informazioni sulla chiave SSH per la VM secondaria.

$gcloud compute instances add-metadata secondary-host-name \ --metadata "ssh-keys=$(whoami):$(cat ~/.ssh/id_rsa.pub)" \ --zone secondary-zoneAutorizza la VM principale a se stessa

$cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys

Nella VM host secondaria:

Accedi tramite SSH alla VM.

Genera una chiave SSH per l'utente che ha bisogno della connessione SSH da host a host.

$ssh-keygenAggiorna i metadati della VM secondaria con le informazioni sulla chiave SSH per la VM principale.

$gcloud compute instances add-metadata primary-host-name \ --metadata "ssh-keys=$(whoami):$(cat ~/.ssh/id_rsa.pub)" \ --zone primary-zoneAutorizza la VM secondaria a se stessa

$cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keysVerifica che le chiavi SSH siano configurate correttamente aprendo una connessione SSH dal sistema secondario al sistema principale.

$ssh primary-host-name

Nella VM host principale, conferma la connessione aprendo una connessione SSH alla VM host secondaria:

$ssh secondary-host-name

Esegui il backup dei database

Crea i backup dei database per avviare la registrazione del database per la replica del sistema SAP HANA e creare un punto di recupero.

Se hai più database tenant in una configurazione MDC, esegui il backup di ciascun database tenant.

Il modello Deployment Manager utilizza /hanabackup/data/SID come directory di backup predefinita.

Per creare i backup dei nuovi database SAP HANA:

Nell'host principale, passa a

SID_LCadm. A seconda dell'immagine del sistema operativo, il comando potrebbe essere diverso.sudo -i -u SID_LCadm

Crea backup del database:

Per un sistema SAP HANA con un singolo contenitore del database:

>hdbsql -t -u system -p SYSTEM_PASSWORD -i INST_NUM \ "backup data using file ('full')"L'esempio seguente mostra una risposta corretta da un nuovo sistema SAP HANA:

0 rows affected (overall time 18.416058 sec; server time 18.414209 sec)

Per un sistema di contenitori multidatabase (MDC) SAP HANA, crea un backup del database di sistema e di tutti i database dei tenant:

>hdbsql -t -d SYSTEMDB -u system -p SYSTEM_PASSWORD -i INST_NUM \ "backup data using file ('full')">hdbsql -t -d SID -u system -p SYSTEM_PASSWORD -i INST_NUM \ "backup data using file ('full')"

L'esempio seguente mostra una risposta corretta da un nuovo sistema SAP HANA:

0 rows affected (overall time 16.590498 sec; server time 16.588806 sec)

Verifica che la modalità di logging sia impostata su normale:

>hdbsql -u system -p SYSTEM_PASSWORD -i INST_NUM \ "select value from "SYS"."M_INIFILE_CONTENTS" where key='log_mode'"Dovresti vedere:

VALUE "normal"

Attiva la replica del sistema SAP HANA

Nell'ambito dell'attivazione della replica del sistema SAP HANA, devi copiare i dati e i file chiave per gli archivi sicuri SAP HANA sul file system (SSFS) dall'hosting primario all'hosting secondario. Il metodo utilizzato da questa procedura per copiare i file è solo uno dei possibili metodi che puoi utilizzare.

Nell'host principale come

SID_LCadm, attiva la replica del sistema:>hdbnsutil -sr_enable --name=primary-host-nameNell'host secondario come

SID_LCadm, interrompi SAP HANA:>HDB stopNell'host principale, utilizza lo stesso account utente utilizzato per configurare SSH tra le VM host e copia i file delle chiavi nell'host secondario. Per comodità, i comandi seguenti definiscono anche una variabile di ambiente per l'ID account utente:

$sudo cp /usr/sap/SID/SYS/global/security/rsecssfs ~/rsecssfs -r$myid=$(whoami)$sudo chown ${myid} -R /home/"${myid}"/rsecssfs$scp -r rsecssfs $(whoami)@secondary-host-name:rsecssfs$rm -r /home/"${myid}"/rsecssfsNell'host secondario, con lo stesso utente del passaggio precedente:

Sostituisci i file di chiavi esistenti nelle directory rsecssfs con i file dell'host principale e imposta le autorizzazioni dei file per limitare l'accesso:

$SAPSID=SID$sudo rm /usr/sap/"${SAPSID}"/SYS/global/security/rsecssfs/data/SSFS_"${SAPSID}".DAT$sudo rm /usr/sap/"${SAPSID}"/SYS/global/security/rsecssfs/key/SSFS_"${SAPSID}".KEY$myid=$(whoami)$sudo cp /home/"${myid}"/rsecssfs/data/SSFS_"${SAPSID}".DAT \ /usr/sap/"${SAPSID}"/SYS/global/security/rsecssfs/data/SSFS_"${SAPSID}".DAT$sudo cp /home/"${myid}"/rsecssfs/key/SSFS_"${SAPSID}".KEY \ /usr/sap/"${SAPSID}"/SYS/global/security/rsecssfs/key/SSFS_"${SAPSID}".KEY$sudo chown "${SAPSID,,}"adm:sapsys \ /usr/sap/"${SAPSID}"/SYS/global/security/rsecssfs/data/SSFS_"${SAPSID}".DAT$sudo chown "${SAPSID,,}"adm:sapsys \ /usr/sap/"${SAPSID}"/SYS/global/security/rsecssfs/key/SSFS_"${SAPSID}".KEY$sudo chmod 644 \ /usr/sap/"${SAPSID}"/SYS/global/security/rsecssfs/data/SSFS_"${SAPSID}".DAT$sudo chmod 640 \ /usr/sap/"${SAPSID}"/SYS/global/security/rsecssfs/key/SSFS_"${SAPSID}".KEYRipulisci i file nella home directory.

$rm -r /home/"${myid}"/rsecssfsCome

SID_LCadm, registra il sistema SAP HANA secondario con la replica del sistema SAP HANA:>hdbnsutil -sr_register --remoteHost=primary-host-name --remoteInstance=inst_num \ --replicationMode=syncmem --operationMode=logreplay --name=secondary-host-nameCome

SID_LCadm, avvia SAP HANA:>HDB start

Convalida della replica del sistema

Nell'host principale come SID_LCadm, verifica che la replica del sistema SAP HANA sia attiva eseguendo il seguente script Python:

$ python $DIR_INSTANCE/exe/python_support/systemReplicationStatus.pySe la replica è configurata correttamente, tra gli altri indicatori, vengono visualizzati i seguenti valori per i servizi xsengine, nameserver e indexserver:

- Il valore

Secondary Active StatusèYES - Il valore

Replication StatusèACTIVE

Inoltre, overall system replication status mostra ACTIVE.

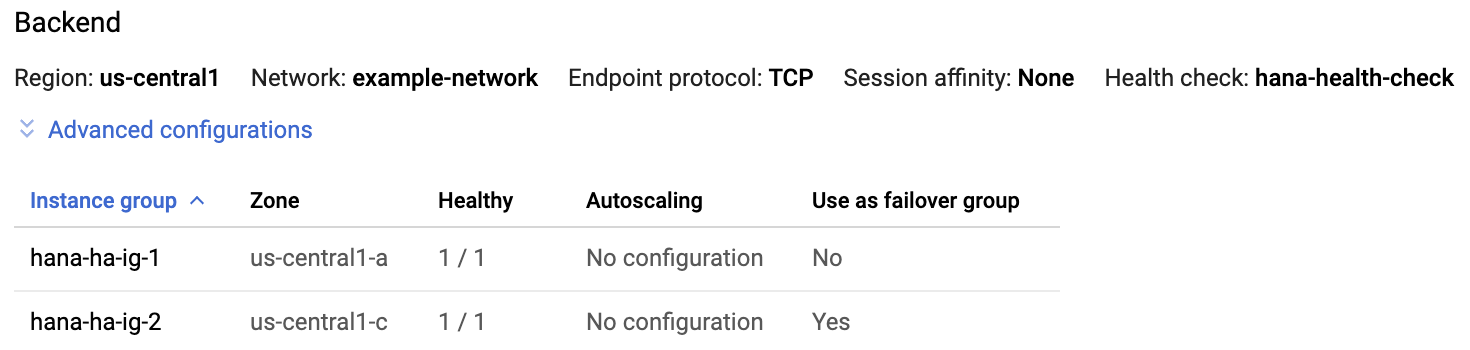

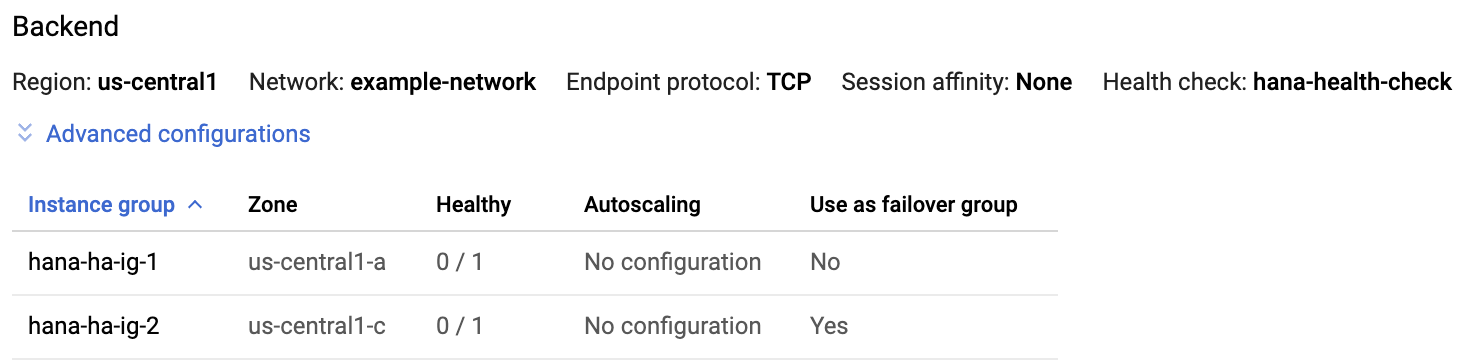

Configurare il supporto del failover di Cloud Load Balancing

Il servizio bilanciatore del carico di rete passthrough interno con supporto del failover instrada il traffico all'host attivo in un cluster SAP HANA in base a un servizio di controllo di integrità.

Prenota un indirizzo IP per l'IP virtuale

L'indirizzo IP virtuale (VIP), a volte indicato come indirizzo IP mobile, segue il sistema SAP HANA attivo. Il bilanciatore del carico indirizza il traffico inviato all'indirizzo VIP alla VM che attualmente ospita il sistema SAP HANA attivo.

Apri Cloud Shell:

Prenota un indirizzo IP per l'IP virtuale. Si tratta dell'indirizzo IP utilizzato dalle applicazioni per accedere a SAP HANA. Se ometti il flag

--addresses, viene scelto per te un indirizzo IP nella subnet specificata:$gcloud compute addresses create VIP_NAME \ --region CLUSTER_REGION --subnet CLUSTER_SUBNET \ --addresses VIP_ADDRESSPer ulteriori informazioni sulla prenotazione di un indirizzo IP statico, consulta Prenotazione di un indirizzo IP interno statico.

Conferma la prenotazione dell'indirizzo IP:

$gcloud compute addresses describe VIP_NAME \ --region CLUSTER_REGIONDovresti vedere un output simile al seguente esempio:

address: 10.0.0.19 addressType: INTERNAL creationTimestamp: '2020-05-20T14:19:03.109-07:00' description: '' id: '8961491304398200872' kind: compute#address name: vip-for-hana-ha networkTier: PREMIUM purpose: GCE_ENDPOINT region: https://www.googleapis.com/compute/v1/projects/example-project-123456/regions/us-central1 selfLink: https://www.googleapis.com/compute/v1/projects/example-project-123456/regions/us-central1/addresses/vip-for-hana-ha status: RESERVED subnetwork: https://www.googleapis.com/compute/v1/projects/example-project-123456/regions/us-central1/subnetworks/example-subnet-us-central1

Crea gruppi di istanze per le VM host

In Cloud Shell, crea due gruppi di istanze non gestite e assegna la VM host principale a uno e la VM host secondaria all'altro:

$gcloud compute instance-groups unmanaged create PRIMARY_IG_NAME \ --zone=PRIMARY_ZONE$gcloud compute instance-groups unmanaged add-instances PRIMARY_IG_NAME \ --zone=PRIMARY_ZONE \ --instances=PRIMARY_HOST_NAME$gcloud compute instance-groups unmanaged create SECONDARY_IG_NAME \ --zone=SECONDARY_ZONE$gcloud compute instance-groups unmanaged add-instances SECONDARY_IG_NAME \ --zone=SECONDARY_ZONE \ --instances=SECONDARY_HOST_NAMEConferma la creazione dei gruppi di istanze:

$gcloud compute instance-groups unmanaged listDovresti vedere un output simile al seguente esempio:

NAME ZONE NETWORK NETWORK_PROJECT MANAGED INSTANCES hana-ha-ig-1 us-central1-a example-network example-project-123456 No 1 hana-ha-ig-2 us-central1-c example-network example-project-123456 No 1

Crea un controllo di integrità Compute Engine

In Cloud Shell, crea il controllo di integrità. Per la porta utilizzata dal controllo di integrità, scegli una porta nell'intervallo privato 49152-65535 per evitare conflitti con altri servizi. I valori di intervallo di controllo e timeout sono leggermente più lunghi di quelli predefiniti per aumentare la tolleranza al failover durante gli eventi di migrazione live di Compute Engine. Se necessario, puoi modificare i valori:

$gcloud compute health-checks create tcp HEALTH_CHECK_NAME --port=HEALTHCHECK_PORT_NUM \ --proxy-header=NONE --check-interval=10 --timeout=10 --unhealthy-threshold=2 \ --healthy-threshold=2Conferma la creazione del controllo di integrità:

$gcloud compute health-checks describe HEALTH_CHECK_NAMEDovresti vedere un output simile al seguente esempio:

checkIntervalSec: 10 creationTimestamp: '2020-05-20T21:03:06.924-07:00' healthyThreshold: 2 id: '4963070308818371477' kind: compute#healthCheck name: hana-health-check selfLink: https://www.googleapis.com/compute/v1/projects/example-project-123456/global/healthChecks/hana-health-check tcpHealthCheck: port: 60000 portSpecification: USE_FIXED_PORT proxyHeader: NONE timeoutSec: 10 type: TCP unhealthyThreshold: 2

Crea una regola firewall per i controlli di integrità

Definisci una regola firewall per una porta nell'intervallo privato che consenta l'accesso alle VM host dagli intervalli IP utilizzati dai controlli di salute di Compute Engine, 35.191.0.0/16 e 130.211.0.0/22. Per saperne di più, consulta Creare regole firewall per i controlli di integrità.

Se non ne hai già uno, aggiungi un tag di rete alle VM host. Questo tag di rete viene utilizzato dalla regola firewall per i controlli di integrità.

$gcloud compute instances add-tags PRIMARY_HOST_NAME \ --tags NETWORK_TAGS \ --zone PRIMARY_ZONE$gcloud compute instances add-tags SECONDARY_HOST_NAME \ --tags NETWORK_TAGS \ --zone SECONDARY_ZONESe non ne hai già una, crea una regola firewall per consentire i controlli di integrità:

$gcloud compute firewall-rules create RULE_NAME \ --network NETWORK_NAME \ --action ALLOW \ --direction INGRESS \ --source-ranges 35.191.0.0/16,130.211.0.0/22 \ --target-tags NETWORK_TAGS \ --rules tcp:HLTH_CHK_PORT_NUMAd esempio:

gcloud compute firewall-rules create fw-allow-health-checks \ --network example-network \ --action ALLOW \ --direction INGRESS \ --source-ranges 35.191.0.0/16,130.211.0.0/22 \ --target-tags cluster-ntwk-tag \ --rules tcp:60000

Configura il bilanciatore del carico e il gruppo di failover

Crea il servizio di backend del bilanciatore del carico:

$gcloud compute backend-services create BACKEND_SERVICE_NAME \ --load-balancing-scheme internal \ --health-checks HEALTH_CHECK_NAME \ --no-connection-drain-on-failover \ --drop-traffic-if-unhealthy \ --failover-ratio 1.0 \ --region CLUSTER_REGION \ --global-health-checksAggiungi il gruppo di istanze principale al servizio di backend:

$gcloud compute backend-services add-backend BACKEND_SERVICE_NAME \ --instance-group PRIMARY_IG_NAME \ --instance-group-zone PRIMARY_ZONE \ --region CLUSTER_REGIONAggiungi il gruppo di istanze di failover secondario al servizio di backend:

$gcloud compute backend-services add-backend BACKEND_SERVICE_NAME \ --instance-group SECONDARY_IG_NAME \ --instance-group-zone SECONDARY_ZONE \ --failover \ --region CLUSTER_REGIONCreare una regola di forwarding. Per l'indirizzo IP, specifica l'indirizzo IP che hai riservato per il VIP. Se devi accedere al sistema SAP HANA dall'esterno della regione specificata di seguito, includi il flag

--allow-global-accessnella definizione:$gcloud compute forwarding-rules create RULE_NAME \ --load-balancing-scheme internal \ --address VIP_ADDRESS \ --subnet CLUSTER_SUBNET \ --region CLUSTER_REGION \ --backend-service BACKEND_SERVICE_NAME \ --ports ALLPer saperne di più sull'accesso tra regioni al sistema SAP HANA di alta disponibilità, consulta Bilanciamento del carico TCP/UDP interno.

Testa la configurazione del bilanciatore del carico

Anche se i gruppi di istanza di backend non verranno registrati come integri fino a più tardi, puoi testare la configurazione del bilanciatore del carico impostando un listener per rispondere ai controlli di integrità. Dopo aver configurato un ascoltatore, se il bilanciatore del carico è configurato correttamente, lo stato dei gruppi di istanza di backend diventa Stabile.

Le sezioni seguenti presentano diversi metodi che puoi utilizzare per testare la configurazione.

Test del bilanciatore del carico con l'utilità socat

Puoi utilizzare l'utilità socat per ascoltare temporaneamente sulla porta di controllo di integrità.

Su entrambe le VM host, installa l'utilità

socat:$sudo yum install -y socatAvvia un processo

socatper ascoltare per 60 secondi sulla porta di controllo di integrità:$sudo timeout 60s socat - TCP-LISTEN:HLTH_CHK_PORT_NUM,forkIn Cloud Shell, dopo aver atteso qualche secondo affinché il controllo di integrità rilevi il listener, controlla lo stato dei gruppi di istanza di backend:

$gcloud compute backend-services get-health BACKEND_SERVICE_NAME \ --region CLUSTER_REGIONDovresti vedere un output simile al seguente:

--- backend: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-a/instanceGroups/hana-ha-ig-1 status: healthStatus: ‐ healthState: HEALTHY instance: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-a/instances/hana-ha-vm-1 ipAddress: 10.0.0.35 port: 80 kind: compute#backendServiceGroupHealth --- backend: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-c/instanceGroups/hana-ha-ig-2 status: healthStatus: ‐ healthState: HEALTHY instance: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-c/instances/hana-ha-vm-2 ipAddress: 10.0.0.34 port: 80 kind: compute#backendServiceGroupHealth

Test del bilanciatore del carico utilizzando la porta 22

Se la porta 22 è aperta per le connessioni SSH sulle VM host, puoi modificare temporaneamente il controllo di integrità in modo che utilizzi la porta 22, che ha un listener in grado di rispondere al controllo di integrità.

Per utilizzare temporaneamente la porta 22:

Fai clic sul controllo di integrità nella console:

Fai clic su Modifica.

Nel campo Porta, imposta il numero di porta su 22.

Fai clic su Salva e attendi un paio di minuti.

In Cloud Shell, controlla lo stato dei gruppi di istanza di backend:

$gcloud compute backend-services get-health BACKEND_SERVICE_NAME \ --region CLUSTER_REGIONDovresti vedere un output simile al seguente:

--- backend: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-a/instanceGroups/hana-ha-ig-1 status: healthStatus: ‐ healthState: HEALTHY instance: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-a/instances/hana-ha-vm-1 ipAddress: 10.0.0.35 port: 80 kind: compute#backendServiceGroupHealth --- backend: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-c/instanceGroups/hana-ha-ig-2 status: healthStatus: ‐ healthState: HEALTHY instance: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-c/instances/hana-ha-vm-2 ipAddress: 10.0.0.34 port: 80 kind: compute#backendServiceGroupHealth

Al termine, ripristina il numero di porta del controllo di integrità.

Configurare Pacemaker

La procedura seguente configura l'implementazione Red Hat di un cluster Pacemaker su VM Compute Engine per SAP HANA.

La procedura si basa sulla documentazione di Red Hat per la configurazione di cluster ad alta disponibilità, tra cui (è richiesto un abbonamento a Red Hat):

- Installazione e configurazione di un cluster ad alta disponibilità Red Hat Enterprise Linux 7.6 (e versioni successive) su Google Cloud

- Replicazione automatica del sistema SAP HANA in scale-up in un cluster pacemaker

Installa gli agenti del cluster su entrambi i nodi

Completa i seguenti passaggi su entrambi i nodi.

Come utente root, installa i componenti di Pacemaker:

#yum -y install pcs pacemaker fence-agents-gce resource-agents-gcp resource-agents-sap-hana#yum update -ySe utilizzi un'immagine RHEL per SAP fornita da Google, questi pacchetti sono già installati, ma potrebbero essere necessari alcuni aggiornamenti.

Imposta la password per l'utente

hacluster, che viene installato come parte dei pacchetti:#passwd haclusterSpecifica una password per

haclusterquando richiesto.Nelle immagini RHEL fornite da Google Cloud, il servizio firewall del sistema operativo è attivo per impostazione predefinita. Configura il servizio firewall per consentire il traffico ad alta disponibilità:

#firewall-cmd --permanent --add-service=high-availability#firewall-cmd --reloadAvvia il servizio pcs e configuralo in modo che venga avviato all'avvio:

#systemctl start pcsd.service#systemctl enable pcsd.serviceControlla lo stato del servizio pcs:

#systemctl status pcsd.serviceDovresti vedere un output simile al seguente:

● pcsd.service - PCS GUI and remote configuration interface Loaded: loaded (/usr/lib/systemd/system/pcsd.service; enabled; vendor preset: disabled) Active: active (running) since Sat 2020-06-13 21:17:05 UTC; 25s ago Docs: man:pcsd(8) man:pcs(8) Main PID: 31627 (pcsd) CGroup: /system.slice/pcsd.service └─31627 /usr/bin/ruby /usr/lib/pcsd/pcsd Jun 13 21:17:03 hana-ha-vm-1 systemd[1]: Starting PCS GUI and remote configuration interface... Jun 13 21:17:05 hana-ha-vm-1 systemd[1]: Started PCS GUI and remote configuration interface.Nel file

/etc/hosts, aggiungi il nome host completo e gli indirizzi IP interni di entrambi gli host del cluster. Ad esempio:127.0.0.1 localhost localhost.localdomain localhost4 localhost4.localdomain4 ::1 localhost localhost.localdomain localhost6 localhost6.localdomain6 10.0.0.40 hana-ha-vm-1.us-central1-a.c.example-project-123456.internal hana-ha-vm-1 # Added by Google 10.0.0.41 hana-ha-vm-2.us-central1-c.c.example-project-123456.internal hana-ha-vm-2 169.254.169.254 metadata.google.internal # Added by Google

Per ulteriori informazioni di Red Hat sulla configurazione del file

/etc/hostssui nodi del cluster RHEL, visita la pagina https://access.redhat.com/solutions/81123.

Crea il cluster

Con accesso come utente root su entrambi i nodi, autorizza l'utente

hacluster. Fai clic sulla scheda corrispondente alla tua versione di RHEL per visualizzare il comando:RHEL 8 e versioni successive

#pcs host auth primary-host-name secondary-host-nameRHEL 7

#pcs cluster auth primary-host-name secondary-host-nameQuando richiesto, inserisci il nome utente

haclustere la password impostata per l'utentehacluster.Crea il cluster:

RHEL 8 e versioni successive

#pcs cluster setup cluster-name primary-host-name secondary-host-nameRHEL 7

#pcs cluster setup --name cluster-name primary-host-name secondary-host-name

Modifica le impostazioni predefinite di corosync.conf

Modifica il file /etc/corosync/corosync.conf sull'host principale per impostare un punto di partenza più appropriato per testare la tolleranza ai guasti del cluster ad alta disponibilità su Google Cloud.

Su entrambi gli host, utilizza l'editor di testo che preferisci per aprire il

/etc/corosync/corosync.conffile per la modifica:#/etc/corosync/corosync.confSe

/etc/corosync/corosync.confè un nuovo file o è vuoto, puoi controllare la directory/etc/corosync/per trovare un file di esempio da utilizzare come base per il file corosync.Nella sezione

totemdel file corosync.conf, aggiungi le seguenti proprietà con i valori suggeriti come mostrato per la tua versione di RHEL:RHEL 8 e versioni successive

transport: knettoken: 20000token_retransmits_before_loss_const: 10join: 60max_messages: 20

Ad esempio:

totem { version: 2 cluster_name: hacluster secauth: off transport: knet token: 20000 token_retransmits_before_loss_const: 10 join: 60 max_messages: 20 } ...RHEL 7

transport: udputoken: 20000token_retransmits_before_loss_const: 10join: 60max_messages: 20

Ad esempio:

totem { version: 2 cluster_name: hacluster secauth: off transport: udpu token: 20000 token_retransmits_before_loss_const: 10 join: 60 max_messages: 20 } ...Dall'host che contiene il file

corosync.confmodificato, sincronizza la configurazione di corosync nel cluster:RHEL 8 e versioni successive

#pcs cluster sync corosyncRHEL 7

#pcs cluster syncImposta il cluster in modo che si avvii automaticamente:

#pcs cluster enable --all#pcs cluster start --all

Verifica che le nuove impostazioni di corosync siano attive nel cluster utilizzando l'utilità corosync-cmapctl:

#corosync-cmapctl

Configurare le recinzioni

Le immagini RHEL fornite da Google Cloud includono un agente di recinzione fence_gce

specifico per Google Cloud. Utilizza fence_gce

per creare dispositivi di recinzione per ogni VM host.

Per garantire la sequenza corretta di eventi dopo un'azione di recinzione, configura il sistema operativo in modo da ritardare il riavvio di Corosync dopo la recinzione di una VM. Modifica anche il timeout di Pacemaker per i riavvii in modo da tenere conto del ritardo.

Per visualizzare tutte le opzioni disponibili con l'agente di recinzione fence_gce,

esegui fence_gce -h.

Crea le risorse del dispositivo di recinzione

Nell'host principale come utente root:

Crea un dispositivo di recinzione per ogni VM host:

#pcs stonith create primary-fence-name fence_gce \ port=primary-host-name \ zone=primary-host-zone \ project=project-id \ pcmk_reboot_timeout=300 pcmk_monitor_retries=4 pcmk_delay_max=30 \ op monitor interval="300s" timeout="120s" \ op start interval="0" timeout="60s"#pcs stonith create secondary-fence-name fence_gce \ port=secondary-host-name \ zone=secondary-host-zone \ project=project-id \ pcmk_reboot_timeout=300 pcmk_monitor_retries=4 \ op monitor interval="300s" timeout="120s" \ op start interval="0" timeout="60s"Limita ogni dispositivo di recinzione all'altra VM host:

#pcs constraint location primary-fence-name avoids primary-host-name#pcs constraint location secondary-fence-name avoids secondary-host-name

Nell'host principale come utente root, testa il dispositivo di recinzione secondario:

Arresta la VM host secondaria:

#fence_gce -o off -n secondary-host-name --zone=secondary-host-zoneSe il comando va a buon fine, perdi la connettività con la VM host secondaria e questa viene visualizzata come interrotta nella pagina Istanze VM nella Google Cloud console. Potresti dover aggiornare la pagina.

Riavvia la VM host secondaria:

#fence_gce -o on -n secondary-host-name --zone=secondary-host-zone

Nell'host secondario, come utente root, testa il dispositivo di recinzione principale ripetendo i passaggi precedenti utilizzando i valori per l'host principale nei comandi.

Su uno degli host come utente root, controlla lo stato del cluster:

#pcs statusLe risorse di recinzione vengono visualizzate nella sezione delle risorse dello stato del cluster, in modo simile all'esempio seguente:

[root@hana-ha-vm-2 ~]# pcs status Cluster name: hana-ha-cluster Stack: corosync Current DC: hana-ha-vm-1 (version 1.1.19-8.el7_6.5-c3c624ea3d) - partition with quorum Last updated: Mon Jun 15 17:19:07 2020 Last change: Mon Jun 15 17:18:33 2020 by root via cibadmin on hana-ha-vm-1 2 nodes configured 2 resources configured Online: [ hana-ha-vm-1 hana-ha-vm-2 ] Full list of resources: STONITH-hana-ha-vm-1 (stonith:fence_gce): Started hana-ha-vm-2 STONITH-hana-ha-vm-2 (stonith:fence_gce): Started hana-ha-vm-1 Daemon Status: corosync: active/enabled pacemaker: active/enabled pcsd: active/enabled

Imposta un ritardo per il riavvio di Corosync

Su entrambi gli host, come utente root, crea un file drop-in

systemdche ritarda l'avvio di Corosync per garantire la sequenza corretta di eventi dopo il riavvio di una VM protetta:systemctl edit corosync.service

Aggiungi le seguenti righe al file:

[Service] ExecStartPre=/bin/sleep 60

Salva il file ed esci dall'editor.

Ricarica la configurazione del gestore systemd.

systemctl daemon-reload

Verifica che il file plug-in sia stato creato:

service corosync status

Dovresti vedere una riga per il file plug-in, come nell'esempio seguente:

● corosync.service - Corosync Cluster Engine Loaded: loaded (/usr/lib/systemd/system/corosync.service; disabled; vendor preset: disabled) Drop-In: /etc/systemd/system/corosync.service.d └─override.conf Active: active (running) since Tue 2021-07-20 23:45:52 UTC; 2 days ago

Attivare i hook del provider SAP HANA HA/RE

Red Hat consiglia di attivare i hook del provider SAP HANA HA/RE, che consentono a SAP HANA di inviare notifiche per determinati eventi e migliorano il rilevamento degli errori. Gli hook del provider SAP HANA HA/RE richiedono SAP HANA 2.0 SPS 03 o una versione successiva.

Sia sul sito principale che su quello secondario, completa i seguenti passaggi:

Come

SID_LCadm, interrompi SAP HANA:>HDB stop

Come utente root o

SID_LCadm, apri il fileglobal.iniper la modifica:>vi /hana/shared/SID/global/hdb/custom/config/global.iniAggiungi le seguenti definizioni al file

global.ini:[ha_dr_provider_SAPHanaSR] provider = SAPHanaSR path = /usr/share/SAPHanaSR/srHook execution_order = 1 [ha_dr_provider_chksrv] provider = ChkSrv path = /usr/share/SAPHanaSR/srHook execution_order = 2 action_on_lost = stop [trace] ha_dr_saphanasr = info ha_dr_chksrv = info

Come utente root, crea un file di configurazione personalizzato nella directory

/etc/sudoers.deseguendo il seguente comando. Questo nuovo file di configurazione consente all'utenteSID_LCadmdi accedere agli attributi del nodo del cluster quando viene chiamato il metodo di hooksrConnectionChanged().>visudo -f /etc/sudoers.d/20-saphanaNel file

Sostituisci quanto segue:/etc/sudoers.d/20-saphana, aggiungi il seguente testo:SITE_A: il nome del sito del server SAP HANA principaleSITE_B: il nome del sito del server SAP HANA secondarioSID_LC: l'SID deve essere specificato in lettere minuscole

crm_mon -A1 | grep sitecome utente root sul server SAP HANA principale o sul server secondario.Cmnd_Alias SITEA_SOK = /usr/sbin/crm_attribute -n hana_SID_LC_site_srHook_SITE_A -v SOK -t crm_config -s SAPHanaSR Cmnd_Alias SITEA_SFAIL = /usr/sbin/crm_attribute -n hana_SID_LC_site_srHook_SITE_A -v SFAIL -t crm_config -s SAPHanaSR Cmnd_Alias SITEB_SOK = /usr/sbin/crm_attribute -n hana_SID_LC_site_srHook_SITE_B -v SOK -t crm_config -s SAPHanaSR Cmnd_Alias SITEB_SFAIL = /usr/sbin/crm_attribute -n hana_SID_LC_site_srHook_SITE_B -v SFAIL -t crm_config -s SAPHanaSR SID_LCadm ALL=(ALL) NOPASSWD: SITEA_SOK, SITEA_SFAIL, SITEB_SOK, SITEB_SFAIL Defaults!SITEA_SOK, SITEA_SFAIL, SITEB_SOK, SITEB_SFAIL !requiretty

Nel file

/etc/sudoers, assicurati che sia incluso il seguente testo:#includedir /etc/sudoers.d

Tieni presente che

#in questo testo fa parte della sintassi e non indica che la riga è un commento.Come

SID_LCadm, avvia SAP HANA:>HDB startNell'host principale come

SID_LCadm, testa lo stato riportato dallo script di hook:>cdtrace>awk '/ha_dr_SAPHanaSR.*crm_attribute/ { printf "%s %s %s %s\n",$2,$3,$5,$16 }' nameserver_*

Impostare i valori predefiniti del cluster

Configura le soglie di migrazione e l'aderenza per determinare il numero di passaggi di failover da tentare prima del fallimento e per impostare il sistema in modo che provi prima a riavviare sull'host corrente. Questo valore deve essere impostato su un solo nodo per essere applicato al cluster.

Come utente root su uno degli host, avvia il cluster:

#pcs cluster start --all #start the clusterImposta i valori predefiniti della risorsa:

#pcs resource defaults resource-stickiness=1000#pcs resource defaults migration-threshold=5000La proprietà

resource-stickinesscontrolla la probabilità che un servizio rimanga in esecuzione dove si trova. I valori più elevati rendono il servizio più stabile. Un valore1000indica che il servizio è molto stabile.La proprietà

migration-thresholdspecifica il numero di errori che devono verificarsi prima che un servizio venga eseguito in un altro host. Un valore di 5000 è sufficientemente elevato da impedire il failover per situazioni di errore di durata più breve.Puoi controllare i valori predefiniti della risorsa inserendo

pcs resource defaults.Imposta i valori predefiniti per il timeout dell'operazione della risorsa:

#pcs resource op defaults timeout=600sPuoi controllare i valori predefiniti delle operazioni sulle risorse inserendo

pcs resource op defaults.Imposta le seguenti proprietà del cluster:

#pcs property set stonith-enabled="true"#pcs property set stonith-timeout="300s"Puoi controllare le impostazioni della tua proprietà con

pcs property list.

Crea la risorsa SAPHanaTopology

La risorsa SAPHanaTopology recupera lo stato e la configurazione della replica del sistema HANA sui nodi. Controlla anche l'agente host SAP.

Come utente root su uno degli host, crea la risorsa

SAPHanaTopology:#pcs resource create topology_resource_name SAPHanaTopology SID=SID \ InstanceNumber=inst_num \ op start timeout=600 \ op stop timeout=300 \ op monitor interval=10 timeout=600 \ clone clone-max=2 clone-node-max=1 interleave=trueDopo aver creato la risorsa, controlla la configurazione. Aggiungi

-cloneal nome della risorsa per includere le informazioni del set di cloni nella risposta:RHEL 8 e versioni successive

#pcs resource config topology_resource_name-cloneRHEL 7

#pcs resource show topology_resource_name-cloneDovresti vedere un output simile al seguente:

Clone: SAPHanaTopology_HA1_22-clone Meta Attrs: clone-max=2 clone-node-max=1 interleave=true Resource: SAPHanaTopology_HA1_22 (class=ocf provider=heartbeat type=SAPHanaTopology) Attributes: InstanceNumber=22 SID=HA1 Operations: methods interval=0s timeout=5 (SAPHanaTopology_HA1_22-methods-interval-0s) monitor interval=10 timeout=600 (SAPHanaTopology_HA1_22-monitor-interval-10) reload interval=0s timeout=5 (SAPHanaTopology_HA1_22-reload-interval-0s) start interval=0s timeout=600 (SAPHanaTopology_HA1_22-start-interval-0s) stop interval=0s timeout=300 (SAPHanaTopology_HA1_22-stop-interval-0s)

Puoi anche controllare gli attributi del cluster utilizzando il comando crm_mon -A1.

Crea la risorsa SAPHana

L'agente di risorse SAPHana gestisce i database configurati per la replica del sistema SAP HANA.

I seguenti parametri nella definizione della risorsa SAPHana sono facoltativi:

AUTOMATED_REGISTER, che, se impostato sutrue, registra automaticamente l'attributo precedente come secondario quando il valore DUPLICATE_PRIMARY_TIMEOUT scade dopo un'acquisizione. Il valore predefinito èfalse.Per un cluster SAP HANA HA multilivello, se utilizzi una versione precedente a SAP HANA 2.0 SP03, imposta

AUTOMATED_REGISTERsufalse. In questo modo, un'istanza recuperata non tenterà di registrarsi autonomamente per la replica a un sistema HANA che ha già un target di replica configurato. Per SAP HANA 2.0 SP03 o versioni successive, puoi impostareAUTOMATED_REGISTERsutrueper le configurazioni SAP HANA che utilizzano la replica di sistema a più livelli.DUPLICATE_PRIMARY_TIMEOUT, che imposta la differenza di tempo in secondi tra due timestamp principali se si verifica una situazione di doppio timestamp principale. Il valore predefinito è7200.PREFER_SITE_TAKEOVER, che determina se vengono tentati i riavvii locali prima dell'avvio del failover. Il valore predefinito èfalse.

Per ulteriori informazioni su questi parametri, consulta Installare e configurare un cluster ad alta disponibilità Red Hat Enterprise Linux 7.6 (e versioni successive) su Google Cloud. È necessario un abbonamento Red Hat.

Come utente root su uno degli host, crea la risorsa SAP HANA:

RHEL 8 e versioni successive

#pcs resource create sap_hana_resource_name SAPHana SID=SID \ InstanceNumber=inst_num \ PREFER_SITE_TAKEOVER=true DUPLICATE_PRIMARY_TIMEOUT=7200 AUTOMATED_REGISTER=true \ op start timeout=3600 \ op stop timeout=3600 \ op monitor interval=61 role="Slave" timeout=700 \ op monitor interval=59 role="Master" timeout=700 \ op promote timeout=3600 \ op demote timeout=3600 \ promotable meta notify=true clone-max=2 clone-node-max=1 interleave=trueRHEL 7

#pcs resource create sap_hana_resource_name SAPHana SID=SID \ InstanceNumber=inst_num \ PREFER_SITE_TAKEOVER=true DUPLICATE_PRIMARY_TIMEOUT=7200 AUTOMATED_REGISTER=true \ op start timeout=3600 \ op stop timeout=3600 \ op monitor interval=61 role="Slave" timeout=700 \ op monitor interval=59 role="Master" timeout=700 \ op promote timeout=3600 \ op demote timeout=3600 \ master meta notify=true clone-max=2 clone-node-max=1 interleave=trueControlla gli attributi della risorsa risultanti:

RHEL 8 e versioni successive

#pcs resource config sap_hana_resource_nameRHEL 7

#pcs resource show sap_hana_resource_nameDovresti vedere un output simile al seguente esempio:

Resource: SAPHana_HA1_22 (class=ocf provider=heartbeat type=SAPHana) Attributes: AUTOMATED_REGISTER=true DUPLICATE_PRIMARY_TIMEOUT=7200 InstanceNumber=22 PREFER_SITE_TAKEOVER=true SID=HA1 Meta Attrs: clone-max=2 clone-node-max=1 interleave=true notify=true Operations: demote interval=0s timeout=3600 (SAPHana_HA1_22-demote-interval-0s) methods interval=0s timeout=5 (SAPHana_HA1_22-methods-interval-0s) monitor interval=61 role=Slave timeout=700 (SAPHana_HA1_22-monitor-interval-61) monitor interval=59 role=Master timeout=700 (SAPHana_HA1_22-monitor-interval-59) promote interval=0s timeout=3600 (SAPHana_HA1_22-promote-interval-0s) reload interval=0s timeout=5 (SAPHana_HA1_22-reload-interval-0s) start interval=0s timeout=3600 (SAPHana_HA1_22-start-interval-0s) stop interval=0s timeout=3600 (SAPHana_HA1_22-stop-interval-0s)Dopo aver avviato la risorsa, controlla gli attributi dei nodi per visualizzare lo stato corrente dei database SAP HANA sui nodi:

#crm_mon -A1Dovresti vedere un output simile al seguente: