本指南介绍如何为 SAP NetWeaver 系统部署和配置针对性能优化的 SUSE Linux Enterprise Server (SLES) 高可用性 (HA) 集群。

本指南包含以下步骤:- 配置内部直通式网络负载均衡器以在发生故障时重新路由流量。

- 在 SLES 上配置 Pacemaker 集群,以在故障切换期间管理 SAP 系统和其他资源。 还为 SLES 15 for SAP 及更高版本提供了简单装载配置。

本指南还包括配置 SAP NetWeaver 系统以实现高可用性的步骤,但请参阅 SAP 文档来了解权威说明。

如需了解如何为 SAP NetWeaver 部署 Compute Engine 虚拟机,请参阅您的操作系统对应的 SAP NetWeaver 部署指南。

如需为 Red Hat Enterprise Linux (RHEL) 上的 SAP HANA 配置高可用性集群,请参阅 RHEL 上的 SAP NetWeaver 的高可用性集群手动配置指南。

本指南适用于熟悉 SAP NetWeaver 的 Linux 高可用性配置的 SAP NetWeaver 高级用户。

本指南部署的系统

按照本指南,您将部署两个 SAP NetWeaver 实例并在 SLES 上设置高可用性集群。您需要在同一区域内不同可用区中的 Compute Engine 虚拟机上部署每个 SAP NetWeaver 实例。本指南未介绍底层数据库的高可用性安装。

部署的集群包括以下功能和特性:

- 两个主机虚拟机,一个用于活跃 ASCS 实例,另一个用于 ENSA2 Enqueue Replicator 或 ENSA1 Enqueue Replication Server (ENSA1) 的活跃实例。ENSA2 和 ENSA1 实例均称为 ERS。

- Pacemaker 高可用性集群资源管理器。

- STONITH 防护机制。

- 自动重启失败的实例,将其用作新的辅助实例。

如需使用 Terraform 自动部署 SAP NetWeaver 高可用性系统,请参阅 Terraform:SLES 上的 SAP NetWeaver 的高可用性集群配置指南。

前提条件

在创建 SAP NetWeaver 高可用性集群之前,请确保满足以下前提条件:

- 您已阅读 SAP NetWeaver 规划指南和适用于 SAP NetWeaver on Google Cloud的高可用性规划指南。

- 您或您的组织已有一个 Google Cloud 账号,并且您已为 SAP NetWeaver 部署创建了一个项目。如需了解如何创建Google Cloud 账号和项目,请参阅《适用于 Linux 的 SAP NetWeaver 部署指南》中的创建项目。

- 如果您需要 SAP 工作负载根据数据驻留、访问权限控制、支持人员或监管要求运行,则必须创建所需的 Assured Workloads 文件夹。如需了解详情,请参阅 SAP on Google Cloud的合规性和主权控制。

如果您使用的是 VPC 内部 DNS,则项目元数据中

vmDnsSetting变量的值必须为GlobalOnly或ZonalPreferred,才能支持跨可用区解析节点名称。vmDnsSetting的默认设置为ZonalOnly。如需了解详情,请参阅以下主题:您已使用 NFS 共享文件存储解决方案(如 Filestore Enterprise)设置了文件共享。

如果在项目元数据中启用了 OS Login,则需要暂时停用 OS Login,直到部署完成。出于部署目的,此过程会在实例元数据中配置 SSH 密钥。启用 OS Login 后,基于元数据的 SSH 密钥配置会停用,并且此部署将失败。部署完成后,您可以再次启用 OS Login。

如需了解详情,请参阅以下主题:

SUSE 提供的相关信息

除非 Google Cloud 环境另有要求,否则本指南中的信息与 SUSE 提供的以下相关指南一致:

- SAP NetWeaver Enqueue Replication 1 高可用性集群 - SAP NetWeaver 7.40 和 7.50 设置指南 | SUSE Linux Enterprise Server for SAP Applications 12

- SAP NetWeaver Enqueue Replication 1 高可用性集群 - SAP NetWeaver 7.40 和 7.50 设置指南 | SUSE Linux Enterprise Server for SAP Applications 15

- SAP S/4 HANA - Enqueue Replication 2 高可用性集群 - 设置指南 | SUSE Linux Enterprise Server for SAP Applications 12

- SAP S/4 HANA - Enqueue Replication 2 高可用性集群 - 设置指南 | SUSE Linux Enterprise Server for SAP Applications 15

创建网络

出于安全考虑,建议您创建一个新的网络。您可以通过添加防火墙规则或使用其他访问权限控制方法来控制哪些人有权访问该网络。

如果您的项目具有默认 VPC 网络,请勿使用。 请创建自己的 VPC 网络,以保证只有您明确创建的防火墙规则在起作用。

在部署期间,Compute Engine 实例通常需要访问互联网来下载 Google Cloud的 Agent for SAP。如果您使用的是由 Google Cloud提供的某个经 SAP 认证的 Linux 映像,那么计算实例还需要访问互联网来注册许可以及访问操作系统供应商仓库。具有 NAT 网关和虚拟机网络标记的配置支持这种访问,即使目标计算实例没有外部 IP 地址也是如此。

如需设置网络,请执行以下操作:

控制台

- 在 Google Cloud 控制台中,前往 VPC 网络页面。

- 点击创建 VPC 网络。

- 输入网络的名称。

名称必须遵循命名惯例。VPC 网络使用 Compute Engine 命名惯例。

- 对于子网创建模式,选择自定义。

- 在新子网部分,为子网指定以下配置参数:

- 输入子网的名称。

- 对于区域,请选择您要在其中创建子网的 Compute Engine 区域。

- 对于 IP 栈类型,请选择 IPv4(单栈),然后输入 CIDR 格式的 IP 地址范围,例如

10.1.0.0/24。这是子网的主要 IPv4 地址范围。如果您计划添加多个子网,请为网络中的每个子网分配互不重叠的 CIDR IP 地址范围。请注意,每个子网及其内部 IP 地址范围都映射到一个区域。

- 点击完成。

- 如需添加更多子网,请点击添加子网,然后重复上述步骤。您可以在创建网络后向网络添加更多子网。

- 点击创建。

gcloud

- 转至 Cloud Shell。

- 如需在自定义子网模式下创建新网络,请运行以下命令:

gcloud compute networks create NETWORK_NAME --subnet-mode custom

将

NETWORK_NAME替换为新网络的名称。名称必须遵循命名惯例。VPC 网络使用 Compute Engine 命名惯例。指定

--subnet-mode custom可避免使用默认的自动模式,该模式会自动在每个 Compute Engine 区域创建一个子网。如需了解详情,请参阅子网创建模式。 - 创建一个子网,并指定区域和 IP 地址范围:

gcloud compute networks subnets create SUBNETWORK_NAME \ --network NETWORK_NAME --region REGION --range RANGE替换以下内容:

SUBNETWORK_NAME:新子网的名称NETWORK_NAME:您在上一步中创建的网络的名称REGION:该子网所在的区域RANGE:以 CIDR 格式指定的 IP 地址范围,例如10.1.0.0/24如果您计划添加多个子网,请为网络中的每个子网分配互不重叠的 CIDR IP 地址范围。请注意,每个子网及其内部 IP 地址范围均映射到一个区域。

- (可选)重复上述步骤并添加更多子网。

设置 NAT 网关

如果您需要创建一个或多个没有公共 IP 地址的虚拟机,则需要使用网络地址转换 (NAT) 以使虚拟机能够访问互联网。使用 Cloud NAT,这是 Google Cloud 提供的一项软件定义的托管式服务,可让虚拟机将出站数据包发送到互联网,并接收任何对应的已建立入站响应数据包。或者,您可以将单独的虚拟机设置为 NAT 网关。

如需为项目创建 Cloud NAT 实例,请参阅使用 Cloud NAT。

为项目配置 Cloud NAT 后,虚拟机实例可以在没有公共 IP 地址的情况下安全地访问互联网。

添加防火墙规则

默认情况下,系统会屏蔽从 Google Cloud 网络外部传入的连接。如需允许传入的连接,请为您的虚拟机设置防火墙规则。 这些防火墙规则仅适用于新传入虚拟机的连接。在与虚拟机建立连接后,防火墙会允许通过此连接的双向流量。

通过创建防火墙规则,您可以允许对指定端口进行访问,也可以允许同一子网中各虚拟机之间互相访问。

如要允许以下访问,请创建防火墙规则:

- 访问 SAP NetWeaver 使用的默认端口,具体请参阅所有 SAP 产品的 TCP/IP 端口。

- 从您的计算机或公司网络环境连接到 Compute Engine 虚拟机实例。如果您不确定使用哪个 IP 地址,请与您公司的网络管理员联系。

- 3 层式、横向扩缩或高可用性配置中的虚拟机之间的通信。例如,如果您要部署 3 层式系统,则子网中应至少有 2 个虚拟机:一个用于 SAP NetWeaver,另一个用于数据库服务器。为使两个虚拟机之间得以相互通信,您必须创建防火墙规则以允许来自子网的流量。

- Cloud Load Balancing 健康检查。 如需了解详情,请参阅为健康检查创建防火墙规则。

如需创建防火墙规则,请执行以下操作:

在 Google Cloud 控制台中,前往 VPC 网络防火墙页面。

点击页面顶部的创建防火墙规则。

- 在网络字段中,选择您的虚拟机所在的网络。

- 在目标字段中,选择网络中的所有实例。

- 在来源过滤条件字段中,选择下列选项之一:

- IP 地址范围:用于允许从特定 IP 地址传入的流量。 请在来源 IP 地址范围字段中指定相应 IP 地址范围。

- 子网:用于允许从特定子网传入的流量。请在下面的子网字段中指定相应子网名称。此选项可用于允许 3 层式或横向扩缩式配置中的各虚拟机之间互相访问。

- 在协议和端口部分,选择指定的协议和端口并指定

tcp:PORT_NUMBER;。

点击创建以创建防火墙规则。

为 SAP NetWeaver 部署虚拟机

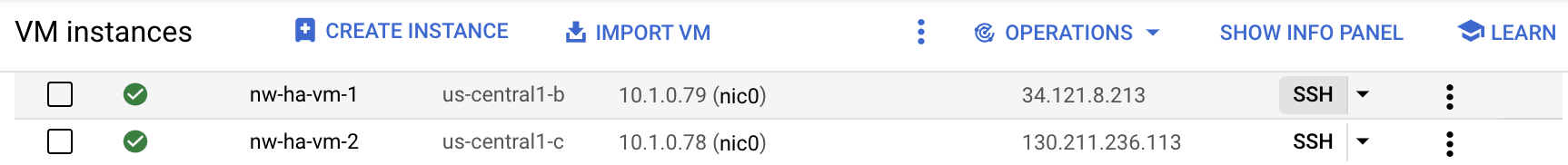

在开始配置高可用性集群之前,您需要定义和部署将充当高可用性集群中的主节点和辅助节点的虚拟机实例。

要定义和部署虚拟机,请使用您在自动部署在 Linux 上运行 SAP NetWeaver 的虚拟机中为 SAP NetWeaver 系统部署虚拟机时使用的相同 Cloud Deployment Manager 模板。

但是,为了部署两个虚拟机而不是一个虚拟机,您需要通过复制和粘贴第一个虚拟机的定义来将第二个虚拟机的定义添加到配置文件中。创建第二个定义后,您需要更改第二个定义中的资源和实例名称。为了防止发生可用区故障,请在同一区域中指定另一个可用区。两个定义中的所有其他属性值均相同。

成功部署虚拟机后,您将安装 SAP NetWeaver 并定义和配置高可用性集群。

以下说明使用的是 Cloud Shell,但一般也适用于 Google Cloud CLI。

打开 Cloud Shell。

将 YAML 配置文件模板

template.yaml下载到您的工作目录:wget https://storage.googleapis.com/cloudsapdeploy/deploymentmanager/latest/dm-templates/sap_nw/template.yaml

(可选)重命名

template.yaml文件以标识其定义的配置。例如nw-ha-sles15sp3.yaml。点击 Cloud Shell 终端窗口右上角的铅笔 (edit) 图标启动编辑器,在 Cloud Shell 代码编辑器中打开 YAML 配置文件。

在 YAML 配置文件模板中,定义第一个虚拟机实例。在下表中,您需要在下一步中定义第二个虚拟机实例。

通过将英文括号及其内容替换为安装使用的值来指定属性值。下表介绍了这些属性。如需查看已完成的配置文件的示例,请参阅完整 YAML 配置文件的示例。

属性 数据类型 说明 name字符串 用于标识以下一组属性定义的部署资源的任意名称。 type字符串 指定要在部署期间使用的 Deployment Manager 模板的位置、类型和版本。

YAML 文件包含两个

type规范,其中一个被注释掉。默认处于活跃状态的type规范将模板版本指定为latest。注释掉的type规范使用时间戳指定特定模板版本。如果您需要所有部署都使用相同的模板版本,请使用包含时间戳的

type规范。instanceName字符串 您要定义的虚拟机实例的名称。请在主虚拟机定义和辅助虚拟机定义中指定不同的名称。请考虑使用将实例标识为属于同一高可用性集群的名称。 实例名称不得超过 13 个字符,并且只能包含小写字母、数字或连字符。请确保在您的项目范围内不重名。

instanceType字符串 您需要的 Compute Engine 虚拟机类型。为主虚拟机和辅助虚拟机指定相同的实例类型。 zone字符串 在其中部署您正在定义的虚拟机实例的 Google Cloud 可用区。请在同一区域中为主虚拟机定义和辅助虚拟机定义指定不同的可用区。可用区必须在您为子网选择的区域内。 subnetwork字符串 您在先前步骤中创建的子网的名称。如果您要部署到共享 VPC,请以 SHAREDVPC_PROJECT/SUBNETWORK的格式指定此值。例如myproject/network1。linuxImage字符串 与 SAP NetWeaver 结合使用的 Linux 操作系统映像或映像系列的名称。如需指定映像系列,请将前缀 family/添加到系列名称中,例如:family/sles-15-sp3-sap。如需查看可用映像系列的列表,请参阅 Google Cloud 控制台中的映像页面。linuxImageProject字符串 包含您要使用的映像的 Google Cloud 项目。此项目可以是您自己的项目,也可以是 Google Cloud 映像项目 suse-sap-cloud。 如需查看 Google Cloud 映像项目的列表,请参阅 Compute Engine 文档中的映像页面。usrsapSize整数 /usr/sap磁盘的大小。最小为 8 GB。swapSize整数 交换卷的大小。最小为 1 GB。 networkTag字符串 可选。一个或多个英文逗号分隔的网络标记,表示用于防火墙或路由的虚拟机实例。

对于高可用性配置,请指定允许集群节点之间通信的防火墙规则的网络标记,以及允许 Cloud Load Balancing 健康检查访问集群节点的防火墙规则的网络标记。

如果您指定

publicIP: No而不指定网络标记,请务必另外提供一种访问互联网的方法。serviceAccount字符串 可选。指定用于已部署虚拟机的自定义服务账号。该服务账号必须包含在部署 SAP 虚拟机期间需要的权限。

如果未指定

serviceAccount,则使用默认 Compute Engine 服务账号。指定完整的服务账号地址。例如

sap-ha-example@example-project-123456.publicIP布尔值 可选。决定是否为虚拟机实例添加一个公共 IP 地址。默认为 Yes。sap_deployment_debug布尔值 可选。如果此值设置为 Yes,则部署将生成详细的部署日志。除非 Google 支持工程师要求您启用调试,否则请勿开启此设置。在 YAML 配置文件中,通过复制第一个虚拟机的定义并在第一个定义后粘贴副本,创建第二个虚拟机的定义。如需查看示例,请参阅完整 YAML 配置文件的示例。

在第二个虚拟机的定义中,为以下属性指定与第一个定义中的指定值不同的值:

nameinstanceNamezone

创建虚拟机实例:

gcloud deployment-manager deployments create DEPLOYMENT_NAME --config TEMPLATE_NAME.yaml

其中:

DEPLOYMENT_NAME表示您的部署的名称。TEMPLATE_NAME表示 YAML 配置文件的名称。

上述命令会调用 Deployment Manager,以根据 YAML 配置文件中的规范部署虚拟机。

部署处理包含两个阶段。在第一阶段,Deployment Manager 会将其状态写入控制台。 在第二阶段,部署脚本会将其状态写入 Cloud Logging。

完整的 YAML 配置文件示例

以下示例展示了一个已完成的 YAML 配置文件,该文件使用最新版本的 Deployment Manager 模板部署两个虚拟机实例,用于 SAP NetWeaver 的高可用性配置。该示例省略了首次下载模板时包含的注释。

该文件包含要部署的两个资源(sap_nw_node_1 和 sap_nw_node_2)的定义。每个资源定义都包含一个虚拟机的定义。

sap_nw_node_2 资源定义是通过以下方式创建的:复制并粘贴第一个定义,然后修改 name、instanceName、zone 属性的值。两个资源定义中的所有其他属性值都相同。

networkTag 和 serviceAccount 属性来自配置文件模板的“高级选项”部分。

resources:

- name: sap_nw_node_1

type: https://storage.googleapis.com/cloudsapdeploy/deploymentmanager/latest/dm-templates/sap_nw/sap_nw.py

properties:

instanceName: nw-ha-vm-1

instanceType: n2-standard-4

zone: us-central1-b

subnetwork: example-sub-network-sap

linuxImage: family/sles-15-sp3-sap

linuxImageProject: suse-sap-cloud

usrsapSize: 15

swapSize: 24

networkTag: cluster-ntwk-tag,allow-health-check

serviceAccount: limited-roles@example-project-123456.

- name: sap_nw_node_2

type: https://storage.googleapis.com/cloudsapdeploy/deploymentmanager/latest/dm-templates/sap_nw/sap_nw.py

properties:

instanceName: nw-ha-vm-2

instanceType: n2-standard-4

zone: us-central1-c

subnetwork: example-sub-network-sap

linuxImage: family/sles-15-sp3-sap

linuxImageProject: suse-sap-cloud

usrsapSize: 15

swapSize: 24

networkTag: cluster-ntwk-tag,allow-health-check

serviceAccount: limited-roles@example-project-123456.创建允许访问主机虚拟机的防火墙规则

请创建允许从以下来源访问每个主机虚拟机的防火墙规则(如果您尚未执行此操作):

- 您的本地工作站、堡垒主机或跳转服务器(用于配置用途)

- 高可用性集群中的其他主机虚拟机(用于集群节点之间的访问)

- Cloud Load Balancing 使用的健康检查,如下文的为健康检查创建防火墙规则步骤中所述。

创建 VPC 防火墙规则时,请指定您在 template.yaml 配置文件中定义的网络标记,以将您的主机虚拟机指定为规则的目标。

若要验证部署,请定义规则以允许在端口 22 上从堡垒主机或本地工作站进行 SSH 连接。

对于集群节点之间的访问,请添加防火墙规则,用于允许在任何端口上从同一子网中的其他虚拟机建立所有类型的连接。

在继续下一部分之前,请确保已创建用于验证部署的防火墙规则以及用于集群内通信的防火墙规则。如需了解相关说明,请参阅添加防火墙规则。

验证虚拟机的部署

在安装 SAP NetWeaver 或开始配置高可用性集群之前,请通过检查日志和操作系统存储映射来验证虚拟机已正确部署。

查看日志

在 Google Cloud 控制台中,打开 Cloud Logging 以监控安装进度并检查是否存在错误。

过滤日志:

日志浏览器

在日志浏览器页面中,转到查询窗格。

从资源下拉菜单中选择全局,然后点击添加。

如果您没有看到全局选项,请在查询编辑器中输入以下查询:

resource.type="global" "Deployment"点击运行查询。

旧式日志查看器

- 在旧版日志查看器页面中,从基本选择器菜单选择全局作为日志记录资源。

分析过滤后的日志:

- 如果显示

"--- Finished",则表示部署已完成处理,您可以继续执行下一步。 如果出现配额错误,请执行以下步骤:

对于任何不符合 SAP NetWeaver 规划指南中列出的 SAP NetWeaver 要求的配额,请在“IAM 和管理”的配额页面上提高配额。

在 Deployment Manager 的部署页面上,删除部署以清理失败安装中的虚拟机和永久性磁盘。

重新运行部署。

- 如果显示

检查虚拟机的配置

虚拟机实例部署完成之后,使用

ssh连接到虚拟机。显示文件系统:

~>df -h确保您看到类似如下所示的输出:

Filesystem Size Used Avail Use% Mounted on devtmpfs 32G 8.0K 32G 1% /dev tmpfs 48G 0 48G 0% /dev/shm tmpfs 32G 402M 32G 2% /run tmpfs 32G 0 32G 0% /sys/fs/cgroup /dev/sda3 30G 3.4G 27G 12% / /dev/sda2 20M 3.7M 17M 19% /boot/efi /dev/mapper/vg_usrsap-vol 15G 48M 15G 1% /usr/sap tmpfs 6.3G 0 6.3G 0% /run/user/1002 tmpfs 6.3G 0 6.3G 0% /run/user/0

确认已创建交换空间:

~>cat /proc/meminfo | grep Swap您会看到类似如下示例的结果:

SwapCached: 0 kB SwapTotal: 25161724 kB SwapFree: 25161724 kB

如果任一验证步骤显示安装失败,请执行以下步骤:

- 更正错误。

- 在部署页面上,删除该部署以从失败的安装中清除虚拟机和永久性磁盘。

- 重新运行部署。

更新 Google Cloud CLI

在部署期间,Deployment Manager 模板会在虚拟机上安装 Google Cloud CLI。更新 gcloud CLI,以确保其包含所有最新更新。

通过 SSH 连接到主虚拟机。

更新 gcloud CLI:

~>sudo gcloud components update请按照提示操作。

在辅助虚拟机上重复上述步骤。

启用虚拟机之间的负载均衡器后端通信

确认虚拟机已成功部署后,启用将充当高可用性集群中的节点的虚拟机之间的后端通信。

您可以通过修改 google-guest-agent(包含在 Google Cloud提供的所有 Linux 公共映像的 Linux 访客环境中)的配置来启用虚拟机之间的后端通信。

如需启用负载均衡器后端通信,请在集群中的每个虚拟机上执行以下步骤:

停止代理:

sudo service google-guest-agent stop

打开或创建

/etc/default/instance_configs.cfg文件进行修改。例如:sudo vi /etc/default/instance_configs.cfg

在

/etc/default/instance_configs.cfg文件中,指定以下配置属性,如下所示。如果这些部分不存在,请创建它们。尤其要确保target_instance_ips和ip_forwarding属性设置为false:[IpForwarding] ethernet_proto_id = 66 ip_aliases = true target_instance_ips = false [NetworkInterfaces] dhclient_script = /sbin/google-dhclient-script dhcp_command = ip_forwarding = false setup = true

启动访客代理服务:

sudo service google-guest-agent start

负载均衡器健康检查配置需要健康检查监听目标端口以及为接口分配虚拟 IP 地址。如需了解详情,请参阅测试负载均衡器配置。

在主虚拟机和辅助虚拟机上配置 SSH 密钥

为了允许在高可用性集群中的主机之间复制文件,本部分中的步骤在这两个主机之间创建根 SSH 连接。

Google Cloud提供的 Deployment Manager 模板会为您生成密钥,但您也可以根据需要将其替换为您生成的密钥。

您的组织可能有内部网络通信管理规范。必要时,在部署完成后,您可以从虚拟机中移除元数据,并从 authorized_keys 目录中移除密钥。

如果设置直接 SSH 连接不符合您组织的规范,您可以使用其他方法传输文件,例如:

- 使用 Cloud Shell 上传文件和下载文件菜单选项通过本地工作站传输较小的文件。请参阅使用 Cloud Shell 管理文件。

- 使用 Cloud Storage 存储桶交换文件。请参阅上传和下载。

- 使用 Filestore 或 Google Cloud NetApp Volumes 等文件存储解决方案来创建共享文件夹。请参阅文件共享解决方案。

如需在主实例和辅助实例之间启用 SSH 连接,请按照以下步骤操作。这些步骤假定您使用 SAP 的 Deployment Manager 模板生成的 SSH 密钥。

在主要主机虚拟机上:

通过 SSH 连接到虚拟机。

切换到根用户:

$sudo su -确认 SSH 密钥存在:

#ls -l /root/.ssh/您应该会看到 id_rsa 密钥文件,如以下示例所示:

-rw-r--r-- 1 root root 569 May 4 23:07 authorized_keys -rw------- 1 root root 2459 May 4 23:07 id_rsa -rw-r--r-- 1 root root 569 May 4 23:07 id_rsa.pub

使用辅助虚拟机的 SSH 密钥相关信息更新主虚拟机的元数据。

#gcloud compute instances add-metadata SECONDARY_VM_NAME \ --metadata "ssh-keys=$(whoami):$(cat ~/.ssh/id_rsa.pub)" \ --zone SECONDARY_VM_ZONE通过打开主系统到辅助系统之间的 SSH 连接,确认 SSH 密钥已正确设置:

#ssh SECONDARY_VM_NAME

在辅助主机虚拟机上:

通过 SSH 连接到虚拟机。

切换到根用户:

$sudo su -确认 SSH 密钥存在:

#ls -l /root/.ssh/您应该会看到 id_rsa 密钥文件,如以下示例所示:

-rw-r--r-- 1 root root 569 May 4 23:07 authorized_keys -rw------- 1 root root 2459 May 4 23:07 id_rsa -rw-r--r-- 1 root root 569 May 4 23:07 id_rsa.pub

使用主虚拟机的 SSH 密钥相关信息更新辅助虚拟机的元数据。

#gcloud compute instances add-metadata PRIMARY_VM_NAME \ --metadata "ssh-keys=$(whoami):$(cat ~/.ssh/id_rsa.pub)" \ --zone PRIMARY_VM_ZONE#cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys通过打开辅助系统到主系统之间的 SSH 连接,确认 SSH 密钥已正确设置。

#ssh PRIMARY_VM_NAME

设置共享文件存储并配置共享目录

您需要设置一个 NFS 文件共享解决方案,以提供高可用性集群的两个节点均可访问的高可用共享文件存储。然后,在这两个映射到共享文件存储的节点上创建目录。集群软件可确保正确的目录仅装载在正确的实例上。

本指南不介绍如何设置文件共享解决方案。如需了解如何设置文件共享系统,请参阅所选解决方案的供应商提供的说明。如果您选择将 Filestore 用于文件共享解决方案,我们建议您使用 Filestore 的企业层级。如需了解如何创建 Filestore 实例,请参阅创建实例。

如需了解Google Cloud上提供的文件共享解决方案,请参阅 Google Cloud上高可用性 SAP 系统的共享存储选项。

要配置共享目录,请执行以下操作:

如果您尚未设置高可用性 NFS 共享文件存储解决方案,请立即设置。

在两个服务器上装载 NFS 共享存储空间以进行初始配置。

~>sudo mkdir /mnt/nfs~>sudo mount -t nfs NFS_PATH /mnt/nfs将

NFS_PATH替换为 NFS 文件共享解决方案的路径。例如10.49.153.26:/nfs_share_nw_ha。在任一服务器中,为

sapmnt、中央传输目录和实例专用目录创建目录。如果您使用的是 Java 堆栈,请在使用以下命令以及任何其他命令之前,将“ASCS”替换为“SCS”:~>sudo mkdir /mnt/nfs/sapmntSID~>sudo mkdir /mnt/nfs/usrsap{trans,SIDASCSASCS_INSTANCE_NUMBER,SIDERSERS_INSTANCE_NUMBER}如果您使用的是简单装载设置,请改为运行以下命令:

~>sudo mkdir /mnt/nfs/sapmntSID~>sudo mkdir /mnt/nfs/usrsap{trans,SID}替换以下内容:

SID:SAP 系统 ID (SID)。所有字母均大写。例如AHA。ASCS_INSTANCE_NUMBER:ASCS 系统的实例编号。例如00。ERS_INSTANCE_NUMBER:ERS 系统的实例编号。例如10。

在两个服务器上,创建必要的装载点:

~>sudo mkdir -p /sapmnt/SID~>sudo mkdir -p /usr/sap/trans~>sudo mkdir -p /usr/sap/SID/ASCSASCS_INSTANCE_NUMBER~>sudo mkdir -p /usr/sap/SID/ERSERS_INSTANCE_NUMBER如果您使用的是简单装载设置,请改为运行以下命令:

~>sudo mkdir -p /sapmnt/SID~>sudo mkdir -p /usr/sap/trans~>sudo mkdir -p /usr/sap/SID配置

autofs,以便在首次访问文件目录时装载通用的共享文件目录。ASCSASCS_INSTANCE_NUMBER和ERSERS_INSTANCE_NUMBER目录的装载由集群软件管理,您将在后续步骤中配置该软件。根据需要为文件共享解决方案调整命令中的 NFS 选项。

在两个服务器上配置

autofs:~>echo "/- /etc/auto.sap" | sudo tee -a /etc/auto.master~>NFS_OPTS="-rw,relatime,vers=3,hard,proto=tcp,timeo=600,retrans=2,mountvers=3,mountport=2050,mountproto=tcp"~>echo "/sapmnt/SID ${NFS_OPTS} NFS_PATH/sapmntSID" | sudo tee -a /etc/auto.sap~>echo "/usr/sap/trans ${NFS_OPTS} NFS_PATH/usrsaptrans" | sudo tee -a /etc/auto.sap如需详细了解

autofs,请参阅 autofs - 工作原理。如果您使用的是简单装载设置,请改为运行以下命令:

~>echo "/- /etc/auto.sap" | sudo tee -a /etc/auto.master~>NFS_OPTS="-rw,relatime,vers=3,hard,proto=tcp,timeo=600,retrans=2,mountvers=3,mountport=2050,mountproto=tcp"~>echo "/sapmnt/SID ${NFS_OPTS}/sapmnt" | sudo tee -a /etc/auto.sap~>echo "/usr/sap/trans ${NFS_OPTS}/usrsaptrans" | sudo tee -a /etc/auto.sap~>echo "/usr/sap/SID ${NFS_OPTS}/usrsapSID" | sudo tee -a /etc/auto.sap在两个服务器上启动

autofs服务:~>sudo systemctl enable autofs~>sudo systemctl restart autofs~>sudo automount -v触发

autofs,以通过使用cd命令访问每个目录来装载共享目录。例如:~>cd /sapmnt/SID~>cd /usr/sap/trans如果您使用的是简单装载设置,请改为运行以下命令:

~>cd /sapmnt/SID~>cd /usr/sap/trans~>cd /usr/sap/SID访问所有目录后,发出

df -Th命令以确认目录已装载。~>df -Th | grep FILE_SHARE_NAME将

FILE_SHARE_NAME替换为您的 NFS 文件共享解决方案的名称。例如nfs_share_nw_ha。您会看到类似如下所示的装载点和目录:

10.49.153.26:/nfs_share_nw_ha nfs 1007G 76M 956G 1% /mnt/nfs 10.49.153.26:/nfs_share_nw_ha/usrsaptrans nfs 1007G 76M 956G 1% /usr/sap/trans 10.49.153.26:/nfs_share_nw_ha/sapmntAHA nfs 1007G 76M 956G 1% /sapmnt/AHA

如果您使用的是简单装载设置,则会看到类似于以下示例的装载点和目录:

10.49.153.26:/nfs_share_nw_ha nfs 1007G 76M 956G 1% /mnt/nfs 10.49.153.26:/nfs_share_nw_ha/usrsaptrans nfs 1007G 76M 956G 1% /usr/sap/trans 10.49.153.26:/nfs_share_nw_ha/sapmntAHA nfs 1007G 76M 956G 1% /sapmnt/AHA 10.49.153.26:/nfs_share_nw_ha/usrsapAHA nfs 1007G 76M 956G 1% /usr/sap/AHA

配置 Cloud Load Balancing 故障切换支持

具有故障切换支持的内部直通式网络负载均衡器服务会将 ASCS 和 ERS 流量路由到 SAP NetWeaver 集群中各自的活跃实例。内部直通式网络负载均衡器使用虚拟 IP (VIP) 地址、后端服务、实例组和健康检查来相应地路由流量。

为虚拟 IP 地址预留 IP 地址

对于 SAP NetWeaver 高可用性集群,您将创建两个 VIP 地址(有时称为“浮动” IP 地址)。一个 VIP 用于活动的 SAP 中央服务 (SCS) 实例,另一个用于 Enqueue Replication Server (ERS) 实例。负载均衡器会将发送到每个 VIP 地址的流量路由到当前正在托管 VIP 地址的 ASCS 或 ERS 组件的活跃实例的虚拟机。

打开 Cloud Shell:

为 ASCS 的虚拟 IP 地址和 ERS 的 VIP 地址预留 IP 地址。对于 ASCS,该 IP 地址是应用用于访问 SAP NetWeaver 的 IP 地址。对于 ERS,该 IP 地址是用于排队服务器复制的 IP 地址。如果您省略

--addresses标志,系统会为您选择指定子网中的 IP 地址:~gcloud compute addresses create ASCS_VIP_NAME \ --region CLUSTER_REGION --subnet CLUSTER_SUBNET \ --addresses ASCS_VIP_ADDRESS~gcloud compute addresses create ERS_VIP_NAME \ --region CLUSTER_REGION --subnet CLUSTER_SUBNET \ --addresses ERS_VIP_ADDRESS替换以下内容:

ASCS_VIP_NAME:指定 ASCS 实例的虚拟 IP 地址的名称。例如:ascs-aha-vip。CLUSTER_REGION:指定集群所在的 Google Cloud 区域。 例如:us-central1CLUSTER_SUBNET:指定用于集群的子网。例如:example-sub-network-sap。ASCS_VIP_ADDRESS:(可选)以 CIDR 表示法为 ASCS 虚拟 IP 地址指定 IP 地址。例如:10.1.0.2。ERS_VIP_NAME:指定 ERS 实例的虚拟 IP 地址的名称。例如:ers-aha-vip。ERS_VIP_ADDRESS:(可选)以 CIDR 表示法为 ERS 虚拟 IP 地址指定 IP 地址。例如:10.1.0.4。

如需详细了解如何预留静态 IP 地址,请参阅预留静态内部 IP 地址。

确认 IP 地址预留:

~gcloud compute addresses describe VIP_NAME \ --region CLUSTER_REGION您应该会看到类似于以下示例的输出:

address: 10.1.0.2 addressType: INTERNAL creationTimestamp: '2022-04-04T15:04:25.872-07:00' description: '' id: '555067171183973766' kind: compute#address name: ascs-aha-vip networkTier: PREMIUM purpose: GCE_ENDPOINT region: https://www.googleapis.com/compute/v1/projects/example-project-123456/regions/us-central1 selfLink: https://www.googleapis.com/compute/v1/projects/example-project-123456/regions/us-central1/addresses/ascs-aha-vip status: RESERVED subnetwork: https://www.googleapis.com/compute/v1/projects/example-project-123456/regions/us-central1/subnetworks/example-sub-network-sap

在 /etc/hosts 中为 VIP 地址定义主机名

为每个 VIP 地址定义主机名,然后将虚拟机和 VIP 的 IP 地址和主机名添加到每个虚拟机上的 /etc/hosts 文件。

虚拟机外部不知道 VIP 主机名,除非您也将其添加到 DNS 服务。将这些条目添加到本地 /etc/hosts 文件可保护集群免受 DNS 服务中断的影响。

对 /etc/hosts 文件的更新应与以下示例类似:

127.0.0.1 localhost localhost.localdomain localhost4 localhost4.localdomain4 ::1 localhost localhost.localdomain localhost6 localhost6.localdomain6 10.1.0.113 nw-ha-vm-2.us-central1-c.c.example-project-123456.internal nw-ha-vm-2 10.1.0.2 ascs-aha-vip 10.1.0.4 ers-aha-vip 10.1.0.114 nw-ha-vm-1.us-central1-b.c.example-project-123456.internal nw-ha-vm-1 # Added by Google 169.254.169.254 metadata.google.internal # Added by Google

创建 Cloud Load Balancing 健康检查

创建健康检查:一个用于活跃的 ASCS 实例,另一个用于活跃的 ERS。

在 Cloud Shell 中,创建健康检查。为避免与其他服务发生冲突,请在专用范围 (49152-65535) 中为 ASCS 和 ERS 实例指定端口号。以下命令中的检查间隔和超时值略大于默认值,其目的是为了在 Compute Engine 实时迁移事件期间提高故障切换容忍度。您可以根据需要调整这些值:

~gcloud compute health-checks create tcp ASCS_HEALTH_CHECK_NAME \ --port=ASCS_HEALTHCHECK_PORT_NUM --proxy-header=NONE --check-interval=10 --timeout=10 \ --unhealthy-threshold=2 --healthy-threshold=2~gcloud compute health-checks create tcp ERS_HEALTH_CHECK_NAME \ --port=ERS_HEALTHCHECK_PORT_NUM --proxy-header=NONE --check-interval=10 --timeout=10 \ --unhealthy-threshold=2 --healthy-threshold=2

确认每个健康检查均已创建:

~gcloud compute health-checks describe HEALTH_CHECK_NAME您应该会看到类似于以下示例的输出:

checkIntervalSec: 10 creationTimestamp: '2021-05-12T15:12:21.892-07:00' healthyThreshold: 2 id: '1981070199800065066' kind: compute#healthCheck name: ascs-aha-health-check-name selfLink: https://www.googleapis.com/compute/v1/projects/example-project-123456/global/healthChecks/scs-aha-health-check-name tcpHealthCheck: port: 60000 portSpecification: USE_FIXED_PORT proxyHeader: NONE timeoutSec: 10 type: TCP unhealthyThreshold: 2

为健康检查创建防火墙规则

请为专用范围内的端口定义防火墙规则,以允许从 Cloud Load Balancing 健康检查使用的 IP 地址范围(35.191.0.0/16 和 130.211.0.0/22)访问您的主机虚拟机(如果您尚未这样做)。如需详细了解负载均衡器的防火墙规则,请参阅为健康检查创建防火墙规则。

如果您还没有为主机虚拟机添加网络标记,请先添加。此网络标记由防火墙规则用于健康检查。

~gcloud compute instances add-tags PRIMARY_VM_NAME \ --zone=PRIMARY_ZONE \ --tags NETWORK_TAGS~gcloud compute instances add-tags SECONDARY_VM_NAME \ --zone=SECONDARY_ZONE \ --tags NETWORK_TAGS

创建使用网络标记的防火墙规则以允许健康检查:

~gcloud compute firewall-rules create RULE_NAME \ --network=NETWORK_NAME \ --action=ALLOW \ --direction=INGRESS \ --source-ranges=35.191.0.0/16,130.211.0.0/22 \ --target-tags=NETWORK_TAGS \ --rules=tcp:ASCS_HEALTHCHECK_PORT_NUM,tcp:ERS_HEALTHCHECK_PORT_NUM例如:

gcloud compute firewall-rules create nw-ha-cluster-health-checks \ --network=example-network \ --action=ALLOW \ --direction=INGRESS \ --source-ranges=35.191.0.0/16,130.211.0.0/22 \ --target-tags=allow-health-check \ --rules=tcp:60000,tcp:60010

创建 Compute Engine 实例组

您需要在包含集群节点虚拟机的每个可用区中创建一个实例组,并将该可用区中的虚拟机添加到实例组中。

在 Cloud Shell 中,创建主实例组并向其添加主虚拟机:

~gcloud compute instance-groups unmanaged create PRIMARY_IG_NAME \ --zone=PRIMARY_ZONE~gcloud compute instance-groups unmanaged add-instances PRIMARY_IG_NAME \ --zone=PRIMARY_ZONE \ --instances=PRIMARY_VM_NAME

在 Cloud Shell 中,创建辅助实例组并向其添加辅助虚拟机:

~gcloud compute instance-groups unmanaged create SECONDARY_IG_NAME \ --zone=SECONDARY_ZONE~gcloud compute instance-groups unmanaged add-instances SECONDARY_IG_NAME \ --zone=SECONDARY_ZONE \ --instances=SECONDARY_VM_NAME

确认已创建实例组:

~gcloud compute instance-groups unmanaged list您应该会看到类似于以下示例的输出:

NAME ZONE NETWORK NETWORK_PROJECT MANAGED INSTANCES sap-aha-primary-instance-group us-central1-b example-network-sap example-project-123456 No 1 sap-aha-secondary-instance-group us-central1-c example-network-sap example-project-123456 No 1

配置后端服务

创建两个后端服务,一个用于 ASCS,另一个用于 ERS。将两个实例组添加到每个后端服务,并将相反的实例组指定为每个后端服务中的故障切换实例组。最后,创建从 VIP 地址到后端服务的转发规则。

在 Cloud Shell 中,为 ASCS 创建后端服务和故障切换组:

为 ASCS 创建后端服务:

~gcloud compute backend-services create ASCS_BACKEND_SERVICE_NAME \ --load-balancing-scheme internal \ --health-checks ASCS_HEALTH_CHECK_NAME \ --no-connection-drain-on-failover \ --drop-traffic-if-unhealthy \ --failover-ratio 1.0 \ --region CLUSTER_REGION \ --global-health-checks将主实例组添加到 ASCS 后端服务:

~gcloud compute backend-services add-backend ASCS_BACKEND_SERVICE_NAME \ --instance-group PRIMARY_IG_NAME \ --instance-group-zone PRIMARY_ZONE \ --region CLUSTER_REGION将辅助实例组添加为 ASCS 后端服务的故障切换实例组:

~gcloud compute backend-services add-backend ASCS_BACKEND_SERVICE_NAME \ --instance-group SECONDARY_IG_NAME \ --instance-group-zone SECONDARY_ZONE \ --failover \ --region CLUSTER_REGION

在 Cloud Shell 中,为 ERS 创建后端服务和故障切换组:

为 ERS 创建后端服务:

~gcloud compute backend-services create ERS_BACKEND_SERVICE_NAME \ --load-balancing-scheme internal \ --health-checks ERS_HEALTH_CHECK_NAME \ --no-connection-drain-on-failover \ --drop-traffic-if-unhealthy \ --failover-ratio 1.0 \ --region CLUSTER_REGION \ --global-health-checks将辅助实例组添加到 ERS 后端服务:

~gcloud compute backend-services add-backend ERS_BACKEND_SERVICE_NAME \ --instance-group SECONDARY_IG_NAME \ --instance-group-zone SECONDARY_ZONE \ --region CLUSTER_REGION将主实例组添加为 ERS 后端服务的故障切换实例组:

~gcloud compute backend-services add-backend ERS_BACKEND_SERVICE_NAME \ --instance-group PRIMARY_IG_NAME \ --instance-group-zone PRIMARY_ZONE \ --failover \ --region CLUSTER_REGION

(可选)确认后端服务按预期包含实例组:

~gcloud compute backend-services describe BACKEND_SERVICE_NAME \ --region=CLUSTER_REGION对于 ASCS 后端服务,您应该会看到类似以下示例的输出。对于 ERS,

failover: true会显示在主实例组上:backends: - balancingMode: CONNECTION group: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-b/instanceGroups/sap-aha-primary-instance-group - balancingMode: CONNECTION failover: true group: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-c/instanceGroups/sap-aha-secondary-instance-group connectionDraining: drainingTimeoutSec: 0 creationTimestamp: '2022-04-06T10:58:37.744-07:00' description: '' failoverPolicy: disableConnectionDrainOnFailover: true dropTrafficIfUnhealthy: true failoverRatio: 1.0 fingerprint: s4qMEAyhrV0= healthChecks: - https://www.googleapis.com/compute/v1/projects/example-project-123456/global/healthChecks/ascs-aha-health-check-name id: '6695034709671438882' kind: compute#backendService loadBalancingScheme: INTERNAL name: ascs-aha-backend-service-name protocol: TCP region: https://www.googleapis.com/compute/v1/projects/example-project-123456/regions/us-central1 selfLink: https://www.googleapis.com/compute/v1/projects/example-project-123456/regions/us-central1/backendServices/ascs-aha-backend-service-name sessionAffinity: NONE timeoutSec: 30

在 Cloud Shell 中,为 ASCS 和 ERS 后端服务创建转发规则:

创建从 ASCS VIP 地址到 ASCS 后端服务的转发规则:

~gcloud compute forwarding-rules create ASCS_FORWARDING_RULE_NAME \ --load-balancing-scheme internal \ --address ASCS_VIP_ADDRESS \ --subnet CLUSTER_SUBNET \ --region CLUSTER_REGION \ --backend-service ASCS_BACKEND_SERVICE_NAME \ --ports ALL创建从 ERS VIP 到 ERS 后端服务的转发规则:

~gcloud compute forwarding-rules create ERS_FORWARDING_RULE_NAME \ --load-balancing-scheme internal \ --address ERS_VIP_ADDRESS \ --subnet CLUSTER_SUBNET \ --region CLUSTER_REGION \ --backend-service ERS_BACKEND_SERVICE_NAME \ --ports ALL

测试负载均衡器配置

即使您的后端实例组在稍后完成相应配置之前不会被注册为运行状况良好,您仍然可以通过设置监听器响应健康检查来测试负载均衡器配置。设置监听器后,如果负载均衡器配置正确,则后端实例组的状态会变为运行状况良好。

以下部分介绍了可用于测试配置的各种不同方法。

使用 socat 实用程序测试负载均衡器

您可以使用 socat 实用程序来临时监听健康检查端口。无论如何,您都需要安装 socat 实用程序,因为稍后在配置集群资源时会用到它。

在两个主机虚拟机上,以根用户的身份安装

socat实用程序:#zypper install socat在主虚拟机上,将 VIP 地址临时分配给 eth0 网络卡:

ip addr add VIP_ADDRESS dev eth0

在主虚拟机上,启动

socat进程以监听 ASCS 健康检查端口 60 秒:#timeout 60s socat - TCP-LISTEN:ASCS_HEALTHCHECK_PORT_NUM,fork在 Cloud Shell 中,等待几秒钟,让健康检查检测到监听器,然后检查 ASCS 后端实例组的健康状况:

~gcloud compute backend-services get-health ASCS_BACKEND_SERVICE_NAME \ --region CLUSTER_REGION对于 ASCS,您应该会看到类似于如下示例的输出:

backend: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-b/instanceGroups/sap-aha-primary-instance-group status: healthStatus: - forwardingRule: https://www.googleapis.com/compute/v1/projects/example-project-123456/regions/us-central1/forwardingRules/scs-aha-forwarding-rule forwardingRuleIp: 10.1.0.90 healthState: HEALTHY instance: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-b/instances/nw-ha-vm-1 ipAddress: 10.1.0.89 port: 80 kind: compute#backendServiceGroupHealth --- backend: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-c/instanceGroups/sap-aha-secondary-instance-group status: healthStatus: - forwardingRule: https://www.googleapis.com/compute/v1/projects/example-project-123456/regions/us-central1/forwardingRules/scs-aha-forwarding-rule forwardingRuleIp: 10.1.0.90 healthState: UNHEALTHY instance: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-c/instances/nw-ha-vm-2 ipAddress: 10.1.0.88 port: 80 kind: compute#backendServiceGroupHealth从 eth0 接口中移除 VIP 地址:

ip addr del VIP_ADDRESS dev eth0

对 ERS 重复上述步骤,将 ASCS 变量值替换为 ERS 值。

使用端口 22 测试负载均衡器

如果主机虚拟机上的端口 22 对于 SSH 连接是打开的,则您可以将健康检查器临时修改为使用端口 22,该端口上具有可以响应健康检查器的监听器。

若要临时使用端口 22,请按以下步骤操作:

在 Google Cloud 控制台中,前往 Compute Engine 的健康检查页面:

点击您的健康检查名称。

点击修改。

在端口字段中,将端口号更改为 22。

点击保存,然后等待一两分钟。

在 Cloud Shell 中,等待几秒钟,让健康检查检测到监听器,然后检查后端实例组的健康状况:

~gcloud compute backend-services get-health BACKEND_SERVICE_NAME \ --region CLUSTER_REGION您将看到如下所示的输出:

backend: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-b/instanceGroups/sap-aha-primary-instance-group status: healthStatus: - forwardingRule: https://www.googleapis.com/compute/v1/projects/example-project-123456/regions/us-central1/forwardingRules/scs-aha-forwarding-rule forwardingRuleIp: 10.1.0.85 healthState: HEALTHY instance: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-b/instances/nw-ha-vm-1 ipAddress: 10.1.0.79 port: 80 kind: compute#backendServiceGroupHealth --- backend: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-c/instanceGroups/sap-aha-secondary-instance-group status: healthStatus: - forwardingRule: https://www.googleapis.com/compute/v1/projects/example-project-123456/regions/us-central1/forwardingRules/scs-aha-forwarding-rule forwardingRuleIp: 10.1.0.85 healthState: HEALTHY instance: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-c/instances/nw-ha-vm-2 ipAddress: 10.1.0.78 port: 80 kind: compute#backendServiceGroupHealth完成后,将健康检查端口号更改回原始端口号。

设置 Pacemaker

以下过程将在 SAP NetWeaver 的 Compute Engine 虚拟机上配置 Pacemaker 集群的 SUSE 实现。

如需详细了解如何在 SLES 上配置高可用性集群,请参阅适用于您 SLES 版本的 SUSE Linux Enterprise 高可用性扩展程序文档。

安装所需的集群软件包

在主要主机和辅助主机上,以根用户身份下载以下必需的集群软件包:

ha_sles模型:#zypper install -t pattern ha_slessap-suse-cluster-connector软件包:#zypper install -y sap-suse-cluster-connector如果您使用的是简单挂载设置,请另外运行以下命令:

#zypper install -y sapstartsrv-resource-agentssocat实用程序(如果尚未安装):#zypper install -y socat

确认已加载最新的高可用性代理:

#zypper se -t patch SUSE-SLE-HA

在主虚拟机上初始化、配置并启动集群

您可以使用 ha-cluster-init SUSE 脚本初始化集群。然后,您需要修改 Corosync 配置文件并将其与辅助节点同步。启动集群后,您可以使用 crm 命令设置其他集群属性和默认值。

创建 Corosync 配置文件

在主要主机上创建 Corosync 配置文件:

使用您的首选文本编辑器创建以下文件:

/etc/corosync/corosync.conf

在主要主机上的

corosync.conf文件中,添加以下配置,注意将斜体变量文本替换为您的值:totem { version: 2 secauth: off crypto_hash: sha1 crypto_cipher: aes256 cluster_name: hacluster clear_node_high_bit: yes token: 20000 token_retransmits_before_loss_const: 10 join: 60 max_messages: 20 transport: udpu interface { ringnumber: 0 Bindnetaddr: STATIC_IP_OF_THIS_HOST mcastport: 5405 ttl: 1 } } logging { fileline: off to_stderr: no to_logfile: no logfile: /var/log/cluster/corosync.log to_syslog: yes debug: off timestamp: on logger_subsys { subsys: QUORUM debug: off } } nodelist { node { ring0_addr: THIS_HOST_NAME nodeid: 1 } node { ring0_addr: OTHER_HOST_NAME nodeid: 2 } } quorum { provider: corosync_votequorum expected_votes: 2 two_node: 1 }

替换以下内容:

STATIC_IP_OF_THIS_HOST:指定此虚拟机的静态主要内部 IP 地址,如 Google Cloud 控制台中的网络接口下所示或gcloud compute instances describe VM_NAME所示。THIS_HOST_NAME:指定此虚拟机的主机名。OTHER_HOST_NAME:指定集群中其他虚拟机的主机名。

通过重复用于主要主机的相同步骤,在辅助主机上创建 Corosync 配置文件。除了

Bindnetaddr属性上 HDB 的静态 IP 和nodelist中主机名的顺序之外,每个主机的配置文件属性值都相同。

初始化集群

要初始化集群,请执行以下操作:

更改

hacluster用户的密码:#passwd hacluster在主要主机上,以根用户身份初始化集群。

以下命令为该集群命名并创建配置文件

corosync.conf:对其进行配置,并在集群节点之间设置同步。#crm cluster init --name CLUSTER_NAME --yes ssh#crm cluster init --name CLUSTER_NAME --yes --interface eth0 csync2#crm cluster init --name CLUSTER_NAME --yes --interface eth0 corosync在主要主机上启动 Pacemaker:

#systemctl enable pacemaker#systemctl start pacemaker

设置其他集群属性

设置常规集群属性:

#crm configure property stonith-timeout="300s"#crm configure property stonith-enabled="true"#crm configure rsc_defaults resource-stickiness="1"#crm configure rsc_defaults migration-threshold="3"#crm configure op_defaults timeout="600"定义各个集群资源时,您为

resource-stickiness和migration-threshold设置的值会替换您在此处设置的默认值。如需查看资源默认值以及任何已定义资源的值,请输入

crm config show。

将辅助虚拟机加入集群

在主虚拟机上打开的终端中,通过 SSH 在辅助虚拟机上加入和启动集群。

更改

hacluster用户的密码:#passwd hacluster在主虚拟机中,通过 SSH 在辅助虚拟机上运行以下

crm cluster join脚本选项。如果您已按照这些说明配置高可用性集群,则可以忽略有关监控定时器设备的警告。运行

--yes ssh选项以在集群节点之间设置ssh:#ssh SECONDARY_VM_NAME 'crm cluster join --cluster-node PRIMARY_VM_NAME --yes ssh'运行

--interface eth0 csync2选项:#ssh SECONDARY_VM_NAME 'crm cluster join --cluster-node PRIMARY_VM_NAME --yes --interface eth0 csync2'运行

ssh_merge选项:#ssh SECONDARY_VM_NAME 'crm cluster join --cluster-node PRIMARY_VM_NAME --yes ssh_merge'运行

cluster选项:#ssh SECONDARY_VM_NAME 'crm cluster join --cluster-node PRIMARY_VM_NAME --yes cluster'

在辅助主机上启动 Pacemaker:

启用 Pacemaker:

#ssh SECONDARY_VM_NAME systemctl enable pacemaker启动 Pacemaker:

#ssh SECONDARY_VM_NAME systemctl start pacemaker

在任一主机上,以根用户身份确认该集群同时显示了两个节点:

#crm_mon -s您将看到如下所示的输出:

CLUSTER OK: 2 nodes online, 0 resource instances configured

为基础架构配置集群资源

您可以定义 Pacemaker 在高可用性集群中管理的资源。您需要为以下集群组件定义资源:

- 防护设备,用于防止脑裂情况

- 共享文件系统中的 ASCS 和 ERS 目录

- 健康检查

- VIP

- ASCS 和 ERS 组件

您为 ASCS 和 ERS 组件定义资源的时间将晚于其余资源,因为您需要先安装 SAP NetWeaver。

启用维护模式

在任一主机上,以根用户身份将集群置于维护模式:

#crm configure property maintenance-mode="true"确认维护模式:

#crm status输出应表明资源管理已停用,如以下示例所示:

Cluster Summary: * Stack: corosync * Current DC: nw-ha-vm-1 (version 2.0.4+20200616.2deceaa3a-3.3.1-2.0.4+20200616.2deceaa3a) - partition with quorum * Last updated: Fri May 14 15:26:08 2021 * Last change: Thu May 13 19:02:33 2021 by root via cibadmin on nw-ha-vm-1 * 2 nodes configured * 0 resource instances configured *** Resource management is DISABLED *** The cluster will not attempt to start, stop or recover services Node List: * Online: [ nw-ha-vm-1 nw-ha-vm-2 ] Full List of Resources: * No resources

设置防护功能

您可以通过使用每个主机虚拟机的 fence_gce 代理定义集群资源来设置防护功能。

为了确保执行防护操作后的事件序列正确无误,您还可以配置操作系统,以在防护虚拟机后延迟 Corosync 的重启。此外,您还需要调整 Pacemaker 的重启超时,以将该延迟考虑在内。

创建防护设备资源

对于集群中的每个虚拟机,您需要为能够重启该虚拟机的防护设备创建一个集群资源。虚拟机的防护设备必须在其他虚拟机上运行,因此您需将集群资源的位置配置为在除其重启的虚拟机之外的任何其他虚拟机上运行。

在主要主机上,以根用户身份为主虚拟机的防护设备创建一个集群资源:

#crm configure primitive FENCING_RESOURCE_PRIMARY_VM stonith:fence_gce \ op monitor interval="300s" timeout="120s" \ op start interval="0" timeout="60s" \ params port="PRIMARY_VM_NAME" zone="PRIMARY_ZONE" \ project="CLUSTER_PROJECT_ID" \ pcmk_reboot_timeout=300 pcmk_monitor_retries=4 pcmk_delay_max=30为主虚拟机配置防护设备的位置,使其仅在辅助虚拟机上处于活跃状态:

#crm configure location FENCING_LOCATION_NAME_PRIMARY_VM \ FENCING_RESOURCE_PRIMARY_VM -inf: "PRIMARY_VM_NAME"确认新创建的配置:

#crm config show related:FENCING_RESOURCE_PRIMARY_VM您应该会看到类似于以下示例的输出:

primitive FENCING_RESOURCE_PRIMARY_VM stonith:fence_gce \ op monitor interval=300s timeout=120s \ op start interval=0 timeout=60s \ params PRIMARY_VM_NAME zone=PRIMARY_ZONE project=CLUSTER_PROJECT_ID pcmk_reboot_timeout=300 pcmk_monitor_retries=4 pcmk_delay_max=30 location FENCING_RESOURCE_PRIMARY_VM FENCING_RESOURCE_PRIMARY_VM -inf: PRIMARY_VM_NAME在主要主机上,以根用户身份为辅助虚拟机的防护设备创建一个集群资源:

#crm configure primitive FENCING_RESOURCE_SECONDARY_VM stonith:fence_gce \ op monitor interval="300s" timeout="120s" \ op start interval="0" timeout="60s" \ params port="SECONDARY_VM_NAME" zone="SECONDARY_VM_ZONE" \ project="CLUSTER_PROJECT_ID" \ pcmk_reboot_timeout=300 pcmk_monitor_retries=4为辅助虚拟机配置防护设备的位置,使其仅在主虚拟机上处于活跃状态:

#crm configure location FENCING_LOCATION_NAME_SECONDARY_VM \ FENCING_RESOURCE_SECONDARY_VM -inf: "SECONDARY_VM_NAME"确认新创建的配置:

#crm config show related:FENCING_RESOURCE_SECONDARY_VM您应该会看到类似于以下示例的输出:

primitive FENCING_RESOURCE_SECONDARY_VM stonith:fence_gce \ op monitor interval=300s timeout=120s \ op start interval=0 timeout=60s \ params SECONDARY_VM_NAME zone=SECONDARY_ZONE project=CLUSTER_PROJECT_ID pcmk_reboot_timeout=300 pcmk_monitor_retries=4 location FENCING_RESOURCE_SECONDARY_VM FENCING_RESOURCE_SECONDARY_VM -inf: SECONDARY_VM_NAME

设置 Corosync 重启延迟

在两个主机上,以根用户身份创建一个

systemd普适性文件,该文件用于延迟 Corosync 的启动,以确保在重启经过防护的虚拟机后具有正确的事件序列:systemctl edit corosync.service

将以下代码行添加到文件中:

[Service] ExecStartPre=/bin/sleep 60

保存文件并退出编辑器。

重新加载 systemd 管理器配置。

systemctl daemon-reload

确认已创建普适性文件:

service corosync status

您应能看到普适性文件所对应的行,如以下示例所示:

● corosync.service - Corosync Cluster Engine Loaded: loaded (/usr/lib/systemd/system/corosync.service; disabled; vendor preset: disabled) Drop-In: /etc/systemd/system/corosync.service.d └─override.conf Active: active (running) since Tue 2021-07-20 23:45:52 UTC; 2 days ago

创建文件系统资源

如果您使用的是简单装载设置,请跳过本部分,因为“简单装载”设置不会使用由集群管理的实例特定的文件系统资源。

您已经创建共享文件系统目录,因此可以开始定义集群资源。

为实例专用目录配置文件系统资源。

#crm configure primitive ASCS_FILE_SYSTEM_RESOURCE Filesystem \ device="NFS_PATH/usrsapSIDASCSASCS_INSTANCE_NUMBER" \ directory="/usr/sap/SID/ASCSASCS_INSTANCE_NUMBER" fstype="nfs" \ op start timeout=60s interval=0 \ op stop timeout=60s interval=0 \ op monitor interval=20s timeout=40s替换以下内容:

ASCS_FILE_SYSTEM_RESOURCE:为 ASCS 文件系统的集群资源指定一个名称。NFS_PATH:指定 ASCS 的 NFS 文件系统的路径。SID:指定系统 ID (SID)。所有字母均大写。ASCS_INSTANCE_NUMBER:指定 ASCS 实例编号。

#crm configure primitive ERS_FILE_SYSTEM_RESOURCE Filesystem \ device="NFS_PATH/usrsapSIDERSERS_INSTANCE_NUMBER" \ directory="/usr/sap/SID/ERSERS_INSTANCE_NUMBER" fstype="nfs" \ op start timeout=60s interval=0 \ op stop timeout=60s interval=0 \ op monitor interval=20s timeout=40s替换以下内容:

ERS_FILE_SYSTEM_RESOURCE:指定 ERS 文件系统集群资源的名称。NFS_PATH:指定 ERS 的 NFS 文件系统的路径。SID:指定系统 ID (SID)。所有字母均大写。ERS_INSTANCE_NUMBER:指定 ASCS 实例编号。

确认新创建的配置:

#crm configure show ASCS_FILE_SYSTEM_RESOURCE ERS_FILE_SYSTEM_RESOURCE您应该会看到类似于以下示例的输出:

primitive ASCS_FILE_SYSTEM_RESOURCE Filesystem \ params device="NFS_PATH/usrsapSIDASCSASCS_INSTANCE_NUMBER" directory="/usr/sap/SID/ASCSASCS_INSTANCE_NUMBER" fstype=nfs \ op start timeout=60s interval=0 \ op stop timeout=60s interval=0 \ op monitor interval=20s timeout=40s primitive ERS_FILE_SYSTEM_RESOURCE Filesystem \ params device="NFS_PATH/usrsapSIDERSERS_INSTANCE_NUMBER" directory="/usr/sap/SID/ERSERS_INSTANCE_NUMBER" fstype=nfs \ op start timeout=60s interval=0 \ op stop timeout=60s interval=0 \ op monitor interval=20s timeout=40s

创建健康检查资源

为 ASCS 和 ERS 健康检查配置集群资源:

#crm configure primitive ASCS_HEALTH_CHECK_RESOURCE anything \ params binfile="/usr/bin/socat" \ cmdline_options="-U TCP-LISTEN:ASCS_HEALTHCHECK_PORT_NUM,backlog=10,fork,reuseaddr /dev/null" \ op monitor timeout=20s interval=10s \ op_params depth=0#crm configure primitive ERS_HEALTH_CHECK_RESOURCE anything \ params binfile="/usr/bin/socat" \ cmdline_options="-U TCP-LISTEN:ERS_HEALTHCHECK_PORT_NUM,backlog=10,fork,reuseaddr /dev/null" \ op monitor timeout=20s interval=10s \ op_params depth=0确认新创建的配置:

#crm configure show ERS_HEALTH_CHECK_RESOURCE ASCS_HEALTH_CHECK_RESOURCE您应该会看到类似于以下示例的输出:

primitive ERS_HEALTH_CHECK_RESOURCE anything \ params binfile="/usr/bin/socat" cmdline_options="-U TCP-LISTEN:ASCS_HEALTHCHECK_PORT_NUM,backlog=10,fork,reuseaddr /dev/null" \ op monitor timeout=20s interval=10s \ op_params depth=0 primitive ASCS_HEALTH_CHECK_RESOURCE anything \ params binfile="/usr/bin/socat" cmdline_options="-U TCP-LISTEN:ERS_HEALTHCHECK_PORT_NUM,backlog=10,fork,reuseaddr /dev/null" \ op monitor timeout=20s interval=10s \ op_params depth=0

创建 VIP 资源

定义 VIP 地址的集群资源。

如果您需要查询数字 VIP 地址,可以使用:

gcloud compute addresses describe ASCS_VIP_NAME

--region=CLUSTER_REGION --format="value(address)"gcloud compute addresses describe ERS_VIP_NAME

--region=CLUSTER_REGION --format="value(address)"

为 ASCS 和 ERS VIP 地址创建集群资源。

#crm configure primitive ASCS_VIP_RESOURCE IPaddr2 \ params ip=ASCS_VIP_ADDRESS cidr_netmask=32 nic="eth0" \ op monitor interval=3600s timeout=60s#crm configure primitive ERS_VIP_RESOURCE IPaddr2 \ params ip=ERS_VIP_ADDRESS cidr_netmask=32 nic="eth0" \ op monitor interval=3600s timeout=60s确认新创建的配置:

#crm configure show ASCS_VIP_RESOURCE ERS_VIP_RESOURCE您应该会看到类似于以下示例的输出:

primitive ASCS_VIP_RESOURCE IPaddr2 \ params ip=ASCS_VIP_ADDRESS cidr_netmask=32 nic=eth0 \ op monitor interval=3600s timeout=60s primitive ERS_VIP_RESOURCE IPaddr2 \ params ip=ERS_VIP_RESOURCE cidr_netmask=32 nic=eth0 \ op monitor interval=3600s timeout=60s

查看已定义的资源

如需查看到目前为止定义的所有资源,请输入以下命令:

#crm status您应该会看到类似于以下示例的输出:

Stack: corosync Current DC: nw-ha-vm-1 (version 1.1.24+20201209.8f22be2ae-3.12.1-1.1.24+20201209.8f22be2ae) - partition with quorum Last updated: Wed May 26 19:10:10 2021 Last change: Tue May 25 23:48:35 2021 by root via cibadmin on nw-ha-vm-1 2 nodes configured 8 resource instances configured *** Resource management is DISABLED *** The cluster will not attempt to start, stop or recover services Online: [ nw-ha-vm-1 nw-ha-vm-2 ] Full list of resources: fencing-rsc-nw-aha-vm-1 (stonith:fence_gce): Stopped (unmanaged) fencing-rsc-nw-aha-vm-2 (stonith:fence_gce): Stopped (unmanaged) filesystem-rsc-nw-aha-ascs (ocf::heartbeat:Filesystem): Stopped (unmanaged) filesystem-rsc-nw-aha-ers (ocf::heartbeat:Filesystem): Stopped (unmanaged) health-check-rsc-nw-ha-ascs (ocf::heartbeat:anything): Stopped (unmanaged) health-check-rsc-nw-ha-ers (ocf::heartbeat:anything): Stopped (unmanaged) vip-rsc-nw-aha-ascs (ocf::heartbeat:IPaddr2): Stopped (unmanaged) vip-rsc-nw-aha-ers (ocf::heartbeat:IPaddr2): Stopped (unmanaged)如果您使用的是简单装载设置,则会看到类似于以下示例的输出:

Stack: corosync Current DC: nw-ha-vm-1 (version 1.1.24+20201209.8f22be2ae-3.12.1-1.1.24+20201209.8f22be2ae) - partition with quorum Last updated: Wed Sep 26 19:10:10 2024 Last change: Tue Sep 25 23:48:35 2024 by root via cibadmin on nw-ha-vm-1 2 nodes configured 8 resource instances configured *** Resource management is DISABLED *** The cluster will not attempt to start, stop or recover services Online: [ nw-ha-vm-1 nw-ha-vm-2 ] Full list of resources: fencing-rsc-nw-aha-vm-1 (stonith:fence_gce): Stopped (unmanaged) fencing-rsc-nw-aha-vm-2 (stonith:fence_gce): Stopped (unmanaged) health-check-rsc-nw-ha-ascs (ocf::heartbeat:anything): Stopped (unmanaged) health-check-rsc-nw-ha-ers (ocf::heartbeat:anything): Stopped (unmanaged) vip-rsc-nw-aha-ascs (ocf::heartbeat:IPaddr2): Stopped (unmanaged) vip-rsc-nw-aha-ers (ocf::heartbeat:IPaddr2): Stopped (unmanaged)

安装 ASCS 和 ERS

以下部分仅介绍特定于在 Google Cloud上安装 SAP NetWeaver 的要求和建议。

如需了解完整的安装说明,请参阅 SAP NetWeaver 文档。

准备安装

要确保集群之间的一致性并简化安装,请在安装 SAP NetWeaver ASCS 和 ERS 组件之前定义用户、组和权限,并将辅助服务器置于待机模式。

让集群退出维护模式:

#crm configure property maintenance-mode="false"在两个服务器上,以根用户身份输入以下命令,指定适合您的环境的用户 ID 和组 ID:

#groupadd -g GID_SAPINST sapinst#groupadd -g GID_SAPSYS sapsys#useradd -u UID_SIDADM SID_LCadm -g sapsys#usermod -a -G sapinst SID_LCadm#useradd -u UID_SAPADM sapadm -g sapinst#chown SID_LCadm:sapsys /usr/sap/SID/SYS#chown SID_LCadm:sapsys /sapmnt/SID -R#chown SID_LCadm:sapsys /usr/sap/trans -R#chown SID_LCadm:sapsys /usr/sap/SID/SYS -R#chown SID_LCadm:sapsys /usr/sap/SID -R如果您使用的是简单装载设置,请改为在两台服务器上以根用户身份运行以下命令。指定适合您环境的用户 ID 和群组 ID。

#groupadd -g GID_SAPINST sapinst#groupadd -g GID_SAPSYS sapsys#useradd -u UID_SIDADM SID_LCadm -g sapsys#usermod -a -G sapinst SID_LCadm#useradd -u UID_SAPADM sapadm -g sapinst#chown SID_LCadm:sapsys /usr/sap/SID#chown SID_LCadm:sapsys /sapmnt/SID -R#chown SID_LCadm:sapsys /usr/sap/trans -R#chown SID_LCadm:sapsys /usr/sap/SID -R#chown SID_LCadm:sapsys /usr/sap/SID/SYS替换以下内容:

GID_SAPINST:指定 SAP 预配工具的 Linux 组 ID。GID_SAPSYS:指定 SAPSYS 用户的 Linux 组 ID。UID_SIDADM:指定 SAP 系统管理员的 Linux 用户 ID (SID)。SID_LC:指定系统 ID (SID)。对于任何字母,请使用小写字母。UID_SAPADM:指定 SAP Host Agent 的用户 ID。SID:指定系统 ID (SID)。所有字母均大写。

例如,下面显示了实际的 GID 和 UID 编号方案:

Group sapinst 1001 Group sapsys 1002 Group dbhshm 1003 User en2adm 2001 User sapadm 2002 User dbhadm 2003

安装 ASCS 组件

在辅助服务器上,输入以下命令,将辅助服务器置于备用模式:

#crm_standby -v on -N ${HOSTNAME};将辅助服务器置于备用模式会将所有集群资源整合到主服务器上,从而简化安装。

确认辅助服务器处于待机模式:

#crm status输出类似于以下示例:

Stack: corosync Current DC: nw-ha-vm-1 (version 1.1.24+20201209.8f22be2ae-3.12.1-1.1.24+20201209.8f22be2ae) - partition with quorum Last updated: Thu May 27 17:45:16 2021 Last change: Thu May 27 17:45:09 2021 by root via crm_attribute on nw-ha-vm-2 2 nodes configured 8 resource instances configured Node nw-ha-vm-2: standby Online: [ nw-ha-vm-1 ] Full list of resources: fencing-rsc-nw-aha-vm-1 (stonith:fence_gce): Stopped fencing-rsc-nw-aha-vm-2 (stonith:fence_gce): Started nw-ha-vm-1 filesystem-rsc-nw-aha-scs (ocf::heartbeat:Filesystem): Started nw-ha-vm-1 filesystem-rsc-nw-aha-ers (ocf::heartbeat:Filesystem): Started nw-ha-vm-1 health-check-rsc-nw-ha-scs (ocf::heartbeat:anything): Started nw-ha-vm-1 health-check-rsc-nw-ha-ers (ocf::heartbeat:anything): Started nw-ha-vm-1 vip-rsc-nw-aha-scs (ocf::heartbeat:IPaddr2): Started nw-ha-vm-1 vip-rsc-nw-aha-ers (ocf::heartbeat:IPaddr2): Started nw-ha-vm-1如果您使用的是简单装载设置,则输出类似于以下内容:

Stack: corosync Current DC: nw-ha-vm-1 (version 1.1.24+20201209.8f22be2ae-3.12.1-1.1.24+20201209.8f22be2ae) - partition with quorum Last updated: Wed Sep 26 19:30:10 2024 Last change: Tue Sep 25 23:58:35 2024 by root via crm_attribute on nw-ha-vm-2 2 nodes configured 8 resource instances configured Node nw-ha-vm-2: standby Online: [ nw-ha-vm-1 ] Full list of resources: fencing-rsc-nw-aha-vm-1 (stonith:fence_gce): Stopped fencing-rsc-nw-aha-vm-2 (stonith:fence_gce): Started nw-ha-vm-1 health-check-rsc-nw-ha-scs (ocf::heartbeat:anything): Started nw-ha-vm-1 health-check-rsc-nw-ha-ers (ocf::heartbeat:anything): Started nw-ha-vm-1 vip-rsc-nw-aha-scs (ocf::heartbeat:IPaddr2): Started nw-ha-vm-1 vip-rsc-nw-aha-ers (ocf::heartbeat:IPaddr2): Started nw-ha-vm-1在主服务器上,以根用户的身份将目录更改为临时安装目录(例如

/tmp),以运行 SAP Software Provisioning Manager (SWPM) 来安装 ASCS 实例。要访问 SWPM 的网页界面,您需要

root用户的密码。如果您的 IT 政策不允许 SAP 管理员访问根密码,可以使用SAPINST_REMOTE_ACCESS_USER。启动 SWPM 时,请使用

SAPINST_USE_HOSTNAME参数指定您在/etc/hosts文件中为 ASCS VIP 地址定义的虚拟主机名。例如:

cd /tmp; /mnt/nfs/install/SWPM/sapinst SAPINST_USE_HOSTNAME=vh-aha-scs

在最终的 SWPM 确认页面上,确保虚拟主机名正确无误。

配置完成后,将辅助虚拟机退出备用模式:

#crm_standby -v off -N ${HOSTNAME}; # On SECONDARY

安装 ERS 组件

在主服务器上,以根用户或

SID_LCadm身份停止 ASCS 服务。#su - SID_LCadm -c "sapcontrol -nr ASCS_INSTANCE_NUMBER -function Stop"#su - SID_LCadm -c "sapcontrol -nr ASCS_INSTANCE_NUMBER -function StopService"在主服务器上,输入以下命令,将主服务器置于备用模式:

#crm_standby -v on -N ${HOSTNAME};将主服务器置于备用模式会将所有集群资源整合到辅助服务器上,从而简化安装。

确认主服务器处于备用模式:

#crm status在辅助服务器上,以根用户的身份将目录更改为临时安装目录(例如

/tmp),以运行 SAP Software Provisioning Manager (SWPM) 来安装 ERS 实例。使用您在安装 ASCS 组件时使用的相同用户和密码访问 SWPM。

启动 SWPM 时,请使用

SAPINST_USE_HOSTNAME参数指定您为/etc/hosts文件中为 ERS VIP 地址定义的虚拟主机名。例如:

cd /tmp; /mnt/nfs/install/SWPM/sapinst SAPINST_USE_HOSTNAME=vh-aha-ers

在最终的 SWPM 确认页面上,确保虚拟主机名正确无误。

将主虚拟机退出备用状态,使两个虚拟机都处于活动状态:

#crm_standby -v off -N ${HOSTNAME};

配置 SAP 服务

您需要确认服务已正确配置,检查 ASCS 和 ERS 配置文件中的设置,并将 SID_LCadm 用户添加到 haclient 用户组。

确认 SAP 服务条目

在两个服务器上,确认您的

/usr/sap/sapservices文件包含 ASCS 和 ERS 服务的条目。为此,您可以使用systemV或systemd集成。您可以使用带有

pf=PROFILE_OF_THE_SAP_INSTANCE和-reg选项的sapstartsrv命令来添加任何缺失的条目。如需详细了解这些集成,请参阅以下 SAP 说明:

systemV以下示例展示了使用

systemV集成时/usr/sap/sapservices文件中的 ASCS 和 ERS 服务的条目:#LD_LIBRARY_PATH=/usr/sap/hostctrl/exe:$LD_LIBRARY_PATH; export LD_LIBRARY_PATH /usr/sap/hostctrl/exe/sapstartsrv \ pf=/usr/sap/SID/SYS/profile/SID_ERSERS_INSTANCE_NUMBER_ERS_VIRTUAL_HOST_NAME \ -D -u SID_LCadm /usr/sap/hostctrl/exe/sapstartsrv \ pf=/usr/sap/SID/SYS/profile/SID_ASCSASCS_INSTANCE_NUMBER_ASCS_VIRTUAL_HOST_NAME \ -D -u SID_LCadmsystemd验证您的

/usr/sap/sapservices文件包含 ASCS 和 ERS 服务的条目。以下示例展示了使用systemd集成时/usr/sap/sapservices文件中的这些条目:systemctl --no-ask-password start SAPSID_ASCS_INSTANCE_NUMBER # sapstartsrv pf=/usr/sap/SID/SYS/profile/SID_ASCSASCS_INSTANCE_NUMBER_SID_LCascs systemctl --no-ask-password start SAPSID_ERS_INSTANCE_NUMBER # sapstartsrv pf=/usr/sap/SID/SYS/profile/SID_ERSERS_INSTANCE_NUMBER_SID_LCers

在 ASCS 和 ERS 实例上停用

systemd集成:#systemctl disable SAPSID_ASCS_INSTANCE_NUMBER.service#systemctl stop SAPSID_ASCS_INSTANCE_NUMBER.service#systemctl disable SAPSID_ERS_INSTANCE_NUMBER.service#systemctl stop SAPSID_ERS_INSTANCE_NUMBER.service验证

systemd集成已停用:#systemctl list-unit-files | grep sap类似于以下示例的输出表示

systemd集成已停用。请注意,某些服务(例如saphostagent和saptune)已启用,某些服务已停用。SAPSID_ASCS_INSTANCE_NUMBER.service disabled SAPSID_ERS_INSTANCE_NUMBER.service disabled saphostagent.service enabled sapinit.service generated saprouter.service disabled saptune.service enabled

如需了解详情,请参阅 SUSE 文档停用 ASCS 和 ERS SAP 实例的

systemd服务。

停止 SAP 服务

在辅助服务器上,停止 ERS 服务:

#su - SID_LCadm -c "sapcontrol -nr ERS_INSTANCE_NUMBER -function Stop"#su - SID_LCadm -c "sapcontrol -nr ERS_INSTANCE_NUMBER -function StopService"在每个服务器上,验证所有服务都已停止:

#su - SID_LCadm -c "sapcontrol -nr ASCS_INSTANCE_NUMBER -function GetSystemInstanceList"#su - SID_LCadm -c "sapcontrol -nr ERS_INSTANCE_NUMBER -function GetSystemInstanceList"您应该会看到类似于以下示例的输出:

GetSystemInstanceList FAIL: NIECONN_REFUSED (Connection refused), NiRawConnect failed in plugin_fopen()

启用 sapping 和 sappong。

如果您未使用简单装载设置,请跳过本部分。

由于集群中的启动和停止过程由 Pacemaker 管理,因此您需要确保 sapstartsrv 不会在系统启动期间自动启动。在系统启动期间,sapping 会在 sapinit 之前运行,这会隐藏 sapservices 文件。完成 sapinit 后,sappong 会取消隐藏 sapservices 文件。

如需激活此流程,您需要使用以下命令启用 systemd 服务 sapping 和 sappong:

#systemctl enable sapping sappong#systemctl status sapping sappong

修改 ASCS 和 ERS 配置文件

在任一服务器上,使用以下任一命令切换到配置文件目录:

#cd /usr/sap/SID/SYS/profile#cd /sapmnt/SID/profile如有必要,您可以通过列出配置文件目录中的文件来找到 ASCS 配置文件的文件名,也可以使用以下格式:

SID_ASCSASCS_INSTANCE_NUMBER_ASCS_VIRTUAL_HOST_NAME

SID_ERSERS_INSTANCE_NUMBER_ERS_VIRTUAL_HOST_NAME

将以下行添加到 ASCS 和 ERS 实例配置文件中,以启用软件包

sap-suse-cluster-connector:#----------------------------------------------------------------------- # SUSE HA library #----------------------------------------------------------------------- service/halib = $(DIR_CT_RUN)/saphascriptco.so service/halib_cluster_connector = /usr/bin/sap_suse_cluster_connector如果您使用的是 ENSA1,请通过在 ASCS 配置文件中进行以下设置来启用 keepalive 函数:

enque/encni/set_so_keepalive = true

如需了解详情,请参阅 SAP 说明 1410736 - TCP/IP:设置 keepalive 间隔。

如有必要,请修改 ASCS 和 ERS 配置文件,以更改 Enqueue Server 和 Enqueue Replication Server 的启动行为。

ENSA1

在 ASCS 配置文件的“Start SAP enqueue server”部分,如果您看到

Restart_Program_NN,请将“Restart”更改为“Start”,如以下示例所示。Start_Program_01 = local $(_EN) pf=$(_PF)

在 ERS 配置文件的“Start enqueue replication server”部分,如果您看到

Restart_Program_NN,请将“Restart”更改为“Start”,如以下示例所示。Start_Program_00 = local $(_ER) pf=$(_PFL) NR=$(SCSID)

ENSA2

在 ASCS 配置文件的“Start SAP enqueue server”部分,如果您看到

Restart_Program_NN,请将“Restart”更改为“Start”,如以下示例所示。Start_Program_01 = local $(_ENQ) pf=$(_PF)

在 ERS 配置文件的“Start enqueue replicator”部分,如果您看到

Restart_Program_NN,请将“Restart”更改为“Start”,如以下示例所示。Start_Program_00 = local $(_ENQR) pf=$(_PF) ...

将 sidadm 用户添加到 haclient 用户群组

当您安装 sap-suse-cluster-connector 时,安装会创建一个 haclient 用户组。如需允许 SID_LCadm 用户使用集群,请将集群添加到 haclient 用户组。

在两个服务器上,将

SID_LCadm用户添加到haclient用户组:#usermod -aG haclient SID_LCadm

为 ASCS 和 ERS 配置集群资源

在任一服务器上,以根用户身份将集群置于维护模式:

#crm configure property maintenance-mode="true"确认集群处于维护模式:

#crm status如果集群处于维护模式,则状态包括以下行:

*** Resource management is DISABLED *** The cluster will not attempt to start, stop or recover services

如果您使用的是简单装载设置,请为 ASCS 和 ERS 服务创建

sapstartsrv集群资源。如果您未使用简单装载设置,请跳过此步骤。对于 ASCS,请创建一个名为

sapstartsrv_scs.txt且包含以下内容的配置文件:primitive rsc_SAPStartSrv_SID_ASCSINSTANCENUMBER ocf:suse:SAPStartSrv \ params InstanceName=SID_ASCSINSTANCE_NUMBER_ASCS_VIRTUAL_HOSTNAME

如需加载 ASCS 的配置,请运行以下命令:

#crm configure load update sapstartsrv_scs.txt对于 ERS,请创建一个名为

sapstartsrv_ers.txt且包含以下内容的配置文件:primitive rsc_SAPStartSrv_SID_ERSINSTANCENUMBER ocf:suse:SAPStartSrv \ params InstanceName=SID_ERSINSTANCE_NUMBER_ERS_VIRTUAL_HOSTNAME

如需加载 ERS 的配置,请运行以下命令:

#crm configure load update sapstartsrv_ers.txt

为 ASCS 和 ERS 服务创建集群资源:

ENSA1

为 ASCS 实例创建集群资源。

InstanceName的值是您安装 ASCS 时 SWPM 生成的实例配置文件的名称。#crm configure primitive ASCS_INSTANCE_RESOURCE SAPInstance \ operations \$id=ASCS_INSTANCE_RSC_OPERATIONS_NAME \ op monitor interval=11 timeout=60 on-fail=restart \ params InstanceName=SID_ASCSASCS_INSTANCE_NUMBER_ASCS_VIRTUAL_HOST_NAME \ START_PROFILE="/PATH_TO_PROFILE/SID_ASCSASCS_INSTANCE_NUMBER_ASCS_VIRTUAL_HOST_NAME" \ AUTOMATIC_RECOVER=false \ meta resource-stickiness=5000 failure-timeout=60 \ migration-threshold=1 priority=10如果您使用的是简单装载设置,请改为运行以下命令:

#crm configure primitive ASCS_INSTANCE_RESOURCE SAPInstance \ operations \$id=ASCS_INSTANCE_RSC_OPERATIONS_NAME \ op monitor interval=11 timeout=60 on-fail=restart \ params InstanceName=SID_ASCSASCS_INSTANCE_NUMBER_ASCS_VIRTUAL_HOST_NAME \ START_PROFILE="/PATH_TO_PROFILE/SID_ASCSASCS_INSTANCE_NUMBER_ASCS_VIRTUAL_HOST_NAME" \ AUTOMATIC_RECOVER=false MINIMAL_PROBE=true \ meta resource-stickiness=5000 failure-timeout=60 \ migration-threshold=1 priority=10为 ERS 实例创建集群资源。

InstanceName的值是您安装 ERS 时 SWPM 生成的实例配置文件的名称。参数IS_ERS=true告知 Pacemaker 在 ERS 处于活动状态的节点上将runsersSID标志设置为1。#crm configure primitive ERS_INSTANCE_RESOURCE SAPInstance \ operations \$id=ERS_INSTANCE_RSC_OPERATIONS_NAME \ op monitor interval=11 timeout=60 on-fail=restart \ params InstanceName=SID_ERSERS_INSTANCE_NUMBER_ERS_VIRTUAL_HOST_NAME \ START_PROFILE="/PATH_TO_PROFILE/SID_ERSERS_INSTANCE_NUMBER_ERS_VIRTUAL_HOST_NAME" \ AUTOMATIC_RECOVER=false IS_ERS=true \ meta priority=1000如果您使用的是简单装载设置,请改为运行以下命令:

#crm configure primitive ERS_INSTANCE_RESOURCE SAPInstance \ operations \$id=ERS_INSTANCE_RSC_OPERATIONS_NAME \ op monitor interval=11 timeout=60 on-fail=restart \ params InstanceName=SID_ERSERS_INSTANCE_NUMBER_ERS_VIRTUAL_HOST_NAME \ START_PROFILE="/PATH_TO_PROFILE/SID_ERSERS_INSTANCE_NUMBER_ERS_VIRTUAL_HOST_NAME" \ AUTOMATIC_RECOVER=false MINIMAL_PROBE=true IS_ERS=true \ meta priority=1000确认新创建的配置:

#crm configure show ASCS_INSTANCE_RESOURCE ERS_INSTANCE_RESOURCE输出类似于以下示例:

primitive ASCS_INSTANCE_RESOURCE SAPInstance \ operations $id=ASCS_INSTANCE_RSC_OPERATIONS_NAME \ op monitor interval=11 timeout=60 on-fail=restart \ params InstanceName=SID_ASCSASCS_INSTANCE_NUMBER_ASCS_VIRTUAL_HOST_NAME START_PROFILE="/PATH_TO_PROFILE/SID_ASCSASCS_INSTANCE_NUMBER_ASCS_VIRTUAL_HOST_NAME" AUTOMATIC_RECOVER=false \ meta resource-stickiness=5000 failure-timeout=60 migration-threshold=1 priority=10 primitive ERS_INSTANCE_RESOURCE SAPInstance \ operations $id=ERS_INSTANCE_RSC_OPERATIONS_NAME \ op monitor interval=11 timeout=60 on-fail=restart \ params InstanceName=SID_ERSERS_INSTANCE_NUMBER_ERS_VIRTUAL_HOST_NAME START_PROFILE="/PATH_TO_PROFILE/SID_ERSERS_INSTANCE_NUMBER_ERS_VIRTUAL_HOST_NAME" AUTOMATIC_RECOVER=false IS_ERS=true \ meta priority=1000

如果您使用的是简单装载设置,则输出类似于以下示例:

primitive ASCS_INSTANCE_RESOURCE SAPInstance \ operations $id=ASCS_INSTANCE_RSC_OPERATIONS_NAME \ op monitor interval=11 timeout=60 on-fail=restart \ params InstanceName=SID_ASCSASCS_INSTANCE_NUMBER_ASCS_VIRTUAL_HOST_NAME START_PROFILE="/PATH_TO_PROFILE/SID_ASCSASCS_INSTANCE_NUMBER_ASCS_VIRTUAL_HOST_NAME" AUTOMATIC_RECOVER=false MINIMAL_PROBE=true \ meta resource-stickiness=5000 failure-timeout=60 migration-threshold=1 priority=10 primitive ERS_INSTANCE_RESOURCE SAPInstance \ operations $id=ERS_INSTANCE_RSC_OPERATIONS_NAME \ op monitor interval=11 timeout=60 on-fail=restart \ params InstanceName=SID_ERSERS_INSTANCE_NUMBER_ERS_VIRTUAL_HOST_NAME START_PROFILE="/PATH_TO_PROFILE/SID_ERSERS_INSTANCE_NUMBER_ERS_VIRTUAL_HOST_NAME" AUTOMATIC_RECOVER=false MINIMAL_PROBE=true IS_ERS=true \ meta priority=1000

ENSA2

为 ASCS 实例创建集群资源。

InstanceName的值是您安装 ASCS 时 SWPM 生成的实例配置文件的名称。#crm configure primitive ASCS_INSTANCE_RESOURCE SAPInstance \ operations \$id=ASCS_INSTANCE_RSC_OPERATIONS_NAME \ op monitor interval=11 timeout=60 on-fail=restart \ params InstanceName=SID_ASCSASCS_INSTANCE_NUMBER_ASCS_VIRTUAL_HOST_NAME \ START_PROFILE="/PATH_TO_PROFILE/SID_ASCSASCS_INSTANCE_NUMBER_ASCS_VIRTUAL_HOST_NAME" \ AUTOMATIC_RECOVER=false \ meta resource-stickiness=5000 failure-timeout=60如果您使用的是简单装载设置,请改为运行以下命令:

#crm configure primitive ASCS_INSTANCE_RESOURCE SAPInstance \ operations \$id=ASCS_INSTANCE_RSC_OPERATIONS_NAME \ op monitor interval=11 timeout=60 on-fail=restart \ params InstanceName=SID_ASCSASCS_INSTANCE_NUMBER_ASCS_VIRTUAL_HOST_NAME \ START_PROFILE="/PATH_TO_PROFILE/SID_ASCSASCS_INSTANCE_NUMBER_ASCS_VIRTUAL_HOST_NAME" \ AUTOMATIC_RECOVER=false MINIMAL_PROBE=true \ meta resource-stickiness=5000 failure-timeout=60为 ERS 实例创建集群资源。

InstanceName的值是您安装 ERS 时 SWPM 生成的实例配置文件的名称。#crm configure primitive ERS_INSTANCE_RESOURCE SAPInstance \ operations \$id=ERS_INSTANCE_RSC_OPERATIONS_NAME \ op monitor interval=11 timeout=60 on-fail=restart \ params InstanceName=SID_ERSERS_INSTANCE_NUMBER_ERS_VIRTUAL_HOST_NAME \ START_PROFILE="/PATH_TO_PROFILE/SID_ERSERS_INSTANCE_NUMBER_ERS_VIRTUAL_HOST_NAME" \ AUTOMATIC_RECOVER=false IS_ERS=true如果您使用的是简单装载设置,请改为运行以下命令:

#crm configure primitive ERS_INSTANCE_RESOURCE SAPInstance \ operations \$id=ERS_INSTANCE_RSC_OPERATIONS_NAME \ op monitor interval=11 timeout=60 on-fail=restart \ params InstanceName=SID_ERSERS_INSTANCE_NUMBER_ERS_VIRTUAL_HOST_NAME \ START_PROFILE="/PATH_TO_PROFILE/SID_ERSERS_INSTANCE_NUMBER_ERS_VIRTUAL_HOST_NAME" \ AUTOMATIC_RECOVER=false IS_ERS=true MINIMAL_PROBE=true \ meta priority=1000确认新创建的配置:

#crm configure show ASCS_INSTANCE_RESOURCE ERS_INSTANCE_RESOURCE输出类似于以下示例:

primitive ASCS_INSTANCE_RESOURCE SAPInstance \ operations $id=ASCS_INSTANCE_RSC_OPERATIONS_NAME \ op monitor interval=11 timeout=60 on-fail=restart \ params InstanceName=SID_ASCSASCS_INSTANCE_NUMBER_ASCS_VIRTUAL_HOST_NAME START_PROFILE="/PATH_TO_PROFILE/SID_ASCSASCS_INSTANCE_NUMBER_ASCS_VIRTUAL_HOST_NAME" AUTOMATIC_RECOVER=false \ meta resource-stickiness=5000 failure-timeout=60 primitive ERS_INSTANCE_RESOURCE SAPInstance \ operations $id=ERS_INSTANCE_RSC_OPERATIONS_NAME \ op monitor interval=11 timeout=60 on-fail=restart \ params InstanceName=SID_ERSERS_INSTANCE_NUMBER_ERS_VIRTUAL_HOST_NAME START_PROFILE="/PATH_TO_PROFILE/SID_ERSERS_INSTANCE_NUMBER_ERS_VIRTUAL_HOST_NAME" AUTOMATIC_RECOVER=false IS_ERS=true \

如果您使用的是简单装载设置,则输出类似于以下内容:

primitive ASCS_INSTANCE_RESOURCE SAPInstance \ operations $id=ASCS_INSTANCE_RSC_OPERATIONS_NAME \ op monitor interval=11 timeout=60 on-fail=restart \ params InstanceName=SID_ASCSASCS_INSTANCE_NUMBER_ASCS_VIRTUAL_HOST_NAME START_PROFILE="/PATH_TO_PROFILE/SID_ASCSASCS_INSTANCE_NUMBER_ASCS_VIRTUAL_HOST_NAME" AUTOMATIC_RECOVER=false MINIMAL_PROBE=true \ meta resource-stickiness=5000 failure-timeout=60 \ migration-threshold=1 priority=10 primitive ERS_INSTANCE_RESOURCE SAPInstance \ operations $id=ERS_INSTANCE_RSC_OPERATIONS_NAME \ op monitor interval=11 timeout=60 on-fail=restart \ params InstanceName=SID_ERSERS_INSTANCE_NUMBER_ERS_VIRTUAL_HOST_NAME START_PROFILE="/PATH_TO_PROFILE/SID_ERSERS_INSTANCE_NUMBER_ERS_VIRTUAL_HOST_NAME" AUTOMATIC_RECOVER=false MINIMAL_PROBE=true IS_ERS=true \ meta priority=1000

配置资源组和位置限制条件

将 ASCS 和 ERS 资源分组。您可以通过输入命令

crm resource status,显示之前定义的所有资源的名称:#crm configure group ASCS_RESOURCE_GROUP ASCS_FILE_SYSTEM_RESOURCE \ ASCS_HEALTH_CHECK_RESOURCE ASCS_VIP_RESOURCE \ ASCS_INSTANCE_RESOURCE \ meta resource-stickiness=3000#crm configure group ASCS_RESOURCE_GROUP ASCS_SAPSTARTSRV_RESOURCE \ ASCS_HEALTH_CHECK_RESOURCE ASCS_VIP_RESOURCE \ ASCS_INSTANCE_RESOURCE \ meta resource-stickiness=3000ASCS_RESOURCE_GROUP:为 ASCS 集群资源指定唯一的组名称。您可以使用SID_LC_ASCSINSTANCE_NUMBER_group等惯例来确保唯一性。例如nw1_ASCS00_group。ASCS_FILE_SYSTEM_RESOURCE:指定您之前为 ASCS 文件系统定义的集群资源的名称。 如果您使用的是简单装载设置,则此占位符变量不适用。ASCS_SAPSTARTSRV_RESOURCE:指定您之前为 ASCSsapstartsrv定义的集群资源的名称。仅当您使用简单装载设置时,此占位符变量才适用。ASCS_HEALTH_CHECK_RESOURCE:指定您之前为 ASCS 健康检查定义的集群资源的名称。ASCS_VIP_RESOURCE:指定您之前为 ASCS VIP 地址定义的集群资源的名称。ASCS_INSTANCE_RESOURCE:指定您之前为 ASCS 实例定义的集群资源的名称。

#crm configure group ERS_RESOURCE_GROUP ERS_FILE_SYSTEM_RESOURCE \ ERS_HEALTH_CHECK_RESOURCE ERS_VIP_RESOURCE \ ERS_INSTANCE_RESOURCE#crm configure group ERS_RESOURCE_GROUP ERS_SAPSTARTSRV_RESOURCE \ ERS_HEALTH_CHECK_RESOURCE ERS_VIP_RESOURCE \ ERS_INSTANCE_RESOURCEERS_RESOURCE_GROUP:为 ERS 集群资源指定唯一的组名称。您可以使用“SID_ERSinstance number_group”等惯例来确保唯一性。例如nw1_ERS10_group。ERS_SAPSTARTSRV_RESOURCE:指定您之前为 ERSsapstartsrv定义的集群资源的名称。仅当您使用简单装载设置时,此占位符变量才适用。ERS_FILE_SYSTEM_RESOURCE:指定您之前为 ERS 文件系统定义的集群资源的名称。 如果您使用的是简单装载设置,则此占位符变量不适用。ERS_HEALTH_CHECK_RESOURCE:指定您之前为 ERS 健康检查定义的集群资源的名称。ERS_VIP_RESOURCE:指定您之前为 ERS VIP 地址定义的集群资源的名称。ERS_INSTANCE_RESOURCE:指定您之前为 ERS 实例定义的集群资源的名称。

确认新创建的配置:

#crm configure show type:group输出类似于以下示例:

group ERS_RESOURCE_GROUP ERS_FILE_SYSTEM_RESOURCE ERS_HEALTH_CHECK_RESOURCE ERS_VIP_RESOURCE ERS_INSTANCE_RESOURCE group ASCS_RESOURCE_GROUP ASCS_FILE_SYSTEM_RESOURCE ASCS_HEALTH_CHECK_RESOURCE ASCS_VIP_RESOURCE ASCS_INSTANCE_RESOURCE \ meta resource-stickiness=3000如果您使用的是简单装载设置,则输出类似于以下示例:

group ERS_RESOURCE_GROUP ERS_SAPSTARTSRV_RESOURCE ERS_HEALTH_CHECK_RESOURCE ERS_VIP_RESOURCE ERS_INSTANCE_RESOURCE group ASCS_RESOURCE_GROUP ASCS_SAPSTARTSRV_RESOURCE ASCS_HEALTH_CHECK_RESOURCE ASCS_VIP_RESOURCE ASCS_INSTANCE_RESOURCE

创建主机托管限制条件:

ENSA1

创建一个主机托管限制条件,以防止 ASCS 资源与 ERS 资源在同一个服务器上运行:

#crm configure colocation PREVENT_SCS_ERS_COLOC -5000: ERS_RESOURCE_GROUP ASCS_RESOURCE_GROUP配置 ASCS,当标志

runsersSID等于1时,ASCS 故障切换到运行 ERS 的服务器:#crm configure location LOC_SCS_SID_FAILOVER_TO_ERS ASCS_INSTANCE_RESOURCE \ rule 2000: runs_ers_SID eq 1将 ASCS 配置为在故障切换后 ERS 移至其他服务器之前启动:

#crm configure order ORD_SAP_SID_FIRST_START_ASCS \ Optional: ASCS_INSTANCE_RESOURCE:start \ ERS_INSTANCE_RESOURCE:stop symmetrical=false确认新创建的配置:

#crm configure show type:colocation type:location type:order您应该会看到类似于以下示例的输出:

order ORD_SAP_SID_FIRST_START_ASCS Optional: ASCS_INSTANCE_RESOURCE:start ERS_INSTANCE_RESOURCE:stop symmetrical=false colocation PREVENT_SCS_ERS_COLOC -5000: ERS_RESOURCE_GROUP ASCS_RESOURCE_GROUP location LOC_SCS_SID_FAILOVER_TO_ERS ASCS_INSTANCE_RESOURCE \ rule 2000: runs_ers_SID eq 1

ENSA2

创建一个主机托管限制条件,以防止 ASCS 资源与 ERS 资源在同一个服务器上运行:

#crm configure colocation PREVENT_SCS_ERS_COLOC -5000: ERS_RESOURCE_GROUP ASCS_RESOURCE_GROUP将 ASCS 配置为在故障切换后 ERS 移至其他服务器之前启动:

#crm configure order ORD_SAP_SID_FIRST_START_ASCS \ Optional: ASCS_INSTANCE_RESOURCE:start \ ERS_INSTANCE_RESOURCE:stop symmetrical=false确认新创建的配置:

#crm configure show type:colocation type:order您应该会看到类似于以下示例的输出:

colocation PREVENT_SCS_ERS_COLOC -5000: ERS_RESOURCE_GROUP ASCS_RESOURCE_GROUP order ORD_SAP_SID_FIRST_START_ASCS Optional: ASCS_INSTANCE_RESOURCE:start ERS_INSTANCE_RESOURCE:stop symmetrical=false

停用维护模式。

#crm configure property maintenance-mode="false"

验证和测试集群

本部分介绍如何运行以下测试:

- 检查配置错误

- 确认 ASCS 和 ERS 资源在故障切换期间正确切换服务器

- 确认锁定被保留

- 模拟 Compute Engine 维护事件,以确保实时迁移不会触发故障切换

检查集群配置

在任一服务器上,以根用户身份查看您的资源在哪些节点上运行:

#crm status在以下示例中,ASCS 资源在

nw-ha-vm-1服务器上运行,ERS 资源在nw-ha-vm-2服务器上运行。Cluster Summary: * Stack: corosync * Current DC: nw-ha-vm-2 (version 2.0.4+20200616.2deceaa3a-3.3.1-2.0.4+20200616.2deceaa3a) - partition with quorum * Last updated: Thu May 20 16:58:46 2021 * Last change: Thu May 20 16:57:31 2021 by ahaadm via crm_resource on nw-ha-vm-2 * 2 nodes configured * 10 resource instances configured Node List: * Online: [ nw-ha-vm-1 nw-ha-vm-2 ] Active Resources: * fencing-rsc-nw-aha-vm-1 (stonith:fence_gce): Started nw-ha-vm-2 * fencing-rsc-nw-aha-vm-2 (stonith:fence_gce): Started nw-ha-vm-1 * Resource Group: ascs-aha-rsc-group-name: * filesystem-rsc-nw-aha-ascs (ocf::heartbeat:Filesystem): Started nw-ha-vm-1 * health-check-rsc-nw-ha-ascs (ocf::heartbeat:anything): Started nw-ha-vm-1 * vip-rsc-nw-aha-ascs (ocf::heartbeat:IPaddr2): Started nw-ha-vm-1 * ascs-aha-instance-rsc-name (ocf::heartbeat:SAPInstance): Started nw-ha-vm-1 * Resource Group: ers-aha-rsc-group-name: * filesystem-rsc-nw-aha-ers (ocf::heartbeat:Filesystem): Started nw-ha-vm-2 * health-check-rsc-nw-ha-ers (ocf::heartbeat:anything): Started nw-ha-vm-2 * vip-rsc-nw-aha-ers (ocf::heartbeat:IPaddr2): Started nw-ha-vm-2 * ers-aha-instance-rsc-name (ocf::heartbeat:SAPInstance): Started nw-ha-vm-2如果您使用的是简单装载设置,则输出类似于以下示例:

Cluster Summary: * Stack: corosync * Current DC: nw-ha-vm-2 (version 2.0.4+20200616.2deceaa3a-3.3.1-2.0.4+20200616.2deceaa3a) - partition with quorum * Last updated: Thu Sep 20 19:44:26 2024 * Last change: Thu Sep 20 19:53:41 2024 by ahaadm via crm_resource on nw-ha-vm-2 * 2 nodes configured * 10 resource instances configured Node List: * Online: [ nw-ha-vm-1 nw-ha-vm-2 ] Active Resources: * fencing-rsc-nw-aha-vm-1 (stonith:fence_gce): Started nw-ha-vm-2 * fencing-rsc-nw-aha-vm-2 (stonith:fence_gce): Started nw-ha-vm-1 * Resource Group: ascs-aha-rsc-group-name: * SAPStartSrv-rsc-nw-aha-ascs (ocf::heartbeat:SAPStartSrv): Started nw-ha-vm-1 * health-check-rsc-nw-ha-ascs (ocf::heartbeat:anything): Started nw-ha-vm-1 * vip-rsc-nw-aha-ascs (ocf::heartbeat:IPaddr2): Started nw-ha-vm-1 * ascs-aha-instance-rsc-name (ocf::heartbeat:SAPInstance): Started nw-ha-vm-1 * Resource Group: ers-aha-rsc-group-name: * SAPStartSrv-rsc-nw-aha-ers (ocf::heartbeat:SAPStartSrv): Started nw-ha-vm-2 * health-check-rsc-nw-ha-ers (ocf::heartbeat:anything): Started nw-ha-vm-2 * vip-rsc-nw-aha-ers (ocf::heartbeat:IPaddr2): Started nw-ha-vm-2 * ers-aha-instance-rsc-name (ocf::heartbeat:SAPInstance): Started nw-ha-vm-2切换到

SID_LCadm用户:#su - SID_LCadm检查集群配置。对于

INSTANCE_NUMBER,请指定您输入以下命令的服务器上处于活跃状态的 ASCS 或 ERS 实例的编号:>sapcontrol -nr INSTANCE_NUMBER -function HAGetFailoverConfigHAActive应为TRUE,如以下示例所示:20.05.2021 01:33:25 HAGetFailoverConfig OK HAActive: TRUE HAProductVersion: SUSE Linux Enterprise Server for SAP Applications 15 SP2 HASAPInterfaceVersion: SUSE Linux Enterprise Server for SAP Applications 15 SP2 (sap_suse_cluster_connector 3.1.2) HADocumentation: https://www.suse.com/products/sles-for-sap/resource-library/sap-best-practices/ HAActiveNode: nw-ha-vm-1 HANodes: nw-ha-vm-1, nw-ha-vm-2

以

SID_LCadm身份,检查配置中的错误:>sapcontrol -nr INSTANCE_NUMBER -function HACheckConfig您应该会看到类似于以下示例的输出:

20.05.2021 01:37:19 HACheckConfig OK state, category, description, comment SUCCESS, SAP CONFIGURATION, Redundant ABAP instance configuration, 0 ABAP instances detected SUCCESS, SAP CONFIGURATION, Redundant Java instance configuration, 0 Java instances detected SUCCESS, SAP CONFIGURATION, Enqueue separation, All Enqueue server separated from application server SUCCESS, SAP CONFIGURATION, MessageServer separation, All MessageServer separated from application server SUCCESS, SAP STATE, SCS instance running, SCS instance status ok SUCCESS, SAP CONFIGURATION, SAPInstance RA sufficient version (vh-ascs-aha_AHA_00), SAPInstance includes is-ers patch SUCCESS, SAP CONFIGURATION, Enqueue replication (vh-ascs-aha_AHA_00), Enqueue replication enabled SUCCESS, SAP STATE, Enqueue replication state (vh-ascs-aha_AHA_00), Enqueue replication active

在 ASCS 处于活跃状态的服务器上,以

SID_LCadm身份模拟故障切换:>sapcontrol -nr ASCS_INSTANCE_NUMBER -function HAFailoverToNode ""如果您以根用户身份使用

crm_mon跟踪故障切换,应该会看到 ASCS 迁移到另一个服务器,ERS 在该服务器上停止,然后 ERS 迁移到 ASCS 之前运行的服务器。

模拟故障切换

通过在主要主机上模拟故障来测试集群。在发布系统以供使用之前,请使用测试系统或在生产系统上运行测试。

您可以通过多种方式模拟故障,包括:

ip link set eth0 downecho c > /proc/sysrq-trigger

这里的说明使用 ip link set eth0 down 来将网络接口设为离线,因为它将同时验证故障切换和防护。

备份您的系统。

在具有活跃 SCS 实例的主机上,以根用户身份让网络接口离线:

#ip link set eth0 down使用 SSH 重新连接到任一主机并切换到根用户。

输入

crm status以确认主要主机在辅助主机以前所在的虚拟机上当前处于活跃状态。集群中已启用自动重启,因此已停止的主机将重启并担任辅助主机的角色,如以下示例所示。Cluster Summary: * Stack: corosync * Current DC: nw-ha-vm-2 (version 2.0.4+20200616.2deceaa3a-3.3.1-2.0.4+20200616.2deceaa3a) - partition with quorum * Last updated: Fri May 21 22:31:32 2021 * Last change: Thu May 20 20:36:36 2021 by ahaadm via crm_resource on nw-ha-vm-1 * 2 nodes configured * 10 resource instances configured Node List: * Online: [ nw-ha-vm-1 nw-ha-vm-2 ] Full List of Resources: * fencing-rsc-nw-aha-vm-1 (stonith:fence_gce): Started nw-ha-vm-2 * fencing-rsc-nw-aha-vm-2 (stonith:fence_gce): Started nw-ha-vm-1 * Resource Group: scs-aha-rsc-group-name: * filesystem-rsc-nw-aha-scs (ocf::heartbeat:Filesystem): Started nw-ha-vm-2 * health-check-rsc-nw-ha-scs (ocf::heartbeat:anything): Started nw-ha-vm-2 * vip-rsc-nw-aha-scs (ocf::heartbeat:IPaddr2): Started nw-ha-vm-2 * scs-aha-instance-rsc-name (ocf::heartbeat:SAPInstance): Started nw-ha-vm-2 * Resource Group: ers-aha-rsc-group-name: * filesystem-rsc-nw-aha-ers (ocf::heartbeat:Filesystem): Started nw-ha-vm-1 * health-check-rsc-nw-ha-ers (ocf::heartbeat:anything): Started nw-ha-vm-1 * vip-rsc-nw-aha-ers (ocf::heartbeat:IPaddr2): Started nw-ha-vm-1 * ers-aha-instance-rsc-name (ocf::heartbeat:SAPInstance): Started nw-ha-vm-1

如果您使用的是简单装载设置,则会看到类似于以下内容的输出:

Cluster Summary: * Stack: corosync * Current DC: nw-ha-vm-2 (version 2.0.4+20200616.2deceaa3a-3.3.1-2.0.4+20200616.2deceaa3a) - partition with quorum * Last updated: Wed Sep 26 19:10:10 2024 * Last change: Tue Sep 25 23:48:35 2024 by ahaadm via crm_resource on nw-ha-vm-1 * 2 nodes configured * 10 resource instances configured Node List: * Online: [ nw-ha-vm-1 nw-ha-vm-2 ] Full List of Resources: * fencing-rsc-nw-aha-vm-1 (stonith:fence_gce): Started nw-ha-vm-2 * fencing-rsc-nw-aha-vm-2 (stonith:fence_gce): Started nw-ha-vm-1 * Resource Group: scs-aha-rsc-group-name: * SAPStartSrv-rsc-nw-aha-scs (ocf::heartbeat:SAPStartSrv): Started nw-ha-vm-2 * health-check-rsc-nw-ha-scs (ocf::heartbeat:anything): Started nw-ha-vm-2 * vip-rsc-nw-aha-scs (ocf::heartbeat:IPaddr2): Started nw-ha-vm-2 * scs-aha-instance-rsc-name (ocf::heartbeat:SAPInstance): Started nw-ha-vm-2 * Resource Group: ers-aha-rsc-group-name: * SAPStartSrv-rsc-nw-aha-ers (ocf::heartbeat:SAPStartSrv): Started nw-ha-vm-1 * health-check-rsc-nw-ha-ers (ocf::heartbeat:anything): Started nw-ha-vm-1 * vip-rsc-nw-aha-ers (ocf::heartbeat:IPaddr2): Started nw-ha-vm-1 * ers-aha-instance-rsc-name (ocf::heartbeat:SAPInstance): Started nw-ha-vm-1

确认锁定条目被保留

如需确认锁定条目在故障切换中被保留,首先选择您的 Enqueue Server 版本对应的标签页,然后按照步骤生成锁定条目、模拟故障切换并确认锁定条目在 ASCS 激活后保留。

ENSA1

在 ERS 处于活动状态的服务器上,以

SID_LCadm身份使用enqt程序生成锁定条目:>enqt pf=/PATH_TO_PROFILE/SID_ERSERS_INSTANCE_NUMBER_ERS_VIRTUAL_HOST_NAME 11 NUMBER_OF_LOCKS在 ASCS 处于活跃状态的服务器上,以

SID_LCadm身份验证锁定条目已注册:>sapcontrol -nr ASCS_INSTANCE_NUMBER -function EnqGetStatistic | grep locks_now如果您创建了 10 个锁定,应该会看到类似于以下示例的输出:

locks_now: 10

在 ERS 处于活动状态的服务器上,以

SID_LCadm身份启动enqt程序的监控函数OpCode=20:>enqt pf=/PATH_TO_PROFILE/SID_ERSERS_INSTANCE_NUMBER_ERS_VIRTUAL_HOST_NAME 20 1 1 9999例如:

>enqt pf=/sapmnt/AHA/profile/AHA_ERS10_vh-ers-aha 20 1 1 9999重新启动 ASCS 处于活跃状态的服务器。

在监控服务器上,当 Pacemaker 停止 ERS 以将其移动到其他服务器时,您应该会看到类似如下所示的输出。

Number of selected entries: 10 Number of selected entries: 10 Number of selected entries: 10 Number of selected entries: 10 Number of selected entries: 10

当

enqt监控程序停止时,输入Ctrl + c退出监控程序。(可选)在任一服务器上以根用户身份监控集群故障切换:

#crm_mon以

SID_LCadm身份,在确认锁定被保留后,释放锁定:>enqt pf=/PATH_TO_PROFILE/SID_ERSERS_INSTANCE_NUMBER_ERS_VIRTUAL_HOST_NAME 12 NUMBER_OF_LOCKS在 ASCS 处于活跃状态的服务器上,以

SID_LCadm身份验证锁定条目已移除:>sapcontrol -nr ASCS_INSTANCE_NUMBER -function EnqGetStatistic | grep locks_now

ENSA2

在 ASCS 处于活跃状态的服务器上,以

SID_LCadm身份使用enq_adm程序生成锁定条目:>enq_admin --set_locks=NUMBER_OF_LOCKS:X:DIAG::TAB:%u pf=/PATH_TO_PROFILE/SID_ASCSASCS_INSTANCE_NUMBER_ASCS_VIRTUAL_HOST_NAME在 ASCS 处于活跃状态的服务器上,以

SID_LCadm身份验证锁定条目已注册:>sapcontrol -nr ASCS_INSTANCE_NUMBER -function EnqGetStatistic | grep locks_now如果您创建了 10 个锁定,应该会看到类似于以下示例的输出:

locks_now: 10

在 ERS 处于活跃状态时,确认锁定条目已复制:

>sapcontrol -nr ERS_INSTANCE_NUMBER -function EnqGetStatistic | grep locks_now返回的锁定数应与 ASCS 实例上的锁定数相同。

重新启动 ASCS 处于活跃状态的服务器。

(可选)在任一服务器上以根用户身份监控集群故障切换:

#crm_mon在重启 ASCS 的服务器上,以

SID_LCadm身份验证锁定条目被保留:>sapcontrol -nr ASCS_INSTANCE_NUMBER -function EnqGetStatistic | grep locks_now确认锁定被保留后,在 ERS 处于活动状态的服务器上,以

SID_LCadm身份释放锁定:>enq_admin --release_locks=NUMBER_OF_LOCKS:X:DIAG::TAB:%u pf=/PATH_TO_PROFILE/SID_ERSERS_INSTANCE_NUMBER_ERS_VIRTUAL_HOST_NAME在 ASCS 处于活跃状态的服务器上,以

SID_LCadm身份验证锁定条目已移除:>sapcontrol -nr ASCS_INSTANCE_NUMBER -function EnqGetStatistic | grep locks_now您应该会看到类似于以下示例的输出:

locks_now: 0

模拟 Compute Engine 维护事件

模拟 Compute Engine 维护事件,以确保实时迁移不会触发故障切换。

在这些说明中使用的超时和间隔值考虑了实时迁移的时长。如果您在集群配置中使用较短的值,则实时迁移可能触发故障切换的风险会比较大。

如需测试集群对实时迁移的容忍度,请执行以下操作:

在主节点上,使用以下 gcloud CLI 命令触发模拟维护事件:

#gcloud compute instances simulate-maintenance-event PRIMARY_VM_NAME确认主节点没有发生变化:

#crm status

评估 SAP NetWeaver 工作负载

如需对 Google Cloud上运行的 SAP NetWeaver 高可用性工作负载自动执行持续验证检查,您可以使用 Workload Manager。

借助 Workload Manager,您可以根据 SAP、 Google Cloud和操作系统供应商的最佳实践自动扫描和评估 SAP NetWeaver 高可用性工作负载。这有助于提高工作负载的质量、性能和可靠性。

如需了解 Workload Manager 支持用于评估 Google Cloud上运行的 SAP NetWeaver 高可用性工作负载的最佳实践,请参阅适用于 SAP 的 Workload Manager 最佳实践。如需了解如何使用 Workload Manager 创建和运行评估,请参阅创建和运行评估。

问题排查

如需排查 SAP NetWeaver 的高可用性配置问题,请参阅排查 SAP 高可用性配置问题。

收集 SAP NetWeaver 高可用性集群的诊断信息

如果您在解决 SAP NetWeaver 高可用性集群问题时需要帮助,请收集必要的诊断信息并与 Cloud Customer Care 联系。

如需收集诊断信息,请参阅 SLES 上的高可用性集群诊断信息。支持

如有 Google Cloud 基础设施或服务方面的问题,请与 Customer Care 联系。您可以在 Google Cloud 控制台中的“支持概览”页面上找到联系信息。如果 Customer Care 确定问题在于您的 SAP 系统,会将您引荐给 SAP 支持。

对于与 SAP 产品有关的问题,请通过 SAP 支持记录您的支持请求。

SAP 会评估支持服务工单,如果该问题似乎是 Google Cloud基础设施问题,则 SAP 会将工单转移到其系统中的相应Google Cloud 组成团队:BC-OP-LNX-GOOGLE 或 BC-OP-NT-GOOGLE。

支持要求

您必须满足最低支持方案要求,才能获得对 SAP 系统及其使用的Google Cloud基础设施和服务的支持。

如需详细了解Google Cloud上的 SAP 的最低支持要求,请参阅:

执行部署后任务

在使用 SAP NetWeaver 系统之前,建议您备份新的 SAP NetWeaver 高可用性系统。

如需了解详情,请参阅 SAP NetWeaver 操作指南。

后续步骤

如需详细了解高可用性、SAP NetWeaver 和 Google Cloud,请参阅以下资源:

如需详细了解虚拟机管理和监控,请参阅 SAP NetWeaver 运维指南