En esta guía, se muestra cómo implementar y configurar clústeres de alta disponibilidad (HA) de SUSE Linux Enterprise Server (SLES) optimizado para un sistema de escalamiento de SAP HANA en Google Cloud.

En esta guía, se incluyen los siguientes pasos:

- Configurar un balanceador de cargas de red de transferencia interno para redirigir el tráfico en caso de una falla

- Configurar un clúster de Pacemaker en SLES para administrar los sistemas SAP y otros recursos durante una conmutación por error

En esta guía, también se incluyen pasos para configurar la replicación del sistema SAP HANA, pero consulta la documentación de SAP para obtener las instrucciones definitivas.

Para implementar un sistema de SAP HANA sin un clúster de alta disponibilidad de Linux o un host de nodo en espera, usa la Guía de implementación de SAP HANA.

Si deseas configurar un clúster de alta disponibilidad para SAP HANA en Red Hat Enterprise Linux (RHEL), consulta la guía sobre la configuración de clústeres de alta disponibilidad para el escalamiento vertical de SAP HANA en RHEL.

Esta guía está destinada a usuarios avanzados de SAP HANA que estén familiarizados con las configuraciones de alta disponibilidad de Linux para SAP HANA.

El sistema que se implementa en esta guía

Con esta guía, podrás implementar dos instancias de SAP HANA y configurar un clúster de HA en SLES. Implementarás cada instancia de SAP HANA en una VM de Compute Engine en una zona diferente dentro de la misma región. En esta guía, no se aborda la instalación de alta disponibilidad de SAP NetWeaver.

El clúster implementado incluye las siguientes funciones y características:

- Dos VM de host, cada una con una instancia de SAP HANA

- Replicación síncrona del sistema SAP HANA.

- El administrador de recursos del clúster de alta disponibilidad de Pacemaker

- Un mecanismo de defensa STONITH

- Reinicio automático de la instancia con errores como la instancia secundaria nueva

En esta guía, se usan las plantillas de Cloud Deployment Manager que proporciona Google Cloud para implementar las máquinas virtuales (VM) de Compute Engine y las instancias de SAP HANA, lo que garantiza que los sistemas de base SAP HANA cumplan con los requisitos de compatibilidad de SAP y con las prácticas recomendadas actuales.

En esta guía, se usa SAP HANA Studio para probar la replicación del sistema SAP HANA. Si lo prefieres, puedes usar SAP HANA Cockpit. Para obtener información sobre la instalación de SAP HANA Studio, consulta la siguiente página:

- Instala SAP HANA Studio en una VM de Windows de Compute Engine

- SAP HANA Studio Installation and Update Guide (Guía de instalación y actualización de SAP HANA Studio)

Requisitos previos

Antes de crear el clúster de alta disponibilidad de SAP HANA, asegúrate de que se cumplan los siguientes requisitos:

- Leíste la Guía de planificación de SAP HANA y la Guía de planificación de alta disponibilidad de SAP HANA.

- Tú o tu organización deben tener una cuenta de Google Cloud y haber creado un proyecto para la implementación de SAP HANA. Para obtener información sobre cómo crear cuentas y proyectos deGoogle Cloud , consulta Configura tu Cuenta de Google en la guía de implementación de SAP HANA.

- Si necesitas que tu carga de trabajo de SAP se ejecute de acuerdo con los requisitos de residencia de datos, control de acceso, personal de asistencia o reglamentario, debes crear la carpeta de cargas de trabajo de Assured Workloads requerida. Para obtener más información, consulta Cumplimiento y controles soberanos para SAP en Google Cloud.

El medio de instalación de SAP HANA se almacena en un bucket de Cloud Storage que está disponible en tu proyecto y región de implementación. Para obtener información sobre cómo subir medios de instalación de SAP HANA a un bucket de Cloud Storage, consulta Descarga SAP HANA en la Guía de implementación de SAP HANA.

Si el Acceso al SO está habilitado en los metadatos del proyecto, debes inhabilitar el Acceso al SO de forma temporal hasta que se complete la implementación. Para fines de implementación, este procedimiento configura las claves SSH en metadatos de instancia. Cuando el acceso al SO está habilitado, la configuración de las claves SSH basada en metadatos se inhabilita y esta implementación falla. Una vez terminada la implementación, puedes volver a habilitar el acceso al SO.

Para obtener más información, consulte:

Si usas un DNS interno de VPC, el valor de la variable

vmDnsSettingen los metadatos del proyecto debe serGlobalOnlyoZonalPreferredpara habilitar la resolución de los nombres del nodo entre zonas. La configuración predeterminada devmDnsSettingesZonalOnly. Para obtener más información, consulta:

Crea una red

Por razones de seguridad, crea una red nueva. Puedes controlar quién tiene acceso con reglas de firewall o a través de otro método de control de acceso.

Si tu proyecto tiene una red de VPC predeterminada, no la uses. En su lugar, crea tu propia red de VPC para que las únicas reglas de firewall vigentes sean aquellas que crees explícitamente.

Durante la implementación, las instancias de Compute Engine suelen requerir acceso a Internet para descargar el agente de Google Cloudpara SAP. Si usas una de las imágenes de Linux certificadas por SAP que están disponibles en Google Cloud, la instancia de procesamiento también requiere acceso a Internet para registrar la licencia y acceder a los repositorios de los proveedores de SO. Una configuración con una puerta de enlace NAT y con etiquetas de red de VM admite este acceso, incluso si las instancias de procesamiento de destino no tienen IP externas.

Para configurar la red, sigue estos pasos:

Console

- En la consola de Google Cloud , ve a la página Redes de VPC.

- Haz clic en Crear red de VPC.

- Ingresa un Nombre para la red.

El nombre debe cumplir con la convención de nombres. Las redes de VPC usan la convención de nombres de Compute Engine.

- En Modo de creación de subredes, selecciona Custom.

- En la sección Subred nueva, especifica los siguientes parámetros de configuración para una subred:

- Ingresa un Nombre para la subred.

- En Región, selecciona la región de Compute Engine en la que deseas crear la subred.

- En Tipo de pila IP, selecciona IPv4 (pila única) y, luego, ingresa un rango de direcciones IP en el formato CIDR. , como

10.1.0.0/24.Este es el rango de IPv4 principal de la subred. Si planeas agregar más de una subred, asigna rangos de IP de CIDR no superpuestos para cada subred de la red. Ten en cuenta que cada subred y sus rangos de IP interna se asignan a una sola región.

- Haz clic en Listo.

- Para agregar más subredes, haz clic en Agregar subred y repite los pasos anteriores. Puedes agregar más subredes a la red después de haberla creado.

- Haz clic en Crear.

gcloud

- Ve a Cloud Shell.

- Para crear una red nueva en el modo de subredes personalizadas, ejecuta el siguiente comando:

gcloud compute networks create NETWORK_NAME --subnet-mode custom

Reemplaza

NETWORK_NAMEpor el nombre de la red nueva. El nombre debe cumplir con la convención de nombres. Las redes de VPC usan la convención de nombres de Compute Engine.Especifica

--subnet-mode custompara evitar el uso del modo automático predeterminado, que crea de forma automática una subred en cada región de Compute Engine. Para obtener más información, consulta Modo de creación de subredes. - Crea una subred y especifica la región y el rango de IP a través del siguiente comando:

gcloud compute networks subnets create SUBNETWORK_NAME \ --network NETWORK_NAME --region REGION --range RANGEReemplaza lo siguiente:

SUBNETWORK_NAME: el nombre de la subred nuevaNETWORK_NAME: el nombre de la zona que creaste en el paso anteriorREGION: la región en la que deseas que esté la subredRANGE: el rango de direcciones IP especificado en formato CIDR, como10.1.0.0/24Si planeas agregar más de una subred, asigna rangos de IP de CIDR no superpuestos para cada subred de la red. Ten en cuenta que cada subred y sus rangos de IP interna se asignan a una sola región.

- Si quieres, puedes repetir el paso anterior y agregar más subredes.

Cómo configurar una puerta de enlace NAT

Si necesitas crear una o más VMs sin direcciones IP públicas, debes usar la traducción de direcciones de red (NAT) para permitir que las VMs accedan a Internet. Usa Cloud NAT, un servicio administrado distribuido y definido por software por Google Cloud que permite que las VMs envíen paquetes salientes a Internet y reciban cualquier paquete de respuesta entrante establecido. Como alternativa, puedes configurar una VM independiente como una puerta de enlace NAT.

A fin de crear una instancia de Cloud NAT para tu proyecto, consulta Usa Cloud NAT.

Después de configurar Cloud NAT para tu proyecto, tus instancias de VM pueden acceder a Internet de forma segura sin una dirección IP pública.

Cómo agregar reglas de firewall

De forma predeterminada, una regla de firewall implícita bloquea las conexiones entrantes desde fuera de tu red de nube privada virtual (VPC). Para permitir conexiones entrantes, establece una regla de firewall para la VM. Después de establecer una conexión entrante con una VM, se permite el tráfico en ambas direcciones a través de esa conexión.

También puedes crear una regla de firewall para permitir el acceso externo a puertos especificados o restringir el acceso entre las VM en la misma red. Si se usa el tipo de red de VPC default, también se aplican algunas reglas predeterminadas adicionales, como la regla default-allow-internal, que permite la conectividad entre VM en la misma red en todos los puertos.

En función de la política de TI que se aplique a tu entorno, es posible que debas aislar o restringir la conectividad a tu host de base de datos, lo que puedes hacer a través de la creación de reglas de firewall.

Según la situación en la que te encuentres, puedes crear reglas de firewall para permitir los siguientes accesos:

- Los puertos SAP predeterminados que se enumeran en TCP/IP de todos los productos SAP.

- Conexiones desde tu computadora o tu entorno de red corporativa a tu instancia de VM de Compute Engine. Si no estás seguro de qué dirección IP usar, comunícate con el administrador de red de tu empresa.

- Comunicación entre las VM de la subred de SAP HANA, incluida la comunicación entre los nodos en un sistema de escalamiento horizontal de SAP HANA o la comunicación entre el servidor de base de datos y los servidores de aplicaciones en una arquitectura de 3 niveles. Puedes habilitar la comunicación entre las VM si creas una regla de firewall para permitir el tráfico que se origina desde la subred.

Para crear una regla de firewall, sigue estos pasos:

Console

En la consola de Google Cloud , ve a la página Firewall de la red de VPC.

En la parte superior de la página, haz clic en Crear regla de firewall.

- En el campo Red, selecciona la red en la que se ubica tu VM.

- En el campo Destinos, especifica los recursos de Google Cloud a los que se aplica esta regla. Por ejemplo, especifica Todas las instancias de la red. O bien, para limitar la regla a instancias específicas en Google Cloud, ingresa las etiquetas en Etiquetas de destino especificadas.

- En el campo Filtro de fuente, selecciona una de las siguientes opciones:

- Rangos de IP para permitir el tráfico entrante de direcciones IP específicas. Especifica el rango de direcciones IP en el campo Rangos de IP de origen.

- Subredes para permitir el tráfico entrante desde una subred específica. Especifica el nombre de la subred en el siguiente campo Subredes. Puedes usar esta opción para permitir el acceso entre las VM en una configuración de escalamiento horizontal o de 3 niveles.

- En la sección Protocolos y puertos, selecciona Protocolos y puertos especificados y luego ingresa

tcp:PORT_NUMBER.

Haz clic en Crear para crear tu regla de firewall.

gcloud

Crea una regla de firewall mediante el siguiente comando:

$ gcloud compute firewall-rules create FIREWALL_NAME

--direction=INGRESS --priority=1000 \

--network=NETWORK_NAME --action=ALLOW --rules=PROTOCOL:PORT \

--source-ranges IP_RANGE --target-tags=NETWORK_TAGSImplementa las VM y SAP HANA

Antes de comenzar a configurar el clúster de HA, debes definir e implementar las instancias de VM y los sistemas SAP HANA que funcionan como los nodos principales y secundarios en tu clúster de HA.

A fin de definir e implementar los sistemas, usa la misma plantilla de Cloud Deployment Manager que usas para implementar un sistema SAP HANA en la guía de implementación de SAP HANA.

Sin embargo, a fin de implementar dos sistemas en lugar de uno, debes agregar la definición del segundo sistema al archivo de configuración. Para ello, copia y pega la definición del primer sistema. Después de crear la segunda definición, debes cambiar los nombres de los recursos y las instancias en la segunda definición. Para evitar una falla zonal, especifica una zona diferente en la misma región. Todos los demás valores de propiedad en las dos definiciones permanecen iguales.

Una vez que los sistemas SAP HANA se implementen de forma correcta, debes definir y configurar el clúster de HA.

En las siguientes instrucciones, se usa Cloud Shell, pero, en términos generales, se pueden aplicar a Google Cloud CLI.

Confirma que las cuotas actuales de los recursos como discos persistentes y CPU sean suficientes para los sistemas SAP HANA que estás a punto de instalar. Si las cuotas no son suficientes, la implementación fallará. Si quieres ver los requisitos de cuota de SAP HANA, consulta las consideraciones de precios y cuotas para SAP HANA.

Abre Cloud Shell o, si instalaste la CLI de gcloud en tu estación de trabajo local, abre una terminal.

Ingresa el siguiente comando en Cloud Shell o en la CLI de gcloud a fin de descargar la plantilla del archivo de configuración

template.yamlpara el clúster de alta disponibilidad de SAP HANA en el directorio de trabajo:wget https://storage.googleapis.com/cloudsapdeploy/deploymentmanager/latest/dm-templates/sap_hana/template.yaml

De manera opcional, cambia el nombre del archivo

template.yamlpara identificar la configuración que define.Abre el archivo

template.yamlen el editor de código de Cloud Shell o, si usas la CLI de gcloud, el editor de texto que elijas.Para abrir el editor de código de Cloud Shell, haz clic en el ícono de lápiz en la esquina superior derecha de la ventana de la terminal de Cloud Shell.

En el archivo

template.yaml, completa la definición del sistema SAP HANA principal. Reemplaza los corchetes y su contenido por los valores de la instalación a fin de especificar los siguientes valores de propiedad. Las propiedades se describen en la siguiente tabla.Para crear las instancias de VM sin instalar SAP HANA, borra todas las líneas que comiencen con

sap_hana_o conviértelas en comentarios.Propiedad Tipo de datos Descripción tipo String Especifica la ubicación, el tipo y la versión de la plantilla de Deployment Manager que se usará durante la implementación.

El archivo YAML incluye dos especificaciones

type, y una de ellas se marca como comentario. La especificacióntypeque está activa de forma predeterminada especifica la versión de la plantilla comolatest. La especificacióntypeque se marca como comentario especifica una versión específica de la plantilla con una marca de tiempo.Si necesitas que todas tus implementaciones usen la misma versión de plantilla, usa la especificación

type, que incluye la marca de tiempo.instanceNameString El nombre de la instancia de VM que se define en este momento. Especifica nombres diferentes en las definiciones de la VM principal y secundaria. Los nombres se deben especificar con letras minúsculas, números o guiones. instanceTypeString El tipo de máquina virtual de Compute Engine en el que quieres ejecutar SAP HANA. Si necesitas un tipo de VM personalizada, especifica un tipo de VM predefinido con una cantidad de CPU virtuales más cercana al número que necesitas sin dejar de ser más grande. Una vez completada la implementación, modifica la cantidad de CPU virtuales y la cantidad de memoria. zoneString La Google Cloud zona en la que se implementará la instancia de VM que estás definiendo. Especifica diferentes zonas en la misma región para las definiciones de HANA principales y secundarias. Las zonas deben estar en la misma región que seleccionaste para tu subred. subnetworkString El nombre de la subred que creaste en un paso anterior. Si realizas la implementación en una VPC compartida, especifica este valor como [SHAREDVPC_PROJECT]/[SUBNETWORK]. Por ejemplo,myproject/network1.linuxImageString El nombre de la imagen del sistema operativo Linux o de la familia de imágenes que usas con SAP HANA. Para especificar una familia de imágenes, agrega el prefijo family/al nombre de la familia. Por ejemplo,family/sles-15-sp1-sap. Para indicar una imagen específica, proporciona solo el nombre de la imagen. Para ver la lista de imágenes y familias disponibles, consulta la página Imágenes en la Google Cloud consola.linuxImageProjectString El proyecto Google Cloud que contiene la imagen que usarás. Este proyecto puede ser uno propio o un proyecto de Google Cloud imágenes, como suse-sap-cloud. Para obtener más información sobre los Google Cloud proyectos de imagen, consulta la página Imágenes en la documentación de Compute Engine.sap_hana_deployment_bucketString El nombre del bucket de almacenamiento de Google Cloud en tu proyecto que contiene los archivos de instalación y revisión de SAP HANA que subiste en un paso anterior. Todos los archivos de revisión de actualización en el bucket se aplican a SAP HANA durante el proceso de implementación. sap_hana_sidString El ID del sistema SAP HANA (SID). Debe constar de tres caracteres alfanuméricos y comenzar con una letra. Todas las letras deben estar en mayúsculas. sap_hana_instance_numberNúmero entero El número de instancia, de 0 a 99, del sistema SAP HANA. El valor predeterminado es 0. sap_hana_sidadm_passwordString La contraseña del administrador del sistema operativo (SO). Las contraseñas deben tener como mínimo ocho caracteres y deben incluir al menos una letra mayúscula, una letra minúscula y un número. sap_hana_system_passwordString La contraseña para el superusuario de la base de datos. Las contraseñas deben tener al menos ocho caracteres y, a su vez, incluir al menos una letra mayúscula, una letra minúscula y un número. sap_hana_sidadm_uidNúmero entero El valor predeterminado para el ID de usuario SID_LCadmes900a fin de evitar que los grupos creados por el usuario entren en conflicto con SAP HANA. Puedes cambiar este valor a uno diferente si es necesario.sap_hana_sapsys_gidNúmero entero El ID de grupo predeterminado para sapsys es 79. Si especificas un valor superior, puedes anular este valor según tus requisitos.sap_hana_scaleout_nodesEntero Especifica 0. Estas instrucciones son solo para sistemas SAP HANA de escalamiento vertical.networkTagString Una etiqueta de red que representa tu instancia de VM para el firewall o el enrutamiento. Si especificas publicIP: Noy no especificas una etiqueta de red, asegúrate de proporcionar otro medio de acceso a Internet.nic_typeString Opcional, pero recomendado si está disponible para la máquina de destino y la versión del SO. Especifica la interfaz de red que se usará con la instancia de VM. Puedes especificar el valor GVNICoVIRTIO_NET. Para usar una NIC virtual de Google (gVNIC), debes especificar una imagen de SO que admita gVNIC como valor de la propiedadlinuxImage. Para obtener la lista de imágenes del SO, consulta Detalles de los sistemas operativos.Si no especificas un valor para esta propiedad, la interfaz de red se selecciona de manera automática según el tipo de máquina que especifiques para la propiedad

Este argumento está disponible en las versionesinstanceType.202302060649de la plantilla de Deployment Manager o posteriores.publicIPBooleano Opcional. Determina si se agrega una dirección IP pública a tu instancia de VM. El valor predeterminado es Yes.serviceAccountString Opcional. Especifica una cuenta de servicio que usarán las VM del host y los programas que se ejecutan en las VM del host. Especifica la dirección de correo electrónico de la cuenta de servicio. Por ejemplo, svc-acct-name@project-id.. De forma predeterminada, se usa la cuenta de servicio predeterminada de Compute Engine. Para obtener más información, consulta Administración de identidades y accesos para programas de SAP en Google Cloud. Para crear la definición del sistema SAP HANA secundario, copia la definición del sistema SAP HANA principal y pégala después de la definición del sistema SAP HANA principal. SIgue estos pasos para consultar el ejemplo.

En la definición del sistema SAP HANA secundario, especifica valores diferentes para las siguientes propiedades que los que especificaste en la definición del sistema SAP HANA principal:

nameinstanceNamezone

Crea las instancias:

gcloud deployment-manager deployments create DEPLOYMENT_NAME --config TEMPLATE_NAME.yaml

Mediante el comando anterior, se invoca a Deployment Manager, que implementa las VMs, descarga el software de SAP HANA del bucket de almacenamiento e instala SAP HANA, todo según las especificaciones del archivo

template.yaml.El procesamiento de la implementación consta de dos etapas. En la primera, Deployment Manager escribe su estado en la consola. En la segunda, las secuencias de comandos de implementación escriben su estado en Cloud Logging.

Ejemplo de un archivo de configuración template.yaml completo

En el siguiente ejemplo, se muestra un archivo de configuración template.yaml completo que implementa dos instancias de VMs con un sistema SAP HANA instalado.

El archivo contiene las definiciones de dos recursos para implementar: sap_hana_primary y sap_hana_secondary. Cada definición de recurso contiene las definiciones de una VM y una instancia de SAP HANA.

La definición del recurso sap_hana_secondary se creó cuando se copió y se pegó la primera definición y, luego, se modificaron los valores de las propiedades name, instanceName y zone. Todos los demás valores de propiedad en las dos definiciones de recursos son iguales.

Las propiedades networkTag, serviceAccount, sap_hana_sidadm_uid y sap_hana_sapsys_gid pertenecen a la sección Opciones avanzadas de la plantilla del archivo de configuración. Las propiedades sap_hana_sidadm_uid y sap_hana_sapsys_gid se incluyen para mostrar sus valores predeterminados, que se usan porque las propiedades se convertieron en comentarios.

resources:

- name: sap_hana_primary

type: https://storage.googleapis.com/cloudsapdeploy/deploymentmanager/latest/dm-templates/sap_hana/sap_hana.py

#

# By default, this configuration file uses the latest release of the deployment

# scripts for SAP on Google Cloud. To fix your deployments to a specific release

# of the scripts, comment out the type property above and uncomment the type property below.

#

# type: https://storage.googleapis.com/cloudsapdeploy/deploymentmanager/yyyymmddhhmm/dm-templates/sap_hana/sap_hana.py

#

properties:

instanceName: hana-ha-vm-1

instanceType: n2-highmem-32

zone: us-central1-a

subnetwork: example-subnet-us-central1

linuxImage: family/sles-15-sp1-sap

linuxImageProject: suse-sap-cloud

sap_hana_deployment_bucket: hana2-sp4-rev46

sap_hana_sid: HA1

sap_hana_instance_number: 22

sap_hana_sidadm_password: Tempa55word

sap_hana_system_password: Tempa55word

sap_hana_scaleout_nodes: 0

networkTag: cluster-ntwk-tag

serviceAccount: limited-roles@example-project-123456.

# sap_hana_sidadm_uid: 900

# sap_hana_sapsys_gid: 79

- name: sap_hana_secondary

type: https://storage.googleapis.com/cloudsapdeploy/deploymentmanager/latest/dm-templates/sap_hana/sap_hana.py

#

# By default, this configuration file uses the latest release of the deployment

# scripts for SAP on Google Cloud. To fix your deployments to a specific release

# of the scripts, comment out the type property above and uncomment the type property below.

#

# type: https://storage.googleapis.com/cloudsapdeploy/deploymentmanager/yyyymmddhhmm/dm-templates/sap_hana/sap_hana.py

#

properties:

instanceName: hana-ha-vm-2

instanceType: n2-highmem-32

zone: us-central1-c

subnetwork: example-subnet-us-central1

linuxImage: family/sles-15-sp1-sap

linuxImageProject: suse-sap-cloud

sap_hana_deployment_bucket: hana2-sp4-rev46

sap_hana_sid: HA1

sap_hana_instance_number: 22

sap_hana_sidadm_password: Google123

sap_hana_system_password: Google123

sap_hana_scaleout_nodes: 0

networkTag: cluster-ntwk-tag

serviceAccount: limited-roles@example-project-123456.

# sap_hana_sidadm_uid: 900

# sap_hana_sapsys_gid: 79

Crea reglas de firewall que permitan el acceso a las VM del host

Si aún no lo hiciste, crea reglas de firewall que permitan el acceso a cada VM del host desde las siguientes fuentes:

- Para fines de configuración, tu estación de trabajo local, un host de bastión o un servidor de salto

- Para el acceso entre los nodos del clúster, las otras VM del host en el clúster de HA

Cuando creas reglas de firewall de VPC, especificas las etiquetas de red que definiste en el archivo de configuración template.yaml para designar tus VM del host como destino de la regla.

Para verificar la implementación, define una regla que permita conexiones SSH en el puerto 22 desde un host de bastión o tu estación de trabajo local.

Para el acceso entre los nodos del clúster, agrega una regla de firewall que permita todos los tipos de conexiones en cualquier puerto de otras VM en la misma subred.

Asegúrate de que se creen las reglas de firewall para verificar la implementación y la comunicación dentro del clúster antes de continuar con la siguiente sección. Para obtener instrucciones, consulta Agrega reglas de firewall.

Verifica la implementación de las VMs y SAP HANA

Para verificar la implementación, revisa los registros de implementación en Cloud Logging y los discos y servicios en las VMs de los hosts principales y secundarios.

En la consola de Google Cloud , abre Cloud Logging para supervisar el progreso de la instalación y verificar si hay errores.

Filtra los registros:

Explorador de registros

En la página Explorador de registros, ve al panel Consulta.

En el menú desplegable Recurso, selecciona Global y, luego, haz clic en Agregar.

Si no ves la opción Global, ingresa la siguiente consulta en el editor de consultas:

resource.type="global" "Deployment"Haz clic en Ejecutar consulta.

Visor de registros heredado

- En la página Visor de registros heredado, en el menú del selector básico, selecciona Global como tu recurso de registro.

Analiza los registros filtrados:

- Si se muestra

"--- Finished", el proceso de implementación está completo y puedes continuar con el siguiente paso. Si ves un error de cuota, sigue estos pasos:

En la página Cuotas de IAM y administración, aumenta cualquiera de las cuotas que no cumplan con los requisitos de SAP HANA que se enumeran en la Guía de planificación de SAP HANA.

En la página Implementaciones de Deployment Manager, borra la implementación para limpiar las VMs y los discos persistentes de la instalación con errores.

Vuelve a ejecutar tu implementación.

- Si se muestra

Verifica la configuración de las VM y SAP HANA

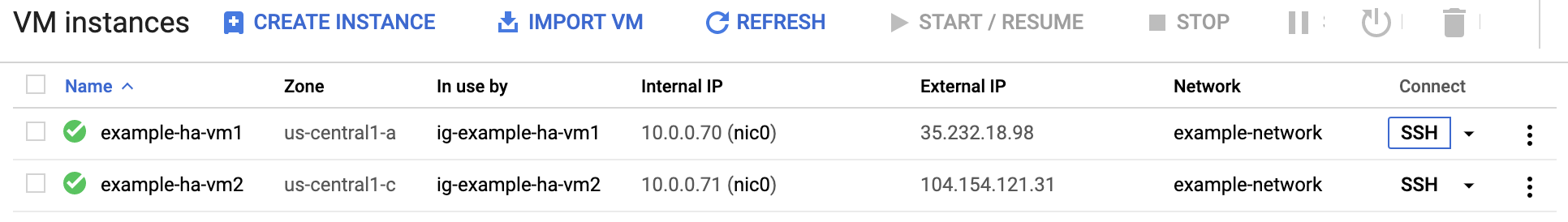

Después de que el sistema SAP HANA se implemente sin errores, conéctate a cada VM mediante una conexión SSH. En la página Instancias de VM de Compute Engine, puedes hacer clic en el botón SSH para cada instancia de VM o usar tu método SSH preferido.

Cambia al usuario raíz.

$sudo su -En el símbolo del sistema, ingresa

df -h. En cada VM, asegúrate de ver los directorios/hana, como/hana/data.Filesystem Size Used Avail Use% Mounted on /dev/sda2 30G 4.0G 26G 14% / devtmpfs 126G 0 126G 0% /dev tmpfs 126G 0 126G 0% /dev/shm tmpfs 126G 17M 126G 1% /run tmpfs 126G 0 126G 0% /sys/fs/cgroup /dev/sda1 200M 9.7M 191M 5% /boot/efi /dev/mapper/vg_hana-shared 251G 49G 203G 20% /hana/shared /dev/mapper/vg_hana-sap 32G 240M 32G 1% /usr/sap /dev/mapper/vg_hana-data 426G 7.0G 419G 2% /hana/data /dev/mapper/vg_hana-log 125G 4.2G 121G 4% /hana/log /dev/mapper/vg_hanabackup-backup 512G 33M 512G 1% /hanabackup tmpfs 26G 0 26G 0% /run/user/900 tmpfs 26G 0 26G 0% /run/user/899 tmpfs 26G 0 26G 0% /run/user/1000

En el siguiente comando, reemplaza

SID_LCcon el ID del sistema que especificaste en la plantilla del archivo de configuración para cambiar al usuario administrador de SAP. Usa minúsculas para las letras.#su - SID_LCadmEjecuta el siguiente comando para asegurarte de que los servicios de SAP HANA, como

hdbnameserver,hdbindexservery otros, se ejecuten en la instancia:>HDB infoSi usas RHEL para SAP 9.0 o una versión posterior, asegúrate de que los paquetes

chkconfigycompat-openssl11estén instalados en la instancia de VM.Para obtener más información de SAP, consulta la Nota 3108316 de SAP: Red Hat Enterprise Linux 9.x: Instalación y configuración.

Valida la instalación del agente de Google Cloudpara SAP

Después de que hayas implementado una VM y le hayas instalado SAP NetWeaver, valida que el agente deGoogle Cloudpara SAP funcione de forma correcta.

Verifica que el agente de Google Cloudpara SAP esté en ejecución

Para verificar que el agente esté en ejecución, sigue estos pasos:

Establece una conexión SSH con tu instancia de Compute Engine.

Ejecuta el siguiente comando:

systemctl status google-cloud-sap-agent

Si el agente funciona de forma correcta, el resultado contendrá

active (running). Por ejemplo:google-cloud-sap-agent.service - Google Cloud Agent for SAP Loaded: loaded (/usr/lib/systemd/system/google-cloud-sap-agent.service; enabled; vendor preset: disabled) Active: active (running) since Fri 2022-12-02 07:21:42 UTC; 4 days ago Main PID: 1337673 (google-cloud-sa) Tasks: 9 (limit: 100427) Memory: 22.4 M (max: 1.0G limit: 1.0G) CGroup: /system.slice/google-cloud-sap-agent.service └─1337673 /usr/bin/google-cloud-sap-agent

Si el agente no está en ejecución, reinicia el agente.

Verifica que SAP Host Agent reciba métricas

Para verificar que el agente deGoogle Cloudpara SAP recopile las métricas de infraestructura y que se envíen de forma correcta al agente de host SAP, sigue estos pasos:

- En el sistema SAP, ingresa la transacción

ST06. En el panel de descripción general, revisa la disponibilidad y el contenido de los siguientes campos para verificar la configuración completa y correcta de la infraestructura de supervisión de SAP y Google:

- Proveedor de servicios en la nube:

Google Cloud Platform - Acceso de supervisión mejorada:

TRUE - Detalles de supervisión mejorada:

ACTIVE

- Proveedor de servicios en la nube:

Configura la supervisión para SAP HANA

De manera opcional, puedes supervisar tus instancias de SAP HANA con el agente de SAP deGoogle Cloud. Desde la versión 2.0, puedes configurar el agente para recopilar las métricas de supervisión de SAP HANA y enviarlas a Cloud Monitoring. Cloud Monitoring te permite crear paneles para visualizar estas métricas, configurar alertas basadas en límites de métricas y mucho más.

Si deseas obtener más información sobre la recopilación de métricas de supervisión de SAP HANA a través del agente deGoogle Cloudpara SAP, consulta Recopilación de métricas de supervisión de SAP HANA.

Inhabilita el inicio automático de SAP HANA

Asegúrate de que el inicio automático de SAP HANA esté inhabilitado para cada instancia de SAP HANA en el clúster. Para las conmutaciones por error, Pacemaker administra el inicio y la detención de las instancias de SAP HANA en un clúster.

En cada host como SID_LCadm, detén SAP HANA:

>HDB stopEn cada host, abre el perfil de SAP HANA con un editor, como "vi":

vi /usr/sap/SID/SYS/profile/SID_HDBINST_NUM_HOST_NAME

Establece la propiedad

Autostarten0:Autostart=0

Guarda el perfil.

En cada host como SID_LCadm, inicia SAP HANA:

>HDB start

Habilita SAP HANA Fast Restart

Google Cloud Recomienda enfáticamente habilitar SAP HANA Fast Restart para cada instancia de SAP HANA, en especial para instancias más grandes. SAP HANA Fast Restart reduce los tiempos de reinicio en caso de que SAP HANA finalice, pero el sistema operativo permanezca en ejecución.

Como se establece en las secuencias de comandos de automatización que proporciona Google Cloud , la configuración del kernel y el sistema operativo ya son compatibles con el reinicio rápido de SAP HANA.

Debes definir el sistema de archivos tmpfs y configurar SAP HANA.

Para definir el sistema de archivos tmpfs y configurar SAP HANA, puedes seguir los pasos manuales o usar la secuencia de comandos de automatización que proporcionaGoogle Cloud para habilitar el reinicio rápido de SAP HANA. Para obtener más información, consulta los siguientes vínculos:

- Pasos manuales: Habilita el reinicio rápido de SAP HANA

- Pasos manuales: Habilita el reinicio rápido de SAP HANA

Para obtener instrucciones autorizadas completas sobre Fast Restart SAP HANA, consulta la documentación de la opción Fast Restart SAP HANA.

Pasos manuales

Configura el sistema de archivos tmpfs

Después de que las VM del host y los sistemas base de SAP HANA se implementan de forma correcta, debes crear y activar directorios para los nodos de NUMA en el sistema de archivos tmpfs.

Muestra la topología de NUMA de tu VM

Para poder asignar el sistema de archivos tmpfs requerido, debes saber cuántos nodos de NUMA tiene tu VM. Si deseas mostrar los nodos de NUMA disponibles en una VM de Compute Engine, ingresa el siguiente comando:

lscpu | grep NUMA

Por ejemplo, un tipo de VM m2-ultramem-208 tiene cuatro nodos de NUMA, numerados del 0 al 3, como se muestra en el siguiente ejemplo:

NUMA node(s): 4 NUMA node0 CPU(s): 0-25,104-129 NUMA node1 CPU(s): 26-51,130-155 NUMA node2 CPU(s): 52-77,156-181 NUMA node3 CPU(s): 78-103,182-207

Crea los directorios de nodos de NUMA

Crea un directorio para cada nodo de NUMA en tu VM y configura los permisos.

Por ejemplo, para cuatro nodos de NUMA que están numerados del 0 al 3:

mkdir -pv /hana/tmpfs{0..3}/SID

chown -R SID_LCadm:sapsys /hana/tmpfs*/SID

chmod 777 -R /hana/tmpfs*/SIDActiva los directorios de nodos de NUMA en tmpfs

Activa los directorios del sistema de archivos tmpfs y especifica una preferencia de nodo de NUMA para cada uno con mpol=prefer:

SID especifica el SID con letras mayúsculas.

mount tmpfsSID0 -t tmpfs -o mpol=prefer:0 /hana/tmpfs0/SID mount tmpfsSID1 -t tmpfs -o mpol=prefer:1 /hana/tmpfs1/SID mount tmpfsSID2 -t tmpfs -o mpol=prefer:2 /hana/tmpfs2/SID mount tmpfsSID3 -t tmpfs -o mpol=prefer:3 /hana/tmpfs3/SID

Actualizar /etc/fstab

Para asegurarte de que los puntos de activación estén disponibles después de reiniciar el sistema operativo, agrega entradas a la tabla del sistema de archivos, /etc/fstab:

tmpfsSID0 /hana/tmpfs0/SID tmpfs rw,nofail,relatime,mpol=prefer:0 tmpfsSID1 /hana/tmpfs1/SID tmpfs rw,nofail,relatime,mpol=prefer:1 tmpfsSID1 /hana/tmpfs2/SID tmpfs rw,nofail,relatime,mpol=prefer:2 tmpfsSID1 /hana/tmpfs3/SID tmpfs rw,nofail,relatime,mpol=prefer:3

Opcional: Establece límites para el uso de memoria

El sistema de archivos tmpfs puede aumentar o reducirse de forma dinámica.

A fin de limitar la memoria que usa el sistema de archivos tmpfs, puedes establecer un límite de tamaño para un volumen de nodo NUMA con la opción size.

Por ejemplo:

mount tmpfsSID0 -t tmpfs -o mpol=prefer:0,size=250G /hana/tmpfs0/SID

También puedes limitar el uso de memoria tmpfs general de todos los nodos de NUMA para una instancia determinada de SAP HANA y un nodo del servidor determinado si configuras el parámetro persistent_memory_global_allocation_limit en la sección [memorymanager] del archivo global.ini.

Configuración de SAP HANA para Fast Restart

A fin de configurar SAP HANA para Fast Restart, actualiza el archivo global.ini y especifica las tablas que se almacenarán en la memoria persistente.

Actualiza la sección [persistence] en el archivo global.ini

Configura la sección [persistence] en el archivo global.ini de SAP HANA para hacer referencia a las ubicaciones de tmpfs. Separa cada ubicación de tmpfs con un punto y coma:

[persistence] basepath_datavolumes = /hana/data basepath_logvolumes = /hana/log basepath_persistent_memory_volumes = /hana/tmpfs0/SID;/hana/tmpfs1/SID;/hana/tmpfs2/SID;/hana/tmpfs3/SID

En el ejemplo anterior, se especifican cuatro volúmenes de memoria para cuatro nodos de NUMA, que corresponden a m2-ultramem-208. Si ejecutas en el m2-ultramem-416, debes configurar ocho volúmenes de memoria (0..7).

Reinicia SAP HANA después de modificar el archivo global.ini.

SAP HANA ahora puede usar la ubicación de tmpfs como espacio de memoria persistente.

Especifica las tablas que se almacenarán en la memoria persistente

Especifica particiones o tablas de columnas específicas para almacenarlas en la memoria persistente.

Por ejemplo, para activar la memoria persistente en una tabla existente, ejecuta la consulta de SQL:

ALTER TABLE exampletable persistent memory ON immediate CASCADE

Para cambiar el valor predeterminado de las tablas nuevas, agrega el parámetro table_default en el archivo indexserver.ini. Por ejemplo:

[persistent_memory] table_default = ON

Para obtener más información sobre cómo controlar las columnas, las tablas y qué vistas de supervisión proporcionan información detallada, consulta Memoria persistente de SAP HANA.

Pasos automatizados

La secuencia de comandos de automatización que proporciona Google Cloud para habilitar el reinicio rápido de SAP HANA realiza cambios en los directorios /hana/tmpfs*, el archivo /etc/fstab y la configuración de SAP HANA. Cuando ejecutas la secuencia de comandos, es posible que debas realizar pasos adicionales en función de si esta es la implementación inicial de tu sistema SAP HANA o de cambiar el tamaño de la máquina a un tamaño de NUMA diferente.

Para la implementación inicial de tu sistema SAP HANA o cambio del tamaño de la máquina a fin de aumentar la cantidad de nodos de NUMA, asegúrate de que SAP HANA se ejecute durante la ejecución de la secuencia de comandos de automatización que proporciona Google Cloudpara habilitar el reinicio rápido de SAP HANA.

Cuando cambies el tamaño de tu máquina para disminuir la cantidad de nodos de NUMA, asegúrate de que SAP HANA se detenga durante la ejecución de la secuencia de comandos de automatización que proporciona Google Cloud para habilitar el reinicio rápido de SAP HANA. Después de ejecutar la secuencia de comandos, debes actualizar de forma manual la configuración de SAP HANA para completar la configuración de reinicio rápido de SAP HANA. Para obtener más información, consulta Configuración de SAP HANA para un reinicio rápido.

Para habilitar el reinicio rápido de SAP HANA, sigue estos pasos:

Establece una conexión SSH con la VM del host.

Cambiar a la raíz:

sudo su -

Descarga la secuencia de comandos

sap_lib_hdbfr.sh:wget https://storage.googleapis.com/cloudsapdeploy/terraform/latest/terraform/lib/sap_lib_hdbfr.sh

Haz que el archivo sea ejecutable:

chmod +x sap_lib_hdbfr.sh

Verifica que la configuración no tenga errores:

vi sap_lib_hdbfr.sh ./sap_lib_hdbfr.sh -help

Si el comando muestra un error, comunícate con el servicio de Atención al cliente de Cloud. Si deseas obtener más información para comunicarte con el equipo de Atención al cliente, consulta Obtén asistencia para SAP en Google Cloud.

Ejecuta la secuencia de comandos después de reemplazar el ID del sistema SAP HANA (SID) y la contraseña para el usuario SYSTEM de la base de datos SAP HANA. Para proporcionar la contraseña de forma segura, te recomendamos que uses un secreto en Secret Manager.

Ejecuta la secuencia de comandos con el nombre de un secreto en Secret Manager. Este secreto debe existir en el proyecto de Google Cloud que contiene tu instancia de VM del host.

sudo ./sap_lib_hdbfr.sh -h 'SID' -s SECRET_NAME

Reemplaza lo siguiente:

SID: Especifica el SID con letras mayúsculas. Por ejemplo,AHA.SECRET_NAME: Especifica el nombre del secreto que corresponde a la contraseña del usuario del sistema de la base de datos de SAP HANA. Este secreto debe existir en el Google Cloud proyecto que contiene tu instancia de VM del host.

Como alternativa, puedes ejecutar la secuencia de comandos con una contraseña de texto sin formato. Después de habilitar el reinicio rápido de SAP HANA, asegúrate de cambiar la contraseña. No se recomienda usar una contraseña con texto sin formato, ya que tu contraseña se registraría en el historial de línea de comandos de tu VM.

sudo ./sap_lib_hdbfr.sh -h 'SID' -p 'PASSWORD'

Reemplaza lo siguiente:

SID: Especifica el SID con letras mayúsculas. Por ejemplo,AHA.PASSWORD: Especifica la contraseña para el usuario del sistema de la base de datos de SAP HANA.

Para obtener una ejecución inicial exitosa, deberías ver un resultado similar al siguiente:

INFO - Script is running in standalone mode

ls: cannot access '/hana/tmpfs*': No such file or directory

INFO - Setting up HANA Fast Restart for system 'TST/00'.

INFO - Number of NUMA nodes is 2

INFO - Number of directories /hana/tmpfs* is 0

INFO - HANA version 2.57

INFO - No directories /hana/tmpfs* exist. Assuming initial setup.

INFO - Creating 2 directories /hana/tmpfs* and mounting them

INFO - Adding /hana/tmpfs* entries to /etc/fstab. Copy is in /etc/fstab.20220625_030839

INFO - Updating the HANA configuration.

INFO - Running command: select * from dummy

DUMMY

"X"

1 row selected (overall time 4124 usec; server time 130 usec)

INFO - Running command: ALTER SYSTEM ALTER CONFIGURATION ('global.ini', 'SYSTEM') SET ('persistence', 'basepath_persistent_memory_volumes') = '/hana/tmpfs0/TST;/hana/tmpfs1/TST;'

0 rows affected (overall time 3570 usec; server time 2239 usec)

INFO - Running command: ALTER SYSTEM ALTER CONFIGURATION ('global.ini', 'SYSTEM') SET ('persistent_memory', 'table_unload_action') = 'retain';

0 rows affected (overall time 4308 usec; server time 2441 usec)

INFO - Running command: ALTER SYSTEM ALTER CONFIGURATION ('indexserver.ini', 'SYSTEM') SET ('persistent_memory', 'table_default') = 'ON';

0 rows affected (overall time 3422 usec; server time 2152 usec)

Configura claves SSH en las VM principales y secundarias

Las claves del almacenamiento seguro (SSFS) de SAP HANA deben sincronizarse entre los hosts en el clúster de alta disponibilidad. Estas instrucciones te permiten crear conexiones SSH raíz entre los dos hosts para simplificar la sincronización y permitir que se copien archivos como las copias de seguridad entre los hosts del clúster de alta disponibilidad.

Es probable que tu organización tenga lineamientos que rijan las comunicaciones de red internas. Si es necesario, después de completar la implementación, puedes quitar los metadatos de las VM y las claves del directorio authorized_keys.

Si configurar conexiones SSH directas no cumple con los lineamientos de tu organización, puedes sincronizar las claves SSFS y transferir archivos mediante otros métodos, como los que se mencionan a continuación:

- Transfiere archivos más pequeños a través de tu estación de trabajo local mediante las opciones del menú Subir archivo y Descargar archivo de Cloud Shell. Consulta Administra archivos con Cloud Shell.

- Intercambia archivos mediante un bucket de Google Cloud Storage. Consulta Trabaja con objetos en la documentación de Cloud Storage.

- Usa el agente de Backint de Cloud Storage para SAP HANA a fin de crear una copia de seguridad y restablecer las bases de datos de HANA. Consulta Agente de Backint de Cloud Storage para SAP HANA.

- Usa una solución de almacenamiento de archivos como Filestore o Google Cloud NetApp Volumes para crear una carpeta compartida. Para obtener más información, consulta Opciones del servidor de archivos.

Para habilitar las conexiones SSH entre la instancia principal y la secundaria, haz lo que se indica a continuación.

En la VM host principal, sigue estos pasos:

Conéctate a la VM mediante SSH.

Cambiar a la raíz:

$sudo su -Como raíz, genera una clave SSH.

#ssh-keygenActualiza los metadatos de la VM principal con información sobre la clave SSH para la VM secundaria.

#gcloud compute instances add-metadata secondary-host-name \ --metadata "ssh-keys=$(whoami):$(cat ~/.ssh/id_rsa.pub)" --zone secondary-zoneAutoriza la VM principal a sí misma

#cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys

En la VM secundaria del host, sigue estos pasos:

Conéctate a la VM mediante SSH.

Cambiar a la raíz:

$sudo su -Como raíz, genera una clave SSH.

#ssh-keygenActualiza los metadatos de la VM secundaria con información sobre la clave SSH para la VM principal.

#gcloud compute instances add-metadata primary-host-name \ --metadata "ssh-keys=$(whoami):$(cat ~/.ssh/id_rsa.pub)" --zone primary-zoneAutoriza la VM secundaria a sí misma

#cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keysPara confirmar que las claves SSH estén configuradas correctamente, abre una conexión SSH desde el sistema secundario al principal.

#ssh primary-host-name

En la VM host principal como raíz, abre una conexión SSH a la VM host secundaria para confirmar la conexión:

#ssh secondary-host-name

Crea un usuario de base de datos de SAP HANA para supervisar el estado del clúster

En el host principal, como

SID_LCadm, accede a la terminal interactiva de la base de datos de SAP HANA:>hdbsql -u system -p "system-password" -i inst_numEn la terminal interactiva, crea el usuario de base de datos

slehasync:=>CREATE USER slehasync PASSWORD "hdb-user-password";=>GRANT CATALOG READ TO slehasync;=>GRANT MONITOR ADMIN TO slehasync;=>ALTER USER slehasync DISABLE PASSWORD LIFETIME;Como

SID_LCadm, define la clave de usuarioSLEHALOCen el almacenamiento seguro del usuario de SAP HANA (hdbuserstore):>PATH="$PATH:/usr/sap/SID/HDBinst_num/exe">hdbuserstore SET SLEHALOC localhost:3inst_num15 slehasync hdb-user-password

Crea una copia de seguridad de las bases de datos

Crea copias de seguridad de tus bases de datos a fin de iniciar el registro de la base de datos para la replicación del sistema SAP HANA y crear un punto de recuperación.

Si tienes varias bases de datos de usuarios en una configuración de MDC, crea una copia de seguridad de cada una de ellas.

La plantilla de Deployment Manager usa /hanabackup/data/SID como directorio de copia de seguridad predeterminado.

Sigue estos pasos para crear copias de seguridad de bases de datos nuevas de SAP HANA:

En el host principal, cambia a

SID_LCadm. El comando puede ser diferente según la imagen de SO.sudo -i -u SID_LCadm

Crea copias de seguridad de las bases de datos:

Para un sistema de contenedor de base de datos único de SAP HANA, ejecuta este comando:

>hdbsql -t -u system -p SYSTEM_PASSWORD -i INST_NUM \ "backup data using file ('full')"En el siguiente ejemplo, se muestra una respuesta exitosa de un sistema SAP HANA nuevo:

0 rows affected (overall time 18.416058 sec; server time 18.414209 sec)

Para un sistema de contenedores de varias bases de datos (MDC) de SAP HANA, crea una copia de seguridad de la base de datos del sistema y de todas las bases de datos de usuarios:

>hdbsql -t -d SYSTEMDB -u system -p SYSTEM_PASSWORD -i INST_NUM \ "backup data using file ('full')">hdbsql -t -d SID -u system -p SYSTEM_PASSWORD -i INST_NUM \ "backup data using file ('full')"

En el siguiente ejemplo, se muestra una respuesta exitosa de un sistema SAP HANA nuevo:

0 rows affected (overall time 16.590498 sec; server time 16.588806 sec)

Confirma que el modo de registro esté configurado en normal:

>hdbsql -u system -p SYSTEM_PASSWORD -i INST_NUM \ "select value from "SYS"."M_INIFILE_CONTENTS" where key='log_mode'"Deberías ver lo siguiente:

VALUE "normal"

Habilita la replicación del sistema SAP HANA

Como parte de la habilitación de la replicación del sistema SAP HANA, debes copiar los datos y los archivos de claves de los almacenes seguros de SAP HANA en el sistema de archivos (SSFS) del host principal al secundario. El método que usa este procedimiento para copiar los archivos es solo uno de los métodos que se pueden usar.

En el host principal como

SID_LCadm, habilita la replicación del sistema:>hdbnsutil -sr_enable --name=PRIMARY_HOST_NAMEEn el host secundario:

Como

SID_LCadm, detén SAP HANA:>HDB stopComo raíz, archiva los datos de SSFS y los archivos de claves existentes:

#cd /usr/sap/SID/SYS/global/security/rsecssfs/#mv data/SSFS_SID.DAT data/SSFS_SID.DAT-ARC#mv key/SSFS_SID.KEY key/SSFS_SID.KEY-ARCCopia el archivo de datos del host principal:

#scp -o StrictHostKeyChecking=no \ PRIMARY_HOST_NAME:/usr/sap/SID/SYS/global/security/rsecssfs/data/SSFS_SID.DAT \ /usr/sap/SID/SYS/global/security/rsecssfs/data/SSFS_SID.DATCopia el archivo de claves del host principal:

#scp -o StrictHostKeyChecking=no \ PRIMARY_HOST_NAME:/usr/sap/SID/SYS/global/security/rsecssfs/key/SSFS_SID.KEY \ /usr/sap/SID/SYS/global/security/rsecssfs/key/SSFS_SID.KEYActualiza la propiedad de los archivos:

#chown SID_LCadm:sapsys /usr/sap/SID/SYS/global/security/rsecssfs/data/SSFS_SID.DAT#chown SID_LCadm:sapsys /usr/sap/SID/SYS/global/security/rsecssfs/key/SSFS_SID.KEYActualiza los permisos de los archivos:

#chmod 644 /usr/sap/SID/SYS/global/security/rsecssfs/data/SSFS_SID.DAT#chmod 640 /usr/sap/SID/SYS/global/security/rsecssfs/key/SSFS_SID.KEYComo SID_LC, registra el sistema SAP HANA secundario con la replicación del sistema SAP HANA:

>hdbnsutil -sr_register --remoteHost=PRIMARY_HOST_NAME --remoteInstance=INST_NUM \ --replicationMode=syncmem --operationMode=logreplay --name=SECONDARY_HOST_NAMEComo SID_LCadm, inicia SAP HANA:

>HDB start

Valida la replicación del sistema

En el host principal como SID_LCadm, confirma que la replicación del sistema SAP HANA esté activa mediante la ejecución de la siguiente secuencia de comandos de Python:

$ python $DIR_INSTANCE/exe/python_support/systemReplicationStatus.pySi la replicación está configurada de forma correcta, entre otros indicadores, se muestran los siguientes valores para los servicios xsengine, nameserver y indexserver:

- El

Secondary Active StatusesYES. - El

Replication StatusesACTIVE.

Además, el overall system replication status muestra ACTIVE.

Instala los paquetes de HA necesarios

Para SLES para SAP 15 SP6 o versiones posteriores, se recomienda usar el paquete SAPHanaSR-angi. Para SLES para SAP 15 SP5 o versiones anteriores, puedes usar el paquete SAPHanaSR.

Para instalar el paquete

SAPHanaSR, ejecuta el siguiente comando como usuario raíz:zypper install SAPHanaSR

Para instalar el paquete

SAPHanaSR-angi, ejecuta el siguiente comando como usuario raíz:Si los paquetes

SAPHanaSRoSAPHanaSR-docya están instalados, quítalos:zypper remove SAPHanaSR SAPHanaSR-doc

Instala el paquete

SAPHanaSR-angi:zypper install SAPHanaSR-angi

Habilita los hooks del proveedor de HA/DR de SAP HANA

SUSE recomienda que habilites los hooks del proveedor de HA/DR de SAP HANA, que permiten que SAP HANA envíe notificaciones para ciertos eventos y mejora la detección de fallas.

Los hooks del proveedor de HA/DR de SAP HANA requieren SAP HANA 2.0 SPS 03 o una versión posterior para el hook SAPHanaSR, y SAP HANA 2.0 SPS 05 o una versión posterior para el hook SAPHanaSR-angi.

En el sitio principal y secundario, completa los siguientes pasos:

Como

SID_LCadm, detén SAP HANA:>HDB stop

Como raíz o

SID_LCadm, abre el archivoglobal.inipara editarlo:>vi /hana/shared/SID/global/hdb/custom/config/global.iniAgrega las siguientes definiciones al archivo

global.ini:SLES para SAP 15 SP5 o versiones anteriores

[ha_dr_provider_SAPHanaSR] provider = SAPHanaSR path = /usr/share/SAPHanaSR/ execution_order = 1 [ha_dr_provider_suschksrv] provider = susChkSrv path = /usr/share/SAPHanaSR/ execution_order = 3 action_on_lost = stop [trace] ha_dr_saphanasr = info

SLES para SAP 15 SP6 o posterior

[ha_dr_provider_susHanaSR] provider = susHanaSR path = /usr/share/SAPHanaSR-angi execution_order = 1 [ha_dr_provider_suschksrv] provider = susChkSrv path = /usr/share/SAPHanaSR-angi execution_order = 3 action_on_lost = stop [ha_dr_provider_susTkOver] provider = susTkOver path = /usr/share/SAPHanaSR-angi execution_order = 1 sustkover_timeout = 30 [trace] ha_dr_sushanasr = info ha_dr_suschksrv = info ha_dr_sustkover = info

Como raíz, crea un archivo de configuración personalizado en el directorio

/etc/sudoers.dmediante la ejecución del siguiente comando. Este archivo de configuración nuevo permite que el usuarioSID_LCadmacceda a los atributos del nodo del clúster cuando se llama al método de hooksrConnectionChanged().>visudo -f /etc/sudoers.d/SAPHanaSREn el archivo

/etc/sudoers.d/SAPHanaSR, agrega el siguiente texto:SLES para SAP 15 SP5 o versiones anteriores

Reemplaza lo siguiente:

SITE_A: Es el nombre del sitio del servidor principal de SAP HANA.SITE_B: Es el nombre del sitio del servidor secundario de SAP HANASID_LC: Es el SID, especificado con letras minúsculas.

crm_mon -A1 | grep sitecomo usuario raíz en el servidor principal de SAP HANA o en el servidor secundario.Cmnd_Alias SOK_SITEA = /usr/sbin/crm_attribute -n hana_SID_LC_site_srHook_SITE_A -v SOK -t crm_config -s SAPHanaSR Cmnd_Alias SFAIL_SITEA = /usr/sbin/crm_attribute -n hana_SID_LC_site_srHook_SITE_A -v SFAIL -t crm_config -s SAPHanaSR Cmnd_Alias SOK_SITEB = /usr/sbin/crm_attribute -n hana_SID_LC_site_srHook_SITE_B -v SOK -t crm_config -s SAPHanaSR Cmnd_Alias SFAIL_SITEB = /usr/sbin/crm_attribute -n hana_SID_LC_site_srHook_SITE_B -v SFAIL -t crm_config -s SAPHanaSR SID_LCadm ALL=(ALL) NOPASSWD: SOK_SITEA, SFAIL_SITEA, SOK_SITEB, SFAIL_SITEB

SLES para SAP 15 SP6 o posterior

Reemplaza lo siguiente:

SITE_A: Es el nombre del sitio del servidor principal de SAP HANA.SITE_B: Es el nombre del sitio del servidor secundario de SAP HANASID_LC: Es el SID, especificado con letras minúsculas.

crm_mon -A1 | grep sitecomo usuario raíz, en el servidor principal de SAP HANA o en el servidor secundario.Cmnd_Alias SOK_SITEA = /usr/sbin/crm_attribute -n hana_SID_LC_site_srHook_SITE_A -v SOK -t crm_config -s SAPHanaSR Cmnd_Alias SFAIL_SITEA = /usr/sbin/crm_attribute -n hana_SID_LC_site_srHook_SITE_A -v SFAIL -t crm_config -s SAPHanaSR Cmnd_Alias SOK_SITEB = /usr/sbin/crm_attribute -n hana_SID_LC_site_srHook_SITE_B -v SOK -t crm_config -s SAPHanaSR Cmnd_Alias SFAIL_SITEB = /usr/sbin/crm_attribute -n hana_SID_LC_site_srHook_SITE_B -v SFAIL -t crm_config -s SAPHanaSR Cmnd_Alias HOOK_HELPER = /usr/bin/SAPHanaSR-hookHelper --sid=SID --case=* SID_LCadm ALL=(ALL) NOPASSWD: SOK_SITEA, SFAIL_SITEA, SOK_SITEB, SFAIL_SITEB

En el archivo

/etc/sudoers, asegúrate de que se incluya el siguiente texto.Para SLES para SAP 15 SP3 o versiones posteriores:

@includedir /etc/sudoers.d

Para versiones hasta SLES para SAP 15 SP2:

#includedir /etc/sudoers.d

Ten en cuenta que el

#de este texto es parte de la sintaxis y no significa que la línea sea un comentario.

Como

SID_LCadm, inicia SAP HANA:>HDB startDespués de completar la configuración del clúster para SAP HANA, puedes verificar que el hook funcione de forma correcta durante una prueba de conmutación por error, como se describe en Soluciona problemas del hook de Python de SAPHanaSR y Apropiación del clúster de HA tarda demasiado en la falla del servidor de índices de HANA.

Configura la compatibilidad con la conmutación por error de Cloud Load Balancing

El servicio de balanceador de cargas de red de transferencia interno con compatibilidad con la conmutación por error enruta el tráfico al host activo en un clúster de SAP HANA basado en un servicio de verificación de estado.

Reserva una dirección IP para la IP virtual

La dirección IP virtual (VIP), que a veces se conoce como dirección IP flotante, sigue el sistema SAP HANA activo. El balanceador de cargas enruta el tráfico que se envía a la VIP hacia la VM que aloja el sistema SAP HANA activo.

Abre Cloud Shell:

Reserva una dirección IP para la IP virtual. Esta es la dirección IP que usan las aplicaciones para acceder a SAP HANA. Si omites la marca

--addresses, se elige una dirección IP en la subred especificada:$gcloud compute addresses create VIP_NAME \ --region CLUSTER_REGION --subnet CLUSTER_SUBNET \ --addresses VIP_ADDRESSPara obtener más información sobre cómo reservar una IP estática, consulta Reserva una dirección IP interna estática.

Confirma la reserva de la dirección IP:

$gcloud compute addresses describe VIP_NAME \ --region CLUSTER_REGIONDeberías ver un resultado similar al siguiente:

address: 10.0.0.19 addressType: INTERNAL creationTimestamp: '2020-05-20T14:19:03.109-07:00' description: '' id: '8961491304398200872' kind: compute#address name: vip-for-hana-ha networkTier: PREMIUM purpose: GCE_ENDPOINT region: https://www.googleapis.com/compute/v1/projects/example-project-123456/regions/us-central1 selfLink: https://www.googleapis.com/compute/v1/projects/example-project-123456/regions/us-central1/addresses/vip-for-hana-ha status: RESERVED subnetwork: https://www.googleapis.com/compute/v1/projects/example-project-123456/regions/us-central1/subnetworks/example-subnet-us-central1

Crea grupos de instancias para tus VM host

En Cloud Shell, crea dos grupos de instancias no administrados y asigna el VM host de instancia principal a uno y el VM host de instancia principal del secundario a la otra:

$gcloud compute instance-groups unmanaged create PRIMARY_IG_NAME \ --zone=PRIMARY_ZONE$gcloud compute instance-groups unmanaged add-instances PRIMARY_IG_NAME \ --zone=PRIMARY_ZONE \ --instances=PRIMARY_HOST_NAME$gcloud compute instance-groups unmanaged create SECONDARY_IG_NAME \ --zone=SECONDARY_ZONE$gcloud compute instance-groups unmanaged add-instances SECONDARY_IG_NAME \ --zone=SECONDARY_ZONE \ --instances=SECONDARY_HOST_NAMEConfirma la creación de los grupos de instancias:

$gcloud compute instance-groups unmanaged listDeberías ver un resultado similar al siguiente:

NAME ZONE NETWORK NETWORK_PROJECT MANAGED INSTANCES hana-ha-ig-1 us-central1-a example-network example-project-123456 No 1 hana-ha-ig-2 us-central1-c example-network example-project-123456 No 1

Crea una verificación de estado de Compute Engine

En Cloud Shell, crea la verificación de estado. Para el puerto que usa la verificación de estado, elige un puerto que esté en el rango privado, 49152-65535, a fin de evitar conflictos con otros servicios. Los valores de intervalo de verificación y tiempo de espera son un poco más largos que los valores predeterminados con el fin de aumentar la tolerancia a la conmutación por error durante los eventos de migración en vivo de Compute Engine. Puedes ajustar los valores si es necesario:

$gcloud compute health-checks create tcp HEALTH_CHECK_NAME --port=HEALTHCHECK_PORT_NUM \ --proxy-header=NONE --check-interval=10 --timeout=10 --unhealthy-threshold=2 \ --healthy-threshold=2Confirma la creación de la verificación de estado:

$gcloud compute health-checks describe HEALTH_CHECK_NAMEDeberías ver un resultado similar al siguiente:

checkIntervalSec: 10 creationTimestamp: '2020-05-20T21:03:06.924-07:00' healthyThreshold: 2 id: '4963070308818371477' kind: compute#healthCheck name: hana-health-check selfLink: https://www.googleapis.com/compute/v1/projects/example-project-123456/global/healthChecks/hana-health-check tcpHealthCheck: port: 60000 portSpecification: USE_FIXED_PORT proxyHeader: NONE timeoutSec: 10 type: TCP unhealthyThreshold: 2

Crea una regla de firewall para las verificaciones de estado

Define una regla de firewall para un puerto en el rango privado que permita el acceso a las VM de tu host desde los rangos de IP que usan las verificaciones de estado de Compute Engine, 35.191.0.0/16 y 130.211.0.0/22. Si deseas obtener más información, consulta Crea reglas de firewall para las verificaciones de estado.

Si aún no tienes una, agrega una etiqueta de red a las VM del host. La regla de firewall usa esta etiqueta de red para las verificaciones de estado.

$gcloud compute instances add-tags PRIMARY_HOST_NAME \ --tags NETWORK_TAGS \ --zone PRIMARY_ZONE$gcloud compute instances add-tags SECONDARY_HOST_NAME \ --tags NETWORK_TAGS \ --zone SECONDARY_ZONESi aún no tienes una, crea una regla de firewall para permitir las verificaciones de estado:

$gcloud compute firewall-rules create RULE_NAME \ --network NETWORK_NAME \ --action ALLOW \ --direction INGRESS \ --source-ranges 35.191.0.0/16,130.211.0.0/22 \ --target-tags NETWORK_TAGS \ --rules tcp:HLTH_CHK_PORT_NUMPor ejemplo:

gcloud compute firewall-rules create fw-allow-health-checks \ --network example-network \ --action ALLOW \ --direction INGRESS \ --source-ranges 35.191.0.0/16,130.211.0.0/22 \ --target-tags cluster-ntwk-tag \ --rules tcp:60000

Configura el balanceador de cargas y el grupo de conmutación por error

Crea el servicio de backend del balanceador de cargas:

$gcloud compute backend-services create BACKEND_SERVICE_NAME \ --load-balancing-scheme internal \ --health-checks HEALTH_CHECK_NAME \ --no-connection-drain-on-failover \ --drop-traffic-if-unhealthy \ --failover-ratio 1.0 \ --region CLUSTER_REGION \ --global-health-checksAgrega el grupo de instancias principal al servicio de backend:

$gcloud compute backend-services add-backend BACKEND_SERVICE_NAME \ --instance-group PRIMARY_IG_NAME \ --instance-group-zone PRIMARY_ZONE \ --region CLUSTER_REGIONAgrega el grupo de instancias de conmutación por error secundario al servicio de backend:

$gcloud compute backend-services add-backend BACKEND_SERVICE_NAME \ --instance-group SECONDARY_IG_NAME \ --instance-group-zone SECONDARY_ZONE \ --failover \ --region CLUSTER_REGIONCrea una regla de reenvío. En la dirección IP, especifica la dirección IP que reservaste para la VIP. Si necesitas acceder al sistema SAP HANA desde fuera de la región que se especifica a continuación, incluye la marca

--allow-global-accessen la definición:$gcloud compute forwarding-rules create RULE_NAME \ --load-balancing-scheme internal \ --address VIP_ADDRESS \ --subnet CLUSTER_SUBNET \ --region CLUSTER_REGION \ --backend-service BACKEND_SERVICE_NAME \ --ports ALLPara obtener más información sobre el acceso entre regiones al sistema de alta disponibilidad de SAP HANA, consulta Balanceo de cargas de TCP/UDP interno.

Prueba la configuración del balanceador de cargas

Aunque los grupos de instancias de backend no se registren como en buen estado, puedes probar la configuración del balanceador de cargas mediante la configuración de un objeto de escucha que responda a las verificaciones de estado. Después de configurar un objeto de escucha, si el balanceador de cargas está configurado de forma correcta, el estado de los grupos de instancias de backend cambia a en buen estado.

En las siguientes secciones, se presentan diferentes métodos que puedes usar para probar la configuración.

Prueba el balanceador de cargas con la utilidad socat

Puedes usar la utilidad socat para escuchar temporalmente en el puerto de verificación de estado. Debes instalar la utilidad socat de todos modos, ya que la usarás más adelante cuando configures los recursos del clúster.

En ambas VMs host como raíz, instala la utilidad

socat:#zypper install -y socatInicia un proceso

socatpara escuchar durante 60 segundos en el puerto de verificación de estado:#timeout 60s socat - TCP-LISTEN:HLTH_CHK_PORT_NUM,forkEn Cloud Shell, después de esperar algunos segundos para que la verificación de estado detecte el objeto de escucha, verifica el estado de tus grupos de instancias de backend:

$gcloud compute backend-services get-health BACKEND_SERVICE_NAME \ --region CLUSTER_REGIONDebería ver un resultado similar al siguiente:

--- backend: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-a/instanceGroups/hana-ha-ig-1 status: healthStatus: ‐ healthState: HEALTHY instance: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-a/instances/hana-ha-vm-1 ipAddress: 10.0.0.35 port: 80 kind: compute#backendServiceGroupHealth --- backend: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-c/instanceGroups/hana-ha-ig-2 status: healthStatus: ‐ healthState: HEALTHY instance: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-c/instances/hana-ha-vm-2 ipAddress: 10.0.0.34 port: 80 kind: compute#backendServiceGroupHealth

Prueba el balanceador de cargas mediante el puerto 22

Si el puerto 22 está abierto para conexiones SSH en las VM del host, puedes editar de manera temporal el verificador de estado a fin de usar el puerto 22, que tiene un objeto de escucha que puede responder al verificador de estado.

Para usar de forma temporal el puerto 22, sigue estos pasos:

Haz clic en la verificación de estado en la consola:

Haz clic en Editar.

En el campo Puerto, cambia el número de puerto a 22.

Haz clic en Guardar y espera uno o dos minutos.

En Cloud Shell, verifica el estado de tus grupos de instancias de backend:

$gcloud compute backend-services get-health BACKEND_SERVICE_NAME \ --region CLUSTER_REGIONDebería ver un resultado similar al siguiente:

--- backend: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-a/instanceGroups/hana-ha-ig-1 status: healthStatus: ‐ healthState: HEALTHY instance: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-a/instances/hana-ha-vm-1 ipAddress: 10.0.0.35 port: 80 kind: compute#backendServiceGroupHealth --- backend: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-c/instanceGroups/hana-ha-ig-2 status: healthStatus: ‐ healthState: HEALTHY instance: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-c/instances/hana-ha-vm-2 ipAddress: 10.0.0.34 port: 80 kind: compute#backendServiceGroupHealth

Cuando termines, vuelve a cambiar el número de puerto de verificación de estado al número de puerto original.

Configura Pacemaker

El siguiente procedimiento configura la implementación de SUSE de un clúster de Pacemaker en las VM de Compute Engine para SAP HANA.

Para obtener más información sobre la configuración de clústeres de alta disponibilidad en SLES, consulta la documentación de la extensión de alta disponibilidad de SUSE Linux Enterprise para tu versión de SLES.

Crea los archivos de configuración de Corosync

Crea un archivo de configuración de Corosync en el host principal:

Crea el siguiente archivo:

vi /etc/corosync/corosync.conf

En el archivo

corosync.confdel host principal, agrega la siguiente configuración y reemplaza el texto de la variable en cursiva por tus valores:totem { version: 2 secauth: off crypto_hash: sha1 crypto_cipher: aes256 cluster_name: hacluster clear_node_high_bit: yes token: 20000 token_retransmits_before_loss_const: 10 join: 60 max_messages: 20 transport: udpu interface { ringnumber: 0 Bindnetaddr: static-ip-of-hdb-on-this-host mcastport: 5405 ttl: 1 } } logging { fileline: off to_stderr: no to_logfile: no logfile: /var/log/cluster/corosync.log to_syslog: yes debug: off timestamp: on logger_subsys { subsys: QUORUM debug: off } } nodelist { node { ring0_addr: this-host-name nodeid: 1 } node { ring0_addr: other-host-name nodeid: 2 } } quorum { provider: corosync_votequorum expected_votes: 2 two_node: 1 }

Crea un archivo de configuración de Corosync en el host secundario mediante la repetición de los mismos pasos que usaste para el host principal. A excepción de la IP estática de la HDB en la propiedad

Bindnetaddry el orden de los nombres de host ennodelist, los valores de propiedad del archivo de configuración son los mismos para cada host.

Inicializa el clúster

En el host principal como raíz:

Cambia la contraseña del usuario

hacluster:#passwd haclusterInicializa el clúster:

#corosync-keygen#crm cluster init --yes ssh#crm cluster init -y csync2Inicia Pacemaker en el host principal:

#systemctl enable pacemaker#systemctl start pacemaker

En el host secundario como raíz:

Cambia la contraseña del usuario

hacluster:#passwd haclusterUne el host secundario al clúster que se inicializó en el host principal:

#crm cluster join --yes ssh#crm cluster join -y -c primary-host-name csync2Inicia Pacemaker en el host secundario:

#systemctl enable pacemaker#systemctl start pacemaker

En cualquiera de los hosts como raíz, confirma que el clúster muestre ambos nodos:

#crm_mon -sDebería ver un resultado similar al siguiente:

CLUSTER OK: 2 nodes online, 0 resources configured

Configura la protección

Para configurar la protección, debes definir un recurso de clúster con un agente de protección para cada VM del host.

A fin de garantizar la secuencia correcta de eventos después de una acción de protección, también debes configurar el sistema operativo para que retrase el reinicio de Corosync después de que se protege una VM. También debes ajustar el tiempo de espera de Pacemaker para los reinicios a fin de responder ante la demora.

Crea los recursos del dispositivo de protección

En el host principal como raíz, crea los recursos de protección:

#crm configure primitive STONITH-"primary-host-name" stonith:fence_gce \ op monitor interval="300s" timeout="120s" \ op start interval="0" timeout="60s" \ params port="primary-host-name" zone="primary-zone" project="project_id" \ pcmk_reboot_timeout=300 pcmk_monitor_retries=4 pcmk_delay_max=30#crm configure primitive STONITH-"secondary-host-name" stonith:fence_gce \ op monitor interval="300s" timeout="120s" \ op start interval="0" timeout="60s" \ params port="secondary-host-name" zone="secondary-zone" project="project_id" \ pcmk_reboot_timeout=300 pcmk_monitor_retries=4Establece la ubicación de cada dispositivo de protección:

#crm configure location LOC_STONITH_"primary-host-name" \ STONITH-"primary-host-name" -inf: "primary-host-name"#crm configure location LOC_STONITH_"secondary-host-name" \ STONITH-"secondary-host-name" -inf: "secondary-host-name"

Configura el clúster

Para configurar el clúster, debes definir las propiedades generales del clúster y los recursos básicos del clúster.

Habilita el modo de mantenimiento

En cualquier host como raíz, coloca el clúster en modo de mantenimiento:

#crm configure property maintenance-mode="true"

Configura las propiedades generales del clúster

En el host principal, configura las propiedades generales del clúster:

#crm configure property stonith-timeout="300s"#crm configure property stonith-enabled="true"#crm configure rsc_defaults resource-stickiness="1000"#crm configure rsc_defaults migration-threshold="5000"#crm configure op_defaults timeout="600"

Establece una demora para el reinicio de Corosync

En ambos hosts como raíz, crea un archivo directo

systemdque retrase el inicio de Corosync para garantizar la secuencia adecuada de eventos después de reiniciar una VM protegida:systemctl edit corosync.service

Agrega las siguientes líneas al archivo:

[Service] ExecStartPre=/bin/sleep 60

Guarda el archivo y sal del editor.

Vuelve a cargar la configuración del administrador del sistema.

systemctl daemon-reload

Confirma que se creó el archivo directo:

service corosync status

Deberías ver una línea para el archivo directo, como se muestra en el siguiente ejemplo:

● corosync.service - Corosync Cluster Engine Loaded: loaded (/usr/lib/systemd/system/corosync.service; disabled; vendor preset: disabled) Drop-In: /etc/systemd/system/corosync.service.d └─override.conf Active: active (running) since Tue 2021-07-20 23:45:52 UTC; 2 days ago

Crea un recurso de IP de clúster local para la dirección VIP

Para configurar la dirección VIP en el sistema operativo, crea un recurso de IP de clúster local para la dirección VIP que reservaste antes:

# crm configure primitive rsc_vip_int-primary IPaddr2 \

params ip=vip-address cidr_netmask=32 nic="eth0" op monitor interval=3600s timeout=60sConfigura el servicio de verificación de estado auxiliar

El balanceador de cargas usa un objeto de escucha en el puerto de verificación de estado de cada host para determinar dónde se ejecuta la instancia principal del clúster de SAP HANA.

A fin de administrar los objetos de escucha en el clúster, debes crear un recurso para el objeto de escucha.

Estas instrucciones usan la utilidad socat como objeto de escucha.

En ambos hosts como raíz, instala

socat utility:#zypper in -y socatEn el host principal, crea un recurso para el servicio de verificación de estado auxiliar:

#crm configure primitive rsc_healthcheck-primary anything \ params binfile="/usr/bin/socat" \ cmdline_options="-U TCP-LISTEN:healthcheck-port-num,backlog=10,fork,reuseaddr /dev/null" \ op monitor timeout=20s interval=10s \ op_params depth=0

Agrupa los recursos VIP y auxiliares del servicio de verificación de estado

Agrupa los recursos VIP y auxiliares del servicio de verificación de estado:

# crm configure group g-primary rsc_vip_int-primary rsc_healthcheck-primary meta resource-stickiness=0Crea el recurso básico SAPHanaTopology

Debes definir el recurso básico SAPHanaTopology en un archivo de configuración temporal, que luego subirás a Corosync.

En el host principal como raíz:

Crea un archivo de configuración temporal para los parámetros de configuración de

SAPHanaTopology:#vi /tmp/cluster.tmpCopia y pega las definiciones de recursos de SAPHanaTopology en el archivo

/tmp/cluster.tmp:SLES para SAP 15 SP5 o versiones anteriores

primitive rsc_SAPHanaTopology_SID_HDBinst_num ocf:suse:SAPHanaTopology \ operations \$id="rsc_sap2_SID_HDBinst_num-operations" \ op monitor interval="10" timeout="600" \ op start interval="0" timeout="600" \ op stop interval="0" timeout="300" \ params SID="SID" InstanceNumber="inst_num" clone cln_SAPHanaTopology_SID_HDBinst_num rsc_SAPHanaTopology_SID_HDBinst_num \ meta clone-node-max="1" target-role="Started" interleave="true"

SLES para SAP 15 SP6 o posterior

primitive rsc_SAPHanaTopology_SID_HDBinst_num ocf:suse:SAPHanaTopology \ operations \$id="rsc_sap2_SID_HDBinst_num-operations" \ op monitor interval="10" timeout="600" \ op start interval="0" timeout="600" \ op stop interval="0" timeout="300" \ params SID="SID" InstanceNumber="inst_num" clone cln_SAPHanaTopology_SID_HDBinst_num rsc_SAPHanaTopology_SID_HDBinst_num \ meta clone-node-max="1" interleave="true"

Edita el archivo

/tmp/cluster.tmppara reemplazar el texto de la variable con el SID y el número de instancia de tu sistema SAP HANA.En la instancia principal como raíz, carga el contenido del archivo

/tmp/cluster.tmpen Corosync:crm configure load update /tmp/cluster.tmp

Crea el recurso primitivo SAPHana o SAPHanaController

Debes definir el recurso con el mismo método que usaste para el recurso SAPHanaTopology: en un archivo de configuración temporal, que luego subirás a Corosync.

Reemplaza el archivo de configuración temporal:

#rm /tmp/cluster.tmp#vi /tmp/cluster.tmpCopia y pega las definiciones de recursos en el archivo

/tmp/cluster.tmp:SLES para SAP 15 SP5 o versiones anteriores

primitive rsc_SAPHana_SID_HDBinst_num ocf:suse:SAPHana \ operations \$id="rsc_sap_SID_HDBinst_num-operations" \ op start interval="0" timeout="3600" \ op stop interval="0" timeout="3600" \ op promote interval="0" timeout="3600" \ op demote interval="0" timeout="3600" \ op monitor interval="60" role="Master" timeout="700" \ op monitor interval="61" role="Slave" timeout="700" \ params SID="SID" InstanceNumber="inst_num" PREFER_SITE_TAKEOVER="true" DUPLICATE_PRIMARY_TIMEOUT="7200" AUTOMATED_REGISTER="true" ms msl_SAPHana_SID_HDBinst_num rsc_SAPHana_SID_HDBinst_num \ meta notify="true" clone-max="2" clone-node-max="1" \ target-role="Started" interleave="true" colocation col_saphana_ip_SID_HDBinst_num 4000: g-primary:Started \ msl_SAPHana_SID_HDBinst_num:Master order ord_SAPHana_SID_HDBinst_num Optional: cln_SAPHanaTopology_SID_HDBinst_num \ msl_SAPHana_SID_HDBinst_num

SLES para SAP 15 SP6 o posterior

primitive rsc_SAPHana_SID_HDBinst_num ocf:suse:SAPHanaController \ operations \$id="rsc_sap_SID_HDBinst_num-operations" \ op start interval="0" timeout="3600" \ op stop interval="0" timeout="3600" \ op promote interval="0" timeout="3600" \ op demote interval="0" timeout="3600" \ op monitor interval="60" role="Promoted" timeout="700" \ op monitor interval="61" role="Unpromoted" timeout="700" \ params SID="SID" InstanceNumber="inst_num" PREFER_SITE_TAKEOVER="true" \ DUPLICATE_PRIMARY_TIMEOUT="7200" AUTOMATED_REGISTER="true" clone mst_SAPHana_SID_HDBinst_num rsc_SAPHana_SID_HDBinst_num \ meta clone-node-max="1" interleave="true" promotable="true" colocation col_saphana_ip_SID_HDBinst_num 4000: g-primary:Started \ mst_SAPHana_SID_HDBinst_num:Promoted order ord_SAPHana_SID_HDBinst_num Optional: cln_SAPHanaTopology_SID_HDBinst_num \ mst_SAPHana_SID_HDBinst_num

Para un clúster de SAP HANA con alta disponibilidad de varios niveles, si usas una versión anterior a SAP HANA 2.0 SP03, configura

AUTOMATED_REGISTERcomofalse. Esto evita que una instancia recuperada intente registrarse para la replicación en un sistema HANA que ya tiene un destino de replicación configurado. Para SAP HANA 2.0 SP03 o versiones posteriores, puedes establecerAUTOMATED_REGISTERcomotruepara las configuraciones de SAP HANA que usan la replicación de sistemas de varios niveles.Para obtener información adicional, consulta: