Questa guida alla pianificazione fornisce agli Google Cloud amministratori SAP le informazioni di cui hanno bisogno per pianificare la replica dei dati SAP in BigQuery utilizzando la versione 2.8 (ultima) di BigQuery Connector per SAP con SAP LT Replication Server.

BigQuery Connector per SAP si installa in SAP Landscape Transformation Replication Server (SAP LT Replication Server) e consente la replica quasi in tempo reale dei dati SAP direttamente in BigQuery.

Con i dati in BigQuery, puoi eseguire analisi in tempo reale con l'intelligenza artificiale o il machine learning sui dati delle applicazioni SAP in tempo reale. In BigQuery puoi anche integrare i tuoi dati SAP con quelli di altre origini.

Questa guida tratta i seguenti argomenti:

- Panoramica di BigQuery Connector per SAP

- Architetture di installazione

- Requisiti software

- Sicurezza

- Networking

- Pianificazione del rendimento

- Opzioni di mappatura di tabelle e campi

- Ciclo di vita dell'assistenza

Per istruzioni dettagliate su come installare e configurare le repliche di SAP LT Replication Server con BigQuery Connector per SAP, consulta la guida all'installazione e alla configurazione di BigQuery Connector per SAP.

Per informazioni su BigQuery, consulta Che cos'è BigQuery?.

Per informazioni sugli acceleratori di soluzioni per la modellazione dei dati SAP in BigQuery, consulta Google Cloud Cortex Framework.

Panoramica del connettore BigQuery per SAP

Il connettore BigQuery per SAP utilizza le interfacce e le funzionalità standard di SAP Landscape Transformation Replication Server e supporta tutte le origini dati supportate da SAP LT Replication Server.

BigQuery Connector per SAP è fornito da Google Cloud in forma di file di trasporto da installare in SAP LT Replication Server.

Scarica il pacchetto di installazione contenente i file di trasporto prima di installare il connettore BigQuery per SAP. Anche se BigQuery Connector per SAP viene offerto senza costi, devi avere un account di fatturazione Cloud per ricevere il pacchetto di installazione. Per ulteriori informazioni, consulta la sezione Scaricare il pacchetto di installazione.

BigQuery Connector per SAP è un' Google Cloud implementazione di un plug-in di SAP (Business Add In, BAdI) per SAP LT Replication Server. BigQuery Connector per SAP è sviluppato da Google Cloud seguendo la procedura dell'SDK SAP LT Replication Server.

BigQuery Connector per SAP sfrutta la funzionalità di acquisizione dei dati sulle modifiche di SAP LT Replication Server.

Trattamento dati

BigQuery Connector per SAP invia i record SAP direttamente a BigQuery da SAP LT Replication Server senza alcun strumento o livello di integrazione dei dati intermedio.

Una volta ricevuti, BigQuery li aggiunge alla tabella in modalità di inserimento esclusivo. Se BigQuery riceve un aggiornamento di un record esistente nella tabella BigQuery, inserisce una nuova istanza del record nella tabella senza modificare l'istanza esistente. L'istanza del record inserita più di recente riflette lo stato corrente del record nella tabella di origine.

BigQuery Connector per SAP consente solo una trasformazione minima dei dati, in conformità a un modello estrazione, caricamento, trasformazione (ELT), diversamente da un modello estrazione, trasformazione e caricamento (ETL). Per ulteriori informazioni su questi modelli, consulta Procedure e pattern per le pipeline di dati.

Il connettore BigQuery per SAP suggerisce automaticamente i campi, i nomi dei campi e i tipi di dati per la tabella di destinazione in base ai dati di origine. Prima della creazione della tabella BigQuery di destinazione, puoi modificare i valori suggeriti in base alle tue esigenze.

I nomi suggeriti per i campi di destinazione si basano sulle descrizioni dei campi nella tabella di origine. Per ulteriori informazioni, consulta le opzioni di denominazione predefinite per i campi.

Sebbene BigQuery Connector per SAP suggerisca automaticamente i tipi di dati BigQuery per la maggior parte dei campi, i valori booleani, timestamp ed esadecimali non possono essere interpretati automaticamente, quindi devi mapparli manualmente. Per ulteriori informazioni, vedi Mappatura dei tipi di dati.

BigQuery Connector per SAP offre diversi punti di miglioramento in cui puoi inserire i tuoi miglioramenti personalizzati nel codice di BigQuery Connector per SAP. Per ulteriori informazioni, consulta la sezione Uscite di miglioramento.

Se una tabella di destinazione non esiste già in BigQuery, BigQuery Connector per SAP ne crea una.

Una volta avviata la replica, i record SAP vengono aggiunti a BigQuery in modalità di inserimento esclusivo.

Sicurezza

Controlla l'accesso a BigQuery Connector per SAP in SAP LT Replication Server utilizzando il sistema di autorizzazione basato sui ruoli di SAP LT Replication Server. Quando installi BigQuery Connector per SAP, i file di trasporto includono ruoli personalizzati per BigQuery Connector per SAP. Per ulteriori informazioni sui ruoli personalizzati, consulta Sicurezza SAP.

Controlli l'accesso a Google Cloud e BigQuery utilizzando l'autenticazione e l'autorizzazione di Identity and Access Management e l'autenticazione dell'API BigQuery. Per ulteriori informazioni, consulta Google Cloud security.

Per la comunicazione tra BigQuery Connector per SAP e BigQuery, BigQuery Connector per SAP utilizza la comunicazione HTTPS end-to-end e SSL.

Per informazioni di SAP sull'autorizzazione, consulta la Guida alla sicurezza per la tua versione di SAP LT Replication Server nel portale di assistenza SAP.

Scalabilità

Per volumi molto grandi, come miliardi di record di dati con milioni di delta, BigQuery Connector per SAP utilizza le funzioni di scalabilità e partizione di SAP LT Replication Server per parallelizzare l'estrazione dei dati su larga scala. Per ulteriori informazioni, consulta la guida alla definizione delle dimensioni per la tua versione di SAP LT Replication Server nel portale di assistenza SAP.

Sul lato BigQuery, BigQuery Connector per SAP utilizza l'API BigQuery Streaming per scalare il caricamento dei dati.

Architettura di installazione

Installa BigQuery Connector per SAP come componente aggiuntivo aziendale (BAdI) all'interno di un'istanza SAP LT Replication Server.

L'istanza SAP LT Replication Server può essere on Google Cloud, on-premise o su un altro provider cloud. SAP LT Replication Server deve essere eseguito il più vicino possibile al sistema di origine. Collabora con il team di rete per garantire bassa latenza e alta velocità effettiva tra il sistema SAP di origine, SAP LT Replication Server e il tuo set di dati BigQuery.

Le sezioni seguenti descrivono le architetture comuni consigliate per BigQuery Connector per SAP.

Architettura per le origini dati SAP su Google Cloud

Il seguente diagramma mostra due esempi di installazioni di SAP LT Replication Server su Google Cloud con l'origine dati SAP su Google Cloud.

Per mostrare un esempio di ciascuna architettura, un'installazione utilizza un'architettura autonoma di SAP LT Replication Server, in cui SAP LT Replication Server è installato su un server separato, mentre l'altra utilizza un'architettura incorporata di SAP LT Replication Server, in cui SAP LT Replication Server è installato nel server del sistema di origine SAP.

Poiché le istanze di SAP LT Replication Server sono installate su Google Cloud, BigQuery Connector per SAP si connette direttamente all'endpoint dell'API BigQuery, senza richiedere una connessione Cloud Interconnect o Cloud VPN.

Nel diagramma, i sistemi SAP e BigQuery sono indicati in progetti Google Cloud diversi, ma puoi utilizzare lo stesso progetto per entrambi, se necessario.

Architettura per le origini dati SAP on-premise o su un altro provider cloud

Il seguente diagramma mostra due esempi di installazioni di SAP LT Replication Server eseguite on-premise o su un altro provider cloud.

Per mostrare un esempio di ciascuna architettura, una delle installazioni utilizza un'architettura SAP LT Replication Server autonoma e l'altra un'architettura SAP LT Replication Server incorporata.

In entrambi gli esempi, SAP LT Replication Server è installato nello stesso ambiente dell'origine dati SAP.

La connessione da BigQuery Connector per SAP in SAP LT Replication Server a BigQuery è fornita da una connessione Cloud Interconnect o da una connessione Cloud VPN.

Visualizzazione dettagliata dell'architettura del flusso di dati

Il seguente diagramma mostra dove il connettore BigQuery per SAP rientra nel flusso di dati di SAP LT Replication Server.

I numeri nel diagramma sono spiegati sotto il diagramma.

Le seguenti spiegazioni numerate corrispondono ai numeri nel diagramma:

- Dopo l'inizializzazione di SAP LT Replication Server, quando i record nelle tabelle di origine vengono inseriti, aggiornati o eliminati, il database attiva la registrazione delle modifiche nelle tabelle di log.

- SAP LT Replication Server controlla continuamente le tabelle di log per verificare la presenza di nuove voci utilizzando le chiamate RFC.

- Se SAP LT Replication Server trova nuove voci, il motore di lettura legge i record e chiama il motore di mappatura e trasformazione.

- Il motore di mappatura e trasformazione chiama il motore di scrittura, che invoca il connettore BigQuery per SAP.

- BigQuery Connector per SAP esegue le seguenti azioni:

- Mappa i dati SAP al nome della tabella di destinazione, ai nomi dei campi e ai tipi di dati BigQuery.

- Se necessario, crea la tabella BigQuery.

- Invia i record a BigQuery in blocchi tramite l'API di streaming BigQuery.

- Al ricevimento dei dati, BigQuery esegue le seguenti azioni:

- Esegue controlli di convalida.

- Inserisce i record nella tabella di destinazione.

- Invia un codice di stato HTTP 200 (

OK) a BigQuery Connector per SAP.

- BigQuery Connector per SAP restituisce il codice di stato HTTP

OKa SAP LT Replication Server, che elimina le voci replicate dalla tabella di log e libera le risorse nel sistema di origine SAP.

Requisiti software

Questa sezione descrive i requisiti software per BigQuery Connector per SAP.

Puoi installare BigQuery Connector per SAP in SAP LT Replication Server su Google Cloud, on-premise o su cloud pubblici, come AWS, Azure e così via.

Requisiti della versione del software SAP

Le versioni richieste di SAP LT Replication Server e dei sistemi di origine SAP differiscono a seconda che tu installi SAP LT Replication Server su un server autonomo in un'architettura autonoma o all'interno del sistema di applicazioni ABAP di origine in un'architettura incorporata.

Anche i requisiti del software SAP sono diversi a seconda del sistema SAP utilizzato come origine dati: SAP S/4HANA o SAP ECC.

Per visualizzare le versioni software SAP supportate Google Cloud da BigQuery Connector per SAP, seleziona la scheda corrispondente al tuo sistema di origine SAP:

S/4HANA

| Architettura di installazione | Sistema | Versioni supportate | Componente aggiuntivo dell'interfaccia utente (UI) |

|---|---|---|---|

| Autonoma | Sistema di origine |

|

Assicurati che il componente aggiuntivo dell'interfaccia utente sia la versione più recente compatibile con la tua versione di SAP NetWeaver, come consigliato da SAP. /UI2/CL_JSON: PL12 o versioni successive. Per informazioni sulla versione minima richiesta del componente aggiuntivo dell'interfaccia utente, consulta la sezione "Pacchetto di assistenza" della nota SAP 22798102 - Correzioni /UI2/CL_JSON - PL12. Per informazioni sulla compatibilità del componente aggiuntivo dell'interfaccia utente con SAP NetWeaver, consulta:

|

| Sistema SAP LT Replication Server |

|

||

| Strato | Sistema di origine |

|

ECC

| Architettura di installazione | Sistema | Versioni supportate | Componente aggiuntivo dell'interfaccia utente (UI) |

|---|---|---|---|

| Autonoma | Sistema di origine |

|

Assicurati che il componente aggiuntivo dell'interfaccia utente sia la versione più recente compatibile con la tua versione di SAP NetWeaver, come consigliato da SAP. /UI2/CL_JSON: PL12 o versioni successive. Per informazioni sulla versione minima richiesta del componente aggiuntivo dell'interfaccia utente, consulta la sezione "Pacchetto di assistenza" della nota SAP 22798102 - Correzioni /UI2/CL_JSON - PL12. Per informazioni sulla compatibilità del componente aggiuntivo dell'interfaccia utente con SAP NetWeaver, consulta:

|

| Sistema SAP LT Replication Server |

|

||

| Strato | Sistema di origine |

|

Requisiti del sistema operativo

BigQuery Connector per SAP supporta qualsiasi sistema operativo supportato da SAP LT Replication Server.

Per informazioni sui sistemi operativi supportati da SAP LT Replication Server, consulta la matrice di disponibilità dei prodotti SAP.

Origini di replica supportate

BigQuery Connector per SAP supporta la maggior parte dei sistemi di origine di applicazioni e database di uso comune supportati da SAP LT Replication Server.

Origini delle applicazioni SAP supportate

Puoi replicare i dati dalle origini delle applicazioni SAP supportate da SAP LT Replication Server. BigQuery Connector per SAP supporta le principali versioni delle applicazioni aziendali in manutenzione come origini dati, nonché le applicazioni legacy precedenti. Alcune delle applicazioni SAP supportate sono:

- SAP Business Suite 7

- S/4HANA

- Applicazioni SAP in esecuzione su SAP NetWeaver

Per la replica dei dati da SAP Business Warehouse, SAP sconsiglia di utilizzare SAP LT Replication Server. Per ulteriori informazioni di SAP, consulta la nota SAP 2525755.

Le applicazioni cloud SAP, come S/4HANA Cloud, SAP Ariba, SAP SuccessFactors e altre, non sono supportate.

Origini dati supportate

Puoi replicare solo tabelle trasparenti o cluster.

BigQuery Connector per SAP non supporta la replica delle viste SAP Core Data Services (CDS).

In Information Design Tool, BigQuery è supportato a partire da SAP BusinessObjects Business Intelligence 4.3 come origine dati. Puoi eseguire query sui dati archiviati in BigQuery dagli strumenti di reporting SAP BusinessObjects, tra cui SAP BusinessObjects Web Intelligence e SAP Crystal Reports for Enterprise.

Per ulteriori informazioni sul controllo di compatibilità, consulta la nota SAP 2750723 - Supporto di Google BigQuery nei prodotti della piattaforma SAP BI.

Sicurezza

Quando implementi la sicurezza per la replica dei dati da SAP LT Replication Server a BigQuery, devi implementare i controlli di sicurezza in SAP LT Replication Server, nel sistema operativo host di SAP LT Replication Server e in Google Cloud.

Sicurezza SAP

Per controllare chi può configurare e utilizzare il connettore BigQuery per SAP in SAP LT Replication Server, utilizza l'autorizzazione basata sui ruoli SAP standard.

BigQuery Connector per SAP fornisce l'oggetto di autorizzazione ZGOOG_MTID nell'ambito dell'installazione del trasporto.

Per configurare ed eseguire job di replica dei dati che utilizzano il BigQuery Connector per SAP, puoi definire un ruolo con accesso amministrativo all'interno di SAP LT Replication Server, come descritto in Creare ruoli SAP e autorizzazioni per BigQuery Connector per SAP.

Ad esempio, puoi definire un ruolo denominato ZGOOGLE_BIGQUERY_ADMIN che possieda tutte le autorizzazioni SAP e le autorizzazioni ZGOOG_MTID necessarie per configurare e gestire la replica dei dati in BigQuery utilizzando il connettore BigQuery per SAP.

Per ulteriori informazioni di SAP su ruoli e autorizzazioni, consulta la Guida alla sicurezza per la tua versione di SAP LT Replication Server nel portale di assistenza SAP.

Google Cloud sicurezza

L'implementazione della sicurezza per Google Cloud BigQuery Connector per SAP può comportare i seguenti controlli di sicurezza:

- Autorizzazioni, ruoli, account di servizio e chiavi IAM (Identity and Access Management).

- Controlli BigQuery impostati a livello di set di dati o tabella.

- Controlli di servizio Virtual Private Cloud (VPC) per servizi basati su API come BigQuery.

- Endpoint di Private Service Connect che consentono il consumo privato di servizi, come BigQuery, nelle reti VPC.

Google Cloud Gestione di identità e accessi

Per l'autenticazione e l'autorizzazione di BigQuery Connector per SAP, è necessario un account di servizio IAM nel progetto Google Cloud che contiene il set di dati BigQuery.

Per l'autorizzazione a interagire con le risorse BigQuery, devi concedere i ruoli all'account di servizio che contiene le autorizzazioni per dialogare con BigQuery nel progetto BigQuery.

Se crei l'account di servizio nel progetto BigQuery, puoi concedere i ruoli richiesti al momento della creazione e l'account di servizio diventa automaticamente un principale nel progetto BigQuery.

Le autorizzazioni di cui BigQuery Connector per SAP ha bisogno per accedere a BigQuery sono contenute nei seguenti ruoli IAM:

- BigQuery Data Editor

- Utente job BigQuery

Se SAP LT Replication Server è in esecuzione su una VM Compute Engine, devi anche concedere il ruolo Creatore token account di servizio all'account di servizio della VM host.

Se SAP LT Replication Server è in esecuzione on-premise o su un'altra piattaforma cloud, oltre a creare un account di servizio, devi anche creare una chiave dell'account di servizio per BigQuery Connector per SAP. L'amministratore SAP installa la chiave sull'host SAP LT Replication Server. Quando BigQuery Connector per SAP si connette a BigQuery, SAP LT Replication Server utilizza la chiave dell'account di servizio per autenticarsi con Google Cloud.

Una chiave del service account non è richiesta quando SAP LT Replication Server è in esecuzione su Google Cloud.

Per ulteriori informazioni su IAM, account di servizio, ruoli e autorizzazioni, consulta:

- Service account

- Eseguire l'autenticazione come account di servizio

- Best practice per gli account di servizio

- Introduzione all'autenticazione dell'API BigQuery

Controlli di accesso ai set di dati e alle tabelle BigQuery

Oltre ai controlli IAM, puoi anche controllare l'accesso utilizzando BigQuery. Per il connettore BigQuery per SAP, puoi impostare i controlli di accesso su set di dati e tabelle.

Per ulteriori informazioni, vedi:

Controlli di servizio VPC

In Google Cloud, le regole del firewall VPC non sono applicabili alle interazioni basate su API con BigQuery. In alternativa, puoi utilizzare Controlli di servizio VPC (Virtual Private Cloud) per limitare il traffico.

Se il tuo carico di lavoro SAP è in esecuzione su Google Cloud, puoi implementare i Controlli di servizio VPC definendo i perimetri di servizio. Per ulteriori informazioni, consulta Perimetri di servizio.

Se il tuo carico di lavoro SAP non è in esecuzione su Google Cloud, puoi implementare i Controlli di servizio VPC nell'ambito della configurazione dell'accesso privato Google per gli host on-premise.

Per ulteriori informazioni sulla sicurezza di rete per BigQuery, consulta Sicurezza di rete.

Endpoint di Private Service Connect

Se vuoi configurare endpoint nella tua rete VPC che consentano il consumo privato di servizi gestiti da Google come BigQuery, puoi utilizzare Private Service Connect.

Private Service Connect ti consente di creare endpoint privati che utilizzano indirizzi IP interni di un intervallo CIDR VPC per accedere ad API e servizi Google. Puoi anche utilizzare Private Service Connect per creare un nome DNS privato personalizzato per l'API di streaming BigQuery. Per ulteriori informazioni, consulta Private Service Connect.

Per il connettore BigQuery per SAP in esecuzione su un host esterno a Google Cloud, Private Service Connect non è supportato.

Ulteriori informazioni sulla Google Cloud sicurezza

Per ulteriori informazioni su account, ruoli e autorizzazioni di sicurezza, consulta:

- Service account

- Creare e abilitare gli account di servizio per le istanze

- Panoramica della sicurezza e della governance dei dati

Networking

Quando pianifichi il percorso di rete per la replica in BigQuery, considera i seguenti punti:

- Larghezza di banda

- Latenza e relativo impatto sul consumo di risorse sull'host SAP LT Replication Server

- Volume di dati e relativo impatto sul carico di rete esistente

- Se il tuo carico di lavoro SAP non è in esecuzione su Google Cloud, il tipo di connessione da utilizzare: Cloud Interconnect o Cloud VPN

Connessione a Google Cloud

Se i tuoi sistemi SAP non sono in esecuzione su Google Cloud e non hai già una connessione dai tuoi sistemi SAP a Google Cloud, devi stabilire una connessione e configurare l'accesso privato alle API Google Cloud .

Puoi stabilire una connessione a Google Cloud utilizzando Cloud Interconnect o Cloud VPN.

In genere, Cloud Interconnect offre una larghezza di banda maggiore, una latenza inferiore e una contesa della rete inferiore rispetto a Cloud VPN. Per job di replica ad alto volume e sensibili alle prestazioni, Google Cloud si consiglia Cloud Interconnect per BigQuery Connector per SAP.

Con Cloud VPN, i dati di replica vengono trasmessi tramite internet pubblico, pertanto la contesa della rete è meno prevedibile e le latenze sono in genere più elevate.

Indipendentemente dall'opzione di connessione scelta, devi esaminare tutto il traffico che prevedi che la connessione supporti. Determina se la connessione ha una larghezza di banda e una velocità di rete sufficienti per supportare i job di replica e qualsiasi altro carico di lavoro senza influire negativamente su nessuno dei due.

Le connessioni lente possono aumentare il consumo di risorse sia sul server di origine SAP sia sull'host di SAP LT Replication Server prolungando il tempo necessario per completare i job delle risorse, il che impedisce alle risorse richieste per la replica di essere utilizzate per periodi di tempo più lunghi.

Per ulteriori informazioni sulle opzioni di connessione:

Per utilizzare un server proxy per inviare le richieste HTTP a Google Cloud, consigliamo di utilizzare le destinazioni RFC definite nella transazione SM59.

Destinazioni RFC

I file di trasporto del connettore BigQuery per SAP contengono le seguenti destinazioni RFC di esempio nella transazione SM59. Queste destinazioni RFC sono connessioni HTTP a server esterni (tipo G) e si connettono all'endpoint dell'API pubblica del rispettivo servizio.

| Nome di destinazione RFC di esempio | Host target (endpoint API) | Note |

|---|---|---|

GOOG_BIGQUERY |

https://bigquery.googleapis.com |

Questa destinazione RFC ha come target l'API BigQuery. |

GOOG_IAMCREDENTIALS |

https://iamcredentials.googleapis.com |

Questa destinazione RFC ha come target l'API IAM. |

GOOG_OAUTH2_TOKEN |

https://googleapis.com/oauth2 |

Questa destinazione RFC ha come target l'endpoint Google Cloud per l'autenticazione basata su OAuth 2.0. Questo metodo viene utilizzato per i carichi di lavoro SAP in esecuzione al di fuori di Google Cloud e solo quando vuoi autenticarti in Google Cloud utilizzando il token JWT (JSON Web Token). |

L'utilizzo delle destinazioni RFC per connettersi a Google Cloud offre i seguenti vantaggi:

Se utilizzi un server proxy nel tuo panorama SAP e vuoi utilizzarlo anche per inviare le richieste HTTP a Google Cloud, puoi configurare il server proxy nella destinazione RFC.

Se vuoi abilitare l'accesso a Google Cloud API e servizi tramite gli endpoint di Private Service Connect, puoi crearli nel tuo progetto Google Cloud e poi specificarli nelle destinazioni RFC.

Puoi utilizzare la compressione HTTP, cheGoogle Cloud è consigliata per le repliche tra regioni, quando il sistema di origine SAP e il set di dati BigQuery si trovano in regioni Compute Engine diverse.

Per utilizzare le destinazioni RFC per connetterti ad API o servizi Google Cloud , devi creare voci nella tabella /GOOG/SERVIC_MAP che mappano le destinazioni RFC alla tabella /GOOG/CLIENT_KEY. Per la procedura di configurazione, consulta la Guida all'installazione e alla configurazione di BigQuery Connector per SAP per il tuo scenario.

Compressione HTTP

Quando utilizzi le destinazioni RFC per configurare la connessione tra il connettore BigQuery per SAP e le API, puoi utilizzare l'opzione Compressione per comprimere il corpo della richiesta HTTP. Google Cloud La compressione HTTP è

disponibile solo se configuri le destinazioni RFC in modo che utilizzino HTTP 1.1.

Prima di attivare la compressione HTTP nell'ambiente di produzione, analizza i parametri del profilo che influiscono sulla compressione HTTP in un ambiente di test. Per maggiori informazioni di SAP, consulta la nota SAP 1037677 - La compressione HTTP comprime solo alcuni documenti.

Larghezza di banda

Assicurati che la connessione di rete tra SAP LT Replication Server e BigQuery abbia una larghezza di banda sufficiente per supportare il volume di dati alla velocità richiesta.

Le connessioni di rete più lente aumentano la latenza della replica dei dati, aumentando le risorse utilizzate dalla replica nel sistema SAP di origine.

Per le installazioni produttive, Google Cloud consiglia una connessione Cloud Interconnect. Puoi anche utilizzare Cloud VPN.

Latenza

Per ridurre la latenza sulla connessione di rete, crea il set di dati BigQuery di destinazione il più vicino possibile al sistema SAP LT Replication Server e al sistema di origine SAP. Se il sistema SAP di origine è in esecuzione su Google Cloud, crea il set di dati BigQuery nella stessa Google Cloud regione del sistema SAP di origine.

Testa la latenza prima di eseguire la migrazione dell'installazione a un ambiente di produzione.

Per ulteriori informazioni sul rendimento della rete, consulta Rendimento della connessione di rete.

Controlli di accesso alla rete

Puoi implementare i controlli di accesso di rete su entrambi i lati della connessione tra SAP LT Replication Server e Google Cloud.

Google Cloud controlli dell'accesso alla rete

BigQuery Connector per SAP comunica con BigQuery tramite un endpoint API, che non è soggetto alle regole del firewall Google Clouddella VPC.

Utilizza invece Controlli di servizio VPC per limitare il traffico.

Per ulteriori informazioni sulla sicurezza di rete per BigQuery, consulta Sicurezza di rete.

Controlli dell'accesso di rete all'host di SAP LT Replication Server

Nell'host di SAP LT Replication Server, devi assicurarti che eventuali firewall o proxy consentano il traffico in uscita dal server all'endpoint dell'API BigQuery. In particolare, SAP LT Replication Server deve essere in grado di accedere alle seguenti Google Cloud API:

- https://bigquery.googleapis.com

- https://iamcredentials.googleapis.com

Se vuoi utilizzare gli endpoint di Private Service Connect per accedere all'API di streaming BigQuery, devi assicurarti di configurarli nella tabella/GOOG/SERVIC_MAP. Per ulteriori informazioni, consulta la guida all'installazione e alla configurazione per il tuo scenario.

Pianificazione del rendimento

Le prestazioni dei caricamenti iniziali e dei job di replica tra SAP LT Replication Server e BigQuery sono influenzate da più fattori in punti diversi lungo il percorso di replica.

Tuttavia, alcuni fattori di base, come la distanza tra SAP LT Replication Server e il set di dati BigQuery o la larghezza di banda della connessione a Google Cloud, hanno un impatto maggiore sulle prestazioni rispetto alla maggior parte degli altri fattori.

Best practice generali per le prestazioni

Per un rendimento ottimale, incorpora i seguenti consigli nella configurazione di SAP LT Replication Server:

- Esegui il tuo carico di lavoro SAP, incluso il sistema di origine SAP e SAP LT Replication Server, su Google Cloud.

- Se il tuo workload SAP è su Google Cloud, crea il set di dati BigQuery nella stessa regione del tuo workload SAP.

- Se non riesci a eseguire il tuo carico di lavoro SAP su Google Cloud:

- Crea il tuo set di dati BigQuery nella Google Cloud regione più vicina al tuo carico di lavoro SAP.

- Connettiti a Google Cloud utilizzando Cloud Interconnect.

- Per evitare contese per le risorse, utilizza host dedicati separati sia per il sistema di origine SAP sia per SAP LT Replication Server.

- Scegli le dimensioni ottimali del sistema SAP LT Replication Server per il tuo carico di lavoro in base alla guida alle dimensioni per la tua versione di SAP LT Replication Server nel portale di assistenza SAP.

- Utilizza le seguenti impostazioni di replica di SAP LT Replication Server:

- Job paralleli.

- Lettura di tipo 1, se possibile. Per ulteriori informazioni, consulta Rendimento e impostazioni di replica avanzata LTRS.

- Configura BigQuery Connector per SAP con:

- Compressione dei record predefinita.

- Dimensione del chunk predefinita.

- Quando esegui la mappatura dei campi alla tabella BigQuery, se possibile, evita i nomi personalizzati.

Per ulteriori informazioni, vedi:

- Considerazioni sulle prestazioni di SAP LT Replication Server

- Rendimento della connessione di rete

- Trasmissione dei dati

- Compressione dei record

Altre caratteristiche che possono influire sul rendimento

Molte caratteristiche della configurazione e dei dati possono influire sulle prestazioni. Alcune di queste caratteristiche potrebbero non essere modificabili. Queste caratteristiche includono:

- Sul server di origine:

- Il numero di CPU.

- La quantità di memoria.

- Il database utilizzato, ad esempio SAP HANA, SAP ASE, IBM Db2 o altri.

- Il numero di colonne nella tabella di origine.

- La quantità di dati contenuti in ogni record.

- I metadati della tabella, ad esempio la lunghezza dei nomi dei campi.

- Il numero di processi di lavoro della finestra di dialogo.

- Su SAP LT Replication Server:

- Il numero di CPU.

- La quantità di memoria.

- Altri carichi di lavoro che l'host potrebbe eseguire.

- Dialoghi SAP e processi di lavoro in background.

- Il tipo di architettura di installazione di SAP LT Replication Server. Per ulteriori informazioni, consulta Installazione autonoma (consigliata) o integrata di SAP LT Replication Server.

- Il numero di job in background in esecuzione sul sistema SAP LT Replication Server.

- Il numero di job in background allocati al trasferimento collettivo nella scheda Amministrazione della transazione

LTRC. - Le impostazioni relative al rendimento delle transazioni

LTRS, tra cui Tipo di lettura e Dimensione porzione.

- Nella configurazione della replica di BigQuery (transazione

/GOOG/SLT_SETTINGS):- Indica se sono specificati o meno nomi personalizzati per i campi di destinazione. L'elaborazione dei nomi dei campi BigQuery di destinazione può avere un leggero impatto sulle prestazioni.

- Indica se la compressione dei record è attivata.

- Dimensione chunk di BigQuery Connector per SAP, che può influire sul numero totale di richieste HTTP inviate.

Considerazioni sulle prestazioni di SAP LT Replication Server

Le sezioni seguenti illustrano le opzioni di rendimento correlate alla configurazione di SAP LT Replication Server.

Prestazioni e architettura di installazione di SAP LT Replication Server

Un'architettura autonoma, in cui SAP LT Replication Server è installato sul suo proprio server dedicato, in genere offre prestazioni migliori rispetto a un'architettura incorporata, in cui SAP LT Replication Server è installato sullo stesso server del sistema di origine.

In un'architettura incorporata, SAP LT Replication Server deve condividere le risorse del server con il sistema di origine SAP.

Anche con un'architettura autonoma, la CPU e la memoria dell'host, nonché eventuali altri carichi di lavoro in esecuzione sul server, possono influire sulle prestazioni di un'istanza di SAP LT Replication Server.

Prestazioni e LTRS Impostazioni di replica avanzate

Il rendimento dei caricamenti iniziali e della replica è influenzato dalle impostazioni specificate per la tabella di origine nella transazione LTRS in Impostazioni di replica avanzate.

Per indicazioni sull'ottimizzazione delle prestazioni, in particolare per l'ottimizzazione della replica o dei caricamenti iniziali di alto volume, consulta la Guida all'ottimizzazione delle prestazioni di SAP LT Replication Server nel portale di assistenza SAP.

Google Cloud consiglia le seguenti specifiche nella sezione

Impostazioni di replica avanzate > Prestazioni generali della

transazione LTRS:

Per i caricamenti iniziali dalla maggior parte dei tipi di tabelle, specifica 1 Calcolo intervallo come Tipo di lettura. Per le tabelle troppo grandi per il calcolo dell'intervallo 1, specifica il tipo di lettura 5.

Per le repliche, in Impostazioni attive:

- Per le repliche più veloci, specifica Intervalli automatici.

- Per una maggiore affidabilità delle repliche, specifica Nessun intervallo.

La tabella seguente suggerisce le impostazioni per alcuni scenari comuni.

| Tipo di tabella | Tipo di lettura consigliata |

|---|---|

| Trasparente (piccole e medie dimensioni) | Tipo di lettura 1 - Calcolo dell'intervallo |

| Trasparente (grande) | Solo se il tipo di lettura 1 non funziona, tipo di lettura 5 - Calcolo dell'intervallo |

| Tabella cluster | Tipo di lettura 4: coda del mittente |

Prestazioni della connessione di rete

La larghezza di banda e la latenza della connessione tra il sistema SAP LT Replication Server e BigQuery possono influire sulle prestazioni complessive della replica in BigQuery.

L'impatto non riguarda solo la velocità di replica, ma anche la quantità di risorse impiegate da SAP LT Replication Server e dal sistema di origine, perché più tempo occorre per ricevere la conferma della replica da BigQuery, più a lungo SAP LT Replication Server e il sistema di origine trattengono le risorse dell'host.

Se il tuo carico di lavoro SAP viene eseguito on-premise o su un altro provider cloud,Google Cloud consiglia di utilizzare una connessione Cloud Interconnect, che offre larghezza di banda elevata e bassa latenza senza dover competere con il traffico sulla rete internet pubblica.

Puoi utilizzare Cloud VPN per connetterti a Google Cloud e BigQuery, tuttavia, con una connessione VPN, le tue repliche devono competere con il traffico internet generale.

Se il tuo carico di lavoro SAP è in esecuzione su Google Cloud, Google Cloud consiglia di posizionare SAP LT Replication Server e il tuo set di dati BigQuery nella stessa regione. Se SAP LT Replication Server e BigQuery si trovano in regioni diverse, la latenza è in genere più elevata e le prestazioni sono in genere peggiori. Per saperne di più sulla scelta di una regione, consulta Scegliere una regione e una zona.

Trasmissione dei dati

In genere, è consigliabile inviare il maggior numero possibile di dati in ogni richiesta HTTP per ridurre il numero complessivo di richieste HTTP e il relativo overhead di elaborazione.

In alcuni casi, però, potresti dover ridurre la quantità di dati inviati, in base alle dimensioni dei record di una determinata tabella o perché hai raggiunto un limite di quota o un altro limite in BigQuery.

Puoi controllare la quantità di dati inviati in ogni richiesta nei seguenti modi:

- Modifica la quantità di dati (la dimensione della porzione) che SAP LT Replication Server invia a BigQuery Connector per SAP.

- Modifica la quantità di dati (la dimensione del chunk) che il connettore BigQuery per SAP invia a BigQuery.

- Modifica le quote per gli inserimenti in streaming nel tuo progetto BigQuery.

Modificare la quantità di dati inviati da SAP LT Replication Server

SAP LT Replication Server invia i record dal sistema di origine al BigQuery Connector per SAP in parti. Ogni parte viene gestita come un job di caricamento o di replica separato che consuma le risorse del server fino al completamento.

In genere, se aumenti la dimensione della porzione di SAP LT Replication Server, diminuisci il numero di processi di SAP LT Replication Server, nonché il overhead associato.

Dimensioni della porzione e del chunk

Le parti di SAP LT Replication Server sono misurate in byte o come prodotto di byte e record. Le dimensioni dei chunk di BigQuery Connector per SAP sono basate sul numero di record che possono contenere. Le dimensioni in byte di un blocco variano in base a diversi fattori, tra cui il numero di campi nei record e la quantità di dati memorizzati in ciascun record.

Se la dimensione della porzione di SAP LT Replication Server è maggiore della dimensione del chunk di BigQuery Connector per SAP, BigQuery Connector per SAP invia più chunk per ogni porzione, finché non vengono inviati tutti i record della porzione.

Se la dimensione della porzione è inferiore a quella del chunk, BigQuery Connector per SAP invia un solo chunk per porzione. Ogni chunk contiene solo il numero di record inviati in ogni porzione, indipendentemente dalle dimensioni del chunk impostate in BigQuery Connector per SAP.

Idealmente, imposta una dimensione della porzione in SAP LT Replication Server che consenta a BigQuery Connector per SAP di creare i chunk più grandi possibili senza superare il limite di BigQuery per il numero di byte in ogni richiesta HTTP.

Per ulteriori indicazioni su come specificare una dimensione del chunk, consulta Dimensione del chunk in BigQuery Connector per SAP.

Dimensioni della porzione in SAP LT Replication Server

Per modificare la dimensione predefinita della porzione utilizzata da SAP LT Replication Server,

esegui la transazione LTRS e modifica il valore nel campo Dimensione pacchetto

in Impostazioni di replica avanzate in Opzioni di prestazioni.

Per ulteriori informazioni, consulta la Guida all'ottimizzazione del rendimento di SAP LT Replication Server nel portale di assistenza SAP.

Dimensione del chunk nel connettore BigQuery per SAP

BigQuery Connector per SAP invia i dati a BigQuery come chunk di record. Ti consigliamo di utilizzare la dimensione del chunk predefinita con il connettore BigQuery per SAP, ovvero 10.000 record. Se i record di una tabella di origine contengono pochissimi campi o se i campi contengono valori di dati di dimensioni molto ridotte, puoi utilizzare una dimensione del chunk più grande fino al valore massimo consentito dal connettore BigQuery per SAP, ovvero 50.000 record.

Se il numero di record in un determinato chunk genera una dimensione in byte che supera il limite di BigQuery per le richieste HTTP, potresti ricevere un errore quotaExceeded o invalid.

Questo può accadere se i record di una tabella di origine contengono molti campi o se i campi contengono molti dati.

Se ricevi un messaggio di errore relativo alle dimensioni dei chunk, prova a ridurle come specificato nella configurazione del trasferimento collettivo per la tabella in questione. In alternativa, puoi attivare la dimensione del chunk dinamico per la tabella in modo da regolare automaticamente la dimensione del chunk. Per ulteriori informazioni, vedi Dimensioni dei chunk dinamici.

Se non hai attivato la dimensione del chunk dinamico, per le tabelle di origine SAP come MSEG, ACDOCA e MATDOC, che possono avere record di grandi dimensioni con molti campi per record, potrebbe essere necessario specificare una dimensione del chunk minima di 2000.

Puoi specificare una dimensione del chunk eseguendo la transazione /GOOG/SLT_SETTINGS. Le dimensioni del chunk sono specificate nel campo Dimensioni chunk nella schermata degli attributi della tabella.

Per ulteriori indicazioni su come specificare le dimensioni di un chunk, consulta:

- Se SAP LT Replication Server è in esecuzione su una VM Compute Engine, consulta Specificare gli attributi della tabella.

- Se SAP LT Replication Server è in esecuzione su un host esterno a Google Cloud, consulta Specificare gli attributi delle tabelle.

Per ulteriori informazioni sui messaggi di errore di BigQuery, consulta Messaggi di errore.

Overhead di elaborazione associato all'invio di parti

Ogni parte inviata attiva le seguenti azioni, ciascuna delle quali comporta un sovraccarico di elaborazione o un consumo di risorse:

- Una raccolta di record modificati nella tabella di log sul sistema di origine viene inviata a SAP LT Replication Server in un'unica porzione. I record modificati non sono ancora stati eliminati dalla tabella di logging.

- SAP LT Replication Server richiede un nuovo token di accesso da Google Cloud.

- BigQuery Connector per SAP invia una richiesta HTTP a BigQuery per verificare la struttura della tabella di destinazione.

- BigQuery Connector per SAP invia i record a BigQuery in tutti i chunk necessari per inviare tutti i record ricevuti nella singola porzione. Ogni chunk viene inviato in una richiesta HTTP distinta.

- BigQuery elabora ogni chunk che riceve.

- A SAP LT Replication Server viene restituito un codice di stato HTTP

OKper ogni chunk. - Dopo che BigQuery ha ricevuto tutti i record, SAP LT Replication Server elimina i record inviati dalla tabella di log, che libera finalmente le risorse sul sistema di origine.

Per ulteriori informazioni sulle parti e sulla configurazione di SAP LT Replication Server per le prestazioni, consulta la Guida all'ottimizzazione delle prestazioni di SAP LT Replication Server nel portale di assistenza SAP.

Quote BigQuery

Le quote dell'API di streaming di BigQuery in vigore per il tuo progetto limitano la quantità di dati che puoi inviare in streaming in BigQuery nel tempo e in una singola richiesta HTTP.

Ad esempio, BigQuery imposta limiti su misurazioni come:

- I byte al secondo per progetto che puoi inviare.

- Il numero massimo di record o righe che puoi inviare in una singola richiesta HTTP.

- La dimensione massima di una richiesta HTTP che puoi inviare.

Per gli inserimenti di streaming, BigQuery fissa le dimensioni delle richieste HTTP a 10 MB e il numero di record che puoi inviare in una singola richiesta HTTP a 50.000.

Nella maggior parte dei casi, puoi modificare le quote, ma non i limiti.

Puoi visualizzare e modificare le quote in vigore per il tuo progetto nella pagina Quote della console Google Cloud.

Per ulteriori informazioni sulle quote e sui limiti di BigQuery per gli inserimenti di flussi di dati, consulta:

Compressione dei record

Per impostazione predefinita, BigQuery Connector per SAP migliora le prestazioni della replica comprimendo i record inviati a BigQuery. A partire dalla versione 2.8 e successive di BigQuery Connector per SAP, l'opzione di compressione dei record è disponibile a livello di tabella e di campo.

Quando la compressione dei record è abilitata a livello di tabella, che è l'impostazione predefinita, il connettore BigQuery per SAP omette tutti i campi vuoti nel record di origine dai record inviati a BigQuery. Quando il record viene inserito in BigQuery, i campi omessi dai dati inviati vengono inizializzati con null nella tabella di destinazione in BigQuery.

Tuttavia, se devi replicare alcuni campi vuoti con i relativi valori iniziali in BigQuery continuando a utilizzare la compressione dei record a livello di tabella, puoi modificare l'impostazione di compressione dei record per questi campi specifici. Ciò significa che i valori vuoti nei campi specificati non vengono omessi dai dati inviati e mantengono il valore con cui sono inizializzati nella tabella di origine.

Puoi controllare il comportamento di compressione dei record utilizzando l'impostazione Invia indicatore non compresso disponibile a livello di tabella e di campo. La seguente tabella riassume il comportamento di compressione dei record:

| Invia il flag Non compresso a livello di tabella | Invia il flag Non compresso a livello di campo | Registra il comportamento di compressione |

|---|---|---|

| Sì | No | Tutti i campi vengono inviati non compressi. |

| Sì | Sì | Tutti i campi vengono inviati non compressi. |

| No | Sì | Solo i campi selezionati a livello di campo vengono inviati non compressi. |

| No | No | Tutti i campi vengono inviati compressi. |

Quando i dati non compressi vengono inviati per la replica, tranne per i campi della data e i campi del timestamp, i campi vuoti mantengono il valore con cui sono stati inizializzati nella tabella di origine. Il valore inizializzato per i campi data e timestamp riceve i seguenti valori:

- Valore di inizializzazione del campo Data:

DATE 1970-01-01 - Valore di inizializzazione del campo Timestamp:

TIMESTAMP 1970-01-01 00:00:00 UTC

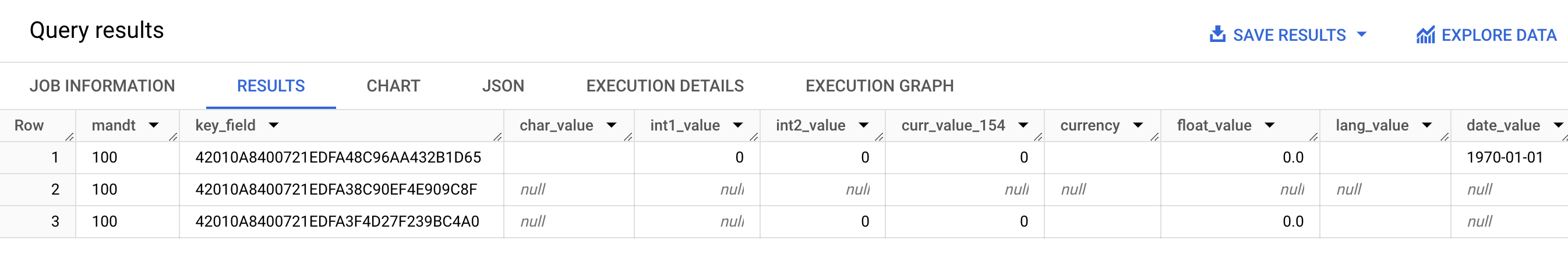

Lo screenshot seguente mostra un esempio del comportamento di compressione dei record:

- Riga 1: tutti i campi non sono compressi. L'opzione Send Uncompressed Flag (Invia indicatore non compresso) è selezionata a livello di tabella.

- Riga 2: tutti i campi sono compressi. L'indicatore Invia non compresso è attivo a livello di tabella.

- Riga 3: i seguenti campi non sono compressi:

int2_value,curr_value_154,currency,float_valueelang_value. Per questi campi, Invia flag non compresso è selezionato a livello di campo.

Per ottenere prestazioni migliori, non disattivare la compressione dei record selezionando Invia indicatore non compresso a livello di tabella. Può avere un impatto negativo sul rendimento della replica. Se devi inviare dati non compressi solo per campi specifici, seleziona Invia indicatore non compresso per questi campi specifici a livello di campo. Per ulteriori informazioni su come la compressione dei record influisce sui dati trasferiti da SAP LT Replication Server a BigQuery, consulta Informazioni sulla funzionalità di compressione di BigQuery Connector per SAP.

Configurazioni di replica di BigQuery

Quando configuri la replica con BigQuery Connector per SAP, utilizzi diverse transazioni SAP, inclusa una transazione personalizzata fornita da Google Cloud:

SM30: definisce le proprietà per la connessione a Google Cloud, che vengono memorizzate come record nella tabella di configurazione personalizzata/GOOG/CLIENT_KEY. Se vuoi, quando utilizzi le destinazioni RFC per connetterti aGoogle Cloud API e servizi, alcune proprietà di connessione vengono memorizzate nella tabella di configurazione personalizzata/GOOG/SERVIC_MAP.LTRC: definisce l'applicazione di replica di BigQuery Connector per SAP e l'ID trasferimento collettivo, tra le altre proprietà.SM59: definisce le destinazioni RFC che consentono di connettersi a Google Cloud API e servizi come BigQuery e IAM./GOOG/SLT_SETTINGS: definisce le proprietà per il set di dati, la tabella e i campi BigQuery di destinazione. Quando inserisci/GOOG/SLT_SETTINGSin SAP LT Replication Server, devi aggiungere/nper eseguire la fuga della barra diagonale iniziale nel nome della transazione.

Supporto dei linguaggi

BigQuery Connector per SAP supporta solo le configurazioni di replica in inglese. Quando configuri la replica utilizzando le transazioni SAP e la transazione personalizzata fornita da Google Cloud, utilizza Inglese come lingua di accesso nella schermata di accesso SAP.

Tuttavia, BigQuery Connector per SAP supporta l'esecuzione di job in background in esecuzione su SAP LT Replication Server in tutte le lingue supportate da SAP SLT.

Eventuali messaggi di errore che potresti riscontrare quando utilizzi BigQuery Connector per SAP vengono generati in inglese indipendentemente dal linguaggio di esecuzione dei job in background.

Proprietà della tabella di destinazione

Quando configuri la replica in SAP LT Replication Server eseguendo la transazione /GOOG/SLT_SETTINGS, puoi specificare le impostazioni da applicare quando il connettore BigQuery per SAP crea la tabella di destinazione in BigQuery.

Ad esempio, puoi specificare le seguenti proprietà per una tabella BigQuery di destinazione:

- Nome tabella

- L'opzione di denominazione predefinita per i campi

- Campi aggiuntivi per acquisire le modifiche ai record e attivare le query sul conteggio dei record

- Partizionamento delle tabelle

Opzioni di denominazione predefinite per i campi

Puoi configurare il connettore BigQuery per SAP in modo che crei i nomi dei campi nella tabella BigQuery di destinazione dai nomi dei campi di origine o dalle etichette e descrizioni dei campi di origine. Le etichette e le descrizioni sono in genere più informative sui contenuti del campo.

Per impostazione predefinita, BigQuery Connector per SAP utilizza i nomi dei campi di origine.

Puoi modificare il valore predefinito specificando il flag Nomi personalizzati quando specifichi gli attributi di creazione della tabella nella configurazione del trasferimento collettivo della transazione /GOOG/SLT_SETTINGS. Questa specifica viene memorizzata nella tabella di configurazione /GOOG/BQ_MASTR.

Quando crea i nomi, BigQuery Connector per SAP li modifica in modo che rispettino la convenzione di denominazione di BigQuery.

Prima di creare una tabella, puoi modificare i nomi dei campi nella schermata di mappatura dei campi della transazione /GOOG/SLT_SETTINGS.

Quando viene specificato il flag Nomi personalizzati, i nomi che il connettore BigQuery per SAP utilizzerà per creare la tabella di destinazione vengono visualizzati nella colonna Nome campo esterno della schermata di mappatura dei campi.

BigQuery Connector per SAP crea i nomi nella colonna Nome campo esterno dall'etichetta del campo medium di ogni campo di origine. Se nella definizione del campo di origine non è specificata un'etichetta di campo di medie dimensioni, viene utilizzata la descrizione breve del campo. Se non viene specificata nemmeno la descrizione breve, viene utilizzata l'etichetta più breve specificata. Se non viene specificato alcun valore, viene utilizzato il nome del campo di origine.

Per ulteriori informazioni sulla personalizzazione dei nomi dei campi target, consulta Personalizzare i nomi dei campi target.

Acquisisci le modifiche ai record e attiva i conteggi dei record

Per acquisire il tipo di modifica nella tabella di origine che ha attivato la replica

e per poter eseguire query sui conteggi dei record nella tabella BigQuery

per il confronto con SAP LT Replication Server o sui conteggi dei record nella tabella di origine, specifica l'opzione Extra Fields Flag nella

transazione /GOOG/SLT_SETTINGS quando configuri la replica.

Quando viene specificata l'opzione Extra Fields Flag (Indicatore campi aggiuntivi), le seguenti colonne vengono aggiunte allo schema della tabella BigQuery di destinazione:

| Nome campo | Tipo di dati | Descrizione |

|---|---|---|

operation_flag

|

STRING

|

Identifica il tipo di modifica nella tabella di origine che ha attivato il caricamento o la replica del record in BigQuery.

Per conteggiare i record inseriti in modalità di replica, esegui query sui record con un valore

Per conteggiare i record inseriti in modalità di caricamento iniziale, esegui query sui record con un valore |

is_deleted

|

BOOLEAN

|

Se true, indica che il record di origine è stato

eliminato dalla tabella di origine.

Per conteggiare solo i record di una tabella BigQuery che

non sono stati eliminati dalla tabella di origine, utilizza il

campo |

recordstamp

|

TIMESTAMP

|

L'ora in cui SAP LT Replication Server ha inviato il record a BigQuery. Per conteggiare il numero di record univoci in una tabella BigQuery, eseguire una query solo sull'istanza inserita più di recente di ogni record. Per un esempio di query, vedi Eseguire una query sul conteggio totale dei record in una tabella BigQuery. |

L'impostazione corrente dell'opzione Extra Fields Flag è memorizzata nella tabella di configurazione /GOOG/BQ_MASTR.

Per ulteriori informazioni su come specificare l'indicatore di campi aggiuntivi, consulta:

- Se SAP LT Replication Server è in esecuzione su una VM Compute Engine, consulta Specificare la creazione della tabella e altri attributi generali.

- Se SAP LT Replication Server è in esecuzione su un host esterno a Google Cloud, consulta Specificare la creazione di tabelle e altri attributi generali.

Partizionamento delle tabelle

Puoi creare tabelle BigQuery partizionate in base a un campo timestamp nella tabella di origine, che crea una tabella partizionata per unità di tempo, o in base all'ora in cui i record vengono inseriti in BigQuery, che crea una tabella partizionata per data di importazione.

Per abilitare il partizionamento, specifica un tipo di partizione nel campo Partition Type (Tipo partizione) in /GOOG/BQ_TABLE quando configuri le proprietà di replica.

I tipi di partizione che puoi specificare regolano la granularità della suddivisione per ora, giorno, mese o anno.

Per utilizzare un timestamp della tabella di origine per il partizionamento delle colonne in base alle unità di tempo, specifica il nome del campo di origine nel campo Campo partizione.

Per utilizzare una data di inserimento BigQuery per il partitioning in base alla data di importazione, puoi lasciare vuoto il campo Campo partizione. BigQuery Connector per SAP crea un campo nella tabella di destinazione per memorizzare la data e l'ora di inserimento.

Proprietà dei campi target

Per impostazione predefinita, BigQuery Connector per SAP utilizza i nomi dei campi e i tipi di dati nella tabella di origine SAP come nomi dei campi e tipi di dati in BigQuery di destinazione.

Se vuoi, prima di creare la tabella di destinazione puoi personalizzare i nomi dei campi o modificare il tipo di dati BigQuery.

Personalizzazione dei nomi dei campi target

Prima di creare una tabella, puoi personalizzare i nomi dei campi target.

Se necessario, BigQuery Connector per SAP modifica i nomi personalizzati che specifichi in modo che siano conformi alla convenzione di denominazione di BigQuery.

Quando configuri la replica, puoi visualizzare i nomi dei campi nella schermata di mappatura dei campi della transazione /GOOG/SLT_SETTINGS. Il

collegatore BigQuery per SAP archivia le impostazioni nella tabella di configurazione /GOOG/BQ_FIELD.

Prima di creare una tabella, puoi specificare un nome campo personalizzato modificando il nome generato nella colonna Nome campo temporaneo della schermata di mappatura dei campi. Se elimini un valore e lasci vuoto il campo Nome campo temporaneo, il connettore BigQuery per SAP utilizza il nome del campo di origine per il nome del campo di destinazione.

Dopo aver apportato modifiche al nome del campo temporaneo, quando fai clic su Salva, BigQuery Connector per SAP convalida il valore, applica le convenzioni di denominazione di BigQuery, se necessario, e salva le modifiche. Puoi convalidare un valore senza salvarlo premendo Invio.

Per informazioni su come impostare il metodo di denominazione predefinito per i campi di destinazione, consulta Opzioni di denominazione predefinite per i campi.

Utilizza un foglio di lavoro o un file di testo per modificare la mappa dei campi BigQuery

Prima di creare una tabella BigQuery di destinazione, puoi facoltativamente salvare i tipi di dati, i nomi e le descrizioni predefiniti dei campi di destinazione in un foglio di lavoro o in un file di testo, in modo che i data engineer o gli amministratori di BigQuery possano modificare i valori senza richiedere l'accesso a SAP LT Replication Server.

Dopo aver modificato i valori, devi convertire il file e i relativi contenuti nel formato CSV (valori separati da virgole). Puoi quindi applicare gli aggiornamenti alle impostazioni del trasferimento collettivo caricando il file CSV utilizzando la transazione personalizzata /GOOG/SLT_SETTINGS.

La procedura per modificare la mappa dei campi BigQuery utilizzando un file CSV include i seguenti passaggi:

- Crea un foglio di lavoro o un file di testo delle mappature dei campi predefinite.

- Modifica i valori.

- Converti il foglio di lavoro o il file di testo in formato CSV.

- Carica il file CSV.

Per istruzioni dettagliate su ciascuno di questi passaggi, consulta Modificare la mappa dei campi BigQuery in un file CSV.

Convenzione di denominazione dei campi di BigQuery

La convenzione di denominazione di BigQuery utilizza solo lettere minuscole, numeri e trattini bassi.

Il connettore BigQuery per SAP applica le convenzioni di denominazione di BigQuery a qualsiasi valore di input da utilizzare per il nome di un campo di destinazione.

Ad esempio, se inserisci FIELD-@#!*123 come nome di un campo personalizzato, il connettore BigQuery per SAP cambia il nome in field_123.

Per ulteriori informazioni sulla convenzione di denominazione di BigQuery per i campi, consulta Nomi delle colonne.

Mappatura dei tipi di dati

Per impostazione predefinita, BigQuery Connector per SAP assegna i tipi di dati ai campi BigQuery di destinazione in base al tipo di tipo SAP o al tipo di dati SAP del campo SAP di origine.

Quando configuri la replica, puoi visualizzare i tipi di dati nella schermata di mappatura dei campi della transazione /GOOG/SLT_SETTINGS. Il

collegatore BigQuery per SAP archivia le impostazioni nella tabella di configurazione /GOOG/BQ_FIELD.

Prima di creare una tabella, puoi modificare la specifica del tipo di dati predefinito in un tipo di dati BigQuery diverso nella colonna Elemento dati esterni della schermata di mappatura dei campi.

Tipi di dati che richiedono una gestione speciale

Diversi tipi di dati SAP richiedono una gestione speciale in modo che vengano rappresentati accuratamente nella tabella BigQuery di destinazione.

Alcuni di questi tipi di dati devi gestirli autonomamente. Il BigQuery Connector per SAP si occupa di tutto per te.

Valori booleani

Per i valori booleani, SAP utilizza il tipo di dati CHAR, che per impostazione predefinita il connettore BigQuery per SAP mappa al tipo di dati STRING nella tabella BigQuery di destinazione.

Di conseguenza, per i valori booleani, quando configuri la replica utilizzando la transazione /GOOG/SLT_SETTINGS, devi modificare l'assegnazione del tipo di dati predefinito per i campi booleani da STRING a BOOLEAN nella schermata di mappatura dei campi.

Timestamp

Per i timestamp, SAP utilizza i tipi di dati P (decimale compresso) o DEC

(decimale), che per impostazione predefinita BigQuery Connector per SAP mappa a

NUMERIC nella tabella BigQuery di destinazione.

Di conseguenza, per i timestamp, quando configuri la replica utilizzando la transazione /GOOG/SLT_SETTINGS, devi modificare l'assegnazione del tipo di dato predefinito per i campi timestamp da NUMERIC a TIMESTAMP o TIMESTAMP (LONG) nella schermata di mappatura dei campi.

X Tipo di tipo SAP

Il tipo di tipo SAP X è esadecimale ed è rappresentato dai tipi di dati SAP RAW,

RAWSTRING o LRAW. Per impostazione predefinita, il connettore BigQuery per SAP mappa questi tipi di dati a STRING nella tabella BigQuery di origine.

Se invece hai bisogno di un campo di origine con il tipo di tipo SAP X da mappare a BYTES, devi modificare l'assegnazione del tipo di dati predefinito per il campo nella schermata di mappatura dei campi della transazione /GOOG/SLT_SETTINGS.

Il tipo di tipo SAP X viene talvolta utilizzato anche in SAP per rappresentare gli interi.

In questo caso, BigQuery Connector per SAP controlla il tipo di dato del

campo di origine per uno dei tipi di dati SAP per gli interi, INT1, INT2,

INT4, INT8 e assegna il tipo di dato INTEGER nella tabella BigQuery di destinazione.

y Tipo di tipo SAP

Il tipo di tipo SAP y è una stringa di byte ed è rappresentato dai tipi di dati SAP RAW,

RAWSTRING o LRAW. Per impostazione predefinita, il connettore BigQuery per SAP mappa questi tipi di dati a STRING nella tabella BigQuery di origine.

Se invece hai bisogno di un campo di origine con il tipo di tipo SAP y da mappare a BYTES, devi modificare l'assegnazione del tipo di dati predefinito per il campo nella schermata di mappatura dei campi della transazione /GOOG/SLT_SETTINGS.

Mappatura dei tipi di dati predefiniti

La tabella seguente mostra la conversione del tipo di dati predefinita del BigQuery Connector per SAP:

| Tipo di tipo SAP | Tipo di dati SAP | Tipo di dati BigQuery | Note |

|---|---|---|---|

b (numero intero di 1 byte)s (numero intero di 2 byte)I (numero intero di 4 byte)8 (numero intero di 8 byte)

|

INT1INT2INT4INT8

|

INTEGER |

|

F (float)

|

FLTP

|

FLOAT |

|

P (imballato)

|

CURRDECQUAN

|

NUMERIC |

Per impostazione predefinita, il tipo di tipo SAP P è mappato al

tipo di dati BigQuery NUMERIC e convertito

in un numero nel formato esterno. |

a (numero in virgola mobile decimale, 16 cifre)

|

DECFLOAT16 |

NUMERIC |

|

e (numero in virgola mobile decimale, 16 cifre)

|

DECFLOAT34 |

NUMERIC |

|

N (numerico) |

NUMC |

STRING |

|

X (esadecimale)y (stringa di byte)

|

RAWRAWSTRINGLRAW

|

STRING |

Se il tipo di tipo SAP è X, ma il nome del tipo di dati copre

il pattern 'INT*' (INT1, INT2, INT4), un elemento di dati di origine viene sostituito

con un nuovo elemento di dati TYPINT8 con TYPEKIND '8', che è mappato

al tipo di dati BigQuery INTEGER. |

C (carattere)g (stringa di caratteri)? (csequence)& (clike)

|

CHARSTRING |

STRING |

|

D (data) |

DATS |

DATE |

|

T (ora) |

TIMS |

TIME |

Licenze

BigQuery Connector per SAP viene reso disponibile come "Software" ai sensi del contratto che regola l'utilizzo della Google Cloud piattaforma, inclusi i Termini di servizio specifici disponibili all'indirizzo https://cloud.google.com/terms/service-terms. Senza alcuna limitazione alla portata generale dei termini precedenti, non puoi modificare o distribuire BigQuery Connector per SAP senza l'autorizzazione scritta espressa di Google.

Il software BigQuery Connector per SAP è offerto senza costi. Per chiarire, l'utilizzo di altro "Software" e "Servizi" ai sensi del contratto che regola l'utilizzo della Google Cloud Piattaforma, ad esempio BigQuery e l'API di streaming di BigQuery, potrebbe comportare un costo.

BigQuery Connector per SAP non include alcuna licenza per il software SAP, incluso, a titolo esemplificativo, SAP LT Replication Server. Acquista separatamente una licenza appropriata per il software SAP.

Ciclo di vita del supporto

Google Cloud supporta e gestisce la versione principale più recente di BigQuery Connector per SAP per un periodo di almeno 12 mesi dalla pubblicazione di una notifica di ritiro nella pagina delle note di rilascio per SAP su Google Cloud, la versione principale precedente.