Questa guida mostra come utilizzare Cloud Deployment Manager per eseguire il deployment di un sistema SAP HANA scalabile orizzontalmente che include la soluzione di recupero dei guasti con failover automatico dell'host SAP HANA. Utilizzando Deployment Manager, puoi eseguire il deployment di un sistema che soddisfi i requisiti di assistenza SAP e sia conforme alle best practice di SAP e Compute Engine.

Il sistema SAP HANA risultante include un host master, fino a 15 host worker e fino a 3 host di riserva, tutti all'interno di un'unica zona Compute Engine.

Il sistema include anche il

Google Cloud gestore dello spazio di archiviazione per i nodi di standby SAP HANA (Gestione archiviazione per SAP HANA), che

gestisce il trasferimento dei dispositivi di archiviazione al nodo di standby durante un failover.

Il Gestione archiviazione per SAP HANA è installato nel volume SAP HANA /shared.

Per informazioni sul gestore dello spazio di archiviazione per SAP HANA e sulle autorizzazioni IAM richieste, consulta Il Gestione archiviazione per SAP HANA.

Se devi eseguire il deployment di SAP HANA in un cluster ad alta disponibilità Linux, utilizza una delle seguenti guide:

- Deployment Manager: guida alla configurazione del cluster SAP HANA HA

- La guida alla configurazione del cluster ad alta disponibilità per SAP HANA su RHEL

- La guida alla configurazione del cluster ad alta disponibilità per SAP HANA su SLES

Questa guida è rivolta agli utenti avanzati di SAP HANA che hanno familiarità con le configurazioni di scalabilità orizzontale di SAP che includono host di riserva per l'alta disponibilità, nonché file system di rete.

Prerequisiti

Prima di creare il sistema SAP HANA scalabile orizzontalmente ad alta disponibilità, assicurati che siano soddisfatti i seguenti prerequisiti:

- Hai letto la guida alla pianificazione di SAP HANA e la guida alla pianificazione dell'alta disponibilità di SAP HANA.

- Tu o la tua organizzazione avete un Google Cloud account e avete creato un progetto per il deployment di SAP HANA. Per informazioni sulla creazione diGoogle Cloud account e progetti, consulta Configurare l'Account Google nella Guida all'implementazione di SAP HANA.

- Se vuoi che il tuo carico di lavoro SAP venga eseguito in conformità con la residenza dei dati, controllo dell'accesso, il personale di assistenza o i requisiti normativi, devi creare la cartella Assured Workloads richiesta. Per ulteriori informazioni, consulta Controlli di conformità e sovranità per SAP su Google Cloud.

- I contenuti multimediali di installazione di SAP HANA sono archiviati in un bucket Cloud Storage disponibile nel progetto e nella regione di deployment. Per informazioni su come caricare i media di installazione di SAP HANA in un bucket Cloud Storage, consulta Creare un bucket Cloud Storage nella Guida all'implementazione di SAP HANA.

- Disporre di una soluzione NFS, come la soluzione Filestore gestita, per condividere i volumi SAP HANA

/hana/sharede/hanabackuptra gli host nel sistema SAP HANA scalabile orizzontalmente. Prima di poter eseguire il deployment del sistema, devi specificare i punti di montaggio per i server NFS nel file di configurazione di Deployment Manager. Per eseguire il deployment dei server NFS Filestore, consulta la sezione Creare istanze. La comunicazione deve essere consentita tra tutte le VM nella sottorete SAP HANA che ospitano un nodo SAP HANA scalabile orizzontalmente.

Se OS Login è abilitato nei metadati del progetto, devi disattivarlo temporaneamente fino al completamento del deployment. Ai fini del deployment, questa procedura configura le chiavi SSH nei metadati dell'istanza. Quando l'accesso al sistema operativo è abilitato, le configurazioni delle chiavi SSH basate su metadati vengono disabilitate e questo deployment non va a buon fine. Al termine del deployment, puoi riattivare l'accesso al sistema operativo.

Per ulteriori informazioni, vedi:

Creare una rete

Per motivi di sicurezza, crea una nuova rete. Puoi controllare chi ha accesso aggiungendo regole firewall o utilizzando un altro metodo di controllo dell'accesso.

Se il progetto ha una rete VPC predefinita, non utilizzarla. Crea invece una tua rete VPC in modo che le uniche regole firewall in vigore siano quelle che crei esplicitamente.

Durante il deployment, le istanze Compute Engine in genere richiedono l'accesso a internet per scaricare l'agente per SAP di Google Cloud. Se utilizzi una delle immagini Linux certificate da SAP disponibili su Google Cloud, l'istanza di calcolo richiede anche l'accesso a internet per registrare la licenza e accedere ai repository del fornitore del sistema operativo. Una configurazione con un gateway NAT e con tag di rete VM supporta questo accesso, anche se le istanze di calcolo di destinazione non hanno IP esterni.

Per configurare la rete:

Console

- Nella console Google Cloud , vai alla pagina Reti VPC.

- Fai clic su Crea rete VPC.

- Inserisci un nome per la rete.

Il nome deve rispettare la convenzione di denominazione. Le reti VPC utilizzano la convenzione di denominazione di Compute Engine.

- In Modalità di creazione subnet, scegli Personalizzata.

- Nella sezione Nuova subnet, specifica i seguenti parametri di configurazione per una

subnet:

- Inserisci un nome per la subnet.

- Per Regione, seleziona la regione Compute Engine in cui vuoi creare la sottorete.

- In Tipo di stack IP, seleziona IPv4 (stack singolo) e poi inserisci un intervallo di indirizzi IP nel formato CIDR, ad esempio

10.1.0.0/24.Si tratta dell'intervallo IPv4 principale per la subnet. Se prevedi di aggiungere più di una subnet, assegni intervalli IP CIDR non sovrapposti per ogni subnet della rete. Tieni presente che ogni subnet e i relativi intervalli IP interni sono mappati a una singola regione.

- Fai clic su Fine.

- Per aggiungere altre subnet, fai clic su Aggiungi subnet e ripeti i passaggi precedenti. Puoi aggiungere altre subnet alla rete dopo averla creata.

- Fai clic su Crea.

gcloud

- Vai a Cloud Shell.

- Per creare una nuova rete in modalità di subnet personalizzate, esegui:

gcloud compute networks create NETWORK_NAME --subnet-mode custom

Sostituisci

NETWORK_NAMEcon il nome della nuova rete. Il nome deve rispettare la convenzione di denominazione. Le reti VPC utilizzano la convenzione di denominazione di Compute Engine.Specifica

--subnet-mode customper evitare di utilizzare la modalità automatica predefinita, che crea automaticamente una subnet in ogni regione Compute Engine. Per ulteriori informazioni, consulta la sezione Modalità di creazione subnet. - Crea una subnet e specifica la regione e l'intervallo IP:

gcloud compute networks subnets create SUBNETWORK_NAME \ --network NETWORK_NAME --region REGION --range RANGESostituisci quanto segue:

SUBNETWORK_NAME: il nome della nuova subnetNETWORK_NAME: il nome della rete creata nel passaggio precedenteREGION: la regione in cui vuoi la subnetRANGE: l'intervallo di indirizzi IP, specificato in formato CIDR, ad esempio10.1.0.0/24Se prevedi di aggiungere più di una subnet, assegna intervalli IP CIDR non sovrapposti per ogni subnet della rete. Tieni presente che ogni subnet e i relativi intervalli IP interni sono mappati a una singola regione.

- Se vuoi, ripeti il passaggio precedente e aggiungi altre sottoreti.

Configurazione di un gateway NAT

Se devi creare una o più VM senza indirizzi IP pubblici, devi utilizzare la Network Address Translation (NAT) per consentire alle VM di accedere a internet. Utilizza Cloud NAT, un Google Cloud servizio gestito software-defined distribuito che consente alle VM di inviare pacchetti in uscita a internet e di ricevere eventuali pacchetti di risposta in entrata stabiliti corrispondenti. In alternativa, puoi configurare una VM separata come gateway NAT.

Per creare un'istanza Cloud NAT per il tuo progetto, consulta Utilizzo di Cloud NAT.

Dopo aver configurato Cloud NAT per il progetto, le istanze VM possono accedere in sicurezza a internet senza un indirizzo IP pubblico.

aggiungi regole firewall

Per impostazione predefinita, una regola del firewall implicita blocca le connessioni in entrata dall'esterno della rete Virtual Private Cloud (VPC). Per consentire le connessioni in entrata, configura una regola firewall per la tua VM. Dopo aver stabilito una connessione in entrata con una VM, il traffico è consentito in entrambe le direzioni tramite la connessione.

Puoi anche creare una regola firewall per consentire l'accesso esterno a porte specifiche o per limitare l'accesso tra le VM sulla stessa rete. Se viene utilizzato il tipo di rete VPC default, vengono applicate anche alcune regole predefinite aggiuntive, come la regola default-allow-internal, che consente la connettività tra le VM sulla stessa rete su tutte le porte.

A seconda dei criteri IT applicabili al tuo ambiente, potresti dover isolare o limitare in altro modo la connettività all'host del database, cosa che puoi fare creando regole firewall.

A seconda dello scenario, puoi creare regole firewall per consentire l'accesso per:

- Le porte SAP predefinite elencate in TCP/IP di tutti i prodotti SAP.

- Connessioni dal tuo computer o dall'ambiente di rete aziendale all'istanza VM Compute Engine. Se hai dubbi su quale indirizzo IP utilizzare, rivolgiti all'amministratore di rete della tua azienda.

- Comunicazione tra le VM nella sottorete SAP HANA, inclusa la comunicazione tra i nodi di un sistema SAP HANA scalabile o tra il server di database e i server delle applicazioni in un'architettura a tre livelli. Puoi attivare la comunicazione tra le VM creando una regola firewall per consentire il traffico proveniente dalla sottorete.

Per creare una regola firewall:

Console

Nella console Google Cloud , vai alla pagina Firewall della rete VPC.

Nella parte superiore della pagina, fai clic su Crea regola firewall.

- Nel campo Rete, seleziona la rete in cui si trova la VM.

- Nel campo Destinazioni, specifica le risorse Google Cloud a cui si applica questa regola. Ad esempio, specifica Tutte le istanze nella rete. In alternativa, per limitare la regola a istanze specifiche Google Cloud, inserisci i tag in Tag target specificati.

- Nel campo Filtro origine, seleziona una delle seguenti opzioni:

- Intervalli IP per consentire il traffico in entrata da indirizzi IP specifici. Specifica l'intervallo di indirizzi IP nel campo Intervalli IP di origine.

- Subnet per consentire il traffico in entrata da una determinata subnet. Specifica il nome della sottorete nel seguente Subnet. Puoi utilizzare questa opzione per consentire l'accesso tra le VM in una configurazione a 3 livelli o scalabile.

- Nella sezione Protocolli e porte, seleziona Protocolli e porte specificati e inserisci

tcp:PORT_NUMBER.

Fai clic su Crea per creare la regola firewall.

gcloud

Crea una regola firewall utilizzando il seguente comando:

$ gcloud compute firewall-rules create FIREWALL_NAME

--direction=INGRESS --priority=1000 \

--network=NETWORK_NAME --action=ALLOW --rules=PROTOCOL:PORT \

--source-ranges IP_RANGE --target-tags=NETWORK_TAGSCreazione di un sistema SAP HANA scalabile orizzontalmente con host di riserva

Nelle istruzioni riportate di seguito, completa le seguenti azioni:

- Crea il sistema SAP HANA richiamando Deployment Manager con un modello di file di configurazione che completi.

- Verifica il deployment.

- Testa gli host di riserva simulando un errore dell'host.

Alcuni passaggi delle istruzioni riportate di seguito utilizzano Cloud Shell per inserire i comandi gcloud. Se hai installato la versione più recente di Google Cloud CLI, puoi inserire i comandi gcloud da un terminale locale.

Definisci e crea il sistema SAP HANA

Nei passaggi che seguono, scarichi e completi un modello di file di configurazione di Deployment Manager e richiami Deployment Manager, che esegue il deployment delle VM, dei dischi persistenti e delle istanze SAP HANA.

Verifica che le quote attuali per le risorse del progetto, come CPU e dischi permanenti, siano sufficienti per il sistema SAP HANA che stai per installare. Se le quote non sono sufficienti, il deployment non riesce. Per i requisiti relativi alle quote di SAP HANA, consulta Considerazioni su prezzi e quote per SAP HANA.

Apri Cloud Shell.

Scarica il modello di file di configurazione

template.yamlper il sistema scalabile orizzontale ad alta disponibilità SAP HANA nella tua directory di lavoro:wget https://storage.googleapis.com/cloudsapdeploy/deploymentmanager/latest/dm-templates/sap_hana_scaleout/template.yaml

Se vuoi, rinomina il file

template.yamlper identificare la configurazione che definisce. Ad esempio, puoi utilizzare un nome file comehana2sp3rev30-scaleout.yaml.Apri il file

template.yamlnell'editor di codice di Cloud Shell.Per aprire l'editor di codice di Cloud Shell, fai clic sull'icona a forma di matita nell'angolo in alto a destra della finestra del terminale di Cloud Shell.

Nel file

template.yaml, aggiorna i seguenti valori delle proprietà sostituendo le parentesi e i relativi contenuti con i valori per la tua installazione. Ad esempio, puoi sostituire "[ZONE]" con "us-central1-f".Proprietà Tipo di dati Descrizione tipo Stringa Specifica la posizione, il tipo e la versione del modello Deployment Manager da utilizzare durante il deployment.

Il file YAML include due specifiche

type, una delle quali è commentata. La specificatypeattiva per impostazione predefinita specifica la versione del modello comelatest. La specificatypecommentata specifica una versione del modello specifica con un timestamp.Se vuoi che tutti i tuoi implementazioni utilizzino la stessa versione del modello, utilizza la specifica

typeche include il timestamp.instanceNameStringa Il nome dell'istanza VM per l'host master SAP HANA. Il nome deve essere specificato con lettere minuscole, numeri o trattini. Le istanze VM per gli host worker e di riserva utilizzano lo stesso nome con "w" e il numero dell'host aggiunti al nome. instanceTypeStringa Il tipo di macchina virtuale Compute Engine su cui devi eseguire SAP HANA. Se hai bisogno di un tipo di VM personalizzato, specifica un tipo di VM predefinito con un numero di vCPU più vicino a quello di cui hai bisogno, pur essendo più grande. Al termine del deployment, modifica il numero di vCPU e la quantità di memoria. zoneStringa La zona in cui esegui il deployment dei sistemi SAP HANA per farli eseguire. Deve trovarsi nella regione selezionata per la subnet. subnetworkStringa Il nome della sottorete creata in un passaggio precedente. Se esegui il deployment in un VPC condiviso, specifica questo valore come [SHAREDVPC_PROJECT]/[SUBNETWORK]. Ad esempio,myproject/network1.linuxImageStringa Il nome dell'immagine o della famiglia di immagini del sistema operativo Linux che utilizzi con SAP HANA. Per specificare una famiglia di immagini, aggiungi il prefisso family/al nome della famiglia. Ad esempio,family/rhel-8-1-sap-haofamily/sles-15-sp2-sap. Per specificare un'immagine specifica, specifica solo il nome dell'immagine. Per l'elenco delle famiglie di immagini disponibili, consulta la pagina Immagini nella console Google Cloud .linuxImageProjectStringa Il Google Cloud progetto che contiene l'immagine che hai intenzione di utilizzare. Può trattarsi del tuo progetto o di un Google Cloud progetto immagine. Per un'immagine Compute Engine, specifica rhel-sap-cloudosuse-sap-cloud. Per trovare il progetto immagine per il tuo sistema operativo, consulta Dettagli del sistema operativo.sap_hana_deployment_bucketStringa Il nome del bucket Cloud Storage nel progetto che contiene i file di installazione di SAP HANA che hai caricato in un passaggio precedente. sap_hana_sidStringa L'ID sistema SAP HANA. L'ID deve essere composto da 3 caratteri alfanumerici e deve iniziare con una lettera. Tutte le lettere devono essere in maiuscolo. sap_hana_instance_numberNumero intero Il numero di istanza, compreso tra 0 e 99, del sistema SAP HANA. Il valore predefinito è 0. sap_hana_sidadm_passwordStringa Una password temporanea per l'amministratore del sistema operativo da utilizzare durante il deployment. Le password devono essere costituite da almeno 8 caratteri e includere almeno una lettera maiuscola, una lettera minuscola e un numero. sap_hana_system_passwordStringa Una password temporanea per il superutente del database da utilizzare durante il deployment. Le password devono essere costituite da almeno 8 caratteri e includere almeno una lettera maiuscola, una lettera minuscola e un numero. sap_hana_worker_nodesNumero intero Il numero di host worker SAP HANA aggiuntivi di cui hai bisogno. Puoi specificare da 1 a 15 host worker. Il valore predefinito è 1. sap_hana_standby_nodesNumero intero Il numero di host SAP HANA standby aggiuntivi di cui hai bisogno. Puoi specificare da 1 a 3 host di riserva. Il valore predefinito è 1. sap_hana_shared_nfsStringa Il punto di montaggio NFS per il volume /hana/shared. Ad esempio,10.151.91.122:/hana_shared_nfs.sap_hana_backup_nfsStringa Il punto di montaggio NFS per il volume /hanabackup. Ad esempio,10.216.41.122:/hana_backup_nfs.networkTagStringa Facoltativo. Uno o più tag di rete separati da virgola che rappresentano l'istanza VM a fini di firewall o routing. Se specifichi publicIP: Noe non specifichi un tag di rete, assicurati di fornire un altro mezzo di accesso a internet.nic_typeStringa Facoltativo, ma consigliato se disponibile per la macchina e la versione del sistema operativo di destinazione. Specifica l'interfaccia di rete da utilizzare con l'istanza VM. Puoi specificare il valore GVNICoVIRTIO_NET. Per utilizzare una Google Virtual NIC (gVNIC), devi specificare un'immagine del sistema operativo che supporti gVNIC come valore per la proprietàlinuxImage. Per l'elenco delle immagini del sistema operativo, consulta Dettagli del sistema operativo.Se non specifichi un valore per questa proprietà, l'interfaccia di rete viene selezionata automaticamente in base al tipo di macchina specificato per la proprietà

Questo argomento è disponibile nelle versioni dei modelli di Deployment ManagerinstanceType.202302060649o successive.publicIPBooleano Facoltativo. Determina se viene aggiunto un indirizzo IP pubblico alla tua istanza VM. Il valore predefinito è Yes.sap_hana_double_volume_sizeNumero intero Facoltativo. Raddoppia le dimensioni del volume HANA. È utile se vuoi eseguire il deployment di più istanze SAP HANA o di un'istanza SAP HANA di ripristino di emergenza nella stessa VM. Per impostazione predefinita, la dimensione del volume viene calcolata automaticamente in base alla dimensione minima richiesta per l'impronta di memoria, pur soddisfacendo i requisiti di certificazione e assistenza SAP. sap_hana_sidadm_uidNumero intero Facoltativo. Sostituisce il valore predefinito dell'ID utente SID_LCadm. Il valore predefinito è 900. Puoi impostare un valore diverso per la coerenza all'interno del tuo panorama SAP.sap_hana_sapsys_gidNumero intero Facoltativo. Sostituisce l'ID gruppo predefinito per sapsys. Il valore predefinito è 79. sap_deployment_debugBooleano Facoltativo. Se questo valore è impostato su Yes, il deployment genera log dettagliati. Non attivare questa impostazione a meno che un tecnico del servizio di assistenza Google non ti chieda di attivare il debug.post_deployment_scriptBooleano Facoltativo. L'URL o la posizione di archiviazione di uno script da eseguire al termine del deployment. Lo script deve essere ospitato su un server web o in un bucket Cloud Storage. Inizia il valore con http://, https:// o gs://. Tieni presente che questo script verrà eseguito su tutte le VM create dal modello. Se vuoi eseguire lo script solo sull'istanza principale, dovrai aggiungere un controllo nella parte superiore dello script. L'esempio seguente mostra un file di configurazione completo che esegue il deployment di un sistema SAP HANA scalabile orizzontalmente con tre host worker e un host di riserva nella zona us-central1-f. Ogni host è installato su una VM n2-highmem-32 che esegue un sistema operativo Linux fornito da un'immagine pubblica di Compute Engine. I volumi NFS sono forniti da Filestore. Le password temporary vengono utilizzate solo durante l'elaborazione del deployment e della configurazione. L'account di servizio personalizzato specificato diventerà l'account di servizio delle VM di cui è stato eseguito il deployment.

resources: - name: sap_hana_ha_scaleout type: https://storage.googleapis.com/cloudsapdeploy/deploymentmanager/latest/dm-templates/sap_hana_scaleout/sap_hana_scaleout.py # # By default, this configuration file uses the latest release of the deployment # scripts for SAP on Google Cloud. To fix your deployments to a specific release # of the scripts, comment out the type property above and uncomment the type property below. # # type: https://storage.googleapis.com/cloudsapdeploy/deploymentmanager/YYYYMMDDHHMM/dm-templates/sap_hana_scaleout/sap_hana_scaleout.py # properties: instanceName: hana-scaleout-w-failover instanceType: n2-highmem-32 zone: us-central1-f subnetwork: example-sub-network-sap linuxImage: family/sles-15-sp2-sap linuxImageProject: suse-sap-cloud sap_hana_deployment_bucket: hana2-sp5-rev53 sap_hana_sid: HF0 sap_hana_instance_number: 00 sap_hana_sidadm_password: TempPa55word sap_hana_system_password: TempPa55word sap_hana_worker_nodes: 3 sap_hana_standby_nodes: 1 sap_hana_shared_nfs: 10.74.146.58:/hana_shr sap_hana_backup_nfs: 10.188.249.170:/hana_bup serviceAccount: sap-deploy-example@example-project-123456.Crea le istanze:

gcloud deployment-manager deployments create [DEPLOYMENT_NAME] --config [TEMPLATE_NAME].yamlIl comando precedente richiama Deployment Manager, che configura l' Google Cloud infrastruttura e poi richiama un altro script che configura il sistema operativo e installa SAP HANA.

Mentre Deployment Manager ha il controllo, i messaggi di stato vengono scritti in Cloud Shell. Dopo l'attivazione degli script, i messaggi di stato vengono scritti in Logging e sono visualizzabili nella Google Cloud console, come descritto in Controllare i log di Logging.

Il tempo di completamento può variare, ma l'intera procedura richiede in genere meno di 30 minuti.

Verifica del deployment

Per verificare il deployment, controlla i log di deployment in Cloud Logging, controlla i dischi e i servizi sulle VM degli host principali e di lavoro, visualizza il sistema in SAP HANA Studio e testa il rilevamento da parte di un host di riserva.

Controlla i log

Nella Google Cloud console, apri Cloud Logging per monitorare l'avanzamento dell'installazione e verificare la presenza di errori.

Filtra i log:

Esplora log

Nella pagina Esplora log, vai al riquadro Query.

Dal menu a discesa Risorsa, seleziona Globale e poi fai clic su Aggiungi.

Se non vedi l'opzione Globale, nell'editor di query inserisci la seguente query:

resource.type="global" "Deployment"Fai clic su Esegui query.

Visualizzatore log legacy

- Nella pagina Visualizzatore log legacy, seleziona Globale come risorsa di log nel menu del selettore di base.

Analizza i log filtrati:

- Se viene visualizzato

"--- Finished", significa che l'elaborazione del deployment è completata e puoi procedere al passaggio successivo. Se viene visualizzato un errore relativo alla quota:

Nella pagina IAM e amministrazione Quote, aumenta le quote che non soddisfano i requisiti di SAP HANA elencati nella guida alla pianificazione di SAP HANA.

Nella pagina Deployment di Deployment Manager, elimina il deployment per ripulire le VM e i dischi permanenti dall'installazione non riuscita.

Esegui di nuovo il deployment.

- Se viene visualizzato

Connettiti alle VM per controllare i dischi e i servizi SAP HANA

Al termine del deployment, verifica che i dischi e i servizi SAP HANA siano stati implementati correttamente controllando i dischi e i servizi dell'host master e di un host worker.

Nella pagina Istanze VM di Compute Engine, connettiti alla VM dell'host principale e alla VM di un host worker facendo clic sul pulsante SSH nella riga di ciascuna delle due istanze VM.

Quando ti connetti all'host di lavoro, assicurati di non connetterti a un host di riserva. Gli host di riserva utilizzano la stessa convenzione di denominazione degli host worker, ma hanno il suffisso dell'host worker con il numero più alto prima del primo takeover. Ad esempio, se hai tre host worker e un host di riserva, prima del primo rilevamento l'host di riserva ha il suffisso "w4".

In ogni finestra del terminale, passa all'utente root.

sudo su -

In ogni finestra del terminale, viene visualizzato il file system del disco.

df -h

Nell'host principale, dovresti vedere un output simile al seguente.

hana-scaleout-w-failover:~ # df -h Filesystem Size Used Avail Use% Mounted on devtmpfs 126G 8.0K 126G 1% /dev tmpfs 189G 0 189G 0% /dev/shm tmpfs 126G 18M 126G 1% /run tmpfs 126G 0 126G 0% /sys/fs/cgroup /dev/sda3 45G 5.6G 40G 13% / /dev/sda2 20M 2.9M 18M 15% /boot/efi 10.135.35.138:/hana_shr 1007G 50G 906G 6% /hana/shared tmpfs 26G 0 26G 0% /run/user/473 10.197.239.138:/hana_bup 1007G 0 956G 0% /hanabackup tmpfs 26G 0 26G 0% /run/user/900 /dev/mapper/vg_hana-data 709G 7.7G 702G 2% /hana/data/HF0/mnt00001 /dev/mapper/vg_hana-log 125G 5.3G 120G 5% /hana/log/HF0/mnt00001 tmpfs 26G 0 26G 0% /run/user/1003

Su un host di lavoro, tieni presente che le directory

/hana/datae/hana/loghanno montaggi diversi.hana-scaleout-w-failoverw2:~ # df -h Filesystem Size Used Avail Use% Mounted on devtmpfs 126G 8.0K 126G 1% /dev tmpfs 189G 0 189G 0% /dev/shm tmpfs 126G 9.2M 126G 1% /run tmpfs 126G 0 126G 0% /sys/fs/cgroup /dev/sda3 45G 5.6G 40G 13% / /dev/sda2 20M 2.9M 18M 15% /boot/efi tmpfs 26G 0 26G 0% /run/user/0 10.135.35.138:/hana_shr 1007G 50G 906G 6% /hana/shared 10.197.239.138:/hana_bup 1007G 0 956G 0% /hanabackup /dev/mapper/vg_hana-data 709G 821M 708G 1% /hana/data/HF0/mnt00003 /dev/mapper/vg_hana-log 125G 2.2G 123G 2% /hana/log/HF0/mnt00003 tmpfs 26G 0 26G 0% /run/user/1003

Su un host di riserva, le directory di dati e log non vengono montate fino a quando l'host di riserva non prende il controllo di un host non funzionante.

hana-scaleout-w-failoverw4:~ # df -h Filesystem Size Used Avail Use% Mounted on devtmpfs 126G 8.0K 126G 1% /dev tmpfs 189G 0 189G 0% /dev/shm tmpfs 126G 18M 126G 1% /run tmpfs 126G 0 126G 0% /sys/fs/cgroup /dev/sda3 45G 5.6G 40G 13% / /dev/sda2 20M 2.9M 18M 15% /boot/efi tmpfs 26G 0 26G 0% /run/user/0 10.135.35.138:/hana_shr 1007G 50G 906G 6% /hana/shared 10.197.239.138:/hana_bup 1007G 0 956G 0% /hanabackup tmpfs 26G 0 26G 0% /run/user/1003

In ogni finestra del terminale, passa all'utente del sistema operativo SAP HANA.

su - SID_LCadm

Sostituisci

SID_LCcon il valore SID specificato nel modello del file di configurazione. Utilizza le lettere minuscole.In ogni finestra del terminale, assicurati che i servizi SAP HANA, come

hdbnameserver,hdbindexservere altri, siano in esecuzione nell'istanza.HDB info

Nell'host principale, dovresti vedere un output simile a quello riportato nel seguente esempio troncato:

hf0adm@hana-scaleout-w-failover:/usr/sap/HF0/HDB00> HDB info USER PID PPID %CPU VSZ RSS COMMAND hf0adm 5936 5935 0.7 18540 6776 -sh hf0adm 6011 5936 0.0 14128 3856 \_ /bin/sh /usr/sap/HF0/HDB00/HDB info hf0adm 6043 6011 0.0 34956 3568 \_ ps fx -U hf0adm -o user:8,pid:8,ppid:8,pcpu:5,vsz:10 hf0adm 17950 1 0.0 23052 3168 sapstart pf=/hana/shared/HF0/profile/HF0_HDB00_hana-scaleout hf0adm 17957 17950 0.0 457332 70956 \_ /usr/sap/HF0/HDB00/hana-scaleout-w-failover/trace/hdb.sa hf0adm 17975 17957 1.8 9176656 3432456 \_ hdbnameserver hf0adm 18334 17957 0.4 4672036 229204 \_ hdbcompileserver hf0adm 18337 17957 0.4 4941180 257348 \_ hdbpreprocessor hf0adm 18385 17957 4.5 9854464 4955636 \_ hdbindexserver -port 30003 hf0adm 18388 17957 1.2 7658520 1424708 \_ hdbxsengine -port 30007 hf0adm 18865 17957 0.4 6640732 526104 \_ hdbwebdispatcher hf0adm 14230 1 0.0 568176 32100 /usr/sap/HF0/HDB00/exe/sapstartsrv pf=/hana/shared/HF0/profi hf0adm 10920 1 0.0 710684 51560 hdbrsutil --start --port 30003 --volume 3 --volumesuffix mn hf0adm 10575 1 0.0 710680 51104 hdbrsutil --start --port 30001 --volume 1 --volumesuffix mn hf0adm 10217 1 0.0 72140 7752 /usr/lib/systemd/systemd --user hf0adm 10218 10217 0.0 117084 2624 \_ (sd-pam)

Su un host di lavoro, dovresti vedere un output simile a quello riportato nel seguente esempio troncato:

hf0adm@hana-scaleout-w-failoverw2:/usr/sap/HF0/HDB00> HDB info USER PID PPID %CPU VSZ RSS COMMAND hf0adm 22136 22135 0.3 18540 6804 -sh hf0adm 22197 22136 0.0 14128 3892 \_ /bin/sh /usr/sap/HF0/HDB00/HDB info hf0adm 22228 22197 100 34956 3528 \_ ps fx -U hf0adm -o user:8,pid:8,ppid:8,pcpu:5,vsz:10 hf0adm 9138 1 0.0 23052 3064 sapstart pf=/hana/shared/HF0/profile/HF0_HDB00_hana-scaleout hf0adm 9145 9138 0.0 457360 70900 \_ /usr/sap/HF0/HDB00/hana-scaleout-w-failoverw2/trace/hdb. hf0adm 9163 9145 0.7 7326228 755772 \_ hdbnameserver hf0adm 9336 9145 0.5 4670756 226972 \_ hdbcompileserver hf0adm 9339 9145 0.6 4942460 259724 \_ hdbpreprocessor hf0adm 9385 9145 2.0 7977460 1666792 \_ hdbindexserver -port 30003 hf0adm 9584 9145 0.5 6642012 528840 \_ hdbwebdispatcher hf0adm 8226 1 0.0 516532 52676 hdbrsutil --start --port 30003 --volume 5 --volumesuffix mn hf0adm 7756 1 0.0 567520 31316 /hana/shared/HF0/HDB00/exe/sapstartsrv pf=/hana/shared/HF0/p

Su un host di riserva, dovresti vedere un output simile a quello riportato nel seguente esempio troncato:

hana-scaleout-w-failoverw4:~ # su - hf0adm hf0adm@hana-scaleout-w-failoverw4:/usr/sap/HF0/HDB00> HDB info USER PID PPID %CPU VSZ RSS COMMAND hf0adm 19926 19925 0.2 18540 6748 -sh hf0adm 19987 19926 0.0 14128 3864 \_ /bin/sh /usr/sap/HF0/HDB00/HDB info hf0adm 20019 19987 0.0 34956 3640 \_ ps fx -U hf0adm -o user:8,pid:8,ppid:8,pcpu:5,vsz:10 hf0adm 8120 1 0.0 23052 3232 sapstart pf=/hana/shared/HF0/profile/HF0_HDB00_hana-scaleout hf0adm 8127 8120 0.0 457348 71348 \_ /usr/sap/HF0/HDB00/hana-scaleout-w-failoverw4/trace/hdb. hf0adm 8145 8127 0.6 7328784 708284 \_ hdbnameserver hf0adm 8280 8127 0.4 4666916 223892 \_ hdbcompileserver hf0adm 8283 8127 0.4 4939904 256740 \_ hdbpreprocessor hf0adm 8328 8127 0.4 6644572 534044 \_ hdbwebdispatcher hf0adm 7374 1 0.0 633568 31520 /hana/shared/HF0/HDB00/exe/sapstartsrv pf=/hana/shared/HF0/p

Se utilizzi RHEL per SAP 9.0 o versioni successive, assicurati che i pacchetti

chkconfigecompat-openssl11siano installati nell'istanza VM.Per ulteriori informazioni di SAP, consulta Nota SAP 3108316 - Red Hat Enterprise Linux 9.x: installazione e configurazione .

Connetti SAP HANA Studio

Connettiti all'host SAP HANA principale da SAP HANA Studio.

Puoi connetterti da un'istanza di SAP HANA Studio esterna Google Cloud o da un'istanza su Google Cloud. Potresti dover attivare l'accesso alla rete tra le VM di destinazione e SAP HANA Studio.

Per utilizzare SAP HANA Studio su Google Cloud e abilitare l'accesso al sistema SAP HANA, consulta Installazione di SAP HANA Studio su una VM Windows Compute Engine.

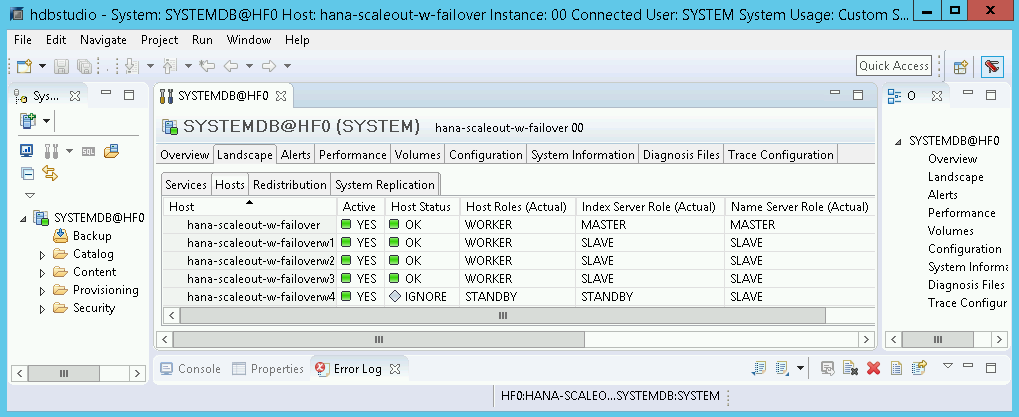

In SAP HANA Studio, fai clic sulla scheda Landscape (Panoramica) nel riquadro di amministrazione del sistema predefinito. Dovresti visualizzare una schermata simile all'esempio riportato di seguito.

Se uno dei passaggi di convalida indica che l'installazione non è riuscita:

- Correggi l'errore.

- Nella pagina Deployment, elimina il deployment.

- Esegui di nuovo il deployment.

Eseguire un test di failover

Dopo aver verificato che il sistema SAP HANA sia stato implementato correttamente, testa la funzione di failover.

Le istruzioni riportate di seguito attivano un failover passando all'utente del sistema operativo SAP HANA e inserendo il comando HDB stop. Il comando HDB stop

avvia un arresto di SAP HANA e scollega i dischi dall'host, il che consente un failover relativamente rapido.

Per eseguire un test di failover:

Connettiti alla VM di un host di lavoro tramite SSH. Puoi connetterti dalla pagina delle istanze VM di Compute Engine facendo clic sul pulsante SSH per ogni istanza VM oppure puoi utilizzare il metodo SSH che preferisci.

Passa all'utente del sistema operativo SAP HANA. Nell'esempio seguente, sostituisci

SID_LCcon l'SID che hai definito per il tuo sistema.su - SID_LCadm

Simula un errore arrestando SAP HANA:

HDB stop

Il comando

HDB stopavvia l'arresto di SAP HANA, che attiva un failover. Durante il failover, i dischi vengono scollegati dall'host in cui si è verificato il problema e ricollegati all'host di riserva. L'host con errore viene riavviato e diventa un host di riserva.Dopo aver concesso il tempo necessario per il completamento del passaggio di proprietà, riconnettiti all'host che ha assunto il controllo dell'host non riuscito utilizzando SSH.

Passa all'utente root.

sudo su -

Mostra il file system dei dischi delle VM per gli host master e worker.

df -h

Dovresti vedere un output simile al seguente. Le directory

/hana/datae/hana/logdell'host che ha avuto un problema ora sono montate sull'host che ha preso il controllo.hana-scaleout-w-failoverw4:~ # df -h Filesystem Size Used Avail Use% Mounted on devtmpfs 126G 8.0K 126G 1% /dev tmpfs 189G 0 189G 0% /dev/shm tmpfs 126G 9.2M 126G 1% /run tmpfs 126G 0 126G 0% /sys/fs/cgroup /dev/sda3 45G 5.6G 40G 13% / /dev/sda2 20M 2.9M 18M 15% /boot/efi tmpfs 26G 0 26G 0% /run/user/0 10.74.146.58:/hana_shr 1007G 50G 906G 6% /hana/shared 10.188.249.170:/hana_bup 1007G 0 956G 0% /hanabackup /dev/mapper/vg_hana-data 709G 821M 708G 1% /hana/data/HF0/mnt00003 /dev/mapper/vg_hana-log 125G 2.2G 123G 2% /hana/log/HF0/mnt00003 tmpfs 26G 0 26G 0% /run/user/1003

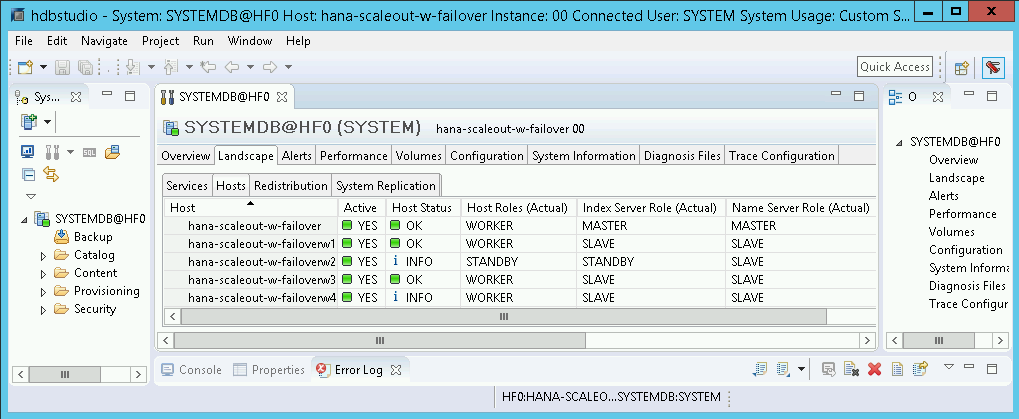

In SAP HANA Studio, apri la visualizzazione Landscape del sistema SAP HANA per verificare che il failover sia andato a buon fine:

- Lo stato degli host coinvolti nel failover deve essere

INFO. - La colonna Ruolo del server di indicizzazione (effettivo) dovrebbe mostrare l'host con errori come il nuovo host di riserva.

- Lo stato degli host coinvolti nel failover deve essere

Convalida l'installazione dell'agente per SAP di Google Cloud

Dopo aver disegnato una VM e installato il sistema SAP, verifica che Agent per SAP diGoogle Cloudfunzioni correttamente.

Verifica che l'agente per SAP di Google Cloudsia in esecuzione

Per verificare che l'agente sia in esecuzione:

Stabilisci una connessione SSH con la tua istanza Compute Engine.

Esegui questo comando:

systemctl status google-cloud-sap-agent

Se l'agente funziona correttamente, l'output contiene

active (running). Ad esempio:google-cloud-sap-agent.service - Google Cloud Agent for SAP Loaded: loaded (/usr/lib/systemd/system/google-cloud-sap-agent.service; enabled; vendor preset: disabled) Active: active (running) since Fri 2022-12-02 07:21:42 UTC; 4 days ago Main PID: 1337673 (google-cloud-sa) Tasks: 9 (limit: 100427) Memory: 22.4 M (max: 1.0G limit: 1.0G) CGroup: /system.slice/google-cloud-sap-agent.service └─1337673 /usr/bin/google-cloud-sap-agent

Se l'agente non è in esecuzione, riavvialo.

Verificare che l'agente host SAP riceva le metriche

Per verificare che le metriche dell'infrastruttura vengano raccolte dall'agente diGoogle Cloudper SAP e inviate correttamente all'agente host SAP, segui questi passaggi:

- Nel sistema SAP, inserisci la transazione

ST06. Nel riquadro di panoramica, controlla la disponibilità e i contenuti dei seguenti campi per la configurazione end-to-end corretta dell'infrastruttura di monitoraggio di SAP e Google:

- Fornitore di servizi cloud:

Google Cloud Platform - Accesso al monitoraggio avanzato:

TRUE - Dettagli sul monitoraggio migliorati:

ACTIVE

- Fornitore di servizi cloud:

Configurare il monitoraggio per SAP HANA

Se vuoi, puoi monitorare le tue istanze SAP HANA utilizzando Agente per SAP diGoogle Cloud. Dalla versione 2.0, puoi configurare l'agente per raccogliere le metriche di monitoraggio di SAP HANA e inviarle a Cloud Monitoring. Cloud Monitoring ti consente di creare dashboard per visualizzare queste metriche, configurare avvisi in base alle soglie delle metriche e altro ancora.

Per ulteriori informazioni sulla raccolta delle metriche di monitoraggio di SAP HANA utilizzando Agente per SAP diGoogle Cloud, consulta la raccolta delle metriche di monitoraggio di SAP HANA.

Attivare il riavvio rapido di SAP HANA

Google Cloud Consiglia vivamente di attivare il riavvio rapido di SAP HANA per ogni istanza di SAP HANA, in particolare per le istanze più grandi. Il riavvio rapido di SAP HANA riduce il tempo di riavvio nel caso in cui SAP HANA si arresti, ma il sistema operativo rimanga in esecuzione.

Come configurato dagli script di automazione forniti,

le impostazioni del sistema operativo e del kernel supportano già il riavvio rapido di SAP HANA. Google Cloud

Devi definire il file system tmpfs e configurare SAP HANA.

Per definire il file system tmpfs e configurare SAP HANA, puoi seguire i passaggi manuali o utilizzare lo script di automazione fornito daGoogle Cloud per attivare il riavvio rapido di SAP HANA. Per ulteriori informazioni, consulta:

- Passaggi manuali: attivare il riavvio rapido di SAP HANA

- Passaggi automatici: attiva Fast Restart di SAP HANA

Per istruzioni autorevoli complete su SAP HANA Fast Restart, consulta la documentazione dell'opzione SAP HANA Fast Restart.

Procedura manuale

Configura il file system tmpfs

Dopo aver eseguito il deployment delle VM host e dei sistemi SAP HANA di base,

devi creare e montare le directory per i nodi NUMA nel file system tmpfs.

Mostra la topologia NUMA della VM

Prima di poter mappare il file system tmpfs richiesto, devi sapere quanti nodi NUMA sono presenti nella tua VM. Per visualizzare i nodi NUMA disponibili su una VM Compute Engine, inserisci il seguente comando:

lscpu | grep NUMA

Ad esempio, un tipo di VM m2-ultramem-208 ha quattro nodi NUMA,

numerati da 0 a 3, come mostrato nell'esempio seguente:

NUMA node(s): 4 NUMA node0 CPU(s): 0-25,104-129 NUMA node1 CPU(s): 26-51,130-155 NUMA node2 CPU(s): 52-77,156-181 NUMA node3 CPU(s): 78-103,182-207

Crea le directory dei nodi NUMA

Crea una directory per ogni nodo NUMA nella VM e imposta le autorizzazioni.

Ad esempio, per quattro nodi NUMA numerati da 0 a 3:

mkdir -pv /hana/tmpfs{0..3}/SID

chown -R SID_LCadm:sapsys /hana/tmpfs*/SID

chmod 777 -R /hana/tmpfs*/SIDMonta le directory dei nodi NUMA su tmpfs

Monta le directory del file system tmpfs e specifica

una preferenza per il nodo NUMA per ciascuna con mpol=prefer:

SID specifica il SID con lettere maiuscole.

mount tmpfsSID0 -t tmpfs -o mpol=prefer:0 /hana/tmpfs0/SID mount tmpfsSID1 -t tmpfs -o mpol=prefer:1 /hana/tmpfs1/SID mount tmpfsSID2 -t tmpfs -o mpol=prefer:2 /hana/tmpfs2/SID mount tmpfsSID3 -t tmpfs -o mpol=prefer:3 /hana/tmpfs3/SID

Aggiorna /etc/fstab

Per assicurarti che i punti di montaggio siano disponibili dopo il riavvio del sistema operativo, aggiungi voci alla tabella del file system, /etc/fstab:

tmpfsSID0 /hana/tmpfs0/SID tmpfs rw,nofail,relatime,mpol=prefer:0 tmpfsSID1 /hana/tmpfs1/SID tmpfs rw,nofail,relatime,mpol=prefer:1 tmpfsSID1 /hana/tmpfs2/SID tmpfs rw,nofail,relatime,mpol=prefer:2 tmpfsSID1 /hana/tmpfs3/SID tmpfs rw,nofail,relatime,mpol=prefer:3

(Facoltativo) Imposta limiti all'utilizzo della memoria

Il file system tmpfs può aumentare e diminuire dinamicamente.

Per limitare la memoria utilizzata dal file system tmpfs, puoi impostare un limite di dimensioni per un volume del nodo NUMA con l'opzione size.

Ad esempio:

mount tmpfsSID0 -t tmpfs -o mpol=prefer:0,size=250G /hana/tmpfs0/SID

Puoi anche limitare l'utilizzo complessivo della memoria tmpfs per tutti i nodi NUMA per

una determinata istanza SAP HANA e un determinato nodo del server impostando il

parametro persistent_memory_global_allocation_limit nella sezione [memorymanager]

del file global.ini.

Configurazione di SAP HANA per il riavvio rapido

Per configurare SAP HANA per il riavvio rapido, aggiorna il file global.ini

e specifica le tabelle da archiviare nella memoria persistente.

Aggiorna la sezione [persistence] nel file global.ini

Configura la sezione [persistence] nel file global.ini di SAP HANA

per fare riferimento alle località tmpfs. Separa ogni località tmpfs con un punto e virgola:

[persistence] basepath_datavolumes = /hana/data basepath_logvolumes = /hana/log basepath_persistent_memory_volumes = /hana/tmpfs0/SID;/hana/tmpfs1/SID;/hana/tmpfs2/SID;/hana/tmpfs3/SID

L'esempio precedente specifica quattro volumi di memoria per quattro nodi NUMA,

che corrispondono a m2-ultramem-208. Se esegui la tua esecuzione su m2-ultramem-416, devi configurare otto volumi di memoria (0-7).

Riavvia SAP HANA dopo aver modificato il file global.ini.

Ora SAP HANA può utilizzare la posizione tmpfs come spazio di memoria permanente.

Specifica le tabelle da archiviare nella memoria persistente

Specifica tabelle o partizioni di colonne specifiche da archiviare nella memoria persistente.

Ad esempio, per attivare la memoria persistente per una tabella esistente, esegui la query SQL:

ALTER TABLE exampletable persistent memory ON immediate CASCADE

Per modificare il valore predefinito per le nuove tabelle, aggiungi il parametro

table_default nel file indexserver.ini. Ad esempio:

[persistent_memory] table_default = ON

Per ulteriori informazioni su come controllare le colonne, le tabelle e le visualizzazioni di monitoraggio che forniscono informazioni dettagliate, consulta Memoria persistente SAP HANA.

Passaggi automatici

Lo script di automazione fornito Google Cloud per attivare il riavvio rapido di SAP HANA apporta modifiche alle directory /hana/tmpfs*, al file /etc/fstab e alla configurazione di SAP HANA. Quando esegui lo script, potresti dover eseguire passaggi aggiuntivi a seconda che si tratti del deployment iniziale del sistema SAP HANA o se stai ridimensionando la macchina a una dimensione NUMA diversa.

Per il deployment iniziale del sistema SAP HANA o per il ridimensionamento della macchina al fine di aumentare il numero di nodi NUMA, assicurati che SAP HANA sia in esecuzione durante l'esecuzione dello script di automazione fornito per attivare il riavvio rapido di SAP HANA. Google Cloud

Quando redimensioni la macchina per ridurre il numero di nodi NUMA, assicurati che SAP HANA sia interrotta durante l'esecuzione dello script di automazione che consente di attivare il riavvio rapido di SAP HANA. Google Cloud Dopo l'esecuzione dello script, devi aggiornare manualmente la configurazione di SAP HANA per completare la configurazione del riavvio rapido di SAP HANA. Per ulteriori informazioni, consulta la configurazione di SAP HANA per il riavvio rapido.

Per attivare il riavvio rapido di SAP HANA:

Stabilisci una connessione SSH con la VM host.

Passa al root:

sudo su -

Scarica lo script

sap_lib_hdbfr.sh:wget https://storage.googleapis.com/cloudsapdeploy/terraform/latest/terraform/lib/sap_lib_hdbfr.sh

Rendi eseguibile il file:

chmod +x sap_lib_hdbfr.sh

Verifica che lo script non contenga errori:

vi sap_lib_hdbfr.sh ./sap_lib_hdbfr.sh -help

Se il comando restituisce un errore, contatta l'assistenza clienti Google Cloud. Per ulteriori informazioni su come contattare l'assistenza clienti, consulta Ricevere assistenza per SAP su Google Cloud.

Esegui lo script dopo aver sostituito l'ID sistema (SID) e la password di SAP HANA per l'utente SYSTEM del database SAP HANA. Per fornire la password in modo sicuro, ti consigliamo di utilizzare un secret in Secret Manager.

Esegui lo script utilizzando il nome di un secret in Secret Manager. Questo segreto deve esistere nel Google Cloud progetto che contiene l'istanza VM host.

sudo ./sap_lib_hdbfr.sh -h 'SID' -s SECRET_NAME

Sostituisci quanto segue:

SID: specifica l'SID con lettere maiuscole. Ad esempio,AHA.SECRET_NAME: specifica il nome del segreto corrispondente alla password per l'utente SYSTEM del database SAP HANA. Questo segreto deve esistere nel Google Cloud progetto che contiene l'istanza VM host.

In alternativa, puoi eseguire lo script utilizzando una password in testo normale. Dopo aver attivato il riavvio rapido di SAP HANA, assicurati di cambiare la password. L'utilizzo di una password in testo normale non è consigliato perché la password verrà registrata nella cronologia della riga di comando della VM.

sudo ./sap_lib_hdbfr.sh -h 'SID' -p 'PASSWORD'

Sostituisci quanto segue:

SID: specifica l'SID con lettere maiuscole. Ad esempio,AHA.PASSWORD: specifica la password per l'utente SYSTEM del database SAP HANA.

Se l'esecuzione iniziale è andata a buon fine, dovresti vedere un output simile al seguente:

INFO - Script is running in standalone mode

ls: cannot access '/hana/tmpfs*': No such file or directory

INFO - Setting up HANA Fast Restart for system 'TST/00'.

INFO - Number of NUMA nodes is 2

INFO - Number of directories /hana/tmpfs* is 0

INFO - HANA version 2.57

INFO - No directories /hana/tmpfs* exist. Assuming initial setup.

INFO - Creating 2 directories /hana/tmpfs* and mounting them

INFO - Adding /hana/tmpfs* entries to /etc/fstab. Copy is in /etc/fstab.20220625_030839

INFO - Updating the HANA configuration.

INFO - Running command: select * from dummy

DUMMY

"X"

1 row selected (overall time 4124 usec; server time 130 usec)

INFO - Running command: ALTER SYSTEM ALTER CONFIGURATION ('global.ini', 'SYSTEM') SET ('persistence', 'basepath_persistent_memory_volumes') = '/hana/tmpfs0/TST;/hana/tmpfs1/TST;'

0 rows affected (overall time 3570 usec; server time 2239 usec)

INFO - Running command: ALTER SYSTEM ALTER CONFIGURATION ('global.ini', 'SYSTEM') SET ('persistent_memory', 'table_unload_action') = 'retain';

0 rows affected (overall time 4308 usec; server time 2441 usec)

INFO - Running command: ALTER SYSTEM ALTER CONFIGURATION ('indexserver.ini', 'SYSTEM') SET ('persistent_memory', 'table_default') = 'ON';

0 rows affected (overall time 3422 usec; server time 2152 usec)

Connessione a SAP HANA

Tieni presente che, poiché queste istruzioni non utilizzano un IP esterno per SAP HANA, puoi collegarti alle istanze SAP HANA solo tramite l'istanza bastion utilizzando SSH o tramite il server Windows utilizzando SAP HANA Studio.

Per connetterti a SAP HANA tramite l'istanza bastion, connettiti all'bastion host e poi alle istanze SAP HANA utilizzando un client SSH di tua scelta.

Per connetterti al database SAP HANA tramite SAP HANA Studio, utilizza un client desktop remoto per connetterti all'istanza Windows Server. Dopo la connessione, installa manualmente SAP HANA Studio e accedi al tuo database SAP HANA.

Eseguire le attività di post-deployment

Prima di utilizzare l'istanza SAP HANA, ti consigliamo di eseguire i seguenti passaggi di post-deployment. Per ulteriori informazioni, consulta la Guida all'installazione e all'aggiornamento di SAP HANA.

Modifica le password temporanee per l'amministratore di sistema SAP HANA e per il superutente del database.

Aggiorna il software SAP HANA con le patch più recenti.

Installa eventuali componenti aggiuntivi come le librerie di funzioni per le applicazioni (AFL) o l'accesso ai dati intelligenti (SDA).

Se esegui l'upgrade di un sistema SAP HANA esistente, carica i dati dal sistema esistente utilizzando le procedure di backup e ripristino standard o la replica del sistema SAP HANA.

Configura e esegui il backup del nuovo database SAP HANA. Per ulteriori informazioni, consulta la guida alle operazioni di SAP HANA.

Passaggi successivi

- Per ulteriori informazioni sull'amministrazione e sul monitoraggio delle VM, consulta la Guida alle operazioni di SAP HANA.