Questa guida mostra come eseguire il deployment e configurare un cluster ad alta disponibilità (HA) Red Hat Enterprise Linux (RHEL) ottimizzato per le prestazioni per il sistema SAP NetWeaver.

Questa guida include i passaggi per:- Configurazione di un bilanciatore del carico di rete passthrough interno per reindirizzare il traffico in caso di errore.

- Configurazione di un cluster Pacemaker su RHEL per gestire i sistemi SAP e altre risorse durante un failover.

Questa guida include anche i passaggi per configurare il sistema SAP NetWeaver per l'HA, ma fai riferimento alla documentazione di SAP per le istruzioni definitive.

Per informazioni sul deployment di VM Compute Engine per SAP NetWeaver non specifiche per la disponibilità elevata, consulta la guida al deployment di SAP NetWeaver specifica per il tuo sistema operativo.

Per configurare un cluster ad alta disponibilità per SAP NetWeaver su SUSE Linux Enterprise Server (SLES), consulta la guida alla configurazione manuale del cluster ad alta disponibilità per SAP NetWeaver su SLES.

Questa guida è rivolta agli utenti avanzati di SAP NetWeaver che hanno familiarità con le configurazioni di disponibilità elevata di Linux per SAP NetWeaver.

Il sistema di cui questa guida descrive l'implementazione

Seguendo questa guida, eseguirai il deployment di due istanze SAP NetWeaver e configurerai un cluster ad alta disponibilità su RHEL. Esegui il deployment di ogni istanza SAP NetWeaver su una VM Compute Engine in una zona diversa all'interno della stessa regione. Questa guida non tratta l'installazione ad alta disponibilità del database sottostante.

Il cluster di cui è stato eseguito il deployment include le seguenti funzioni e funzionalità:

- Due VM host, una per l'istanza ASCS attiva e una per l'istanza attiva dell'Enqueue Replicator ENSA2 o del server di replicazione enqueue ENSA1. Entrambe le istanze ENSA2 ed ENSA1 sono indicate come ERS.

- Il gestore delle risorse del cluster ad alta disponibilità Pacemaker.

- Un meccanismo di isolamento STONITH.

- Riavvio automatico dell'istanza non riuscita come nuova istanza secondaria.

Per utilizzare Terraform per automatizzare il deployment di sistemi SAP NetWeaver ad alta disponibilità, consulta Terraform: guida alla configurazione del cluster ad alta disponibilità per SAP NetWeaver su RHEL.

Prerequisiti

Prima di creare il cluster SAP NetWeaver ad alta disponibilità, assicurati che siano soddisfatti i seguenti prerequisiti:

- Hai letto la guida alla pianificazione di SAP NetWeaver e la guida alla pianificazione dell'alta disponibilità per SAP NetWeaver su Google Cloud.

- Tu o la tua organizzazione avete un Google Cloud account e avete creato un progetto per il deployment di SAP NetWeaver. Per informazioni sulla creazione diGoogle Cloud account e progetti, consulta Creazione di un progetto nella Guida all'implementazione di SAP NetWeaver per Linux.

- Se vuoi che il tuo carico di lavoro SAP venga eseguito in conformità con la residenza dei dati, controllo dell'accesso, il personale di assistenza o i requisiti normativi, devi creare la cartella Assured Workloads richiesta. Per ulteriori informazioni, consulta Controlli di conformità e sovranità per SAP su Google Cloud.

Se utilizzi il DNS interno della VPC, il valore della variabile

vmDnsSettingnei metadati del progetto deve essereGlobalOnlyoZonalPreferredper abilitare la risoluzione dei nomi dei nodi nelle varie zone. L'impostazione predefinita divmDnsSettingèZonalOnly. Per ulteriori informazioni, consulta:Hai configurato una condivisione file utilizzando una soluzione di archiviazione file condivisa NFS, come Filestore Enterprise.

Se OS Login è abilitato nei metadati del progetto, devi disattivarlo temporaneamente fino al completamento del deployment. Ai fini del deployment, questa procedura configura le chiavi SSH nei metadati dell'istanza. Quando l'accesso al sistema operativo è abilitato, le configurazioni delle chiavi SSH basate su metadati vengono disabilitate e questo deployment non va a buon fine. Al termine del deployment, puoi riattivare l'accesso al sistema operativo.

Per ulteriori informazioni, vedi:

Informazioni correlate di RHEL

Salvo ove richiesto per l' Google Cloud ambiente, le informazioni riportate in questa guida sono coerenti con le seguenti guide correlate di Red Hat e SAP:

- Configurare SAP NetWeaver ASCS/ERS ENSA1 con risorse autonome in RHEL 7.5 e versioni successive e RHEL 8

- Configurare SAP S/4HANA ASCS/ERS con Standalone Enqueue Server 2 (ENSA2) in Pacemaker

- Nota SAP 2002167 - Red Hat Enterprise Linux 7.x: installazione e upgrade

- Nota SAP 2772999 - Red Hat Enterprise Linux 8.x: installazione e configurazione

- Nota SAP 3108316 - Red Hat Enterprise Linux 9.x: installazione e configurazione

- Nota SAP 2641322 - Installazione di ENSA2 e aggiornamento da ENSA1 a ENSA2 quando si utilizzano le soluzioni Red Hat HA per SAP

Creare una rete

Per motivi di sicurezza, crea una nuova rete. Puoi controllare chi ha accesso aggiungendo regole firewall o utilizzando un altro metodo di controllo dell'accesso.

Se il progetto ha una rete VPC predefinita, non utilizzarla. Crea invece una tua rete VPC in modo che le uniche regole firewall in vigore siano quelle che crei esplicitamente.

Durante il deployment, le istanze Compute Engine in genere richiedono l'accesso a internet per scaricare l'agente per SAP di Google Cloud. Se utilizzi una delle immagini Linux certificate da SAP disponibili su Google Cloud, l'istanza di calcolo richiede anche l'accesso a internet per registrare la licenza e accedere ai repository del fornitore del sistema operativo. Una configurazione con un gateway NAT e con tag di rete VM supporta questo accesso, anche se le istanze di calcolo di destinazione non hanno IP esterni.

Per configurare la rete:

Console

- Nella Google Cloud console, vai alla pagina Reti VPC.

- Fai clic su Crea rete VPC.

- Inserisci un nome per la rete.

Il nome deve rispettare la convenzione di denominazione. Le reti VPC utilizzano la convenzione di denominazione di Compute Engine.

- In Modalità di creazione subnet, scegli Personalizzata.

- Nella sezione Nuova subnet, specifica i seguenti parametri di configurazione per una

subnet:

- Inserisci un nome per la subnet.

- Per Regione, seleziona la regione Compute Engine in cui vuoi creare la sottorete.

- In Tipo di stack IP, seleziona IPv4 (stack singolo) e poi inserisci un intervallo di indirizzi IP nel formato CIDR, ad esempio

10.1.0.0/24.Si tratta dell'intervallo IPv4 principale per la subnet. Se prevedi di aggiungere più di una subnet, assegni intervalli IP CIDR non sovrapposti per ogni subnet della rete. Tieni presente che ogni subnet e i relativi intervalli IP interni sono mappati a una singola regione.

- Fai clic su Fine.

- Per aggiungere altre subnet, fai clic su Aggiungi subnet e ripeti i passaggi precedenti. Puoi aggiungere altre subnet alla rete dopo averla creata.

- Fai clic su Crea.

gcloud

- Vai a Cloud Shell.

- Per creare una nuova rete in modalità di subnet personalizzate, esegui:

gcloud compute networks create NETWORK_NAME --subnet-mode custom

Sostituisci

NETWORK_NAMEcon il nome della nuova rete. Il nome deve rispettare la convenzione di denominazione. Le reti VPC utilizzano la convenzione di denominazione di Compute Engine.Specifica

--subnet-mode customper evitare di utilizzare la modalità automatica predefinita, che crea automaticamente una subnet in ogni regione Compute Engine. Per ulteriori informazioni, consulta la sezione Modalità di creazione subnet. - Crea una subnet e specifica la regione e l'intervallo IP:

gcloud compute networks subnets create SUBNETWORK_NAME \ --network NETWORK_NAME --region REGION --range RANGESostituisci quanto segue:

SUBNETWORK_NAME: il nome della nuova subnetNETWORK_NAME: il nome della rete creata nel passaggio precedenteREGION: la regione in cui vuoi la subnetRANGE: l'intervallo di indirizzi IP, specificato in formato CIDR, ad esempio10.1.0.0/24Se prevedi di aggiungere più di una subnet, assegna intervalli IP CIDR non sovrapposti per ogni subnet della rete. Tieni presente che ogni subnet e i relativi intervalli IP interni sono mappati a una singola regione.

- Se vuoi, ripeti il passaggio precedente e aggiungi altre sottoreti.

Configurazione di un gateway NAT

Se devi creare una o più VM senza indirizzi IP pubblici, devi utilizzare la Network Address Translation (NAT) per consentire alle VM di accedere a internet. Utilizza Cloud NAT, un Google Cloud servizio gestito software-defined distribuito che consente alle VM di inviare pacchetti in uscita a internet e di ricevere eventuali pacchetti di risposta in entrata stabiliti corrispondenti. In alternativa, puoi configurare una VM separata come gateway NAT.

Per creare un'istanza Cloud NAT per il tuo progetto, consulta Utilizzo di Cloud NAT.

Dopo aver configurato Cloud NAT per il progetto, le istanze VM possono accedere in sicurezza a internet senza un indirizzo IP pubblico.

aggiungi regole firewall

Per impostazione predefinita, le connessioni in entrata dall'esterno della Google Cloud rete sono bloccate. Per consentire le connessioni in entrata, configura una regola firewall per la tua VM. Le regole firewall regolano solo le nuove connessioni in entrata a una VM. Dopo aver stabilito una connessione con una VM, il traffico è consentito in entrambe le direzioni su quella connessione.

Puoi creare una regola firewall per consentire l'accesso a porte specifiche o per consentire l'accesso tra le VM nella stessa sottorete.

Crea regole firewall per consentire l'accesso per elementi quali:

- Le porte predefinite utilizzate da SAP NetWeaver, come documentato in Porte TCP/IP di tutti i prodotti SAP.

- Connessioni dal tuo computer o dall'ambiente di rete aziendale all'istanza VM Compute Engine. Se hai dubbi su quale indirizzo IP utilizzare, rivolgiti all'amministratore di rete della tua azienda.

- Comunicazione tra VM in una configurazione a 3 livelli, scalabile o ad alta disponibilità. Ad esempio, se esegui il deployment di un sistema a tre livelli, nella sottorete avrai almeno due VM: la VM per SAP NetWeaver e un'altra VM per il server di database. Per abilitare la comunicazione tra le due VM, devi creare una regola firewall per consentire il traffico proveniente dalla sottorete.

- Controlli di integrità di Cloud Load Balancing. Per saperne di più, consulta Creare una regola firewall per i controlli di integrità.

Per creare una regola firewall:

Nella Google Cloud console, vai alla pagina Firewall della rete VPC.

Nella parte superiore della pagina, fai clic su Crea regola firewall.

- Nel campo Rete, seleziona la rete in cui si trova la VM.

- Nel campo Destinazioni, seleziona Tutte le istanze nella rete.

- Nel campo Filtro origine, seleziona una delle seguenti opzioni:

- Intervalli IP per consentire il traffico in entrata da indirizzi IP specifici. Specifica l'intervallo di indirizzi IP nel campo Intervalli IP di origine.

- Subnet per consentire il traffico in entrata da una determinata subnet. Specifica il nome della sottorete nel seguente subnet. Puoi utilizzare questa opzione per consentire l'accesso tra le VM in una configurazione a 3 livelli o scalabile.

- Nella sezione Protocolli e porte, seleziona Protocolli e porte specificati e specifica

tcp:PORT_NUMBER;.

Fai clic su Crea per creare la regola firewall.

Deployment delle VM per SAP NetWeaver

Prima di iniziare a configurare il cluster ad alta disponibilità, definisci ed esegui il deployment delle istanze VM che fungeranno da nodi principali e secondari nel cluster ad alta disponibilità.

Per definire ed eseguire il deployment delle VM, utilizza lo stesso modello Cloud Deployment Manager impiegato per eseguire il deployment di una VM per un sistema SAP NetWeaver in Deployment automatico delle VM per SAP NetWeaver su Linux.

Tuttavia, per eseguire il deployment di due VM anziché una, devi aggiungere la definizione della seconda VM al file di configurazione copiando e incollando la definizione della prima VM. Dopo aver creato la seconda definizione, devi modificare i nomi della risorsa e dell'istanza nella seconda definizione. Per proteggerti da un errore zonale, specifica un'altra zona nella stessa regione. Tutti gli altri valori delle proprietà nelle due definizioni rimangono invariati.

Dopo aver eseguito correttamente il deployment delle VM, installa SAP NetWeaver e definisci e configura il cluster HA.

Le istruzioni riportate di seguito utilizzano Cloud Shell, ma sono applicabili in generale a Google Cloud CLI.

Apri Cloud Shell.

Scarica il modello di file di configurazione YAML,

template.yaml, nella directory di lavoro:wget https://storage.googleapis.com/cloudsapdeploy/deploymentmanager/latest/dm-templates/sap_nw/template.yaml

Se vuoi, rinomina il file

template.yamlper identificare la configurazione che definisce. Ad esempio,nw-ha-rhel-8-4.yaml.Apri il file di configurazione YAML nell'editor di codice di Cloud Shell facendo clic sull'icona a forma di matita (edit) nell'angolo in alto a destra della finestra del terminale di Cloud Shell per avviare l'editor.

Nel modello di file di configurazione YAML, definisci la prima istanza VM. Definisci la seconda istanza VM nel passaggio successivo dopo la tabella seguente.

Specifica i valori delle proprietà sostituendo le parentesi e i relativi contenuti con i valori per la tua installazione. Le proprietà sono descritte nella tabella seguente. Per un esempio di un file di configurazione completato, consulta Esempio di un file di configurazione YAML completo.

Proprietà Tipo di dati Descrizione nameStringa Un nome arbitrario che identifica la risorsa di deployment definita dal seguente insieme di proprietà. typeStringa Specifica la posizione, il tipo e la versione del template Deployment Manager da utilizzare durante il deployment.

Il file YAML include due specifiche

type, una delle quali è commentata. La specificatypeattiva per impostazione predefinita specifica la versione del modello comelatest. La specificatypecommentata specifica una versione del modello specifica con un timestamp.Se vuoi che tutti i tuoi implementazioni utilizzino la stessa versione del modello, utilizza la specifica

typeche include il timestamp.instanceNameStringa Il nome dell'istanza VM che stai definendo. Specifica nomi diversi nelle definizioni delle VM principali e secondarie. Valuta la possibilità di utilizzare nomi che identifichino le istanze come appartenenti allo stesso cluster ad alta disponibilità. I nomi delle istanze devono contenere al massimo 13 caratteri ed essere specificati con lettere minuscole, numeri o trattini. Utilizza un nome univoco all'interno del progetto.

instanceTypeStringa Il tipo di VM Compute Engine di cui hai bisogno. Specifica lo stesso tipo di istanza per le VM principali e secondarie. Se hai bisogno di un tipo di VM personalizzato, specifica un piccolo tipo di VM predefinito e, al termine del deployment, personalizza la VM in base alle tue esigenze.

zoneStringa La Google Cloud zona in cui eseguire il deployment dell'istanza VM che stai definendo. Specifica zone diverse nella stessa regione per le definizioni della VM principale e secondaria. Le zone devono trovarsi nella stessa regione selezionata per la subnet. subnetworkStringa Il nome della sottorete creata in un passaggio precedente. Se esegui il deployment in un VPC condiviso, specifica questo valore come SHAREDVPC_PROJECT/SUBNETWORK. Ad esempio,myproject/network1.linuxImageStringa Il nome dell'immagine o della famiglia di immagini del sistema operativo Linux che utilizzi con SAP NetWeaver. Per specificare una famiglia di immagini, aggiungi il prefisso family/al nome della famiglia. Ad esempio,family/rhel-8-4-sap-ha. Per l'elenco delle famiglie di immagini disponibili, consulta la pagina Immagini nella console Google Cloud .linuxImageProjectStringa Il Google Cloud progetto che contiene l'immagine che hai intenzione di utilizzare. Questo progetto potrebbe essere il tuo progetto o il Google Cloud progetto immagine rhel-sap-cloud. Per un elenco dei Google Cloud progetti di immagini, consulta la pagina Immagini nella documentazione di Compute Engine.usrsapSizeNumero intero Le dimensioni del disco /usr/sap. La dimensione minima è di 8 GB.sapmntSizeNumero intero Le dimensioni del disco /sapmnt. La dimensione minima è di 8 GB.swapSizeNumero intero La dimensione del volume dello scambio. La dimensione minima è 1 GB. networkTagStringa Facoltativo. Uno o più tag di rete separati da virgole che rappresentano l'istanza VM a fini di firewall o routing.

Per le configurazioni ad alta disponibilità, specifica un tag di rete da utilizzare per una regola firewall che consenta la comunicazione tra i nodi del cluster e un tag di rete da utilizzare in una regola firewall che consenta ai controlli di integrità Cloud Load Balancing di accedere ai nodi del cluster.

Se specifichi

publicIP: Noe non specifichi un tag di rete, assicurati di fornire un altro mezzo di accesso a internet.serviceAccountStringa Facoltativo. Specifica un account di servizio personalizzato da utilizzare per la VM di cui è stato eseguito il deployment. L'account di servizio deve includere le autorizzazioni necessarie durante il deployment per configurare la VM per SAP.

Se

serviceAccountnon è specificato, viene utilizzato il account di servizio Compute Engine predefinito.Specifica l'indirizzo completo dell'account di servizio. Ad esempio:

sap-ha-example@example-project-123456.publicIPBooleano Facoltativo. Determina se viene aggiunto un indirizzo IP pubblico alla tua istanza VM. Il valore predefinito è Yes.sap_deployment_debugBooleano Facoltativo. Se questo valore è impostato su Yes, il deployment genera log dettagliati. Non attivare questa impostazione a meno che un tecnico del servizio di assistenza Google non ti chieda di attivare il debug.Nel file di configurazione YAML, crea la definizione della seconda VM copiando la definizione della prima VM e incollando la copia dopo la prima definizione. Per un esempio, consulta Esempio di file di configurazione YAML completo.

Nella definizione della seconda VM, specifica valori diversi per le seguenti proprietà rispetto a quelli specificati nella prima definizione:

nameinstanceNamezone

Crea le istanze VM:

gcloud deployment-manager deployments create DEPLOYMENT_NAME --config TEMPLATE_NAME.yaml

dove:

DEPLOYMENT_NAMErappresenta il nome del deployment.TEMPLATE_NAMErappresenta il nome del file di configurazione YAML.

Il comando precedente richiama Deployment Manager, che esegue il deployment delle VM in base alle specifiche nel file di configurazione YAML.

L'elaborazione del deployment prevede due fasi. Nella prima fase, Deployment Manager scrive il proprio stato nella console. Nella seconda fase, gli script di deployment scrivono il loro stato in Cloud Logging.

Esempio di file di configurazione YAML completo

L'esempio seguente mostra un file di configurazione YAML completo che esegue il deployment di due istanze VM per una configurazione HA per SAP NetWeaver utilizzando la versione più recente dei modelli di Deployment Manager. L'esempio omette i commenti contenuti nel modello al primo download.

Il file contiene le definizioni di due risorse da eseguire il deployment:

sap_nw_node_1 e sap_nw_node_2. Ogni definizione della risorsa contiene le definizioni di una VM.

La definizione della risorsa sap_nw_node_2 è stata creata copiando e incollando la prima definizione, quindi modificando i valori delle proprietà name, instanceName e zone. Tutti gli altri valori delle proprietà nelle due definizioni delle risorse sono uguali.

Le proprietà networkTag e serviceAccount provengono dalla sezione Opzioni avanzate del modello del file di configurazione.

resources:

- name: sap_nw_node_1

type: https://storage.googleapis.com/cloudsapdeploy/deploymentmanager/latest/dm-templates/sap_nw/sap_nw.py

properties:

instanceName: nw-ha-vm-1

instanceType: n2-standard-4

zone: us-central1-b

subnetwork: example-sub-network-sap

linuxImage: family/rhel-8-4-sap-ha

linuxImageProject: rhel-sap-cloud

usrsapSize: 15

sapmntSize: 15

swapSize: 24

networkTag: cluster-ntwk-tag,allow-health-check

serviceAccount: limited-roles@example-project-123456.

- name: sap_nw_node_2

type: https://storage.googleapis.com/cloudsapdeploy/deploymentmanager/latest/dm-templates/sap_nw/sap_nw.py

properties:

instanceName: nw-ha-vm-2

instanceType: n2-standard-4

zone: us-central1-c

subnetwork: example-sub-network-sap

linuxImage: family/rhel-8-4-sap-ha

linuxImageProject: rhel-sap-cloud

usrsapSize: 15

sapmntSize: 15

swapSize: 24

networkTag: cluster-ntwk-tag,allow-health-check

serviceAccount: limited-roles@example-project-123456.Creare regole firewall che consentano l'accesso alle VM host

Se non l'hai già fatto, crea regole firewall che consentano l'accesso a ogni VM host dalle seguenti origini:

- A scopo di configurazione, la tua workstation locale, un bastion host o un server di jump

- Per l'accesso tra i nodi del cluster, le altre VM host nel cluster HA

- I controlli di integrità utilizzati da Cloud Load Balancing, come descritto nel passaggio successivo Creare una regola firewall per i controlli di integrità.

Quando crei regole firewall VPC, specifichi i tag di rete che hai definito nel file di configurazione template.yaml per designare le VM host come target della regola.

Per verificare il deployment, definisci una regola per consentire le connessioni SSH sulla porta 22 da un bastion host o dalla tua workstation locale.

Per l'accesso tra i nodi del cluster, aggiungi una regola firewall che consenta tutti i tipi di connessione su qualsiasi porta da altre VM nella stessa sottorete.

Prima di procedere alla sezione successiva, assicurati che le regole del firewall per la verifica del deployment e per la comunicazione all'interno del cluster siano state create. Per istruzioni, vedi Aggiungere regole firewall.

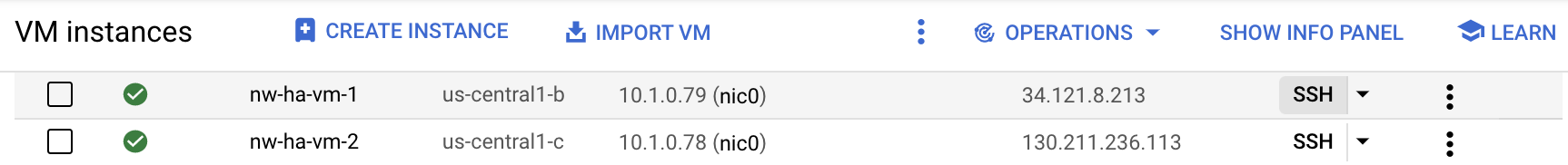

Verifica del deployment delle VM

Prima di installare SAP NetWeaver o di iniziare a configurare il cluster HA, verifica che le VM siano state implementate correttamente controllando i log e la mappatura dello spazio di archiviazione del sistema operativo.

Controlla i log

Nella Google Cloud console, apri Cloud Logging per monitorare l'avanzamento dell'installazione e verificare la presenza di errori.

Filtra i log:

Esplora log

Nella pagina Esplora log, vai al riquadro Query.

Dal menu a discesa Risorsa, seleziona Globale e poi fai clic su Aggiungi.

Se non vedi l'opzione Globale, nell'editor di query inserisci la seguente query:

resource.type="global" "Deployment"Fai clic su Esegui query.

Visualizzatore log legacy

- Nella pagina Visualizzatore log legacy, seleziona Globale come risorsa di logging nel menu del selettore di base.

Analizza i log filtrati:

- Se viene visualizzato

"--- Finished", significa che l'elaborazione del deployment è completata e puoi procedere al passaggio successivo. Se viene visualizzato un errore relativo alla quota:

Nella pagina IAM e amministrazione Quote, aumenta le quote che non soddisfano i requisiti di SAP NetWeaver elencati nella guida alla pianificazione di SAP NetWeaver.

Nella pagina Deployment di Deployment Manager, elimina il deployment per ripulire le VM e i dischi permanenti dall'installazione non riuscita.

Esegui di nuovo il deployment.

- Se viene visualizzato

Controlla la configurazione delle VM

Dopo il deployment delle istanze VM, connettiti alle VM utilizzando

ssh.- Se non l'hai ancora fatto,

crea una regola firewall

per consentire una connessione SSH sulla porta

22. Vai alla pagina Istanze VM.

Connettiti a ogni istanza VM facendo clic sul pulsante SSH nella voce corrispondente a ogni istanza VM oppure puoi utilizzare il metodo SSH che preferisci.

- Se non l'hai ancora fatto,

crea una regola firewall

per consentire una connessione SSH sulla porta

Visualizza il file system:

~>df -hAssicurati di visualizzare un output simile al seguente:

Filesystem Size Used Avail Use% Mounted on devtmpfs 32G 8.0K 32G 1% /dev tmpfs 48G 0 48G 0% /dev/shm tmpfs 32G 402M 32G 2% /run tmpfs 32G 0 32G 0% /sys/fs/cgroup /dev/sda3 30G 3.4G 27G 12% / /dev/sda2 20M 3.7M 17M 19% /boot/efi /dev/mapper/vg_usrsap-vol 15G 48M 15G 1% /usr/sap

/dev/mapper/vg_sapmnt-vol 15G 48M 15G 1% /sapmnt tmpfs 6.3G 0 6.3G 0% /run/user/1002 tmpfs 6.3G 0 6.3G 0% /run/user/0Verifica che lo spazio di scambio sia stato creato:

~>cat /proc/meminfo | grep SwapVedrai risultati simili all'esempio seguente:

SwapCached: 0 kB SwapTotal: 25161724 kB SwapFree: 25161724 kB

Se uno dei passaggi di convalida indica che l'installazione non è riuscita:

- Correggi l'errore.

- Nella pagina Deployment, elimina il deployment per ripulire le VM e i dischi permanenti dall'installazione non riuscita.

- Esegui di nuovo il deployment.

Abilita la comunicazione di backend del bilanciatore del carico tra le VM

Dopo aver verificato che le VM sono state implementate correttamente, attiva la comunicazione di backend tra le VM che fungeranno da nodi nel cluster ad alta disponibilità.

Attiva la comunicazione di backend tra le VM modificando la configurazione del google-guest-agent, incluso nell'ambiente guest Linux per tutte le immagini pubbliche Linux fornite da Google Cloud.

Per attivare le comunicazioni di backend del bilanciatore del carico, svolgi i seguenti passaggi su ogni VM che fa parte del cluster:

Interrompi l'agente:

sudo service google-guest-agent stop

Apri o crea il file

/etc/default/instance_configs.cfgper modificarlo. Ad esempio:sudo vi /etc/default/instance_configs.cfg

Nel file

/etc/default/instance_configs.cfg, specifica le seguenti proprietà di configurazione come mostrato. Se le sezioni non esistono, creane di nuove. In particolare, assicurati che entrambe le proprietàtarget_instance_ipseip_forwardingsiano impostate sufalse:[IpForwarding] ethernet_proto_id = 66 ip_aliases = true target_instance_ips = false [NetworkInterfaces] dhclient_script = /sbin/google-dhclient-script dhcp_command = ip_forwarding = false setup = true

Avvia il servizio dell'agente ospite:

sudo service google-guest-agent start

La configurazione del controllo di integrità del bilanciatore del carico richiede sia una porta di destinazione in ascolto per il controllo di integrità sia l'assegnazione dell'IP virtuale a un'interfaccia. Per ulteriori informazioni, consulta Testare la configurazione del bilanciatore del carico.

Configura le chiavi SSH sulle VM principali e secondarie

Per consentire la copia dei file tra gli host nel cluster HA, i passaggi di questa sezione creano connessioni SSH root tra i due host.

I modelli di Deployment Manager forniti Google Cloud generano una chiave per te, ma puoi sostituirla con una chiave che genera tu, se necessario.

La tua organizzazione ha probabilmente linee guida che regolano le comunicazioni della rete interna. Se necessario, al termine del deployment puoi rimuovere i metadati dalle VM e le chiavi dalla directory authorized_keys.

Se la configurazione di connessioni SSH dirette non è conforme alle linee guida della tua organizzazione, puoi trasferire i file utilizzando altri metodi, ad esempio:

- Trasferisci file di dimensioni ridotte tramite la tua workstation locale utilizzando le opzioni di menu Carica file e Scarica file di Cloud Shell. Consulta Gestire i file con Cloud Shell.

- Scambia file utilizzando un bucket Cloud Storage. Consulta Caricamenti e download.

- Utilizza una soluzione di archiviazione file come Filestore o Google Cloud NetApp Volumes per creare una cartella condivisa. Consulta Soluzioni di condivisione dei file.

Per abilitare le connessioni SSH tra le istanze principale e secondaria: I passaggi presuppongono che tu stia utilizzando la chiave SSH generata dai modelli di Deployment Manager per SAP.

Nella VM host principale:

Connettiti alla VM tramite SSH.

Passa al root:

$sudo su -Verifica che la chiave SSH esista:

#ls -l /root/.ssh/Dovresti vedere i file della chiave id_rsa come nell'esempio seguente:

-rw-r--r-- 1 root root 569 May 4 23:07 authorized_keys -rw------- 1 root root 2459 May 4 23:07 id_rsa -rw-r--r-- 1 root root 569 May 4 23:07 id_rsa.pub

Aggiorna i metadati della VM principale con le informazioni sulla chiave SSH per la VM secondaria.

#gcloud compute instances add-metadata SECONDARY_VM_NAME \ --metadata "ssh-keys=$(whoami):$(cat ~/.ssh/id_rsa.pub)" \ --zone SECONDARY_VM_ZONEVerifica che le chiavi SSH siano configurate correttamente aprendo una connessione SSH dal sistema principale al sistema secondario:

#ssh SECONDARY_VM_NAME

Nella VM host secondaria:

Accedi tramite SSH alla VM.

Passa al root:

$sudo su -Verifica che la chiave SSH esista:

#ls -l /root/.ssh/Dovresti vedere i file della chiave id_rsa come nell'esempio seguente:

-rw-r--r-- 1 root root 569 May 4 23:07 authorized_keys -rw------- 1 root root 2459 May 4 23:07 id_rsa -rw-r--r-- 1 root root 569 May 4 23:07 id_rsa.pub

Aggiorna i metadati della VM secondaria con le informazioni sulla chiave SSH per la VM principale.

#gcloud compute instances add-metadata PRIMARY_VM_NAME \ --metadata "ssh-keys=$(whoami):$(cat ~/.ssh/id_rsa.pub)" \ --zone PRIMARY_VM_ZONE#cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keysVerifica che le chiavi SSH siano configurate correttamente aprendo una connessione SSH dal sistema secondario al sistema principale.

#ssh PRIMARY_VM_NAME

Configurare lo spazio di archiviazione dei file condivisi e le directory condivise

Devi configurare una soluzione di condivisione file NFS che fornisca uno spazio di archiviazione per file con elevata disponibilità a cui possono accedere entrambi i nodi del cluster HA. Poi, crea directory su entrambi i nodi che mappano allo spazio di archiviazione dei file condivisi. Il software del cluster garantisce che le directory appropriate vengano montate solo sulle istanze corrette.

La configurazione di una soluzione di condivisione di file non è trattata in questa guida. Per istruzioni sulla configurazione del sistema di condivisione dei file, consulta le istruzioni fornite dal fornitore della soluzione selezionata. Se scegli di utilizzare Filestore per la tua soluzione di condivisione file, ti consigliamo di utilizzare il livello Enterprise di Filestore. Per scoprire come creare un'istanza Filestore, consulta Creare istanze.

Per informazioni sulle soluzioni di condivisione file disponibili su Google Cloud, consulta Opzioni di archiviazione condivisa per i sistemi SAP HA su Google Cloud.

Per configurare le directory condivise:

Se non hai ancora configurato una soluzione di archiviazione file condivisa NFS a disponibilità elevata, fallo ora.

Monta lo spazio di archiviazione condiviso NFS su entrambi i server per la configurazione iniziale.

~>sudo mkdir /mnt/nfs~>sudo mount -t nfs NFS_PATH /mnt/nfsSostituisci

NFS_PATHcon il percorso della tua soluzione di condivisione di file NFS. Ad esempio,10.49.153.26:/nfs_share_nw_ha.Da uno dei server, crea le directory per

sapmnt, la directory di trasporto centrale e la directory specifica per l'istanza. Se utilizzi uno stack Java, sostituisci "ASCS" con "SCS" prima di utilizzare il seguente e qualsiasi altro comando di esempio:~>sudo mkdir /mnt/nfs/sapmntSID~>sudo mkdir /mnt/nfs/usrsap{trans,SIDASCSASCS_INSTANCE_NUMBER,SIDERSERS_INSTANCE_NUMBER}Se utilizzi una configurazione di montaggio semplice, esegui invece i seguenti comandi:

~>sudo mkdir /mnt/nfs/sapmntSID~>sudo mkdir /mnt/nfs/usrsap{trans,SID}Sostituisci quanto segue:

SID: l'ID sistema SAP (SID). Utilizza le lettere maiuscole per tutte le lettere. Ad esempio,AHA.ASCS_INSTANCE_NUMBER: il numero di istanza del sistema ASCS. Ad esempio,00.ERS_INSTANCE_NUMBER: il numero di istanza del sistema ERS. Ad esempio,10.

Crea i punti di montaggio necessari su entrambi i server:

~>sudo mkdir -p /sapmnt/SID~>sudo mkdir -p /usr/sap/trans~>sudo mkdir -p /usr/sap/SID/ASCSASCS_INSTANCE_NUMBER~>sudo mkdir -p /usr/sap/SID/ERSERS_INSTANCE_NUMBERSe utilizzi una configurazione di montaggio semplice, esegui invece i seguenti comandi:

~>sudo mkdir -p /sapmnt/SID~>sudo mkdir -p /usr/sap/trans~>sudo mkdir -p /usr/sap/SIDConfigura

autofsin modo da montare le directory dei file condivisi comuni quando si accede per la prima volta alle directory dei file. Il montaggio delle directoryASCSASCS_INSTANCE_NUMBEReERSERS_INSTANCE_NUMBERè gestito dal software del cluster, che viene configurato in un passaggio successivo.Modifica le opzioni NFS nei comandi in base alle esigenze della tua soluzione di condivisione file.

Su entrambi i server, configura

autofs:~>echo "/- /etc/auto.sap" | sudo tee -a /etc/auto.master~>NFS_OPTS="-rw,relatime,vers=3,hard,proto=tcp,timeo=600,retrans=2,mountvers=3,mountport=2050,mountproto=tcp"~>echo "/sapmnt/SID ${NFS_OPTS} NFS_PATH/sapmntSID" | sudo tee -a /etc/auto.sap~>echo "/usr/sap/trans ${NFS_OPTS} NFS_PATH/usrsaptrans" | sudo tee -a /etc/auto.sapPer informazioni su

autofs, consulta autofs - how it works.Se utilizzi una configurazione di montaggio semplice, esegui invece i seguenti comandi:

~>echo "/- /etc/auto.sap" | sudo tee -a /etc/auto.master~>NFS_OPTS="-rw,relatime,vers=3,hard,proto=tcp,timeo=600,retrans=2,mountvers=3,mountport=2050,mountproto=tcp"~>echo "/sapmnt/SID ${NFS_OPTS}/sapmnt" | sudo tee -a /etc/auto.sap~>echo "/usr/sap/trans ${NFS_OPTS}/usrsaptrans" | sudo tee -a /etc/auto.sap~>echo "/usr/sap/SID ${NFS_OPTS}/usrsapSID" | sudo tee -a /etc/auto.sapSu entrambi i server, avvia il servizio

autofs:~>sudo systemctl enable autofs~>sudo systemctl restart autofs~>sudo automount -vAttiva

autofsper montare le directory condivise accedendo a ogni directory utilizzando il comandocd. Ad esempio:~>cd /sapmnt/SID~>cd /usr/sap/transSe utilizzi una configurazione di montaggio semplice, esegui invece il seguente comando:

~>cd /sapmnt/SID~>cd /usr/sap/trans~>cd /usr/sap/SIDDopo aver eseguito l'accesso a tutte le directory, esegui il comando

df -Thper verificare che le directory siano montate.~>df -Th | grep FILE_SHARE_NAMESostituisci

FILE_SHARE_NAMEcon il nome della tua soluzione di condivisione file NFS. Ad esempio,nfs_share_nw_ha.Vedrai punti di montaggio e directory simili al seguente esempio:

10.49.153.26:/nfs_share_nw_ha nfs 1007G 76M 956G 1% /mnt/nfs 10.49.153.26:/nfs_share_nw_ha/usrsaptrans nfs 1007G 76M 956G 1% /usr/sap/trans 10.49.153.26:/nfs_share_nw_ha/sapmntAHA nfs 1007G 76M 956G 1% /sapmnt/AHA

Se utilizzi una configurazione di montaggio semplice, vedrai punti di montaggio e directory simili all'esempio seguente:

10.49.153.26:/nfs_share_nw_ha nfs 1007G 76M 956G 1% /mnt/nfs 10.49.153.26:/nfs_share_nw_ha/usrsaptrans nfs 1007G 76M 956G 1% /usr/sap/trans 10.49.153.26:/nfs_share_nw_ha/sapmntAHA nfs 1007G 76M 956G 1% /sapmnt/AHA 10.49.153.26:/nfs_share_nw_ha/usrsapAHA nfs 1007G 76M 956G 1% /usr/sap/AHA

Configurare il supporto del failover di Cloud Load Balancing

Il servizio di bilanciatore del carico di rete passthrough interno con supporto del failover instrada il traffico ASCS e ERS alle istanze attive di ciascun servizio in un cluster SAP NetWeaver. I bilanciatori del carico di rete passthrough interni utilizzano indirizzi IP virtuali (VIP), servizi di backend, gruppi di istanze e controlli di integrità per instradare il traffico in modo appropriato.

Prenota gli indirizzi IP per gli IP virtuali

Per un cluster SAP NetWeaver ad alta disponibilità, crei due VIP, talvolta indicati come indirizzi IP virtuali. Un VIP segue l'istanza SAP Central Services (SCS) attiva e l'altro segue l'istanza Enqueue Replication Server (ERS). Il bilanciatore del carico instrada il traffico inviato a ogni VIP alla VM che attualmente ospita l'istanza attiva del componente ASCS o ERS del VIP.

Apri Cloud Shell:

Prenota un indirizzo IP per l'IP virtuale dell'ASCS e per l'IP VIP dell'ERS. Per ASCS, l'indirizzo IP è quello utilizzato dalle applicazioni per accedere a SAP NetWeaver. Per ERS, l'indirizzo IP è quello utilizzato per la replica del server di coda. Se ometti il

--addressesflag, viene scelto un indirizzo IP nella subnet specificata:~gcloud compute addresses create ASCS_VIP_NAME \ --region CLUSTER_REGION --subnet CLUSTER_SUBNET \ --addresses ASCS_VIP_ADDRESS~gcloud compute addresses create ERS_VIP_NAME \ --region CLUSTER_REGION --subnet CLUSTER_SUBNET \ --addresses ERS_VIP_ADDRESSSostituisci quanto segue:

ASCS_VIP_NAME: specifica un nome per l'indirizzo IP virtuale dell'istanza ASCS. Ad esempio,ascs-aha-vip.CLUSTER_REGION: specifica la Google Cloud regione in cui si trova il tuo cluster. Ad esempio,us-central1CLUSTER_SUBNET: specifica la sottorete che utilizzi con il cluster. Ad esempio,example-sub-network-sap.ASCS_VIP_ADDRESS: facoltativamente, specifica un indirizzo IP per l'IP virtuale dell'ASCS in notazione CIDR. Ad esempio,10.1.0.2.ERS_VIP_NAME: specifica un nome per l'indirizzo IP virtuale dell'istanza ERS. Ad esempio,ers-aha-vip.ERS_VIP_ADDRESS: facoltativamente, specifica un indirizzo IP per l'IP virtuale ERS in notazione CIDR. Ad esempio,10.1.0.4.

Per ulteriori informazioni sulla prenotazione di un indirizzo IP statico, consulta Prenotazione di un indirizzo IP interno statico.

Conferma la prenotazione dell'indirizzo IP:

~gcloud compute addresses describe VIP_NAME \ --region CLUSTER_REGIONDovresti vedere un output simile al seguente esempio:

address: 10.1.0.2 addressType: INTERNAL creationTimestamp: '2022-04-04T15:04:25.872-07:00' description: '' id: '555067171183973766' kind: compute#address name: ascs-aha-vip networkTier: PREMIUM purpose: GCE_ENDPOINT region: https://www.googleapis.com/compute/v1/projects/example-project-123456/regions/us-central1 selfLink: https://www.googleapis.com/compute/v1/projects/example-project-123456/regions/us-central1/addresses/ascs-aha-vip status: RESERVED subnetwork: https://www.googleapis.com/compute/v1/projects/example-project-123456/regions/us-central1/subnetworks/example-sub-network-sap

Definisci i nomi host per l'indirizzo VIP in /etc/hosts

Definisci un nome host per ogni indirizzo VIP e poi aggiungi gli indirizzi IP e i nomi host sia per le VM sia per i VIP al file /etc/hosts su ogni VM.

I nomi host VIP non sono noti al di fuori delle VM, a meno che non li aggiunga anche al

tuo servizio DNS. L'aggiunta di queste voci al file /etc/hosts locale protegge il cluster da eventuali interruzioni del servizio DNS.

Gli aggiornamenti al file /etc/hosts dovrebbero essere simili al seguente

esempio:

127.0.0.1 localhost localhost.localdomain localhost4 localhost4.localdomain4 ::1 localhost localhost.localdomain localhost6 localhost6.localdomain6 10.1.0.113 nw-ha-vm-2.us-central1-c.c.example-project-123456.internal nw-ha-vm-2 10.1.0.2 ascs-aha-vip 10.1.0.4 ers-aha-vip 10.1.0.114 nw-ha-vm-1.us-central1-b.c.example-project-123456.internal nw-ha-vm-1 # Added by Google 169.254.169.254 metadata.google.internal # Added by Google

Crea i controlli di integrità di Cloud Load Balancing

Crea controlli di integrità: uno per l'istanza ASCS attiva e uno per l'ERS attivo.

In Cloud Shell, crea i controlli di integrità. Per evitare conflitti con altri servizi, designa i numeri di porta per le istanze ASCS ed ERS nell'intervallo privato 49152-65535. I valori di intervallo di controllo e timeout nei seguenti comandi sono leggermente più lunghi rispetto ai valori predefiniti per aumentare la tolleranza al failover durante gli eventi di migrazione in produzione di Compute Engine. Se necessario, puoi modificare i valori:

~gcloud compute health-checks create tcp ASCS_HEALTH_CHECK_NAME \ --port=ASCS_HEALTHCHECK_PORT_NUM --proxy-header=NONE --check-interval=10 --timeout=10 \ --unhealthy-threshold=2 --healthy-threshold=2~gcloud compute health-checks create tcp ERS_HEALTH_CHECK_NAME \ --port=ERS_HEALTHCHECK_PORT_NUM --proxy-header=NONE --check-interval=10 --timeout=10 \ --unhealthy-threshold=2 --healthy-threshold=2

Conferma la creazione di ogni controllo di integrità:

~gcloud compute health-checks describe HEALTH_CHECK_NAMEDovresti vedere un output simile al seguente esempio:

checkIntervalSec: 10 creationTimestamp: '2021-05-12T15:12:21.892-07:00' healthyThreshold: 2 id: '1981070199800065066' kind: compute#healthCheck name: ascs-aha-health-check-name selfLink: https://www.googleapis.com/compute/v1/projects/example-project-123456/global/healthChecks/scs-aha-health-check-name tcpHealthCheck: port: 60000 portSpecification: USE_FIXED_PORT proxyHeader: NONE timeoutSec: 10 type: TCP unhealthyThreshold: 2

Crea una regola firewall per i controlli di integrità

Se non lo hai già fatto, definisci una regola firewall per una porta nell'intervallo privato che consenta l'accesso alle VM host dagli intervalli IP utilizzati dai controlli di integrità di Cloud Load Balancing, 35.191.0.0/16 e

130.211.0.0/22. Per saperne di più sulle regole firewall per i bilanciatori del carico, consulta Creare regole firewall per i controlli di integrità.

Se non ne hai già uno, aggiungi un tag di rete alle VM host. Questo tag di rete viene utilizzato dalla regola firewall per i controlli di integrità.

~gcloud compute instances add-tags PRIMARY_VM_NAME \ --zone=PRIMARY_ZONE \ --tags NETWORK_TAGS~gcloud compute instances add-tags SECONDARY_VM_NAME \ --zone=SECONDARY_ZONE \ --tags NETWORK_TAGS

Crea una regola firewall che utilizzi il tag di rete per consentire i controlli di integrità:

~gcloud compute firewall-rules create RULE_NAME \ --network=NETWORK_NAME \ --action=ALLOW \ --direction=INGRESS \ --source-ranges=35.191.0.0/16,130.211.0.0/22 \ --target-tags=NETWORK_TAGS \ --rules=tcp:ASCS_HEALTHCHECK_PORT_NUM,tcp:ERS_HEALTHCHECK_PORT_NUMAd esempio:

gcloud compute firewall-rules create nw-ha-cluster-health-checks \ --network=example-network \ --action=ALLOW \ --direction=INGRESS \ --source-ranges=35.191.0.0/16,130.211.0.0/22 \ --target-tags=allow-health-check \ --rules=tcp:60000,tcp:60010

Creare gruppi di istanze Compute Engine

Devi creare un gruppo di istanze in ogni zona contenente una VM con nodo cluster e aggiungere la VM in quella zona al gruppo di istanze.

In Cloud Shell, crea il gruppo di istanze principale e aggiungi la VM principale:

~gcloud compute instance-groups unmanaged create PRIMARY_IG_NAME \ --zone=PRIMARY_ZONE~gcloud compute instance-groups unmanaged add-instances PRIMARY_IG_NAME \ --zone=PRIMARY_ZONE \ --instances=PRIMARY_VM_NAME

In Cloud Shell, crea il gruppo di istanze secondarie e aggiungi la VM secondaria:

~gcloud compute instance-groups unmanaged create SECONDARY_IG_NAME \ --zone=SECONDARY_ZONE~gcloud compute instance-groups unmanaged add-instances SECONDARY_IG_NAME \ --zone=SECONDARY_ZONE \ --instances=SECONDARY_VM_NAME

Conferma la creazione dei gruppi di istanze:

~gcloud compute instance-groups unmanaged listDovresti vedere un output simile al seguente esempio:

NAME ZONE NETWORK NETWORK_PROJECT MANAGED INSTANCES sap-aha-primary-instance-group us-central1-b example-network-sap example-project-123456 No 1 sap-aha-secondary-instance-group us-central1-c example-network-sap example-project-123456 No 1

Configura i servizi di backend

Crea due servizi di backend, uno per ASCS e uno per ERS. Aggiungi entrambi gli gruppi di istanze a ogni servizio di backend, designando il gruppo di istanze opposto come gruppo di istanze di failover in ogni servizio di backend. Infine, crea regole di inoltro dai VIP ai servizi di backend.

In Cloud Shell, crea il servizio di backend e il gruppo di failover per ASCS:

Crea il servizio di backend per ASCS:

~gcloud compute backend-services create ASCS_BACKEND_SERVICE_NAME \ --load-balancing-scheme internal \ --health-checks ASCS_HEALTH_CHECK_NAME \ --no-connection-drain-on-failover \ --drop-traffic-if-unhealthy \ --failover-ratio 1.0 \ --region CLUSTER_REGION \ --global-health-checksAggiungi il gruppo di istanze principale al servizio di backend ASCS:

~gcloud compute backend-services add-backend ASCS_BACKEND_SERVICE_NAME \ --instance-group PRIMARY_IG_NAME \ --instance-group-zone PRIMARY_ZONE \ --region CLUSTER_REGIONAggiungi il gruppo di istanze secondario come gruppo di istanze di failover per il servizio di backend ASCS:

~gcloud compute backend-services add-backend ASCS_BACKEND_SERVICE_NAME \ --instance-group SECONDARY_IG_NAME \ --instance-group-zone SECONDARY_ZONE \ --failover \ --region CLUSTER_REGION

In Cloud Shell, crea il servizio di backend e il gruppo di failover per ERS:

Crea il servizio di backend per ERS:

~gcloud compute backend-services create ERS_BACKEND_SERVICE_NAME \ --load-balancing-scheme internal \ --health-checks ERS_HEALTH_CHECK_NAME \ --no-connection-drain-on-failover \ --drop-traffic-if-unhealthy \ --failover-ratio 1.0 \ --region CLUSTER_REGION \ --global-health-checksAggiungi il gruppo di istanze secondario al servizio di backend ERS:

~gcloud compute backend-services add-backend ERS_BACKEND_SERVICE_NAME \ --instance-group SECONDARY_IG_NAME \ --instance-group-zone SECONDARY_ZONE \ --region CLUSTER_REGIONAggiungi il gruppo di istanze principale come gruppo di istanze di failover per il servizio di backend ERS:

~gcloud compute backend-services add-backend ERS_BACKEND_SERVICE_NAME \ --instance-group PRIMARY_IG_NAME \ --instance-group-zone PRIMARY_ZONE \ --failover \ --region CLUSTER_REGION

Se vuoi, verifica che i servizi di backend contengano i gruppi di istanze come previsto:

~gcloud compute backend-services describe BACKEND_SERVICE_NAME \ --region=CLUSTER_REGIONDovresti vedere un output simile all'esempio riportato di seguito per il servizio di backend ASCS. Per ERS,

failover: trueviene visualizzato nel gruppo di istanze principali:backends: - balancingMode: CONNECTION group: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-b/instanceGroups/sap-aha-primary-instance-group - balancingMode: CONNECTION failover: true group: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-c/instanceGroups/sap-aha-secondary-instance-group connectionDraining: drainingTimeoutSec: 0 creationTimestamp: '2022-04-06T10:58:37.744-07:00' description: '' failoverPolicy: disableConnectionDrainOnFailover: true dropTrafficIfUnhealthy: true failoverRatio: 1.0 fingerprint: s4qMEAyhrV0= healthChecks: - https://www.googleapis.com/compute/v1/projects/example-project-123456/global/healthChecks/ascs-aha-health-check-name id: '6695034709671438882' kind: compute#backendService loadBalancingScheme: INTERNAL name: ascs-aha-backend-service-name protocol: TCP region: https://www.googleapis.com/compute/v1/projects/example-project-123456/regions/us-central1 selfLink: https://www.googleapis.com/compute/v1/projects/example-project-123456/regions/us-central1/backendServices/ascs-aha-backend-service-name sessionAffinity: NONE timeoutSec: 30

In Cloud Shell, crea regole di inoltro per i servizi di backend ASCS e ERS:

Crea la regola di forwarding dall'IP virtuale ASCS al servizio di backend ASCS:

~gcloud compute forwarding-rules create ASCS_FORWARDING_RULE_NAME \ --load-balancing-scheme internal \ --address ASCS_VIP_ADDRESS \ --subnet CLUSTER_SUBNET \ --region CLUSTER_REGION \ --backend-service ASCS_BACKEND_SERVICE_NAME \ --ports ALLCrea la regola di forwarding dall'IP pubblico virtuale ERS al servizio di backend ERS:

~gcloud compute forwarding-rules create ERS_FORWARDING_RULE_NAME \ --load-balancing-scheme internal \ --address ERS_VIP_ADDRESS \ --subnet CLUSTER_SUBNET \ --region CLUSTER_REGION \ --backend-service ERS_BACKEND_SERVICE_NAME \ --ports ALL

Testa la configurazione del bilanciatore del carico

Anche se i gruppi di istanza di backend non verranno registrati come integri fino a più tardi, puoi testare la configurazione del bilanciatore del carico impostando un listener per rispondere ai controlli di integrità. Dopo aver configurato un ascoltatore, se il bilanciatore del carico è configurato correttamente, lo stato dei gruppi di istanza di backend diventa Stabile.

Le sezioni seguenti presentano diversi metodi che puoi utilizzare per testare la configurazione.

Test del bilanciatore del carico con l'utilità socat

Puoi utilizzare l'utilità socat per ascoltare temporaneamente su una porta di controllo di integrità.

Su entrambe le VM host, installa l'utilità

socat:$sudo yum install socatNella VM principale, assegna temporaneamente l'IP virtuale alla scheda di rete eth0:

ip addr add VIP_ADDRESS dev eth0

Nella VM principale, avvia un processo

socatper ascoltare per 60 secondi sulla porta di controllo di integrità dell'ASCS:$timeout 60s socat - TCP-LISTEN:ASCS_HEALTHCHECK_PORT_NUM,forkIn Cloud Shell, dopo aver atteso alcuni secondi affinché il controllo di integrità rilevi il listener, controlla l'integrità del gruppo di istanza di backend ASCS:

~gcloud compute backend-services get-health ASCS_BACKEND_SERVICE_NAME \ --region CLUSTER_REGIONDovresti vedere un output simile al seguente esempio per ASCS:

backend: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-b/instanceGroups/sap-aha-primary-instance-group status: healthStatus: - forwardingRule: https://www.googleapis.com/compute/v1/projects/example-project-123456/regions/us-central1/forwardingRules/scs-aha-forwarding-rule forwardingRuleIp: 10.1.0.90 healthState: HEALTHY instance: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-b/instances/nw-ha-vm-1 ipAddress: 10.1.0.89 port: 80 kind: compute#backendServiceGroupHealth --- backend: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-c/instanceGroups/sap-aha-secondary-instance-group status: healthStatus: - forwardingRule: https://www.googleapis.com/compute/v1/projects/example-project-123456/regions/us-central1/forwardingRules/scs-aha-forwarding-rule forwardingRuleIp: 10.1.0.90 healthState: UNHEALTHY instance: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-c/instances/nw-ha-vm-2 ipAddress: 10.1.0.88 port: 80 kind: compute#backendServiceGroupHealthRimuovi l'IP virtuale dall'interfaccia eth0:

ip addr del VIP_ADDRESS dev eth0

Ripeti i passaggi per ERS, sostituendo i valori delle variabili ASCS con quelli di ERS.

Test del bilanciatore del carico utilizzando la porta 22

Se la porta 22 è aperta per le connessioni SSH sulle VM host, puoi modificare temporaneamente il controllo di integrità in modo che utilizzi la porta 22, che ha un listener in grado di rispondere al controllo di integrità.

Per utilizzare temporaneamente la porta 22:

Nella Google Cloud console, vai alla pagina Controlli di integrità di Compute Engine:

Fai clic sul nome del controllo di integrità.

Fai clic su Modifica.

Nel campo Porta, imposta il numero di porta su 22.

Fai clic su Salva e attendi un paio di minuti.

In Cloud Shell, dopo aver atteso qualche secondo affinché il controllo di integrità rilevi il listener, controlla lo stato dei gruppi di istanza di backend:

~gcloud compute backend-services get-health BACKEND_SERVICE_NAME \ --region CLUSTER_REGIONDovresti vedere un output simile al seguente:

backend: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-b/instanceGroups/sap-aha-primary-instance-group status: healthStatus: - forwardingRule: https://www.googleapis.com/compute/v1/projects/example-project-123456/regions/us-central1/forwardingRules/scs-aha-forwarding-rule forwardingRuleIp: 10.1.0.85 healthState: HEALTHY instance: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-b/instances/nw-ha-vm-1 ipAddress: 10.1.0.79 port: 80 kind: compute#backendServiceGroupHealth --- backend: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-c/instanceGroups/sap-aha-secondary-instance-group status: healthStatus: - forwardingRule: https://www.googleapis.com/compute/v1/projects/example-project-123456/regions/us-central1/forwardingRules/scs-aha-forwarding-rule forwardingRuleIp: 10.1.0.85 healthState: HEALTHY instance: https://www.googleapis.com/compute/v1/projects/example-project-123456/zones/us-central1-c/instances/nw-ha-vm-2 ipAddress: 10.1.0.78 port: 80 kind: compute#backendServiceGroupHealthAl termine, ripristina il numero di porta del controllo di integrità.

Installa i listener per i controlli di integrità

Per configurare una risorsa di controllo di integrità, devi prima installare i listener.

Il bilanciatore del carico utilizza un listener sulla porta di controllo di integrità di ciascun host per determinare dove è in esecuzione l'istanza principale del cluster SAP HANA.

Su ogni host del cluster, installa un listener completando i seguenti passaggi:

Come utente root, installa un semplice listener TCP. Queste istruzioni descrivono come installare e utilizzare HAProxy come listener.

#yum install haproxyCopia e rinomina il file di configurazione

haproxy.cfgpredefinito in modo da trasformarlo in un file modello per le più istanze haproxy:#cp /usr/lib/systemd/system/haproxy.service \ /etc/systemd/system/haproxy@.serviceModifica le sezioni

[Unit]e[Service]del filehaproxy@.serviceper includere il parametro istanza%i, come mostrato nell'esempio seguente:[Unit] Description=HAProxy Load Balancer %i After=network-online.target Wants=network-online.target [Service] Environment="CONFIG=/etc/haproxy/haproxy-%i.cfg" "PIDFILE=/run/haproxy-%i.pid" ...

Per ulteriori informazioni di Red Hat sui modelli di unità

systemd, consulta Utilizzare le unità con istanza.Crea un file di configurazione

haproxy.cfgper l'istanza ASCS. Ad esempio:#vi /etc/haproxy/haproxy-SIDscs.cfgSostituisci

SIDcon l'ID sistema SAP (SID). Utilizza le lettere maiuscole per tutte le lettere. Ad esempio,AHA.Nel file di configurazione

haproxy-SIDscs.cfgASCS, inserisci la seguente configurazione e sostituisciASCS_HEALTHCHECK_PORT_NUMcon il numero di porta specificato in precedenza quando hai creato il controllo di stato di Compute Engine per ASCS:global chroot /var/lib/haproxy pidfile /var/run/haproxy-%i.pid user haproxy group haproxy daemon defaults mode tcp log global option dontlognull option redispatch retries 3 timeout queue 1m timeout connect 10s timeout client 1m timeout server 1m timeout check 10s maxconn 3000 # Listener for SAP healthcheck listen healthcheck bind *:ASCS_HEALTHCHECK_PORT_NUMCrea un file di configurazione

haproxy.cfgper l'istanza ERS. Ad esempio:#vi /etc/haproxy/haproxy-SIDers.cfgNel file di configurazione

haproxy-SIDers.cfgERS, inserisci la seguente configurazione e sostituisciERS_HEALTHCHECK_PORT_NUMcon il numero di porta specificato in precedenza quando hai creato il controllo di stato di Compute Engine per ERS:global chroot /var/lib/haproxy pidfile /var/run/haproxy-%i.pid user haproxy group haproxy daemon defaults mode tcp log global option dontlognull option redispatch retries 3 timeout queue 1m timeout connect 10s timeout client 1m timeout server 1m timeout check 10s maxconn 3000 # Listener for SAP healthcheck listen healthcheck bind *:ERS_HEALTHCHECK_PORT_NUMRicarica i servizi

systemd:#systemctl daemon-reloadVerifica che il servizio haproxy sia configurato correttamente:

#systemctl start haproxy#systemctl status haproxy#systemctl | grep haproxyLo stato restituito dovrebbe mostrare

haproxy.servicecomeactive (running).● haproxy.service - HAProxy Load Balancer Loaded: loaded (/usr/lib/systemd/system/haproxy.service; enabled; vendor preset: disabled) Active: active (running) since Sun 2022-04-10 16:48:10 UTC; 2 days ago Main PID: 1079 (haproxy) Tasks: 2 (limit: 100996) Memory: 5.1M CGroup: /system.slice/haproxy.service ├─1079 /usr/sbin/haproxy -Ws -f /etc/haproxy/haproxy.cfg -p /run/haproxy.pid └─1083 /usr/sbin/haproxy -Ws -f /etc/haproxy/haproxy.cfg -p /run/haproxy.pid Apr 10 16:48:10 dru-hanw-ascs systemd[1]: Starting HAProxy Load Balancer... Apr 10 16:48:10 dru-hanw-ascs systemd[1]: Started HAProxy Load Balancer.Ripeti i passaggi precedenti su ogni host del cluster.

Configurare Pacemaker

La procedura seguente configura l'implementazione RHEL di un cluster Pacemaker sulle VM Compute Engine per SAP NetWeaver.

La procedura si basa sulla documentazione di Red Hat per la configurazione di cluster ad alta disponibilità, incluse le seguenti pubblicazioni (è necessario un abbonamento a Red Hat):

- Configurazione di SAP NetWeaver ASCS/ERS ENSA1 con risorse autonome in RHEL 7.5 e versioni successive e RHEL 8

- Configurazione di SAP S/4HANA ASCS/ERS con Standalone Enqueue Server 2 (ENSA2) in Pacemaker

Per informazioni di SAP sull'installazione e sulla configurazione di RHEL, consulta:

- Nota SAP 3108316 - Red Hat Enterprise Linux 9.x: installazione e configurazione

- Nota SAP 2772999 - Red Hat Enterprise Linux 8.x: installazione e configurazione

- Nota SAP 2002167 - Red Hat Enterprise Linux 7.x: installazione e upgrade

Configura i pacchetti del cluster e il firewall del sistema operativo richiesti su entrambi gli host

Con accesso come utente root su entrambi gli host principali e secondari, installa e aggiorna i pacchetti del cluster richiesti, configura hacluster e configura il servizio firewall del sistema operativo.

Installa i seguenti pacchetti del cluster richiesti:

#yum install pcs pacemaker#yum install fence-agents-gce#yum install resource-agents-gcp#yum install resource-agents-sap#yum install sap-cluster-connectorAggiorna i pacchetti installati:

#yum update -yImposta la password per l'utente

hacluster, che viene installato come parte dei pacchetti del cluster:#passwd haclusterSpecifica una password per

haclusterquando richiesto.Nelle immagini RHEL fornite da Google Cloud, il servizio di firewall del sistema operativo è attivo per impostazione predefinita. Configura il servizio firewall per consentire il traffico ad alta disponibilità:

#firewall-cmd --permanent --add-service=high-availability#firewall-cmd --reloadAvvia il servizio pcs e configuralo in modo che venga avviato all'avvio:

#systemctl start pcsd.service#systemctl enable pcsd.serviceControlla lo stato del servizio pcs:

#systemctl status pcsd.serviceDovresti vedere un output simile al seguente:

● pcsd.service - PCS GUI and remote configuration interface Loaded: loaded (/usr/lib/systemd/system/pcsd.service; enabled; vendor preset: disabled) Active: active (running) since Sat 2020-06-13 21:17:05 UTC; 25s ago Docs: man:pcsd(8) man:pcs(8) Main PID: 31627 (pcsd) CGroup: /system.slice/pcsd.service └─31627 /usr/bin/ruby /usr/lib/pcsd/pcsd Jun 13 21:17:03 hana-ha-vm-1 systemd[1]: Starting PCS GUI and remote configuration interface... Jun 13 21:17:05 hana-ha-vm-1 systemd[1]: Started PCS GUI and remote configuration interface.

Crea il cluster

Con accesso come utente root su entrambi i nodi, autorizza l'utente

hacluster. Fai clic sulla scheda corrispondente alla tua versione di RHEL per visualizzare il comando:RHEL 8 e versioni successive

#pcs host auth PRIMARY_VM_NAME SECONDARY_VM_NAMERHEL 7

#pcs cluster auth PRIMARY_VM_NAME SECONDARY_VM_NAMEQuando richiesto, inserisci il nome utente

haclustere la password impostata per l'utentehacluster.Crea il cluster:

RHEL 8 e versioni successive

#pcs cluster setup CLUSTER_NAME PRIMARY_VM_NAME SECONDARY_VM_NAMERHEL 7

#pcs cluster setup --name CLUSTER_NAME PRIMARY_VM_NAME SECONDARY_VM_NAME

Aggiorna i file di configurazione di Corosync

I passaggi riportati di seguito impostano i valori consigliati per il cluster di Corosync.

Se il file di configurazione di Corosync, /etc/corosync/corosync.conf,

non esiste ancora o è vuoto, puoi utilizzare il file di esempio nella directory

/etc/corosync/ come base per la configurazione.

Apri il file

corosync.confper la modifica:#vi /etc/corosync/corosync.confNella sezione

totemdel filecorosync.conf, imposta i parametri nell'esempio riportato di seguito sui valori visualizzati. Alcuni parametri potrebbero essere già impostati sui valori corretti:RHEL 8

totem { ... transport: knet token: 20000 token_retransmits_before_loss_const: 10 join: 60 max_messages: 20 ... }RHEL 7

totem { ... transport: udpu token: 20000 token_retransmits_before_loss_const: 10 join: 60 max_messages: 20 ... }Sincronizza la configurazione con il secondo server:

RHEL 8 e versioni successive

#pcs cluster sync corosyncRHEL 7

#pcs cluster syncDalla VM principale, abilita e avvia il cluster

#pcs cluster enable --all#pcs cluster start --allVerifica che le nuove impostazioni di corosync siano attive nel cluster utilizzando l'utilità corosync-cmapctl:

#corosync-cmapctlControlla lo stato del cluster:

#pcs statusDovresti vedere un output simile al seguente esempio:

Cluster name: nwha WARNINGS: No stonith devices and stonith-enabled is not false Cluster Summary: * Stack: corosync * Current DC: nw-ha-vm-2 (version 2.0.5-9.el8_4.3-ba59be7122) - partition with quorum * 2 nodes configured * 0 resource instances configured Node List: * Online: [ nw-ha-vm-1 nw-ha-vm-2 ] Full List of Resources: * No resources Daemon Status: corosync: active/enabled pacemaker: active/enabled pcsd: active/enabled

Configura le risorse del cluster per l'infrastruttura

Devi definire le risorse Pacemaker per la seguente infrastruttura del cluster:

- Il dispositivo di recinzione, che impedisce gli scenari di split brain

- Le directory ASCS ed ERS nel file system condiviso

- I controlli di integrità

- I VIP

- Componenti ASCS ed ERS

Devi prima definire le risorse per il dispositivo di recinzione, il file system condiviso, i controlli di integrità e i VIP. Poi installa SAP NetWeaver. Dopo aver installato SAP NetWeaver, definisci infine le risorse del cluster per i componenti ASCS ed ERS.

Configurare le recinzioni

La configurazione del recinto virtuale avviene definendo una risorsa del cluster con l'agente fence_gce per ogni VM host.

Per garantire la sequenza corretta degli eventi dopo un'azione di recinzione, devi anche configurare il sistema operativo in modo da ritardare il riavvio di Corosync dopo la recinzione di una VM. Regola anche il timeout di Pacemaker per i riavvii in modo da tenere conto del ritardo.

Crea le risorse del dispositivo di recinzione

Per ogni VM del cluster, crea una risorsa cluster per il dispositivo di recinzione in modo che il cluster possa riavviare la VM. Il dispositivo di recinzione per una VM deve essere eseguito su una VM diversa, quindi devi configurare la posizione della risorsa del cluster in modo che venga eseguita su qualsiasi VM tranne la VM che può essere riavviata.

Nell'host principale, come utente root, crea una risorsa cluster per un dispositivo di recinzione per la VM principale:

#pcs stonith create FENCING_RESOURCE_PRIMARY_VM fence_gce \ port="PRIMARY_VM_NAME" \ zone="PRIMARY_ZONE" \ project="CLUSTER_PROJECT_ID" \ pcmk_reboot_timeout=300 pcmk_monitor_retries=4 pcmk_delay_max=30 \ op monitor interval="300s" timeout="120s" \ op start interval="0" timeout="60s"Configura la posizione del dispositivo di recinzione per la VM principale in modo che sia attivo solo sulla VM secondaria:

#pcs constraint location FENCING_RESOURCE_PRIMARY_VM avoids PRIMARY_VM_NAMENell'host secondario, come utente root, crea una risorsa cluster per un dispositivo di recinzione per la VM secondaria:

#pcs stonith create FENCING_RESOURCE_SECONDARY_VM fence_gce \ port="SECONDARY_VM_NAME" \ zone="SECONDARY_ZONE" \ project="CLUSTER_PROJECT_ID" \ pcmk_reboot_timeout=300 pcmk_monitor_retries=4 \ op monitor interval="300s" timeout="120s" \ op start interval="0" timeout="60s"Configura la posizione del dispositivo di recinzione per la VM secondaria in modo che sia attivo solo sulla VM principale:

#pcs constraint location FENCING_RESOURCE_SECONDARY_VM avoids SECONDARY_VM_NAME

Imposta un ritardo per il riavvio di Corosync

Su entrambi gli host, come utente root, crea un file drop-in

systemdche ritarda l'avvio di Corosync per garantire la sequenza corretta di eventi dopo il riavvio di una VM protetta:systemctl edit corosync.service

Aggiungi le seguenti righe al file:

[Service] ExecStartPre=/bin/sleep 60

Salva il file ed esci dall'editor.

Ricarica la configurazione del gestore systemd.

systemctl daemon-reload

Verifica che il file plug-in sia stato creato:

service corosync status

Dovresti vedere una riga per il file plug-in, come nell'esempio seguente:

● corosync.service - Corosync Cluster Engine Loaded: loaded (/usr/lib/systemd/system/corosync.service; disabled; vendor preset: disabled) Drop-In: /etc/systemd/system/corosync.service.d └─override.conf Active: active (running) since Tue 2021-07-20 23:45:52 UTC; 2 days ago

Crea le risorse del file system

Definisci le risorse del cluster per le directory ASCS ed ERS nel file system condiviso.

Configura una risorsa del file system per la directory ASCS.

#pcs resource create ASCS_FILE_SYSTEM_RESOURCE Filesystem \ device="NFS_PATH/usrsapSIDASCSASCS_INSTANCE_NUMBER" \ directory="/usr/sap/SID/ASCSASCS_INSTANCE_NUMBER" \ fstype=nfs force_unmount=safe \ --group ASCS_RESOURCE_GROUP \ op start interval=0 timeout=60 \ op stop interval=0 timeout=120 \ op monitor interval=200 timeout=40Sostituisci quanto segue:

ASCS_FILE_SYSTEM_RESOURCE: specifica un nome per la risorsa cluster per il file system ASCS.NFS_PATH: specifica il percorso della directory del file system NFS.SID: specifica l'ID sistema (SID). Utilizza le lettere maiuscole per tutte le lettere.ASCS_INSTANCE_NUMBER: specifica il numero di istanza ASCS.ASCS_RESOURCE_GROUP: specifica un nome di gruppo univoco per le risorse del cluster ASCS. Puoi garantire l'unicità utilizzando una convenzione come "SID_ASCSinstance_number_group". Ad esempio,nw8_ASCS00_group.Poiché il gruppo non esiste ancora, Pacemaker lo crea ora. Man mano che crei altre risorse ASCS, le aggiungi a questo gruppo.

Configura una risorsa del file system per la directory ERS.

#pcs resource create ERS_FILE_SYSTEM_RESOURCE Filesystem \ device="NFS_PATH/usrsapSIDERSERS_INSTANCE_NUMBER" \ directory="/usr/sap/SID/ERSERS_INSTANCE_NUMBER" \ fstype=nfs force_unmount=safe \ --group ERS_RESOURCE_GROUP \ op start interval=0 timeout=60 \ op stop interval=0 timeout=120 \ op monitor interval=200 timeout=40Sostituisci quanto segue:

ERS_FILE_SYSTEM_RESOURCE: specifica un nome per la risorsa del file system.NFS_PATH: specifica il percorso della directory del file system NFS.SID: specifica l'ID sistema (SID). Utilizza le lettere maiuscole per tutte le lettere.ERS_INSTANCE_NUMBER: specifica il numero di istanza ERS.ERS_RESOURCE_GROUP: specifica un nome di gruppo univoco per le risorse del cluster ERS. Puoi garantire l'unicità utilizzando una convenzione come "SID_ERSinstance_number_group". Ad esempio,nw8_ERS10_group.Poiché il gruppo non esiste ancora, Pacemaker lo crea ora. Man mano che crei altre risorse ERS, le aggiungi a questo gruppo.

Crea una risorsa indirizzo IP virtuale

Definisci le risorse del cluster per gli indirizzi VIP.

Se devi cercare l'indirizzo VIP, puoi utilizzare:

gcloud compute addresses describe ASCS_VIP_NAME

--region=CLUSTER_REGION --format="value(address)"gcloud compute addresses describe ERS_VIP_NAME

--region=CLUSTER_REGION --format="value(address)"

Crea le risorse del cluster per gli IP virtuali ASCS ed ERS.

#pcs resource create ASCS_VIP_RESOURCE IPaddr2 \ ip=ASCS_VIP_ADDRESS cidr_netmask=32 nic=eth0 \ op monitor interval=3600 timeout=60 \ --group ASCS_RESOURCE_GROUP#pcs resource create ERS_VIP_RESOURCE IPaddr2 \ ip=ERS_VIP_ADDRESS cidr_netmask=32 nic=eth0 \ op monitor interval=3600 timeout=60 \ --group ERS_RESOURCE_GROUP

Crea le risorse di controllo di integrità

Configura la risorsa cluster per il controllo di integrità dell'ASCS:

#pcs resource create _HEALTHCHECK_SCS service:haproxy@SIDascs \ op monitor interval=10s timeout=20s \ --group ASCS_RESOURCE_GROUPConfigura la risorsa del cluster per il controllo di integrità di ERS:

#pcs resource create _HEALTHCHECK_ERS service:haproxy@SIDers \ op monitor interval=10s timeout=20s \ --group ERS_RESOURCE_GROUP

Impostare valori predefiniti aggiuntivi per il cluster

Imposta proprietà aggiuntive del cluster:

#pcs resource defaults resource-stickiness=1#pcs resource defaults migration-threshold=3

Visualizza le risorse definite

Visualizza le risorse del cluster che hai definito finora per assicurarti che siano corrette.

Visualizza lo stato del cluster:

#pcs statusDovresti vedere un output simile al seguente esempio:

Cluster name: nwha Cluster Summary: * Stack: corosync * Current DC: nw-ha-vm-1 (version 2.0.5-9.el8_4.3-ba59be7122) - partition with quorum * 2 nodes configured * 8 resource instances configured Node List: * Online: [ nw-ha-vm-1 nw-ha-vm-2 ] Full List of Resources: * fence-nw-ha-vm-2 (stonith:fence_gce): Started nw-ha-vm-1 * fence-nw-ha-vm-1 (stonith:fence_gce): Started nw-ha-vm-2 * Resource Group: nw8_ascs00_group: * nw8_vip_ascs00 (ocf::heartbeat:IPaddr2): Started nw-ha-vm-1 * nw8_healthcheck_scs (service:haproxy@nw8scs): Started nw-ha-vm-1 * nw8_fs_ascs00 (ocf::heartbeat:Filesystem): Started nw-ha-vm-1 * Resource Group: nw8_ers10_group: * nw8_vip_ers10 (ocf::heartbeat:IPaddr2): Started nw-ha-vm-2 * nw8_healthcheck_ers (service:haproxy@nw8ers): Started nw-ha-vm-2 * nw8_fs_ers10 (ocf::heartbeat:Filesystem): Started nw-ha-vm-2 Daemon Status: corosync: active/enabled pacemaker: active/enabled pcsd: active/enabled

Installa ASCS ed ERS

La sezione seguente illustra solo i requisiti e i consigli specifici per l'installazione di SAP NetWeaver su Google Cloud.

Per istruzioni di installazione complete, consulta la documentazione di SAP NetWeaver.

Prepararsi all'installazione

Per garantire la coerenza nel cluster e semplificare l'installazione, prima di installare i componenti ASCS ed ERS di SAP NetWeaver, definisci gli utenti, i gruppi e le autorizzazioni e metti il server secondario in modalità standby.

Rimuovi il cluster dalla modalità di manutenzione:

#sudo pcs property set maintenance-mode="false"Su entrambi i server, come utente root, inserisci i seguenti comandi, specificando gli ID utente e gruppo appropriati per il tuo ambiente:

#groupadd -g GID_SAPINST sapinst#groupadd -g GID_SAPSYS sapsys#useradd -u UID_SIDADM SID_LCadm -g sapsys#usermod -a -G sapinst SID_LCadm#useradd -u UID_SAPADM sapadm -g sapinst#chown SID_LCadm:sapsys /usr/sap/SID/SYS#chown SID_LCadm:sapsys /sapmnt/SID -R#chown SID_LCadm:sapsys /usr/sap/trans -R#chown SID_LCadm:sapsys /usr/sap/SID/SYS -R#chown SID_LCadm:sapsys /usr/sap/SID -RSe utilizzi una configurazione di montaggio semplice , esegui invece i seguenti comandi su entrambi i server come utente root. Specifica gli ID utente e gruppo appropriati per il tuo ambiente.

#groupadd -g GID_SAPINST sapinst#groupadd -g GID_SAPSYS sapsys#useradd -u UID_SIDADM SID_LCadm -g sapsys#usermod -a -G sapinst SID_LCadm#useradd -u UID_SAPADM sapadm -g sapinst#chown SID_LCadm:sapsys /usr/sap/SID#chown SID_LCadm:sapsys /sapmnt/SID -R#chown SID_LCadm:sapsys /usr/sap/trans -R#chown SID_LCadm:sapsys /usr/sap/SID -R#chown SID_LCadm:sapsys /usr/sap/SID/SYSSostituisci quanto segue:

GID_SAPINST: specifica l'ID gruppo Linux per lo strumento di provisioning SAP.GID_SAPSYS: specifica l'ID gruppo Linux per l'utente SAPSYS.UID_SIDADM: specifica l'ID utente Linux per l'amministratore del sistema SAP (SID).SID_LC: specifica l'ID sistema (SID). Utilizza le lettere minuscole.UID_SAPADM: specifica l'ID utente per l'agente host SAP.SID: specifica l'ID sistema (SID). Utilizza le lettere maiuscole per tutte le lettere.

Ad esempio, di seguito è riportato uno schema di numerazione pratico per GID e UID:

Group sapinst 1001 Group sapsys 1002 Group dbhshm 1003 User en2adm 2001 User sapadm 2002 User dbhadm 2003

Installa il componente ASCS

Sul server secondario, inserisci il seguente comando per metterlo in modalità standby:

#pcs node standbyLa modalità standby del server secondario consente di consolidare tutte le risorse del cluster sul server principale, semplificando l'installazione.

Verifica che il server secondario sia in modalità standby:

#pcs statusL'output è simile al seguente esempio:

Cluster name: nwha Cluster Summary: * Stack: corosync * Current DC: nw-ha-vm-1 (version 2.0.5-9.el8_4.3-ba59be7122) - partition with quorum * 2 nodes configured * 8 resource instances configured Node List: * Online: [ nw-ha-vm-1 nw-ha-vm-2 ] Full List of Resources: * fence-nw-ha-vm-2 (stonith:fence_gce): Started nw-ha-vm-1 * fence-nw-ha-vm-1 (stonith:fence_gce): Stopped * Resource Group: nw8_ascs00_group: * nw8_vip_ascs00 (ocf::heartbeat:IPaddr2): Started nw-ha-vm-1 * nw8_healthcheck_scs (service:haproxy@nw8scs): Started nw-ha-vm-1 * nw8_fs_ascs00 (ocf::heartbeat:Filesystem): Started nw-ha-vm-1 * Resource Group: nw8_ers10_group: * nw8_vip_ers10 (ocf::heartbeat:IPaddr2): Started nw-ha-vm-1 * nw8_healthcheck_ers (service:haproxy@nw8ers): Started nw-ha-vm-1 * nw8_fs_ers10 (ocf::heartbeat:Filesystem): Started nw-ha-vm-1 Daemon Status: corosync: active/enabledSul server principale, come utente root, modifica la directory in una directory di installazione temporanea, ad esempio

/tmp, per installare l'istanza ASCS eseguendo SAP Software Provisioning Manager (SWPM).Per accedere all'interfaccia web di SWPM, devi disporre della password dell'utente

root. Se i tuoi criteri IT non consentono all'amministratore SAP di accedere alla password di root, puoi utilizzareSAPINST_REMOTE_ACCESS_USER.Quando avvii SWPM, utilizza il parametro

SAPINST_USE_HOSTNAMEper specificare il nome host virtuale che hai definito per l'indirizzo VIP ASCS nel file/etc/hosts.Ad esempio:

cd /tmp; /mnt/nfs/install/SWPM/sapinst SAPINST_USE_HOSTNAME=vh-aha-scs

Nella pagina di conferma finale di SWPM, assicurati che il nome dell'host virtuale sia corretto.

Al termine della configurazione, estrarre la VM secondaria dalla modalità standby:

#pcs node unstandby

Installa il componente ERS

Sul server principale, come utente root o

SID_LCadm, interrompi il servizio ASCS.#su - SID_LCadm -c "sapcontrol -nr ASCS_INSTANCE_NUMBER -function Stop"#su - SID_LCadm -c "sapcontrol -nr ASCS_INSTANCE_NUMBER -function StopService"Sul server principale, inserisci il seguente comando per metterlo in modalità standby:

#pcs node standbyLa modalità standby del server principale consente di consolidare tutte le risorse del cluster sul server secondario, semplificando l'installazione.

Verifica che il server principale sia in modalità standby:

#pcs statusSul server secondario, come utente root, modifica la directory in una directory di installazione temporanea, ad esempio

/tmp, per installare l'istanza ERS eseguendo SAP Software Provisioning Manager (SWPM).Utilizza lo stesso utente e la stessa password per accedere a SWPM che hai utilizzato quando hai installato il componente ASCS.

Quando avvii SWPM, utilizza il parametro

SAPINST_USE_HOSTNAMEper specificare il nome dell'host virtuale che hai definito per l'indirizzo VIP ERS nel file/etc/hosts.Ad esempio:

cd /tmp; /mnt/nfs/install/SWPM/sapinst SAPINST_USE_HOSTNAME=vh-aha-ers

Nella pagina di conferma finale di SWPM, assicurati che il nome dell'host virtuale sia corretto.

Rimuovi la VM principale dallo stato di standby per attivarle entrambe:

#pcs node unstandby

Configura i servizi SAP

Devi verificare che i servizi siano configurati correttamente, controllare le impostazioni nei profili ASCS ed ERS e aggiungere l'utente SID_LCadm al gruppo di utenti haclient.

Conferma le voci del servizio SAP

Su entrambi i server, verifica che il file

/usr/sap/sapservicescontenga voci sia per i servizi ASCS sia per ERS. Per farlo, puoi utilizzare l'integrazionesystemVosystemd.Puoi aggiungere le voci mancanti utilizzando il comando

sapstartsrvcon le opzionipf=PROFILE_OF_THE_SAP_INSTANCEe-reg.Per ulteriori informazioni su queste integrazioni, consulta le seguenti note SAP:

systemVDi seguito è riportato un esempio di come vengono visualizzate le voci per i servizi ASCS ed ERS nel file

/usr/sap/sapservicesquando utilizzi l'integrazionesystemV:#LD_LIBRARY_PATH=/usr/sap/hostctrl/exe:$LD_LIBRARY_PATH; export LD_LIBRARY_PATH /usr/sap/hostctrl/exe/sapstartsrv \ pf=/usr/sap/SID/SYS/profile/SID_ERSERS_INSTANCE_NUMBER_ERS_VIRTUAL_HOST_NAME \ -D -u SID_LCadm /usr/sap/hostctrl/exe/sapstartsrv \ pf=/usr/sap/SID/SYS/profile/SID_ASCSASCS_INSTANCE_NUMBER_ASCS_VIRTUAL_HOST_NAME \ -D -u SID_LCadmsystemdVerifica che il file

/usr/sap/sapservicescontenga voci per i servizi ASCS ed ERS. Di seguito è riportato un esempio di come queste voci vengono visualizzate nel file/usr/sap/sapservicesquando utilizzi l'integrazionesystemd:systemctl --no-ask-password start SAPSID_ASCS_INSTANCE_NUMBER # sapstartsrv pf=/usr/sap/SID/SYS/profile/SID_ASCSASCS_INSTANCE_NUMBER_SID_LCascs systemctl --no-ask-password start SAPSID_ERS_INSTANCE_NUMBER # sapstartsrv pf=/usr/sap/SID/SYS/profile/SID_ERSERS_INSTANCE_NUMBER_SID_LCers

Disattiva l'integrazione di

systemdnelle istanze ASCS ed ERS:#systemctl disable SAPSID_ASCS_INSTANCE_NUMBER.service#systemctl stop SAPSID_ASCS_INSTANCE_NUMBER.service#systemctl disable SAPSID_ERS_INSTANCE_NUMBER.service#systemctl stop SAPSID_ERS_INSTANCE_NUMBER.serviceVerifica che l'integrazione di

systemdsia disattivata:#systemctl list-unit-files | grep sapUn output simile all'esempio seguente indica che l'integrazione di

systemdè disattivata. Tieni presente che alcuni servizi, comesaphostagentesaptune, sono abilitati e alcuni sono disattivati.SAPSID_ASCS_INSTANCE_NUMBER.service disabled SAPSID_ERS_INSTANCE_NUMBER.service disabled saphostagent.service enabled sapinit.service generated saprouter.service disabled saptune.service enabled

Interrompi i servizi SAP

Sul server secondario, arresta il servizio ERS: