Esporta i dati delle tabelle in Cloud Storage

Questa pagina descrive come esportare o estrarre i dati dalle tabelle BigQuery in Cloud Storage.

Dopo aver caricato i dati in BigQuery, puoi esportarli in diversi formati. BigQuery può esportare fino a 1 GB di dimensioni logiche dei dati in un unico file. Se esporti più di 1 GB di dati, devi esportarli in più file. Quando esporti i dati in più file, le dimensioni dei file variano.

Puoi anche esportare i risultati di una query utilizzando l'istruzione

EXPORT DATA. Puoi utilizzare EXPORT DATA OPTIONS

per specificare il formato dei dati esportati.

Infine, puoi utilizzare un servizio come Dataflow per leggere i dati da BigQuery anziché esportarli da BigLake. Per ulteriori informazioni sull'utilizzo di Dataflow per leggere e scrivere in BigQuery, consulta la documentazione di BigQuery I/O.

Limitazioni per l'esportazione

Quando esporti i dati da BigQuery, tieni presente quanto segue:

- Non puoi esportare i dati della tabella in un file locale, in Fogli Google o in Google Drive. L'unica posizione di esportazione supportata è Cloud Storage. Per informazioni sul salvataggio dei risultati delle query, consulta Download e salvataggio dei risultati delle query.

- Puoi esportare fino a 1 GB di dati della tabella logica in un unico file. Se esporti più di 1 GB di dati, utilizza un carattere jolly per esportare i dati in più file. Quando esporti i dati in più file, le dimensioni dei file variano. Per limitare le dimensioni del file esportato, puoi partizionare i dati ed esportare ogni partizione.

- Le dimensioni del file generato quando si utilizza l'istruzione

EXPORT DATAnon sono garantite. - Il numero di file generati da un job di estrazione può variare.

- Non puoi esportare dati nidificati e ripetuti in formato CSV. I dati nidificati e ripetuti sono supportati per le esportazioni Avro, JSON e Parquet.

- Quando esporti i dati in formato JSON, i tipi di dati INT64 (integer) vengono codificati come stringhe JSON per preservare la precisione a 64 bit quando i dati vengono letti da altri sistemi.

- Non puoi esportare dati da più tabelle in un unico job di estrazione.

- Non puoi scegliere un tipo di compressione diverso da

GZIPquando esporti i dati utilizzando la console Google Cloud . - Quando esporti una tabella in formato JSON, i simboli

<,>e&vengono convertiti utilizzando la notazione Unicode\uNNNN, doveNè una cifra esadecimale. Ad esempio,profit&lossdiventaprofit\u0026loss. Questa conversione Unicode viene eseguita per evitare vulnerabilità di sicurezza. - L'ordine dei dati della tabella esportati non è garantito, a meno che non utilizzi l'istruzione

EXPORT DATAe specifichi una clausolaORDER BYinquery_statement. - BigQuery non supporta i percorsi delle risorse Cloud Storage

che includono più barre consecutive dopo la doppia barra iniziale.

I nomi degli oggetti Cloud Storage possono contenere più caratteri barra

("/") consecutivi. Tuttavia, BigQuery converte più

slash consecutivi in un unico slash. Ad esempio, il seguente percorso

della risorsa, sebbene valido in Cloud Storage, non funziona in

BigQuery:

gs://bucket/my//object//name. - I nuovi dati caricati in BigQuery durante l'esecuzione di un job di estrazione non verranno inclusi in questo job. Per esportare i nuovi dati, devi creare un nuovo job di estrazione.

Prima di iniziare

Concedi ruoli Identity and Access Management (IAM) che forniscono agli utenti le autorizzazioni necessarie per eseguire ogni attività descritta in questo documento.

Autorizzazioni obbligatorie

Per eseguire le attività descritte in questo documento, devi disporre delle seguenti autorizzazioni.

Autorizzazioni per esportare i dati da una tabella BigQuery

Per esportare i dati da una tabella BigQuery, devi disporre dell'autorizzazione IAM

bigquery.tables.export.

Ciascuno dei seguenti ruoli IAM predefiniti include l'autorizzazione bigquery.tables.export:

roles/bigquery.dataViewerroles/bigquery.dataOwnerroles/bigquery.dataEditorroles/bigquery.admin

Autorizzazioni per eseguire un job di estrazione

Per eseguire un job di estrazione, devi disporre dell'autorizzazione IAM bigquery.jobs.create.

Ognuno dei seguenti ruoli IAM predefiniti include le autorizzazioni necessarie per eseguire un job di estrazione:

roles/bigquery.userroles/bigquery.jobUserroles/bigquery.admin

Autorizzazioni per scrivere i dati nel bucket Cloud Storage

Per scrivere i dati in un bucket Cloud Storage esistente, devi disporre delle seguenti autorizzazioni IAM:

storage.objects.createstorage.objects.delete

Ognuno dei seguenti ruoli IAM predefiniti include le autorizzazioni necessarie per scrivere i dati in un bucket Cloud Storage esistente:

roles/storage.objectAdminroles/storage.admin

Per saperne di più sui ruoli e sulle autorizzazioni IAM in BigQuery, consulta Ruoli e autorizzazioni predefiniti.

Formati di esportazione e tipi di compressione

BigQuery supporta i seguenti formati di dati e tipi di compressione per i dati esportati.

| Formato dei dati | Tipi di compressione supportati | Dettagli |

|---|---|---|

| CSV | GZIP | Puoi controllare il delimitatore CSV nei dati esportati utilizzando

il flag I dati nidificati e ripetuti non sono supportati. |

| JSON | GZIP | Sono supportati i dati nidificati e ripetuti. |

| Avro | DEFLATE, SNAPPY | GZIP non è supportato per le esportazioni Avro. Sono supportati i dati nidificati e ripetuti. Consulta Dettagli dell'esportazione Avro. |

| Parquet | SNAPPY, GZIP, ZSTD | Sono supportati i dati nidificati e ripetuti. Vedi Dettagli dell'esportazione Parquet. |

Esporta i dati

Le sezioni riportate di seguito mostrano come esportare i dati delle tabelle, i metadati delle tabelle e i risultati delle query in Cloud Storage.

Esportare i dati delle tabelle

Puoi esportare i dati della tabella:

- Utilizzo della console Google Cloud

- Utilizzo del comando

bq extractnello strumento a riga di comando bq - Invio di un job

extractutilizzando l'API o le librerie client

Seleziona una delle seguenti opzioni:

Console

Apri la pagina BigQuery nella console Google Cloud .

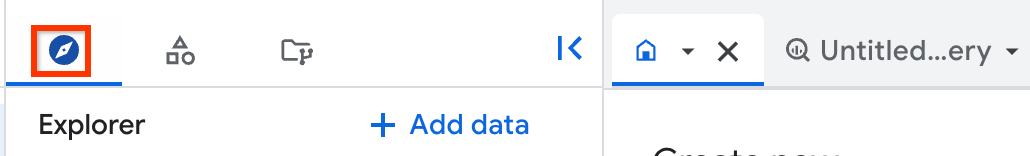

Nel riquadro a sinistra, fai clic su Explorer:

Se non vedi il riquadro a sinistra, fai clic su Espandi riquadro a sinistra per aprirlo.

Nel riquadro Explorer, espandi il progetto, fai clic su Set di dati e poi sul tuo set di dati.

Fai clic su Panoramica > Tabelle e poi seleziona una tabella.

Nel riquadro dei dettagli, fai clic su Carica Esporta.

Nella finestra di dialogo Esporta in Google Cloud Storage:

- Per Posizione GCS, cerca il bucket, la cartella o il file in cui vuoi esportare i dati.

- Per Formato di esportazione, scegli il formato per i dati esportati: CSV, JSON (delimitato da nuova riga), Avro o Parquet.

- In Compressione, seleziona un formato di compressione o

Noneper nessuna compressione.

Fai clic su Salva per esportare la tabella.

Per controllare l'avanzamento del job, nel riquadro Explorer, fai clic su Cronologia dei job e cerca un job di tipo ESTRAI.

Per esportare le visualizzazioni in Cloud Storage, utilizza l'istruzione EXPORT DATA OPTIONS.

SQL

Utilizza l'istruzione EXPORT DATA.

Il seguente esempio esporta

i campi selezionati da una tabella denominata mydataset.table1:

Nella console Google Cloud , vai alla pagina BigQuery.

Nell'editor di query, inserisci la seguente istruzione:

EXPORT DATA OPTIONS ( uri = 'gs://bucket/folder/*.csv', format = 'CSV', overwrite = true, header = true, field_delimiter = ';') AS ( SELECT field1, field2 FROM mydataset.table1 ORDER BY field1 );

Fai clic su Esegui.

Per saperne di più su come eseguire le query, consulta Eseguire una query interattiva.

bq

Utilizza il comando bq extract con il flag --destination_format.

(Facoltativo) Fornisci il flag --location e imposta il valore sulla tua

posizione.

Altri flag facoltativi includono:

--compression: Il tipo di compressione da utilizzare per i file esportati.--field_delimiter: il carattere che indica il limite tra le colonne nel file di output per le esportazioni CSV. Sono consentiti sia\tchetabper i delimitatori di tabulazione.--print_header: se specificato, stampa le righe di intestazione per i formati che hanno intestazioni come CSV.

bq extract --location=location \ --destination_format format \ --compression compression_type \ --field_delimiter delimiter \ --print_header=boolean \ project_id:dataset.table \ gs://bucket/filename.ext

Dove:

- location è il nome della tua sede. Il flag

--locationè facoltativo. Ad esempio, se utilizzi BigQuery nella regione di Tokyo, puoi impostare il valore del flag suasia-northeast1. Puoi impostare un valore predefinito per la località utilizzando il file.bigqueryrc. - format è il formato dei dati esportati:

CSV,NEWLINE_DELIMITED_JSON,AVROoPARQUET. - compression_type è un tipo di compressione supportato per il formato dei dati. Consulta Formati di esportazione e tipi di compressione.

- delimiter è il carattere che indica il limite tra le colonne nelle esportazioni CSV.

\tetabsono nomi accettati per la scheda. - boolean è

trueofalse. Se impostato sutrue, le righe di intestazione vengono stampate nei dati esportati se il formato dei dati supporta le intestazioni. Il valore predefinito ètrue. - project_id è l'ID progetto.

- dataset è il nome del set di dati di origine.

- table è la tabella che stai esportando. Se utilizzi un

decoratore di partizioni,

devi racchiudere il percorso della tabella tra virgolette singole o

inserire il carattere di escape

$. - bucket è il nome del bucket Cloud Storage in cui esporti i dati. Il set di dati BigQuery e il bucket Cloud Storage devono trovarsi nella stessa posizione.

- filename.ext è il nome e l'estensione del file di dati esportato. Puoi esportare in più file utilizzando un carattere jolly.

Esempi:

Ad esempio, il seguente comando esporta mydataset.mytable in un file compresso gzip denominato myfile.csv. myfile.csv è archiviato in un bucket Cloud Storage denominato example-bucket.

bq extract \ --compression GZIP \ 'mydataset.mytable' \ gs://example-bucket/myfile.csv

Il formato di destinazione predefinito è CSV. Per esportare in JSON o Avro, utilizza il flag

destination_format e impostalo su NEWLINE_DELIMITED_JSON

o AVRO. Ad esempio:

bq extract \ --destination_format NEWLINE_DELIMITED_JSON \ 'mydataset.mytable' \ gs://example-bucket/myfile.json

Il seguente comando esporta mydataset.mytable in un file Avro compresso utilizzando Snappy. Il file si chiama myfile.avro. myfile.avro viene

esportato in un bucket Cloud Storage denominato example-bucket.

bq extract \ --destination_format AVRO \ --compression SNAPPY \ 'mydataset.mytable' \ gs://example-bucket/myfile.avro

Il seguente comando esporta una singola partizione di

mydataset.my_partitioned_table in un file CSV in Cloud Storage:

bq extract \ --destination_format CSV \ 'mydataset.my_partitioned_table$0' \ gs://example-bucket/single_partition.csv

API

Per esportare i dati, crea un job extract e compila la configurazione del job.

(Facoltativo) Specifica la tua posizione nella proprietà location nella sezione

jobReference della risorsa job.

Crea un job di estrazione che punti ai dati di origine BigQuery e alla destinazione Cloud Storage.

Specifica la tabella di origine utilizzando l'oggetto di configurazione

sourceTableche contiene l'ID progetto, l'ID set di dati e l'ID tabella.La proprietà

destination URI(s)deve essere completa, nel formatogs://bucket/filename.ext. Ogni URI può contenere un carattere jolly "*" e deve essere dopo il nome del bucket.Specifica il formato dei dati impostando la proprietà

configuration.extract.destinationFormat. Ad esempio, per esportare un file JSON, imposta questa proprietà sul valoreNEWLINE_DELIMITED_JSON.Per controllare lo stato del job, chiama jobs.get(job_id) con l'ID del job restituito dalla richiesta iniziale.

- Se

status.state = DONE, il job è stato completato correttamente. - Se è presente la proprietà

status.errorResult, la richiesta non è riuscita e l'oggetto includerà informazioni che descrivono cosa è andato storto. - Se

status.errorResultnon è presente, il job è stato completato correttamente, anche se potrebbero essersi verificati alcuni errori non fatali. Gli errori non irreversibili sono elencati nella proprietàstatus.errorsdell'oggetto job restituito.

- Se

Note sull'API:

Come best practice, genera un ID univoco e passalo come

jobReference.jobIdquando chiamijobs.insertper creare un job. Questo approccio è più resistente agli errori di rete perché il client può eseguire il polling o riprovare con l'ID job noto.La chiamata di

jobs.insertsu un determinato ID job è idempotente. In altre parole, puoi riprovare tutte le volte che vuoi sullo stesso ID job e al massimo una di queste operazioni andrà a buon fine.

C#

Prima di provare questo esempio, segui le istruzioni di configurazione di C# nella guida rapida di BigQuery per l'utilizzo delle librerie client. Per saperne di più, consulta la documentazione di riferimento dell'API BigQuery C#.

Per eseguire l'autenticazione in BigQuery, configura le Credenziali predefinite dell'applicazione. Per saperne di più, vedi Configurare l'autenticazione per le librerie client.

Vai

Prima di provare questo esempio, segui le istruzioni di configurazione di Go nella guida rapida di BigQuery per l'utilizzo delle librerie client. Per saperne di più, consulta la documentazione di riferimento dell'API BigQuery Go.

Per eseguire l'autenticazione in BigQuery, configura le Credenziali predefinite dell'applicazione. Per saperne di più, vedi Configurare l'autenticazione per le librerie client.

Java

Prima di provare questo esempio, segui le istruzioni di configurazione di Java nella guida rapida di BigQuery per l'utilizzo delle librerie client. Per saperne di più, consulta la documentazione di riferimento dell'API BigQuery Java.

Per eseguire l'autenticazione in BigQuery, configura le Credenziali predefinite dell'applicazione. Per saperne di più, vedi Configurare l'autenticazione per le librerie client.

Node.js

Prima di provare questo esempio, segui le istruzioni di configurazione di Node.js nella guida rapida di BigQuery per l'utilizzo delle librerie client. Per saperne di più, consulta la documentazione di riferimento dell'API BigQuery Node.js.

Per eseguire l'autenticazione in BigQuery, configura le Credenziali predefinite dell'applicazione. Per saperne di più, vedi Configurare l'autenticazione per le librerie client.

PHP

Prima di provare questo esempio, segui le istruzioni di configurazione di PHP nella guida rapida di BigQuery per l'utilizzo delle librerie client. Per saperne di più, consulta la documentazione di riferimento dell'API BigQuery PHP.

Per eseguire l'autenticazione in BigQuery, configura le Credenziali predefinite dell'applicazione. Per saperne di più, vedi Configurare l'autenticazione per le librerie client.

Python

Prima di provare questo esempio, segui le istruzioni di configurazione di Python nella guida rapida di BigQuery per l'utilizzo delle librerie client. Per saperne di più, consulta la documentazione di riferimento dell'API BigQuery Python.

Per eseguire l'autenticazione in BigQuery, configura le Credenziali predefinite dell'applicazione. Per saperne di più, vedi Configurare l'autenticazione per le librerie client.

Ruby

Prima di provare questo esempio, segui le istruzioni di configurazione di Ruby nella guida rapida di BigQuery per l'utilizzo delle librerie client. Per saperne di più, consulta la documentazione di riferimento dell'API BigQuery Ruby.

Per eseguire l'autenticazione in BigQuery, configura le Credenziali predefinite dell'applicazione. Per saperne di più, vedi Configurare l'autenticazione per le librerie client.

Esporta i metadati della tabella

Per esportare i metadati della tabella dalle tabelle Iceberg, utilizza la seguente istruzione SQL:

EXPORT TABLE METADATA FROM `[[PROJECT_NAME.]DATASET_NAME.]TABLE_NAME`;

Sostituisci quanto segue:

- PROJECT_NAME: il nome del progetto per la tabella. Il valore predefinito è il progetto che esegue questa query.

- DATASET_NAME: il nome del set di dati per la tabella.

- TABLE_NAME: il nome della tabella.

I metadati esportati si trovano nella cartella STORAGE_URI/metadata, dove STORAGE_URI è la posizione di archiviazione della tabella impostata nelle opzioni.

Esportare i risultati della query

Puoi esportare i risultati della query in Cloud Storage nella console Google Cloud seguendo questi passaggi:

Apri la pagina BigQuery nella console Google Cloud .

Fai clic su Query SQL.

Inserisci una query GoogleSQL valida nell'area di testo dell'editor di query.

Fai clic su Esegui.

Quando vengono restituiti i risultati, fai clic su Salva risultati > Cloud Storage.

Nella finestra di dialogo Esporta in Google Cloud Storage:

- Per Posizione GCS, cerca il bucket, la cartella o il file in cui vuoi esportare i dati.

- Per Formato di esportazione, scegli il formato per i dati esportati: CSV, JSON (delimitato da nuova riga), Avro o Parquet.

- In Compressione, seleziona un formato di compressione o

Noneper nessuna compressione.

Fai clic su Salva per esportare i risultati della query.

Per controllare l'avanzamento del job, espandi il riquadro Cronologia dei job e

cerca il job di tipo EXTRACT.

Dettagli esportazione Avro

BigQuery esprime i dati formattati in Avro nei seguenti modi:

- I file di esportazione risultanti sono file contenitore Avro.

- Ogni riga BigQuery è rappresentata come un record Avro. I dati nidificati sono rappresentati da oggetti record nidificati.

- I campi

REQUIREDsono rappresentati come i tipi Avro corrispondenti. Ad esempio, un tipoINTEGERBigQuery viene mappato a un tipoLONGAvro. - I campi

NULLABLEsono rappresentati come un'unione Avro del tipo corrispondente e "null". - I campi

REPEATEDsono rappresentati come array Avro. - I tipi di dati

TIMESTAMPsono rappresentati come tipo logicotimestamp-micros(annotano un tipo AvroLONG) per impostazione predefinita sia nei job di estrazione sia in Export Data SQL. (Attenzione: puoi aggiungereuse_avro_logical_types=FalseaExport Data Optionsper disattivare il tipo logico in modo che utilizzi il tipostringinvece nella colonna timestamp, ma nei job di estrazione utilizza sempre il tipo logico Avro.) - I tipi di dati

DATEsono rappresentati come tipo logicodate(annotano i tipi AvroINT) per impostazione predefinita in Export Data SQL, ma sono rappresentati come tipostringper impostazione predefinita nei job di estrazione. (Nota: puoi aggiungereuse_avro_logical_types=FalseaExport Data Optionsper disattivare il tipo logico oppure utilizzare il flag--use_avro_logical_types=Trueper attivare il tipo logico nei job di estrazione.) - I tipi di dati

TIMEsono rappresentati come tipo logicotimestamp-micro(annotano i tipi AvroLONG) per impostazione predefinita in Esporta dati SQL, ma sono rappresentati come tipostringper impostazione predefinita nei job di estrazione. (Nota: puoi aggiungereuse_avro_logical_types=FalseaExport Data Optionsper disattivare il tipo logico o utilizzare il flag--use_avro_logical_types=Trueper attivare il tipo logico nei job di estrazione.) - I tipi di dati

DATETIMEsono rappresentati come tipi AvroSTRING(un tipo stringa con tipo logico denominato personalizzatodatetime) per impostazione predefinita in Export Data SQL, ma sono rappresentati come tipostringper impostazione predefinita nei job di estrazione. (Nota: puoi aggiungereuse_avro_logical_types=FalseaExport Data Optionsper disattivare il tipo logico oppure utilizzare il flag--use_avro_logical_types=Trueper attivare il tipo logico nei job di estrazione.) - I tipi RANGE non sono supportati nell'esportazione Avro.

I tipi di dati NUMERIC(P[, S]) e BIGNUMERIC(P[, S]) con parametri trasferiscono

i parametri di tipo precisione e scalabilità al tipo logico decimale Avro.

Il formato Avro non può essere utilizzato in combinazione con la compressione GZIP. Per comprimere

i dati Avro, utilizza lo strumento a riga di comando bq o l'API e specifica uno dei

tipi di compressione supportati per i dati Avro: DEFLATE o SNAPPY.

Dettagli esportazione Parquet

BigQuery converte i tipi di dati GoogleSQL nei seguenti tipi di dati Parquet:

| Tipo di dati BigQuery | Tipo primitivo Parquet | Tipo logico Parquet |

|---|---|---|

| Numero intero | INT64 |

NONE |

| Numerico | FIXED_LEN_BYTE_ARRAY |

DECIMAL (precision = 38, scale = 9) |

| Numerico(P[, S]) | FIXED_LEN_BYTE_ARRAY |

DECIMAL (precision = P, scale = S) |

| BigNumeric | FIXED_LEN_BYTE_ARRAY |

DECIMAL (precision = 76, scale = 38) |

| BigNumeric(P[, S]) | FIXED_LEN_BYTE_ARRAY |

DECIMAL (precision = P, scale = S) |

| Virgola mobile | FLOAT |

NONE |

| Booleano | BOOLEAN |

NONE |

| Stringa | BYTE_ARRAY |

STRING (UTF8) |

| Byte | BYTE_ARRAY |

NONE |

| Data | INT32 |

DATE |

| Data/ora | INT64 |

TIMESTAMP (isAdjustedToUTC = false, unit = MICROS) |

| Ora | INT64 |

TIME (isAdjustedToUTC = true, unit = MICROS) |

| Timestamp | INT64 |

TIMESTAMP (isAdjustedToUTC = false, unit = MICROS) |

| Area geografica | BYTE_ARRAY |

GEOGRAPHY (edges = spherical) |

Lo schema Parquet rappresenta i dati nidificati come un gruppo e i record ripetuti come gruppi ripetuti. Per ulteriori informazioni sull'utilizzo di dati nidificati e ripetuti in BigQuery, consulta Specifica di colonne nidificate e ripetute.

Puoi utilizzare le seguenti soluzioni alternative per i tipi di DATETIME:

- Carica il file in una tabella di staging. Poi utilizza una query SQL per eseguire il cast del campo in

un

DATETIMEe salva il risultato in una nuova tabella. Per saperne di più, consulta Modifica del tipo di dati di una colonna. - Fornisci uno schema per la tabella utilizzando il flag

--schemanel job di caricamento. Definisci la colonna data/ora comecol:DATETIME.

Il tipo logico GEOGRAPHY è rappresentato dai metadati

GeoParquet aggiunti ai file esportati.

Esportazione di dati in uno o più file

La proprietà destinationUris indica una o più posizioni e nomi di file in cui

BigQuery deve esportare i file.

BigQuery supporta un singolo operatore jolly (*) in ogni URI. Il

carattere jolly può essere visualizzato in qualsiasi punto del componente del nome file. L'utilizzo

del carattere jolly indica a BigQuery di creare più

file suddivisi in shard in base al pattern fornito. L'operatore jolly viene sostituito

con un numero (a partire da 0), con riempimento a sinistra fino a 12 cifre. Ad esempio, un URI con un carattere jolly alla fine del nome file creerebbe file con 000000000000 aggiunto al primo file e 000000000001 aggiunto al secondo file, continuando con questo pattern.

La tabella seguente descrive diverse opzioni possibili per la proprietà destinationUris:

Opzioni destinationUris |

|

|---|---|

| URI singolo |

Utilizza un singolo URI se esporti dati di tabelle di dimensioni pari o inferiori a 1 GB. Questa opzione è il caso d'uso più comune, poiché i dati esportati sono

generalmente inferiori al valore massimo di 1 GB. Questa opzione non è

supportata per l'istruzione

Definizione della proprietà:

Crea: gs://my-bucket/file-name.json |

| URI con un solo carattere jolly |

È possibile utilizzare un solo carattere jolly nel componente del nome file dell'URI. Utilizza un singolo URI con caratteri jolly se ritieni che i dati esportati supereranno il valore massimo di 1 GB. BigQuery suddivide i dati in più file in base al pattern fornito. Le dimensioni dei file esportati variano. Definizione della proprietà:

Crea: gs://my-bucket/file-name-000000000000.json gs://my-bucket/file-name-000000000001.json gs://my-bucket/file-name-000000000002.json ...

Crea: gs://my-bucket/000000000000 gs://my-bucket/000000000001 gs://my-bucket/000000000002 ... |

Limitare le dimensioni del file esportato

Quando esporti più di 1 GB di dati in una singola esportazione, devi utilizzare un carattere jolly per esportare i dati in più file e le dimensioni dei file variano. Se devi limitare le dimensioni massime di ogni file esportato, un'opzione è partizionare i dati in modo casuale ed esportare ogni partizione in un file:

- Determina il numero di partizioni necessarie, che è uguale alla dimensione totale dei dati divisa per la dimensione del file esportato scelta. Ad esempio, se hai 8000 MB di dati e vuoi che ogni file esportato sia di circa 20 MB, ti servono 400 partizioni.

Crea una nuova tabella partizionata e raggruppata in cluster in base a una nuova colonna generata casualmente denominata

export_id. L'esempio seguente mostra come creare un nuovoprocessed_tableda una tabella esistente denominatasource_tableche richiedenpartizioni per raggiungere la dimensione del file scelta:CREATE TABLE my_dataset.processed_table PARTITION BY RANGE_BUCKET(export_id, GENERATE_ARRAY(0, n, 1)) CLUSTER BY export_id AS ( SELECT *, CAST(FLOOR(n*RAND()) AS INT64) AS export_id FROM my_dataset.source_table );

Per ogni numero intero

icompreso tra 0 en-1, esegui un'istruzioneEXPORT DATAnella seguente query:SELECT * EXCEPT(export_id) FROM my_dataset.processed_table WHERE export_id = i;

Estrai tabella compressa

Go

Prima di provare questo esempio, segui le istruzioni di configurazione di Go nella guida rapida di BigQuery per l'utilizzo delle librerie client. Per saperne di più, consulta la documentazione di riferimento dell'API BigQuery Go.

Per eseguire l'autenticazione in BigQuery, configura le Credenziali predefinite dell'applicazione. Per saperne di più, vedi Configurare l'autenticazione per le librerie client.

Java

Prima di provare questo esempio, segui le istruzioni di configurazione di Java nella guida rapida di BigQuery per l'utilizzo delle librerie client. Per saperne di più, consulta la documentazione di riferimento dell'API BigQuery Java.

Per eseguire l'autenticazione in BigQuery, configura le Credenziali predefinite dell'applicazione. Per saperne di più, vedi Configurare l'autenticazione per le librerie client.

Node.js

Prima di provare questo esempio, segui le istruzioni di configurazione di Node.js nella guida rapida di BigQuery per l'utilizzo delle librerie client. Per saperne di più, consulta la documentazione di riferimento dell'API BigQuery Node.js.

Per eseguire l'autenticazione in BigQuery, configura le Credenziali predefinite dell'applicazione. Per saperne di più, vedi Configurare l'autenticazione per le librerie client.

Python

Prima di provare questo esempio, segui le istruzioni di configurazione di Python nella guida rapida di BigQuery per l'utilizzo delle librerie client. Per saperne di più, consulta la documentazione di riferimento dell'API BigQuery Python.

Per eseguire l'autenticazione in BigQuery, configura le Credenziali predefinite dell'applicazione. Per saperne di più, vedi Configurare l'autenticazione per le librerie client.

Caso d'uso di esempio

Questo esempio mostra come esportare i dati in Cloud Storage.

Supponiamo che tu stia trasmettendo in streaming i dati a Cloud Storage dai log degli endpoint in modo continuo. Uno snapshot giornaliero deve essere esportato in Cloud Storage per scopi di backup e archiviazione. La scelta migliore è un job di estrazione soggetto a determinate quote e limitazioni.

Invia un job di estrazione con l'API o le librerie client, passando un ID univoco come jobReference.jobId. I job di estrazione sono

asincroni.

Controlla lo stato del job

utilizzando l'ID univoco del job utilizzato per crearlo. Il job è stato completato correttamente

se status.status è DONE. Se è presente status.errorResult,

il job non è riuscito e deve essere ritentato.

Elaborazione dei dati in batch

Supponiamo che un job batch notturno venga utilizzato per caricare i dati entro una scadenza fissa. Al termine del job di caricamento, una tabella con le statistiche viene materializzata da una query come descritto nella sezione precedente. I dati di questa tabella vengono recuperati e compilati in un report PDF e inviati a un ente regolatore.

Poiché la quantità di dati da leggere è ridotta, utilizza l'API tabledata.list per recuperare tutte le righe della tabella in formato dizionario JSON. Se sono presenti più pagine di dati, i risultati hanno la proprietà pageToken impostata. Per recuperare la pagina successiva dei risultati, effettua un'altra chiamata tabledata.list

e includi il valore del token come parametro pageToken. Se la chiamata API

non va a buon fine

e genera un

errore 5xx,

riprova con backoff esponenziale. Non è possibile riprovare la maggior parte degli errori 4xx. Per

un migliore disaccoppiamento dell'esportazione BigQuery e della generazione di report,

i risultati devono essere salvati su disco.

Criteri per le quote

Per informazioni sulle quote dei job di estrazione, consulta la sezione Job di estrazione nella pagina Quote e limiti.

L'utilizzo per i job di estrazione è disponibile in INFORMATION_SCHEMA.

La voce del job nelle tabelle di sistema JOBS_BY_* per il job di estrazione contiene un valore total_bytes_processed che può essere utilizzato per monitorare l'utilizzo aggregato per garantire che rimanga al di sotto di 50 TiB al giorno. Per scoprire come eseguire query sulla visualizzazione

INFORMATION_SCHEMA.JOBS per ottenere il valore total_bytes_processed, consulta lo

schema INFORMATION_SCHEMA.JOBS.

Visualizzare l'utilizzo attuale della quota

Puoi visualizzare l'utilizzo corrente dei job di query, caricamento, estrazione o copia eseguendo

una query INFORMATION_SCHEMA per visualizzare i metadati dei job eseguiti in un

periodo di tempo specificato. Puoi confrontare l'utilizzo corrente con il limite di quota per determinare l'utilizzo della quota per un particolare tipo di job. La seguente query di esempio utilizza la vista INFORMATION_SCHEMA.JOBS per elencare il numero di job di query, caricamento, estrazione e copia per progetto:

SELECT sum(case when job_type="QUERY" then 1 else 0 end) as QRY_CNT, sum(case when job_type="LOAD" then 1 else 0 end) as LOAD_CNT, sum(case when job_type="EXTRACT" then 1 else 0 end) as EXT_CNT, sum(case when job_type="COPY" then 1 else 0 end) as CPY_CNT FROM `region-REGION_NAME`.INFORMATION_SCHEMA.JOBS_BY_PROJECT WHERE date(creation_time)= CURRENT_DATE()

Puoi configurare un criterio di avviso di Cloud Monitoring che monitora il numero di byte esportati.

-

Nella Google Cloud console, vai alla pagina notifications Avvisi:

Se utilizzi la barra di ricerca per trovare questa pagina, seleziona il risultato con il sottotitolo Monitoring.

Nella pagina Avvisi, fai clic su Crea criterio.

Nella sezione Modalità di configurazione dei criteri, seleziona Editor di codice (MQL o PromQL).

Nell'editor di query PromQL, inserisci la seguente query:

( sum by (project_id, quota_metric, location) (increase({"serviceruntime.googleapis.com/quota/rate/net_usage", monitored_resource="consumer_quota", service="bigquery.googleapis.com"}[1m])) / max by (project_id, quota_metric, location) ({"serviceruntime.googleapis.com/quota/limit", monitored_resource="consumer_quota", service="bigquery.googleapis.com", limit_name="ExtractBytesPerDay"}) ) > 0.01Se l'opzione Esecuzione automatica non è attivata, fai clic su Esegui query.

Configura il resto dell'avviso e fai clic su Crea policy.

Per i passaggi dettagliati sulla creazione di criteri di avviso basati su PromQL, consulta Creare criteri di avviso basati su PromQL (console).

Risoluzione dei problemi

Per diagnosticare i problemi relativi ai job di estrazione, puoi utilizzare Esplora log per esaminare i log di un job di estrazione specifico e identificare i possibili errori. Il seguente filtro di Esplora log restituisce informazioni sui job di estrazione:

resource.type="bigquery_resource"

protoPayload.methodName="jobservice.insert"

(protoPayload.serviceData.jobInsertRequest.resource.jobConfiguration.query.query=~"EXPORT" OR

protoPayload.serviceData.jobCompletedEvent.eventName="extract_job_completed" OR

protoPayload.serviceData.jobCompletedEvent.job.jobConfiguration.query.query=~"EXPORT")

Prezzi

Per informazioni sui prezzi dell'esportazione dei dati, consulta la pagina Prezzi di BigQuery.

Una volta esportati i dati, ti viene addebitato il costo di archiviazione dei dati in Cloud Storage. Per maggiori informazioni, consulta Prezzi di Cloud Storage.

Sicurezza delle tabelle

Per controllare l'accesso alle tabelle in BigQuery, vedi Controllare l'accesso alle risorse con IAM.

Passaggi successivi

- Per scoprire di più sulla console Google Cloud , consulta Utilizzo della console Google Cloud .

- Per saperne di più sullo strumento a riga di comando bq, consulta Utilizzo dello strumento a riga di comando bq.

- Per scoprire come creare un'applicazione utilizzando le librerie client dell'API BigQuery, consulta la guida rapida alle librerie client.