Trabaja con datos de series temporales

En este documento, se describe cómo usar las funciones de SQL para admitir el análisis de series temporales.

Introducción

Una serie temporal es una secuencia de datos, cada uno de los cuales consiste en una hora y un valor asociado con ese tiempo. Por lo general, una serie temporal también tiene un identificador, que nombra de manera inequívoca la serie temporal.

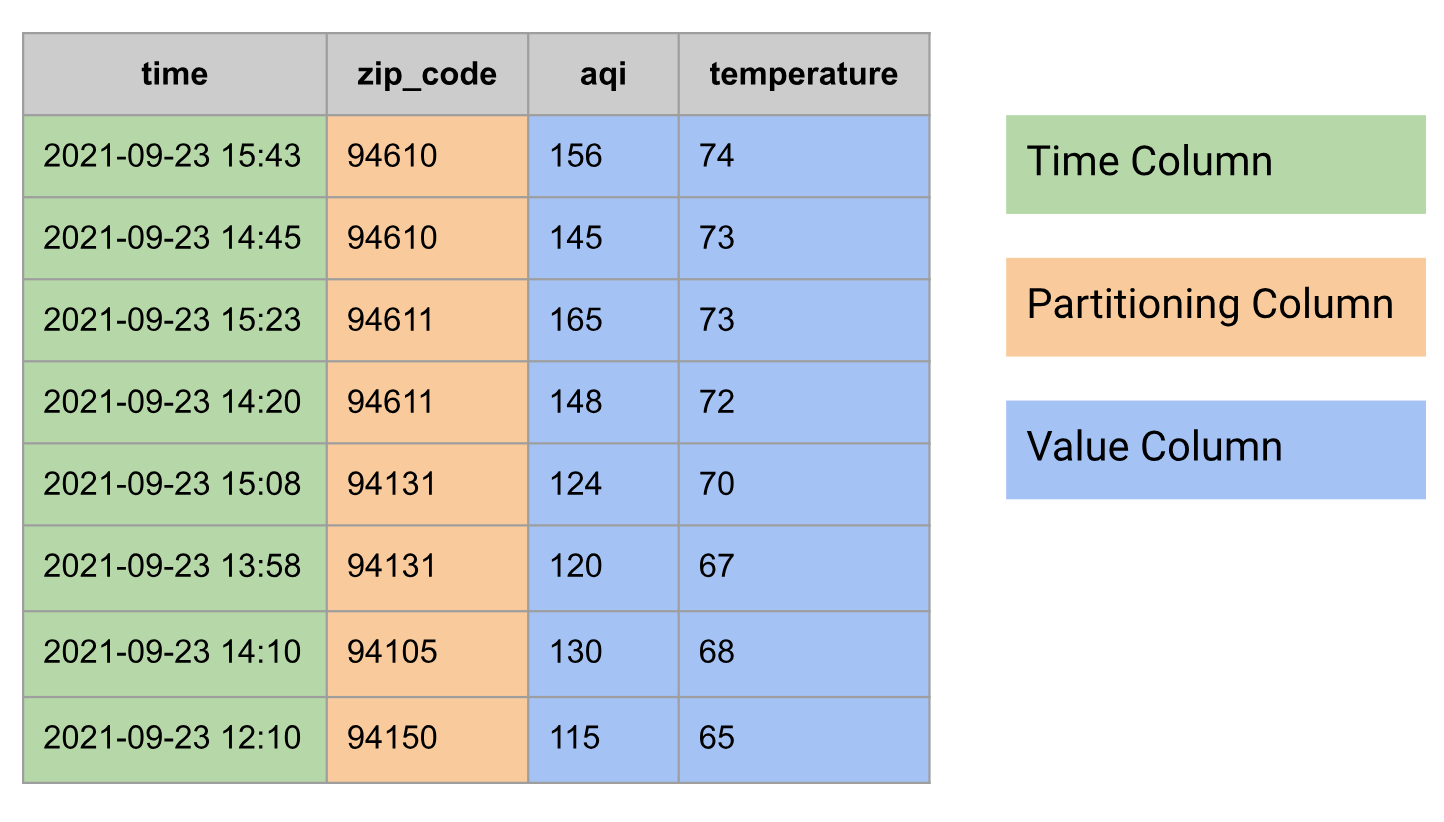

En las bases de datos relacionales, una serie temporal se modela como una tabla con los siguientes grupos de columnas:

- Columna de tiempo

- Puede tener columnas de partición, por ejemplo, el código postal.

- Una o más columnas de valores, o un tipo

STRUCTque combina varios valores, por ejemplo, temperatura e ICA

El siguiente es un ejemplo de datos de series temporales modelados como una tabla:

Agrega una serie temporal

En el análisis de series temporales, la agregación de tiempo es una agregación que se realiza a lo largo del eje de tiempo.

Puedes realizar la agregación de tiempo en BigQuery con la ayuda de las funciones de agrupamiento de tiempo (TIMESTAMP_BUCKET, DATE_BUCKET y DATETIME_BUCKET). Las funciones de agrupamiento de tiempo asignan valores de tiempo de entrada al bucket al que pertenecen.

Por lo general, la agregación de tiempo se realiza para combinar varios datos en un período en un solo dato, con una función de agregación, como AVG, MIN, MAX, COUNT o SUM. Por ejemplo, la latencia promedio de la solicitud de 15 minutos, las temperaturas mínimas y máximas diarias y la cantidad diaria de viajes en taxi.

Para las consultas de esta sección, crea una tabla llamada mydataset.environmental_data_hourly:

CREATE OR REPLACE TABLE mydataset.environmental_data_hourly AS

SELECT * FROM UNNEST(

ARRAY<STRUCT<zip_code INT64, time TIMESTAMP, aqi INT64, temperature INT64>>[

STRUCT(60606, TIMESTAMP '2020-09-08 00:30:51', 22, 66),

STRUCT(60606, TIMESTAMP '2020-09-08 01:32:10', 23, 63),

STRUCT(60606, TIMESTAMP '2020-09-08 02:30:35', 22, 60),

STRUCT(60606, TIMESTAMP '2020-09-08 03:29:39', 21, 58),

STRUCT(60606, TIMESTAMP '2020-09-08 04:33:05', 21, 59),

STRUCT(60606, TIMESTAMP '2020-09-08 05:32:01', 21, 57),

STRUCT(60606, TIMESTAMP '2020-09-08 06:31:14', 22, 56),

STRUCT(60606, TIMESTAMP '2020-09-08 07:31:06', 28, 55),

STRUCT(60606, TIMESTAMP '2020-09-08 08:29:59', 30, 55),

STRUCT(60606, TIMESTAMP '2020-09-08 09:29:34', 31, 55),

STRUCT(60606, TIMESTAMP '2020-09-08 10:31:24', 38, 56),

STRUCT(60606, TIMESTAMP '2020-09-08 11:31:24', 38, 56),

STRUCT(60606, TIMESTAMP '2020-09-08 12:32:38', 38, 57),

STRUCT(60606, TIMESTAMP '2020-09-08 13:29:59', 38, 56),

STRUCT(60606, TIMESTAMP '2020-09-08 14:31:22', 43, 59),

STRUCT(60606, TIMESTAMP '2020-09-08 15:31:38', 42, 63),

STRUCT(60606, TIMESTAMP '2020-09-08 16:34:22', 43, 65),

STRUCT(60606, TIMESTAMP '2020-09-08 17:33:23', 42, 68),

STRUCT(60606, TIMESTAMP '2020-09-08 18:28:47', 36, 69),

STRUCT(60606, TIMESTAMP '2020-09-08 19:30:28', 34, 67),

STRUCT(60606, TIMESTAMP '2020-09-08 20:30:53', 29, 67),

STRUCT(60606, TIMESTAMP '2020-09-08 21:32:28', 27, 67),

STRUCT(60606, TIMESTAMP '2020-09-08 22:31:45', 25, 65),

STRUCT(60606, TIMESTAMP '2020-09-08 23:31:02', 22, 63),

STRUCT(94105, TIMESTAMP '2020-09-08 00:07:11', 60, 74),

STRUCT(94105, TIMESTAMP '2020-09-08 01:07:24', 61, 73),

STRUCT(94105, TIMESTAMP '2020-09-08 02:08:07', 60, 71),

STRUCT(94105, TIMESTAMP '2020-09-08 03:11:05', 69, 69),

STRUCT(94105, TIMESTAMP '2020-09-08 04:07:26', 72, 67),

STRUCT(94105, TIMESTAMP '2020-09-08 05:08:11', 70, 66),

STRUCT(94105, TIMESTAMP '2020-09-08 06:07:30', 68, 65),

STRUCT(94105, TIMESTAMP '2020-09-08 07:07:10', 77, 64),

STRUCT(94105, TIMESTAMP '2020-09-08 08:06:35', 81, 64),

STRUCT(94105, TIMESTAMP '2020-09-08 09:10:18', 82, 63),

STRUCT(94105, TIMESTAMP '2020-09-08 10:08:10', 107, 62),

STRUCT(94105, TIMESTAMP '2020-09-08 11:08:01', 115, 62),

STRUCT(94105, TIMESTAMP '2020-09-08 12:07:39', 120, 62),

STRUCT(94105, TIMESTAMP '2020-09-08 13:06:03', 125, 61),

STRUCT(94105, TIMESTAMP '2020-09-08 14:08:37', 129, 62),

STRUCT(94105, TIMESTAMP '2020-09-08 15:09:19', 150, 62),

STRUCT(94105, TIMESTAMP '2020-09-08 16:06:39', 151, 62),

STRUCT(94105, TIMESTAMP '2020-09-08 17:08:01', 155, 63),

STRUCT(94105, TIMESTAMP '2020-09-08 18:09:23', 154, 64),

STRUCT(94105, TIMESTAMP '2020-09-08 19:08:43', 151, 67),

STRUCT(94105, TIMESTAMP '2020-09-08 20:07:19', 150, 69),

STRUCT(94105, TIMESTAMP '2020-09-08 21:07:37', 148, 72),

STRUCT(94105, TIMESTAMP '2020-09-08 22:08:01', 143, 76),

STRUCT(94105, TIMESTAMP '2020-09-08 23:08:41', 137, 75)

]);

Una observación interesante sobre los datos anteriores es que las mediciones se toman en períodos arbitrarios, conocidos como series temporales no alineadas. La agregación es una de las formas en que se puede alinear una serie temporal.

Obtén un promedio de 3 horas

La siguiente consulta calcula un índice de calidad del aire (ICA) promedio de 3 horas y una temperatura para cada código postal. La función TIMESTAMP_BUCKET realiza la agregación de tiempo mediante la asignación de cada valor de tiempo a un día en particular.

SELECT

TIMESTAMP_BUCKET(time, INTERVAL 3 HOUR) AS time,

zip_code,

CAST(AVG(aqi) AS INT64) AS aqi,

CAST(AVG(temperature) AS INT64) AS temperature

FROM mydataset.environmental_data_hourly

GROUP BY zip_code, time

ORDER BY zip_code, time;

/*---------------------+----------+-----+-------------+

| time | zip_code | aqi | temperature |

+---------------------+----------+-----+-------------+

| 2020-09-08 00:00:00 | 60606 | 22 | 63 |

| 2020-09-08 03:00:00 | 60606 | 21 | 58 |

| 2020-09-08 06:00:00 | 60606 | 27 | 55 |

| 2020-09-08 09:00:00 | 60606 | 36 | 56 |

| 2020-09-08 12:00:00 | 60606 | 40 | 57 |

| 2020-09-08 15:00:00 | 60606 | 42 | 65 |

| 2020-09-08 18:00:00 | 60606 | 33 | 68 |

| 2020-09-08 21:00:00 | 60606 | 25 | 65 |

| 2020-09-08 00:00:00 | 94105 | 60 | 73 |

| 2020-09-08 03:00:00 | 94105 | 70 | 67 |

| 2020-09-08 06:00:00 | 94105 | 75 | 64 |

| 2020-09-08 09:00:00 | 94105 | 101 | 62 |

| 2020-09-08 12:00:00 | 94105 | 125 | 62 |

| 2020-09-08 15:00:00 | 94105 | 152 | 62 |

| 2020-09-08 18:00:00 | 94105 | 152 | 67 |

| 2020-09-08 21:00:00 | 94105 | 143 | 74 |

+---------------------+----------+-----+-------------*/

Obtén un valor mínimo y máximo de 3 horas

En la siguiente consulta, calcularás las temperaturas mínimas y máximas de 3 horas para cada código postal:

SELECT

TIMESTAMP_BUCKET(time, INTERVAL 3 HOUR) AS time,

zip_code,

MIN(temperature) AS temperature_min,

MAX(temperature) AS temperature_max,

FROM mydataset.environmental_data_hourly

GROUP BY zip_code, time

ORDER BY zip_code, time;

/*---------------------+----------+-----------------+-----------------+

| time | zip_code | temperature_min | temperature_max |

+---------------------+----------+-----------------+-----------------+

| 2020-09-08 00:00:00 | 60606 | 60 | 66 |

| 2020-09-08 03:00:00 | 60606 | 57 | 59 |

| 2020-09-08 06:00:00 | 60606 | 55 | 56 |

| 2020-09-08 09:00:00 | 60606 | 55 | 56 |

| 2020-09-08 12:00:00 | 60606 | 56 | 59 |

| 2020-09-08 15:00:00 | 60606 | 63 | 68 |

| 2020-09-08 18:00:00 | 60606 | 67 | 69 |

| 2020-09-08 21:00:00 | 60606 | 63 | 67 |

| 2020-09-08 00:00:00 | 94105 | 71 | 74 |

| 2020-09-08 03:00:00 | 94105 | 66 | 69 |

| 2020-09-08 06:00:00 | 94105 | 64 | 65 |

| 2020-09-08 09:00:00 | 94105 | 62 | 63 |

| 2020-09-08 12:00:00 | 94105 | 61 | 62 |

| 2020-09-08 15:00:00 | 94105 | 62 | 63 |

| 2020-09-08 18:00:00 | 94105 | 64 | 69 |

| 2020-09-08 21:00:00 | 94105 | 72 | 76 |

+---------------------+----------+-----------------+-----------------*/

Obtén un promedio de 3 horas con alineación personalizada

Cuando realizas la agregación de series temporales, usas una alineación específica para las ventanas de series temporales, ya sea de forma implícita o explícita. En las consultas anteriores, se usó la alineación implícita, que produjo buckets que se iniciaron en momentos como 00:00:00, 03:00:00 y 06:00:00. Para establecer esta alineación de forma explícita en la función TIMESTAMP_BUCKET, pasa un argumento opcional que especifique el origen.

En la siguiente consulta, el origen se establece como 2020-01-01 02:00:00. Esto cambia la alineación y produce buckets que comienzan en momentos como 02:00:00, 05:00:00 y 08:00:00:

SELECT

TIMESTAMP_BUCKET(time, INTERVAL 3 HOUR, TIMESTAMP '2020-01-01 02:00:00') AS time,

zip_code,

CAST(AVG(aqi) AS INT64) AS aqi,

CAST(AVG(temperature) AS INT64) AS temperature

FROM mydataset.environmental_data_hourly

GROUP BY zip_code, time

ORDER BY zip_code, time;

/*---------------------+----------+-----+-------------+

| time | zip_code | aqi | temperature |

+---------------------+----------+-----+-------------+

| 2020-09-07 23:00:00 | 60606 | 23 | 65 |

| 2020-09-08 02:00:00 | 60606 | 21 | 59 |

| 2020-09-08 05:00:00 | 60606 | 24 | 56 |

| 2020-09-08 08:00:00 | 60606 | 33 | 55 |

| 2020-09-08 11:00:00 | 60606 | 38 | 56 |

| 2020-09-08 14:00:00 | 60606 | 43 | 62 |

| 2020-09-08 17:00:00 | 60606 | 37 | 68 |

| 2020-09-08 20:00:00 | 60606 | 27 | 66 |

| 2020-09-08 23:00:00 | 60606 | 22 | 63 |

| 2020-09-07 23:00:00 | 94105 | 61 | 74 |

| 2020-09-08 02:00:00 | 94105 | 67 | 69 |

| 2020-09-08 05:00:00 | 94105 | 72 | 65 |

| 2020-09-08 08:00:00 | 94105 | 90 | 63 |

| 2020-09-08 11:00:00 | 94105 | 120 | 62 |

| 2020-09-08 14:00:00 | 94105 | 143 | 62 |

| 2020-09-08 17:00:00 | 94105 | 153 | 65 |

| 2020-09-08 20:00:00 | 94105 | 147 | 72 |

| 2020-09-08 23:00:00 | 94105 | 137 | 75 |

+---------------------+----------+-----+-------------*/

Agrega una serie temporal con el relleno de brechas

A veces, después de agregar una serie temporal, los datos pueden tener brechas que se deben completar con algunos valores para un análisis o una presentación más detallados.

La técnica que se usa para llenar esas brechas se denomina relleno de brechas. En BigQuery, puedes usar la función de tabla GAP_FILL para completar los espacios en los datos de series temporales con uno de los siguientes métodos de relleno de espacios:

- NULL, también conocido como constante

- LOCF, última observación desarrollada

- Tipo de interpolación lineal entre los dos datos cercanos

Para las consultas de esta sección, crea una tabla llamada mydataset.environmental_data_hourly_with_gaps, que se base en los datos que se usaron en la sección anterior, pero con espacios. En situaciones reales, es posible que los datos contengan datos faltantes debido a un mal funcionamiento de la estación meteorológica a corto plazo.

CREATE OR REPLACE TABLE mydataset.environmental_data_hourly_with_gaps AS

SELECT * FROM UNNEST(

ARRAY<STRUCT<zip_code INT64, time TIMESTAMP, aqi INT64, temperature INT64>>[

STRUCT(60606, TIMESTAMP '2020-09-08 00:30:51', 22, 66),

STRUCT(60606, TIMESTAMP '2020-09-08 01:32:10', 23, 63),

STRUCT(60606, TIMESTAMP '2020-09-08 02:30:35', 22, 60),

STRUCT(60606, TIMESTAMP '2020-09-08 03:29:39', 21, 58),

STRUCT(60606, TIMESTAMP '2020-09-08 04:33:05', 21, 59),

STRUCT(60606, TIMESTAMP '2020-09-08 05:32:01', 21, 57),

STRUCT(60606, TIMESTAMP '2020-09-08 06:31:14', 22, 56),

STRUCT(60606, TIMESTAMP '2020-09-08 07:31:06', 28, 55),

STRUCT(60606, TIMESTAMP '2020-09-08 08:29:59', 30, 55),

STRUCT(60606, TIMESTAMP '2020-09-08 09:29:34', 31, 55),

STRUCT(60606, TIMESTAMP '2020-09-08 10:31:24', 38, 56),

STRUCT(60606, TIMESTAMP '2020-09-08 11:31:24', 38, 56),

-- No data points between hours 12 and 15.

STRUCT(60606, TIMESTAMP '2020-09-08 16:34:22', 43, 65),

STRUCT(60606, TIMESTAMP '2020-09-08 17:33:23', 42, 68),

STRUCT(60606, TIMESTAMP '2020-09-08 18:28:47', 36, 69),

STRUCT(60606, TIMESTAMP '2020-09-08 19:30:28', 34, 67),

STRUCT(60606, TIMESTAMP '2020-09-08 20:30:53', 29, 67),

STRUCT(60606, TIMESTAMP '2020-09-08 21:32:28', 27, 67),

STRUCT(60606, TIMESTAMP '2020-09-08 22:31:45', 25, 65),

STRUCT(60606, TIMESTAMP '2020-09-08 23:31:02', 22, 63),

STRUCT(94105, TIMESTAMP '2020-09-08 00:07:11', 60, 74),

STRUCT(94105, TIMESTAMP '2020-09-08 01:07:24', 61, 73),

STRUCT(94105, TIMESTAMP '2020-09-08 02:08:07', 60, 71),

STRUCT(94105, TIMESTAMP '2020-09-08 03:11:05', 69, 69),

STRUCT(94105, TIMESTAMP '2020-09-08 04:07:26', 72, 67),

STRUCT(94105, TIMESTAMP '2020-09-08 05:08:11', 70, 66),

STRUCT(94105, TIMESTAMP '2020-09-08 06:07:30', 68, 65),

STRUCT(94105, TIMESTAMP '2020-09-08 07:07:10', 77, 64),

STRUCT(94105, TIMESTAMP '2020-09-08 08:06:35', 81, 64),

STRUCT(94105, TIMESTAMP '2020-09-08 09:10:18', 82, 63),

STRUCT(94105, TIMESTAMP '2020-09-08 10:08:10', 107, 62),

STRUCT(94105, TIMESTAMP '2020-09-08 11:08:01', 115, 62),

STRUCT(94105, TIMESTAMP '2020-09-08 12:07:39', 120, 62),

STRUCT(94105, TIMESTAMP '2020-09-08 13:06:03', 125, 61),

STRUCT(94105, TIMESTAMP '2020-09-08 14:08:37', 129, 62),

-- No data points between hours 15 and 18.

STRUCT(94105, TIMESTAMP '2020-09-08 19:08:43', 151, 67),

STRUCT(94105, TIMESTAMP '2020-09-08 20:07:19', 150, 69),

STRUCT(94105, TIMESTAMP '2020-09-08 21:07:37', 148, 72),

STRUCT(94105, TIMESTAMP '2020-09-08 22:08:01', 143, 76),

STRUCT(94105, TIMESTAMP '2020-09-08 23:08:41', 137, 75)

]);

Obtén un promedio de 3 horas (incluye las pausas)

La siguiente consulta calcula el ICA y la temperatura promedio de 3 horas para cada código postal:

SELECT

TIMESTAMP_BUCKET(time, INTERVAL 3 HOUR) AS time,

zip_code,

CAST(AVG(aqi) AS INT64) AS aqi,

CAST(AVG(temperature) AS INT64) AS temperature

FROM mydataset.environmental_data_hourly_with_gaps

GROUP BY zip_code, time

ORDER BY zip_code, time;

/*---------------------+----------+-----+-------------+

| time | zip_code | aqi | temperature |

+---------------------+----------+-----+-------------+

| 2020-09-08 00:00:00 | 60606 | 22 | 63 |

| 2020-09-08 03:00:00 | 60606 | 21 | 58 |

| 2020-09-08 06:00:00 | 60606 | 27 | 55 |

| 2020-09-08 09:00:00 | 60606 | 36 | 56 |

| 2020-09-08 15:00:00 | 60606 | 43 | 67 |

| 2020-09-08 18:00:00 | 60606 | 33 | 68 |

| 2020-09-08 21:00:00 | 60606 | 25 | 65 |

| 2020-09-08 00:00:00 | 94105 | 60 | 73 |

| 2020-09-08 03:00:00 | 94105 | 70 | 67 |

| 2020-09-08 06:00:00 | 94105 | 75 | 64 |

| 2020-09-08 09:00:00 | 94105 | 101 | 62 |

| 2020-09-08 12:00:00 | 94105 | 125 | 62 |

| 2020-09-08 18:00:00 | 94105 | 151 | 68 |

| 2020-09-08 21:00:00 | 94105 | 143 | 74 |

+---------------------+----------+-----+-------------*/

Observa cómo el resultado tiene espacios en ciertos intervalos de tiempo. Por ejemplo, las series temporales para el código postal 60606 no tienen datos en 2020-09-08 12:00:00 y la serie temporal para el código postal 94105 no tiene datos en 2020-09-08 15:00:00.

Obtén un promedio de 3 horas (completa las brechas)

Usa la consulta de la sección anterior y agrega la función GAP_FILL para completar las brechas:

WITH aggregated_3_hr AS (

SELECT

TIMESTAMP_BUCKET(time, INTERVAL 3 HOUR) AS time,

zip_code,

CAST(AVG(aqi) AS INT64) AS aqi,

CAST(AVG(temperature) AS INT64) AS temperature

FROM mydataset.environmental_data_hourly_with_gaps

GROUP BY zip_code, time)

SELECT *

FROM GAP_FILL(

TABLE aggregated_3_hr,

ts_column => 'time',

bucket_width => INTERVAL 3 HOUR,

partitioning_columns => ['zip_code']

)

ORDER BY zip_code, time;

/*---------------------+----------+------+-------------+

| time | zip_code | aqi | temperature |

+---------------------+----------+------+-------------+

| 2020-09-08 00:00:00 | 60606 | 22 | 63 |

| 2020-09-08 03:00:00 | 60606 | 21 | 58 |

| 2020-09-08 06:00:00 | 60606 | 27 | 55 |

| 2020-09-08 09:00:00 | 60606 | 36 | 56 |

| 2020-09-08 12:00:00 | 60606 | NULL | NULL |

| 2020-09-08 15:00:00 | 60606 | 43 | 67 |

| 2020-09-08 18:00:00 | 60606 | 33 | 68 |

| 2020-09-08 21:00:00 | 60606 | 25 | 65 |

| 2020-09-08 00:00:00 | 94105 | 60 | 73 |

| 2020-09-08 03:00:00 | 94105 | 70 | 67 |

| 2020-09-08 06:00:00 | 94105 | 75 | 64 |

| 2020-09-08 09:00:00 | 94105 | 101 | 62 |

| 2020-09-08 12:00:00 | 94105 | 125 | 62 |

| 2020-09-08 15:00:00 | 94105 | NULL | NULL |

| 2020-09-08 18:00:00 | 94105 | 151 | 68 |

| 2020-09-08 21:00:00 | 94105 | 143 | 74 |

+---------------------+----------+------+-------------*/

La tabla de salida ahora contiene una fila faltante en 2020-09-08 12:00:00 para el código postal 60606 y en 2020-09-08 15:00:00 para el código postal 94105, con valores NULL en las correspondientes columnas métricas. Como no especificaste ningún método para completar las brechas, GAP_FILL usó el método predeterminado, NULL.

Completa las brechas con relleno de brechas lineal y de LOCF

En la siguiente consulta, se usa la función GAP_FILL con el método de relleno de brechas LOCF para la columna aqi y el tipo de interpolación lineal para la columna temperature:

WITH aggregated_3_hr AS (

SELECT

TIMESTAMP_BUCKET(time, INTERVAL 3 HOUR) AS time,

zip_code,

CAST(AVG(aqi) AS INT64) AS aqi,

CAST(AVG(temperature) AS INT64) AS temperature

FROM mydataset.environmental_data_hourly_with_gaps

GROUP BY zip_code, time)

SELECT *

FROM GAP_FILL(

TABLE aggregated_3_hr,

ts_column => 'time',

bucket_width => INTERVAL 3 HOUR,

partitioning_columns => ['zip_code'],

value_columns => [

('aqi', 'locf'),

('temperature', 'linear')

]

)

ORDER BY zip_code, time;

/*---------------------+----------+-----+-------------+

| time | zip_code | aqi | temperature |

+---------------------+----------+-----+-------------+

| 2020-09-08 00:00:00 | 60606 | 22 | 63 |

| 2020-09-08 03:00:00 | 60606 | 21 | 58 |

| 2020-09-08 06:00:00 | 60606 | 27 | 55 |

| 2020-09-08 09:00:00 | 60606 | 36 | 56 |

| 2020-09-08 12:00:00 | 60606 | 36 | 62 |

| 2020-09-08 15:00:00 | 60606 | 43 | 67 |

| 2020-09-08 18:00:00 | 60606 | 33 | 68 |

| 2020-09-08 21:00:00 | 60606 | 25 | 65 |

| 2020-09-08 00:00:00 | 94105 | 60 | 73 |

| 2020-09-08 03:00:00 | 94105 | 70 | 67 |

| 2020-09-08 06:00:00 | 94105 | 75 | 64 |

| 2020-09-08 09:00:00 | 94105 | 101 | 62 |

| 2020-09-08 12:00:00 | 94105 | 125 | 62 |

| 2020-09-08 15:00:00 | 94105 | 125 | 65 |

| 2020-09-08 18:00:00 | 94105 | 151 | 68 |

| 2020-09-08 21:00:00 | 94105 | 143 | 74 |

+---------------------+----------+-----+-------------*/

En esta consulta, la primera fila llena de vacíos tiene el valor de aqi 36, que se toma del dato anterior de esta serie temporal (código postal 60606) en 2020-09-08 09:00:00. El valor temperature 62 es el resultado del tipo de interpolación lineal entre los datos 2020-09-08 09:00:00 y 2020-09-08 15:00:00. La otra fila faltante se creó de manera similar: el valor de aqi 125 se transfirió del dato anterior de esta serie temporal (código postal 94105) y el valor de temperatura 65 es el resultado del tipo de interpolación lineal entre el dato anterior y el siguiente dato disponible.

Alinea una serie temporal con el relleno de brechas

Las series temporales pueden alinearse o no estar alineadas. Una serie temporal está alineada cuando los datos solo ocurren a intervalos regulares.

En el mundo real, en el momento de la recopilación, las series temporales rara vez están alineadas y, por lo general, requieren un procesamiento adicional para alinearlas.

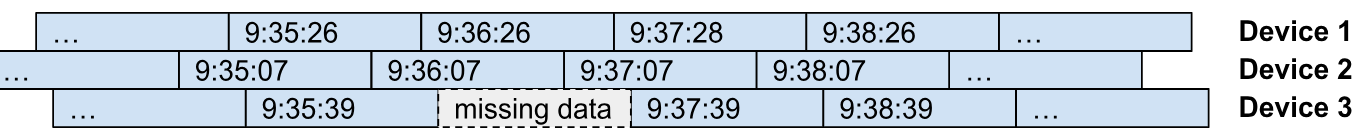

Por ejemplo, considera los dispositivos de IoT que envían sus métricas a un colector centralizado cada minuto. Sería injustificado esperar que los dispositivos envíen sus métricas en los mismos momentos. Por lo general, cada dispositivo envía sus métricas con la misma frecuencia (período), pero con una compensación de tiempo diferente (alineación). En el siguiente diagrama, se ilustra este ejemplo. Puedes ver que cada dispositivo envía sus datos con un intervalo de un minuto con algunas instancias de datos faltantes (Dispositivo 3 en 9:36:39) y datos retrasados (Dispositivo 1 en 9:37:28).

Puedes realizar la alineación de series temporales en los datos sin alinear mediante la agregación de tiempo. Esto es útil si quieres cambiar el período de muestreo de las series temporales, por ejemplo, pasar del período de muestreo original de 1 minuto a un período de 15 minutos. Puedes alinear los datos para su mayor procesamiento de series temporales, como la unión de datos de series temporales, o con fines de visualización (como la creación de gráficos).

Puedes usar la función de tabla GAP_FILL con LOCF o métodos de relleno lineal de espacios para realizar la alineación de series temporales. La idea es usar GAP_FILL con el período de salida y la alineación seleccionados (controlado por el argumento de origen opcional). El resultado de la operación es una tabla con series temporales alineadas, en la que los valores de cada dato se derivan de la serie temporal de entrada con el método de relleno de brechas que se usa para esa columna de valor en particular (LOCF de lineal).

Crea una tabla mydataset.device_data, que se parece a la ilustración anterior:

CREATE OR REPLACE TABLE mydataset.device_data AS

SELECT * FROM UNNEST(

ARRAY<STRUCT<device_id INT64, time TIMESTAMP, signal INT64, state STRING>>[

STRUCT(2, TIMESTAMP '2023-11-01 09:35:07', 87, 'ACTIVE'),

STRUCT(1, TIMESTAMP '2023-11-01 09:35:26', 82, 'ACTIVE'),

STRUCT(3, TIMESTAMP '2023-11-01 09:35:39', 74, 'INACTIVE'),

STRUCT(2, TIMESTAMP '2023-11-01 09:36:07', 88, 'ACTIVE'),

STRUCT(1, TIMESTAMP '2023-11-01 09:36:26', 82, 'ACTIVE'),

STRUCT(2, TIMESTAMP '2023-11-01 09:37:07', 88, 'ACTIVE'),

STRUCT(1, TIMESTAMP '2023-11-01 09:37:28', 80, 'ACTIVE'),

STRUCT(3, TIMESTAMP '2023-11-01 09:37:39', 77, 'ACTIVE'),

STRUCT(2, TIMESTAMP '2023-11-01 09:38:07', 86, 'ACTIVE'),

STRUCT(1, TIMESTAMP '2023-11-01 09:38:26', 81, 'ACTIVE'),

STRUCT(3, TIMESTAMP '2023-11-01 09:38:39', 77, 'ACTIVE')

]);

Los siguientes son los datos reales ordenados por las columnas time y device_id:

SELECT * FROM mydataset.device_data ORDER BY time, device_id;

/*-----------+---------------------+--------+----------+

| device_id | time | signal | state |

+-----------+---------------------+--------+----------+

| 2 | 2023-11-01 09:35:07 | 87 | ACTIVE |

| 1 | 2023-11-01 09:35:26 | 82 | ACTIVE |

| 3 | 2023-11-01 09:35:39 | 74 | INACTIVE |

| 2 | 2023-11-01 09:36:07 | 88 | ACTIVE |

| 1 | 2023-11-01 09:36:26 | 82 | ACTIVE |

| 2 | 2023-11-01 09:37:07 | 88 | ACTIVE |

| 1 | 2023-11-01 09:37:28 | 80 | ACTIVE |

| 3 | 2023-11-01 09:37:39 | 77 | ACTIVE |

| 2 | 2023-11-01 09:38:07 | 86 | ACTIVE |

| 1 | 2023-11-01 09:38:26 | 81 | ACTIVE |

| 3 | 2023-11-01 09:38:39 | 77 | ACTIVE |

+-----------+---------------------+--------+----------*/

La tabla contiene las series temporales de cada dispositivo con dos columnas de métricas:

signal: Es el nivel de señal que observa el dispositivo en el momento del muestreo, representado como un valor de número entero entre0y100.state: Es el estado del dispositivo en el momento del muestreo, representado como una cadena de formato libre.

En la siguiente consulta, se usa la función GAP_FILL para alinear las series temporales en intervalos de 1 minuto. Ten en cuenta cómo se usa el tipo de interpolación lineal para calcular los valores de la columna signal y el LOCF para la columna state. Para este dato de ejemplo, el tipo de interpolación lineal es una opción adecuada para calcular los valores de salida.

SELECT *

FROM GAP_FILL(

TABLE mydataset.device_data,

ts_column => 'time',

bucket_width => INTERVAL 1 MINUTE,

partitioning_columns => ['device_id'],

value_columns => [

('signal', 'linear'),

('state', 'locf')

]

)

ORDER BY time, device_id;

/*---------------------+-----------+--------+----------+

| time | device_id | signal | state |

+---------------------+-----------+--------+----------+

| 2023-11-01 09:36:00 | 1 | 82 | ACTIVE |

| 2023-11-01 09:36:00 | 2 | 88 | ACTIVE |

| 2023-11-01 09:36:00 | 3 | 75 | INACTIVE |

| 2023-11-01 09:37:00 | 1 | 81 | ACTIVE |

| 2023-11-01 09:37:00 | 2 | 88 | ACTIVE |

| 2023-11-01 09:37:00 | 3 | 76 | INACTIVE |

| 2023-11-01 09:38:00 | 1 | 81 | ACTIVE |

| 2023-11-01 09:38:00 | 2 | 86 | ACTIVE |

| 2023-11-01 09:38:00 | 3 | 77 | ACTIVE |

+---------------------+-----------+--------+----------*/

La tabla de resultados contiene una serie temporal alineada para cada dispositivo y columnas de valor (signal y state), calculadas con los métodos de relleno de brechas especificados en la llamada a función.

Une datos de series temporales

Puedes unir datos de series temporales mediante una unión con ventanas o una unión AS OF.

Unión con ventanas

A veces, debes unir dos o más tablas con datos de series temporales. Considera las siguientes dos tablas:

mydataset.sensor_temperatures, contiene los datos de temperatura que informa cada sensor cada 15 segundos.mydataset.sensor_fuel_rates, contiene la tasa de consumo de combustible que mide cada sensor cada 15 segundos.

Para crear estas tablas, ejecuta las siguientes consultas:

CREATE OR REPLACE TABLE mydataset.sensor_temperatures AS

SELECT * FROM UNNEST(

ARRAY<STRUCT<sensor_id INT64, ts TIMESTAMP, temp FLOAT64>>[

(1, TIMESTAMP '2020-01-01 12:00:00.063', 37.1),

(1, TIMESTAMP '2020-01-01 12:00:15.024', 37.2),

(1, TIMESTAMP '2020-01-01 12:00:30.032', 37.3),

(2, TIMESTAMP '2020-01-01 12:00:01.001', 38.1),

(2, TIMESTAMP '2020-01-01 12:00:15.082', 38.2),

(2, TIMESTAMP '2020-01-01 12:00:31.009', 38.3)

]);

CREATE OR REPLACE TABLE mydataset.sensor_fuel_rates AS

SELECT * FROM UNNEST(

ARRAY<STRUCT<sensor_id INT64, ts TIMESTAMP, rate FLOAT64>>[

(1, TIMESTAMP '2020-01-01 12:00:11.016', 10.1),

(1, TIMESTAMP '2020-01-01 12:00:26.015', 10.2),

(1, TIMESTAMP '2020-01-01 12:00:41.014', 10.3),

(2, TIMESTAMP '2020-01-01 12:00:08.099', 11.1),

(2, TIMESTAMP '2020-01-01 12:00:23.087', 11.2),

(2, TIMESTAMP '2020-01-01 12:00:38.077', 11.3)

]);

A continuación, se muestran los datos reales de las tablas:

SELECT * FROM mydataset.sensor_temperatures ORDER BY sensor_id, ts;

/*-----------+---------------------+------+

| sensor_id | ts | temp |

+-----------+---------------------+------+

| 1 | 2020-01-01 12:00:00 | 37.1 |

| 1 | 2020-01-01 12:00:15 | 37.2 |

| 1 | 2020-01-01 12:00:30 | 37.3 |

| 2 | 2020-01-01 12:00:01 | 38.1 |

| 2 | 2020-01-01 12:00:15 | 38.2 |

| 2 | 2020-01-01 12:00:31 | 38.3 |

+-----------+---------------------+------*/

SELECT * FROM mydataset.sensor_fuel_rates ORDER BY sensor_id, ts;

/*-----------+---------------------+------+

| sensor_id | ts | rate |

+-----------+---------------------+------+

| 1 | 2020-01-01 12:00:11 | 10.1 |

| 1 | 2020-01-01 12:00:26 | 10.2 |

| 1 | 2020-01-01 12:00:41 | 10.3 |

| 2 | 2020-01-01 12:00:08 | 11.1 |

| 2 | 2020-01-01 12:00:23 | 11.2 |

| 2 | 2020-01-01 12:00:38 | 11.3 |

+-----------+---------------------+------*/

Para verificar la tasa de consumo de combustible a la temperatura que informa cada sensor, puedes unir las dos series temporales.

Aunque los datos de las dos series temporales no están alineados, se toman muestras en el mismo intervalo (15 segundos), por lo que son un buen candidato para la unión con ventanas. Usa las funciones de agrupamiento de tiempo para alinear las marcas de tiempo que se usan como claves de unión.

En las siguientes consultas, se ilustra cómo cada marca de tiempo se puede asignar a ventanas de 15 segundos con la función TIMESTAMP_BUCKET:

SELECT *, TIMESTAMP_BUCKET(ts, INTERVAL 15 SECOND) ts_window

FROM mydataset.sensor_temperatures

ORDER BY sensor_id, ts;

/*-----------+---------------------+------+---------------------+

| sensor_id | ts | temp | ts_window |

+-----------+---------------------+------+---------------------+

| 1 | 2020-01-01 12:00:00 | 37.1 | 2020-01-01 12:00:00 |

| 1 | 2020-01-01 12:00:15 | 37.2 | 2020-01-01 12:00:15 |

| 1 | 2020-01-01 12:00:30 | 37.3 | 2020-01-01 12:00:30 |

| 2 | 2020-01-01 12:00:01 | 38.1 | 2020-01-01 12:00:00 |

| 2 | 2020-01-01 12:00:15 | 38.2 | 2020-01-01 12:00:15 |

| 2 | 2020-01-01 12:00:31 | 38.3 | 2020-01-01 12:00:30 |

+-----------+---------------------+------+---------------------*/

SELECT *, TIMESTAMP_BUCKET(ts, INTERVAL 15 SECOND) ts_window

FROM mydataset.sensor_fuel_rates

ORDER BY sensor_id, ts;

/*-----------+---------------------+------+---------------------+

| sensor_id | ts | rate | ts_window |

+-----------+---------------------+------+---------------------+

| 1 | 2020-01-01 12:00:11 | 10.1 | 2020-01-01 12:00:00 |

| 1 | 2020-01-01 12:00:26 | 10.2 | 2020-01-01 12:00:15 |

| 1 | 2020-01-01 12:00:41 | 10.3 | 2020-01-01 12:00:30 |

| 2 | 2020-01-01 12:00:08 | 11.1 | 2020-01-01 12:00:00 |

| 2 | 2020-01-01 12:00:23 | 11.2 | 2020-01-01 12:00:15 |

| 2 | 2020-01-01 12:00:38 | 11.3 | 2020-01-01 12:00:30 |

+-----------+---------------------+------+---------------------*/

Puedes usar este concepto para unir los datos de la tasa de consumo de combustible con la temperatura que informa cada sensor:

SELECT

t1.sensor_id AS sensor_id,

t1.ts AS temp_ts,

t1.temp AS temp,

t2.ts AS rate_ts,

t2.rate AS rate

FROM mydataset.sensor_temperatures t1

LEFT JOIN mydataset.sensor_fuel_rates t2

ON TIMESTAMP_BUCKET(t1.ts, INTERVAL 15 SECOND) =

TIMESTAMP_BUCKET(t2.ts, INTERVAL 15 SECOND)

AND t1.sensor_id = t2.sensor_id

ORDER BY sensor_id, temp_ts;

/*-----------+---------------------+------+---------------------+------+

| sensor_id | temp_ts | temp | rate_ts | rate |

+-----------+---------------------+------+---------------------+------+

| 1 | 2020-01-01 12:00:00 | 37.1 | 2020-01-01 12:00:11 | 10.1 |

| 1 | 2020-01-01 12:00:15 | 37.2 | 2020-01-01 12:00:26 | 10.2 |

| 1 | 2020-01-01 12:00:30 | 37.3 | 2020-01-01 12:00:41 | 10.3 |

| 2 | 2020-01-01 12:00:01 | 38.1 | 2020-01-01 12:00:08 | 11.1 |

| 2 | 2020-01-01 12:00:15 | 38.2 | 2020-01-01 12:00:23 | 11.2 |

| 2 | 2020-01-01 12:00:31 | 38.3 | 2020-01-01 12:00:38 | 11.3 |

+-----------+---------------------+------+---------------------+------*/

AS OF join

En esta sección, usa la tabla mydataset.sensor_temperatures y crea una tabla nueva, mydataset.sensor_location.

La tabla mydataset.sensor_temperatures contiene datos de temperatura de diferentes sensores, que se informan cada 15 segundos:

SELECT * FROM mydataset.sensor_temperatures ORDER BY sensor_id, ts;

/*-----------+---------------------+------+

| sensor_id | ts | temp |

+-----------+---------------------+------+

| 1 | 2020-01-01 12:00:00 | 37.1 |

| 1 | 2020-01-01 12:00:15 | 37.2 |

| 1 | 2020-01-01 12:00:30 | 37.3 |

| 2 | 2020-01-01 12:00:45 | 38.1 |

| 2 | 2020-01-01 12:01:01 | 38.2 |

| 2 | 2020-01-01 12:01:15 | 38.3 |

+-----------+---------------------+------*/

Para crear mydataset.sensor_location, ejecuta la siguiente consulta:

CREATE OR REPLACE TABLE mydataset.sensor_locations AS

SELECT * FROM UNNEST(

ARRAY<STRUCT<sensor_id INT64, ts TIMESTAMP, location GEOGRAPHY>>[

(1, TIMESTAMP '2020-01-01 11:59:47.063', ST_GEOGPOINT(-122.022, 37.406)),

(1, TIMESTAMP '2020-01-01 12:00:08.185', ST_GEOGPOINT(-122.021, 37.407)),

(1, TIMESTAMP '2020-01-01 12:00:28.032', ST_GEOGPOINT(-122.020, 37.405)),

(2, TIMESTAMP '2020-01-01 07:28:41.239', ST_GEOGPOINT(-122.390, 37.790))

]);

/*-----------+---------------------+------------------------+

| sensor_id | ts | location |

+-----------+---------------------+------------------------+

| 1 | 2020-01-01 11:59:47 | POINT(-122.022 37.406) |

| 1 | 2020-01-01 12:00:08 | POINT(-122.021 37.407) |

| 1 | 2020-01-01 12:00:28 | POINT(-122.02 37.405) |

| 2 | 2020-01-01 07:28:41 | POINT(-122.39 37.79) |

+-----------+---------------------+------------------------*/

Ahora une los datos de mydataset.sensor_temperatures con los datos de mydataset.sensor_location.

En esta situación, no puedes usar una unión con ventanas, ya que los datos de temperatura y la fecha de la ubicación no se informan en el mismo intervalo.

Una forma de hacerlo en BigQuery es transformar los datos de la marca de tiempo en un rango con el tipo de datos RANGE. El rango representa la validez temporal de una fila y proporciona la hora de inicio y finalización para las que la fila es válida.

Usa la función analítica LEAD para encontrar el siguiente dato de la serie temporal en relación con el dato actual, que también es el límite final de la validez temporal de la fila actual. Las siguientes consultas demuestran esto y convierten los datos de ubicación en rangos de validez:

WITH locations_ranges AS (

SELECT

sensor_id,

RANGE(ts, LEAD(ts) OVER (PARTITION BY sensor_id ORDER BY ts ASC)) AS ts_range,

location

FROM mydataset.sensor_locations

)

SELECT * FROM locations_ranges ORDER BY sensor_id, ts_range;

/*-----------+--------------------------------------------+------------------------+

| sensor_id | ts_range | location |

+-----------+--------------------------------------------+------------------------+

| 1 | [2020-01-01 11:59:47, 2020-01-01 12:00:08) | POINT(-122.022 37.406) |

| 1 | [2020-01-01 12:00:08, 2020-01-01 12:00:28) | POINT(-122.021 37.407) |

| 1 | [2020-01-01 12:00:28, UNBOUNDED) | POINT(-122.02 37.405) |

| 2 | [2020-01-01 07:28:41, UNBOUNDED) | POINT(-122.39 37.79) |

+-----------+--------------------------------------------+------------------------*/

Ahora puedes unir los datos de temperaturas (izquierda) con los datos de ubicación (derecha):

WITH locations_ranges AS (

SELECT

sensor_id,

RANGE(ts, LEAD(ts) OVER (PARTITION BY sensor_id ORDER BY ts ASC)) AS ts_range,

location

FROM mydataset.sensor_locations

)

SELECT

t1.sensor_id AS sensor_id,

t1.ts AS temp_ts,

t1.temp AS temp,

t2.location AS location

FROM mydataset.sensor_temperatures t1

LEFT JOIN locations_ranges t2

ON RANGE_CONTAINS(t2.ts_range, t1.ts)

AND t1.sensor_id = t2.sensor_id

ORDER BY sensor_id, temp_ts;

/*-----------+---------------------+------+------------------------+

| sensor_id | temp_ts | temp | location |

+-----------+---------------------+------+------------------------+

| 1 | 2020-01-01 12:00:00 | 37.1 | POINT(-122.022 37.406) |

| 1 | 2020-01-01 12:00:15 | 37.2 | POINT(-122.021 37.407) |

| 1 | 2020-01-01 12:00:30 | 37.3 | POINT(-122.02 37.405) |

| 2 | 2020-01-01 12:00:01 | 38.1 | POINT(-122.39 37.79) |

| 2 | 2020-01-01 12:00:15 | 38.2 | POINT(-122.39 37.79) |

| 2 | 2020-01-01 12:00:31 | 38.3 | POINT(-122.39 37.79) |

+-----------+---------------------+------+------------------------*/

Combina y divide datos de rango

En esta sección, combina los datos de rango que tengan rangos superpuestos y divide los datos de rango en rangos más pequeños.

Combina datos de rango

Las tablas con valores de rango pueden tener rangos superpuestos. En la siguiente consulta, los intervalos de tiempo capturan el estado de los sensores en intervalos de 5 minutos aproximadamente:

CREATE OR REPLACE TABLE mydataset.sensor_metrics AS

SELECT * FROM UNNEST(

ARRAY<STRUCT<sensor_id INT64, duration RANGE<DATETIME>, flow INT64, spins INT64>>[

(1, RANGE<DATETIME> "[2020-01-01 12:00:01, 2020-01-01 12:05:23)", 10, 1),

(1, RANGE<DATETIME> "[2020-01-01 12:05:12, 2020-01-01 12:10:46)", 10, 20),

(1, RANGE<DATETIME> "[2020-01-01 12:10:27, 2020-01-01 12:15:56)", 11, 4),

(1, RANGE<DATETIME> "[2020-01-01 12:16:00, 2020-01-01 12:20:58)", 11, 9),

(1, RANGE<DATETIME> "[2020-01-01 12:20:33, 2020-01-01 12:25:08)", 11, 8),

(2, RANGE<DATETIME> "[2020-01-01 12:00:19, 2020-01-01 12:05:08)", 21, 31),

(2, RANGE<DATETIME> "[2020-01-01 12:05:08, 2020-01-01 12:10:30)", 21, 2),

(2, RANGE<DATETIME> "[2020-01-01 12:10:22, 2020-01-01 12:15:42)", 21, 10)

]);

La siguiente consulta en la tabla muestra varios rangos superpuestos:

SELECT * FROM mydataset.sensor_metrics;

/*-----------+--------------------------------------------+------+-------+

| sensor_id | duration | flow | spins |

+-----------+--------------------------------------------+------+-------+

| 1 | [2020-01-01 12:00:01, 2020-01-01 12:05:23) | 10 | 1 |

| 1 | [2020-01-01 12:05:12, 2020-01-01 12:10:46) | 10 | 20 |

| 1 | [2020-01-01 12:10:27, 2020-01-01 12:15:56) | 11 | 4 |

| 1 | [2020-01-01 12:16:00, 2020-01-01 12:20:58) | 11 | 9 |

| 1 | [2020-01-01 12:20:33, 2020-01-01 12:25:08) | 11 | 8 |

| 2 | [2020-01-01 12:00:19, 2020-01-01 12:05:08) | 21 | 31 |

| 2 | [2020-01-01 12:05:08, 2020-01-01 12:10:30) | 21 | 2 |

| 2 | [2020-01-01 12:10:22, 2020-01-01 12:15:42) | 21 | 10 |

+-----------+--------------------------------------------+------+-------*/

Para algunos de los rangos superpuestos, el valor en la columna flow es el mismo.

Por ejemplo, las filas 1 y 2 se superponen y también tienen las mismas lecturas flow. Puedes combinar estas dos filas para reducir la cantidad de filas en la tabla. Puedes usar la función de tabla RANGE_SESSIONIZE para encontrar rangos que se superpongan con cada fila y proporcionar una columna session_range adicional que contenga un rango que sea la unión de todos los rangos que se superponen. . Para mostrar los rangos de sesión de cada fila, ejecuta la siguiente consulta:

SELECT sensor_id, session_range, flow

FROM RANGE_SESSIONIZE(

# Input data.

(SELECT sensor_id, duration, flow FROM mydataset.sensor_metrics),

# Range column.

"duration",

# Partitioning columns. Ranges are sessionized only within these partitions.

["sensor_id", "flow"],

# Sessionize mode.

"OVERLAPS")

ORDER BY sensor_id, session_range;

/*-----------+--------------------------------------------+------+

| sensor_id | session_range | flow |

+-----------+--------------------------------------------+------+

| 1 | [2020-01-01 12:00:01, 2020-01-01 12:10:46) | 10 |

| 1 | [2020-01-01 12:00:01, 2020-01-01 12:10:46) | 10 |

| 1 | [2020-01-01 12:10:27, 2020-01-01 12:15:56) | 11 |

| 1 | [2020-01-01 12:16:00, 2020-01-01 12:25:08) | 11 |

| 1 | [2020-01-01 12:16:00, 2020-01-01 12:25:08) | 11 |

| 2 | [2020-01-01 12:00:19, 2020-01-01 12:05:08) | 21 |

| 2 | [2020-01-01 12:05:08, 2020-01-01 12:15:42) | 21 |

| 2 | [2020-01-01 12:05:08, 2020-01-01 12:15:42) | 21 |

+-----------+--------------------------------------------+------*/

Ten en cuenta que, para sensor_id con el valor 2, el límite de finalización de la primera fila tiene el mismo valor de fecha y hora que el límite de inicio de la segunda fila. Sin embargo, debido a que los límites finales son exclusivos, no se superponen (solo se encuentran) y, por lo tanto, no estaban en los mismos rangos de sesión. Si deseas colocar estas dos filas en los mismos rangos de sesión, usa el modo de sesión MEETS.

Para combinar los rangos, agrupa los resultados por session_range y las columnas de partición (sensor_id y flow):

SELECT sensor_id, session_range, flow

FROM RANGE_SESSIONIZE(

(SELECT sensor_id, duration, flow FROM mydataset.sensor_metrics),

"duration",

["sensor_id", "flow"],

"OVERLAPS")

GROUP BY sensor_id, session_range, flow

ORDER BY sensor_id, session_range;

/*-----------+--------------------------------------------+------+

| sensor_id | session_range | flow |

+-----------+--------------------------------------------+------+

| 1 | [2020-01-01 12:00:01, 2020-01-01 12:10:46) | 10 |

| 1 | [2020-01-01 12:10:27, 2020-01-01 12:15:56) | 11 |

| 1 | [2020-01-01 12:16:00, 2020-01-01 12:25:08) | 11 |

| 2 | [2020-01-01 12:00:19, 2020-01-01 12:05:08) | 21 |

| 2 | [2020-01-01 12:05:08, 2020-01-01 12:15:42) | 21 |

+-----------+--------------------------------------------+------*/

Por último, agrega la columna spins a los datos de la sesión agrúpalos con SUM.

SELECT sensor_id, session_range, flow, SUM(spins) as spins

FROM RANGE_SESSIONIZE(

TABLE mydataset.sensor_metrics,

"duration",

["sensor_id", "flow"],

"OVERLAPS")

GROUP BY sensor_id, session_range, flow

ORDER BY sensor_id, session_range;

/*-----------+--------------------------------------------+------+-------+

| sensor_id | session_range | flow | spins |

+-----------+--------------------------------------------+------+-------+

| 1 | [2020-01-01 12:00:01, 2020-01-01 12:10:46) | 10 | 21 |

| 1 | [2020-01-01 12:10:27, 2020-01-01 12:15:56) | 11 | 4 |

| 1 | [2020-01-01 12:16:00, 2020-01-01 12:25:08) | 11 | 17 |

| 2 | [2020-01-01 12:00:19, 2020-01-01 12:05:08) | 21 | 31 |

| 2 | [2020-01-01 12:05:08, 2020-01-01 12:15:42) | 21 | 12 |

+-----------+--------------------------------------------+------+-------*/

Divide datos de rango

También puedes dividir un rango en rangos más pequeños. Para este ejemplo, usa la siguiente tabla con datos de rango:

/*-----------+--------------------------+------+-------+

| sensor_id | duration | flow | spins |

+-----------+--------------------------+------+-------+

| 1 | [2020-01-01, 2020-12-31) | 10 | 21 |

| 1 | [2021-01-01, 2021-12-31) | 11 | 4 |

| 2 | [2020-04-15, 2021-04-15) | 21 | 31 |

| 2 | [2021-04-15, 2021-04-15) | 21 | 12 |

+-----------+--------------------------+------+-------*/

Ahora, divide los rangos originales en intervalos de 3 meses:

WITH sensor_data AS (

SELECT * FROM UNNEST(

ARRAY<STRUCT<sensor_id INT64, duration RANGE<DATE>, flow INT64, spins INT64>>[

(1, RANGE<DATE> "[2020-01-01, 2020-12-31)", 10, 21),

(1, RANGE<DATE> "[2021-01-01, 2021-12-31)", 11, 4),

(2, RANGE<DATE> "[2020-04-15, 2021-04-15)", 21, 31),

(2, RANGE<DATE> "[2021-04-15, 2022-04-15)", 21, 12)

])

)

SELECT sensor_id, expanded_range, flow, spins

FROM sensor_data, UNNEST(GENERATE_RANGE_ARRAY(duration, INTERVAL 3 MONTH)) AS expanded_range;

/*-----------+--------------------------+------+-------+

| sensor_id | expanded_range | flow | spins |

+-----------+--------------------------+------+-------+

| 1 | [2020-01-01, 2020-04-01) | 10 | 21 |

| 1 | [2020-04-01, 2020-07-01) | 10 | 21 |

| 1 | [2020-07-01, 2020-10-01) | 10 | 21 |

| 1 | [2020-10-01, 2020-12-31) | 10 | 21 |

| 1 | [2021-01-01, 2021-04-01) | 11 | 4 |

| 1 | [2021-04-01, 2021-07-01) | 11 | 4 |

| 1 | [2021-07-01, 2021-10-01) | 11 | 4 |

| 1 | [2021-10-01, 2021-12-31) | 11 | 4 |

| 2 | [2020-04-15, 2020-07-15) | 21 | 31 |

| 2 | [2020-07-15, 2020-10-15) | 21 | 31 |

| 2 | [2020-10-15, 2021-01-15) | 21 | 31 |

| 2 | [2021-01-15, 2021-04-15) | 21 | 31 |

| 2 | [2021-04-15, 2021-07-15) | 21 | 12 |

| 2 | [2021-07-15, 2021-10-15) | 21 | 12 |

| 2 | [2021-10-15, 2022-01-15) | 21 | 12 |

| 2 | [2022-01-15, 2022-04-15) | 21 | 12 |

+-----------+--------------------------+------+-------*/

En la consulta anterior, cada rango original se desglosó en rangos más pequeños, con un ancho establecido en INTERVAL 3 MONTH. Sin embargo, los rangos de 3 meses no están alineados con un origen común. Para alinear estos rangos con un origen común 2020-01-01, ejecuta la siguiente consulta:

WITH sensor_data AS (

SELECT * FROM UNNEST(

ARRAY<STRUCT<sensor_id INT64, duration RANGE<DATE>, flow INT64, spins INT64>>[

(1, RANGE<DATE> "[2020-01-01, 2020-12-31)", 10, 21),

(1, RANGE<DATE> "[2021-01-01, 2021-12-31)", 11, 4),

(2, RANGE<DATE> "[2020-04-15, 2021-04-15)", 21, 31),

(2, RANGE<DATE> "[2021-04-15, 2022-04-15)", 21, 12)

])

)

SELECT sensor_id, expanded_range, flow, spins

FROM sensor_data

JOIN UNNEST(GENERATE_RANGE_ARRAY(RANGE<DATE> "[2020-01-01, 2022-12-31)", INTERVAL 3 MONTH)) AS expanded_range

ON RANGE_OVERLAPS(duration, expanded_range);

/*-----------+--------------------------+------+-------+

| sensor_id | expanded_range | flow | spins |

+-----------+--------------------------+------+-------+

| 1 | [2020-01-01, 2020-04-01) | 10 | 21 |

| 1 | [2020-04-01, 2020-07-01) | 10 | 21 |

| 1 | [2020-07-01, 2020-10-01) | 10 | 21 |

| 1 | [2020-10-01, 2021-01-01) | 10 | 21 |

| 1 | [2021-01-01, 2021-04-01) | 11 | 4 |

| 1 | [2021-04-01, 2021-07-01) | 11 | 4 |

| 1 | [2021-07-01, 2021-10-01) | 11 | 4 |

| 1 | [2021-10-01, 2022-01-01) | 11 | 4 |

| 2 | [2020-04-01, 2020-07-01) | 21 | 31 |

| 2 | [2020-07-01, 2020-10-01) | 21 | 31 |

| 2 | [2020-10-01, 2021-01-01) | 21 | 31 |

| 2 | [2021-01-01, 2021-04-01) | 21 | 31 |

| 2 | [2021-04-01, 2021-07-01) | 21 | 31 |

| 2 | [2021-04-01, 2021-07-01) | 21 | 12 |

| 2 | [2021-07-01, 2021-10-01) | 21 | 12 |

| 2 | [2021-10-01, 2022-01-01) | 21 | 12 |

| 2 | [2022-01-01, 2022-04-01) | 21 | 12 |

| 2 | [2022-04-01, 2022-07-01) | 21 | 12 |

+-----------+--------------------------+------+-------*/

En la consulta anterior, la fila con el rango [2020-04-15, 2021-04-15) se divide en 5 rangos, comenzando con el rango [2020-04-01, 2020-07-01). Ten en cuenta que el límite de inicio ahora se extiende más allá del límite de inicio original para alinearse con el origen común. Si no deseas que el límite de inicio no se extienda más allá del límite de inicio original, puedes restringir la condición JOIN:

WITH sensor_data AS (

SELECT * FROM UNNEST(

ARRAY<STRUCT<sensor_id INT64, duration RANGE<DATE>, flow INT64, spins INT64>>[

(1, RANGE<DATE> "[2020-01-01, 2020-12-31)", 10, 21),

(1, RANGE<DATE> "[2021-01-01, 2021-12-31)", 11, 4),

(2, RANGE<DATE> "[2020-04-15, 2021-04-15)", 21, 31),

(2, RANGE<DATE> "[2021-04-15, 2022-04-15)", 21, 12)

])

)

SELECT sensor_id, expanded_range, flow, spins

FROM sensor_data

JOIN UNNEST(GENERATE_RANGE_ARRAY(RANGE<DATE> "[2020-01-01, 2022-12-31)", INTERVAL 3 MONTH)) AS expanded_range

ON RANGE_CONTAINS(duration, RANGE_START(expanded_range));

/*-----------+--------------------------+------+-------+

| sensor_id | expanded_range | flow | spins |

+-----------+--------------------------+------+-------+

| 1 | [2020-01-01, 2020-04-01) | 10 | 21 |

| 1 | [2020-04-01, 2020-07-01) | 10 | 21 |

| 1 | [2020-07-01, 2020-10-01) | 10 | 21 |

| 1 | [2020-10-01, 2021-01-01) | 10 | 21 |

| 1 | [2021-01-01, 2021-04-01) | 11 | 4 |

| 1 | [2021-04-01, 2021-07-01) | 11 | 4 |

| 1 | [2021-07-01, 2021-10-01) | 11 | 4 |

| 1 | [2021-10-01, 2022-01-01) | 11 | 4 |

| 2 | [2020-07-01, 2020-10-01) | 21 | 31 |

| 2 | [2020-10-01, 2021-01-01) | 21 | 31 |

| 2 | [2021-01-01, 2021-04-01) | 21 | 31 |

| 2 | [2021-04-01, 2021-07-01) | 21 | 31 |

| 2 | [2021-07-01, 2021-10-01) | 21 | 12 |

| 2 | [2021-10-01, 2022-01-01) | 21 | 12 |

| 2 | [2022-01-01, 2022-04-01) | 21 | 12 |

| 2 | [2022-04-01, 2022-07-01) | 21 | 12 |

+-----------+--------------------------+------+-------*/

Ahora ves que el rango [2020-04-15, 2021-04-15) se dividió en 4 rangos, comenzando con el rango [2020-07-01, 2020-10-01).

Prácticas recomendadas para almacenar datos

Cuando se almacenan datos de series temporales, es importante tener en cuenta los patrones de consulta que se usan en las tablas donde se almacenan los datos. Por lo general, cuando consultas datos de series temporales, puedes filtrar los datos para un intervalo de tiempo específico.

Para optimizar estos patrones de uso, se recomienda almacenar datos de series temporales en tablas particionadas, con datos particionados por la columna de tiempo o tiempo de transferencia. Esto puede mejorar bastante el rendimiento del tiempo de consulta de los datos de series temporales, ya que esto permite que BigQuery reduzca las particiones que no contienen datos consultados.

Puedes habilitar el agrupamiento en clústeres en el tiempo, el rango o una de las columnas de partición para mejorar aún más el rendimiento del tiempo de consulta.