Carga datos de CSV desde Cloud Storage

Cuando cargas datos de CSV desde Cloud Storage, puedes subirlos en una tabla o una partición nuevas. También puedes adjuntarlos a una tabla o una partición existentes o reemplazar los datos de ellas. Cuando tus datos se cargan en BigQuery, se convierten en formato de columnas para Capacitor (formato de almacenamiento de BigQuery).

Cuando cargas datos de Cloud Storage en una tabla de BigQuery, el conjunto de datos que contiene la tabla debe estar en la misma ubicación regional o multirregional que el bucket de Cloud Storage.

Para obtener información sobre la carga de datos de CSV desde un archivo local, consulta Carga datos desde una fuente de datos local.

Pruébalo tú mismo

Si eres nuevo en Google Cloud, crea una cuenta para evaluar el rendimiento de BigQuery en situaciones reales. Los clientes nuevos también obtienen $300 en créditos gratuitos para ejecutar, probar y, además, implementar cargas de trabajo.

Probar BigQuery gratisLimitaciones

Estás sujeto a las siguientes limitaciones cuando cargas datos en BigQuery desde un bucket de Cloud Storage:

- BigQuery no garantiza la coherencia de los datos provenientes de fuentes de datos externas. Los cambios en los datos subyacentes mientras se ejecuta una consulta pueden dar como resultado un comportamiento inesperado.

- BigQuery no admite el control de versiones de objetos de Cloud Storage. Si incluyes un número de generación en el URI de Cloud Storage, el trabajo de carga fallará.

Cuando cargues archivos CSV en BigQuery, ten en cuenta lo siguiente:

- Los archivos CSV no admiten datos anidados o repetidos.

- Quita los caracteres de marca de orden de bytes (BOM). Pueden causar problemas inesperados.

- Si usas la compresión gzip, BigQuery no puede leer los datos en paralelo. Cargar datos de CSV comprimidos en BigQuery es más lento que subir datos sin comprimir. Consulta Cómo cargar datos comprimidos y sin comprimir.

- No puedes incluir archivos comprimidos y descomprimidos en el mismo trabajo de carga.

- El tamaño máximo de un archivo gzip es de 4 GB.

- La carga de datos de CSV con la detección automática de esquemas no detecta automáticamente los encabezados si todas las columnas son tipos de strings. En este caso, agrega una columna numérica a la entrada o declara el esquema de forma explícita.

- Cuando cargues datos CSV o JSON, en los valores de las columnas

DATE, se debe usar el separador de guion (-), y la fecha debe estar en el siguiente formato:YYYY-MM-DD(año-mes-día). - Cuando cargues datos JSON o CSV, en los valores de las columnas

TIMESTAMP, se debe usar un separador de guion (-) o barra (/) para la parte de fecha de la marca de tiempo, y la fecha debe tener uno de los siguientes formatos:YYYY-MM-DD(año-mes-día) oYYYY/MM/DD(año/mes/día). En la parte dehh:mm:ss(horas-minutos-segundos) de la marca de tiempo, se debe usar un separador de dos puntos (:). - Tus archivos deben cumplir con los límites de tamaño de archivo CSV descritos en los límites de trabajos de carga.

Antes de comenzar

Otorga roles de Identity and Access Management (IAM) que otorguen a los usuarios los permisos necesarios para hacer cada tarea de este documento y crea un conjunto de datos para almacenar tus datos.

Permisos necesarios

Si deseas cargar datos en BigQuery, necesitas permisos de IAM para ejecutar un trabajo de carga y subir datos en tablas y particiones de BigQuery. Si cargas datos desde Cloud Storage, también necesitas permisos de IAM para acceder al bucket que contiene tus datos.

Permisos para cargar datos a BigQuery

Para cargar datos en una tabla o partición de BigQuery nueva o bien agregar o reemplazar una tabla o partición existente, necesitas los siguientes permisos de IAM:

bigquery.tables.createbigquery.tables.updateDatabigquery.tables.updatebigquery.jobs.create

Cada una de las siguientes funciones predefinidas de IAM incluye los permisos que necesitas para cargar datos en una tabla o partición de BigQuery:

roles/bigquery.dataEditorroles/bigquery.dataOwnerroles/bigquery.admin(incluye el permisobigquery.jobs.create)bigquery.user(incluye el permisobigquery.jobs.create)bigquery.jobUser(incluye el permisobigquery.jobs.create)

Además, si tienes el permiso bigquery.datasets.create, puedes crear y actualizar tablas con un trabajo de carga en los conjuntos de datos que crees.

Para obtener más información sobre las funciones y los permisos de IAM en BigQuery, consulta Funciones y permisos predefinidos.

Permisos para subir datos desde Cloud Storage

Para obtener los permisos que

necesitas para cargar datos desde un bucket de Cloud Storage,

pídele a tu administrador que te otorgue el rol de IAM

Administrador de almacenamiento (roles/storage.admin)

en el bucket.

Para obtener más información sobre cómo otorgar roles, consulta Administra el acceso a proyectos, carpetas y organizaciones.

Este rol predefinido contiene los permisos necesarios para cargar datos desde un bucket de Cloud Storage. Para ver los permisos exactos que son necesarios, expande la sección Permisos requeridos:

Permisos necesarios

Los siguientes permisos son necesarios para cargar datos desde un bucket de Cloud Storage:

-

storage.buckets.get -

storage.objects.get -

storage.objects.list (required if you are using a URI wildcard)

También puedes obtener estos permisos con roles personalizados o con otros roles predefinidos.

Crea un conjunto de datos

Crea un conjunto de datos de BigQuery para almacenar tus datos.

Compresión de CSV

Puedes usar la utilidad gzip para comprimir archivos CSV. Ten en cuenta que gzip realiza

la compresión completa de archivos, a diferencia de la compresión de contenido de archivos que realizan los

códecs de compresión para otros formatos de archivo, como Avro. El uso de gzip para

comprimir los archivos CSV puede tener un impacto en el rendimiento. Para obtener más información

sobre las compensaciones, consulta

Carga datos comprimidos y sin comprimir.

Carga datos CSV en una tabla

Para cargar datos de CSV desde Cloud Storage en una tabla nueva de BigQuery, selecciona una de las siguientes opciones:

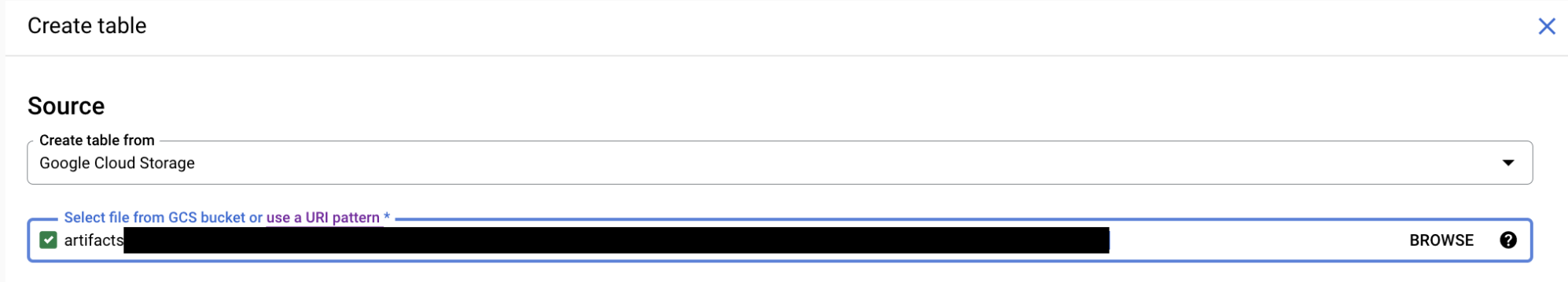

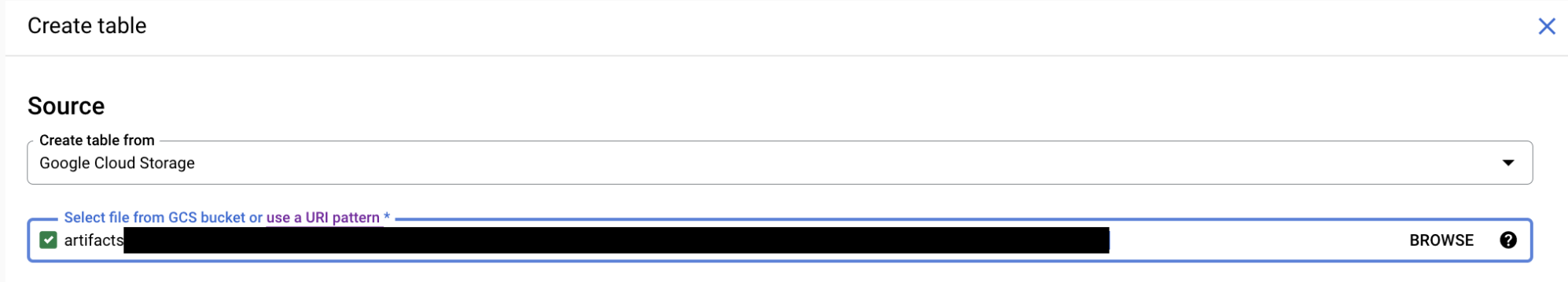

Console

Para seguir la guía paso a paso sobre esta tarea directamente en el editor de Cloud Shell, haz clic en Guiarme:

En la consola de Google Cloud , ve a la página BigQuery.

- En el panel de la izquierda, haz clic en Explorar.

- En el panel Explorador, expande tu proyecto, haz clic en Conjuntos de datos y, luego, selecciona un conjunto de datos.

- En la sección Información del conjunto de datos, haz clic en Crear tabla.

- En el panel Crear tabla, especifica los siguientes detalles:

- En la sección Fuente, elige Google Cloud Storage en la lista Crear tabla desde.

A continuación, sigue estos pasos:

- Selecciona un archivo del bucket de Cloud Storage o ingresa el URI de Cloud Storage.

No puedes incluir múltiples URIs en la consola de Google Cloud , pero se admiten comodines. El bucket de Cloud Storage debe estar en la misma ubicación que el conjunto de datos que contiene la tabla que deseas crear, agregar o reemplazar.

- Para Formato del archivo, selecciona CSV.

- Selecciona un archivo del bucket de Cloud Storage o ingresa el URI de Cloud Storage.

No puedes incluir múltiples URIs en la consola de Google Cloud , pero se admiten comodines. El bucket de Cloud Storage debe estar en la misma ubicación que el conjunto de datos que contiene la tabla que deseas crear, agregar o reemplazar.

- En la sección Destino, especifica los siguientes detalles:

- En Conjunto de datos, elige el conjunto de datos en el que deseas crear la tabla.

- En el campo Tabla, escribe el nombre de la tabla que deseas crear.

- Verifica que el campo Tipo de tabla esté configurado como Tabla nativa.

- En la sección Esquema, ingresa la definición del esquema.

Para habilitar la detección automática de un esquema, selecciona Detección automática.

Puedes ingresar la información del esquema de forma manual mediante uno de los siguientes métodos:

- Opción 1: Haz clic en Editar como texto y pega el esquema con el formato de un array JSON. Cuando usas un array JSON, generas el esquema mediante el mismo proceso que se usa para crear un archivo de esquema JSON.

Puedes ver el esquema de una tabla existente en formato JSON si ingresas el siguiente comando:

bq show --format=prettyjson dataset.table

- Opción 2: Haz clic en Agregar campo y, luego, ingresa el esquema de la tabla. Especifica el Nombre, el Tipo y el Modo de cada campo.

- Opción 1: Haz clic en Editar como texto y pega el esquema con el formato de un array JSON. Cuando usas un array JSON, generas el esquema mediante el mismo proceso que se usa para crear un archivo de esquema JSON.

Puedes ver el esquema de una tabla existente en formato JSON si ingresas el siguiente comando:

- Opcional: Especifica Configuración de particiones y clústeres. Para obtener más información, consulta Crea tablas particionadas y Crea y usa tablas agrupadas en clústeres.

- Haz clic en Opciones avanzadas y haz lo siguiente:

- En Preferencia de escritura, deja elegido Escribir si está vacía. Con esta opción, se crea una tabla nueva y se cargan los datos en ella.

- En Cantidad de errores permitidos, acepta el valor predeterminado de

0o ingresa la cantidad máxima de filas con errores que pueden ignorarse. Si la cantidad de filas con errores excede este valor, el trabajo generará un mensaje deinvalidy fallará. Esta opción se aplica solo a los archivos CSV y JSON. - En Zona horaria, ingresa la zona horaria predeterminada que se aplicará cuando se analicen los valores de marcas de tiempo que no tienen una zona horaria específica. Consulta aquí para ver más nombres de zonas horarias válidos. Si este valor no está presente, los valores de marcas de tiempo sin una zona horaria específica se analizan con la zona horaria predeterminada UTC. (Vista previa)

- En Formato de fecha, ingresa los

elementos de formato que definen cómo se formatean los valores de DATE en los archivos de entrada. Este campo espera el formato de estilos SQL (por ejemplo,

MM/DD/YYYY). Si este valor está presente, este formato es el único formato DATE compatible. La detección automática del esquema también decidirá el tipo de columna DATE según este formato en lugar del formato existente. Si este valor no está presente, el campo DATE se analiza con los formatos predeterminados. (Vista previa) - En Formato de fecha y hora, ingresa los

elementos de formato que definen cómo se formatean los valores de DATETIME en los archivos de entrada.

Este campo espera el formato de estilos SQL (por ejemplo,

MM/DD/YYYY HH24:MI:SS.FF3). Si este valor está presente, este formato es el único formato de FECHA y HORA compatible. La detección automática del esquema también decidirá el tipo de columna DATETIME según este formato en lugar del formato existente. Si este valor no está presente, el campo DATETIME se analiza con los formatos predeterminados. (Vista previa) - En Formato de hora, ingresa los

elementos de formato que definen cómo se formatean los valores de TIME en los archivos de entrada. Este campo espera el formato de estilos SQL (por ejemplo,

HH24:MI:SS.FF3). Si este valor está presente, este formato es el único formato de TIME compatible. La detección automática del esquema también decidirá el tipo de columna TIME según este formato en lugar del formato existente. Si este valor no está presente, el campo TIME se analiza con los formatos predeterminados. (Vista previa) - En Formato de marca de tiempo, ingresa los

elementos de formato que definen cómo se formatean los valores de TIMESTAMP en los archivos de entrada.

Este campo espera el formato de estilos SQL (por ejemplo,

MM/DD/YYYY HH24:MI:SS.FF3). Si este valor está presente, este formato es el único formato TIMESTAMP compatible. La detección automática de esquemas también decidirá el tipo de columna TIMESTAMP según este formato en lugar del formato existente. Si este valor no está presente, el campo TIMESTAMP se analiza con los formatos predeterminados. (Vista previa) - Si deseas ignorar los valores de una fila que no están presentes en el esquema de la tabla, elige Valores desconocidos.

- En Delimitador de campos, elige el carácter que separa las celdas en tu archivo CSV: Coma, Tabulador, Barra vertical o Personalizado. Si eliges Personalizado, debes ingresar el delimitador en la casilla Delimitador de campos personalizado. El valor predeterminado es Coma.

- En Source column match, elige una de las siguientes estrategias que se usan para hacer coincidir las columnas cargadas con el esquema (Preview).

Default: El comportamiento predeterminado se elige según la forma en que se proporciona el esquema. Si la detección automática está habilitada, el comportamiento predeterminado es hacer coincidir las columnas por nombre. De lo contrario, la opción predeterminada es hacer coincidir las columnas por posición. Esto se hace para mantener el comportamiento retrocompatible.Position: Coincide con las columnas por posición, suponiendo que las columnas están ordenadas de la misma manera que el esquema.Name: Coincide por nombre leyendo la fila de encabezado como los nombres de las columnas y reordenando las columnas para que coincidan con los nombres de los campos en el esquema. Los nombres de las columnas se leen de la última fila omitida según Filas del encabezado que se omitirán.- En Filas del encabezado que se omitirán, ingresa la cantidad de filas de encabezado que se omitirán en la parte superior del archivo CSV. El valor predeterminado es

0. - En Saltos de línea en secciones entrecomilladas, marca Permitir saltos de línea en secciones entrecomilladas para permitir secciones de datos entrecomilladas que contengan caracteres de salto de línea en un archivo CSV. El valor predeterminado es

false. - En Filas irregulares, marca Permitir filas irregulares para aceptar filas en archivos CSV a las que les falten columnas opcionales finales. Los valores faltantes se consideran nulos. Si no se marca esta opción, los registros en los que faltan columnas finales se tratan como registros incorrectos y, si hay demasiados, se muestra un error no válido en el resultado del trabajo. El valor predeterminado es

false. - En Marcadores de nulos, ingresa una lista de cadenas personalizadas que representen un valor NULL en los datos CSV. (Vista previa)

- En Encriptación, haz clic en Clave administrada por el cliente para usar una clave de Cloud Key Management Service. Si dejas establecida la configuración Google-managed key, BigQuery encripta los datos en reposo.

- Haz clic en Crear tabla.

SQL

Usa la declaración DDL LOAD DATA.

En el siguiente ejemplo, se carga un archivo CSV en la nueva tabla mytable:

En la consola de Google Cloud , ve a la página BigQuery.

En el editor de consultas, escribe la siguiente sentencia:

LOAD DATA OVERWRITE mydataset.mytable (x INT64,y STRING) FROM FILES ( format = 'CSV', uris = ['gs://bucket/path/file.csv']);

Haz clic en Ejecutar.

Si deseas obtener información sobre cómo ejecutar consultas, visita Ejecuta una consulta interactiva.

bq

Usa el comando bq load, especifica CSV con la marca --source_format e incluye un URI de Cloud Storage.

Puedes incluir un único URI, una lista de URI separados por comas o un URI que contenga un comodín.

Proporciona el esquema intercalado con un archivo de definición de esquema o usa la detección automática de esquemas. Si no especificas un

esquema y --autodetect es false, y la tabla de destino

existe, se usa el esquema de la tabla de destino.

Opcional: Proporciona la marca --location y configura el valor en tu ubicación.

Las siguientes son otras marcas opcionales:

--allow_jagged_rows: Cuando se especifica, se aceptan filas de archivos CSV a las que les faltan columnas opcionales finales. Los valores faltantes se consideran nulos. Si no se marca esta opción, los registros en los que faltan columnas finales se tratan como registros incorrectos y, si hay demasiados, se muestra un error no válido en el resultado del trabajo. El valor predeterminado esfalse.--allow_quoted_newlines: cuando se especifica, permite secciones de datos entrecomillados que contienen caracteres de salto de línea en un archivo CSV. El valor predeterminado esfalse.--field_delimiter: el carácter que indica el límite entre las columnas en los datos.\tytabpueden ser delimitadores de tabulación. El valor predeterminado es,.--null_marker: una string personalizada opcional que representa un valor NULL en los datos de CSV.--null_markers: (Versión preliminar) Es una lista opcional de cadenas personalizadas separadas por comas que representan valores NULL en los datos CSV. Esta opción no se puede usar con la marca--null_marker.--source_column_match: (Vista previa) Especifica la estrategia que se usa para hacer coincidir las columnas cargadas con el esquema. Puedes especificarPOSITIONpara que coincidan las columnas cargadas por posición, suponiendo que las columnas se ordenan de la misma manera que el esquema. También puedes especificarNAMEpara que coincida por nombre leyendo la fila de encabezado como los nombres de las columnas y reordenando las columnas para que coincidan con los nombres de los campos en el esquema. Si no se especifica este valor, el valor predeterminado se basa en la forma en que se proporciona el esquema. Si--autodetectestá habilitado, el comportamiento predeterminado es hacer coincidir las columnas por nombre. De lo contrario, la opción predeterminada es hacer coincidir las columnas por posición.--skip_leading_rows: especifica la cantidad de filas de encabezado que se omiten en la parte superior del archivo CSV. El valor predeterminado es0.--quote: El carácter de comillas que se usará para encerrar registros. El valor predeterminado es". Para indicar que no hay ningún carácter de comilla, usa una string vacía.--max_bad_records: Un número entero que especifica la cantidad máxima de registros incorrectos permitidos antes de que falle todo el trabajo. El valor predeterminado es0. Como máximo, se muestran cinco errores de cualquier tipo, sin importar el valor--max_bad_records.--ignore_unknown_values: Cuando se especifica, permite y también ignora valores extras no reconocidos en datos CSV o JSON.--time_zone: (Vista previa) Es una zona horaria predeterminada opcional que se aplicará cuando se analicen valores de marcas de tiempo que no tengan una zona horaria específica en los datos CSV o JSON.--date_format: (Vista previa) Es una cadena personalizada opcional que define el formato de los valores DATE en los datos CSV o JSON.--datetime_format: (Vista previa) Es una cadena personalizada opcional que define cómo se formatean los valores de DATETIME en los datos de CSV o JSON.--time_format: (Versión preliminar) Es una cadena personalizada opcional que define cómo se formatean los valores de TIME en los datos CSV o JSON.--timestamp_format: (Versión preliminar) Es una cadena personalizada opcional que define el formato de los valores TIMESTAMP en los datos CSV o JSON.--autodetect: Cuando se especifica, se habilita la detección automática de esquemas para los datos de formato CSV y JSON.--time_partitioning_type: Habilita las particiones basadas en el tiempo en una tabla y establece el tipo de partición. Los valores posibles sonHOUR,DAY,MONTHyYEAR. Esta marca es opcional cuando se crea una tabla particionada en una columnaDATE,DATETIMEoTIMESTAMP. El tipo de partición predeterminado para la partición basada en el tiempo esDAY. No puedes cambiar la especificación de partición de una tabla existente.--time_partitioning_expiration: Un número entero que especifica (en segundos) cuándo se debe borrar una partición basada en el tiempo. La hora de vencimiento se evalúa según la suma de la fecha de la partición en formato UTC más el valor del número entero.--time_partitioning_field: La columnaDATEoTIMESTAMPque se usa para crear una tabla particionada. Si la partición basada en el tiempo se habilita sin este valor, se creará una tabla particionada por tiempo de transferencia.--require_partition_filter: Cuando se habilita esta opción, se solicita a los usuarios que incluyan una cláusulaWHEREque especifique las particiones que se desean consultar. Exigir un filtro de partición puede reducir los costos y mejorar el rendimiento. Para obtener más información, lee Consulta tablas particionadas.--clustering_fields: Una lista separada por comas de hasta cuatro nombres de columna que se usa para crear una tabla agrupada en clústeres.--destination_kms_key: Es la clave de Cloud KMS para la encriptación de los datos de la tabla.--column_name_character_map: Define el alcance y el manejo de los caracteres en los nombres de las columnas, con la opción de habilitar nombres de columnas flexibles. Requiere la opción--autodetectpara los archivos CSV. Para obtener más información, consultaload_option_list.Para obtener más información sobre el uso del comando

bq load, consulta:Para obtener más información sobre tablas particionadas, consulta los siguientes artículos:

Para obtener más información sobre tablas agrupadas, consulta el siguiente artículo:

Para obtener más información sobre la encriptación de tablas, consulta el siguiente artículo:

Para cargar datos de CSV en BigQuery, ingresa el siguiente comando:

bq --location=location load \ --source_format=format \ dataset.table \ path_to_source \ schema

Aquí:

- location es tu ubicación. La marca

--locationes opcional. Por ejemplo, si usas BigQuery en la región de Tokio, puedes establecer el valor de la marca comoasia-northeast1. Puedes configurar un valor predeterminado para la ubicación mediante el archivo .bigqueryrc. - format es

CSV. - dataset es un conjunto de datos existente.

- table es el nombre de la tabla en la que cargas datos.

- path_to_source es un URI de Cloud Storage completamente calificado o una lista de URI separados por comas. También se admiten comodines.

- schema es un esquema válido. El esquema puede ser un archivo JSON local o se puede escribir intercalado como parte del comando. También puedes usar la marca

--autodetecten lugar de proporcionar una definición de esquema.

Ejemplos:

El siguiente comando carga datos de gs://mybucket/mydata.csv a una tabla llamada mytable en mydataset. El esquema se define en un archivo de esquema local llamado myschema.json.

bq load \

--source_format=CSV \

mydataset.mytable \

gs://mybucket/mydata.csv \

./myschema.json

El siguiente comando carga datos de gs://mybucket/mydata.csv a una tabla llamada mytable en mydataset. El esquema se define en un archivo de esquema local llamado myschema.json. El archivo CSV incluye dos filas de encabezado.

Si no se especifica --skip_leading_rows, el comportamiento predeterminado es suponer que el archivo no contiene encabezados.

bq load \

--source_format=CSV \

--skip_leading_rows=2

mydataset.mytable \

gs://mybucket/mydata.csv \

./myschema.json

El siguiente comando carga datos de gs://mybucket/mydata.csv a una tabla particionada por tiempo de transferencia llamada mytable en mydataset. El esquema se define en un archivo de esquema local llamado myschema.json.

bq load \

--source_format=CSV \

--time_partitioning_type=DAY \

mydataset.mytable \

gs://mybucket/mydata.csv \

./myschema.json

Con el siguiente comando, se cargan datos de gs://mybucket/mydata.csv en una tabla particionada llamada mytable en mydataset. La tabla está particionada en la columna mytimestamp. El esquema se define en un archivo de esquema local llamado myschema.json.

bq load \

--source_format=CSV \

--time_partitioning_field mytimestamp \

mydataset.mytable \

gs://mybucket/mydata.csv \

./myschema.json

El siguiente comando carga datos de gs://mybucket/mydata.csv a una tabla llamada mytable en mydataset. El esquema se detecta de forma automática.

bq load \

--autodetect \

--source_format=CSV \

mydataset.mytable \

gs://mybucket/mydata.csv

El siguiente comando carga datos de gs://mybucket/mydata.csv a una tabla llamada mytable en mydataset. El esquema se define intercalado en el formato field:data_type,field:data_type.

bq load \

--source_format=CSV \

mydataset.mytable \

gs://mybucket/mydata.csv \

qtr:STRING,sales:FLOAT,year:STRING

El siguiente comando carga datos de varios archivos en gs://mybucket/ en una tabla llamada mytable en mydataset. El URI de Cloud Storage usa un comodín. El esquema se detecta de forma automática.

bq load \

--autodetect \

--source_format=CSV \

mydataset.mytable \

gs://mybucket/mydata*.csv

El siguiente comando carga datos de varios archivos en gs://mybucket/ en una tabla llamada mytable en mydataset. El comando incluye una lista separada por comas de URI de Cloud Storage con comodines. El esquema se define en un archivo de esquema local llamado myschema.json.

bq load \

--source_format=CSV \

mydataset.mytable \

"gs://mybucket/00/*.csv","gs://mybucket/01/*.csv" \

./myschema.json

API

Crea un trabajo

loadque apunte a los datos de origen en Cloud Storage.Especifica tu ubicación en la propiedad

locationde la secciónjobReferencedel recurso de trabajo (opcional).La propiedad

source URIsdebe estar completamente calificada en el formatogs://bucket/object. Cada URI puede contener un carácter comodín “*”.Configura la propiedad

sourceFormatcomoCSVpara especificar el formato de datos de CSV.Para verificar el estado del trabajo, llama a

jobs.get(job_id*). job_id es el ID del trabajo que muestra la solicitud inicial.- Si se muestra

status.state = DONE, el trabajo se completó de forma correcta. - Si la propiedad

status.errorResultestá presente, la solicitud falló y ese objeto incluirá información que describirá qué salió mal. Cuando una solicitud falla, no se crea ninguna tabla ni se cargan datos. - Si

status.errorResultestá ausente, el trabajo se completó con éxito, aunque puede haber algunos errores recuperables, como problemas cuando se importan algunas filas. Se enumeran los errores recuperables en la propiedadstatus.errorsdel objeto de trabajo que se muestra.

- Si se muestra

Notas de API:

Los trabajos de carga son atómicos y coherentes. Es decir, si falla uno, ninguno de los datos estará disponible y si uno se hace con éxito, todos los datos estarán disponibles.

Como práctica recomendada, genera un ID único y pásalo como

jobReference.jobIdcuando llames ajobs.insertpara crear un trabajo de carga. Este enfoque es más resistente al fallo de la red porque el cliente puede sondear o reintentar con el ID de trabajo conocido.Llamar a

jobs.inserten un ID de trabajo determinado es idempotente. Puedes intentar tantas veces como desees en el mismo ID de trabajo y, como máximo, una de esas operaciones tendrá éxito.

C#

Antes de probar este ejemplo, sigue las instrucciones de configuración para C# incluidas en la guía de inicio rápido de BigQuery sobre cómo usar bibliotecas cliente. Para obtener más información, consulta la documentación de referencia de la API de BigQuery para C#.

Para autenticarte en BigQuery, configura las credenciales predeterminadas de la aplicación. Si deseas obtener más información, consulta Configura la autenticación para bibliotecas cliente.

Go

Antes de probar este ejemplo, sigue las instrucciones de configuración para Go incluidas en la guía de inicio rápido de BigQuery sobre cómo usar bibliotecas cliente. Para obtener más información, consulta la documentación de referencia de la API de BigQuery para Go.

Para autenticarte en BigQuery, configura las credenciales predeterminadas de la aplicación. Si deseas obtener más información, consulta Configura la autenticación para bibliotecas cliente.

Java

Antes de probar este ejemplo, sigue las instrucciones de configuración para Java incluidas en la guía de inicio rápido de BigQuery sobre cómo usar bibliotecas cliente. Para obtener más información, consulta la documentación de referencia de la API de BigQuery para Java.

Para autenticarte en BigQuery, configura las credenciales predeterminadas de la aplicación. Si deseas obtener más información, consulta Configura la autenticación para bibliotecas cliente.

Node.js

Antes de probar este ejemplo, sigue las instrucciones de configuración para Node.js incluidas en la guía de inicio rápido de BigQuery sobre cómo usar bibliotecas cliente. Para obtener más información, consulta la documentación de referencia de la API de BigQuery para Node.js.

Para autenticarte en BigQuery, configura las credenciales predeterminadas de la aplicación. Si deseas obtener más información, consulta Configura la autenticación para bibliotecas cliente.

PHP

Antes de probar este ejemplo, sigue las instrucciones de configuración para PHP incluidas en la guía de inicio rápido de BigQuery sobre cómo usar bibliotecas cliente. Para obtener más información, consulta la documentación de referencia de la API de BigQuery para PHP.

Para autenticarte en BigQuery, configura las credenciales predeterminadas de la aplicación. Si deseas obtener más información, consulta Configura la autenticación para bibliotecas cliente.

Python

Antes de probar este ejemplo, sigue las instrucciones de configuración para Python incluidas en la guía de inicio rápido de BigQuery sobre cómo usar bibliotecas cliente. Para obtener más información, consulta la documentación de referencia de la API de BigQuery para Python.

Para autenticarte en BigQuery, configura las credenciales predeterminadas de la aplicación. Si deseas obtener más información, consulta Configura la autenticación para bibliotecas cliente.

Usa el método Client.load_table_from_uri() para cargar datos desde un archivo de CSV a Cloud Storage. Proporciona una definición de esquema explícita. Para ello, define la propiedad LoadJobConfig.schema en una lista de objetos SchemaField.

Ruby

Antes de probar este ejemplo, sigue las instrucciones de configuración para Ruby incluidas en la guía de inicio rápido de BigQuery sobre cómo usar bibliotecas cliente. Para obtener más información, consulta la documentación de referencia de la API de BigQuery para Ruby.

Para autenticarte en BigQuery, configura las credenciales predeterminadas de la aplicación. Si deseas obtener más información, consulta Configura la autenticación para bibliotecas cliente.

Carga datos CSV en una tabla que usa partición de tiempo basada en columnas

Para cargar datos CSV de Cloud Storage en una tabla de BigQuery que usa partición de tiempo basada en columnas, haz lo siguiente:

Go

Antes de probar este ejemplo, sigue las instrucciones de configuración para Go incluidas en la guía de inicio rápido de BigQuery sobre cómo usar bibliotecas cliente. Para obtener más información, consulta la documentación de referencia de la API de BigQuery para Go.

Para autenticarte en BigQuery, configura las credenciales predeterminadas de la aplicación. Si deseas obtener más información, consulta Configura la autenticación para bibliotecas cliente.

Java

Antes de probar este ejemplo, sigue las instrucciones de configuración para Java incluidas en la guía de inicio rápido de BigQuery sobre cómo usar bibliotecas cliente. Para obtener más información, consulta la documentación de referencia de la API de BigQuery para Java.

Para autenticarte en BigQuery, configura las credenciales predeterminadas de la aplicación. Si deseas obtener más información, consulta Configura la autenticación para bibliotecas cliente.

Node.js

Antes de probar este ejemplo, sigue las instrucciones de configuración para Node.js incluidas en la guía de inicio rápido de BigQuery sobre cómo usar bibliotecas cliente. Para obtener más información, consulta la documentación de referencia de la API de BigQuery para Node.js.

Para autenticarte en BigQuery, configura las credenciales predeterminadas de la aplicación. Si deseas obtener más información, consulta Configura la autenticación para bibliotecas cliente.

Python

Antes de probar este ejemplo, sigue las instrucciones de configuración para Python incluidas en la guía de inicio rápido de BigQuery sobre cómo usar bibliotecas cliente. Para obtener más información, consulta la documentación de referencia de la API de BigQuery para Python.

Para autenticarte en BigQuery, configura las credenciales predeterminadas de la aplicación. Si deseas obtener más información, consulta Configura la autenticación para bibliotecas cliente.

Anexa o reemplaza una tabla con datos CSV

Puedes cargar datos adicionales en una tabla desde archivos de origen o cuando adjuntas resultados de consultas.

En la Google Cloud consola, usa la opción Preferencia de escritura para especificar qué acción se debe tomar cuando cargues datos desde un archivo de origen o desde un resultado de consulta.

Cuando cargas datos adicionales en una tabla, tienes las siguientes opciones:

| Opción de Console | Marca de la herramienta de bq | Propiedad de la API de BigQuery | Descripción |

|---|---|---|---|

| Realiza la operación de escritura si la tabla está vacía. | No compatible | WRITE_EMPTY |

Solo escribe los datos si la tabla está vacía. |

| Agregar a la tabla | --noreplace o --replace=false; si no se especifica --[no]replace, la opción predeterminada es agregar |

WRITE_APPEND |

Agrega los datos al final de la tabla (predeterminado). |

| Reemplazar tabla | --replace o --replace=true |

WRITE_TRUNCATE |

Borra todos los datos existentes de una tabla antes de escribir los datos nuevos. Esta acción también borra el esquema de la tabla, la seguridad a nivel de las filas y quita cualquier clave de Cloud KMS. |

Si cargas datos en una tabla existente, el trabajo de carga puede agregar los datos o reemplazar la tabla.

Console

En la consola de Google Cloud , ve a la página BigQuery.

- En el panel de la izquierda, haz clic en Explorar.

- En el panel Explorador, expande tu proyecto, haz clic en Conjuntos de datos y, luego, selecciona un conjunto de datos.

- En la sección Información del conjunto de datos, haz clic en Crear tabla.

- En el panel Crear tabla, especifica los siguientes detalles:

- En la sección Fuente, elige Google Cloud Storage en la lista Crear tabla desde.

A continuación, sigue estos pasos:

- Selecciona un archivo del bucket de Cloud Storage o ingresa el URI de Cloud Storage.

No puedes incluir múltiples URIs en la consola de Google Cloud , pero se admiten comodines. El bucket de Cloud Storage debe estar en la misma ubicación que el conjunto de datos que contiene la tabla que deseas crear, agregar o reemplazar.

- Para Formato del archivo, selecciona CSV.

- Selecciona un archivo del bucket de Cloud Storage o ingresa el URI de Cloud Storage.

No puedes incluir múltiples URIs en la consola de Google Cloud , pero se admiten comodines. El bucket de Cloud Storage debe estar en la misma ubicación que el conjunto de datos que contiene la tabla que deseas crear, agregar o reemplazar.

- En la sección Destino, especifica los siguientes detalles:

- En Conjunto de datos, elige el conjunto de datos en el que deseas crear la tabla.

- En el campo Tabla, escribe el nombre de la tabla que deseas crear.

- Verifica que el campo Tipo de tabla esté configurado como Tabla nativa.

- En la sección Esquema, ingresa la definición del esquema.

Para habilitar la detección automática de un esquema, selecciona Detección automática.

Puedes ingresar la información del esquema de forma manual mediante uno de los siguientes métodos:

- Opción 1: Haz clic en Editar como texto y pega el esquema con el formato de un array JSON. Cuando usas un array JSON, generas el esquema mediante el mismo proceso que se usa para crear un archivo de esquema JSON.

Puedes ver el esquema de una tabla existente en formato JSON si ingresas el siguiente comando:

bq show --format=prettyjson dataset.table

- Opción 2: Haz clic en Agregar campo y, luego, ingresa el esquema de la tabla. Especifica el Nombre, el Tipo y el Modo de cada campo.

- Opción 1: Haz clic en Editar como texto y pega el esquema con el formato de un array JSON. Cuando usas un array JSON, generas el esquema mediante el mismo proceso que se usa para crear un archivo de esquema JSON.

Puedes ver el esquema de una tabla existente en formato JSON si ingresas el siguiente comando:

- Opcional: Especifica Configuración de particiones y clústeres. Para obtener más información, consulta Crea tablas particionadas y Crea y usa tablas agrupadas en clústeres. No puedes agregar datos a una tabla ni reemplazarla para convertirla en una tabla particionada o agrupada en clústeres. La Google Cloud consola no admite agregar datos a tablas particionadas o agrupadas en clústeres ni reemplazarlas en un trabajo de carga.

- Haz clic en Opciones avanzadas y haz lo siguiente:

- En Preferencia de escritura, elige Agregar a la tabla o Reemplazar tabla.

- En Cantidad de errores permitidos, acepta el valor predeterminado de

0o ingresa la cantidad máxima de filas con errores que pueden ignorarse. Si la cantidad de filas con errores excede este valor, el trabajo generará un mensaje deinvalidy fallará. Esta opción se aplica solo a los archivos CSV y JSON. - En Zona horaria, ingresa la zona horaria predeterminada que se aplicará cuando se analicen los valores de marcas de tiempo que no tienen una zona horaria específica. Consulta aquí para ver más nombres de zonas horarias válidos. Si este valor no está presente, los valores de marcas de tiempo sin una zona horaria específica se analizan con la zona horaria predeterminada UTC. (Vista previa)

- En Formato de fecha, ingresa los

elementos de formato que definen cómo se formatean los valores de DATE en los archivos de entrada. Este campo espera el formato de estilos SQL (por ejemplo,

MM/DD/YYYY). Si este valor está presente, este formato es el único formato DATE compatible. La detección automática del esquema también decidirá el tipo de columna DATE según este formato en lugar del formato existente. Si este valor no está presente, el campo DATE se analiza con los formatos predeterminados. (Vista previa) - En Formato de fecha y hora, ingresa los

elementos de formato que definen cómo se formatean los valores de DATETIME en los archivos de entrada.

Este campo espera el formato de estilos SQL (por ejemplo,

MM/DD/YYYY HH24:MI:SS.FF3). Si este valor está presente, este formato es el único formato de FECHA y HORA compatible. La detección automática del esquema también decidirá el tipo de columna DATETIME según este formato en lugar del formato existente. Si este valor no está presente, el campo DATETIME se analiza con los formatos predeterminados. (Vista previa) - En Formato de hora, ingresa los

elementos de formato que definen cómo se formatean los valores de TIME en los archivos de entrada. Este campo espera el formato de estilos SQL (por ejemplo,

HH24:MI:SS.FF3). Si este valor está presente, este formato es el único formato de TIME compatible. La detección automática del esquema también decidirá el tipo de columna TIME según este formato en lugar del formato existente. Si este valor no está presente, el campo TIME se analiza con los formatos predeterminados. (Vista previa) - En Formato de marca de tiempo, ingresa los

elementos de formato que definen cómo se formatean los valores de TIMESTAMP en los archivos de entrada.

Este campo espera el formato de estilos SQL (por ejemplo,

MM/DD/YYYY HH24:MI:SS.FF3). Si este valor está presente, este formato es el único formato TIMESTAMP compatible. La detección automática de esquemas también decidirá el tipo de columna TIMESTAMP según este formato en lugar del formato existente. Si este valor no está presente, el campo TIMESTAMP se analiza con los formatos predeterminados. (Vista previa) - Si deseas ignorar los valores de una fila que no están presentes en el esquema de la tabla, elige Valores desconocidos.

- En Delimitador de campos, elige el carácter que separa las celdas en tu archivo CSV: Coma, Tabulador, Barra vertical o Personalizado. Si eliges Personalizado, debes ingresar el delimitador en la casilla Delimitador de campos personalizado. El valor predeterminado es Coma.

- En Source column match, elige una de las siguientes estrategias que se usan para hacer coincidir las columnas cargadas con el esquema (Preview).

Default: El comportamiento predeterminado se elige según la forma en que se proporciona el esquema. Si la detección automática está habilitada, el comportamiento predeterminado es hacer coincidir las columnas por nombre. De lo contrario, la opción predeterminada es hacer coincidir las columnas por posición. Esto se hace para mantener el comportamiento retrocompatible.Position: Coincide con las columnas por posición, suponiendo que las columnas están ordenadas de la misma manera que el esquema.Name: Coincide por nombre leyendo la fila de encabezado como los nombres de las columnas y reordenando las columnas para que coincidan con los nombres de los campos en el esquema. Los nombres de las columnas se leen de la última fila omitida según Filas del encabezado que se omitirán.- En Filas del encabezado que se omitirán, ingresa la cantidad de filas de encabezado que se omitirán en la parte superior del archivo CSV. El valor predeterminado es

0. - En Saltos de línea en secciones entrecomilladas, marca Permitir saltos de línea en secciones entrecomilladas para permitir secciones de datos entrecomilladas que contengan caracteres de salto de línea en un archivo CSV. El valor predeterminado es

false. - En Filas irregulares, marca Permitir filas irregulares para aceptar filas en archivos CSV a las que les falten columnas opcionales finales. Los valores faltantes se consideran nulos. Si no se marca esta opción, los registros en los que faltan columnas finales se tratan como registros incorrectos y, si hay demasiados, se muestra un error no válido en el resultado del trabajo. El valor predeterminado es

false. - En Marcadores de nulos, ingresa una lista de cadenas personalizadas que representen un valor NULL en los datos CSV. (Vista previa)

- En Encriptación, haz clic en Clave administrada por el cliente para usar una clave de Cloud Key Management Service. Si dejas establecida la configuración Google-managed key, BigQuery encripta los datos en reposo.

- Haz clic en Crear tabla.

SQL

Usa la declaración DDL LOAD DATA.

En el siguiente ejemplo, se agrega un archivo CSV a la tabla mytable:

En la consola de Google Cloud , ve a la página BigQuery.

En el editor de consultas, escribe la siguiente sentencia:

LOAD DATA INTO mydataset.mytable FROM FILES ( format = 'CSV', uris = ['gs://bucket/path/file.csv']);

Haz clic en Ejecutar.

Si deseas obtener información sobre cómo ejecutar consultas, visita Ejecuta una consulta interactiva.

bq

Usa el comando bq load, especifica CSV con la marca --source_format e incluye un URI de Cloud Storage.

Puedes incluir un único URI, una lista de URI separados por comas o un URI que contenga un comodín.

Proporciona el esquema intercalado con un archivo de definición de esquema o usa la detección automática de esquemas. Si no especificas un

esquema y --autodetect es false, y la tabla de destino

existe, se usa el esquema de la tabla de destino.

Especifica la marca --replace para reemplazar la tabla. Usa la marca --noreplace para adjuntar datos a la tabla. Si no se especifica ninguna marca, se agregan datos de manera predeterminada.

Es posible modificar el esquema de la tabla cuando adjuntas datos a ella o la reemplazas. Para obtener más información sobre los cambios de esquema admitidos durante una operación de carga, consulta Modifica esquemas de tablas.

Opcional: Proporciona la marca --location y configura el valor en tu ubicación.

Las siguientes son otras marcas opcionales:

--allow_jagged_rows: Cuando se especifica, se aceptan filas de archivos CSV a las que les faltan columnas opcionales finales. Los valores faltantes se consideran nulos. Si no se marca esta opción, los registros en los que faltan columnas finales se tratan como registros incorrectos y, si hay demasiados, se muestra un error no válido en el resultado del trabajo. El valor predeterminado esfalse.--allow_quoted_newlines: cuando se especifica, permite secciones de datos entrecomillados que contienen caracteres de salto de línea en un archivo CSV. El valor predeterminado esfalse.--field_delimiter: el carácter que indica el límite entre las columnas en los datos.\tytabpueden ser delimitadores de tabulación. El valor predeterminado es,.--null_marker: una string personalizada opcional que representa un valor NULL en los datos de CSV.--null_markers: (Versión preliminar) Es una lista opcional de cadenas personalizadas separadas por comas que representan valores NULL en los datos CSV. Esta opción no se puede usar con la marca--null_marker.--source_column_match: (Vista previa) Especifica la estrategia que se usa para hacer coincidir las columnas cargadas con el esquema. Puedes especificarPOSITIONpara que coincidan las columnas cargadas por posición, suponiendo que las columnas se ordenan de la misma manera que el esquema. También puedes especificarNAMEpara que coincida por nombre leyendo la fila de encabezado como los nombres de las columnas y reordenando las columnas para que coincidan con los nombres de los campos en el esquema. Si no se especifica este valor, el valor predeterminado se basa en la forma en que se proporciona el esquema. Si--autodetectestá habilitado, el comportamiento predeterminado es hacer coincidir las columnas por nombre. De lo contrario, la opción predeterminada es hacer coincidir las columnas por posición.--skip_leading_rows: especifica la cantidad de filas de encabezado que se omiten en la parte superior del archivo CSV. El valor predeterminado es0.--quote: El carácter de comillas que se usará para encerrar registros. El valor predeterminado es". Para indicar que no hay ningún carácter de comilla, usa una string vacía.--max_bad_records: Un número entero que especifica la cantidad máxima de registros incorrectos permitidos antes de que falle todo el trabajo. El valor predeterminado es0. Como máximo, se muestran cinco errores de cualquier tipo, sin importar el valor--max_bad_records.--ignore_unknown_values: Cuando se especifica, permite y también ignora valores extras no reconocidos en datos CSV o JSON.--time_zone: (Vista previa) Es una zona horaria predeterminada opcional que se aplicará cuando se analicen valores de marcas de tiempo que no tengan una zona horaria específica en los datos CSV o JSON.--date_format: (Vista previa) Es una cadena personalizada opcional que define el formato de los valores DATE en los datos CSV o JSON.--datetime_format: (Vista previa) Es una cadena personalizada opcional que define cómo se formatean los valores de DATETIME en los datos de CSV o JSON.--time_format: (Versión preliminar) Es una cadena personalizada opcional que define cómo se formatean los valores de TIME en los datos CSV o JSON.--timestamp_format: (Versión preliminar) Es una cadena personalizada opcional que define el formato de los valores TIMESTAMP en los datos CSV o JSON.--autodetect: Cuando se especifica, se habilita la detección automática de esquemas para los datos de formato CSV y JSON.--destination_kms_key: Es la clave de Cloud KMS para la encriptación de los datos de la tabla.

bq --location=location load \ --[no]replace \ --source_format=format \ dataset.table \ path_to_source \ schema

aquí:

- location es tu ubicación.

La marca

--locationes opcional. Puedes configurar un valor predeterminado para la ubicación con el archivo .bigqueryrc. - format es

CSV. - dataset es un conjunto de datos existente.

- table es el nombre de la tabla en la que cargas datos.

- path_to_source es un URI de Cloud Storage completamente calificado o una lista de URI separados por comas. También se admiten comodines.

- schema es un esquema válido. El esquema puede ser un archivo JSON local o se puede escribir intercalado como parte del comando. También puedes usar la marca

--autodetecten lugar de proporcionar una definición de esquema.

Ejemplos:

Con el siguiente comando, se cargan datos de gs://mybucket/mydata.csv y se reemplazan los datos de una tabla llamada mytable en mydataset. El esquema se define mediante la detección automática de esquemas.

bq load \

--autodetect \

--replace \

--source_format=CSV \

mydataset.mytable \

gs://mybucket/mydata.csv

Con el siguiente comando, se cargan datos de gs://mybucket/mydata.csv y se adjuntan datos a una tabla llamada mytable en mydataset. El esquema se define mediante un archivo de esquema JSON: myschema.json.

bq load \

--noreplace \

--source_format=CSV \

mydataset.mytable \

gs://mybucket/mydata.csv \

./myschema.json

API

Crea un trabajo

loadque apunte a los datos de origen en Cloud Storage.Especifica tu ubicación en la propiedad

locationde la secciónjobReferencedel recurso de trabajo (opcional).La propiedad

source URIsdebe estar completamente calificada en el formatogs://bucket/object. Puedes incluir varios URI en una lista separada por comas. Ten en cuenta que también se admiten comodines.Para especificar el formato de los datos, establece la propiedad

configuration.load.sourceFormatenCSV.Para especificar la preferencia de escritura, establece la propiedad

configuration.load.writeDispositionenWRITE_TRUNCATEoWRITE_APPEND.

Go

Antes de probar este ejemplo, sigue las instrucciones de configuración para Go incluidas en la guía de inicio rápido de BigQuery sobre cómo usar bibliotecas cliente. Para obtener más información, consulta la documentación de referencia de la API de BigQuery para Go.

Para autenticarte en BigQuery, configura las credenciales predeterminadas de la aplicación. Si deseas obtener más información, consulta Configura la autenticación para bibliotecas cliente.

Java

Antes de probar este ejemplo, sigue las instrucciones de configuración para Java incluidas en la guía de inicio rápido de BigQuery sobre cómo usar bibliotecas cliente. Para obtener más información, consulta la documentación de referencia de la API de BigQuery para Java.

Para autenticarte en BigQuery, configura las credenciales predeterminadas de la aplicación. Si deseas obtener más información, consulta Configura la autenticación para bibliotecas cliente.

Node.js

Antes de probar este ejemplo, sigue las instrucciones de configuración para Node.js incluidas en la guía de inicio rápido de BigQuery sobre cómo usar bibliotecas cliente. Para obtener más información, consulta la documentación de referencia de la API de BigQuery para Node.js.

Para autenticarte en BigQuery, configura las credenciales predeterminadas de la aplicación. Si deseas obtener más información, consulta Configura la autenticación para bibliotecas cliente.

Para reemplazar las filas en una tabla existente, establece el valor writeDisposition en el parámetro metadata en 'WRITE_TRUNCATE'.

Antes de probar este ejemplo, sigue las instrucciones de configuración para PHP incluidas en la guía de inicio rápido de BigQuery sobre cómo usar bibliotecas cliente. Para obtener más información, consulta la documentación de referencia de la API de BigQuery para PHP.

Para autenticarte en BigQuery, configura las credenciales predeterminadas de la aplicación. Si deseas obtener más información, consulta Configura la autenticación para bibliotecas cliente.

Python

Antes de probar este ejemplo, sigue las instrucciones de configuración para Python incluidas en la guía de inicio rápido de BigQuery sobre cómo usar bibliotecas cliente. Para obtener más información, consulta la documentación de referencia de la API de BigQuery para Python.

Para autenticarte en BigQuery, configura las credenciales predeterminadas de la aplicación. Si deseas obtener más información, consulta Configura la autenticación para bibliotecas cliente.

Para reemplazar las filas de una tabla existente, configura la propiedad LoadJobConfig.write_disposition como la constante WRITE_TRUNCATE de SourceFormat.

Carga datos CSV con particiones de subárbol

BigQuery admite la carga de datos de CSV con particiones de subárbol almacenados en Cloud Storage y propagará las columnas de partición de subárbol como columnas en la tabla administrada de BigQuery de destino. Para obtener más información, consulta Carga datos particionados de forma externa de Cloud Storage.

Detalles de la carga de datos de CSV

En esta sección, se describe cómo BigQuery maneja varias opciones de formato CSV.

Codificación

BigQuery espera que los datos CSV estén codificados en UTF-8. Si tienes archivos CSV con otros tipos de codificación compatibles, debes especificar la codificación de forma explícita para que BigQuery pueda convertir los datos en UTF-8 de manera correcta.

BigQuery es compatible con los siguientes tipos de codificación para los archivos CSV:

- UTF-8

- ISO-8859-1

- UTF-16BE (UTF-16 Big Endian)

- UTF-16LE (UTF-16 Little Endian)

- UTF-32BE (UTF-32 Big Endian)

- UTF-32LE (UTF-32 Little Endian)

Si no especificas una codificación o si especificas la codificación UTF-8 cuando el archivo CSV no está codificado en UTF-8, BigQuery intentará convertir los datos en UTF-8. Por lo general, si el archivo CSV está codificado en ISO-8859-1, los datos se cargarán con éxito, pero es posible que no coincidan exactamente con lo que esperas. Si el archivo CSV está codificado en UTF-16BE, UTF-16LE, UTF-32BE o UTF-32LE, es posible que la carga falle.

Para evitar fallas inesperadas, especifica la codificación correcta con la marca --encoding.

Si BigQuery no puede convertir un carácter que no sea el carácter ASCII 0, BigQuery convierte el carácter en el carácter de reemplazo estándar de Unicode: �.

Delimitadores de campo

Los delimitadores en archivos CSV pueden ser cualquier carácter de un solo byte. Si el archivo de origen usa la codificación ISO-8859-1, cualquier carácter puede ser un delimitador. Si el archivo de origen usa la codificación UTF-8, se puede usar cualquier carácter en el rango decimal 1-127 (U+0001-U+007F) sin modificaciones. Puedes insertar un carácter ISO-8859-1 fuera de este rango como delimitador y BigQuery lo interpretará de forma correcta. Sin embargo, si usas un carácter de varios bytes como delimitador, algunos de los bytes se interpretarán de manera incorrecta como parte del valor del campo.

Por lo general, se recomienda usar un delimitador estándar, como una tabulación, una barra vertical o una coma. El valor predeterminado es una coma.

Tipos de datos

Booleano. BigQuery puede analizar cualquiera de los siguientes pares para datos booleanos: 1 o 0, true o false, t o f, yes o no, y o n (todos distinguen entre mayúsculas y minúsculas). La detección automática de esquemas detecta de forma automática cualquiera de estas opciones, excepto 0 y 1.Bytes. Las columnas con tipos BYTES deben codificarse como Base64.

Fecha. Las columnas con tipos DATE deben tener el formato YYYY-MM-DD.

Fecha y hora. Las columnas con tipos DATETIME deben tener el formato YYYY-MM-DD

HH:MM:SS[.SSSSSS].

Geográficos. Las columnas con tipos GEOGRAPHY deben contener strings en uno de los siguientes formatos:

- Texto conocido (WKT)

- Objeto binario conocido (WKB)

- GeoJSON

Si usas WKB, el valor debe estar codificado en hexadecimal.

En la siguiente lista, se muestran ejemplos de datos válidos:

- WKT:

POINT(1 2) - GeoJSON:

{ "type": "Point", "coordinates": [1, 2] } - WKB codificado en hexadecimal:

0101000000feffffffffffef3f0000000000000040

Antes de cargar datos de GEOGRAPHY, también consulta Carga datos geoespaciales.

Intervalo. Las columnas con tipos INTERVAL deben tener el formato Y-M D H:M:S[.F], en el que:

- Y = Año. El rango admitido es de 0 a 10,000.

- M = Mes. El rango admitido es de 1 a 12.

- D = Día. El rango admitido es de 1 a [último día del mes indicado].

- H = Hora.

- M = Minuto.

- S = Segundo.

- [.F] = Fracciones de un segundo hasta seis dígitos, con precisión de microsegundos.

Puedes indicar un valor negativo si antepones un guion (-).

En la siguiente lista, se muestran ejemplos de datos válidos:

10-6 0 0:0:00-0 -5 0:0:00-0 0 0:0:1.25

Para cargar datos de INTERVAL, debes usar el comando bq load y la marca --schema a fin de especificar un esquema. No puedes subir datos de INTERVAL mediante la consola.

JSON. Las comillas se evitan mediante la secuencia de dos caracteres "". Para obtener más información, consulta un ejemplo en la página sobre cómo cargar datos JSON desde un archivo CSV.

Hora. Las columnas con tipos TIME deben tener el formato HH:MM:SS[.SSSSSS].

Timestamp. BigQuery acepta varios formatos de marca de tiempo. La marca de tiempo debe incluir una parte de la fecha y una de la hora.

La parte de la fecha puede tener el formato

YYYY-MM-DDoYYYY/MM/DD.La parte de la marca de tiempo debe tener el formato

HH:MM[:SS[.SSSSSS]](los segundos y las fracciones de segundos son opcionales).La fecha y la hora deben estar separadas por un espacio o “T”.

De forma opcional, la fecha y la hora pueden estar seguidas por una compensación UTC o el designador de zona UTC (

Z). Para obtener más información, consulta Zonas horarias.

Por ejemplo, cualquiera de los siguientes son valores de marca de tiempo válidos:

- 2018-08-19 12:11

- 2018-08-19 12:11:35

- 2018-08-19 12:11:35.22

- 2018/08/19 12:11

- 2018-07-05 12:54:00 UTC

- 2018-08-19 07:11:35.220 -05:00

- 2018-08-19T12:11:35.220Z

Si proporcionas un esquema, BigQuery también acepta el tiempo Unix para los valores de marca de tiempo. Sin embargo, la detección automática de esquemas no detecta este caso y trata el valor como un tipo numérico o de string.

Ejemplos de valores de marca de tiempo de hora de Unix:

- 1534680695

- 1.534680695e12

RANGO. Se representa en archivos CSV en el formato [LOWER_BOUND, UPPER_BOUND), en el que LOWER_BOUND y UPPER_BOUND son cadenas DATE, DATETIME o TIMESTAMP válidas. NULL y UNBOUNDED representan valores de inicio o finalización no delimitados.

Los siguientes son ejemplos de valores CSV para RANGE<DATE>:

"[2020-01-01, 2021-01-01)""[UNBOUNDED, 2021-01-01)""[2020-03-01, NULL)""[UNBOUNDED, UNBOUNDED)"

Detección automática de esquemas

En esta sección, se describe el comportamiento de la detección automática de esquema cuando se cargan archivos CSV.

Delimitador CSV

BigQuery detecta los siguientes delimitadores:

- coma ( , )

- barra vertical ( | )

- tabulador ( \t )

Encabezado CSV

BigQuery infiere los encabezados mediante la comparación de la primera fila del archivo con otras filas en el archivo. Si la primera línea solo contiene cadenas y las otras contienen otros tipos de datos, BigQuery supone que la primera fila es una fila de encabezado. BigQuery asigna nombres de columnas según los nombres de campo en la fila del encabezado. Los nombres pueden modificarse a fin de cumplir con las reglas de nomenclatura para las columnas en BigQuery. Por ejemplo, los espacios se reemplazarán con guiones bajos.

De lo contrario, BigQuery supone que la primera fila es una fila de datos y asigna nombres de columnas genéricos como string_field_1. Ten en cuenta que, después de que se crea una tabla, los nombres de las columnas no se pueden actualizar en el esquema, pero puedes cambiar los nombres de forma manual después de que se crea la tabla. Otra opción es proporcionar un esquema explícito, en lugar de usar la detección automática.

Es posible que tengas un archivo CSV con una fila de encabezado, en la que todos los campos de datos sean strings. En ese caso, BigQuery no detectará de manera automática que la primera fila es un encabezado. Usa la opción --skip_leading_rows para omitir la fila de encabezado. De lo contrario, el encabezado se importará como datos. También considera proporcionar un esquema explícito en este caso para que puedas asignar nombres de columnas.

Saltos de línea con comillas en CSV

BigQuery detecta los caracteres de línea nueva con comillas dentro de un campo CSV y no interpreta el carácter con comillas de la línea nueva como un límite de fila.

Soluciona errores de análisis

Si hay un problema cuando se analizan tus archivos CSV, el recurso errors del trabajo de carga se propaga con los detalles del error.

En general, estos errores identifican el inicio de la línea problemática con un desplazamiento de bytes. Para los archivos sin comprimir, puedes usar gcloud storage con el argumento --recursive así puedes acceder a la línea relevante.

Por ejemplo, ejecuta el comando bq load y recibe un error:

bq load

--skip_leading_rows=1 \

--source_format=CSV \

mydataset.mytable \

gs://my-bucket/mytable.csv \

'Number:INTEGER,Name:STRING,TookOffice:STRING,LeftOffice:STRING,Party:STRING'

El error en el resultado es similar al siguiente:

Waiting on bqjob_r5268069f5f49c9bf_0000018632e903d7_1 ... (0s)

Current status: DONE

BigQuery error in load operation: Error processing job

'myproject:bqjob_r5268069f5f49c9bf_0000018632e903d7_1': Error while reading

data, error message: Error detected while parsing row starting at position: 1405.

Error: Data between close quote character (") and field separator.

File: gs://my-bucket/mytable.csv

Failure details:

- gs://my-bucket/mytable.csv: Error while reading data,

error message: Error detected while parsing row starting at

position: 1405. Error: Data between close quote character (") and

field separator. File: gs://my-bucket/mytable.csv

- Error while reading data, error message: CSV processing encountered

too many errors, giving up. Rows: 22; errors: 1; max bad: 0; error

percent: 0

Según el error anterior, hay un error de formato en el archivo.

Para ver el contenido del archivo, ejecuta el comando gcloud storage cat:

gcloud storage cat 1405-1505 gs://my-bucket/mytable.csv --recursive

El resultado es similar a este:

16,Abraham Lincoln,"March 4, 1861","April 15, "1865,Republican 18,Ulysses S. Grant,"March 4, 1869", ...

Según el resultado del archivo, el problema es una cita mal ubicada en "April 15, "1865.

Archivos CSV comprimidos

La depuración de los errores de análisis es más difícil para los archivos CSV comprimidos, ya que el desplazamiento de bytes informado se refiere a la ubicación en el archivo sin comprimir.

En el siguiente comando gcloud storage cat se transmite el archivo desde Cloud Storage, descomprime el archivo, identifica el desplazamiento de bytes adecuado y, luego, imprime la línea con el error de formato:

gcloud storage cat gs://my-bucket/mytable.csv.gz | gunzip - | tail -c +1406 | head -n 1

El resultado es similar a este:

16,Abraham Lincoln,"March 4, 1861","April 15, "1865,Republican

Opciones de CSV

Para cambiar la forma en que BigQuery analiza los datos de CSV, especifica opciones adicionales en la Google Cloud consola, la herramienta de línea de comandos de bq o la API.

Para obtener más información sobre el formato CSV, consulta RFC 4180.

| Opción CSV | Opción de Console | Marca de la herramienta de bq | Propiedad de la API de BigQuery | Descripción |

|---|---|---|---|---|

| Delimitador de campos | Delimitador de campos: coma, tabulador, barra vertical, o uno personalizado | -F o --field_delimiter. |

fieldDelimiter

(Java,

Python)

|

El separador de campos de un archivo CSV (opcional). El separador puede ser cualquier carácter ISO-8859-1 de un solo byte. BigQuery convierte la string en codificación ISO-8859-1 y usa el primer byte de la string codificada para dividir los datos en su estado binario sin procesar. BigQuery también admite la secuencia de escape “\t” para especificar un separador de tabulador. El valor predeterminado es una coma (“,”). |

| Filas del encabezado | Filas del encabezado que se omitirán | --skip_leading_rows |

skipLeadingRows

(Java,

Python)

|

Un número entero que indica la cantidad de filas de encabezado en los datos de origen (opcional). |

| Coincidencia de columna de origen | Coincidencia de columna de origen: Predeterminada, Posición, Nombre | --source_column_match |

Ninguno | (Vista previa) (Opcional) Este parámetro controla la estrategia que se usa para hacer coincidir las columnas cargadas con el esquema.

Entre los valores admitidos, se incluyen los siguientes:

|

| Cantidad de registros incorrectos permitidos | Cantidad de errores permitidos | --max_bad_records |

maxBadRecords

(Java,

Python)

|

El número máximo de registros erróneos que BigQuery puede ignorar cuando ejecuta el trabajo (opcional). Si la cantidad de registros incorrectos excede este valor, se muestra un error no válido en el resultado del trabajo. El valor predeterminado es 0, por lo que es obligatorio que todos los registros sean válidos. |

| Caracteres de saltos de línea | Permitir saltos de línea en secciones entrecomilladas | --allow_quoted_newlines |

allowQuotedNewlines

(Java,

Python)

|

Indica si se deben permitir las secciones de datos entrecomillados que contienen caracteres de saltos de línea en un archivo CSV (opcional). El valor predeterminado es falso. |

| Valores nulos personalizados | Ninguno | --null_marker |

nullMarker

(Java,

Python)

|

Especifica una string que representa un valor nulo en un archivo CSV (opcional). Por ejemplo, si especificas “\N”, BigQuery interpreta “\N” como un valor nulo cuando se carga un archivo CSV. El valor predeterminado es una string vacía. Si estableces esta propiedad como un valor personalizado, BigQuery muestra un error si hay una string vacía para todos los tipos de datos, excepto STRING y BYTE. Para las columnas STRING y BYTE, BigQuery interpreta la string vacía como un valor vacío. |

| Columnas opcionales finales | Permitir filas irregulares | --allow_jagged_rows |

allowJaggedRows

(Java,

Python)

|

Acepta las filas que no contienen columnas opcionales finales (opcional). Los valores que faltan se consideran nulos. Si es falso, los registros en los que faltan columnas finales se tratan como registros incorrectos, y si hay demasiados, se muestra un error no válido en el resultado del trabajo. El valor predeterminado es falso. Aplica solo a CSV, se ignora para otros formatos. |

| Valores desconocidos | Ignorar valores desconocidos | --ignore_unknown_values |

ignoreUnknownValues

(Java,

Python)

|

Indica si BigQuery debe permitir valores adicionales que no estén representados en el esquema de la tabla (opcional). Si es verdadero, los valores adicionales se ignoran. Si es falso, los registros con columnas adicionales se tratan como registros incorrectos, y si hay demasiados, se muestra un error no válido en el resultado del trabajo. El valor predeterminado es falso. Con la propiedad sourceFormat, se determina qué es lo que BigQuery trata como un valor adicional:

|

| Cotización | Carácter de comilla: Comillas dobles, Comillas simples, Ninguna, Personalizada | --quote |

quote

(Java,

Python)

|

El valor que se usa para entrecomillar secciones de datos en un archivo CSV (opcional).

BigQuery convierte la string en codificación ISO-8859-1 y, luego, usa el primer byte de la string codificada para dividir los datos en su estado binario sin procesar. El valor predeterminado es una comilla doble (“”). Si tus datos no contienen secciones entrecomilladas, establece el valor de la propiedad en una string vacía. Si los datos contienen caracteres de salto de línea entrecomillados, también debes establecer la propiedad allowQuotedNewlines en true. Para incluir el carácter de comillas específico dentro de un valor entrecomillado, coloca un carácter de comillas que coincida antes de él. Por ejemplo, si deseas escapar del carácter predeterminado ‘ " ’, usa ‘ "" ’. |

| Codificación | Ninguno | -E o --encoding. |

encoding

(Java,

Python) |

La codificación de caracteres de los datos (opcional). Los valores admitidos son UTF-8, ISO-8859-1, UTF-16BE, UTF-16LE, UTF-32BE o UTF-32LE.

El valor predeterminado es UTF-8. BigQuery decodifica los datos luego de la división de los datos binarios sin procesar mediante los valores de las propiedades quote y fieldDelimiter. |

| Carácter de control ASCII | Ninguno | --preserve_ascii_control_characters |

Ninguno | Si deseas permitir ASCII 0 y otros caracteres de control ASCII, configura --preserve_ascii_control_characters como true en tus trabajos de carga (opcional). |

| Marcadores nulos | Marcadores nulos | --null_markers |

Ninguno | (Vista previa) (opcional)

Es una lista de cadenas personalizadas que representan un valor NULL en los datos

de CSV. Esta opción no se puede usar con la opción --null_marker. |

| Zona horaria | Zona horaria | --time_zone |

Ninguno | (Vista previa) (opcional) Zona horaria predeterminada que se aplicará cuando se analicen los valores de marcas de tiempo que no tienen una zona horaria específica. Consulta los nombres de zonas horarias válidos. Si este valor no está presente, los valores de marcas de tiempo sin una zona horaria específica se analizan con la zona horaria predeterminada UTC. |

| Formato de fecha | Formato de fecha | --date_format |

Ninguno | (Vista previa) (opcional)

Elementos de formato

que definen cómo se formatean los valores de DATE en los archivos de entrada (por ejemplo, MM/DD/YYYY). Si este valor está presente, este formato es el único formato de DATE compatible.

La autodetección de esquemas también decidirá el tipo de columna DATE según este formato en lugar del formato existente. Si este valor no está presente, el campo DATE se analiza con los formatos predeterminados. |

| Formato de fecha y hora | Formato de fecha y hora | --datetime_format |

Ninguno | (Vista previa) (opcional)

Elementos de formato

que definen cómo se formatean los valores de DATETIME en los archivos de entrada (por

ejemplo, MM/DD/YYYY HH24:MI:SS.FF3). Si este valor está presente,

este formato es el único formato de DATETIME compatible.

La detección automática del esquema también decidirá el tipo de columna DATETIME según este formato en lugar del formato existente. Si este valor no está presente, el campo DATETIME se analiza con los formatos predeterminados. |

| Formato de hora | Formato de hora | --time_format |

Ninguno | (Versión preliminar) (opcional)

Elementos de formato

que definen cómo se formatean los valores de TIME en los archivos de entrada (por

ejemplo, HH24:MI:SS.FF3). Si este valor está presente, este formato

es el único formato de TIME compatible.

La autodetección de esquemas también decidirá el tipo de columna TIME según este formato en lugar del formato existente. Si este valor no está presente, el campo TIME se analiza con los formatos predeterminados. |

| Formato de marca de tiempo | Formato de marca de tiempo | --timestamp_format |

Ninguno | (Vista previa) (opcional)

Elementos de formato

que definen cómo se formatean los valores de TIMESTAMP en los archivos de entrada (por ejemplo, MM/DD/YYYY HH24:MI:SS.FF3). Si este valor está presente,

este formato es el único formato de TIMESTAMP compatible.

La detección automática del esquema también decidirá el tipo de columna TIMESTAMP según este formato en lugar del formato existente. Si este valor no está presente, el campo TIMESTAMP se analiza con los formatos predeterminados. |