ML.GENERATE_TEXT 함수를 사용하여 텍스트 생성

이 문서에서는 Vertex AI 모델을 나타내는 BigQuery ML 원격 모델을 만든 후 이 원격 모델을 ML.GENERATE_TEXT 함수와 함께 사용하여 텍스트를 생성하는 방법을 설명합니다.

지원되는 원격 모델 유형은 다음과 같습니다.

- 정식 버전 또는 프리뷰 Gemini 모델을 사용하는 원격 모델

- Anthropic Claude 모델을 통한 원격 모델

- Llama 모델을 통한 원격 모델

- Mistral AI 모델을 통한 원격 모델

- 지원되는 개방형 모델을 통한 원격 모델

선택한 Vertex AI 모델에 따라 객체 테이블의 비정형 데이터 입력 또는 표준 테이블의 텍스트 입력을 기반으로 텍스트를 생성할 수 있습니다.

필요한 역할

원격 모델을 만들고 텍스트를 생성하려면 다음 Identity and Access Management (IAM) 역할이 필요합니다.

- BigQuery 데이터 세트, 테이블, 모델을 만들고 사용하기: 프로젝트에 대한 BigQuery 데이터 편집자(

roles/bigquery.dataEditor) BigQuery 연결을 만들고, 위임하고, 사용하기: 프로젝트에 대한 BigQuery 연결 관리자(

roles/bigquery.connectionsAdmin)구성된 기본 연결이 없는 경우

CREATE MODEL문을 실행하는 과정에서 연결을 만들고 설정할 수 있습니다. 이렇게 하려면 프로젝트에 BigQuery 관리자(roles/bigquery.admin)가 있어야 합니다. 자세한 내용은 기본 연결 구성을 참조하세요.연결의 서비스 계정에 권한 부여: Vertex AI 엔드포인트가 포함된 프로젝트에 대한 프로젝트 IAM 관리자(

roles/resourcemanager.projectIamAdmin). 이는 모델 이름을 엔드포인트로 지정하여 만드는 원격 모델의 현재 프로젝트입니다. 이는 엔드포인트로 URL을 지정하여 만드는 원격 모델의 URL에서 식별되는 프로젝트입니다.원격 모델을 사용하여 객체 테이블의 비정형 데이터를 분석하고 객체 테이블에서 사용하는 Cloud Storage 버킷이 Vertex AI 엔드포인트와 다른 프로젝트에 있는 경우 객체 테이블에서 사용하는 Cloud Storage 버킷에 대한 스토리지 관리자(

roles/storage.admin) 권한도 있어야 합니다.BigQuery 작업 만들기: 프로젝트에 대한 BigQuery 작업 사용자(

roles/bigquery.jobUser)

이러한 사전 정의된 역할에는 이 문서의 작업을 수행하는 데 필요한 권한이 포함되어 있습니다. 필요한 정확한 권한을 보려면 필수 권한 섹션을 확장하세요.

필수 권한

- 데이터 세트 만들기:

bigquery.datasets.create - 연결을 만들고, 위임하고, 사용하기:

bigquery.connections.* - 서비스 계정 권한 설정:

resourcemanager.projects.getIamPolicy및resourcemanager.projects.setIamPolicy - 모델을 만들고 추론을 실행하기:

bigquery.jobs.createbigquery.models.createbigquery.models.getDatabigquery.models.updateDatabigquery.models.updateMetadata

커스텀 역할이나 다른 사전 정의된 역할을 사용하여 이 권한을 부여받을 수도 있습니다.

시작하기 전에

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

-

Enable the BigQuery, BigQuery Connection, and Vertex AI APIs.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles.

데이터 세트 만들기

리소스를 포함할 BigQuery 데이터 세트를 만듭니다.

콘솔

Google Cloud 콘솔에서 BigQuery 페이지로 이동합니다.

왼쪽 창에서 탐색기를 클릭합니다.

왼쪽 창이 표시되지 않으면 왼쪽 창 펼치기를 클릭하여 창을 엽니다.

탐색기 창에서 프로젝트 이름을 클릭합니다.

작업 보기 > 데이터 세트 만들기를 클릭합니다.

데이터 세트 만들기 페이지에서 다음을 수행합니다.

데이터 세트 ID에 데이터 세트 이름을 입력합니다.

위치 유형으로 리전 또는 멀티 리전을 선택합니다.

- 리전을 선택한 경우 리전 목록에서 위치를 선택합니다.

- 멀티 리전을 선택한 경우 멀티 리전 목록에서 미국 또는 유럽을 선택합니다.

데이터 세트 만들기를 클릭합니다.

bq

연결 만들기

기본 연결이 구성되어 있거나 BigQuery 관리자 역할이 있는 경우 이 단계를 건너뛸 수 있습니다.

원격 모델이 사용할 클라우드 리소스 연결을 만들고 연결의 서비스 계정을 가져옵니다. 이전 단계에서 만든 데이터 세트와 동일한 위치에 연결을 만듭니다.

다음 옵션 중 하나를 선택합니다.

콘솔

BigQuery 페이지로 이동합니다.

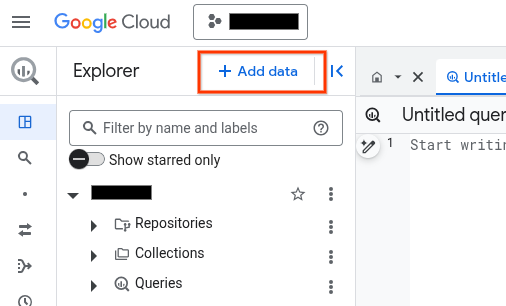

탐색기 창에서 데이터 추가를 클릭합니다.

데이터 추가 대화상자가 열립니다.

필터링 기준 창의 데이터 소스 유형 섹션에서 비즈니스 애플리케이션을 선택합니다.

또는 데이터 소스 검색 필드에

Vertex AI을 입력할 수 있습니다.추천 데이터 소스 섹션에서 Vertex AI를 클릭합니다.

Vertex AI 모델: BigQuery 제휴 솔루션 카드를 클릭합니다.

연결 유형 목록에서 Vertex AI 원격 모델, 원격 함수, BigLake, Spanner (Cloud 리소스)를 선택합니다.

연결 ID 필드에 연결 이름을 입력합니다.

연결 만들기를 클릭합니다.

연결로 이동을 클릭합니다.

연결 정보 창에서 나중의 단계에 사용할 서비스 계정 ID를 복사합니다.

bq

명령줄 환경에서 연결을 만듭니다.

bq mk --connection --location=REGION --project_id=PROJECT_ID \ --connection_type=CLOUD_RESOURCE CONNECTION_ID

--project_id매개변수는 기본 프로젝트를 재정의합니다.다음을 바꿉니다.

REGION: 연결 리전PROJECT_ID: Google Cloud 프로젝트 IDCONNECTION_ID: 연결의 ID

연결 리소스를 만들면 BigQuery가 고유한 시스템 서비스 계정을 만들고 이를 연결에 연계합니다.

문제 해결: 다음 연결 오류가 발생하면 Google Cloud SDK를 업데이트하세요.

Flags parsing error: flag --connection_type=CLOUD_RESOURCE: value should be one of...

이후 단계에서 사용할 수 있도록 서비스 계정 ID를 가져와 복사합니다.

bq show --connection PROJECT_ID.REGION.CONNECTION_ID

출력은 다음과 유사합니다.

name properties 1234.REGION.CONNECTION_ID {"serviceAccountId": "connection-1234-9u56h9@gcp-sa-bigquery-condel.iam.gserviceaccount.com"}

Terraform

google_bigquery_connection 리소스를 사용합니다.

BigQuery에 인증하려면 애플리케이션 기본 사용자 인증 정보를 설정합니다. 자세한 내용은 클라이언트 라이브러리의 인증 설정을 참조하세요.

다음 예시에서는 US 리전에 my_cloud_resource_connection이라는 Cloud 리소스 연결을 만듭니다.

Google Cloud 프로젝트에 Terraform 구성을 적용하려면 다음 섹션의 단계를 완료하세요.

Cloud Shell 준비

- Cloud Shell을 실행합니다.

-

Terraform 구성을 적용할 기본 Google Cloud 프로젝트를 설정합니다.

이 명령어는 프로젝트당 한 번만 실행하면 되며 어떤 디렉터리에서도 실행할 수 있습니다.

export GOOGLE_CLOUD_PROJECT=PROJECT_ID

Terraform 구성 파일에서 명시적 값을 설정하면 환경 변수가 재정의됩니다.

디렉터리 준비

각 Terraform 구성 파일에는 자체 디렉터리(루트 모듈이라고도 함)가 있어야 합니다.

-

Cloud Shell에서 디렉터리를 만들고 해당 디렉터리 내에 새 파일을 만드세요. 파일 이름에는

.tf확장자가 있어야 합니다(예:main.tf). 이 튜토리얼에서는 파일을main.tf라고 합니다.mkdir DIRECTORY && cd DIRECTORY && touch main.tf

-

튜토리얼을 따라 하는 경우 각 섹션이나 단계에서 샘플 코드를 복사할 수 있습니다.

샘플 코드를 새로 만든

main.tf에 복사합니다.필요한 경우 GitHub에서 코드를 복사합니다. 이는 Terraform 스니펫이 엔드 투 엔드 솔루션의 일부인 경우에 권장됩니다.

- 환경에 적용할 샘플 파라미터를 검토하고 수정합니다.

- 변경사항을 저장합니다.

-

Terraform을 초기화합니다. 이 작업은 디렉터리당 한 번만 수행하면 됩니다.

terraform init

원하는 경우 최신 Google 공급업체 버전을 사용하려면

-upgrade옵션을 포함합니다.terraform init -upgrade

변경사항 적용

-

구성을 검토하고 Terraform에서 만들거나 업데이트할 리소스가 예상과 일치하는지 확인합니다.

terraform plan

필요에 따라 구성을 수정합니다.

-

다음 명령어를 실행하고 프롬프트에

yes를 입력하여 Terraform 구성을 적용합니다.terraform apply

Terraform에 '적용 완료' 메시지가 표시될 때까지 기다립니다.

- 결과를 보려면 Google Cloud 프로젝트를 엽니다. Google Cloud 콘솔에서 UI의 리소스로 이동하여 Terraform이 리소스를 만들었거나 업데이트했는지 확인합니다.

원격 모델 연결의 서비스 계정에 역할 부여

원격 모델이 사용하는 연결의 서비스 계정에 Vertex AI 사용자 역할을 부여해야 합니다.

원격 모델의 엔드포인트를 URL(예: endpoint = 'https://us-central1-aiplatform.googleapis.com/v1/projects/myproject/locations/us-central1/publishers/google/models/gemini-2.0-flash')로 지정할 계획이라면 URL에 지정한 동일한 프로젝트에서 이 역할을 부여합니다.

모델 이름을 사용(예: endpoint = 'gemini-2.0-flash')하여 원격 모델의 엔드포인트를 지정할 계획이라면 원격 모델을 만들려는 동일한 프로젝트에서 이 역할을 부여합니다.

다른 프로젝트에서 역할을 부여하면 bqcx-1234567890-wxyz@gcp-sa-bigquery-condel.iam.gserviceaccount.com does not have the permission to access resource 오류가 발생합니다.

Vertex AI 사용자 역할을 부여하려면 다음 단계를 따르세요.

콘솔

IAM 및 관리자 페이지로 이동합니다.

추가를 클릭합니다.

주 구성원 추가 대화상자가 열립니다.

새 주 구성원 필드에 앞에서 복사한 서비스 계정 ID를 입력합니다.

역할 선택 필드에서 Vertex AI를 선택한 후 Vertex AI 사용자를 선택합니다.

저장을 클릭합니다.

gcloud

gcloud projects add-iam-policy-binding 명령어를 사용합니다.

gcloud projects add-iam-policy-binding 'PROJECT_NUMBER' --member='serviceAccount:MEMBER' --role='roles/aiplatform.user' --condition=None

다음을 바꿉니다.

PROJECT_NUMBER: 프로젝트 번호MEMBER: 이전에 복사한 서비스 계정 ID

객체 테이블 연결의 서비스 계정에 역할 부여

원격 모델을 사용하여 객체 테이블 데이터에서 텍스트를 생성하는 경우 원격 모델을 만들려는 동일한 프로젝트에서 객체 테이블 연결의 서비스 계정에 Vertex AI 사용자 역할을 부여합니다. 그 외의 경우에는 이 단계를 건너뛸 수 있습니다.

객체 테이블 연결의 서비스 계정을 찾으려면 다음 단계를 따르세요.

BigQuery 페이지로 이동합니다.

왼쪽 창에서 탐색기를 클릭합니다.

왼쪽 창이 표시되지 않으면 왼쪽 창 펼치기를 클릭하여 창을 엽니다.

탐색기 창에서 데이터 세트를 클릭한 후 객체 테이블이 포함된 데이터 세트를 선택합니다.

개요 > 테이블을 클릭한 다음 객체 테이블을 선택합니다.

편집기 창에서 세부정보 탭을 클릭합니다.

연결 ID 필드의 연결 이름을 기록합니다.

탐색기 창에서 연결을 클릭합니다.

객체 테이블의 연결 ID 필드와 일치하는 연결을 선택합니다.

서비스 계정 ID 필드의 값을 복사합니다.

역할을 부여하려면 다음 단계를 따르세요.

콘솔

IAM 및 관리자 페이지로 이동합니다.

추가를 클릭합니다.

주 구성원 추가 대화상자가 열립니다.

새 주 구성원 필드에 앞에서 복사한 서비스 계정 ID를 입력합니다.

역할 선택 필드에서 Vertex AI를 선택한 후 Vertex AI 사용자를 선택합니다.

저장을 클릭합니다.

gcloud

gcloud projects add-iam-policy-binding 명령어를 사용합니다.

gcloud projects add-iam-policy-binding 'PROJECT_NUMBER' --member='serviceAccount:MEMBER' --role='roles/aiplatform.user' --condition=None

다음을 바꿉니다.

PROJECT_NUMBER: 프로젝트 번호MEMBER: 이전에 복사한 서비스 계정 ID

파트너 모델 사용 설정

이 단계는 Anthropic Claude, Llama 또는 Mistral AI 모델을 사용하려는 경우에만 필요합니다.

Google Cloud 콘솔에서 Vertex AI Model Garden 페이지로 이동합니다.

사용할 파트너 모델을 검색하거나 탐색합니다.

모델 카드를 클릭합니다.

모델 페이지에서 사용 설정을 클릭합니다.

요청된 사용 설정 정보를 입력한 후 다음을 클릭합니다.

이용약관 섹션에서 체크박스를 선택합니다.

동의를 클릭하여 이용약관에 동의하고 모델을 사용 설정합니다.

개방형 모델 배포 방법 선택

지원되는 개방형 모델을 통해 원격 모델을 만드는 경우 CREATE MODEL 문에서 Vertex AI Model Garden 또는 Hugging Face 모델 ID를 지정하여 원격 모델을 만드는 동시에 개방형 모델을 자동으로 배포할 수 있습니다.

또는 먼저 오픈 모델을 수동으로 배포한 다음 CREATE MODEL 문에서 모델 엔드포인트를 지정하여 원격 모델과 함께 해당 오픈 모델을 사용할 수 있습니다. 자세한 내용은 개방형 모델 배포를 참고하세요.

BigQuery ML 원격 모델 만들기

원격 모델을 만듭니다.

새로운 개방형 모델

Google Cloud 콘솔에서 BigQuery 페이지로 이동합니다.

SQL 편집기를 사용하여 원격 모델을 만듭니다.

CREATE OR REPLACE MODEL `PROJECT_ID.DATASET_ID.MODEL_NAME` REMOTE WITH CONNECTION {DEFAULT | `PROJECT_ID.REGION.CONNECTION_ID`} OPTIONS ( {HUGGING_FACE_MODEL_ID = 'HUGGING_FACE_MODEL_ID' | MODEL_GARDEN_MODEL_NAME = 'MODEL_GARDEN_MODEL_NAME'} [, HUGGING_FACE_TOKEN = 'HUGGING_FACE_TOKEN' ] [, MACHINE_TYPE = 'MACHINE_TYPE' ] [, MIN_REPLICA_COUNT = MIN_REPLICA_COUNT ] [, MAX_REPLICA_COUNT = MAX_REPLICA_COUNT ] [, RESERVATION_AFFINITY_TYPE = {'NO_RESERVATION' | 'ANY_RESERVATION' | 'SPECIFIC_RESERVATION'} ] [, RESERVATION_AFFINITY_KEY = 'compute.googleapis.com/reservation-name' ] [, RESERVATION_AFFINITY_VALUES = RESERVATION_AFFINITY_VALUES ] [, ENDPOINT_IDLE_TTL = ENDPOINT_IDLE_TTL ] );

다음을 바꿉니다.

PROJECT_ID: 프로젝트 IDDATASET_ID: 모델을 포함할 데이터 세트의 ID. 이 데이터 세트는 사용 중인 연결과 동일한 위치에 있어야 합니다.MODEL_NAME: 모델의 이름REGION: 연결에 사용되는 리전CONNECTION_ID: BigQuery 연결의 ID.Google Cloud 콘솔에서 연결 세부정보를 확인하고 연결 ID에 표시되는 정규화된 연결 ID의 마지막 섹션에 있는 값을 복사하여 이 값을 확인할 수 있습니다. 예를 들어

projects/myproject/locations/connection_location/connections/myconnection입니다.HUGGING_FACE_MODEL_ID: 지원되는 Hugging Face 모델의 모델 ID를 지정하는STRING값(provider_name/model_name형식). 예:deepseek-ai/DeepSeek-R1Hugging Face Model Hub에서 모델 이름을 클릭한 다음 모델 카드 상단에서 모델 ID를 복사하여 모델 ID를 가져올 수 있습니다.MODEL_GARDEN_MODEL_NAME: 지원되는 Vertex AI Model Garden 모델의 모델 ID와 모델 버전을 지정하는STRING값입니다. 형식은publishers/publisher/models/model_name@model_version입니다. 예를 들면publishers/openai/models/gpt-oss@gpt-oss-120b입니다. Vertex AI Model Garden에서 모델 카드를 클릭한 다음 모델 ID 필드에서 모델 ID를 복사하여 모델 ID를 가져올 수 있습니다. 모델 카드의 버전 필드에서 복사하여 기본 모델 버전을 가져올 수 있습니다. 사용할 수 있는 다른 모델 버전을 보려면 모델 배포를 클릭한 다음 리소스 ID 필드를 클릭합니다.HUGGING_FACE_TOKEN: 사용할 Hugging Face 사용자 액세스 토큰을 지정하는STRING값입니다.HUGGING_FACE_MODEL_ID옵션의 값을 지정한 경우에만 이 옵션의 값을 지정할 수 있습니다.토큰에는 최소한

read역할이 있어야 하지만 범위가 더 넓은 토큰도 허용됩니다. 이 옵션은HUGGING_FACE_MODEL_ID값으로 식별되는 모델이 Hugging Face 액세스 제한 또는 비공개 모델인 경우 필요합니다.일부 게이트 모델은 액세스 권한이 부여되기 전에 서비스 약관에 명시적으로 동의해야 합니다. 이 약관에 동의하려면 다음 단계를 따르세요.

- Hugging Face 웹사이트에서 모델 페이지로 이동합니다.

- 모델의 서비스 약관을 찾아 검토합니다. 서비스 계약 링크는 일반적으로 모델 카드에 있습니다.

- 페이지에 표시되는 약관에 동의합니다.

MACHINE_TYPE: Vertex AI에 모델을 배포할 때 사용할 머신 유형을 지정하는STRING값입니다. 지원되는 머신 유형에 대한 자세한 내용은 머신 유형을 참고하세요.MACHINE_TYPE옵션의 값을 지정하지 않으면 모델의 Vertex AI Model Garden 기본 머신 유형이 사용됩니다.MIN_REPLICA_COUNT: Vertex AI 엔드포인트에 모델을 배포할 때 사용되는 최소 머신 복제본 수를 지정하는INT64값입니다. 서비스는 엔드포인트의 추론 로드에 따라 복제본 수를 늘리거나 줄입니다. 사용되는 복제본 수는MIN_REPLICA_COUNT값보다 낮지 않고MAX_REPLICA_COUNT값보다 높지 않습니다.MIN_REPLICA_COUNT값은[1, 4096]범위 내에 있어야 합니다. 기본값은1입니다.MAX_REPLICA_COUNT: Vertex AI 엔드포인트에 모델을 배포할 때 사용되는 최대 머신 복제본 수를 지정하는INT64값입니다. 서비스는 엔드포인트의 추론 로드에 따라 복제본 수를 늘리거나 줄입니다. 사용되는 복제본 수는MIN_REPLICA_COUNT값보다 낮지 않고MAX_REPLICA_COUNT값보다 높지 않습니다.MAX_REPLICA_COUNT값은[1, 4096]범위 내에 있어야 합니다. 기본값은MIN_REPLICA_COUNT값입니다.RESERVATION_AFFINITY_TYPE: 배포된 모델이 예측을 제공할 때 Compute Engine 예약을 사용하여 가상 머신 (VM) 가용성을 보장하는지 여부를 결정하고 모델이 사용 가능한 모든 예약의 VM을 사용하는지 아니면 특정 예약의 VM만 사용하는지 지정합니다. 자세한 내용은 Compute Engine 예약 선호도를 참고하세요.Vertex AI와 공유된 Compute Engine 예약만 사용할 수 있습니다. 자세한 내용은 예약 사용 허용을 참고하세요.

지원되는 값은 다음과 같습니다.

NO_RESERVATION: 모델이 Vertex AI 엔드포인트에 배포되면 예약이 사용되지 않습니다.NO_RESERVATION을 지정하면 예약 어피니티를 지정하지 않는 것과 동일한 효과가 있습니다.ANY_RESERVATION: Vertex AI 모델 배포가 현재 프로젝트에 있거나 프로젝트와 공유되고 자동 사용을 위해 구성된 Compute Engine 예약의 가상 머신 (VM)을 사용합니다. 다음 자격을 충족하는 VM만 사용됩니다.MACHINE_TYPE값으로 지정된 머신 유형을 사용합니다.- 원격 모델을 만드는 BigQuery 데이터 세트가 단일 리전인 경우 예약은 동일한 리전에 있어야 합니다. 데이터 세트가

US멀티 리전에 있는 경우 예약은us-central1리전에 있어야 합니다. 데이터 세트가EU멀티 리전에 있는 경우 예약은europe-west4리전에 있어야 합니다.

사용 가능한 예약의 용량이 충분하지 않거나 적합한 예약이 없는 경우 시스템은 리소스 요구사항을 충족하기 위해 주문형 Compute Engine VM을 프로비저닝합니다.

SPECIFIC_RESERVATION: Vertex AI 모델 배포가RESERVATION_AFFINITY_VALUES값에 지정된 예약의 VM만 사용합니다. 이 예약은 구체적으로 타겟팅된 사용을 위해 구성되어야 합니다. 지정된 예약에 충분한 용량이 없으면 배포가 실패합니다.

RESERVATION_AFFINITY_KEY: 문자열compute.googleapis.com/reservation-name입니다.RESERVATION_AFFINITY_TYPE값이SPECIFIC_RESERVATION인 경우 이 옵션을 지정해야 합니다.RESERVATION_AFFINITY_VALUES: 다음 형식으로 Compute Engine 예약의 전체 리소스 이름을 지정하는ARRAY<STRING>값입니다.

projects/myproject/zones/reservation_zone/reservations/reservation_name예를 들면

RESERVATION_AFFINITY_values = ['projects/myProject/zones/us-central1-a/reservations/myReservationName']입니다.Google Cloud 콘솔의 예약 페이지에서 예약 이름과 영역을 확인할 수 있습니다. 자세한 내용은 예약 보기를 참고하세요.

RESERVATION_AFFINITY_TYPE값이SPECIFIC_RESERVATION인 경우 이 옵션을 지정해야 합니다.ENDPOINT_IDLE_TTL: Vertex AI 엔드포인트에서 개방형 모델이 자동으로 배포 취소되는 비활성 기간을 지정하는INTERVAL값입니다.자동 배포 해제를 사용 설정하려면 390분 (6.5시간)에서 7일 사이의 간격 리터럴 값을 지정합니다. 예를 들어 8시간 동안 유휴 상태가 되면 모델이 배포 해제되도록 하려면

INTERVAL 8 HOUR를 지정합니다. 기본값은 390분 (6시간 30분)입니다.모델 비활성은 모델에서 다음 작업 중 하나가 실행된 후 경과된 시간으로 정의됩니다.

CREATE MODEL문을 실행합니다.DEPLOY_MODEL인수가TRUE로 설정된ALTER MODEL문을 실행합니다.- 모델 엔드포인트에 추론 요청을 전송합니다. 예를 들어

ML.GENERATE_EMBEDDING또는ML.GENERATE_TEXT함수를 실행합니다.

이러한 각 작업은 비활성 타이머를 0으로 재설정합니다. 재설정은 작업을 실행하는 BigQuery 작업이 시작될 때 트리거됩니다.

모델이 배포 해제된 후 모델에 전송된 추론 요청은 오류를 반환합니다. 모델 메타데이터를 비롯한 BigQuery 모델 객체는 변경되지 않습니다. 추론에 모델을 다시 사용하려면 모델에서

ALTER MODEL문을 실행하고DEPLOY_MODEL옵션을TRUE로 설정하여 모델을 재배포해야 합니다.

배포된 개방형 모델

Google Cloud 콘솔에서 BigQuery 페이지로 이동합니다.

SQL 편집기를 사용하여 원격 모델을 만듭니다.

CREATE OR REPLACE MODEL `PROJECT_ID.DATASET_ID.MODEL_NAME` REMOTE WITH CONNECTION {DEFAULT | `PROJECT_ID.REGION.CONNECTION_ID`} OPTIONS ( ENDPOINT = 'https://ENDPOINT_REGION-aiplatform.googleapis.com/v1/projects/ENDPOINT_PROJECT_ID/locations/ENDPOINT_REGION/endpoints/ENDPOINT_ID' );

다음을 바꿉니다.

PROJECT_ID: 프로젝트 IDDATASET_ID: 모델을 포함할 데이터 세트의 ID. 이 데이터 세트는 사용 중인 연결과 동일한 위치에 있어야 합니다.MODEL_NAME: 모델의 이름REGION: 연결에 사용되는 리전CONNECTION_ID: BigQuery 연결의 ID.Google Cloud 콘솔에서 연결 세부정보를 확인하고 연결 ID에 표시되는 정규화된 연결 ID의 마지막 섹션에 있는 값을 복사하여 이 값을 확인할 수 있습니다. 예를 들어

projects/myproject/locations/connection_location/connections/myconnection입니다.ENDPOINT_REGION: 개방형 모델이 배포되는 리전입니다.ENDPOINT_PROJECT_ID: 개방형 모델이 배포된 프로젝트입니다.ENDPOINT_ID: 개방형 모델에서 사용하는 HTTPS 엔드포인트의 ID입니다. 온라인 예측 페이지에서 개방형 모델을 찾아 ID 필드의 값을 복사하여 엔드포인트 ID를 가져올 수 있습니다.

다른 모든 모델

Google Cloud 콘솔에서 BigQuery 페이지로 이동합니다.

SQL 편집기를 사용하여 원격 모델을 만듭니다.

CREATE OR REPLACE MODEL `PROJECT_ID.DATASET_ID.MODEL_NAME` REMOTE WITH CONNECTION {DEFAULT | `PROJECT_ID.REGION.CONNECTION_ID`} OPTIONS (ENDPOINT = 'ENDPOINT');

다음을 바꿉니다.

PROJECT_ID: 프로젝트 IDDATASET_ID: 모델을 포함할 데이터 세트의 ID. 이 데이터 세트는 사용 중인 연결과 동일한 위치에 있어야 합니다.MODEL_NAME: 모델의 이름REGION: 연결에 사용되는 리전CONNECTION_ID: BigQuery 연결의 ID.Google Cloud 콘솔에서 연결 세부정보를 확인하고 연결 ID에 표시되는 정규화된 연결 ID의 마지막 섹션에 있는 값을 복사하여 이 값을 확인할 수 있습니다. 예를 들어

projects/myproject/locations/connection_location/connections/myconnection입니다.ENDPOINT: 사용할 Vertex AI 모델의 엔드포인트입니다.선행 학습된 Vertex AI 모델, Claude 모델, Mistral AI 모델의 경우 모델 이름을 지정합니다. 이러한 모델 중 일부의 경우 이름의 일부로 모델의 특정 버전을 지정할 수 있습니다. 지원되는 Gemini 모델의 경우 전역 엔드포인트를 지정하여 가용성을 개선할 수 있습니다.

Llama 모델의 경우

openapi/<publisher_name>/<model_name>형식으로 OpenAI API 엔드포인트를 지정합니다. 예를 들면openapi/meta/llama-3.1-405b-instruct-maas입니다.지원되는 모델 이름 및 버전에 관한 자세한 내용은

ENDPOINT를 참고하세요.지정한 Vertex AI 모델은 원격 모델을 만드는 위치에서 사용할 수 있어야 합니다. 자세한 내용은 위치를 참고하세요.

표준 테이블 데이터에서 텍스트 생성

표준 테이블의 프롬프트 데이터를 사용하여 ML.GENERATE_TEXT 함수로 텍스트를 생성합니다.

Gemini

SELECT * FROM ML.GENERATE_TEXT( MODEL `PROJECT_ID.DATASET_ID.MODEL_NAME`, {TABLE PROJECT_ID.DATASET_ID.TABLE_NAME | (PROMPT_QUERY)}, STRUCT(TOKENS AS max_output_tokens, TEMPERATURE AS temperature, TOP_P AS top_p, FLATTEN_JSON AS flatten_json_output, STOP_SEQUENCES AS stop_sequences, GROUND_WITH_GOOGLE_SEARCH AS ground_with_google_search, SAFETY_SETTINGS AS safety_settings, REQUEST_TYPE AS request_type) );

다음을 바꿉니다.

PROJECT_ID: 프로젝트 IDDATASET_ID: 모델이 포함된 데이터 세트의 IDMODEL_NAME: 모델의 이름TABLE_NAME: 프롬프트가 포함된 테이블의 이름. 이 테이블에는 이름이prompt인 열이 있어야 합니다. 또는 별칭을 사용하여 다른 이름의 열을 사용할 수 있습니다.PROMPT_QUERY: 프롬프트 데이터를 제공하는 쿼리 이 쿼리는 이름이prompt인 열을 생성해야 합니다.TOKENS: 대답에서 생성될 수 있는 토큰의 최대 개수를 설정하는INT64값입니다. 이 값은[1,8192]범위 내에 있어야 합니다. 짧은 응답이 필요하면 낮은 값을 지정하고 긴 응답을 위해서는 높은 값을 지정합니다. 기본값은128입니다.TEMPERATURE: 토큰 선택에서 무작위성 수준을 제어하는[0.0,1.0]범위의FLOAT64값입니다. 기본값은0입니다.temperature값이 낮을수록 자유롭거나 창의적인 답변과 거리가 먼 확정적인 응답이 필요한 프롬프트에 적합하고,temperature값이 높을수록 보다 다양하거나 창의적인 결과로 이어질 수 있습니다.temperature값이0이면 확정적입니다. 즉, 확률이 가장 높은 응답이 항상 선택됩니다.TOP_P:[0.0,1.0]범위의FLOAT64값은 토큰이 선택될 확률을 결정하는 데 도움이 됩니다. 임의성이 낮은 응답을 위해서는 낮은 값을 지정하고 임의성이 높은 응답을 위해서는 높은 값을 지정합니다. 기본값은0.95입니다.FLATTEN_JSON: 생성된 텍스트 및 보안 특성을 개별 열로 반환할지 여부를 결정하는BOOL값입니다. 기본값은FALSE입니다.STOP_SEQUENCES: 지정한 문자열이 모델의 응답에 포함된 경우 이 문자열을 제거하는ARRAY<STRING>값입니다. 문자열은 대문자 사용을 비롯해 정확히 일치합니다. 기본값은 빈 배열입니다.GROUND_WITH_GOOGLE_SEARCH: 응답을 생성할 때 Vertex AI 모델이 [Google 검색으로 그라운딩](/vertex-ai/generative-ai/docs/grounding/overview#ground-public)을 사용할지 여부를 결정하는BOOL값입니다. 그라운딩을 통해 모델은 응답을 생성할 때 인터넷에서 추가 정보를 사용하여 보다 구체적이고 사실에 기반하는 모델 응답을 만들 수 있습니다.flatten_json_output및 이 필드가 모두True로 설정되면 결과에 추가ml_generate_text_grounding_result열이 포함되어 모델이 추가 정보를 수집하는 데 사용한 소스를 제공합니다. 기본값은FALSE입니다.SAFETY_SETTINGS: 응답을 필터링하도록 콘텐츠 안전 기준을 구성하는ARRAY<STRUCT<STRING AS category, STRING AS threshold>>값입니다. 구조체의 첫 번째 요소는 피해 카테고리를 지정하고 구조체의 두 번째 요소는 해당하는 차단 기준을 지정합니다. 모델은 이러한 설정을 위반하는 콘텐츠를 필터링합니다. 각 카테고리는 한 번만 지정할 수 있습니다. 예를 들어STRUCT('HARM_CATEGORY_DANGEROUS_CONTENT' AS category, 'BLOCK_MEDIUM_AND_ABOVE' AS threshold)및STRUCT('HARM_CATEGORY_DANGEROUS_CONTENT' AS category, 'BLOCK_ONLY_HIGH' AS threshold)를 모두 지정할 수 없습니다. 지정된 카테고리에 안전 설정이 없는 경우BLOCK_MEDIUM_AND_ABOVE안전 설정이 사용됩니다. 지원되는 카테고리는 다음과 같습니다.HARM_CATEGORY_HATE_SPEECHHARM_CATEGORY_DANGEROUS_CONTENTHARM_CATEGORY_HARASSMENTHARM_CATEGORY_SEXUALLY_EXPLICIT

BLOCK_NONE(제한됨)BLOCK_LOW_AND_ABOVEBLOCK_MEDIUM_AND_ABOVE(기본값)BLOCK_ONLY_HIGHHARM_BLOCK_THRESHOLD_UNSPECIFIED

REQUEST_TYPE: Gemini 모델에 전송할 추론 요청의 유형을 지정하는STRING값입니다. 요청 유형에 따라 요청에서 사용하는 할당량이 결정됩니다. 유효한 값은 다음과 같습니다.DEDICATED:ML.GENERATE_TEXT함수는 프로비저닝된 처리량 할당량만 사용합니다.ML.GENERATE_TEXT함수는 프로비저닝된 처리량 할당량을 사용할 수 없는 경우Provisioned throughput is not purchased or is not active오류를 반환합니다.SHARED: 프로비저닝된 처리량 할당량을 구매한 경우에도ML.GENERATE_TEXT함수는 동적 공유 할당량 (DSQ)만 사용합니다.UNSPECIFIED:ML.GENERATE_TEXT함수는 다음과 같이 할당량을 사용합니다.- 프로비저닝된 처리량 할당량을 구매하지 않은 경우

ML.GENERATE_TEXT함수는 DSQ 할당량을 사용합니다. - 프로비저닝된 처리량 할당량을 구매한 경우

ML.GENERATE_TEXT함수는 프로비저닝된 처리량 할당량을 먼저 사용합니다. 요청이 프로비저닝된 처리량 할당량을 초과하면 오버플로 트래픽이 DSQ 할당량을 사용합니다.

- 프로비저닝된 처리량 할당량을 구매하지 않은 경우

기본값은

UNSPECIFIED입니다.자세한 내용은 Vertex AI 프로비저닝된 처리량 사용을 참고하세요.

예시 1

다음 예시는 이러한 특성이 포함된 요청을 보여줍니다.

articles테이블의body열에 있는 텍스트 요약을 요청하는 프롬프트입니다.- 모델의 JSON 응답을 별도의 열로 파싱합니다.

SELECT * FROM ML.GENERATE_TEXT( MODEL `mydataset.text_model`, ( SELECT CONCAT('Summarize this text', body) AS prompt FROM mydataset.articles ), STRUCT(TRUE AS flatten_json_output));

예시 2

다음 예시는 이러한 특성이 포함된 요청을 보여줍니다.

- 쿼리를 사용하여 테이블 열에 프롬프트 프리픽스를 제공하는 문자열을 연결하여 프롬프트 데이터를 만듭니다.

- 짧은 응답을 반환합니다.

- 모델의 JSON 응답을 별도의 열로 파싱하지 않습니다.

SELECT * FROM ML.GENERATE_TEXT( MODEL `mydataset.text_model`, ( SELECT CONCAT(question, 'Text:', description, 'Category') AS prompt FROM mydataset.input_table ), STRUCT( 100 AS max_output_tokens, FALSE AS flatten_json_output));

예시 3

다음 예시는 이러한 특성이 포함된 요청을 보여줍니다.

- 프롬프트에

prompts테이블의prompt열을 사용합니다. - 모델의 JSON 응답을 별도의 열로 파싱합니다.

SELECT * FROM ML.GENERATE_TEXT( MODEL `mydataset.text_model`, TABLE mydataset.prompts, STRUCT(TRUE AS flatten_json_output));

예시 4

다음 예시는 이러한 특성이 포함된 요청을 보여줍니다.

- 프롬프트에

prompts테이블의prompt열을 사용합니다. - 짧은 응답을 반환합니다.

- JSON 응답을 별도의 열로 평면화합니다.

- 대답 그라운딩을 위해 공개 웹 데이터를 검색하여 반환합니다.

- 두 가지 안전 설정을 사용하여 안전하지 않은 응답을 필터링합니다.

SELECT * FROM ML.GENERATE_TEXT( MODEL `mydataset.text_model`, TABLE mydataset.prompts, STRUCT( 100 AS max_output_tokens, 0.5 AS top_p, TRUE AS flatten_json_output, TRUE AS ground_with_google_search, [STRUCT('HARM_CATEGORY_HATE_SPEECH' AS category, 'BLOCK_LOW_AND_ABOVE' AS threshold), STRUCT('HARM_CATEGORY_DANGEROUS_CONTENT' AS category, 'BLOCK_MEDIUM_AND_ABOVE' AS threshold)] AS safety_settings));

예시 5

다음 예시는 이러한 특성이 포함된 요청을 보여줍니다.

- 프롬프트에

prompts테이블의prompt열을 사용합니다. - 더 긴 응답을 반환합니다.

- JSON 응답을 별도의 열로 평면화합니다.

SELECT * FROM ML.GENERATE_TEXT( MODEL `mydataset.flash_2_model`, TABLE mydataset.prompts, STRUCT( 0.4 AS temperature, 8192 AS max_output_tokens, TRUE AS flatten_json_output));

예 6

다음 예시는 이러한 특성이 포함된 요청을 보여줍니다.

articles테이블의body열에 있는 텍스트 요약을 요청하는 프롬프트입니다.- JSON 응답을 별도의 열로 평면화합니다.

- 대답 그라운딩을 위해 공개 웹 데이터를 검색하여 반환합니다.

- 두 가지 안전 설정을 사용하여 안전하지 않은 응답을 필터링합니다.

SELECT * FROM ML.GENERATE_TEXT( MODEL `mydataset.text_model`, ( SELECT CONCAT('Summarize this text', body) AS prompt FROM mydataset.articles ), STRUCT( .1 AS TEMPERATURE, TRUE AS flatten_json_output, TRUE AS ground_with_google_search, [STRUCT('HARM_CATEGORY_HATE_SPEECH' AS category, 'BLOCK_LOW_AND_ABOVE' AS threshold), STRUCT('HARM_CATEGORY_DANGEROUS_CONTENT' AS category, 'BLOCK_MEDIUM_AND_ABOVE' AS threshold)] AS safety_settings));

Claude

SELECT * FROM ML.GENERATE_TEXT( MODEL `PROJECT_ID.DATASET_ID.MODEL_NAME`, {TABLE PROJECT_ID.DATASET_ID.TABLE_NAME | (PROMPT_QUERY)}, STRUCT(TOKENS AS max_output_tokens, TOP_K AS top_k, TOP_P AS top_p, FLATTEN_JSON AS flatten_json_output) );

다음을 바꿉니다.

PROJECT_ID: 프로젝트 IDDATASET_ID: 모델이 포함된 데이터 세트의 IDMODEL_NAME: 모델의 이름TABLE_NAME: 프롬프트가 포함된 테이블의 이름. 이 테이블에는 이름이prompt인 열이 있어야 합니다. 또는 별칭을 사용하여 다른 이름의 열을 사용할 수 있습니다.PROMPT_QUERY: 프롬프트 데이터를 제공하는 쿼리 이 쿼리는 이름이prompt인 열을 생성해야 합니다.TOKENS: 대답에서 생성될 수 있는 토큰의 최대 개수를 설정하는INT64값입니다. 이 값은[1,4096]범위 내에 있어야 합니다. 짧은 응답이 필요하면 낮은 값을 지정하고 긴 응답을 위해서는 높은 값을 지정합니다. 기본값은128입니다.TOP_K: 모델이 선택에 고려해야 하는 토큰의 초기 풀을 결정하는[1,40]범위의INT64값입니다. 임의성이 낮은 응답을 위해서는 낮은 값을 지정하고 임의성이 높은 응답을 위해서는 높은 값을 지정합니다. 값을 지정하지 않으면 모델에서 적절한 값을 결정합니다.TOP_P:[0.0,1.0]범위의FLOAT64값은 토큰이 선택될 확률을 결정하는 데 도움이 됩니다. 임의성이 낮은 응답을 위해서는 낮은 값을 지정하고 임의성이 높은 응답을 위해서는 높은 값을 지정합니다. 값을 지정하지 않으면 모델에서 적절한 값을 결정합니다.FLATTEN_JSON: 생성된 텍스트 및 보안 특성을 개별 열로 반환할지 여부를 결정하는BOOL값입니다. 기본값은FALSE입니다.

예시 1

다음 예시는 이러한 특성이 포함된 요청을 보여줍니다.

articles테이블의body열에 있는 텍스트 요약을 요청하는 프롬프트입니다.- 모델의 JSON 응답을 별도의 열로 파싱합니다.

SELECT * FROM ML.GENERATE_TEXT( MODEL `mydataset.text_model`, ( SELECT CONCAT('Summarize this text', body) AS prompt FROM mydataset.articles ), STRUCT(TRUE AS flatten_json_output));

예시 2

다음 예시는 이러한 특성이 포함된 요청을 보여줍니다.

- 쿼리를 사용하여 테이블 열에 프롬프트 프리픽스를 제공하는 문자열을 연결하여 프롬프트 데이터를 만듭니다.

- 짧은 응답을 반환합니다.

- 모델의 JSON 응답을 별도의 열로 파싱하지 않습니다.

SELECT * FROM ML.GENERATE_TEXT( MODEL `mydataset.text_model`, ( SELECT CONCAT(question, 'Text:', description, 'Category') AS prompt FROM mydataset.input_table ), STRUCT( 100 AS max_output_tokens, FALSE AS flatten_json_output));

예시 3

다음 예시는 이러한 특성이 포함된 요청을 보여줍니다.

- 프롬프트에

prompts테이블의prompt열을 사용합니다. - 모델의 JSON 응답을 별도의 열로 파싱합니다.

SELECT * FROM ML.GENERATE_TEXT( MODEL `mydataset.text_model`, TABLE mydataset.prompts, STRUCT(TRUE AS flatten_json_output));

Llama

SELECT * FROM ML.GENERATE_TEXT( MODEL `PROJECT_ID.DATASET_ID.MODEL_NAME`, {TABLE PROJECT_ID.DATASET_ID.TABLE_NAME | (PROMPT_QUERY)}, STRUCT(TOKENS AS max_output_tokens, TEMPERATURE AS temperature, TOP_P AS top_p, FLATTEN_JSON AS flatten_json_output, STOP_SEQUENCES AS stop_sequences) );

다음을 바꿉니다.

PROJECT_ID: 프로젝트 IDDATASET_ID: 모델이 포함된 데이터 세트의 IDMODEL_NAME: 모델의 이름TABLE_NAME: 프롬프트가 포함된 테이블의 이름. 이 테이블에는 이름이prompt인 열이 있어야 합니다. 또는 별칭을 사용하여 다른 이름의 열을 사용할 수 있습니다.PROMPT_QUERY: 프롬프트 데이터를 제공하는 쿼리 이 쿼리는 이름이prompt인 열을 생성해야 합니다.TOKENS: 대답에서 생성될 수 있는 토큰의 최대 개수를 설정하는INT64값입니다. 이 값은[1,4096]범위 내에 있어야 합니다. 짧은 응답이 필요하면 낮은 값을 지정하고 긴 응답을 위해서는 높은 값을 지정합니다. 기본값은128입니다.TEMPERATURE: 토큰 선택에서 무작위성 수준을 제어하는[0.0,1.0]범위의FLOAT64값입니다. 기본값은0입니다.temperature값이 낮을수록 자유롭거나 창의적인 답변과 거리가 먼 확정적인 응답이 필요한 프롬프트에 적합하고,temperature값이 높을수록 보다 다양하거나 창의적인 결과로 이어질 수 있습니다.temperature값이0이면 확정적입니다. 즉, 확률이 가장 높은 응답이 항상 선택됩니다.TOP_P:[0.0,1.0]범위의FLOAT64값은 토큰이 선택될 확률을 결정하는 데 도움이 됩니다. 임의성이 낮은 응답을 위해서는 낮은 값을 지정하고 임의성이 높은 응답을 위해서는 높은 값을 지정합니다. 기본값은0.95입니다.FLATTEN_JSON: 생성된 텍스트 및 보안 특성을 개별 열로 반환할지 여부를 결정하는BOOL값입니다. 기본값은FALSE입니다.STOP_SEQUENCES: 지정한 문자열이 모델의 응답에 포함된 경우 이 문자열을 제거하는ARRAY<STRING>값입니다. 문자열은 대문자 사용을 비롯해 정확히 일치합니다. 기본값은 빈 배열입니다.

예시 1

다음 예시는 이러한 특성이 포함된 요청을 보여줍니다.

articles테이블의body열에 있는 텍스트 요약을 요청하는 프롬프트입니다.- 모델의 JSON 응답을 별도의 열로 파싱합니다.

SELECT * FROM ML.GENERATE_TEXT( MODEL `mydataset.text_model`, ( SELECT CONCAT('Summarize this text', body) AS prompt FROM mydataset.articles ), STRUCT(TRUE AS flatten_json_output));

예시 2

다음 예시는 이러한 특성이 포함된 요청을 보여줍니다.

- 쿼리를 사용하여 테이블 열에 프롬프트 프리픽스를 제공하는 문자열을 연결하여 프롬프트 데이터를 만듭니다.

- 짧은 응답을 반환합니다.

- 모델의 JSON 응답을 별도의 열로 파싱하지 않습니다.

SELECT * FROM ML.GENERATE_TEXT( MODEL `mydataset.text_model`, ( SELECT CONCAT(question, 'Text:', description, 'Category') AS prompt FROM mydataset.input_table ), STRUCT( 100 AS max_output_tokens, FALSE AS flatten_json_output));

예시 3

다음 예시는 이러한 특성이 포함된 요청을 보여줍니다.

- 프롬프트에

prompts테이블의prompt열을 사용합니다. - 모델의 JSON 응답을 별도의 열로 파싱합니다.

SELECT * FROM ML.GENERATE_TEXT( MODEL `mydataset.text_model`, TABLE mydataset.prompts, STRUCT(TRUE AS flatten_json_output));

Mistral AI

SELECT * FROM ML.GENERATE_TEXT( MODEL `PROJECT_ID.DATASET_ID.MODEL_NAME`, {TABLE PROJECT_ID.DATASET_ID.TABLE_NAME | (PROMPT_QUERY)}, STRUCT(TOKENS AS max_output_tokens, TEMPERATURE AS temperature, TOP_P AS top_p, FLATTEN_JSON AS flatten_json_output, STOP_SEQUENCES AS stop_sequences) );

다음을 바꿉니다.

PROJECT_ID: 프로젝트 IDDATASET_ID: 모델이 포함된 데이터 세트의 IDMODEL_NAME: 모델의 이름TABLE_NAME: 프롬프트가 포함된 테이블의 이름. 이 테이블에는 이름이prompt인 열이 있어야 합니다. 또는 별칭을 사용하여 다른 이름의 열을 사용할 수 있습니다.PROMPT_QUERY: 프롬프트 데이터를 제공하는 쿼리 이 쿼리는 이름이prompt인 열을 생성해야 합니다.TOKENS: 대답에서 생성될 수 있는 토큰의 최대 개수를 설정하는INT64값입니다. 이 값은[1,4096]범위 내에 있어야 합니다. 짧은 응답이 필요하면 낮은 값을 지정하고 긴 응답을 위해서는 높은 값을 지정합니다. 기본값은128입니다.TEMPERATURE: 토큰 선택에서 무작위성 수준을 제어하는[0.0,1.0]범위의FLOAT64값입니다. 기본값은0입니다.temperature값이 낮을수록 자유롭거나 창의적인 답변과 거리가 먼 확정적인 응답이 필요한 프롬프트에 적합하고,temperature값이 높을수록 보다 다양하거나 창의적인 결과로 이어질 수 있습니다.temperature값이0이면 확정적입니다. 즉, 확률이 가장 높은 응답이 항상 선택됩니다.TOP_P:[0.0,1.0]범위의FLOAT64값은 토큰이 선택될 확률을 결정하는 데 도움이 됩니다. 임의성이 낮은 응답을 위해서는 낮은 값을 지정하고 임의성이 높은 응답을 위해서는 높은 값을 지정합니다. 기본값은0.95입니다.FLATTEN_JSON: 생성된 텍스트 및 보안 특성을 개별 열로 반환할지 여부를 결정하는BOOL값입니다. 기본값은FALSE입니다.STOP_SEQUENCES: 지정한 문자열이 모델의 응답에 포함된 경우 이 문자열을 제거하는ARRAY<STRING>값입니다. 문자열은 대문자 사용을 비롯해 정확히 일치합니다. 기본값은 빈 배열입니다.

예시 1

다음 예시는 이러한 특성이 포함된 요청을 보여줍니다.

articles테이블의body열에 있는 텍스트 요약을 요청하는 프롬프트입니다.- 모델의 JSON 응답을 별도의 열로 파싱합니다.

SELECT * FROM ML.GENERATE_TEXT( MODEL `mydataset.text_model`, ( SELECT CONCAT('Summarize this text', body) AS prompt FROM mydataset.articles ), STRUCT(TRUE AS flatten_json_output));

예시 2

다음 예시는 이러한 특성이 포함된 요청을 보여줍니다.

- 쿼리를 사용하여 테이블 열에 프롬프트 프리픽스를 제공하는 문자열을 연결하여 프롬프트 데이터를 만듭니다.

- 짧은 응답을 반환합니다.

- 모델의 JSON 응답을 별도의 열로 파싱하지 않습니다.

SELECT * FROM ML.GENERATE_TEXT( MODEL `mydataset.text_model`, ( SELECT CONCAT(question, 'Text:', description, 'Category') AS prompt FROM mydataset.input_table ), STRUCT( 100 AS max_output_tokens, FALSE AS flatten_json_output));

예시 3

다음 예시는 이러한 특성이 포함된 요청을 보여줍니다.

- 프롬프트에

prompts테이블의prompt열을 사용합니다. - 모델의 JSON 응답을 별도의 열로 파싱합니다.

SELECT * FROM ML.GENERATE_TEXT( MODEL `mydataset.text_model`, TABLE mydataset.prompts, STRUCT(TRUE AS flatten_json_output));

모델 열기

SELECT * FROM ML.GENERATE_TEXT( MODEL `PROJECT_ID.DATASET_ID.MODEL_NAME`, {TABLE PROJECT_ID.DATASET_ID.TABLE_NAME | (PROMPT_QUERY)}, STRUCT(TOKENS AS max_output_tokens, TEMPERATURE AS temperature, TOP_K AS top_k, TOP_P AS top_p, FLATTEN_JSON AS flatten_json_output) );

다음을 바꿉니다.

PROJECT_ID: 프로젝트 IDDATASET_ID: 모델이 포함된 데이터 세트의 IDMODEL_NAME: 모델의 이름TABLE_NAME: 프롬프트가 포함된 테이블의 이름. 이 테이블에는 이름이prompt인 열이 있어야 합니다. 또는 별칭을 사용하여 다른 이름의 열을 사용할 수 있습니다.PROMPT_QUERY: 프롬프트 데이터를 제공하는 쿼리 이 쿼리는 이름이prompt인 열을 생성해야 합니다.TOKENS: 대답에서 생성될 수 있는 토큰의 최대 개수를 설정하는INT64값입니다. 이 값은[1,4096]범위 내에 있어야 합니다. 짧은 응답이 필요하면 낮은 값을 지정하고 긴 응답을 위해서는 높은 값을 지정합니다. 값을 지정하지 않으면 모델에서 적절한 값을 결정합니다.TEMPERATURE: 토큰 선택에서 무작위성 수준을 제어하는[0.0,1.0]범위의FLOAT64값입니다. 값을 지정하지 않으면 모델에서 적절한 값을 결정합니다.temperature값이 낮을수록 자유롭거나 창의적인 답변과 거리가 먼 확정적인 응답이 필요한 프롬프트에 적합하고,temperature값이 높을수록 보다 다양하거나 창의적인 결과로 이어질 수 있습니다.temperature값이0이면 확정적입니다. 즉, 확률이 가장 높은 응답이 항상 선택됩니다.TOP_K: 모델이 선택에 고려해야 하는 토큰의 초기 풀을 결정하는[1,40]범위의INT64값입니다. 임의성이 낮은 응답을 위해서는 낮은 값을 지정하고 임의성이 높은 응답을 위해서는 높은 값을 지정합니다. 값을 지정하지 않으면 모델에서 적절한 값을 결정합니다.TOP_P:[0.0,1.0]범위의FLOAT64값은 토큰이 선택될 확률을 결정하는 데 도움이 됩니다. 임의성이 낮은 응답을 위해서는 낮은 값을 지정하고 임의성이 높은 응답을 위해서는 높은 값을 지정합니다. 값을 지정하지 않으면 모델에서 적절한 값을 결정합니다.FLATTEN_JSON: 생성된 텍스트 및 보안 특성을 개별 열로 반환할지 여부를 결정하는BOOL값입니다. 기본값은FALSE입니다.

예시 1

다음 예시는 이러한 특성이 포함된 요청을 보여줍니다.

articles테이블의body열에 있는 텍스트 요약을 요청하는 프롬프트입니다.- 모델의 JSON 응답을 별도의 열로 파싱합니다.

SELECT * FROM ML.GENERATE_TEXT( MODEL `mydataset.text_model`, ( SELECT CONCAT('Summarize this text', body) AS prompt FROM mydataset.articles ), STRUCT(TRUE AS flatten_json_output));

예시 2

다음 예시는 이러한 특성이 포함된 요청을 보여줍니다.

- 쿼리를 사용하여 테이블 열에 프롬프트 프리픽스를 제공하는 문자열을 연결하여 프롬프트 데이터를 만듭니다.

- 짧은 응답을 반환합니다.

- 모델의 JSON 응답을 별도의 열로 파싱하지 않습니다.

SELECT * FROM ML.GENERATE_TEXT( MODEL `mydataset.text_model`, ( SELECT CONCAT(question, 'Text:', description, 'Category') AS prompt FROM mydataset.input_table ), STRUCT( 100 AS max_output_tokens, FALSE AS flatten_json_output));

예시 3

다음 예시는 이러한 특성이 포함된 요청을 보여줍니다.

- 프롬프트에

prompts테이블의prompt열을 사용합니다. - 모델의 JSON 응답을 별도의 열로 파싱합니다.

SELECT * FROM ML.GENERATE_TEXT( MODEL `mydataset.text_model`, TABLE mydataset.prompts, STRUCT(TRUE AS flatten_json_output));

객체 테이블 데이터에서 텍스트 생성

Gemini 모델로 ML.GENERATE_TEXT 함수를 사용하여 객체 테이블의 구조화되지 않은 데이터를 분석하여 텍스트를 생성합니다. prompt 파라미터에 프롬프트 데이터를 제공합니다.

SELECT * FROM ML.GENERATE_TEXT( MODEL `PROJECT_ID.DATASET_ID.MODEL_NAME`, TABLE PROJECT_ID.DATASET_ID.TABLE_NAME, STRUCT(PROMPT AS prompt, TOKENS AS max_output_tokens, TEMPERATURE AS temperature, TOP_P AS top_p, FLATTEN_JSON AS flatten_json_output, STOP_SEQUENCES AS stop_sequences, SAFETY_SETTINGS AS safety_settings) );

다음을 바꿉니다.

PROJECT_ID: 프로젝트 IDDATASET_ID: 모델이 포함된 데이터 세트의 IDMODEL_NAME: 모델의 이름 Gemini 모델이어야 합니다.TABLE_NAME: 분석할 콘텐츠를 포함하는 객체 테이블의 이름입니다. 분석할 수 있는 콘텐츠 유형에 대한 자세한 내용은 입력을 참조하세요.객체 테이블에 사용되는 Cloud Storage 버킷은 모델을 만들고

ML.GENERATE_TEXT함수를 호출하는 동일한 프로젝트에 있어야 합니다. 객체 테이블에서 사용하는 Cloud Storage 버킷이 포함된 프로젝트가 아닌 다른 프로젝트에서ML.GENERATE_TEXT함수를 호출하려면service-A@gcp-sa-aiplatform.iam.gserviceaccount.com서비스 계정에 버킷 수준에서 스토리지 관리자 역할을 부여해야 합니다.PROMPT: 콘텐츠를 분석하는 데 사용할 프롬프트입니다.TOKENS: 대답에서 생성될 수 있는 토큰의 최대 개수를 설정하는INT64값입니다. 이 값은[1,4096]범위 내에 있어야 합니다. 짧은 응답이 필요하면 낮은 값을 지정하고 긴 응답을 위해서는 높은 값을 지정합니다. 값을 지정하지 않으면 모델에서 적절한 값을 결정합니다.TEMPERATURE: 토큰 선택에서 무작위성 수준을 제어하는[0.0,1.0]범위의FLOAT64값입니다. 값을 지정하지 않으면 모델에서 적절한 값을 결정합니다.temperature값이 낮을수록 자유롭거나 창의적인 답변과 거리가 먼 확정적인 응답이 필요한 프롬프트에 적합하고,temperature값이 높을수록 보다 다양하거나 창의적인 결과로 이어질 수 있습니다.temperature값이0이면 확정적입니다. 즉, 확률이 가장 높은 응답이 항상 선택됩니다.TOP_K: 모델이 선택에 고려해야 하는 토큰의 초기 풀을 결정하는[1,40]범위의INT64값입니다. 임의성이 낮은 응답을 위해서는 낮은 값을 지정하고 임의성이 높은 응답을 위해서는 높은 값을 지정합니다. 값을 지정하지 않으면 모델에서 적절한 값을 결정합니다.TOP_P:[0.0,1.0]범위의FLOAT64값은 토큰이 선택될 확률을 결정하는 데 도움이 됩니다. 임의성이 낮은 응답을 위해서는 낮은 값을 지정하고 임의성이 높은 응답을 위해서는 높은 값을 지정합니다. 값을 지정하지 않으면 모델에서 적절한 값을 결정합니다.FLATTEN_JSON: 생성된 텍스트 및 보안 특성을 개별 열로 반환할지 여부를 결정하는BOOL값입니다. 기본값은FALSE입니다.

예시

이 예시에서는 feedback이라는 객체 테이블에서 오디오 콘텐츠를 번역하고 텍스트 변환합니다.

SELECT * FROM ML.GENERATE_TEXT( MODEL `mydataset.audio_model`, TABLE `mydataset.feedback`, STRUCT('What is the content of this audio clip, translated into Spanish?' AS PROMPT, TRUE AS FLATTEN_JSON_OUTPUT));

이 예시에서는 invoices라는 객체 테이블에서 PDF 콘텐츠를 분류합니다.

SELECT * FROM ML.GENERATE_TEXT( MODEL `mydataset.classify_model`, TABLE `mydataset.invoices`, STRUCT('Classify this document based on the invoice total, using the following categories: 0 to 100, 101 to 200, greater than 200' AS PROMPT, TRUE AS FLATTEN_JSON_OUTPUT));