Transcrire des fichiers audio avec la fonction ML.TRANSCRIBE

Ce document explique comment utiliser la fonction ML.TRANSCRIBE avec un modèle distant pour transcrire des fichiers audio à partir d'unetable d'objets.

Pays acceptés

Vous devez créer le modèle distant utilisé dans cette procédure dans l'un des emplacements suivants :

asia-northeast1asia-south1asia-southeast1australia-southeast1eueurope-west1europe-west2europe-west3europe-west4northamerica-northeast1usus-central1us-east1us-east4us-west1

Vous devez exécuter la fonction ML.TRANSCRIBE dans la même région que le modèle distant.

Rôles requis

Pour créer un modèle à distance et transcrire des fichiers audio, vous avez besoin des rôles Identity and Access Management (IAM) suivants au niveau du projet :

- Créer un outil de reconnaissance vocale : Éditeur Cloud Speech (

roles/speech.editor) - Créer et utiliser des ensembles de données, des tables et des modèles BigQuery : Éditeur de données BigQuery (

roles/bigquery.dataEditor) Créer, déléguer et utiliser des connexions BigQuery : administrateur de connexion BigQuery (

roles/bigquery.connectionsAdmin)Si vous n'avez pas configuré de connexion par défaut, vous pouvez en créer une et la définir lors de l'exécution de l'instruction

CREATE MODEL. Pour ce faire, vous devez disposer du rôle Administrateur BigQuery (roles/bigquery.admin) sur votre projet. Pour en savoir plus, consultez Configurer la connexion par défaut.Accorder des autorisations au compte de service de la connexion : Administrateur IAM du projet (

roles/resourcemanager.projectIamAdmin)Créer des jobs BigQuery : Utilisateur de job BigQuery (

roles/bigquery.jobUser)

Ces rôles prédéfinis contiennent les autorisations requises pour effectuer les tâches décrites dans ce document. Pour afficher les autorisations exactes requises, développez la section Autorisations requises :

Autorisations requises

- Créez un ensemble de données :

bigquery.datasets.create - Créer, déléguer et utiliser une connexion :

bigquery.connections.* - Définissez les autorisations du compte de service :

resourcemanager.projects.getIamPolicyetresourcemanager.projects.setIamPolicy - Créez un modèle et exécutez l'inférence :

bigquery.jobs.createbigquery.models.createbigquery.models.getDatabigquery.models.updateDatabigquery.models.updateMetadata

- Créez une table d'objets :

bigquery.tables.createetbigquery.tables.update - Créez un module de reconnaissance vocale :

speech.recognizers.createspeech.recognizers.getspeech.recognizers.recognizespeech.recognizers.update

Vous pouvez également obtenir ces autorisations avec des rôles personnalisés ou d'autres rôles prédéfinis.

Avant de commencer

- Sign in to your Google Cloud account. If you're new to Google Cloud, create an account to evaluate how our products perform in real-world scenarios. New customers also get $300 in free credits to run, test, and deploy workloads.

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

-

Enable the BigQuery, BigQuery Connection API, and Speech-to-Text APIs.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles. -

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

-

Enable the BigQuery, BigQuery Connection API, and Speech-to-Text APIs.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles. Dans la console Google Cloud , accédez à la page BigQuery.

Dans le volet Explorateur, cliquez sur le nom de votre projet.

Cliquez sur Afficher les actions > Créer un ensemble de données.

Sur la page Créer un ensemble de données, procédez comme suit :

Pour ID de l'ensemble de données, saisissez un nom pour l'ensemble de données.

Dans Type d'emplacement, sélectionnez un emplacement pour l'ensemble de données.

Cliquez sur Créer un ensemble de données.

Pour créer un ensemble de données, exécutez la commande

bq mken spécifiant l'option--location:bq --location=LOCATION mk -d DATASET_ID

Remplacez les éléments suivants :

LOCATION: emplacement de l'ensemble de données.DATASET_IDest l'ID de l'ensemble de données que vous créez.

Vérifiez que l'ensemble de données a été créé :

bq lsAccédez à la page BigQuery.

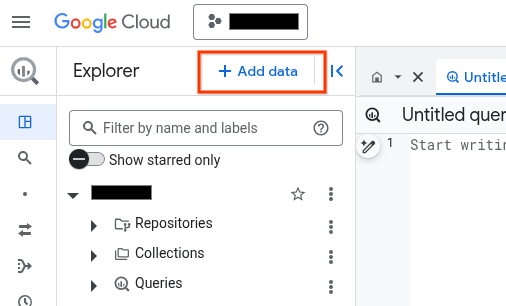

Dans le volet Explorateur, cliquez sur Ajouter des données :

La boîte de dialogue Ajouter des données s'ouvre.

Dans le panneau Filtrer par, dans la section Type de source de données, sélectionnez Applications métier.

Vous pouvez également saisir

Vertex AIdans le champ Rechercher des sources de données.Dans la section Sources de données recommandées, cliquez sur Vertex AI.

Cliquez sur la fiche solution Modèles Vertex AI : fédération BigQuery.

Dans la liste Type de connexion, sélectionnez Modèles distants Vertex AI, fonctions distantes et BigLake (ressource Cloud).

Dans le champ ID de connexion, saisissez un nom pour votre connexion.

Cliquez sur Créer une connexion.

Cliquez sur Accéder à la connexion.

Dans le volet Informations de connexion, copiez l'ID du compte de service à utiliser à l'étape suivante.

Dans un environnement de ligne de commande, créez une connexion :

bq mk --connection --location=REGION --project_id=PROJECT_ID \ --connection_type=CLOUD_RESOURCE CONNECTION_ID

Le paramètre

--project_idremplace le projet par défaut.Remplacez les éléments suivants :

REGION: votre région de connexionPROJECT_ID: ID de votre projet Google CloudCONNECTION_ID: ID de votre connexion

Lorsque vous créez une ressource de connexion, BigQuery crée un compte de service système unique et l'associe à la connexion.

Dépannage : Si vous obtenez l'erreur de connexion suivante, mettez à jour le Google Cloud SDK :

Flags parsing error: flag --connection_type=CLOUD_RESOURCE: value should be one of...

Récupérez et copiez l'ID du compte de service pour l'utiliser lors d'une prochaine étape :

bq show --connection PROJECT_ID.REGION.CONNECTION_ID

Le résultat ressemble à ce qui suit :

name properties 1234.REGION.CONNECTION_ID {"serviceAccountId": "connection-1234-9u56h9@gcp-sa-bigquery-condel.iam.gserviceaccount.com"}- Lancez Cloud Shell.

-

Définissez le projet Google Cloud par défaut dans lequel vous souhaitez appliquer vos configurations Terraform.

Vous n'avez besoin d'exécuter cette commande qu'une seule fois par projet et vous pouvez l'exécuter dans n'importe quel répertoire.

export GOOGLE_CLOUD_PROJECT=PROJECT_ID

Les variables d'environnement sont remplacées si vous définissez des valeurs explicites dans le fichier de configuration Terraform.

-

Dans Cloud Shell, créez un répertoire et un nouveau fichier dans ce répertoire. Le nom du fichier doit comporter l'extension

.tf, par exemplemain.tf. Dans ce tutoriel, le fichier est appelémain.tf.mkdir DIRECTORY && cd DIRECTORY && touch main.tf

-

Si vous suivez un tutoriel, vous pouvez copier l'exemple de code dans chaque section ou étape.

Copiez l'exemple de code dans le fichier

main.tfque vous venez de créer.Vous pouvez également copier le code depuis GitHub. Cela est recommandé lorsque l'extrait Terraform fait partie d'une solution de bout en bout.

- Examinez et modifiez les exemples de paramètres à appliquer à votre environnement.

- Enregistrez les modifications.

-

Initialisez Terraform. Cette opération n'est à effectuer qu'une seule fois par répertoire.

terraform init

Vous pouvez également utiliser la dernière version du fournisseur Google en incluant l'option

-upgrade:terraform init -upgrade

-

Examinez la configuration et vérifiez que les ressources que Terraform va créer ou mettre à jour correspondent à vos attentes :

terraform plan

Corrigez les modifications de la configuration si nécessaire.

-

Appliquez la configuration Terraform en exécutant la commande suivante et en saisissant

yeslorsque vous y êtes invité :terraform apply

Attendez que Terraform affiche le message "Apply completed!" (Application terminée).

- Ouvrez votre projet Google Cloud pour afficher les résultats. Dans la console Google Cloud , accédez à vos ressources dans l'interface utilisateur pour vous assurer que Terraform les a créées ou mises à jour.

Accédez à la page IAM et administration.

Cliquez sur Accorder l'accès.

La boîte de dialogue Ajouter des comptes principaux s'ouvre.

Dans le champ Nouveaux comptes principaux, saisissez l'ID du compte de service que vous avez copié précédemment.

Cliquez sur le champ Sélectionner un rôle, puis saisissez

Cloud Speech Clientdans le champ Filtre.Cliquez sur Ajouter un autre rôle.

Dans le champ Sélectionnez un rôle, sélectionnez Cloud Storage, puis Lecteur d'objets Storage.

Cliquez sur Enregistrer.

PROJECT_NUMBER: votre numéro de projet.MEMBER: ID du compte de service que vous avez copié précédemmentPROJECT_ID: ID de votre projet.DATASET_ID: ID de l'ensemble de données pour contenir le modèle.MODEL_NAME: nom du modèleREGION: région utilisée par la connexion.CONNECTION_ID: ID de connexion, par exemplemyconnection.Lorsque vous affichez les détails de la connexion dans la console Google Cloud , il s'agit de la valeur de la dernière section de l'ID de connexion complet affiché dans ID de connexion (par exemple,

projects/myproject/locations/connection_location/connections/myconnection).PROJECT_NUMBER: numéro du projet contenant l'outil de reconnaissance vocale. Vous trouverez cette valeur sur la fiche Informations sur le projet de la page Tableau de bord de la console Google Cloud .LOCATION: emplacement utilisé par le système de reconnaissance vocale. Vous pouvez trouver cette valeur dans le champ Emplacement de la page Répertorier les outils de reconnaissance de la console Google Cloud .RECOGNIZER_ID: ID de l'outil de reconnaissance vocale. Vous pouvez trouver cette valeur dans le champ ID de la page Répertorier les outils de reconnaissance de la console Google Cloud .Cette option n'est pas obligatoire. Si vous ne spécifiez pas de valeur, un outil de reconnaissance par défaut est utilisé. Dans ce cas, vous devez spécifier une valeur pour le paramètre

recognition_configde la fonctionML.TRANSCRIBE, afin de fournir une configuration pour l'outil de reconnaissance par défaut.Vous ne pouvez utiliser le modèle de transcription

chirpque dans la valeurrecognition_configque vous avez spécifiée.PROJECT_ID: ID de votre projet.DATASET_ID: ID de l'ensemble de données contenant le modèle.MODEL_NAME: nom du modèleOBJECT_TABLE_NAME: nom de la table d'objets contenant les URI des fichiers audio à traiter.recognition_config: ressourceRecognitionConfigau format JSON.Si un outil de reconnaissance a été spécifié pour le modèle distant à l'aide de l'option

SPEECH_RECOGNIZER, vous ne pouvez pas spécifier de valeurrecognition_config.Si aucun outil de reconnaissance n'a été spécifié pour le modèle distant à l'aide de l'option

SPEECH_RECOGNIZER, vous devez spécifier une valeurrecognition_config. Cette valeur permet de fournir une configuration pour l'outil de reconnaissance par défaut.Vous ne pouvez utiliser le modèle de transcription

chirpque dans la valeurrecognition_configque vous fournissez.- Pour en savoir plus sur l'inférence de modèle dans BigQuery ML, consultez la présentation de l'inférence de modèle.

- Pour en savoir plus sur l'utilisation des API Cloud AI pour effectuer des tâches d'IA, consultez la page Présentation des applications d'IA.

- Pour en savoir plus sur les instructions et les fonctions SQL compatibles avec les modèles d'IA générative, consultez Parcours utilisateur de bout en bout pour les modèles d'IA générative.

Créer un outil de reconnaissance

Speech-to-Text accepte les ressources appelées "outils de reconnaissance". Ces outils de reconnaissance constituent la version stockée et réutilisable d'une configuration de reconnaissance. Vous pouvez créer un outil de reconnaissance pour regrouper logiquement les transcriptions ou le trafic de votre application.

La création d'un outil de reconnaissance vocale est facultative. Si vous choisissez de créer un outil de reconnaissance vocale, notez l'ID de projet, l'emplacement et l'ID de l'outil de reconnaissance à utiliser dans l'instruction CREATE MODEL, comme décrit à la section SPEECH_RECOGNIZER.

Si vous choisissez de ne pas créer d'outil de reconnaissance vocale, vous devez spécifier une valeur pour l'argument recognition_config de la fonction ML.TRANSCRIBE.

Vous ne pouvez utiliser que le modèle de transcription chirp dans l'outil de reconnaissance vocale ou la valeur recognition_config que vous avez spécifiée.

Créer un ensemble de données

Créez un ensemble de données BigQuery pour contenir vos ressources :

Console

bq

Créer une connexion

Vous pouvez ignorer cette étape si vous avez configuré une connexion par défaut ou si vous disposez du rôle Administrateur BigQuery.

Créez une connexion de ressource cloud pour que le modèle distant puisse l'utiliser, et obtenez le compte de service de la connexion. Créez la connexion dans le même emplacement que l'ensemble de données que vous avez créé à l'étape précédente.

Sélectionnez l'une des options suivantes :

Console

bq

Terraform

Utilisez la ressource google_bigquery_connection.

Pour vous authentifier auprès de BigQuery, configurez le service Identifiants par défaut de l'application. Pour en savoir plus, consultez la page Configurer l'authentification pour les bibliothèques clientes.

L'exemple suivant crée une connexion de ressources Cloud nommée my_cloud_resource_connection dans la région US :

Pour appliquer votre configuration Terraform dans un projet Google Cloud , suivez les procédures des sections suivantes.

Préparer Cloud Shell

Préparer le répertoire

Chaque fichier de configuration Terraform doit avoir son propre répertoire (également appelé module racine).

Appliquer les modifications

Accorder l'accès au compte de service

Sélectionnez l'une des options suivantes :

Console

gcloud

Exécutez la commande gcloud projects add-iam-policy-binding :

gcloud projects add-iam-policy-binding 'PROJECT_NUMBER' --member='serviceAccount:MEMBER' --role='roles/speech.client' --condition=None gcloud projects add-iam-policy-binding 'PROJECT_NUMBER' --member='serviceAccount:MEMBER' --role='roles/storage.objectViewer' --condition=None

Remplacez les éléments suivants :

L'échec de l'attribution de l'autorisation génère une erreur Permission denied.

Créer une table d'objets

Créer une table d'objets sur un ensemble de fichiers audio dans Cloud Storage. Les fichiers audio de la table d'objets doivent être d'un type compatible.

Le bucket Cloud Storage utilisé par la table d'objets doit se trouver dans le même projet que celui dans lequel vous prévoyez de créer le modèle et d'appeler la fonction ML.TRANSCRIBE. Si vous souhaitez appeler la fonction ML.TRANSCRIBE dans un projet différent de celui qui contient le bucket Cloud Storage utilisé par la table d'objets, vous devez attribuer le rôle d'Administrateur de l'espace de stockage au niveau du bucket au compte de service service-A@gcp-sa-aiplatform.iam.gserviceaccount.com.

Créer un modèle

Créez un modèle distant avec une valeur REMOTE_SERVICE_TYPE de CLOUD_AI_SPEECH_TO_TEXT_V2 :

CREATE OR REPLACE MODEL `PROJECT_ID.DATASET_ID.MODEL_NAME` REMOTE WITH CONNECTION {DEFAULT | `PROJECT_ID.REGION.CONNECTION_ID`} OPTIONS ( REMOTE_SERVICE_TYPE = 'CLOUD_AI_SPEECH_TO_TEXT_V2', SPEECH_RECOGNIZER = 'projects/PROJECT_NUMBER/locations/LOCATION/recognizers/RECOGNIZER_ID' );

Remplacez les éléments suivants :

Transcrire des fichiers audio

Transcrivez des fichiers audio avec la fonction ML.TRANSCRIBE :

SELECT * FROM ML.TRANSCRIBE( MODEL `PROJECT_ID.DATASET_ID.MODEL_NAME`, TABLE `PROJECT_ID.DATASET_ID.OBJECT_TABLE_NAME`, RECOGNITION_CONFIG => ( JSON 'recognition_config') );

Remplacez les éléments suivants :

Exemples

Exemple 1

L'exemple suivant transcrit les fichiers audio représentés par la table audio sans remplacer la configuration par défaut de l'outil de reconnaissance :

SELECT * FROM ML.TRANSCRIBE( MODEL `myproject.mydataset.transcribe_model`, TABLE `myproject.mydataset.audio` );

L'exemple suivant transcrit les fichiers audio représentés par la table audio et fournit une configuration pour l'outil de reconnaissance par défaut :

SELECT * FROM ML.TRANSCRIBE( MODEL `myproject.mydataset.transcribe_model`, TABLE `myproject.mydataset.audio`, recognition_config => ( JSON '{"language_codes": ["en-US" ],"model": "chirp","auto_decoding_config": {}}') );