Memuat data Avro dari Cloud Storage

Avro adalah format data open source yang memaketkan data serial dengan skema data dalam file yang sama.

Saat memuat data Avro dari Cloud Storage, Anda dapat memuat data ke dalam tabel atau partisi baru, atau Anda dapat menambahkan ke atau menimpa tabel atau partisi yang sudah ada. Setelah dimuat ke BigQuery, data Anda akan dikonversi ke format kolom untuk Capacitor (format penyimpanan BigQuery).

Saat Anda memuat data dari Cloud Storage ke tabel BigQuery, set data yang berisi tabel harus berada di lokasi regional atau multi-regional yang sama dengan bucket Cloud Storage.

Untuk mengetahui informasi tentang cara memuat data Avro dari file lokal, lihat Memuat data ke BigQuery dari sumber data lokal.

Batasan

Anda harus tunduk kepada batasan berikut saat memuat data ke BigQuery dari bucket Cloud Storage:

- BigQuery tidak menjamin konsistensi data untuk sumber data eksternal. Perubahan pada data yang mendasari saat kueri berjalan dapat menyebabkan perilaku yang tidak terduga.

- BigQuery tidak mendukung pembuatan versi objek Cloud Storage. Jika Anda menyertakan nomor pembuatan dalam Cloud Storage URI, tugas pemuatan akan gagal.

Batasan berikut juga berlaku saat memuat file Avro ke BigQuery:

- BigQuery tidak mendukung pemuatan file skema Avro (.avsc) mandiri.

- Pemformatan array bertingkat tidak didukung di BigQuery. File Avro yang menggunakan format ini harus dikonversi sebelum diimpor.

- Di file Avro, nama dan namespace untuk nama lengkap hanya boleh berisi karakter alfanumerik dan karakter garis bawah

_. Ekspresi reguler berikut menunjukkan karakter yang diizinkan:[A-Za-z_][A-Za-z0-9_]*.

Untuk mengetahui informasi tentang batas tugas pemuatan BigQuery, lihat Tugas pemuatan.

Persyaratan file input

Untuk menghindari error resourcesExceeded saat memuat file Avro ke BigQuery, ikuti panduan berikut:

- Batasi ukuran baris maksimal 50 MB.

- Jika baris berisi banyak kolom array, atau kolom array yang sangat panjang, bagi nilai array tersebut menjadi kolom terpisah.

Sebelum memulai

Berikan peran Identity and Access Management (IAM) yang memberi pengguna izin yang diperlukan untuk melakukan setiap tugas dalam dokumen ini, serta buat set data dan tabel untuk menyimpan data Anda.

Izin yang diperlukan

Untuk memuat data ke BigQuery, Anda memerlukan izin IAM untuk menjalankan tugas pemuatan dan memuat data ke dalam tabel dan partisi BigQuery. Jika memuat data dari Cloud Storage, Anda juga memerlukan izin IAM untuk mengakses bucket yang berisi data Anda.

Izin untuk memuat data ke BigQuery

Untuk memuat data ke dalam tabel atau partisi BigQuery baru, atau menambahkan atau menimpa tabel atau partisi yang sudah ada, Anda memerlukan izin IAM berikut:

bigquery.tables.createbigquery.tables.updateDatabigquery.tables.updatebigquery.jobs.create

Setiap peran IAM yang telah ditetapkan berikut mencakup izin yang diperlukan untuk memuat data ke dalam tabel atau partisi BigQuery:

roles/bigquery.dataEditorroles/bigquery.dataOwnerroles/bigquery.admin(termasuk izinbigquery.jobs.create)bigquery.user(termasuk izinbigquery.jobs.create)bigquery.jobUser(termasuk izinbigquery.jobs.create)

Selain itu, jika memiliki izin bigquery.datasets.create, Anda dapat membuat dan

memperbarui tabel menggunakan tugas pemuatan dalam set data yang Anda buat.

Untuk mengetahui informasi selengkapnya tentang peran dan izin IAM di BigQuery, lihat Peran dan izin yang telah ditetapkan.

Izin untuk memuat data dari Cloud Storage

Untuk mendapatkan izin yang Anda perlukan untuk memuat data dari bucket Cloud Storage, minta administrator Anda untuk memberi Anda peran IAM Storage Admin (roles/storage.admin) di bucket.

Untuk mengetahui informasi selengkapnya tentang cara memberikan peran, lihat Mengelola akses ke project, folder, dan organisasi.

Peran bawaan ini berisi izin yang diperlukan untuk memuat data dari bucket Cloud Storage. Untuk melihat izin yang benar-benar diperlukan, luaskan bagian Izin yang diperlukan:

Izin yang diperlukan

Izin berikut diperlukan untuk memuat data dari bucket Cloud Storage:

-

storage.buckets.get -

storage.objects.get -

storage.objects.list (required if you are using a URI wildcard)

Anda mungkin juga bisa mendapatkan izin ini dengan peran khusus atau peran bawaan lainnya.

Membuat set data dan tabel

Untuk menyimpan data, Anda harus membuat set data BigQuery, lalu membuat tabel BigQuery di dalam set data tersebut.

Manfaat Avro

Avro adalah format pilihan untuk memuat data ke BigQuery. Pemuatan file Avro memiliki keunggulan berikut dibandingkan CSV dan JSON (dibatasi newline):

- Format biner Avro:

- Lebih cepat dimuat. Data dapat dibaca secara paralel, meskipun blok data dikompresi.

- Tidak memerlukan pengetikan atau serialisasi.

- Lebih mudah diurai karena tidak ditemukan masalah encoding dalam format lain seperti ASCII.

- Saat Anda memuat file Avro ke BigQuery, skema tabel otomatis diambil dari data sumber yang mendeskripsikan formatnya sendiri.

Skema Avro

Saat Anda memuat file Avro ke dalam tabel BigQuery baru, skema tabel otomatis diambil menggunakan data sumber. Saat BigQuery mengambil skema dari data sumber, file terakhir menurut abjad akan digunakan.

Misalnya, Anda memiliki file Avro berikut di Cloud Storage:

gs://mybucket/00/ a.avro z.avro gs://mybucket/01/ b.avro

Menjalankan perintah ini di alat command line bq akan memuat semua file (sebagai daftar yang dipisahkan koma), dan skemanya berasal dari mybucket/01/b.avro:

bq load \ --source_format=AVRO \ dataset.table \ "gs://mybucket/00/*.avro","gs://mybucket/01/*.avro"

Saat mengimpor beberapa file Avro dengan berbagai skema Avro, semua skema harus kompatibel dengan resolusi skema Avro.

Saat BigQuery mendeteksi skema, beberapa jenis data Avro akan dikonversi ke jenis data BigQuery agar kompatibel dengan sintaksis GoogleSQL. Untuk mengetahui informasi selengkapnya, lihat Konversi Avro.

Guna menyediakan skema tabel untuk membuat tabel eksternal, tetapkan propertireferenceFileSchemaUri di BigQuery API atau parameter --reference_file_schema_uri di alat command line bq ke URL file referensi.

Misalnya, --reference_file_schema_uri="gs://mybucket/schema.avro".

Anda juga dapat mengimpor skema ke BigQuery dengan menentukan file skema JSON.

Kompresi Avro

BigQuery mendukung codec kompresi berikut untuk konten file Avro:

SnappyDEFLATEZSTD

Memuat data Avro ke dalam tabel baru

Untuk memuat data Avro dari Cloud Storage ke dalam tabel BigQuery baru, pilih salah satu opsi berikut:

Konsol

Di konsol Google Cloud , buka halaman BigQuery.

Di panel kiri, klik Explorer:

Jika Anda tidak melihat panel kiri, klik Luaskan panel kiri untuk membuka panel.

Di panel Explorer, luaskan project, klik Set data, lalu klik nama set data Anda.

Di panel detail, klik Buat tabel .

Di halaman Create table, di bagian Source:

Untuk Create table from, pilih Google Cloud Storage.

Di kolom sumber, cari atau masukkan Cloud Storage URI. Perhatikan bahwa Anda tidak dapat menyertakan beberapa URI di konsolGoogle Cloud , tetapi karakter pengganti didukung. Bucket Cloud Storage harus berada di lokasi yang sama dengan set data yang berisi tabel yang Anda buat.

Untuk File format, pilih Avro.

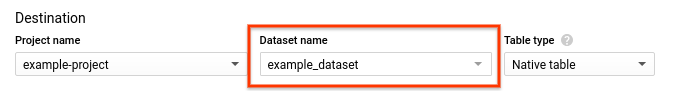

Di halaman Create table, di bagian Destination:

- Untuk Dataset name, pilih set data yang sesuai.

- Pastikan Table type ditetapkan ke Native table.

- Pada kolom Table name, masukkan nama tabel yang Anda buat di BigQuery.

Di bagian Schema, Anda tidak perlu melakukan tindakan apa pun. Skema ini dijelaskan sendiri dalam file Avro.

(Opsional) Untuk mempartisi tabel, pilih opsi Anda di Partition and cluster settings. Untuk mengetahui informasi selengkapnya, lihat Membuat tabel berpartisi.

(Opsional) Untuk Partitioning filter, klik kotak Require partition filter untuk mengharuskan pengguna menyertakan klausa

WHEREyang menentukan partisi yang akan dikueri. Mengharuskan penggunaan filter partisi dapat mengurangi biaya dan meningkatkan performa. Untuk mengetahui informasi selengkapnya, lihat Mewajibkan filter partisi dalam kueri. Opsi ini tidak tersedia jika No partitioning dipilih.(Opsional) Untuk mengelompokkan tabel, di kotak Clustering order, masukkan antara satu dan empat nama kolom.

(Opsional) Klik Advanced options.

- Untuk Write preferences, tetap pilih Write if empty. Opsi ini akan membuat tabel baru dan memuat data Anda ke dalamnya.

- Untuk Unknown values, biarkan opsi Ignore unknown values kosong. Opsi ini hanya berlaku untuk file CSV dan JSON.

- Untuk Encryption, klik Customer-managed key untuk menggunakan kunci Cloud Key Management Service. Jika Anda membiarkan setelan Google-managed key, BigQuery akan mengenkripsi data dalam penyimpanan.

Klik Create table.

SQL

Gunakan pernyataan DDL LOAD DATA.

Contoh berikut memuat file Avro ke dalam tabel baru mytable:

Di konsol Google Cloud , buka halaman BigQuery.

Di editor kueri, masukkan pernyataan berikut:

LOAD DATA OVERWRITE mydataset.mytable FROM FILES ( format = 'avro', uris = ['gs://bucket/path/file.avro']);

Klik Run.

Untuk mengetahui informasi selengkapnya tentang cara menjalankan kueri, lihat artikel Menjalankan kueri interaktif.

bq

Gunakan perintah bq load, tentukan AVRO menggunakan flag --source_format,

dan sertakan Cloud Storage URI.

Anda dapat menyertakan satu URI, daftar URI yang dipisahkan koma, atau URI

yang berisi karakter pengganti.

(Opsional) Berikan flag --location dan tetapkan nilainya ke

lokasi Anda.

Flag opsional lainnya meliputi:

--time_partitioning_type: Mengaktifkan partisi berbasis waktu pada tabel dan menetapkan jenis partisi. Nilai yang mungkin adalahHOUR,DAY,MONTH, danYEAR. Flag ini bersifat opsional saat Anda membuat tabel yang dipartisi pada kolomDATE,DATETIME, atauTIMESTAMP. Jenis partisi default untuk partisi berbasis waktu adalahDAY. Anda tidak dapat mengubah spesifikasi partisi pada tabel yang ada.--time_partitioning_expiration: Bilangan bulat yang menentukan (dalam detik) kapan partisi berbasis waktu harus dihapus. Waktu habis masa berlaku bernilai tanggal UTC partisi ditambah nilai bilangan bulat.--time_partitioning_field: KolomDATEatauTIMESTAMPyang digunakan untuk membuat tabel yang dipartisi. Jika partisi berbasis waktu diaktifkan tanpa nilai ini, tabel berpartisi berdasarkan waktu penyerapan akan dibuat.--require_partition_filter: Jika diaktifkan, opsi ini mengharuskan pengguna menyertakan klausaWHEREyang menentukan partisi yang akan dikueri. Menggunakan filter partisi dapat mengurangi biaya dan meningkatkan performa. Untuk mengetahui informasi selengkapnya, lihat Mewajibkan filter partisi dalam kueri.--clustering_fields: Daftar yang dipisahkan koma yang berisi maksimum empat nama kolom yang digunakan untuk membuat tabel yang dikelompokkan.--destination_kms_key: Kunci Cloud KMS untuk enkripsi data tabel.Untuk mengetahui informasi selengkapnya tentang tabel berpartisi, lihat:

Untuk mengetahui informasi selengkapnya tentang tabel yang dikelompokkan, lihat:

Untuk mengetahui informasi selengkapnya tentang enkripsi tabel, lihat:

Untuk memuat data Avro ke BigQuery, masukkan perintah berikut:

bq --location=location load \ --source_format=format \ dataset.table \ path_to_source

Ganti kode berikut:

- location adalah lokasi Anda. Flag

--locationbersifat opsional. Misalnya, jika menggunakan BigQuery di region Tokyo, Anda dapat menetapkan nilai flag keasia-northeast1. Anda dapat menetapkan nilai default untuk lokasi menggunakan file .bigqueryrc. - format sebesar

AVRO. - dataset adalah set data yang sudah ada.

- table adalah nama tabel tempat Anda memuat data.

- path_to_source adalah Cloud Storage URI yang sepenuhnya memenuhi syarat atau daftar URI yang dipisahkan koma. Karakter pengganti juga didukung.

Contoh:

Perintah berikut memuat data dari gs://mybucket/mydata.avro ke dalam tabel bernama mytable di mydataset.

bq load \

--source_format=AVRO \

mydataset.mytable \

gs://mybucket/mydata.avro

Perintah berikut memuat data dari gs://mybucket/mydata.avro ke dalam tabel berpartisi berdasarkan waktu penyerapan bernama mytable di mydataset.

bq load \

--source_format=AVRO \

--time_partitioning_type=DAY \

mydataset.mytable \

gs://mybucket/mydata.avro

Perintah berikut memuat data dari gs://mybucket/mydata.avro ke dalam tabel berpartisi baru bernama mytable di mydataset. Tabel dipartisi pada kolom mytimestamp.

bq load \

--source_format=AVRO \

--time_partitioning_field mytimestamp \

mydataset.mytable \

gs://mybucket/mydata.avro

Perintah berikut memuat data dari beberapa file di gs://mybucket/

ke dalam tabel bernama mytable di mydataset. Cloud Storage URI menggunakan

karakter pengganti.

bq load \

--source_format=AVRO \

mydataset.mytable \

gs://mybucket/mydata*.avro

Perintah berikut memuat data dari beberapa file di gs://mybucket/

ke dalam tabel bernama mytable di mydataset. Perintah ini menyertakan daftar Cloud Storage URI yang dipisahkan koma dengan karakter pengganti.

bq load \

--source_format=AVRO \

mydataset.mytable \

"gs://mybucket/00/*.avro","gs://mybucket/01/*.avro"

API

Buat tugas

loadyang mengarah ke data sumber di Cloud Storage.(Opsional) Tentukan lokasi Anda di properti

locationdi bagianjobReferencepada resource tugas.Properti

source URIsharus sepenuhnya memenuhi syarat, dalam formatgs://bucket/object. Setiap URI dapat berisi satu karakter pengganti '*'.Tentukan format data Avro dengan menetapkan properti

sourceFormatkeAVRO.Untuk memeriksa status tugas, panggil

jobs.get(job_id*), dengan job_id yang merupakan ID tugas yang ditampilkan oleh permintaan awal.- Jika statusnya

status.state = DONE, tugas berhasil diselesaikan. - Jika properti

status.errorResultada, permintaan gagal, dan objek tersebut akan menyertakan informasi yang menjelaskan penyebabnya. Jika permintaan gagal, tidak ada tabel yang dibuat dan tidak ada data yang dimuat. - Jika

status.errorResulttidak ada, tugas berhasil diselesaikan, meskipun mungkin ada beberapa error non-fatal, seperti masalah mengimpor beberapa baris. Error non-fatal tercantum dalam propertistatus.errorsobjek tugas yang ditampilkan.

- Jika statusnya

Catatan API:

Tugas pemuatan bersifat atomik dan konsisten. Jika tugas pemuatan gagal, tidak ada data yang tersedia, dan jika tugas pemuatan berhasil, semua datanya tersedia.

Sebagai praktik terbaik, buat ID unik dan teruskan sebagai

jobReference.jobIdsaat memanggiljobs.insertuntuk membuat tugas pemuatan. Pendekatan ini lebih tangguh untuk kegagalan jaringan karena klien dapat melakukan polling atau mencoba ulang ID tugas yang diketahui.Memanggil

jobs.insertpada ID tugas tertentu bersifat idempoten. Anda dapat mencoba lagi sebanyak yang Anda inginkan pada ID tugas yang sama, dan maksimal satu dari operasi tersebut akan berhasil.

Go

Sebelum mencoba contoh ini, ikuti petunjuk penyiapan Go di Panduan memulai BigQuery menggunakan library klien. Untuk mengetahui informasi selengkapnya, lihat Dokumentasi referensi BigQuery Go API.

Untuk melakukan autentikasi ke BigQuery, siapkan Kredensial Default Aplikasi. Untuk mengetahui informasi selengkapnya, lihat Menyiapkan autentikasi untuk library klien.

Java

Sebelum mencoba contoh ini, ikuti petunjuk penyiapan Java di Panduan memulai BigQuery menggunakan library klien. Untuk mengetahui informasi selengkapnya, lihat Dokumentasi referensi BigQuery Java API.

Untuk melakukan autentikasi ke BigQuery, siapkan Kredensial Default Aplikasi. Untuk mengetahui informasi selengkapnya, lihat Menyiapkan autentikasi untuk library klien.

Node.js

Sebelum mencoba contoh ini, ikuti petunjuk penyiapan Node.js di Panduan memulai BigQuery menggunakan library klien. Untuk mengetahui informasi selengkapnya, lihat Dokumentasi referensi BigQuery Node.js API.

Untuk melakukan autentikasi ke BigQuery, siapkan Kredensial Default Aplikasi. Untuk mengetahui informasi selengkapnya, lihat Menyiapkan autentikasi untuk library klien.

Python

Sebelum mencoba contoh ini, ikuti petunjuk penyiapan Python di Panduan memulai BigQuery menggunakan library klien. Untuk mengetahui informasi selengkapnya, lihat Dokumentasi referensi BigQuery Python API.

Untuk melakukan autentikasi ke BigQuery, siapkan Kredensial Default Aplikasi. Untuk mengetahui informasi selengkapnya, lihat Menyiapkan autentikasi untuk library klien.

Mengekstrak data JSON dari data Avro

Ada dua cara untuk memastikan bahwa data Avro dimuat ke BigQuery sebagai data JSON:

Anotasikan skema Avro Anda dengan

sqlTypeyang ditetapkan keJSON. Misalnya, jika Anda memuat data dengan skema Avro berikut, kolomjson_fieldakan dibaca sebagai jenisJSON:{ "type": {"type": "string", "sqlType": "JSON"}, "name": "json_field" }

Tentukan skema tabel tujuan BigQuery secara eksplisit dan tetapkan jenis kolom ke

JSON. Untuk mengetahui informasi selengkapnya, lihat Menentukan skema.

Jika Anda tidak menentukan JSON sebagai jenis dalam skema Avro atau skema tabel BigQuery, data akan dibaca sebagai STRING.

Menambahkan atau menimpakan data Avro ke tabel

Anda dapat memuat data tambahan ke dalam tabel dari file sumber atau dengan menambahkan hasil kueri.

Di konsol Google Cloud , gunakan opsi Write preference untuk menentukan tindakan yang harus diambil saat Anda memuat data dari file sumber atau dari hasil kueri.

Anda memiliki opsi berikut saat memuat data tambahan ke dalam tabel:

| Opsi konsol | flag alat bq | Properti BigQuery API | Deskripsi |

|---|---|---|---|

| Tulis jika kosong | Tidak didukung | WRITE_EMPTY |

Menulis data hanya jika tabel kosong. |

| Tambahkan ke tabel | --noreplace atau --replace=false; jika

--[no]replace tidak ditentukan, defaultnya adalah menambahkan |

WRITE_APPEND |

(Default) Menambahkan data ke akhir tabel. |

| Timpa tabel | --replace atau --replace=true |

WRITE_TRUNCATE |

Menghapus semua data yang ada di tabel sebelum menulis data baru. Tindakan ini juga akan menghapus skema tabel, keamanan tingkat baris, dan menghapus semua kunci Cloud KMS. |

Jika Anda memuat data ke dalam tabel yang sudah ada, tugas pemuatan dapat menambahkan data atau menimpa tabel.

Untuk menambahkan atau menimpakan data Avro ke tabel:

Konsol

Di konsol Google Cloud , buka halaman BigQuery.

Di panel kiri, klik Explorer:

Di panel Explorer, luaskan project, klik Set data, lalu klik nama set data Anda.

Di panel detail, klik Buat tabel .

Di halaman Create table, di bagian Source:

- Untuk Create table from, pilih Cloud Storage.

Di kolom sumber, jelajahi atau masukkan Cloud Storage URI. Perhatikan bahwa Anda tidak dapat menyertakan beberapa URI di konsol Google Cloud , tetapi karakter pengganti didukung. Bucket Cloud Storage harus berada di lokasi yang sama dengan set data yang berisi tabel yang Anda tambahkan atau timpa.

Untuk File format, pilih Avro.

Di halaman Create table, di bagian Destination:

Untuk Dataset name, pilih set data yang sesuai.

Di kolom Table name, masukkan nama tabel yang Anda tambahkan atau timpa di BigQuery.

Pastikan Table type ditetapkan ke Native table.

Di bagian Schema, Anda tidak perlu melakukan tindakan apa pun. Skema ini dijelaskan sendiri dalam file Avro.

Untuk Partition and cluster settings, gunakan nilai default. Anda tidak dapat mengonversi tabel menjadi tabel berpartisi atau tabel yang dikelompokkan dengan menambahkan data atau menimpanya, dan konsol Google Cloud tidak mendukung penambahan data ke atau penimpaan tabel berpartisi atau tabel yang dikelompokkan dalam tugas pemuatan.

Klik Advanced options.

- Untuk Write preference, pilih Append to table atau Overwrite table.

- Untuk Unknown values, biarkan opsi Ignore unknown values kosong. Opsi ini hanya berlaku untuk file CSV dan JSON.

- Untuk Encryption, klik Customer-managed key untuk menggunakan kunci Cloud Key Management Service. Jika Anda membiarkan setelan Google-owned and managed key, BigQuery akan mengenkripsi data dalam penyimpanan.

Klik Create table.

SQL

Gunakan pernyataan DDL LOAD DATA.

Contoh berikut menambahkan file Avro ke dalam tabel mytable:

Di konsol Google Cloud , buka halaman BigQuery.

Di editor kueri, masukkan pernyataan berikut:

LOAD DATA INTO mydataset.mytable FROM FILES ( format = 'avro', uris = ['gs://bucket/path/file.avro']);

Klik Run.

Untuk mengetahui informasi selengkapnya tentang cara menjalankan kueri, lihat artikel Menjalankan kueri interaktif.

bq

Masukkan perintah bq load dengan flag --replace untuk menimpa

tabel. Gunakan flag --noreplace untuk menambahkan data ke tabel. Jika tidak ada flag

yang ditentukan, defaultnya adalah menambahkan data. Berikan flag --source_format dan tetapkan ke AVRO. Karena skema Avro otomatis diambil dari data sumber yang mendeskripsikan formatnya sendiri, Anda tidak perlu memberikan definisi skema.

(Opsional) Berikan flag --location dan tetapkan nilainya ke lokasi Anda.

Flag opsional lainnya meliputi:

--destination_kms_key: Kunci Cloud KMS untuk enkripsi data tabel.

bq --location=location load \ --[no]replace \ --source_format=format \ dataset.table \ path_to_source

Ganti kode berikut:

- location adalah lokasi Anda.

Flag

--locationbersifat opsional. Anda dapat menetapkan nilai default untuk lokasi menggunakan file .bigqueryrc. - format sebesar

AVRO. - dataset adalah set data yang sudah ada.

- table adalah nama tabel tempat Anda memuat data.

- path_to_source adalah Cloud Storage URI yang sepenuhnya memenuhi syarat atau daftar URI yang dipisahkan koma. Karakter pengganti juga didukung.

Contoh:

Perintah berikut memuat data dari gs://mybucket/mydata.avro dan

menimpa tabel bernama mytable di mydataset.

bq load \

--replace \

--source_format=AVRO \

mydataset.mytable \

gs://mybucket/mydata.avro

Perintah berikut memuat data dari gs://mybucket/mydata.avro dan menambahkan data ke tabel bernama mytable di mydataset.

bq load \

--noreplace \

--source_format=AVRO \

mydataset.mytable \

gs://mybucket/mydata.avro

Untuk mengetahui informasi tentang cara menambahkan dan menimpa tabel berpartisi menggunakan alat command line bq, lihat: Menambahkan dan menimpa data tabel berpartisi.

API

Buat tugas

loadyang mengarah ke data sumber di Cloud Storage.(Opsional) Tentukan lokasi Anda di properti

locationdi bagianjobReferencepada resource tugas.Properti

source URIsharus sepenuhnya memenuhi syarat, dalam formatgs://bucket/object. Anda dapat menyertakan beberapa URI sebagai daftar yang dipisahkan koma. Perlu diperhatikan bahwa karakter pengganti juga didukung.Tentukan format data dengan menetapkan properti

configuration.load.sourceFormatkeAVRO.Tentukan preferensi tulis dengan menetapkan properti

configuration.load.writeDispositionkeWRITE_TRUNCATEatauWRITE_APPEND.

Go

Sebelum mencoba contoh ini, ikuti petunjuk penyiapan Go di Panduan memulai BigQuery menggunakan library klien. Untuk mengetahui informasi selengkapnya, lihat Dokumentasi referensi BigQuery Go API.

Untuk melakukan autentikasi ke BigQuery, siapkan Kredensial Default Aplikasi. Untuk mengetahui informasi selengkapnya, lihat Menyiapkan autentikasi untuk library klien.

Java

Sebelum mencoba contoh ini, ikuti petunjuk penyiapan Java di Panduan memulai BigQuery menggunakan library klien. Untuk mengetahui informasi selengkapnya, lihat Dokumentasi referensi BigQuery Java API.

Untuk melakukan autentikasi ke BigQuery, siapkan Kredensial Default Aplikasi. Untuk mengetahui informasi selengkapnya, lihat Menyiapkan autentikasi untuk library klien.

Node.js

Sebelum mencoba contoh ini, ikuti petunjuk penyiapan Node.js di Panduan memulai BigQuery menggunakan library klien. Untuk mengetahui informasi selengkapnya, lihat Dokumentasi referensi BigQuery Node.js API.

Untuk melakukan autentikasi ke BigQuery, siapkan Kredensial Default Aplikasi. Untuk mengetahui informasi selengkapnya, lihat Menyiapkan autentikasi untuk library klien.

Python

Sebelum mencoba contoh ini, ikuti petunjuk penyiapan Python di Panduan memulai BigQuery menggunakan library klien. Untuk mengetahui informasi selengkapnya, lihat Dokumentasi referensi BigQuery Python API.

Untuk melakukan autentikasi ke BigQuery, siapkan Kredensial Default Aplikasi. Untuk mengetahui informasi selengkapnya, lihat Menyiapkan autentikasi untuk library klien.

Memuat data Avro yang dipartisi hive

BigQuery mendukung pemuatan data Avro yang dipartisi hive yang disimpan di Cloud Storage dan mengisi kolom partisi hive sebagai kolom di tabel terkelola BigQuery tujuan. Untuk mengetahui informasi selengkapnya, baca Memuat Data yang Dipartisi secara Eksternal dari Cloud Storage.

Konversi Avro

BigQuery mengonversi jenis data Avro ke jenis data BigQuery berikut:

Jenis primitif

| Jenis data BigQuery | Catatan | |

|---|---|---|

| null | BigQuery mengabaikan nilai ini | |

| boolean | BOOLEAN | |

| int | INTEGER | |

| long | INTEGER | |

| float | FLOAT | |

| double | FLOAT | |

| byte | BYTES | |

| string | STRING | Khusus UTF-8 |

Jenis logika

Secara default, BigQuery mengabaikan atribut logicalType untuk sebagian besar jenis dan menggunakan jenis Avro yang mendasarinya. Untuk mengonversi jenis logika Avro ke jenis data BigQuery yang sesuai, tetapkan flag --use_avro_logical_types ke true menggunakan alat command line bq, atau tetapkan properti useAvroLogicalTypes di resource tugas saat Anda memanggil metode jobs.insert untuk membuat tugas pemuatan.

Tabel di bawah menampilkan konversi jenis logika Avro ke jenis data BigQuery.

| Jenis data BigQuery: Jenis logika dinonaktifkan | Jenis data BigQuery: Jenis logika diaktifkan | |

|---|---|---|

| tanggal | INTEGER | DATE |

| time-millis | INTEGER | WAKTU |

| time-micros | INTEGER (dikonversi dari LONG) | WAKTU |

| timestamp-millis | INTEGER (dikonversi dari LONG) | TIMESTAMP |

| timestamp-micros | INTEGER (dikonversi dari LONG) | TIMESTAMP |

| local-timestamp-millis | INTEGER (dikonversi dari LONG) | DATETIME |

| local-timestamp-micros | INTEGER (dikonversi dari LONG) | DATETIME |

| durasi | BYTES (dikonversi dari jenis fixed ukuran 12) |

BYTES (dikonversi dari jenis fixed ukuran 12) |

| decimal | NUMERIC, BIGNUMERIC, atau STRING (lihat Jenis logika decimal (desimal)) | NUMERIC, BIGNUMERIC, atau STRING (lihat Jenis logika decimal (desimal)) |

Untuk mengetahui informasi selengkapnya tentang jenis data Avro, lihat Spesifikasi Apache Avro™ 1.8.2.

Jenis logika date (tanggal)

Pada file Avro yang ingin dimuat, Anda harus menentukan jenis logika date (tanggal) dalam format berikut:

{

"type": {"logicalType": "date", "type": "int"},

"name": "date_field"

}

Jenis logika decimal (desimal)

Jenis logika Decimal dapat dikonversi menjadi jenis NUMERIC, BIGNUMERIC, atau STRING. Jenis yang dikonversi bergantung

pada parameter presisi dan skala dari jenis logika decimal dan

jenis target desimal yang ditentukan. Tentukan jenis target desimal sebagai berikut:

- Untuk tugas pemuatan menggunakan

jobs.insertAPI: gunakan kolomJobConfigurationLoad.decimalTargetTypes. - Untuk tugas pemuatan menggunakan

perintah

bq loadpada alat command line bq: gunakan flag--decimal_target_types. - Untuk kueri terhadap tabel dengan sumber eksternal:

gunakan kolom

ExternalDataConfiguration.decimalTargetTypes. - Untuk tabel eksternal persisten yang dibuat dengan DDL: gunakan opsi

decimal_target_types.

Untuk kompatibilitas mundur, jika jenis target desimal tidak ditentukan, Anda dapat memuat file Avro yang berisi kolom bytes dengan jenis logika decimal ke dalam kolom BYTES pada tabel sementara. Dalam hal ini, jenis logika decimal pada kolom dalam file Avro akan diabaikan. Mode konversi ini tidak digunakan lagi dan mungkin akan dihapus pada masa mendatang.

Untuk mengetahui informasi selengkapnya tentang jenis logika decimal, lihat Spesifikasi Apache Avro™ 1.8.2 Specification.

Jenis logika time (waktu)

Pada file Avro yang ingin dimuat, Anda harus menentukan jenis logika time (waktu) dalam salah satu format berikut.

Untuk presisi milidetik:

{

"type": {"logicalType": "time-millis", "type": "int"},

"name": "time_millis_field"

}

Untuk presisi mikrodetik:

{

"type": {"logicalType": "time-micros", "type": "int"},

"name": "time_micros_field"

}

Jenis logika timestamp (stempel waktu)

Pada file Avro yang ingin dimuat, Anda harus menentukan jenis logika timestamp (stempel waktu) dalam salah satu format berikut.

Untuk presisi milidetik:

{

"type": {"logicalType": "timestamp-millis", "type": "long"},

"name": "timestamp_millis_field"

}

Untuk presisi mikrodetik:

{

"type": {"logicalType": "timestamp-micros", "type": "long"},

"name": "timestamp_micros_field"

}

Jenis logika local-timestamp (stempel waktu lokal)

Dalam file Avro yang ingin dimuat, Anda harus menentukan jenis logika local-timestamp (stempel waktu lokal) dalam salah satu format berikut.

Untuk presisi milidetik:

{

"type": {"logicalType": "local-timestamp-millis", "type": "long"},

"name": "local_timestamp_millis_field"

}

Untuk presisi mikrodetik:

{

"type": {"logicalType": "local-timestamp-micros", "type": "long"},

"name": "local_timestamp_micros_field"

}

Jenis kompleks

| Jenis data BigQuery | Catatan | |

|---|---|---|

| record | RECORD |

|

| enum | STRING |

|

| array | kolom berulang | Array array tidak didukung. Array yang hanya berisi jenis NULL akan diabaikan. |

| map<T> | RECORD | BigQuery mengonversi kolom map<T> Avro ke RECORD berulang yang berisi dua kolom: kunci dan nilai. BigQuery menyimpan kunci sebagai STRING, dan mengonversi nilai ke jenis data yang sesuai di BigQuery. |

| gabungan |

|

|

| tetap | BYTES |

|