Vertex Explainable AI fournit des fonctionnalités de visualisation intégrées pour vos données d'image. Vous pouvez configurer les visualisations pour des modèles d'images entraînés.

Lorsque vous demandez une explication sur un modèle de classification d'images, vous obtenez la classe prédite ainsi qu'une superposition d'image indiquant les pixels ou régions ayant contribué à la prédiction.

Les images suivantes montrent des visualisations sur une image de husky. La visualisation de gauche utilise la méthode des gradients intégrés et met en évidence les zones d'attribution positive. La visualisation de droite utilise la méthode XRAI avec un dégradé de couleurs pour indiquer les zones les moins influentes (bleue) et les zones les plus influentes (jaune) lors d'une prédiction positive.

Le type de données peut influer sur la visualisation des explications selon que vous utilisez des gradients intégrés ou la méthode XRAI.

- La méthode XRAI s'avère généralement plus efficace avec les images naturelles, car elle fournit un résumé plus détaillé des insights, par exemple pour montrer que l'attribution positive est liée à la forme de la tête d'un chien.

- Les gradients intégrés ont tendance à fournir des détails au niveau des pixels et permettent de dégager des attributions plus précises.

Pour en savoir plus sur les méthodes d'attribution, consultez la page de présentation de Vertex Explainable AI.

Premiers pas

Configurez la visualisation lorsque vous créez une ressource Model compatible avec Vertex Explainable AI ou lorsque vous remplacez la valeur ExplanationSpec du Model.

Pour configurer la visualisation pour votre modèle, renseignez le champ visualization du message InputMetadata correspondant à la fonctionnalité que vous souhaitez visualiser. Dans ce message de configuration, vous pouvez inclure des options telles que le type de superposition utilisée, les attributions mises en surbrillance, la couleur, etc… Tous les paramètres sont facultatifs.

Options de visualisation

Les paramètres par défaut et les paramètres recommandés dépendent de la méthode d'attribution choisie (gradient intégré ou XRAI). La liste suivante décrit les options de configuration et explique comment les utiliser. Pour obtenir la liste complète des options, consultez la documentation de référence de l'API pour le message Visualization.

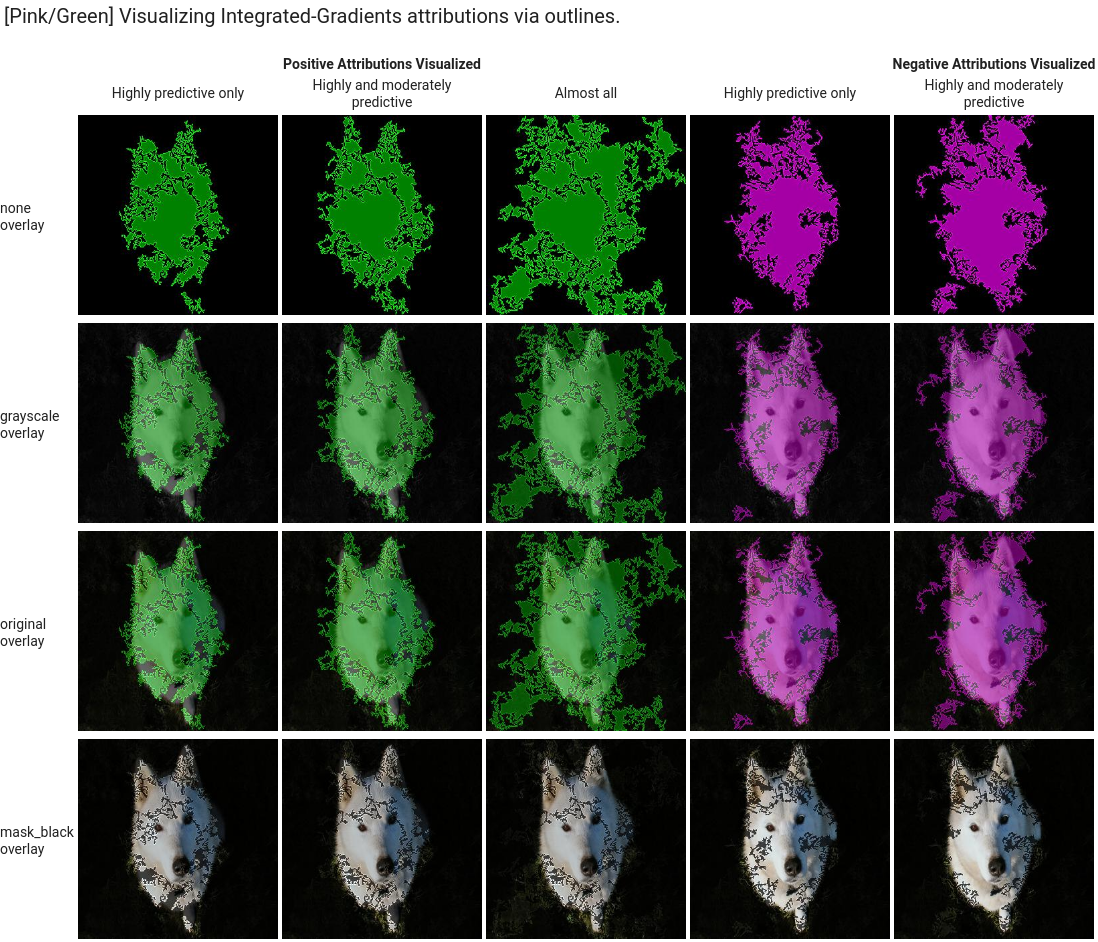

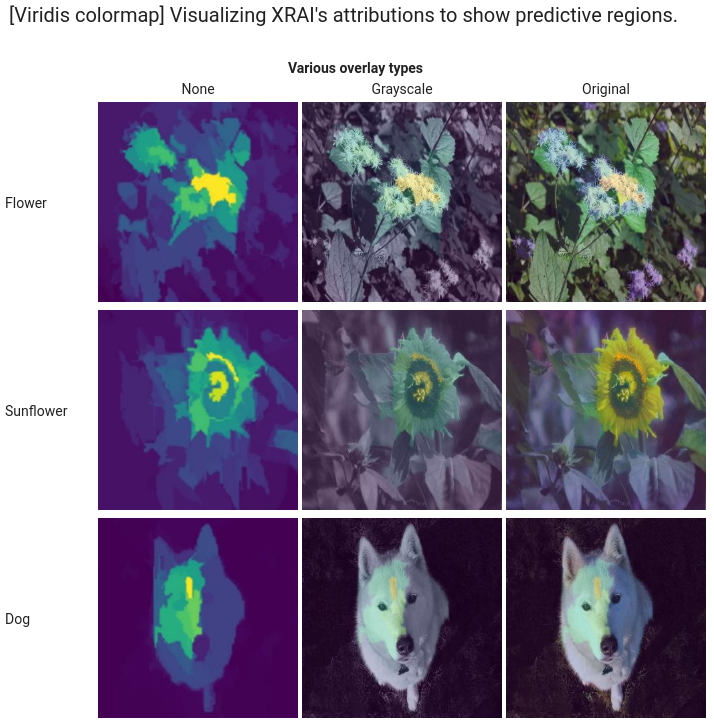

type: type de visualisation utilisé :OUTLINESouPIXELS. La valeur par défaut du champtypeestOUTLINES, qui indique les régions d'attribution. Pour afficher l'attribution par pixel, définissez le champ surPIXELS.polarity: orientation des attributions mises en évidence. Le paramètrepositiveest défini par défaut. Il met en évidence les zones à forte attribution positive. Cela consiste à mettre en évidence les pixels les plus influents sur la prédiction positive du modèle. Le paramètre de polarité défini surnegativemet en évidence les zones qui influencent le modèle à ne pas prédire la classe positive. L'utilisation d'une polarité négative peut être utile pour déboguer votre modèle, car elle identifie les fausses régions négatives. Vous pouvez également définir la polarité surboth, ce qui met en évidence les attributions positives et négatives.clip_percent_upperbound: exclut les attributions supérieures au centile spécifié des zones mises en évidence. L'utilisation conjointe des paramètres de bornement peut être utile pour filtrer le bruit et faciliter la visualisation des zones à forte attribution.clip_percent_lowerbound: exclut les attributions inférieures au centile spécifié des zones mises en évidence.color_map: jeu de couleurs utilisé pour les zones mises en évidence. Pour les gradients intégrés, la valeur par défaut estpink_green, ce qui met en évidence les attributions positives en vert et les attributions négatives en rose. Pour les visualisations XRAI, la carte de couleurs est un gradient. Pour la méthode XRAI, la valeur par défaut estviridis, ce qui met en évidence les régions les plus influentes en jaune et les régions les moins influentes en bleu.Pour obtenir la liste complète des valeurs possibles, consultez la documentation de référence de l'API pour le message

Visualization.overlay_type: mode d'affichage de l'image d'origine dans la visualisation. L'ajustement de la superposition permet d'améliorer la clarté visuelle lorsque l'image d'origine rend la visualisation difficile.Pour obtenir la liste complète des valeurs possibles, consultez la documentation de référence de l'API pour le message

Visualization.

Exemples de configurations

Pour commencer, vous trouverez ci-dessous des exemples de configurations Visualization que vous pouvez utiliser comme point de départ ainsi que des images indiquant une plage de paramètres appliqués.

Gradients intégrés

Pour les gradients intégrés, vous devrez peut-être ajuster les valeurs de bornement si les zones d'attribution comportent trop de bruit.

visualization: {

"type": "OUTLINES",

"polarity": "positive",

"clip_percent_lowerbound": 70,

"clip_percent_upperbound": 99.9,

"color_map": "pink_green",

"overlay_type": "grayscale"

}

Les visualisations suivantes utilisent à la fois les types outlines et pixels. Les colonnes libellées "Highly predictive only" (Hautement prédictif uniquement), "Moderately predictive" (Moyennement prédictif) et "Almost all" (Presque tous) sont des exemples de bornement à différents niveaux, qui peuvent vous aider à cibler la visualisation.

![]()

XRAI

Pour les visualisations XRAI, nous vous recommandons de commencer sans les valeurs de bornement, car la superposition affiche les zones de forte attribution et de faible attribution à l'aide d'un gradient.

visualization: {

"type": "PIXELS",

"polarity": "positive",

"clip_percent_lowerbound": 0,

"clip_percent_upperbound": 100,

"color_map": "viridis",

"overlay_type": "grayscale"

}

L'image suivante est une visualisation XRAI qui utilise la carte de couleurs viridis par défaut et divers types de superposition. Les zones en jaune correspondent aux régions les plus influentes qui ont contribué positivement à la prédiction.

Étape suivante

- Pour en savoir plus sur les autres options de configuration de Vertex Explainable AI, consultez la page Configurer des explications pour les modèles personnalisés.