Introduzione

Questa guida per principianti introduce AutoML. Per comprendere le principali differenze tra AutoML e l'addestramento personalizzato, consulta Scegliere un metodo di addestramento.

Immagina:

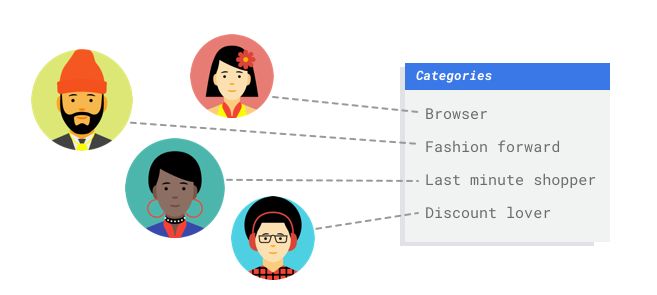

- Lavori nel reparto marketing di un rivenditore digitale.

- Stai lavorando a un progetto architettonico che identifica i tipi di edifici.

- La tua attività ha un modulo di contatto sul suo sito web.

La selezione manuale di immagini e tabelle è noiosa e richiede molto tempo. Insegna a un computer a identificare e segnalare automaticamente i contenuti.

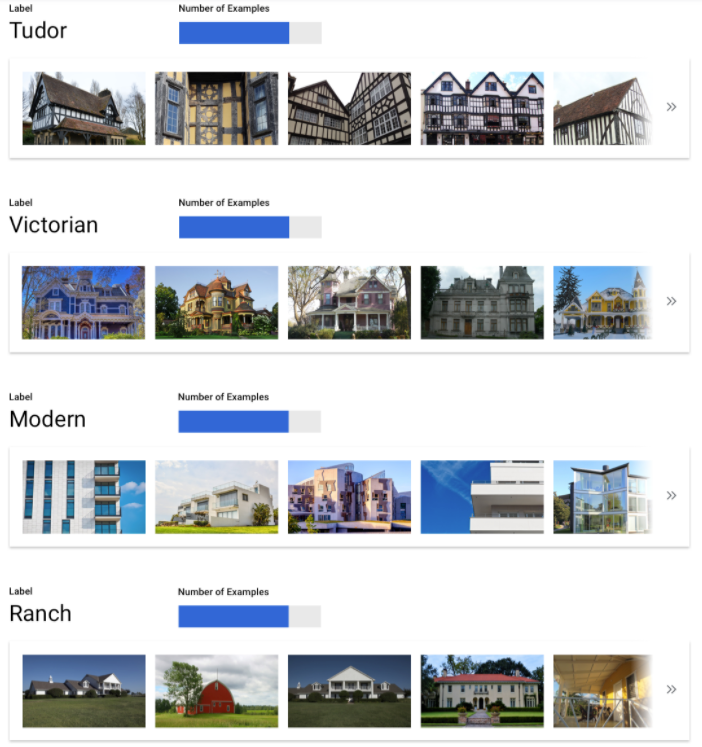

Immagine

Lavori con un consiglio per la conservazione architettonica che sta cercando di identificare

i quartieri della tua città che hanno uno stile architettonico coerente. Hai centinaia di migliaia di snapshot di case da esaminare. Tuttavia, è noioso e soggetto a errori quando

si tenta di classificare tutte queste immagini manualmente. Un tirocinante ne ha etichettati alcune centinaia

qualche mese fa, ma nessun altro ha esaminato i dati. Sarebbe molto utile se potessi insegnare

al tuo computer a fare questa revisione per te.

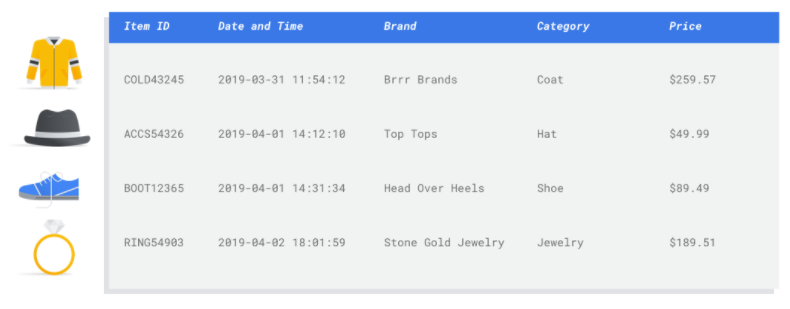

Tabulare

Lavori nel reparto marketing di un rivenditore digitale. Tu e il tuo team state

creando un programma email personalizzato basato sulle buyer persona. Hai creato le buyer persona e le email di marketing sono pronte per essere inviate. Ora devi creare un sistema che raggruppi i clienti in ogni buyer persona in base alle preferenze di vendita al dettaglio e al comportamento di spesa, anche quando si tratta di nuovi clienti. Per massimizzare il coinvolgimento dei clienti, vuoi anche prevedere le loro abitudini di spesa in modo da poter ottimizzare i tempi di invio delle email.

In qualità di rivenditore digitale, disponi di dati sui tuoi clienti e sugli acquisti che hanno effettuato. Ma che dire dei nuovi clienti? Gli approcci tradizionali possono calcolare questi valori per i clienti esistenti con lunghe cronologie acquisti, ma non funzionano bene con i clienti con pochi dati storici. E se potessi creare un sistema per prevedere questi valori e aumentare la velocità con cui offri programmi di marketing personalizzati a tutti i tuoi clienti?

Fortunatamente, il machine learning e Vertex AI sono ben posizionati per risolvere questi problemi.

Questa guida illustra il funzionamento di Vertex AI per i set di dati e i modelli AutoML e illustra i tipi di problemi che Vertex AI risolve.

Una nota sull'equità

Google si impegna a fare progressi nel rispetto delle pratiche di AI responsabile. A questo scopo, i nostri prodotti di ML, tra cui AutoML, sono progettati in base a principi fondamentali come l'equità e l'apprendimento automatico incentrato sull'essere umano. Per saperne di più sulle best practice per ridurre il bias durante la creazione del tuo sistema ML, consulta la Guida al machine learning inclusivo - AutoML.

Perché Vertex AI è lo strumento giusto per questo problema?

La programmazione classica richiede al programmatore di specificare istruzioni passo passo che il computer deve seguire. Esistono così tante variazioni di colore, angolazione, risoluzione e illuminazione che è necessario codificare troppe regole per indicare a una macchina come prendere la decisione corretta. È difficile immaginare da dove iniziare. Oppure, i commenti dei clienti utilizzano un vocabolario e una struttura ampi e variegati e sono troppo diversi per essere acquisiti da un semplice insieme di regole. Se provi a creare filtri manuali, ti accorgi subito che non riesci a classificare la maggior parte dei commenti dei clienti. Hai bisogno di un sistema che possa generalizzare un'ampia gamma di commenti. In uno scenario in cui una sequenza di regole specifiche è destinata a espandersi in modo esponenziale, hai bisogno di un sistema che possa apprendere dagli esempi.

Fortunatamente, il machine learning risolve questi problemi.

Come funziona Vertex AI?

Vertex AI prevede attività di apprendimento supervisionato per raggiungere un risultato scelto. I dettagli dell'algoritmo e dei metodi di addestramento cambiano in base al tipo di dati e al caso d'uso. Esistono molte sottocategorie diverse di machine learning, ognuna delle quali risolve problemi diversi e opera entro vincoli diversi.

Immagine

Addestri, testi e convalidi il modello di machine learning con immagini di esempio annotate con etichette per la classificazione o con etichette e riquadri di delimitazione per il rilevamento di oggetti. Utilizzando l'apprendimento supervisionato, puoi addestrare un modello a riconoscere i pattern e i contenuti che ti interessano nelle immagini.

Tabulare

Addestri un modello di machine learning con dati di esempio. Vertex AI

utilizza i dati tabulari (strutturati) per addestrare un modello di machine learning per fare

inferenze sui nuovi dati. Il modello imparerà a fare previsioni sui dati di una singola colonna del set di dati, chiamata target. Alcune delle altre colonne di dati

sono gli input (chiamati caratteristiche) da cui il modello apprenderà i pattern. Puoi

utilizzare le stesse caratteristiche di input per creare diversi tipi di modelli semplicemente modificando

la colonna target e le opzioni di addestramento. Dall'esempio di email marketing, ciò

significa che potresti creare modelli con le stesse caratteristiche di input, ma con inferenze

di target diverse. Un modello potrebbe prevedere la persona tipo di un cliente (un

target categorico), un altro modello potrebbe prevedere la sua spesa mensile (un

target numerico) e un altro ancora potrebbe prevedere la domanda giornaliera dei tuoi prodotti

per i prossimi tre mesi (una serie di target numerici).

Flusso di lavoro di Vertex AI

Vertex AI utilizza un flusso di lavoro di machine learning standard:

- Raccogli i dati: determina i dati necessari per l'addestramento e il test del modello in base al risultato che vuoi ottenere.

- Prepara i dati: assicurati che siano formattati ed etichettati correttamente.

- Addestra: imposta i parametri e crea il modello.

- Valuta: esamina le metriche del modello.

- Esegui il deployment e la previsione: rendi disponibile il tuo modello.

Preparazione dei dati

Ma prima di iniziare a raccogliere i dati, pensa al problema che stai cercando di risolvere. Ciò determina i requisiti dei dati.

Valuta il tuo caso d'uso

Inizia dal tuo problema: qual è il risultato che vuoi ottenere?

Immagine

Quando crei il set di dati, inizia sempre dal tuo caso d'uso. Puoi iniziare con le seguenti domande:

- Qual è il risultato che stai cercando di ottenere?

- Quali tipi di categorie o oggetti dovresti riconoscere per raggiungere questo risultato?

- È possibile per gli esseri umani riconoscere queste categorie? Sebbene Vertex AI possa gestire un numero maggiore di categorie rispetto a quelle che gli esseri umani possono ricordare e assegnare in un determinato momento, se un essere umano non riesce a riconoscere una categoria specifica, anche Vertex AI avrà difficoltà.

- Quali tipi di esempi riflettono meglio il tipo e l'intervallo di dati che il sistema vedrà e cercherà di classificare?

Tabulare

Che tipo di dati contiene la colonna target? A quanti dati hai accesso? In base alle tue risposte, Vertex AI crea il modello necessario per risolvere il tuo caso d'uso:

- Un modello di classificazione binaria prevede un risultato binario (una delle due classi). Utilizza questo tipo di domanda per domande con risposta sì o no, ad esempio per prevedere se un cliente acquisterà un abbonamento (o meno). A parità di condizioni, un problema di classificazione binaria richiede meno dati rispetto ad altri tipi di modelli.

- Un modello di classificazione multi-classe prevede una classe da tre o più classi discrete. Utilizzalo per categorizzare gli elementi. Per l'esempio di vendita al dettaglio, ti consigliamo di creare un modello di classificazione multiclasse per segmentare i clienti in diverse buyer persona.

- Un modello di previsione prevede una sequenza di valori. Ad esempio, in qualità di rivenditore, potresti voler prevedere la domanda giornaliera dei tuoi prodotti per i prossimi tre mesi, in modo da poter fare scorta di inventari in anticipo.

- Un modello di regressione prevede un valore continuo. Per l'esempio di vendita al dettaglio, ti consigliamo di creare un modello di regressione per prevedere quanto spenderà un cliente il mese successivo.

Raccogliere i dati

Dopo aver stabilito il caso d'uso, raccogli i dati che ti consentono di creare il modello che preferisci.

Immagine

Dopo aver stabilito quali dati ti servono, devi trovare un modo per procurarteli. Puoi

iniziare prendendo in considerazione tutti i dati raccolti dalla tua organizzazione. Potresti scoprire di

raccogliere già i dati pertinenti necessari per addestrare un modello. Se non disponi di questi dati,

puoi ottenerli manualmente o esternalizzarli a un fornitore di terze parti.

Dopo aver stabilito quali dati ti servono, devi trovare un modo per procurarteli. Puoi

iniziare prendendo in considerazione tutti i dati raccolti dalla tua organizzazione. Potresti scoprire di

raccogliere già i dati pertinenti necessari per addestrare un modello. Se non disponi di questi dati,

puoi ottenerli manualmente o esternalizzarli a un fornitore di terze parti.

Includi un numero sufficiente di esempi etichettati in ogni categoria

Il minimo indispensabile richiesto da Vertex AI Training è di 100 esempi di immagini per categoria/etichetta per la classificazione.

La probabilità di riconoscere correttamente un'etichetta aumenta con il numero di esempi di alta qualità per ciascuna. In generale, più dati etichettati puoi portare al processo di addestramento, migliore sarà il modello. Scegli come target almeno 1000 esempi per etichetta.

Il minimo indispensabile richiesto da Vertex AI Training è di 100 esempi di immagini per categoria/etichetta per la classificazione.

La probabilità di riconoscere correttamente un'etichetta aumenta con il numero di esempi di alta qualità per ciascuna. In generale, più dati etichettati puoi portare al processo di addestramento, migliore sarà il modello. Scegli come target almeno 1000 esempi per etichetta.

Distribuire gli esempi in modo uniforme tra le categorie

È importante acquisire quantità di esempi di addestramento più o meno simili per ogni categoria. Anche

se hai molti dati per un'etichetta, è meglio avere una distribuzione uniforme per

ogni etichetta. Per capire il motivo, immagina che l'80% delle immagini che utilizzi per creare il modello siano foto

di case unifamiliari in stile moderno. Con una distribuzione così sbilanciata delle etichette, è molto probabile che il modello impari che è sicuro dirti che una foto è di una casa unifamiliare moderna, piuttosto che rischiare di prevedere un'etichetta molto meno comune.

È come scrivere un test a scelta multipla in cui quasi tutte le risposte corrette sono "C". Presto

il tuo studente esperto capirà che può rispondere "C" ogni volta senza nemmeno guardare

la domanda.

Ci rendiamo conto che potrebbe non essere sempre possibile trovare un numero di esempi approssimativamente uguale per ogni etichetta. Potrebbe essere più difficile trovare esempi imparziali e di alta qualità per alcune categorie. In queste circostanze, puoi seguire questa regola empirica: l'etichetta con il numero più basso di esempi deve avere almeno il 10% degli esempi dell'etichetta con il numero più alto di esempi. Quindi, se l'etichetta più grande ha 10.000 esempi, l'etichetta più piccola deve averne almeno 1000.

Acquisire la variazione nello spazio del problema

Per motivi simili, cerca di assicurarti che i tuoi dati catturino la varietà e la diversità del tuo

spazio dei problemi. Più ampia è la selezione che il processo di addestramento del modello riesce a vedere, più facilmente

generalizzerà i nuovi esempi. Ad esempio, se stai cercando di classificare le foto di elettronica di consumo in categorie, più ampia è la varietà di elettronica di consumo a cui il modello è esposto durante l'addestramento, più è probabile che sia in grado di distinguere tra un nuovo modello di tablet, smartphone o laptop, anche se non ha mai visto quel modello specifico prima.

Far corrispondere i dati all'output previsto per il modello

Trova immagini visivamente simili a quelle su cui prevedi di fare inferenze. Se stai

cercando di classificare immagini di case scattate tutte in condizioni climatiche invernali nevose, probabilmente non

otterrai un ottimo rendimento da un modello addestrato solo su immagini di case scattate in condizioni di sole, anche se

le hai taggate con le classi che ti interessano, poiché l'illuminazione e lo scenario potrebbero essere

abbastanza diversi da influire sul rendimento. Idealmente, gli esempi di addestramento sono dati reali

estratti dallo stesso set di dati che prevedi di utilizzare per classificare il modello.

Tabulare

Dopo aver stabilito il caso d'uso, devi raccogliere i dati per addestrare il modello.

L'ottenimento e la preparazione dei dati sono passaggi fondamentali per la creazione di un modello di machine learning.

I dati a tua disposizione determinano il tipo di problemi che puoi risolvere. Quanti dati hai a disposizione? I dati sono pertinenti alle domande a cui stai cercando di rispondere? Durante la

raccolta dei dati, tieni presente le seguenti considerazioni chiave.

Dopo aver stabilito il caso d'uso, devi raccogliere i dati per addestrare il modello.

L'ottenimento e la preparazione dei dati sono passaggi fondamentali per la creazione di un modello di machine learning.

I dati a tua disposizione determinano il tipo di problemi che puoi risolvere. Quanti dati hai a disposizione? I dati sono pertinenti alle domande a cui stai cercando di rispondere? Durante la

raccolta dei dati, tieni presente le seguenti considerazioni chiave.

Seleziona le funzionalità pertinenti

Una funzionalità è un attributo di input utilizzato per l'addestramento del modello. Le funzionalità sono il modo in cui il modello identifica i pattern per fare inferenze, quindi devono essere pertinenti al problema. Ad esempio, per creare un modello che preveda se una transazione con carta di credito è fraudolenta o meno, devi creare un set di dati che contenga i dettagli della transazione, come acquirente, venditore, importo, data e ora e articoli acquistati. Altre funzionalità utili potrebbero essere informazioni storiche sull'acquirente e sul venditore e la frequenza con cui l'articolo acquistato è stato coinvolto in frodi. Quali altre funzionalità potrebbero essere pertinenti?

Considera il caso d'uso del marketing via email per la vendita al dettaglio dell'introduzione. Ecco alcune colonne delle funzionalità che potresti richiedere:

- Elenco degli articoli acquistati (inclusi brand, categorie, prezzi, sconti)

- Numero di articoli acquistati (ultimo giorno, settimana, mese, anno)

- Somma di denaro speso (ultimo giorno, settimana, mese, anno)

- Per ogni articolo, il numero totale venduto ogni giorno

- Per ogni articolo, il totale disponibile ogni giorno

- Se stai organizzando una promozione per un giorno specifico

- Profilo demografico noto dell'acquirente

Includere dati sufficienti

In generale, più esempi di addestramento hai, migliore sarà il risultato. La quantità di dati di esempio

richiesti varia anche in base alla complessità del problema che stai cercando di risolvere. Non avrai bisogno di tanti dati per ottenere un modello di classificazione binaria accurato rispetto a un modello multiclasse

perché è meno complicato prevedere una classe da due piuttosto che da molte.

In generale, più esempi di addestramento hai, migliore sarà il risultato. La quantità di dati di esempio

richiesti varia anche in base alla complessità del problema che stai cercando di risolvere. Non avrai bisogno di tanti dati per ottenere un modello di classificazione binaria accurato rispetto a un modello multiclasse

perché è meno complicato prevedere una classe da due piuttosto che da molte.

Non esiste una formula perfetta, ma sono consigliati valori minimi per i dati di esempio:

- Problema di classificazione: 50 righe x il numero di caratteristiche

- Problema di previsione:

- 5000 righe x il numero di caratteristiche

- 10 valori univoci nella colonna dell'identificatore della serie temporale x il numero di funzionalità

- Problema di regressione: 200 x il numero di funzionalità

Acquisizione della variante

Il set di dati deve riflettere la diversità dello spazio del problema. Più esempi diversi vede un modello durante l'addestramento, più facilmente può generalizzare a esempi nuovi o meno comuni. Immagina se il tuo modello di vendita al dettaglio fosse addestrato solo utilizzando i dati di acquisto invernali. Sarebbe in grado di prevedere correttamente le preferenze di abbigliamento estivo o i comportamenti di acquisto?

Preparare i dati

Immagine

Dopo aver deciso quale è la soluzione più adatta a te, una suddivisione manuale o quella predefinita, puoi aggiungere i dati in

Vertex AI utilizzando uno dei seguenti metodi:

Dopo aver deciso quale è la soluzione più adatta a te, una suddivisione manuale o quella predefinita, puoi aggiungere i dati in

Vertex AI utilizzando uno dei seguenti metodi:

- Puoi importare i dati dal computer o da Cloud Storage in un formato disponibile (CSV o JSON Lines) con le etichette (e i riquadri di selezione, se necessario) in linea. Per saperne di più sul formato del file di importazione, consulta Preparare i dati di addestramento. Se vuoi dividere manualmente il set di dati, puoi specificare le suddivisioni nel file di importazione CSV o JSON Lines.

- Se i tuoi dati non sono stati annotati, puoi caricare immagini senza etichette e utilizzare la console Google Cloud per applicare le annotazioni. Puoi gestire queste annotazioni in più set di annotazioni per lo stesso insieme di immagini. Ad esempio, per un singolo set di immagini puoi avere un set di annotazioni con informazioni su riquadro di delimitazione ed etichetta per eseguire il rilevamento degli oggetti e anche un altro set di annotazioni con solo annotazioni di etichette per la classificazione.

Tabulare

Dopo aver identificato i dati disponibili, devi assicurarti che siano pronti per l'addestramento.

Se i dati sono distorti o contengono valori mancanti o errati, la qualità del modello ne risente. Prima di iniziare ad addestrare il modello, considera quanto segue.

Scopri di più.

Dopo aver identificato i dati disponibili, devi assicurarti che siano pronti per l'addestramento.

Se i dati sono distorti o contengono valori mancanti o errati, la qualità del modello ne risente. Prima di iniziare ad addestrare il modello, considera quanto segue.

Scopri di più.

Prevenire la perdita di dati e il disallineamento tra addestramento e distribuzione

La perdita di dati si verifica quando utilizzi feature di input durante l'addestramento che "rivelano" informazioni sul target che stai cercando di prevedere e che non sono disponibili quando il modello viene effettivamente utilizzato. Ciò può essere rilevato quando una funzionalità altamente correlata alla colonna target viene inclusa come una delle funzionalità di input. Ad esempio, se stai creando un modello per prevedere se un cliente si abbonerà il mese successivo e una delle funzionalità di input è un futuro pagamento dell'abbonamento da parte di quel cliente. Ciò può portare a un buon rendimento del modello durante il test, ma non durante il deployment in produzione, poiché i dati di pagamento dell'abbonamento futuro non sono disponibili al momento della pubblicazione.

Il disallineamento addestramento/produzione si verifica quando le funzionalità di input utilizzate durante l'addestramento sono diverse da quelle fornite al modello al momento della pubblicazione, causando una scarsa qualità del modello in produzione. Ad esempio, la creazione di un modello per prevedere le temperature orarie, ma l'addestramento con dati che contengono solo le temperature settimanali. Un altro esempio: fornire sempre i voti di uno studente nei dati di addestramento quando si prevede l'abbandono degli studi, ma non fornire queste informazioni al momento della pubblicazione.

Comprendere i dati di addestramento è importante per prevenire la perdita di dati e il disallineamento tra addestramento e distribuzione:

- Prima di utilizzare i dati, assicurati di sapere cosa significano e se devi utilizzarli come funzionalità

- Controlla la correlazione nella scheda Train. Le correlazioni elevate devono essere segnalate per la revisione.

- Disallineamento addestramento/produzione: assicurati di fornire al modello solo le funzionalità di input disponibili esattamente nella stessa forma al momento della pubblicazione.

Pulire i dati mancanti, incompleti e incoerenti

È normale che nei dati di esempio siano presenti valori mancanti e imprecisi. Prenditi il tempo necessario per esaminare e, se possibile, migliorare la qualità dei dati prima di utilizzarli per l'addestramento. Più valori mancanti ci sono, meno utili saranno i dati per l'addestramento di un modello di machine learning.

- Controlla se nei dati sono presenti valori mancanti e correggili, se possibile, oppure lascia vuoto il valore se la colonna è impostata in modo da accettare valori nulli. Vertex AI è in grado di gestire i valori mancanti, ma è più probabile che tu ottenga risultati ottimali se tutti i valori sono disponibili.

- Per la previsione, verifica che l'intervallo tra le righe di addestramento sia coerente. Vertex AI può imputare i valori mancanti, ma è più probabile ottenere risultati ottimali se tutte le righe sono disponibili.

- Pulisci i dati correggendo o eliminando errori o rumore. Rendi coerenti i dati: Controlla l'ortografia, le abbreviazioni e la formattazione.

Analizzare i dati dopo l'importazione

Vertex AI fornisce una panoramica del set di dati dopo l'importazione. Controlla il set di dati importato per assicurarti che ogni colonna abbia il tipo di variabile corretto. Vertex AI rileverà automaticamente il tipo di variabile in base ai valori delle colonne, ma è consigliabile esaminare ciascuna variabile. Devi anche esaminare la nullabilità di ogni colonna, che determina se una colonna può avere valori mancanti o NULL.

Addestramento del modello

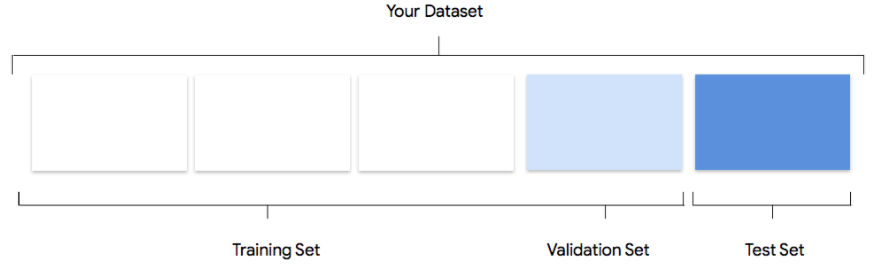

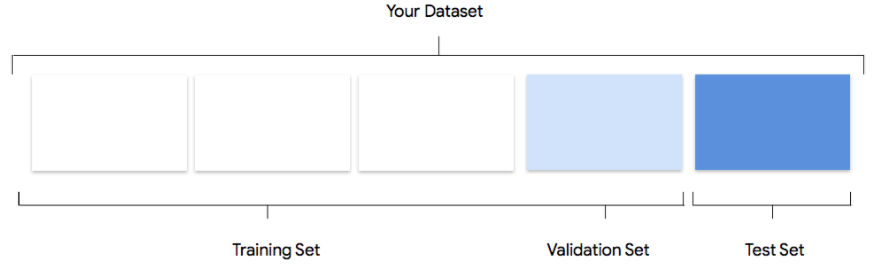

Immagine

Considera il modo in cui Vertex AI utilizza il tuo set di dati per creare un modello personalizzato

Il set di dati contiene set di addestramento, convalida e test. Se non specifichi le suddivisioni

(vedi Prepara i dati), Vertex AI utilizza automaticamente l'80% delle immagini per l'addestramento, il 10% per la convalida e il 10% per i test.

Set di addestramento

La maggior parte dei dati dovrebbe essere presente nel set di addestramento. Questi sono i dati che il modello "vede"

durante l'addestramento: vengono utilizzati per apprendere i parametri del modello, ossia i pesi delle

connessioni tra i nodi della rete neurale.

La maggior parte dei dati dovrebbe essere presente nel set di addestramento. Questi sono i dati che il modello "vede"

durante l'addestramento: vengono utilizzati per apprendere i parametri del modello, ossia i pesi delle

connessioni tra i nodi della rete neurale.

Set di convalida

Il set di convalida, talvolta chiamato anche set "dev", viene utilizzato anche durante il processo di addestramento.

Dopo che i dati di addestramento sono stati incorporati durante ogni iterazione del processo di addestramento, il framework di apprendimento del modello utilizza le prestazioni del modello sul set di convalida per ottimizzarne gli iperparametri, che sono variabili che specificano la struttura del modello. Se si cercasse di utilizzare il set di addestramento per ottimizzare gli iperparametri, è molto probabile che il modello finirebbe per concentrarsi eccessivamente sui dati di addestramento e avrebbe difficoltà a generalizzare in base a esempi che non corrispondono esattamente.

L'utilizzo di un set di dati nuovo per ottimizzare la struttura del modello consente una migliore generalizzazione da parte del modello.

Il set di convalida, talvolta chiamato anche set "dev", viene utilizzato anche durante il processo di addestramento.

Dopo che i dati di addestramento sono stati incorporati durante ogni iterazione del processo di addestramento, il framework di apprendimento del modello utilizza le prestazioni del modello sul set di convalida per ottimizzarne gli iperparametri, che sono variabili che specificano la struttura del modello. Se si cercasse di utilizzare il set di addestramento per ottimizzare gli iperparametri, è molto probabile che il modello finirebbe per concentrarsi eccessivamente sui dati di addestramento e avrebbe difficoltà a generalizzare in base a esempi che non corrispondono esattamente.

L'utilizzo di un set di dati nuovo per ottimizzare la struttura del modello consente una migliore generalizzazione da parte del modello.

Set di test

Il set di test non è coinvolto in alcun modo nel processo di addestramento. Al termine dell'addestramento del modello, utilizziamo il set di test come risorsa di verifica completamente nuova per il modello. Le prestazioni del modello in base al set di test hanno lo scopo di dare un'idea abbastanza precisa di come il modello si comporterà utilizzando dati reali.

Il set di test non è coinvolto in alcun modo nel processo di addestramento. Al termine dell'addestramento del modello, utilizziamo il set di test come risorsa di verifica completamente nuova per il modello. Le prestazioni del modello in base al set di test hanno lo scopo di dare un'idea abbastanza precisa di come il modello si comporterà utilizzando dati reali.

Divisione manuale

Puoi anche dividere il set di dati autonomamente. La suddivisione manuale dei dati è una buona scelta quando

vuoi esercitare un maggiore controllo sul processo o se ci sono esempi specifici che

vuoi includere in una determinata parte del ciclo di vita dell'addestramento del modello.

Puoi anche dividere il set di dati autonomamente. La suddivisione manuale dei dati è una buona scelta quando

vuoi esercitare un maggiore controllo sul processo o se ci sono esempi specifici che

vuoi includere in una determinata parte del ciclo di vita dell'addestramento del modello.

Tabulare

Dopo aver importato il set di dati, il passaggio successivo consiste nell'addestramento di un modello. Vertex AI genererà un modello di machine learning affidabile con i valori predefiniti di addestramento, ma potresti voler modificare alcuni parametri in base al tuo caso d'uso.

Cerca di selezionare il maggior numero possibile di colonne di funzionalità per l'addestramento, ma esamina ciascuna per assicurarti che sia adatta all'addestramento. Tieni presente quanto segue per la selezione delle funzionalità:

- Non selezionare colonne di funzionalità che creano rumore, ad esempio colonne di identificatori assegnati casualmente con un valore univoco per ogni riga.

- Assicurati di comprendere ogni colonna delle funzionalità e i relativi valori.

- Se stai creando più modelli da un set di dati, rimuovi le colonne di destinazione che non fanno parte del problema di inferenza corrente.

- Ricorda i principi di equità: stai addestrando il modello con una funzionalità che potrebbe portare a processi decisionali di parte o ingiusti per i gruppi emarginati?

Come Vertex AI utilizza il tuo set di dati

Il set di dati verrà suddiviso in set di addestramento, convalida e test. La

divisione predefinita applicata da Vertex AI dipende dal tipo di modello che

stai addestrando. Se necessario, puoi anche specificare le suddivisioni (suddivisioni manuali). Per saperne di più, consulta Informazioni sulle suddivisioni di dati per i modelli AutoML.

Set di addestramento

La maggior parte dei dati dovrebbe essere presente nel set di addestramento. Questi sono i dati che il modello "vede"

durante l'addestramento: vengono utilizzati per apprendere i parametri del modello, ossia i pesi delle

connessioni tra i nodi della rete neurale.

La maggior parte dei dati dovrebbe essere presente nel set di addestramento. Questi sono i dati che il modello "vede"

durante l'addestramento: vengono utilizzati per apprendere i parametri del modello, ossia i pesi delle

connessioni tra i nodi della rete neurale.

Set di convalida

Il set di convalida, talvolta chiamato anche set "dev", viene utilizzato anche durante il processo di addestramento.

Dopo che i dati di addestramento sono stati incorporati durante ogni iterazione del processo di addestramento, il framework di apprendimento del modello utilizza le prestazioni del modello sul set di convalida per ottimizzarne gli iperparametri, che sono variabili che specificano la struttura del modello. Se si cercasse di utilizzare il set di addestramento per ottimizzare gli iperparametri, è molto probabile che il modello finirebbe per concentrarsi eccessivamente sui dati di addestramento e avrebbe difficoltà a generalizzare in base a esempi che non corrispondono esattamente.

L'utilizzo di un set di dati nuovo per ottimizzare la struttura del modello consente una migliore generalizzazione da parte del modello.

Il set di convalida, talvolta chiamato anche set "dev", viene utilizzato anche durante il processo di addestramento.

Dopo che i dati di addestramento sono stati incorporati durante ogni iterazione del processo di addestramento, il framework di apprendimento del modello utilizza le prestazioni del modello sul set di convalida per ottimizzarne gli iperparametri, che sono variabili che specificano la struttura del modello. Se si cercasse di utilizzare il set di addestramento per ottimizzare gli iperparametri, è molto probabile che il modello finirebbe per concentrarsi eccessivamente sui dati di addestramento e avrebbe difficoltà a generalizzare in base a esempi che non corrispondono esattamente.

L'utilizzo di un set di dati nuovo per ottimizzare la struttura del modello consente una migliore generalizzazione da parte del modello.

Set di test

Il set di test non è coinvolto in alcun modo nel processo di addestramento. Al termine dell'addestramento del modello, Vertex AI utilizza il set di test come risorsa di verifica completamente nuova per il modello.

Le prestazioni del modello in base al set di test hanno lo scopo di dare un'idea abbastanza precisa di come

il modello si comporterà utilizzando dati reali.

Il set di test non è coinvolto in alcun modo nel processo di addestramento. Al termine dell'addestramento del modello, Vertex AI utilizza il set di test come risorsa di verifica completamente nuova per il modello.

Le prestazioni del modello in base al set di test hanno lo scopo di dare un'idea abbastanza precisa di come

il modello si comporterà utilizzando dati reali.

Valuta, testa ed esegui il deployment del modello

Valuta il modello

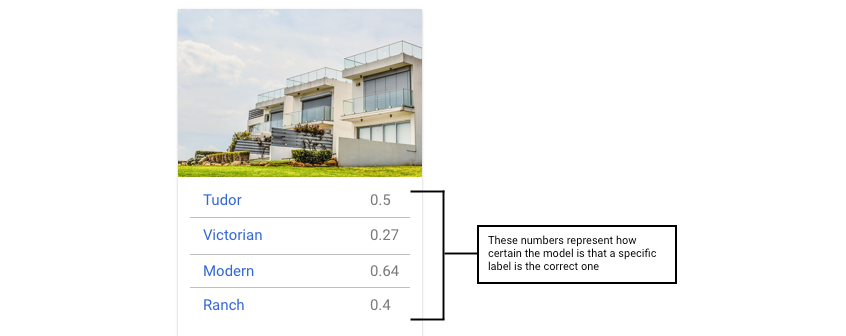

Immagine

Una volta addestrato il modello, riceverai un riepilogo delle sue prestazioni. Fai clic su Valuta o Vedi valutazione completa per visualizzare un'analisi dettagliata.

Il debug di un modello riguarda più il debug dei dati che del modello stesso. Se in qualsiasi momento il modello inizia a comportarsi in modo inatteso durante la valutazione delle prestazioni prima e dopo il push in produzione, devi tornare indietro e controllare i dati per vedere dove potrebbero essere migliorati.

Il debug di un modello riguarda più il debug dei dati che del modello stesso. Se in qualsiasi momento il modello inizia a comportarsi in modo inatteso durante la valutazione delle prestazioni prima e dopo il push in produzione, devi tornare indietro e controllare i dati per vedere dove potrebbero essere migliorati.

Quali tipi di analisi posso eseguire in Vertex AI?

Nella sezione Valuta di Vertex AI, puoi valutare le prestazioni del tuo modello personalizzato utilizzando l'output del modello sugli esempi di test e le metriche di machine learning comuni. In questa sezione spiegheremo il significato di ciascuno di questi concetti.

- Output del modello

- Soglia punteggio

- Veri positivi, veri negativi, falsi positivi e falsi negativi

- Precisione e richiamo

- Curve di precisione-richiamo

- Precisione media

Come faccio a interpretare l'output del modello?

Vertex AI estrae esempi dai dati di test per presentare sfide completamente nuove per il tuo modello. Per ogni esempio, il modello restituisce una serie di numeri che comunicano la forza con cui

associa ogni etichetta a quell'esempio. Se il numero è elevato, il modello è molto sicuro

che l'etichetta debba essere applicata a quel documento.

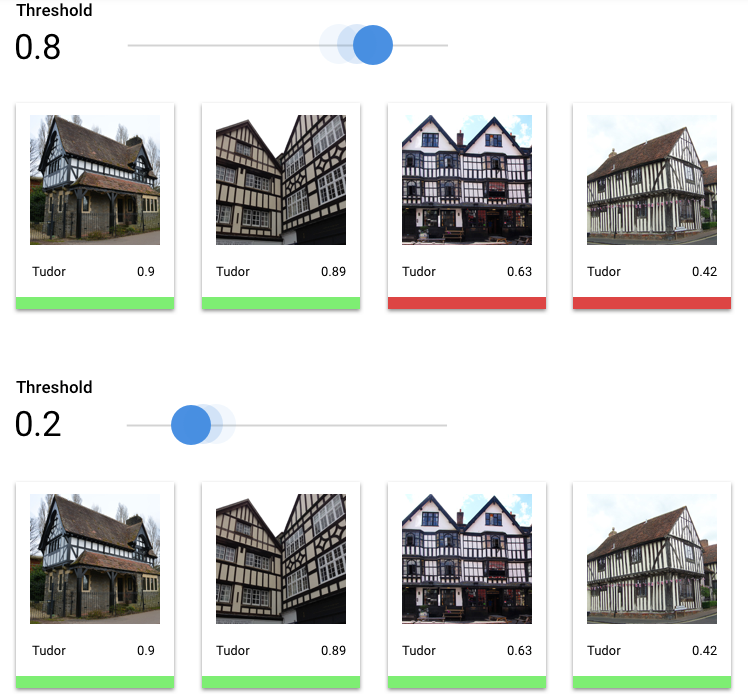

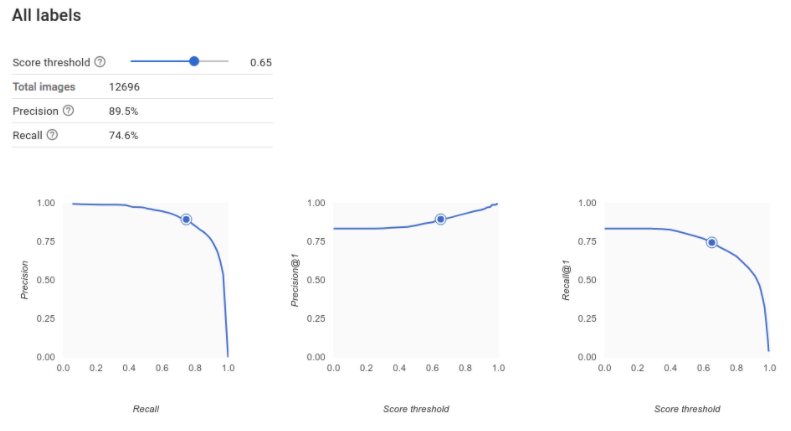

Che cos'è la soglia del punteggio?

Possiamo convertire queste probabilità in valori binari "on"/"off" impostando una soglia di punteggio.

La soglia di punteggio si riferisce al livello di confidenza che il modello deve avere per assegnare una categoria a un elemento di test. Il cursore della soglia del punteggio nella console Google Cloud è uno strumento visivo per testare

l'effetto di diverse soglie per tutte le categorie e le singole categorie nel set di dati.

Se la soglia del punteggio è bassa, il modello classificherà più immagini, ma corre il rischio di

classificarne erroneamente alcune durante la procedura. Se la soglia del punteggio è elevata, il modello classifica

meno immagini, ma ha un rischio inferiore di classificarle in modo errato. Puoi modificare le soglie per categoria nella console Google Cloud per sperimentare. Tuttavia, quando utilizzi il modello in

produzione, devi applicare le soglie che hai ritenuto ottimali.

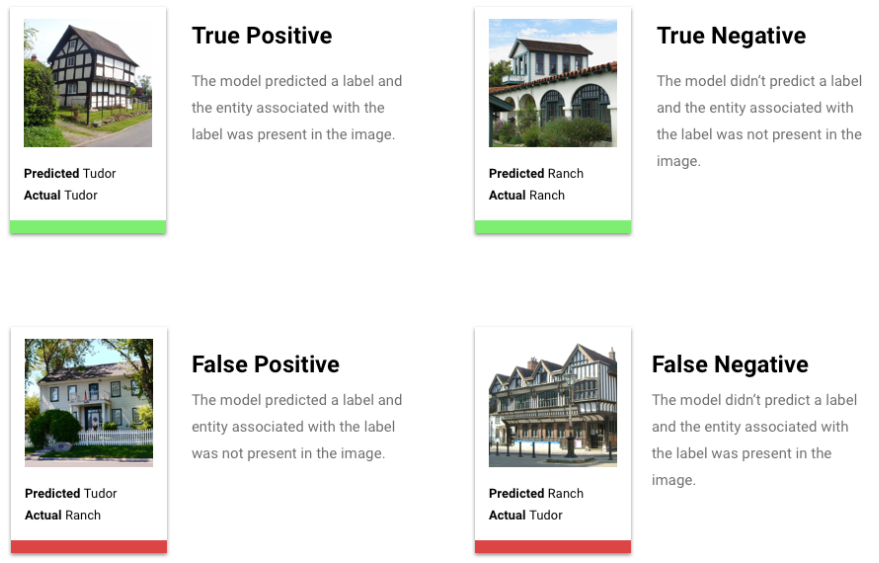

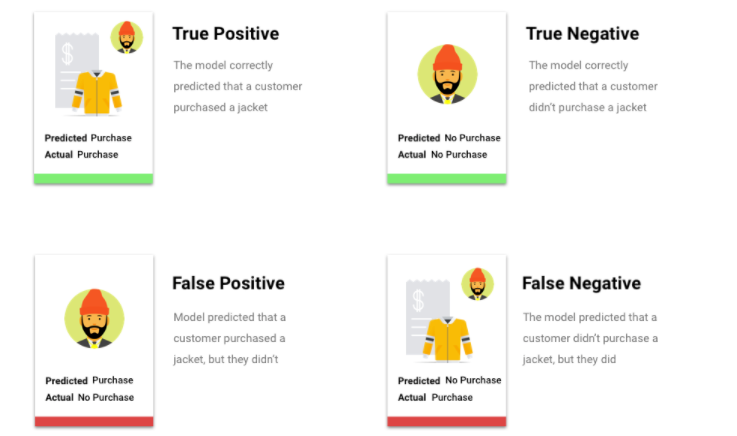

Che cosa sono veri positivi, veri negativi, falsi positivi e falsi negativi?

Dopo aver applicato la soglia del punteggio, le inferenze fatte dal tuo modello rientreranno in una delle

seguenti quattro categorie:

Le soglie che hai ritenuto ottimali.

Possiamo utilizzare queste categorie per calcolare precisione e richiamo, metriche che ci aiutano a valutare l'efficacia del nostro modello.

Che cosa sono precisione e richiamo?

Precisione e richiamo ci aiutano a capire se il modello sta acquisendo informazioni adeguate e cosa sta tralasciando. La precisione indica, tra tutti gli esempi di test a cui è stata assegnata un'etichetta, quanti

avrebbero dovuto essere classificati con quell'etichetta. Il richiamo indica, tra tutti gli esempi di test a cui avrebbe dovuto essere assegnata l'etichetta, a quanti è stata effettivamente assegnata.

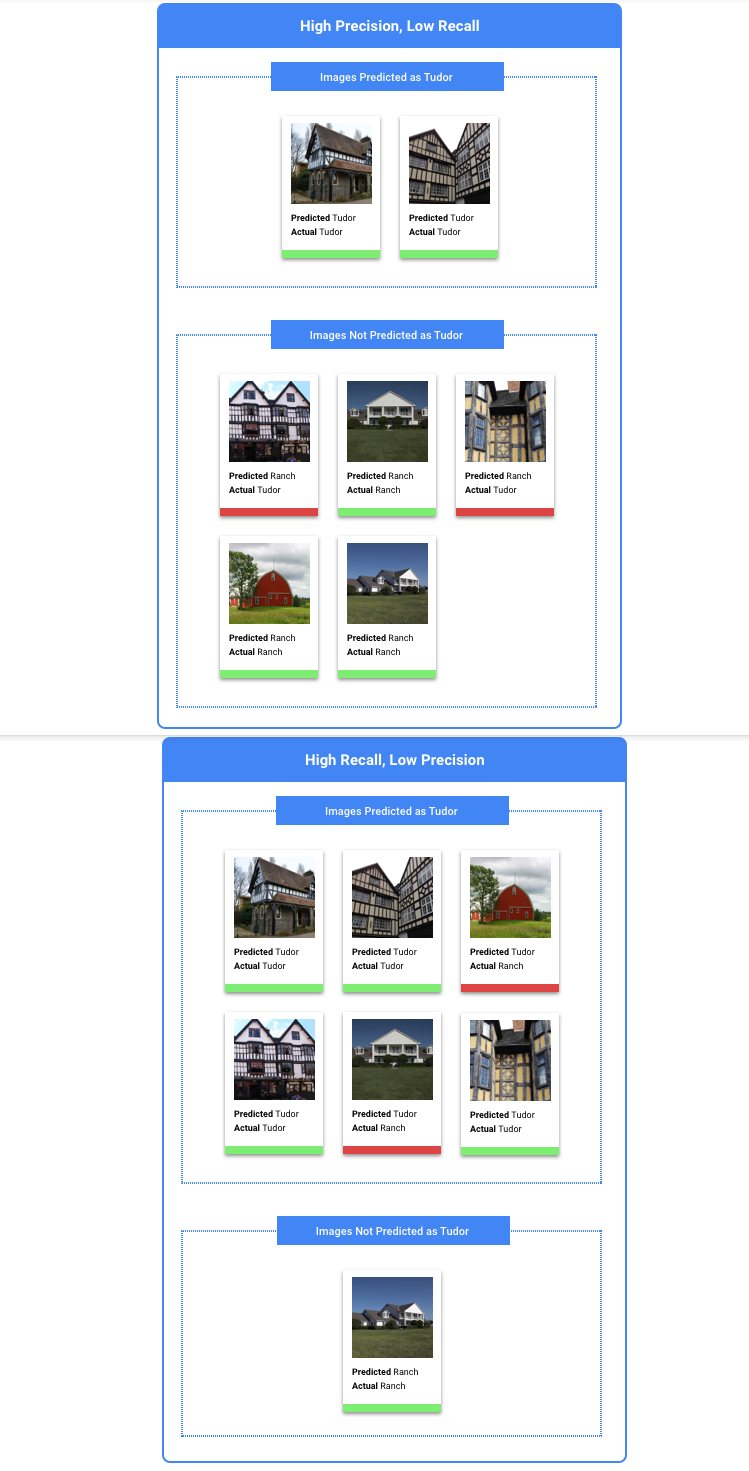

Devo ottimizzare la precisione o il richiamo?

A seconda del caso d'uso, potresti voler ottimizzare la precisione o il richiamo. Prendi in esame i seguenti due casi d'uso per decidere quale approccio è più adatto alle tue esigenze.

Caso d'uso: privacy nelle immagini

Supponiamo che tu voglia creare un sistema che rilevi automaticamente le informazioni sensibili e le sfumi.

I falsi positivi in questo caso sarebbero elementi che non devono essere sfocati ma che vengono sfocati,

il che può essere fastidioso ma non dannoso.

I falsi negativi in questo caso sono elementi che devono essere sfocati ma non lo sono, ad esempio una carta di credito, che può portare a un furto di identità.

In questo caso, è consigliabile eseguire l'ottimizzazione per il recupero. Questa metrica misura, per tutte le inferenze effettuate, la quantità di dati esclusi. Un modello a richiamo elevato è più propenso a etichettare esempi marginalmente pertinenti. Ciò è utile nei casi in cui la categoria dispone di pochi dati di addestramento.

Caso d'uso: ricerca di foto stock

Supponiamo che tu voglia creare un sistema che trovi la migliore foto stock per una determinata parola chiave.

Un falso positivo in questo caso potrebbe essere la restituzione di un'immagine non pertinente. Poiché il tuo prodotto si vanta di restituire solo le immagini con la migliore corrispondenza, questo sarebbe un grave errore.

Un falso negativo in questo caso potrebbe essere il mancato ritorno di un'immagine pertinente per una ricerca di parole chiave. Poiché molti termini di ricerca hanno migliaia di foto che rappresentano un potenziale match, questo va bene.

In questo caso, è consigliabile ottimizzare per la precisione. Questa metrica misura, per tutte le inferenze effettuate, la loro correttezza. Un modello ad alta precisione probabilmente etichetterà solo gli esempi più pertinenti, il che è utile nei casi in cui la classe è comune nei dati di addestramento.

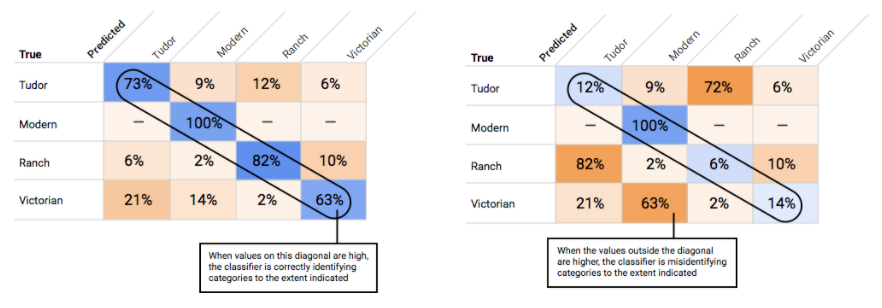

Come si usa la matrice di confusione?

Come faccio a interpretare le curve di precisione-richiamo?

Lo strumento per la soglia del punteggio ti consente di esplorare l'impatto della soglia del punteggio scelta

su precisione e richiamo. Se trascini il cursore sulla barra della soglia di punteggio, puoi vedere dove

si trova la soglia sulla curva di tradeoff precisione-richiamo, nonché in che modo la soglia

influisce su precisione e richiamo individualmente (per i modelli multiclasse, in questi grafici, precisione

e richiamo indicano che l'unica etichetta utilizzata per calcolare le metriche di precisione e richiamo è l'etichetta con il punteggio più alto

nel set di etichette restituite). In questo modo puoi trovare un buon equilibrio tra falsi

positivi e falsi negativi.

Una volta scelto un valore di soglia che ti sembra accettabile per il modello nel suo complesso, fai clic sulle singole etichette e vedi dove cade la soglia sulla curva precisione-richiamo per etichetta. In alcuni casi, potresti ottenere molte inferenze errate per alcune etichette, il che potrebbe aiutarti a decidere di scegliere una soglia per classe personalizzata per queste etichette. Ad esempio, supponiamo che tu esamini il set di dati delle case e noti che una soglia pari a 0,5 ha una precisione e un richiamo ragionevoli per ogni tipo di immagine, tranne "Tudor", forse perché è una categoria molto generale. Per questa categoria, vengono visualizzati molti falsi positivi. In questo caso, potresti decidere di utilizzare una soglia di 0,8 solo per "Tudor" quando chiami il classificatore per le inferenze.

Che cos'è la precisione media?

Una metrica utile per l'accuratezza del modello è l'area sotto la curva di precisione-richiamo. Misura le prestazioni del modello per tutte le soglie di punteggio. In Vertex AI, questa metrica è chiamata precisione media. Più questo punteggio si avvicina a 1,0, migliori sono le prestazioni del modello sul set di test; un modello che indovina a caso per ogni etichetta otterrebbe una precisione media intorno a 0,5.

Tabulare

Dopo l'addestramento del modello, riceverai un riepilogo delle sue prestazioni. Le metriche di valutazione del modello si basano sul rendimento del modello rispetto a una sezione del set di dati (il set di dati di test). Esistono alcune metriche e concetti chiave da considerare per determinare se il modello è pronto per essere utilizzato con dati reali.

Dopo l'addestramento del modello, riceverai un riepilogo delle sue prestazioni. Le metriche di valutazione del modello si basano sul rendimento del modello rispetto a una sezione del set di dati (il set di dati di test). Esistono alcune metriche e concetti chiave da considerare per determinare se il modello è pronto per essere utilizzato con dati reali.

Metriche di classificazione

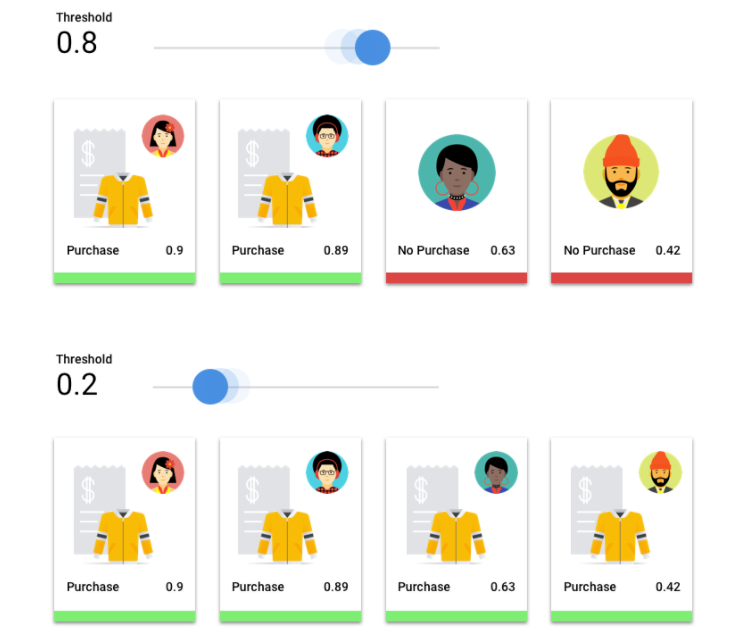

Soglia punteggio

Prendi in considerazione un modello di machine learning che preveda se un cliente acquisterà una giacca nel prossimo

anno. Quanto deve essere sicuro il modello prima di prevedere che un determinato cliente acquisterà una

giacca? Nei modelli di classificazione, a ogni inferenza viene assegnato un punteggio di confidenza, ovvero una valutazione numerica del livello di certezza del modello che la classe prevista sia corretta. La soglia del punteggio è

il numero che determina quando un determinato punteggio viene convertito in una decisione affermativa o negativa, ovvero

il valore in corrispondenza del quale il modello afferma "Sì, questo punteggio di confidenza è sufficientemente alto per concludere che

questo cliente acquisterà un cappotto nel prossimo anno".

Se la soglia del punteggio è bassa, il modello rischia di essere classificato in modo errato. Per questo motivo, la soglia del punteggio deve essere basata su un determinato caso d'uso.

Risultati dell'inferenza

Dopo aver applicato la soglia del punteggio, le inferenze effettuate dal modello rientreranno in una delle quattro categorie. Per comprendere queste categorie, immagina di nuovo un modello di classificazione binaria di una giacca. In questo esempio, la classe positiva (ciò che il modello tenta di prevedere) è che il cliente acquisterà una giacca nel prossimo anno.

- Vero positivo: il modello prevede correttamente la classe positiva. Il modello ha previsto correttamente che un cliente ha acquistato una giacca.

- Falso positivo: il modello prevede in modo errato la classe positiva. Il modello ha previsto che un cliente ha acquistato una giacca, ma non è così.

- Vero negativo: il modello prevede correttamente la classe negativa. Il modello ha previsto correttamente che un cliente non ha acquistato una giacca.

- Falso negativo: il modello prevede in modo errato una classe negativa. Il modello ha previsto che un cliente non ha acquistato una giacca, ma l'ha fatto.

Precisione e richiamo

Le metriche di precisione e richiamo ti aiutano a capire se il modello sta acquisendo informazioni adeguate e cosa sta tralasciando. Scopri di più su precisione e richiamo.

- Per precisione si intende la frazione delle inferenze positive che sono risultate corrette. Tra tutte le inferenze di acquisto di un cliente, qual è la frazione di acquisti effettivi?

- Per richiamo si intende la frazione delle righe con questa etichetta che sono state previste correttamente dal modello. Tra tutte le previsioni che un cliente potrebbe aver identificato, qual è la frazione prevista correttamente?

A seconda del caso d'uso, potrebbe essere necessario ottimizzare la precisione o il richiamo.

Altre metriche di classificazione

- AUC PR: l'area sotto la curva di precisione-richiamo (PR). Il valore va da zero a uno, dove un valore più elevato indica un modello di qualità superiore.

- AUC ROC: l'area sotto la curva della caratteristica operativa del ricevitore (ROC). Il valore varia in un intervallo da zero a uno, dove un valore più elevato indica un modello di qualità superiore.

- Accuratezza: la frazione delle inferenze di classificazione prodotte dal modello che sono risultate corrette.

- Perdita logaritmica: l'entropia incrociata tra le inferenze del modello e i valori target. L'intervallo va da zero a infinito, dove un valore più basso indica un modello di qualità superiore.

- Punteggio F1: la media armonica di precisione e richiamo. F1 è una metrica utile per trovare un equilibrio tra precisione e richiamo qualora esista una distribuzione non uniforme delle classi.

Metriche di previsione e regressione

Una volta creato il modello, Vertex AI fornisce una serie di metriche standard da esaminare. Non esiste una risposta perfetta su come valutare il modello. Considera le metriche di valutazione nel contesto del tipo di problema e di ciò che vuoi ottenere con il modello. Il seguente elenco è una panoramica di alcune metriche che Vertex AI può fornire.

Errore assoluto medio (MAE)

Il MAE (Mean Absolute Error) indica la differenza media assoluta tra i valori target e quelli previsti. Misura la portata media degli errori, ovvero la differenza tra il valore target e quello previsto, in un insieme di inferenze. Inoltre, poiché utilizza valori assoluti, il MAE non prende in considerazione la direzione della relazione né indica se le prestazioni sono migliori o peggiori. Quando si valuta il MAE, un valore minore indica un modello di qualità migliore (0 rappresenta un predittore perfetto).

Errore quadratico medio (RMSE)

L'RMSE (Root Mean Square Error) è la radice quadrata della media dei quadrati delle differenze tra i valori target e quelli previsti. L'RMSE è più sensibile agli outlier rispetto al MAE. Di conseguenza, se la preoccupazione principale riguarda gli errori di grande entità, l'RMSE può essere una metrica più utile da valutare. Analogamente al MAE, un valore minore indica un modello di qualità migliore (0 rappresenta un predittore perfetto).

Errore logaritmico quadratico medio (RMSLE)

L'errore logaritmico quadratico medio (RMSLE) è l'equivalente in scala logaritmica dell'errore quadratico medio (RMSE). L'RMSLE è più sensibile agli errori relativi rispetto a quelli assoluti e si preoccupa maggiormente del rendimento insoddisfacente rispetto a quello eccessivo.

Quantile osservato (solo previsione)

Per un dato quantile target, il quantile osservato mostra la frazione effettiva dei valori osservati al di sotto dei valori di inferenza del quantile specificato. Il quantile osservato mostra quanto il modello si avvicina o si allontana dal quantile target. Una differenza minore tra i due valori indica un modello di qualità migliore.

Scaled pinball loss (solo previsione)

Misura la qualità di un modello in un dato quantile target. Un numero più basso indica un modello di qualità migliore. Puoi confrontare la metrica della perdita a forma di flipper scalata in diversi quantili per determinare l'accuratezza relativa del modello tra questi quantili.

Testa il tuo modello

Immagine

Vertex AI utilizza automaticamente il 10% dei dati (o, se hai scelto tu la suddivisione dei dati, la percentuale che hai scelto di utilizzare) per testare il modello e la pagina "Valuta" indica il rendimento del modello sui dati di test. Ma nel caso in cui tu voglia verificare l'affidabilità del tuo modello, ci sono alcuni modi per farlo. Il modo più semplice è caricare alcune immagini nella pagina "Deployment e test" e osservare le etichette scelte dal modello per gli esempi. Spero che questo soddisfi le tue aspettative. Prova qualche esempio di ogni tipo di immagine che prevedi di ricevere.

Se invece vuoi utilizzare il modello nei test automatici, la pagina "Deployment e test" ti spiega anche come chiamare il modello in modo programmatico.

Tabulare

La valutazione delle metriche del modello è il modo principale per determinare se il modello è pronto per la distribuzione, ma è anche possibile testarlo con nuovi dati. Carica nuovi dati per vedere se le inferenze del modello corrispondono alle tue aspettative. In base alle metriche di valutazione o ai test con nuovi dati, potrebbe essere necessario continuare a migliorare le prestazioni del modello.

Esegui il deployment del modello

Immagine

Se ritieni che le prestazioni del modello vadano bene, puoi iniziare a utilizzarlo. Potresti utilizzarlo in produzione o potrebbe essere una richiesta di inferenza una tantum. In base al caso d'uso, puoi usare il modello in vari modi.

Inferenza batch

L'inferenza batch è utile per fare molte richieste di inferenza contemporaneamente. L'inferenza batch è asincrona, il che significa che il modello attende di elaborare tutte le richieste di inferenza prima di restituire un file JSON Lines con i valori di inferenza.

Inferenza online

Esegui il deployment del modello per renderlo disponibile per le richieste di inferenza utilizzando un'API REST. L'inferenza online è sincrona (in tempo reale), il che significa che restituirà rapidamente un risultato di inferenza, ma accetta una sola richiesta di inferenza per ogni chiamata API. L'inferenza online è utile se il modello fa parte di un'applicazione e alcune parti del tuo sistema dipendono da risposte rapide restituite dall'inferenza.

Tabulare

Se ritieni che le prestazioni del modello vadano bene, puoi iniziare a utilizzarlo. Potresti utilizzarlo in produzione o potrebbe essere una richiesta di inferenza una tantum. In base al caso d'uso, puoi usare il modello in vari modi.

Inferenza batch

L'inferenza batch è utile per fare molte richieste di inferenza contemporaneamente. L'inferenza batch è asincrona, il che significa che il modello attende di elaborare tutte le richieste di inferenza prima di restituire un file CSV o una tabella BigQuery con i valori di inferenza.

Inferenza online

Esegui il deployment del modello per renderlo disponibile per le richieste di inferenza utilizzando un'API REST. L'inferenza online è sincrona (in tempo reale), il che significa che restituirà rapidamente i risultati, ma accetta una sola richiesta di inferenza per ogni chiamata API. L'inferenza online è utile se il modello fa parte di un'applicazione e alcune parti del tuo sistema dipendono da risposte rapide restituite dall'inferenza.

Esegui la pulizia

Per evitare addebiti indesiderati, annulla il deployment del modello quando non è in uso.

Quando hai finito di utilizzare il modello, elimina le risorse che hai creato per evitare addebiti indesiderati sul tuo account.

- Introduzione ai dati di immagine: pulizia del progetto

- Introduzione ai dati tabulari: pulizia del progetto