Questa pagina illustra come visualizzare i log di monitoraggio associati ai cluster Ray e monitorare le metriche di Ray su Vertex AI. Vengono inoltre fornite indicazioni per il debug dei cluster Ray.

Visualizza i log

Quando esegui attività con il cluster Ray su Vertex AI, i log di monitoraggio vengono generati e archiviati automaticamente sia in Cloud Logging sia nella dashboard Ray open source. Questa sezione descrive come accedere ai log generati tramite la console Google Cloud .

Prima di iniziare, assicurati di leggere la panoramica di Ray su Vertex AI e di configurare tutti gli strumenti prerequisiti di cui hai bisogno.Dashboard Ray OSS

Puoi visualizzare i file di log di Ray open source tramite la dashboard Ray OSS:

Nella console Google Cloud , vai alla pagina Ray su Vertex AI.

Nella riga del cluster che hai creato, seleziona il menu Altre azioni.

Seleziona il link alla dashboard Ray OSS. La dashboard si apre in un'altra scheda.

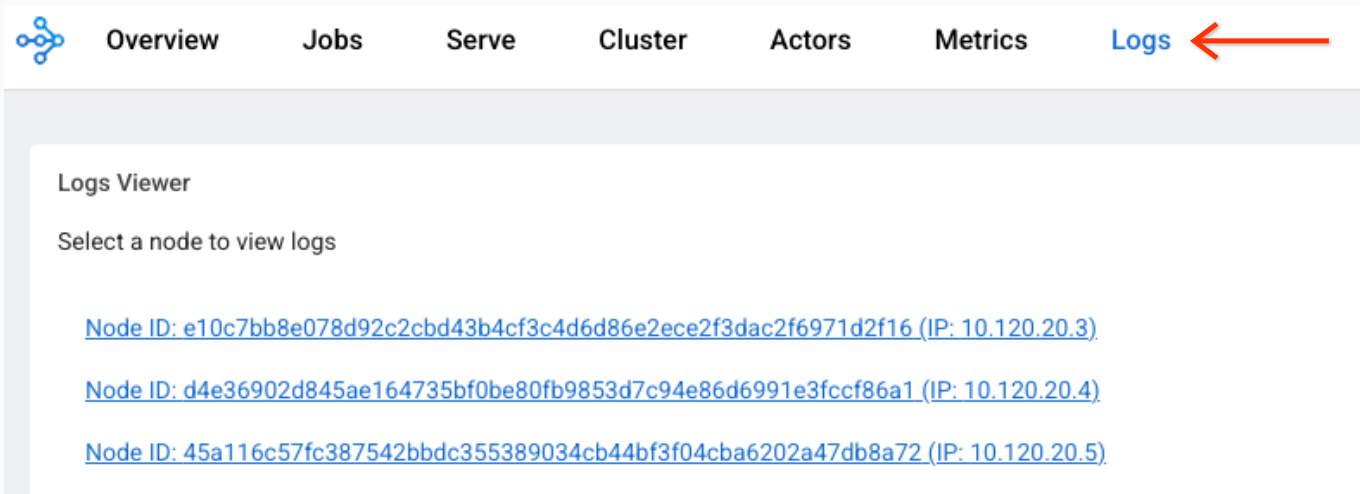

Vai alla visualizzazione Log nell'angolo in alto a destra del menu:

Fai clic su ogni nodo per visualizzare i file di log associati.

Console Cloud Logging

-

Nella Google Cloud console, vai alla pagina Esplora log:

Se utilizzi la barra di ricerca per trovare questa pagina, seleziona il risultato con il sottotitolo Logging.

Seleziona un progetto, una cartella o un'organizzazione Google Cloud esistente.

Per visualizzare tutti i log di Ray, inserisci la seguente query nel campo dell'editor query e poi fai clic su Esegui query:

resource.labels.task_name="ray-cluster-logs"

Per restringere i log a un cluster Ray specifico, aggiungi la seguente riga alla query e poi fai clic su Esegui query:

labels."ml.googleapis.com/ray_cluster_id"=CLUSTER_NAME

Sostituisci CLUSTER_NAME con il nome del tuo cluster Ray. Nella console Google Cloud , vai a Vertex AI > Ray su Vertex AI, dove vedi un elenco dei nomi dei cluster in ogni regione.

Per restringere ulteriormente i log a un file di log specifico come

raylet.out, fai clic sul nome del log in Campi log -> Nome log.Puoi raggruppare le voci di log simili:

In Risultati delle query, fai clic su una voce di log per espandere il log.

Nel

jsonPayload, fai clic sul valoretailed_path. Viene visualizzato un menu a discesa.Fai clic su Mostra voci corrispondenti.

Disattiva log

Per impostazione predefinita, Ray on Vertex AI Cloud Logging è abilitato.

Per disattivare l'esportazione dei log di Ray in Cloud Logging, utilizza il seguente comando dell'SDK Vertex AI per Python:

vertex_ray.create_ray_cluster(..., enable_logging=False, ...)

Puoi visualizzare i file di log di Ray nella dashboard di Ray anche se la funzionalità Ray on Vertex AI Cloud Logging è disattivata.

Monitorare le metriche

Puoi visualizzare le metriche di Ray su Vertex AI in diversi modi utilizzando Google Cloud Monitoring (GCM). In alternativa, puoi esportare le metriche da GCM al tuo server Grafana.

Monitorare le metriche in GCM

Esistono due modi per visualizzare le metriche di Ray su Vertex AI in GCM.

- Utilizza la visualizzazione diretta in Esplora metriche.

Importa la dashboard Grafana.

Esplora metriche

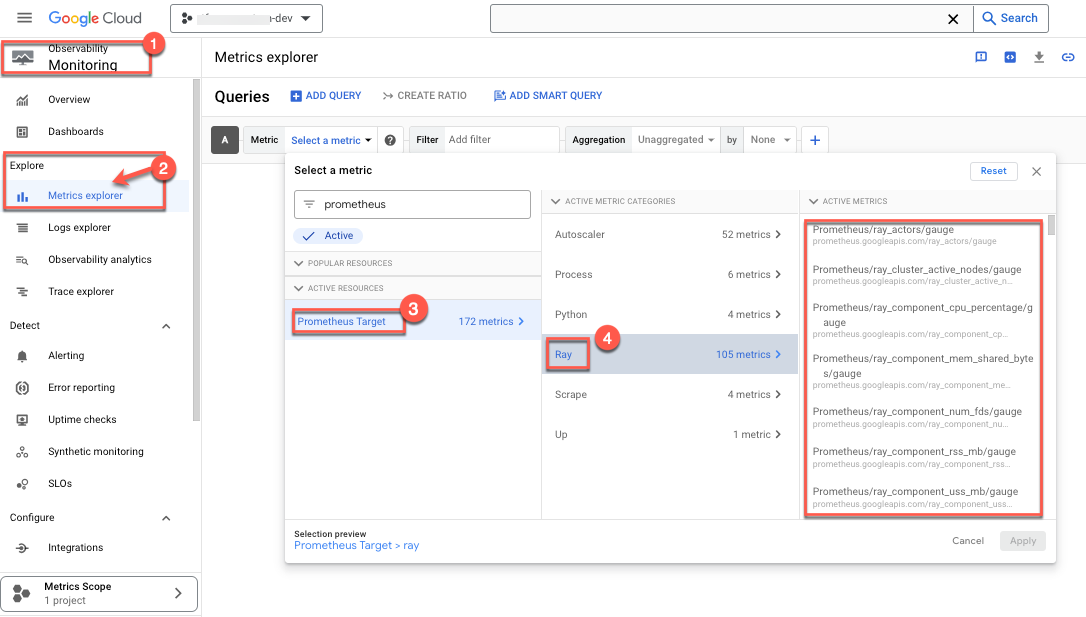

Per utilizzare la visualizzazione diretta in Esplora metriche, segui questi passaggi:

- Vai alla console Google Cloud Monitoring.

- Nella sezione Esplora, seleziona Esplora metriche.

- In Risorse attive, seleziona Destinazione Prometheus. Viene visualizzata la sezione Categorie di metriche attive.

Seleziona Ray.

Viene visualizzato un elenco di metriche:

- Seleziona le metriche che vuoi monitorare. Ad esempio:

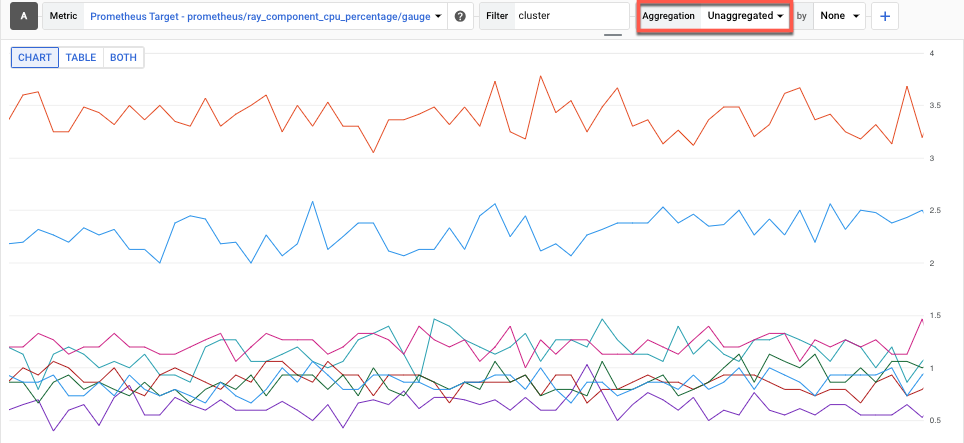

- Scegli la percentuale di utilizzo della CPU come metrica monitorata:

- Seleziona un filtro. Ad esempio, seleziona il cluster:

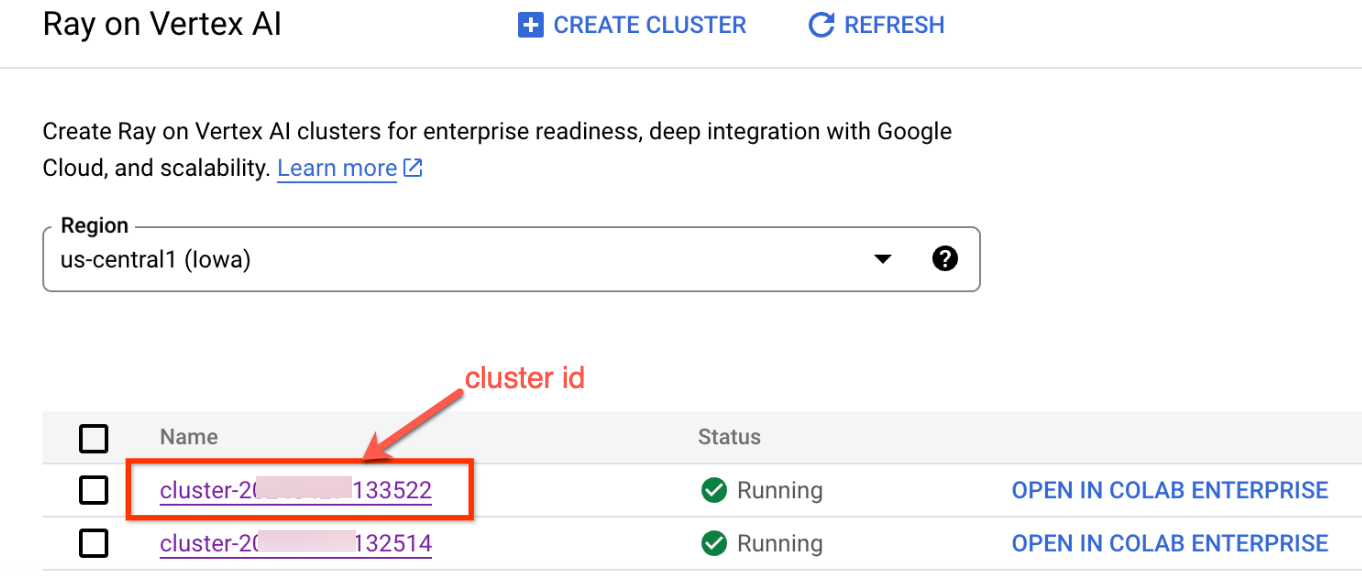

Utilizza l'ID cluster per monitorare solo le metriche precedenti per un cluster specifico. Per trovare l'ID cluster,

segui questi passaggi:

Utilizza l'ID cluster per monitorare solo le metriche precedenti per un cluster specifico. Per trovare l'ID cluster,

segui questi passaggi:

Nella console Google Cloud , vai alla pagina Ray.

- Assicurati di trovarti nel progetto in cui vuoi creare l'esperimento.

- Sotto Nome viene visualizzato un elenco di ID cluster.

- Seleziona il metodo di aggregazione per visualizzare le metriche. ovvero puoi scegliere di

visualizzare le metriche non aggregate, che mostrano l'utilizzo della CPU di ogni processo Ray:

- Scegli la percentuale di utilizzo della CPU come metrica monitorata:

Dashboard GCM

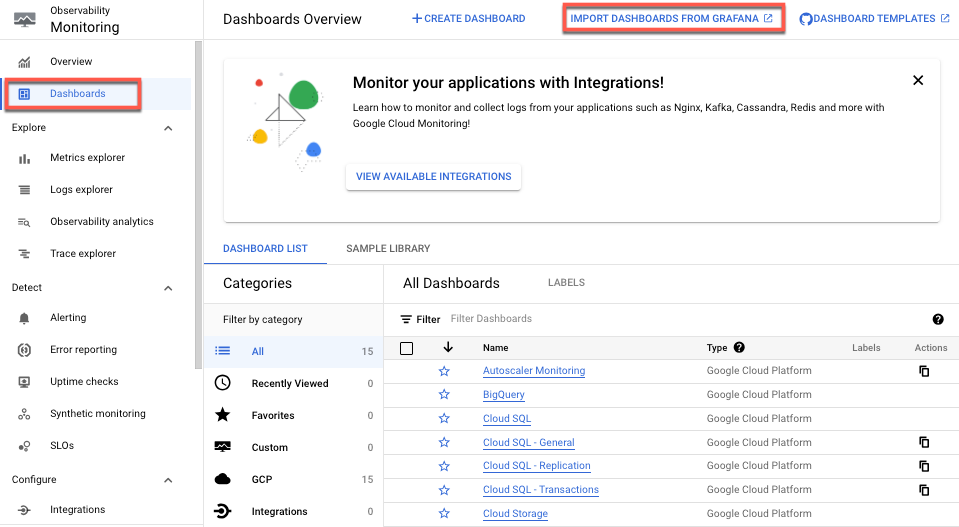

Per importare una dashboard Grafana per Ray su Vertex AI, segui le linee guida riportate nella dashboard di Cloud Monitoring, Importa la tua dashboard Grafana.

Tutto ciò che ti serve è un file JSON della dashboard Grafana. OSS Ray supporta questa configurazione manuale fornendo il file JSON della dashboard Grafana predefinita.

Monitorare le metriche

da Grafana di proprietà dell'utente

Se hai già un server Grafana in esecuzione, esiste anche un modo per esportare tutte le metriche Prometheus del cluster Ray su Vertex AI nel server Grafana esistente. Per farlo, segui le indicazioni Query GMP utilizzando Grafana. In questo modo puoi aggiungere una nuova origine dati Grafana al server Grafana esistente e utilizzare lo strumento di sincronizzazione delle origini dati per sincronizzare la nuova origine dati Grafana Prometheus con Ray su Vertex AI Metrics.

È importante configurare e autenticare l'origine dati Grafana appena aggiunta utilizzando lo strumento di sincronizzazione delle origini dati. Segui i passaggi descritti in Configurare e autenticare l'origine dati Grafana.

Una volta sincronizzate, puoi creare e aggiungere qualsiasi dashboard di cui hai bisogno in base alle metriche di Ray su Vertex AI.

Per impostazione predefinita, le raccolte di metriche Ray su Vertex AI sono abilitate. Ecco come disattivarli utilizzando l'SDK Vertex AI per Python:

vertex_ray.create_ray_cluster(..., enable_metrics_collection=False, ...)

Eseguire il debug dei cluster Ray

Per eseguire il debug dei cluster Ray, utilizza la shell interattiva del nodo head:

Console Google Cloud

Per accedere alla shell interattiva del nodo head:

- Nella console Google Cloud , vai alla pagina Ray su Vertex AI.

Vai a Ray su Vertex AI - Assicurati di trovarti nel progetto corretto.

- Seleziona il cluster da esaminare. Viene visualizzata la sezione Informazioni di base.

- Nella sezione Link di accesso, fai clic sul link per Shell interattiva del nodo head. Viene visualizzata la shell interattiva del nodo head.

- Segui le istruzioni descritte in Monitoraggio e debug dell'addestramento con una shell interattiva.