Ray는 AI 및 Python 애플리케이션을 확장하기 위한 오픈소스 프레임워크입니다. Ray는 머신러닝(ML) 워크플로에 대해 분산형 계산과 병렬 처리를 수행하기 위한 인프라를 제공합니다.

이미 Ray를 사용하고 있으면 같은 오픈소스 Ray 코드를 사용하여 최소한의 변경으로 Vertex AI에서 프로그램을 작성하고 애플리케이션을 개발할 수 있습니다. 그런 다음 Vertex AI Inference나 BigQuery와 같은 다른 Google Cloud서비스와 Vertex AI의 통합 기능을 머신러닝 워크플로의 일부로 사용할 수 있습니다.

이미 Vertex AI를 사용 중이고 컴퓨팅 리소스를 관리하는 간단한 방법이 필요한 경우 Ray 코드를 사용하여 학습을 확장할 수 있습니다.

Ray on Vertex AI를 사용하기 위한 워크플로

Colab Enterprise 및 Vertex AI SDK for Python을 사용하여 Ray 클러스터에 연결합니다.

| 단계 | 설명 |

|---|---|

| 1. Ray on Vertex AI 설정 | Google 프로젝트를 설정하고 Ray 클라이언트의 기능이 포함된 Vertex AI SDK for Python 버전을 설치하고 VPC 피어링 네트워크를 설정합니다(선택사항). |

| 2. Ray on Vertex AI 클러스터 만들기 | Ray on Vertex AI 클러스터를 만듭니다. Vertex AI 관리자 역할이 필요합니다. |

| 3. Ray on Vertex AI 애플리케이션 개발 | Ray on Vertex AI 클러스터에 연결하고 애플리케이션을 개발합니다. Vertex AI 사용자 역할이 필요합니다. |

| 4. (선택사항) BigQuery와 함께 Ray on Vertex AI 사용 | BigQuery로 데이터를 읽고 쓰고 변환합니다. |

| 5. (선택사항) Vertex AI에 모델 배포하고 추론 가져오기 | 모델을 Vertex AI 온라인 엔드포인트에 배포하고 추론을 가져옵니다. |

| 6. Ray on Vertex AI 클러스터 모니터링 | Cloud Logging에서 생성된 로그와 Cloud Monitoring의 측정항목을 모니터링합니다. |

| 7. Ray on Vertex AI 클러스터 삭제 | 불필요한 요금 청구를 방지하기 위해 Ray on Vertex AI 클러스터를 삭제합니다. |

개요

Ray 클러스터는 성수기나 중요한 ML 워크로드에 대해 용량 가용성을 보장하기 위해 기본 제공됩니다. 학습 서비스가 작업 완료 후에 리소스를 해제하는 커스텀 작업과 달리 Ray 클러스터는 삭제될 때까지 계속 사용 가능합니다.

참고: 다음 시나리오에서는 장기 실행 Ray 클러스터를 사용하세요.

- 동일한 Ray 작업을 여러 번 제출하는 경우 동일한 장기 실행 Ray 클러스터에서 작업을 실행하여 데이터 및 이미지 캐싱을 활용할 수 있습니다.

- 실제 처리 시간이 작업 시작 시간보다 짧은 단기 Ray 작업을 여러 개 실행하는 경우 장기 실행 클러스터를 사용하는 것이 좋습니다.

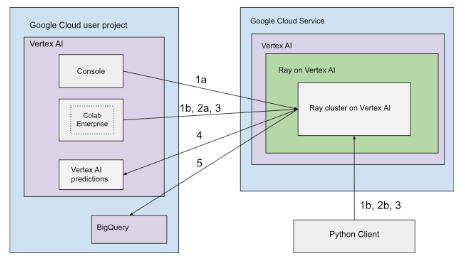

Ray on Vertex AI 클러스터는 공개 또는 비공개 연결을 사용하여 설정할 수 있습니다. 다음 다이어그램은 Ray on Vertex AI에 대한 아키텍처와 워크플로를 보여줍니다. 자세한 내용은 공개 또는 비공개 연결을 참조하세요.

공개 연결을 사용하는 아키텍처

다음 옵션을 사용하여 Ray on Vertex AI 클러스터를 만듭니다.

a. Google Cloud 콘솔을 사용하여 Vertex AI에 Ray 클러스터를 만듭니다.

b. Vertex AI SDK for Python을 사용하여 Ray on Vertex AI 클러스터를 만듭니다.

다음 옵션을 사용하여 대화형 개발을 위해 Ray on Vertex AI 클러스터에 연결합니다.

a. Google Cloud 콘솔에서 Colab Enterprise를 사용하여 원활하게 연결합니다.

b. 공개 인터넷에 액세스할 수 있는 Python 환경을 사용합니다.

Ray on Vertex AI 클러스터에서 애플리케이션을 개발하고 모델을 학습시킵니다.

원하는 환경(Colab Enterprise 또는 Python 노트북)에서 Vertex AI SDK for Python을 사용합니다.

원하는 환경을 사용하여 Python 스크립트를 작성합니다.

Vertex AI SDK for Python, Ray Job CLI 또는 Ray Job Submission API를 사용하여 Ray on Vertex AI 클러스터에 Ray 작업을 제출합니다.

학습된 모델을 온라인 Vertex AI 엔드포인트에 배포하여 실시간 추론을 수행합니다.

BigQuery를 사용하여 데이터를 관리합니다.

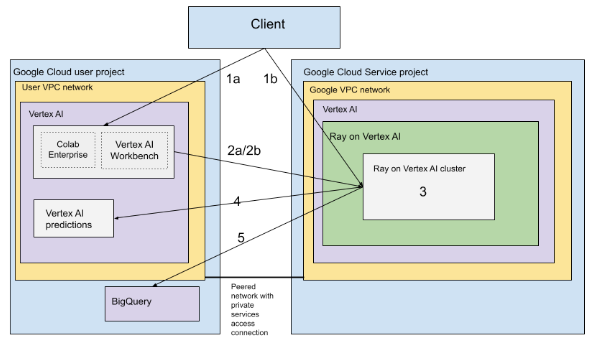

VPC를 사용하는 아키텍처

다음은 Google Cloud 프로젝트와 VPC 네트워크(선택사항)를 설정한 후 Vertex AI의 Ray에 대한 아키텍처와 워크플로를 보여주는 다이어그램입니다.

(a) Google 프로젝트와 (b) VPC 네트워크를 설정합니다.

다음 옵션을 사용하여 Ray on Vertex AI 클러스터를 만듭니다.

a. Google Cloud 콘솔을 사용하여 Vertex AI에 Ray 클러스터를 만듭니다.

b. Vertex AI SDK for Python을 사용하여 Ray on Vertex AI 클러스터를 만듭니다.

다음 옵션을 사용하여 VPC 피어링된 네트워크를 통해 Ray on Vertex AI 클러스터에 연결합니다.

Google Cloud 콘솔에서 Colab Enterprise를 사용합니다.

Vertex AI Workbench 노트북을 사용합니다.

다음 옵션을 사용하여 애플리케이션을 개발하고 Ray on Vertex AI 클러스터에서 모델을 학습시킵니다.

원하는 환경(Colab Enterprise 또는 Vertex AI Workbench 노트북)에서 Vertex AI SDK for Python을 사용합니다.

원하는 환경을 사용하여 Python 스크립트를 작성합니다. Vertex AI SDK for Python, Ray Job CLI 또는 Ray 대시보드를 사용하여 Ray 작업을 Ray on Vertex AI 클러스터에 제출합니다.

학습된 모델을 온라인 Vertex AI 엔드포인트에 배포하여 추론합니다.

BigQuery를 사용하여 데이터를 관리합니다.

용어

전체 용어 목록은 예측 AI용 Vertex AI 용어집을 참고하세요.

-

자동 확장

- 자동 확장 기능은 Ray 클러스터의 워커 풀과 같은 컴퓨팅 리소스가 워크로드 요구에 따라 노드 수를 자동으로 늘리거나 줄여 리소스 사용률과 비용을 최적화하는 기능입니다. 자세한 내용은 Vertex AI에서 Ray 클러스터 확장: 자동 확장을 참고하세요.

-

일괄 추론

- 일괄 추론은 추론 요청 그룹을 취하여 하나의 파일에 결과를 출력합니다. 자세한 내용은 Vertex AI의 추론 가져오기 개요를 참조하세요.

-

BigQuery

- BigQuery는 Google Cloud에서 제공하는 완전 관리형 서버리스 확장성이 뛰어난 엔터프라이즈 데이터 웨어하우스로, SQL 쿼리를 사용하여 매우 빠른 속도로 대규모 데이터 세트를 분석하도록 설계되었습니다. BigQuery를 사용하면 사용자가 인프라를 관리하지 않아도 강력한 비즈니스 인텔리전스 및 분석을 수행할 수 있습니다. 자세한 내용은 데이터 웨어하우스에서 자율형 데이터 및 AI 플랫폼으로를 참고하세요.

-

Cloud Logging

- Cloud Logging은 Google Cloud에서 제공하는 완전 관리형 실시간 로깅 서비스로, 모든 Google Cloud 리소스, 온프레미스 애플리케이션, 맞춤 소스의 로그를 수집, 저장, 분석, 모니터링할 수 있습니다. Cloud Logging은 로그 관리를 중앙 집중화하여 애플리케이션과 인프라의 동작과 상태를 더 쉽게 문제 해결, 감사, 이해할 수 있도록 지원합니다. 자세한 내용은 Cloud Logging 개요를 참고하세요.

-

Colab Enterprise

- Colab Enterprise는 공동작업을 위한 관리형 Jupyter 노트북 환경으로, 인기 있는 Google Colab 사용자 환경을 Google Cloud에 제공하여 엔터프라이즈급 보안 및 규정 준수 기능을 제공합니다. Colab Enterprise는 노트북 중심의 제로 구성 환경을 제공하며, Vertex AI에서 관리하는 컴퓨팅 리소스와 BigQuery와 같은 다른 Google Cloud 서비스와 통합됩니다. 자세한 내용은 Colab Enterprise 소개를 참고하세요.

-

커스텀 컨테이너 이미지

- 맞춤 컨테이너 이미지는 사용자의 애플리케이션 코드, 런타임, 라이브러리, 종속 항목, 환경 구성을 포함하는 자체 포함형 실행 가능 패키지입니다. Google Cloud, 특히 Vertex AI의 맥락에서 사용자는 정확한 종속 항목과 함께 머신러닝 학습 코드 또는 서비스 애플리케이션을 패키징하여 재현성을 보장하고 표준 환경에서 제공하지 않는 특정 소프트웨어 버전 또는 고유한 구성을 사용하여 관리형 서비스에서 워크로드를 실행할 수 있습니다. 자세한 내용은 추론을 위한 커스텀 컨테이너 요구사항을 참고하세요.

-

엔드포인트

- 학습된 모델을 배포하여 추론을 서빙할 수 있는 리소스입니다. 자세한 내용은 엔드포인트 유형 선택을 참조하세요.

-

Identity and Access Management(IAM) 권한

- Identity and Access Management(IAM) 권한은 누가 어떤 Google Cloud 리소스에서 무엇을 할 수 있는지 정의하는 구체적인 세분화된 기능입니다. 역할을 통해 주 구성원(예: 사용자, 그룹 또는 서비스 계정)에 할당되어 Google Cloud 프로젝트 또는 조직 내 서비스 및 데이터에 대한 액세스를 정확하게 제어할 수 있습니다. 자세한 내용은 IAM으로 액세스 제어를 참조하세요.

-

추론

- Vertex AI 플랫폼의 맥락에서 추론은 머신러닝 모델을 통해 데이터 포인트를 실행하여 단일 숫자 점수와 같은 출력을 계산하는 프로세스를 의미합니다. 이러한 프로세스를 가리켜 '머신러닝 모델을 운용'하거나 '머신러닝 모델을 프로덕션에 배치'한다고도 말합니다. 추론은 모델을 사용하여 새 데이터를 추론할 수 있게 하므로 머신러닝 워크플로에서 중요한 단계입니다. Vertex AI에서는 일괄 추론 및 온라인 추론을 비롯한 다양한 방법으로 추론을 실행할 수 있습니다. 일괄 추론은 일련의 추론 요청을 실행하고 결과를 하나의 파일로 출력하는 반면, 온라인 추론은 개별 데이터 포인트에 대한 실시간 추론을 허용합니다.

-

네트워크 파일 시스템(NFS)

- 사용자가 네트워크를 통해 파일에 액세스하고 로컬 파일 디렉터리에 있는 것처럼 처리할 수 있는 클라이언트/서버 시스템입니다. 자세한 내용은 커스텀 학습용 NFS 공유 마운트를 참조하세요.

-

온라인 추론

- 개별 인스턴스에 대한 추론을 동기식으로 가져옵니다. 자세한 내용은 온라인 추론을 참고하세요.

-

영구 리소스

- 명시적으로 삭제될 때까지 할당되고 사용 가능한 상태로 유지되는 Vertex AI 컴퓨팅 리소스 유형(예: Ray 클러스터)으로, 반복적인 개발에 유용하며 작업 간 시작 오버헤드를 줄여줍니다. 자세한 내용은 영구 리소스 정보 가져오기를 참고하세요.

-

pipeline

- ML 파이프라인은 컨테이너 기반의 이동성 및 확장성을 가진 ML 워크플로입니다. 자세한 내용은 Vertex AI Pipelines 소개를 참조하세요.

-

사전 빌드된 컨테이너

- Vertex AI에서 제공하는 컨테이너 이미지로, 일반적인 ML 프레임워크 및 종속 항목이 사전 설치되어 있어 학습 및 추론 작업의 설정을 간소화합니다. 자세한 내용은 커스텀 학습용 사전 빌드된 컨테이너 를 참조하세요.

-

PSC(Private Service Connect)

- Private Service Connect는 Compute Engine 고객이 네트워크의 비공개 IP를 다른 VPC 네트워크 또는 Google API에 매핑할 수 있는 기술입니다. 자세한 내용은 Private Service Connect를 참조하세요.

-

Vertex AI 기반 Ray 클러스터

- Vertex AI 기반 Ray 클러스터는 분산형 머신러닝(ML) 및 Python 애플리케이션을 실행하는 데 사용할 수 있는 컴퓨팅 노드의 관리형 클러스터입니다. ML 워크플로에 대해 분산 컴퓨팅과 병렬 처리를 수행하기 위한 인프라를 제공합니다. Ray 클러스터는 성수기 때나 중요한 ML 워크로드에 대해 용량 가용성을 보장하기 위해 Vertex AI에 내장되어 있습니다. 학습 서비스가 작업 완료 후에 리소스를 해제하는 커스텀 작업과 달리 Ray 클러스터는 삭제될 때까지 계속 사용 가능합니다. 자세한 내용은 Vertex AI 기반 Ray 개요를 참조하세요.

-

Vertex AI 기반 Ray(RoV)

- Vertex AI 기반 Ray는 같은 오픈소스 Ray 코드를 사용하여 최소한의 변경만으로 Vertex AI에서 프로그램을 작성하고 애플리케이션을 개발할 수 있도록 설계되었습니다. 자세한 내용은 Vertex AI 기반 Ray 개요를 참조하세요.

-

Vertex AI SDK for Python 기반 Ray

- Vertex AI SDK for Python 기반 Ray는 Ray 클라이언트, Ray BigQuery 커넥터, Vertex AI 기반 Ray 클러스터 관리, Vertex AI의 추론 기능이 포함된 Vertex AI SDK for Python 버전입니다. 자세한 내용은 Vertex AI SDK for Python 소개를 참조하세요.

-

Vertex AI SDK for Python 기반 Ray

- Vertex AI SDK for Python 기반 Ray는 Ray 클라이언트, Ray BigQuery 커넥터, Vertex AI 기반 Ray 클러스터 관리, Vertex AI의 추론 기능이 포함된 Vertex AI SDK for Python 버전입니다. 자세한 내용은 Vertex AI SDK for Python 소개를 참조하세요.

-

서비스 계정

- 서비스 계정은 애플리케이션 또는 가상 머신이 Google Cloud 서비스에 승인된 API 호출을 수행하는 데 사용하는 특별한 Google Cloud 계정입니다. 사용자 계정과 달리 개별 사용자와 연결되지 않으며 코드의 ID 역할을 하여 사람의 사용자 인증 정보 없이 리소스에 안전하게 프로그래매틱 방식으로 액세스할 수 있습니다. 자세한 내용은 서비스 계정 개요를 참고하세요.

-

Vertex AI Workbench

- Vertex AI Workbench는 데이터 탐색 및 분석부터 모델 개발, 학습, 배포까지 전체 데이터 과학 워크플로를 지원하는 통합 Jupyter 노트북 기반 개발 환경입니다. Vertex AI Workbench는 BigQuery 및 Cloud Storage와 같은 다른 Google Cloud 서비스와의 기본 통합을 통해 관리되고 확장 가능한 인프라를 제공하므로 데이터 과학자가 기본 인프라를 관리하지 않고도 머신러닝 작업을 효율적으로 수행할 수 있습니다. 자세한 내용은 Vertex AI Workbench 소개를 참고하세요.

-

워커 노드

- 워커 노드는 클러스터 내에서 작업을 실행하거나 작업을 수행하는 역할을 하는 개별 머신 또는 컴퓨팅 인스턴스를 의미합니다. Kubernetes 또는 Ray 클러스터와 같은 시스템에서 노드는 컴퓨팅의 기본 단위입니다.

-

워커 풀

- 분산 작업을 실행하는 Ray 클러스터의 구성요소입니다. 워커 풀은 특정 머신 유형으로 구성할 수 있으며 자동 확장과 수동 확장을 모두 지원합니다. 자세한 내용은 학습 클러스터의 구조를 참고하세요.

가격 책정

Ray on Vertex AI 가격은 다음과 같이 계산됩니다.

사용하는 컴퓨팅 리소스 요금은 Ray on Vertex AI 클러스터를 만들 때 선택한 머신 구성에 따라 청구됩니다. Ray on Vertex AI 가격 책정은 가격 책정 페이지를 참조하세요.

Ray 클러스터의 경우 RUNNING 및 UPDATING 상태 중에만 비용이 청구됩니다. 다른 상태에서는 비용이 청구되지 않습니다. 청구 금액은 현재의 실제 클러스터 크기를 기준으로 합니다.

Vertex AI의 Ray 클러스터를 사용하여 태스크를 수행하면 로그가 자동으로 생성되고 Cloud Logging 가격 책정에 따라 요금이 청구됩니다.

온라인 추론을 위해 모델을 엔드포인트에 배포하는 경우 Vertex AI 가격 책정 페이지의 '예측 및 설명' 섹션을 참조하세요.

Ray on Vertex AI와 함께 BigQuery를 사용하는 경우 BigQuery 가격 책정을 참조하세요.