Vertex Explainable AI proporciona funciones de visualización integradas para los datos de imagen. Puedes configurar las visualizaciones de los modelos de clasificación de imágenes de AutoML.

Cuando solicitas una explicación de un modelo de clasificación de imágenes, obtienes la clase prevista junto con una superposición de imágenes que muestra qué píxeles (gradientes integrados) o regiones (gradientes integrados o XRAI) contribuyeron a la predicción.

En las siguientes imágenes, se muestran visualizaciones en la imagen de un husky siberiano. Para la visualización izquierda, se usa el método de gradientes integrados y se destacan las áreas de atribución positiva. En la visualización derecha, se usa un método XRAI con un gradiente de color que indica áreas de menor influencia (azul) y mayor influencia (amarillo) para hacer una predicción positiva.

El tipo de datos con el que trabajas puede influir en la decisión de usar un enfoque XRAI o de gradientes integrados para visualizar las explicaciones.

- XRAI suele funcionar mejor con imágenes naturales y, a su vez, proporciona un mejor resumen de alto nivel de estadísticas, como, por ejemplo, mostrar que la atribución positiva se relaciona con la forma del rostro del perro.

- Los gradientes integrados (IG) suelen proporcionar detalles a nivel de píxel y son útiles para descubrir atribuciones más detalladas.

Obtén más información sobre los métodos de atribución en la página Overview de Vertex Explainable AI.

Primeros pasos

Configura la visualización cuando entrenes un modelo de AutoML que admita Vertex Explainable AI y habilita las explicaciones cuando implementes el modelo.

Opciones de visualización

La configuración predeterminada y recomendada depende del método de atribución (XRAI o gradientes integrados). En la siguiente lista, se describen las opciones de configuración y cómo se pueden usar. Si deseas ver una lista completa de opciones, consulta la referencia de la API para el mensaje Visualization.

type: Es el tipo de visualización usado:OUTLINESoPIXELS. Especifica este campo solo si usas gradientes integrados. No puedes especificarlo si usas XRAI.En el caso de los gradientes integrados, el campo predeterminado es

OUTLINES, que muestra regiones de atribución. Para mostrar la atribución por píxel, configura el campo comoPIXELS.polarity: Es la direccionalidad de las atribuciones destacadas.positivese establece de forma predeterminada, por lo que se destacan las áreas con las atribuciones positivas más altas. Esto implica que se destacan los píxeles que fueron más influyentes para la predicción positiva del modelo. Si configuras la polaridad ennegative, se destacan las áreas que llevaron al modelo a no predecir la clase positiva. Usar una polaridad negativa puede ser útil para depurar el modelo mediante la identificación de regiones de falsos negativos. También puedes establecer la polaridad enboth, lo que muestra las atribuciones positivas y negativas.clip_percent_upperbound: Excluye las atribuciones por encima del percentil especificado de las áreas destacadas. Usar los parámetros de recorte a la vez puede ser útil para filtrar el ruido y facilitar la visualización de áreas de atribución sólida.clip_percent_lowerbound: Excluye las atribuciones por debajo del percentil especificado de las áreas destacadas.color_map: Es el esquema de colores que se usa para las áreas destacadas. El valor predeterminado espink_greenpara los gradientes integrados, lo que muestra las atribuciones positivas en verde y las negativas en rosa. Para las visualizaciones de XRAI, el mapa de colores es un gradiente. El valor predeterminado de XRAI esviridis, lo que destaca las regiones más influyentes en amarillo y las menos influyentes en azul.Para obtener una lista completa de los valores posibles, consulta la referencia de la API para el mensaje

Visualization.overlay_type: Es la forma en la que se muestra la imagen original en la visualización Ajustar la superposición permite aumentar la claridad visual si la imagen original es difícil de visualizar.Para obtener una lista completa de los valores posibles, consulta la referencia de la API para el mensaje

Visualization.

Configuración de ejemplo

Para comenzar, a continuación, se muestran ejemplos de configuraciones de Visualization que puedes usar como punto de partida e imágenes que muestran un rango de configuraciones aplicadas.

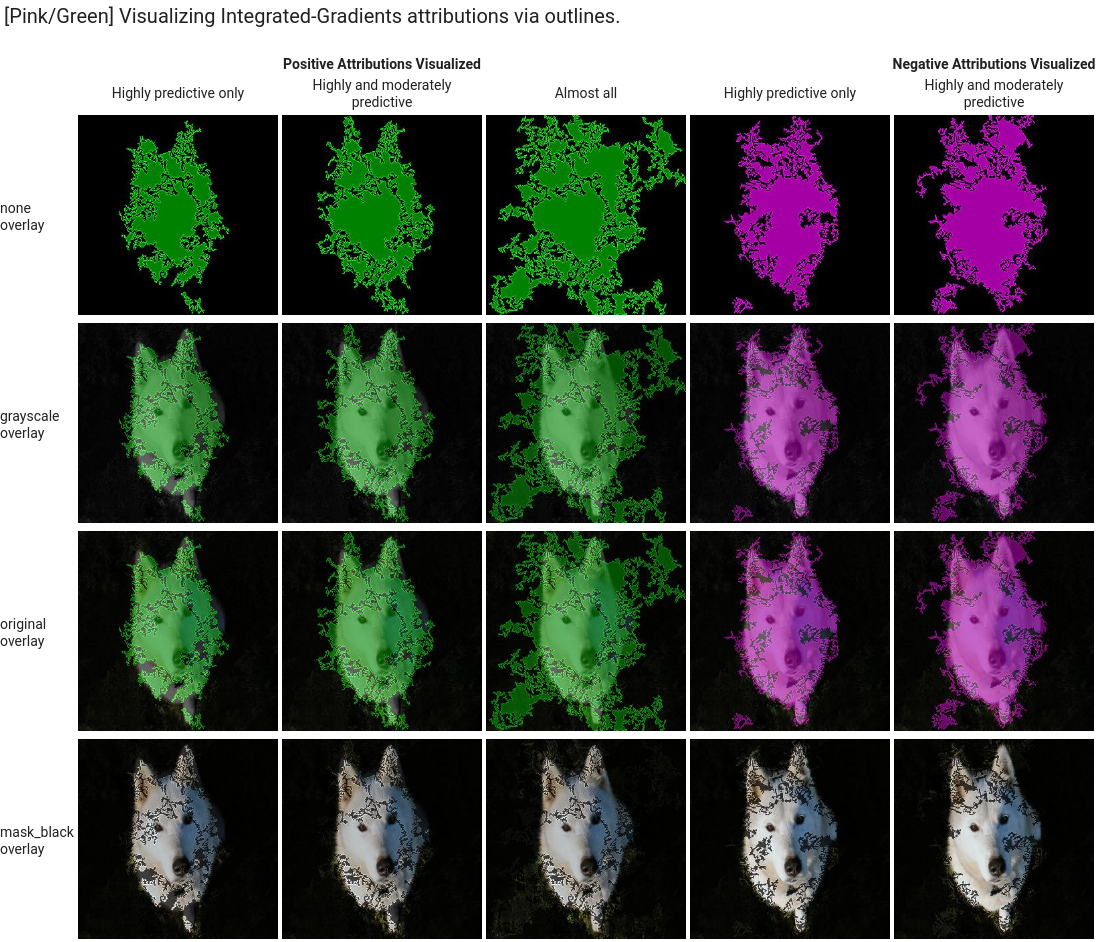

Gradientes integrados

En el caso de los gradientes integrados, es posible que debas ajustar los valores de recorte si las áreas de atribución presentan demasiado ruido.

visualization: {

"type": "OUTLINES",

"polarity": "positive",

"clip_percent_lowerbound": 70,

"clip_percent_upperbound": 99.9,

"color_map": "pink_green",

"overlay_type": "grayscale"

}

A continuación, se muestran dos visualizaciones en las que se usan los tipos outlines y pixels. Las columnas con la etiqueta “Highly predictive only” (“Solo nivel de predicción alto”), “Moderately predictive” (“Nivel de predicción moderado”) y “Almost all” (“Casi todo”) son ejemplos de recorte en diferentes niveles que pueden ayudarte a centrar tu atención en la visualización.

![]()

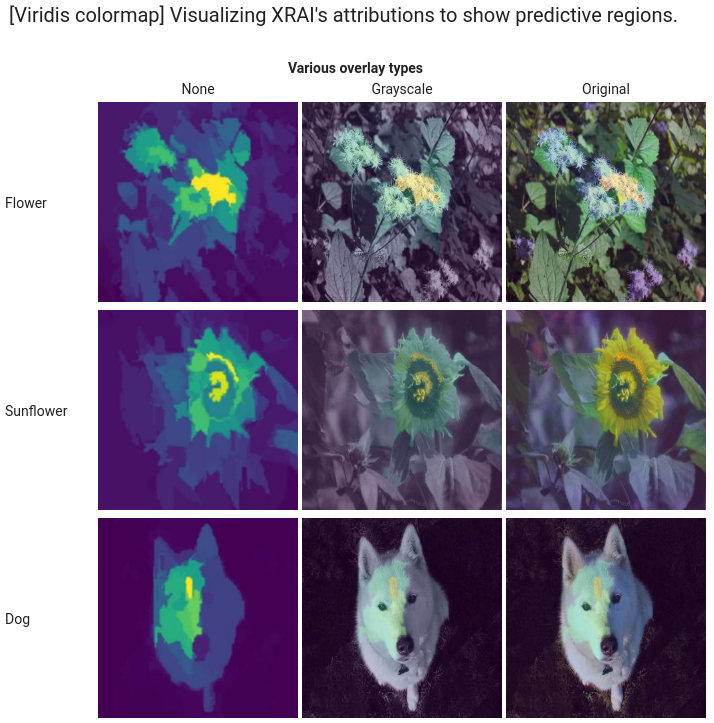

XRAI

Para las visualizaciones de XRAI, recomendamos comenzar sin valores de recorte de XRAI porque la superposición usa un gradiente a fin de mostrar áreas de atribución alta y baja.

visualization: {

"clip_percent_lowerbound": 0,

"clip_percent_upperbound": 100,

"color_map": "viridis",

"overlay_type": "grayscale"

}

La siguiente imagen es una visualización de XRAI en la que se usa el mapa de colores predeterminado viridis y un rango de tipos de superposición. Mediante las áreas en amarillo se indican las regiones más influyentes que contribuyeron de manera positiva a la predicción.

¿Qué sigue?

- Usa cómo obtener explicaciones para obtener predicciones con explicaciones de tu modelo.

- Si deseas obtener detalles sobre cómo mejorar los resultados de Vertex Explainable AI para los modelos de clasificación de imágenes de AutoML, consulta Mejora las explicaciones.