run

do job de treinamento para executar o script.

Neste tópico, você cria o script de treinamento e especifica argumentos de comando para ele.

Criar um script de treinamento

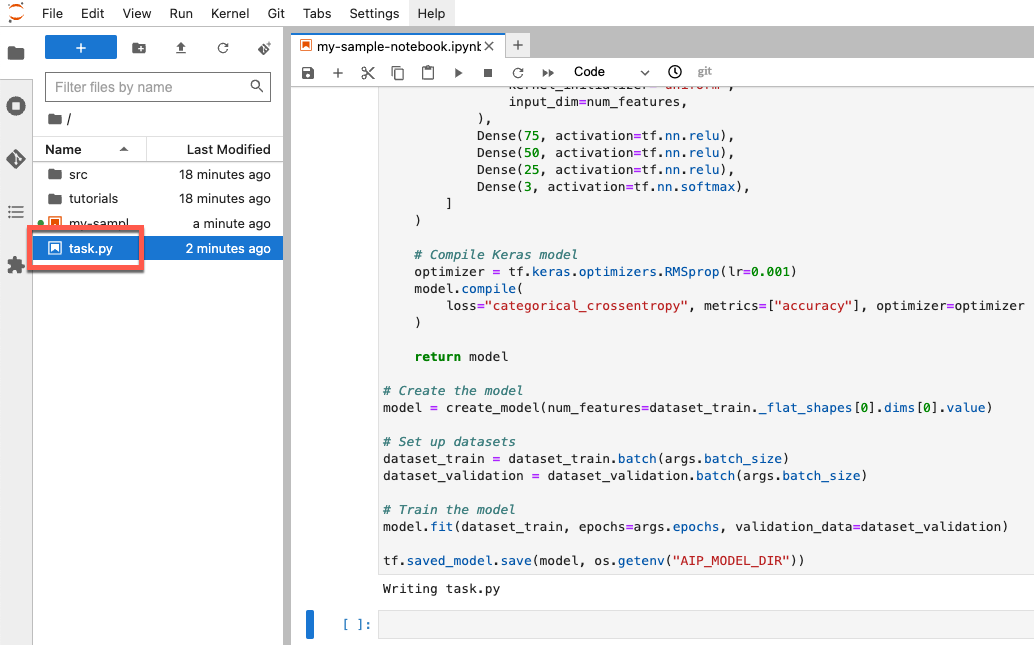

Nesta seção, você criará um script de treinamento. Esse script é um novo arquivo no ambiente

do notebook chamado task.py. Mais adiante neste tutorial, você vai transmitir esse

script para o construtor aiplatform.CustomTrainingJob. Quando o script é executado, ele faz o seguinte:

Carrega os dados no conjunto de dados do BigQuery que você criou.

Usa a API TensorFlow Keras para criar, compilar e treinar seu modelo.

Especifica o número de épocas e o tamanho do lote a ser usado quando o método

Model.fitdo Keras é invocado.Especifica onde salvar os artefatos de modelo usando a variável de ambiente

AIP_MODEL_DIR.AIP_MODEL_DIRé definido pela Vertex AI e contém o URI de um diretório para salvar artefatos de modelo. Para mais informações, consulte Variáveis de ambiente para diretórios especiais do Cloud Storage.Exporta um

SavedModeldo TensorFlow para o diretório do modelo. Para mais informações, consulte Como usar o formatoSavedModelno site do TensorFlow.

Para criar o script de treinamento, execute o seguinte código no seu notebook:

%%writefile task.py

import argparse

import numpy as np

import os

import pandas as pd

import tensorflow as tf

from google.cloud import bigquery

from google.cloud import storage

# Read environmental variables

training_data_uri = os.getenv("AIP_TRAINING_DATA_URI")

validation_data_uri = os.getenv("AIP_VALIDATION_DATA_URI")

test_data_uri = os.getenv("AIP_TEST_DATA_URI")

# Read args

parser = argparse.ArgumentParser()

parser.add_argument('--label_column', required=True, type=str)

parser.add_argument('--epochs', default=10, type=int)

parser.add_argument('--batch_size', default=10, type=int)

args = parser.parse_args()

# Set up training variables

LABEL_COLUMN = args.label_column

# See https://cloud.google.com/vertex-ai/docs/workbench/managed/executor#explicit-project-selection for issues regarding permissions.

PROJECT_NUMBER = os.environ["CLOUD_ML_PROJECT_ID"]

bq_client = bigquery.Client(project=PROJECT_NUMBER)

# Download a table

def download_table(bq_table_uri: str):

# Remove bq:// prefix if present

prefix = "bq://"

if bq_table_uri.startswith(prefix):

bq_table_uri = bq_table_uri[len(prefix) :]

# Download the BigQuery table as a dataframe

# This requires the "BigQuery Read Session User" role on the custom training service account.

table = bq_client.get_table(bq_table_uri)

return bq_client.list_rows(table).to_dataframe()

# Download dataset splits

df_train = download_table(training_data_uri)

df_validation = download_table(validation_data_uri)

df_test = download_table(test_data_uri)

def convert_dataframe_to_dataset(

df_train: pd.DataFrame,

df_validation: pd.DataFrame,

):

df_train_x, df_train_y = df_train, df_train.pop(LABEL_COLUMN)

df_validation_x, df_validation_y = df_validation, df_validation.pop(LABEL_COLUMN)

y_train = tf.convert_to_tensor(np.asarray(df_train_y).astype("float32"))

y_validation = tf.convert_to_tensor(np.asarray(df_validation_y).astype("float32"))

# Convert to numpy representation

x_train = tf.convert_to_tensor(np.asarray(df_train_x).astype("float32"))

x_test = tf.convert_to_tensor(np.asarray(df_validation_x).astype("float32"))

# Convert to one-hot representation

num_species = len(df_train_y.unique())

y_train = tf.keras.utils.to_categorical(y_train, num_classes=num_species)

y_validation = tf.keras.utils.to_categorical(y_validation, num_classes=num_species)

dataset_train = tf.data.Dataset.from_tensor_slices((x_train, y_train))

dataset_validation = tf.data.Dataset.from_tensor_slices((x_test, y_validation))

return (dataset_train, dataset_validation)

# Create datasets

dataset_train, dataset_validation = convert_dataframe_to_dataset(df_train, df_validation)

# Shuffle train set

dataset_train = dataset_train.shuffle(len(df_train))

def create_model(num_features):

# Create model

Dense = tf.keras.layers.Dense

model = tf.keras.Sequential(

[

Dense(

100,

activation=tf.nn.relu,

kernel_initializer="uniform",

input_dim=num_features,

),

Dense(75, activation=tf.nn.relu),

Dense(50, activation=tf.nn.relu),

Dense(25, activation=tf.nn.relu),

Dense(3, activation=tf.nn.softmax),

]

)

# Compile Keras model

optimizer = tf.keras.optimizers.RMSprop(lr=0.001)

model.compile(

loss="categorical_crossentropy", metrics=["accuracy"], optimizer=optimizer

)

return model

# Create the model

model = create_model(num_features=dataset_train._flat_shapes[0].dims[0].value)

# Set up datasets

dataset_train = dataset_train.batch(args.batch_size)

dataset_validation = dataset_validation.batch(args.batch_size)

# Train the model

model.fit(dataset_train, epochs=args.epochs, validation_data=dataset_validation)

tf.saved_model.save(model, os.getenv("AIP_MODEL_DIR"))

Depois que você criar o script, ele vai aparecer na pasta raiz do notebook:

Defina argumentos para seu script de treinamento

Transmita os seguintes argumentos de linha de comando para seu script de treinamento:

label_column: identifica a coluna nos dados que contém o que você quer prever. Nesse caso, essa coluna éspecies. Você definiu isso em uma variável chamadaLABEL_COLUMNao processar seus dados. Para mais informações, consulte Fazer o download, pré-processamento e divisão dos dados.epochs: esse é o número de épocas usadas ao treinar o modelo. Uma época é uma iteração dos dados ao treinar o modelo. Neste tutorial, usamos 20 épocas.batch_size: é o número de amostras processadas antes da atualização do modelo. Este tutorial usa um tamanho de lote de 10.

Para definir os argumentos que são transmitidos para seu script, execute o seguinte código:

JOB_NAME = "custom_job_unique"

EPOCHS = 20

BATCH_SIZE = 10

CMDARGS = [

"--label_column=" + LABEL_COLUMN,

"--epochs=" + str(EPOCHS),

"--batch_size=" + str(BATCH_SIZE),

]