Les journaux et les métriques vous permettent de surveiller vos services et de résoudre les problèmes liés à leurs performances. Vous pouvez afficher les journaux et les métriques des services Vertex AI à l'aide des ressources de surveillance et de journalisation de Google Distributed Cloud (GDC) air-gapped. Vous pouvez également créer des requêtes pour surveiller des métriques Vertex AI spécifiques.

Cette page explique comment interroger et afficher les journaux et les métriques des services Vertex AI dans l'instance de surveillance de Distributed Cloud.

Cette page contient également des exemples de requêtes que vous pouvez utiliser pour surveiller la plate-forme et les services Vertex AI, tels que la reconnaissance optique des caractères (OCR), Speech-to-Text et Vertex AI Translation. Pour en savoir plus sur les solutions de journalisation et de surveillance dans Distributed Cloud, consultez Surveiller les métriques et les journaux.

Avant de commencer

Pour obtenir les autorisations nécessaires pour afficher les journaux et les métriques de Vertex AI, demandez à l'administrateur IAM de votre projet de vous accorder le rôle Lecteur Grafana du projet (project-grafana-viewer) dans l'espace de noms de votre projet.

Pour en savoir plus sur ce rôle, consultez Préparer les autorisations IAM.

Visualiser les journaux et les métriques dans des tableaux de bord

Vous pouvez afficher les métriques et les journaux Vertex AI dans des tableaux de bord. Par exemple, vous pouvez créer une requête pour afficher l'impact de Vertex AI sur l'utilisation du processeur.

Pour afficher les journaux et les métriques Vertex AI dans des tableaux de bord, procédez comme suit :

Connectez-vous à la console GDC et sélectionnez votre projet.

Dans le menu de navigation, cliquez sur Vertex AI > API pré-entraînées.

Sur la page API pré-entraînées, assurez-vous que l'API Vertex AI du service que vous souhaitez surveiller est activée.

Cliquez sur Surveiller les services dans Grafana pour ouvrir la page d'accueil de Grafana.

Dans le menu de navigation de la page d'accueil, cliquez sur Explorer Explorer pour ouvrir la page Explorer.

Dans le menu de la page Explorer, sélectionnez l'une des sources de données suivantes :

- Journaux opérationnels : récupérez les journaux opérationnels.

- Journaux d'audit : récupérez les journaux d'audit.

- Prometheus : récupérez les métriques.

Si vous souhaitez afficher des métriques, saisissez une requête à l'aide d'expressions PromQL (Prometheus Query Language).

Si vous souhaitez afficher des journaux, saisissez une requête à l'aide d'expressions LogQL (Log Query Language).

La page affiche les métriques ou les journaux correspondant à votre requête.

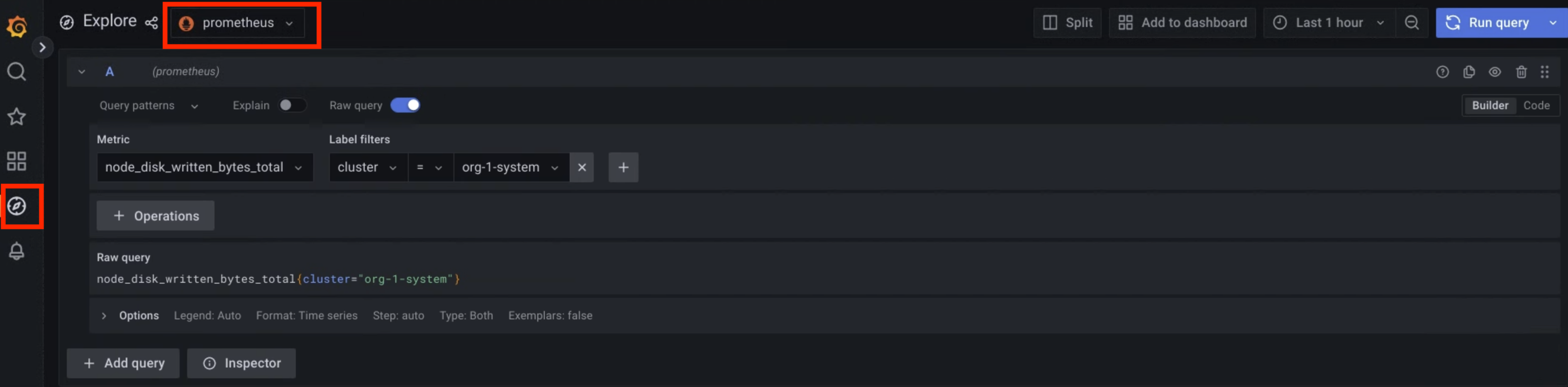

Figure 1 : Option de menu dans Grafana permettant d'interroger les métriques.

Dans la figure 1, l'option Prometheus affiche l'interface qui vous permet de créer des requêtes pour récupérer des métriques.

Exemples de requêtes

Le tableau suivant contient des exemples de requêtes permettant de surveiller la plate-forme Vertex AI dans votre environnement :

| Plate-forme Vertex AI | |||

|---|---|---|---|

| Source de données | Description | Composant | Requête |

| Métriques | Pourcentage d'utilisation du processeur du conteneur | Opérateur de niveau 1 | rate(container_cpu_usage_seconds_total{namespace="ai-system",container="l1operator"}[30s]) * 100 |

| Opérateur de niveau 2 | rate(container_cpu_usage_seconds_total{namespace="ai-system",container="l2operator"}[30s]) * 100 |

||

| Utilisation de la mémoire du conteneur en Mo | Opérateur de niveau 1 | container_memory_usage_bytes{namespace="ai-system",container="l1operator"} * 1e-6 |

|

| Opérateur de niveau 2 | container_memory_usage_bytes{namespace="ai-system",container="l2operator"} * 1e-6 |

||

| Journaux opérationnels | Journaux des opérateurs de niveau 1 | Opérateur de niveau 1 | {service_name="vai-l1operator"} |

| Journaux des opérateurs de niveau 2 | Opérateur de niveau 2 | {service_name="vai-l2operator"} |

|

| Journaux d'audit | Journaux d'audit du frontend de la plate-forme | Interface utilisateur du plug-in Web Vertex AI | {service_name="istio"} |~ upstream_cluster:.*(vai-web-plugin-frontend) |

| Journaux d'audit du backend de la plate-forme | Backend du plug-in Web Vertex AI | {service_name="istio"} |~ upstream_cluster:.*(vai-web-plugin-backend) |

|

Le tableau suivant contient des exemples de requêtes permettant de surveiller les services d'API Vertex AI, tels que OCR, Speech-to-Text et Vertex AI Translation, dans votre environnement :

| Services Vertex AI | |||

|---|---|---|---|

| Source de données | Description | Service | Requête |

| Métriques | Effet d'une API pré-entraînée sur l'utilisation du processeur |

ROC | rate(container_cpu_usage_seconds_total{namespace="g-vai-ocr-sie",container="CONTAINER_NAME"}[30s]) * 100 CONTAINER_NAME values: vision-extractor | vision-frontend | vision-vms-ocr |

| Speech-to-Text | rate(container_cpu_usage_seconds_total{namespace="g-vai-speech-sie",container="CONTAINER_NAME"}[30s]) * 100 |

||

| Vertex AI Translation | rate(container_cpu_usage_seconds_total{namespace="g-vai-translation-sie",container="CONTAINER_NAME"}[30s]) * 100 CONTAINER_NAME values: translation-aligner | translation-frontend | translation-prediction |

||

Utilisez le libellé de filtre destination_service pour obtenir le taux d'erreur au cours des 60 dernières minutes. |

ROC | rate(istio_requests_total{destination_service=~".*g-vai-ocr-sie.svc.cluster.local",response_code=~"[4-5][0-9][0-9]"}[60m]) |

|

| Speech-to-Text | rate(istio_requests_total{destination_service=~".*g-vai-speech-sie.svc.cluster.local",response_code=~"[4-5][0-9][0-9]"}[60m]) |

||

| Vertex AI Translation | rate(istio_requests_total{destination_service=~".*g-vai-translation-sie.svc.cluster.local",response_code=~"[4-5][0-9][0-9]"}[60m]) |

||

| Journaux opérationnels | Journaux opérationnels des services Vertex AI |

ROC | {namespace="g-vai-ocr-sie"} |

| Speech-to-Text | {namespace="g-vai-speech-sie"} |

||

| Vertex AI Translation | {namespace="g-vai-translation-sie"} |

||

| Journaux d'audit | Journaux d'audit des services Vertex AI | ROC | {service_name="istio"} |= "vision-frontend-server" |

| Speech-to-Text | {service_name="istio"} |= "speech-frontend-server" |

||

| Vertex AI Translation | {service_name="istio"} |= "translation-frontend-server" |

||