Questo tutorial descrive come eseguire la migrazione dei dati da Aerospike a Bigtable. Il tutorial spiega le differenze tra Aerospike e Bigtable e come trasformare il tuo carico di lavoro per eseguirlo in Bigtable. È destinato ai professionisti dei database che cercano un servizio di database su Google Cloud simile ad Aerospike. Questo tutorial presuppone che tu abbia familiarità con gli schemi di database, i tipi di dati, i fondamenti di NoSQL e i sistemi di database relazionali. Questo tutorial si basa sull'esecuzione di attività predefinite per eseguire una migrazione di esempio. Al termine del tutorial, puoi modificare il codice e i passaggi forniti in modo che corrispondano al tuo ambiente.

Bigtable è un servizio di database NoSQL completamente gestito su scala petabyte per carichi di lavoro analitici e operativi di grandi dimensioni. Puoi utilizzarlo come motore di archiviazione per il tuo servizio a bassa latenza e nell'ordine dei petabyte con maggiore disponibilità e durabilità. Puoi analizzare i dati in Bigtable utilizzando Google Cloud servizi di analisi dei dati come Dataproc e BigQuery.

Bigtable è ideale per la tecnologia pubblicitaria (ad tech), la tecnologia finanziaria (fintech) e i servizi di Internet of Things (IoT) implementati con database NoSQL come AeroSpike o Cassandra. Se cerchi un servizio gestito NoSQL, utilizza Bigtable.

Architettura

Il seguente diagramma dell'architettura di riferimento mostra i componenti comuni che puoi utilizzare per eseguire la migrazione dei dati da Aerospike a Bigtable.

Nel diagramma precedente, i dati vengono migrati da un ambiente on-premise utilizzando Aerospike a Bigtable su Google Cloud utilizzando due metodi diversi. Il primo metodo esegue la migrazione dei dati utilizzando l'elaborazione batch. Inizia spostando i dati di backup di Aerospike in un bucket Cloud Storage. Quando i dati di backup arrivano in Cloud Storage, attivano le funzioni Cloud Run per avviare un processo di estrazione, trasformazione e caricamento (ETL) batch utilizzando Dataflow. Il job Dataflow converte i dati di backup in un formato compatibile con Bigtable e li importa nell'istanza Bigtable.

Il secondo metodo esegue la migrazione dei dati utilizzando l'elaborazione in streaming. In questo metodo, ti connetti ad Aerospike utilizzando una coda di messaggi, ad esempio Kafka utilizzando Aerospike Connect, e trasferisci i messaggi in tempo reale a Pub/Sub su Google Cloud. Quando il messaggio arriva in un argomento Pub/Sub, viene elaborato dal job di streaming Dataflow in tempo reale per convertire e importare i dati nell'istanza Bigtable.

Con l'elaborazione batch, puoi eseguire la migrazione in modo efficiente di grandi blocchi di dati. Tuttavia, spesso richiede un tempo di inattività sufficiente per il cutover durante la migrazione e l'aggiornamento del servizio per i nuovi database. Se vuoi ridurre al minimo i tempi di inattività del cutover, potresti prendere in considerazione l'utilizzo dell'elaborazione in streaming per eseguire la migrazione dei dati gradualmente dopo la prima elaborazione batch per mantenere la coerenza dei dati di backup fino al completamento del cutover controllato. In questo documento puoi eseguire la migrazione da Aerospike utilizzando l'elaborazione batch con applicazioni di esempio, incluso il processo di cutover.

Confronto tra Aerospike e Bigtable

Prima di iniziare la migrazione dei dati, è fondamentale comprendere le differenze tra i modello dei dati di Aerospike e Bigtable.

Il modello dei dati Bigtable è una mappa chiave/valore distribuita, multidimensionale e ordinata con righe e famiglie di colonne. Al contrario, il modello dei dati Aerospike è un database orientato alle righe, in cui ogni record è identificato in modo univoco da una chiave. La differenza tra i modelli è il modo in cui raggruppano gli attributi di un'entità. Bigtable raggruppa gli attributi correlati in una famiglia di colonne, mentre Aerospike raggruppa gli attributi in un insieme. Aerospike supporta più tipi di dati rispetto a Bigtable. Ad esempio, Aerospike supporta numeri interi, stringhe, elenchi e mappe. Bigtable tratta tutti i dati come stringhe di byte non elaborate per la maggior parte degli scopi.

Uno schema in Aerospike è flessibile e i valori dinamici negli stessi bin possono essere di tipi diversi. Le app che utilizzano Aerospike o Bigtable hanno flessibilità e responsabilità di amministrazione dei dati simili: le app gestiscono i tipi di dati e i vincoli di integrità, anziché fare affidamento sul motore del database.

Migrazione della libreria

L'app Bookshelf è un'app web in cui gli utenti possono archiviare informazioni sui libri e visualizzare l'elenco di tutti i libri attualmente archiviati nel database. L'app utilizza un identificatore del libro (ID) per cercare le informazioni sul libro. L'app o il database genera automaticamente questi ID. Quando un utente seleziona l'immagine di un libro, il backend dell'app carica i dettagli del libro dal database.

In questo tutorial, esegui la migrazione dei dati dall'app Bookshelf utilizzando Aerospike a Bigtable. Dopo la migrazione, puoi accedere ai libri da Bigtable.

Il seguente diagramma mostra come vengono migrati i dati da Aerospike a Bigtable:

Nel diagramma precedente, la migrazione dei dati avviene nel seguente modo:

- Esegui il backup dei dati sui libri dal database Aerospike corrente e trasferisci i dati in un bucket Cloud Storage.

- Quando carichi i dati di backup nel bucket, viene attivato automaticamente

il job Dataflow

as2bttramite le notifiche di aggiornamento di Cloud Storage utilizzando la funzione Cloud Run. - Una volta completata la migrazione dei dati dal job Dataflow

as2bt, modifichi il backend del database da Aerospike a Bigtable in modo che l'app Libreria carichi i dati dei libri dal cluster Bigtable.

Obiettivi

- Esegui il deployment di un ambiente tutorial per la migrazione da Aerospike a Bigtable.

- Crea un set di dati di backup dell'app di esempio da Aerospike in Cloud Storage.

- Utilizza Dataflow per trasferire lo schema dei dati ed eseguirne la migrazione a Bigtable.

- Modifica la configurazione dell'app di esempio per utilizzare Bigtable come backend.

- Verifica che l'app Libreria funzioni correttamente con Bigtable.

Costi

In questo documento vengono utilizzati i seguenti componenti fatturabili di Google Cloud:

Per generare una stima dei costi in base all'utilizzo previsto,

utilizza il calcolatore prezzi.

I costi di Bigtable si basano sul numero di ore di nodo, sulla quantità di dati archiviati e sulla quantità di larghezza di banda di rete utilizzata. Per stimare il costo del cluster Bigtable e di altre risorse, puoi utilizzare il Calcolatore prezzi. La configurazione di esempio del Calcolatore prezzi utilizza tre nodi Bigtable anziché un singolo nodo. Il costo totale stimato nell'esempio precedente è superiore al costo totale effettivo di questo tutorial.

Al termine delle attività descritte in questo documento, puoi evitare l'addebito di ulteriori costi eliminando le risorse che hai creato. Per ulteriori informazioni, vedi Pulizia.

Prima di iniziare

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

-

Enable the Cloud Resource Manager API.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles.Terraform utilizza l'API Cloud Resource Manager per abilitare le API richieste per questo tutorial.

-

In the Google Cloud console, activate Cloud Shell.

prepara l'ambiente

Per preparare l'ambiente per la migrazione da Aerospike a Bigtable, esegui i seguenti strumenti direttamente da Cloud Shell:

- Google Cloud CLI

- Lo strumento a riga di comando Bigtable,

cbt - Terraform

- Apache Maven

Questi strumenti sono già disponibili in Cloud Shell, quindi non devi installarli di nuovo.

Configura il tuo progetto

In Cloud Shell, controlla l'ID progetto che Cloud Shell configura automaticamente. Il prompt dei comandi viene aggiornato in modo da riflettere il progetto attualmente attivo e viene visualizzato in questo formato:

USERNAME@cloudshell:~ (PROJECT_ID)$Se l'ID progetto non è configurato correttamente, puoi configurarlo manualmente:

gcloud config set project <var>PROJECT_ID</var>Sostituisci

PROJECT_IDcon l'ID progetto Google Cloud .Configura

us-east1come regione eus-east1-bcome zona:gcloud config set compute/region us-east1 gcloud config set compute/zone us-east1-bPer saperne di più su regioni e zone, consulta Area geografica e regioni.

Esegui il deployment dell'ambiente del tutorial

In Cloud Shell, clona il repository di codice:

git clone https://github.com/fakeskimo/as2bt.git/In Cloud Shell, inizializza la directory di lavoro di Terraform:

cd "$HOME"/as2bt/bookshelf/terraform terraform initConfigura le variabili di ambiente Terraform per il deployment:

export TF_VAR_gce_vm_zone="$(gcloud config get-value compute/zone)" export TF_VAR_gcs_bucket_location="$(gcloud config get-value compute/region)"Rivedi il piano di esecuzione di Terraform:

terraform planL'output è simile al seguente:

Terraform will perform the following actions: # google_bigtable_instance.bookshelf_bigtable will be created + resource "google_bigtable_instance" "bookshelf_bigtable" { + display_name = (known after apply) + id = (known after apply) + instance_type = "DEVELOPMENT" + name = "bookshelf-bigtable" + project = (known after apply) + cluster { + cluster_id = "bookshelf-bigtable-cluster" + storage_type = "SSD" + zone = "us-east1-b" } }(Facoltativo) Per visualizzare le risorse con dipendenze di cui viene eseguito il deployment da Terraform, disegna grafici:

terraform graph | dot -Tsvg > graph.svgEsegui il provisioning dell'ambiente del tutorial:

terraform apply

Verifica dell'ambiente tutorial e dell'app Bookshelf

Dopo aver eseguito il provisioning dell'ambiente e prima di avviare il job di migrazione dei dati, devi verificare che tutte le risorse siano state implementate e configurate. Questa sezione spiega come verificare il processo di provisioning e ti aiuta a capire quali componenti sono configurati nell'ambiente.

Verifica l'ambiente del tutorial

In Cloud Shell, verifica l'istanza di Compute Engine

bookshelf-aerospike:gcloud compute instances listL'output mostra che l'istanza è di cui è stato eseguito il deployment nella zona

us-east1-b:NAME ZONE MACHINE_TYPE PREEMPTIBLE INTERNAL_IP EXTERNAL_IP STATUS bookshelf-aerospike us-east1-b n1-standard-2 10.142.0.4 34.74.72.3 RUNNING

Verifica l'istanza Bigtable

bookshelf-bigtable:gcloud bigtable instances listL'output è simile al seguente:

NAME DISPLAY_NAME STATE bookshelf-bigtable bookshelf-bigtable READY

Questa istanza Bigtable viene utilizzata come destinazione di migrazione per i passaggi successivi.

Verifica che il bucket Cloud Storage

bookshelfsi trovi nel job della pipeline Dataflow:gcloud storage ls gs://bookshelf-* --bucketsPoiché i nomi dei bucket Cloud Storage devono essere univoci a livello globale, il nome del bucket viene creato con un suffisso casuale. L'output è simile al seguente:

gs://bookshelf-616f60d65a3abe62/

Aggiungere un libro all'app Bookshelf

In Cloud Shell, recupera l'indirizzo IP esterno dell'istanza

bookshelf-aerospike:gcloud compute instances list --filter="name:bookshelf-aerospike" \ --format="value(networkInterfaces[0].accessConfigs.natIP)"Prendi nota dell'indirizzo IP perché ti servirà nel passaggio successivo.

Per aprire l'app Bookshelf, in un browser web, vai a

http://IP_ADDRESS:8080.Sostituisci

IP_ADDRESScon l'indirizzo IP esterno che hai copiato dal passaggio precedente.Per creare un nuovo libro, fai clic su Aggiungi libro.

Nella finestra Aggiungi libro, compila i seguenti campi e poi fai clic su Salva:

- Nel campo Title (Titolo), inserisci

Aerospike-example. - Nel campo Author (Autore), inserisci

Aerospike-example. - Nel campo Data di pubblicazione, inserisci la data odierna.

- Nel campo Descrizione, inserisci

Aerospike-example.

Questo libro viene utilizzato per verificare che l'app Bookshelf utilizzi Aerospike come spazio di archiviazione dei libri.

- Nel campo Title (Titolo), inserisci

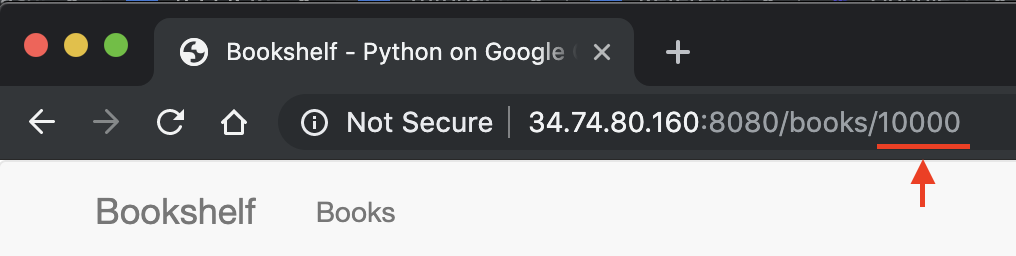

Nell'URL dell'app Bookshelf, prendi nota dell'ID libro. Ad esempio, se l'URL è

34.74.80.160:8080/books/10000, l'ID libro è10000.

In Cloud Shell, utilizza SSH per connetterti all'istanza

bookshelf-aerospike:gcloud compute ssh bookshelf-aerospikeDalla sessione dell'istanza

bookshelf-aerospike, verifica che sia stato creato un nuovo libro con l'ID libro annotato in precedenza:aql -c 'select * from bookshelf.books where id = "BOOK_ID"'

L'output è simile al seguente:

+----------------------+----------------------+---------------+----------------------+----------+---------+ | title | author | publishedDate | description | imageUrl | id | +----------------------+----------------------+---------------+----------------------+----------+---------+ | " Aerospike-example" | " Aerospike-example" | "2000-01-01" | " Aerospike-example" | "" | "10000" | +----------------------+----------------------+---------------+----------------------+----------+---------+ 1 row in set (0.001 secs)

Se l'ID libro non è presente nell'elenco, ripeti i passaggi per aggiungere un nuovo libro.

Trasferimento dei dati di backup da Aerospike a Cloud Storage

In Cloud Shell, dalla sessione dell'istanza

bookshelf-aerospike, crea un file di backup di Aerospike:aql -c "select * from bookshelf.books" --timeout=-1 --outputmode=json \` | tail -n +2 | jq -c '.[0] | .[]' \ | gcloud storage cp - $(gcloud storage ls gs://bookshelf-* --buckets)bookshelf-backup.jsonQuesto comando elabora i dati e crea un file di backup tramite la seguente procedura:

- Seleziona le informazioni sul libro da Aerospike e le stampa nel formato JSON prettyprint.

- Rimuove i primi due titoli dall'output e converte i dati nel formato JSON delimitato da newline (ndjson) utilizzando

jq, un processore JSON a riga di comando. - Utilizza gcloud CLI per caricare i dati nel bucket Cloud Storage.

Verifica che il file di backup di Aerospike sia stato caricato ed esista nel bucket Cloud Storage:

gcloud storage ls gs://bookshelf-*/bookshelf-*\ gs://bookshelf-616f60d65a3abe62/bookshelf-backup.json(Facoltativo) Esamina i contenuti del file di backup dal bucket Cloud Storage:

gcloud storage cat -r 0-1024 gs://bookshelf-*/bookshelf-backup.json | head -n 2L'output è simile al seguente:

{"title":"book_2507","author":"write_2507","publishedDate":"1970-01-01","imageUrl":"https://storage.googleapis.com/aerospike2bt-bookshelf/The_Home_Edit-2019-06-24-044906.jpg","description":"test_2507","createdBy":"write_2507","createdById":"2507_anonymous","id":"2507"} {"title":"book_3867","author":"write_3867","publishedDate":"1970-01-01","imageUrl":"https://storage.googleapis.com/aerospike2bt-bookshelf/The_Home_Edit-2019-06-24-044906.jpg","description":"test_3867","createdBy":"write_3867","createdById":"3867_anonymous","id":"3867"}Esci dalla sessione SSH e torna a Cloud Shell:

exit

Migrazione dei dati di backup a Bigtable utilizzando Dataflow

Ora puoi eseguire la migrazione dei dati di backup da Cloud Storage a un'istanza Bigtable. Questa sezione spiega come utilizzare le pipeline Dataflow per eseguire la migrazione dei dati compatibili con uno schema Bigtable.

Configura il job di migrazione di Dataflow

In Cloud Shell, vai alla directory

dataflownel repository di codice di esempio:cd "$HOME"/as2bt/dataflow/Configura le variabili di ambiente per un job Dataflow:

export BOOKSHELF_BACKUP_FILE="$(gcloud storage ls gs://bookshelf*/bookshelf-backup.json)" export BOOKSHELF_DATAFLOW_ZONE="$(gcloud config get-value compute/zone)"Verifica che le variabili di ambiente siano configurate correttamente:

env | grep BOOKSHELFSe le variabili di ambiente sono configurate correttamente, l'output è simile al seguente:

BOOKSHELF_BACKUP_FILE=gs://bookshelf-616f60d65a3abe62/bookshelf-backup.json BOOKSHELF_DATAFLOW_ZONE=us-east1-b

Esegui il job Dataflow

In Cloud Shell, esegui la migrazione dei dati da Cloud Storage all'istanza Bigtable:

./run_oncloud_json.shPer monitorare il job di migrazione dei dati di backup, nella consoleGoogle Cloud , vai alla pagina Job.

Attendi il completamento del job. Al termine del job, l'output in Cloud Shell è simile al seguente:

Dataflow SDK version: 2.13.0 Submitted job: 2019-12-16_23_24_06-2124083021829446026 [INFO] ------------------------------------------------------------------------ [INFO] BUILD SUCCESS [INFO] ------------------------------------------------------------------------ [INFO] Total time: 08:20 min [INFO] Finished at: 2019-12-17T16:28:08+09:00 [INFO] ------------------------------------------------------------------------

Controlla i risultati del job di migrazione

In Cloud Shell, verifica che i dati di backup siano stati trasferiti correttamente in Bigtable:

cbt -instance bookshelf-bigtable lookup books 00001L'output è simile al seguente:

---------------------------------------- 00001 info:author @ 2019/12/17-16:26:04.434000 "Aerospike-example" info:description @ 2019/12/17-16:26:04.434000 "Aerospike-example" info:id @ 2019/12/17-16:26:04.434000 "00001" info:imageUrl @ 2019/12/17-16:26:04.434000 "" info:publishedDate @ 2019/12/17-16:26:04.434000 "2019-10-01" info:title @ 2019/12/17-16:26:04.434000 "Aerospike-example"

Modifica del database della libreria da Aerospike a Bigtable

Dopo aver eseguito la migrazione dei dati da Aerospike a Bigtable, puoi modificare la configurazione dell'app Bookshelf per utilizzare Bigtable per l'archiviazione. Quando configuri questa impostazione, i nuovi libri vengono salvati nelle istanze Bigtable.

Modificare la configurazione dell'app Bookshelf

In Cloud Shell, utilizza SSH per connetterti all'app

bookshelf-aerospike:gcloud compute ssh bookshelf-aerospikeVerifica che la configurazione

DATA_BACKENDattuale siaaerospike:grep DATA_BACKEND /opt/app/bookshelf/config.pyL'output è il seguente:

DATA_BACKEND = 'aerospike'

Modifica la configurazione di

DATA_BACKENDdaaerospikeabigtable:sudo sed -i "s/DATA_BACKEND =.*/DATA_BACKEND = 'bigtable'/g" /opt/app/bookshelf/config.pyVerifica che la configurazione di

DATA_BACKENDsia stata modificata inbigtable:grep DATA_BACKEND /opt/app/bookshelf/config.pyL'output è il seguente:

DATA_BACKEND = 'bigtable'

Riavvia l'app Bookshelf che utilizza la nuova configurazione di backend

bigtable:sudo supervisorctl restart bookshelfVerifica che l'app Bookshelf sia stata riavviata e sia in esecuzione correttamente:

sudo supervisorctl status bookshelfL'output è simile al seguente:

bookshelf RUNNING pid 18318, uptime 0:01:00

Verifica che l'app Libreria utilizzi il backend Bigtable

- In un browser, vai a

http://IP_ADDRESS:8080. Aggiungi un nuovo libro chiamato

Bigtable-example.Per verificare che il libro

Bigtable-examplesia stato creato in un'istanza Bigtable dall'app Bookshelf, copia l'ID del libro dalla barra degli indirizzi del browser.In Cloud Shell, cerca i dati dei libri

Bigtable-exampleda un'istanza Bigtable:cbt -instance bookshelf-bigtable lookup books 7406950188L'output è simile al seguente:

---------------------------------------- 7406950188 info:author @ 2019/12/17-17:28:25.592000 "Bigtable-example" info:description @ 2019/12/17-17:28:25.592000 "Bigtable-example" info:id @ 2019/12/17-17:28:25.592000 "7406950188" info:image_url @ 2019/12/17-17:28:25.592000 "" info:published_date @ 2019/12/17-17:28:25.592000 "2019-10-01" info:title @ 2019/12/17-17:28:25.592000 "Bigtable-example"

Hai eseguito correttamente la migrazione dei dati da Aerospike a Bigtable e hai modificato la configurazione del bookshelf per connetterti a un backend Bigtable.

Esegui la pulizia

Il modo più semplice per eliminare la fatturazione è eliminare il progetto che hai creato per il tutorial. Google Cloud In alternativa, puoi eliminare le singole risorse.

Elimina il progetto

- In the Google Cloud console, go to the Manage resources page.

- In the project list, select the project that you want to delete, and then click Delete.

- In the dialog, type the project ID, and then click Shut down to delete the project.

Passaggi successivi

- Scopri come progettare lo schema Bigtable.

- Scopri come avviare la migrazione a Google Cloud.

- Comprendi quali strategie hai per il trasferimento di set di dati di grandi dimensioni.

- Esplora architetture, diagrammi e best practice di riferimento su Google Cloud. Consulta il nostro Cloud Architecture Center.