TPU (Tensor Processing Unit)

Conçu pour l'IA nouvelle génération

Créez, optimisez et faites évoluer les charges de travail d'entraînement, d'inférence et d'apprentissage par renforcement pour alimenter les agents de raisonnement autonome.

Présentation

Une décennie de Tensor Processing Units (TPU)

Les TPU sont des accélérateurs conçus sur mesure pour les charges de travail d'IA, comme les agents, la génération de code, les grands modèles de langage, la génération de contenu multimédia, la synthèse vocale, les services de vision, les moteurs de recommandations et les modèles de personnalisation, entre autres. Les TPU alimentent Gemini et toutes les applications de Google optimisées par l'IA, comme la recherche, Photos et Maps, qui comptent plus d'un milliard d'utilisateurs.

Conçu pour l'IA agentique

Le passage à l'IA agentique nécessite une infrastructure capable d'effectuer un raisonnement en plusieurs étapes et un apprentissage par renforcement continu. Les TPU brisent le "mur de mémoire" de l'inférence en hébergeant des caches KV massifs entièrement sur silicium, grâce à une SRAM sur puce étendue avec le TPU 8i. Combinée à notre moteur SparseCore, qui décharge les tâches de communication, cette architecture réduit le temps d'inactivité des cœurs. Le résultat est une performance prévisible à faible latence qui alimente des boucles de raisonnement complexes.

Des performances sans compromis

Accélérez votre délai de déploiement en réduisant les délais d'entraînement des modèles de pointe. Les instances Cloud TPU maximisent le débit utile, en veillant à ce que presque chaque cycle de calcul soit consacré à l'apprentissage actif. Cette architecture s'appuie sur une interconnexion entre puces à haut débit, un commutateur de circuits optiques et le réseau Virgo, permettant aux accélérateurs de fonctionner comme un système unifié et hautement fiable.

Économie durable à grande échelle

Les TPU sont conçus pour améliorer la valeur et la consommation d'énergie en se concentrant sur les besoins de calcul de l'IA, éliminant ainsi les frais généraux opérationnels propres aux architectures polyvalentes. La gestion de l'alimentation intégrée s'adapte de manière dynamique au volume de requêtes en temps réel, offrant ainsi des performances par watt élevées et prenant en charge les charges de travail d'IA complexes de manière durable.

Opérations ouvertes, flexibles et fiables

Créez des applications sur un écosystème ouvert à l'aide de bibliothèques et d'outils que vous connaissez déjà. Les Cloud TPU offrent une compatibilité native et hautes performances avec PyTorch et JAX, ainsi qu'avec le moteur vLLM pour une inférence rapide. Gérez et faites évoluer ces déploiements de manière fiable sur des clusters mondiaux avec Google Kubernetes Engine (GKE).

Versions de Cloud TPU

| Version de Cloud TPU | Description | Disponibilité |

|---|---|---|

TPU 8i | Le TPU 8i est optimisé pour le post-entraînement et l'inférence, tout en offrant une amélioration de 80 % des performances par dollar par rapport aux générations précédentes pour l'inférence à faible latence des grands modèles MoE. | Bientôt disponible |

TPU 8t | Le TPU 8t est conçu pour le pré-entraînement à grande échelle et les charges de travail intensives en embeddings, avec une capacité allant jusqu'à 9 600 puces dans un seul superpod. Il offre un rapport performances/prix par dollar jusqu'à 2,7 fois supérieur à celui d'Ironwood pour l'entraînement à grande échelle. | Bientôt disponible |

Ironwood | Le TPU de 7e génération économe en énergie, conçu pour l'entraînement, le raisonnement et l'inférence à grande échelle. Chaque pod comporte 9 216 puces à refroidissement liquide, fournit 42,5 exaflops et offre des performances par puce quatre fois supérieures à celles de Trillium. | Ironwood est en disponibilité générale en Amérique du Nord (région Centre) et en Europe (région Ouest) |

Trillium | Le TPU de sixième génération offrant une meilleure efficacité énergétique et des performances de calcul optimales pour l'entraînement et l'inférence. Il offre une efficacité énergétique 67 % supérieure et des performances de calcul optimales par puce 4,7 fois plus élevées par rapport à la génération précédente, TPU v5e. | Trillium est en disponibilité générale en Amérique du Nord (région Est des États-Unis), en Europe (région Ouest) et en Asie (région Nord-Est). |

Informations supplémentaires sur les versions de Cloud TPU

TPU 8i

Le TPU 8i est optimisé pour le post-entraînement et l'inférence, tout en offrant une amélioration de 80 % des performances par dollar par rapport aux générations précédentes pour l'inférence à faible latence des grands modèles MoE.

Bientôt disponible

TPU 8t

Le TPU 8t est conçu pour le pré-entraînement à grande échelle et les charges de travail intensives en embeddings, avec une capacité allant jusqu'à 9 600 puces dans un seul superpod. Il offre un rapport performances/prix par dollar jusqu'à 2,7 fois supérieur à celui d'Ironwood pour l'entraînement à grande échelle.

Bientôt disponible

Ironwood

Le TPU de 7e génération économe en énergie, conçu pour l'entraînement, le raisonnement et l'inférence à grande échelle. Chaque pod comporte 9 216 puces à refroidissement liquide, fournit 42,5 exaflops et offre des performances par puce quatre fois supérieures à celles de Trillium.

Ironwood est en disponibilité générale en Amérique du Nord (région Centre) et en Europe (région Ouest)

Trillium

Le TPU de sixième génération offrant une meilleure efficacité énergétique et des performances de calcul optimales pour l'entraînement et l'inférence. Il offre une efficacité énergétique 67 % supérieure et des performances de calcul optimales par puce 4,7 fois plus élevées par rapport à la génération précédente, TPU v5e.

Trillium est en disponibilité générale en Amérique du Nord (région Est des États-Unis), en Europe (région Ouest) et en Asie (région Nord-Est).

Informations supplémentaires sur les versions de Cloud TPU

Fonctionnement

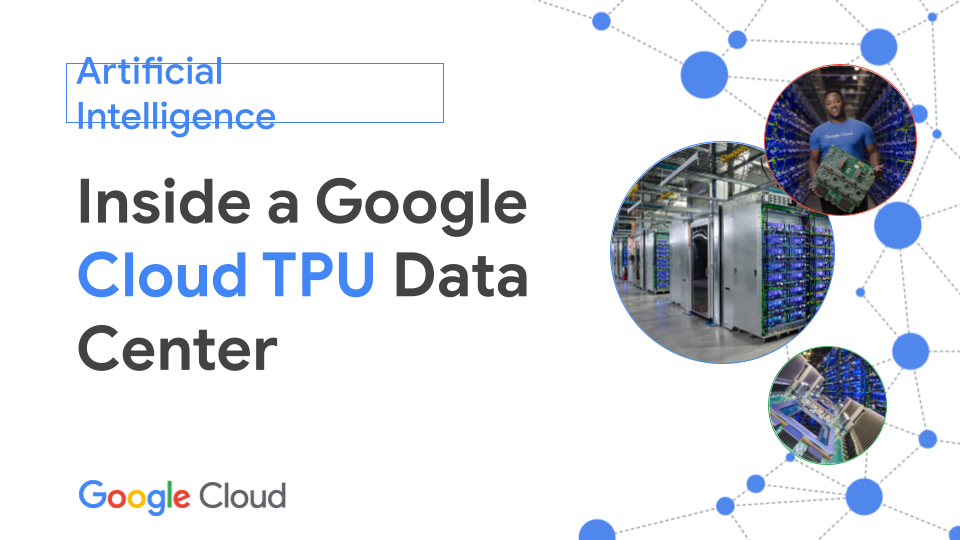

Découvrez la magie des TPU Google Cloud de l'intérieur et profitez d'un aperçu rare des centres de données. Nos clients utilisent des Cloud TPU pour exécuter certaines des charges de travail d'IA à grande échelle, et cette capacité ne se résume pas à une simple puce. Dans cette vidéo, découvrez les composants du système TPU : mise en réseau de centres de données, commutateurs de circuits optiques, systèmes de refroidissement à eau, vérification de la sécurité biométrique, etc.

Découvrez la magie des TPU Google Cloud de l'intérieur et profitez d'un aperçu rare des centres de données. Nos clients utilisent des Cloud TPU pour exécuter certaines des charges de travail d'IA à grande échelle, et cette capacité ne se résume pas à une simple puce. Dans cette vidéo, découvrez les composants du système TPU : mise en réseau de centres de données, commutateurs de circuits optiques, systèmes de refroidissement à eau, vérification de la sécurité biométrique, etc.

Exécutez des charges de travail de pré-entraînement de l'IA à grande échelle

Accélérer le délai de mise sur le marché des modèles de frontière

Réduisez les délais de pré-entraînement pour les modèles de fondation massifs. Le TPU 8t fournit une puissance de calcul hautes performances dans un seul pod et évolue via le réseau Virgo. Associée à un accès rapide au stockage et à l'isolation NUMA alimentée par Axion, l'architecture atteint un débit utile élevé, garantissant que les cycles de calcul sont consacrés à la création active de modèles plutôt qu'à l'inactivité pendant le transfert de données ou les réinitialisations matérielles.

Autres ressources

Accélérer le délai de mise sur le marché des modèles de frontière

Réduisez les délais de pré-entraînement pour les modèles de fondation massifs. Le TPU 8t fournit une puissance de calcul hautes performances dans un seul pod et évolue via le réseau Virgo. Associée à un accès rapide au stockage et à l'isolation NUMA alimentée par Axion, l'architecture atteint un débit utile élevé, garantissant que les cycles de calcul sont consacrés à la création active de modèles plutôt qu'à l'inactivité pendant le transfert de données ou les réinitialisations matérielles.

Post-entraînement et apprentissage par renforcement efficaces

Faire évoluer efficacement les charges de travail d'apprentissage par renforcement

Transformez les modèles de base en agents intelligents grâce à des workflows de post-entraînement intensifs. La 8e génération de système TPU traite rapidement les essais d'apprentissage par renforcement continu, en récompensant les meilleurs chemins de raisonnement sans les retards de cycle courants qu'on retrouvait dans les générations précédentes. Cela vous permet d'affiner efficacement les modèles du monde, en donnant aux agents la possibilité d'améliorer leur raisonnement dans des environnements simulés avant une exécution dans le monde réel.

Autres ressources

Faire évoluer efficacement les charges de travail d'apprentissage par renforcement

Transformez les modèles de base en agents intelligents grâce à des workflows de post-entraînement intensifs. La 8e génération de système TPU traite rapidement les essais d'apprentissage par renforcement continu, en récompensant les meilleurs chemins de raisonnement sans les retards de cycle courants qu'on retrouvait dans les générations précédentes. Cela vous permet d'affiner efficacement les modèles du monde, en donnant aux agents la possibilité d'améliorer leur raisonnement dans des environnements simulés avant une exécution dans le monde réel.

Charges de travail d'inférence d'IA à faible latence à grande échelle

Inférence hautes performances et économique

Brisez les limites de la mémoire d'inférence. Le TPU 8i étend la SRAM sur puce et la mémoire à haut débit, hébergeant des caches KV haute capacité entièrement sur silicium. En utilisant le moteur d'accélération SparseCore-Collectives (SC-CAE) pour décharger les tâches de communication globale, cette architecture réduit considérablement la latence sur puce, libérant ainsi les cœurs de calcul principaux pour la génération de jetons pure et à faible latence.

Autres ressources

Inférence hautes performances et économique

Brisez les limites de la mémoire d'inférence. Le TPU 8i étend la SRAM sur puce et la mémoire à haut débit, hébergeant des caches KV haute capacité entièrement sur silicium. En utilisant le moteur d'accélération SparseCore-Collectives (SC-CAE) pour décharger les tâches de communication globale, cette architecture réduit considérablement la latence sur puce, libérant ainsi les cœurs de calcul principaux pour la génération de jetons pure et à faible latence.

Cas d'utilisation métier

Agents de raisonnement autonomes

Les TPU offrent la bande passante mémoire et l'inférence à faible latence nécessaires pour exécuter des boucles de raisonnement continues en plusieurs étapes pour les assistants de codage en temps réel, le service client autonome et les opérations de sécurité.

Modèles de fondation et IA générative multimodale

Les TPU offrent un calcul continu à haut débit. Ils permettent de créer et d'exploiter efficacement des modèles de fondation massifs dans les modalités de texte, d'image, d'audio et de vidéo.

Science et santé de précision

Les TPU gèrent des calculs mathématiques complexes et matriciels pour accélérer les simulations à forte intensité de calcul pour la biologie structurelle, le séquençage génomique et la découverte de médicaments.

IA physique

Créez des agents physiques qui interagissent avec le monde réel et s'y adaptent. Simulez et entraînez des robots, des agents autonomes et des machines industrielles plus rapidement et plus efficacement avec des données synthétiques et réelles.