Vertex AI 价格

所列价格以美元 (USD) 为单位。 如果您使用非美元货币付费,请参阅 Cloud Platform SKU 上以您的币种列出的价格。

Vertex AI 价格与旧版产品价格的比较

Vertex AI 的费用与被其取代的旧版 AI Platform 和 AutoML 产品的费用相同,但以下情况除外:

- 旧版 AI Platform Prediction 和 AutoML Tables 预测支持一些费用和性能都更低的机器类型,而 Vertex AI 推理和 AutoML 表格不支持。

- 旧版 AI Platform Prediction 支持缩减至零,而 Vertex AI Inference 不支持。

Vertex AI 还提供了更多优化成本的方法,比如:

- 优化的 TensorFlow 运行时

- 支持共同托管模型。

- 训练和预测没有最短使用时长,而是以 30 秒为增量计算使用费。

Vertex AI 上的生成式 AI 的价格

如需 Vertex AI 上的生成式 AI 的价格信息,请参阅 Vertex AI 上的生成式 AI 的价格。

AutoML 模型的价格

对于 Vertex AI AutoML 模型,您需要为三类主要活动付费:

- 训练模型

- 将模型部署到端点

- 使用模型进行预测

Vertex AI 使用 Vertex AutoML 模型的预定义机器配置,这些活动的每小时费率反映了资源使用情况。

训练模型所需的时间取决于训练数据的规模和复杂程度。您必须先部署模型,然后模型才能提供在线预测或在线解释。

即使模型未进行预测,您也需要为部署到端点的每个模型付费。如需避免模型产生进一步的费用,您必须取消部署模型。未部署或部署失败的模型不会产生费用。

您只需为实际使用的计算小时数付费;如果训练因用户自行取消之外的原因而失败,您不需要为相应训练时间付费。如果您取消操作,则需要按训练时间付费。

请从下方选择一种模型类型以获取价格信息。

图片数据

图片数据

操作 | 价格(分类)(美元) | 价格(对象检测)(USD) |

|---|---|---|

培训 | US$3.465 / 1 hour | US$3.465 / 1 hour |

训练(Edge 设备端模型) | US$18.00 / 1 hour | US$18.00 / 1 hour |

部署和在线预测 | US$1.375 / 1 hour | US$2.002 / 1 hour |

批量预测 | US$2.222 / 1 hour | US$2.222 / 1 hour |

表格数据

表格数据

操作 | 每节点时价格(分类/回归) | 预测价格 |

|---|---|---|

培训 | US$21.252 / 1 hour | |

推理 | 价格与自定义训练模型的推理价格相同。 Vertex AI 使用 40 台 n1-highmem-8 机器执行批量推理。 |

Vertex Explainable AI 的推理费用

与 Vertex Explainable AI 关联的计算按照与推理相同的费率计费。但解释要比正常的推理花费更长的时间,因此大量使用 Vertex Explainable AI 以及自动扩缩可能导致启动更多节点,这将增加推理费用。

Vertex AI Forecast

AutoML

AutoML

阶段 | 价格 |

|---|---|

预测 | 0 count to 1,000,000 count US$0.20 / 1,000 count, per 1 month / account 1,000,000 count to 50,000,000 count US$0.10 / 1,000 count, per 1 month / account 50,000,000 count and above US$0.02 / 1,000 count, per 1 month / account |

培训 | US$21.252 / 1 hour |

Explainable AI | 使用 Shapley 值实现可解释性。请参阅 Vertex AI 推理和解释 价格页面。 |

* 预测数据点是预测范围内的一个时间点。例如,如果粒度按天计算,7 天的范围为每个时序 7 个点。

- 如果包含的预测分位数不超过 5 个,则无需额外付费。

- 每个层级消耗的数据点数量每月更新一次。

ARIMA+

ARIMA+

阶段 | 价格 |

|---|---|

预测 | US$5.00 / 1,000 count |

培训 | 每 TB$250.00 x 候选模型数量 x 回测窗口数量* |

Explainable AI | 使用时序分解来实现可解释性无需额外付费。不支持使用 Shapley 值实现可解释性。 |

请参阅 BigQuery ML 价格页面了解更多详情。如 Vertex AI 价格中所述,每项训练和预测作业都会产生 1 次托管式流水线运行的费用。

* 测试集内的每个时段都会创建一个回测窗口。候选模型的数量由使用的 AUTO_ARIMA_MAX_ORDER 决定。对于有多个时序的模型,数量范围在 6-42 之间。

自定义训练模型

培训

培训

下表提供了各种训练配置的大致每小时价格。您可以选择采用由所选机器类型组成的自定义配置。如需计算价格,请将您使用的虚拟机的费用相加。

如果您使用 Compute Engine 机器类型并挂接加速器,则加速器的费用需另外计算。如需计算此费用,请将下表中加速器的价格乘以您使用的每种加速器类型的机器小时数。

机器类型

机器类型

您可以将 Spot 虚拟机用于 Vertex AI 自定义训练。Spot 虚拟机的费用根据 Compute Engine Spot 虚拟机价格计算。除基础设施使用费之外,还需支付 Vertex AI 自定义训练管理费,详情见以下表格。

您可以将 Compute Engine 预留与 Vertex AI 自定义训练搭配使用。使用 Compute Engine 预留时,您需要按照 Compute Engine 价格付费,包括所有适用的承诺使用折扣 (CUD)。除基础设施使用费之外,还需支付 Vertex AI 自定义训练管理费,详情见以下表格。

- Johannesburg (africa-south1)

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Delhi (asia-south2)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Melbourne (australia-southeast2)

- Warsaw (europe-central2)

- Finland (europe-north1)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- Turin (europe-west12)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Milan (europe-west8)

- Paris (europe-west9)

- Doha (me-central1)

- Dammam (me-central2)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Toronto (northamerica-northeast2)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Alabama (us-east7)

- Dallas (us-south1)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

机器类型 | 价格 (USD) |

|---|---|

g4-standard-48 | US$5.17508763 / 1 hour |

g4-standard-96 | US$10.35017526 / 1 hour |

g4-standard-192 | US$20.70035052 / 1 hour |

g4-standard-384 | US$41.40070104 / 1 hour |

n1-standard-4 | US$0.21849885 / 1 hour |

n1-standard-8 | US$0.4369977 / 1 hour |

n1-standard-16 | US$0.8739954 / 1 hour |

n1-standard-32 | US$1.7479908 / 1 hour |

n1-standard-64 | US$3.4959816 / 1 hour |

n1-standard-96 | US$5.2439724 / 1 hour |

n1-highmem-2 | US$0.13604845 / 1 hour |

n1-highmem-4 | US$0.2720969 / 1 hour |

n1-highmem-8 | US$0.5441938 / 1 hour |

n1-highmem-16 | US$1.0883876 / 1 hour |

n1-highmem-32 | US$2.1767752 / 1 hour |

n1-highmem-64 | US$4.3535504 / 1 hour |

n1-highmem-96 | US$6.5303256 / 1 hour |

n1-highcpu-16 | US$0.65180712 / 1 hour |

n1-highcpu-32 | US$1.30361424 / 1 hour |

n1-highcpu-64 | US$2.60722848 / 1 hour |

n1-highcpu-96 | US$3.91084272 / 1 hour |

a2-highgpu-1g* | US$4.425248914 / 1 hour |

a2-highgpu-2g* | US$8.850497829 / 1 hour |

a2-highgpu-4g* | US$17.700995658 / 1 hour |

a2-highgpu-8g* | US$35.401991315 / 1 hour |

a2-megagpu-16g* | US$65.707278915 / 1 hour |

a3-highgpu-8g* | US$101.007352 / 1 hour |

a3-megagpu-8g* | US$106.0464232 / 1 hour |

a3-ultragpu-8g* | US$99.7739296 / 1 hour |

a4-highgpu-8g* | US$148.212 / 1 hour |

e2-standard-4 | US$0.154126276 / 1 hour |

e2-standard-8 | US$0.308252552 / 1 hour |

e2-standard-16 | US$0.616505104 / 1 hour |

e2-standard-32 | US$1.233010208 / 1 hour |

e2-highmem-2 | US$0.103959618 / 1 hour |

e2-highmem-4 | US$0.207919236 / 1 hour |

e2-highmem-8 | US$0.415838472 / 1 hour |

e2-highmem-16 | US$0.831676944 / 1 hour |

e2-highcpu-16 | US$0.455126224 / 1 hour |

e2-highcpu-32 | US$0.910252448 / 1 hour |

n2-standard-4 | US$0.2233714 / 1 hour |

n2-standard-8 | US$0.4467428 / 1 hour |

n2-standard-16 | US$0.8934856 / 1 hour |

n2-standard-32 | US$1.7869712 / 1 hour |

n2-standard-48 | US$2.6804568 / 1 hour |

n2-standard-64 | US$3.5739424 / 1 hour |

n2-standard-80 | US$4.467428 / 1 hour |

n2-highmem-2 | US$0.1506661 / 1 hour |

n2-highmem-4 | US$0.3013322 / 1 hour |

cloud-tpu | 价格取决于加速器类型。请参阅“加速器”。 |

n2-highmem-8 | US$0.6026644 / 1 hour |

n2-highmem-16 | US$1.2053288 / 1 hour |

n2-highmem-32 | US$2.4106576 / 1 hour |

n2-highmem-48 | US$3.6159864 / 1 hour |

n2-highmem-64 | US$4.8213152 / 1 hour |

n2-highmem-80 | US$6.026644 / 1 hour |

n2-highcpu-16 | US$0.6596032 / 1 hour |

n2-highcpu-32 | US$1.3192064 / 1 hour |

n2-highcpu-48 | US$1.9788096 / 1 hour |

n2-highcpu-64 | US$2.6384128 / 1 hour |

n2-highcpu-80 | US$3.298016 / 1 hour |

c2-standard-4 | US$0.2401292 / 1 hour |

c2-standard-8 | US$0.4802584 / 1 hour |

c2-standard-16 | US$0.9605168 / 1 hour |

c2-standard-30 | US$1.800969 / 1 hour |

c2-standard-60 | US$3.601938 / 1 hour |

m1-ultramem-40 | US$7.237065 / 1 hour |

m1-ultramem-80 | US$14.47413 / 1 hour |

m1-ultramem-160 | US$28.94826 / 1 hour |

m1-megamem-96 | US$12.249984 / 1 hour |

*此金额包含 GPU 价格,因为此实例类型始终需要固定数量的 GPU 加速器。

如果您使用非美元货币付费,请参阅 Cloud Platform SKU 上以您的币种列出的价格。

加速器

加速器

- Johannesburg (africa-south1)

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Delhi (asia-south2)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Melbourne (australia-southeast2)

- Warsaw (europe-central2)

- Finland (europe-north1)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- Berlin (europe-west10)

- Turin (europe-west12)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Milan (europe-west8)

- Paris (europe-west9)

- Doha (me-central1)

- Dammam (me-central2)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Toronto (northamerica-northeast2)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

- Phoenix (us-west8)

机器类型 | 价格 (USD) | Vertex 管理费 |

|---|---|---|

NVIDIA_TESLA_A100 | US$2.933908 / 1 hour | US$0.4400862 / 1 hour |

NVIDIA_TESLA_A100_80GB | US$3.92808 / 1 hour | US$0.589212 / 1 hour |

NVIDIA_H100_80GB | US$9.79655057 / 1 hour | US$1.4694826 / 1 hour |

NVIDIA_H200_141GB | US$10.708501 / 1 hour | 不可用 |

NVIDIA_H100_MEGA_80GB | US$11.8959171 / 1 hour | 不可用 |

NVIDIA_TESLA_L4 | US$0.644046276 / 1 hour | 不可用 |

NVIDIA_TESLA_P4 | US$0.69 / 1 hour | 不可用 |

NVIDIA_TESLA_P100 | US$1.679 / 1 hour | 不可用 |

NVIDIA_TESLA_T4 | US$0.4025 / 1 hour | 不可用 |

NVIDIA_TESLA_V100 | US$2.852 / 1 hour | 不可用 |

TPU_V2 单个(8 个核心) | US$5.175 / 1 hour | 不可用 |

TPU_V2 Pod(32 核)* | US$27.60 / 1 hour | 不可用 |

TPU_V3 单个(8 个核心) | US$9.20 / 1 hour | 不可用 |

TPU_V3 Pod(32 核)* | US$36.80 / 1 hour | 不可用 |

tpu7x-standard-4t(1 个芯片) | US$13.80 / 1 hour | 不可用 |

如果您使用非美元货币付费,请参阅 Cloud Platform SKU 上以您的币种列出的价格。

* 使用 Cloud TPU Pod 训练的价格基于 Pod 的核心数计算。Pod 的核心数始终都是 32 的倍数。要确定核心数超过 32 的 Pod 的训练价格,用 32 核 Pod 的价格乘以核心数再除以 32 即可。例如,对于 128 核的 Pod,价格是(32 核 Pod 的价格)* (128/32)。如需了解特定区域可用的 Cloud TPU Pod,请参阅 Cloud TPU 文档中的系统架构。

磁盘

磁盘

- Johannesburg (africa-south1)

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Delhi (asia-south2)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Melbourne (australia-southeast2)

- Warsaw (europe-central2)

- Finland (europe-north1)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- Turin (europe-west12)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Milan (europe-west8)

- Paris (europe-west9)

- Doha (me-central1)

- Dammam (me-central2)

- Montreal (northamerica-northeast1)

- Toronto (northamerica-northeast2)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

机器类型 | 价格 (USD) |

|---|---|

pd-standard | US$0.000063014 / 1 gibibyte hour |

pd-ssd | US$0.000267808 / 1 gibibyte hour |

如果您使用非美元货币付费,请参阅 Cloud Platform SKU 上以您的币种列出的价格。

- 所有使用均受 Vertex AI 配额政策的约束。

- 在 Vertex AI 生命周期中,您必须将数据和程序文件存储在 Google Cloud Storage 存储分区中。详细了解 Cloud Storage 的用法。

训练模型的计费从您为某项作业预配资源开始到该作业结束为止。

警告:训练作业受 Vertex AI 配额政策的约束。如果您为首批训练作业选择了非常强大的处理集群,可能会超出您的配额。

预定义配置的规模层级 (AI Platform Training)

您可以控制在训练模型时使用的处理集群类型。最简单的方法是选择称为“规模层级”的其中一种预定义配置。详细了解规模层级。

自定义配置的机器类型

如果您使用 Vertex AI 或选择 CUSTOM 作为 AI Platform Training 的规模层级,则可以控制用于集群主实例、工作器和参数服务器的虚拟机数量和类型。详细了解适用于 Vertex AI 的机器类型和适用于 AI Platform Training 的机器类型。

使用自定义处理集群进行训练的费用等于您指定的所有机器的费用总和。您需要按作业总时间支付费用,而不是按单个机器的实际处理时间付费。

Gen AI Evaluation Service

对于基于模型的指标,仅收取与底层自动评估器模型相关的预测费用。费用根据您在评估数据集中提供的输入词元和自动评分器输出计算。

Gen AI Evaluation Service 已正式发布 (GA)。价格变更已于 2025 年 4 月 14 日生效。

公制 | 价格 |

|---|---|

逐点 | 默认自动评分器模型 Gemini 2.0 Flash |

成对 | 默认自动评分器模型 Gemini 2.0 Flash |

基于计算的指标按每 1,000 个输入字符 $0.00003 和每 1,000 个输出字符 $0.00009 收费。它们在 SKU 中称为“自动指标”。

指标名称 | 类型 |

|---|---|

完全匹配 | 基于计算 |

Bleu | 基于计算 |

Rouge | 基于计算 |

工具调用有效 | 基于计算 |

工具名称匹配 | 基于计算 |

工具参数键匹配 | 基于计算 |

工具参数 KV 匹配 | 基于计算 |

所列价格以美元 (USD) 为单位。 如果您使用非美元货币付费,请参阅 Cloud Platform SKU 上以您的币种列出的价格。

基于旧模型的指标按输入每 1,000 个字符 $0.005 和输出每 1,000 个字符 $0.015 收费。

指标名称 | 类型 |

|---|---|

连贯性 | 逐点 |

流畅度 | 逐点 |

履行情况 | 逐点 |

安全 | 逐点 |

接地性 | 逐点 |

总结质量 | 逐点 |

摘要实用性 | 逐点 |

摘要详细程度 | 逐点 |

问答质量 | 逐点 |

问答相关性 | 逐点 |

问答实用性 | 逐点 |

问答正确性 | 逐点 |

成对摘要质量 | 成对 |

成对问答质量 | 成对 |

所列价格以美元 (USD) 为单位。 如果您使用非美元货币付费,请参阅 Cloud Platform SKU 上以您的币种列出的价格。

Vertex AI Agent Engine

Vertex AI Agent Engine 是一组服务,可让开发者在生产环境中扩缩智能体。您可以同时使用这些服务,也可以单独使用。您只需要按照实际用量付费。目前,您需要为 Agent Engine 运行时付费。

从 2026 年 1 月 28 日起,我们将开始对代码执行、会话和内存库收费。

运行时

价格取决于部署到 Agent Engine 运行时环境的代理所使用的计算资源(vCPU 小时)和内存资源(GiB 小时)。结算时间会舍入到最接近的秒数。客服人员的空闲时间不计费。

免费层级

为了帮助您开始使用运行时,我们每月提供免费层级。

- vCPU - 每月前 18 万 vCPU 秒(50 小时)免费

- RAM - 每月前 36 万 GiB 秒(100 小时)免费

基于用量的价格

一旦月用量超过免费层级,系统就会开始按以下费率结算费用。

资源 | 价格 (USD) |

|---|---|

vCPU | 0 hour to 50 hour US$0.00 (Free) / 3,600 second, per 1 month / project 50 hour and above US$0.0864 / 3,600 second, per 1 month / project |

RAM | 0 gibibyte hour to 100 gibibyte hour US$0.00 (Free) / 3,600 gibibyte second, per 1 month / project 100 gibibyte hour and above US$0.009 / 3,600 gibibyte second, per 1 month / project |

代码执行

与运行时类似,您需要为运行沙盒所需的计算和内存付费。结算时间会舍入到最接近的秒数。空闲时间不计费。

- 计算: $0.0864/vCPU 小时

- 内存: 每 GiB 小时$0.0090

会话

您需要根据会话服务中存储的事件数付费。我们对包含内容的存储的会话事件收费。这包括初始用户请求、模型回答、函数调用和函数回答。我们不会对存储在会话服务中的系统控制事件(例如检查点)收费。

- 每存储 1,000 个事件 $0.25

Memory Bank

根据存储和返回的记忆数量付费。

- 存储的记忆: 每存储 1,000 个记忆,每月 0.25 美元(+ LLM 生成记忆的费用,单独支付)

- 记忆检索:每返回 1,000 个记忆 $0.50;每月前 1,000 个返回的记忆免费

价格场景

价格场景

为了帮助您了解使用 Agent Engine 服务的费用,我们提供了两个假设的智能体:轻量级智能体和标准智能体。对于这两种情况,我们做出以下假设:

- 免费层级: 在这些计算中,我们假设运行时和内存库的免费层级已在之前的实验中用完。

- 每个会话的运行时请求数:一个“完整会话”或对话包含 10 个运行时请求。

- 会话:每个运行时请求平均生成 3 个会话事件。

- Memory Bank:

- 存储:在每个完整会话结束时,系统会提取并存储 1 条记忆。

- 检索:我们假设每个运行时请求平均返回 1 个记忆。

- 30% 的运行时请求会调用代码执行。

- 结算月份:所有月度计算均以 30 天为一个月。

补充说明:

- 服务模块化:虽然以下场景展示了同时使用 Agent Engine 服务的费用,但您可以选择单独使用各项服务。例如,您可以使用 Agent Engine 会话和记忆库服务,而无需使用 Agent Engine 运行时。

- 额外的模型费用:智能体需要 LLM 来进行推理和规划。智能体消耗的 LLM 词元单独计费,不包含在以下场景中。

- 额外的工具费用:智能体需要使用工具来执行操作。智能体使用的工具(例如 API 调用、存储)单独计费,不包含在以下场景中。

假设场景

假设场景

场景 1:轻量级内部智能体

此场景表示客服人员处理少量零星流量。

- 用例示例:小型公司的 IT 服务台机器人、起草电子邮件的个人效率助理,或根据文档提供答案的 Slack 机器人。

- 运行时和代码执行所需的计算资源和内存:1 个 vCPU / 1 GiB RAM。

- 流量:每秒 0.16 次查询(每分钟 10 次查询),每月总计 432,000 次请求。

- 平均请求时长: 3 秒

服务 | 计算 | 每月费用 |

|---|---|---|

运行时 | (432,000 次请求 × 3 秒/请求 ÷ 3600 秒/小时)= 360 小时 vCPU: (360 小时 × 1 个 vCPU × $0.0864/小时) = $31.10 RAM:(360 小时 × 1 GiB × $0.0090/小时)= $3.24 | $34.34 |

代码执行 | (360 运行时小时数 × 30% 使用率)= 108 小时 vCPU: (108 小时 × 1 个 vCPU × $0.0864/小时) = $9.33 RAM: (108 小时 × 1 GiB × $0.0090/小时) = $0.97 | $10.30 |

会话 | 432,000 个请求 x 3 个事件 ÷ 1,000 × $0.25 | $324 |

Memory Bank | 存储:(432,000 次请求 ÷ 10 次请求/会话 × 1 个内存/会话 ÷ 1,000)× $0.25 = $10.80 检索: (432,000 次请求 × 1 个返回的记忆 ÷ 1,000) × $0.50 = $216.00 | $226.80 |

预计每月总费用 | $595.44 |

场景 2:标准智能体

此场景代表集成到业务应用中的生产环境智能体,用于处理稳定的用户流量。

- 应用场景示例:电子商务网站上的客户服务智能体、B2B 网站上的潜在客户资格评估机器人,或销售团队的内部数据分析智能体。

- 计算:2 个 vCPU / 5 GiB RAM

- 流量:每秒 10 次查询(每分钟 600 次查询),每月总计 25,920,000 次请求。

- 平均请求时长: 5 秒

服务 | 计算 | 每月费用 |

|---|---|---|

运行时 | (25,920,000 个请求 × 5 秒/请求 ÷ 3600 秒/小时)= 36,000 小时 vCPU:(36,000 小时 × 2 个 vCPU × $0.0864/小时)= $6,220.80 RAM:(36,000 小时 × 5 GiB × $0.0090/小时)= $1,620.00 | $7,840.80 |

代码执行 | (36,000 运行时小时 × 30% 使用率)= 10,800 小时 vCPU: (10,800 小时 × 2 个 vCPU × $0.0864/小时)= $1,866.24 RAM:(10,800 小时 × 5 GiB × $0.0090/小时)= $486 | $2,352.24 |

会话 | 25,920,000 个请求 * 3 个事件 ÷ 1,000 × $0.25 | $19,440 |

Memory Bank | 存储:(25,920,000 次请求 ÷ 10 次请求/会话 × 1 个内存/会话 ÷ 1,000)× $0.25 = $648.00 检索: (25,920,000 次请求 × 1 个返回的记忆 ÷ 1,000) × $0.50 = $12,960.00 | $13,608 |

预计每月总费用 | $43,241.04 |

Ray on Vertex AI

培训

培训

下表提供了各种训练配置的大致每小时价格。您可以选择采用由所选机器类型组成的自定义配置。如需计算价格,请将您使用的虚拟机的费用相加。

如果您使用 Compute Engine 机器类型并挂接加速器,则加速器的费用需另外计算。如需计算此费用,请将下表中加速器的价格乘以您使用的每种加速器类型的机器小时数。

机器类型

机器类型

- Johannesburg (africa-south1)

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Melbourne (australia-southeast2)

- Warsaw (europe-central2)

- Finland (europe-north1)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- Turin (europe-west12)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Milan (europe-west8)

- Paris (europe-west9)

- Doha (me-central1)

- Dammam (me-central2)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Toronto (northamerica-northeast2)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

机器类型 | 价格 (USD) |

|---|---|

n1-standard-4 | US$0.2279988 / 1 hour |

n1-standard-8 | US$0.4559976 / 1 hour |

n1-standard-16 | US$0.9119952 / 1 hour |

n1-standard-32 | US$1.8239904 / 1 hour |

n1-standard-64 | US$3.6479808 / 1 hour |

n1-standard-96 | US$5.4719712 / 1 hour |

n1-highmem-2 | US$0.1419636 / 1 hour |

n1-highmem-4 | US$0.2839272 / 1 hour |

n1-highmem-8 | US$0.5678544 / 1 hour |

n1-highmem-16 | US$1.1357088 / 1 hour |

n1-highmem-32 | US$2.2714176 / 1 hour |

n1-highmem-64 | US$4.5428352 / 1 hour |

n1-highmem-96 | US$6.8142528 / 1 hour |

n1-highcpu-16 | US$0.68014656 / 1 hour |

n1-highcpu-32 | US$1.36029312 / 1 hour |

n1-highcpu-64 | US$2.72058624 / 1 hour |

n1-highcpu-96 | US$4.08087936 / 1 hour |

a2-highgpu-1g* | US$4.408062 / 1 hour |

a2-highgpu-2g* | US$8.816124 / 1 hour |

a2-highgpu-4g* | US$17.632248 / 1 hour |

a2-highgpu-8g* | US$35.264496 / 1 hour |

a2-highgpu-16g* | US$70.528992 / 1 hour |

a3-highgpu-8g* | US$105.39898088 / 1 hour |

a3-megagpu-8g* | US$110.65714224 / 1 hour |

a4-highgpu-8g* | US$148.212 / 1 hour |

e2-standard-4 | US$0.16082748 / 1 hour |

e2-standard-4 | US$0.32165496 / 1 hour |

e2-standard-16 | US$0.64330992 / 1 hour |

e2-standard-32 | US$1.28661984 / 1 hour |

e2-highmem-2 | US$0.10847966 / 1 hour |

e2-highmem-4 | US$0.21695932 / 1 hour |

e2-highmem-8 | US$0.43391864 / 1 hour |

e2-highmem-16 | US$0.86783728 / 1 hour |

e2-highcpu-16 | US$0.4749144 / 1 hour |

e2-highcpu-32 | US$0.9498288 / 1 hour |

n2-standard-4 | US$0.2330832 / 1 hour |

n2-standard-8 | US$0.4661664 / 1 hour |

n2-standard-16 | US$0.9323328 / 1 hour |

n2-standard-32 | US$1.8646656 / 1 hour |

n2-standard-48 | US$2.7969984 / 1 hour |

n2-standard-64 | US$3.7293312 / 1 hour |

n2-standard-80 | US$4.661664 / 1 hour |

n2-highmem-2 | US$0.1572168 / 1 hour |

n2-highmem-4 | US$0.3144336 / 1 hour |

n2-highmem-8 | US$0.6288672 / 1 hour |

n2-highmem-16 | US$1.2577344 / 1 hour |

n2-highmem-32 | US$2.5154688 / 1 hour |

n2-highmem-48 | US$3.7732032 / 1 hour |

n2-highmem-64 | US$5.0309376 / 1 hour |

n2-highmem-80 | US$6.288672 / 1 hour |

n2-highcpu-16 | US$0.6882816 / 1 hour |

n2-highcpu-32 | US$1.3765632 / 1 hour |

n2-highcpu-48 | US$2.0648448 / 1 hour |

n2-highcpu-64 | US$2.7531264 / 1 hour |

n2-highcpu-80 | US$3.441408 / 1 hour |

c2-standard-4 | US$0.2505696 / 1 hour |

c2-standard-8 | US$0.5011392 / 1 hour |

c2-standard-16 | US$1.0022784 / 1 hour |

c2-standard-30 | US$1.879272 / 1 hour |

c2-standard-60 | US$3.758544 / 1 hour |

m1-ultramem-40 | US$7.55172 / 1 hour |

m1-ultramem-80 | US$15.10344 / 1 hour |

m1-ultramem-160 | US$30.20688 / 1 hour |

m1-megamem-96 | US$12.782592 / 1 hour |

cloud-tpu | 价格取决于加速器类型。请参阅“加速器”。 |

如果您使用非美元货币付费,请参阅 Cloud Platform SKU 上以您的币种列出的价格。

加速器

加速器

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Finland (europe-north1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Montreal (northamerica-northeast1)

- Sao Paulo (southamerica-east1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

GPU 类型 | 价格 (USD) |

|---|---|

NVIDIA_TESLA_A100 | US$3.5206896 / 1 hour |

NVIDIA_TESLA_A100_80GB | US$4.517292 / 1 hour |

NVIDIA_H100_80GB | US$11.75586073 / 1 hour |

NVIDIA_TESLA_P4 | US$0.72 / 1 hour |

NVIDIA_TESLA_P100 | US$1.752 / 1 hour |

NVIDIA_TESLA_T4 | US$0.42 / 1 hour |

NVIDIA_TESLA_V100 | US$2.976 / 1 hour |

TPU_V2 单个(8 个核心) | US$5.40 / 1 hour |

TPU_V2 Pod(32 核)* | US$28.80 / 1 hour |

TPU_V3 单个(8 个核心) | US$9.60 / 1 hour |

TPU_V3 Pod(32 核)* | US$38.40 / 1 hour |

如果您使用非美元货币付费,请参阅 Cloud Platform SKU 上以您的币种列出的价格。

* 使用 Cloud TPU Pod 训练的价格基于 Pod 的核心数计算。Pod 的核心数始终都是 32 的倍数。要确定核心数超过 32 的 Pod 的训练价格,用 32 核 Pod 的价格乘以核心数再除以 32 即可。例如,对于 128 核的 Pod,价格是(32 核 Pod 的价格)* (128/32)。如需了解特定区域可用的 Cloud TPU Pod,请参阅 Cloud TPU 文档中的系统架构。

磁盘

磁盘

- Johannesburg (africa-south1)

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Melbourne (australia-southeast2)

- Warsaw (europe-central2)

- Finland (europe-north1)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- Turin (europe-west12)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Milan (europe-west8)

- Paris (europe-west9)

- Doha (me-central1)

- Dammam (me-central2)

- Montreal (northamerica-northeast1)

- Toronto (northamerica-northeast2)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

磁盘类型 | 价格 (USD) |

|---|---|

pd-standard | US$0.000065753 / 1 gibibyte hour |

pd-ssd | US$0.000279452 / 1 gibibyte hour |

如果您使用非美元货币付费,请参阅 Cloud Platform SKU 上以您的币种列出的价格。

- 所有使用均受 Vertex AI 配额政策的约束。

- 在 Vertex AI 生命周期中,您必须将数据和程序文件存储在 Google Cloud Storage 存储分区中。详细了解 Cloud Storage 的用法。

训练模型的计费从您为某项作业预配资源开始到该作业结束为止。

警告:训练作业受 Vertex AI 配额政策的约束。如果您为首批训练作业选择了非常强大的处理集群,可能会超出您的配额。

预测和解释

下表提供了批量预测、在线预测和在线解释的每“节点时”价格。“节点时”表示虚拟机运行预测作业花费的时间,或者处于活跃状态(部署了一个或多个模型的端点)等待处理预测或解释请求的时间。

您可以将 Spot 虚拟机与 Vertex AI Inference 结合使用。Spot 虚拟机的费用根据 Compute Engine Spot 虚拟机价格计算。除了基础设施使用费之外,还需支付 Vertex AI 推理管理费,详情见以下表格。

您可以将 Compute Engine 预留与 Vertex AI Inference 搭配使用。使用 Compute Engine 预留时,您需要按照 Compute Engine 价格付费,包括所有适用的承诺使用折扣 (CUD)。除了基础设施使用费之外,还需支付 Vertex AI 推理管理费,详情见以下表格。

E2 系列

E2 系列

- Johannesburg (africa-south1)

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Melbourne (australia-southeast2)

- Warsaw (europe-central2)

- Finland (europe-north1)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- Turin (europe-west12)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Milan (europe-west8)

- Paris (europe-west9)

- Doha (me-central1)

- Dammam (me-central2)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Toronto (northamerica-northeast2)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

机器类型 | 价格 (USD) |

|---|---|

e2-standard-2 | US$0.0770564 / 1 hour |

e2-standard-4 | US$0.1541128 / 1 hour |

e2-standard-8 | US$0.3082256 / 1 hour |

e2-standard-16 | US$0.6164512 / 1 hour |

e2-standard-32 | US$1.2329024 / 1 hour |

e2-highmem-2 | US$0.1039476 / 1 hour |

e2-highmem-4 | US$0.2078952 / 1 hour |

e2-highmem-8 | US$0.4157904 / 1 hour |

e2-highmem-16 | US$0.8315808 / 1 hour |

e2-highcpu-2 | US$0.056888 / 1 hour |

e2-highcpu-4 | US$0.113776 / 1 hour |

e2-highcpu-8 | US$0.227552 / 1 hour |

e2-highcpu-16 | US$0.455104 / 1 hour |

e2-highcpu-32 | US$0.910208 / 1 hour |

N1 系列

N1 系列

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Melbourne (australia-southeast2)

- Warsaw (europe-central2)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Milan (europe-west8)

- Paris (europe-west9)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Toronto (northamerica-northeast2)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

机器类型 | 价格 (USD) |

|---|---|

n1-standard-2 | US$0.1095 / 1 hour |

n1-standard-4 | US$0.219 / 1 hour |

n1-standard-8 | US$0.438 / 1 hour |

n1-standard-16 | US$0.876 / 1 hour |

n1-standard-32 | US$1.752 / 1 hour |

n1-highmem-2 | US$0.137 / 1 hour |

n1-highmem-4 | US$0.274 / 1 hour |

n1-highmem-8 | US$0.548 / 1 hour |

n1-highmem-16 | US$1.096 / 1 hour |

n1-highcpu-2 | US$0.081 / 1 hour |

n1-highcpu-4 | US$0.162 / 1 hour |

n1-highcpu-8 | US$0.324 / 1 hour |

n1-highcpu-16 | US$0.648 / 1 hour |

n1-highcpu-32 | US$1.296 / 1 hour |

N2 系列

N2 系列

- Johannesburg (africa-south1)

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Melbourne (australia-southeast2)

- Warsaw (europe-central2)

- Finland (europe-north1)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- Turin (europe-west12)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Milan (europe-west8)

- Paris (europe-west9)

- Doha (me-central1)

- Dammam (me-central2)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Toronto (northamerica-northeast2)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

机器类型 | 价格 (USD) |

|---|---|

n2-standard-2 | US$0.1116854 / 1 hour |

n2-standard-4 | US$0.2233708 / 1 hour |

n2-standard-8 | US$0.4467416 / 1 hour |

n2-standard-16 | US$0.8934832 / 1 hour |

n2-standard-32 | US$1.7869664 / 1 hour |

n2-highmem-2 | US$0.1506654 / 1 hour |

n2-highmem-4 | US$0.3013308 / 1 hour |

n2-highmem-8 | US$0.6026616 / 1 hour |

n2-highmem-16 | US$1.2053232 / 1 hour |

n2-highcpu-2 | US$0.0824504 / 1 hour |

n2-highcpu-4 | US$0.1649008 / 1 hour |

n2-highcpu-8 | US$0.3298016 / 1 hour |

n2-highcpu-16 | US$0.6596032 / 1 hour |

n2-highcpu-32 | US$1.3192064 / 1 hour |

N2D 系列

N2D 系列

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Melbourne (australia-southeast2)

- Warsaw (europe-central2)

- Finland (europe-north1)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Milan (europe-west8)

- Paris (europe-west9)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Sao Paulo (southamerica-east1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

机器类型 | 价格 (USD) |

|---|---|

n2d-standard-2 | US$0.0971658 / 1 hour |

n2d-standard-4 | US$0.1943316 / 1 hour |

n2d-standard-8 | US$0.3886632 / 1 hour |

n2d-standard-16 | US$0.7773264 / 1 hour |

n2d-standard-32 | US$1.5546528 / 1 hour |

n2d-highmem-2 | US$0.131077 / 1 hour |

n2d-highmem-4 | US$0.262154 / 1 hour |

n2d-highmem-8 | US$0.524308 / 1 hour |

n2d-highmem-16 | US$1.048616 / 1 hour |

n2d-highcpu-2 | US$0.0717324 / 1 hour |

n2d-highcpu-4 | US$0.1434648 / 1 hour |

n2d-highcpu-8 | US$0.2869296 / 1 hour |

n2d-highcpu-16 | US$0.5738592 / 1 hour |

n2d-highcpu-32 | US$1.1477184 / 1 hour |

C2 系列

C2 系列

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Sydney (australia-southeast1)

- Finland (europe-north1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Montreal (northamerica-northeast1)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

机器类型 | 价格 (USD) |

|---|---|

c2-standard-4 | US$0.240028 / 1 hour |

c2-standard-8 | US$0.480056 / 1 hour |

c2-standard-16 | US$0.960112 / 1 hour |

c2-standard-30 | US$1.80021 / 1 hour |

c2-standard-60 | US$3.60042 / 1 hour |

C2D 系列

C2D 系列

- Taiwan (asia-east1)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Oregon (us-west1)

- Las Vegas (us-west4)

机器类型 | 价格 (USD) |

|---|---|

c2d-standard-2 | US$0.1044172 / 1 hour |

c2d-standard-4 | US$0.2088344 / 1 hour |

c2d-standard-8 | US$0.4176688 / 1 hour |

c2d-standard-16 | US$0.8353376 / 1 hour |

c2d-standard-32 | US$1.6706752 / 1 hour |

c2d-standard-56 | US$2.9236816 / 1 hour |

c2d-standard-112 | US$5.8473632 / 1 hour |

c2d-highmem-2 | US$0.1408396 / 1 hour |

c2d-highmem-4 | US$0.2816792 / 1 hour |

c2d-highmem-8 | US$0.5633584 / 1 hour |

c2d-highmem-16 | US$1.1267168 / 1 hour |

c2d-highmem-32 | US$2.2534336 / 1 hour |

c2d-highmem-56 | US$3.9435088 / 1 hour |

c2d-highmem-112 | US$7.8870176 / 1 hour |

c2d-highcpu-2 | US$0.086206 / 1 hour |

c2d-highcpu-4 | US$0.172412 / 1 hour |

c2d-highcpu-8 | US$0.344824 / 1 hour |

c2d-highcpu-16 | US$0.689648 / 1 hour |

c2d-highcpu-32 | US$1.379296 / 1 hour |

c2d-highcpu-56 | US$2.413768 / 1 hour |

c2d-highcpu-112 | US$4.827536 / 1 hour |

C3 系列

C3 系列

- Singapore (asia-southeast1)

- Belgium (europe-west1)

- Netherlands (europe-west4)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

机器类型 | 价格 (USD) |

|---|---|

c3-highcpu-4 | US$0.19824 / 1 hour |

c3-highcpu-8 | US$0.39648 / 1 hour |

c3-highcpu-22 | US$1.09032 / 1 hour |

c3-highcpu-44 | US$2.18064 / 1 hour |

c3-highcpu-88 | US$4.36128 / 1 hour |

c3-highcpu-176 | US$8.72256 / 1 hour |

A2 系列

A2 系列

- Tokyo (asia-northeast1)

- Seoul (asia-northeast3)

- Singapore (asia-southeast1)

- Netherlands (europe-west4)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Oregon (us-west1)

- Salt Lake City (us-west3)

机器类型 | 价格 (USD) |

|---|---|

a2-highgpu-1g | US$4.2244949 / 1 hour |

a2-highgpu-2g | US$8.4489898 / 1 hour |

a2-highgpu-4g | US$16.8979796 / 1 hour |

a2-highgpu-8g | US$33.7959592 / 1 hour |

a2-megagpu-16g | US$64.1020592 / 1 hour |

a2-ultragpu-1g | US$5.7818474 / 1 hour |

a2-ultragpu-2g | US$11.5636948 / 1 hour |

a2-ultragpu-4g | US$23.1273896 / 1 hour |

a2-ultragpu-8g | US$46.2547792 / 1 hour |

当使用预留容量或 Spot 容量时,结算会涉及两个 SKU:带有“vertex-ai-online-prediction”标签的 GCE SKU 和 Vertex AI Management Fee SKU。这样一来,您就可以在 Vertex AI 中使用承诺使用折扣 (CUD)。

A3 系列

A3 系列

- Tokyo (asia-northeast1)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Delhi (asia-south2)

- Singapore (asia-southeast1)

- Sydney (australia-southeast1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Toronto (northamerica-northeast2)

- Iowa (us-central1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

- Oregon (us-west1)

- Las Vegas (us-west4)

机器类型 | 价格 (USD) |

|---|---|

a3-ultragpu-8g | US$96.015616 / 1 hour |

a3-megagpu-8g | US$106.65474 / 1 hour |

当使用预留容量或 Spot 容量时,结算会涉及两个 SKU:带有“vertex-ai-online-prediction”标签的 GCE SKU 和 Vertex AI Management Fee SKU。这样一来,您就可以在 Vertex AI 中使用承诺使用折扣 (CUD)。

A4 系列

A4 系列

- Singapore (asia-southeast1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Los Angeles (us-west2)

机器类型 | 价格 (USD) |

|---|---|

a4-highgpu-8g | US$148.212 / 1 hour |

当使用预留容量或 Spot 容量时,结算会涉及两个 SKU:带有“vertex-ai-online-prediction”标签的 GCE SKU 和 Vertex AI Management Fee SKU。这样一来,您就可以在 Vertex AI 中使用承诺使用折扣 (CUD)。

A4X 系列

A4X 系列

- Netherlands (europe-west4)

- Iowa (us-central1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

机器类型 | 价格 (USD) |

|---|---|

a4x-highgpu-4g | US$74.75 / 1 hour |

当使用预留容量或 Spot 容量时,结算会涉及两个 SKU:带有“vertex-ai-online-prediction”标签的 GCE SKU 和 Vertex AI Management Fee SKU。这样一来,您就可以在 Vertex AI 中使用承诺使用折扣 (CUD)。

a4x-highgpu-4g 至少需要 18 个虚拟机。

G2 系列

G2 系列

- Taiwan (asia-east1)

- Tokyo (asia-northeast1)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Dammam (me-central2)

- Toronto (northamerica-northeast2)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Oregon (us-west1)

- Las Vegas (us-west4)

机器类型 | 价格 (USD) |

|---|---|

g2-standard-4 | US$0.81293 / 1 hour |

g2-standard-8 | US$0.98181 / 1 hour |

g2-standard-12 | US$1.15069 / 1 hour |

g2-standard-16 | US$1.31957 / 1 hour |

g2-standard-24 | US$2.30138 / 1 hour |

g2-standard-32 | US$1.99509 / 1 hour |

g2-standard-48 | US$4.60276 / 1 hour |

g2-standard-96 | US$9.20552 / 1 hour |

当使用预留容量或 Spot 容量时,结算会涉及两个 SKU:带有“vertex-ai-online-prediction”标签的 GCE SKU 和 Vertex AI Management Fee SKU。这样一来,您就可以在 Vertex AI 中使用承诺使用折扣 (CUD)。

G4 系列

G4 系列

- Taiwan (asia-east1)

- Delhi (asia-south2)

- Singapore (asia-southeast1)

- Finland (europe-north1)

- Belgium (europe-west1)

- Netherlands (europe-west4)

- Milan (europe-west8)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Alabama (us-east7)

- Oregon (us-west1)

- Salt Lake City (us-west3)

机器类型 | 价格 (USD) |

|---|---|

g4-standard-48 | US$5.17508763 / 1 hour |

g4-standard-96 | US$10.35017526 / 1 hour |

g4-standard-192 | US$20.70035052 / 1 hour |

g4-standard-384 | US$41.40070104 / 1 hour |

TPU v5e 价格

TPU v5e 价格

- Singapore (asia-southeast1)

- Netherlands (europe-west4)

- Iowa (us-central1)

- South Carolina (us-east1)

- Oregon (us-west1)

- Las Vegas (us-west4)

机器类型 | 价格 (USD) |

|---|---|

ct5lp-hightpu-1t | US$1.38 / 1 hour |

ct5lp-hightpu-4t | US$5.52 / 1 hour |

ct5lp-hightpu-8t | US$5.52 / 1 hour |

TPU v6e 价格

TPU v6e 价格

- Tokyo (asia-northeast1)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- London (europe-west2)

- Netherlands (europe-west4)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

机器类型 | 价格 (USD) |

|---|---|

ct6e-standard-1t | US$3.105 / 1 hour |

ct6e-standard-4t | US$12.42 / 1 hour |

ct6e-standard-8t | US$24.84 / 1 hour |

E2 系列

E2 系列

- Johannesburg (africa-south1)

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Melbourne (australia-southeast2)

- Warsaw (europe-central2)

- Finland (europe-north1)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- Turin (europe-west12)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Milan (europe-west8)

- Paris (europe-west9)

- Doha (me-central1)

- Dammam (me-central2)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Toronto (northamerica-northeast2)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

项 | 价格 (USD) |

|---|---|

vCPU | US$0.0250826 / 1 hour |

RAM | US$0.0033614 / 1 gibibyte hour |

N1 系列

N1 系列

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Melbourne (australia-southeast2)

- Warsaw (europe-central2)

- Finland (europe-north1)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Milan (europe-west8)

- Paris (europe-west9)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Toronto (northamerica-northeast2)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

项 | 价格 (USD) |

|---|---|

vCPU | US$0.036 / 1 hour |

RAM | US$0.005 / 1 gibibyte hour |

N2 系列

N2 系列

- Johannesburg (africa-south1)

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Melbourne (australia-southeast2)

- Warsaw (europe-central2)

- Finland (europe-north1)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- Turin (europe-west12)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Milan (europe-west8)

- Paris (europe-west9)

- Doha (me-central1)

- Dammam (me-central2)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Toronto (northamerica-northeast2)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

项 | 价格 (USD) |

|---|---|

vCPU | US$0.0363527 / 1 hour |

RAM | US$0.0048725 / 1 gibibyte hour |

N2D 系列

N2D 系列

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Melbourne (australia-southeast2)

- Warsaw (europe-central2)

- Finland (europe-north1)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Milan (europe-west8)

- Paris (europe-west9)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Sao Paulo (southamerica-east1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

项 | 价格 (USD) |

|---|---|

vCPU | US$0.0316273 / 1 hour |

RAM | US$0.0042389 / 1 gibibyte hour |

C2 系列

C2 系列

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Sydney (australia-southeast1)

- Finland (europe-north1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Montreal (northamerica-northeast1)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

项 | 价格 (USD) |

|---|---|

vCPU | US$0.039077 / 1 hour |

RAM | US$0.0052325 / 1 gibibyte hour |

C2D 系列

C2D 系列

- Taiwan (asia-east1)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Oregon (us-west1)

- Las Vegas (us-west4)

项 | 价格 (USD) |

|---|---|

vCPU | US$0.0339974 / 1 hour |

RAM | US$0.0045528 / 1 gibibyte hour |

C3 系列

C3 系列

- Singapore (asia-southeast1)

- Belgium (europe-west1)

- Netherlands (europe-west4)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

项 | 价格 (USD) |

|---|---|

vCPU | US$0.03908 / 1 hour |

RAM | US$0.00524 / 1 gibibyte hour |

A2 系列

A2 系列

- Tokyo (asia-northeast1)

- Seoul (asia-northeast3)

- Singapore (asia-southeast1)

- Netherlands (europe-west4)

- Tel Aviv (me-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Oregon (us-west1)

- Salt Lake City (us-west3)

项 | 价格 (USD) |

|---|---|

vCPU | US$0.0363527 / 1 hour |

RAM | US$0.0048725 / 1 gibibyte hour |

GPU (A100 40 GB) | US$3.3741 / 1 hour |

GPU (A100 80 GB) | US$4.51729 / 1 hour |

A3 系列

A3 系列

- Tokyo (asia-northeast1)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Delhi (asia-south2)

- Singapore (asia-southeast1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Toronto (northamerica-northeast2)

- Iowa (us-central1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

- Oregon (us-west1)

- Las Vegas (us-west4)

项 | 价格 (USD) |

|---|---|

vCPU | US$0.0293227 / 1 hour |

RAM | US$0.0025534 / 1 gibibyte hour |

GPU (H100 80 GB) | US$11.2660332 / 1 hour |

GPU (H200) | US$10.708501 / 1 hour |

G2 系列

G2 系列

- Taiwan (asia-east1)

- Tokyo (asia-northeast1)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Dammam (me-central2)

- Toronto (northamerica-northeast2)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Oregon (us-west1)

- Las Vegas (us-west4)

项 | 价格 (USD) |

|---|---|

vCPU | US$0.02874 / 1 hour |

RAM | US$0.00337 / 1 gibibyte hour |

GPU (L4) | US$0.64405 / 1 hour |

某些机器类型允许添加可选的 GPU 加速器用于预测。除上表所列费用外,可选 GPU 会产生一笔额外的费用。可查看以下各价格表,了解各种可选 GPU 的价格。

加速器 - 每小时价格

加速器 - 每小时价格

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Warsaw (europe-central2)

- Finland (europe-north1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Sao Paulo (southamerica-east1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

GPU 类型 | 价格 (USD) |

|---|---|

NVIDIA_TESLA_P4 | US$0.69 / 1 hour |

NVIDIA_TESLA_P100 | US$1.679 / 1 hour |

NVIDIA_TESLA_T4 | US$0.402 / 1 hour |

NVIDIA_TESLA_V100 | US$2.852 / 1 hour |

价格按 GPU 计算。如果您的每个预测节点使用多个 GPU(或者您的版本在扩容后使用多个节点),那么费用会按比例增加。

AI Platform Prediction 通过运行多个虚拟机(“节点”)来使用模型进行预测。默认情况下,Vertex AI 会随时自动扩缩运行的节点数。对于在线预测,系统会根据需求量来扩缩节点数。每个节点可响应多个预测请求。对于批量预测,AI Platform Prediction 会适当扩缩节点数以减少运行作业所需的总时间。您可以自定义预测节点的扩缩方式。

您需要为模型所用的每个节点的运行时间支付费用,包括:

- 节点处理批量预测作业的时间。

- 节点处理在线预测请求的时间。

- 节点处于就绪状态,可用于在线预测的时间。

一个节点运行一小时即为一个“节点时”。预测价格表列出了节点时的价格。各个区域的价格各不相同,在线预测和批量预测的价格也有差异。

节点时可按小数计费。例如,一个节点运行 30 分钟计为 0.5 节点时。

Compute Engine (N1) 机器类型的费用计算

- 以 30 秒为增量计量节点的运行时间。这意味着每 30 秒,系统就会根据您的节点当时所使用的 vCPU、RAM 和 GPU 资源对您的项目收取 30 秒的相应费用。

详细了解预测节点的自动扩缩

在线预测 | 批量预测 |

|---|---|

扩缩的优先目标是缩短各个请求的延迟时间。处理完一个请求后,服务会让您的模型在几分钟的空闲时间里保持就绪状态。 | 容量扩缩的优先目标是减少作业的总时间。 |

扩缩会影响您每个月的总费用:请求数越多,请求越频繁,使用的节点就越多。 | 扩缩对作业价格的影响微乎其微,但启用新节点需要一定的开销。 |

您可以选择让服务根据流量多少来扩缩(自动扩缩),也可以指定不间断运行的节点数量以避免延迟(手动扩缩)。

| 您可为批量预测作业设置所用节点数量上限并在部署模型时设置要保持运行的节点数,以此影响扩缩方式。 |

批量预测作业在作业完成后计费

批量预测作业在作业完成后计费,而不是在作业期间递增费用。作业运行时不会触发您已配置的任何 Cloud Billing 预算提醒。在启动大型作业之前,请考虑先使用较小的输入数据集运行一些作业,确立费用基准。

预测计算示例

美洲区域一家房地产公司每周都会对他们营业地区的房屋价值进行预测。在一个月的四周内,他们分别运行了包含 3920、4277、3849 和 3961 项预测的四项作业。作业仅使用一个节点,每项预测平均需要 0.72 秒的处理时间。

首先计算每项作业运行的时长:

- 计算

每项作业都运行超过十分钟,因此按处理分钟数计费:

- 计算

当月的总费用为 $0.26。

此示例假定作业在单个节点上运行,并且每项预测花费的时间都一致。在实际使用中,请务必在计算时考虑使用的节点数量和每个节点的实际运行时间。

Vertex Explainable AI 费用

Vertex Explainable AI 费用

基于特征的解释

基于特征的解释不会在预测价格的基础上产生额外费用。但解释要比正常的预测花费更长的时间,因此大量使用 Vertex Explainable AI 以及自动扩缩可能导致启动更多节点,这将增加预测费用。

基于样本的解释

基于样本的解释的收费包含以下部分:

- 上传模型或更新模型数据集时,您需要:

- 按照用于生成样本潜在空间表示法的批量预测作业的节点时付费。收费标准与预测相同。

- 支付构建或更新索引的费用。这笔费用与 Vector Search 的索引费用相同,等于样本数 * 维度数 * 每浮点数 4 个字节 * $3.00/GB。比如,如果您有 100 万个样本和 1,000 个维度潜在空间,则费用为 $12 (1,000,000 * 1,000 * 4 * 3.00 / 1,000,000,000)。

- 部署到端点时,端点中的每个节点都按节点时计费。与端点相关的所有计算均按与预测相同的费率收费。但是,基于样本的解释需要使用额外的计算资源来为 Vector Search 索引提供服务,这会导致需要启动更多节点,从而增加预测费用。

Vertex AI Neural Architecture Search

下面的表格汇总了 Neural Architecture Search 在每个提供该服务的区域的价格。

价格

价格

下面的表格提供了各种配置的“每小时价格”。

您可以选择预定义的容量层级,也可以选择由所选机器类型组成的自定义配置。如果选择自定义配置,请将您使用的虚拟机的费用相加。

支持加速器的旧版机器类型的价格包含了加速器的费用。如果您使用 Compute Engine 机器类型并挂接加速器,则加速器的费用需另外计算。如需计算此费用,请将下表中加速器的价格乘以您使用的每种加速器类型的数量。

机器类型

机器类型

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Finland (europe-north1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Montreal (northamerica-northeast1)

- Sao Paulo (southamerica-east1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

机器类型 | 价格 (USD) |

|---|---|

n1-standard-4 | US$0.2849985 / 1 hour |

n1-standard-8 | US$0.569997 / 1 hour |

n1-standard-16 | US$1.139994 / 1 hour |

n1-standard-32 | US$2.279988 / 1 hour |

n1-standard-64 | US$4.559976 / 1 hour |

n1-standard-96 | US$6.839964 / 1 hour |

n1-highmem-2 | US$0.1774545 / 1 hour |

n1-highmem-4 | US$0.1774545 / 1 hour |

n1-highmem-8 | US$0.709818 / 1 hour |

n1-highmem-16 | US$1.419636 / 1 hour |

n1-highmem-32 | US$2.839272 / 1 hour |

n1-highmem-64 | US$5.678544 / 1 hour |

n1-highmem-96 | US$8.517816 / 1 hour |

n1-highcpu-16 | US$0.8501832 / 1 hour |

n1-highcpu-32 | US$1.7003664 / 1 hour |

n1-highcpu-64 | US$3.4007328 / 1 hour |

n1-highcpu-96 | US$5.1010992 / 1 hour |

a2-highgpu-1g | US$5.641070651 / 1 hour |

a2-highgpu-2g | US$11.282141301 / 1 hour |

a2-highgpu-4g | US$22.564282603 / 1 hour |

a2-highgpu-8g | US$45.128565205 / 1 hour |

a2-highgpu-16g | US$90.257130411 / 1 hour |

e2-standard-4 | US$0.20103426 / 1 hour |

e2-standard-8 | US$0.40206852 / 1 hour |

e2-standard-16 | US$0.80413704 / 1 hour |

e2-standard-32 | US$1.60827408 / 1 hour |

e2-highmem-2 | US$0.13559949 / 1 hour |

e2-highmem-4 | US$0.27119898 / 1 hour |

e2-highmem-8 | US$0.54239796 / 1 hour |

e2-highmem-16 | US$1.08479592 / 1 hour |

e2-highcpu-16 | US$0.59364288 / 1 hour |

e2-highcpu-32 | US$1.18728576 / 1 hour |

n2-standard-4 | US$0.291354 / 1 hour |

n2-standard-8 | US$0.582708 / 1 hour |

n2-standard-16 | US$1.165416 / 1 hour |

n2-standard-32 | US$2.330832 / 1 hour |

n2-standard-48 | US$3.496248 / 1 hour |

n2-standard-64 | US$4.661664 / 1 hour |

n2-standard-80 | US$5.82708 / 1 hour |

n2-highmem-2 | US$0.196521 / 1 hour |

n2-highmem-4 | US$0.393042 / 1 hour |

n2-highmem-8 | US$0.786084 / 1 hour |

n2-highmem-16 | US$1.572168 / 1 hour |

n2-highmem-32 | US$3.144336 / 1 hour |

n2-highmem-48 | US$4.716504 / 1 hour |

n2-highmem-64 | US$6.288672 / 1 hour |

n2-highmem-80 | US$7.86084 / 1 hour |

n2-highcpu-16 | US$0.860352 / 1 hour |

n2-highcpu-32 | US$1.720704 / 1 hour |

n2-highcpu-64 | US$3.441408 / 1 hour |

n2-highcpu-80 | US$4.30176 / 1 hour |

c2-standard-4 | US$0.313212 / 1 hour |

c2-standard-8 | US$0.626424 / 1 hour |

c2-standard-16 | US$1.252848 / 1 hour |

c2-standard-30 | US$2.34909 / 1 hour |

c2-standard-60 | US$4.69818 / 1 hour |

如果您使用非美元货币付费,请参阅 Cloud Platform SKU 上以您的币种列出的价格。

a2-highgpu 实例的价格包含挂接 NVIDIA_TESLA_A100 加速器的价格。

加速器

加速器

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Finland (europe-north1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Montreal (northamerica-northeast1)

- Sao Paulo (southamerica-east1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

GPU 类型 | 价格 (USD) |

|---|---|

NVIDIA_TESLA_A100 | US$4.400862 / 1 hour |

NVIDIA_TESLA_P4 | US$0.90 / 1 hour |

NVIDIA_TESLA_P100 | US$2.19 / 1 hour |

NVIDIA_TESLA_T4 | US$0.525 / 1 hour |

NVIDIA_TESLA_V100 | US$3.72 / 1 hour |

如果您使用非美元货币付费,请参阅 Cloud Platform SKU 上以您的币种列出的价格。

磁盘

磁盘

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Finland (europe-north1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Montreal (northamerica-northeast1)

- Sao Paulo (southamerica-east1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

磁盘类型 | 价格 (USD) |

|---|---|

pd-standard | US$0.000082192 / 1 gibibyte hour |

pd-ssd | US$0.000349315 / 1 gibibyte hour |

如果您使用非美元货币付费,请参阅 Cloud Platform SKU 上以您的币种列出的价格。

注意:

- 所有使用均受 Neural Architecture Search 配额政策的约束。

- 在 Neural Architecture Search 生命周期中,您必须将数据和程序文件存储在 Cloud Storage 存储分区中。详细了解 Cloud Storage 的用法。

- 如需了解批量折扣,请与销售团队联系。

- 只有在您将每个虚拟机的磁盘大小配置为 100 GB 以上时,您才需要按照磁盘价格付费。每个虚拟机的前 100 GB(默认磁盘大小)磁盘空间都不会产生费用。例如,如果您将每个虚拟机配置为使用 105 GB 的磁盘,则需要为每个虚拟机支付 5 GB 的磁盘费用。

必须使用 Cloud Storage

必须使用 Cloud Storage

除了本文档中列出的费用以外,在 Neural Architecture Search 生命周期中,您必须将数据和程序文件存储在 Cloud Storage 存储分区中。此类存储需遵循 Cloud Storage 价格政策。

以下各项必须使用 Cloud Storage:

- 暂存训练应用软件包。

- 存储训练输入数据。

注意:您可以使用 BigQuery 等其他 Google Cloud 服务来存储输入数据,并按相应的价格付费。

- 存储作业的输出结果。Neural Architecture Search 不需要长期存储这些内容。操作完成后,您可以立即移除相关文件。

用于管理资源的免费操作

用于管理资源的免费操作

Neural Architecture Search 提供的资源管理操作是免费的。Neural Architecture Search 配额政策对其中一些操作设有限制。

资源 | 免费操作 |

|---|---|

作业 | get、list、cancel |

操作 | get、list、cancel、delete |

Vertex AI Pipelines

Vertex AI Pipelines 的每次流水线运行费用为 $0.03。在预览版期间,您无需支付执行费用。您还需要为与 Vertex AI Pipelines 一起使用的 Google Cloud 资源付费,例如流水线组件消耗的 Compute Engine 资源(按与 Vertex AI 训练相同的费率计费)。最后,您要负责流水线调用的任何服务(例如 Dataflow)的费用。

Vertex AI Feature Store

Vertex AI Feature Store 正式版 (GA) 自 2023 年 11 月推出。如需了解该产品的过往版本,请前往 Vertex AI Feature Store(旧版)。

全新 Vertex AI Feature Store

全新 Vertex AI Feature Store

全新的 Vertex AI Feature Store 支持两类操作功能:

- 离线操作是指在离线存储区 (BigQuery) 中进行数据传输、存储、检索和转换等操作。

- 在线操作是指将数据传输到在线存储区,以及于在线存储区中对数据进行的操作。

离线操作费用

由于离线操作使用 BigQuery,请参阅 BigQuery 费用,了解有关注入离线存储区、查询离线存储区和离线存储等功能。

在线操作费用

就在线操作而言,Vertex AI Feature Store 会对将数据传输至在线存储区、传送数据或存储数据的所有正式版功能收费。节点时表示虚拟机完成一项操作花费的时间,按分钟计费。

- Johannesburg (africa-south1)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Warsaw (europe-central2)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- Turin (europe-west12)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Milan (europe-west8)

- Doha (me-central1)

- Dammam (me-central2)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

操作 | 价格 (USD) |

|---|---|

数据处理节点 数据处理(例如,将数据注入到任何在线 存储、监控等) | US$0.08 / 1 hour |

经过优化的在线传送节点 低延迟服务和嵌入服务 每个节点包含 200GB 存储空间 | US$0.30 / 1 hour |

Bigtable 在线传送节点 使用 Cloud Bigtable 提供服务 | US$0.94 / 1 hour |

Bigtable 在线传送存储 使用 Cloud Bigtable 提供服务的存储空间 | US$0.000342466 / 1 gibibyte hour |

经过优化的在线传送与 Bigtable 在线传送使用的架构并不相同,因此两者的节点不具有可比性。

如果您使用非美元货币付费,请参阅 Cloud Platform SKU 上以您的币种列出的价格。

在线操作工作负载估算

在估算工作负载时请考虑以下准则。对于特定工作负载,不同的传送方式需要的节点数可能不同。

- 数据处理:

- 注入 - 如果不使用分析功能,一个节点每小时至少可将约 100 MiB 的数据注入到 Bigtable 在线存储区或优化后的在线存储区中。

- Bigtable 在线传送:每个节点可支持约 15,000 QPS 和多达 5 TB 的存储空间。

- 优化在线服务:性能取决于机器类型和副本,这些机器类型和副本会自动配置,以在满足工作负载的前提下最大限度地降低成本。每个节点可以有最少 2 个、最多 6 个副本,以实现高可用性和自动扩缩。您需要根据副本数量支付费用。如需了解详情,请参阅示例月度场景。

- 对于非嵌入相关的工作负载,每个节点可支持约 500 QPS 和多达 200 GB 的存储空间。

- 对于嵌入相关的工作负载,每个节点可以支持大约 500 QPS 和最多 4 GB 的 512 维数据存储空间。

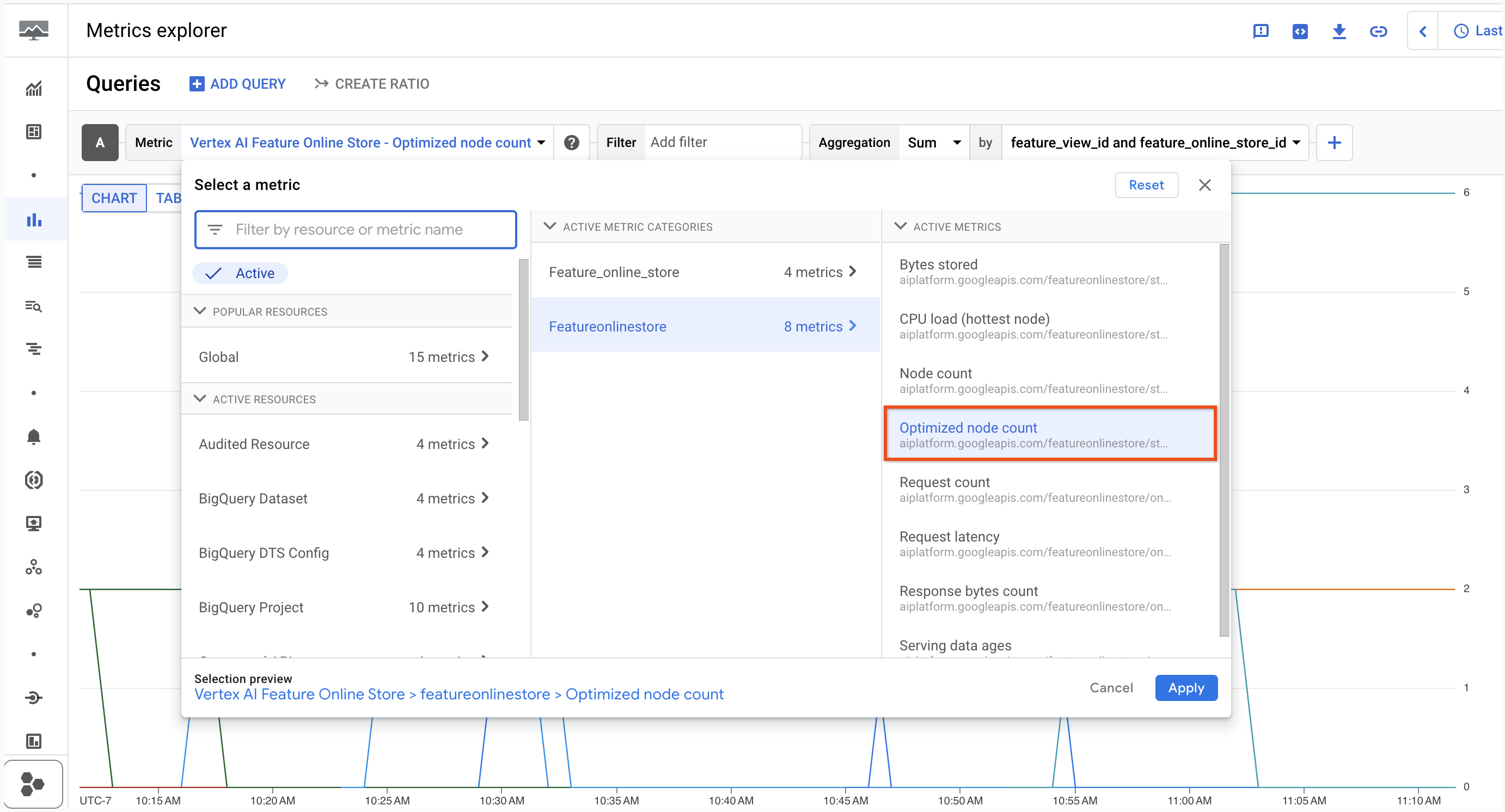

您可以在 Metric Explorer 中查看节点(含副本)的数量:

月度场景示例(假设使用 us-central1)

数据流工作负载 - Bigtable 在线传送 2.5 TB 数据(每日更新 1 GB)和 1200 QPS

操作 | 每月用量 | 每月费用 |

|---|---|---|

数据处理节点 | (1 GB/天) * (30 天/月) * (1,000 MB/GB) * (1 节点时 / 100 MB) = 300 节点时 | 300 节点时 * ($0.08/节点时) = $24 |

经过优化的在线传送节点 | 不可用 | 不可用 |

Bigtable 在线传送节点 | (1 个节点) * (24 小时/天) * (30 天/月) = 720 节点时 | 720 节点时 * ($0.94/节点时) = $677 |

Bigtable 在线传送存储 | (2.5 TB-月) * (1000 GB/TB) = 2500 GB-月 | 2500 GB-月 * ($0.25/ GB-月) = $625 |

总计 | $1,326 |

高 QPS 工作负载 - 优化后的在线传送,包含 10GB 非嵌入数据(每日更新 5GB)和 2000QPS

操作 | 每月用量 | 每月费用 |

|---|---|---|

数据处理节点 | (5 GB/天) * (30 天/月) * (1,000 MB/GB) * (1 节点时 / 100MB) = 1500 节点时 | 1500 节点时 * ($0.08/节点时) = $120 |

经过优化的在线传送节点 | Roundup(10GB * (1 个节点 / 200 GB)) = 1 * max(2 个默认副本, 2000 QPS * (1 个副本 / 500 QPS)) = 4 个总节点 * (24 小时/天) * (30 天/月) =2880 节点时 | 2880 节点时 * (0.30/节点时) = $864 |

Bigtable 在线传送节点 | 不可用 | 不可用 |

Bigtable 在线传送存储 | 不可用 | 不可用 |

总计 | $984 |

嵌入传送工作负载 - 优化后的在线传送,包含 20GB 的嵌入数据(每日更新 2GB)和 800QPS

操作 | 每月用量 | 每月费用 |

|---|---|---|

数据处理节点 | (2 GB/天) * (30 天/月) * (1,000 MB/GB) * (1 节点时 / 100MB) = 600 节点时 | 600 节点时 * ($0.08/节点时) = $48 |

经过优化的在线传送节点 | Roundup(20GB* (1 个节点 / 4GB) = 5 * max(2 个默认副本, 800 QPS * (1 个副本 / 500 QPS)) = 10 个总节点 * (24 小时/天) * (30 天/月) = 7200 节点时 | 7200 节点时 * (0.30/节点时) = $2160 |

Bigtable 在线传送节点 | 不可用 | 不可用 |

Bigtable 在线传送存储 | 不可用 | 不可用 |

总计 | $2,208 |

Vertex AI Feature Store(旧版)

Vertex AI Feature Store(旧版)

Vertex AI Feature Store(旧版)的价格取决于在线和离线存储中的特征数据量以及在线传送的可用性。“每节点时”表示虚拟机花费在传送特征数据上或处于就绪状态以等待处理特征数据请求的时间。

操作 | 价格 (USD) |

|---|---|

在线存储天数 | 每月每 GB $0.25 |

离线存储天数 | 每月每 GB $0.023 |

在线传送 | 每个节点每小时 $0.94 |

批量导出 | 每 GB $0.005 |

流式注入 | 每 GB 注入费用 $0.10 |

如果您使用非美元货币付费,请参阅 Cloud Platform SKU 上以您的币种列出的价格。

启用特征值监控功能后,计费范围不仅包含上述适用费用,还包含以下适用费用:

- 分析的所有数据按每 GB $3.50 计费。启用快照分析功能后,Vertex AI Feature Store(旧版)中的数据快照将包含在内。启用导入特征分析后,注入的批量数据将包含在内。

- 与特征值监控功能配合使用的其他 Vertex AI Feature Store(旧版)操作包含以下额外费用:

- 快照分析功能会根据您配置的监控间隔时间,定期对特征值创建快照。

- 快照导出的费用与常规批量导出操作的费用相同。

快照分析示例

一位数据科学家在 Vertex AI Feature Store(旧版)中启用了特征值监控功能,并开启了每日快照分析监控。系统每天为监控的实体类型运行一条流水线。该流水线扫描了 Vertex AI Feature Store(旧版)中的 2GB 数据,并导出含 0.1GB 数据的快照。一天的分析总费用为:

(0.1 GB * $3.50) + (2 GB * $0.005) = $0.36

注入分析示例

一位数据科学家在 Vertex AI Feature Store(旧版)中启用了特征值监控功能,并开启了注入操作监控。注入操作将 1GB 数据导入到 Vertex AI Feature Store(旧版)。特征值监控的总费用为:

(1 GB * $3.50) = $3.50

Vertex ML Metadata

元数据存储量是以二进制千兆字节 (GiB) 为单位计量的,其中 1 GiB 为 1,073,741,824 个字节。这种计量单位也称为吉比字节。

Vertex ML Metadata 按照每月每吉比字节 (GiB) $10 收取元数据存储的费用。按每兆字节 (MB) 的比例计费。例如,如果您存储了 10 MB 的元数据,则每月需为这 10 MB 元数据支付 $0.10。

注意:在所有支持 Vertex ML Metadata 的区域,价格都相同。

Vertex AI TensorBoard

如需使用 Vertex AI TensorBoard,请向项目的 IAM 管理员申请为您分配“Vertex AI TensorBoard Web App User”角色。Vertex AI Administrator 角色也有访问权限。

从 2023 年 8 月开始,Vertex AI TensorBoard 的收费发生了变化,从每月向每位用户收取 $300 的许可费变更为按每月每 GiB $10 收取日志和指标的数据存储费用。这意味着不会再产生任何订阅费用。您只需为已使用的存储空间付费。如需了解如何管理存储空间,请参阅 Vertex AI TensorBoard:删除过时的 TensorBoard 实验 教程。

Vertex AI Vizier

Vertex AI Vizier 是 Vertex AI 内的一项黑盒优化服务。Vertex AI Vizier 价格模型由以下几个部分组成:

- 使用 RANDOM_SEARCH 和 GRID_SEARCH 进行的尝试不收取任何费用。详细了解搜索算法。

- 每个日历月的前 100 次 Vertex AI Vizier 试验免费(使用 RANDOM_SEARCH 和 GRID_SEARCH 进行的试验不计入此总数)。

- 100 次 Vertex AI Vizier 试验后,同一日历月内的后续试验按每次试验 $1 收费(使用 RANDOM_SEARCH 或 GRID_SEARCH 的试验不会产生费用)。

向量搜索

Vector Search Approximate Nearest Neighbor 服务的价格包含:

- 用于托管已部署索引的每个虚拟机的每节点时价格。

- 构建新索引、更新现有索引和使用流式索引更新的费用。

在构建和更新索引期间处理的数据是以二进制千兆字节 (GiB) 为单位计量的,其中 1 GiB 为 1,073,741,824 个字节。这种计量单位也称为吉比字节。

Vector Search 对所有区域中处理的每吉比字节 (GiB) 数据收取 $3.00。Vector Search 对流式更新插入收取 $0.45/GiB 的注入费用。

下面的表格汇总了 Vector Search 在每个提供该服务的区域的索引服务价格。价格按照机器类型、区域和每节点时的费用计算。

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Melbourne (australia-southeast2)

- Warsaw (europe-central2)

- Finland (europe-north1)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Milan (europe-west8)

- Paris (europe-west9)

- Doha (me-central1)

- Dammam (me-central2)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Toronto (northamerica-northeast2)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Dallas (us-south1)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

机器类型 | 价格 (USD) |

|---|---|

e2-standard-2 | US$0.0938084 / 1 hour |

e2-standard-16 | US$0.7504672 / 1 hour |

e2-highmem-16 | US$1.012368 / 1 hour |

n2d-standard-32 | US$1.8926208 / 1 hour |

n1-standard-16 | US$1.0639944 / 1 hour |

n1-standard-32 | US$2.1279888 / 1 hour |

Vector Search 价格示例

Vector Search 价格示例

Vector Search 的价格取决于数据大小、您想要运行的每秒查询次数 (QPS) 和使用的节点数。要预估服务成本,需要计算数据的总大小。数据大小为嵌入/矢量数量* 维度数量* 每维度 4 字节。确定数据大小后,即可计算传送费用和构建费用。传送费用加构建费用等于每月总费用。

- 传送费用:副本数量/分片 * 分片数量(~数据大小/分片大小)* 每小时费用 * 730 小时

- 构建费用:数据大小(GiB) * $3/GiB * 更新次数/月

流式更新:Vector Search 使用基于启发法的指标来确定何时触发压缩。如果最早的未压缩数据存在时间超过 5 天,则始终会触发压缩。除了流式更新费用外,您还需要按与批量更新相同的费率支付重建索引的费用。

嵌入/矢量数量 | 维度数量 | 每秒查询数 (QPS) | 机器类型 | 节点 | 估算的每月传送费用(美元) |

|---|---|---|---|---|---|

200 万 | 128 | 100 | e2-standard-2 | 1 | $68 |

2000 万 | 256 | 1000 | e2-standard-16 | 1 | $547 |

2000 万 | 256 | 3000 | e2-standard-16 | 3 | $1,642 |

1 亿 | 256 | 500 | e2-highmem-16 | 2 | $1,477 |

10 亿 | 100 | 500 | e2-highmem-16 | 8 | $5,910 |

所有示例均基于 us-central1 中的机器类型。产生的费用因召回率和延迟要求而异。预计的每月传送成本与控制台中使用的节点数直接相关。如需详细了解影响费用的配置参数,请参阅影响召回和延迟的配置参数。

如果每秒查询次数 (QPS) 较高,则对这些查询进行批处理可将总费用降低 30%-40%。

存储优化型 Vector Search 层

存储优化型 Vector Search 层

您无需管理和支付单个虚拟机和单独的压缩作业,而是可以选择以下两种 SKU:

- 容量单位 (CU):这是服务的主要计量单位。CU 是计算和活跃 SSD 存储的捆绑单位,每个单位最多 1 TiB,价格为每个副本每小时每个 CU 2.30 美元。这一费率涵盖了服务费用和持续的索引管理费用。随着索引大小的增加,服务会自动扩缩并添加额外的 CU。

- 写入单位:添加数据时,每 GiB 收费 $0.45。此费用适用于批量索引更新和流式索引更新。

单位 | 价格 |

|---|---|

存储优化型容量单位 | US$2.30 / 1 hour |

写入单位 | US$0.45 / 1 gibibyte |

Vertex AI Model Registry

Vertex AI Model Registry 是一个中央存储库,可以跟踪和列示您的模型版本。将模型导入 Vertex AI 后,这些模型就会出现在 Vertex AI Model Registry 中。将您的模型导入 Model Registry 不会产生任何费用。只有将模型部署至端点或使用模型进行批量预测时,才会产生费用。该费用取决于部署的模型类型。

如需详细了解从 Vertex AI Model Registry 部署自定义模型的价格,请参阅自定义训练模型。如需详细了解部署 AutoML 模型的价格,请参阅 AutoML 模型的价格。

Vertex AI Model Monitoring

Vertex AI 使您能够在将模型部署到生产环境后监控模型的持续有效性。如需了解详情,请参阅 Vertex AI Model Monitoring 简介。

使用 Vertex AI Model Monitoring 时,您需要支付以下费用:

- 分析的所有数据(包括提供的训练数据和记录在 BigQuery 表中的预测数据)每 GB $3.50。

- 与 Model Monitoring 一起使用的其他 Google Cloud 产品的费用,例如启用归因监控时的 BigQuery 存储或 Batch Explain。

Vertex AI Model Monitoring 支持以下区域:us-central1、europe-west4、asia-east1 和 asia-southeast1。所有区域的价格都相同。

数据大小在转换为 TfRecord 格式后进行测量。

设置 Vertex AI Model Monitoring 作业时,训练数据集会产生一次性费用。

预测数据集由从在线预测服务收集的日志组成。当预测请求在不同的时间窗口到达时,每个时间窗口的数据会被收集,为每个预测窗口分析的数据的总和会用于计算费用。

示例:数据科学家对其模型的预测流量进行模型监控。

- 该模型是根据 BigQuery 数据集训练的。转换为 TfRecord 后的数据大小为 1.5GB。

- 下午 1:00 - 2:00 之间记录的预测数据为 0.1 GB,下午 3:00 - 4:00 之间记录的预测数据为 0.2 GB。

- 设置模型监控作业的总费用为:

- (1.5 GB * $3.50) + ((0.1 GB + 0.2 GB) * $3.50) = $6.30

Vertex AI Workbench

请选择实例、托管式笔记本或用户管理的笔记本以了解价格信息。

实例

实例

下表提供了各种虚拟机配置的大致每小时价格。您可以选择采用由所选机器类型组成的自定义配置。如需计算价格,请将您使用的虚拟机的费用相加。

如果您使用 Compute Engine 机器类型并挂接加速器,则加速器的费用需另外计算。如需计算此费用,请将下表中加速器的价格乘以您使用的每种加速器类型的机器小时数。

CPU

CPU

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Warsaw (europe-central2)

- Belgium (europe-west1)

- Turin (europe-west12)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Doha (me-central1)

- Dammam (me-central2)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Toronto (northamerica-northeast2)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

机器类型 | 每个 vCPU 的价格(美元) |

|---|---|

N1 | US$0.0379332 / 1 hour |

N2 | US$0.0379332 / 1 hour |

E2 | US$0.026173908 / 1 hour |

A2 | US$0.0379332 / 1 hour |

内存

内存

- Johannesburg (africa-south1)

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Warsaw (europe-central2)

- Finland (europe-north1)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- Turin (europe-west12)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Milan (europe-west8)

- Doha (me-central1)

- Dammam (me-central2)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Sao Paulo (southamerica-east1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Las Vegas (us-west4)

机器类型 | 价格 (USD) |

|---|---|

N1 | US$0.0050844 / 1 gibibyte hour |

N2 | US$0.0050844 / 1 gibibyte hour |

E2 | US$0.003508236 / 1 gibibyte hour |

A2 | US$0.0050844 / 1 gibibyte hour |

加速器

加速器

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Finland (europe-north1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Sao Paulo (southamerica-east1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

机器类型 | 价格 (USD) |

|---|---|

Nvidia Tesla A100 | US$4.400862 / 1 hour |

Nvidia Tesla A100 80GB | US$4.51729 / 1 hour |

Nvidia Tesla T4 | US$0.525 / 1 hour |

Nvidia Tesla V100 | US$3.72 / 1 hour |

Nvidia Tesla P100 | US$2.19 / 1 hour |

磁盘

磁盘

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Warsaw (europe-central2)

- Belgium (europe-west1)

- Turin (europe-west12)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Doha (me-central1)

- Dammam (me-central2)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Toronto (northamerica-northeast2)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

机器类型 | 价格 (USD) |

|---|---|

Hyperdisk Extreme 预配空间 | US$0.000205479 / 1 gibibyte hour |

平衡预配空间 | US$0.000164384 / 1 gibibyte hour |

极端预配空间 | US$0.000205479 / 1 gibibyte hour |

SSD 预配空间 | US$0.000279452 / 1 gibibyte hour |

标准预配空间 | US$0.000065753 / 1 gibibyte hour |

您的 Vertex AI Workbench 实例会产生以下费用:

- 对于 CPU 和加速器用量,当实例处于以下状态时,您需要支付费用:

- 正在开始

- 正在预配

- ACTIVE

- 正在升级

- 回滚

- 恢复

- 正在停止

- 暂停

- 对于磁盘存储,当实例处于以下状态时,您需要支付费用:

- 正在开始

- 正在预配

- ACTIVE

- 正在升级

- 回滚

- 恢复

- 正在停止

- 已停止

- 暂停

- 已暂停

代管式笔记本

代管式笔记本

价格由以下费用组成:您使用的计算和存储资源、Vertex AI Workbench 实例的管理费,以及您使用的所有其他云资源。如需了解详情,请参阅以下部分。

计算和存储资源

计算和存储资源

计算和存储资源的费用与您当前支付的 Compute Engine 和 Cloud Storage 费率相同。

管理费

管理费

除了基础设施使用费之外,还需支付 Vertex AI Workbench 管理费,详情见以下表格。

SKU | 价格 (USD) |

|---|---|

vCPU | 每个 vCPU $0.05 |

T4 和 P4(标准 GPU) | 每个 GPU $0.35 |

P100、V100、L4 和 A100 GPU(高级 GPU) | 每个 GPU $2.48 |

用户管理的笔记本

用户管理的笔记本

价格由以下费用组成:您使用的计算和存储资源、Vertex AI Workbench 实例的管理费,以及您使用的所有其他云资源。如需了解详情,请参阅以下部分。

计算和存储资源

计算和存储资源

计算和存储资源的费用与您当前支付的 Compute Engine 和 Cloud Storage 费率相同。

管理费

管理费

除了基础设施使用费之外,还需支付 Vertex AI Workbench 管理费,详情见以下表格。

SKU | 价格 (USD) |

|---|---|

vCPU | 每个 vCPU $0.005 |

T4 和 P4(标准 GPU) | 每个 GPU $0.035 |

P100、V100 和 A100 GPU(高级 GPU) | 每个 GPU $0.25 |

其他 Google Cloud 资源

其他 Google Cloud 资源

除了此前提及的费用,您使用的所有 Google Cloud 资源也需付费。例如:

- 数据分析服务:当您在笔记本中发出 SQL 查询时,即会产生 BigQuery 费用(请参阅 BigQuery 价格)。

- 客户管理的加密密钥:使用客户管理的加密密钥会产生费用。每当您的托管式笔记本或用户管理的笔记本实例使用 Cloud Key Management Service 密钥时,该操作均按 Cloud KMS 密钥操作的费率计费(请参阅 Cloud Key Management Service 价格)。

Colab Enterprise

如需了解 Colab Enterprise 价格信息,请参阅 Colab Enterprise 价格。

Deep Learning Containers、Deep Learning VM 和 AI Platform Pipelines

对于 Deep Learning Containers、Deep Learning VM Image 和 AI Platform Pipelines,根据您使用的计算和存储资源来计算价格。这些资源的费用与您当前支付的 Compute Engine 和 Cloud Storage 费率相同。

除了计算和存储费用之外,您使用的所有 Google Cloud 资源也需付费。例如:

- 数据分析服务:当您在笔记本中发出 SQL 查询时,即会产生 BigQuery 费用(请参阅 BigQuery 价格)。

- 客户管理的加密密钥:使用客户管理的加密密钥会产生费用。每当您的托管式笔记本或用户管理的笔记本实例使用 Cloud Key Management Service 密钥时,该操作均按 Cloud KMS 密钥操作的费率计费(请参阅 Cloud Key Management Service 价格)。

为数据加标签

使用 Vertex AI 时,您可以申请以人工方式为计划用于训练自定义机器学习模型的数据集加标签。该服务的价格根据标签任务的类型计算。

- 对于常规标签任务,价格取决于注释单元数。

- 对于图像分类任务,单元数取决于图像数量和人工标签添加者的数量。例如,有 3 个人工标签添加者的一个图像计为 1 * 3 = 3 个单元。单标签分类和多标签分类的价格相同。

- 对于图像边界框任务,单元数取决于图像中所标识的边界框数量和人工标签添加者的数量。例如,如果一个图像有 2 个边界框和 3 个人工标签添加者,则该图像计为 2 * 3 = 6 个单元。没有边界框的图片不会产生费用。

- 对于图像分割/旋转框/多段线/多边形任务,单元数的确定方式与图像边界框任务中的单元数确定方式相同。

- 对于视频分类任务,单元数取决于视频时长(每 5 秒计为一个价格单元)以及人工标签添加者的数量。例如,有 3 个人工标签添加者的一个 25 秒的视频计为 25 / 5 * 3 = 15 个单元。单标签分类和多标签分类的价格相同。

- 对于视频对象跟踪任务,单元数取决于视频中标识的对象数量和人工标签添加者的数量。例如,一个视频有 2 个对象和 3 个人工标签添加者,则此视频将计为 2 * 3 = 6 个单元。没有对象的视频不会产生费用。

- 对于视频动作识别任务,单元数的确定方式与视频对象跟踪任务相同。

- 对于文本分类任务,单元数取决于文本长度(每 50 个字词计为一个价格单元)和人工标签添加者的数量。例如,有 100 个字词和 3 个人工标签添加者的一段文本计为 100 / 50 * 3 = 6 个单元。单标签分类和多标签分类的价格相同。

- 对于文本情感任务,单元数的确定方式与文本分类任务中的单元数确定方式相同。

- 对于文本实体提取任务,单元数取决于文本长度(每 50 个字词计为一个价格单元)、识别出的实体数量以及人工标签添加者的数量。例如,一段有 100 个字词、2 个识别出的实体和 3 个人工标签添加者的文本计为 100 / 50 * 2 * 3 = 12 个单元。没有实体的文本不会产生费用。

- 对于图像/视频/文本分类和文本情感任务,如果标签集过大,人工标签添加者可能会难以跟踪类别。因此,我们每次最多向人工标签添加者发送 20 个类别。例如,如果标签任务的标签集大小为 40,则每个数据项都将送交人工审核 40 / 20 = 2 次,并且我们会按上文计算得出的价格相应收取 2 次费用。

- 对于启用了自定义标签添加者功能的标签任务,每个数据项均计为 1 个自定义标签添加者单元。

- 对于含有由模型(在没有人工标签添加者协助的情况下)所生成注释的数据项的主动学习标签任务,每个数据项均计为 1 个主动学习单元。

- 对于含有由人工标签添加者所生成注释的数据项的主动学习标签任务,每个数据项均计为常规标签任务(如上所述)。

下表根据为每个目标列出的单位,提供了为每个人工标签添加者每添加 1,000 单位注释的价格。每个 Google Cloud 项目中每月前 5 万个单元按层级 1 的价格付费;接下来的 95 万个单元按层级 2 的价格付费,直至满 100 万个单元。如需了解每月超过 100 万个单元时的价格,请与我们联系。

数据类型 | 目标 | 单位 | 第 1 层价格(美元) | 层级 2 价格 (USD) |

|---|---|---|---|---|

图片 | 分类 | 图片 | $35 | $25 |