Vertex AI 定價

價格均以美元 (USD) 表示。如果您使用美元以外的貨幣付費,系統將按照 Cloud Platform SKU 頁面上列出的相應貨幣價格來計費。

Vertex AI 定價與舊版產品定價的比較

Vertex AI 的費用與 Vertex AI 所取代的舊版 AI 平台和 AutoML 產品相同,但以下項目除外:

- 舊版 AI Platform Prediction 和 AutoML Tables 預測支援成本較低、效能較差的機器類型,但 Vertex AI Inference 和 AutoML 表格模型並不支援這些機器類型。

- 舊版 AI 平台預測支援將資源調度率降至零,但 Vertex AI 推論不支援這項功能。

Vertex AI 還提供其他有助提高成本效益的方式,例如:

- 最佳化 TensorFlow 執行階段。

- 支援共同託管模型。

- 訓練和預測沒有最短使用時間限制,而是以 30 秒為單位累計費用。

Vertex AI 的生成式 AI 定價

如需 Vertex AI 的生成式 AI 定價資訊,請參閱「Vertex AI 的生成式 AI 定價」。

AutoML 模型的定價

使用 Vertex AI AutoML 模型時,您必須支付以下三種主要活動的費用:

- 訓練模型

- 將模型部署至端點

- 使用模型執行預測

Vertex AI 會將預先定義的機器設定套用至 Vertex AutoML 模型,且這些活動的每小時費率反映出資源用量。

訓練模型所需的時間則取決於訓練資料的大小和複雜程度。模型必須先經過部署才能提供線上預測或線上說明。

您必須為部署至端點的每個模型支付費用,即使模型未提供預測也一樣。如要避免產生其他費用,您必須取消部署模型。未部署或部署失敗的模型不會產生費用。

系統只會針對您使用的運算時數向您收取費用。如果訓練作業基於任何原因 (使用者自行取消除外) 而失敗,您無須為這段訓練時間支付費用。如果是您自行取消訓練作業,則該作業的訓練時間仍會產生費用。

在下方選取模型類型即可查看定價資訊。

圖片資料

圖片資料

作業 | 價格 (分類) (美元) | 價格 (物件偵測) (美元) |

|---|---|---|

訓練 | US$3.465 / 1 hour | US$3.465 / 1 hour |

訓練 (邊緣裝置端模型) | US$18.00 / 1 hour | US$18.00 / 1 hour |

部署和線上預測 | US$1.375 / 1 hour | US$2.002 / 1 hour |

批次預測 | US$2.222 / 1 hour | US$2.222 / 1 hour |

表格資料

表格資料

作業 | 每節點時數價格 (分類/迴歸) | 預測作業價格 |

|---|---|---|

訓練 | US$21.252 / 1 hour | 請參閱「Vertex AI 預測」 |

推論 | 與自訂訓練模型的推論價格相同。 Vertex AI 會使用 40 部 n1-highmem-8 機器執行批次推論。 | 請參閱「Vertex AI 預測」 |

Vertex Explainable AI 的推論費用

與 Vertex Explainable AI 相關的運算作業費用和推論費率相同。不過,說明作業的處理時間比一般推論作業更長,因此如果在密集使用 Vertex Explainable AI 時啟用自動調整資源配置功能,有可能導致系統啟用更多節點,連帶增加推論費用。

Vertex AI 預測

AutoML

AutoML

舞台 | 定價 |

|---|---|

預測 | 0 count to 1,000,000 count US$0.20 / 1,000 count, per 1 month / account 1,000,000 count to 50,000,000 count US$0.10 / 1,000 count, per 1 month / account 50,000,000 count and above US$0.02 / 1,000 count, per 1 month / account |

訓練 | US$21.252 / 1 hour |

Explainable AI | 使用 Shapley 值進行說明。請參閱「Vertex AI 推論和說明」定價頁面。 |

* 單一預測資料點是預測期間的一個時間點。舉例來說,在精細程度為每日的情況下,如果預測期間為 7 天,則每個時間序列有 7 個點。

- 最多可免付費納入 5 個預測分位數。

- 各層級使用的資料點數量每個月都會重新整理。

ARIMA+

ARIMA+

舞台 | 定價 |

|---|---|

預測 | US$5.00 / 1,000 count |

訓練 | 每 TB$250.00 x 候選模型數量 x 回測期數量* |

Explainable AI | 使用時間序列分解進行說明不會產生額外費用。不支援使用 Shapley 值進行說明。 |

詳情請參閱 BigQuery ML 定價頁面。如「Vertex AI 定價」所述,每項訓練和預測工作都會產生 1 項代管管道執行作業的費用。

* 系統會針對測試集中的每個週期建立回測期。候選模型的數量取決於所使用的 AUTO_ARIMA_MAX_ORDER。如果是含有多個時間序列的模型,數量會介於 6 到 42 個之間。

自訂訓練模型

訓練課程

訓練課程

下表列出了各種訓練設定約略的「每小時費用」。您可以選擇所選機器類型的自訂設定。如要計算價格,請加總您使用的虛擬機器費用。

如果您使用 Compute Engine 機器類型,並另外加裝加速器,加速器的費用將另外計算。請在下方加速器表格中找出您使用的各種加速器類型,以該類型的價格乘上機器時數,應付費用即為各加速器類型的費用總和。

機器類型

機器類型

您可以在 Vertex AI 自訂訓練中使用 Spot VM。Spot VM 的計費方式請見 Compute Engine Spot VM 定價。除了基礎架構使用費,您還必須支付 Vertex AI 自訂訓練管理費,詳情請見下表。

您可以在 Vertex AI 自訂訓練中使用 Compute Engine 預留資源。使用 Compute Engine 預留資源時,系統會依據 Compute Engine 定價向您收費,包括任何適用的承諾使用折扣 (CUD)。除了基礎架構使用費,您還必須支付 Vertex AI 自訂訓練管理費,詳情請見下表。

- Johannesburg (africa-south1)

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Delhi (asia-south2)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Melbourne (australia-southeast2)

- Warsaw (europe-central2)

- Finland (europe-north1)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- Turin (europe-west12)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Milan (europe-west8)

- Paris (europe-west9)

- Doha (me-central1)

- Dammam (me-central2)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Toronto (northamerica-northeast2)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Alabama (us-east7)

- Dallas (us-south1)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

機型 | 價格 (美元) |

|---|---|

g4-standard-48 | US$5.17508763 / 1 hour |

g4-standard-96 | US$10.35017526 / 1 hour |

g4-standard-192 | US$20.70035052 / 1 hour |

g4-standard-384 | US$41.40070104 / 1 hour |

n1-standard-4 | US$0.21849885 / 1 hour |

n1-standard-8 | US$0.4369977 / 1 hour |

n1-standard-16 | US$0.8739954 / 1 hour |

n1-standard-32 | US$1.7479908 / 1 hour |

n1-standard-64 | US$3.4959816 / 1 hour |

n1-standard-96 | US$5.2439724 / 1 hour |

n1-highmem-2 | US$0.13604845 / 1 hour |

n1-highmem-4 | US$0.2720969 / 1 hour |

n1-highmem-8 | US$0.5441938 / 1 hour |

n1-highmem-16 | US$1.0883876 / 1 hour |

n1-highmem-32 | US$2.1767752 / 1 hour |

n1-highmem-64 | US$4.3535504 / 1 hour |

n1-highmem-96 | US$6.5303256 / 1 hour |

n1-highcpu-16 | US$0.65180712 / 1 hour |

n1-highcpu-32 | US$1.30361424 / 1 hour |

n1-highcpu-64 | US$2.60722848 / 1 hour |

n1-highcpu-96 | US$3.91084272 / 1 hour |

a2-highgpu-1g* | US$4.425248914 / 1 hour |

a2-highgpu-2g* | US$8.850497829 / 1 hour |

a2-highgpu-4g* | US$17.700995658 / 1 hour |

a2-highgpu-8g* | US$35.401991315 / 1 hour |

a2-megagpu-16g* | US$65.707278915 / 1 hour |

a3-highgpu-8g* | US$101.007352 / 1 hour |

a3-megagpu-8g* | US$106.0464232 / 1 hour |

a3-ultragpu-8g* | US$99.7739296 / 1 hour |

a4-highgpu-8g* | US$148.212 / 1 hour |

e2-standard-4 | US$0.154126276 / 1 hour |

e2-standard-8 | US$0.308252552 / 1 hour |

e2-standard-16 | US$0.616505104 / 1 hour |

e2-standard-32 | US$1.233010208 / 1 hour |

e2-highmem-2 | US$0.103959618 / 1 hour |

e2-highmem-4 | US$0.207919236 / 1 hour |

e2-highmem-8 | US$0.415838472 / 1 hour |

e2-highmem-16 | US$0.831676944 / 1 hour |

e2-highcpu-16 | US$0.455126224 / 1 hour |

e2-highcpu-32 | US$0.910252448 / 1 hour |

n2-standard-4 | US$0.2233714 / 1 hour |

n2-standard-8 | US$0.4467428 / 1 hour |

n2-standard-16 | US$0.8934856 / 1 hour |

n2-standard-32 | US$1.7869712 / 1 hour |

n2-standard-48 | US$2.6804568 / 1 hour |

n2-standard-64 | US$3.5739424 / 1 hour |

n2-standard-80 | US$4.467428 / 1 hour |

n2-highmem-2 | US$0.1506661 / 1 hour |

n2-highmem-4 | US$0.3013322 / 1 hour |

cloud-tpu | 定價取決於加速器類型。請參閱「加速器」。 |

n2-highmem-8 | US$0.6026644 / 1 hour |

n2-highmem-16 | US$1.2053288 / 1 hour |

n2-highmem-32 | US$2.4106576 / 1 hour |

n2-highmem-48 | US$3.6159864 / 1 hour |

n2-highmem-64 | US$4.8213152 / 1 hour |

n2-highmem-80 | US$6.026644 / 1 hour |

n2-highcpu-16 | US$0.6596032 / 1 hour |

n2-highcpu-32 | US$1.3192064 / 1 hour |

n2-highcpu-48 | US$1.9788096 / 1 hour |

n2-highcpu-64 | US$2.6384128 / 1 hour |

n2-highcpu-80 | US$3.298016 / 1 hour |

c2-standard-4 | US$0.2401292 / 1 hour |

c2-standard-8 | US$0.4802584 / 1 hour |

c2-standard-16 | US$0.9605168 / 1 hour |

c2-standard-30 | US$1.800969 / 1 hour |

c2-standard-60 | US$3.601938 / 1 hour |

m1-ultramem-40 | US$7.237065 / 1 hour |

m1-ultramem-80 | US$14.47413 / 1 hour |

m1-ultramem-160 | US$28.94826 / 1 hour |

m1-megamem-96 | US$12.249984 / 1 hour |

*由於這種執行個體類型一律需要固定數量的 GPU 加速器,因此這筆金額包含 GPU 價格。

如果您使用美元以外的貨幣付費,系統將按照 Cloud Platform SKU 頁面上列出的相應貨幣價格來計費。

加速器

加速器

- Johannesburg (africa-south1)

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Delhi (asia-south2)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Melbourne (australia-southeast2)

- Warsaw (europe-central2)

- Finland (europe-north1)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- Berlin (europe-west10)

- Turin (europe-west12)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Milan (europe-west8)

- Paris (europe-west9)

- Doha (me-central1)

- Dammam (me-central2)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Toronto (northamerica-northeast2)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

- Phoenix (us-west8)

機型 | 價格 (美元) | Vertex 管理費 |

|---|---|---|

NVIDIA_TESLA_A100 | US$2.933908 / 1 hour | US$0.4400862 / 1 hour |

NVIDIA_TESLA_A100_80GB | US$3.92808 / 1 hour | US$0.589212 / 1 hour |

NVIDIA_H100_80GB | US$9.79655057 / 1 hour | US$1.4694826 / 1 hour |

NVIDIA_H200_141GB | US$10.708501 / 1 hour | 無資訊 |

NVIDIA_H100_MEGA_80GB | US$11.8959171 / 1 hour | 無資訊 |

NVIDIA_TESLA_L4 | US$0.644046276 / 1 hour | 無資訊 |

NVIDIA_TESLA_P4 | US$0.69 / 1 hour | 無資訊 |

NVIDIA_TESLA_P100 | US$1.679 / 1 hour | 無資訊 |

NVIDIA_TESLA_T4 | US$0.4025 / 1 hour | 無資訊 |

NVIDIA_TESLA_V100 | US$2.852 / 1 hour | 無資訊 |

TPU_V2 單元 (8 核心) | US$5.175 / 1 hour | 無資訊 |

TPU_V2 Pod (32 個核心)* | US$27.60 / 1 hour | 無資訊 |

TPU_V3 單元 (8 核心) | US$9.20 / 1 hour | 無資訊 |

TPU_V3 Pod (32 核心)* | US$36.80 / 1 hour | 無資訊 |

tpu7x-standard-4t (1 個晶片) | US$13.80 / 1 hour | 無資訊 |

如果您使用美元以外的貨幣付費,系統將按照 Cloud Platform SKU 頁面上列出的相應貨幣價格來計費。

* 使用 Cloud TPU Pod 訓練的價格取決於 Pod 中的核心數量。Pod 中的核心數量一律是 32 的倍數。如要針對含有超過 32 個核心的 Pod 計算訓練費用,請將 32 核心 Pod 的價格乘以核心數量,再除以 32。舉例來說,如果是 128 核心的 Pod,則價格為 (32 核心 Pod 價格) * (128/32)。如要瞭解特定區域的可用 Cloud TPU Pod,請參閱 Cloud TPU 說明文件中的「系統架構」。

磁碟

磁碟

- Johannesburg (africa-south1)

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Delhi (asia-south2)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Melbourne (australia-southeast2)

- Warsaw (europe-central2)

- Finland (europe-north1)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- Turin (europe-west12)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Milan (europe-west8)

- Paris (europe-west9)

- Doha (me-central1)

- Dammam (me-central2)

- Montreal (northamerica-northeast1)

- Toronto (northamerica-northeast2)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

機型 | 價格 (美元) |

|---|---|

pd-standard | US$0.000063014 / 1 gibibyte hour |

pd-ssd | US$0.000267808 / 1 gibibyte hour |

如果您使用美元以外的貨幣付費,系統將按照 Cloud Platform SKU 頁面上列出的相應貨幣價格來計費。

- 所有使用情形均須符合 Vertex AI 配額 政策的規定。

- 在 Vertex AI 的生命週期內,您必須將資料和程式檔案儲存在 Google Cloud Storage 值區中。詳情請參閱 Cloud Storage 使用說明。

從開始佈建工作資源到工作完成為止,您必須支付模型訓練費用。

警告:訓練工作均須符合 Vertex AI 配額政策的規定。如果一開始就為訓練工作選擇效能強大的處理叢集,可能會超出配額。

預先定義設定的資源調度層級 (AI 平台訓練)

您可以控管訓練模型時要使用的處理叢集類型。最簡單的方法是選擇其中一個預先定義的設定 (稱為「資源調度層級」)。進一步瞭解資源調度層級。

自訂設定的機器類型

如果您使用 Vertex AI 或選取「CUSTOM」做為 AI Platform Training 的資源調度層級,就可以控管用於叢集主要執行個體、工作站和參數伺服器的虛擬機器數量及類型。進一步瞭解 Vertex AI 的機器類型和 AI 平台訓練的機器類型。

如果使用自訂處理叢集進行訓練,費用即為您指定的所有機器費用總和。系統會根據工作的總作業時間向您收取費用,而不是以個別機器的有效處理時間計費。

Gen AI Evaluation Service

如果是模型指標,則只會收取基礎自動評分模型相關的預測費用。系統會根據評估資料集中提供的輸入權杖,以及自動評估工具的輸出內容計費。

Gen AI Evaluation Service 正式發布 (GA)。價格異動已於 2025 年 4 月 14 日生效。

公制 | 定價 |

|---|---|

逐點 | 預設自動評分模型 Gemini 2.0 Flash |

逐對 | 預設自動評分模型 Gemini 2.0 Flash |

以運算為基礎的指標,輸入內容每 1,000 個字元收費 $0.00003 美元,輸出內容每 1,000 個字元收費 $0.00009 美元。在 SKU 中稱為「自動指標」。

指標名稱 | 類型 |

|---|---|

完全符合 | 以運算為基礎 |

Bleu | 以運算為基礎 |

Rouge | 以運算為基礎 |

工具呼叫有效 | 以運算為基礎 |

工具名稱比對 | 以運算為基礎 |

工具參數金鑰比對 | 以運算為基礎 |

工具參數 KV 比對 | 以運算為基礎 |

價格均以美元 (USD) 表示。如果您使用美元以外的貨幣付費,系統將按照 Cloud Platform SKU 頁面上列出的相應貨幣價格來計費。

舊版模型指標的輸入內容費用為每 1,000 個字元 $0.005 美元,輸出內容費用為每 1,000 個字元 $0.015 美元。

指標名稱 | 類型 |

|---|---|

連貫性 | 逐點 |

流暢度 | 逐點 |

完成度 | 逐點 |

安全性 | 逐點 |

實證性 | 逐點 |

摘要品質 | 逐點 |

摘要實用性 | 逐點 |

摘要詳細程度 | 逐點 |

問題回答品質 | 逐點 |

問題回答相關性 | 逐點 |

問題回答實用性 | 逐點 |

問題回答正確性 | 逐點 |

成對摘要品質 | 逐對 |

成對問題回答品質 | 逐對 |

價格均以美元 (USD) 表示。如果您使用美元以外的貨幣付費,系統將按照 Cloud Platform SKU 頁面上列出的相應貨幣價格來計費。

Vertex AI Agent Engine

Vertex AI Agent Engine 是一組服務,可讓開發人員在正式環境中調度代理。這些服務可搭配使用,也能單獨選用。用多少就付多少。目前您需要支付 Agent Engine 執行階段費用。

自 2026 年 1 月 28 日起,Code Execution、Sessions 和 Memory Bank 將開始計費。

執行階段

定價依據為部署至 Agent Engine 執行階段的代理程式所使用的運算 (vCPU 小時) 和記憶體 (GiB 小時) 資源。計費時,系統會將用量進位至最接近的秒數。服務專員的閒置時間不計費。

免費方案

為協助您開始使用執行階段,我們提供每月免費方案。

- vCPU:每月前 180,000 vCPU-秒 (50 小時) 免費

- RAM - 每月前 360,000 GiB-秒 (100 小時) 免費

根據用量計費

每月用量超過免費級別後,系統會按照下列費率開始計費。

資源 | 價格 (美元) |

|---|---|

vCPU | 0 hour to 50 hour US$0.00 (Free) / 3,600 second, per 1 month / project 50 hour and above US$0.0864 / 3,600 second, per 1 month / project |

RAM | 0 gibibyte hour to 100 gibibyte hour US$0.00 (Free) / 3,600 gibibyte second, per 1 month / project 100 gibibyte hour and above US$0.009 / 3,600 gibibyte second, per 1 month / project |

執行程式碼

與執行階段類似,您需要支付執行沙箱所需的運算和記憶體資源費用。計費時,系統會將用量進位至最接近的秒數。閒置時間不計費。

- 運算:每 vCPU 時數 $0.0864

- 記憶體: 每 GiB 小時$0.0090 美元

工作階段

您需要根據工作階段服務中儲存的事件數量付費。我們將針對包含內容的儲存工作階段事件收費。包括初始使用者要求、模型回覆、函式呼叫和函式回覆。我們不會針對儲存在工作階段服務中的系統控制事件 (例如檢查點) 收費。

- 每儲存 1,000 個事件 $0.25 美元

Memory Bank

根據儲存和傳回的記憶數量計費。

- 儲存的記憶體: 每月每 1,000 個儲存的記憶體$0.25 美元 (另計生成記憶體的 LLM 費用)

- 記憶擷取:每傳回 1,000 個記憶 $0.50 美元;每月前 1,000 個記憶免費

計費情境

計費情境

為協助您瞭解 Agent Engine 服務的費用,我們提供兩個假設的虛擬服務專員:Lightweight Agent 和 Standard Agent。在這兩種情境中,我們都做出以下假設:

- 免費方案: 在這些計算中,我們假設執行階段和記憶體儲存空間的免費方案已在一個月內用於先前的實驗。

- 單次工作階段的執行階段要求數:「完整工作階段」或對話包含 10 項執行階段要求。

- 工作階段:每個執行階段要求平均會產生 3 個工作階段事件。

- 記憶庫:

- 儲存空間:每次完整對話結束時,系統會擷取並儲存 1 個記憶。

- 檢索:我們假設每個執行階段要求平均會傳回 1 個記憶體。

- 程式碼執行功能會針對 30% 的所有執行階段要求叫用。

- 計費月份:所有每月計算均以 30 天為一個月。

其他注意事項:

- 服務模組化:雖然以下情境顯示的是 Agent Engine 服務的總費用,但您可以選擇單獨使用各項服務。舉例來說,您可以使用 Agent Engine 工作階段和記憶庫服務,不必使用 Agent Engine 執行階段。

- 額外模型費用:代理程式需要 LLM 來進行推理和規劃。代理程式使用的 LLM 權杖會另外計費,不包含在下列情境中。

- 額外工具費用:代理程式需要工具才能採取行動。代理程式使用的工具 (例如 API 呼叫、儲存空間) 會另外計費,不包含在下列情境中。

假設情境

假設情境

情境 1:輕量級內部虛擬服務專員

這個情境代表服務專員處理低量、零星的流量。

- 應用範例:小型公司的 IT 服務台機器人、可撰寫電子郵件的個人效率提升代理程式,或是可從說明文件中提供解答的 Slack 機器人。

- 執行階段和程式碼執行所需的運算資源和記憶體:1 個 vCPU / 1 GiB RAM。

- 流量:每秒 0.16 次查詢 (每分鐘 10 次查詢),每月共 432,000 次要求。

- 平均要求時間: 3 秒

服務 | 計算方式 | 每月費用 |

|---|---|---|

執行階段 | (432,000 個要求 × 3 秒/要求 ÷ 3,600 秒/小時) = 360 小時 vCPU: (360 小時 × 1 個 vCPU × 每小時 $0.0864 美元) = $31.10 美元 RAM:(360 小時 × 1 GiB × 每小時 $0.0090 美元) = $3.24 美元 | $34.34 |

執行程式碼 | (360 小時執行時間 × 30% 使用率) = 108 小時 vCPU: (108 小時 × 1 個 vCPU × 每小時 $0.0864 美元) = $9.33 美元 RAM: (108 小時 × 1 GiB × $0.0090/小時) = $0.97 | $10.30 |

工作階段 | 432,000 項要求 x 3 個事件 ÷ 1,000 × $0.25 | $324 |

Memory Bank | 儲存: (432,000 個要求 ÷ 10 個要求/工作階段 × 1 個記憶體/工作階段 ÷ 1,000) × $0.25 美元 = $10.80 美元 擷取: (432,000 項要求 × 1 個傳回的記憶體 ÷ 1,000) × $0.50 美元 = $216.00 美元 | $226.80 |

預估每月總費用 | $595.44 |

情境 2:標準代理程式

這個情境代表已整合至業務應用程式的正式版代理程式,可處理穩定的使用者流量。

- 應用範例:電子商務網站的客服專員、B2B 網站的待開發客戶資格評估機器人,或是銷售團隊的內部資料分析專員。

- 運算:2 個 vCPU / 5 GiB RAM

- 流量:每秒 10 次查詢 (每分鐘 600 次查詢),每月共 25,920,000 次要求。

- 平均要求持續時間: 5 秒

服務 | 計算方式 | 每月費用 |

|---|---|---|

執行階段 | (25,920,000 個要求 × 5 秒/要求 ÷ 3,600 秒/小時) = 36,000 小時 vCPU: (36,000 小時 × 2 個 vCPU × $0.0864/小時) = $6,220.80 RAM: (36,000 小時 × 5 GiB × $0.0090/小時) = $1,620.00 | $7,840.80 |

執行程式碼 | (36,000 執行階段時數 × 30% 使用率) = 10,800 小時 vCPU: (10,800 小時 × 2 vCPU × 每小時 $0.0864 美元) = $1,866.24 美元 RAM: (10,800 小時 × 5 GiB × $0.0090/小時) = $486 | $2,352.24 |

工作階段 | 25,920,000 個要求 * 3 個事件 ÷ 1,000 × $0.25 美元 | $19,440 |

Memory Bank | 儲存:(25,920,000 次要求 ÷ 10 次要求/工作階段 × 1 個記憶體/工作階段 ÷ 1,000) × $0.25 美元 = $648.00 美元 檢索: (25,920,000 次要求 × 1 個傳回的記憶體 ÷ 1,000) × $0.50 美元 = $12,960.00 美元 | $13,608 |

預估每月總費用 | $43,241.04 |

Ray on Vertex AI

訓練課程

訓練課程

下表列出了各種訓練設定約略的「每小時費用」。您可以選擇所選機器類型的自訂設定。如要計算價格,請加總您使用的虛擬機器費用。

如果您使用 Compute Engine 機器類型,並另外加裝加速器,加速器的費用將另外計算。請在下方加速器表格中找出您使用的各種加速器類型,以該類型的價格乘上機器時數,應付費用即為各加速器類型的費用總和。

機器類型

機器類型

- Johannesburg (africa-south1)

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Melbourne (australia-southeast2)

- Warsaw (europe-central2)

- Finland (europe-north1)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- Turin (europe-west12)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Milan (europe-west8)

- Paris (europe-west9)

- Doha (me-central1)

- Dammam (me-central2)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Toronto (northamerica-northeast2)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

機型 | 價格 (美元) |

|---|---|

n1-standard-4 | US$0.2279988 / 1 hour |

n1-standard-8 | US$0.4559976 / 1 hour |

n1-standard-16 | US$0.9119952 / 1 hour |

n1-standard-32 | US$1.8239904 / 1 hour |

n1-standard-64 | US$3.6479808 / 1 hour |

n1-standard-96 | US$5.4719712 / 1 hour |

n1-highmem-2 | US$0.1419636 / 1 hour |

n1-highmem-4 | US$0.2839272 / 1 hour |

n1-highmem-8 | US$0.5678544 / 1 hour |

n1-highmem-16 | US$1.1357088 / 1 hour |

n1-highmem-32 | US$2.2714176 / 1 hour |

n1-highmem-64 | US$4.5428352 / 1 hour |

n1-highmem-96 | US$6.8142528 / 1 hour |

n1-highcpu-16 | US$0.68014656 / 1 hour |

n1-highcpu-32 | US$1.36029312 / 1 hour |

n1-highcpu-64 | US$2.72058624 / 1 hour |

n1-highcpu-96 | US$4.08087936 / 1 hour |

a2-highgpu-1g* | US$4.408062 / 1 hour |

a2-highgpu-2g* | US$8.816124 / 1 hour |

a2-highgpu-4g* | US$17.632248 / 1 hour |

a2-highgpu-8g* | US$35.264496 / 1 hour |

a2-highgpu-16g* | US$70.528992 / 1 hour |

a3-highgpu-8g* | US$105.39898088 / 1 hour |

a3-megagpu-8g* | US$110.65714224 / 1 hour |

a4-highgpu-8g* | US$148.212 / 1 hour |

e2-standard-4 | US$0.16082748 / 1 hour |

e2-standard-4 | US$0.32165496 / 1 hour |

e2-standard-16 | US$0.64330992 / 1 hour |

e2-standard-32 | US$1.28661984 / 1 hour |

e2-highmem-2 | US$0.10847966 / 1 hour |

e2-highmem-4 | US$0.21695932 / 1 hour |

e2-highmem-8 | US$0.43391864 / 1 hour |

e2-highmem-16 | US$0.86783728 / 1 hour |

e2-highcpu-16 | US$0.4749144 / 1 hour |

e2-highcpu-32 | US$0.9498288 / 1 hour |

n2-standard-4 | US$0.2330832 / 1 hour |

n2-standard-8 | US$0.4661664 / 1 hour |

n2-standard-16 | US$0.9323328 / 1 hour |

n2-standard-32 | US$1.8646656 / 1 hour |

n2-standard-48 | US$2.7969984 / 1 hour |

n2-standard-64 | US$3.7293312 / 1 hour |

n2-standard-80 | US$4.661664 / 1 hour |

n2-highmem-2 | US$0.1572168 / 1 hour |

n2-highmem-4 | US$0.3144336 / 1 hour |

n2-highmem-8 | US$0.6288672 / 1 hour |

n2-highmem-16 | US$1.2577344 / 1 hour |

n2-highmem-32 | US$2.5154688 / 1 hour |

n2-highmem-48 | US$3.7732032 / 1 hour |

n2-highmem-64 | US$5.0309376 / 1 hour |

n2-highmem-80 | US$6.288672 / 1 hour |

n2-highcpu-16 | US$0.6882816 / 1 hour |

n2-highcpu-32 | US$1.3765632 / 1 hour |

n2-highcpu-48 | US$2.0648448 / 1 hour |

n2-highcpu-64 | US$2.7531264 / 1 hour |

n2-highcpu-80 | US$3.441408 / 1 hour |

c2-standard-4 | US$0.2505696 / 1 hour |

c2-standard-8 | US$0.5011392 / 1 hour |

c2-standard-16 | US$1.0022784 / 1 hour |

c2-standard-30 | US$1.879272 / 1 hour |

c2-standard-60 | US$3.758544 / 1 hour |

m1-ultramem-40 | US$7.55172 / 1 hour |

m1-ultramem-80 | US$15.10344 / 1 hour |

m1-ultramem-160 | US$30.20688 / 1 hour |

m1-megamem-96 | US$12.782592 / 1 hour |

cloud-tpu | 定價取決於加速器類型。請參閱「加速器」。 |

如果您使用美元以外的貨幣付費,系統將按照 Cloud Platform SKU 頁面上列出的相應貨幣價格來計費。

加速器

加速器

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Finland (europe-north1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Montreal (northamerica-northeast1)

- Sao Paulo (southamerica-east1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

GPU 類型 | 價格 (美元) |

|---|---|

NVIDIA_TESLA_A100 | US$3.5206896 / 1 hour |

NVIDIA_TESLA_A100_80GB | US$4.517292 / 1 hour |

NVIDIA_H100_80GB | US$11.75586073 / 1 hour |

NVIDIA_TESLA_P4 | US$0.72 / 1 hour |

NVIDIA_TESLA_P100 | US$1.752 / 1 hour |

NVIDIA_TESLA_T4 | US$0.42 / 1 hour |

NVIDIA_TESLA_V100 | US$2.976 / 1 hour |

TPU_V2 單元 (8 核心) | US$5.40 / 1 hour |

TPU_V2 Pod (32 個核心)* | US$28.80 / 1 hour |

TPU_V3 單元 (8 核心) | US$9.60 / 1 hour |

TPU_V3 Pod (32 核心)* | US$38.40 / 1 hour |

如果您使用美元以外的貨幣付費,系統將按照 Cloud Platform SKU 頁面上列出的相應貨幣價格來計費。

* 使用 Cloud TPU Pod 訓練的價格取決於 Pod 中的核心數量。Pod 中的核心數量一律是 32 的倍數。如要針對含有超過 32 個核心的 Pod 計算訓練費用,請將 32 核心 Pod 的價格乘以核心數量,再除以 32。舉例來說,如果是 128 核心的 Pod,則價格為 (32 核心 Pod 價格) * (128/32)。如要瞭解特定區域的可用 Cloud TPU Pod,請參閱 Cloud TPU 說明文件中的「系統架構」。

磁碟

磁碟

- Johannesburg (africa-south1)

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Melbourne (australia-southeast2)

- Warsaw (europe-central2)

- Finland (europe-north1)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- Turin (europe-west12)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Milan (europe-west8)

- Paris (europe-west9)

- Doha (me-central1)

- Dammam (me-central2)

- Montreal (northamerica-northeast1)

- Toronto (northamerica-northeast2)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

磁碟類型 | 價格 (美元) |

|---|---|

pd-standard | US$0.000065753 / 1 gibibyte hour |

pd-ssd | US$0.000279452 / 1 gibibyte hour |

如果您使用美元以外的貨幣付費,系統將按照 Cloud Platform SKU 頁面上列出的相應貨幣價格來計費。

- 所有使用情形均須符合 Vertex AI 配額 政策的規定。

- 在 Vertex AI 的生命週期內,您必須將資料和程式檔案儲存在 Google Cloud Storage 值區中。詳情請參閱 Cloud Storage 使用說明。

從開始佈建工作資源到工作完成為止,您必須支付模型訓練費用。

警告:訓練工作均須符合 Vertex AI 配額政策的規定。如果一開始就為訓練工作選擇效能強大的處理叢集,可能會超出配額。

預測和說明

下表列出每節點時數的批次預測、線上預測和線上說明費用。節點時數代表虛擬機器執行預測工作所花費的時間,或在運作狀態下 (已部署一或多個模型的端點) 等候處理預測或說明要求的時間。

您可以在 Vertex AI Inference 中使用 Spot VM。Spot VM 的計費方式請見 Compute Engine Spot VM 定價。除了基礎架構使用費,您還必須支付 Vertex AI Inference 管理費,詳情請見下表。

您可以將 Compute Engine 預留項目與 Vertex AI Inference 搭配使用。使用 Compute Engine 預留資源時,系統會依據 Compute Engine 定價向您收費,包括任何適用的承諾使用折扣 (CUD)。除了基礎架構使用費,您還必須支付 Vertex AI Inference 管理費,詳情請見下表。

E2 系列

E2 系列

- Johannesburg (africa-south1)

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Melbourne (australia-southeast2)

- Warsaw (europe-central2)

- Finland (europe-north1)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- Turin (europe-west12)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Milan (europe-west8)

- Paris (europe-west9)

- Doha (me-central1)

- Dammam (me-central2)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Toronto (northamerica-northeast2)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

機型 | 價格 (美元) |

|---|---|

e2-standard-2 | US$0.0770564 / 1 hour |

e2-standard-4 | US$0.1541128 / 1 hour |

e2-standard-8 | US$0.3082256 / 1 hour |

e2-standard-16 | US$0.6164512 / 1 hour |

e2-standard-32 | US$1.2329024 / 1 hour |

e2-highmem-2 | US$0.1039476 / 1 hour |

e2-highmem-4 | US$0.2078952 / 1 hour |

e2-highmem-8 | US$0.4157904 / 1 hour |

e2-highmem-16 | US$0.8315808 / 1 hour |

e2-highcpu-2 | US$0.056888 / 1 hour |

e2-highcpu-4 | US$0.113776 / 1 hour |

e2-highcpu-8 | US$0.227552 / 1 hour |

e2-highcpu-16 | US$0.455104 / 1 hour |

e2-highcpu-32 | US$0.910208 / 1 hour |

N1 系列

N1 系列

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Melbourne (australia-southeast2)

- Warsaw (europe-central2)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Milan (europe-west8)

- Paris (europe-west9)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Toronto (northamerica-northeast2)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

機型 | 價格 (美元) |

|---|---|

n1-standard-2 | US$0.1095 / 1 hour |

n1-standard-4 | US$0.219 / 1 hour |

n1-standard-8 | US$0.438 / 1 hour |

n1-standard-16 | US$0.876 / 1 hour |

n1-standard-32 | US$1.752 / 1 hour |

n1-highmem-2 | US$0.137 / 1 hour |

n1-highmem-4 | US$0.274 / 1 hour |

n1-highmem-8 | US$0.548 / 1 hour |

n1-highmem-16 | US$1.096 / 1 hour |

n1-highcpu-2 | US$0.081 / 1 hour |

n1-highcpu-4 | US$0.162 / 1 hour |

n1-highcpu-8 | US$0.324 / 1 hour |

n1-highcpu-16 | US$0.648 / 1 hour |

n1-highcpu-32 | US$1.296 / 1 hour |

N2 系列

N2 系列

- Johannesburg (africa-south1)

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Melbourne (australia-southeast2)

- Warsaw (europe-central2)

- Finland (europe-north1)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- Turin (europe-west12)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Milan (europe-west8)

- Paris (europe-west9)

- Doha (me-central1)

- Dammam (me-central2)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Toronto (northamerica-northeast2)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

機型 | 價格 (美元) |

|---|---|

n2-standard-2 | US$0.1116854 / 1 hour |

n2-standard-4 | US$0.2233708 / 1 hour |

n2-standard-8 | US$0.4467416 / 1 hour |

n2-standard-16 | US$0.8934832 / 1 hour |

n2-standard-32 | US$1.7869664 / 1 hour |

n2-highmem-2 | US$0.1506654 / 1 hour |

n2-highmem-4 | US$0.3013308 / 1 hour |

n2-highmem-8 | US$0.6026616 / 1 hour |

n2-highmem-16 | US$1.2053232 / 1 hour |

n2-highcpu-2 | US$0.0824504 / 1 hour |

n2-highcpu-4 | US$0.1649008 / 1 hour |

n2-highcpu-8 | US$0.3298016 / 1 hour |

n2-highcpu-16 | US$0.6596032 / 1 hour |

n2-highcpu-32 | US$1.3192064 / 1 hour |

N2D 系列

N2D 系列

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Melbourne (australia-southeast2)

- Warsaw (europe-central2)

- Finland (europe-north1)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Milan (europe-west8)

- Paris (europe-west9)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Sao Paulo (southamerica-east1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

機型 | 價格 (美元) |

|---|---|

n2d-standard-2 | US$0.0971658 / 1 hour |

n2d-standard-4 | US$0.1943316 / 1 hour |

n2d-standard-8 | US$0.3886632 / 1 hour |

n2d-standard-16 | US$0.7773264 / 1 hour |

n2d-standard-32 | US$1.5546528 / 1 hour |

n2d-highmem-2 | US$0.131077 / 1 hour |

n2d-highmem-4 | US$0.262154 / 1 hour |

n2d-highmem-8 | US$0.524308 / 1 hour |

n2d-highmem-16 | US$1.048616 / 1 hour |

n2d-highcpu-2 | US$0.0717324 / 1 hour |

n2d-highcpu-4 | US$0.1434648 / 1 hour |

n2d-highcpu-8 | US$0.2869296 / 1 hour |

n2d-highcpu-16 | US$0.5738592 / 1 hour |

n2d-highcpu-32 | US$1.1477184 / 1 hour |

C2 系列

C2 系列

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Sydney (australia-southeast1)

- Finland (europe-north1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Montreal (northamerica-northeast1)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

機型 | 價格 (美元) |

|---|---|

c2-standard-4 | US$0.240028 / 1 hour |

c2-standard-8 | US$0.480056 / 1 hour |

c2-standard-16 | US$0.960112 / 1 hour |

c2-standard-30 | US$1.80021 / 1 hour |

c2-standard-60 | US$3.60042 / 1 hour |

C2D 系列

C2D 系列

- Taiwan (asia-east1)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Oregon (us-west1)

- Las Vegas (us-west4)

機型 | 價格 (美元) |

|---|---|

c2d-standard-2 | US$0.1044172 / 1 hour |

c2d-standard-4 | US$0.2088344 / 1 hour |

c2d-standard-8 | US$0.4176688 / 1 hour |

c2d-standard-16 | US$0.8353376 / 1 hour |

c2d-standard-32 | US$1.6706752 / 1 hour |

c2d-standard-56 | US$2.9236816 / 1 hour |

c2d-standard-112 | US$5.8473632 / 1 hour |

c2d-highmem-2 | US$0.1408396 / 1 hour |

c2d-highmem-4 | US$0.2816792 / 1 hour |

c2d-highmem-8 | US$0.5633584 / 1 hour |

c2d-highmem-16 | US$1.1267168 / 1 hour |

c2d-highmem-32 | US$2.2534336 / 1 hour |

c2d-highmem-56 | US$3.9435088 / 1 hour |

c2d-highmem-112 | US$7.8870176 / 1 hour |

c2d-highcpu-2 | US$0.086206 / 1 hour |

c2d-highcpu-4 | US$0.172412 / 1 hour |

c2d-highcpu-8 | US$0.344824 / 1 hour |

c2d-highcpu-16 | US$0.689648 / 1 hour |

c2d-highcpu-32 | US$1.379296 / 1 hour |

c2d-highcpu-56 | US$2.413768 / 1 hour |

c2d-highcpu-112 | US$4.827536 / 1 hour |

C3 系列

C3 系列

- Singapore (asia-southeast1)

- Belgium (europe-west1)

- Netherlands (europe-west4)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

機型 | 價格 (美元) |

|---|---|

c3-highcpu-4 | US$0.19824 / 1 hour |

c3-highcpu-8 | US$0.39648 / 1 hour |

c3-highcpu-22 | US$1.09032 / 1 hour |

c3-highcpu-44 | US$2.18064 / 1 hour |

c3-highcpu-88 | US$4.36128 / 1 hour |

c3-highcpu-176 | US$8.72256 / 1 hour |

A2 系列

A2 系列

- Tokyo (asia-northeast1)

- Seoul (asia-northeast3)

- Singapore (asia-southeast1)

- Netherlands (europe-west4)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Oregon (us-west1)

- Salt Lake City (us-west3)

機型 | 價格 (美元) |

|---|---|

a2-highgpu-1g | US$4.2244949 / 1 hour |

a2-highgpu-2g | US$8.4489898 / 1 hour |

a2-highgpu-4g | US$16.8979796 / 1 hour |

a2-highgpu-8g | US$33.7959592 / 1 hour |

a2-megagpu-16g | US$64.1020592 / 1 hour |

a2-ultragpu-1g | US$5.7818474 / 1 hour |

a2-ultragpu-2g | US$11.5636948 / 1 hour |

a2-ultragpu-4g | US$23.1273896 / 1 hour |

a2-ultragpu-8g | US$46.2547792 / 1 hour |

從預留容量或現貨容量取用資源時,帳單會分為兩個 SKU:標籤為「vertex-ai-online-prediction」的 GCE SKU 和 Vertex AI 管理費 SKU。這樣一來,您就能在 Vertex AI 中使用承諾使用折扣 (CUD)。

A3 系列

A3 系列

- Tokyo (asia-northeast1)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Delhi (asia-south2)

- Singapore (asia-southeast1)

- Sydney (australia-southeast1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Toronto (northamerica-northeast2)

- Iowa (us-central1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

- Oregon (us-west1)

- Las Vegas (us-west4)

機型 | 價格 (美元) |

|---|---|

a3-ultragpu-8g | US$96.015616 / 1 hour |

a3-megagpu-8g | US$106.65474 / 1 hour |

從預留容量或現貨容量取用資源時,帳單會分為兩個 SKU:標籤為「vertex-ai-online-prediction」的 GCE SKU 和 Vertex AI 管理費 SKU。這樣一來,您就能在 Vertex AI 中使用承諾使用折扣 (CUD)。

A4 系列

A4 系列

- Singapore (asia-southeast1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Los Angeles (us-west2)

機型 | 價格 (美元) |

|---|---|

a4-highgpu-8g | US$148.212 / 1 hour |

從預留容量或現貨容量取用資源時,帳單會分為兩個 SKU:標籤為「vertex-ai-online-prediction」的 GCE SKU 和 Vertex AI 管理費 SKU。這樣一來,您就能在 Vertex AI 中使用承諾使用折扣 (CUD)。

A4X 系列

A4X 系列

- Netherlands (europe-west4)

- Iowa (us-central1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

機型 | 價格 (美元) |

|---|---|

a4x-highgpu-4g | US$74.75 / 1 hour |

從預留容量或現貨容量取用資源時,帳單會分為兩個 SKU:標籤為「vertex-ai-online-prediction」的 GCE SKU 和 Vertex AI 管理費 SKU。這樣一來,您就能在 Vertex AI 中使用承諾使用折扣 (CUD)。

a4x-highgpu-4g 至少需要 18 個 VM。

G2 系列

G2 系列

- Taiwan (asia-east1)

- Tokyo (asia-northeast1)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Dammam (me-central2)

- Toronto (northamerica-northeast2)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Oregon (us-west1)

- Las Vegas (us-west4)

機型 | 價格 (美元) |

|---|---|

g2-standard-4 | US$0.81293 / 1 hour |

g2-standard-8 | US$0.98181 / 1 hour |

g2-standard-12 | US$1.15069 / 1 hour |

g2-standard-16 | US$1.31957 / 1 hour |

g2-standard-24 | US$2.30138 / 1 hour |

g2-standard-32 | US$1.99509 / 1 hour |

g2-standard-48 | US$4.60276 / 1 hour |

g2-standard-96 | US$9.20552 / 1 hour |

從預留容量或現貨容量取用資源時,帳單會分為兩個 SKU:標籤為「vertex-ai-online-prediction」的 GCE SKU 和 Vertex AI 管理費 SKU。這樣一來,您就能在 Vertex AI 中使用承諾使用折扣 (CUD)。

G4 系列

G4 系列

- Taiwan (asia-east1)

- Delhi (asia-south2)

- Singapore (asia-southeast1)

- Finland (europe-north1)

- Belgium (europe-west1)

- Netherlands (europe-west4)

- Milan (europe-west8)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Alabama (us-east7)

- Oregon (us-west1)

- Salt Lake City (us-west3)

機型 | 價格 (美元) |

|---|---|

g4-standard-48 | US$5.17508763 / 1 hour |

g4-standard-96 | US$10.35017526 / 1 hour |

g4-standard-192 | US$20.70035052 / 1 hour |

g4-standard-384 | US$41.40070104 / 1 hour |

TPU v5e 定價

TPU v5e 定價

- Singapore (asia-southeast1)

- Netherlands (europe-west4)

- Iowa (us-central1)

- South Carolina (us-east1)

- Oregon (us-west1)

- Las Vegas (us-west4)

機型 | 價格 (美元) |

|---|---|

ct5lp-hightpu-1t | US$1.38 / 1 hour |

ct5lp-hightpu-4t | US$5.52 / 1 hour |

ct5lp-hightpu-8t | US$5.52 / 1 hour |

TPU v6e 定價

TPU v6e 定價

- Tokyo (asia-northeast1)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- London (europe-west2)

- Netherlands (europe-west4)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

機型 | 價格 (美元) |

|---|---|

ct6e-standard-1t | US$3.105 / 1 hour |

ct6e-standard-4t | US$12.42 / 1 hour |

ct6e-standard-8t | US$24.84 / 1 hour |

E2 系列

E2 系列

- Johannesburg (africa-south1)

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Melbourne (australia-southeast2)

- Warsaw (europe-central2)

- Finland (europe-north1)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- Turin (europe-west12)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Milan (europe-west8)

- Paris (europe-west9)

- Doha (me-central1)

- Dammam (me-central2)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Toronto (northamerica-northeast2)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

項目 | 價格 (美元) |

|---|---|

vCPU | US$0.0250826 / 1 hour |

RAM | US$0.0033614 / 1 gibibyte hour |

N1 系列

N1 系列

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Melbourne (australia-southeast2)

- Warsaw (europe-central2)

- Finland (europe-north1)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Milan (europe-west8)

- Paris (europe-west9)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Toronto (northamerica-northeast2)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

項目 | 價格 (美元) |

|---|---|

vCPU | US$0.036 / 1 hour |

RAM | US$0.005 / 1 gibibyte hour |

N2 系列

N2 系列

- Johannesburg (africa-south1)

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Melbourne (australia-southeast2)

- Warsaw (europe-central2)

- Finland (europe-north1)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- Turin (europe-west12)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Milan (europe-west8)

- Paris (europe-west9)

- Doha (me-central1)

- Dammam (me-central2)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Toronto (northamerica-northeast2)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

項目 | 價格 (美元) |

|---|---|

vCPU | US$0.0363527 / 1 hour |

RAM | US$0.0048725 / 1 gibibyte hour |

N2D 系列

N2D 系列

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Melbourne (australia-southeast2)

- Warsaw (europe-central2)

- Finland (europe-north1)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Milan (europe-west8)

- Paris (europe-west9)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Sao Paulo (southamerica-east1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

項目 | 價格 (美元) |

|---|---|

vCPU | US$0.0316273 / 1 hour |

RAM | US$0.0042389 / 1 gibibyte hour |

C2 系列

C2 系列

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Sydney (australia-southeast1)

- Finland (europe-north1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Montreal (northamerica-northeast1)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

項目 | 價格 (美元) |

|---|---|

vCPU | US$0.039077 / 1 hour |

RAM | US$0.0052325 / 1 gibibyte hour |

C2D 系列

C2D 系列

- Taiwan (asia-east1)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Oregon (us-west1)

- Las Vegas (us-west4)

項目 | 價格 (美元) |

|---|---|

vCPU | US$0.0339974 / 1 hour |

RAM | US$0.0045528 / 1 gibibyte hour |

C3 系列

C3 系列

- Singapore (asia-southeast1)

- Belgium (europe-west1)

- Netherlands (europe-west4)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

項目 | 價格 (美元) |

|---|---|

vCPU | US$0.03908 / 1 hour |

RAM | US$0.00524 / 1 gibibyte hour |

A2 系列

A2 系列

- Tokyo (asia-northeast1)

- Seoul (asia-northeast3)

- Singapore (asia-southeast1)

- Netherlands (europe-west4)

- Tel Aviv (me-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Oregon (us-west1)

- Salt Lake City (us-west3)

項目 | 價格 (美元) |

|---|---|

vCPU | US$0.0363527 / 1 hour |

RAM | US$0.0048725 / 1 gibibyte hour |

GPU (A100 40 GB) | US$3.3741 / 1 hour |

GPU (A100 80 GB) | US$4.51729 / 1 hour |

A3 系列

A3 系列

- Tokyo (asia-northeast1)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Delhi (asia-south2)

- Singapore (asia-southeast1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Toronto (northamerica-northeast2)

- Iowa (us-central1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

- Oregon (us-west1)

- Las Vegas (us-west4)

項目 | 價格 (美元) |

|---|---|

vCPU | US$0.0293227 / 1 hour |

RAM | US$0.0025534 / 1 gibibyte hour |

GPU (H100 80 GB) | US$11.2660332 / 1 hour |

GPU (H200) | US$10.708501 / 1 hour |

G2 系列

G2 系列

- Taiwan (asia-east1)

- Tokyo (asia-northeast1)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Dammam (me-central2)

- Toronto (northamerica-northeast2)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Oregon (us-west1)

- Las Vegas (us-west4)

項目 | 價格 (美元) |

|---|---|

vCPU | US$0.02874 / 1 hour |

RAM | US$0.00337 / 1 gibibyte hour |

GPU (L4) | US$0.64405 / 1 hour |

某些機器類型可讓您新增用於預測的選用 GPU 加速器。選用 GPU 會產生額外費用,這筆費用不包含在上表所述的費用內。請查看價目表,瞭解各種選用 GPU 的定價。

加速器 - 每小時費用

加速器 - 每小時費用

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Warsaw (europe-central2)

- Finland (europe-north1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Sao Paulo (southamerica-east1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

GPU 類型 | 價格 (美元) |

|---|---|

NVIDIA_TESLA_P4 | US$0.69 / 1 hour |

NVIDIA_TESLA_P100 | US$1.679 / 1 hour |

NVIDIA_TESLA_T4 | US$0.402 / 1 hour |

NVIDIA_TESLA_V100 | US$2.852 / 1 hour |

價格為每個 GPU 的費用。如果每個預測節點使用多個 GPU (或如果版本擴充為使用多個節點),費用也會隨之調整。

AI Platform Prediction 會執行多部虛擬機器 (也就是「節點」),提供模型產生的預測結果。根據預設,Vertex AI 會隨時自動調整執行的節點數。如果是線上預測,系統會依據需求調整節點數。每個節點可回應多項預測要求;如果是批次預測,系統會調整節點數來縮減執行工作所需的總時間。您可以自訂預測節點的調整方式。

系統會根據每個節點針對模型的執行時間計算費用,當中包含:

- 節點處理批次預測工作的時間。

- 節點處理線上預測要求的時間。

- 節點處於就緒狀態,可用於執行線上預測的時間。

每個節點執行一小時的費用為一個「節點時數」。預測工作價目表列出了一個節點時數的價格,依據不同地區以及執行的是線上預測或批次預測,這個價格會有所不同。

節點時數能以小數計費。舉例來說,一個節點執行 30 分鐘的費用為 0.5 個節點時數。

Compute Engine (N1) 機器類型的費用計算

- 節點執行時間的計費以 30 秒為單位累計。也就是說,我們會根據節點每 30 秒內使用的 vCPU、RAM 和 GPU 資源向您的專案收費。

進一步瞭解預測節點的自動調整資源配置

線上預測 | 批次預測 |

|---|---|

資源調度的優先目標為降低個別要求的延遲時間。這項服務可讓您的模型在回應要求後幾分鐘的閒置時間內保持就緒狀態。 | 資源配置調整功能的優先目標為減少工作的總經過時間。 |

資源調度功能會影響每月的總費用,如果您的要求次數和頻率較高,系統就會使用較多節點。 | 資源調度功能對工作成本的影響不大,但增加新的節點有時可能會衍生出額外費用。 |

您可以選擇讓這項服務依據流量調度資源 (自動調整資源配置),或是指定要持續執行的節點數量,以免發生延遲 (手動調整資源配置)。

| 如要控管資源調度方式,您可以設定批次預測工作可使用的節點數量上限,或是在部署模型時設定要持續運作的節點數量。 |

針對批次預測工作,系統會等工作完成後再收取費用

針對批次預測工作,系統會等工作完成後再收取費用,而非在工作期間累計費用。工作執行期間不會觸發您設定的任何 Cloud Billing 預算快訊。在啟動大型工作前,建議您先以少量輸入資料執行費用基準工作。

預測計算示例

位於美洲地區的某家房地產公司每週均會針對服務區域的房價進行預測。他們在某個月執行了四週的批次預測作業,分別使用 3, 920、4, 277、3, 849 和 3, 961 個執行個體。工作僅透過一個節點執行,且每個執行個體的作業處理時間平均為 0.72 秒。

首先,計算每項工作的執行時間長度:

- 計算

由於每項工作均超過 10 分鐘,因此系統會根據處理時間 (分鐘) 計費:

- 計算

由此得出,該月的總費用為 $0.26 美元。

本示例假定工作是在單一節點上執行,且每個輸入執行個體均花費相同的時間。在實際使用時,請務必考慮多個節點的情況,並將每個節點花費的實際執行時間列入計算。

Vertex Explainable AI 費用

Vertex Explainable AI 費用

特徵式說明

特徵式說明不會產生額外的預測費用。不過,說明作業的處理時間比一般預測作業更長,因此如果在密集使用 Vertex Explainable AI 時啟用自動調整資源配置功能,有可能導致系統啟用更多節點,連帶增加預測費用。

示例式說明

示例式說明會產生以下費用:

- 當您上傳模型或更新模型的資料集時,系統會收取以下費用:

- 針對用於以潛在空間表示示例的批次預測工作,系統會按節點時數收取費用。費率與預測工作相同。

- 建構或更新索引的費用。這筆費用與 Vector Search 的索引建立費用相同,計算方式為示例數量 * 維度數量 * 每浮點值 4 位元組 * 每 GB $3.00。舉例來說,如果您有 100 萬個示例和 1,000 個維度潛在空間,則費用為 $12 美元 (1,000,000 * 1,000 * 4 * 3.00 / 1,000,000,000)。

- 當您部署至端點時,系統會針對端點中的每個節點,按節點時數收取費用。所有與該端點相關聯的運算作業都會按預測作業的費率計費。不過,示例式說明需要額外運算資源才能提供 Vector Search 索引,因此系統會啟動更多節點,導致預測作業費用增加。

Vertex AI 類神經架構搜尋

下表統整了各個區域的類神經架構搜尋定價。

價格

價格

下表列出各種不同設定的每小時費用。

您可以選擇預先定義的資源調度層級,或是特定機器類型的自訂設定。如果選擇自訂設定,請加總您使用的所有虛擬機器費用。

支援加速器的舊版機器類型定價已包含加速器的費用。如果您使用 Compute Engine 機器類型,並另外加裝加速器,加速器的費用將另外計算。請在下方加速器表格中找出您使用的各種加速器類型,以該類型的價格乘上您使用的數量,應付費用即為各加速器類型的費用總和。

機器類型

機器類型

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Finland (europe-north1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Montreal (northamerica-northeast1)

- Sao Paulo (southamerica-east1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

機型 | 價格 (美元) |

|---|---|

n1-standard-4 | US$0.2849985 / 1 hour |

n1-standard-8 | US$0.569997 / 1 hour |

n1-standard-16 | US$1.139994 / 1 hour |

n1-standard-32 | US$2.279988 / 1 hour |

n1-standard-64 | US$4.559976 / 1 hour |

n1-standard-96 | US$6.839964 / 1 hour |

n1-highmem-2 | US$0.1774545 / 1 hour |

n1-highmem-4 | US$0.1774545 / 1 hour |

n1-highmem-8 | US$0.709818 / 1 hour |

n1-highmem-16 | US$1.419636 / 1 hour |

n1-highmem-32 | US$2.839272 / 1 hour |

n1-highmem-64 | US$5.678544 / 1 hour |

n1-highmem-96 | US$8.517816 / 1 hour |

n1-highcpu-16 | US$0.8501832 / 1 hour |

n1-highcpu-32 | US$1.7003664 / 1 hour |

n1-highcpu-64 | US$3.4007328 / 1 hour |

n1-highcpu-96 | US$5.1010992 / 1 hour |

a2-highgpu-1g | US$5.641070651 / 1 hour |

a2-highgpu-2g | US$11.282141301 / 1 hour |

a2-highgpu-4g | US$22.564282603 / 1 hour |

a2-highgpu-8g | US$45.128565205 / 1 hour |

a2-highgpu-16g | US$90.257130411 / 1 hour |

e2-standard-4 | US$0.20103426 / 1 hour |

e2-standard-8 | US$0.40206852 / 1 hour |

e2-standard-16 | US$0.80413704 / 1 hour |

e2-standard-32 | US$1.60827408 / 1 hour |

e2-highmem-2 | US$0.13559949 / 1 hour |

e2-highmem-4 | US$0.27119898 / 1 hour |

e2-highmem-8 | US$0.54239796 / 1 hour |

e2-highmem-16 | US$1.08479592 / 1 hour |

e2-highcpu-16 | US$0.59364288 / 1 hour |

e2-highcpu-32 | US$1.18728576 / 1 hour |

n2-standard-4 | US$0.291354 / 1 hour |

n2-standard-8 | US$0.582708 / 1 hour |

n2-standard-16 | US$1.165416 / 1 hour |

n2-standard-32 | US$2.330832 / 1 hour |

n2-standard-48 | US$3.496248 / 1 hour |

n2-standard-64 | US$4.661664 / 1 hour |

n2-standard-80 | US$5.82708 / 1 hour |

n2-highmem-2 | US$0.196521 / 1 hour |

n2-highmem-4 | US$0.393042 / 1 hour |

n2-highmem-8 | US$0.786084 / 1 hour |

n2-highmem-16 | US$1.572168 / 1 hour |

n2-highmem-32 | US$3.144336 / 1 hour |

n2-highmem-48 | US$4.716504 / 1 hour |

n2-highmem-64 | US$6.288672 / 1 hour |

n2-highmem-80 | US$7.86084 / 1 hour |

n2-highcpu-16 | US$0.860352 / 1 hour |

n2-highcpu-32 | US$1.720704 / 1 hour |

n2-highcpu-64 | US$3.441408 / 1 hour |

n2-highcpu-80 | US$4.30176 / 1 hour |

c2-standard-4 | US$0.313212 / 1 hour |

c2-standard-8 | US$0.626424 / 1 hour |

c2-standard-16 | US$1.252848 / 1 hour |

c2-standard-30 | US$2.34909 / 1 hour |

c2-standard-60 | US$4.69818 / 1 hour |

如果您使用美元以外的貨幣付費,系統將按照 Cloud Platform SKU 頁面上列出的相應貨幣價格來計費。

a2-highgpu 執行個體的價格包含加裝的 NVIDIA_TESLA_A100 加速器費用。

加速器

加速器

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Finland (europe-north1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Montreal (northamerica-northeast1)

- Sao Paulo (southamerica-east1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

GPU 類型 | 價格 (美元) |

|---|---|

NVIDIA_TESLA_A100 | US$4.400862 / 1 hour |

NVIDIA_TESLA_P4 | US$0.90 / 1 hour |

NVIDIA_TESLA_P100 | US$2.19 / 1 hour |

NVIDIA_TESLA_T4 | US$0.525 / 1 hour |

NVIDIA_TESLA_V100 | US$3.72 / 1 hour |

如果您使用美元以外的貨幣付費,系統將按照 Cloud Platform SKU 頁面上列出的相應貨幣價格來計費。

磁碟

磁碟

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Finland (europe-north1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Montreal (northamerica-northeast1)

- Sao Paulo (southamerica-east1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

磁碟類型 | 價格 (美元) |

|---|---|

pd-standard | US$0.000082192 / 1 gibibyte hour |

pd-ssd | US$0.000349315 / 1 gibibyte hour |

如果您使用美元以外的貨幣付費,系統將按照 Cloud Platform SKU 頁面上列出的相應貨幣價格來計費。

注意:

- 所有使用情形均須符合類神經架構搜尋配額政策的規定。

- 在類神經架構搜尋的生命週期內,您必須將資料和程式檔案儲存在 Cloud Storage 值區中。詳情請參閱 Cloud Storage 使用說明。

- 如想瞭解以用量為基準的折扣,請聯絡銷售團隊。

- 只有在每個 VM 的磁碟大小設為超過 100 GB 時,系統才會收取磁碟費用。每個 VM 磁碟的前 100 GB (預設磁碟大小) 不收費。舉例來說,如果您將每個 VM 的磁碟大小設為 105 GB,系統會針對每個 VM 向您收取 5 GB 的磁碟費用。

必須使用 Cloud Storage

必須使用 Cloud Storage

除了本文所述的費用外,在類神經架構搜尋的生命週期內,您還必須將資料和程式檔案儲存在 Cloud Storage 值區中。儲存上述項目時,您必須遵守《Cloud Storage 定價政策》的規定。

在下列情況下,您必須使用 Cloud Storage:

- 暫存訓練應用程式套件。

- 儲存訓練輸入資料。

注意:您可以使用其他 Google Cloud 服務來儲存輸入資料,例如擁有獨立價目表的 BigQuery。

- 儲存工作的輸出資料。類神經架構搜尋不會要求您長期儲存這些資料,因此您可以在作業完成後移除這些檔案。

免付費的資源管理作業

免付費的資源管理作業

您可以免付費使用類神經架構搜尋提供的資源管理作業。不過請注意,類神經架構搜尋配額政策對部分作業設有限制。

資源 | 免費作業項目 |

|---|---|

工作 | get、list、cancel |

作業套件 | get、list、cancel、delete |

Vertex AI Pipelines

Vertex AI Pipelines 的執行費用是以每個 pipeline 執行作業 $0.03 美元來計算。預先發布版不會向您收取執行費用。您也必須為 Vertex AI Pipelines 使用的 Google Cloud 資源支付費用,例如管道元件所耗用的 Compute Engine 資源 (費率與 Vertex AI 訓練相同)。最後,您必須為管道呼叫的任何服務 (例如 Dataflow) 支付費用。

Vertex AI 特徵儲存庫

Vertex AI 特徵儲存庫已在 2023 年 11 月正式發布。如要進一步瞭解這項產品的先前版本,請前往 Vertex AI 特徵儲存庫 (舊版) 頁面。

全新 Vertex AI 特徵儲存庫

全新 Vertex AI 特徵儲存庫

新版 Vertex AI 特徵儲存庫支援 2 種作業的功能:

- 離線作業:在離線儲存庫 (BigQuery) 中轉移、儲存、擷取和轉換資料

- 線上作業:將資料轉移至線上儲存庫,以及對線上儲存庫中的資料執行各項作業。

離線作業定價

由於 BigQuery 會用於離線作業,因此請參閱 BigQuery 定價 瞭解可用的功能,例如擷取至離線儲存庫、查詢離線儲存庫,以及離線儲存空間。

線上作業定價

對於線上作業,Vertex AI 特徵儲存庫會針對任何正式發布版功能 (將資料轉移至線上儲存庫、提供資料或儲存資料) 收取費用。「節點時數」代表虛擬機器完成作業所花費的時間 (以分鐘為單位計費)。

- Johannesburg (africa-south1)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Warsaw (europe-central2)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- Turin (europe-west12)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Milan (europe-west8)

- Doha (me-central1)

- Dammam (me-central2)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

作業 | 價格 (美元) |

|---|---|

資料處理節點 資料處理 (例如:擷取至任何線上 store, monitoring, etc.) | US$0.08 / 1 hour |

最佳化線上提供節點 低延遲服務和嵌入服務 每個節點都包含 200 GB 儲存空間 | US$0.30 / 1 hour |

Bigtable 線上提供節點 使用 Cloud Bigtable 提供服務 | US$0.94 / 1 hour |

Bigtable 線上提供儲存空間 使用 Cloud Bigtable 提供服務的儲存空間 | US$0.000342466 / 1 gibibyte hour |

最佳化線上提供和 Bigtable 線上提供採用不同架構,因此兩者的節點無法相比。

如果您使用美元以外的貨幣付費,系統將按照 Cloud Platform SKU 頁面上列出的相應貨幣價格來計費。

估算線上作業工作負載

估算工作負載時請考量下列準則。特定工作負載所需的節點數可能會因提供方法而有所不同。

- 資料處理:

- 擷取:如未使用分析功能,單一節點每小時可擷取至少約 100 MiB 的資料至 Bigtable 線上商店或最佳化線上商店。

- Bigtable 線上提供:每個節點可支援約 15,000 QPS 及最多 5 TB 的儲存空間。

- 最佳化線上供應:效能取決於機器類型和複本,系統會根據工作負載自動設定,盡可能降低費用。每個節點最少可有 2 個副本,最多 6 個副本,以確保高可用性和自動調度。系統會根據備用資源數量向您收費。詳情請參閱每月情境範例。

- 對於非嵌入相關的工作負載,每個節點可支援約 500 QPS 及最多 200 GB 的儲存空間。

- 對於嵌入相關工作負載,每個節點可支援約 500 QPS 和最多 4 GB 的 512 維度資料儲存空間。

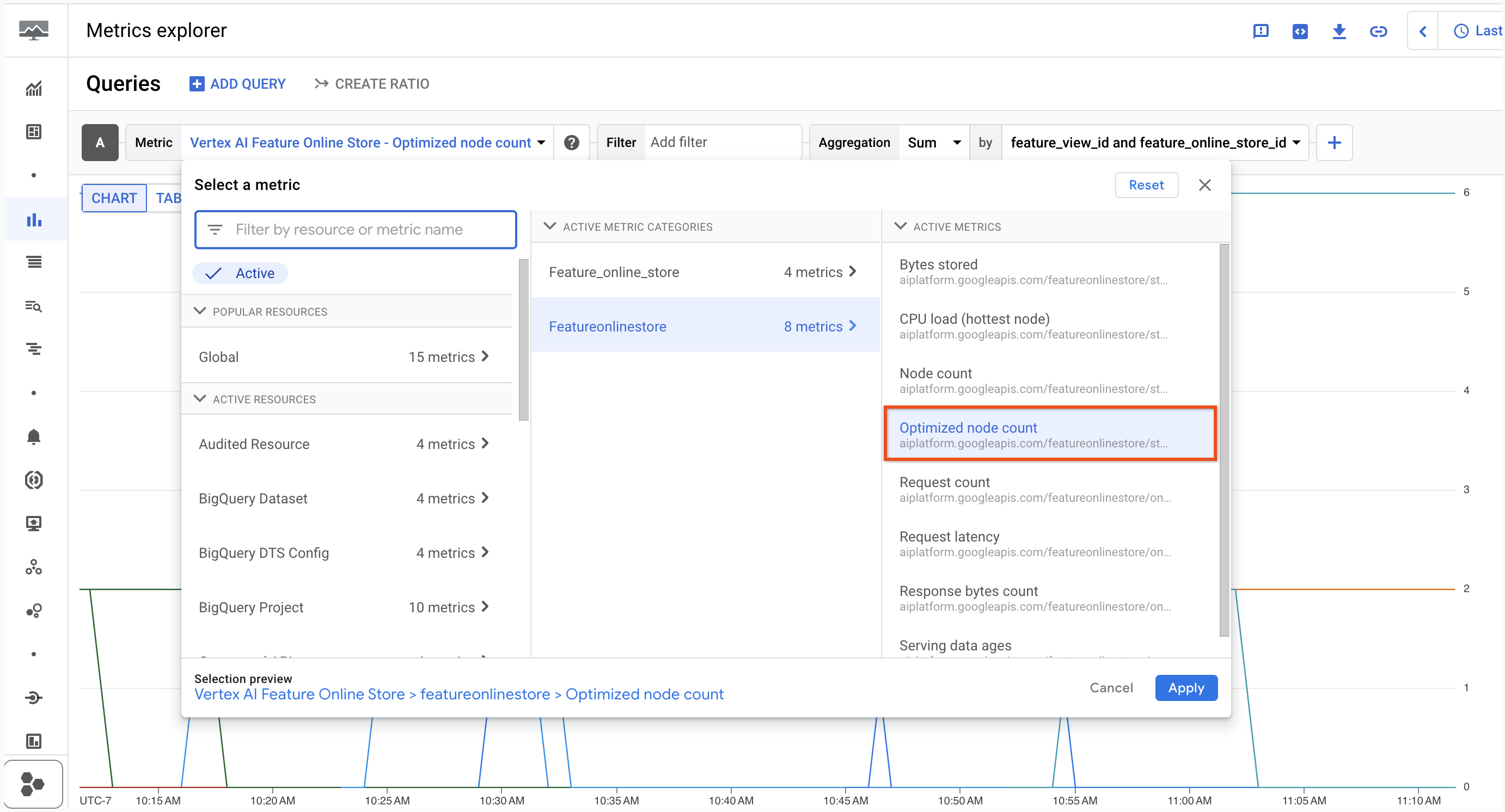

您可以在 Metrics Explorer 中查看節點 (含副本) 數量:

每月情境範例 (假設為 us-central1)

資料串流工作負載:採用 Bigtable 線上提供 (1,200 QPS,2.5 TB 的資料,每天重新整理 1 GB)

作業 | 每月用量 | 每月費用 |

|---|---|---|

資料處理節點 | (1 GB/天) * (30 天/月) * (1,000 MB/GB) * (1 節點時數 / 100 MB) = 300 節點時數 | 300 節點時數 * (每節點時數 $0.08) = $24 |

最佳化線上提供節點 | 不適用 | 不適用 |

Bigtable 線上提供節點 | (1 個節點) * (24 小時/天) * (30 天/月) = 720 節點時數 | 720 節點時數 * (每節點時數 $0.94) = $677 |

Bigtable 線上提供儲存空間 | (2.5 TB-月) * (1000 GB/TB) = 2,500 GB-月 | 2,500 GB-月 * (每 GB-月 $0.25) = $625 |

總計 | $1,326 |

高 QPS 工作負載:最佳化線上提供 (2,000 QPS,10 GB 的非嵌入資料,每天重新整理 5 GB)

作業 | 每月用量 | 每月費用 |

|---|---|---|

資料處理節點 | (5 GB/天) * (30 天/月) * (1,000 MB/GB) * (1 節點時數 / 100 MB) = 1,500 節點時數 | 1,500 節點時數 * (每節點時數 $0.08) = $120 |

最佳化線上提供節點 | Roundup(10GB * (1 node / 200 GB)) = 1 * max(2 default replicas, 2000 QPS * (1 replica / 500 QPS)) = 4 total nodes * (24 hr/day) * (30days/month) =2880 node-hr | 2,880 節點時數 * (每節點時數 $0.30) = $864 |

Bigtable 線上提供節點 | 不適用 | 不適用 |

Bigtable 線上提供儲存空間 | 不適用 | 不適用 |

總計 | $984 |

嵌入向量提供工作負載:最佳化線上提供 (800 QPS,20 GB 的嵌入向量資料,每天重新整理 2 GB)

作業 | 每月用量 | 每月費用 |

|---|---|---|

資料處理節點 | (2 GB/天) * (30 天/月) * (1,000 MB/GB) * (1 節點時數 / 100 MB) = 600 節點時數 | 600 節點時數 * (每節點時數 $0.08) = $48 |

最佳化線上提供節點 | Roundup(20GB* (1 node / 4GB) = 5 * max(2 default replicas, 800 QPS * (1 replica / 500 QPS)) = 10 total nodes * (24 hr/day) * (30days/month) = 7200 node-hr | 7,200 節點時數 * (每節點時數 $0.30) = $2,160 |

Bigtable 線上提供節點 | 不適用 | 不適用 |

Bigtable 線上提供儲存空間 | 不適用 | 不適用 |

總計 | $2,208 |

Vertex AI 特徵儲存庫 (舊版)

Vertex AI 特徵儲存庫 (舊版)

Vertex AI 特徵儲存庫的價格取決於線上和離線儲存空間中的特徵資料量,以及是否可使用線上提供。「每小時節點」代表虛擬機器提供特徵資料的時間,或在就緒狀態下等候處理特徵資料要求的時間。

作業 | 價格 (美元) |

|---|---|

線上儲存天數 | 每 GB 每月 $0.25 美元 |

離線儲存天數 | 每 GB 每月 $0.023 美元 |

線上提供 | 每小時每節點 $0.94 美元 |

批次匯出 | 每 GB $0.005 美元 |

串流擷取 | 每 GB 擷取資料 $0.10 美元 |

如果您使用美元以外的貨幣付費,系統將按照 Cloud Platform SKU 頁面上列出的相應貨幣價格來計費。

如果您啟用特徵值監控功能,帳單會包含前述的適用費用和下列適用費用:

- 每分析 1 GB 資料 $3.50 美元。如果您啟用快照分析,則會包含 Vertex AI 特徵儲存庫 (舊版) 資料的快照。如果啟用匯入特徵分析,則會包含擷取資料批次。

- 啟用特徵值監控功能後,如果您搭配使用其他 Vertex AI 特徵儲存庫 (舊版) 作業,則會產生額外費用,包括:

- 快照分析功能會根據您設定的監控間隔,定期擷取特徵值快照。

- 匯出快照的費用與一般批次匯出作業相同。

快照分析範例

某位數據資料學家為 Vertex AI 特徵儲存庫 (舊版) 啟用了特徵值監控功能,並開啟監控功能來每天分析快照。系統會每天執行一個管道來監控實體類型。該 pipeline 會掃描 Vertex AI 特徵儲存庫 (舊版) 中 2 GB 的資料,並匯出包含 0.1 GB 資料的快照。在這種情況下,一天的分析總費用為:

(0.1 GB * $3.50) + (2 GB * $0.005) = $0.36

擷取分析範例

某位數據資料學家為 Vertex AI 特徵儲存庫 (舊版) 啟用了特徵值監控功能,並開啟監控功能來進行擷取作業。擷取作業將 1 GB 的資料匯入 Vertex AI 特徵儲存庫 (舊版。在這種情況下,特徵值監控的總費用為:

(1 GB * $3.50) = $3.50

Vertex ML Metadata

中繼資料儲存空間的計算單位是二進位 GB (GiB),1 GiB 為 1,073,741,824 位元組。這種計算單位又稱為 gibibyte。

Vertex 機器學習中繼資料會針對中繼資料儲存空間收取每月每 GiB $10 美元的費用。系統會以 MB 按比例計算費用。舉例來說,如果您儲存 10 MB 的中繼資料,則每月必須為該 10 MB 的中繼資料支付 $0.10 美元。

在支援 Vertex 機器學習中繼資料的所有區域中,價格都相同。

Vertex AI TensorBoard

如要使用 Vertex AI TensorBoard,請要求專案的 IAM 管理員為您指派「Vertex AI TensorBoard 網頁應用程式使用者」角色。Vertex AI 管理員角色也具有存取權。

自 2023 年 8 月起,Vertex AI TensorBoard 的定價已從每位使用者每月 $300 美元的授權費,變成每月每 GiB $10 美元的記錄與指標資料儲存空間費用。這表示您不必再支付訂閱費用,只需為使用的儲存空間付費。想瞭解如何管理儲存空間,請查看 Vertex AI TensorBoard:刪除過舊 TensorBoard 實驗教學課程。

Vertex AI Vizier

Vertex AI Vizier 是 Vertex AI 內的黑盒最佳化服務。Vertex AI Vizier 計費模式如下:

- 使用 RANDOM_SEARCH 和 GRID_SEARCH 的試驗不收費。進一步瞭解搜尋演算法。

- 當月前 100 次 Vertex AI Vizier 試驗不收費 (使用 RANDOM_SEARCH 和 GRID_SEARCH 的試驗不會計入這個總數)。

- 經過 100 次 Vertex AI Vizier 試驗後,相同月份的每次後續試驗皆會產生 $1 美元的費用 (使用 RANDOM_SEARCH 或 GRID_SEARCH 的試驗不收費)。

Vector Search

Vector Search 約略最鄰近服務的價格包含:

- 針對用於託管已部署索引的 VM,根據其數量計算的每節點時數費用。

- 建構新索引、更新現有索引,以及使用串流索引更新的費用。

建構與更新索引的資料處理量計算單位是二進位 GB (GiB),而 1 GiB 為 1,073,741,824 個位元組。這種計算單位又稱為 gibibyte。

Vector Search 會針對所有區域的資料處理量,收取每 GiB $3.00 美元的費用。針對串流更新插入項目,Vector Search 會根據擷取的 GiB 數,收取每 GiB $0.45 美元的費用。

下表統整了每個 Vector Search 可用區域的索引提供價格。表中的價格是按機器類型和區域劃分,並依節點時數計費。

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Melbourne (australia-southeast2)

- Warsaw (europe-central2)

- Finland (europe-north1)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Milan (europe-west8)

- Paris (europe-west9)

- Doha (me-central1)

- Dammam (me-central2)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Toronto (northamerica-northeast2)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Dallas (us-south1)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

機型 | 價格 (美元) |

|---|---|

e2-standard-2 | US$0.0938084 / 1 hour |

e2-standard-16 | US$0.7504672 / 1 hour |

e2-highmem-16 | US$1.012368 / 1 hour |

n2d-standard-32 | US$1.8926208 / 1 hour |

n1-standard-16 | US$1.0639944 / 1 hour |

n1-standard-32 | US$2.1279888 / 1 hour |

Vector Search 價格範例

Vector Search 價格範例

Vector Search 的價格取決於資料大小、您想執行的每秒查詢次數 (QPS),以及您使用的節點數量。如要估算提供費用,您必須計算資料總大小。資料大小的計算方式為您的嵌入/向量數量* 維度數量* 每維度 4 個位元組。算出資料大小後,您就可以計算提供費用和建構費用。提供費用加上建構費用即為您的每月總費用。

- 提供費用:備用資源數量/資料分割數量 * 資料分割數量 (約為資料大小/資料分割大小) * 每小時費用 * 730 小時

- 建構費用:資料大小(以 GiB 為單位) * 每 GiB $3 美元 * 每月更新次數

串流更新:Vector Search 會使用啟發式指標,判斷何時觸發壓縮作業。如果最舊的未壓縮資料已留存五天,系統一律會觸發壓縮作業。除了串流更新費用外,您還需支付索引重建費用,費率與批次更新相同。

嵌入/向量數量 | 維度數量 | 每秒查詢次數 (QPS) | 機器類型 | 節點 | 預估每月提供費用 (美元) |

|---|---|---|---|---|---|

200 萬 | 128 | 100 | e2-standard-2 | 1 | $68 |

2,000 萬 | 256 | 1,000 | e2-standard-16 | 1 | $547 |

2,000 萬 | 256 | 3,000 | e2-standard-16 | 3 | $1,642 |

1 億 | 256 | 500 | e2-highmem-16 | 2 | $1,477 |

10 億 | 100 | 500 | e2-highmem-16 | 8 | $5,910 |

所有範例均是以 us-central1 中的機器類型為準。您產生的費用會因喚回率和延遲時間要求而有所差異。預估的每月提供費用與控制台中使用的節點數量直接相關。如要進一步瞭解會影響費用的設定參數,請參閱「影響喚回度和延遲時間的設定參數」。

如果您的每秒查詢次數 (QPS) 較高,批次執行這些查詢可減少最多 30% 到 40% 的總費用。

儲存空間最佳化 Vector Search 服務等級

儲存空間最佳化 Vector Search 服務等級

您不必管理個別 VM 和支付相關費用,也不必另外執行壓縮工作,只要選擇以下兩種 SKU 即可:

- 容量單位 (CU):這是服務的主要計量單位。CU 是運算和有效 SSD 儲存空間的組合單位,每項最多 1 TiB,每個 CU 的價格為每小時每副本 $2.30 美元。這項單一費率包含提供服務和持續管理索引的費用。隨著索引大小增加,服務會自動擴充資源,並新增額外的運算單元。

- 寫入單位:新增資料時,每 GiB 需支付 $0.45 美元。這項費用適用於批次和串流索引更新。

單位 | 價格 |

|---|---|

儲存空間最佳化容量單位 | US$2.30 / 1 hour |

寫入單位 | US$0.45 / 1 gibibyte |

Vertex AI Model Registry

Vertex AI Model Registry 是中央存放區,可追蹤及列出您的模型和模型版本。模型匯入 Vertex AI 後,就會顯示在 Vertex AI Model Registry 中。讓模型列在 Model Registry 中不會產生費用。只有在將模型部署至端點,或是針對模型執行批次預測時,您才須支付相關費用。實際費用取決於您部署的模型類型。

如要進一步瞭解透過 Vertex AI Model Registry 部署自訂模型的費用,請參閱「自訂訓練模型」。如要進一步瞭解部署 AutoML 模型的費用,請參閱「AutoML 模型的定價」。

Vertex AI Model Monitoring

Vertex AI 可讓您在將模型部署至正式環境後,持續監控模型的成效。詳情請參閱 Vertex AI Model Monitoring 簡介。

使用 Vertex AI Model Monitoring 時,您必須支付下列項目的費用:

- 每分析 1 GB 資料 $3.50 美元,包括提供的訓練資料和 BigQuery 資料表中記錄的預測資料。

- 搭配 Model Monitoring 使用的其他 Google Cloud 產品也會產生費用,例如在啟用歸因監控功能的情況下使用 BigQuery 儲存空間或批次說明。

下列區域支援 Vertex AI Model Monitoring:us-central1、europe-west4、asia-east1 和 asia-southeast1。所有區域的價格均相同。

資料轉換成 TfRecord 格式後,系統就會開始評估資料大小。

設定 Vertex AI Model Monitoring 工作時,訓練資料集會產生一次性費用。

預測資料集包含線上預測服務收集的記錄。在不同期間收到預測要求時,系統會收集各個期間的資料,並根據各個預測期所分析的資料量總和計算費用。

範例:某位數據資料學家針對其模型的預測流量執行模型監控。

- 模型是透過 BigQuery 資料集來訓練。轉換為 TfRecord 後的資料大小為 1.5 GB。

- 下午 1:00 至 2:00 之間記錄的預測資料量為 0.1 GB,下午 3:00 至 4:00 之間為 0.2 GB。

- 設定模型監控工作的總費用為:

- (1.5 GB * $3.50) + ((0.1 GB + 0.2 GB) * $3.50) = $6.30

Vertex AI Workbench

如要取得定價資訊,請選取執行個體、代管的筆記本或使用者自行管理的筆記本。

執行個體

執行個體

下表列出了各種 VM 設定約略的每小時費用。您可以選擇所選機器類型的自訂設定。如要計算價格,請加總您使用的虛擬機器費用。

如果您使用 Compute Engine 機器類型,並另外加裝加速器,加速器的費用將另外計算。請在下方加速器表格中找出您使用的各種加速器類型,以該類型的價格乘上機器時數,應付費用即為各加速器類型的費用總和。

CPU

CPU

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Warsaw (europe-central2)

- Belgium (europe-west1)

- Turin (europe-west12)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Doha (me-central1)

- Dammam (me-central2)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Toronto (northamerica-northeast2)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

機型 | 每 vCPU 價格 (美元) |

|---|---|

N1 | US$0.0379332 / 1 hour |

N2 | US$0.0379332 / 1 hour |

E2 | US$0.026173908 / 1 hour |

A2 | US$0.0379332 / 1 hour |

記憶體

記憶體

- Johannesburg (africa-south1)

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Warsaw (europe-central2)

- Finland (europe-north1)

- Madrid (europe-southwest1)

- Belgium (europe-west1)

- Turin (europe-west12)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Milan (europe-west8)

- Doha (me-central1)

- Dammam (me-central2)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Sao Paulo (southamerica-east1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Las Vegas (us-west4)

機型 | 價格 (美元) |

|---|---|

N1 | US$0.0050844 / 1 gibibyte hour |

N2 | US$0.0050844 / 1 gibibyte hour |

E2 | US$0.003508236 / 1 gibibyte hour |

A2 | US$0.0050844 / 1 gibibyte hour |

加速器

加速器

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Osaka (asia-northeast2)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Finland (europe-north1)

- Belgium (europe-west1)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Sao Paulo (southamerica-east1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

機型 | 價格 (美元) |

|---|---|

Nvidia Tesla A100 | US$4.400862 / 1 hour |

Nvidia Tesla A100 80GB | US$4.51729 / 1 hour |

Nvidia Tesla T4 | US$0.525 / 1 hour |

Nvidia Tesla V100 | US$3.72 / 1 hour |

Nvidia Tesla P100 | US$2.19 / 1 hour |

磁碟

磁碟

- Taiwan (asia-east1)

- Hong Kong (asia-east2)

- Tokyo (asia-northeast1)

- Seoul (asia-northeast3)

- Mumbai (asia-south1)

- Singapore (asia-southeast1)

- Jakarta (asia-southeast2)

- Sydney (australia-southeast1)

- Warsaw (europe-central2)

- Belgium (europe-west1)

- Turin (europe-west12)

- London (europe-west2)

- Frankfurt (europe-west3)

- Netherlands (europe-west4)

- Zurich (europe-west6)

- Doha (me-central1)

- Dammam (me-central2)

- Tel Aviv (me-west1)

- Montreal (northamerica-northeast1)

- Toronto (northamerica-northeast2)

- Sao Paulo (southamerica-east1)

- Santiago (southamerica-west1)

- Iowa (us-central1)

- South Carolina (us-east1)

- Northern Virginia (us-east4)

- Columbus (us-east5)

- Dallas (us-south1)

- Oregon (us-west1)

- Los Angeles (us-west2)

- Salt Lake City (us-west3)

- Las Vegas (us-west4)

機型 | 價格 (美元) |

|---|---|

Hyperdisk Extreme 佈建空間 | US$0.000205479 / 1 gibibyte hour |

已佈建的平衡儲存空間 | US$0.000164384 / 1 gibibyte hour |

已佈建的極端儲存空間 | US$0.000205479 / 1 gibibyte hour |

已佈建的 SSD 儲存空間 | US$0.000279452 / 1 gibibyte hour |

已佈建的標準儲存空間 | US$0.000065753 / 1 gibibyte hour |

Vertex AI Workbench 執行個體的費用如下:

- 如要瞭解 CPU 和加速器用量,請注意,執行個體處於下列狀態時,系統會向您收費:

- 啟動中

- 佈建中

- ACTIVE

- 正在升級

- 復原中

- 還原中

- 停止中

- 暫停

- 執行個體處於下列狀態時,系統會向您收取磁碟儲存空間費用:

- 啟動中

- 佈建中

- ACTIVE

- 正在升級

- 復原中

- 還原中

- 停止中

- 已停止

- 暫停

- 已停止

代管的筆記本

代管的筆記本

價格包含您使用的運算和儲存空間資源費用、Vertex AI Workbench 執行個體的管理費,以及您使用的其他雲端資源費用。詳情請參閱以下各節。

運算和儲存空間資源

運算和儲存空間資源

運算和儲存空間資源的費率與您目前的 Compute Engine 和 Cloud Storage 費率相同。

管理費

管理費

除了基礎架構使用費,您還必須支付 Vertex AI Workbench 管理費,詳情請見下表。

SKU | 價格 (美元) |

|---|---|

vCPU | 每個 vCPU $0.05 |

T4 和 P4 (標準 GPU) | 每個 GPU $0.35 美元 |

P100、V100、L4 和 A100 GPU (高階 GPU) | 每個 GPU $2.48 美元 |

使用者自行管理的筆記本

使用者自行管理的筆記本

價格包含您使用的運算和儲存空間資源費用、Vertex AI Workbench 執行個體的管理費,以及您使用的其他雲端資源費用。詳情請參閱以下各節。

運算和儲存空間資源

運算和儲存空間資源

運算和儲存空間資源的費率與您目前的 Compute Engine 和 Cloud Storage 費率相同。

管理費

管理費

除了基礎架構使用費,您還必須支付 Vertex AI Workbench 管理費,詳情請見下表。

SKU | 價格 (美元) |

|---|---|

vCPU | 每個 vCPU $0.005 |

T4 和 P4 (標準 GPU) | 每個 GPU $0.035 |

P100、V100 和 A100 GPU (高階 GPU) | 每個 GPU $0.25 |

其他 Google Cloud 資源

其他 Google Cloud 資源

除了前述的費用以外,您還必須為自己使用的 Google Cloud 資源支付費用。例如:

- 資料分析服務:在筆記本中發出 SQL 查詢時會產生 BigQuery 費用。詳情請參閱 BigQuery 定價。

- 客戶自行管理的加密金鑰:使用客戶自行管理的加密金鑰會產生費用。每當代管的筆記本或使用者自行管理的筆記本執行個體使用 Cloud Key Management Service 金鑰時,系統都會依據 Cloud KMS 金鑰作業費率對該項作業收費。詳情請參閱 Cloud Key Management Service 定價。

Colab Enterprise

如要瞭解 Colab Enterprise 的定價資訊,請參閱 Colab Enterprise 定價。

深度學習容器、深度學習 VM 和 AI 平台管道

針對深度學習容器、深度學習 VM 映像檔和 AI Platform Pipelines,系統會根據您使用的運算與儲存空間資源計費。這些資源的費率與您目前的 Compute Engine 和 Cloud Storage 費率相同。

除了運算和儲存空間費用,您還必須為自己使用的 Google Cloud 資源支付費用。例如:

- 資料分析服務:在筆記本中發出 SQL 查詢時會產生 BigQuery 費用。詳情請參閱 BigQuery 定價。

- 客戶自行管理的加密金鑰:使用客戶自行管理的加密金鑰會產生費用。每當代管的筆記本或使用者自行管理的筆記本執行個體使用 Cloud Key Management Service 金鑰時,系統都會依據 Cloud KMS 金鑰作業費率對該項作業收費。詳情請參閱 Cloud Key Management Service 定價。

資料標籤

Vertex AI 可讓您為打算用於訓練自訂機器學習模型的資料集合,申請人工標籤服務。服務價格是根據標籤工作的類型計算。

- 如果是一般標籤工作,則價格取決於註解單位數量。

- 如果是圖片分類工作,則單位取決於圖片數量和標籤人員數量。舉例來說,假設有一張圖片,標籤人員數量為 3,則會計為 1 * 3 = 3 個單位。單一標籤和多標籤分類的價格相同。

- 如果是圖片定界框工作,則單位取決於在圖片中識別的定界框數量和標籤人員數量。舉例來說,假設某張圖片有 2 個定界框,標籤人員數為 3,則會計為 2 * 3 = 6 個單位。使用不含定界框的圖片不須付費。

- 如果是影像分割/旋轉框/折線/多邊形工作,則單位的計算方式與圖片定界框工作相同。

- 如果是影片分類工作,則單位取決於影片長度 (每 5 秒為一個價格單位) 和標籤人員數量。舉例來說,假設影片的長度為 25 秒,標籤人員數量為 3,則會計為 25 / 5 * 3 = 15 個單位。單一標籤和多標籤分類的價格相同。

- 如果是影片物件追蹤工作,則單位取決於在影片中識別的物件數量和標籤人員數量。舉例來說,假設影片中有 2 個物件,標籤人員數量為 3,則會計為 2 * 3 = 6 個單位。不含物件的影片不會產生費用。

- 如果是影片動作識別工作,則單位的計算方式與影片物件追蹤工作相同。

- 如果是文字分類工作,則單位取決於文字長度 (每 50 個字詞為一個價格單位) 和標籤人員數量。舉例來說,假設一段文字有 100 個字詞,標籤人員數量為 3,則會計為 100 / 50 * 3 = 6 個單位。單一標籤和多標籤分類的價格相同。

- 如果是文字情緒工作,則單位的計算方式與文字分類工作相同。

- 如果是文字實體擷取工作,則單位取決於文字長度 (每 50 個字詞為一個價格單位)、識別的實體數量,以及標籤人員數量。舉例來說,假設一段文字有 100 個字詞和 2 個實體,標籤人員數量為 3,則會計為 100 / 50 * 2 * 3 = 12 個單位。不含實體的文字不會產生費用。