Unidades de Processamento de Tensor (TPUs)

Desenvolvido para IA de última geração

Crie, otimize e escalone cargas de trabalho de treinamento, inferência e aprendizado por reforço para capacitar agentes de raciocínio autônomo

Visão geral

Uma década de unidades de processamento de tensor (TPUs)

As TPUs são aceleradores personalizados criados especificamente para cargas de trabalho de IA, como agentes, geração de código, modelos de linguagem grandes, geração de conteúdo de mídia, fala sintética, serviços de visão, mecanismos de recomendação e modelos de personalização, entre outros. As TPUs alimentam o Gemini e todos os aplicativos do Google com tecnologia de IA, como Pesquisa, Fotos e Maps, que atendem mais de 1 bilhão de usuários.

Criado especificamente para IA agêntica

A mudança para a IA agêntica exige uma infraestrutura capaz de raciocínio em várias etapas e aprendizado por reforço contínuo. As TPUs rompem a "barreira de memória" da inferência ao hospedar caches KV massivos totalmente no silício, utilizando SRAM no chip expandida com a TPU 8i. Combinada com nosso mecanismo SparseCore para descarregar tarefas de comunicação, essa arquitetura reduz o tempo ocioso do núcleo. O resultado é um desempenho previsível e de baixa latência que alimenta loops de raciocínio complexos.

Desempenho sem concessões

Acelere o tempo de implantação reduzindo os cronogramas de treinamento para modelos de ponta. As Cloud TPUs maximizam o goodput, garantindo que quase todos os ciclos de computação sejam gastos no aprendizado ativo. Tudo isso é possível por meio da Inter-Chip Interconnect de alta velocidade, Optical Circuit Switching e rede Virgo, permitindo que os aceleradores operem como um sistema unificado e de alta confiabilidade.

Economia sustentável em escala

As TPUs são projetadas para melhorar o valor e o consumo de energia, concentrando-se nas demandas computacionais da IA e eliminando a sobrecarga operacional encontrada em arquiteturas multifuncionais. O gerenciamento de energia integrado se ajusta dinamicamente ao volume de solicitações em tempo real, oferecendo alto desempenho por watt e dando suporte a cargas de trabalho complexas de IA de forma sustentável.

Operações abertas, flexíveis e confiáveis

Crie em um ecossistema aberto usando bibliotecas e ferramentas conhecidas. As Cloud TPUs oferecem suporte nativo e de alto desempenho para PyTorch e JAX, além de oferecer suporte ao mecanismo vLLM para inferência rápida. Gerencie e escale essas implantações de forma confiável em clusters globais com o Google Kubernetes Engine (GKE).

Versões da Cloud TPU

| Versão da Cloud TPU | Descrição | Disponibilidade |

|---|---|---|

TPU 8i | A TPU 8i é otimizada para pós-treinamento e inferência, além de oferecer uma melhoria de 80% no desempenho por dólar em relação às gerações anteriores para inferência de baixa latência para grandes modelos MoE. | Em breve |

TPU 8t | A TPU 8t foi criada para pré-treinamento em grande escala e cargas de trabalho com muitos embeddings em uma escala de 9.600 chips em um único superpod, oferecendo uma melhoria de 2,7 vezes no desempenho por dólar em relação ao Ironwood para treinamento em grande escala. | Em breve |

Ironwood | TPU de 7ª geração com eficiência energética projetada para treinamento, raciocínio e inferência em grande escala. Possui 9.216 chips resfriados a líquido por pod, oferece 42,5 ExaFlops e desempenho 4 vezes melhor por chip em comparação com o Trillium. | O Ironwood está em disponibilidade geral na América do Norte (Central) e na Europa (região oeste) |

Trillium | TPU de sexta geração com melhor eficiência energética e desempenho máximo de computação para treinamento e inferência. Opera com 67% mais eficiência energética e oferece um desempenho de computação de pico 4,7 vezes maior por chip em comparação com a TPU v5e da geração anterior. | O Trillium está disponível em geral na América do Norte (região leste dos EUA), na Europa (região oeste) e na Ásia (região nordeste). |

Outras informações sobre as versões da Cloud TPU

TPU 8i

A TPU 8i é otimizada para pós-treinamento e inferência, além de oferecer uma melhoria de 80% no desempenho por dólar em relação às gerações anteriores para inferência de baixa latência para grandes modelos MoE.

Em breve

TPU 8t

A TPU 8t foi criada para pré-treinamento em grande escala e cargas de trabalho com muitos embeddings em uma escala de 9.600 chips em um único superpod, oferecendo uma melhoria de 2,7 vezes no desempenho por dólar em relação ao Ironwood para treinamento em grande escala.

Em breve

Ironwood

TPU de 7ª geração com eficiência energética projetada para treinamento, raciocínio e inferência em grande escala. Possui 9.216 chips resfriados a líquido por pod, oferece 42,5 ExaFlops e desempenho 4 vezes melhor por chip em comparação com o Trillium.

O Ironwood está em disponibilidade geral na América do Norte (Central) e na Europa (região oeste)

Trillium

TPU de sexta geração com melhor eficiência energética e desempenho máximo de computação para treinamento e inferência. Opera com 67% mais eficiência energética e oferece um desempenho de computação de pico 4,7 vezes maior por chip em comparação com a TPU v5e da geração anterior.

O Trillium está disponível em geral na América do Norte (região leste dos EUA), na Europa (região oeste) e na Ásia (região nordeste).

Outras informações sobre as versões da Cloud TPU

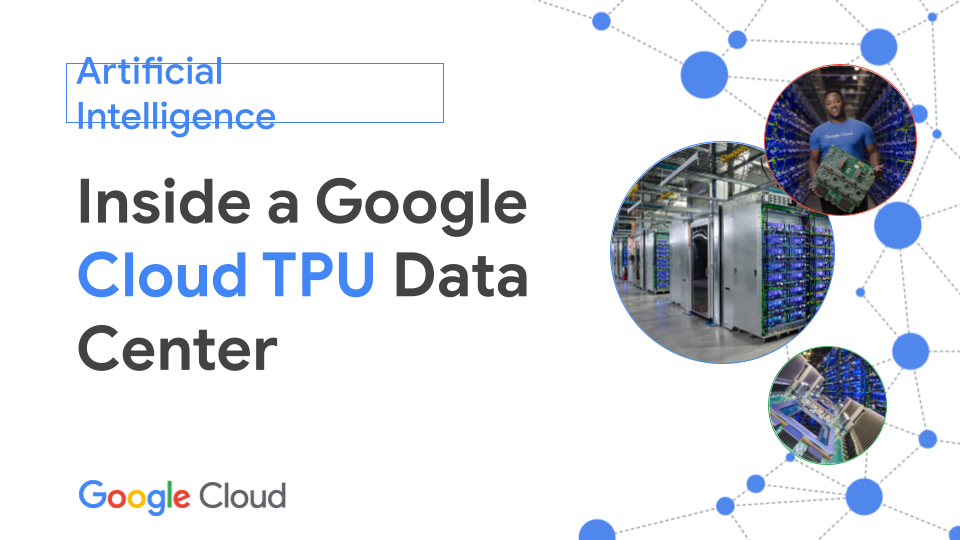

Como funciona

Tenha uma visão detalhada da magia das TPUs do Google Cloud, incluindo uma visão rara dos data centers. Os clientes usam Cloud TPUs para executar algumas das maiores cargas de trabalho de IA do mundo, e essa capacidade vem de muito mais do que apenas um chip. Neste vídeo, confira os componentes do sistema de TPU, incluindo rede de data center, interruptores de circuito óptico, sistemas de resfriamento com água, verificação biométrica de segurança e muito mais.

Tenha uma visão detalhada da magia das TPUs do Google Cloud, incluindo uma visão rara dos data centers. Os clientes usam Cloud TPUs para executar algumas das maiores cargas de trabalho de IA do mundo, e essa capacidade vem de muito mais do que apenas um chip. Neste vídeo, confira os componentes do sistema de TPU, incluindo rede de data center, interruptores de circuito óptico, sistemas de resfriamento com água, verificação biométrica de segurança e muito mais.

Execute cargas de trabalho pré-treinamento de IA em grande escala

Acelere o tempo de lançamento de modelos de fronteira

Reduza os cronogramas de pré-treinamento para modelos de fundação massivos. A TPU 8t oferece capacidade de computação de alto desempenho em um único pod e é escalonada pela rede Virgo. Com acesso rápido ao armazenamento e isolamento NUMA com tecnologia Axion, a arquitetura alcança um bom rendimento, garantindo que os ciclos de computação sejam gastos na criação ativa de modelos em vez de ficarem ociosos durante a transferência de dados ou redefinições de hardware.

Outros recursos

Acelere o tempo de lançamento de modelos de fronteira

Reduza os cronogramas de pré-treinamento para modelos de fundação massivos. A TPU 8t oferece capacidade de computação de alto desempenho em um único pod e é escalonada pela rede Virgo. Com acesso rápido ao armazenamento e isolamento NUMA com tecnologia Axion, a arquitetura alcança um bom rendimento, garantindo que os ciclos de computação sejam gastos na criação ativa de modelos em vez de ficarem ociosos durante a transferência de dados ou redefinições de hardware.

Aprendizado por reforço e pós-treinamento eficiente

Escale cargas de trabalho de aprendizado por reforço com eficiência

Crie modelos de base em agentes inteligentes com fluxos de trabalho intensivos de pós-treinamento. A oitava geração do sistema de TPU processa rapidamente testes contínuos de aprendizado por reforço, recompensando os melhores caminhos de raciocínio sem os atrasos de ciclo comuns nas gerações anteriores. Isso permite ajustar os modelos mundiais de forma eficiente, permitindo que os agentes refinem o raciocínio em ambientes simulados antes de executar no mundo real.

Outros recursos

Escale cargas de trabalho de aprendizado por reforço com eficiência

Crie modelos de base em agentes inteligentes com fluxos de trabalho intensivos de pós-treinamento. A oitava geração do sistema de TPU processa rapidamente testes contínuos de aprendizado por reforço, recompensando os melhores caminhos de raciocínio sem os atrasos de ciclo comuns nas gerações anteriores. Isso permite ajustar os modelos mundiais de forma eficiente, permitindo que os agentes refinem o raciocínio em ambientes simulados antes de executar no mundo real.

Cargas de trabalho de inferência de IA de baixa latência em escala

Inferência de alto desempenho e econômica

Quebre a barreira da memória de inferência. A TPU 8i expande a SRAM no chip e a memória de alta largura de banda, hospedando caches KV de alta capacidade totalmente no silício. Ao usar o SparseCore-Collectives Acceleration Engine (SC-CAE) para descarregar tarefas de comunicação global, essa arquitetura reduz significativamente a latência no chip, liberando os principais núcleos de computação para a geração de tokens pura e de baixa latência.

Outros recursos

Inferência de alto desempenho e econômica

Quebre a barreira da memória de inferência. A TPU 8i expande a SRAM no chip e a memória de alta largura de banda, hospedando caches KV de alta capacidade totalmente no silício. Ao usar o SparseCore-Collectives Acceleration Engine (SC-CAE) para descarregar tarefas de comunicação global, essa arquitetura reduz significativamente a latência no chip, liberando os principais núcleos de computação para a geração de tokens pura e de baixa latência.

Caso de negócios

Agentes de raciocínio autônomo

As TPUs fornecem a largura de banda de memória e a inferência de baixa latência necessárias para executar loops de raciocínio de repetição contínuos e de raciocínio em várias etapas para assistentes de programação em tempo real, atendimento ao cliente autônomo e operações de segurança.

Modelos de fundação e IA generativa multimodal

As TPUs oferecem computação contínua de alta capacidade de processamento, criando e disponibilizando com eficiência modelos de fundação massivos em modalidades de texto, imagem, áudio e vídeo.

Ciência e saúde de precisão

As TPUs gerenciam cálculos complexos e pesados para acelerar simulações computacionalmente intensivas para biologia estrutural, sequenciamento genômico e descoberta de medicamentos.

IA física

Crie agentes físicos que interagem e se adaptam ao mundo real. Simule e treine robôs, agentes autônomos e máquinas industriais com mais rapidez e eficiência usando dados sintéticos e do mundo real.