Google Kubernetes Engine (GKE)

Kubernetes, a evolução: a base para criadores de plataformas

Com a ativação do Autopilot nos contêineres, você executa as cargas de trabalho da sua empresa em escala de forma segura, mesmo com pouca ou nenhuma experiência operacional em Kubernetes.

Receba um cluster zonal ou do Autopilot sem custos financeiros por mês. Além disso, novos clientes recebem US$ 300 em créditos para testar o GKE.

Recursos

Gerenciamento de cluster simplificado e eficiência de recursos aprimorada

O GKE Autopilot é um modo de operação em que o Google gerencia sua infraestrutura de nós, escalonamento, segurança e recursos pré-configurados. Com o dimensionamento automático da capacidade e o preço por pod, você evita o superprovisionamento, o pagamento excessivo e a subutilização. Com a plataforma de computação otimizada para contêineres do Autopilot, você tem computação escalonável vertical e horizontalmente quase em tempo real, que fornece a capacidade necessária, quando necessário, com o melhor preço e desempenho.

Escala, velocidade e segurança sem precedentes para a era agêntica

O GKE Agent Sandbox oferece a infraestrutura mais escalonável e de baixa latência do setor para IA baseada em agentes. Criado com isolamento de kernel gVisor, a mesma tecnologia que protege o Gemini, ele permite executar com segurança códigos e chamadas de ferramentas não confiáveis sem sacrificar o desempenho. Ative até 300 sandboxes isoladas por segundo e implante com confiança uma infraestrutura de agentes segura que acompanha o ritmo da sua empresa.

Plataforma pronta para produção para IA generativa

Com suporte para clusters de até 65 mil nós, integração com o Hipercomputador de IA e suporte a GPU e TPU, o GKE facilita a execução de ML, HPC e outras cargas de trabalho que se beneficiam de aceleradores de hardware especializados.

Os recursos de inferência do GKE com técnicas de escalonamento e balanceamento de carga compatíveis com IA generativa ajudam a reduzir os custos de veiculação em mais de 30%, a latência de cauda em 60% e a aumentar a capacidade de processamento em até 40% em comparação com outras ofertas gerenciadas e de código aberto do Kubernetes.

Segurança incorporada ao design

O GKE é executado em uma base segurança incorporada ao design, agora aprimorada com segurança essencial sempre ativada habilitada por padrão. Tenha visibilidade instantânea de erros de configuração, riscos e verificações sem agente de vulnerabilidades críticas diretamente no painel de segurança do GKE. Proteja os dados em uso com criptografia baseada em hardware nos Confidential GKE Nodes e isole as cargas de trabalho com o GKE Sandbox. Use a verificação de IaC integrada para detectar proativamente configurações incorretas nos seus planos do Terraform antes que eles cheguem à produção.

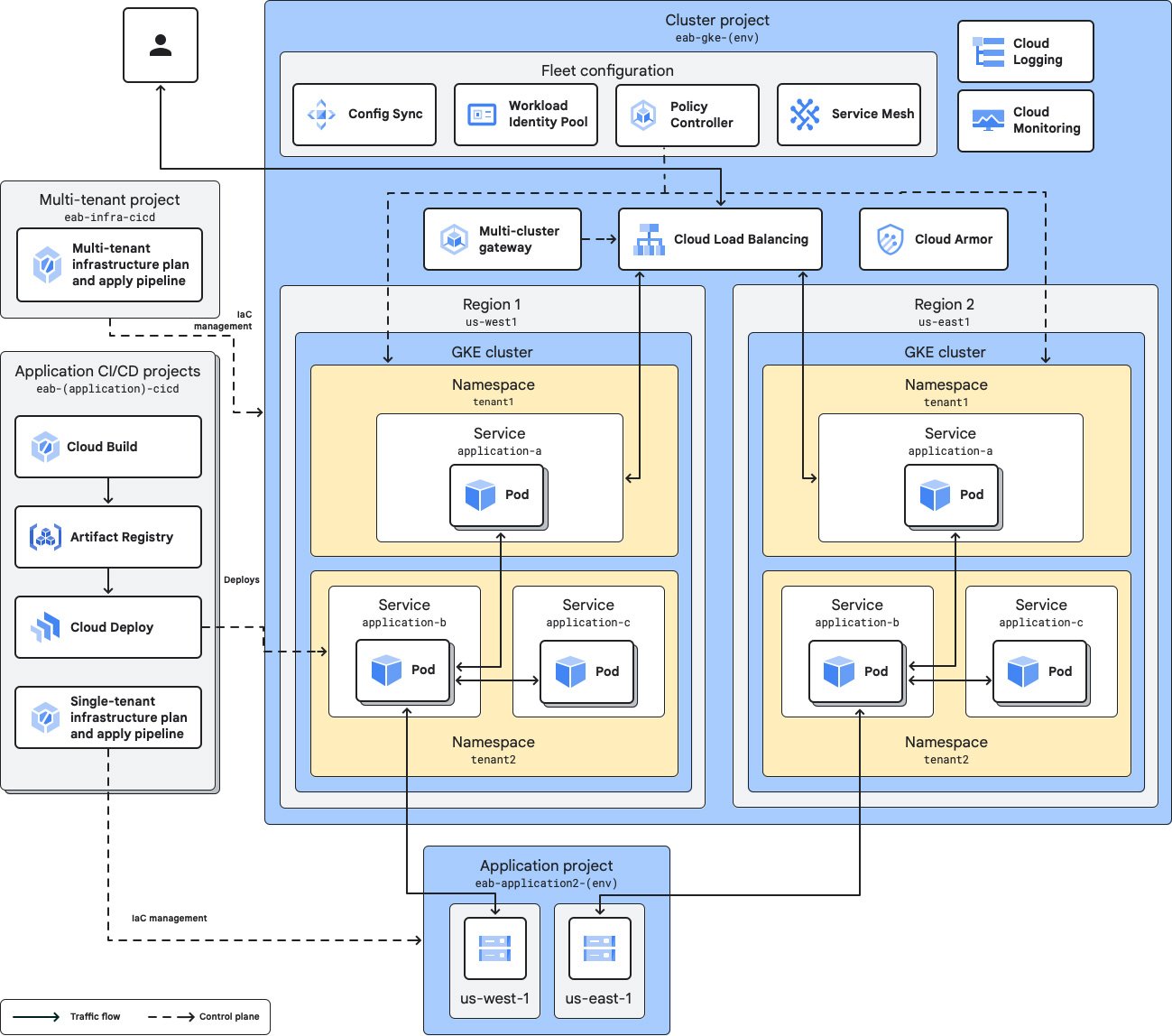

Gerenciamento de várias equipes e vários clusters

As frotas e as equipes podem ser usadas para organizar clusters e cargas de trabalho e atribuir recursos a várias equipes com facilidade para melhorar a velocidade e delegar propriedade. Usando os escopos, é possível definir subconjuntos de recursos da frota por equipe, com cada escopo associado a um ou mais clusters de membros da frota.

É possível escolher vários clusters para separar serviços entre ambientes, níveis, localidades, equipes ou provedores de infraestrutura. As frotas se esforçam para facilitar ao máximo o gerenciamento de vários clusters.

Portabilidade de cargas de trabalho com suporte multicloud

O GKE executa o Kubernetes certificado e adota padrões abertos para permitir que os clientes executem os aplicativos sem modificações nos investimentos de hardware no local ou na nuvem pública.

Com os clusters anexados do GKE, é possível registrar ou anexar qualquer cluster do Kubernetes em conformidade que você tenha criado no ambiente de gerenciamento do GKE. Anexar um cluster oferece gerenciamento e controle do GKE, bem como acesso a recursos adicionais como Config Sync, Cloud Service Mesh e Frotas.

Como funciona

Em cada cluster do GKE, o GKE gerencia o ciclo de vida do plano de controle do Kubernetes, desde a criação até a exclusão do cluster. Com o Autopilot ativado, o GKE também pode gerenciar seus nós, incluindo provisionamento, escalonamento e programação automatizados. Ou você pode escolher ter mais controle e gerenciar os nós por conta própria.

Em cada cluster do GKE, o GKE gerencia o ciclo de vida do plano de controle do Kubernetes, desde a criação até a exclusão do cluster. Com o Autopilot ativado, o GKE também pode gerenciar seus nós, incluindo provisionamento, escalonamento e programação automatizados. Ou você pode escolher ter mais controle e gerenciar os nós por conta própria.

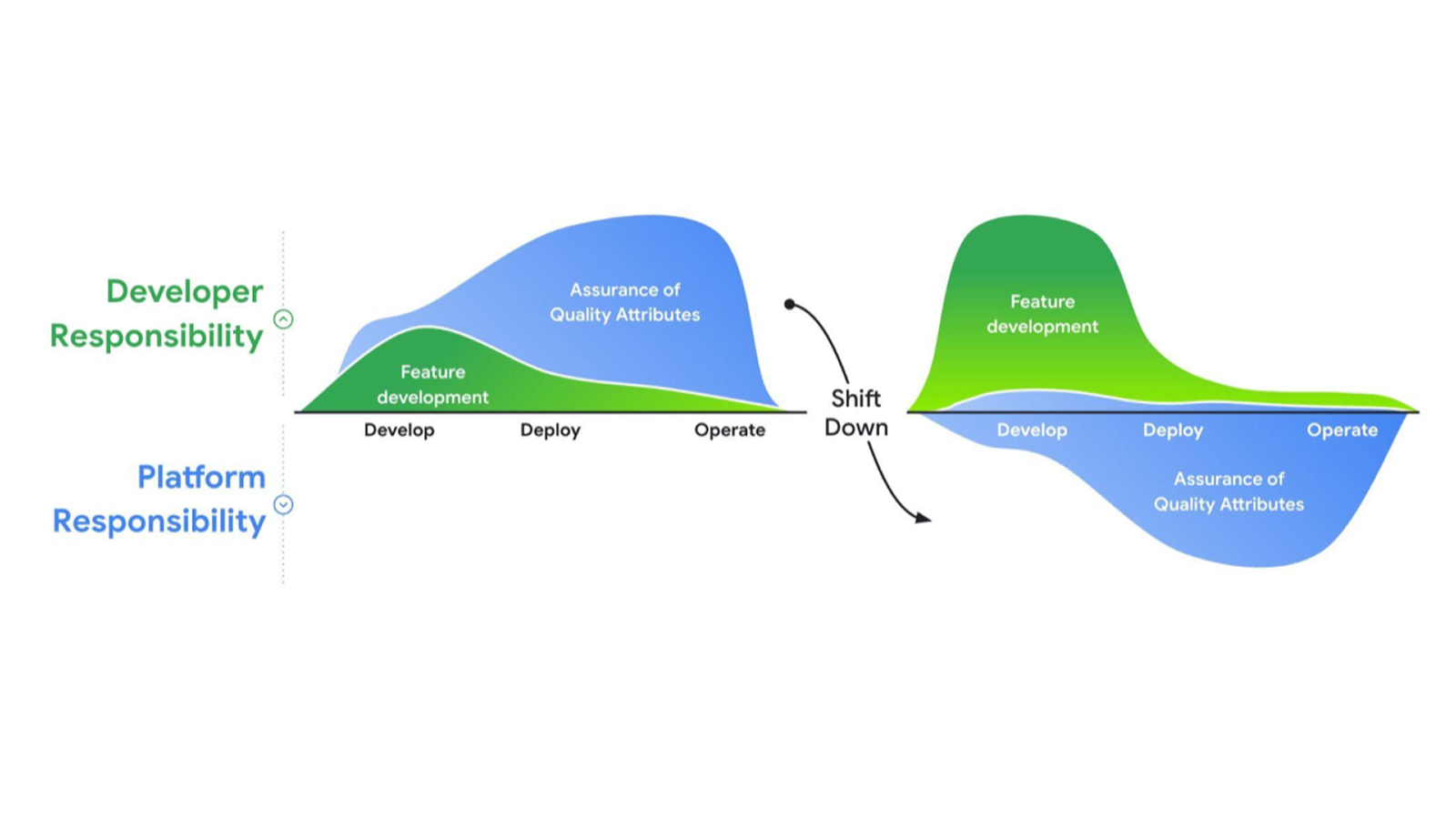

Crie plataformas para todas as suas cargas de trabalho

Crie uma plataforma de desenvolvimento empresarial para entrega rápida e confiável de apps

Crie uma plataforma de desenvolvimento empresarial para entrega rápida e confiável de apps

O Google Cloud oferece um conjunto abrangente de serviços gerenciados e ambientes de execução que atuam como elementos básicos para sua plataforma, para que você possa encontrar a combinação certa de serviços para seus casos de uso. A integração profunda do GKE com o ecossistema do Google Cloud, a escalonabilidade incomparável e a postura de segurança integrada o tornam uma base ideal para sua plataforma.

O que é engenharia de plataforma?

Tutoriais, guias de início rápido e laboratórios

Crie uma plataforma de desenvolvimento empresarial para entrega rápida e confiável de apps

Crie uma plataforma de desenvolvimento empresarial para entrega rápida e confiável de apps

O Google Cloud oferece um conjunto abrangente de serviços gerenciados e ambientes de execução que atuam como elementos básicos para sua plataforma, para que você possa encontrar a combinação certa de serviços para seus casos de uso. A integração profunda do GKE com o ecossistema do Google Cloud, a escalonabilidade incomparável e a postura de segurança integrada o tornam uma base ideal para sua plataforma.

Recursos de aprendizagem

O que é engenharia de plataforma?

Treinar, disponibilizar e escalonar modelos de IA generativa

Implantar inferência de IA generativa com o GKE

Implantar inferência de IA generativa com o GKE

O GKE não apenas fornece uma plataforma para IA, mas também simplifica e automatiza as operações do Kubernetes com IA. Com suporte para até 65 mil nós e integração com o AI Hypercomputer, você pode treinar e escalonar seus maiores modelos de IA generativa no GKE.

Além disso, os recursos de inferência com reconhecimento de IA generativa do GKE oferecem custos de disponibilização até 30% menores, latência de cauda 60% menor e capacidade de processamento 40% maior do que o OSS K8s.

Tutoriais, guias de início rápido e laboratórios

Implantar inferência de IA generativa com o GKE

Implantar inferência de IA generativa com o GKE

O GKE não apenas fornece uma plataforma para IA, mas também simplifica e automatiza as operações do Kubernetes com IA. Com suporte para até 65 mil nós e integração com o AI Hypercomputer, você pode treinar e escalonar seus maiores modelos de IA generativa no GKE.

Além disso, os recursos de inferência com reconhecimento de IA generativa do GKE oferecem custos de disponibilização até 30% menores, latência de cauda 60% menor e capacidade de processamento 40% maior do que o OSS K8s.

Orquestração de vários agentes

Implantar e orquestrar aplicativos multiagente

Implantar e orquestrar aplicativos multiagente

A IA agêntica se concentra na orquestração e execução de agentes que usam LLMs como um "cérebro" para realizar ações por meio de ferramentas.

O GKE é a plataforma aberta definitiva para oferecer suporte a agentes e orquestrar sua computação, para que você possa adotar a próxima geração de cargas de trabalho de IA baseadas em agentes.

Tutoriais, guias de início rápido e laboratórios

Implantar e orquestrar aplicativos multiagente

Implantar e orquestrar aplicativos multiagente

A IA agêntica se concentra na orquestração e execução de agentes que usam LLMs como um "cérebro" para realizar ações por meio de ferramentas.

O GKE é a plataforma aberta definitiva para oferecer suporte a agentes e orquestrar sua computação, para que você possa adotar a próxima geração de cargas de trabalho de IA baseadas em agentes.

Preços

| Como funcionam os preços do GKE | Depois que os créditos sem custo financeiro forem usados, o custo total será baseado no modo de operação do cluster e nas taxas de gerenciamento de clusters e de transferência de dados de entrada aplicáveis. | |

|---|---|---|

| Serviço | Descrição | Preço (USD) |

Nível sem custo financeiro | O nível sem custo financeiro do GKE oferece US$ 74,40 em créditos mensais para cada conta de faturamento aplicada a clusters zonais e do Autopilot. | Sem custo financeiro |

Taxa de gerenciamento de clusters | Inclui gerenciamento totalmente automatizado do ciclo de vida dos clusters, escalonamento automático de pods e clusters, visibilidade de custos, otimização automatizada de custos da infraestrutura e recursos de gerenciamento multicluster, sem custo extra. | US$ 0,10 por cluster a cada hora |

Computação | Ao usar o Autopilot, você paga apenas pela CPU, memória e recursos de computação provisionados para seus pods. Para pools de nós e classes de computação que não usam o Autopilot, você recebe cobranças pelas instâncias do Compute Engine dos nós até que eles sejam excluídos. | Consulte os preços do Compute Engine |

Saiba mais sobre os preços do GKE Confira todos os detalhes de preços.

Como funcionam os preços do GKE

Depois que os créditos sem custo financeiro forem usados, o custo total será baseado no modo de operação do cluster e nas taxas de gerenciamento de clusters e de transferência de dados de entrada aplicáveis.

Nível sem custo financeiro

O nível sem custo financeiro do GKE oferece US$ 74,40 em créditos mensais para cada conta de faturamento aplicada a clusters zonais e do Autopilot.

Sem custo financeiro

Taxa de gerenciamento de clusters

Inclui gerenciamento totalmente automatizado do ciclo de vida dos clusters, escalonamento automático de pods e clusters, visibilidade de custos, otimização automatizada de custos da infraestrutura e recursos de gerenciamento multicluster, sem custo extra.

US$ 0,10

por cluster a cada hora

Computação

Ao usar o Autopilot, você paga apenas pela CPU, memória e recursos de computação provisionados para seus pods.

Para pools de nós e classes de computação que não usam o Autopilot, você recebe cobranças pelas instâncias do Compute Engine dos nós até que eles sejam excluídos.

Consulte os preços do Compute Engine

Saiba mais sobre os preços do GKE Confira todos os detalhes de preços.

Caso de negócios

Aprenda com os clientes do GKE

A Rembrand reduz a complexidade multicloud com o GKE

Ao aproveitar as GPUs do Google Cloud, a Rembrand reduziu os custos de treinamento em 50% e acelerou o desenvolvimento em 6 vezes.

Desbloqueie a inovação em IA no GKE

A Moloco, provedora de publicidade com tecnologia de IA, consegue tempos de treinamento de modelo 10 vezes mais rápidos com TPUs no GKE.

Com as TPUs no GKE, a HubX reduz a latência em até 66%, o que melhora a experiência do usuário e aumenta as taxas de conversão.

10 anos e contando: por que a Signify escolheu o GKE. Com o GKE como base, a plataforma Philips Hue escalonou a infraestrutura para oferecer suporte a um aumento de 1.150% em transações e comandos na última década.

Leia o blog (em inglês).