AI multimodale

Genera testo, codice, video, audio e immagini praticamente da qualsiasi tipo di contenuto

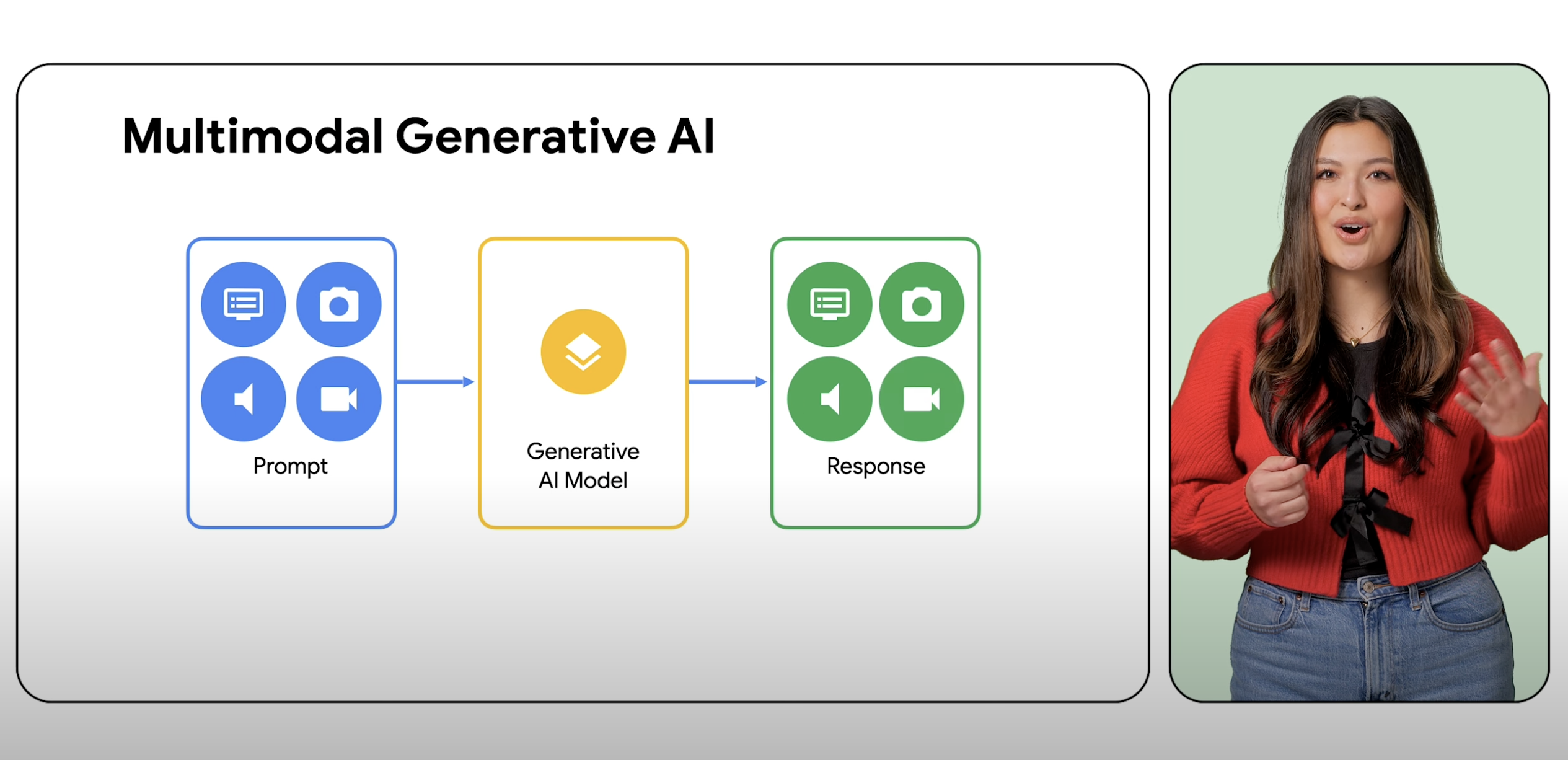

I modelli multimodali possono elaborare un'ampia varietà di input, tra cui testo, immagini e audio, come prompt e convertirli in vari output, non solo il tipo sorgente.

I nuovi clienti ricevono fino a 300 $ di crediti senza costi per provare modelli multimodali in Gemini Enterprise Agent Platform e altri prodotti Google Cloud.

Caratteristiche principali del prodotto

Panoramica

Qual è un esempio di AI multimodale?

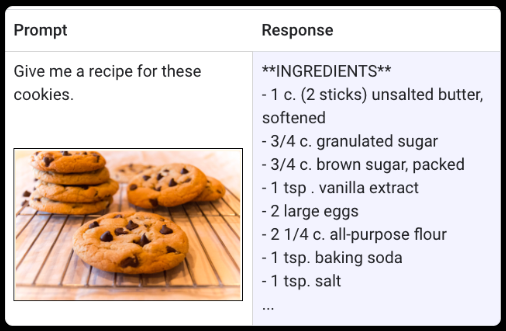

Un modello multimodale è un modello di ML (machine learning) in grado di elaborare le informazioni da diverse modalità, tra cui immagini, video e testo. Ad esempio, il modello multimodale di Google, Gemini, può ricevere la foto di un piatto di biscotti e generare una ricetta scritta in risposta e viceversa.

Qual è la differenza tra AI generativa e AI multimodale?

IA generativa è un termine generico che indica l'uso di modelli di ML per creare nuovi contenuti, come testo, immagini, musica, audio e video, in genere a partire da un solo tipo di prompt. L'IA multimodale amplia queste capacità generative, elaborando informazioni da diverse modalità, tra cui immagini, video e testo. La multimodalità può essere considerata come la capacità dell'IA di elaborare e comprendere diverse modalità sensoriali. In pratica, questo significa che gli utenti non sono limitati a un tipo di input e di un tipo di output e possono richiedere a un modello con qualsiasi input di generare praticamente qualsiasi tipo di contenuto.

Cos'è un'AI che può utilizzare le immagini come prompt?

Gemini è un modello multimodale del team di Google DeepMind che può essere richiesto non solo con immagini, ma anche con testo, codice e video. Gemini è stato progettato interamente per ragionare su testi, immagini, video, audio e codice. Gemini Enterprise Agent Platform può anche utilizzare i prompt per estrarre testo dalle immagini, convertire il testo delle immagini in JSON e generare risposte sulle immagini caricate.

Qual è il futuro dell'IA multimodale e perché è importante?

L'IA multimodale e i modelli multimodali rappresentano un passo in avanti nel modo in cui gli sviluppatori creano ed espandono la funzionalità dell'IA nella prossima generazione di applicazioni. Ad esempio, Gemini è in grado di comprendere, spiegare e generare codice di alta qualità nei linguaggi di programmazione più popolari al mondo, come Python, Java, C++ e Go, consentendo agli sviluppatori di lavorare alla creazione di più applicazioni che ricche di funzionalità. Il potenziale dell'AI multimodale avvicina anche il mondo all'AI, che è meno come un software intelligente e più come un aiutante o un assistente esperto.

Quali sono i vantaggi dei modelli multimodali e dell'IA multimodale?

Il vantaggio dell'AI multimodale è che offre a sviluppatori e utenti un'AI con capacità di ragionamento avanzato, risoluzione dei problemi e generazione più avanzate. Questi progressi offrono infinite possibilità di come le applicazioni di nuova generazione possano cambiare il nostro modo di lavorare e vivere. Per gli sviluppatori che vogliono iniziare a creare, l'API Gemini Enterprise Agent Platform offre funzionalità come sicurezza aziendale, residenza dei dati, prestazioni e assistenza tecnica. I clienti Google Cloud esistenti possono iniziare subito a creare prompt con Gemini in Agent Platform.

Come funziona

Un modello multimodale è in grado di comprendere ed elaborare praticamente qualsiasi input, combinando diversi tipi di informazioni e generando quasi tutti gli output. Ad esempio, utilizzando Agent Platform, gli utenti possono fornire prompt con testo, immagini, video o codice per generare tipi di contenuti diversi rispetto a quelli inseriti in origine.

Un modello multimodale è in grado di comprendere ed elaborare praticamente qualsiasi input, combinando diversi tipi di informazioni e generando quasi tutti gli output. Ad esempio, utilizzando Agent Platform, gli utenti possono fornire prompt con testo, immagini, video o codice per generare tipi di contenuti diversi rispetto a quelli inseriti in origine.

Prova prompt multimodali

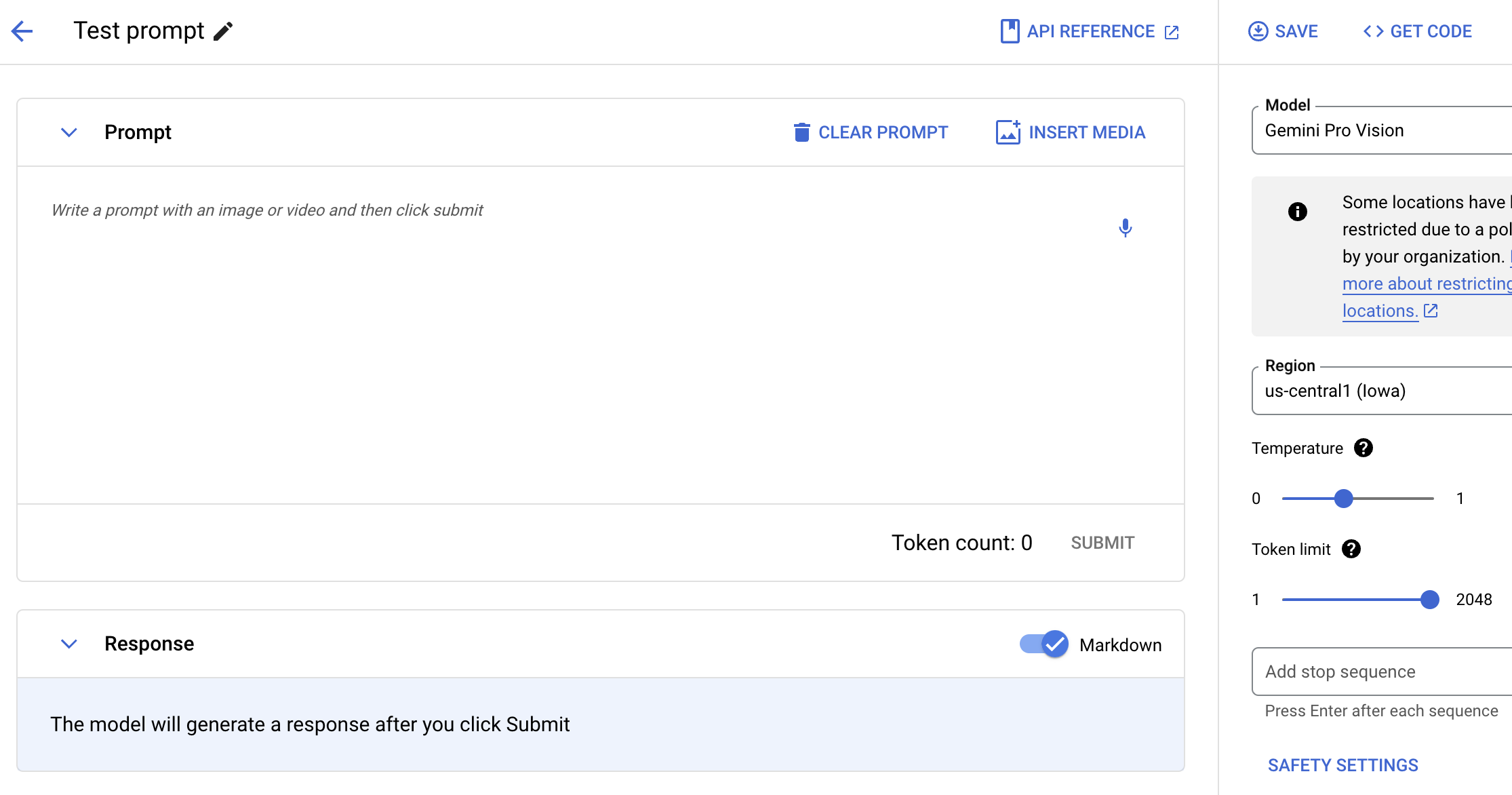

Invia un prompt a Gemini con testo, immagini e video

Testa il modello Gemini utilizzando linguaggio naturale, codice o immagini. Prova i prompt di esempio per estrarre il testo dalle immagini, convertire il testo delle immagini in formato JSON e persino generare risposte sulle immagini caricate per creare applicazioni IA di nuova generazione.

Procedure

Invia un prompt a Gemini con testo, immagini e video

Testa il modello Gemini utilizzando linguaggio naturale, codice o immagini. Prova i prompt di esempio per estrarre il testo dalle immagini, convertire il testo delle immagini in formato JSON e persino generare risposte sulle immagini caricate per creare applicazioni IA di nuova generazione.

Utilizza modelli multimodali

Inizia a utilizzare Gemini, il modello multimodale di Google

Ottieni una panoramica dell'utilizzo del modello multimodale in Google Cloud, punti di forza e limitazioni di Gemini, informazioni su prompt e richieste, e numero di token.

Procedure

Inizia a utilizzare Gemini, il modello multimodale di Google

Ottieni una panoramica dell'utilizzo del modello multimodale in Google Cloud, punti di forza e limitazioni di Gemini, informazioni su prompt e richieste, e numero di token.