IA multimodal

Genera texto, código, vídeo, audio e imágenes a partir de prácticamente cualquier tipo de contenido

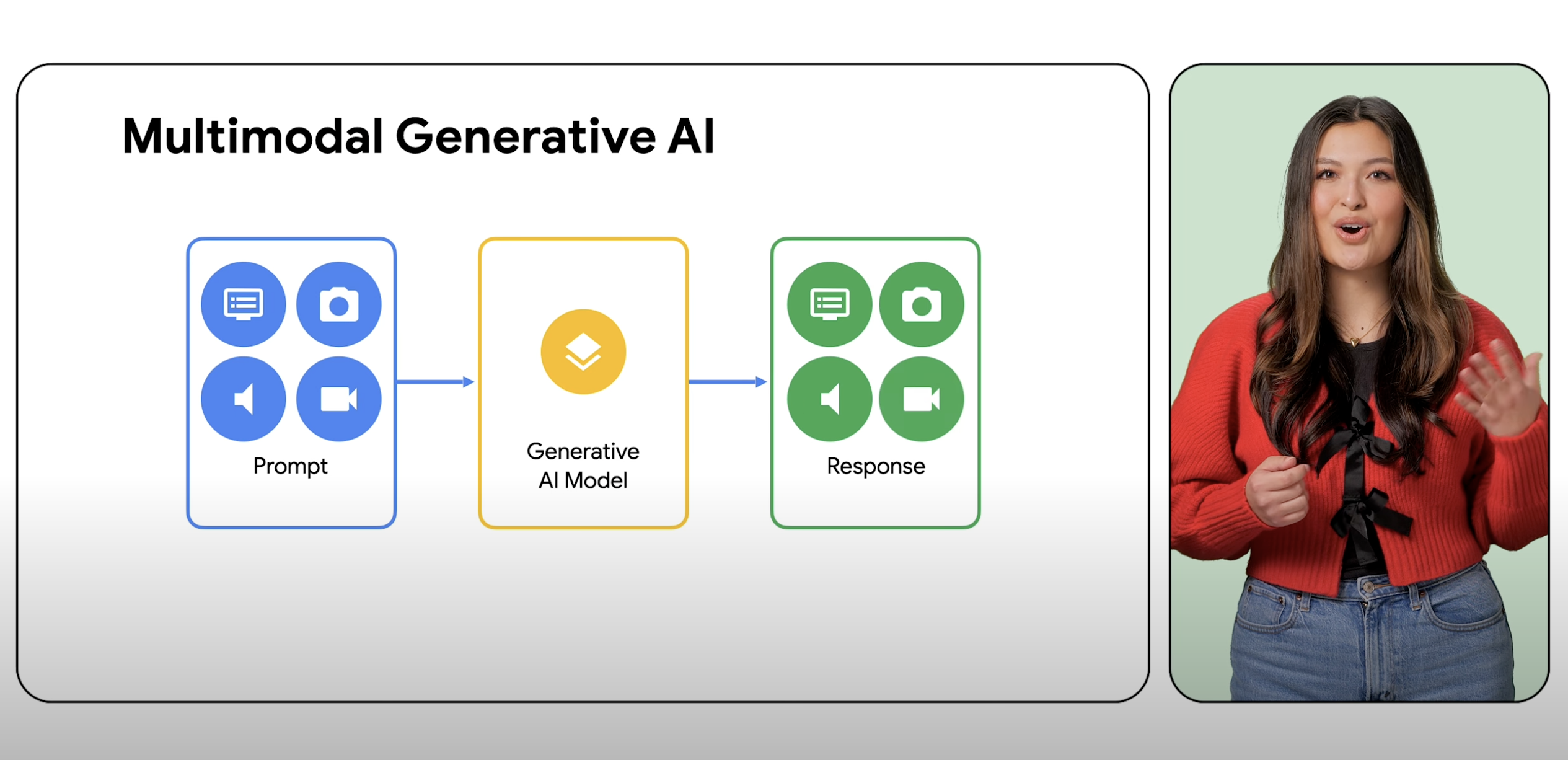

Los modelos multimodales pueden procesar una gran variedad de entradas, como texto, imágenes y audio, como peticiones y convertir esas peticiones en varios resultados (no solo en el tipo de origen).

Los nuevos clientes reciben hasta 300 USD en crédito sin coste para probar modelos multimodales en Gemini Enterprise Agent Platform y otros productos de Google Cloud.

Información general

¿Cuál sería un ejemplo de IA multimodal?

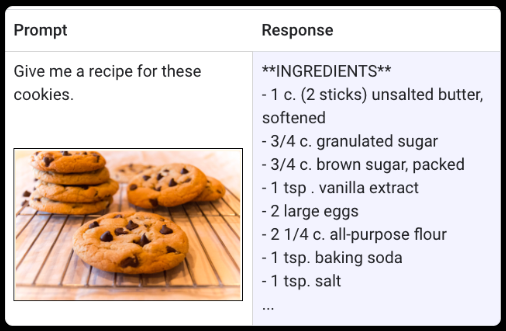

Un modelo multimodal es un modelo de aprendizaje automático que puede procesar información de diferentes modalidades, como imágenes, vídeos y texto. Por ejemplo, Gemini, el modelo multimodal de Google, puede recibir una foto de un plato de galletas y generar una receta escrita como respuesta y viceversa.

¿Qué diferencia hay entre la IA generativa y la IA multimodal?

La IA generativa es un término general que engloba el uso de modelos de aprendizaje automático para crear contenido, como texto, imágenes, música, audio y vídeos, normalmente a partir de una petición de un solo tipo. La IA multimodal amplía estas funciones generativas, ya que procesa información de múltiples modalidades, como imágenes, vídeos y texto. La multimodalidad se puede considerar que proporciona a la IA la capacidad de procesar y comprender diferentes modos sensoriales. En la práctica, esto significa que los usuarios no están limitados a un solo tipo de entrada y de salida, sino que pueden crear un modelo con prácticamente cualquier entrada para generar prácticamente cualquier tipo de contenido.

¿Qué es una IA que puede usar imágenes como petición?

Gemini es un modelo multimodal del equipo de Google DeepMind al que se le puede enviar no solo imágenes, sino también texto, código y vídeo. Gemini se ha diseñado desde cero con la finalidad de funcionar perfectamente en texto, imágenes, vídeo, audio y código. Gemini Enterprise Agent Platform puede usar prompts para extraer texto de imágenes, convertir texto de imagen a JSON y generar respuestas sobre imágenes subidas.

¿Cuál es el futuro de la IA multimodal y por qué es importante?

La IA multimodal y los modelos multimodales suponen un paso adelante en la forma en que los desarrolladores crean y amplían la funcionalidad de la IA en la nueva generación de aplicaciones. Por ejemplo, Gemini puede entender, explicar y generar código de alta calidad en los lenguajes de programación más populares del mundo, como Python, Java, C++ y Go, lo que permite a los desarrolladores centrarse en crear más aplicaciones con funciones. El potencial de la IA multimodal también acerca al mundo a una IA que se parece menos a un software inteligente y más a un ayudante o asistente experto.

¿Cuáles son las ventajas de los modelos multimodales y la IA multimodal?

La ventaja de la IA multimodal es que ofrece a los desarrolladores y a los usuarios una IA con funciones más avanzadas de razonamiento, resolución de problemas y generación. Estos avances ofrecen un sinfín de posibilidades sobre cómo las aplicaciones de última generación pueden cambiar nuestra forma de trabajar y de vivir. Para los desarrolladores que quieran empezar a compilar la API de Gemini Enterprise Agent Platform ofrece ventajas como la seguridad empresarial, la residencia de datos, el rendimiento y la asistencia técnica. Los clientes de Google Cloud ya pueden empezar a generar con Gemini en Agent Platform.

Cómo funciona

Un modelo multimodal es capaz de comprender y procesar prácticamente cualquier entrada, combinando diferentes tipos de información y generar casi cualquier salida. Por ejemplo, al usar Agent Platform, los usuarios pueden formular una prompt con texto, imágenes, vídeo o código para generar tipos de contenido diferentes a los introducidos originalmente.

Un modelo multimodal es capaz de comprender y procesar prácticamente cualquier entrada, combinando diferentes tipos de información y generar casi cualquier salida. Por ejemplo, al usar Agent Platform, los usuarios pueden formular una prompt con texto, imágenes, vídeo o código para generar tipos de contenido diferentes a los introducidos originalmente.

Probar las peticiones multimodales

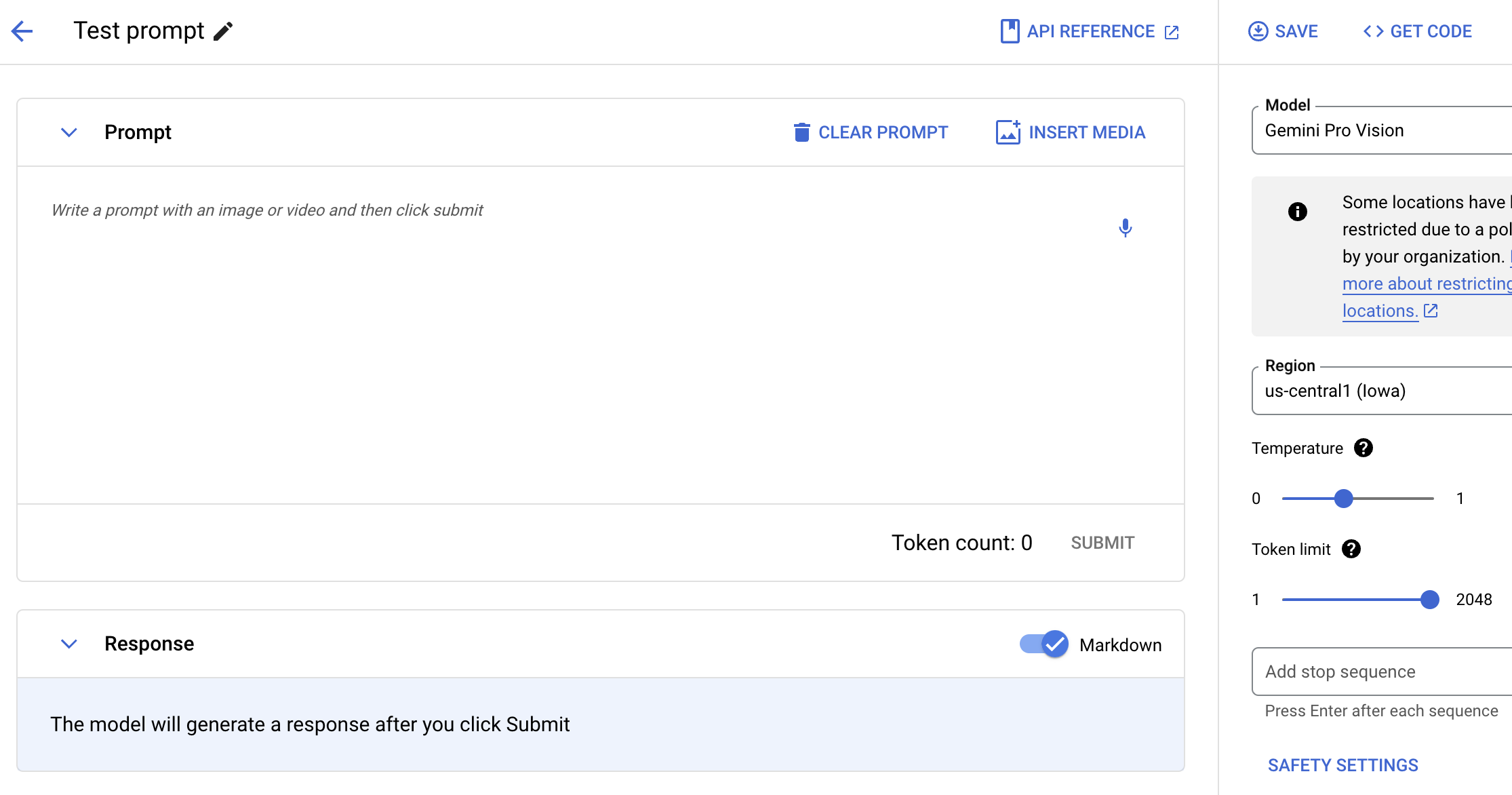

Envía peticiones de texto, imágenes y vídeos a Gemini

Prueba el modelo de Gemini con lenguaje natural, código o imágenes. Prueba las peticiones de ejemplo para extraer texto de imágenes, convertir el texto de las imágenes a JSON e incluso generar respuestas sobre imágenes subidas para crear aplicaciones de IA de última generación.

Instrucciones

Envía peticiones de texto, imágenes y vídeos a Gemini

Prueba el modelo de Gemini con lenguaje natural, código o imágenes. Prueba las peticiones de ejemplo para extraer texto de imágenes, convertir el texto de las imágenes a JSON e incluso generar respuestas sobre imágenes subidas para crear aplicaciones de IA de última generación.

Usar modelos multimodales

Primeros pasos con Gemini, el modelo multimodal de Google

Consulta un resumen del uso de los modelos multimodales en Google Cloud, los puntos fuertes y las limitaciones de Gemini, información sobre mensajes y solicitudes y recuento de tokens.

Instrucciones

Primeros pasos con Gemini, el modelo multimodal de Google

Consulta un resumen del uso de los modelos multimodales en Google Cloud, los puntos fuertes y las limitaciones de Gemini, información sobre mensajes y solicitudes y recuento de tokens.