AI ソリューションの開発、シームレスなアプリケーション統合、効果的なスケーリングのために設計された Apigee の特定の AI 機能の詳細

エンタープライズ対応の AI ゲートウェイを実装する

Apigee のコア API ゲートウェイ機能には、AI アプリケーションのトラフィックを管理するためのネイティブ機能が含まれており、サービス消費の一貫した API 契約を提供します。

次の機能が含まれています。

- モデル抽象化

- マルチクラウド モデル ルーティング

- リクエスト / レスポンスの拡充

- RAG の統合

- サードパーティ システムへのエージェントの接続性(Google Cloud の Application Integration プラットフォームを使用)

- 高可用性のための LLM サーキット ブレーカー パターン

- セマンティック キャッシュ

関連情報

プログラマブル API プロキシ

Apigee API プロキシ フローのさまざまなポイントにポリシーをアタッチすることで、API の動作をきめ細かく制御できます。この配置により、リクエストとレスポンスがプロキシを通過する際に、各ポリシーがいつ適用されるかが正確に決まります。

次世代の統合: AI を活用

生成 AI の力を活用して、高度な自動化ワークフローを構築します。シンプルな自然言語を使用して 100 以上のアプリケーションを接続する方法をご覧ください。生成 AI エージェントを使用して Google Cloud エコシステム内のオペレーションを最適化する方法をご確認ください。

Apigee を使用して Vertex AI から Hugging Face モデルをサービング

Apigee と Vertex AI を使用して LLM API ゲートウェイを構築します。このハンズオン デモでは、LLM エンドポイントのプロキシを作成する方法を説明します。Apigee を初めて使用するデベロッパーや、AI API を統合するデベロッパーに最適です。Apigee が AI アプリケーションを保護、管理、最適化する方法を学びます。

企業のコンテキストに基づくエージェント ワークフローを強化

AI エージェントは、LLM の機能を活用してエンドユーザーのためにタスクを遂行します。エージェントの構築には、Agentspace などのノーコードまたはローコードのプラットフォームから、LangChain や LlamaIndex などのフルコードのフレームワークまで、さまざまなツールを使用できます。Apigee は AI アプリケーションとエージェントの間で仲介役として機能します。

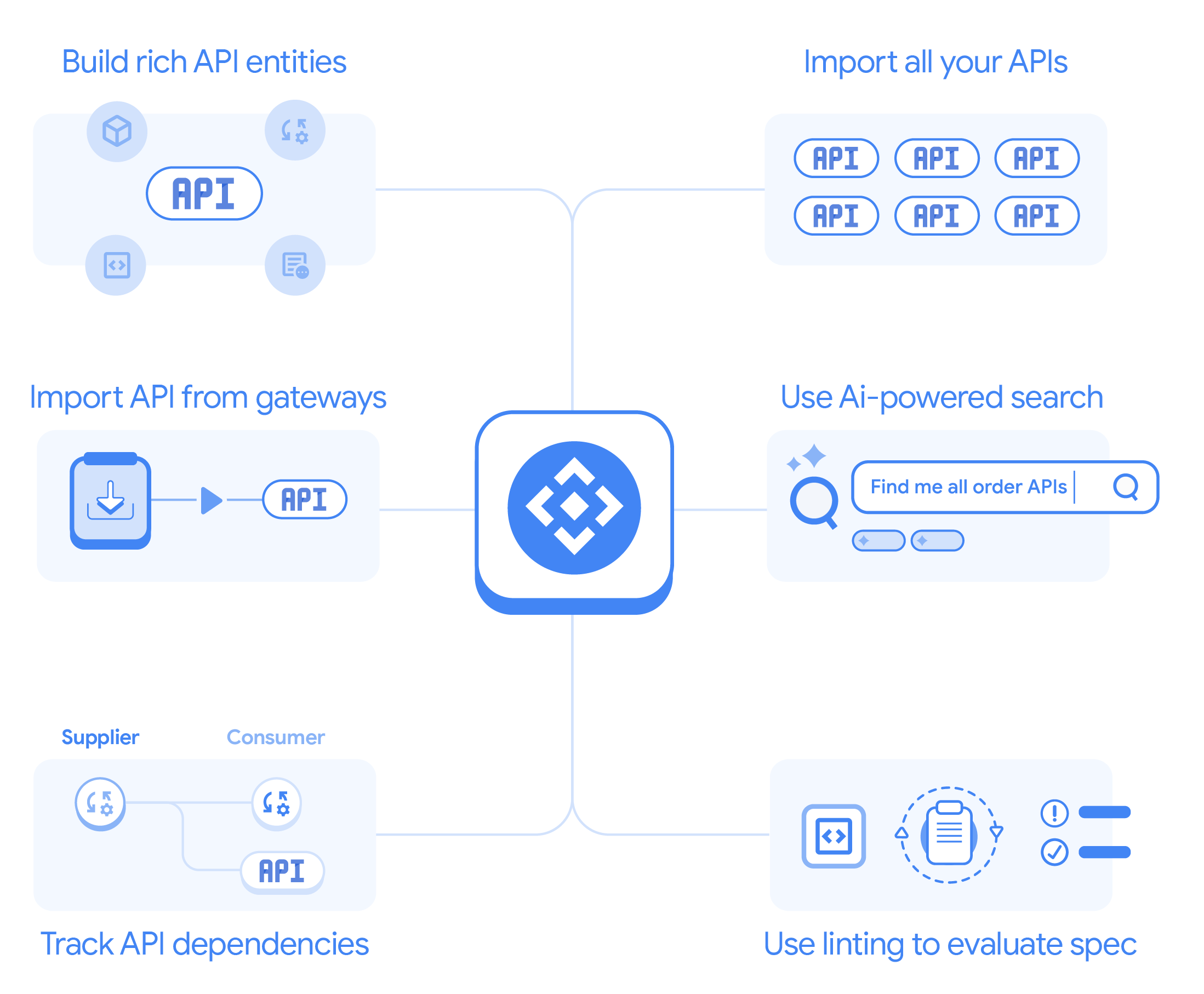

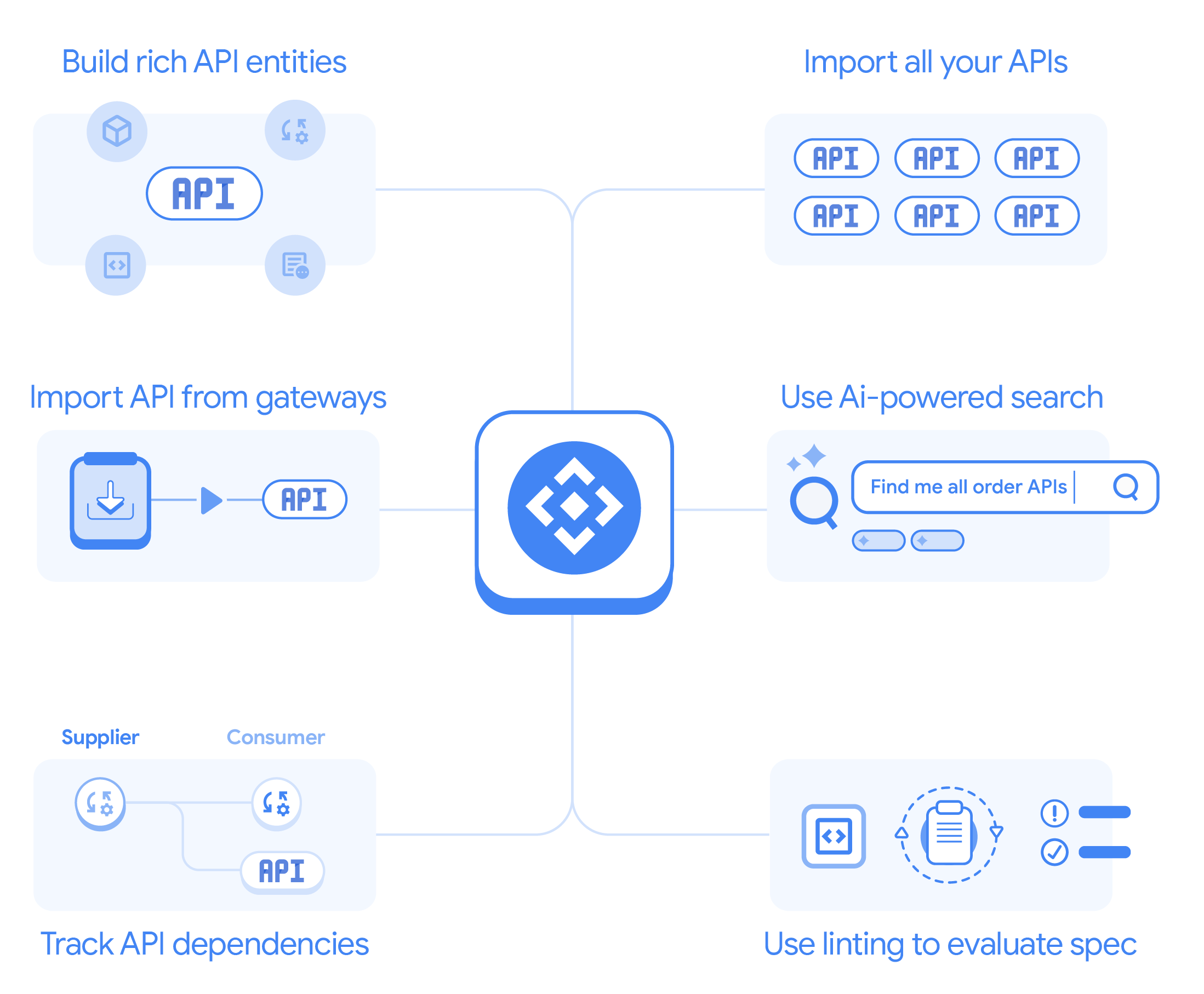

Apigee で Gemini Code Assist が一般提供されたことで、Cloud Code と Gemini Chat の両方のインターフェースで自然言語を使用して API 仕様を迅速に作成できるようになりました。API Hub を通じて組織の API エコシステムを活用することで、ネストされたオブジェクトのサポートと API の重複の予防検出を備えた、一貫性のある安全な API のためのエンタープライズ コンテキストが提供されます。

次の機能が含まれています。

- Apigee API Hub: 自社 API とサードパーティ API およびワークフローをカタログ化する

- 費用管理のためのトークン制限の適用

- マルチエージェント オーケストレーション

- 認証と認可

- パフォーマンスを最適化するためのセマンティック キャッシュ

- エンタープライズ コンテキストによる API 仕様の生成(Gemini Code Assist を使用)

関連情報

ドキュメント: Apigee API Hub

Google Cloud の Apigee API Hub は、すべての API の検出、管理、文書化を可能にする一元化されたプラットフォームです。これにより、可視性、制御、再利用、ガバナンスが向上し、開発が迅速化されます。

ブログ: Apigee API ハブの一般提供を開始

一般提供が開始された Apigee API Hub で、すべての API を一元的に検出、管理、統制できます。このプラットフォームは、デプロイ場所に関係なく、API 環境全体を一括表示できるため、チームは運用を効率化し、企業全体の API ガバナンスを強化できます。

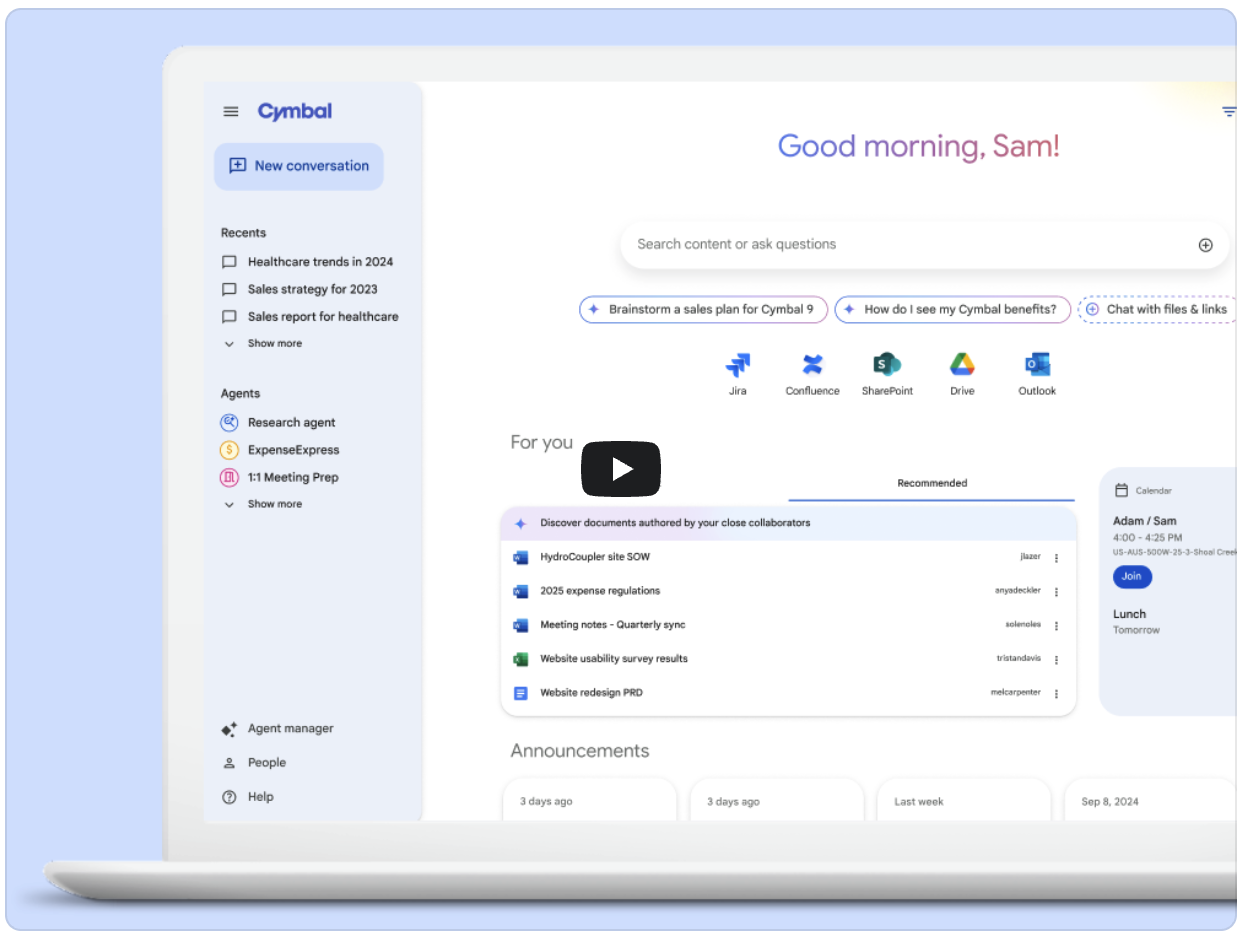

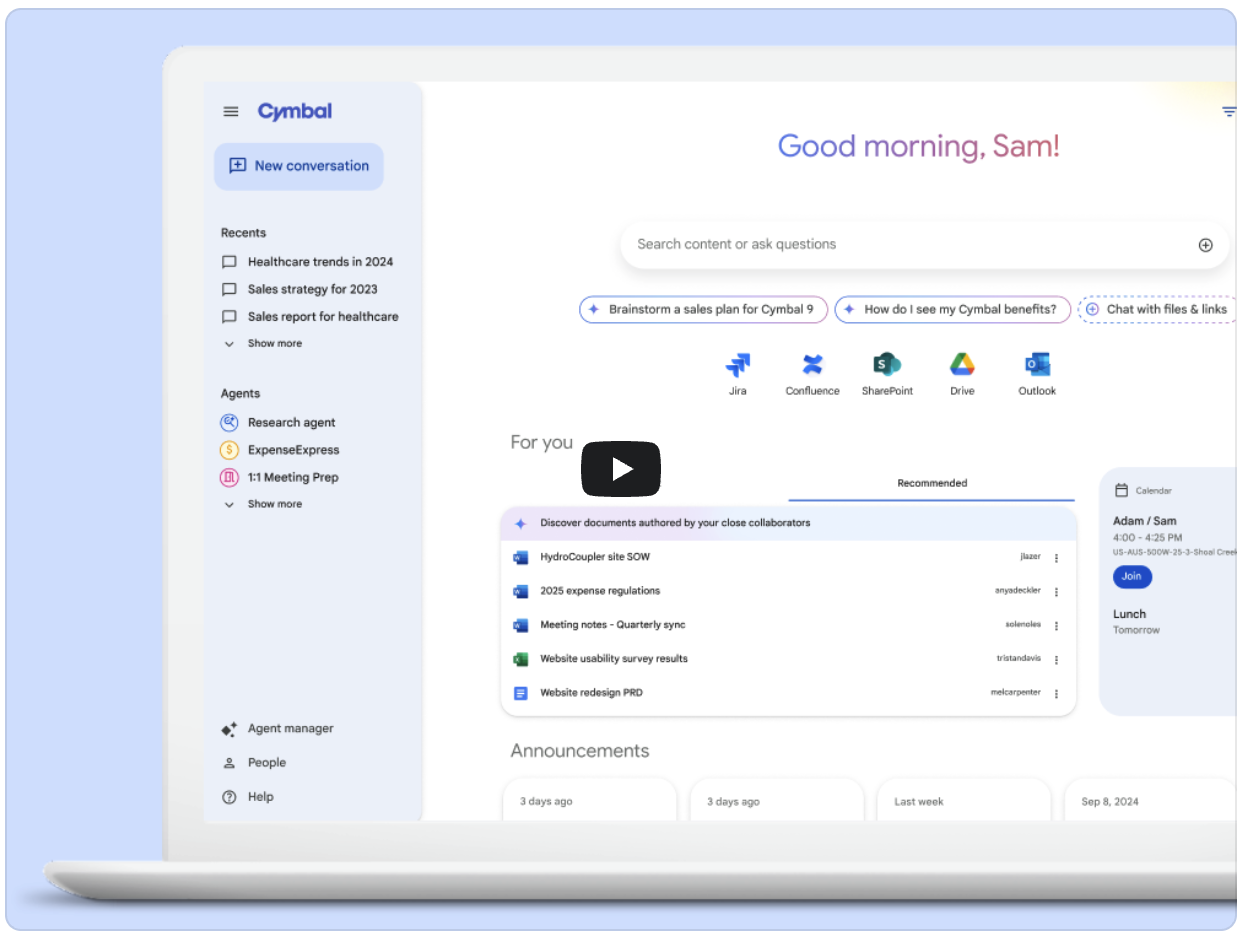

Agentspace の詳細

Google Cloud Agentspace で従業員の可能性を引き出しましょう。従業員は、会社のデータへの安全なアクセス、AI によるタスクの自動化、インテリジェントな分析情報によって、生産性を新たな高みへと押し上げることができます。

LLM のアクセスと使用を全社的に管理

Apigee のネイティブ ポリシーと配信機能により、生成 AI プラットフォーム チームは AI アプリケーションと LLM の使用を効率的に管理できます。

次の機能が含まれています。

- モデルへのセルフサービス アクセスを可能にする統合デベロッパー ポータル

- モデルのアクセスと使用の制限をポリシーベースできめ細かく制御

- トークンの使用制限のモニタリングとレポート

- LLM の監査とロギング

関連情報

ブログ: Apigee で生成 AI アプリを運用化する

Google Cloud の API 管理プラットフォームである Apigee を使用すると、企業は AI サービスの API を安全にスケーリングして管理し、ユーザーの需要が増加しても信頼性の高いアクセスを確保できます。

アプリ登録を使用した API へのアクセスの管理

デベロッパー アプリを登録して、Apigee での API へのアクセスを制御します。登録したアプリを使用して API キーを取得し、安全に API を使用できます。

Apigee API Management による生成 AI の構築とスケーリング

生成 AI は業界を変革していますが、これらの優れたモデルを効果的に本番環境に導入するにはどうすればよいでしょうか。このウェブセミナーでは、生成 AI の運用における API の重要なロールについて説明します。

AI アプリケーションのパフォーマンスと高可用性を維持する

Apigee は、AI アプリケーションの詳細なオブザーバビリティを提供し、生成 AI の費用を管理、最適化し、組織の AI 使用を効率的に管理できるようにします。

次の機能が含まれています。

- モデルの使用状況とアプリケーション トークンの消費状況の可視化

- 社内費用のレポート作成と最適化

- 実際のトークン数に基づいて使用状況をモニタリングするカスタム ダッシュボード(Looker Studio とのインテグレーションを通じて)

- AI アプリケーションのログ記録

エンドユーザーとブランドを保護しながら LLM API を保護する

Apigee は、LLM API の安全なゲートウェイとして機能し、API キー、OAuth 2.0、JWT 検証でアクセスを制御し、レート制限と割り当てを適用して不正使用と過負荷を防止します。Apigee の Advanced API Security は、さらに高度な保護機能を提供します。

能力:

- Model Armor のインテグレーションと、プロンプトとレスポンスのサニタイズのためのポリシーの適用

- 認証と認可

- 不正使用と異常検出

- OWASP トップ 10 API および LLM セキュリティ リスクの軽減

- LLM API セキュリティ構成ミスの検出

- Google SecOps とサードパーティの SIEM の統合

関連情報

Apigee Advanced API Security

Google Cloud の Advanced API Security で API を保護します。このサービスは、API トラフィックと構成を分析して、パフォーマンスに影響を与えることなく脅威を阻止します。ブロック対象の不審なリクエストを特定し、構成ミスを報告します。

ホワイト ペーパー: OWASP の API の脅威トップ 10 の軽減

Apigee で OWASP トップ 10 API 攻撃を阻止。安全な認証、認可、脅威検出でビジネスを保護。

ブログ: OWASP トップ 10 セキュリティ脅威から API を保護する

Google Cloud の API 管理プラットフォームである Apigee を使用して、認証の不備やインジェクションの欠陥などの主要な脅威から API を保護します。

AI ゲートウェイ

エンタープライズ対応の AI ゲートウェイを実装する

Apigee のコア API ゲートウェイ機能には、AI アプリケーションのトラフィックを管理するためのネイティブ機能が含まれており、サービス消費の一貫した API 契約を提供します。

次の機能が含まれています。

- モデル抽象化

- マルチクラウド モデル ルーティング

- リクエスト / レスポンスの拡充

- RAG の統合

- サードパーティ システムへのエージェントの接続性(Google Cloud の Application Integration プラットフォームを使用)

- 高可用性のための LLM サーキット ブレーカー パターン

- セマンティック キャッシュ

関連情報

プログラマブル API プロキシ

Apigee API プロキシ フローのさまざまなポイントにポリシーをアタッチすることで、API の動作をきめ細かく制御できます。この配置により、リクエストとレスポンスがプロキシを通過する際に、各ポリシーがいつ適用されるかが正確に決まります。

次世代の統合: AI を活用

生成 AI の力を活用して、高度な自動化ワークフローを構築します。シンプルな自然言語を使用して 100 以上のアプリケーションを接続する方法をご覧ください。生成 AI エージェントを使用して Google Cloud エコシステム内のオペレーションを最適化する方法をご確認ください。

Apigee を使用して Vertex AI から Hugging Face モデルをサービング

Apigee と Vertex AI を使用して LLM API ゲートウェイを構築します。このハンズオン デモでは、LLM エンドポイントのプロキシを作成する方法を説明します。Apigee を初めて使用するデベロッパーや、AI API を統合するデベロッパーに最適です。Apigee が AI アプリケーションを保護、管理、最適化する方法を学びます。

AI エージェント

企業のコンテキストに基づくエージェント ワークフローを強化

AI エージェントは、LLM の機能を活用してエンドユーザーのためにタスクを遂行します。エージェントの構築には、Agentspace などのノーコードまたはローコードのプラットフォームから、LangChain や LlamaIndex などのフルコードのフレームワークまで、さまざまなツールを使用できます。Apigee は AI アプリケーションとエージェントの間で仲介役として機能します。

Apigee で Gemini Code Assist が一般提供されたことで、Cloud Code と Gemini Chat の両方のインターフェースで自然言語を使用して API 仕様を迅速に作成できるようになりました。API Hub を通じて組織の API エコシステムを活用することで、ネストされたオブジェクトのサポートと API の重複の予防検出を備えた、一貫性のある安全な API のためのエンタープライズ コンテキストが提供されます。

次の機能が含まれています。

- Apigee API Hub: 自社 API とサードパーティ API およびワークフローをカタログ化する

- 費用管理のためのトークン制限の適用

- マルチエージェント オーケストレーション

- 認証と認可

- パフォーマンスを最適化するためのセマンティック キャッシュ

- エンタープライズ コンテキストによる API 仕様の生成(Gemini Code Assist を使用)

関連情報

ドキュメント: Apigee API Hub

Google Cloud の Apigee API Hub は、すべての API の検出、管理、文書化を可能にする一元化されたプラットフォームです。これにより、可視性、制御、再利用、ガバナンスが向上し、開発が迅速化されます。

ブログ: Apigee API ハブの一般提供を開始

一般提供が開始された Apigee API Hub で、すべての API を一元的に検出、管理、統制できます。このプラットフォームは、デプロイ場所に関係なく、API 環境全体を一括表示できるため、チームは運用を効率化し、企業全体の API ガバナンスを強化できます。

Agentspace の詳細

Google Cloud Agentspace で従業員の可能性を引き出しましょう。従業員は、会社のデータへの安全なアクセス、AI によるタスクの自動化、インテリジェントな分析情報によって、生産性を新たな高みへと押し上げることができます。

AI ガバナンス

LLM のアクセスと使用を全社的に管理

Apigee のネイティブ ポリシーと配信機能により、生成 AI プラットフォーム チームは AI アプリケーションと LLM の使用を効率的に管理できます。

次の機能が含まれています。

- モデルへのセルフサービス アクセスを可能にする統合デベロッパー ポータル

- モデルのアクセスと使用の制限をポリシーベースできめ細かく制御

- トークンの使用制限のモニタリングとレポート

- LLM の監査とロギング

関連情報

ブログ: Apigee で生成 AI アプリを運用化する

Google Cloud の API 管理プラットフォームである Apigee を使用すると、企業は AI サービスの API を安全にスケーリングして管理し、ユーザーの需要が増加しても信頼性の高いアクセスを確保できます。

アプリ登録を使用した API へのアクセスの管理

デベロッパー アプリを登録して、Apigee での API へのアクセスを制御します。登録したアプリを使用して API キーを取得し、安全に API を使用できます。

Apigee API Management による生成 AI の構築とスケーリング

生成 AI は業界を変革していますが、これらの優れたモデルを効果的に本番環境に導入するにはどうすればよいでしょうか。このウェブセミナーでは、生成 AI の運用における API の重要なロールについて説明します。

AI のオブザーバビリティ

AI アプリケーションのパフォーマンスと高可用性を維持する

Apigee は、AI アプリケーションの詳細なオブザーバビリティを提供し、生成 AI の費用を管理、最適化し、組織の AI 使用を効率的に管理できるようにします。

次の機能が含まれています。

- モデルの使用状況とアプリケーション トークンの消費状況の可視化

- 社内費用のレポート作成と最適化

- 実際のトークン数に基づいて使用状況をモニタリングするカスタム ダッシュボード(Looker Studio とのインテグレーションを通じて)

- AI アプリケーションのログ記録

AI の安全性とセキュリティ

エンドユーザーとブランドを保護しながら LLM API を保護する

Apigee は、LLM API の安全なゲートウェイとして機能し、API キー、OAuth 2.0、JWT 検証でアクセスを制御し、レート制限と割り当てを適用して不正使用と過負荷を防止します。Apigee の Advanced API Security は、さらに高度な保護機能を提供します。

能力:

- Model Armor のインテグレーションと、プロンプトとレスポンスのサニタイズのためのポリシーの適用

- 認証と認可

- 不正使用と異常検出

- OWASP トップ 10 API および LLM セキュリティ リスクの軽減

- LLM API セキュリティ構成ミスの検出

- Google SecOps とサードパーティの SIEM の統合

関連情報

Apigee Advanced API Security

Google Cloud の Advanced API Security で API を保護します。このサービスは、API トラフィックと構成を分析して、パフォーマンスに影響を与えることなく脅威を阻止します。ブロック対象の不審なリクエストを特定し、構成ミスを報告します。

ホワイト ペーパー: OWASP の API の脅威トップ 10 の軽減

Apigee で OWASP トップ 10 API 攻撃を阻止。安全な認証、認可、脅威検出でビジネスを保護。

ブログ: OWASP トップ 10 セキュリティ脅威から API を保護する

Google Cloud の API 管理プラットフォームである Apigee を使用して、認証の不備やインジェクションの欠陥などの主要な脅威から API を保護します。

デベロッパー向けリソース

Apigee を活用して生成 AI プロジェクトの可能性を最大限に引き出す方法をご確認ください。

ユースケースに適した Apigee AI ソリューション

Apigee で AI アプリケーションを保護する

Apigee を Model Armor のプロンプトとレスポンスのサニタリングのためのポリシー適用ポイントとして使用し、OWASP LLM と API のトップ 10 のセキュリティ リスクを軽減します。

生成 AI の可能性を最大限に引き出すには

生成 AI の可能性を最大限に引き出すには

Apigee で、ソリューションに生成 AI の可能性を引き出しましょう。Apigee の堅牢な運用化機能を利用して、安全でスケーラブル、かつ最適化されたデプロイを自信を持って構築できます。

準備ができたら、Apigee の生成 AI サンプルのページをご覧ください。