¿Qué es un clúster de Kubernetes (K8s)?

Para los desarrolladores empresariales que crean e implementan aplicaciones modernas, gestionar cargas de trabajo en contenedores a escala puede ser un reto habitual. Kubernetes, a menudo abreviado como K8s, se ha convertido en el estándar de orquestación de contenedores. En el núcleo de este potente sistema de código abierto se encuentra el clúster de Kubernetes, un entorno robusto diseñado para automatizar el despliegue, el escalado y la gestión de aplicaciones en contenedores.

Definición de clústeres de Kubernetes

Un clúster de Kubernetes es un conjunto de nodos o máquinas que se agrupan para ejecutar aplicaciones en contenedores. Proporciona un entorno de computación unificado y abstracto que te permite desplegar y gestionar tus servicios sin tener que interactuar directamente con servidores individuales.

La función principal de un clúster de K8s es la orquestación de contenedores: automatiza las complejas tareas que implica mantener la disponibilidad de las aplicaciones, escalar los recursos en función de la demanda y desplegar actualizaciones sin periodos de inactividad.

Al gestionar todo el ciclo de vida de los contenedores, los clústeres de Kubernetes proporcionan la plataforma fundamental que necesitan las aplicaciones empresariales para ser escalables y ágiles.

Nodos

Un nodo es una máquina de trabajo dentro de un clúster de Kubernetes, que puede ser una máquina virtual (VM) de un proveedor de servicios en la nube o un servidor físico en un centro de datos. Cada nodo proporciona los recursos de CPU, memoria y red necesarios para ejecutar contenedores. Un clúster de K8s se compone de un plano de control y uno o varios nodos de trabajador, que en conjunto proporcionan la capacidad de computación del clúster.

Pods

En el modelo de objetos de Kubernetes, la unidad desplegable más pequeña y fundamental es un pod. Representa una sola instancia de un proceso activo en un clúster y encapsula uno o varios contenedores de alto acoplamiento, recursos de almacenamiento compartido y una dirección IP de red única. Aunque un pod puede contener varios contenedores, lo más habitual es que un pod albergue un solo contenedor, lo que crea una asignación de uno a uno entre el pod y la aplicación en contenedores.

Contenedores

Los contenedores son paquetes de software ligeros, independientes y ejecutables que incluyen todo lo necesario para ejecutar una aplicación: código, tiempo de ejecución, herramientas del sistema, bibliotecas del sistema y ajustes. Esta encapsulación ayuda a garantizar que la aplicación se ejecute de forma rápida y fiable de un entorno informático a otro. Los contenedores son portátiles y eficientes, por lo que son los componentes ideales para crear aplicaciones modernas basadas en microservicios.

Arquitectura de clúster de K8s

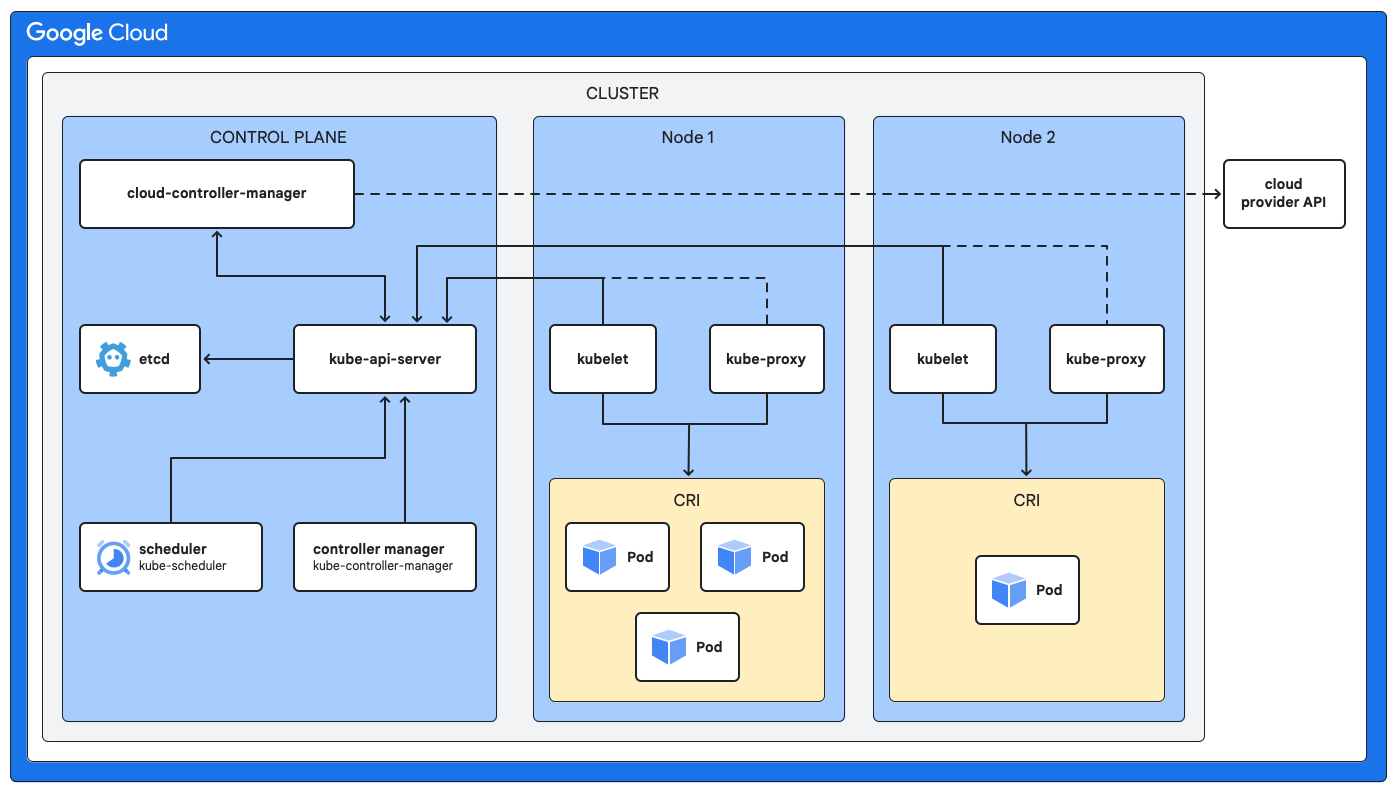

La arquitectura de un clúster de Kubernetes consta de dos tipos principales de componentes que pueden ayudar a crear un sistema tolerante a fallos para ejecutar aplicaciones.

- Plano de control: actúa como el cerebro que gestiona los clústeres.

- Nodos de trabajador: son los que hacen el trabajo pesado, ya que proporcionan el entorno del tiempo de ejecución.

Plano de control (nodos maestros)

El plano de control es el responsable de mantener el estado deseado de todo el clúster. Toma decisiones globales sobre la programación, responde a los eventos del clúster y gestiona el ciclo de vida de todos los objetos de Kubernetes. Entre los componentes clave del plano de control se incluyen los siguientes:

- Almacén de copia (etcd): un almacén de clave-valor coherente y de alta disponibilidad que se usa como almacén de respaldo de Kubernetes para todos los datos de clúster.

- Servidor de la API (kube-apiserver): sirve como frontend del plano de control, exponiendo la API de Kubernetes. Gestiona y valida las solicitudes REST, y después actualiza el estado de los objetos relevantes en etcd.

- Programador (kube-scheduler): el programador supervisa los pods recién creados que no tienen un nodo asignado y selecciona un nodo en el que se ejecutarán en función de la disponibilidad de recursos, las políticas y las especificaciones de afinidad.

- Gestor de controladores (kube-controller-manager) [opcional]: este componente ejecuta varios procesos de controlador que regulan el estado del clúster. Por ejemplo, hay controladores que se encargan de gestionar los fallos de los nodos, mantener el número correcto de pods para un despliegue y gestionar los endpoints de los servicios.

Nodos de trabajador (nodos de computación)

Los nodos de trabajador son las máquinas en las que se ejecutan tus aplicaciones en contenedores. Cada nodo está gestionado por el plano de control y contiene los servicios necesarios para ejecutar pods. Los componentes principales de cada nodo de trabajador son los siguientes:

- kubelet: es un agente que se ejecuta en cada nodo del clúster, se comunica con el plano de control y se asegura de que los contenedores descritos en las especificaciones de los pods se estén ejecutando correctamente.

- kube-proxy [opcional]: este proxy de red se ejecuta en cada nodo y se encarga de mantener las reglas de red en los nodos. Estas reglas de red permiten la comunicación de red a tus pods desde sesiones de red dentro o fuera de tu clúster.

- Tiempo de ejecución de contenedores: este software gestiona la ejecución de contenedores y admite varios tiempos de ejecución, siendo containerd una opción popular.

Usar clústeres en K8s

Los clústeres de Kubernetes pueden ser muy versátiles y abordar muchos de los retos a los que se enfrentan los equipos de desarrollo y operaciones de las empresas.

Contenerización de aplicaciones actuales

Contenerización de aplicaciones actuales

Traslada las aplicaciones antiguas a contenedores para mejorar su portabilidad, escalabilidad y uso de recursos sin tener que refactorizarlas en gran medida.

Creación de nuevas aplicaciones nativas de la nube

Creación de nuevas aplicaciones nativas de la nube

Usa un clúster de K8s como base para las arquitecturas basadas en microservicios, lo que permite desarrollar, desplegar y escalar servicios de forma independiente.

DevOps y CI/CD

DevOps y CI/CD

Automatiza la cadena de creación, prueba y despliegue integrándola con un clúster de Kubernetes para acelerar los ciclos de lanzamiento y mejorar la fiabilidad.

Escalabilidad y resiliencia

Escalabilidad y resiliencia

Gestiona cargas de tráfico variables escalando o reduciendo verticalmente de forma automática las aplicaciones, y habilita la autorreparación reiniciando o sustituyendo automáticamente los contenedores que hayan fallado.

Eficiencia de recursos

Eficiencia de recursos

Mejora la utilización de la infraestructura agrupando los contenedores de forma más densa en menos nodos, lo que puede suponer un ahorro de costes significativo.

Gestión de clústeres de Kubernetes

Aunque Kubernetes es increíblemente potente, configurar y operar un clúster de K8s seguro y apto para producción implica una sobrecarga operativa considerable. Es aquí donde un servicio gestionado como Google Kubernetes Engine (GKE) puede aportar un valor inmenso a los equipos empresariales. GKE puede ayudar a simplificar la gestión de clústeres de Kubernetes automatizando muchas de las tareas complejas y lentas.

GKE puede proporcionar un plano de control totalmente gestionado que se encargue de su disponibilidad, aplicación de parches y actualizaciones, para que tu equipo no tenga que hacerlo. Ofrece funciones como el modo Autopilot, que automatiza toda la gestión operativa del clúster, incluidos los nodos y el escalado, para reducir aún más la sobrecarga y optimizar el uso de los recursos. Con GKE, los desarrolladores pueden centrarse en escribir código y crear aplicaciones, mientras que la plataforma se encarga de la arquitectura y la infraestructura del clúster de Kubernetes subyacente, lo que garantiza que sea seguro, fiable y escalable.

Recursos de aprendizaje sobre clústeres de Kubernetes

- Consulta el curso de Google Skills para obtener más información sobre Kubernetes con GKE.

- Consulta la documentación oficial para desplegar un clúster y una carga de trabajo.

- Sigue la documentación para desplegar una aplicación en contenedores en un clúster de GKE.