详细了解 Apigee 专门为 AI 解决方案的开发、无缝应用集成和有效扩缩而设计的特定 AI 功能。

实现企业级 AI 网关

Apigee 的核心 API 网关功能包括用于管理 AI 应用流量的原生功能,可为服务使用提供一致的 API 合约。

功能包括:

- 模型抽象

- 多云模型路由

- 请求/响应扩充

- RAG 集成

- 代理与第三方系统的连接(使用 Google Cloud 的 Application Integration 平台)

- 用于实现高可用性的 LLM 断路器模式

- 语义缓存

资源

可编程 API 代理

通过将政策附加到 Apigee API 代理流中的不同点,可对 API 行为进行精细控制。布置方案可精确确定在请求和响应通过代理时何时应实施各项政策。

新一代集成:AI 驱动

利用生成式 AI 的强大功能构建高级自动化工作流。了解如何使用简单的自然语言连接 100 多种应用。了解生成式 AI 代理如何优化您在 Google Cloud 生态系统中的运营。

使用 Apigee 从 Vertex AI 部署 Hugging Face 模型

使用 Apigee 和 Vertex AI 构建 LLM API 网关。此实操演示介绍了如何为 LLM 端点创建代理,非常适合刚接触 Apigee 或集成 AI API 的开发者。了解 Apigee 如何保护、管理和优化您的 AI 应用。

支持基于企业背景信息的智能体工作流

AI 代理使用 LLM 的功能为最终用户完成任务。您可以使用各种工具来构建这些代理,例如 Agentspace 等无代码和低代码平台,以及 LangChain 或 LlamaIndex 等全代码框架。Apigee 充当 AI 应用与其代理之间的中介。

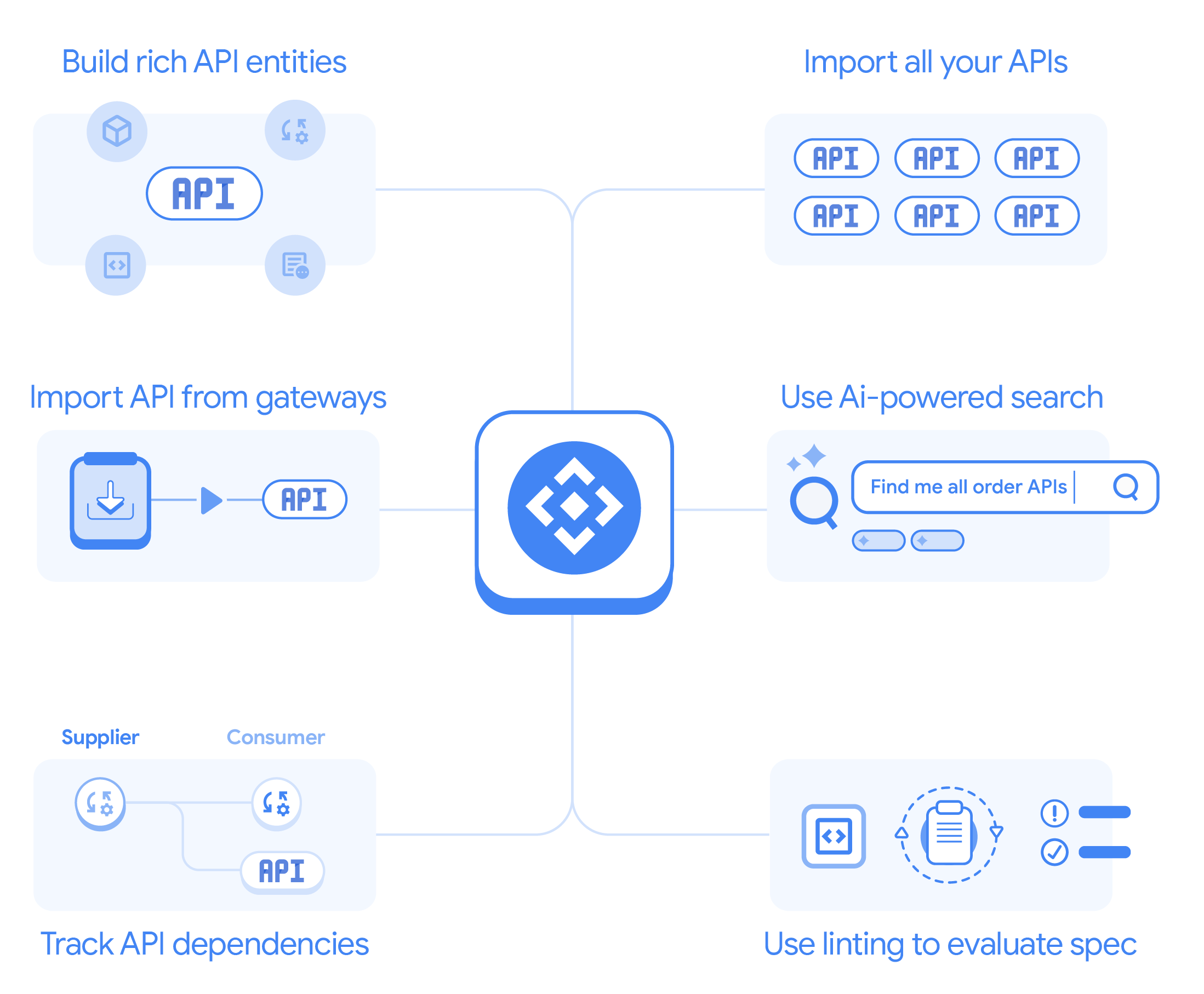

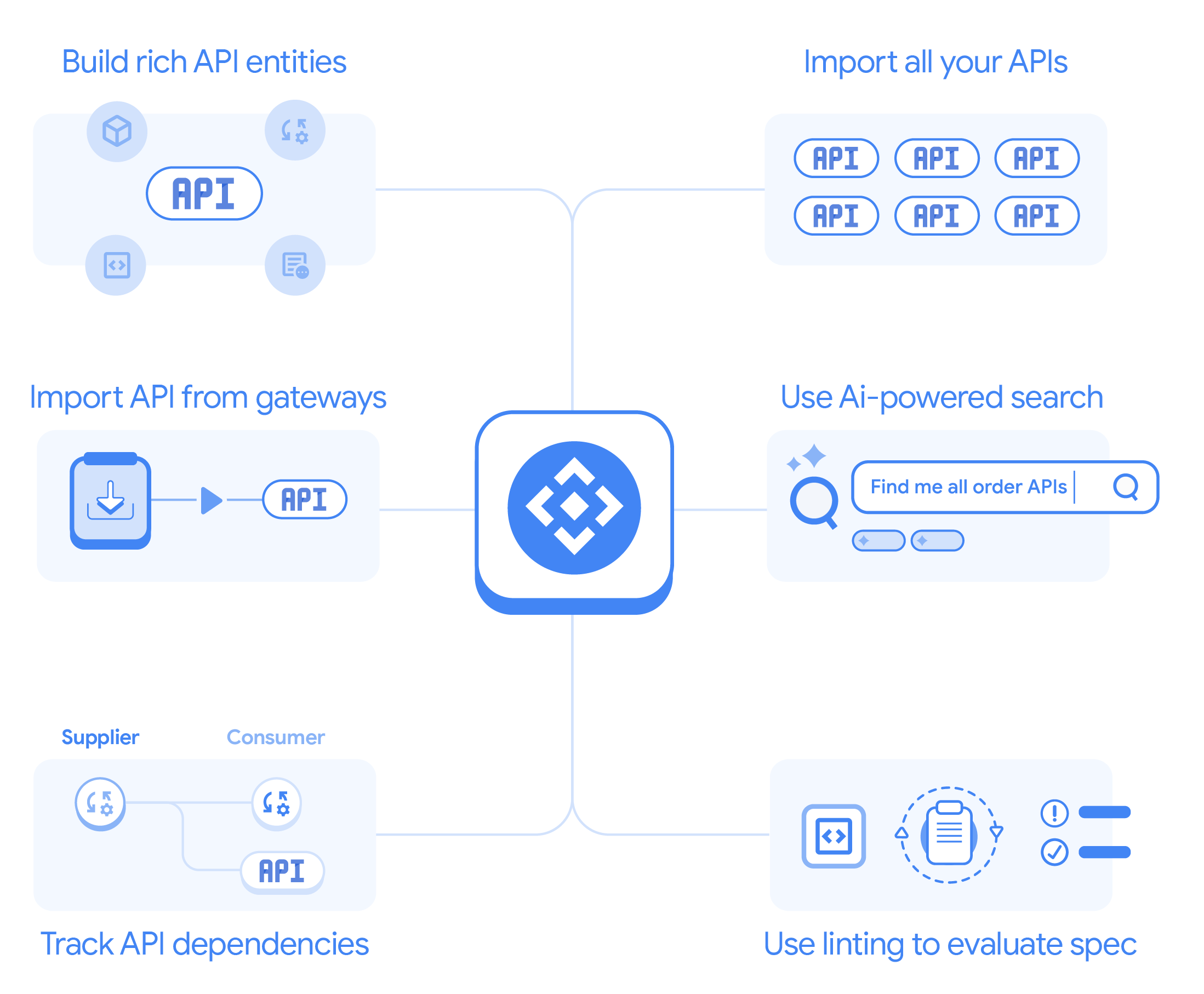

现在,借助 Apigee 中正式发布的 Gemini Code Assist,您可以在 Cloud Code 和 Gemini Chat 界面中使用自然语言快速创建 API 规范。通过 API Hub 利用组织的 API 生态系统,可提供企业上下文,用于通过嵌套对象支持和主动重复 API 检测,实现一致且安全的 API。

功能包括:

- Apigee API Hub,用于编制第一方和第三方 API 和工作流的目录

- 强制实施 token 限额,以控制费用

- 多代理编排

- 身份验证和授权

- 语义缓存,以优化性能

- 通过企业上下文中生成 API 规范(使用 Gemini Code Assist)

资源

文档:Apigee API Hub

Apigee API Hub 是 Google Cloud 上的集中式平台,可让您发现、管理和记录所有 API,从而更好地查看、控制、重用和治理 API,并加快 API 的开发速度。

博客:Apigee API Hub 现已正式发布

使用现已正式发布的 Apigee API Hub,集中发现、治理和管理您的所有 API。此平台为您的整个 API 环境提供单一管理平台,无论它们部署在何处,从而使团队能够简化运营并加强企业级 API 治理。

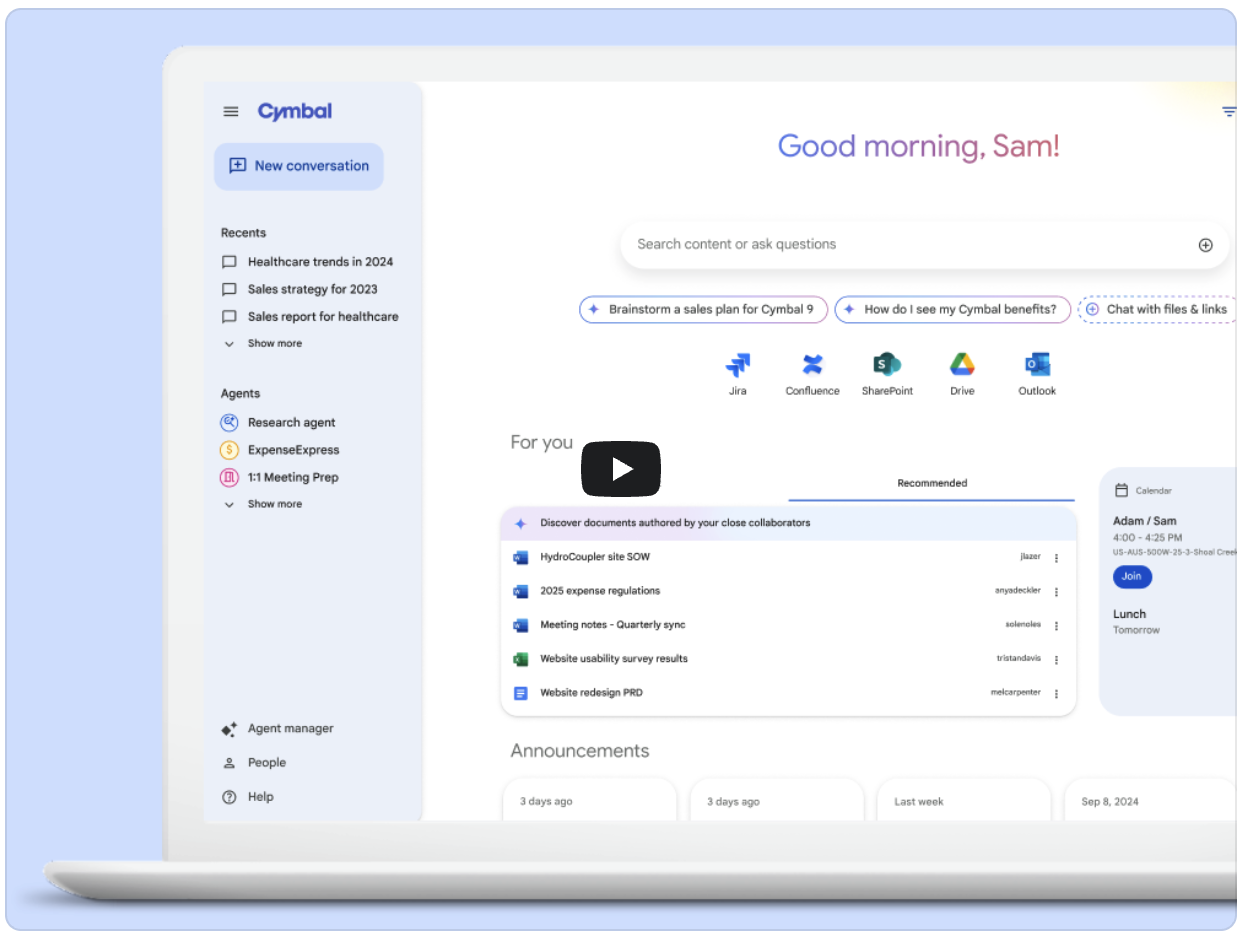

详细了解 Agentspace

利用 Google Cloud Agentspace 释放员工的潜能。通过公司数据的安全访问权限、AI 驱动的任务自动化以及智能数据洞见为员工赋能,让工作效率更上一层楼。

管理 LLM 的企业级访问权限和使用情况

Apigee 的原生政策和分发功能使生成式 AI 平台团队能够高效地管理 AI 应用以及 LLM 的使用情况。

功能包括:

- 集成式开发者门户,可自助访问模

- 基于政策的精细控制,用于控制模型访问权限和用量限额

- 监控和报告 token 用量限额

- LLM 审核和日志记录

确保 AI 应用的性能和高可用性

Apigee 可为 AI 应用提供深入的可观测性,帮助您管理和优化生成式 AI 费用,并高效管理组织的 AI 使用情况。

功能包括:

- 查看模型使用情况和应用 token 使用情况

- 内部费用报告和优化

- 自定义信息中心,可根据实际 token 数量监控使用情况(通过与 Looker Studio 集成)

- AI 应用的日志记录

保护 LLM API,同时保护最终用户和您的品牌

Apigee 充当 LLM API 的安全网关,让您可以使用 API 密钥、OAuth 2.0 和 JWT 验证来控制访问权限,并通过实施速率限制和配额来防止滥用和过载。Apigee Advanced API Security 可提供更高级的保护。

功能:

- Model Armor 集成和政策执行,以对提示和回答进行清理

- 身份验证和授权

- 滥用和异常检测

- 防范 OWASP 十大 API 和 LLM 安全风险

- LLM API 安全错误配置检测

- Google SecOps 与第三方 SIEM 集成

资源

Apigee Advanced API Security

使用 Google Cloud 的 Advanced API Security 保护您的 API。此服务会分析 API 流量和配置,在不影响性能的情况下阻止威胁。它会识别可疑请求以便进行拦截,还会提示配置错误。

白皮书:缓解 OWASP 十大 API 安全威胁

使用 Apigee 阻止 OWASP 十大 API 攻击。安全的身份验证、授权和威胁检测可保护您的业务。

博客:保护您的 API 免受 OWASP 十大安全威胁的危害

使用 Google Cloud 的 API 管理平台 Apigee 来保护您的 API,抵御身份验证机制失效和注入漏洞等重大威胁。

AI 网关

实现企业级 AI 网关

Apigee 的核心 API 网关功能包括用于管理 AI 应用流量的原生功能,可为服务使用提供一致的 API 合约。

功能包括:

- 模型抽象

- 多云模型路由

- 请求/响应扩充

- RAG 集成

- 代理与第三方系统的连接(使用 Google Cloud 的 Application Integration 平台)

- 用于实现高可用性的 LLM 断路器模式

- 语义缓存

资源

可编程 API 代理

通过将政策附加到 Apigee API 代理流中的不同点,可对 API 行为进行精细控制。布置方案可精确确定在请求和响应通过代理时何时应实施各项政策。

新一代集成:AI 驱动

利用生成式 AI 的强大功能构建高级自动化工作流。了解如何使用简单的自然语言连接 100 多种应用。了解生成式 AI 代理如何优化您在 Google Cloud 生态系统中的运营。

使用 Apigee 从 Vertex AI 部署 Hugging Face 模型

使用 Apigee 和 Vertex AI 构建 LLM API 网关。此实操演示介绍了如何为 LLM 端点创建代理,非常适合刚接触 Apigee 或集成 AI API 的开发者。了解 Apigee 如何保护、管理和优化您的 AI 应用。

AI 智能体

支持基于企业背景信息的智能体工作流

AI 代理使用 LLM 的功能为最终用户完成任务。您可以使用各种工具来构建这些代理,例如 Agentspace 等无代码和低代码平台,以及 LangChain 或 LlamaIndex 等全代码框架。Apigee 充当 AI 应用与其代理之间的中介。

现在,借助 Apigee 中正式发布的 Gemini Code Assist,您可以在 Cloud Code 和 Gemini Chat 界面中使用自然语言快速创建 API 规范。通过 API Hub 利用组织的 API 生态系统,可提供企业上下文,用于通过嵌套对象支持和主动重复 API 检测,实现一致且安全的 API。

功能包括:

- Apigee API Hub,用于编制第一方和第三方 API 和工作流的目录

- 强制实施 token 限额,以控制费用

- 多代理编排

- 身份验证和授权

- 语义缓存,以优化性能

- 通过企业上下文中生成 API 规范(使用 Gemini Code Assist)

资源

文档:Apigee API Hub

Apigee API Hub 是 Google Cloud 上的集中式平台,可让您发现、管理和记录所有 API,从而更好地查看、控制、重用和治理 API,并加快 API 的开发速度。

博客:Apigee API Hub 现已正式发布

使用现已正式发布的 Apigee API Hub,集中发现、治理和管理您的所有 API。此平台为您的整个 API 环境提供单一管理平台,无论它们部署在何处,从而使团队能够简化运营并加强企业级 API 治理。

详细了解 Agentspace

利用 Google Cloud Agentspace 释放员工的潜能。通过公司数据的安全访问权限、AI 驱动的任务自动化以及智能数据洞见为员工赋能,让工作效率更上一层楼。

AI 治理

管理 LLM 的企业级访问权限和使用情况

Apigee 的原生政策和分发功能使生成式 AI 平台团队能够高效地管理 AI 应用以及 LLM 的使用情况。

功能包括:

- 集成式开发者门户,可自助访问模

- 基于政策的精细控制,用于控制模型访问权限和用量限额

- 监控和报告 token 用量限额

- LLM 审核和日志记录

AI 可观测性

确保 AI 应用的性能和高可用性

Apigee 可为 AI 应用提供深入的可观测性,帮助您管理和优化生成式 AI 费用,并高效管理组织的 AI 使用情况。

功能包括:

- 查看模型使用情况和应用 token 使用情况

- 内部费用报告和优化

- 自定义信息中心,可根据实际 token 数量监控使用情况(通过与 Looker Studio 集成)

- AI 应用的日志记录

AI 安全性

保护 LLM API,同时保护最终用户和您的品牌

Apigee 充当 LLM API 的安全网关,让您可以使用 API 密钥、OAuth 2.0 和 JWT 验证来控制访问权限,并通过实施速率限制和配额来防止滥用和过载。Apigee Advanced API Security 可提供更高级的保护。

功能:

- Model Armor 集成和政策执行,以对提示和回答进行清理

- 身份验证和授权

- 滥用和异常检测

- 防范 OWASP 十大 API 和 LLM 安全风险

- LLM API 安全错误配置检测

- Google SecOps 与第三方 SIEM 集成

资源

Apigee Advanced API Security

使用 Google Cloud 的 Advanced API Security 保护您的 API。此服务会分析 API 流量和配置,在不影响性能的情况下阻止威胁。它会识别可疑请求以便进行拦截,还会提示配置错误。

白皮书:缓解 OWASP 十大 API 安全威胁

使用 Apigee 阻止 OWASP 十大 API 攻击。安全的身份验证、授权和威胁检测可保护您的业务。

博客:保护您的 API 免受 OWASP 十大安全威胁的危害

使用 Google Cloud 的 API 管理平台 Apigee 来保护您的 API,抵御身份验证机制失效和注入漏洞等重大威胁。

开发者资源

了解如何利用 Apigee 充分发掘生成式 AI 项目的潜力。

适合您的应用场景的 Apigee AI 解决方案

准备好发掘生成式 AI 的全部潜力了吗?

准备好发掘生成式 AI 的全部潜力了吗?

使用 Apigee 为您的解决方案发掘生成式 AI 的潜力。利用 Apigee 强大的运维功能,放心地构建安全、可伸缩且优化的部署。

准备好开始了吗?查看我们的 Apigee 生成式 AI 示例页面。