Cloud Composer 3 | Cloud Composer 2 | Cloud Composer 1

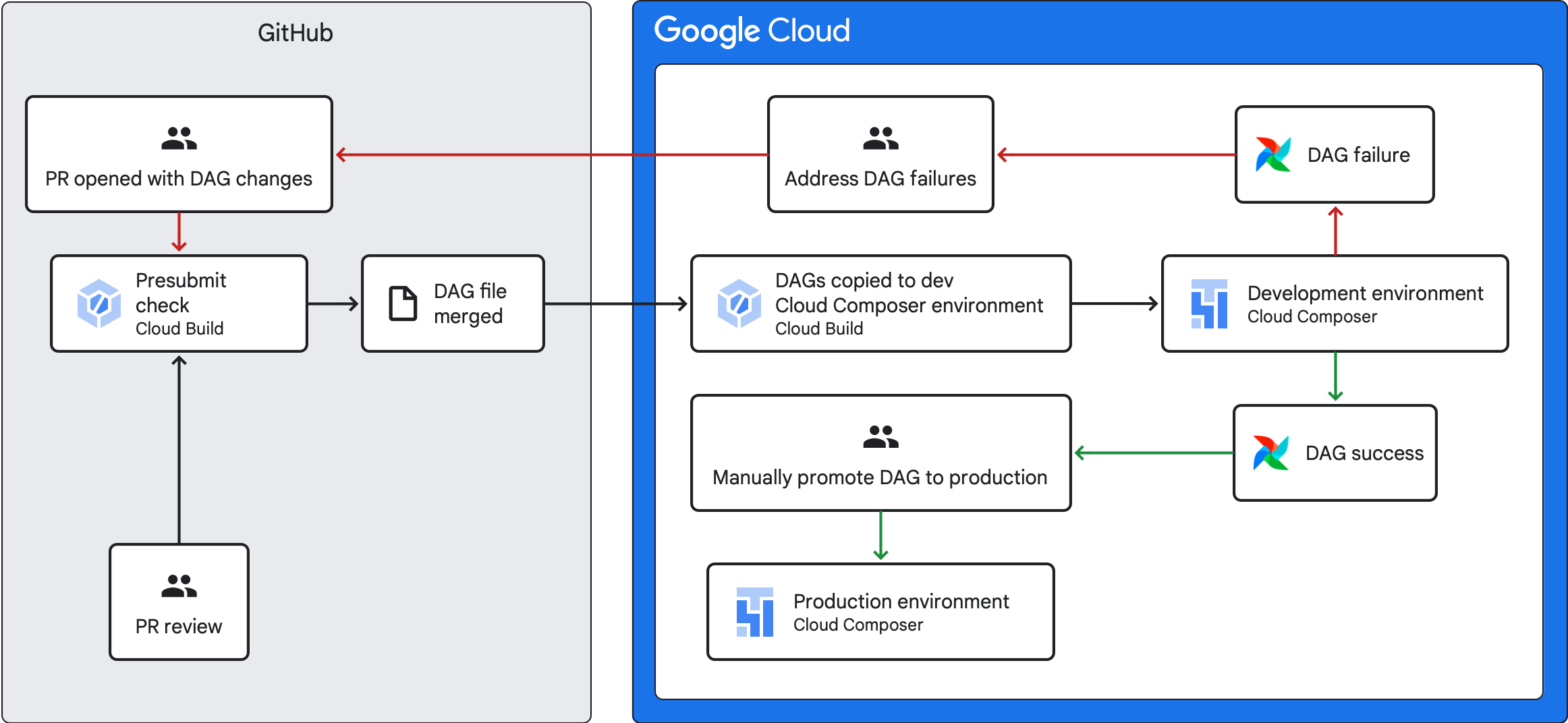

Ce guide explique comment créer un pipeline CI/CD pour tester, synchroniser et déployer des DAG dans votre environnement Cloud Composer à partir de votre dépôt GitHub.

Si vous souhaitez uniquement synchroniser les données d'autres services, consultez la section Transférer des données à partir d'autres services.

Présentation du pipeline CI/CD

Le pipeline CI/CD qui permet de tester, de synchroniser et de déployer des DAG comprend les étapes suivantes:

Vous modifiez un DAG et déployez cette modification dans une branche de développement de votre dépôt.

Vous ouvrez une demande d'extraction sur la branche principale de votre dépôt.

Cloud Build exécute des tests unitaires pour vérifier que votre DAG est valide.

Votre requête d'extraction est approuvée et fusionnée dans la branche principale de votre dépôt.

Cloud Build synchronise votre environnement Cloud Composer de développement avec ces nouvelles modifications.

Vous vérifiez que le DAG se comporte comme prévu dans votre environnement de développement.

Si votre DAG fonctionne comme prévu, importez-le dans votre environnement Cloud Composer de production.

Objectifs

Avant de commencer

Ce guide suppose que vous travaillez avec deux environnements Cloud Composer identiques: un environnement de développement et un environnement de production.

Pour les besoins de ce guide, vous ne configurez un pipeline CI/CD que pour votre environnement de développement. Assurez-vous que l'environnement que vous utilisez n'est pas un environnement de production.

Ce guide suppose que vous avez stocké vos DAG et leurs tests dans un dépôt GitHub.

L'exemple de pipeline CI/CD illustre le contenu d'un exemple de dépôt. Les DAG et les tests sont stockés dans le répertoire

dags/, avec les fichiers de spécifications, le fichier de contraintes et les fichiers de configuration Cloud Build stockés au niveau supérieur. L'utilitaire de synchronisation du DAG et ses exigences se trouvent dans le répertoireutils.Cette structure peut être utilisée pour les environnements Airflow 1, Airflow 2, Cloud Composer 1 et Cloud Composer 2.

Créer une tâche de vérification avant l'envoi et des tests unitaires

La première tâche Cloud Build exécute une vérification avant l'envoi, qui exécute des tests unitaires pour vos DAG.

Ajouter des tests unitaires

Si vous ne l'avez pas déjà fait, créez des tests unitaires pour vos DAG. Enregistrez ces tests à côté des DAG de votre dépôt, chacun avec le suffixe _test. Par exemple, le fichier de test du DAG dans example_dag.py est example_dag_test.py. Il s'agit des tests exécutés en tant que vérification préalable à l'envoi dans votre dépôt.

Créer une configuration YAML Cloud Build pour la vérification avant l'envoi

Dans votre dépôt, créez un fichier YAML nommé test-dags.cloudbuild.yaml qui configure votre tâche Cloud Build pour les vérifications préalables à l'envoi. Il comporte trois étapes:

- Installez les dépendances requises par vos DAG.

- Installez les dépendances requises par vos tests unitaires.

- Exécutez les tests du DAG.

Créer le déclencheur Cloud Build pour la vérification avant l'envoi

Suivez le guide Créer des dépôts à partir de GitHub pour créer un déclencheur basé sur une application GitHub avec les configurations suivantes:

Nom :

test-dagsÉvénement: demande d'extraction

Source : dépôt : sélectionnez votre dépôt.

Source - Branche de base:

^main$(remplacezmainpar le nom de la branche de base de votre dépôt, si nécessaire)Source : contrôle des commentaires : non obligatoire

Configuration de la compilation : fichier de configuration Cloud Build :

/test-dags.cloudbuild.yaml(chemin d'accès à votre fichier de compilation)

Créer une tâche de synchronisation de DAG et ajouter un script d'utilitaire de DAG

Ensuite, configurez une tâche Cloud Build qui exécute un script d'utilitaire DAG. Le script d'utilitaire de cette tâche synchronise vos DAG avec votre environnement Cloud Composer après leur fusion dans la branche principale de votre dépôt.

Ajouter le script d'utilitaire DAG

Ajoutez le script d'utilitaire DAG à votre dépôt. Ce script d'utilitaire copie tous les fichiers DAG du répertoire dags/ de votre dépôt dans un répertoire temporaire, en ignorant tous les fichiers Python autres que les DAG. Le script utilise ensuite la bibliothèque cliente Cloud Storage pour importer tous les fichiers de ce répertoire temporaire dans le répertoire dags/ du bucket de votre environnement Cloud Composer.

Créer une configuration YAML Cloud Build pour synchroniser des DAG

Dans votre dépôt, créez un fichier YAML nommé add-dags-to-composer.cloudbuild.yaml qui configure votre tâche Cloud Build pour la synchronisation des DAG. Il comporte deux étapes:

Installez les dépendances requises par le script d'utilitaire DAG.

Exécutez le script d'utilitaire pour synchroniser les DAG de votre dépôt avec votre environnement Cloud Composer.

Créer le déclencheur Cloud Build

Suivez le guide Créer des dépôts à partir de GitHub pour créer un déclencheur basé sur une application GitHub avec les configurations suivantes:

Nom :

add-dags-to-composerÉvénement: Déployer sur une branche

Source : dépôt : sélectionnez votre dépôt.

Source - Branche de base:

^main$(remplacezmainpar le nom de la branche de base de votre dépôt, si nécessaire)Source : filtre par fichiers inclus (glob) :

dags/**Configuration de la compilation : fichier de configuration Cloud Build :

/add-dags-to-composer.cloudbuild.yaml(chemin d'accès à votre fichier de compilation)

Dans la configuration avancée, ajoutez deux variables de substitution:

_DAGS_DIRECTORY: répertoire dans lequel se trouvent les dags dans votre dépôt. Si vous utilisez l'exemple de dépôt de ce guide, il s'agit dedags/._DAGS_BUCKET: bucket Cloud Storage contenant le répertoiredags/dans votre environnement de développement Cloud Composer. Omettez le préfixegs://. Par exemple,us-central1-example-env-1234ab56-bucket.

Tester votre pipeline CI/CD

Dans cette section, suivez un flux de développement de DAG qui utilise vos déclencheurs Cloud Build nouvellement créés.

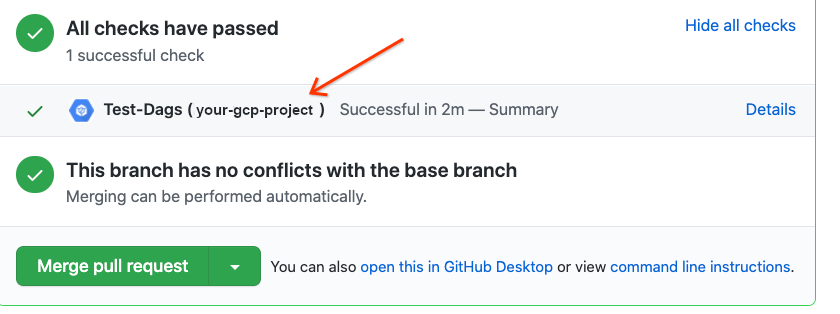

Exécuter une tâche de présoumission

Créez une demande d'extraction sur votre branche principale pour tester votre build. Recherchez votre vérification préalable à l'envoi sur la page. Cliquez sur Détails, puis sur Afficher plus de détails sur Google Cloud Build pour afficher vos journaux de compilation dans la console Google Cloud.

Si votre vérification préalable à l'envoi a échoué, consultez Résoudre les échecs de compilation.

Vérifier que votre DAG fonctionne dans votre environnement Cloud Composer de développement

Une fois votre demande d'extraction approuvée, fusionnez-la avec votre branche principale. Utilisez la console Google Cloud pour afficher les résultats de votre compilation. Si vous disposez de nombreux déclencheurs Cloud Build, vous pouvez filtrer vos compilations en fonction du nom du déclencheur add-dags-to-composer.

Une fois la tâche de synchronisation Cloud Build terminée, le DAG synchronisé apparaît dans votre environnement Cloud Composer de développement. Vous pouvez alors vérifier que le DAG fonctionne comme prévu.

Ajouter le DAG à votre environnement de production

Une fois que le DAG fonctionne comme prévu, ajoutez-le manuellement à votre environnement de production. Pour ce faire, importez le fichier DAG dans le répertoire dags/ du bucket de votre environnement Cloud Composer de production.

Si votre tâche de synchronisation de DAG a échoué ou si votre DAG ne se comporte pas comme prévu dans votre environnement Cloud Composer de développement, consultez la section Résoudre les échecs de compilation.

Résoudre les échecs de compilation

Cette section explique comment résoudre les scénarios d'échec de compilation courants.

Que faire si la vérification préalable à l'envoi a échoué ?

Dans votre demande de tirage, cliquez sur Détails, puis sélectionnez Afficher plus d'informations sur Google Cloud Build pour afficher vos journaux de compilation dans la console Google Cloud. Utilisez ces journaux pour vous aider à déboguer le problème lié à votre DAG. Une fois les problèmes résolus, validez la correction et effectuez un push vers votre branche. La vérification préalable à l'envoi s'exécute à nouveau, et vous pouvez continuer à itérer en utilisant les journaux comme outil de débogage.

Que faire si mon travail de synchronisation DAG a échoué ?

Utilisez la console Google Cloud pour afficher les résultats de votre compilation. Si vous disposez de nombreux déclencheurs Cloud Build, vous pouvez filtrer vos compilations en fonction du nom du déclencheur add-dags-to-composer. Examinez les journaux de la tâche de compilation et corrigez les erreurs. Si vous avez besoin d'aide supplémentaire pour résoudre les erreurs, utilisez les canaux d'assistance.

Que faire si mon DAG ne fonctionne pas correctement dans mon environnement Cloud Composer ?

Si votre DAG ne fonctionne pas comme prévu dans votre environnement Cloud Composer de développement, ne le promouvez pas manuellement dans votre environnement Cloud Composer de production. Effectuez plutôt l'une des opérations suivantes :

- Annulez la demande de tirage avec les modifications qui ont endommagé votre DAG pour le restaurer à l'état immédiatement antérieur à vos modifications (cela annule également tous les autres fichiers de cette demande de tirage).

- Créez une nouvelle demande d'extraction pour annuler manuellement les modifications apportées au DAG défectueux.

- Créez une demande de tirage pour corriger les erreurs de votre DAG.

Le suivi de l'une de ces étapes déclenche un nouveau contrôle avant envoi et, lors de la fusion, la tâche de synchronisation du DAG.

Étape suivante

- Exécuter des environnements Airflow locaux

- Écrire des DAG

- Planifier et déclencher des DAG

- Tester les DAG