¿Qué es AI Hypercomputer?

¿Qué es AI Hypercomputer?

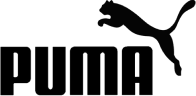

Una arquitectura que combina hardware diseñado específicamente, software libre y un consumo flexible. Cada componente se integra cuidadosamente para que funcione bien con los demás, lo que mejora el rendimiento, el coste y la productividad de los desarrolladores.

Consulta los últimos anuncios (abril del 2026): Novedades en la infraestructura de IA de Google: escalabilidad para la era de los agentes

Entrenamiento más inteligente y rápido

Entrenamiento más inteligente y rápido

Crea modelos en semanas, no en meses. Usa la pila de entrenamiento de Google para acelerar el desarrollo y las pruebas sin sacrificar el rendimiento.

Entrena y ajusta LLMs más rápido

Desarrolla LLMs un 36% más rápido y aprovecha hasta un 97% de productividad (Goodput) de cada acelerador usando TPU 8t junto con software diseñado en colaboración con Google DeepMind e integrado con frameworks de código abierto, desde Pathways hasta Pallas (entrenamiento) y desde Ray hasta Agent Sandbox (ajuste). También sabemos que no hay una solución única para todos los casos, por lo que colaboramos estrechamente con NVIDIA para ofrecer las GPUs más recientes. Google Cloud será una de las primeras plataformas en ofrecer instancias basadas en la GPU de próxima generación NVIDIA Vera Rubin NVL72 cuando esté disponible a finales de este año.

Entrena modelos ligeros de forma más inteligente con datos propios

Usa Gemini Enterprise Agent Platform con BigQuery para entrenar modelos con datos propios 16 veces más rápido combinando tu patrimonio de datos, el desarrollo de aprendizaje automático y los aceleradores en un solo lugar. Ambos están basados en AI Hypercomputer, tanto si usas máquinas virtuales G4 como TPUs Ironwood.

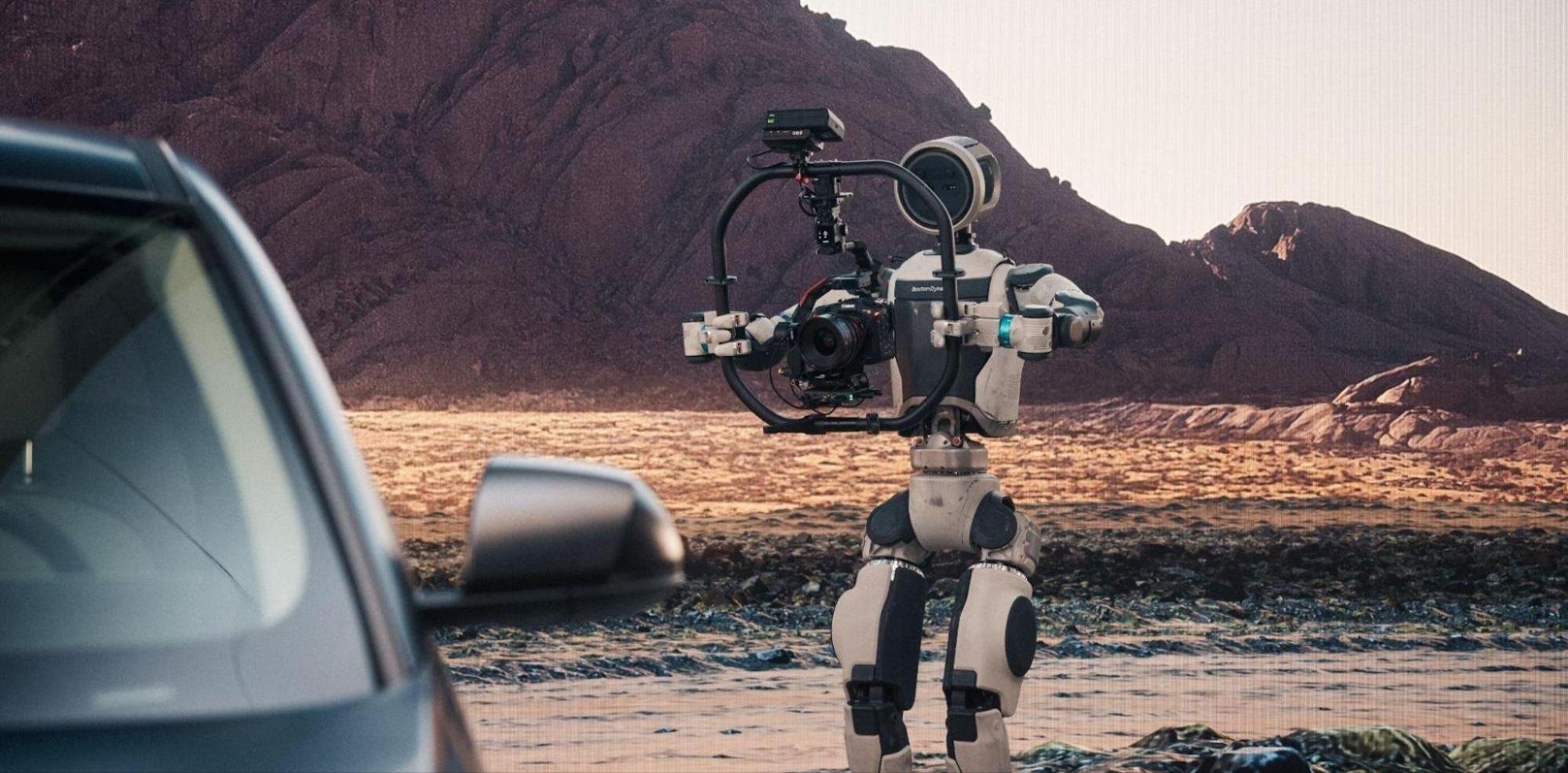

Crea agentes físicos adaptativos con MuJoCo-Warp

Ejecuta simulaciones basadas en GPU en MuJoCo-Warp de DeepMind, hasta 100 veces más rápido que con MuJoCo estándar. Después, simula casos extremos imposibles, arriesgados o caros usando medios sintéticos de Veo, Genie y Nano Banana, o ingiere petabytes de datos de sensores del mundo real en BigQuery. Consulta más información sobre cómo crear agentes físicos en Google Cloud aquí.

Inferencia eficiente y con capacidad de respuesta

Inferencia eficiente y con capacidad de respuesta

Obtén perfiles de modelos validados, además de software de Google y de código abierto totalmente integrado, para mejorar la capacidad de respuesta de las aplicaciones con menos complejidad y desperdicio.

Sirve LLMs con una latencia casi nula

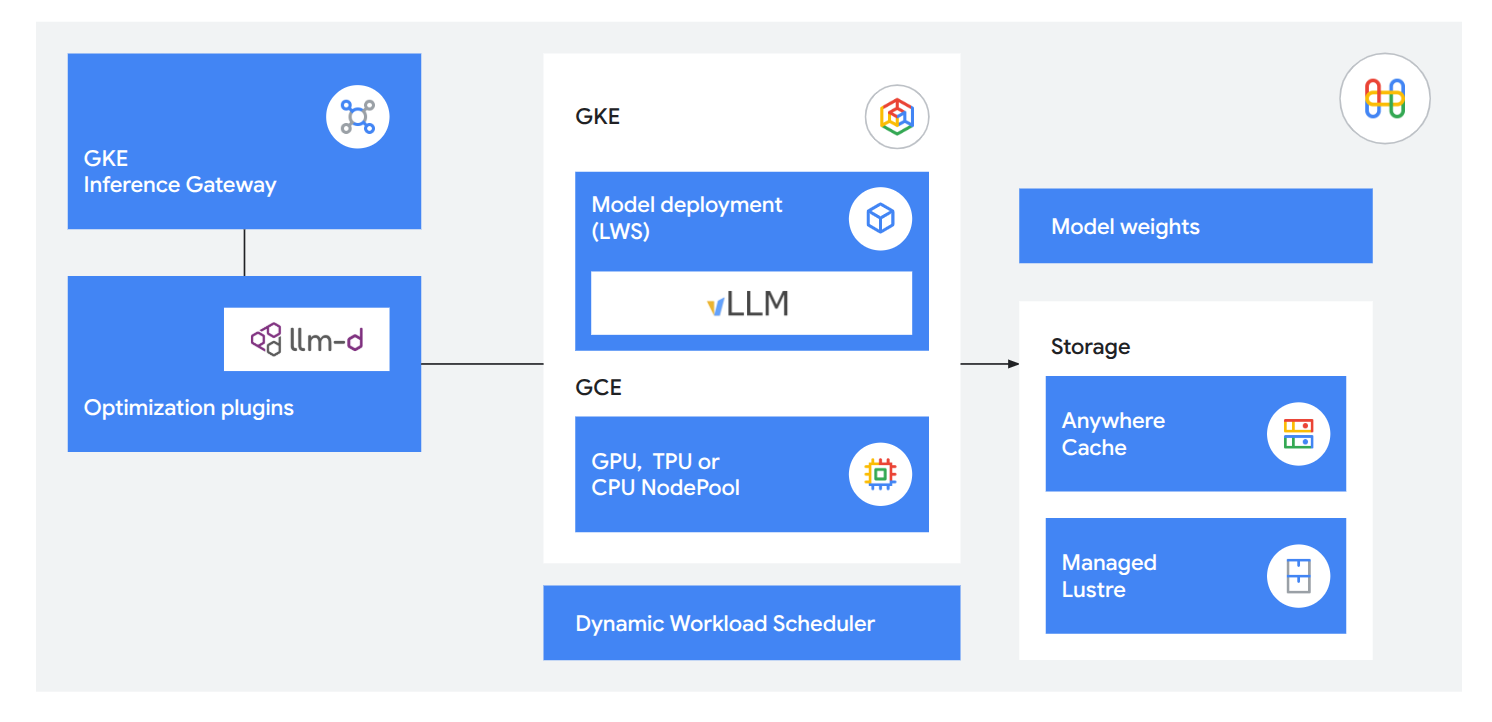

Usa tecnologías de inferencia integradas para ofrecer servicios útiles y con capacidad de respuesta a los clientes. Reduce el tiempo hasta el primer token en un 71% con GKE Inference Gateway, sirve hasta 120.000 tokens por segundo usando llm-d para el servicio desagregado y carga modelos 5 veces más rápido usando Anywhere Cache y TPU 8i para mantener tu memoria de trabajo exactamente donde se necesita.

Servir modelos visuales, de percepción y de medios prediseñados

Implementa modelos de aprendizaje automático clásicos un 70% más rápido usando uno de los más de 200 modelos disponibles en Gemini Enterprise Agent Platform, con la TPU o GPU que prefieras, incluidas las máquinas virtuales A5X (NVIDIA Vera Rubin) y las TPU 8i cuando estén disponibles a finales de este año.

Sirve agentes de forma segura y rentable

Sirve enjambres de agentes de forma segura en GKE Agent Sandbox, aprovisionando hasta 300 entornos aislados por segundo y pausando y reanudando al instante según sea necesario, para que nunca pagues por agentes inactivos.

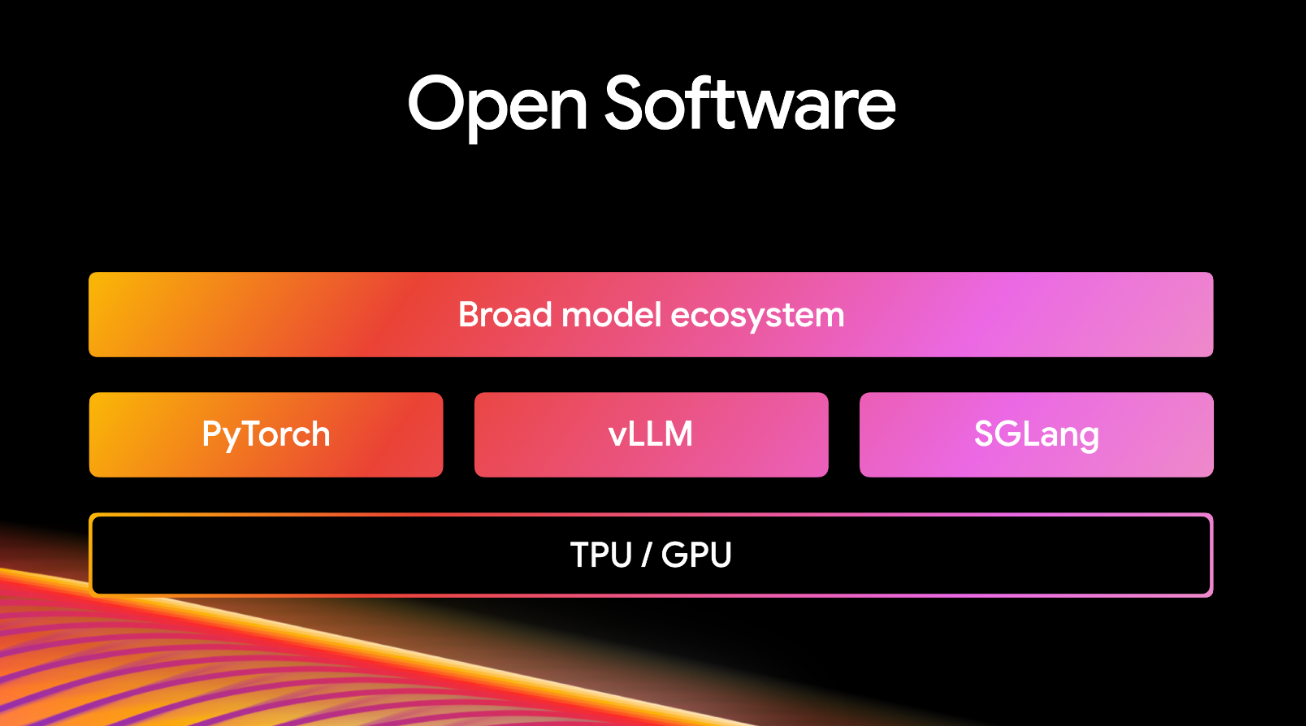

Operaciones flexibles, abiertas y fiables

Operaciones flexibles, abiertas y fiables

Usa cualquier framework o acelerador en entornos híbridos y multinube con mantenimiento y gestión de clústeres automatizados aptos para la exaescala.

Cambia entre TPUs y GPUs sin tener que reescribir el código

TorchTPU elimina la curva de aprendizaje de las TPUs para los desarrolladores, ya que ofrece compatibilidad nativa con PyTorch. De esta forma, puedes usar el mejor acelerador disponible sin tener que reescribir el código de forma compleja.

Despliega la IA en cualquier entorno y a prácticamente cualquier escala

GKE, que se basa en Kubernetes de código abierto, te ofrece portabilidad multinube a escala empresarial, ya que admite hasta 130.000 nodos y se integra de forma nativa con Agent Platform y Google Distributed Cloud para despliegues híbridos.

Automatiza el mantenimiento de clústeres con herramientas avanzadas de diagnóstico y observabilidad

Todos los aceleradores de AI Hypercomputer cuentan con funciones de director de clúster, como un informe de estado previo a la implementación, paneles de observabilidad de 360 grados y comprobaciones de estado continuas.

Conecta cargas de trabajo multinube en cuestión de minutos en lugar de semanas

Conecta servicios en distintas nubes sin que las conexiones se ralenticen gracias a Red Multinube, una red troncal de confianza para más del 65% de las empresas de la lista Fortune 100 que mueve más de 27 exabytes de datos al mes.

Consigue capacidad de aceleración a tu manera

Nuestros modelos de consumo flexibles te ofrecen varias formas de programar y reducir el coste de los aceleradores. Ahorra hasta un 91% en tareas por lotes o tolerantes a fallos con las máquinas virtuales de acceso puntual, hasta un 50% en tareas con una fecha de inicio flexible con Dynamic Workload Scheduler y hasta un 50% al registrarte para obtener descuentos por compromiso de uso.

Sistemas preparados para agentes

Sistemas preparados para agentes

Supera los límites del rendimiento y usa la energía de forma responsable a medida que escalas en la infraestructura en la que confían Google y los laboratorios de IA de vanguardia

Reduce los riesgos de tu hoja de ruta de IA con una base de confianza

Google Cloud da servicio a 9 de los 10 principales laboratorios de IA y al 70 % de las startups de IA financiadas. Al desplegar tu solución en AI Hypercomputer, usas centros de datos que procesaron de forma fiable más de 100.000 millones de tokens para casi 350 clientes solo en diciembre del 2025.

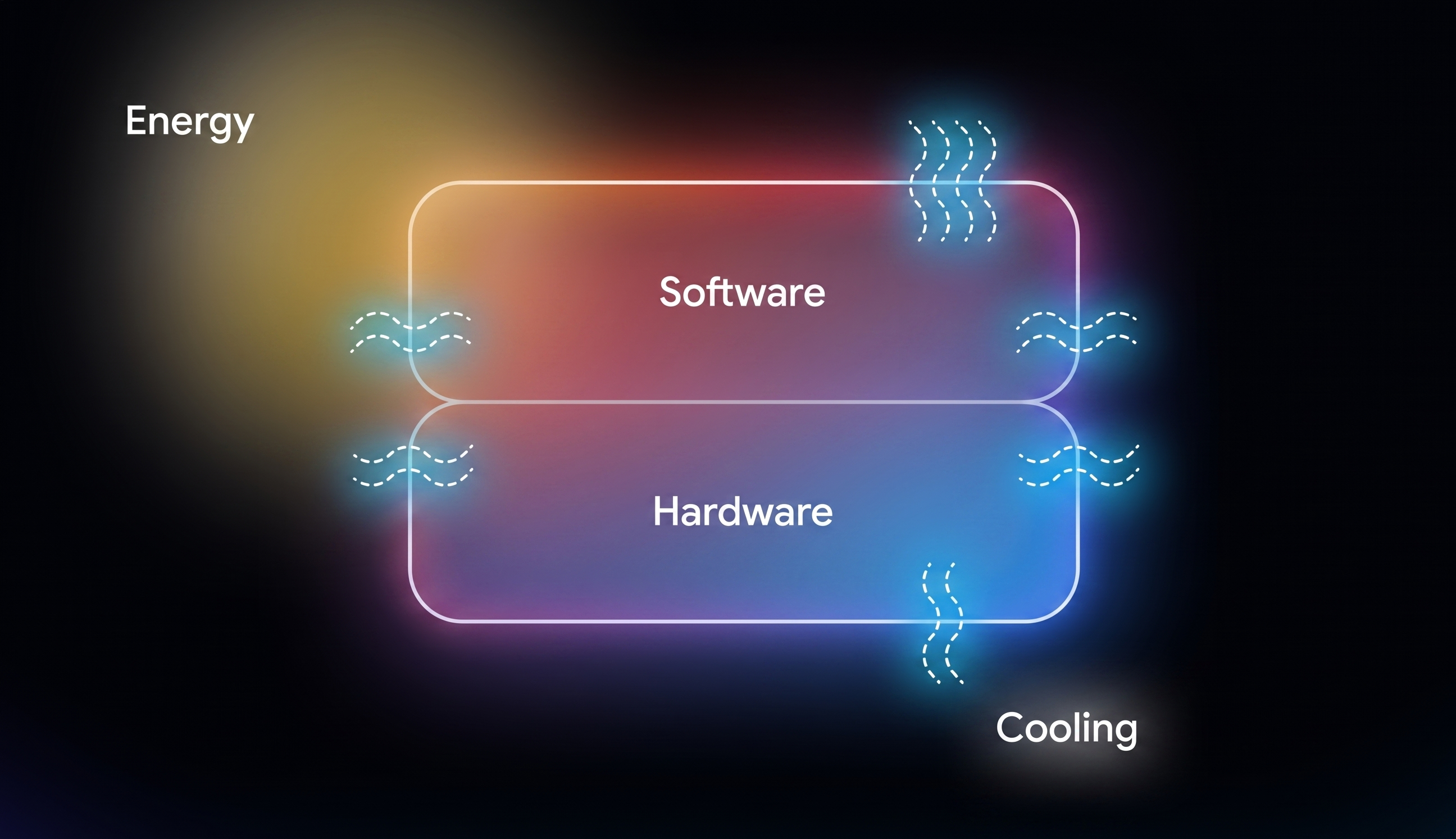

Consigue una eficiencia energética líder en el sector

Los centros de datos de Google Cloud, incluido AI Hypercomputer, ofrecen una eficiencia energética líder en el sector, con seis veces más potencia de computación por unidad de electricidad que hace cinco años. Esto permite que nuestra TPU de 8.ª generación ofrezca una relación precio-rendimiento un 80% mejor y un 20% más de eficiencia energética que la generación anterior.

Reduce tu impacto en la red eléctrica y en las comunidades

Google se compromete a pagar el 100% de la energía que usan nuestros centros de datos y los costes de cualquier infraestructura nueva que se derive directamente de nuestro crecimiento. Colabora con nosotros para que, a medida que aumenten tus ambiciones en materia de IA, los hogares y las empresas locales no tengan que pagar la factura. En los próximos años, financiaremos nuevas fuentes de energía e infraestructuras para nuestros modelos, y seguiremos invirtiendo en fuentes de energía alternativas como la energía nuclear avanzada, la geotérmica y el almacenamiento de larga duración.

Protege tu IP más valiosa desde el silicio hasta el perímetro

La arquitectura Titanium, con sus chips Titan personalizados, ofrece una raíz de confianza de hardware verificable y seguridad de confianza cero. Un análisis independiente de cloudvulndb.org muestra que nuestros sistemas experimentan hasta un 70% menos de vulnerabilidades críticas que otras nubes líderes.

Impulsamos a los innovadores líderes del mundo

Más información sobre AI Hypercomputer

- IDC: el valor empresarial de AI HypercomputerEste informe de IDC analiza el impacto real que tiene AI Hypercomputer en los clientes que usan cargas de trabajo de IA. Lee el informe completo para ver datos de clientes que ilustran una mejora del 353 % en el ROI, un 55 % más de eficiencia en los equipos de TI y un 67 % menos de tiempo de inactividad no planificado en aplicaciones o cargas de trabajo.

Lectura de 5 minutos

Leer el informe - Google ha sido designado como uno de los líderes en servicios de plataforma estratégica en la nube en el informe Magic Quadrant de Gartner®.Por octavo año consecutivo, Gartner® ha nombrado a Google como una empresa líder en servicios de plataforma estratégica en la nube en el Magic Quadrant™ de Gartner. Este año, sin embargo, marca un hito histórico: Google se sitúa ahora a la vanguardia por su integridad de visión.

Lectura de 5 minutos

Ver resultados - Google recibe la designación de líder en el informe The Forrester Wave™ sobre soluciones de infraestructura de IA del cuarto trimestre del 2025Google ha recibido la puntuación más alta de todos los proveedores en la categoría de oferta actual y ha conseguido la máxima puntuación posible en 16 de los 19 criterios de evaluación, entre los que se incluyen, entre otros, los siguientes: visión, arquitectura, formación, inferencia, eficiencia y seguridad.

Lectura de 5 minutos

Ver resultados

- Diseña y despliega tu primera pila de inferenciaDescubre los componentes esenciales que forman una solución de inferencia en Google Cloud, como GKE, las TPUs de Cloud, TensorFlow, PyTorch, JAX y Keras.

Curso de 2 horas

Realizar el curso - Usa vLLM en GKE para servir la inferencia de Gemma 3 27BEn este tutorial se explica cómo desplegar y servir un modelo de lenguaje extenso (LLM) Gemma 3 de 27.000 millones de parámetros con el framework de servicio vLLM. Despliegas Gemma 3 en una sola instancia de máquina virtual (VM) A4 en Google Kubernetes Engine (GKE).

Guía de 15 minutos

Consultar el tutorial - Ajusta Gemma 3 en un clúster de GKE A4En este tutorial se explica cómo ajustar un modelo de lenguaje extenso (LLM) Gemma 3 en un clúster de GKE multinodo y multiGPU en Google Cloud. Este clúster usa una instancia de máquina virtual (VM) A4 que tiene 8 GPUs NVIDIA B200.

Guía de 15 minutos

Consultar el tutorial

- Entrenar Qwen2 en un clúster de Slurm A4En este tutorial se explica cómo entrenar un modelo de lenguaje extenso (LLM) en un clúster de Slurm de varios nodos y varias GPUs en Google Cloud. El modelo que se usa en este tutorial se basa en un modelo de 1500 millones de parámetros de Qwen2. El clúster de Slurm usa dos máquinas virtuales (VMs) a4-highgpu-8g, cada una con 8 GPUs NVIDIA B200.

Guía de 15 minutos

Consultar el tutorial - Sirve Qwen2-7B-Instruct con vLLM en TPUsEn este tutorial, se sirve el modelo Qwen/Qwen2-7B-Instruct mediante el framework de servicio de TPUs vLLM en una VM de TPU v6e.

Guía de 15 minutos

Consultar el tutorial

- Empieza aquíConsulta toda la documentación disponible sobre AI Hypercomputer, que incluye información sobre la arquitectura, el despliegue, la gestión, las pruebas y la optimización.Leer toda la documentación

- Recomendaciones de entrenamientoDescubre tus opciones de aceleradores, los modelos de consumo recomendados y los servicios de almacenamiento que puedes usar en la fase anterior al entrenamiento de modelos.

Lectura de 15 minutos

Consultar la documentación - Recomendaciones para la inferenciaDescubre las opciones de aceleradores, los modelos de consumo recomendados y el servicio de almacenamiento que puedes usar para la inferencia.

Lectura de 15 minutos

Consultar la documentación

Información valiosa de analistas

- IDC: el valor empresarial de AI HypercomputerEste informe de IDC analiza el impacto real que tiene AI Hypercomputer en los clientes que usan cargas de trabajo de IA. Lee el informe completo para ver datos de clientes que ilustran una mejora del 353 % en el ROI, un 55 % más de eficiencia en los equipos de TI y un 67 % menos de tiempo de inactividad no planificado en aplicaciones o cargas de trabajo.

Lectura de 5 minutos

Leer el informe - Google ha sido designado como uno de los líderes en servicios de plataforma estratégica en la nube en el informe Magic Quadrant de Gartner®.Por octavo año consecutivo, Gartner® ha nombrado a Google como una empresa líder en servicios de plataforma estratégica en la nube en el Magic Quadrant™ de Gartner. Este año, sin embargo, marca un hito histórico: Google se sitúa ahora a la vanguardia por su integridad de visión.

Lectura de 5 minutos

Ver resultados - Google recibe la designación de líder en el informe The Forrester Wave™ sobre soluciones de infraestructura de IA del cuarto trimestre del 2025Google ha recibido la puntuación más alta de todos los proveedores en la categoría de oferta actual y ha conseguido la máxima puntuación posible en 16 de los 19 criterios de evaluación, entre los que se incluyen, entre otros, los siguientes: visión, arquitectura, formación, inferencia, eficiencia y seguridad.

Lectura de 5 minutos

Ver resultados

Tutoriales

- Diseña y despliega tu primera pila de inferenciaDescubre los componentes esenciales que forman una solución de inferencia en Google Cloud, como GKE, las TPUs de Cloud, TensorFlow, PyTorch, JAX y Keras.

Curso de 2 horas

Realizar el curso - Usa vLLM en GKE para servir la inferencia de Gemma 3 27BEn este tutorial se explica cómo desplegar y servir un modelo de lenguaje extenso (LLM) Gemma 3 de 27.000 millones de parámetros con el framework de servicio vLLM. Despliegas Gemma 3 en una sola instancia de máquina virtual (VM) A4 en Google Kubernetes Engine (GKE).

Guía de 15 minutos

Consultar el tutorial - Ajusta Gemma 3 en un clúster de GKE A4En este tutorial se explica cómo ajustar un modelo de lenguaje extenso (LLM) Gemma 3 en un clúster de GKE multinodo y multiGPU en Google Cloud. Este clúster usa una instancia de máquina virtual (VM) A4 que tiene 8 GPUs NVIDIA B200.

Guía de 15 minutos

Consultar el tutorial

- Entrenar Qwen2 en un clúster de Slurm A4En este tutorial se explica cómo entrenar un modelo de lenguaje extenso (LLM) en un clúster de Slurm de varios nodos y varias GPUs en Google Cloud. El modelo que se usa en este tutorial se basa en un modelo de 1500 millones de parámetros de Qwen2. El clúster de Slurm usa dos máquinas virtuales (VMs) a4-highgpu-8g, cada una con 8 GPUs NVIDIA B200.

Guía de 15 minutos

Consultar el tutorial - Sirve Qwen2-7B-Instruct con vLLM en TPUsEn este tutorial, se sirve el modelo Qwen/Qwen2-7B-Instruct mediante el framework de servicio de TPUs vLLM en una VM de TPU v6e.

Guía de 15 minutos

Consultar el tutorial

Documentación

- Empieza aquíConsulta toda la documentación disponible sobre AI Hypercomputer, que incluye información sobre la arquitectura, el despliegue, la gestión, las pruebas y la optimización.Leer toda la documentación

- Recomendaciones de entrenamientoDescubre tus opciones de aceleradores, los modelos de consumo recomendados y los servicios de almacenamiento que puedes usar en la fase anterior al entrenamiento de modelos.

Lectura de 15 minutos

Consultar la documentación - Recomendaciones para la inferenciaDescubre las opciones de aceleradores, los modelos de consumo recomendados y el servicio de almacenamiento que puedes usar para la inferencia.

Lectura de 15 minutos

Consultar la documentación