Proteggi l'innovazione dell'AI senza interruzioni

Proteggi l'innovazione dell'AI senza interruzioni

L'innovazione non può crescere senza sicurezza. Scopri come creare, eseguire il deployment e gestire l'AI in modo responsabile, con visibilità, controllo e fiducia integrati in ogni livello.

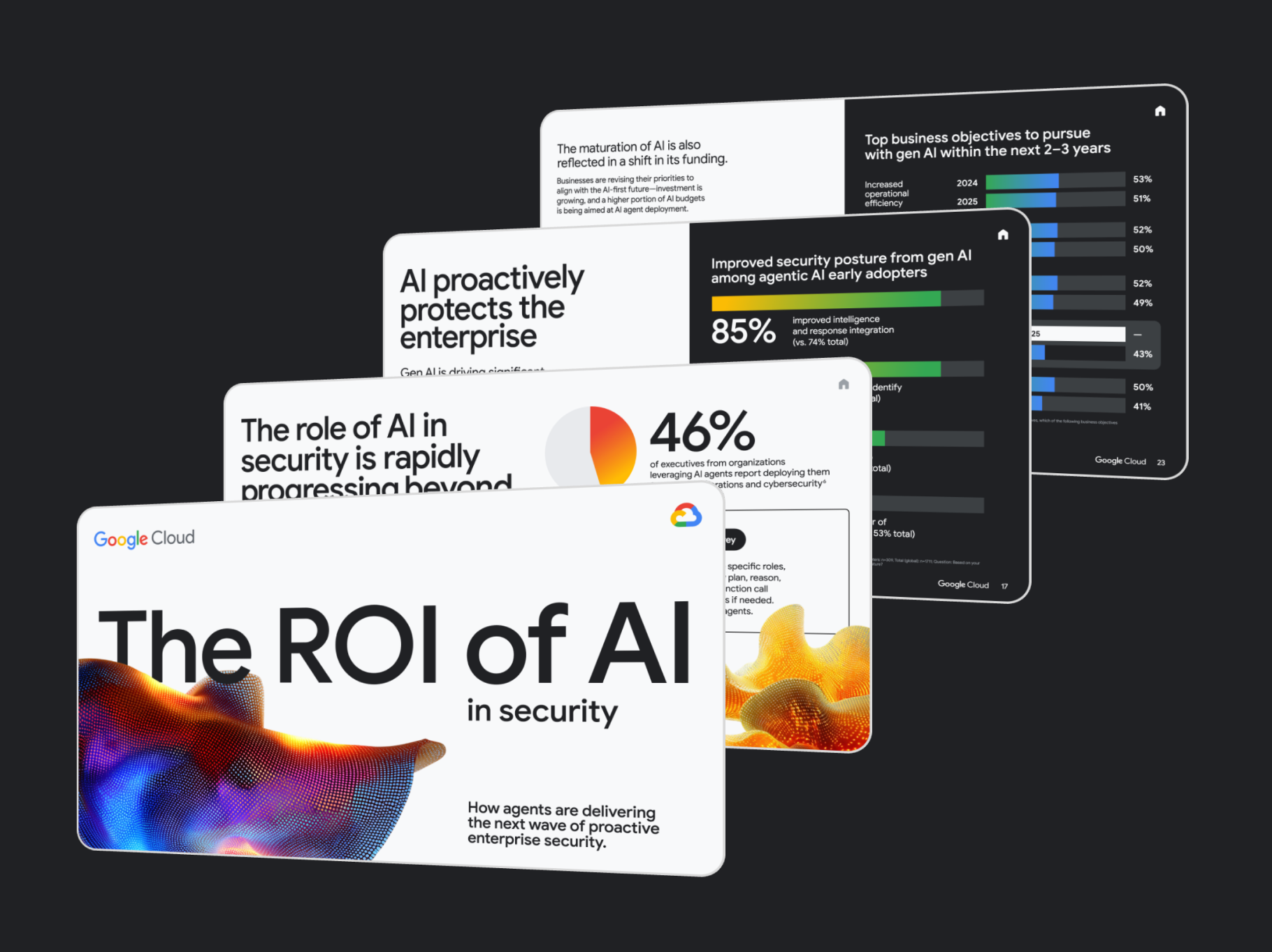

Il ROI dell'AI nella sicurezza

Google Cloud aiuta i team a creare, eseguire il deployment e gestire l'AI in modo responsabile

Google Cloud aiuta i team a creare, eseguire il deployment e gestire l'AI in modo responsabile

Proteggi la tua innovazione AI con Google Cloud IAM

Scopri le ultime innovazioni in materia di IAM, rischio di accesso, governance cloud e assistenza basata su Gemini.

Proteggere le basi

Proteggi la tua innovazione AI con Google Cloud IAM

Scopri le ultime innovazioni in materia di IAM, rischio di accesso, governance cloud e assistenza basata su Gemini.

Protezione del ciclo di vita dell'AI

Autonomia non supervisionata: come proteggere gli agenti AI e limitare i rischi

Scopri in che modo Google Cloud aiuta a proteggere l'intero ciclo di vita dell'agente AI con visibilità, protezione dei dati e mitigazione delle minacce.

Creare fiducia attraverso la trasparenza e la sovranità

Sovereign Cloud di Google: la potenza della scelta

Scopri come Sovereign Cloud di Google offre la possibilità di scegliere con controlli di residenza, accesso e trasparenza.

Risultati concreti: protezione dell'AI su larga scala

Organizzazioni di tutti i settori stanno già utilizzando le funzionalità di protezione dell'AI per scalare l'AI in modo sicuro e con fiducia.

Proteggi il futuro

Esplora le ultime strategie di threat intelligence e sicurezza basate sull'AI per proteggere e accelerare la tua innovazione.

Lo stato della sicurezza e della governance dell'AIScarica il report completo del sondaggio per comprendere lo stato critico della sicurezza e della governance dell'AI e scoprire come creare le policy mature necessarie per accelerare l'adozione con sicurezza.Scarica il report

Lo stato della sicurezza e della governance dell'AIScarica il report completo del sondaggio per comprendere lo stato critico della sicurezza e della governance dell'AI e scoprire come creare le policy mature necessarie per accelerare l'adozione con sicurezza.Scarica il report Cybersecurity Forecast 2026Esplora il futuro delle minacce basate sull'AI. Scopri come gli aggressori stanno mettendo in pratica "Shadow Agents", deepfake e prompt injection e come i difensori possono stare al passo.Scarica la previsione

Cybersecurity Forecast 2026Esplora il futuro delle minacce basate sull'AI. Scopri come gli aggressori stanno mettendo in pratica "Shadow Agents", deepfake e prompt injection e come i difensori possono stare al passo.Scarica la previsione Reinventare il SOC con l'AI agenticaScopri come reinventare le tue operazioni di sicurezza con l'AI agentica per ridurre i rischi, aumentare la velocità e potenziare l'intero team di sicurezza.Scarica l'ebook

Reinventare il SOC con l'AI agenticaScopri come reinventare le tue operazioni di sicurezza con l'AI agentica per ridurre i rischi, aumentare la velocità e potenziare l'intero team di sicurezza.Scarica l'ebook

Iniziamo?

Google Cloud ti fornisce i framework, i controlli e le competenze per innovare in modo responsabile, dal modello al mercato. Che tu stia valutando il rischio, strutturando la governance o implementando agenti autonomi, ti offriamo un percorso chiaro da seguire.

- Applica il Secure AI Framework (SAIF)Approfondisci un approccio pratico per affrontare le sfide della sicurezza dell'AI con un framework concettuale per sistemi di AI sicuri.Completa la valutazione

- Proteggi l'intero stack e ciclo di vita dell'AICrea, esegui il deployment, esegui e gestisci i tuoi workload AI in modo sicuro, conforme e privato.Scopri di più

- Protezione dell'uso dell'AIValuta l'architettura, le difese dei dati e le applicazioni create su modelli di AI con la preparazione alle minacce guidata da esperti e le valutazioni specifiche per l'AI di Mandiant Consulting.Parla con un esperto

Domande frequenti

Quali sono i principali rischi per la sicurezza quando si adotta l'AI generativa?

Secondo il report 2025 State of AI Security and Governance, i principali rischi citati dalle aziende sono l'esposizione di dati sensibili (52%) e la conformità normativa (50%). Altre minacce emergenti includono l'AI ombra, l'iniezione di prompt e il furto di modelli. Una difesa completa richiede la protezione simultanea dei dati, del modello e dello strato di interazione dell'utente.

Che cos'è la Shadow AI e come può rilevarla la mia organizzazione?

La Shadow AI si verifica quando i dipendenti utilizzano modelli o set di dati non autorizzati, aggirando la governance IT. Per rilevarlo, le organizzazioni hanno bisogno di strumenti di rilevamento automatico. Security Command Center di Google Cloud fornisce un inventario in tempo reale di tutti gli asset di AI, compresi i modelli "ombra" non autorizzati, offrendo ai team di sicurezza la visibilità necessaria per applicare policy di sicurezza coerenti ai modelli non autorizzati, riducendo il rischio senza interrompere i flussi di lavoro aziendali.

Sono necessarie competenze di sicurezza specializzate per proteggere i workload di AI?

Sebbene le lacune in termini di competenze siano un ostacolo comune (citato dal 53% delle organizzazioni), non è necessario costruire tutto da zero. Google Cloud incorpora la sicurezza dell'AI direttamente nella sua piattaforma esistente. Strumenti come Security Command Center utilizzano l'AI per riassumere le minacce e consigliare le correzioni, aiutando il tuo team di sicurezza esistente a gestire i rischi dell'AI senza la necessità di essere esperti di data science.

Come posso proteggere l'AI agentica e le identità non umane?

La protezione dell'AI agentica richiede il trattamento degli agenti autonomi come identità di alto valore. A differenza degli utenti standard, gli agenti hanno bisogno di criteri IAM (Identity and Access Management) rigorosi che impongano il "privilegio minimo". Google Cloud ti aiuta a mappare i percorsi di interazione degli agenti e ad assegnare identità specifiche, garantendo che possano accedere solo ai dati necessari per le loro attività specifiche.

Google Cloud può proteggere i modelli di AI di terze parti e open source?

Sì. Google Cloud supporta una strategia di sicurezza multi-modello. Che tu stia utilizzando modelli proprietari come Gemini o modelli open source di terze parti su Vertex AI, puoi applicare guardrail di runtime unificati utilizzando Model Armor. In questo modo, lo stack è protetto da prompt injection e fughe di dati, indipendentemente dal fornitore del modello sottostante.

In che modo Google Cloud protegge dagli attacchi di prompt injection?

Model Armor fornisce un livello di sicurezza dedicato che filtra le prompt injection e le fughe di dati sensibili prima che raggiungano il modello, eliminando la necessità di intercettori codificati personalizzati. Rileva e blocca i prompt dannosi (come i tentativi di jailbreak del modello) e filtra i contenuti non sicuri prima che raggiungano le tue applicazioni, proteggendo sia i tuoi dati che la reputazione del tuo brand.

Come posso assicurarmi che i miei modelli di AI non divulghino dati privati?

La prevenzione della perdita di dati richiede un approccio "defense-in-depth". Google Cloud offre Confidential Computing per crittografare i dati durante l'elaborazione (in uso), insieme ai controlli Data Loss Prevention (DLP) che possono scansionare e oscurare automaticamente le informazioni sensibili (come le PII) dalle risposte del modello prima che vengano mostrate agli utenti.

In che modo Google Cloud garantisce la sovranità dei dati per i carichi di lavoro di AI?

Per i settori regolamentati, la sovranità dei dati significa mantenere i dati sensibili entro confini fisici e digitali specifici. Google Sovereign Cloud ti consente di adottare l'AI mantenendo il pieno controllo sulla residenza dei dati e sulle chiavi di crittografia (utilizzando External Key Manager), garantendo la conformità alle normative regionali come il GDPR o le leggi locali sui dati.

Che cos'è il Secure AI Framework (SAIF)?

Il Secure AI Framework (SAIF) è il progetto di Google per l'adozione responsabile dell'AI, progettato per aiutare le organizzazioni a integrare la sicurezza nel ciclo di vita dello sviluppo dell'AI. È in linea con gli standard di settore per aiutarti a valutare i rischi, automatizzare i controlli e creare una cultura della sicurezza che si adatti alla velocità della tua innovazione basata sull'AI.

Qual è la differenza tra governance e sicurezza per l'AI?

La sicurezza si concentra sulle difese tecniche (come firewall e crittografia), mentre la governance si concentra su criteri, responsabilità e gestione del rischio. Come evidenziato nella nostra guida AI Innovation Without Interruption, l'adozione di successo dell'AI richiede sia strumenti di sicurezza efficaci per applicare i controlli, sia un framework di governance per definire chi è responsabile delle decisioni sull'AI e dell'utilizzo dei dati.