Potenzia la sicurezza con l'AI

L'era dell'AI è arrivata e noi stiamo potenziando il vantaggio del difensore. Scopri di più su come gli agenti AI stanno trasformando la cybersicurezza nel nostro white paper.

Sicurezza per un mondo basato sull'AI

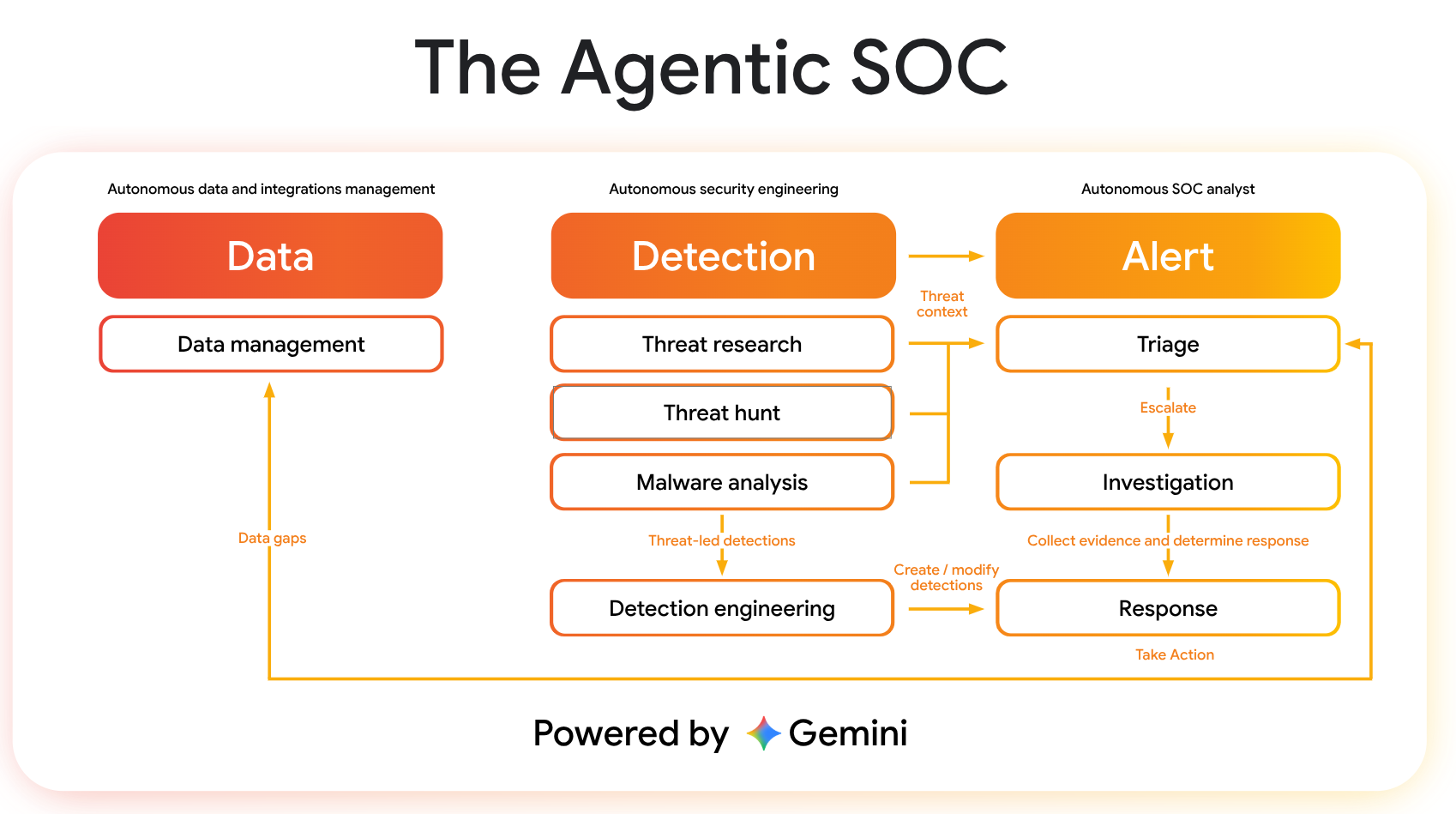

Il SOC agentico

Agentic SOC (SOC agentico), con Gemini integrato, orchestra un sistema di agenti per indagare sugli avvisi, automatizzare i flussi di correzione e contribuire a migliorare il processo decisionale, consentendo ai team di sicurezza di dedicare più tempo alla definizione delle priorità delle minacce ad alta priorità anziché ai falsi positivi.

La difesa agentica inizia con una threat intelligence superiore

Per aiutare a distillare l'intelligence e scoprire avversari nascosti, abbiamo integrato capacità agentiche in Google Threat Intelligence. Gemini consente di attingere all'intelligence sulle minacce all'avanguardia di Mandiant e ricevere rapidamente insight sul comportamento degli utenti malintenzionati, nonché di cercare in modo proattivo nuovi pattern di attacco.

Proteggi l'uso dei sistemi di AI e rafforza le cyberdifese

Gli esperti di Mandiant Consulting possono aiutare i team di sicurezza a utilizzare l'AI per migliorare le proprie difese informatiche e salvaguardare l'uso dei sistemi di AI con valutazioni di sicurezza end-to-end, modellazione delle minacce, red teaming e altro ancora.

In prima linea per l'AI responsabile

Ci impegniamo ad adottare un'AI responsabile. I clienti possono controllare i propri dati con funzionalità di livello enterprise come isolamento e protezione dei dati, nonché il supporto della conformità.

Integrando l'intelligenza artificiale avanzata, come l'Agente di triage e indagine, siamo in grado di fare lo scale in in modi nuovi.

Diego Martinez Blanco, Head of Security Technology, BBVA

Multi-cloud e multi-AI

La protezione di applicazioni, dati e sistemi di AI in ambienti e piattaforme diversi richiede soluzioni di cybersicurezza che operino su scala e velocità di macchina. Per gestire efficacemente questa complessità e mantenere al sicuro gli asset cloud, scopri di più su come Google Cloud e Wiz stanno ridefinendo la sicurezza per l'era dell'AI.

Gemini Enterprise

Scopri di piùGoogle Cloud per la sicurezza

Scopri le offerte di sicurezzaCollabora con un partner di fiducia

Trova un partner