Mehr Sicherheit mit KI

Das KI-Zeitalter ist angebrochen und wir stärken die Position der Verteidiger. In unserem Whitepaper erfahren Sie mehr darüber, wie KI-Agenten die Cybersicherheit verändern.

Sicherheit für eine KI-basierte Welt

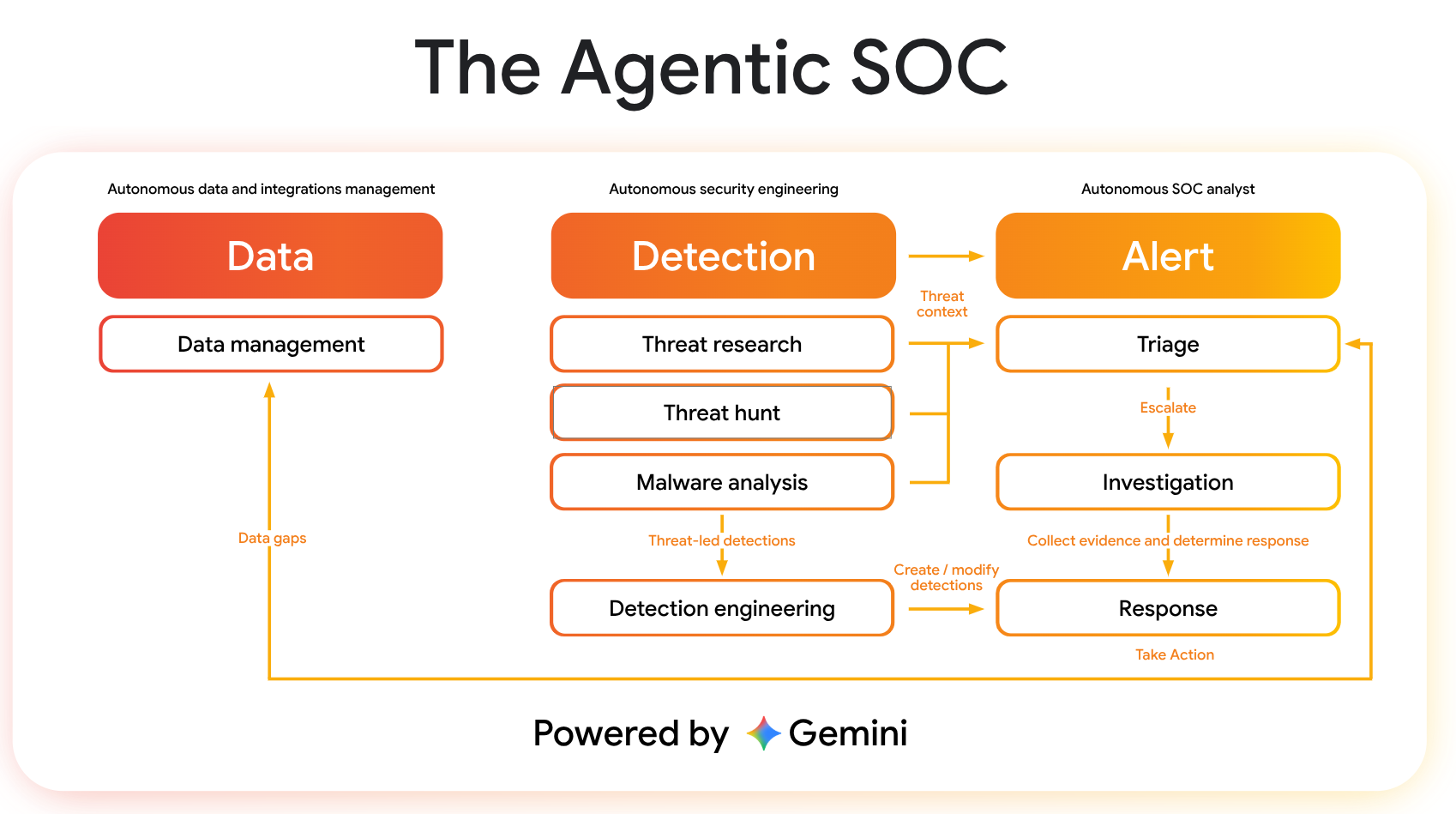

Das Agentic SOC

Das basierend auf Gemini entwickelte Agentic SOC orchestriert ein System von KI-Agenten, um Benachrichtigungen zu untersuchen, Abhilfemaßnahmen zu automatisieren und die Entscheidungsfindung zu verbessern. So können Sicherheitsteams mehr Zeit für die Priorisierung von Bedrohungen mit hoher Priorität aufwenden, anstatt sich mit falsch positiven Ergebnissen zu beschäftigen.

Agentische Abwehr beginnt mit überlegener Threat Intelligence

Um Informationen zu gewinnen und versteckte Angreifer zu entdecken, haben wir Google Threat Intelligence mit agentischen Funktionen ausgestattet. Mit Gemini können Sie die Threat Intelligence von Mandiant nutzen und schnell Insights zum Verhalten der Angreifer erhalten sowie proaktiv nach neuen Angriffsmustern suchen.

Einsatz von KI-Systemen schützen und Cyberabwehr stärken

Die Fachleute von Mandiant Consulting unterstützen Sicherheitsteams bei der Nutzung von KI zur Verbesserung ihrer Cyberabwehr und zum Schutz von KI-Systemen mit Ende-zu-Ende-Sicherheitsbewertungen, Bedrohungsmodellierung, Red Teaming und mehr.

Führend bei der verantwortungsbewussten Anwendung von KI

Wir setzen uns für verantwortungsbewusste KI ein. Kunden können Daten mit Funktionen auf Unternehmensebene verwalten, z. B. zur Datenisolation, zum Datenschutz und zur Compliance.

Informationen zur verantwortungsbewussten Anwendung von KI bei Google

Durch die EInbindung fortschrittlicher künstlicher Intelligenz, wie zum Beispiel des Triage- und Untersuchungs-Agenten, können wir auf ganz neue Arten skalieren.

Diego Martinez Blanco, Head of Security Technology, BBVA

Multi-Cloud und Multi-KI

Um KI-Anwendungen, Daten und Systeme in allen Umgebungen und auf allen Plattformen zu schützen, sind Cybersicherheitslösungen erforderlich, die in Maschinengeschwindigkeit und -größe funktionieren. Google Cloud und Wiz definieren Sicherheit im KI-Zeitalter neu. Erfahren Sie, wie Sie diese Komplexität effektiv bewältigen und Cloud-Assets schützen können.

Gemini Enterprise

Weitere InformationenGoogle Cloud Security

Sicherheitsangebote entdeckenMit einem zertifizierten Partnerunternehmen arbeiten

Partner finden