Esta página descreve como ativar a replicação de dados em tempo real de aplicações SAP para o Google Cloud Platform usando o SAP Landscape Transformation (SLT). Google Cloud O conteúdo aplica-se aos plug-ins SAP SLT Replication e SAP SLT No RFC Replication, que estão disponíveis no Cloud Data Fusion Hub. Mostra as configurações do sistema de origem SAP, do SLT, do Cloud Storage e do Cloud Data Fusion para fazer o seguinte:

- Envie metadados e dados de tabelas SAP para o Google Cloud usando o SAP SLT.

- Crie uma tarefa de replicação do Cloud Data Fusion que leia os dados de um contentor do Cloud Storage.

A replicação do SAP SLT permite-lhe replicar os seus dados continuamente e em tempo real de origens SAP para o BigQuery. Pode configurar e executar transferências de dados de sistemas SAP sem programação.

O processo de replicação SLT do Cloud Data Fusion é o seguinte:

- Os dados provêm de um sistema de origem SAP.

- A SLT monitoriza e lê os dados e envia-os para o Cloud Storage.

- O Cloud Data Fusion extrai dados do contentor de armazenamento e escreve-os no BigQuery.

Pode transferir dados de sistemas SAP suportados, incluindo sistemas SAP alojados no Google Cloud.

Para mais informações, consulte a vista geral do SAP no Google Cloud e os detalhes de apoio técnico.

Antes de começar

Para usar este plug-in, precisa de conhecimentos do domínio nas seguintes áreas:

- Criar pipelines no Cloud Data Fusion

- Gestão de acessos com o IAM

- Configurar sistemas de planeamento de recursos empresariais (ERP) locais e na nuvem da SAP

Administradores e utilizadores que realizam as configurações

As tarefas nesta página são realizadas por pessoas com as seguintes funções no Google Cloud ou no respetivo sistema SAP:

| Tipo de utilizador | Descrição |

|---|---|

| Administrador do Google Cloud | Os utilizadores aos quais esta função é atribuída são administradores de contas do Google Cloud. |

| Utilizador do Cloud Data Fusion | Os utilizadores aos quais esta função é atribuída estão autorizados a conceber e executar

Data pipelines. No mínimo, é-lhes concedida a função de visitante do Data Fusion

(

roles/datafusion.viewer). Se estiver a usar o controlo de acesso baseado em funções, pode precisar de funções adicionais.

|

| Administrador SAP | Os utilizadores aos quais esta função é atribuída são administradores do sistema SAP. Têm acesso à transferência de software a partir do site de serviços da SAP. Não é uma função de IAM. |

| Utilizador do SAP | Os utilizadores aos quais esta função é atribuída estão autorizados a estabelecer ligação a um sistema SAP. Não é uma função de IAM. |

Operações de replicação suportadas

O plug-in de replicação SAP SLT suporta as seguintes operações:

Modelação de dados: todas as operações de modelação de dados (registo insert, delete e update) são suportadas por este plug-in.

Definição de dados: conforme descrito na nota SAP 2055599 (é necessário iniciar sessão no apoio técnico da SAP para ver), existem limitações quanto às alterações à estrutura da tabela do sistema de origem que são replicadas automaticamente pelo SLT. Algumas operações de definição de dados não são suportadas no plug-in (tem de as propagar manualmente).

- Suportado:

- Adicione um campo não chave (depois de fazer alterações no SE11, ative a tabela através do SE14)

- Não suportado:

- Adicione/elimine o campo de chave

- Elimine o campo sem chave

- Modifique os tipos de dados

Requisitos da SAP

Os seguintes itens são obrigatórios no seu sistema SAP:

- Tem a versão 2011 SP17 ou posterior do servidor SLT instalada no sistema SAP de origem (incorporado) ou como um sistema de hub SLT dedicado.

- O seu sistema SAP de origem é o SAP ECC ou o SAP S/4HANA, que suporta o DMIS 2011 SP17 ou superior, como o DMIS 2018 e o DMIS 2020.

- O suplemento da interface do utilizador do SAP tem de ser compatível com a sua versão do SAP Netweaver.

O seu pacote de apoio técnico suporta a classe

/UI2/CL_JSONou posterior.PL 12Caso contrário, implemente a nota SAP mais recente para a classe/UI2/CL_JSONcorrectionsde acordo com a versão do suplemento da interface do utilizador, como a nota SAP 2798102 paraPL12.A seguinte segurança está em vigor:

Requisitos do Cloud Data Fusion

- Precisa de uma instância do Cloud Data Fusion, versão 6.4.0 ou posterior, de qualquer edição.

- A conta de serviço atribuída à instância do Cloud Data Fusion tem as funções necessárias (consulte o artigo Conceder autorização de utilizador da conta de serviço).

- Para instâncias privadas do Cloud Data Fusion, é necessário o intercâmbio de redes da VPC.

Google Cloud requisitos

- Ative a API Cloud Storage no seu Google Cloud projeto.

- O utilizador do Cloud Data Fusion tem de ter autorização para criar pastas no contentor do Cloud Storage (consulte os papéis do IAM para o Cloud Storage).

- Opcional: defina a política de retenção, se a sua organização o exigir.

Crie o contentor de armazenamento

Antes de criar uma tarefa de replicação SLT, crie o contentor do Cloud Storage. A tarefa transfere dados para o contentor e atualiza o contentor de preparação a cada cinco minutos. Quando executa a tarefa, o Cloud Data Fusion lê os dados no contentor de armazenamento e escreve-os no BigQuery.

Se o SLT estiver instalado no dispositivo Google Cloud

O servidor SLT tem de ter autorização para criar e modificar objetos do Cloud Storage no contentor que criou.

No mínimo, conceda as seguintes funções à conta de serviço:

- Criador de tokens de contas de serviço (

roles/iam.serviceAccountTokenCreator) - Consumidor de utilização de serviços (

roles/serviceusage.serviceUsageConsumer) - Administrador de objetos de armazenamento (

roles/storage.objectAdmin)

Se o SLT não estiver instalado no Google Cloud

Instale o Cloud VPN ou o Cloud Interconnect entre a VM SAP e o Google Cloud para permitir a ligação a um ponto final de metadados interno (consulte o artigo Configurar o acesso privado à Google para anfitriões no local).

Se não for possível mapear os metadados internos:

Instale a CLI Google Cloud com base no sistema operativo da infraestrutura em que o SLT está a ser executado.

Crie uma conta de serviço no Google Cloud projeto onde o Cloud Storage está ativado.

No sistema operativo do SLT, autorize o acesso ao Google Cloud com uma conta de serviço.

Crie uma chave da API para a conta de serviço e autorize o âmbito relacionado com o Cloud Storage.

Importe a chave da API para a CLI gcloud instalada anteriormente através da CLI.

Para ativar o comando da CLI gcloud que imprime o token de acesso, configure o comando do sistema operativo SAP na ferramenta de transação SM69 no sistema SLT.

Imprima uma chave de acesso

O administrador do SAP configura o comando do sistema operativo, SM69, que

obtém um token de acesso de Google Cloud.

Crie um script para imprimir um token de acesso e configurar um comando do sistema operativo SAP para chamar o script como utilizador <sid>adm a partir do anfitrião do SAP LT Replication Server.

Linux

Para criar um comando do SO:

No anfitrião do servidor de replicação SAP LT, num diretório acessível a

<sid>adm, crie um script bash que contenha as seguintes linhas:PATH_TO_GCLOUD_CLI/bin/gcloud auth print-access-token SERVICE_ACCOUNT_NAMEUsando a interface do utilizador do SAP, crie um comando do SO externo:

- Introduza o

SM69da transação. - Clique em Criar.

- Na secção Comando do painel Comando externo, introduza o nome do comando, como

ZGOOGLE_CDF_TOKEN. Na secção Definição:

- No campo Comando do sistema operativo, introduza

shcomo a extensão do ficheiro de script. No campo Parâmetros para o comando do sistema operativo, introduza:

/PATH_TO_SCRIPT/FILE_NAME.sh

- No campo Comando do sistema operativo, introduza

Clique em Guardar.

Para testar o script, clique em Executar.

Clique novamente em Executar.

É devolvido um Google Cloud token e apresentado na parte inferior do painel da interface do utilizador do SAP.

- Introduza o

Windows

Usando a interface do utilizador do SAP, crie um comando do sistema operativo externo:

- Introduza o

SM69da transação. - Clique em Criar.

- Na secção Comando do painel Comando externo, introduza o nome do comando, como

ZGOOGLE_CDF_TOKEN. Na secção Definição:

- No campo Comando do sistema operativo, introduza

cmd /c. No campo Parâmetros para o comando do sistema operativo, introduza:

gcloud auth print-access-token SERVICE_ACCOUNT_NAME

- No campo Comando do sistema operativo, introduza

Clique em Guardar.

Para testar o script, clique em Executar.

Clique novamente em Executar.

É devolvido um Google Cloud token e apresentado na parte inferior do painel da interface do utilizador do SAP.

Requisitos de SLT

O conetor SLT tem de ter a seguinte configuração:

- O conetor suporta SAP ECC NW 7.02, DMIS 2011 SP17 e versões posteriores.

- Configure uma RFC ou uma ligação à base de dados entre o SLT e o sistema de armazenamento na nuvem.

- Configure os certificados SSL:

- Transfira os seguintes certificados da AC do

repositório do Google Trust Services:

- GTS Root R1

- GTS CA 1C3

- Na interface do utilizador do SAP, use a transação

STRUSTpara importar os certificados raiz e subordinados para a pastaSSL Client (Standard) PSE.

- Transfira os seguintes certificados da AC do

repositório do Google Trust Services:

- O Internet Communication Manager (ICM) tem de estar configurado para HTTPS. Certifique-se de que as portas HTTP e HTTPS são mantidas e ativadas no sistema SAP SLT.

Isto pode ser verificado através do código de transação

SMICM > Services. - Ative o acesso às Google Cloud APIs na VM onde o sistema SAP SLT está alojado. Isto permite a comunicação privada entre os Google Cloud serviços sem encaminhamento através da Internet pública.

- Certifique-se de que a rede consegue suportar o volume e a velocidade necessários da transferência de dados entre a infraestrutura SAP e o Cloud Storage. Para uma instalação bem-sucedida, recomendamos o Cloud VPN e/ou o Cloud Interconnect. O débito da API de streaming depende das quotas do cliente que foram concedidas ao seu projeto do Cloud Storage.

Configure o servidor de replicação SLT

O utilizador do SAP executa os seguintes passos.

Nos passos seguintes, associa o servidor SLT ao sistema de origem e ao contentor no Cloud Storage, especificando o sistema de origem, as tabelas de dados a replicar e o contentor de armazenamento de destino.

Configure o SDK Google ABAP

Para configurar a SLT para a replicação de dados (uma vez por instância do Cloud Data Fusion), siga estes passos:

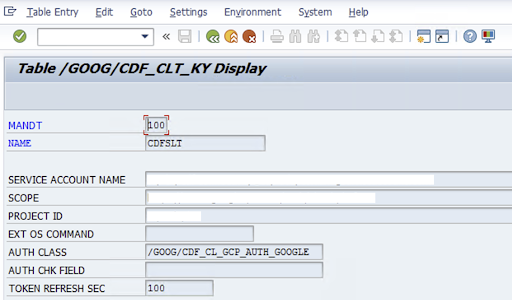

Para configurar o conetor SLT, o utilizador SAP introduz as seguintes informações no ecrã de configuração (transação SAP

/GOOG/CDF_SETTINGS) acerca da chave da conta de serviço para transferir dados para o Cloud Storage. Google Cloud Configure as seguintes propriedades na tabela /GOOG/CDF_CLT_KY através da transação SE16 e tome nota desta chave:- NAME: o nome da chave da conta de serviço (por exemplo,

CDFSLT) - NOME DA CONTA DE SERVIÇO: o nome da conta de serviço de IAM

- ÂMBITO: o âmbito da conta de serviço

- ID DO PROJETO: o ID do seu Google Cloud projeto

- Opcional: comando EXT OS: use este campo apenas se o SLT não estiver instalado no dispositivo Google Cloud

AUTH CLASS: se o comando do SO estiver configurado na tabela

/GOOG/CDF_CLT_KY, use o valor fixo:/GOOG/CDF_CL_GCP_AUTH.TOKEN REFRESH SEC: duração da atualização do token de autorização

- NAME: o nome da chave da conta de serviço (por exemplo,

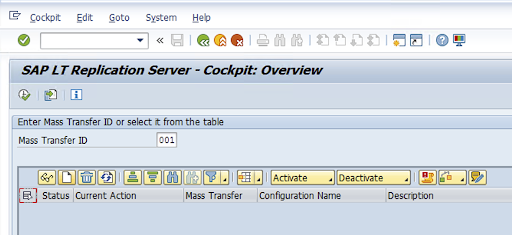

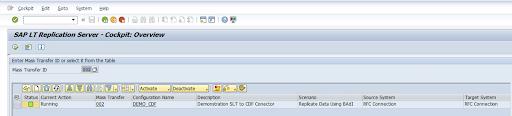

Crie a configuração de replicação

Crie uma configuração de replicação no código de transação: LTRC.

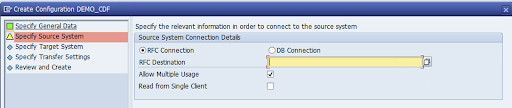

- Antes de continuar com a configuração do LTRC, certifique-se de que a ligação RFC entre o SLT e o sistema SAP de origem está estabelecida.

- Para uma configuração de SLT, podem ser atribuídas várias tabelas SAP para replicação.

Aceda ao código de transação

LTRCe clique em Nova configuração.

Introduza o Nome da configuração e a Descrição e clique em Seguinte.

Especifique a associação RFC do sistema de origem SAP e clique em Seguinte.

Nos detalhes da ligação do sistema de destino, selecione Outro.

Expanda o campo Cenário para comunicação RFC, selecione SDK SLT e clique em Seguinte.

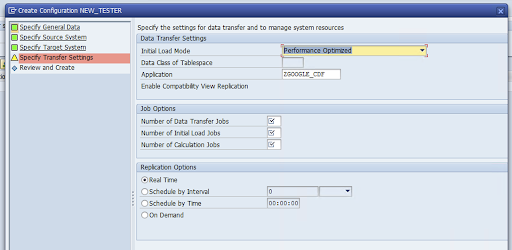

Aceda à janela Especificar definições de transferência e introduza o nome da aplicação:

ZGOOGLE_CDF.

Introduza o Número de tarefas de transferência de dados, o Número de tarefas de carregamento inicial e o Número de tarefas de cálculo. Para mais informações sobre o desempenho, consulte o guia de otimização do desempenho do SAP LT Replication Server.

Clique em Tempo real > Seguinte.

Reveja a configuração e clique em Guardar. Tome nota do ID de transferência em massa para os passos seguintes.

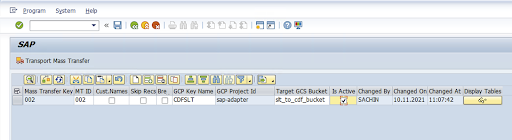

Para manter o ID de transferência em massa e os detalhes da tabela SAP, execute a transação SAP:

/GOOG/CDF_SETTINGS.Clique em Executar ou prima

F8.Crie uma nova entrada clicando no ícone de anexar linha.

Introduza o ID da transferência em massa, a chave de transferência em massa, o nome da chave da GCP e o contentor do GCS de destino. Selecione a caixa de verificação Está ativo e guarde as alterações.

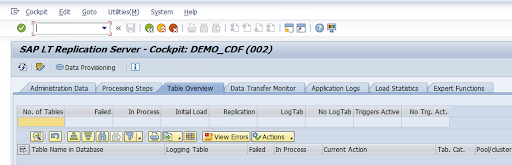

Selecione a configuração na coluna Nome da configuração e clique em Aprovisionamento de dados.

Opcional: personalize os nomes das tabelas e dos campos.

Clique em Nomes personalizados e guarde.

Clique em Visualização.

Clique nos botões Anexar linha ou Criar para criar uma nova entrada.

Introduza o nome da tabela SAP e o nome da tabela externa a usar no BigQuery e guarde as alterações.

Clique no botão Ver na coluna Campos de apresentação para manter o mapeamento dos campos da tabela.

É aberta uma página com mapeamentos sugeridos. Opcional: edite o Nome do campo temporário e a Descrição do campo e, de seguida, guarde os mapeamentos.

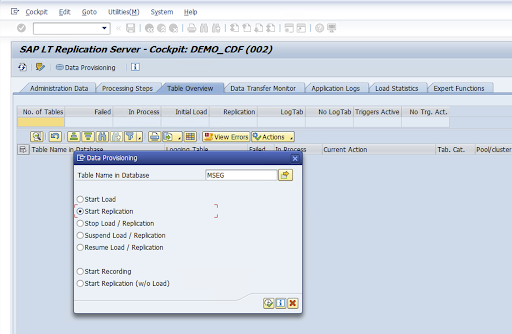

Aceda à transação LTRC.

Selecione o valor na coluna Nome da configuração e clique em Aprovisionamento de dados.

Introduza o nome da tabela no campo Nome da tabela na base de dados e selecione o cenário de replicação.

Clique em Executar. Isto aciona a implementação do SDK da SLT e começa a transferir os dados para o contentor de destino no Cloud Storage.

Instale ficheiros de transporte SAP

Para conceber e executar tarefas de replicação no Cloud Data Fusion, os componentes SAP são fornecidos como ficheiros de transporte SAP que são arquivados num ficheiro ZIP. A transferência está disponível quando implementa o plug-in no Cloud Data Fusion Hub.

Para instalar os transportes SAP, siga estes passos:

Passo 1: carregue os ficheiros de pedido de transporte

- Inicie sessão no sistema operativo da instância SAP.

- Use o código de transação SAP

AL11para obter o caminho da pastaDIR_TRANS. Normalmente, o caminho é/usr/sap/trans/. - Copie os ficheiros de configuração para a pasta

DIR_TRANS/cofiles. - Copie os ficheiros de dados para a pasta

DIR_TRANS/data. - Defina o utilizador e o grupo de dados e o cofile como

<sid>admesapsys.

Passo 2: importe os ficheiros de pedido de transporte

O administrador do SAP pode importar os ficheiros de pedido de transporte através do sistema de gestão de transportes do SAP ou do sistema operativo:

Sistema de gestão de transportes SAP

- Inicie sessão no sistema SAP como administrador do SAP.

- Introduza o STMS da transação.

- Clique em Vista geral > Importações.

- Na coluna Fila, clique duas vezes no SID atual.

- Clique em Extras > Outros pedidos > Adicionar.

- Selecione o ID do pedido de transporte e clique em Continuar.

- Selecione o pedido de transporte na fila de importação e, de seguida, clique em Pedido > Importar.

- Introduza o número de cliente.

No separador Opções, selecione Substituir originais e Ignorar versão de componente inválida (se disponível).

Opcional: para reimportar os transportes mais tarde, clique em Deixar pedidos de transportes na fila para importação posterior e Importar pedidos de transportes novamente. Isto é útil para atualizações do sistema SAP e restauros de cópias de segurança.

Clique em Continuar.

Verifique se o módulo de função e as funções de autorização foram importados com êxito através de transações, como

SE80ePFCG.

Sistema operativo

- Inicie sessão no sistema SAP como administrador do SAP.

Adicione pedidos ao buffer de importação:

tp addtobuffer TRANSPORT_REQUEST_ID SIDPor exemplo:

tp addtobuffer IB1K903958 DD1Importe os pedidos de transportes:

tp import TRANSPORT_REQUEST_ID SID client=NNN U1238Substitua

NNNpelo número do cliente. Por exemplo:tp import IB1K903958 DD1 client=800 U1238Verifique se o módulo de função e as funções de autorização foram importados com êxito através de quaisquer transações adequadas, como

SE80ePFCG.

Autorizações SAP necessárias

Para executar um pipeline de dados no Cloud Data Fusion, precisa de um utilizador do SAP. O utilizador SAP tem de ser do tipo Communications ou Dialog. Para evitar a utilização de recursos de diálogo SAP, é recomendado o tipo de comunicações. Os utilizadores podem ser criados pelo administrador do SAP através do código de transação do SAP SU01.

São necessárias autorizações SAP para manter e configurar o conector para SAP, uma combinação de objetos de autorização SAP padrão e novos conectores. Mantém os objetos de autorização com base nas políticas de segurança da sua organização. A lista seguinte descreve algumas autorizações importantes necessárias para o conetor:

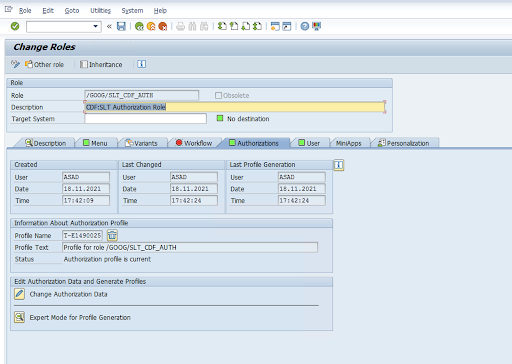

Objeto de autorização: o objeto de autorização

ZGOOGCDFMTé enviado como parte da função de pedido de transporte.Criação de funções: crie uma função através do código de transação

PFCG.

Para objetos de autorização SAP padrão, a sua organização gere as autorizações com o seu próprio mecanismo de segurança.

Para objetos de autorização personalizados, indique valores nos campos de autorização para objetos de autorização

ZGOOGCDFMT.Para um controlo de acesso detalhado, o

ZGOOGCDFMTfornece autorização baseada em grupos de autorização. Os utilizadores com acesso completo, parcial ou nenhum aos grupos de autorização têm acesso com base no grupo de autorização atribuído na respetiva função./GOOG/SLT_CDF_AUTH: função com acesso a todos os grupos de autorização. Para restringir o acesso específico a um determinado grupo de autorização, mantenha o FICDF do grupo de autorização na configuração.

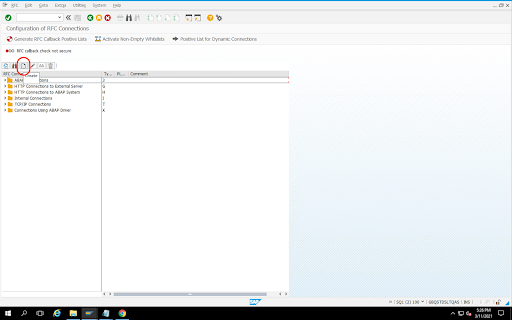

Crie um destino RFC para a origem

Antes de começar a configuração, certifique-se de que a ligação RFC está estabelecida entre a origem e o destino.

Aceda ao código de transação

SM59.Clique em Criar > Tipo de ligação 3 (ligação ABAP).

Na janela Definições técnicas, introduza os detalhes sobre o destino RFC.

Clique no separador Início de sessão e segurança para manter as credenciais RFC (utilizador e palavra-passe RFC).

Clique em Guardar.

Clique em Teste de ligação. Após um teste bem-sucedido, pode continuar.

Verifique se o teste de autorização RFC é bem-sucedido.

Clique em Utilitários > Testar > Teste de autorização.

Configure o plug-in

Para configurar o plug-in, implemente-o a partir do Hub, crie uma tarefa de replicação e configure a origem e o destino com os seguintes passos.

Implemente o plug-in no Cloud Data Fusion

O utilizador do Cloud Data Fusion realiza os seguintes passos.

Antes de poder executar a tarefa de replicação do Cloud Data Fusion, implemente o plug-in de replicação do SAP SLT:

Aceda à sua instância:

Na Google Cloud consola, aceda à página Instances do Cloud Data Fusion.

Ative a replicação numa instância nova ou existente:

- Para uma nova instância, clique em Criar instância, introduza um nome para a instância, clique em Adicionar aceleradores, selecione a caixa de verificação Replicação e clique em Guardar.

- Para uma instância existente, consulte o artigo Ative a replicação numa instância existente.

Clique em Ver instância para abrir a instância na interface Web do Cloud Data Fusion.

Clique em Hub.

Aceda ao separador SAP, clique em SAP SLT e clique em SAP SLT Replication Plugin ou SAP SLT No RFC Replication Plugin.

Clique em Implementar.

Crie um trabalho de replicação

O plug-in de replicação do SAP SLT lê o conteúdo das tabelas SAP através de um contentor de preparação da API Cloud Storage.

Para criar uma tarefa de replicação para a transferência de dados, siga estes passos:

Na instância do Cloud Data Fusion aberta, clique em Página inicial > Replicação > Criar tarefa de replicação. Se não existir a opção Replicação, ative a replicação para a instância.

Introduza um Nome e uma Descrição exclusivos para a tarefa de replicação.

Clicar em Seguinte.

Configure a origem

Configure a origem introduzindo valores nos seguintes campos:

- ID do projeto: o ID do seu Google Cloud projeto (este campo é pré-preenchido)

Caminho do GCS de replicação de dados: o caminho do Cloud Storage que contém dados para replicação. Tem de ser o mesmo caminho que está configurado nos trabalhos do SAP SLT. Internamente, o caminho fornecido é concatenado com

Mass Transfer IDeSource Table Name:Formato:

gs://<base-path>/<mass-transfer-id>/<source-table-name>Exemplo:

gs://slt_bucket/012/MARAGUID: o GUID da SLT, um identificador exclusivo atribuído ao ID de transferência em massa da SAP SLT.

ID de transferência em massa: o ID de transferência em massa do SLT é um identificador exclusivo atribuído à configuração no SAP SLT.

Caminho do GCS da biblioteca SAP JCo: o caminho de armazenamento que contém os ficheiros da biblioteca SAP JCo carregados pelo utilizador. As bibliotecas SAP JCo podem ser transferidas a partir do portal de apoio técnico da SAP. (Removido na versão 0.10.0 do plug-in.)

Anfitrião do servidor SLT: nome de anfitrião ou endereço IP do servidor SLT. (Removido na versão 0.10.0 do plug-in.)

Número do sistema SAP: número do sistema de instalação fornecido pelo administrador do sistema (por exemplo,

00). (Removido na versão 0.10.0 do plug-in.)Cliente SAP: o cliente SAP a usar (por exemplo,

100). (Removido na versão 0.10.0 do plug-in.)Idioma SAP: idioma de início de sessão do SAP (por exemplo,

EN). (Removido na versão 0.10.0 do plug-in.)Nome de utilizador de início de sessão da SAP: nome de utilizador da SAP. (Removido na versão 0.10.0 do plug-in.)

- Recomendado: se o nome de utilizador de início de sessão do SAP mudar periodicamente, use uma macro.

Palavra-passe de início de sessão da SAP (M): palavra-passe de utilizador da SAP para autenticação de utilizadores.

- Recomendado: use macros seguras para valores confidenciais, como palavras-passe. (Removido na versão 0.10.0 do plug-in.)

Suspender a replicação SLT quando a tarefa CDF parar: tenta parar a tarefa de replicação SLT (para as tabelas envolvidas) quando a tarefa de replicação do Cloud Data Fusion para. Pode falhar se a tarefa no Cloud Data Fusion parar inesperadamente.

Replicate Existing Data: indica se deve replicar os dados existentes das tabelas de origem. Por predefinição, as tarefas replicam os dados existentes das tabelas de origem. Se for definido como

false, todos os dados existentes nas tabelas de origem são ignorados e apenas as alterações que ocorrem após o início da tarefa são replicadas.Chave da conta de serviço: a chave a usar quando interage com o Cloud Storage. A conta de serviço tem de ter autorização para escrever no Cloud Storage. Quando executado numa VM, este parâmetro deve ser definido como

auto-detectpara usar a conta de serviço anexada à VM. Google Cloud

Clicar em Seguinte.

Configure o alvo

Para escrever dados no BigQuery, o plug-in requer acesso de escrita ao BigQuery e a um contentor de preparação. Os eventos de alteração são escritos primeiro em lotes do SLT para o Google Cloud Storage. Em seguida, são carregados para tabelas de preparação no BigQuery. As alterações da tabela de preparação são unidas na tabela de destino final através de uma consulta de união do BigQuery.

A tabela de destino final inclui todas as colunas originais da tabela de origem, além de uma coluna _sequence_num adicional. O número de sequência garante que os dados não são duplicados nem perdidos em cenários de falha do replicador.

Configure a origem introduzindo valores nos seguintes campos:

- ID do projeto: projeto do conjunto de dados do BigQuery. Quando executado num cluster do Dataproc, este campo pode ser deixado em branco, o que usa o projeto do cluster.

- Credenciais: consulte Credenciais.

- Chave da conta de serviço: o conteúdo da chave da conta de serviço a usar quando interagir com o Cloud Storage e o BigQuery. Quando executado num cluster do Dataproc, este campo deve ser deixado em branco, que usa a conta de serviço do cluster.

- Nome do conjunto de dados: nome do conjunto de dados a criar no BigQuery. É opcional e, por predefinição, o nome do conjunto de dados é igual ao nome da base de dados de origem. Um nome válido só pode conter letras, números e sublinhados, e o comprimento máximo pode ser de 1024 carateres. Todos os carateres inválidos são substituídos por um sublinhado no nome do conjunto de dados final, e todos os carateres que excedam o limite de comprimento são truncados.

- Nome da chave de encriptação: a chave de encriptação gerida pelo cliente (CMEK) usada para proteger os recursos criados por este destino. O nome da chave de encriptação tem de estar no formato

projects/<project-id>/locations/<key-location>/keyRings/<key-ring-name>/cryptoKeys/<key-name>. - Localização: a localização onde o conjunto de dados do BigQuery e o contentor de preparação do Cloud Storage são criados. Por exemplo,

us-east1para contentores regionais,uspara contentores multirregionais (consulte as Localizações). Este valor é ignorado se for especificado um contentor existente, uma vez que o contentor de preparação e o conjunto de dados do BigQuery são criados na mesma localização que esse contentor. Recipiente de preparação: o recipiente onde os eventos de alteração são escritos antes de serem carregados nas tabelas de preparação. As alterações são escritas num diretório que contém o nome e o espaço de nomes do replicador. É seguro usar o mesmo contentor em vários replicadores na mesma instância. Se for partilhado por replicadores em várias instâncias, certifique-se de que o espaço de nomes e o nome são únicos. Caso contrário, o comportamento não está definido. O contentor tem de estar na mesma localização que o conjunto de dados do BigQuery. Se não for fornecido, é criado um novo contentor para cada tarefa com o nome

df-rbq-<namespace-name>-<job-name>-<deployment-timestamp>.Intervalo de carregamento (segundos): número de segundos a aguardar antes de carregar um lote de dados no BigQuery.

Prefixo da tabela de preparação: as alterações são escritas primeiro numa tabela de preparação antes de serem unidas à tabela final. Os nomes das tabelas de preparação são gerados adicionando este prefixo ao nome da tabela de destino.

Require Manual Drop Intervention: se é necessária uma ação administrativa manual para eliminar tabelas e conjuntos de dados quando é encontrado um evento de eliminação de tabelas ou de bases de dados. Quando definido como verdadeiro, o replicador não elimina uma tabela nem um conjunto de dados. Em vez disso, falha e tenta novamente até que a tabela ou o conjunto de dados não exista. Se o conjunto de dados ou a tabela não existir, não é necessária nenhuma intervenção manual. O evento é ignorado como normal.

Ativar eliminações temporárias: se estiver definido como verdadeiro, quando o destino recebe um evento de eliminação, a coluna

_is_deleteddo registo é definida comotrue. Caso contrário, o registo é eliminado da tabela do BigQuery. Esta configuração não tem efeito para uma origem que gera eventos fora de ordem e os registos são sempre eliminados temporariamente da tabela do BigQuery.

Clicar em Seguinte.

Credenciais

Se o plug-in for executado num cluster do Dataproc, a chave da conta de serviço deve ser definida para deteção automática. As credenciais são lidas automaticamente a partir do ambiente de cluster.

Se o plug-in não for executado num cluster do Dataproc, tem de ser fornecido o caminho para uma chave de conta de serviço. Pode encontrar a chave da conta de serviço na página IAM na Google Cloud consola. Certifique-se de que a chave da conta tem autorização para aceder ao BigQuery. O ficheiro de chave da conta de serviço tem de estar disponível em todos os nós no cluster e tem de ser legível por todos os utilizadores que executam a tarefa.

Limitações

- As tabelas têm de ter uma chave principal para serem replicadas.

- As operações de mudança do nome da tabela não são suportadas.

- As alterações de tabelas são parcialmente suportadas.

- Pode alterar uma coluna não anulável existente para uma coluna anulável.

- É possível adicionar novas colunas anuláveis a uma tabela existente.

- Qualquer outro tipo de alteração ao esquema da tabela falha.

- As alterações à chave principal não falham, mas os dados existentes não são reescritos para obedecer à unicidade na nova chave principal.

Selecione tabelas e transformações

No passo Selecionar tabelas e transformações, é apresentada uma lista de tabelas selecionadas para replicação no sistema SLT.

- Selecione as tabelas a replicar.

- Opcional: selecione operações de esquema adicionais, como Inserções, Atualizações ou Eliminações.

- Para ver o esquema, clique em Colunas a replicar para uma tabela.

Opcional: para mudar o nome das colunas no esquema, siga estes passos:

- Enquanto vê o esquema, clique em Transformar > Mudar o nome.

- No campo Mudar o nome, introduza um novo nome e clique em Aplicar.

- Para guardar o novo nome, clique em Atualizar e Guardar.

Clicar em Seguinte.

Opcional: configure propriedades avançadas

Se souber a quantidade de dados que está a replicar numa hora, pode selecionar a opção adequada.

Reveja a avaliação

O passo Rever avaliação procura problemas de esquema, funcionalidades em falta ou problemas de conetividade que ocorrem durante a replicação.

Na página Rever avaliação, clique em Ver mapeamentos.

Se ocorrerem problemas, estes têm de ser resolvidos antes de poder continuar.

Opcional: se mudou o nome das colunas quando selecionou as tabelas e as transformações, verifique se os novos nomes estão corretos neste passo.

Clicar em Seguinte.

Veja o resumo e implemente a tarefa de replicação

Na página Reveja os detalhes da tarefa de replicação, reveja as definições e clique em Implementar tarefa de replicação.

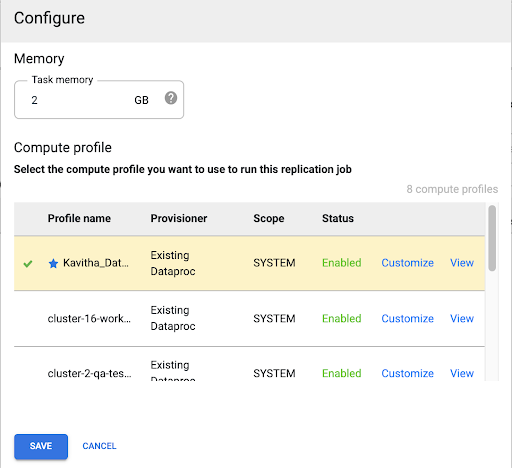

Selecione um perfil do Compute Engine

Depois de implementar a tarefa de replicação, clique em Configurar em qualquer página na interface Web do Cloud Data Fusion.

Selecione o perfil do Compute Engine que quer usar para executar esta tarefa de replicação.

Clique em Guardar.

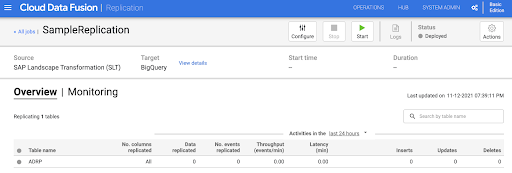

Inicie a tarefa de replicação

- Para executar a tarefa de replicação, clique em Iniciar.

Opcional: otimize o desempenho

Por predefinição, o plug-in está configurado para um desempenho ideal. Para otimizações adicionais, consulte o artigo Argumentos de tempo de execução.

O desempenho da comunicação entre o SLT e o Cloud Data Fusion depende dos seguintes fatores:

- SLT no sistema de origem em comparação com um sistema SLT central dedicado (opção preferencial)

- Processamento de tarefas em segundo plano no sistema SLT

- Processos de trabalho de diálogo no sistema SAP de origem

- O número de processos de tarefas em segundo plano atribuídos a cada ID de transferência em massa no separador Administração do LTRC

- Definições de LTRS

- Hardware (CPU e memória) do sistema SLT

- A base de dados usada (por exemplo: HANA, Sybase ou DB2)

- A largura de banda da Internet (conetividade entre o sistema SAP e Google Cloud através da Internet)

- Utilização pré-existente (carga) no sistema

- O número de colunas na tabela. Com mais colunas, a replicação torna-se lenta e a latência pode aumentar.

Os seguintes tipos de leitura nas definições de LTRS são recomendados para carregamentos iniciais:

| Sistema SLT | Sistema de origem | Tipo de tabela | Tipo de leitura recomendado [initial load] |

|---|---|---|---|

| SLT 3.0 autónomo [DMIS 2018_1_752 SP 2] |

S/4 HANA 1909 | Transparente (pequeno/médio) Transparente (grande) Tabela de clusters |

1 cálculo de intervalo 1 cálculo de intervalo 4 fila de envio |

| SLT embedded [S4CORE 104 HANA 1909] |

N/A | Transparente (pequeno/médio) Transparente (grande) Tabela de clusters |

1 cálculo de intervalo 1 cálculo de intervalo 4 fila de envio |

| SLT 2.0 autónomo [DMIS 2011_1_731 SP 17] |

ECC NW 7.02 | Transparente (pequeno/médio) Transparente (grande) Tabela de clusters |

5 sender queue 5 sender queue 4 sender Queue |

| SLT incorporado [DMIS 2011_1_700 SP 17] |

N/A | Transparente (pequeno/médio) Transparente (grande) Tabela de clusters |

5 sender queue 5 sender queue 4 sender Queue |

- Para a replicação, use No Ranges para melhorar o desempenho:

- Os intervalos têm de ser usados apenas quando os registos pendentes são gerados numa tabela de registo com latência elevada.

- Usar um cálculo de intervalo: o tipo de leitura para o carregamento inicial não é recomendado no caso de sistemas SLT 2.0 e não HANA.

- Usar um cálculo de intervalo: o tipo de leitura para o carregamento inicial pode resultar em registos duplicados no BigQuery.

- O desempenho é sempre melhor quando é usado um sistema SLT autónomo.

- Recomendamos sempre um sistema SLT autónomo se a utilização de recursos do sistema de origem já for elevada.

Argumentos de tempo de execução

snapshot.thread.count: transmite o número de linhas de execução a iniciar para realizar o carregamento de dadosSNAPSHOT/INITIALem paralelo. Por predefinição, usa o número de vCPUs disponíveis no cluster do Dataproc onde a tarefa de replicação é executada.Recomendado: defina este parâmetro apenas nos casos em que precisa de um controlo preciso do número de threads paralelos (por exemplo, para diminuir a utilização no cluster).

poll.file.count: transmite o número de ficheiros a sondar a partir do caminho do armazenamento na nuvem fornecido no campo Caminho do GCS de replicação de dados na interface Web. Por predefinição, o valor é500por sondagem. No entanto, com base na configuração do cluster, pode ser aumentado ou diminuído.Recomendado: defina este parâmetro apenas se tiver requisitos rigorosos para o atraso de replicação. Valores mais baixos podem reduzir o atraso. Pode usá-lo para melhorar o débito (se não responder, use valores superiores aos predefinidos).

bad.files.base.path: transmite o caminho base do Cloud Storage para onde são copiados todos os ficheiros de dados com erros ou defeitos encontrados durante a replicação. Isto é útil quando existem requisitos rigorosos para a auditoria de dados e tem de ser usada uma localização específica para registar transferências com falhas.Por predefinição, todos os ficheiros com falhas são copiados do caminho do Cloud Storage fornecido no campo Caminho do Cloud Storage de replicação de dados na interface Web.

Padrão do caminho final dos ficheiros de dados com falhas:

gs://BASE_FILE_PATH/MASS_TRANSFER_ID/SOURCE_TABLE_NAME/bad_files/REPLICATION_JOB_NAME/REPLICATION_JOB_ID/BAD_FILE_NAME

Exemplo:

gs://slt_to_cdf_bucket/001/MARA/bad_files/MaraRepl/05f97349-7398-11ec-9443-8 ac0640fc83c/20220205_1901205168830_DATA_INIT.xml

Os critérios para um ficheiro incorreto são um ficheiro XML corrompido ou inválido, valores PK em falta ou um problema de incompatibilidade do tipo de dados de campo.

Detalhes do apoio técnico

Produtos e versões SAP compatíveis

- SAP_BASIS 702 release, SP-Level 0016 e posteriores.

- SAP_ABA 702, nível de SP 0016 e posterior.

- Versão DMIS 2011_1_700, SP-Level 0017 e posterior.

Versões de SLT compatíveis

As versões 2 e 3 do SLT são suportadas.

Modelos de implementação do SAP suportados

SLT como um sistema autónomo ou incorporado no sistema de origem.

Notas SAP que têm de ser implementadas antes de começar a usar o SLT

Se o seu pacote de apoio técnico não incluir correções da classe /UI2/CL_JSON para PL12 ou posterior, implemente a nota SAP mais recente para correções da classe /UI2/CL_JSON, por exemplo, a nota SAP 2798102 para PL12.

Recomendado: implemente as notas SAP recomendadas pelo relatório

CNV_NOTE_ANALYZER_SLT com base na condição do sistema central ou de origem. Para mais informações, consulte a nota SAP 3016862 (é necessário iniciar sessão na SAP).

Se o SAP já estiver configurado, não tem de implementar nenhuma nota adicional. Para erros ou problemas específicos, consulte a nota SAP central para a sua versão do SLT.

Limites para o volume de dados ou a largura do registo

Não existe um limite definido para o volume de dados extraídos e a largura dos registos.

Débito esperado para o plug-in de replicação SAP SLT

Para um ambiente configurado de acordo com as diretrizes em Otimize o desempenho, o plug-in pode extrair cerca de 13 GB por hora para o carregamento inicial e 3 GB por hora para a replicação (CDC). O desempenho real pode variar com a carga do sistema SAP ou o tráfego de rede e o Cloud Data Fusion.

Compatibilidade com a extração delta (dados alterados) do SAP

A extração delta do SAP é suportada.

Obrigatório: interligação de inquilinos para instâncias do Cloud Data Fusion

O peering de inquilinos é necessário quando a instância do Cloud Data Fusion é criada com um endereço IP interno. Para mais informações sobre a interligação de inquilinos, consulte o artigo Criar uma instância privada.

Resolver problemas

A tarefa de replicação continua a ser reiniciada

Se a tarefa de replicação continuar a ser reiniciada automaticamente, aumente a memória do cluster da tarefa de replicação e volte a executar a tarefa de replicação.

Duplicados no destino do BigQuery

Se definir o número de tarefas paralelas nas definições avançadas do plug-in de replicação do SAP SLT, quando as tabelas são grandes, ocorre um erro que provoca a duplicação de colunas no destino do BigQuery.

Para evitar o problema, remova as tarefas paralelas para carregar dados.

Cenários de erro

A tabela seguinte apresenta algumas mensagens de erro comuns (o texto entre aspas é substituído por valores reais no tempo de execução):

| ID da mensagem | Mensagem | Ação recomendada |

|---|---|---|

CDF_SAP_SLT_01402 |

Service account type is not defined for

SERVICE_ACCT_NAME_FROM_UI. |

Certifique-se de que o caminho do armazenamento na nuvem fornecido está correto. |

CDF_SAP_SLT_01403 |

Service account key provided is not valid due to error:

ROOT_CAUSE. Please provide a valid service account key for

service account type : SERVICE_ACCT_NAME_FROM_UI. |

Verifique a causa principal apresentada na mensagem e tome as medidas adequadas. |

CDF_SAP_SLT_01404 |

Mass Transfer ID could not be found. Please ensure that it exists

in given GCS Bucket. |

Verifique se o ID de transferência em massa fornecido está no formato correto. |

CDF_SAP_SLT_01502 |

The specified data replication GCS path 'slt_to_cdf_bucket_1' or

Mass Transfer ID '05C' could not be found. Please ensure that it exists in

GCS. |

Certifique-se de que o caminho do Google Cloud Storage indicado está correto. |

CDF_SAP_SLT_01400 |

Metadata file not found. The META_INIT.json file is not present or

file is present with invalid format. |

Verifique a causa principal apresentada na mensagem e tome as medidas adequadas. |

CDF_SAP_SLT_03408 |

Failed to start the event reader. |

Verifique a causa principal apresentada na mensagem e tome as medidas adequadas. |

CDF_SAP_SLT_03409 |

Error while processing TABLE_NAME file for source table

gs://CLOUD_STORAGE_BUCKET_NAME/MT_ID/TABLE_NAME

/FILE_NAME. Root cause: ROOT_CAUSE. |

Verifique a causa principal apresentada na mensagem e tome as medidas adequadas. |

CDF_SAP_SLT_03410 |

Failed to replicate data for source table TABLE_NAME

from file: gs://CLOUD_STORAGE_BUCKET_NAME/MT_ID/

TABLE_NAME/FILE_NAME. Root cause:

ROOT_CAUSE. |

Verifique a causa principal apresentada na mensagem e tome as medidas adequadas. |

CDF_SAP_SLT_03411 |

Failed data replication for source table TABLE_NAME.

Root cause: ROOT_CAUSE. |

Verifique a causa principal apresentada na mensagem e tome as medidas adequadas. |

CDF_SAP_SLT_03412 |

Failed to create target table for source table

TABLE_NAME. Root cause: ROOT_CAUSE. |

Verifique a causa principal apresentada na mensagem e tome as medidas adequadas. |

Mapeamento de tipos de dados

A tabela seguinte mostra o mapeamento entre os tipos de dados usados nas aplicações SAP e no Cloud Data Fusion.

| Tipo de dados SAP | Tipo ABAP | Descrição (SAP) | Tipo de dados do Cloud Data Fusion |

|---|---|---|---|

| Numérico | |||

| INT1 | b | Número inteiro de 1 byte | int |

| INT2 | s | Número inteiro de 2 bytes | int |

| INT4 | i | Número inteiro de 4 bytes | int |

| INT8 | 8 | Número inteiro de 8 bytes | long |

| DEZ | p | Número compactado no formato BCD (DEC) | decimal |

| DF16_DEC DF16_RAW |

a | Vírgula flutuante decimal de 8 bytes IEEE 754r | decimal |

| DF34_DEC DF34_RAW |

e | Vírgula flutuante decimal de 16 bytes IEEE 754r | decimal |

| FLTP | f | Número de vírgula flutuante binário | double |

| Caráter | |||

| CARÁCT CARÁCT.ESQ |

c | String de carateres | string |

| SSTRING GEOM_EWKB |

de string | String de carateres | string |

| STRING GEOM_EWKB |

de string | CLOB de string de carateres | bytes |

| NUMC ACCP |

n | Texto numérico | string |

| Byte | |||

| RAW LRAW |

x | Dados binários | bytes |

| RAWSTRING | xstring | BLOB de string de bytes | bytes |

| Data/hora | |||

| DATS | d | Data | date |

| Tims | t | Hora | time |

| TIMESTAMP | utcl | ( Utclong ) TimeStamp |

timestamp |

O que se segue?

- Saiba mais sobre o Cloud Data Fusion.

- Saiba mais sobre o SAP no Google Cloud.