Die k-Anonymität eines Datasets gibt Auskunft über die Re-Identifizierbarkeit der darin enthaltenen Datensätze. Ein Dataset ist k-anonym, wenn Quasi-Identifikatoren für jede im Dataset gespeicherte Person mit jenen von mindestens k – 1 weiteren in demselben Dataset gespeicherten Personen identisch sind.

Sie können den k-Anonymitätswert basierend auf einzelnen oder mehreren Spalten oder Feldern eines Datasets berechnen. In diesem Thema wird gezeigt, wie k-Anonymitätswerte für ein Dataset mit dem Schutz sensibler Daten berechnet werden. Bevor Sie fortfahren, lesen Sie weitere Informationen zur k-Anonymität oder zur Risikoanalyse im Allgemeinen im Thema zum Konzept der Risikoanalyse.

Hinweise

Bevor Sie fortfahren, führen Sie Folgendes aus:

- Melden Sie sich bei Ihrem Google-Konto an.

- Wählen Sie in der Google Cloud Console auf der Seite für die Projektauswahl ein Google Cloud-Projekt aus oder erstellen Sie eines. Projektauswahl aufrufen

- Die Abrechnung für das Google Cloud-Projekt muss aktiviert sein. Weitere Informationen zur Abrechnung Ihres Projekts.

- Aktivieren Sie den Schutz sensibler Daten. Schutz sensibler Daten aktivieren

- Wählen Sie das zu analysierende BigQuery-Dataset aus. Der Schutz sensibler Daten berechnet den k-Anonymitätsmesswert durch Scannen einer BigQuery-Tabelle.

- Bestimmen Sie (falls zutreffend) einen Identifikator und mindestens einen Quasi-Identifikator im Dataset. Weitere Informationen finden Sie unter Begriffe und Techniken der Risikoanalyse.

k-Anonymität berechnen

Der Schutz sensibler Daten führt bei jeder Ausführung eines Risikoanalysejobs eine Risikoanalyse durch. Sie müssen den Job zuerst erstellen. Verwenden Sie dazu entweder die Google Cloud Console, eine DLP API-Anfrage oder eine Clientbibliothek für den Schutz sensibler Daten.

Console

Rufen Sie in der Google Cloud Console die Seite Risikoanalyse erstellen auf.

Legen Sie im Bereich Eingabedaten auswählen die zu scannende BigQuery-Tabelle fest. Geben Sie dazu die Projekt-ID des Projekts, das die Tabelle enthält, die Dataset-ID der Tabelle und den Namen der Tabelle ein.

Wählen Sie unter Datenschutzmesswert zur Berechnung () k-Anonymität aus.

Im Bereich Job-ID können Sie dem Job optional eine benutzerdefinierte Kennung zuweisen und einen Ressourcenstandort auswählen, an dem der Schutz sensibler Daten Ihre Daten verarbeitet. Wenn Sie fertig sind, klicken Sie auf Weiter.

Im Abschnitt Felder definieren geben Sie Identifikatoren und Quasi-Identifikatoren für den k-Anonymitätsrisiko-Job an. Der Schutz sensibler Daten greift auf die Metadaten der BigQuery-Tabelle zu, die Sie im vorherigen Schritt angegeben haben, und versucht, die Liste der Felder mit Daten zu füllen.

- Klicken Sie das entsprechende Kästchen an, um ein Feld als Identifikator (ID) oder Quasi-Identifikator (QI) zu designieren. Sie müssen entweder 0 oder 1 Identifikator und mindestens 1 Quasi-Identifikator auswählen.

- Wenn die Felder für den Schutz sensibler Daten nicht ausgefüllt werden können, klicken Sie auf Feldnamen eingeben, um ein oder mehrere Felder manuell einzugeben und jedes Feld als Kennung oder Quasi-ID festzulegen. Wenn Sie fertig sind, klicken Sie auf Weiter.

Im Abschnitt Aktionen hinzufügen () können Sie optionale Aktionen hinzufügen, die ausgeführt werden, wenn der Risikojob abgeschlossen ist. Folgende Optionen sind verfügbar:

- In BigQuery speichern (): Die Ergebnisse des Risikoanalysescans werden in einer BigQuery-Tabelle gespeichert.

In Pub/Sub veröffentlichen: Veröffentlicht eine Benachrichtigung in einem Cloud Pub/Sub-Thema.

Per E-Mail benachrichtigen: Sendet Ihnen eine E-Mail mit Ergebnissen. Wenn Sie fertig sind, klicken Sie auf Erstellen.

Der k-Anonymität-Risikoanalysejob beginnt sofort.

C#

Informationen zum Installieren und Verwenden der Clientbibliothek für den Schutz sensibler Daten finden Sie unter Clientbibliotheken für den Schutz sensibler Daten.

Richten Sie Standardanmeldedaten für Anwendungen ein, um sich beim Schutz sensibler Daten zu authentifizieren. Weitere Informationen finden Sie unter Authentifizierung für eine lokale Entwicklungsumgebung einrichten.

Go

Informationen zum Installieren und Verwenden der Clientbibliothek für den Schutz sensibler Daten finden Sie unter Clientbibliotheken für den Schutz sensibler Daten.

Richten Sie Standardanmeldedaten für Anwendungen ein, um sich beim Schutz sensibler Daten zu authentifizieren. Weitere Informationen finden Sie unter Authentifizierung für eine lokale Entwicklungsumgebung einrichten.

Java

Informationen zum Installieren und Verwenden der Clientbibliothek für den Schutz sensibler Daten finden Sie unter Clientbibliotheken für den Schutz sensibler Daten.

Richten Sie Standardanmeldedaten für Anwendungen ein, um sich beim Schutz sensibler Daten zu authentifizieren. Weitere Informationen finden Sie unter Authentifizierung für eine lokale Entwicklungsumgebung einrichten.

Node.js

Informationen zum Installieren und Verwenden der Clientbibliothek für den Schutz sensibler Daten finden Sie unter Clientbibliotheken für den Schutz sensibler Daten.

Richten Sie Standardanmeldedaten für Anwendungen ein, um sich beim Schutz sensibler Daten zu authentifizieren. Weitere Informationen finden Sie unter Authentifizierung für eine lokale Entwicklungsumgebung einrichten.

PHP

Informationen zum Installieren und Verwenden der Clientbibliothek für den Schutz sensibler Daten finden Sie unter Clientbibliotheken für den Schutz sensibler Daten.

Richten Sie Standardanmeldedaten für Anwendungen ein, um sich beim Schutz sensibler Daten zu authentifizieren. Weitere Informationen finden Sie unter Authentifizierung für eine lokale Entwicklungsumgebung einrichten.

Python

Informationen zum Installieren und Verwenden der Clientbibliothek für den Schutz sensibler Daten finden Sie unter Clientbibliotheken für den Schutz sensibler Daten.

Richten Sie Standardanmeldedaten für Anwendungen ein, um sich beim Schutz sensibler Daten zu authentifizieren. Weitere Informationen finden Sie unter Authentifizierung für eine lokale Entwicklungsumgebung einrichten.

REST

Zum Ausführen eines neuen Risikoanalysejobs zur Berechnung der k-Anonymität senden Sie eine Anfrage an die Ressource projects.dlpJobs, wobei PROJECT_ID für Ihre Projekt-ID steht:

https://dlp.googleapis.com/v2/projects/PROJECT_ID/dlpJobs

Die Anfrage enthält ein RiskAnalysisJobConfig-Objekt, das Folgendes umfasst:

Ein

PrivacyMetric-Objekt. Hier geben Sie an, dass Sie die k-Anonymität berechnen, indem Sie einKAnonymityConfig-Objekt einschließen.Ein

BigQueryTable-Objekt. Geben Sie die zu untersuchende BigQuery-Tabelle an. Dazu beziehen Sie die folgenden Parameter ein:projectId: die Projekt-ID des Projekts, das die Tabelle enthältdatasetId: die Dataset-ID der TabelletableId: der Name der Tabelle

Ein oder mehrere

Action-Objekte für Aktionen, die nach Abschluss des Jobs in der angegebenen Reihenfolge ausgeführt werden sollen. JedesAction-Objekt kann eine der folgenden Aktionen enthalten:SaveFindings-Objekt: speichert die Ergebnisse des Risikoanalysescans in einer BigQuery-TabellePublishToPubSub-Objekt: Veröffentlicht eine Benachrichtigung in einem Cloud Pub/Sub-ThemaJobNotificationEmails-Objekt: Sendet Ihnen eine E-Mail mit Ergebnissen.

Geben Sie im Objekt

KAnonymityConfigFolgendes an:quasiIds[]: ein oder mehrere Quasi-Identifikatoren (FieldId-Objekte) zum Scannen und zur Berechnung der k-Anonymität. Wenn Sie mehrere Quasi-Identifikatoren angeben, werden sie als ein einziger zusammengesetzter Schlüssel betrachtet. Structs und wiederholte Datentypen werden nicht unterstützt, verschachtelte Felder werden jedoch unterstützt, sofern sie nicht selbst Structs oder in einem wiederholten Feld verschachtelt sind.entityId: optionaler Identifikator, der angibt, dass alle Zeilen, die der jeweiligen spezifischenentityIdentsprechen, für die k-Anonymitätsberechnung gruppiert werden sollen. In der Regel ist eineentityIdeine Spalte, die einen eindeutigen Nutzer darstellt, z. B. eine Kunden-ID oder eine Nutzer-ID. Wenn eineentityIdin mehreren Zeilen mit unterschiedlichen Quasi-Identifikatoren enthalten ist, werden diese Zeilen zu einem Multiset zusammengefasst, das als Quasi-Identifikator für diese Entität verwendet wird. Weitere Informationen zu Entitäts-IDs finden Sie im Konzept-Thema "Risikoanalyse" unter Entitäts-IDs und das Berechnen der k-Anonymität.

Sobald Sie eine Anfrage an die DLP API senden, wird der Risikoanalysejob gestartet.

Abgeschlossene Risikoanalysejobs auflisten

Sie können eine Liste der Risikoanalysejobs aufrufen, die im aktuellen Projekt ausgeführt wurden.

Console

So listen Sie laufende und zuvor ausgeführte Risikoanalysejobs in der Google Cloud Console auf:

Öffnen Sie in der Google Cloud Console den Schutz sensibler Daten.

Klicken Sie oben auf der Seite auf den Tab Jobs und Job-Trigger.

Klicken Sie auf den Tab Risikojobs.

Die Liste der Risikojobs wird angezeigt.

Protokoll

Senden Sie eine GET-Anfrage an die Ressource projects.dlpJobs, um gerade ausgeführte und zuvor ausgeführte Risikoanalysejobs aufzulisten. Durch Hinzufügen eines Jobtypfilters (?type=RISK_ANALYSIS_JOB) wird die Antwort auf nur Risikoanalysejobs beschränkt.

https://dlp.googleapis.com/v2/projects/PROJECT_ID/dlpJobs?type=RISK_ANALYSIS_JOB

Die erhaltene Antwort enthält eine JSON-Darstellung aller aktuellen und vorherigen Risikoanalysejobs.

k-Anonymität-Job-Ergebnisse ansehen

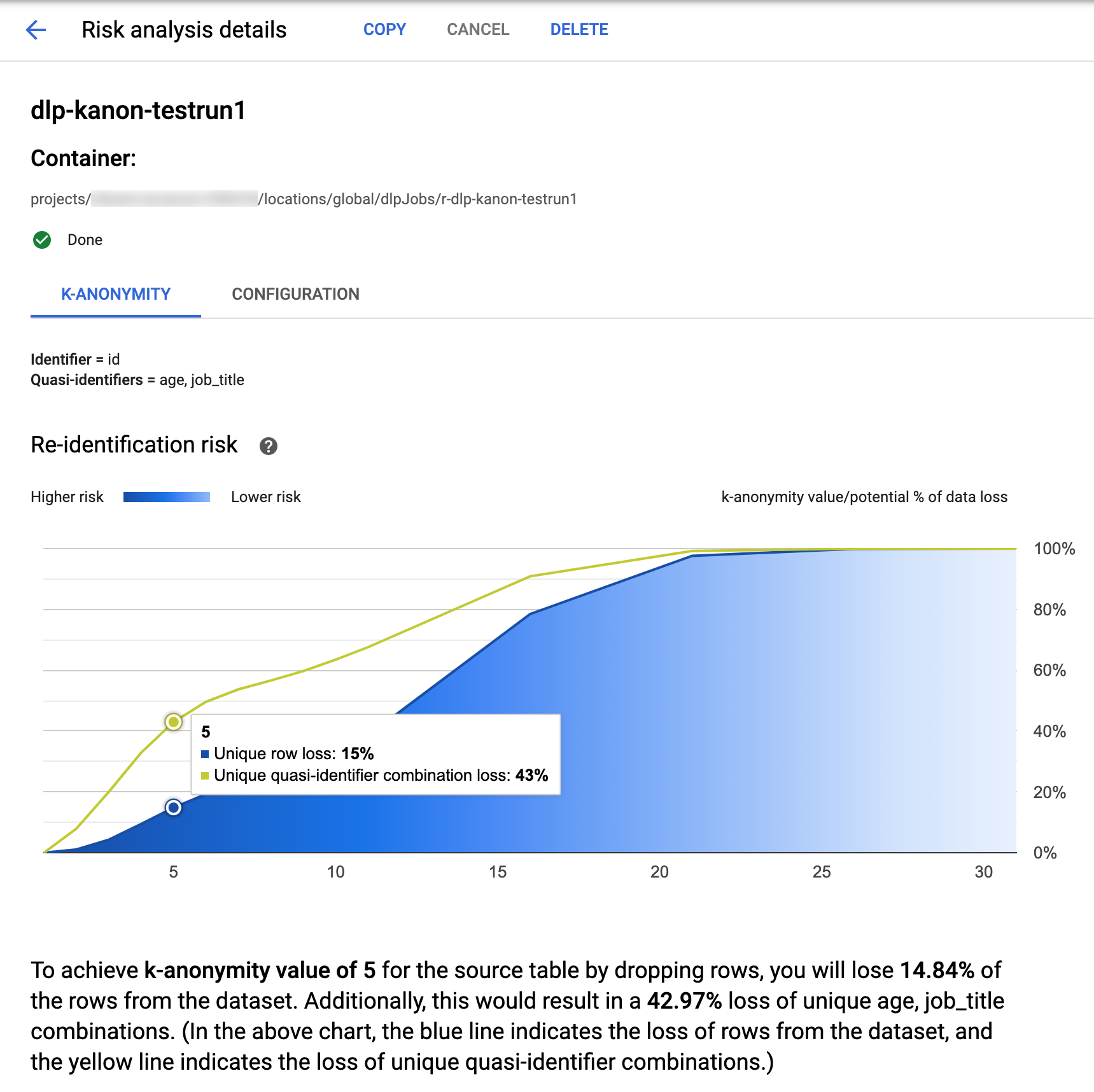

Der Schutz sensibler Daten in der Google Cloud Console bietet integrierte Visualisierungen für abgeschlossene k-Anonymitätsjobs. Nachdem Sie der Anleitung im vorherigen Abschnitt gefolgt sind, wählen Sie aus der Liste der Risikoanalysejobs den Job aus, für den Sie Ergebnisse ansehen möchten. Wenn der Job erfolgreich ausgeführt wurde, sieht die Seite Risikoanalysedetails oben so aus:

Oben auf der Seite finden Sie Informationen zum k-Anonymitäts-Risikojob, einschließlich seiner Job-ID und unter Container seine Ressourcenstandort.

Klicken Sie auf den Tab k-Anonymität, um die Ergebnisse der k-Anonymitätsberechnung anzuzeigen. Klicken Sie zum Anzeigen der Konfiguration des Risikoanalysejobs auf den Tab Konfiguration.

Der Tab k-Anonymität listet zuerst die Entitäts-ID (falls vorhanden) und die Quasi-Kennzeichnungen auf, die zur Berechnung der k-Anonymität verwendet werden.

Risikodiagramm

Im Diagramm Re-Identifikationsrisiko-wird auf der y-Achse der potenzielle Prozentsatz des Datenverlusts sowohl für eindeutige Zeilen als auch für eindeutige Quasi-Identifikator-Kombinationen dargestellt, um auf der x-Achse einen k-Anonymitätswert zu erreichen. Die Farbe des Diagramms zeigt auch das Risikopotenzial an. Dunklere Blautöne weisen auf ein höheres Risiko hin, hellere auf ein geringeres Risiko.

Höhere k-Anonymitätswerte weisen auf ein geringeres Risiko einer Re-Identifikation hin. Um höhere k-Anonymitätswerte zu erreichen, müssten Sie jedoch höhere Prozentsätze der gesamten Zeilen und höhere eindeutige Quasi-Identifier-Kombinationen entfernen, was den Nutzen der Daten verringern könnte. Bewegen Sie den Mauszeiger über das Diagramm, um einen bestimmten potenziellen prozentualen Verlustwert für einen bestimmten k-Anonymitätswert anzuzeigen. Wie im Screenshot dargestellt, wird im Diagramm eine Kurzinfo angezeigt.

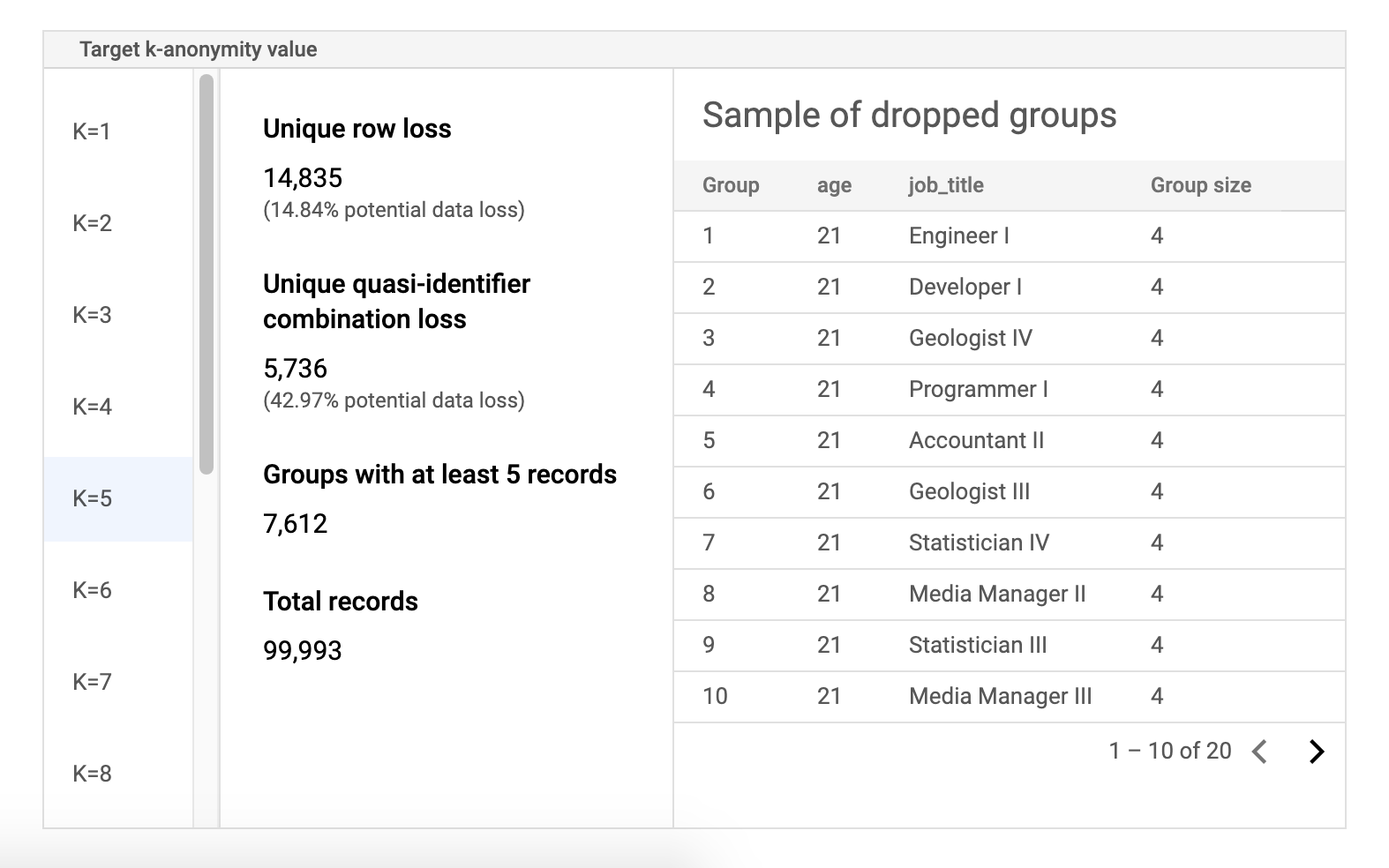

Klicken Sie auf den entsprechenden Datenpunkt, um weitere Details zu einem bestimmten k-Anonymitätswert anzuzeigen. Unter dem Diagramm wird eine detaillierte Erläuterung angezeigt und weiter unten auf der Seite wird eine Beispieldatentabelle angezeigt.

Risiko-Beispieldatentabelle

Die zweite Komponente der Ergebnisseite für Risikojobs ist die Beispieldatentabelle. Darin werden Quasi-Identifikatoren-Kombinationen für einen bestimmten Ziel-k-Anonymitätswert angezeigt.

Die erste Spalte der Tabelle enthält die k-Anonymitätswerte. Klicken Sie auf einen k-Anonymitätswert, um die entsprechenden Beispieldaten anzuzeigen, die gelöscht werden müssten, um diesen Wert zu erreichen.

Die zweite Spalte zeigt den jeweiligen potenziellen Datenverlust von einzigartigen Zeilen und Quasi-Identifikatoren-Kombinationen sowie die Anzahl der Gruppen mit mindestens k Datensätzen und die Gesamtzahl der Datensätze an.

Die letzte Spalte enthält eine Auswahl an Gruppen die eine Quasi-Identifikatoren-Kombination gemeinsam nutzen und die Anzahl der Datensätze, die für diese Kombination vorhanden sind.

Jobdetails mit REST abrufen

Wenn Sie die Ergebnisse des k-Anonymität-Risikoanalysejobs mit der REST API abrufen möchten, senden Sie die folgende GET-Anfrage an die projects.dlpJobs-Ressource. Ersetzen Sie PROJECT_ID durch Ihre Projekt-ID und JOB_ID durch die ID des Jobs, für den Sie Ergebnisse erhalten möchten.

Die Job-ID wurde beim Start des Jobs zurückgegeben und kann auch durch Auflisten aller Jobs abgerufen werden.

GET https://dlp.googleapis.com/v2/projects/PROJECT_ID/dlpJobs/JOB_ID

Die Anfrage gibt ein JSON-Objekt zurück, das eine Instanz des Jobs enthält. Die Ergebnisse der Analyse befinden sich im Schlüssel "riskDetails" in einem AnalyzeDataSourceRiskDetails-Objekt. Weitere Informationen finden Sie in der API-Referenz zur Ressource DlpJob.

Codebeispiel: k-Anonymität mit einer Entitäts-ID berechnen

In diesem Beispiel wird ein Risikoanalysejob erstellt, der die k-Anonymität mit einer Entitäts-ID berechnet.

Weitere Informationen zu Entitäts-IDs finden Sie unter Entitäts-IDs und das Berechnen der k-Anonymität.

C#

Informationen zum Installieren und Verwenden der Clientbibliothek für den Schutz sensibler Daten finden Sie unter Clientbibliotheken für den Schutz sensibler Daten.

Richten Sie Standardanmeldedaten für Anwendungen ein, um sich beim Schutz sensibler Daten zu authentifizieren. Weitere Informationen finden Sie unter Authentifizierung für eine lokale Entwicklungsumgebung einrichten.

Go

Informationen zum Installieren und Verwenden der Clientbibliothek für den Schutz sensibler Daten finden Sie unter Clientbibliotheken für den Schutz sensibler Daten.

Richten Sie Standardanmeldedaten für Anwendungen ein, um sich beim Schutz sensibler Daten zu authentifizieren. Weitere Informationen finden Sie unter Authentifizierung für eine lokale Entwicklungsumgebung einrichten.

Java

Informationen zum Installieren und Verwenden der Clientbibliothek für den Schutz sensibler Daten finden Sie unter Clientbibliotheken für den Schutz sensibler Daten.

Richten Sie Standardanmeldedaten für Anwendungen ein, um sich beim Schutz sensibler Daten zu authentifizieren. Weitere Informationen finden Sie unter Authentifizierung für eine lokale Entwicklungsumgebung einrichten.

Node.js

Informationen zum Installieren und Verwenden der Clientbibliothek für den Schutz sensibler Daten finden Sie unter Clientbibliotheken für den Schutz sensibler Daten.

Richten Sie Standardanmeldedaten für Anwendungen ein, um sich beim Schutz sensibler Daten zu authentifizieren. Weitere Informationen finden Sie unter Authentifizierung für eine lokale Entwicklungsumgebung einrichten.

PHP

Informationen zum Installieren und Verwenden der Clientbibliothek für den Schutz sensibler Daten finden Sie unter Clientbibliotheken für den Schutz sensibler Daten.

Richten Sie Standardanmeldedaten für Anwendungen ein, um sich beim Schutz sensibler Daten zu authentifizieren. Weitere Informationen finden Sie unter Authentifizierung für eine lokale Entwicklungsumgebung einrichten.

Python

Informationen zum Installieren und Verwenden der Clientbibliothek für den Schutz sensibler Daten finden Sie unter Clientbibliotheken für den Schutz sensibler Daten.

Richten Sie Standardanmeldedaten für Anwendungen ein, um sich beim Schutz sensibler Daten zu authentifizieren. Weitere Informationen finden Sie unter Authentifizierung für eine lokale Entwicklungsumgebung einrichten.

Nächste Schritte

- l-Diversität-Wert für ein Dataset berechnen

- k-map-Wert für ein Dataset berechnen

- δ-Präsenzwert für ein Dataset berechnen