En esta guía para principiantes se presentan las tecnologías principales de la IA generativa y se explica cómo se combinan para potenciar los chatbots y las aplicaciones. La IA generativa (también conocida como IA gen o gen AI) es un campo del aprendizaje automático que desarrolla y usa modelos de aprendizaje automático para generar contenido nuevo.

Los modelos de IA generativa se suelen denominar modelos de lenguaje extensos (LLMs) debido a su gran tamaño y a su capacidad para entender y generar lenguaje natural. Sin embargo, en función de los datos con los que se entrenen, estos modelos pueden entender y generar contenido de varias modalidades, como texto, imágenes, vídeos y audio. Los modelos que funcionan con varias modalidades de datos se denominan modelos multimodales.

Google ofrece la familia de modelos de IA generativa Gemini, diseñada para casos prácticos multimodales, capaz de procesar información de múltiples modalidades, como imágenes, vídeos y texto.

Generación de contenido

Para que los modelos de IA generativa puedan generar contenido útil en aplicaciones reales, deben tener las siguientes funciones:

Aprende a realizar tareas nuevas:

Los modelos de IA generativa se han diseñado para realizar tareas generales. Si quieres que un modelo realice tareas específicas de tu caso práctico, debes poder personalizarlo. En Vertex AI, puedes personalizar tu modelo mediante el ajuste de modelos.

Acceder a información externa:

Los modelos de IA generativa se entrenan con grandes cantidades de datos. Sin embargo, para que estos modelos sean útiles, deben poder acceder a información que no esté incluida en sus datos de entrenamiento. Por ejemplo, si quieres crear un chatbot de atención al cliente que funcione con un modelo de IA generativa, el modelo debe tener acceso a información sobre los productos y servicios que ofreces. En Vertex AI, puedes usar las funciones de grounding y de llamadas a funciones para ayudar al modelo a acceder a información externa.

Bloquear contenido dañino:

Los modelos de IA generativa pueden generar resultados inesperados, como texto ofensivo o poco sensible. Para mantener la seguridad y evitar un uso inadecuado, los modelos necesitan filtros de seguridad que bloqueen las peticiones y las respuestas que se consideren potencialmente dañinas. Vertex AI tiene funciones de seguridad integradas que fomentan el uso responsable de nuestros servicios de IA generativa.

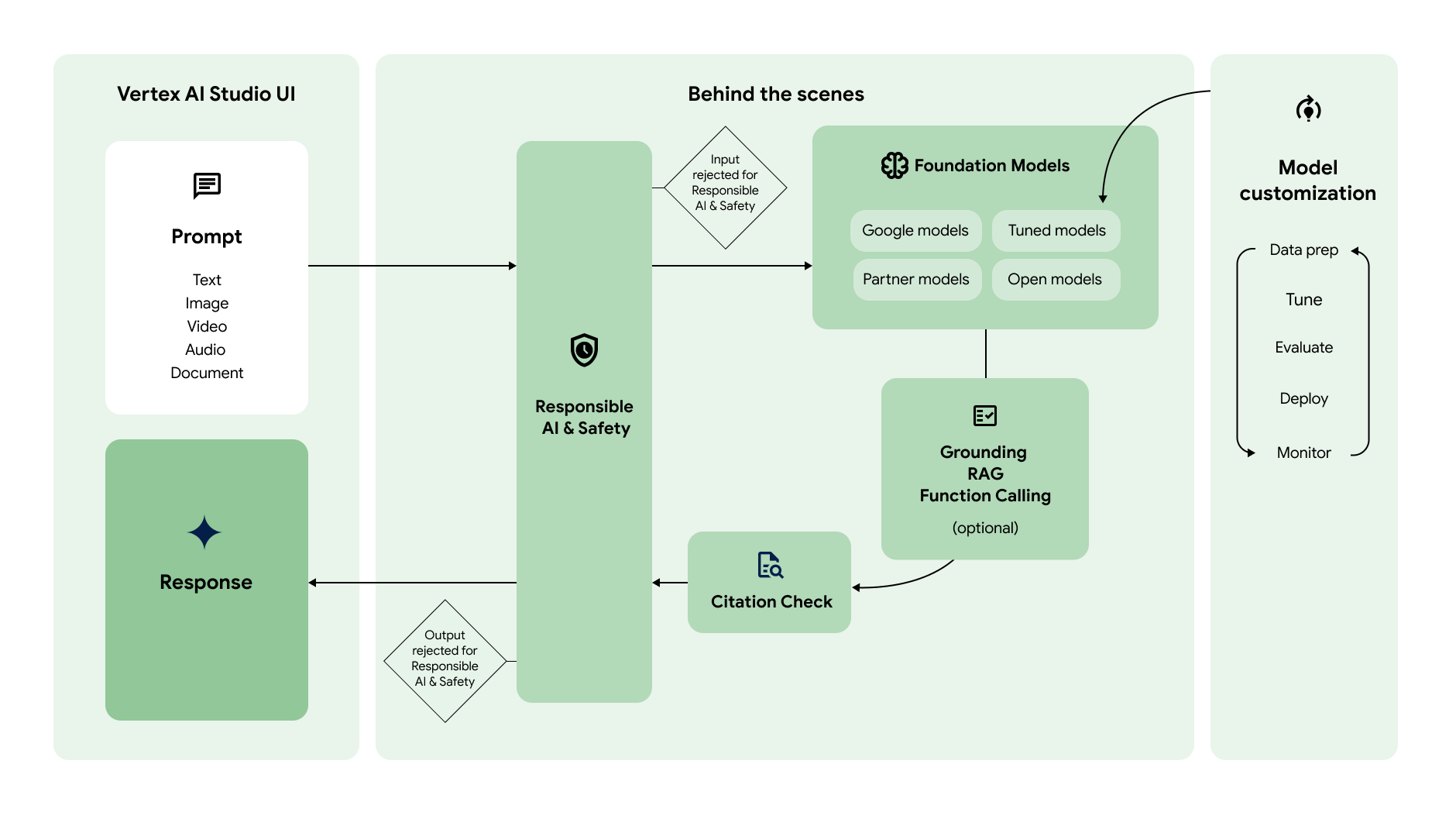

En el siguiente diagrama se muestra cómo funcionan estas funciones en conjunto para generar el contenido que quieres:

Petición

|

|

El flujo de trabajo de la IA generativa suele empezar con una petición. Una petición es una solicitud en lenguaje natural que se envía a un modelo de IA generativa para obtener una respuesta. En función del modelo, una petición puede contener texto, imágenes, vídeos, audio, documentos y otras modalidades, o incluso varias modalidades (multimodal). Crear una petición para obtener la respuesta deseada del modelo es una práctica que se denomina diseño de peticiones. Aunque el diseño de peticiones es un proceso de prueba y error, hay principios y estrategias que puedes usar para animar al modelo a comportarse de la forma que quieras. Vertex AI Studio ofrece una herramienta de gestión de peticiones para ayudarte a gestionar tus peticiones. |

Modelos fundacionales

|

|

Las peticiones se envían a un modelo de IA generativa para que genere respuestas. Vertex AI ofrece una variedad de modelos fundacionales de IA generativa a los que se puede acceder a través de una API gestionada, incluidos los siguientes:

Los modelos se diferencian en tamaño, modalidad y coste. En Model Garden, puedes explorar modelos de Google, así como modelos abiertos y modelos de partners de Google. |

Personalización de modelos

|

|

Puedes personalizar el comportamiento predeterminado de los modelos fundacionales de Google para que generen los resultados que quieras de forma coherente sin usar peticiones complejas. Este proceso de personalización se denomina ajuste del modelo. El ajuste de modelos te ayuda a reducir el coste y la latencia de tus solicitudes, ya que te permite simplificar tus peticiones. Vertex AI también ofrece herramientas de evaluación de modelos para ayudarte a evaluar el rendimiento de tu modelo ajustado. Cuando tu modelo ajustado esté listo para producción, podrás desplegarlo en un endpoint y monitorizar su rendimiento como en los flujos de trabajo de MLOps estándar. |

Acceder a información externa

|

|

Vertex AI ofrece varias formas de dar acceso al modelo a APIs externas e información en tiempo real.

|

Comprobación de citas

|

|

Una vez que se genera la respuesta, Vertex AI comprueba si es necesario incluir citas en ella. Si una cantidad significativa del texto de la respuesta procede de una fuente concreta, esa fuente se añade a los metadatos de la cita en la respuesta. |

IA responsable y seguridad

|

|

La última capa de comprobaciones por la que pasan la petición y la respuesta antes de devolverse son los filtros de seguridad. Vertex AI comprueba tanto la petición como la respuesta para determinar en qué medida pertenecen a una categoría de seguridad. Si se supera el umbral de una o varias categorías, la respuesta se bloquea y Vertex AI devuelve una respuesta alternativa. |

Respuesta

|

|

Si la petición y la respuesta superan las comprobaciones del filtro de seguridad, se devuelve la respuesta. Normalmente, la respuesta se devuelve de una vez. Sin embargo, con Vertex AI también puedes recibir respuestas de forma progresiva a medida que se generan habilitando el streaming. |

Empezar

Prueba una de estas guías de inicio rápido para empezar a usar la IA generativa en Vertex AI:

- Generar texto con la API de Gemini de Vertex AI: usa el SDK para enviar solicitudes a la API de Gemini de Vertex AI

- Enviar peticiones a Gemini mediante la galería de peticiones de Vertex AI Studio: prueba peticiones sin necesidad de configuración.

- Generar una imagen y verificar su marca de agua con Imagen: Crea una imagen con marca de agua usando Imagen en Vertex AI