Questa pagina mostra come esportare log e metriche da un cluster Anthos collegato a Cloud Logging e Cloud Monitoring.

Come funziona

La suite operativa di Google Cloud è la soluzione di osservabilità integrata per Google Cloud. Per esportare la telemetria a livello di cluster da un cluster collegato a Google Cloud, devi eseguire il deployment nel tuo cluster dei seguenti agenti di esportazione open source:

- Stackdriver Log Aggregator (stackdriver-log-aggregator-*). Un Fluentd StatefulSet che invia log all'API Cloud Logging (in precedenza Stackdriver Logging).

- Stackdriver Log Forwarder (stackdriver-log-forwarder-*). Un daemonset Fluentbit che inoltra i log da ogni nodo Kubernetes all'aggregatore di log di Stackdriver.

- Raccoglitore metriche Stackdriver (stackdriver-prometheus-k8s-*). Un Prometheus StatefulSet, configurato con un container sidecar per l'esportazione stackdriver, per inviare metriche Prometheus all'API Cloud Monitoring (in precedenza Stackdriver Monitoring). Il sidecar è un altro container all'interno dello stesso pod che legge le metriche che il server Prometheus archivia su disco e le inoltra all'API Cloud Monitoring.

Prerequisiti

Un progetto Google Cloud con fatturazione abilitata. Per informazioni sui costi della Suite operativa di Google Cloud, consulta la nostra guida ai prezzi.

Un cluster Anthos collegato, registrato utilizzando questa guida. Esegui questo comando per verificare che il cluster sia registrato.

gcloud container fleet memberships list

Output di esempio:

NAME EXTERNAL_ID eks ae7b76b8-7922-42e9-89cd-e46bb8c4ffe4

Un ambiente locale da cui puoi accedere al cluster ed eseguire comandi

kubectl. Consulta la guida rapida di GKE per istruzioni su come installarekubectltramite gcloud. Esegui il comando seguente per verificare di poter raggiungere il cluster associato utilizzandokubectl.kubectl cluster-info

Output di esempio:

Kubernetes master is running at https://[redacted].gr7.us-east-2.eks.amazonaws.com

Configurazione

Clona il repository di esempio e vai alla directory per questa guida.

git clone https://github.com/GoogleCloudPlatform/anthos-samples cd anthos-samples/attached-logging-monitoring

Imposta la variabile ID progetto sul progetto in cui hai registrato il cluster.

PROJECT_ID="your-project-id"

Creare un account di servizio Google Cloud con le autorizzazioni per scrivere metriche e log nelle API Cloud Monitoring e Cloud Logging. La chiave di questo account di servizio verrà aggiunta ai carichi di lavoro di cui hai eseguito il deployment nella sezione successiva.

gcloud iam service-accounts create anthos-lm-forwarder gcloud projects add-iam-policy-binding $PROJECT_ID \ --member="serviceAccount:anthos-lm-forwarder@${PROJECT_ID}.iam.gserviceaccount.com" \ --role=roles/logging.logWriter gcloud projects add-iam-policy-binding $PROJECT_ID \ --member="serviceAccount:anthos-lm-forwarder@${PROJECT_ID}.iam.gserviceaccount.com" \ --role=roles/monitoring.metricWriterCreare e scaricare una chiave JSON per l'account di servizio appena creato, quindi creare un secret Kubernetes nel cluster utilizzando la chiave.

gcloud iam service-accounts keys create credentials.json \ --iam-account anthos-lm-forwarder@${PROJECT_ID}.iam.gserviceaccount.com kubectl create secret generic google-cloud-credentials -n kube-system --from-file credentials.json

Installazione dell'agente Logging

Passa alla directory

logging/.cd logging/

Apri

aggregator.yaml. Nella parte inferiore del file, imposta le seguenti variabili sul valore corrispondente al tuo progetto e cluster:project_id [PROJECT_ID] k8s_cluster_name [CLUSTER_NAME] k8s_cluster_location [CLUSTER_LOCATION]

Puoi trovare la località del cluster eseguendo il comando seguente con il nome dell'appartenenza al cluster associato e recuperando la località visualizzata all'indirizzo

/locations/<location>.gcloud container fleet memberships describe eks | grep name

Output:

name: projects/my-project/locations/global/memberships/eks

In

aggregator.yaml, involumeClaimTemplates/spec, specifica il PersistentVolumeClaimstorageClassNameper il tuo cluster: abbiamo fornito i valori predefiniti per EKS e AKS per consentirti di rimuovere i commenti in base alle tue esigenze. Se utilizzi EKS, questo ègp2. Per AKS, questo èdefault.Se hai configurato una classe di archiviazione Kubernetes personalizzata in AWS o Azure, vuoi utilizzare una classe di archiviazione non predefinita o stai utilizzando un altro tipo di cluster conforme, puoi aggiungere il tuo

storageClassName. L'storageClassNameappropriato si basa sul tipo di PersistentVolume (PV) di cui è stato eseguito il provisioning da un amministratore per il cluster tramiteStorageClass. Puoi trovare ulteriori informazioni sulle classi di archiviazione e sulle classi di archiviazione predefinite per gli altri principali fornitori di Kubernetes nella documentazione di Kubernetes.# storageClassName: standard #Google Cloud # storageClassName: gp2 #AWS EKS # storageClassName: default #Azure AKS

Eseguire il deployment dell'aggregatore di log e dell'inoltro al cluster.

kubectl apply -f aggregator.yaml kubectl apply -f forwarder.yaml

Verifica che i pod siano stati avviati. Dovresti vedere 2 pod di aggregatore e un pod di forwarding per nodo worker di Kubernetes. Ad esempio, in un cluster a 4 nodi dovresti vedere 4 pod di inoltro.

kubectl get pods -n kube-system | grep stackdriver-log

Output:

stackdriver-log-aggregator-0 1/1 Running 0 139m stackdriver-log-aggregator-1 1/1 Running 0 139m stackdriver-log-forwarder-2vlxb 1/1 Running 0 139m stackdriver-log-forwarder-dwgb7 1/1 Running 0 139m stackdriver-log-forwarder-rfrdk 1/1 Running 0 139m stackdriver-log-forwarder-sqz7b 1/1 Running 0 139m

Ottieni i log degli aggregatori e verifica che i log vengano inviati a Google Cloud.

kubectl logs stackdriver-log-aggregator-0 -n kube-system

Output:

2020-10-12 14:35:40 +0000 [info]: #3 [google_cloud] Successfully sent gRPC to Stackdriver Logging API.

Eseguire il deployment di un'applicazione di test nel tuo cluster. Questo è un server web HTTP di base con un generatore di carico.

kubectl apply -f https://raw.githubusercontent.com/GoogleCloudPlatform/istio-samples/master/sample-apps/helloserver/server/server.yaml kubectl apply -f https://raw.githubusercontent.com/GoogleCloudPlatform/istio-samples/master/sample-apps/helloserver/loadgen/loadgen.yaml

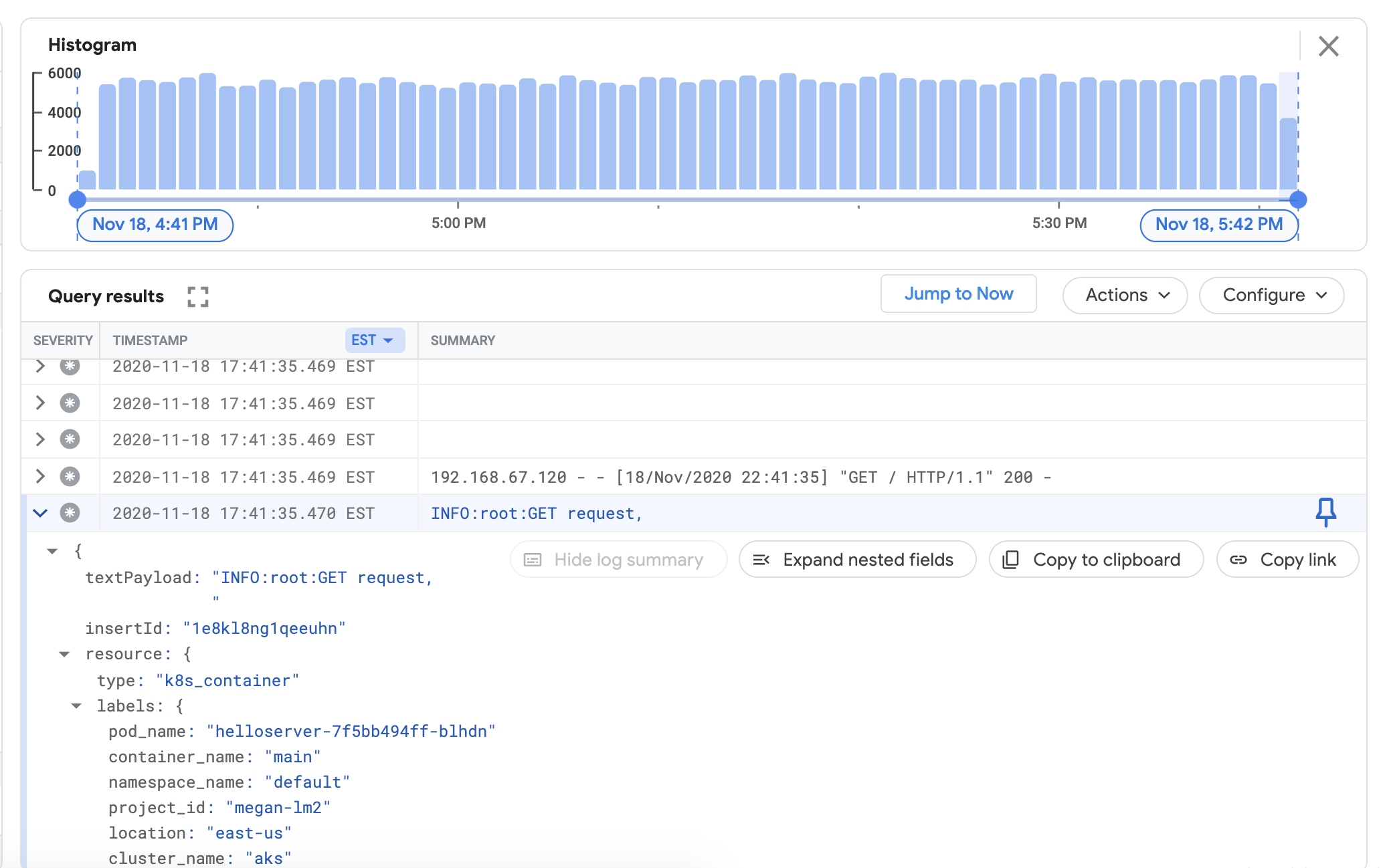

Verificare di poter visualizzare i log dal cluster collegato nella dashboard di Cloud Logging. Vai a Esplora log nella console Google Cloud:

In Esplora log, copia la query di esempio riportata di seguito nel campo Strumento di creazione query, sostituendo

${your-cluster-name}con il nome del cluster. Fai clic su Esegui query. Dovresti vedere i log recenti del cluster in Risultati delle query.resource.type="k8s_container" resource.labels.cluster_name="${your-cluster-name}"

Installazione dell'agente Monitoring

Esci dalla directory

logging/e vai alla directorymonitoring/.cd ../monitoring

Apri

prometheus.yaml. Instackdriver-prometheus-sidecar/args, imposta le seguenti variabili in modo che corrispondano all'ambiente."--stackdriver.project-id=[PROJECT_ID]" "--stackdriver.kubernetes.location=[CLUSTER_LOCATION]" "--stackdriver.generic.location=[CLUSTER_LOCATION]" "--stackdriver.kubernetes.cluster-name=[CLUSTER_NAME]"

Da prometheus.yaml, in

volumeClaimTemplates/spec, rimuovi il commento distorageClassNameche corrisponde al tuo provider cloud, come descritto in Installazione dell'agente Logging.# storageClassName: standard #Google Cloud # storageClassName: gp2 #AWS EKS # storageClassName: default #Azure AKS

Esegui il deployment nel tuo cluster dello stackdriver-prometheus StatefulSet, configurato con il sidecar dell'esportatore.

kubectl apply -f server-configmap.yaml kubectl apply -f sidecar-configmap.yaml kubectl apply -f prometheus.yaml

Verifica che il pod

stackdriver-prometheussia in esecuzione.watch kubectl get pods -n kube-system | grep stackdriver-prometheus

Output:stackdriver-prometheus-k8s-0 2/2 Running 0 5h24m

Scarica i log del container collaterale di Stackdriver Prometheus per verificare che il pod sia stato avviato.

kubectl logs stackdriver-prometheus-k8s-0 -n kube-system stackdriver-prometheus-sidecar

Output:level=info ts=2020-11-18T21:37:24.819Z caller=main.go:598 msg="Web server started" level=info ts=2020-11-18T21:37:24.819Z caller=main.go:579 msg="Stackdriver client started"

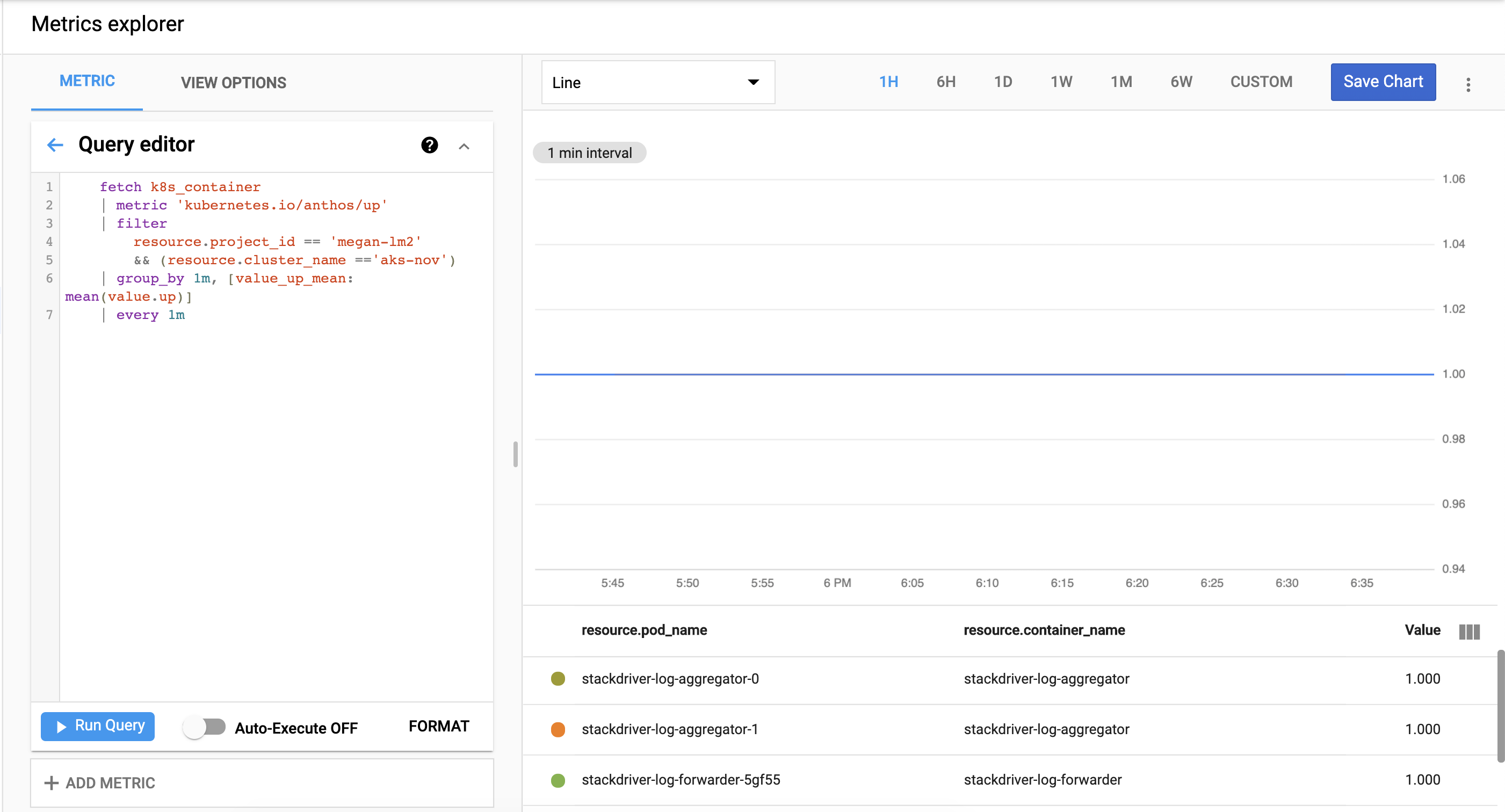

Verifica che le metriche del cluster vengano esportate correttamente in Cloud Monitoring. Vai a Metrics Explorer nella console Google Cloud:

Fai clic su Query editor (Editor query), quindi copia il comando seguente, sostituendo

${your-project-id}e${your-cluster-name}con le informazioni del progetto e del cluster. Quindi, fai clic su Esegui query. Dovresti vedere1.0.fetch k8s_container | metric 'kubernetes.io/anthos/up' | filter resource.project_id == '${your-project-id}' && (resource.cluster_name =='${your-cluster-name}') | group_by 1m, [value_up_mean: mean(value.up)] | every 1m

Esegui la pulizia

Per rimuovere tutte le risorse create in questa guida:

kubectl delete -f logging kubectl delete -f monitoring kubectl delete secret google-cloud-credentials -n kube-system kubectl delete -f https://raw.githubusercontent.com/GoogleCloudPlatform/istio-samples/master/sample-apps/helloserver/loadgen/loadgen.yaml kubectl delete -f https://raw.githubusercontent.com/GoogleCloudPlatform/istio-samples/master/sample-apps/helloserver/server/server.yaml rm -r credentials.json gcloud compute service-accounts delete anthos-lm-forwarder

Quali sono i passaggi successivi?

Informazioni su Cloud Logging:

- Panoramica di Cloud Logging

- Utilizzo di Esplora log

- Creazione di query per Cloud Logging

- Creare metriche basate su log