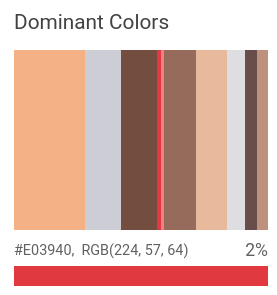

La función Propiedades de la imagen detecta los atributos generales de la imagen, como el color predominante.

Los colores predominantes detectados son los siguientes:

Solicitudes de detección de propiedades de imágenes

Configura el proyecto de Google Cloud y la autenticación

Detecta propiedades de imagen en una imagen local

Puedes usar la API de Vision para realizar la detección de características en un archivo de imagen local.

Para las solicitudes de REST, envía el contenido del archivo de imagen como una string codificada en base64 en el cuerpo de tu solicitud.

Para las solicitudes de biblioteca cliente y gcloud, especifica la ruta a una imagen local en tu solicitud.

El campo ColorInfo no contiene información sobre el espacio de color absoluto que se debe usar para interpretar el valor RGB (p.ej., sRGB, Adobe RGB, DCI-P3, BT.2020, etcétera). De forma predeterminada, las aplicaciones deben tener el espacio de color sRGB.

REST

Antes de usar cualquiera de los datos de solicitud a continuación, realiza los siguientes reemplazos:

- BASE64_ENCODED_IMAGE: Es la representación en base64 (string ASCII) de los datos de la imagen binaria. Esta string debería ser similar a la siguiente:

/9j/4QAYRXhpZgAA...9tAVx/zDQDlGxn//2Q==

- RESULTS_INT: Un valor de número entero de resultados que se mostrarán (opcional). Si omites el campo

"maxResults"y su valor, la API muestra el valor predeterminado de 10 resultados. Este campo no se aplica a los siguientes tipos de funciones:TEXT_DETECTION,DOCUMENT_TEXT_DETECTIONoCROP_HINTS. - PROJECT_ID es el ID del proyecto de Google Cloud.

Método HTTP y URL:

POST https://vision.googleapis.com/v1/images:annotate

Cuerpo JSON de la solicitud:

{

"requests": [

{

"image": {

"content": "BASE64_ENCODED_IMAGE"

},

"features": [

{

"maxResults": RESULTS_INT,

"type": "IMAGE_PROPERTIES"

},

]

}

]

}

Para enviar tu solicitud, elige una de estas opciones:

curl

Guarda el cuerpo de la solicitud en un archivo llamado request.json y ejecuta el siguiente comando:

curl -X POST \

-H "Authorization: Bearer $(gcloud auth print-access-token)" \

-H "x-goog-user-project: PROJECT_ID" \

-H "Content-Type: application/json; charset=utf-8" \

-d @request.json \

"https://vision.googleapis.com/v1/images:annotate"

PowerShell

Guarda el cuerpo de la solicitud en un archivo llamado request.json y ejecuta el siguiente comando:

$cred = gcloud auth print-access-token

$headers = @{ "Authorization" = "Bearer $cred"; "x-goog-user-project" = "PROJECT_ID" }

Invoke-WebRequest `

-Method POST `

-Headers $headers `

-ContentType: "application/json; charset=utf-8" `

-InFile request.json `

-Uri "https://vision.googleapis.com/v1/images:annotate" | Select-Object -Expand Content

Si la solicitud se completa de forma correcta, el servidor muestra un código de estado HTTP 200 OK y la respuesta en formato JSON.

Respuesta:

Go

Antes de probar este código de muestra, sigue las instrucciones de configuración para Go que se encuentran en la Guía de inicio rápido de Vision sobre cómo usar las bibliotecas cliente. Si quieres obtener más información, consulta la documentación de referencia de la API de Vision para Go.

Para autenticarte en Vision, configura las credenciales predeterminadas de la aplicación. Si deseas obtener más información, consulta Configura la autenticación para un entorno de desarrollo local.

Java

Antes de probar este código de muestra, sigue las instrucciones de configuración para Java que se encuentran la Guía de inicio rápido de la API de Vision sobre cómo usar las bibliotecas cliente. Si quieres obtener más información, consulta la documentación de referencia de la API de Vision para Java.

Node.js

Antes de probar este código de muestra, sigue las instrucciones de configuración para Node.js que se encuentran en la Guía de inicio rápido de Vision sobre cómo usar las bibliotecas cliente. Si quieres obtener más información, consulta la documentación de referencia de la API de Vision para Node.js.

Para autenticarte en Vision, configura las credenciales predeterminadas de la aplicación. Si deseas obtener más información, consulta Configura la autenticación para un entorno de desarrollo local.

Python

Antes de probar este código de muestra, sigue las instrucciones de configuración para Python que se encuentran en la Guía de inicio rápido de Vision sobre cómo usar las bibliotecas cliente. Si quieres obtener más información, consulta la documentación de referencia de la API de Vision para Python.

Para autenticarte en Vision, configura las credenciales predeterminadas de la aplicación. Si deseas obtener más información, consulta Configura la autenticación para un entorno de desarrollo local.

Idiomas adicionales

C#: sigue lasinstrucciones de configuración de C# en la página Bibliotecas cliente y, luego, visita la documentación de referencia de Vision para .NET.

PHP: sigue las instrucciones de configuración de PHP en la página Bibliotecas cliente y, luego, visita la documentación de referencia de Vision para PHP.

Ruby: sigue las instrucciones de configuración de Ruby en la página Bibliotecas cliente y, luego, visita la documentación de referencia de Vision para Ruby.

Detecta propiedades de imagen en una imagen remota

Puedes usar la API de Vision para realizar funciones de detección de características en un archivo de imagen remoto ubicado en Cloud Storage o en la Web. Para enviar una solicitud de archivo remoto, especifica la URL web del archivo o el URI de Cloud Storage en el cuerpo de la solicitud.

El campo ColorInfo no contiene información sobre el espacio de color absoluto que se debe usar para interpretar el valor RGB (p.ej., sRGB, Adobe RGB, DCI-P3, BT.2020, etcétera). De forma predeterminada, las aplicaciones deben tener el espacio de color sRGB.

REST

Antes de usar cualquiera de los datos de solicitud a continuación, realiza los siguientes reemplazos:

- CLOUD_STORAGE_IMAGE_URI: La ruta a un archivo de imagen válido en un depósito de Cloud Storage. Como mínimo, debes tener privilegios de lectura en el archivo.

Ejemplo:

gs://cloud-samples-data/vision/image_properties/bali.jpeg

- RESULTS_INT: Un valor de número entero de resultados que se mostrarán (opcional). Si omites el campo

"maxResults"y su valor, la API muestra el valor predeterminado de 10 resultados. Este campo no se aplica a los siguientes tipos de funciones:TEXT_DETECTION,DOCUMENT_TEXT_DETECTIONoCROP_HINTS. - PROJECT_ID es el ID del proyecto de Google Cloud.

Método HTTP y URL:

POST https://vision.googleapis.com/v1/images:annotate

Cuerpo JSON de la solicitud:

{

"requests": [

{

"image": {

"source": {

"gcsImageUri": "CLOUD_STORAGE_IMAGE_URI"

}

},

"features": [

{

"maxResults": RESULTS_INT,

"type": "IMAGE_PROPERTIES"

},

]

}

]

}

Para enviar tu solicitud, elige una de estas opciones:

curl

Guarda el cuerpo de la solicitud en un archivo llamado request.json y ejecuta el siguiente comando:

curl -X POST \

-H "Authorization: Bearer $(gcloud auth print-access-token)" \

-H "x-goog-user-project: PROJECT_ID" \

-H "Content-Type: application/json; charset=utf-8" \

-d @request.json \

"https://vision.googleapis.com/v1/images:annotate"

PowerShell

Guarda el cuerpo de la solicitud en un archivo llamado request.json y ejecuta el siguiente comando:

$cred = gcloud auth print-access-token

$headers = @{ "Authorization" = "Bearer $cred"; "x-goog-user-project" = "PROJECT_ID" }

Invoke-WebRequest `

-Method POST `

-Headers $headers `

-ContentType: "application/json; charset=utf-8" `

-InFile request.json `

-Uri "https://vision.googleapis.com/v1/images:annotate" | Select-Object -Expand Content

Si la solicitud se completa de forma correcta, el servidor muestra un código de estado HTTP 200 OK y la respuesta en formato JSON.

Respuesta:

Go

Antes de probar este código de muestra, sigue las instrucciones de configuración para Go que se encuentran en la Guía de inicio rápido de Vision sobre cómo usar las bibliotecas cliente. Si quieres obtener más información, consulta la documentación de referencia de la API de Vision para Go.

Para autenticarte en Vision, configura las credenciales predeterminadas de la aplicación. Si deseas obtener más información, consulta Configura la autenticación para un entorno de desarrollo local.

Java

Antes de probar este código de muestra, sigue las instrucciones de configuración para Java que se encuentran en la Guía de inicio rápido de Vision sobre cómo usar las bibliotecas cliente. Si quieres obtener más información, consulta la documentación de referencia de la API de Vision para Java.

Para autenticarte en Vision, configura las credenciales predeterminadas de la aplicación. Si deseas obtener más información, consulta Configura la autenticación para un entorno de desarrollo local.

Node.js

Antes de probar este código de muestra, sigue las instrucciones de configuración para Node.js que se encuentran en la Guía de inicio rápido de Vision sobre cómo usar las bibliotecas cliente. Si quieres obtener más información, consulta la documentación de referencia de la API de Vision para Node.js.

Para autenticarte en Vision, configura las credenciales predeterminadas de la aplicación. Si deseas obtener más información, consulta Configura la autenticación para un entorno de desarrollo local.

Python

Antes de probar este código de muestra, sigue las instrucciones de configuración para Python que se encuentran en la Guía de inicio rápido de Vision sobre cómo usar las bibliotecas cliente. Si quieres obtener más información, consulta la documentación de referencia de la API de Vision para Python.

Para autenticarte en Vision, configura las credenciales predeterminadas de la aplicación. Si deseas obtener más información, consulta Configura la autenticación para un entorno de desarrollo local.

gcloud

Si quieres realizar una detección de propiedades de imágenes, usa el comando gcloud ml vision detect-image-properties como se muestra en el siguiente ejemplo:

gcloud ml vision detect-image-properties gs://cloud-samples-data/vision/image_properties/bali.jpeg

Lenguajes adicionales

C#: sigue lasinstrucciones de configuración de C# en la página Bibliotecas cliente y, luego, visita la documentación de referencia de Vision para .NET.

PHP: sigue las instrucciones de configuración de PHP en la página Bibliotecas cliente y, luego, visita la documentación de referencia de Vision para PHP.

Ruby: sigue las instrucciones de configuración de Ruby en la página Bibliotecas cliente y, luego, visita la documentación de referencia de Vision para Ruby.

Prueba la personalización

Prueba la detección de propiedades de imágenes que se muestra a continuación. Puedes usar la imagen ya especificada (gs://cloud-samples-data/vision/image_properties/bali.jpeg) o especificar tu propia imagen en su lugar. Si deseas enviar la solicitud, selecciona Ejecutar.

Cuerpo de la solicitud:

{

"requests": [

{

"features": [

{

"maxResults": 10,

"type": "IMAGE_PROPERTIES"

}

],

"image": {

"source": {

"imageUri": "gs://cloud-samples-data/vision/image_properties/bali.jpeg"

}

}

}

]

}