Questa guida per principianti introduce le tecnologie di base dell'AI generativa e spiega come si combinano per alimentare chatbot e applicazioni. L'AI generativa (nota anche come genAI o gen AI) è un campo del machine learning (ML) che sviluppa e utilizza modelli di ML per generare nuovi contenuti.

I modelli di AI generativa vengono spesso chiamati modelli linguistici di grandi dimensioni (LLM) a causa delle loro grandi dimensioni e della capacità di comprendere e generare il linguaggio naturale. Tuttavia, a seconda dei dati su cui vengono addestrati, questi modelli possono comprendere e generare contenuti da più modalità, tra cui testo, immagini, video e audio. I modelli che funzionano con più modalità di dati sono chiamati modelli multimodali.

Google fornisce la famiglia di modelli di AI generativa Gemini progettati per casi d'uso multimodali, in grado di elaborare informazioni da più modalità, tra cui immagini, video e testo.

Generazione di contenuti

Affinché i modelli di AI generativa possano generare contenuti utili in applicazioni reali, devono disporre delle seguenti funzionalità:

Scopri come eseguire nuove attività:

I modelli di AI generativa sono progettati per svolgere attività generiche. Se vuoi che un modello esegua attività specifiche per il tuo caso d'uso, devi essere in grado di personalizzarlo. Su Vertex AI, puoi personalizzare il modello tramite l'ottimizzazione.

Accedere a informazioni esterne:

I modelli di AI generativa vengono addestrati su grandi quantità di dati. Tuttavia, affinché questi modelli siano utili, devono essere in grado di accedere a informazioni al di fuori dei dati di addestramento. Ad esempio, se vuoi creare un chatbot di assistenza clienti basato su un modello di AI generativa, il modello deve avere accesso alle informazioni sui prodotti e servizi che offri. In Vertex AI, utilizzi le funzionalità di grounding e chiamata di funzione per aiutare il modello ad accedere a informazioni esterne.

Bloccare contenuti dannosi:

I modelli di AI generativa potrebbero generare output inaspettati, tra cui testi offensivi o insensibili. Per mantenere la sicurezza e prevenire l'uso improprio, i modelli hanno bisogno di filtri di sicurezza per bloccare prompt e risposte che sono considerati potenzialmente dannosi. Vertex AI dispone di funzionalità di sicurezza integrate che promuovono l'uso responsabile dei nostri servizi di AI generativa.

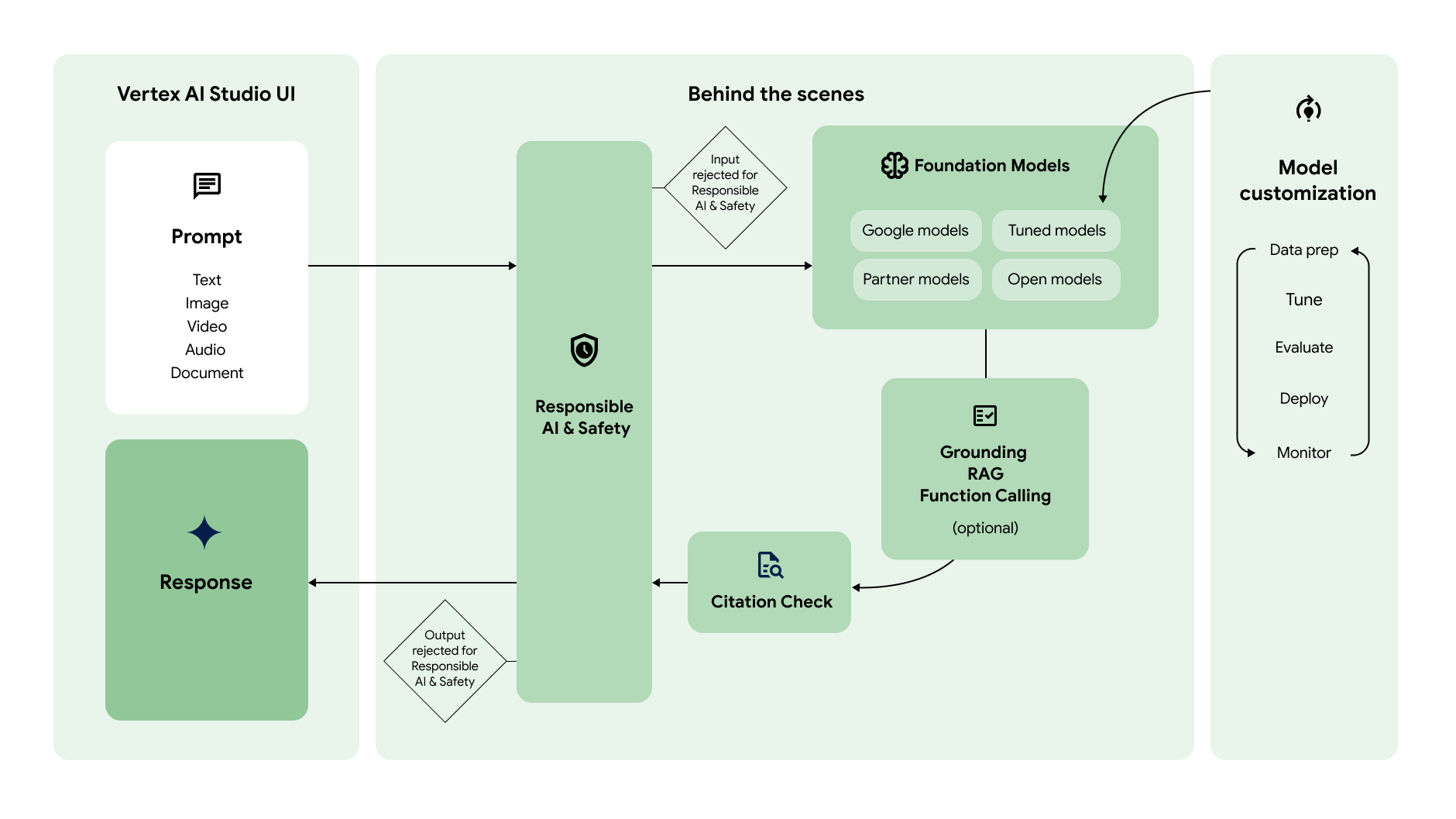

Il seguente diagramma mostra come queste diverse funzionalità interagiscono per generare i contenuti che ti interessano:

Prompt

|

|

Il flusso di lavoro dell'AI generativa inizia in genere con un prompt. Un prompt è una richiesta in linguaggio naturale inviata a un modello di AI generativa per ottenere una risposta. A seconda del modello, un prompt può contenere testo, immagini, video, audio, documenti e altre modalità o anche più modalità (multimodale). La creazione di un prompt per ottenere la risposta desiderata dal modello è una pratica chiamata progettazione dei prompt. Sebbene la progettazione dei prompt sia un processo di tentativi ed errori, esistono principi e strategie di progettazione dei prompt che puoi utilizzare per spingere il modello a comportarsi nel modo desiderato. Vertex AI Studio offre uno strumento di gestione dei prompt per aiutarti a gestirli. |

Modelli di base

|

|

I prompt vengono inviati a un modello di AI generativa per la generazione di risposte. Vertex AI offre una serie di foundation model di AI generativa accessibili tramite un'API gestita, tra cui:

I modelli differiscono per dimensioni, modalità e costo. Puoi esplorare i modelli di Google, nonché i modelli aperti e quelli dei partner di Google, in Model Garden. |

Personalizzazione dei modelli

|

|

Puoi personalizzare il comportamento predefinito dei modelli di base di Google in modo che generino in modo coerente i risultati desiderati senza utilizzare prompt complessi. Questo processo di personalizzazione è chiamato ottimizzazione del modello. La messa a punto del modello ti aiuta a ridurre il costo e la latenza delle tue richieste consentendoti di semplificare i prompt. Vertex AI offre anche strumenti di valutazione dei modelli per aiutarti a valutare le prestazioni del modello ottimizzato. Una volta che il modello ottimizzato è pronto per la produzione, puoi eseguirne il deployment in un endpoint e monitorare le prestazioni come nei flussi di lavoro MLOps standard. |

Accedere a informazioni esterne

|

|

Vertex AI offre diversi modi per consentire al modello di accedere ad API esterne e informazioni in tempo reale.

|

Verifica delle citazioni

|

|

Una volta generata la risposta, Vertex AI verifica se è necessario includere le citazioni. Se una parte significativa del testo nella risposta proviene da una determinata fonte, questa viene aggiunta ai metadati della citazione nella risposta. |

AI responsabile e sicurezza

|

|

L'ultimo livello di controlli a cui vengono sottoposti il prompt e la risposta prima di essere restituiti sono i filtri di sicurezza. Vertex AI controlla sia il prompt che la risposta per determinare in che misura il prompt o la risposta appartiene a una categoria di sicurezza. Se la soglia viene superata per una o più categorie, la risposta viene bloccata e Vertex AI restituisce una risposta di riserva. |

Risposta

|

|

Se il prompt e la risposta superano i controlli del filtro di sicurezza, la risposta viene restituita. In genere, la risposta viene restituita tutta in una volta. Tuttavia, con Vertex AI puoi anche ricevere risposte in modo progressivo man mano che vengono generate attivando lo streaming. |

Inizia

Prova una di queste guide rapide per iniziare a utilizzare l'AI generativa su Vertex AI:

- Genera testo utilizzando l'API Gemini di Vertex AI: utilizza l'SDK per inviare richieste all'API Gemini di Vertex AI

- Invia prompt a Gemini utilizzando la galleria di prompt di Vertex AI Studio: prova i prompt senza alcuna configurazione richiesta

- Genera un'immagine e verifica la filigrana utilizzando Imagen: Crea un'immagine con filigrana utilizzando Imagen su Vertex AI