Este artículo forma parte de una serie en la que se explica la recuperación tras fallos en Google Cloud. En esta parte se describe el proceso para diseñar cargas de trabajo con Google Cloud y componentes que sean resistentes a las interrupciones de la infraestructura de la nube.

La serie consta de las siguientes partes:

- Guía de planificación para la recuperación tras fallos

- Componentes básicos de recuperación tras fallos

- Situaciones de recuperación tras fallos con los datos

- Situaciones de recuperación tras fallos de aplicaciones

- Diseñar la recuperación tras fallos para cargas de trabajo con restricciones de localidad

- Casos prácticos de recuperación ante desastres: aplicaciones de analíticas de datos restringidas por localidad

- Diseñar la recuperación tras fallos para interrupciones de la infraestructura en la nube (este documento)

Introducción

A medida que las empresas migran cargas de trabajo a la nube pública, deben adaptar sus conocimientos sobre la creación de sistemas on-premise resilientes a la infraestructura hiperescalable de proveedores de la nube como Google Cloud. En este artículo se relacionan conceptos estándar del sector sobre la recuperación tras desastres, como el objetivo de tiempo de recuperación (RTO) y el objetivo de punto de recuperación (RPO), con la infraestructura de Google Cloud.

Las directrices de este documento siguen uno de los principios clave de Google para lograr una disponibilidad del servicio extremadamente alta: planificar los fallos. Aunque Google Cloud proporciona un servicio extremadamente fiable, se producirán desastres (desastres naturales, cortes de fibra y fallos complejos e impredecibles de la infraestructura) que provocarán interrupciones. La planificación de las interrupciones permite a los clientes crear aplicaciones que funcionen de forma predecible durante estos eventos inevitables mediante el uso de productos con mecanismos de recuperación tras fallos "integrados".Google Cloud Google Cloud

La recuperación tras fallos es un tema amplio que abarca mucho más que los fallos de infraestructura, como los errores de software o la corrupción de datos, por lo que debes tener un plan integral de principio a fin. Sin embargo, este artículo se centra en una parte de un plan de recuperación tras fallos general: cómo diseñar aplicaciones que sean resistentes a las interrupciones de la infraestructura de la nube. En concreto, en este artículo se explica lo siguiente:

- La Google Cloud infraestructura, cómo se manifiestan los desastres comoGoogle Cloud interrupciones y cómo se Google Cloud ha diseñado para minimizar la frecuencia y el alcance de las interrupciones.

- Una guía de planificación de la arquitectura que proporciona un marco para categorizar y diseñar aplicaciones en función de los resultados de fiabilidad deseados.

- Una lista detallada de productos Google Cloud seleccionados que ofrecen funciones de recuperación ante desastres integradas que puede usar en su aplicación.

Para obtener más información sobre la planificación general de la recuperación tras fallos y el uso de Google Cloud como componente de tu estrategia de recuperación tras fallos local, consulta la guía de planificación de la recuperación tras fallos. Además, aunque la alta disponibilidad es un concepto estrechamente relacionado con la recuperación tras desastres, no se trata en este artículo. Para obtener más información sobre cómo diseñar una arquitectura de alta disponibilidad, consulta el framework Well-Architected.

Nota sobre la terminología: en este artículo se habla de disponibilidad cuando se hace referencia a la capacidad de acceder a un producto y usarlo de forma significativa a lo largo del tiempo, mientras que fiabilidad hace referencia a un conjunto de atributos que incluyen la disponibilidad, pero también aspectos como la durabilidad y la corrección.

Cómo Google Cloud se ha diseñado para ofrecer resiliencia

Centros de datos de Google

Los centros de datos tradicionales se basan en maximizar la disponibilidad de los componentes individuales. En la nube, la escala permite a operadores como Google distribuir servicios en muchos componentes mediante tecnologías de virtualización y, por lo tanto, superar la fiabilidad de los componentes tradicionales. Esto significa que puedes cambiar tu mentalidad sobre la arquitectura de fiabilidad y dejar de preocuparte por los innumerables detalles que antes te preocupaban en las instalaciones locales. En lugar de preocuparte por los distintos modos de fallo de los componentes (como la refrigeración y el suministro de energía), puedes planificar los Google Cloud productos y sus métricas de fiabilidad. Estas métricas reflejan el riesgo de interrupción agregado de toda la infraestructura subyacente. De esta forma, puedes centrarte mucho más en el diseño, el despliegue y las operaciones de las aplicaciones en lugar de en la gestión de la infraestructura.

Google diseña su infraestructura para cumplir objetivos de disponibilidad ambiciosos basados en nuestra amplia experiencia en la creación y gestión de centros de datos modernos. Google es una empresa líder a nivel mundial en el diseño de centros de datos. Desde la energía hasta la refrigeración y las redes, cada tecnología de los centros de datos tiene sus propias redundancias y medidas de mitigación, incluidos los planes de FMEA. Los centros de datos de Google se construyen de forma que se equilibren los diferentes riesgos y se ofrezca a los clientes un nivel de disponibilidad esperado constante para los productos de Google Cloud . Google utiliza su experiencia para modelizar la disponibilidad de la arquitectura general del sistema físico y lógico con el fin de asegurarse de que el diseño del centro de datos cumpla las expectativas. Los ingenieros de Google hacen todo lo posible para que se cumplan esas expectativas. La disponibilidad medida real suele superar nuestros objetivos de diseño con un margen considerable.

Al destilar todos estos riesgos y mitigaciones de los centros de datos en productos orientados a los usuarios, Google Cloud te libera de esas responsabilidades de diseño y operativas. En su lugar, puedes centrarte en la fiabilidad de lasGoogle Cloud regiones y zonas.

Regiones y zonas

Las regiones son áreas geográficas independientes que están formadas por zonas. Las zonas y las regiones son abstracciones lógicas de los recursos físicos subyacentes. Para obtener más información sobre las consideraciones específicas de cada región, consulta el artículo Geografía y regiones.

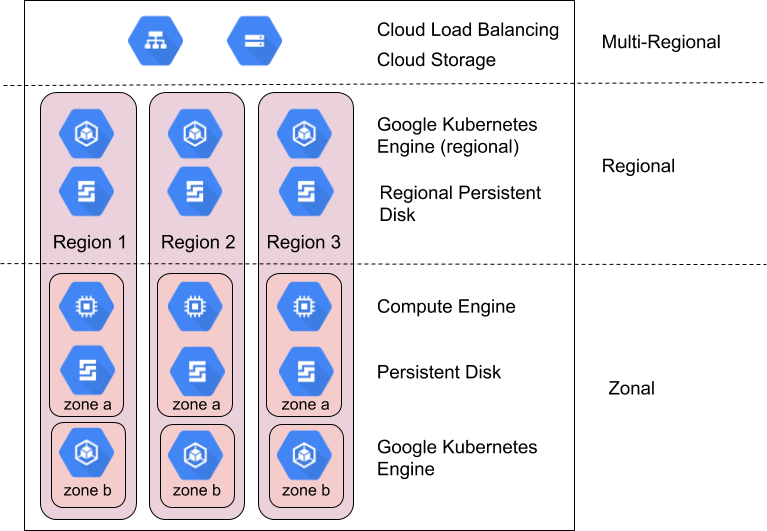

Los productos deGoogle Cloud se dividen en recursos de zona, recursos regionales o recursos multirregionales.

Los recursos de zona se alojan en una sola zona. Una interrupción del servicio en esa zona puede afectar a todos los recursos de la zona. Por ejemplo, una instancia de Compute Engine se ejecuta en una zona específica. Si se produce un fallo de hardware que interrumpe el servicio en esa zona, la instancia de Compute Engine no estará disponible mientras dure la interrupción.

Los recursos regionales se despliegan de forma redundante en varias zonas de una región. De esta manera, tienen una mayor fiabilidad que los recursos de zona.

Los recursos multirregionales se distribuyen dentro de las regiones y en distintas regiones. En general, los recursos multirregionales tienen una fiabilidad mayor que los recursos regionales. Sin embargo, en este nivel, los productos deben optimizar la disponibilidad, el rendimiento y la eficiencia de los recursos. Por lo tanto, es importante que conozcas las ventajas y desventajas de cada producto multirregional que decidas usar. Las medidas que se toman para conseguir ese equilibrio se documentan por separado para cada producto más adelante en este documento.

Cómo aprovechar las zonas y las regiones para lograr la fiabilidad

Los ingenieros de fiabilidad de sitios de Google gestionan y escalan productos para usuarios globales de alta fiabilidad, como Gmail y la Búsqueda, mediante diversas técnicas y tecnologías que aprovechan sin problemas la infraestructura informática de todo el mundo. Esto incluye desviar el tráfico de las ubicaciones no disponibles mediante el balanceo de carga global, ejecutar varias réplicas en muchas ubicaciones de todo el mundo y replicar datos en varias ubicaciones. Estas mismas funciones están disponibles para los clientes a través de productos como Cloud Load Balancing, Google Kubernetes Engine (GKE) y Spanner. Google Cloud

Google Cloud suele diseñar sus productos para que ofrezcan los siguientes niveles de disponibilidad en las zonas y regiones:

| Recurso | Ejemplos | Objetivo de diseño de disponibilidad | Tiempo de inactividad implícito |

|---|---|---|---|

| Por zonas | Compute Engine, Persistent Disk | 99,9 % | 8,75 horas al año |

| Regional | Cloud Storage regional, Persistent Disk replicado y GKE regional | 99,99 % | 52 minutos al año |

Compara los Google Cloud objetivos de diseño de disponibilidad Google Cloud con el tiempo de inactividad aceptable para identificar los recursos adecuados. Mientras que los diseños tradicionales se centran en mejorar la disponibilidad a nivel de componente para mejorar la disponibilidad de la aplicación resultante, los modelos de nube se centran en la composición de los componentes para lograr este objetivo. Muchos productos deGoogle Cloud usan esta técnica. Por ejemplo, Spanner ofrece una base de datos multirregional que se compone de varias regiones para ofrecer una disponibilidad del 99,999 %.

La composición es importante porque, sin ella, la disponibilidad de tu aplicación no puede superar la de los Google Cloud productos que usas. De hecho, a menos que tu aplicación nunca falle, tendrá una disponibilidad inferior a la de los productosGoogle Cloud subyacentes. En el resto de esta sección se muestra cómo puede usar una composición de productos zonales y regionales para conseguir una disponibilidad de la aplicación mayor que la que proporcionaría una sola zona o región. En la siguiente sección se ofrece una guía práctica para aplicar estos principios a tus aplicaciones.

Planificar los ámbitos de las interrupciones de zonas

Los fallos de infraestructura suelen provocar interrupciones del servicio en una sola zona. Dentro de una región, las zonas se diseñan para minimizar el riesgo de fallos correlacionados con otras zonas, y una interrupción del servicio en una zona no suele afectar al servicio de otra zona de la misma región. Si una interrupción se limita a una zona, no significa necesariamente que toda la zona no esté disponible, sino que solo define el límite del incidente. Es posible que una interrupción de una zona no tenga ningún efecto tangible en tus recursos de esa zona.

Aunque es menos habitual, también es importante tener en cuenta que, en algún momento, varias zonas seguirán experimentando una interrupción correlacionada en una misma región. Cuando se produce una interrupción en dos o más zonas, se aplica la estrategia de ámbito de interrupción regional que se indica a continuación.

Los recursos regionales se han diseñado para resistir a las interrupciones de las zonas, ya que ofrecen servicio desde una composición de varias zonas. Si se interrumpe una de las zonas que respaldan un recurso regional, el recurso se pone automáticamente a disposición desde otra zona. Consulta detenidamente la descripción de las funciones del producto en el apéndice para obtener más información.

Google Cloud solo ofrece algunos recursos de zona, como las máquinas virtuales (VMs) de Compute Engine y Persistent Disk. Si tienes previsto usar recursos zonales, tendrás que llevar a cabo tu propia composición de recursos diseñando, creando y probando la conmutación por error y la recuperación entre recursos zonales ubicados en varias zonas. Algunas estrategias son las siguientes:

- Dirigir rápidamente el tráfico a máquinas virtuales de otra zona mediante Cloud Load Balancing cuando una comprobación de estado determina que una zona tiene problemas.

- Usa plantillas de instancias de Compute Engine o grupos de instancias gestionados para ejecutar y escalar instancias de VM idénticas en varias zonas.

- Usa un disco persistente regional para replicar datos de forma síncrona en otra zona de una región. Consulta más información sobre las opciones de alta disponibilidad con discos persistentes regionales.

Planificar los ámbitos de las interrupciones regionales

Una interrupción regional es una interrupción del servicio que afecta a más de una zona de una región. Se trata de interrupciones a mayor escala y menos frecuentes, que pueden deberse a desastres naturales o a fallos de infraestructuras a gran escala.

En el caso de un producto regional diseñado para ofrecer una disponibilidad del 99,99 %, una interrupción puede traducirse en casi una hora de inactividad al año para un producto concreto. Por lo tanto, es posible que tus aplicaciones críticas necesiten un plan de recuperación tras desastres multirregional si no puedes permitirte que se produzca una interrupción de este tipo.

Los recursos multirregionales se han diseñado para resistir a las interrupciones de servicio de las regiones, ya que ofrecen servicio desde varias regiones. Como se ha descrito anteriormente, los productos multirregionales ofrecen un equilibrio entre latencia, coherencia y coste. La compensación más habitual se da entre la replicación de datos síncrona y asíncrona. La replicación asíncrona ofrece una latencia más baja, pero conlleva el riesgo de perder datos durante una interrupción. Por lo tanto, es importante consultar la descripción de las funciones del producto en el apéndice para obtener más información.

Si quieres usar recursos regionales y mantener la resiliencia ante interrupciones regionales, debes realizar tu propia composición de recursos diseñando, creando y probando su conmutación por error y recuperación entre recursos regionales ubicados en varias regiones. Además de las estrategias zonales que se han descrito anteriormente y que también puedes aplicar en varias regiones, ten en cuenta lo siguiente:

- Los recursos regionales deben replicar los datos en una región secundaria, en una opción de almacenamiento multirregional, como Cloud Storage, o en una opción de nube híbrida, como GKE y Google Distributed Cloud.

- Una vez que hayas implementado una mitigación de interrupciones regionales, pruébala periódicamente. Hay pocas cosas peores que pensar que eres resistente a una interrupción de una sola región y descubrir que no es así cuando ocurre de verdad.

Google Cloud enfoque de resiliencia y disponibilidad

Google Cloud supera con frecuencia los objetivos de diseño de disponibilidad, pero no debes dar por hecho que este buen rendimiento anterior es la disponibilidad mínima que puedes diseñar. En su lugar, debes seleccionar Google Cloud dependencias cuyos objetivos de diseño superen la fiabilidad prevista de tu aplicación, de modo que el tiempo de inactividad de tu aplicación más el tiempo de inactividad de la dependencia Google Cloud proporcione el resultado que buscas.

Un sistema bien diseñado puede responder a la pregunta: "¿Qué ocurre cuando una zona o región sufre una interrupción de 1, 5, 10 o 30 minutos?". Esto debe tenerse en cuenta en muchos niveles, como los siguientes:

- ¿Qué experimentarán mis clientes durante una interrupción?

- ¿Cómo puedo saber si se ha producido una interrupción del servicio?

- ¿Qué ocurre con mi aplicación durante una interrupción?

- ¿Qué ocurre con mis datos durante una interrupción?

- ¿Qué ocurre con mis otras aplicaciones debido a una interrupción (por dependencias cruzadas)?

- ¿Qué debo hacer para recuperarme después de que se haya resuelto una interrupción? ¿Quién lo hace?

- ¿A quién debo avisar de una interrupción y en qué plazo?

Guía paso a paso para diseñar la recuperación tras desastres de aplicaciones en Google Cloud

En las secciones anteriores se ha explicado cómo crea Google la infraestructura de nube y algunas estrategias para hacer frente a las interrupciones zonales y regionales.

En esta sección se explica cómo desarrollar un marco para aplicar el principio de composición a tus aplicaciones en función de los resultados de fiabilidad que quieras obtener.

Las aplicaciones del cliente en Google Cloud que tengan como objetivo la recuperación tras desastres, como los objetivos de tiempo de recuperación (RTO) y de punto de recuperación (RPO), deben diseñarse de forma que las operaciones críticas para la empresa, sujetas a los RTO y RPO, solo dependan de los componentes del plano de datos que se encarguen del procesamiento continuo de las operaciones del servicio. En otras palabras, estas operaciones críticas para el negocio del cliente no deben depender de las operaciones del plano de gestión, que gestionan el estado de la configuración y envían la configuración al plano de control y al plano de datos.

Por ejemplo, Google Cloud los clientes que quieran conseguir un tiempo de recuperación ante desastres para operaciones críticas no deben depender de una API de creación de VMs ni de la actualización de un permiso de gestión de identidades y accesos.

Paso 1: Recopila los requisitos actuales

El primer paso es definir los requisitos de disponibilidad de tus aplicaciones. La mayoría de las empresas ya tienen un nivel de directrices de diseño en este ámbito, que pueden haber desarrollado internamente o derivarse de normativas u otros requisitos legales. Estas directrices de diseño se codifican normalmente en dos métricas clave: el objetivo de tiempo de recuperación (RTO) y el objetivo de punto de recuperación (RPO). En términos empresariales, el RTO se traduce como "¿Cuánto tiempo después de un desastre puedo volver a estar operativo?". El RPO se traduce como "¿Cuántos datos puedo permitirme perder en caso de desastre?".

Tradicionalmente, las empresas han definido los requisitos de RTO y RPO para una amplia gama de desastres, desde fallos de componentes hasta terremotos. Esto tenía sentido en el mundo on-premise, donde los planificadores tenían que asignar los requisitos de RTO y RPO a toda la pila de software y hardware. En la nube, ya no es necesario que definas tus requisitos con tanto detalle, ya que el proveedor se encarga de ello. En su lugar, puedes definir tus requisitos de RTO y RPO en términos del ámbito de pérdida (zonas o regiones completas) sin especificar los motivos subyacentes. Google Cloud De esta forma, solo tendrás que tener en cuenta tres escenarios: un fallo en una zona, un fallo en una región o un fallo en varias regiones (algo muy poco probable).

Como no todas las aplicaciones tienen la misma importancia, la mayoría de los clientes clasifican sus aplicaciones en niveles de importancia para los que se puede aplicar un requisito de RTO o RPO específico. Si se tienen en cuenta conjuntamente, el RTO y el RPO, así como la criticidad de la aplicación, se optimiza el proceso de diseño de una aplicación determinada, ya que se responde a las siguientes preguntas:

- ¿La aplicación debe ejecutarse en varias zonas de la misma región o en varias zonas de varias regiones?

- ¿De qué Google Cloud productos puede depender la aplicación?

Este es un ejemplo del resultado del ejercicio de recogida de requisitos:

RTO y RPO por criticidad de la aplicación de la empresa de ejemplo:

| Criticidad de la aplicación | % de las aplicaciones | Aplicaciones de ejemplo | Interrupción de zona | Interrupción del servicio regional |

|---|---|---|---|---|

| Nivel 1

(más importante) |

5 % | Normalmente, se trata de aplicaciones globales o externas orientadas a los clientes, como las de pagos en tiempo real y las escaparates de comercio electrónico. | RTO Cero

RPO Zero |

RTO Cero

RPO Zero |

| Nivel 2 | 35 % | Normalmente, se trata de aplicaciones regionales o internas importantes, como CRM o ERP. | RTO 15 min

RPO 15 min |

RTO 1 h

RPO 1 h |

| Nivel 3

(menos importante) |

60 % | Normalmente, se trata de aplicaciones de equipos o departamentos, como las de gestión interna, reserva de vacaciones, viajes internos, contabilidad y recursos humanos. | RTO 1 h

RPO 1 h |

RTO 12 horas

RPO 12hrs |

Paso 2: Asignación de funciones a los productos disponibles

El segundo paso es conocer las funciones de resiliencia de los productos de Google Cloud que usarán tus aplicaciones. La mayoría de las empresas revisan la información del producto pertinente y, a continuación, añaden directrices sobre cómo modificar sus arquitecturas para cubrir las posibles carencias entre las funciones del producto y sus requisitos de resiliencia. En esta sección se tratan algunas áreas habituales y recomendaciones sobre las limitaciones de datos y aplicaciones en este espacio.

Como se ha mencionado anteriormente, los productos de Google con recuperación ante desastres se adaptan a dos tipos de interrupciones: regionales y de zona. Las interrupciones parciales se deben planificar de la misma forma que las interrupciones completas en lo que respecta a la recuperación ante desastres. Esto proporciona una matriz inicial de alto nivel de los productos que son adecuados para cada situación de forma predeterminada:

Google Cloud Funciones generales de los productos

(consulta el apéndice para ver las funciones específicas de cada producto)

| Todos los productos de Google Cloud | Productos regionales Google Cloud con replicación automática en zonas | Productos multirregionales o globales Google Cloud con replicación automática entre regiones | |

|---|---|---|---|

| Fallo de un componente en una zona | Cubierto* | Con cobertura | Con cobertura |

| Interrupción de zona | No cubierto | Con cobertura | Con cobertura |

| Interrupción del servicio regional | No cubierto | No cubierto | Con cobertura |

* Todos Google Cloud los productos son resistentes a los fallos de los componentes, excepto en los casos específicos que se indican en la documentación del producto. Normalmente, se trata de situaciones en las que el producto ofrece acceso directo o asignación estática a un hardware especializado, como la memoria o las unidades de estado sólido (SSD).

Cómo limitan las RPOs las opciones de productos

En la mayoría de las implementaciones en la nube, la integridad de los datos es el aspecto más importante que se debe tener en cuenta en un servicio. Al menos algunas aplicaciones tienen un requisito de RPO de cero, lo que significa que no debería haber pérdida de datos en caso de interrupción. Para ello, normalmente es necesario que los datos se repliquen de forma síncrona en otra zona o región. La replicación síncrona tiene ventajas e inconvenientes en cuanto a costes y latencia, por lo que, aunque muchos Google Cloud productos ofrecen replicación síncrona entre zonas, solo unos pocos la ofrecen entre regiones. Esta compensación entre coste y complejidad significa que no es raro que los diferentes tipos de datos de una aplicación tengan valores de RPO distintos.

En el caso de los datos con un RPO superior a cero, las aplicaciones pueden aprovechar la replicación asíncrona. La replicación asíncrona es aceptable cuando los datos perdidos se pueden volver a crear fácilmente o se pueden recuperar de una fuente de datos fiable si es necesario. También puede ser una opción razonable cuando se acepta una pequeña pérdida de datos a cambio de la duración prevista de las interrupciones zonales y regionales. También es importante tener en cuenta que, durante una interrupción transitoria, los datos escritos en la ubicación afectada, pero que aún no se han replicado en otra ubicación, suelen estar disponibles una vez que se resuelve la interrupción. Esto significa que el riesgo de perder datos permanentemente es menor que el riesgo de perder el acceso a los datos durante una interrupción.

Acciones clave: determina si necesitas un RPO cero y, si es así, si puedes hacerlo con un subconjunto de tus datos. Esto aumenta considerablemente la gama de servicios habilitados para la recuperación ante desastres que tienes a tu disposición. En Google Cloud, conseguir un RPO cero significa usar principalmente productos regionales para tu aplicación, que de forma predeterminada son resistentes a las interrupciones a nivel de zona, pero no a nivel de región.

Cómo limitan las restricciones de RTO las opciones de productos

Una de las principales ventajas del cloud computing es la capacidad de implementar infraestructura bajo demanda. Sin embargo, no es lo mismo que la implementación instantánea. El valor de RTO de tu aplicación debe tener en cuenta el RTO combinado de los Google Cloud productos que utiliza tu aplicación y las acciones que deben llevar a cabo tus ingenieros o ingenieros de fiabilidad de sitios para reiniciar tus máquinas virtuales o componentes de la aplicación. Un tiempo de recuperación tras un desastre medido en minutos significa diseñar una aplicación que se recupere automáticamente de un desastre sin intervención humana o con pasos mínimos, como pulsar un botón para activar la conmutación por error. Históricamente, el coste y la complejidad de este tipo de sistemas han sido muy elevados, pero los Google Cloud productos, como los balanceadores de carga y los grupos de instancias, hacen que este diseño sea mucho más asequible y sencillo. Por lo tanto, deberías plantearte la conmutación por error y la recuperación automáticas para la mayoría de las aplicaciones. Ten en cuenta que diseñar un sistema para este tipo de conmutación por error activa entre regiones es complicado y caro. Solo una pequeña parte de los servicios críticos justifica esta función.

La mayoría de las aplicaciones tendrán un RTO de entre una hora y un día, lo que permite una conmutación por error en caliente en caso de desastre, con algunos componentes de la aplicación en modo de espera (como las bases de datos) y otros escalados en caso de desastre real (como los servidores web). En estas aplicaciones, te recomendamos que automatices los eventos de escalado horizontal. Los servicios con un RTO de más de un día tienen la criticidad más baja y, a menudo, se pueden recuperar a partir de una copia de seguridad o recrear desde cero.

Acciones clave: determina si necesitas un tiempo de recuperación ante desastres (RTO) de (casi) cero para la conmutación por error regional y, si es así, si puedes hacerlo en un subconjunto de tus servicios. Esto cambia el coste de ejecutar y mantener tu servicio.

Paso 3: Desarrolla tus propias arquitecturas de referencia y guías

El último paso recomendado es crear tus propios patrones de arquitectura específicos de la empresa para ayudar a tus equipos a estandarizar su enfoque de recuperación ante desastres. La mayoría de los clientes Google Cloud elaboran una guía para sus equipos de desarrollo que se ajusta a sus expectativas de resiliencia empresarial en las dos categorías principales de escenarios de interrupción de Google Cloud. De esta forma, los equipos pueden categorizar fácilmente qué productos con recuperación ante desastres son adecuados para cada nivel de criticidad.

Crear directrices de productos

Si volvemos a la tabla de RTO y RPO del ejemplo anterior, tienes una guía hipotética que indica qué productos se permitirían de forma predeterminada en cada nivel de criticidad. Ten en cuenta que, aunque se hayan identificado determinados productos como no aptos de forma predeterminada, siempre puedes añadir tus propios mecanismos de replicación y conmutación por error para habilitar la sincronización entre zonas o regiones. Sin embargo, este ejercicio va más allá del alcance de este artículo. Las tablas también incluyen enlaces a más información sobre cada producto para ayudarte a entender sus funciones en relación con la gestión de las interrupciones de zonas o regiones.

Patrones de arquitectura de ejemplo de la empresa Example Organization Co: interrupción de la zona Resiliencia

| Google Cloud Producto | ¿El producto cumple los requisitos de interrupción zonal de Example Organization (con la configuración de producto adecuada)? | ||

|---|---|---|---|

| Nivel 1 | Nivel 2 | Nivel 3 | |

| Compute Engine | No | No | No |

| Dataflow | No | No | No |

| BigQuery | No | No | Sí |

| GKE | Sí | Sí | Sí |

| Cloud Storage | Sí | Sí | Sí |

| Cloud SQL | No | Sí | Sí |

| Spanner | Sí | Sí | Sí |

| Cloud Load Balancing | Sí | Sí | Sí |

Esta tabla es solo un ejemplo basado en los niveles hipotéticos que se muestran arriba.

Patrones de arquitectura de ejemplo para la empresa de ejemplo Co: resiliencia ante interrupciones en una región

| Google Cloud Producto | ¿El producto cumple los requisitos de interrupción de la región de Ejemplo Organización (con la configuración de producto adecuada)? | ||

|---|---|---|---|

| Nivel 1 | Nivel 2 | Nivel 3 | |

| Compute Engine | Sí | Sí | Sí |

| Dataflow | No | No | No |

| BigQuery | No | No | Sí |

| GKE | Sí | Sí | Sí |

| Cloud Storage | No | No | No |

| Cloud SQL | No | Sí | Sí |

| Spanner | Sí | Sí | Sí |

| Cloud Load Balancing | Sí | Sí | Sí |

Esta tabla es solo un ejemplo basado en los niveles hipotéticos que se muestran arriba.

Para mostrar cómo se usarían estos productos, en las siguientes secciones se describen algunas arquitecturas de referencia para cada uno de los niveles de criticidad de las aplicaciones hipotéticas. Se trata de descripciones de alto nivel que ilustran las decisiones arquitectónicas clave y no representan un diseño de solución completo.

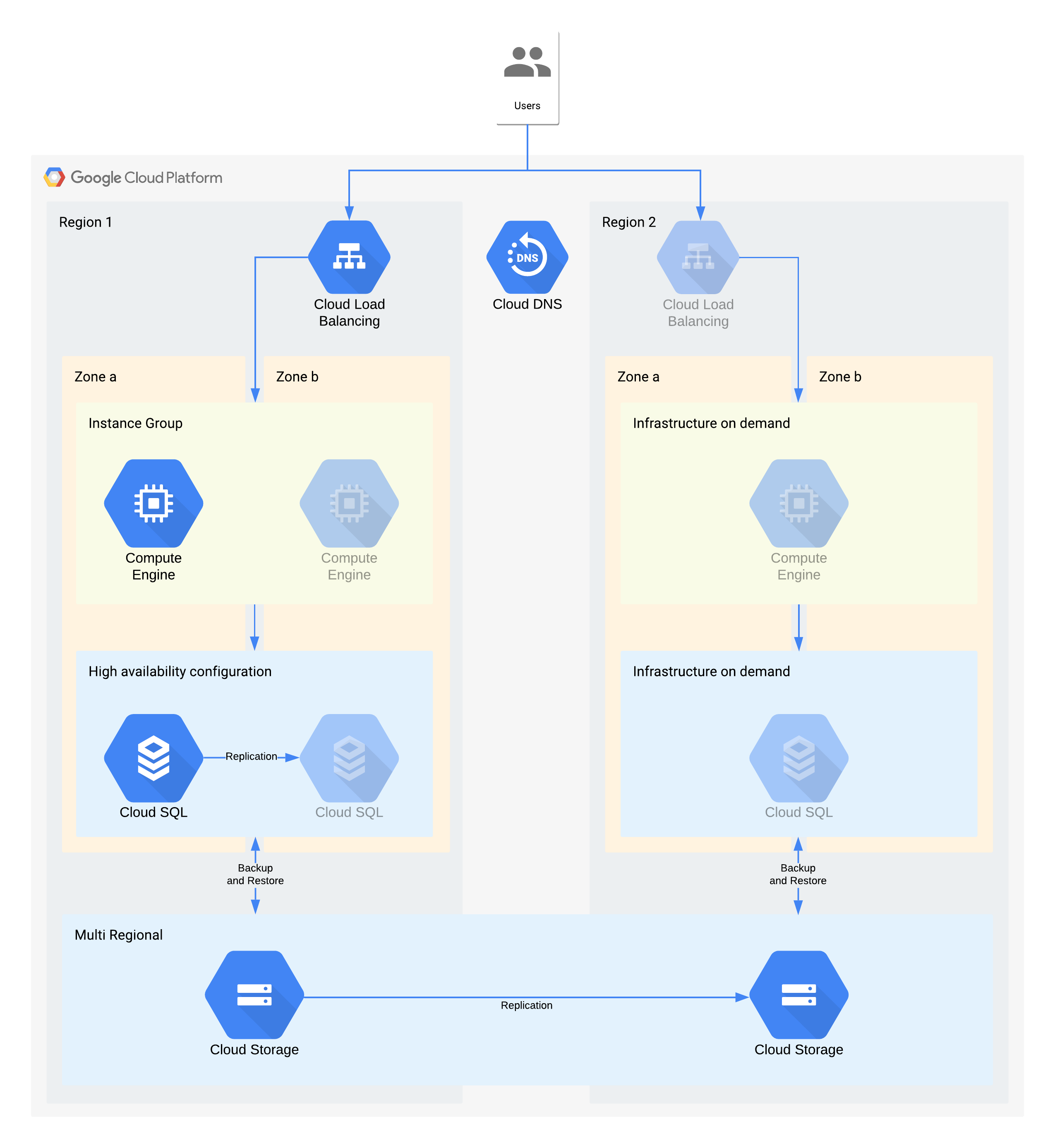

Ejemplo de arquitectura de nivel 3

| Criticidad de la aplicación | Interrupción de zona | Interrupción del servicio regional |

|---|---|---|

| Nivel 3 (menos importante) |

RTO de 12 horas RPO de 24 horas |

RTO de 28 días RPO de 24 horas |

Los iconos atenuados indican que la infraestructura se debe habilitar para la recuperación.

Esta arquitectura describe una aplicación cliente/servidor tradicional: los usuarios internos se conectan a una aplicación que se ejecuta en una instancia de proceso, que está respaldada por una base de datos para el almacenamiento persistente.

Es importante tener en cuenta que esta arquitectura admite valores de RTO y RPO mejores de los necesarios. Sin embargo, también debe plantearse eliminar los pasos manuales adicionales cuando puedan resultar costosos o poco fiables. Por ejemplo, recuperar una base de datos a partir de una copia de seguridad nocturna podría admitir un RPO de 24 horas, pero normalmente se necesitaría a un experto, como un administrador de bases de datos, que podría no estar disponible, sobre todo si se vieran afectados varios servicios al mismo tiempo. Con la infraestructura bajo demanda de Google Cloud, puedes crear esta función sin tener que hacer un gran sacrificio económico. Por eso, esta arquitectura usa la alta disponibilidad de Cloud SQL en lugar de una copia de seguridad o restauración manual en caso de interrupciones zonales.

Decisiones de arquitectura clave en caso de interrupción de la zona: RTO de 12 horas y RPO de 24 horas:

- Se usa un balanceador de carga interno para proporcionar un punto de acceso escalable a los usuarios, lo que permite la conmutación por error automática a otra zona. Aunque el RTO es de 12 horas, los cambios manuales en las direcciones IP o incluso las actualizaciones de DNS pueden tardar más de lo previsto.

- Un grupo de instancias gestionado regional se configura con varias zonas, pero con recursos mínimos. De esta forma, se optimiza el coste, pero se permite que las máquinas virtuales se escalen rápidamente en la zona de copia de seguridad.

- Una configuración de alta disponibilidad de Cloud SQL permite la conmutación por error automática a otra zona. Las bases de datos son mucho más difíciles de recrear y restaurar que las máquinas virtuales de Compute Engine.

Decisiones de arquitectura clave en caso de interrupción del servicio en una región: tiempo de inactividad máximo de 28 días y tiempo de recuperación de datos de 24 horas:

- Un balanceador de carga se crearía en la región 2 solo en caso de interrupción regional. Cloud DNS se usa para proporcionar una función de conmutación por error regional manual y coordinada, ya que la infraestructura de la región 2 solo estará disponible en caso de que se produzca una interrupción en la región.

- Un nuevo grupo de instancias gestionado se crearía solo en caso de que se produjera una interrupción en una región. De esta forma, se optimiza el coste y es poco probable que se invoque, dada la corta duración de la mayoría de las interrupciones regionales. Ten en cuenta que, por motivos de simplicidad, en el diagrama no se muestra la herramienta asociada necesaria para volver a desplegar ni la copia de las imágenes de Compute Engine.

- Se volvería a crear una instancia de Cloud SQL y se restaurarían los datos a partir de una copia de seguridad. De nuevo, el riesgo de que se produzca una interrupción prolongada en una región es extremadamente bajo, por lo que se trata de otra compensación para optimizar los costes.

- Para almacenar estas copias de seguridad, se usa Cloud Storage multirregional. De esta forma, se proporciona una resiliencia automática de la zona y la región dentro del RTO y el RPO.

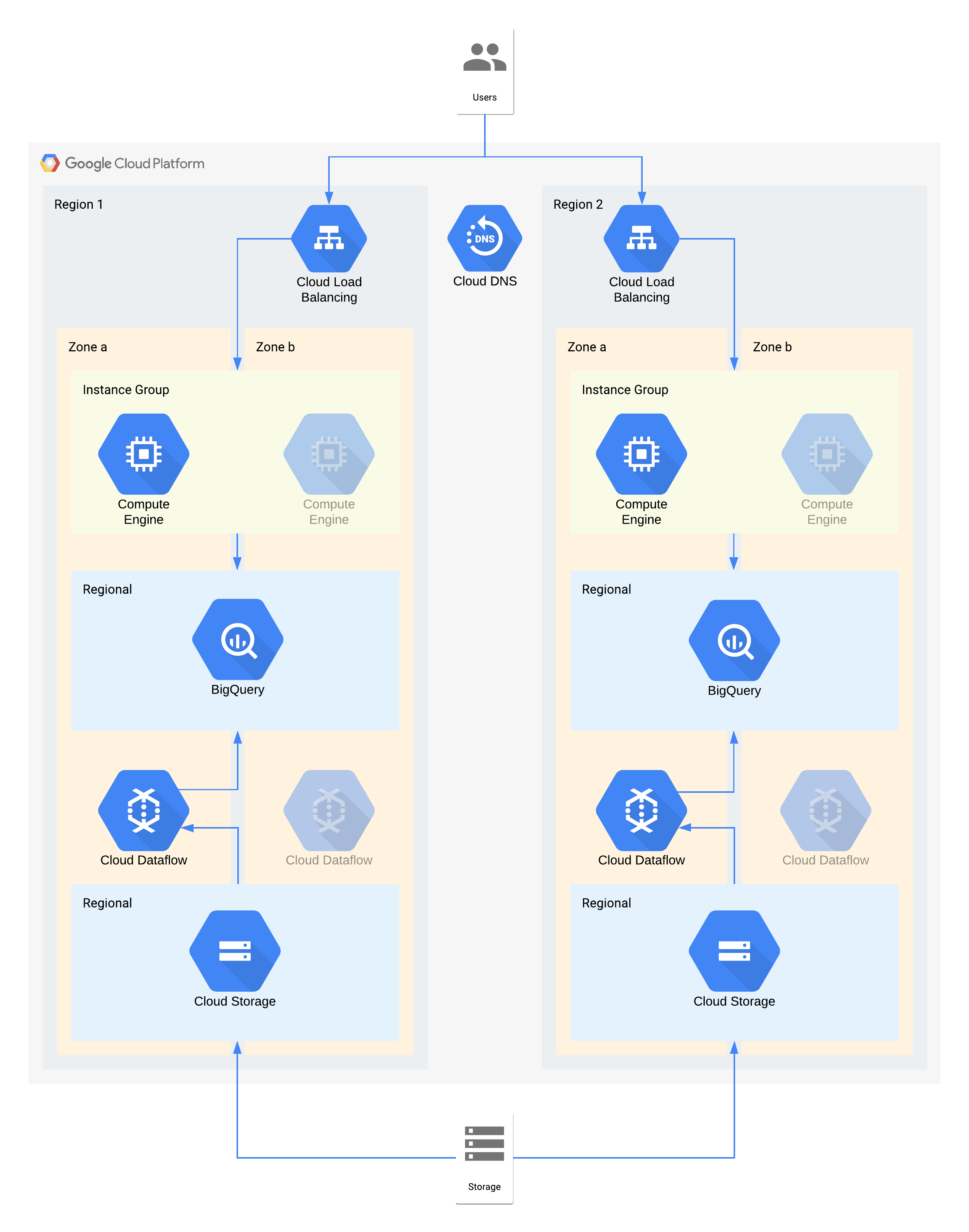

Ejemplo de arquitectura de nivel 2

| Criticidad de la aplicación | Interrupción de zona | Interrupción del servicio regional |

|---|---|---|

| Nivel 2 | RTO de 4 horas RPO cero |

RTO de 24 horas RPO de 4 horas |

En esta arquitectura se describe un almacén de datos con usuarios internos que se conectan a una capa de visualización de instancias de computación y una capa de ingestión y transformación de datos que rellena el almacén de datos backend.

Algunos componentes individuales de esta arquitectura no admiten directamente el RPO requerido para su nivel. Sin embargo, debido a la forma en que se usan conjuntamente, el servicio en general cumple el RPO. En este caso, como Dataflow es un producto zonal, sigue las recomendaciones para diseñar una alta disponibilidad para evitar la pérdida de datos durante una interrupción. Sin embargo, la capa de Cloud Storage es la fuente principal de estos datos y admite un RPO de cero. De esta forma, puedes volver a ingerir los datos perdidos en BigQuery usando la zona b en caso de que se produzca una interrupción en la zona a.

Decisiones de arquitectura clave para una interrupción de zona: RTO de 4 horas y RPO de cero:

- Un balanceador de carga se usa para proporcionar un punto de acceso escalable a los usuarios, lo que permite la conmutación por error automática a otra zona. Aunque el RTO sea de 4 horas, los cambios manuales en las direcciones IP o incluso las actualizaciones de DNS pueden tardar más de lo previsto.

- Un grupo de instancias gestionado regional para la capa de cálculo de visualización de datos se configura con varias zonas, pero con recursos mínimos. De esta forma, se optimiza el coste, pero se permite que las máquinas virtuales se escalen horizontalmente rápidamente.

- El Cloud Storage regional se usa como capa de almacenamiento provisional para la ingestión inicial de datos, lo que proporciona resiliencia automática de las zonas.

- Dataflow se usa para extraer datos de Cloud Storage y transformarlos antes de cargarlos en BigQuery. En caso de que se produzca una interrupción en una zona, se trata de un proceso sin estado que se puede reiniciar en otra zona.

- BigQuery proporciona el backend del almacén de datos para el frontend de visualización de datos. En caso de interrupción de una zona, los datos perdidos se volverían a ingerir desde Cloud Storage.

Decisiones de arquitectura clave para las interrupciones de la región: RTO de 24 horas y RPO de 4 horas:

- Se usa un balanceador de carga en cada región para proporcionar un punto de acceso escalable a los usuarios. Cloud DNS se usa para proporcionar una función de conmutación por error regional orquestada pero manual, ya que la infraestructura de la región 2 solo estaría disponible en caso de que se produjera una interrupción en la región.

- Un grupo de instancias gestionado regional para la capa de cálculo de visualización de datos se configura con varias zonas, pero con recursos mínimos. No se puede acceder a él hasta que se vuelva a configurar el balanceador de carga, pero no requiere ninguna intervención manual.

- Cloud Storage regional se usa como capa de almacenamiento provisional para la ingestión inicial de datos. Se carga al mismo tiempo en ambas regiones para cumplir los requisitos de RPO.

- Dataflow se usa para extraer datos de Cloud Storage y transformarlos antes de cargarlos en BigQuery. En caso de que se produzca una interrupción en una región, BigQuery se rellenaría con los datos más recientes de Cloud Storage.

- BigQuery proporciona el backend del almacén de datos. En condiciones normales, se actualizaría de forma intermitente. En caso de interrupción de una región, los datos más recientes se volverían a ingerir a través de Dataflow desde Cloud Storage.

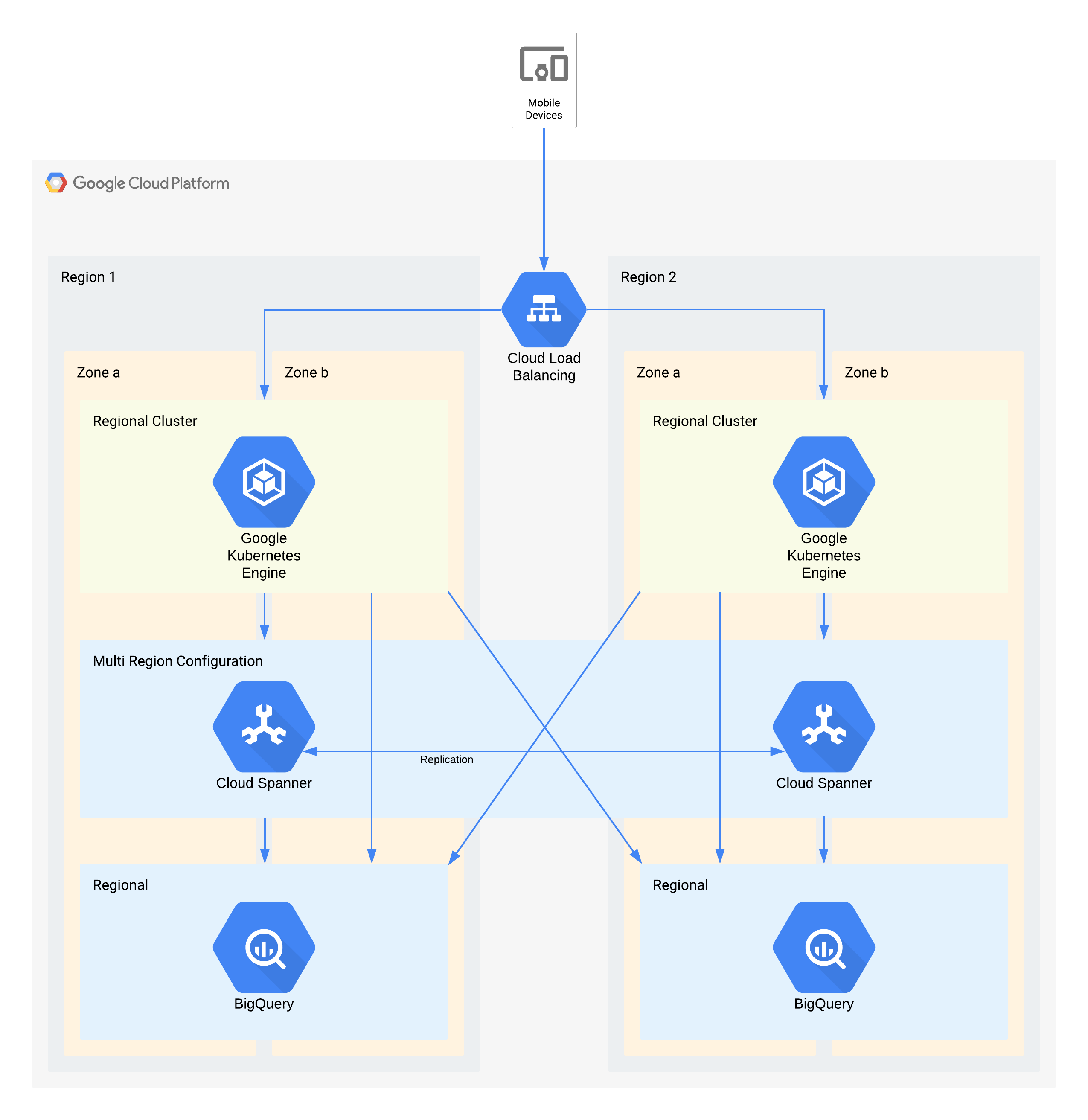

Ejemplo de arquitectura de nivel 1

| Criticidad de la aplicación | Interrupción de zona | Interrupción del servicio regional |

|---|---|---|

| Nivel 1 (más importante) |

RTO cero RPO cero |

RTO de 4 horas RPO de 1 hora |

En esta arquitectura se describe una infraestructura de backend de una aplicación móvil con usuarios externos que se conectan a un conjunto de microservicios que se ejecutan en GKE. Spanner proporciona la capa de almacenamiento de datos backend para los datos en tiempo real, y los datos históricos se transmiten a un lago de datos de BigQuery en cada región.

De nuevo, algunos componentes individuales de esta arquitectura no admiten directamente el RPO necesario para su nivel, pero, debido a la forma en que se usan conjuntamente, el servicio en general sí lo hace. En este caso, BigQuery se usa para consultas analíticas. Cada región se alimenta simultáneamente desde Spanner.

Decisiones de arquitectura clave para las interrupciones de zonas: RTO y RPO cero:

- Un balanceador de carga se usa para proporcionar un punto de acceso escalable a los usuarios, lo que permite la conmutación por error automática a otra zona.

- Se usa un clúster de GKE regional para la capa de aplicación, que se configura con varias zonas. De esta forma, se consigue un RTO de cero en cada región.

- Spanner multirregional se usa como capa de persistencia de datos, lo que proporciona resiliencia automática de los datos de zona y coherencia de las transacciones.

- BigQuery proporciona la función de analíticas de la aplicación. Cada región recibe datos de Spanner de forma independiente y la aplicación accede a ellos de forma independiente.

Decisiones de arquitectura clave para las interrupciones de la región: RTO de 4 horas y RPO de 1 hora:

- Un balanceador de carga se usa para proporcionar un punto de acceso escalable a los usuarios, lo que permite la conmutación por error automática a otra región.

- Se usa un clúster de GKE regional para la capa de aplicación, que se configura con varias zonas. Si se produce una interrupción en una región, el clúster de la región alternativa se escalará automáticamente para asumir la carga de procesamiento adicional.

- Spanner multirregional se usa como capa de persistencia de datos, lo que proporciona resiliencia de datos regional y coherencia de las transacciones automáticas. Este es el componente clave para conseguir un RPO de 1 hora entre regiones.

- BigQuery proporciona la función de analíticas de la aplicación. Cada región recibe datos de Spanner de forma independiente y la aplicación accede a ellos de forma independiente. Esta arquitectura compensa el componente de BigQuery, lo que le permite cumplir los requisitos generales de la aplicación.

Apéndice: Referencia de producto

En esta sección se describe la arquitectura y las funciones de recuperación ante desastres de los productos de Google Cloud que se usan con más frecuencia en las aplicaciones de los clientes y que se pueden aprovechar fácilmente para cumplir los requisitos de recuperación ante desastres.

Temas habituales

Muchos Google Cloud productos ofrecen configuraciones regionales o multirregionales. Los productos regionales son resistentes a las interrupciones de zonas, y los productos multirregionales y globales son resistentes a las interrupciones de regiones. Por lo general, esto significa que, durante una interrupción, tu aplicación apenas se verá afectada. Google consigue estos resultados mediante algunos enfoques arquitectónicos habituales, que reflejan las directrices de arquitectura anteriores.

Implementación redundante: los back-ends de las aplicaciones y el almacenamiento de datos se implementan en varias zonas de una región y en varias regiones de una ubicación multirregional. Para obtener más información sobre las consideraciones específicas de cada región, consulta el artículo sobre geografía y regiones.

Replicación de datos: los productos usan la replicación síncrona o asíncrona en las ubicaciones redundantes.

La replicación síncrona significa que, cuando tu aplicación hace una llamada a la API para crear o modificar datos almacenados por el producto, recibe una respuesta correcta solo cuando el producto ha escrito los datos en varias ubicaciones. La replicación síncrona asegura que no pierdas el acceso a ninguno de tus datos durante una interrupción de la infraestructura, ya que todos tus datos están disponibles en una de las ubicaciones de backend disponibles. Google Cloud

Aunque esta técnica ofrece la máxima protección de datos, puede tener inconvenientes en cuanto a latencia y rendimiento. Los productos multirregión que usan la replicación síncrona experimentan este equilibrio de forma más significativa, normalmente con una latencia añadida del orden de decenas o centenas de milisegundos.

La replicación asíncrona significa que, cuando tu aplicación hace una llamada a la API para crear o modificar datos almacenados por el producto, recibe una respuesta correcta una vez que el producto ha escrito los datos en una sola ubicación. Después de enviar su solicitud de escritura, el producto replica sus datos en ubicaciones adicionales.

Esta técnica proporciona una latencia más baja y un mayor rendimiento en la API que la replicación síncrona, pero a costa de la protección de datos. Si la ubicación en la que has escrito datos sufre una interrupción antes de que se complete la réplica, perderás el acceso a esos datos hasta que se resuelva la interrupción de la ubicación.

Gestión de interrupciones con el balanceo de carga: Google Cloud usa el balanceo de carga de software para dirigir las solicitudes a los backends de aplicación adecuados. En comparación con otros enfoques, como el balanceo de carga de DNS, este enfoque reduce el tiempo de respuesta del sistema ante una interrupción. Cuando se produce una Google Cloud interrupción en una ubicación, el balanceador de carga detecta rápidamente que el backend implementado en esa ubicación ha pasado a estar en mal estado y dirige todas las solicitudes a un backend de una ubicación alternativa. De esta forma, el producto puede seguir respondiendo a las solicitudes de tu aplicación durante una interrupción de la ubicación. Cuando se resuelve la interrupción de la ubicación, el balanceador de carga detecta la disponibilidad de los back-ends de producto en esa ubicación y reanuda el envío de tráfico a ella.

Administrador de contextos de acceso

El Administrador de contextos de acceso permite a las empresas configurar niveles de acceso que se asignan a una política definida sobre atributos de solicitud. Las políticas se replican a nivel regional.

En caso de interrupción de una zona, las solicitudes a zonas no disponibles se atienden automáticamente y de forma transparente desde otras zonas disponibles de la región.

En caso de interrupción regional, los cálculos de las políticas de la región afectada no estarán disponibles hasta que la región vuelva a estarlo.

Transparencia de acceso

Transparencia de acceso permite a los administradores de la organización Google Cloud definir un control de acceso pormenorizado y basado en atributos para proyectos y recursos en Google Cloud. En ocasiones, Google debe acceder a los datos de los clientes con fines administrativos. Cuando accedemos a los datos de los clientes, Transparencia de acceso proporciona registros de acceso a los clientes afectados. Google CloudEstos registros de Transparencia de acceso ayudan a garantizar el compromiso de Google con la seguridad de los datos y la transparencia en el tratamiento de los datos.

Transparencia de acceso es resistente a las interrupciones zonales y regionales. Si se produce una interrupción zonal o regional, Transparencia de acceso sigue procesando los registros de acceso administrativo en otra zona u otra región.

AlloyDB for PostgreSQL

AlloyDB para PostgreSQL es un servicio de bases de datos totalmente gestionado y compatible con PostgreSQL. AlloyDB para PostgreSQL ofrece alta disponibilidad en una región a través de los nodos redundantes de su instancia principal, que se encuentran en dos zonas diferentes de la región. La instancia principal mantiene la disponibilidad regional activando una conmutación por error automática a la zona de espera si la zona activa tiene algún problema. El almacenamiento regional garantiza la durabilidad de los datos en caso de que se pierdan en una sola zona.

Como método adicional de recuperación ante desastres, AlloyDB para PostgreSQL usa la replicación entre regiones para proporcionar funciones de recuperación ante desastres replicando de forma asíncrona los datos de tu clúster principal en clústeres secundarios ubicados en Google Cloud regiones independientes.

Interrupción zonal: durante el funcionamiento normal, solo está activo uno de los dos nodos de una instancia principal de alta disponibilidad, que es el que gestiona todas las escrituras de datos. Este nodo activo almacena los datos en la capa de almacenamiento regional independiente del clúster.

AlloyDB para PostgreSQL detecta automáticamente los fallos a nivel de zona y activa una conmutación por error para restaurar la disponibilidad de la base de datos. Durante la conmutación por error, AlloyDB para PostgreSQL inicia la base de datos en el nodo de espera, que ya se ha aprovisionado en otra zona. Las nuevas conexiones de bases de datos se dirigen automáticamente a esta zona.

Desde el punto de vista de una aplicación cliente, una interrupción zonal se parece a una interrupción temporal de la conectividad de red. Una vez que se haya completado la conmutación por error, un cliente podrá volver a conectarse a la instancia en la misma dirección y con las mismas credenciales, sin perder datos.

Interrupción regional: la replicación entre regiones usa la replicación asíncrona, lo que permite que la instancia principal confirme las transacciones antes de que se confirmen en las réplicas. La diferencia de tiempo entre el momento en que se confirma una transacción en la instancia principal y el momento en que se confirma en la réplica se conoce como latencia de replicación. La diferencia de tiempo entre el momento en que el principal genera el registro de escritura anticipada (WAL) y el momento en que el WAL llega a la réplica se conoce como latencia de vaciado. La latencia de replicación y la latencia de vaciado dependen de la configuración de la instancia de base de datos y de la carga de trabajo generada por el usuario.

En caso de que se produzca una interrupción regional, puedes convertir los clústeres secundarios de otra región en clústeres principales independientes con capacidad de escritura. Este clúster promocionado ya no replica los datos del clúster principal original al que estaba asociado. Debido al retraso de vaciado, puede que se pierdan algunos datos, ya que puede haber transacciones en el clúster principal original que no se hayan propagado al clúster secundario.

El RPO de la replicación entre regiones se ve afectado tanto por el uso de la CPU del clúster principal como por la distancia física entre la región del clúster principal y la del clúster secundario. Para optimizar el RPO, te recomendamos que pruebes tu carga de trabajo con una configuración que incluya una réplica para establecer un límite seguro de transacciones por segundo (TPS), que es el TPS sostenido más alto que no acumula latencia de vaciado. Si tu carga de trabajo supera el límite de TPS seguro, se acumula el flag de vaciado, lo que puede afectar al RPO. Para limitar la latencia de la red, elige pares de regiones del mismo continente.

Para obtener más información sobre la monitorización de la latencia de red y otras métricas de AlloyDB para PostgreSQL, consulta Monitorizar instancias.

Anti Money Laundering AI

Anti Money Laundering AI (AML AI) proporciona una API para ayudar a las instituciones financieras de todo el mundo a detectar el blanqueo de dinero de forma más eficaz y eficiente. La IA contra el blanqueo de capitales es una oferta regional, lo que significa que los clientes pueden elegir la región, pero no las zonas que la componen. Los datos y el tráfico se balancean de carga automáticamente entre las zonas de una región. Las operaciones (por ejemplo, crear una canalización o ejecutar una predicción) se escalan automáticamente en segundo plano y se balancean entre zonas según sea necesario.

Interrupción zonal: AML AI almacena los datos de sus recursos de forma regional, replicados de forma síncrona. Cuando una operación de larga duración se completa correctamente, se puede confiar en los recursos independientemente de los errores zonales. El procesamiento también se replica en las zonas, pero esta replicación tiene como objetivo el balanceo de carga y no la alta disponibilidad, por lo que un fallo de zona durante una operación puede provocar un fallo de la operación. Si esto ocurre, puedes solucionar el problema volviendo a intentar la operación. Durante una interrupción zonal, los tiempos de procesamiento pueden verse afectados.

Interrupción regional: los clientes eligen la región de Google Cloud en la que quieren crear sus recursos de IA de lucha contra el blanqueo de capitales. Los datos nunca se replican entre regiones. La IA de AML nunca dirige el tráfico de los clientes a otra región. En caso de que se produzca un fallo regional, la IA de AML volverá a estar disponible en cuanto se resuelva la interrupción.

Claves de API

Las claves de API proporcionan una gestión escalable de los recursos de claves de API para un proyecto. Las claves de API son un servicio global, lo que significa que las claves se pueden ver y acceder desde cualquier ubicación de Google Cloud . Sus datos y metadatos se almacenan de forma redundante en varias zonas y regiones.

Las claves de API son resistentes a las interrupciones zonales y regionales. En caso de interrupción zonal o regional, las claves de API siguen atendiendo solicitudes desde otra zona de la misma región o de otra.

Para obtener más información sobre las claves de API, consulta el artículo Descripción general de la API Keys.

Apigee

Apigee proporciona una plataforma segura, escalable y fiable para desarrollar y gestionar APIs. Apigee ofrece despliegues de una o varias regiones.

Interrupción por zonas: los datos de tiempo de ejecución de los clientes se replican en varias zonas de disponibilidad. Por lo tanto, una interrupción en una sola zona no afecta a Apigee.

Interrupción regional: en el caso de las instancias de Apigee de una sola región, si una región deja de funcionar, las instancias de Apigee no estarán disponibles en esa región y no se podrán restaurar en otras regiones. En el caso de las instancias de Apigee multirregionales, los datos se replican de forma asíncrona en todas las regiones. Por lo tanto, si falla una región, el tráfico no se reduce por completo. Sin embargo, es posible que no puedas acceder a los datos no confirmados de la región en la que se ha producido el error. Puedes desviar el tráfico de las regiones que no estén en buen estado. Para conseguir una conmutación por error automática del tráfico, puedes configurar el enrutamiento de red mediante grupos de instancias gestionados (MIGs).

AutoML Translation

AutoML Translation es un servicio de traducción automática que te permite importar tus propios datos (pares de oraciones) para entrenar modelos personalizados que se adapten a las necesidades específicas de tu dominio.

Interrupción zonal: AutoML Translation tiene servidores de computación activos en varias zonas y regiones. También admite la replicación síncrona de datos entre zonas de una misma región. Estas funciones ayudan a AutoML Translation a lograr una conmutación por error instantánea sin pérdida de datos en caso de fallos zonales y sin necesidad de que los clientes hagan nada.

Interrupción regional: en caso de fallo regional, AutoML Translation no estará disponible.

AutoML Vision

AutoML Vision forma parte de Vertex AI. Ofrece un marco unificado para crear conjuntos de datos, importar datos, entrenar modelos y usar modelos para predicciones online y por lotes.

AutoML Vision es una oferta regional. Los clientes pueden elegir la región desde la que quieren iniciar un trabajo, pero no pueden elegir las zonas específicas de esa región. El servicio balancea la carga de trabajo automáticamente entre las diferentes zonas de la región.

Interrupción zonal: AutoML Vision almacena los metadatos de los trabajos a nivel regional y escribe de forma síncrona en las zonas de la región. Las tareas se inician en una zona específica, seleccionada por Cloud Load Balancing.

Tareas de entrenamiento de AutoML Vision: si se produce una interrupción zonal, se producirá un error en todas las tareas en curso y el estado de la tarea se actualizará a "Error". Si un trabajo falla, vuelve a intentarlo inmediatamente. El nuevo trabajo se dirige a una zona disponible.

Tareas de predicción por lotes de AutoML Vision: la predicción por lotes se basa en Predicción por lotes de Vertex AI. Cuando se produce una interrupción zonal, el servicio vuelve a intentar ejecutar el trabajo automáticamente dirigiéndolo a las zonas disponibles. Si se produce un error en varios reintentos, el estado del trabajo se actualiza a "failed" (error). Las solicitudes posteriores de los usuarios para ejecutar el trabajo se enrutan a una zona disponible.

Interrupción regional: los clientes eligen la Google Cloud región en la que quieren ejecutar sus tareas. Los datos nunca se replican entre regiones. En caso de fallo regional, el servicio AutoML Vision no estará disponible en esa región. Volverá a estar disponible cuando se solucione la interrupción. Para ejecutar sus trabajos, recomendamos a los clientes que usen varias regiones. Si se produce una interrupción regional, dirige las tareas a otra región disponible.

Lotes

Batch es un servicio totalmente gestionado para poner en cola, programar y ejecutar tareas por lotes en Google Cloud. Los ajustes de los lotes se definen a nivel de región. Los clientes deben elegir una región para enviar sus trabajos por lotes, no una zona de una región. Cuando se envía un trabajo, Batch escribe de forma síncrona los datos del cliente en varias zonas. Sin embargo, los clientes pueden especificar las zonas en las que las VMs de Batch ejecutan los trabajos.

Fallo de zona: cuando falla una zona, también fallan las tareas que se ejecutan en esa zona. Si las tareas tienen ajustes de reintento, Batch automáticamente transfiere esas tareas a otras zonas activas de la misma región. La conmutación por error automática está sujeta a la disponibilidad de recursos en las zonas activas de la misma región. Los trabajos que requieren recursos zonales (como máquinas virtuales, GPUs o discos persistentes zonales) que solo están disponibles en la zona con errores se ponen en cola hasta que se recupera la zona con errores o hasta que se alcanza el tiempo de espera de la cola de los trabajos. Cuando sea posible, recomendamos que los clientes dejen que Batch elija los recursos zonales para ejecutar sus trabajos. De esta forma, te aseguras de que los trabajos sean resistentes a las interrupciones zonales.

Fallo regional: en caso de que se produzca un fallo regional, el plano de control del servicio no estará disponible en la región. El servicio no replica datos ni redirige solicitudes entre regiones. Recomendamos a los clientes que usen varias regiones para ejecutar sus tareas y que redirijan las tareas a otra región si una de ellas falla.

Protección de datos y contra amenazas de Chrome Enterprise Premium

La protección de datos y contra amenazas de Chrome Enterprise Premium forma parte de la solución Chrome Enterprise Premium. Amplía Chrome con una variedad de funciones de seguridad, como la protección contra malware y phishing, la prevención de la pérdida de datos (DLP), las reglas de filtrado de URLs y los informes de seguridad.

Los administradores de Chrome Enterprise Premium pueden habilitar el almacenamiento de contenido principal de clientes que infrinja las políticas de DLP o de malware en eventos de registro de reglas de Google Workspace o en Cloud Storage para futuras investigaciones. Los eventos de registro de reglas de Google Workspace se basan en una base de datos de Spanner multirregional. Chrome Enterprise Premium puede tardar varias horas en detectar infracciones de las políticas. Durante este tiempo, los datos sin procesar están sujetos a pérdidas de datos debido a una interrupción zonal o regional. Una vez que se detecta una infracción, el contenido que infringe tus políticas se escribe en los eventos del registro de reglas de Google Workspace o en Cloud Storage.

Interrupción del servicio por zonas y regiones: como la protección contra amenazas y de datos de Chrome Enterprise Premium es multizonal y multirregional, puede resistir una pérdida completa e imprevista de una zona o una región sin que se vea afectada la disponibilidad. Para ofrecer este nivel de fiabilidad, redirige el tráfico a su servicio en otras zonas o regiones activas. Sin embargo, como la protección contra amenazas y de datos de Chrome Enterprise Premium puede tardar varias horas en detectar infracciones de DLP y malware, los datos sin procesar de una zona o región concretas pueden perderse si se produce una interrupción en esa zona o región.

BigQuery

BigQuery es un almacén de datos en la nube de alta escalabilidad, rentable y sin servidor, diseñado para agilizar tu negocio. BigQuery admite los siguientes tipos de ubicaciones para los conjuntos de datos de los usuarios:

- Una región: una ubicación geográfica específica, como Iowa (

us-central1) o Montreal (northamerica-northeast1). - Una multirregión: una zona geográfica grande que contiene dos o más lugares geográficos, como Estados Unidos (

US) o Europa (EU).

En ambos casos, los datos se almacenan de forma redundante en dos zonas de una misma región de la ubicación seleccionada. Los datos escritos en BigQuery se escriben de forma síncrona en las zonas primaria y secundaria. Esta opción protege frente a la falta de disponibilidad de una sola zona dentro de la región, pero no frente a una interrupción regional.

Autorización binaria

Autorización binaria es un producto de seguridad de la cadena de suministro de software para GKE y Cloud Run.

Todas las políticas de Autorización binaria se replican en varias zonas de cada región. La replicación ayuda a las operaciones de lectura de la política de Binary Authorization a recuperarse de los fallos de otras regiones. La replicación también hace que las operaciones de lectura sean tolerantes a los fallos de zona en cada región.

Las operaciones de aplicación de la autorización binaria son resistentes a las interrupciones zonales, pero no a las regionales. Las operaciones de aplicación se ejecutan en la misma región que el clúster de GKE o el trabajo de Cloud Run que realiza la solicitud. Por lo tanto, en caso de interrupción regional, no se ejecuta nada para hacer solicitudes de aplicación de la autorización binaria.

Certificate Manager

Certificate Manager te permite obtener y gestionar certificados de Seguridad en la capa de transporte (TLS) para usarlos con diferentes tipos de Cloud Load Balancing.

En caso de que se produzca una interrupción por zonas, Certificate Manager regional y global son resistentes a los fallos por zonas, ya que los trabajos y las bases de datos son redundantes en varias zonas de una región. En caso de interrupción regional, Certificate Manager global es resistente a los fallos regionales porque los trabajos y las bases de datos son redundantes en varias regiones. Certificate Manager regional es un producto regional, por lo que no puede resistir un fallo regional.

Sistema de Detección de Intrusos de Cloud

Cloud Intrusion Detection System (Cloud IDS) es un servicio zonal que proporciona endpoints de IDS de ámbito zonal, que procesan el tráfico de las máquinas virtuales de una zona específica y, por lo tanto, no tolera las interrupciones zonales ni regionales.

Interrupción zonal: Cloud IDS está vinculado a instancias de VM. Si un cliente tiene previsto mitigar las interrupciones zonales desplegando VMs en varias zonas (manualmente o mediante grupos de instancias gestionados regionales), también tendrá que desplegar endpoints de Cloud IDS en esas zonas.

Interrupción regional: Cloud IDS es un producto regional. No proporciona ninguna función entre regiones. Si se produce un fallo regional, se inhabilitará toda la funcionalidad de Cloud IDS en todas las zonas de esa región.

Google Security Operations SIEM

Google Security Operations SIEM (que forma parte de Google Security Operations) es un servicio totalmente gestionado que ayuda a los equipos de seguridad a detectar, investigar y responder a las amenazas.

Google Security Operations SIEM ofrece soluciones regionales y multirregionales.

En las ofertas regionales, los datos y el tráfico se equilibran de carga automáticamente entre las zonas de la región elegida, y los datos se almacenan de forma redundante en las zonas de disponibilidad de la región.

Las multirregiones tienen redundancia geográfica. Esta redundancia proporciona un conjunto de protecciones más amplio que el almacenamiento regional. También ayuda a garantizar que el servicio siga funcionando aunque se pierda una región completa.

La mayoría de las rutas de ingestión de datos replican los datos de los clientes de forma síncrona en varias ubicaciones. Cuando los datos se replican de forma asíncrona, hay un periodo (un objetivo de punto de recuperación o RPO) durante el cual los datos aún no se han replicado en varias ubicaciones. Este es el caso cuando se ingieren datos con feeds en implementaciones multirregionales. Después del RPO, los datos están disponibles en varias ubicaciones.

Interrupción zonal:

Despliegues regionales: las solicitudes se atienden desde cualquier zona de la región. Los datos se replican de forma síncrona en varias zonas. En caso de que se produzca una interrupción en toda la zona, las zonas restantes seguirán sirviendo tráfico y procesando los datos. El aprovisionamiento redundante y el escalado automático de la solución SIEM de Google Security Operations ayudan a garantizar que el servicio siga funcionando en las zonas restantes durante estos cambios de carga.

Despliegues multirregionales: las interrupciones de servicio de una zona son equivalentes a las de una región.

Interrupción regional:

Implementaciones regionales: Google Security Operations SIEM almacena todos los datos de los clientes en una sola región y el tráfico nunca se enruta entre regiones. En caso de interrupción regional, Google Security Operations SIEM no estará disponible en la región hasta que se resuelva la interrupción.

Despliegues multirregionales (sin feeds): las solicitudes se sirven desde cualquier región del despliegue multirregional. Los datos se replican de forma síncrona en varias regiones. En caso de que se produzca una interrupción en toda una región, las regiones restantes seguirán enviando tráfico y procesando los datos. El aprovisionamiento redundante y el escalado automático del SIEM de Google Security Operations ayudan a garantizar que el servicio siga funcionando en las regiones restantes durante estos cambios de carga.

Despliegues multirregionales (con feeds): las solicitudes se sirven desde cualquier región del despliegue multirregional. Los datos se replican de forma asíncrona en varias regiones con el RPO proporcionado. En caso de que se produzca una interrupción en toda una región, solo estarán disponibles en las regiones restantes los datos almacenados después del RPO. Es posible que los datos del periodo de RPO no se repliquen.

Inventario de Recursos de Cloud

Inventario de recursos de Cloud es un servicio global de alto rendimiento y resistente que mantiene un repositorio de metadatos de recursos y políticas. Google Cloud Inventario de Recursos de Cloud proporciona herramientas de búsqueda y análisis que te ayudan a hacer un seguimiento de los recursos implementados en organizaciones, carpetas y proyectos.

En caso de interrupción de una zona, Cloud Asset Inventory sigue atendiendo solicitudes desde otra zona de la misma región o de otra.

En caso de interrupción regional, el Inventario de Recursos de Cloud seguirá atendiendo solicitudes de otras regiones.

Bigtable

Bigtable es un servicio de base de datos NoSQL de alto rendimiento y totalmente gestionado para grandes cargas de trabajo analíticas y operativas.

Descripción general de la replicación de Bigtable

Bigtable ofrece una función de replicación flexible y totalmente configurable que puedes usar para aumentar la disponibilidad y la durabilidad de tus datos copiándolos en clústeres de varias regiones o de varias zonas de la misma región. Bigtable también puede proporcionar conmutación por error automática para tus solicitudes cuando usas la replicación.

Cuando se usan configuraciones multizonales o multirregionales con enrutamiento de varios clústeres, en caso de interrupción zonal o regional, Bigtable redirige automáticamente el tráfico y sirve las solicitudes desde el clúster disponible más cercano. Como la replicación de Bigtable es asíncrona y eventualmente coherente, es posible que los cambios muy recientes en los datos de la ubicación de la interrupción no estén disponibles si aún no se han replicado en otras ubicaciones.

Consideraciones sobre el rendimiento.

Cuando la demanda de recursos de CPU supera la capacidad disponible del nodo, Bigtable siempre prioriza el servicio de las solicitudes entrantes por encima del tráfico de replicación.

Para obtener más información sobre cómo usar la replicación de Bigtable con tu carga de trabajo, consulta la descripción general de la replicación de Cloud Bigtable y los ejemplos de configuraciones de replicación.

Los nodos de Bigtable se usan tanto para atender las solicitudes entrantes como para replicar datos de otros clústeres. Además de mantener un número suficiente de nodos por clúster, también debe asegurarse de que sus aplicaciones usen un diseño de esquema adecuado para evitar puntos de acceso, que pueden provocar un uso excesivo o desequilibrado de la CPU y un aumento de la latencia de replicación.

Para obtener más información sobre cómo diseñar el esquema de tu aplicación para maximizar el rendimiento y la eficiencia de Bigtable, consulta las prácticas recomendadas para el diseño de esquemas.

Supervisión

Bigtable ofrece varias formas de monitorizar visualmente la latencia de replicación de tus instancias y clústeres mediante los gráficos de replicación disponibles en la Google Cloud console.

También puedes monitorizar de forma programática las métricas de replicación de Bigtable mediante la API Cloud Monitoring.

Servicio de Autoridades de Certificación

Servicio de Autoridades de Certificación permite a los clientes simplificar, automatizar y personalizar el despliegue, la gestión y la seguridad de las autoridades de certificación privadas, así como emitir certificados de forma resiliente a gran escala.

Interrupción zonal: el servicio de CA es resistente a los fallos zonales porque su plano de control es redundante en varias zonas de una región. Si se produce una interrupción zonal, el servicio de CA sigue atendiendo las solicitudes de otra zona de la misma región sin interrupciones. Como los datos se replican de forma síncrona, no se pierden ni se dañan.

Interrupción regional: el servicio de AC es un producto regional, por lo que no puede resistir un fallo regional. Si necesitas resiliencia ante fallos regionales, crea CAs emisoras en dos regiones diferentes. Crea la AC emisora principal en la región en la que necesites certificados. Crea una AC de respaldo en otra región. Usa la alternativa cuando la región de la AC subordinada principal tenga una interrupción. Si es necesario, ambas autoridades de certificación pueden encadenarse a la misma autoridad de certificación raíz.

Facturación de Google Cloud

La API Cloud Billing permite a los desarrolladores gestionar la facturación de susGoogle Cloud proyectos de forma programática. La API Cloud Billing se ha diseñado como un sistema global con actualizaciones escritas de forma síncrona en varias zonas y regiones.

Fallo zonal o regional: la API Cloud Billing se transferirá automáticamente a otra zona u otra región. Es posible que las solicitudes individuales fallen, pero una política de reintentos debería permitir que las solicitudes posteriores se completen correctamente.

Cloud Build

Cloud Build es un servicio que ejecuta las compilaciones en Google Cloud.

Cloud Build se compone de instancias aisladas por regiones que replican datos de forma síncrona en las zonas de la región. Te recomendamos que uses regiones específicas en lugar de la región global y que te asegures de que los recursos que usa tu compilación (como los contenedores de registro y los repositorios de Artifact Registry) estén alineados con la región en la que se ejecuta tu compilación. Google Cloud

En caso de interrupción zonal, las operaciones del plano de control no se ven afectadas. Sin embargo, las compilaciones que se estén ejecutando en la zona con errores se retrasarán o se perderán definitivamente. Las compilaciones que se activen se distribuirán automáticamente a las zonas que sigan funcionando.

En caso de fallo regional, el plano de control no estará disponible y las compilaciones en curso se retrasarán o se perderán de forma permanente. Los activadores, los grupos de trabajadores y los datos de compilación nunca se replican entre regiones. Te recomendamos que prepares activadores y grupos de trabajadores en varias regiones para facilitar la mitigación de una interrupción.

Cloud CDN

Cloud CDN distribuye y almacena en caché el contenido en muchas ubicaciones de la red de Google para reducir la latencia de servicio de los clientes. El contenido almacenado en caché se sirve de la mejor forma posible. Cuando la caché de Cloud CDN no puede servir una solicitud, esta se reenvía a los servidores de origen, como las VMs de backend o los segmentos de Cloud Storage, donde se almacena el contenido original.

Cuando falla una zona o una región, las cachés de las ubicaciones afectadas no están disponibles. Las solicitudes entrantes se enrutan a las ubicaciones de edge y las cachés de Google disponibles. Si estas cachés alternativas no pueden atender la solicitud, la reenviarán a un servidor de origen disponible. Si el servidor puede atender la solicitud con datos actualizados, no se perderá contenido. Si aumenta la frecuencia de los errores de caché, los servidores de origen experimentarán volúmenes de tráfico superiores a los habituales a medida que se llenen las cachés. Las solicitudes posteriores se atenderán desde las cachés que no se vean afectadas por la interrupción de la zona o la región.

Para obtener más información sobre Cloud CDN y el comportamiento de la caché, consulta la documentación de Cloud CDN.

Cloud Composer

Cloud Composer es un servicio gestionado de orquestación de flujos de trabajo que te permite crear, programar, monitorizar y gestionar flujos de trabajo que abarcan nubes y centros de datos on-premise. Los entornos de Cloud Composer se basan en el proyecto de código abierto Apache Airflow.

La disponibilidad de la API de Cloud Composer no se ve afectada por la falta de disponibilidad de las zonas. Durante una interrupción zonal, conservas el acceso a la API Cloud Composer, incluida la capacidad de crear nuevos entornos de Cloud Composer.

Un entorno de Cloud Composer tiene un clúster de GKE como parte de su arquitectura. Durante una interrupción zonal, los flujos de trabajo del clúster pueden verse afectados:

- En Cloud Composer 1, el clúster del entorno es un recurso zonal, por lo que una interrupción zonal puede hacer que el clúster no esté disponible. Los flujos de trabajo que se estén ejecutando en el momento de la interrupción podrían detenerse antes de completarse.

- En Cloud Composer 2, el clúster del entorno es un recurso regional. Sin embargo, los flujos de trabajo que se ejecuten en nodos de las zonas afectadas por una interrupción zonal podrían detenerse antes de completarse.

En ambas versiones de Cloud Composer, una interrupción zonal puede provocar que los flujos de trabajo ejecutados parcialmente dejen de ejecutarse, incluidas las acciones externas que hayas configurado para que el flujo de trabajo lleve a cabo. En función del flujo de trabajo, esto puede provocar incoherencias externas. Por ejemplo, si el flujo de trabajo se detiene en mitad de una ejecución de varios pasos para modificar almacenes de datos externos. Por lo tanto, debes tener en cuenta el proceso de recuperación al diseñar tu flujo de trabajo de Airflow, incluido cómo detectar estados de flujo de trabajo parcialmente no ejecutados y reparar los cambios de datos parciales.

En Cloud Composer 1, durante una interrupción de la zona, puedes iniciar un nuevo entorno de Cloud Composer en otra zona. Como Airflow mantiene el estado de tus flujos de trabajo en su base de datos de metadatos, transferir esta información a un nuevo entorno de Cloud Composer puede requerir pasos y preparaciones adicionales.

En Cloud Composer 2, puedes hacer frente a las interrupciones zonales configurando con antelación la recuperación ante desastres con instantáneas del entorno. Durante una interrupción de una zona, puedes cambiar a otro entorno transfiriendo el estado de tus flujos de trabajo con una instantánea del entorno. Solo Cloud Composer 2 admite la recuperación ante desastres con capturas de entornos.

Cloud Data Fusion

Cloud Data Fusion es un servicio de integración de datos empresariales totalmente gestionado que ayuda a los usuarios a crear y gestionar flujos de procesamiento de datos rápidamente. Ofrece tres ediciones.

Las interrupciones zonales afectan a las instancias de la edición Developer.

Las interrupciones regionales afectan a las instancias de las ediciones Basic y Enterprise.

Para controlar el acceso a los recursos, puedes diseñar y ejecutar las canalizaciones en entornos independientes. Esta separación te permite diseñar una canalización una vez y, después, ejecutarla en varios entornos. Puedes recuperar las pipelines en ambos entornos. Para obtener más información, consulta Crear copias de seguridad y restaurar datos de instancias.

Los siguientes consejos se aplican a las interrupciones regionales y zonales.

Interrupciones en el entorno de diseño de la canalización

En el entorno de diseño, guarda los borradores de las canalizaciones por si se produce una interrupción. En función de los requisitos específicos de RTO y RPO, puedes usar los borradores guardados para restaurar la canalización en otra instancia de Cloud Data Fusion durante una interrupción.

Interrupciones en el entorno de ejecución de la canalización

En el entorno de ejecución, puedes iniciar el flujo de procesamiento de forma interna con activadores o programaciones de Cloud Data Fusion, o de forma externa con herramientas de orquestación, como Cloud Composer. Para poder recuperar las configuraciones de tiempo de ejecución de las canalizaciones, haz una copia de seguridad de las canalizaciones y las configuraciones, como los complementos y las programaciones. En caso de interrupción, puedes usar la copia de seguridad para replicar una instancia en una región o zona que no se vea afectada.

Otra forma de prepararse para las interrupciones es tener varias instancias en las regiones con la misma configuración y el mismo conjunto de pasos. Si usas la orquestación externa, las canalizaciones en ejecución se pueden equilibrar de carga automáticamente entre instancias. Presta especial atención para asegurarte de que no haya recursos (como fuentes de datos o herramientas de orquestación) vinculados a una sola región y utilizados por todas las instancias, ya que esto podría convertirse en un punto central de fallo en caso de interrupción. Por ejemplo, puedes tener varias instancias en diferentes regiones y usar Cloud Load Balancing y Cloud DNS para dirigir las solicitudes de ejecución de la canalización a una instancia que no se vea afectada por una interrupción (consulta las arquitecturas de nivel 1 y nivel 3).

Interrupciones de otros Google Cloud servicios de datos de la canalización

Tu instancia puede usar otros Google Cloud servicios como fuentes de datos o entornos de ejecución de la canalización, como Dataproc, Cloud Storage o BigQuery. Esos servicios pueden estar en regiones diferentes. Cuando se requiere la ejecución entre regiones, un fallo en cualquiera de las regiones provoca una interrupción. En este caso, debes seguir los pasos estándar de recuperación ante desastres, teniendo en cuenta que la configuración entre regiones con servicios críticos en diferentes regiones es menos resistente.

Cloud Deploy

Cloud Deploy proporciona entrega continua de cargas de trabajo en servicios de tiempo de ejecución, como GKE y Cloud Run. El servicio se compone de instancias regionales que replican los datos de forma síncrona en las zonas de la región.