Gemini Enterprise Agent Platform

创新、构建和部署企业级智能体

Gemini Enterprise Agent Platform 是 Google Cloud 面向开发者推出的全面平台,可用于构建、扩缩、治理和优化智能体。这是一站式平台,技术团队可以在这里构建智能体,将企业应用和工作流转变为强大的智能体系统。

新客户最高可获享 300 美元赠金,用于体验 Agent Platform 和其他 Google Cloud 产品。

功能

构建、扩缩、治理和优化企业级 AI 智能体

Agent Platform 是我们开放而全面的平台,可帮助企业快速构建、扩缩、治理和优化依托企业自身数据的企业级智能体。该平台提供您所需的全栈基础和丰富的开发者选项,可帮助您在全球范围内将您的应用和工作流转变为强大的智能体系统。

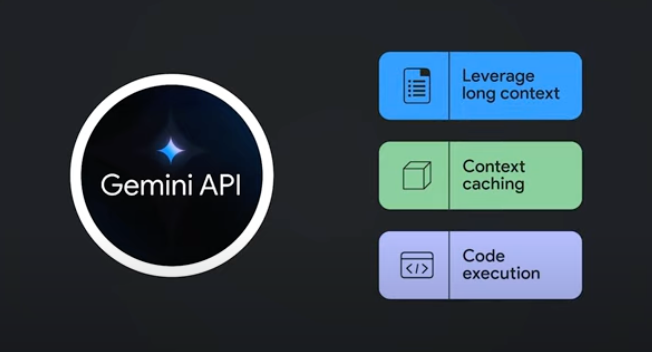

Gemini - Google 旗下最强大的多模态模型

Agent Platform 让您轻松接入 Google 最新的 Gemini 模型,包括 Gemini 3。Gemini 几乎能够理解各类输入信息,整合不同类型的数据,并生成近乎任意形式的输出结果。您可在 Agent Studio 中使用文本、图片、视频或代码,向 Gemini 发出提示并进行测试。利用 Gemini 的高级推理和先进的生成功能,开发者可体验各类示例提示场景:从图片中提取文本、将图片文本转换为 JSON 格式,甚至针对上传的图片生成答案,进而打造新一代 AI 应用。

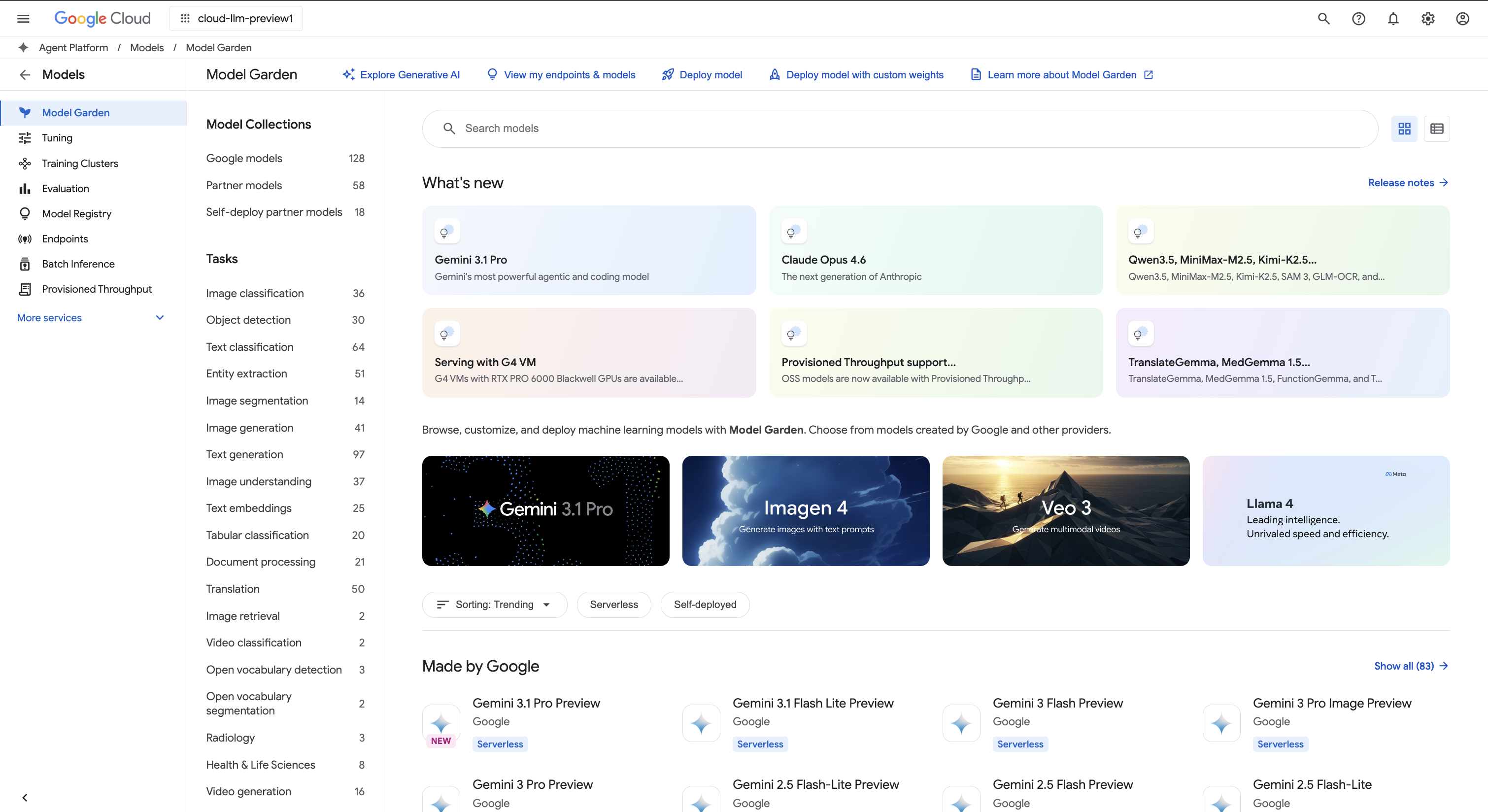

Model Garden 中有 200 多种生成式 AI 模型和工具

在 Model Garden 中,您可选择品类丰富的模型,包括第一方模型(Gemini、Imagen、Lyria、Chirp、Veo)、第三方模型(Anthropic 的 Claude 模型系列)和开放模型(Gemma、Llama)。使用扩展程序使模型能够检索实时信息和触发操作。您还能通过多种调优选项,根据应用场景自定义模型。

模型评估服务提供企业级工具,帮助您对生成式 AI 模型进行客观、数据驱动的评估。

开放的集成式 AI 平台

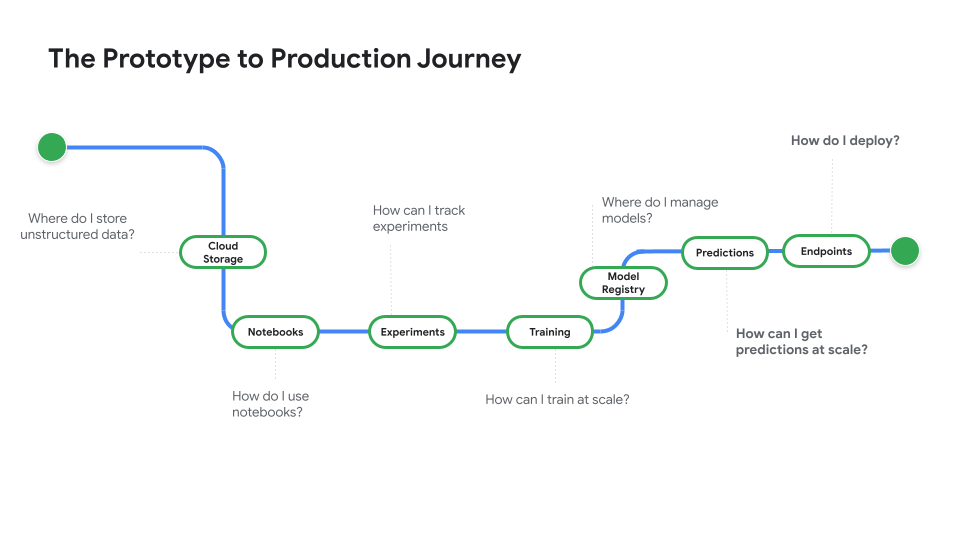

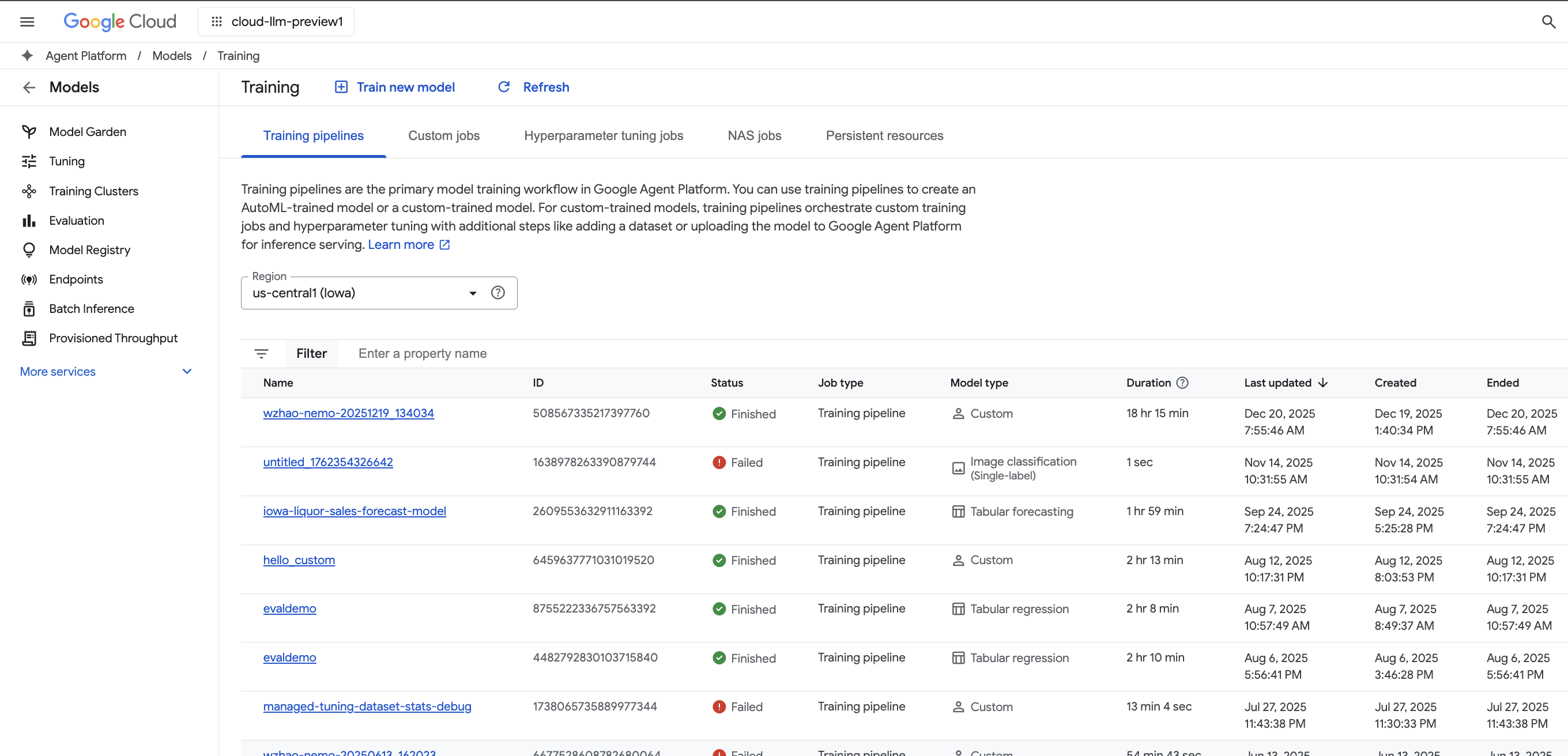

借助 Agent Platform 中用于训练、调整和部署机器学习模型的工具,数据科学家可大幅提升工作效率。

Agent Platform 笔记本(包括您选择的 Colab Enterprise 或 Workbench)与 BigQuery 原生集成,为各类数据及 AI 工作负载提供统一操作途径。

Agent Platform Training 和 Prediction 支持您选用开源框架及优化后的 AI 基础设施,助力缩短训练时间,轻松将模型部署至生产环境。

适用于预测式 AI 和生成式 AI 的 MLOps

Agent Platform 提供专属 MLOps 工具,助力数据科学家与机器学习工程师实现机器学习项目的自动化、标准化和高效管理。

模块化工具支持跨团队协作,在整个开发生命周期中持续优化模型 – 通过 Gen AI Evaluation 评估筛选适配特定应用场景的最优模型,借助 Pipelines 编排工作流、利用 Model Registry 管理各类模型、通过 Feature Store 实现机器学习特征的部署、共享和复用,并对模型进行输入偏移与漂移监控。

工作方式

Agent Platform 提供了多种智能体构建、模型训练和部署选项:

- Agent Platform 可让您在一个统一的平台上构建、扩缩、治理和优化企业级智能体

- 生成式 AI 让您可以使用大型生成式 AI 模型(包括 Gemini 3),助力您评估、调优并部署这些模型,应用于您的 AI 驱动型应用中

- 借助 Model Garden,您可以在 Agent Platform 中发现、测试、自定义制和部署精选开源 (OSS) 模型和相关资产

- 自定义训练让您完全掌控训练流程,包括使用您偏好的机器学习框架、编写专属训练代码,以及选择超参数调优方案

Agent Platform 提供了多种智能体构建、模型训练和部署选项:

- Agent Platform 可让您在一个统一的平台上构建、扩缩、治理和优化企业级智能体

- 生成式 AI 让您可以使用大型生成式 AI 模型(包括 Gemini 3),助力您评估、调优并部署这些模型,应用于您的 AI 驱动型应用中

- 借助 Model Garden,您可以在 Agent Platform 中发现、测试、自定义制和部署精选开源 (OSS) 模型和相关资产

- 自定义训练让您完全掌控训练流程,包括使用您偏好的机器学习框架、编写专属训练代码,以及选择超参数调优方案

构建和部署 AI 智能体

借助 Agent Platform 解锁高级 AI 功能

借助 Agent Platform 解锁高级 AI 功能

在可根据需求扩缩的平台上构建可用于生产用途的生成式 AI 智能体及应用。我们的 Agent Platform 为 AI 模型及应用的开发和部署提供了一个安全的环境。

对于开发者而言,Agent Platform 依旧是功能强大的高级平台,您可以借助智能体开发套件 (ADK) 等框架,构建、自定义和微调复杂的智能体。

立即开始使用此 Codelab 并构建您的第一个 AI 应用

教程、快速入门和实验

借助 Agent Platform 解锁高级 AI 功能

借助 Agent Platform 解锁高级 AI 功能

在可根据需求扩缩的平台上构建可用于生产用途的生成式 AI 智能体及应用。我们的 Agent Platform 为 AI 模型及应用的开发和部署提供了一个安全的环境。

对于开发者而言,Agent Platform 依旧是功能强大的高级平台,您可以借助智能体开发套件 (ADK) 等框架,构建、自定义和微调复杂的智能体。

立即开始使用此 Codelab 并构建您的第一个 AI 应用

使用 Gemini 模型进行构建

开始使用 Google 的多模态模型

开始使用 Google 的多模态模型

在 Agent Platform 中通过 Gemini API 访问 Gemini 模型

- Python

- JavaScript

- Java

- Go

- Curl

教程、快速入门和实验

开始使用 Google 的多模态模型

开始使用 Google 的多模态模型

代码示例

在 Agent Platform 中通过 Gemini API 访问 Gemini 模型

- Python

- JavaScript

- Java

- Go

- Curl

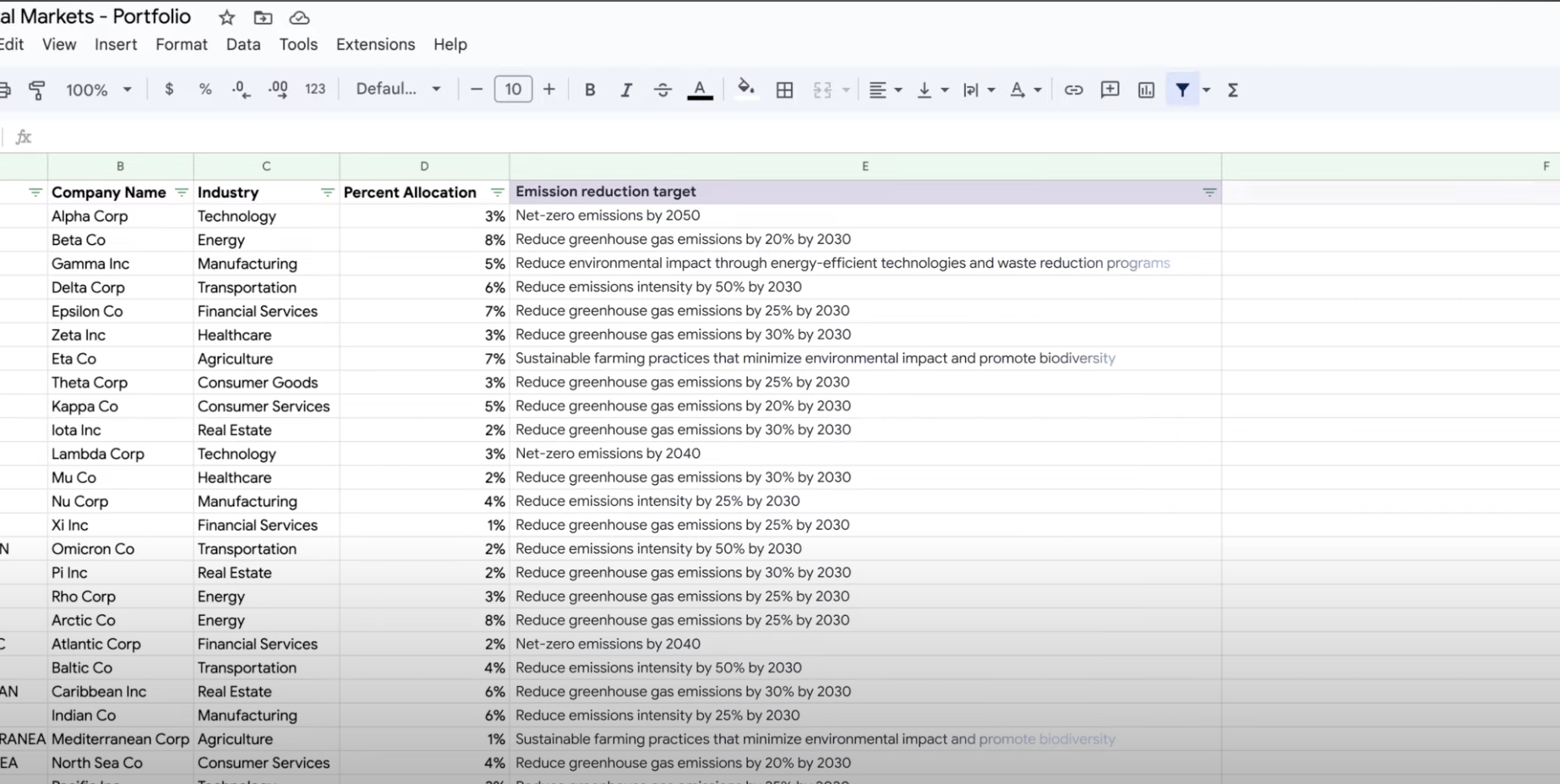

提取、汇总数据,以及对数据进行分类

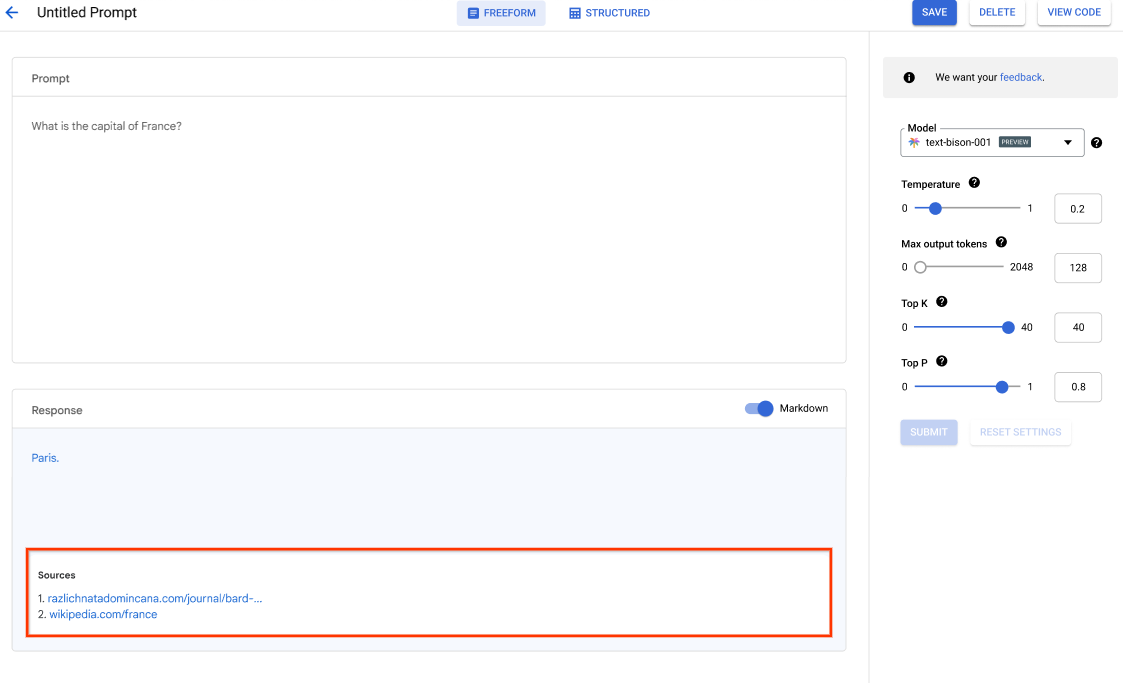

使用生成式 AI 进行总结、分类和信息提取

使用生成式 AI 进行总结、分类和信息提取

了解如何借助 Agent Platform 的生成式 AI 支持,创建可处理各类任务的文本提示。分类、总结、信息提取是其中最常见的应用场景。借助 Gemini on Agent Platform,您可以灵活地设计提示的结构和格式。

教程、快速入门和实验

使用生成式 AI 进行总结、分类和信息提取

使用生成式 AI 进行总结、分类和信息提取

了解如何借助 Agent Platform 的生成式 AI 支持,创建可处理各类任务的文本提示。分类、总结、信息提取是其中最常见的应用场景。借助 Gemini on Agent Platform,您可以灵活地设计提示的结构和格式。

训练自定义模型

自定义模型训练概览和文档

自定义模型训练概览和文档

大致了解 Agent Platform 中的自定义训练工作流、自定义训练的优势,以及各种可用的训练选项。本页面还详细拆解了机器学习训练全流程的每一步操作,从数据准备到模型预测,一目了然。

观看视频演示,了解在 Agent Platform 上训练自定义模型所需的步骤。

教程、快速入门和实验

自定义模型训练概览和文档

自定义模型训练概览和文档

大致了解 Agent Platform 中的自定义训练工作流、自定义训练的优势,以及各种可用的训练选项。本页面还详细拆解了机器学习训练全流程的每一步操作,从数据准备到模型预测,一目了然。

观看视频演示,了解在 Agent Platform 上训练自定义模型所需的步骤。

价格

| Agent Platform 定价方式 | 按所使用的 Agent Platform 工具、存储、计算和 Cloud 资源付费。新客户可获赠 $300 赠金,用于试用 Agent Platform 和 Google Cloud 产品。 | |

|---|---|---|

| 工具和用法 | 说明 | 价格 |

生成式 AI | 用于生成图片的 Imagen 模型 按照图片输入量、字符输入量或自定义训练的对应价格计费。 | 起价 $0.0001 |

文本、对话和代码生成 按每 1,000 个输入字符(提示)和每 1,000 个输出字符(回答)计费。 | 起价 $0.0001 这是每 1,000 个字符的价格 | |

自定义训练模型 | 联系销售团队 | |

Agent Platform 笔记本 | 计算和存储资源 计费标准与 Compute Engine 和 Cloud Storage 相同。 | 参阅产品 |

管理费 除上述资源使用费外,您还需要根据所使用的区域、实例、笔记本和托管式笔记本支付管理费用。查看详情。 | 参阅详细信息 | |

Agent Platform 流水线 | 执行费用和额外费用 按执行收费标准、所用资源及各项额外服务费计费。 | 起价 $0.03 每次流水线运行 |

Agent Platform Vector Search | 服务和构建费用 按照数据规模、您要运行的每秒查询量 (QPS) 和使用的节点数量计费。查看示例。 | 参考示例 |

查看所有 Agent Platform 功能和服务的价格详情。

Agent Platform 定价方式

按所使用的 Agent Platform 工具、存储、计算和 Cloud 资源付费。新客户可获赠 $300 赠金,用于试用 Agent Platform 和 Google Cloud 产品。

文本、对话和代码生成

按每 1,000 个输入字符(提示)和每 1,000 个输出字符(回答)计费。

Starting at

$0.0001

这是每 1,000 个字符的价格

Agent Platform 流水线

执行费用和额外费用

按执行收费标准、所用资源及各项额外服务费计费。

Starting at

$0.03

每次流水线运行

查看所有 Agent Platform 功能和服务的价格详情。

业务用例

充分发掘生成式 AI 的潜力

“Google Cloud 生成式 AI 解决方案的准确率和 Agent Platform 的实用特性,让我们敢于将这项尖端技术落地于业务核心,朝着‘零延迟响应’的长期目标稳步前行。”

GA Telesis 首席执行官 Abdol Moabery