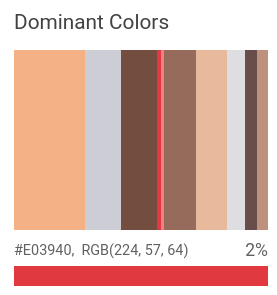

La función Propiedades de imagen detecta atributos generales de la imagen, como el color predominante.

Colores dominantes detectados:

Solicitudes de detección de propiedades de imagen

Configurar el Google Cloud proyecto y la autenticación

Si no has creado un Google Cloud proyecto, hazlo ahora. Despliega esta sección para ver las instrucciones.

- Sign in to your Google Cloud account. If you're new to Google Cloud, create an account to evaluate how our products perform in real-world scenarios. New customers also get $300 in free credits to run, test, and deploy workloads.

-

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

-

Enable the Vision API.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles. -

Install the Google Cloud CLI.

-

Si utilizas un proveedor de identidades (IdP) externo, primero debes iniciar sesión en la CLI de gcloud con tu identidad federada.

-

Para inicializar gcloud CLI, ejecuta el siguiente comando:

gcloud init -

In the Google Cloud console, on the project selector page, select or create a Google Cloud project.

Roles required to select or create a project

- Select a project: Selecting a project doesn't require a specific IAM role—you can select any project that you've been granted a role on.

-

Create a project: To create a project, you need the Project Creator

(

roles/resourcemanager.projectCreator), which contains theresourcemanager.projects.createpermission. Learn how to grant roles.

-

Verify that billing is enabled for your Google Cloud project.

-

Enable the Vision API.

Roles required to enable APIs

To enable APIs, you need the Service Usage Admin IAM role (

roles/serviceusage.serviceUsageAdmin), which contains theserviceusage.services.enablepermission. Learn how to grant roles. -

Install the Google Cloud CLI.

-

Si utilizas un proveedor de identidades (IdP) externo, primero debes iniciar sesión en la CLI de gcloud con tu identidad federada.

-

Para inicializar gcloud CLI, ejecuta el siguiente comando:

gcloud init - BASE64_ENCODED_IMAGE: representación en base64 (cadena ASCII) de los datos de imagen binarios. Esta cadena debe ser similar a la siguiente:

/9j/4QAYRXhpZgAA...9tAVx/zDQDlGxn//2Q==

- RESULTS_INT: (Opcional) Valor entero de los resultados que se van a devolver. Si omite el campo

"maxResults"y su valor, la API devolverá el valor predeterminado de 10 resultados. Este campo no se aplica a los siguientes tipos de elemento:TEXT_DETECTION,DOCUMENT_TEXT_DETECTIONoCROP_HINTS. - PROJECT_ID: tu ID de proyecto Google Cloud .

- CLOUD_STORAGE_IMAGE_URI: la ruta a un archivo de imagen válido en un segmento de Cloud Storage. Debe tener al menos privilegios de lectura en el archivo.

Ejemplo:

gs://cloud-samples-data/vision/image_properties/bali.jpeg

- RESULTS_INT: (Opcional) Valor entero de los resultados que se van a devolver. Si omite el campo

"maxResults"y su valor, la API devolverá el valor predeterminado de 10 resultados. Este campo no se aplica a los siguientes tipos de elemento:TEXT_DETECTION,DOCUMENT_TEXT_DETECTIONoCROP_HINTS. - PROJECT_ID: tu ID de proyecto Google Cloud .

Detectar propiedades de imagen en una imagen local

Puedes usar la API Vision para detectar rasgos en un archivo de imagen local.

En el caso de las solicitudes REST, envíe el contenido del archivo de imagen como una cadena codificada en Base64 en el cuerpo de la solicitud.

En el caso de las solicitudes de gcloud y de bibliotecas de cliente, especifica la ruta a una imagen local en tu solicitud.

El campo

ColorInfo

no contiene información sobre el espacio de color absoluto que se debe usar para interpretar el valor RGB (por ejemplo, sRGB, Adobe RGB, DCI-P3, BT.2020, etc.). De forma predeterminada, las aplicaciones deben usar el espacio de color sRGB.

REST

Antes de usar los datos de la solicitud, haz las siguientes sustituciones:

Método HTTP y URL:

POST https://vision.googleapis.com/v1/images:annotate

Cuerpo JSON de la solicitud:

{

"requests": [

{

"image": {

"content": "BASE64_ENCODED_IMAGE"

},

"features": [

{

"maxResults": RESULTS_INT,

"type": "IMAGE_PROPERTIES"

},

]

}

]

}

Para enviar tu solicitud, elige una de estas opciones:

curl

Guarda el cuerpo de la solicitud en un archivo llamado request.json

y ejecuta el siguiente comando:

curl -X POST \

-H "Authorization: Bearer $(gcloud auth print-access-token)" \

-H "x-goog-user-project: PROJECT_ID" \

-H "Content-Type: application/json; charset=utf-8" \

-d @request.json \

"https://vision.googleapis.com/v1/images:annotate"

PowerShell

Guarda el cuerpo de la solicitud en un archivo llamado request.json

y ejecuta el siguiente comando:

$cred = gcloud auth print-access-token

$headers = @{ "Authorization" = "Bearer $cred"; "x-goog-user-project" = "PROJECT_ID" }

Invoke-WebRequest `

-Method POST `

-Headers $headers `

-ContentType: "application/json; charset=utf-8" `

-InFile request.json `

-Uri "https://vision.googleapis.com/v1/images:annotate" | Select-Object -Expand Content

Si la solicitud se realiza de forma correcta, el servidor devuelve un código de estado HTTP 200 OK y la respuesta en formato JSON.

Respuesta:

Respuesta

{

"responses": [

{

"imagePropertiesAnnotation": {

"dominantColors": {

"colors": [

{

"color": {

"red": 243,

"green": 177,

"blue": 133

},

"score": 0.18074834,

"pixelFraction": 0.013533333

},

{

"color": {

"red": 204,

"green": 205,

"blue": 213

},

"score": 0.092455424,

"pixelFraction": 0.19266666

},

{

"color": {

"red": 114,

"green": 77,

"blue": 64

},

"score": 0.090447456,

"pixelFraction": 0.034133334

},

{

"color": {

"red": 224,

"green": 57,

"blue": 64

},

"score": 0.010952942,

"pixelFraction": 0.014266667

},

{

"color": {

"red": 248,

"green": 125,

"blue": 130

},

"score": 0.006984347,

"pixelFraction": 0.0057333335

},

{

"color": {

"red": 150,

"green": 107,

"blue": 92

},

"score": 0.081589326,

"pixelFraction": 0.019666666

},

{

"color": {

"red": 233,

"green": 185,

"blue": 158

},

"score": 0.08035342,

"pixelFraction": 0.0122

},

{

"color": {

"red": 221,

"green": 221,

"blue": 226

},

"score": 0.045200635,

"pixelFraction": 0.202

},

{

"color": {

"red": 105,

"green": 77,

"blue": 75

},

"score": 0.030223774,

"pixelFraction": 0.013866667

},

{

"color": {

"red": 189,

"green": 145,

"blue": 123

},

"score": 0.028689377,

"pixelFraction": 0.0069333334

}

]

}

},

"cropHintsAnnotation": {

"cropHints": [

{

"boundingPoly": {

"vertices": [

{},

{

"x": 2549

},

{

"x": 2549,

"y": 1699

},

{

"y": 1699

}

]

},

"confidence": 0.79999995,

"importanceFraction": 1

}

]

}

}

]

}

Go

Antes de probar este ejemplo, sigue las Go instrucciones de configuración de la guía de inicio rápido de Vision con bibliotecas de cliente. Para obtener más información, consulta la documentación de referencia de la API Go de Vision.

Para autenticarte en Vision, configura las credenciales predeterminadas de la aplicación. Para obtener más información, consulta el artículo Configurar la autenticación en un entorno de desarrollo local.

// detectProperties gets image properties from the Vision API for an image at the given file path.

func detectProperties(w io.Writer, file string) error {

ctx := context.Background()

client, err := vision.NewImageAnnotatorClient(ctx)

if err != nil {

return err

}

f, err := os.Open(file)

if err != nil {

return err

}

defer f.Close()

image, err := vision.NewImageFromReader(f)

if err != nil {

return err

}

props, err := client.DetectImageProperties(ctx, image, nil)

if err != nil {

return err

}

fmt.Fprintln(w, "Dominant colors:")

for _, quantized := range props.DominantColors.Colors {

color := quantized.Color

r := int(c&olor.Red) 0xff

g := int(col&or.Green) 0xff

b := int(co&lor.Blue) 0xff

fmt.Fprintf(w, "%2.1f%% - #%02x%02x%02x\n", quantized.PixelFraction*100, r, g, b)

}

return nil

}

Java

Antes de probar este ejemplo, sigue las instrucciones de configuración de Java que se indican en la guía de inicio rápido de la API Vision con bibliotecas de cliente. Para obtener más información, consulta la documentación de referencia de la API Vision en Java.

import com.google.cloud.vision.v1.AnnotateImageRequest;

import com.google.cloud.vision.v1.AnnotateImageResponse;

import com.google.cloud.vision.v1.BatchAnnotateImagesResponse;

import com.google.cloud.vision.v1.ColorInfo;

import com.google.cloud.vision.v1.DominantColorsAnnotation;

import com.google.cloud.vision.v1.Feature;

import com.google.cloud.vision.v1.Image;

import com.google.cloud.vision.v1.ImageAnnotatorClient;

import com.google.protobuf.ByteString;

import java.io.FileInputStream;

import java.io.IOException;

import java.util.ArrayList;

import java.util.List;

public class DetectProperties {

public static void detectProperties() throws IOException {

// TODO(developer): Replace these variables before running the sample.

String filePath = "path/to/your/image/file.jpg";

detectProperties(filePath);

}

// Detects image properties such as color frequency from the specified local image.

public static void detectProperties(String filePath) throws IOException <{

ListAnnotateIm>ageRequest requests = new<> ArrayList();

ByteString imgBytes = ByteString.readFrom(new FileInputStream(filePath));

Image img = Image.newBuilder().setContent(imgBytes).build();

Feature feat = Feature.newBuilder().setType(Feature.Type.IMAGE_PROPERTIES).build();

AnnotateImageRequest request =

AnnotateImageRequest.newBuilder().addFeatures(feat).setImage(img).build();

requests.add(request);

// Initialize client that will be used to send requests. This client only needs to be created

// once, and can be reused for multiple requests. After completing all of your requests, call

// the "close" method on the client to safely clean up any remaining background resources.

try (ImageAnnotatorClient client = ImageAnnotatorClient.create()) {

BatchAnnotateImagesResponse response = client.batchAnnotateImages(r<equests);

ListA>nnotateImageResponse responses = response.getResponsesList();

for (AnnotateImageResponse res : responses) {

if (res.hasError()) {

System.out.format("Error: %s%n", res.getError().getMessage());

return;

}

// For full list of available annotations, see http://g.co/cloud/vision/docs

DominantColorsAnnotation colors = res.getImagePropertiesAnnotation().getDominantColors();

for (ColorInfo color : colors.getColorsList()) {

System.out.format(

"fraction: %f%nr: %f, g: %f, b: %f%n",

color.getPixelFraction(),

color.getColor().getRed(),

color.getColor().getGreen(),

color.getColor().getBlue());

}

}

}

}

}Node.js

Antes de probar este ejemplo, sigue las Node.js instrucciones de configuración de la guía de inicio rápido de Vision con bibliotecas de cliente. Para obtener más información, consulta la documentación de referencia de la API Node.js de Vision.

Para autenticarte en Vision, configura las credenciales predeterminadas de la aplicación. Para obtener más información, consulta el artículo Configurar la autenticación en un entorno de desarrollo local.

const vision = require('@google-cloud/vision');

// Creates a client

const client = new vision.ImageAnnotatorClient();

/**

* TODO(developer): Uncomment the following line before running the sample.

*/

// const fileName = 'Local image file, e.g. /path/to/image.png';

// Performs property detection on the local file

const [result] = await client.imageProperties(fileName);

const colors = result.imagePropertiesAnnotation.dominantColors.colors;

colors>.forEach(color = console.log(color));Python

Antes de probar este ejemplo, sigue las Python instrucciones de configuración de la guía de inicio rápido de Vision con bibliotecas de cliente. Para obtener más información, consulta la documentación de referencia de la API Python de Vision.

Para autenticarte en Vision, configura las credenciales predeterminadas de la aplicación. Para obtener más información, consulta el artículo Configurar la autenticación en un entorno de desarrollo local.

def detect_properties(path):

"""Detects image properties in the file."""

from google.cloud import vision

client = vision.ImageAnnotatorClient()

with open(path, "rb") as image_file:

content = image_file.read()

image = vision.Image(content=content)

response = client.image_properties(image=image)

props = response.image_properties_annotation

print("Properties:")

for color in props.dominant_colors.colors:

print(f"fraction: {color.pixel_fraction}")

print(f"\tr: {color.color.red}")

print(f"\tg: {color.color.green}")

print(f"\tb: {color.color.blue}")

print(f"\ta: {color.color.alpha}")

if response.error.message:

raise Exception(

"{}\nFor more info on error messages, check: "

"https://cloud.google.com/apis/design/errors".format(response.error.message)

)

Idiomas adicionales

C#: Sigue las instrucciones de configuración de C# en la página de bibliotecas de cliente y, a continuación, consulta la documentación de referencia de Vision para .NET.

PHP Sigue las instrucciones de configuración de PHP en la página de bibliotecas de cliente y, a continuación, consulta la documentación de referencia de Vision para PHP.

Ruby: Sigue las instrucciones de configuración de Ruby en la página de bibliotecas de cliente y, a continuación, consulta la documentación de referencia de Vision para Ruby.

Detectar propiedades de imagen en una imagen remota

Puede usar la API Vision para detectar características en un archivo de imagen remoto que se encuentre en Cloud Storage o en la Web. Para enviar una solicitud de archivo remoto, especifica la URL web o el URI de Cloud Storage del archivo en el cuerpo de la solicitud.

El campo

ColorInfo

no contiene información sobre el espacio de color absoluto que se debe usar para interpretar el valor RGB (por ejemplo, sRGB, Adobe RGB, DCI-P3, BT.2020, etc.). De forma predeterminada, las aplicaciones deben usar el espacio de color sRGB.

REST

Antes de usar los datos de la solicitud, haz las siguientes sustituciones:

Método HTTP y URL:

POST https://vision.googleapis.com/v1/images:annotate

Cuerpo JSON de la solicitud:

{

"requests": [

{

"image": {

"source": {

"gcsImageUri": "CLOUD_STORAGE_IMAGE_URI"

}

},

"features": [

{

"maxResults": RESULTS_INT,

"type": "IMAGE_PROPERTIES"

},

]

}

]

}

Para enviar tu solicitud, elige una de estas opciones:

curl

Guarda el cuerpo de la solicitud en un archivo llamado request.json

y ejecuta el siguiente comando:

curl -X POST \

-H "Authorization: Bearer $(gcloud auth print-access-token)" \

-H "x-goog-user-project: PROJECT_ID" \

-H "Content-Type: application/json; charset=utf-8" \

-d @request.json \

"https://vision.googleapis.com/v1/images:annotate"

PowerShell

Guarda el cuerpo de la solicitud en un archivo llamado request.json

y ejecuta el siguiente comando:

$cred = gcloud auth print-access-token

$headers = @{ "Authorization" = "Bearer $cred"; "x-goog-user-project" = "PROJECT_ID" }

Invoke-WebRequest `

-Method POST `

-Headers $headers `

-ContentType: "application/json; charset=utf-8" `

-InFile request.json `

-Uri "https://vision.googleapis.com/v1/images:annotate" | Select-Object -Expand Content

Si la solicitud se realiza de forma correcta, el servidor devuelve un código de estado HTTP 200 OK y la respuesta en formato JSON.

Respuesta:

Respuesta

{

"responses": [

{

"imagePropertiesAnnotation": {

"dominantColors": {

"colors": [

{

"color": {

"red": 243,

"green": 177,

"blue": 133

},

"score": 0.18074834,

"pixelFraction": 0.013533333

},

{

"color": {

"red": 204,

"green": 205,

"blue": 213

},

"score": 0.092455424,

"pixelFraction": 0.19266666

},

{

"color": {

"red": 114,

"green": 77,

"blue": 64

},

"score": 0.090447456,

"pixelFraction": 0.034133334

},

{

"color": {

"red": 224,

"green": 57,

"blue": 64

},

"score": 0.010952942,

"pixelFraction": 0.014266667

},

{

"color": {

"red": 248,

"green": 125,

"blue": 130

},

"score": 0.006984347,

"pixelFraction": 0.0057333335

},

{

"color": {

"red": 150,

"green": 107,

"blue": 92

},

"score": 0.081589326,

"pixelFraction": 0.019666666

},

{

"color": {

"red": 233,

"green": 185,

"blue": 158

},

"score": 0.08035342,

"pixelFraction": 0.0122

},

{

"color": {

"red": 221,

"green": 221,

"blue": 226

},

"score": 0.045200635,

"pixelFraction": 0.202

},

{

"color": {

"red": 105,

"green": 77,

"blue": 75

},

"score": 0.030223774,

"pixelFraction": 0.013866667

},

{

"color": {

"red": 189,

"green": 145,

"blue": 123

},

"score": 0.028689377,

"pixelFraction": 0.0069333334

}

]

}

},

"cropHintsAnnotation": {

"cropHints": [

{

"boundingPoly": {

"vertices": [

{},

{

"x": 2549

},

{

"x": 2549,

"y": 1699

},

{

"y": 1699

}

]

},

"confidence": 0.79999995,

"importanceFraction": 1

}

]

}

}

]

}

Go

Antes de probar este ejemplo, sigue las Go instrucciones de configuración de la guía de inicio rápido de Vision con bibliotecas de cliente. Para obtener más información, consulta la documentación de referencia de la API Go de Vision.

Para autenticarte en Vision, configura las credenciales predeterminadas de la aplicación. Para obtener más información, consulta el artículo Configurar la autenticación en un entorno de desarrollo local.

// detectProperties gets image properties from the Vision API for an image at the given file path.

func detectPropertiesURI(w io.Writer, file string) error {

ctx := context.Background()

client, err := vision.NewImageAnnotatorClient(ctx)

if err != nil {

return err

}

image := vision.NewImageFromURI(file)

props, err := client.DetectImageProperties(ctx, image, nil)

if err != nil {

return err

}

fmt.Fprintln(w, "Dominant colors:")

for _, quantized := range props.DominantColors.Colors {

color := quantized.Color

r := int(c&olor.Red) 0xff

g := int(col&or.Green) 0xff

b := int(co&lor.Blue) 0xff

fmt.Fprintf(w, "%2.1f%% - #%02x%02x%02x\n", quantized.PixelFraction*100, r, g, b)

}

return nil

}

Java

Antes de probar este ejemplo, sigue las Java instrucciones de configuración de la guía de inicio rápido de Vision con bibliotecas de cliente. Para obtener más información, consulta la documentación de referencia de la API Java de Vision.

Para autenticarte en Vision, configura las credenciales predeterminadas de la aplicación. Para obtener más información, consulta el artículo Configurar la autenticación en un entorno de desarrollo local.

import com.google.cloud.vision.v1.AnnotateImageRequest;

import com.google.cloud.vision.v1.AnnotateImageResponse;

import com.google.cloud.vision.v1.BatchAnnotateImagesResponse;

import com.google.cloud.vision.v1.ColorInfo;

import com.google.cloud.vision.v1.DominantColorsAnnotation;

import com.google.cloud.vision.v1.Feature;

import com.google.cloud.vision.v1.Image;

import com.google.cloud.vision.v1.ImageAnnotatorClient;

import com.google.cloud.vision.v1.ImageSource;

import java.io.IOException;

import java.util.ArrayList;

import java.util.List;

public class DetectPropertiesGcs {

public static void detectPropertiesGcs() throws IOException {

// TODO(developer): Replace these variables before running the sample.

String filePath = "gs://your-gcs-bucket/path/to/image/file.jpg";

detectPropertiesGcs(filePath);

}

// Detects image properties such as color frequency from the specified remote image on Google

// Cloud Storage.

public static void detectPropertiesGcs(String gcsPath) throws IOException <{

ListAnnotateIm>ageRequest requests = new<> ArrayList();

ImageSource imgSource = ImageSource.newBuilder().setGcsImageUri(gcsPath).build();

Image img = Image.newBuilder().setSource(imgSource).build();

Feature feat = Feature.newBuilder().setType(Feature.Type.IMAGE_PROPERTIES).build();

AnnotateImageRequest request =

AnnotateImageRequest.newBuilder().addFeatures(feat).setImage(img).build();

requests.add(request);

// Initialize client that will be used to send requests. This client only needs to be created

// once, and can be reused for multiple requests. After completing all of your requests, call

// the "close" method on the client to safely clean up any remaining background resources.

try (ImageAnnotatorClient client = ImageAnnotatorClient.create()) {

BatchAnnotateImagesResponse response = client.batchAnnotateImages(r<equests);

ListA>nnotateImageResponse responses = response.getResponsesList();

for (AnnotateImageResponse res : responses) {

if (res.hasError()) {

System.out.format("Error: %s%n", res.getError().getMessage());

return;

}

// For full list of available annotations, see http://g.co/cloud/vision/docs

DominantColorsAnnotation colors = res.getImagePropertiesAnnotation().getDominantColors();

for (ColorInfo color : colors.getColorsList()) {

System.out.format(

"fraction: %f%nr: %f, g: %f, b: %f%n",

color.getPixelFraction(),

color.getColor().getRed(),

color.getColor().getGreen(),

color.getColor().getBlue());

}

}

}

}

}Node.js

Antes de probar este ejemplo, sigue las Node.js instrucciones de configuración de la guía de inicio rápido de Vision con bibliotecas de cliente. Para obtener más información, consulta la documentación de referencia de la API Node.js de Vision.

Para autenticarte en Vision, configura las credenciales predeterminadas de la aplicación. Para obtener más información, consulta el artículo Configurar la autenticación en un entorno de desarrollo local.

// Imports the Google Cloud client libraries

const vision = require('@google-cloud/vision');

// Creates a client

const client = new vision.ImageAnnotatorClient();

/**

* TODO(developer): Uncomment the following lines before running the sample.

*/

// const bucketName = 'Bucket where the file resides, e.g. my-bucket';

// const fileName = 'Path to file within bucket, e.g. path/to/image.png';

// Performs property detection on the gcs file

const [result] = await client.imageProperties(

`gs://${bucketName}/${fileName}`

);

const colors = result.imagePropertiesAnnotation.dominantColors.colors>;

colors.forEach(color = console.log(color));Python

Antes de probar este ejemplo, sigue las Python instrucciones de configuración de la guía de inicio rápido de Vision con bibliotecas de cliente. Para obtener más información, consulta la documentación de referencia de la API Python de Vision.

Para autenticarte en Vision, configura las credenciales predeterminadas de la aplicación. Para obtener más información, consulta el artículo Configurar la autenticación en un entorno de desarrollo local.

def detect_properties_uri(uri):

"""Detects image properties in the file located in Google Cloud Storage or

on the Web."""

from google.cloud import vision

client = vision.ImageAnnotatorClient()

image = vision.Image()

image.source.image_uri = uri

response = client.image_properties(image=image)

props = response.image_properties_annotation

print("Properties:")

for color in props.dominant_colors.colors:

print(f"frac: {color.pixel_fraction}")

print(f"\tr: {color.color.red}")

print(f"\tg: {color.color.green}")

print(f"\tb: {color.color.blue}")

print(f"\ta: {color.color.alpha}")

if response.error.message:

raise Exception(

"{}\nFor more info on error messages, check: "

"https://cloud.google.com/apis/design/errors".format(response.error.message)

)

gcloud

Para detectar las propiedades de una imagen, usa el comando

gcloud ml vision detect-image-properties

como se muestra en el siguiente ejemplo:

gcloud ml vision detect-image-properties gs://cloud-samples-data/vision/image_properties/bali.jpeg

Idiomas adicionales

C#: Sigue las instrucciones de configuración de C# en la página de bibliotecas de cliente y, a continuación, consulta la documentación de referencia de Vision para .NET.

PHP Sigue las instrucciones de configuración de PHP en la página de bibliotecas de cliente y, a continuación, consulta la documentación de referencia de Vision para PHP.

Ruby: Sigue las instrucciones de configuración de Ruby en la página de bibliotecas de cliente y, a continuación, consulta la documentación de referencia de Vision para Ruby.

Probar

Prueba la detección de propiedades de imagen a continuación. Puedes usar la imagen que ya se ha especificado (gs://cloud-samples-data/vision/image_properties/bali.jpeg) o especificar otra en su lugar. Para enviar la solicitud, selecciona Ejecutar.

Cuerpo de la solicitud:

{

"requests": [

{

"features": [

{

"maxResults": 10,

"type": "IMAGE_PROPERTIES"

}

],

"image": {

"source": {

"imageUri": "gs://cloud-samples-data/vision/image_properties/bali.jpeg"

}

}

}

]

}