Vertex AI Agent Engine Memory Bank te permite generar dinámicamente recuerdos a largo plazo basados en las conversaciones de los usuarios con tu agente. Los recuerdos a largo plazo son información personalizada a la que puede acceder un usuario concreto en varias sesiones. El agente puede usar los datos memorizados para personalizar las respuestas al usuario y crear una continuidad entre sesiones.

Estas son algunas de las funciones de Memory Bank:

Almacenamiento persistente de recuerdos a los que se puede acceder desde varios entornos. Puedes usar las sesiones y el banco de memoria de Vertex AI Agent Engine con tu agente desplegado en el tiempo de ejecución de Vertex AI Agent Engine, desde tu entorno local o con otras opciones de despliegue.

Extracción de recuerdos basada en modelos de lenguaje extensos (LLMs) del historial de conversaciones.

Los recuerdos se generan de forma remota y asíncrona, por lo que el agente no tiene que esperar a que se generen.

Recuperación de recuerdos basada en búsquedas de similitud acotadas a una identidad (

scope).Si usas Vertex AI Agent Engine Memory Bank con Agent Development Kit, tu agente puede orquestar llamadas para leer y escribir recuerdos a largo plazo con Memory Bank.

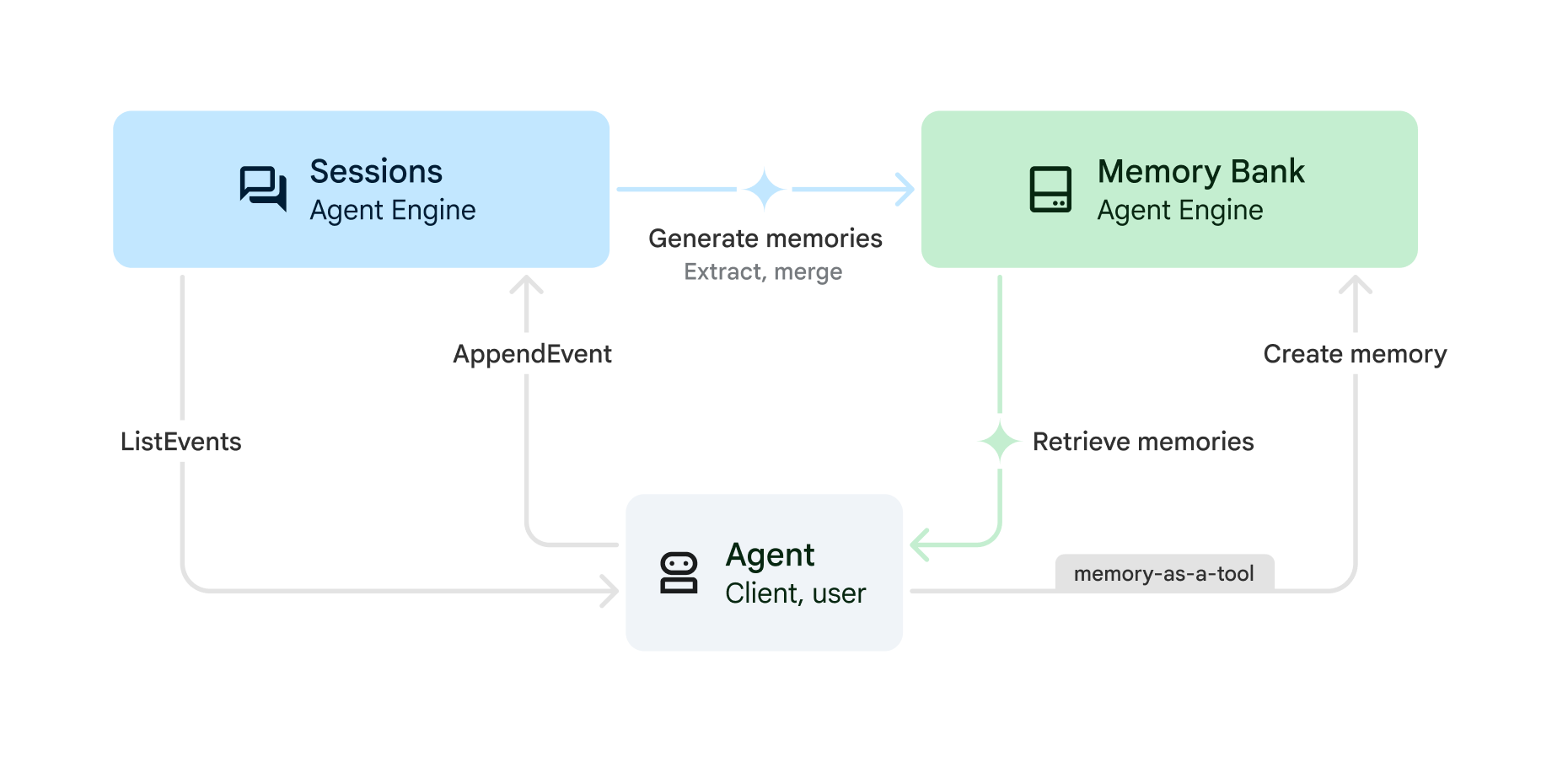

Puedes usar Memory Bank con las sesiones de Vertex AI Agent Engine para generar recuerdos a partir de sesiones almacenadas siguiendo este proceso:

(Sesiones)

CreateSession: al inicio de cada conversación, crea una sesión nueva. El historial de conversaciones que usa el agente se limita a esta sesión. Una sesión contiene la secuencia cronológica de mensajes y acciones (SessionEvents) de una interacción entre un usuario y tu agente. Todas las sesiones deben tener un ID de usuario. Las memorias extraídas (consulteGenerateMemories) de esta sesión se asignan a este usuario.(Sesiones)

AppendEvent: a medida que el usuario interactúa con el agente, los eventos (como los mensajes del usuario, las respuestas del agente y las acciones de herramientas) se suben a Sesiones. Los eventos conservan el historial de conversaciones y crean un registro de la conversación que se puede usar para generar recuerdos.(Sesiones)

ListEvents: a medida que el usuario interactúa con el agente, este recupera el historial de la conversación.(Banco de recuerdos) Generar o crear recuerdos:

GenerateMemories: en un intervalo especificado (por ejemplo, al final de cada sesión o de cada turno), el agente puede activar la generación de recuerdos mediante el historial de conversaciones. Los datos sobre el usuario se extraen automáticamente del historial de conversaciones para que estén disponibles en sesiones actuales o futuras.CreateMemory: tu agente puede escribir recuerdos directamente en el banco de memoria. Por ejemplo, el agente puede decidir cuándo se debe escribir un recuerdo y qué información se debe guardar (la memoria como herramienta). UsaCreateMemorycuando quieras que tu agente tenga más control sobre los datos que se extraen.

(Banco de memoria)

RetrieveMemories: a medida que el usuario interactúa con tu agente, este puede recuperar recuerdos guardados sobre ese usuario. Puedes recuperar todos los recuerdos (recuperación simple) o solo los más relevantes para la conversación actual (recuperación por búsqueda de similitud). Después, puedes insertar los recuerdos recuperados en tu petición.

Guías de inicio rápido

Empieza a usar Memory Bank con las siguientes guías de inicio rápido:

Guía de inicio rápido con la API REST: sigue la guía de inicio rápido de la API REST para hacer llamadas a la API directamente a las sesiones y al banco de memoria de Vertex AI Agent Engine.

Guía de inicio rápido con Agent Development Kit (ADK): sigue la guía de inicio rápido de Agent Development Kit (ADK) si quieres que tu agente de ADK coordine las llamadas a las sesiones y al banco de memoria de Vertex AI Agent Engine.

Riesgos de seguridad de la inyección de peticiones

Además de las responsabilidades de seguridad que se describen en el artículo sobre la responsabilidad compartida de Vertex AI, ten en cuenta el riesgo de inyección de peticiones y de contaminación de la memoria que puede afectar a tu agente al usar memorias a largo plazo. La contaminación de la memoria se produce cuando se almacena información falsa en Memory Bank. El agente puede operar con esta información falsa o maliciosa en sesiones futuras.

Para mitigar el riesgo de envenenamiento de memoria, puedes hacer lo siguiente:

Model Armor: usa Model Armor para inspeccionar las peticiones que se envían a Memory Bank o desde tu agente.

Pruebas adversarias: prueba de forma proactiva tu aplicación LLM para detectar vulnerabilidades de inyección de peticiones simulando ataques. Esta práctica se conoce como "red teaming".

Ejecución en un entorno aislado: si el agente puede ejecutar o interactuar con sistemas externos o críticos, estas acciones deben realizarse en un entorno aislado con un control de acceso estricto y una revisión humana.

Para obtener más información, consulta el enfoque de Google para crear agentes de IA seguros.

Siguientes pasos

- Configura el banco de memoria.

- Guía de inicio rápido de Agent Development Kit

- Guía de inicio rápido del SDK de Vertex AI Agent Engine