Auf dieser Seite wird beschrieben, wie Sie einem Ausgabevideo Untertitel hinzufügen.

Untertitel stellen die Audioinhalte eines Videos visuell dar. Untertitel sind in der Regel in derselben Sprache wie der Audioinhalt und enthalten Hintergrundgeräusche und Sprecherwechsel.

Untertitel werden in der Regel verwendet, um die Dialoge eines Videos in eine andere Sprache zu übersetzen. Untertitel enthalten in der Regel keine Hintergrundgeräusche und Sprecherwechsel.

Auf dieser Seite wird der Begriff Eingabe-Untertiteldatei für eine Textdatei verwendet, die Untertitel enthält. Sie stellen diese Datei als Eingabe für einen Job bereit.

Untertitel und Untertitel zu einer Jobkonfiguration hinzufügen

Informationen zu den unterstützten Eingabe- und Ausgabecaption-Dateiformaten finden Sie unter Unterstützte Ein- und Ausgaben. Eine Beispielvideodatei und Beispiel-Untertiteldateien sind verfügbar, damit Sie Ihre Konfiguration testen können.

In den folgenden Abschnitten erfahren Sie, wie Sie einer Jobkonfiguration Untertitel hinzufügen. Auf dieser Seite wird davon ausgegangen, dass Sie mit einer einfachen JobConfig vertraut sind. Weitere Informationen zum Erstellen von Transcodierungsjobs finden Sie unter Jobs erstellen und verwalten.

Untertitel hinzufügen

So erstellen Sie einen Job, bei dem Untertitel in den Container der Ausgabevideodatei eingebettet werden:

Fügen Sie am Anfang der Jobkonfiguration ein

inputs-Array hinzu.Fügen Sie dem Array

inputseinInput-Objekt hinzu, das den Schlüssel und den URI für das zugehörige Eingabevideo definiert.Fügen Sie ein weiteres

Input-Objekt hinzu, das den Pfad zur Eingabe-Untertiteldatei enthält.Fügen Sie der Jobkonfiguration ein

editList-Array hinzu. Mit diesem Array werden der Ausgabe-Videotimeline Eingaben hinzugefügt.Fügen Sie dem Array

editListeinEditAtom-Objekt hinzu. DiesesEditAtom-Objekt muss auf die Schlüssel für das Eingabevideo und die Untertitel verweisen, die Sie iminputs-Array hinzugefügt haben. Sie können einenstartTimeOffsetundendTimeOffsetangeben, um das Eingabevideo zu kürzen.Fügen Sie den Ausgabecontainern Untertitel hinzu, indem Sie dem Array

elementaryStreamsdas ObjekttextStreamhinzufügen. Es wird nur ein eingebetteter Textstream unterstützt, der allen Ausgabevideos hinzugefügt wird, da es nur eine Ausgabetimeline gibt.Verwenden Sie das Array

mappingim KonfigurationsobjekttextStream, um auf den Schlüssel des ObjektsEditAtomzu verweisen.

Bei der folgenden Beispielkonfiguration werden CEA-608-Untertitel in ein Video eingebettet.

Sie können diese Konfiguration einer Jobvorlage hinzufügen oder sie in eine Ad-hoc-Jobkonfiguration einbinden:

REST

Ersetzen Sie diese Werte in den folgenden Anfragedaten:

PROJECT_ID: Ihre Google Cloud -Projekt-ID, die unter IAM-Einstellungen aufgeführt ist.LOCATION: Der Standort, an dem der Job ausgeführt werden soll. Verwenden Sie eine der unterstützten Regionen.Standorte anzeigenus-central1us-west1us-west2us-east1us-east4southamerica-east1northamerica-northeast1asia-east1asia-northeast1asia-northeast3asia-south1asia-southeast1australia-southeast1europe-west1europe-west2europe-west4me-west1me-central1me-central2

STORAGE_BUCKET_NAME: Der Name des Cloud Storage-Buckets, den Sie erstellt haben.STORAGE_INPUT_VIDEO: Der Name des Videos in Ihrem Cloud Storage-Bucket, den Sie transcodieren, z. B.my-vid.mp4. In diesem Feld sollten alle Ordner berücksichtigt werden, die Sie im Bucket erstellt haben (z. B.input/my-vid.mp4).STORAGE_CAPTIONS_FILE: Der Name einer Untertiteldatei in Ihrem Cloud Storage-Bucket, z. B.captions.srt. In diesem Feld sollten alle Ordner berücksichtigt werden, die Sie im Bucket erstellt haben (z. B.input/captions.srt).STORAGE_OUTPUT_FOLDER: Der Name des Ausgabefolders in Ihrem Cloud Storage-Bucket, in dem die codierten Videoausgaben gespeichert werden sollen.

Wenn Sie die Anfrage senden möchten, maximieren Sie eine der folgenden Optionen:

Sie sollten eine JSON-Antwort ähnlich wie diese erhalten:

{

"name": "projects/PROJECT_NUMBER/locations/LOCATION/jobs/JOB_ID",

"config": {

...

},

"state": "PENDING",

"createTime": CREATE_TIME,

"ttlAfterCompletionDays": 30

}

gcloud

Ersetzen Sie folgende Werte, bevor sie einen der Befehlsdaten verwenden:

LOCATION: Der Standort, an dem der Job ausgeführt werden soll. Verwenden Sie eine der unterstützten Regionen.Standorte anzeigenus-central1us-west1us-west2us-east1us-east4southamerica-east1northamerica-northeast1asia-east1asia-northeast1asia-northeast3asia-south1asia-southeast1australia-southeast1europe-west1europe-west2europe-west4me-west1me-central1me-central2

STORAGE_BUCKET_NAME: Der Name des Cloud Storage-Buckets, den Sie erstellt haben.STORAGE_INPUT_VIDEO: Der Name des Videos in Ihrem Cloud Storage-Bucket, den Sie transcodieren, z. B.my-vid.mp4. In diesem Feld sollten alle Ordner berücksichtigt werden, die Sie im Bucket erstellt haben (z. B.input/my-vid.mp4).STORAGE_CAPTIONS_FILE: Der Name einer Untertiteldatei in Ihrem Cloud Storage-Bucket, z. B.captions.srt. In diesem Feld sollten alle Ordner berücksichtigt werden, die Sie im Bucket erstellt haben (z. B.input/captions.srt).STORAGE_OUTPUT_FOLDER: Der Name des Ausgabefolders in Ihrem Cloud Storage-Bucket, in dem die codierten Videoausgaben gespeichert werden sollen.

Speichern Sie den folgenden Inhalt in einer Datei mit dem Namen request.json:

{ "config": { "inputs": [ { "key": "input0", "uri": "gs://STORAGE_BUCKET_NAME/STORAGE_INPUT_VIDEO" }, { "key": "caption_input0", "uri": "gs://STORAGE_BUCKET_NAME/STORAGE_CAPTIONS_FILE" } ], "editList": [ { "key": "atom0", "inputs": [ "input0", "caption_input0" ] } ], "elementaryStreams": [ { "key": "video-stream0", "videoStream": { "h264": { "heightPixels": 360, "widthPixels": 640, "bitrateBps": 550000, "frameRate": 60 } } }, { "key": "audio-stream0", "audioStream": { "codec": "aac", "bitrateBps": 64000 } }, { "key": "cea-stream0", "textStream": { "codec": "cea608", "mapping": [ { "atomKey": "atom0", "inputKey": "caption_input0", "inputTrack": 0 } ], "languageCode": "en-US", "displayName": "English" } } ], "muxStreams": [ { "key": "sd-hls", "container": "ts", "elementaryStreams": [ "video-stream0", "audio-stream0" ] }, { "key": "sd-dash", "container": "fmp4", "elementaryStreams": [ "video-stream0" ] }, { "key": "audio-dash", "container": "fmp4", "elementaryStreams": [ "audio-stream0" ] } ], "manifests": [ { "fileName": "manifest.m3u8", "type": "HLS", "muxStreams": [ "sd-hls" ] }, { "fileName": "manifest.mpd", "type": "DASH", "muxStreams": [ "sd-dash", "audio-dash" ] } ], "output": { "uri": "gs://STORAGE_BUCKET_NAME/STORAGE_OUTPUT_FOLDER/" } } }

Führen Sie folgenden Befehl aus:

Linux, macOS oder Cloud Shell

gcloud transcoder jobs create --location=LOCATION --file=request.json

Windows (PowerShell)

gcloud transcoder jobs create --location=LOCATION --file=request.json

Windows (cmd.exe)

gcloud transcoder jobs create --location=LOCATION --file=request.json

Sie sollten eine Antwort ähnlich der folgenden erhalten:

{

"name": "projects/PROJECT_NUMBER/locations/LOCATION/jobs/JOB_ID",

"config": {

...

},

"state": "PENDING",

"createTime": CREATE_TIME,

"ttlAfterCompletionDays": 30

}

Go

Folgen Sie der Einrichtungsanleitung für Go in der Transcoder API-Kurzanleitung: Clientbibliotheken verwenden, bevor Sie dieses Beispiel anwenden. Weitere Informationen finden Sie in der Referenzdokumentation zur Transcoder API für Go.

Richten Sie die Standardanmeldedaten für Anwendungen ein, um sich bei der Transcoder API zu authentifizieren. Weitere Informationen finden Sie unter Authentifizierung für eine lokale Entwicklungsumgebung einrichten.

Java

Folgen Sie der Einrichtungsanleitung für Java in der Transcoder API-Kurzanleitung: Clientbibliotheken verwenden, bevor Sie dieses Beispiel anwenden. Weitere Informationen finden Sie in der Referenzdokumentation zur Transcoder API für Java.

Richten Sie die Standardanmeldedaten für Anwendungen ein, um sich bei der Transcoder API zu authentifizieren. Weitere Informationen finden Sie unter Authentifizierung für eine lokale Entwicklungsumgebung einrichten.

Node.js

Folgen Sie der Einrichtungsanleitung für Node.js in der Transcoder API-Kurzanleitung: Clientbibliotheken verwenden, bevor Sie dieses Beispiel anwenden. Weitere Informationen finden Sie in der Referenzdokumentation zur Transcoder API für Node.js.

Richten Sie die Standardanmeldedaten für Anwendungen ein, um sich bei der Transcoder API zu authentifizieren. Weitere Informationen finden Sie unter Authentifizierung für eine lokale Entwicklungsumgebung einrichten.

Python

Folgen Sie der Einrichtungsanleitung für Python in der Transcoder API-Kurzanleitung: Clientbibliotheken verwenden, bevor Sie dieses Beispiel anwenden. Weitere Informationen finden Sie in der Referenzdokumentation zur Transcoder API für Python.

Richten Sie die Standardanmeldedaten für Anwendungen ein, um sich bei der Transcoder API zu authentifizieren. Weitere Informationen finden Sie unter Authentifizierung für eine lokale Entwicklungsumgebung einrichten.

Untertitel hinzufügen

So erstellen Sie einen Job, der Untertiteldateien in mehreren Sprachen erzeugt, die über ein Manifest wiedergegeben werden:

Fügen Sie der Jobkonfiguration ein

inputs-Array hinzu.Fügen Sie dem Array

inputseinInput-Objekt hinzu, das den Schlüssel und den URI für das zugehörige Eingabevideo definiert.Fügen Sie ein weiteres

Input-Objekt hinzu, das den URI für die Eingabe-Untertiteldatei definiert.Fügen Sie der Konfiguration ein

editList-Array hinzu. Mit diesem Array werden die Eingaben der Zeitachse des Ausgabevideos hinzugefügt.Fügen Sie dem Array

editListeinEditAtom-Objekt hinzu, das über den Schlüssel auf die Objekte im Arrayinputsverweist. Sie können einenstartTimeOffsetundendTimeOffsetangeben, um das Eingabevideo zu kürzen.Fügen Sie den Ausgabecontainern Untertitel hinzu, indem Sie dem Array

elementaryStreamsdas ObjekttextStreamhinzufügen.Geben Sie für die eigenständige Untertiteldatei den Container im Array

muxStreaman. Weitere Informationen finden Sie in der folgenden Konfiguration unter den Objekten mit den Schlüsselntext-vtt-enundtext-vtt-es. Für eingebettete Untertitel ist nur der Elementarstream erforderlich.

Bei der folgenden Konfiguration werden mehrere WebVTT-Dateien generiert, eine für englische Untertitel und eine für spanische Untertitel. DASH-Untertitel in WebVTT-Dateien werden im fMP4-Containerformat erstellt.

Sie können diese Konfiguration einer Jobvorlage hinzufügen oder sie in eine Ad-hoc-Jobkonfiguration einbinden:

REST

Ersetzen Sie diese Werte in den folgenden Anfragedaten:

PROJECT_ID: Ihre Google Cloud -Projekt-ID, die unter IAM-Einstellungen aufgeführt ist.LOCATION: Der Standort, an dem der Job ausgeführt werden soll. Verwenden Sie eine der unterstützten Regionen.Standorte anzeigenus-central1us-west1us-west2us-east1us-east4southamerica-east1northamerica-northeast1asia-east1asia-northeast1asia-northeast3asia-south1asia-southeast1australia-southeast1europe-west1europe-west2europe-west4me-west1me-central1me-central2

STORAGE_BUCKET_NAME: Der Name des Cloud Storage-Buckets, den Sie erstellt haben.STORAGE_INPUT_VIDEO: Der Name des Videos in Ihrem Cloud Storage-Bucket, den Sie transcodieren, z. B.my-vid.mp4. In diesem Feld sollten alle Ordner berücksichtigt werden, die Sie im Bucket erstellt haben (z. B.input/my-vid.mp4).STORAGE_SUBTITLES_FILE1: Der Name der Untertiteldatei in Ihrem Cloud Storage-Bucket, z. B.subtitles-en.srtfür englischsprachige Untertitel. In diesem Feld sollten alle Ordner berücksichtigt werden, die Sie im Bucket erstellt haben (z. B.input/subtitles-en.srt).STORAGE_SUBTITLES_FILE2: Der Name einer anderen Untertiteldatei in Ihrem Cloud Storage-Bucket, z. B.subtitles-es.srtfür Untertitel in spanischer Sprache. In diesem Feld sollten alle Ordner berücksichtigt werden, die Sie im Bucket erstellt haben (z. B.input/subtitles-es.srt).STORAGE_OUTPUT_FOLDER: Der Name des Ausgabefolders in Ihrem Cloud Storage-Bucket, in dem die codierten Videoausgaben gespeichert werden sollen.

Wenn Sie die Anfrage senden möchten, maximieren Sie eine der folgenden Optionen:

Sie sollten eine JSON-Antwort ähnlich wie diese erhalten:

{

"name": "projects/PROJECT_NUMBER/locations/LOCATION/jobs/JOB_ID",

"config": {

...

},

"state": "PENDING",

"createTime": CREATE_TIME,

"ttlAfterCompletionDays": 30

}

gcloud

Ersetzen Sie folgende Werte, bevor sie einen der Befehlsdaten verwenden:

LOCATION: Der Standort, an dem der Job ausgeführt werden soll. Verwenden Sie eine der unterstützten Regionen.Standorte anzeigenus-central1us-west1us-west2us-east1us-east4southamerica-east1northamerica-northeast1asia-east1asia-northeast1asia-northeast3asia-south1asia-southeast1australia-southeast1europe-west1europe-west2europe-west4me-west1me-central1me-central2

STORAGE_BUCKET_NAME: Der Name des Cloud Storage-Buckets, den Sie erstellt haben.STORAGE_INPUT_VIDEO: Der Name des Videos in Ihrem Cloud Storage-Bucket, den Sie transcodieren, z. B.my-vid.mp4. In diesem Feld sollten alle Ordner berücksichtigt werden, die Sie im Bucket erstellt haben (z. B.input/my-vid.mp4).STORAGE_SUBTITLES_FILE1: Der Name der Untertiteldatei in Ihrem Cloud Storage-Bucket, z. B.subtitles-en.srtfür englischsprachige Untertitel. In diesem Feld sollten alle Ordner berücksichtigt werden, die Sie im Bucket erstellt haben (z. B.input/subtitles-en.srt).STORAGE_SUBTITLES_FILE2: Der Name einer anderen Untertiteldatei in Ihrem Cloud Storage-Bucket, z. B.subtitles-es.srtfür Untertitel in spanischer Sprache. In diesem Feld sollten alle Ordner berücksichtigt werden, die Sie im Bucket erstellt haben (z. B.input/subtitles-es.srt).STORAGE_OUTPUT_FOLDER: Der Name des Ausgabefolders in Ihrem Cloud Storage-Bucket, in dem die codierten Videoausgaben gespeichert werden sollen.

Speichern Sie den folgenden Inhalt in einer Datei mit dem Namen request.json:

{ "config": { "inputs": [ { "key": "input0", "uri": "gs://STORAGE_BUCKET_NAME/STORAGE_INPUT_VIDEO" }, { "key": "subtitle_input_en", "uri": "gs://STORAGE_BUCKET_NAME/STORAGE_SUBTITLES_FILE1" }, { "key": "subtitle_input_es", "uri": "gs://STORAGE_BUCKET_NAME/STORAGE_SUBTITLES_FILE2" } ], "editList": [ { "key": "atom0", "inputs": [ "input0", "subtitle_input_en", "subtitle_input_es" ] } ], "elementaryStreams": [ { "key": "video-stream0", "videoStream": { "h264": { "heightPixels": 360, "widthPixels": 640, "bitrateBps": 550000, "frameRate": 60 } } }, { "key": "audio-stream0", "audioStream": { "codec": "aac", "bitrateBps": 64000 } }, { "key": "vtt-stream-en", "textStream": { "codec": "webvtt", "languageCode": "en-US", "displayName": "English", "mapping": [ { "atomKey": "atom0", "inputKey": "subtitle_input_en" } ] } }, { "key": "vtt-stream-es", "textStream": { "codec": "webvtt", "languageCode": "es-ES", "displayName": "Spanish", "mapping": [ { "atomKey": "atom0", "inputKey": "subtitle_input_es" } ] } } ], "muxStreams": [ { "key": "sd-hls-fmp4", "container": "fmp4", "elementaryStreams": [ "video-stream0" ] }, { "key": "audio-hls-fmp4", "container": "fmp4", "elementaryStreams": [ "audio-stream0" ] }, { "key": "text-vtt-en", "container": "vtt", "elementaryStreams": [ "vtt-stream-en" ], "segmentSettings": { "segmentDuration": "6s", "individualSegments": true } }, { "key": "text-vtt-es", "container": "vtt", "elementaryStreams": [ "vtt-stream-es" ], "segmentSettings": { "segmentDuration": "6s", "individualSegments": true } } ], "manifests": [ { "fileName": "manifest.m3u8", "type": "HLS", "muxStreams": [ "sd-hls-fmp4", "audio-hls-fmp4", "text-vtt-en", "text-vtt-es" ] } ], "output": { "uri": "gs://STORAGE_BUCKET_NAME/STORAGE_OUTPUT_FOLDER/" } } }

Führen Sie folgenden Befehl aus:

Linux, macOS oder Cloud Shell

gcloud transcoder jobs create --location=LOCATION --file=request.json

Windows (PowerShell)

gcloud transcoder jobs create --location=LOCATION --file=request.json

Windows (cmd.exe)

gcloud transcoder jobs create --location=LOCATION --file=request.json

Sie sollten eine Antwort ähnlich der folgenden erhalten:

{

"name": "projects/PROJECT_NUMBER/locations/LOCATION/jobs/JOB_ID",

"config": {

...

},

"state": "PENDING",

"createTime": CREATE_TIME,

"ttlAfterCompletionDays": 30

}

Go

Folgen Sie der Einrichtungsanleitung für Go in der Transcoder API-Kurzanleitung: Clientbibliotheken verwenden, bevor Sie dieses Beispiel anwenden. Weitere Informationen finden Sie in der Referenzdokumentation zur Transcoder API für Go.

Richten Sie die Standardanmeldedaten für Anwendungen ein, um sich bei der Transcoder API zu authentifizieren. Weitere Informationen finden Sie unter Authentifizierung für eine lokale Entwicklungsumgebung einrichten.

Java

Folgen Sie der Einrichtungsanleitung für Java in der Transcoder API-Kurzanleitung: Clientbibliotheken verwenden, bevor Sie dieses Beispiel anwenden. Weitere Informationen finden Sie in der Referenzdokumentation zur Transcoder API für Java.

Richten Sie die Standardanmeldedaten für Anwendungen ein, um sich bei der Transcoder API zu authentifizieren. Weitere Informationen finden Sie unter Authentifizierung für eine lokale Entwicklungsumgebung einrichten.

Node.js

Folgen Sie der Einrichtungsanleitung für Node.js in der Transcoder API-Kurzanleitung: Clientbibliotheken verwenden, bevor Sie dieses Beispiel anwenden. Weitere Informationen finden Sie in der Referenzdokumentation zur Transcoder API für Node.js.

Richten Sie die Standardanmeldedaten für Anwendungen ein, um sich bei der Transcoder API zu authentifizieren. Weitere Informationen finden Sie unter Authentifizierung für eine lokale Entwicklungsumgebung einrichten.

Python

Folgen Sie der Einrichtungsanleitung für Python in der Transcoder API-Kurzanleitung: Clientbibliotheken verwenden, bevor Sie dieses Beispiel anwenden. Weitere Informationen finden Sie in der Referenzdokumentation zur Transcoder API für Python.

Richten Sie die Standardanmeldedaten für Anwendungen ein, um sich bei der Transcoder API zu authentifizieren. Weitere Informationen finden Sie unter Authentifizierung für eine lokale Entwicklungsumgebung einrichten.

Spielen Sie Ihr Video ab.

Wenn Sie die Untertitel unter Windows ansehen möchten, spielen Sie das Video in der App „Filme & TV“ ab. Achten Sie darauf, dass Sie den Untertitel-Track auswählen.

Wenn Sie die Untertitel unter MacOS oder Linux ansehen möchten, können Sie das Video im Shaka Player abspielen. Achte darauf, dass du im Menü Untertitel Untertitel aktiviert hast.

Führen Sie die folgenden Schritte aus, um die generierte Mediadatei in Shaka Player abzuspielen:

- Machen Sie den von Ihnen erstellten Cloud Storage-Bucket öffentlich.

- So aktivieren Sie Cross-Origin Resource Sharing (CORS) für einen Cloud Storage-Bucket:

- Erstellen Sie eine JSON-Datei, die Folgendes enthält:

[ { "origin": ["https://shaka-player-demo.appspot.com/"], "responseHeader": ["Content-Type", "Range"], "method": ["GET", "HEAD"], "maxAgeSeconds": 3600 } ] - Führen Sie den folgenden Befehl aus, nachdem Sie JSON_FILE_NAME durch den Namen der im vorherigen Schritt erstellten JSON-Datei ersetzt haben:

gcloud storage buckets update gs://STORAGE_BUCKET_NAME --cors-file=JSON_FILE_NAME.json

- Erstellen Sie eine JSON-Datei, die Folgendes enthält:

- Wählen Sie eine der MP4- oder Manifestdateien aus, die vom Transcodierungsjob im Cloud Storage-Bucket generiert wurden. Klicken Sie in der Spalte Öffentlicher Zugriff der Datei auf URL kopieren.

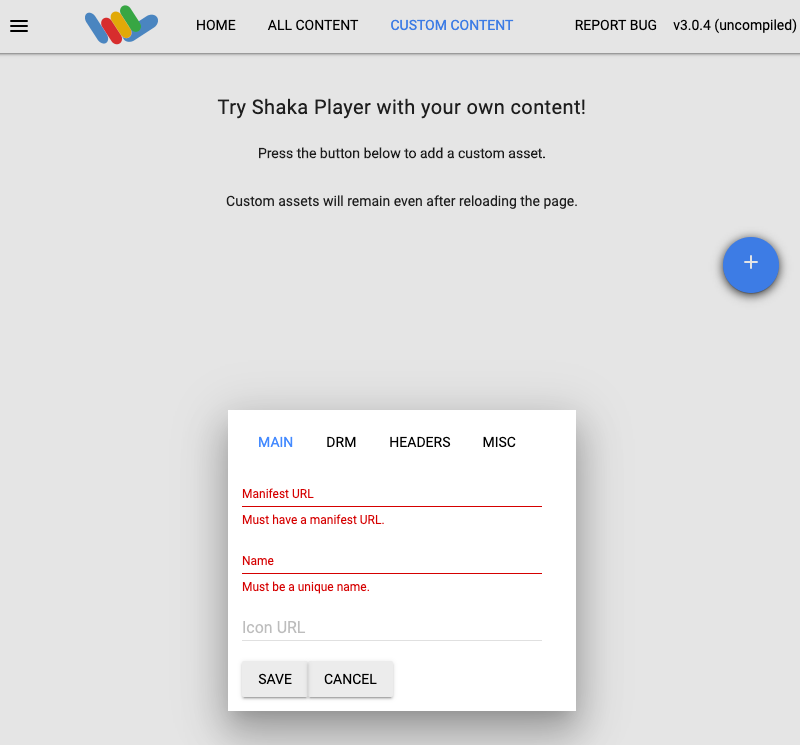

- Rufen Sie Shaka Player, ein Online-Livestream-Player, auf.

- Klicken Sie in der Navigationsleiste oben auf Benutzerdefinierte Inhalte.

- Klicken Sie auf die Schaltfläche +.

Fügen Sie die öffentliche URL der Datei in das Feld URL manifestieren ein.

Geben Sie einen Namen in das Feld Name ein.

Klicken Sie auf Speichern.

Klicken Sie auf Wiedergabe.

Wähle rechts unten im Player das Dreipunkt-Menü aus und aktiviere die Untertitel.

Beispiel

Sie können die folgenden Dateien für einen Testjob verwenden:

- Beispielvideo für die Eingabe

- Beispiel für eine Eingabe-Untertiteldatei für Untertitel

- Beispiel für eine Eingabe-Untertiteldatei für deutsche Untertitel

- Beispiel für eine Eingabe-Untertiteldatei für spanische Untertitel

Die Eingabe-Untertiteldatei darf keine Leerzeilen zwischen den Textzeilen enthalten.