Ce document explique comment rendre GKE sur VMware disponible pour la gestion dans la console Google Cloud. Cela inclut la gestion de base, comme la possibilité de se connecter aux clusters et d'afficher leurs charges de travail, ainsi que l'activation de la gestion du cycle de vie des clusters afin de pouvoir les mettre à niveau, les mettre à jour et les supprimer.

Membres du parc et console

Tous les clusters GKE sur VMware doivent être membres d'un parc, une méthode unifiée permettant d'afficher et de gérer plusieurs clusters et leurs charges de travail. Chaque parc de clusters est associé à un projet hôte de parc.

Dans GKE sur VMware, un cluster d'administrateur est enregistré dans un parc au moment de sa création. Pour ce faire, spécifiez le projet hôte de votre parc dans la section gkeConnect du fichier de configuration du cluster. GKE sur VMware utilise ces informations pour enregistrer votre cluster dans le projet de parc spécifié. Si l'enregistrement échoue, vous pouvez effectuer une nouvelle tentative d'enregistrement en exécutant gkectl update credentials register.

Notez que lorsque vous essayez à nouveau d'enregistrer, vous n'avez pas besoin de mettre à jour la clé de compte de service connect-register. En d'autres termes, vous pouvez continuer à utiliser votre compte de service connect-register d'origine. Pour en savoir plus sur cette commande, consultez la section Effectuer une rotation des clés de compte de service.

Dans GKE sur VMware, un cluster d'utilisateur est enregistré dans un parc au moment de sa création:

Lorsque vous créez un cluster d'utilisateur à l'aide de

gkectl, vous spécifiez le projet hôte de votre parc dans la sectiongkeConnectdu fichier de configuration du cluster. GKE sur VMware utilise ces informations pour enregistrer votre cluster dans le projet de parc spécifié.Lorsque vous créez un cluster d'utilisateur dans la console, celui-ci devient automatiquement membre du parc dans le projet sélectionné dans la console.

Les membres d'un parc en dehors de Google Cloud, tels que GKE sur VMware, s'affichent dans la console du projet hôte de votre parc, avec d'autres clusters de parc tels que GKE sur Google Cloud. La mesure dans laquelle vous pouvez gérer GKE sur VMware à partir de la console dépend des éléments suivants:

Si vous avez configuré l'authentification, vous pouvez vous connecter à vos clusters et afficher leurs charges de travail et d'autres détails.

Si vous avez activé la gestion du cycle de vie du cluster, vous pouvez également mettre à niveau, mettre à jour ou supprimer des clusters d'utilisateur à l'aide de la console. Pour ce faire, le cluster doit être géré par un service appelé API Anthos On-Prem. Pour les clusters d'utilisateur créés dans la console, la gestion du cycle de vie du cluster est activée au moment de la création du cluster. Vous pouvez également activer cette fonctionnalité ultérieurement pour les clusters d'utilisateur créés à l'aide de

gkectl. Si cette fonctionnalité n'est pas activée, vous ne pouvez gérer le cycle de vie d'un cluster qu'à l'aide degkectlsur votre poste de travail administrateur.

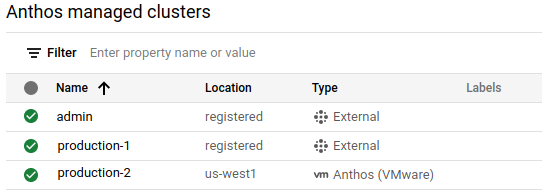

Afficher les clusters enregistrés

Tous les clusters de votre parc sont affichés sur les pages Clusters GKE Enterprise et Clusters GKE de la console. Cela vous donne à la fois un aperçu de l'ensemble de votre parc et, pour GKE sur VMware, vous permet de voir quels clusters sont gérés par l'API Anthos On-Prem.

Pour afficher les clusters de votre parc:

Dans la console, accédez à la page des clusters GKE Enterprise.

Sélectionnez le projet Google Cloud.

Si vm Anthos (VMware) s'affiche dans la colonne Type, le cluster est géré par l'API Anthos On-Prem.

Si Externe s'affiche dans la colonne Type, le cluster n'est pas géré par l'API Anthos On-Prem.

Pour afficher plus d'informations sur un cluster, les utilisateurs doivent se connecter et s'authentifier auprès du cluster. Pour ce faire, vous devez :

- Configurer une méthode d'authentification

- Attribuer des rôles Identity and Access Management spécifiques aux utilisateurs

Configurer l'authentification

Comme décrit ci-dessus, tous les clusters de parc apparaissent dans les listes de clusters GKE et GKE Enterprise de la console. Toutefois, pour afficher plus de détails tels que les nœuds et les charges de travail (et pour effectuer des tâches de gestion du cycle de vie du cluster si la fonctionnalité est activée), les utilisateurs doivent se connecter au cluster et s'authentifier. Pour ce faire, vos clusters enregistrés doivent être configurés avec l'une des méthodes d'authentification suivantes:

Identité Google: cette option permet aux utilisateurs de se connecter à l'aide de leur identité Google Cloud, qui est l'adresse e-mail associée à votre compte Google Cloud. Utilisez cette option si les utilisateurs ont déjà accès à Google Cloud avec leur identité Google. Si vous avez créé le cluster dans la console, vous pouvez vous y connecter à l'aide de votre identité Google, mais vous devrez configurer l'authentification pour les autres utilisateurs.

La connexion avec l'identité Google est l'approche la plus simple pour l'authentification dans la console, en particulier si vous testez GKE sur VMware avec une installation minimale. Nous avons donc décrit plus en détail la procédure à suivre ci-dessous dans la section Configurer l'authentification de l'identité Google.

OpenID Connect (OIDC): cette option permet aux utilisateurs de se connecter aux clusters depuis la console en utilisant leur identité depuis un fournisseur d'identité OIDC tiers tel qu'Okta ou Microsoft AD FS. Vous pouvez utiliser cette option si vos utilisateurs disposent déjà de noms d'utilisateur, de mots de passe et d'appartenances à des groupes de sécurité auprès de votre fournisseur. Vous pouvez découvrir comment configurer l'authentification OIDC tierce pour vos clusters dans les guides suivants:

Configurer des clusters pour GKE Identity Service à l'aide d'OIDC : ce guide vous explique comment configurer l'authentification OIDC cluster par cluster.

Configurer GKE Identity Service pour un parc : cette option vous permet de configurer OIDC au niveau du parc.

Jeton de support: si les solutions précédentes fournies par Google ne conviennent pas à votre organisation, vous pouvez configurer l'authentification à l'aide d'un compte de service Kubernetes et de son jeton de support pour vous connecter. Pour en savoir plus, consultez la section Configurer à l'aide d'un jeton de support.

Attribuer les rôles requis

L'accès à la console est contrôlé par Google Cloud IAM. Ces rôles IAM sont requis quelle que soit la méthode d'authentification choisie. Pour gérer le cycle de vie du cluster dans la console, vous devez attribuer des rôles IAM.

Pour permettre aux utilisateurs d'accéder à la console, vous devez au minimum leur attribuer les rôles suivants:

roles/container.viewer. Ce rôle permet aux utilisateurs d'afficher la page "Clusters GKE" et les autres ressources de conteneur dans la console. Pour en savoir plus sur les autorisations incluses dans ce rôle ou pour attribuer un rôle doté d'autorisations de lecture/écriture, consultez la section Rôles Kubernetes Engine dans la documentation IAM.roles/gkehub.viewer. Ce rôle permet aux utilisateurs d'afficher les clusters en dehors de Google Cloud dans la console. Pour en savoir plus sur les autorisations incluses dans ce rôle ou pour attribuer un rôle doté d'autorisations de lecture/écriture, consultez la page Rôles GKE Hub dans la documentation IAM.

Pour permettre aux utilisateurs de gérer le cycle de vie du cluster dans la console, accordez le rôle IAM

roles/gkeonprem.admin. Le rôleroles/gkeonprem.adminaccorde aux utilisateurs un accès administrateur à l'API Anthos On-Prem, que la console utilise pour gérer le cycle de vie du cluster. Pour en savoir plus sur les autorisations incluses dans ce rôle, consultez la section Rôles GKE On-Prem dans la documentation IAM.

Les commandes suivantes montrent comment attribuer les rôles minimaux nécessaires pour gérer le cycle de vie du cluster dans la console:

gcloud projects add-iam-policy-binding FLEET_HOST_PROJECT_ID \

--member=MEMBER \

--role=roles/container.viewer

gcloud projects add-iam-policy-binding FLEET_HOST_PROJECT_ID \

--member=MEMBER \

--role=roles/gkehub.viewer

gcloud projects add-iam-policy-binding FLEET_HOST_PROJECT_ID \

--member=MEMBER \

--role=roles/gkeonprem.admin

où :

FLEET_HOST_PROJECT_IDest le projet hôte du parc. Pour les clusters créés à l'aide degkectl, il s'agit du projet que vous avez configuré dans la sectiongkeConnectdu fichier de configuration du cluster d'utilisateur. Pour les clusters créés dans la console, il s'agit du projet que vous avez choisi lors de la création du cluster.MEMBERest l'adresse e-mail de l'utilisateur au formatuser:emailID, par exemple:user:alice@example.com

Activer la gestion du cycle de vie des clusters dans la console

Les clusters d'utilisateur créés dans la console sont automatiquement gérés par l'API Anthos On-Prem et vous permettent d'effectuer des tâches de gestion du cycle de vie du cluster dans la console. Si vous souhaitez activer cette fonctionnalité pour les clusters d'utilisateur créés à l'aide de gkectl, suivez la procédure décrite dans Configurer un cluster d'utilisateur à gérer par l'API Anthos On-Prem.

Lorsque la gestion du cycle de vie du cluster est activée, vous pouvez effectuer les tâches suivantes à partir de la console:

- Mettre à niveau des clusters d'utilisateur

- Redimensionner des clusters d'utilisateur

- Créer et gérer des pools de nœuds

- Supprimer des clusters d'utilisateur

Configurer l'authentification de l'identité Google

Pour permettre aux utilisateurs de se connecter au cluster à l'aide de leur identité Google, vous devez configurer les éléments suivants:

Les utilisateurs doivent disposer de rôles de Identity and Access Management (IAM) spécifiques pour pouvoir afficher et interagir avec les clusters dans la console, depuis les pages figurant sur la liste des clusters GKE et sur les pages liste des clusters GKE Enterprise.

Les utilisateurs doivent être ajoutés aux stratégies de contrôle des accès basé sur les rôles (RBAC) Kubernetes dont la passerelle Connect a besoin pour accéder au serveur d'API Kubernetes du cluster via l'agent Connect.

Configurer l'autorisation RBAC

Le serveur d'API Kubernetes de chaque cluster doit être en mesure d'autoriser les requêtes provenant de la console. Pour configurer l'autorisation, vous devez configurer les stratégies de contrôle des accès basées sur les rôles (RBAC) de Kubernetes sur chaque cluster. Si vous avez créé le cluster dans la console, l'API Anthos On-Prem ajoute votre compte utilisateur en tant qu'administrateur et crée les stratégies RBAC appropriées qui vous accordent un accès administrateur complet au cluster.

Si vous avez créé le cluster dans la console, puis que vous utilisez gcloud pour configurer les stratégies RBAC, les adresses e-mail des utilisateurs ne seront pas visibles dans la section Détails du cluster de la console.

gcloud CLI

Exécutez les commandes suivantes pour vous connecter avec votre compte Google et mettre à jour les composants:

gcloud auth login gcloud components updateGénérez et appliquez les stratégies RBAC à votre cluster pour les utilisateurs et les comptes de service:

gcloud container fleet memberships generate-gateway-rbac \ --membership=MEMBERSHIP_NAME \ --role=ROLE \ --users=USERS \ --project=FLEET_HOST_PROJECT_ID \ --kubeconfig=KUBECONFIG_PATH \ --context=KUBECONFIG_CONTEXT \ --applyRemplacez les éléments suivants :

- MEMBERSHIP_NAME: nom utilisé pour représenter de manière unique le cluster dans son parc. Dans GKE sur VMware, le nom de l'appartenance et le nom du cluster sont identiques.

- ROLE: rôle Kubernetes que vous souhaitez attribuer aux utilisateurs du cluster. Pour accorder aux utilisateurs un accès complet à chaque ressource du cluster dans tous les espaces de noms, spécifiez

clusterrole/cluster-admin. Pour restreindre l'accès, créez un rôle personnalisé, par exemplerole/mynamespace/namespace-reader. Le rôle personnalisé doit déjà exister avant que vous puissiez exécuter la commande. - USERS : adresses e-mail des utilisateurs (comptes utilisateur ou comptes de service) auxquels vous souhaitez accorder les autorisations, sous la forme d'une liste d'éléments séparés par une virgule. Exemple :

--users=foo@example.com,test-acct@test-project.iam.gserviceaccount.com. - FLEET_HOST_PROJECT_ID: ID du projet hôte du parc.

- KUBECONFIG_PATH : chemin d'accès à l'emplacement local du fichier kubeconfig contenant une entrée pour le cluster.

KUBECONFIG_CONTEXT : contexte du cluster tel qu'il apparaît dans le fichier kubeconfig. Vous pouvez obtenir le contexte actuel à partir de la ligne de commande en exécutant la commande

kubectl config current-context. Que vous utilisiez le contexte actuel ou non, assurez-vous qu'il fonctionne pour l'accès au cluster en exécutant une commande simple telle que la suivante :kubectl get namespaces \ --kubeconfig=KUBECONFIG_PATH \ --context=KUBECONFIG_CONTEXT

Après l'exécution de

gcloud container fleet memberships generate-gateway-rbac, une sortie semblable à la suivante s'affiche à la fin de la sortie, qui est tronquée pour des raisons de lisibilité:Validating input arguments. Specified Cluster Role is: clusterrole/cluster-admin Generated RBAC policy is: -------------------------------------------- ... Applying the generate RBAC policy to cluster with kubeconfig: /usr/local/google/home/foo/.kube/config, context: kind-kind Writing RBAC policy for user: foo@example.com to cluster. Successfully applied the RBAC policy to cluster.Il s'agit du contexte permettant d'accéder au cluster via la passerelle Connect.

Pour en savoir plus sur la commande

generate-gateway-rbac, consultez le guide de référence de gcloud CLI.

Console

Pour appliquer les stratégies RBAC aux utilisateurs, procédez comme suit dans la console:

Dans la console, accédez à la page des clusters GKE Enterprise.

Sélectionnez le projet Google Cloud dans lequel se trouve le cluster d'utilisateur.

Dans la liste des clusters, cliquez sur le nom du cluster puis sur Afficher les détails dans le panneau Détails.

Dans la section Autorisation, cliquez sur le champ Utilisateurs administrateurs du cluster et saisissez l'adresse e-mail de chaque utilisateur.

Lorsque vous avez terminé d'ajouter des utilisateurs, cliquez sur OK.

Informations complémentaires

- Présentation de la gestion de parc

- Utiliser des clusters depuis Google Cloud Console

- Présentation de Connect

- Présentation de l'agent Connect