この初心者向けガイドでは、生成 AI のコア テクノロジーを紹介し、それらがどのように連携して chatbot やアプリケーションを強化しているのかを説明します。生成 AI(genAI や gen AI とも呼ばれます)は ML の分野の一つで、ML モデルを開発して新しいコンテンツの生成に使用します。

生成 AI モデルは、その大きな規模と自然言語を理解、生成する能力から、よく大規模言語モデル(LLM)と呼ばれます。しかし、モデルがトレーニングに使用するデータによっては、テキストだけでなく、画像、動画、音声といった複数のモダリティの内容を理解して生成することができます。このように、複数のモダリティのデータを扱うモデルは、マルチモーダル モデルと呼ばれます。

Google の Gemini は、マルチモーダルのユースケース用に設計された生成 AI モデルのファミリーです。画像、動画、テキストなど複数のモダリティからの情報を処理できます。

コンテンツの生成

生成 AI モデルが実世界の用途に役立つコンテンツを生成するには、以下の機能が必要です。

新しいタスクの実行方法を学習する:

生成 AI モデルは、一般的なタスクを実行するように設計されています。ユーザーのユースケースに固有のタスクをモデルに実行させる場合は、ユーザーがモデルをカスタマイズできる必要があります。Vertex AI では、モデル チューニングによってモデルをカスタマイズできます。

外部情報にアクセスする:

生成 AI モデルは膨大な量のデータでトレーニングされます。ただし、これらのモデルが役立つには、トレーニング データ以外の情報にアクセスできることが必要です。たとえば、生成 AI モデルを活用したカスタマー サービス chatbot を作成する場合、モデルはユーザーが提供するプロダクトやサービスに関する情報にアクセスできる必要があります。Vertex AI では、グラウンディング機能や関数呼び出し機能を使用して、モデルが外部情報にアクセスできるようにします。

有害なコンテンツをブロックする:

生成 AI モデルから生成される出力は、不適切なテキストや配慮に欠けたテキストといった予期しないものになる場合があります。安全性を維持し、不正使用を防ぐため、モデルには、有害な可能性があると判断されたプロンプトやレスポンスをブロックする安全フィルタが必要です。Vertex AI には、生成 AI サービスの責任ある使用を促進する安全機能が組み込まれています。

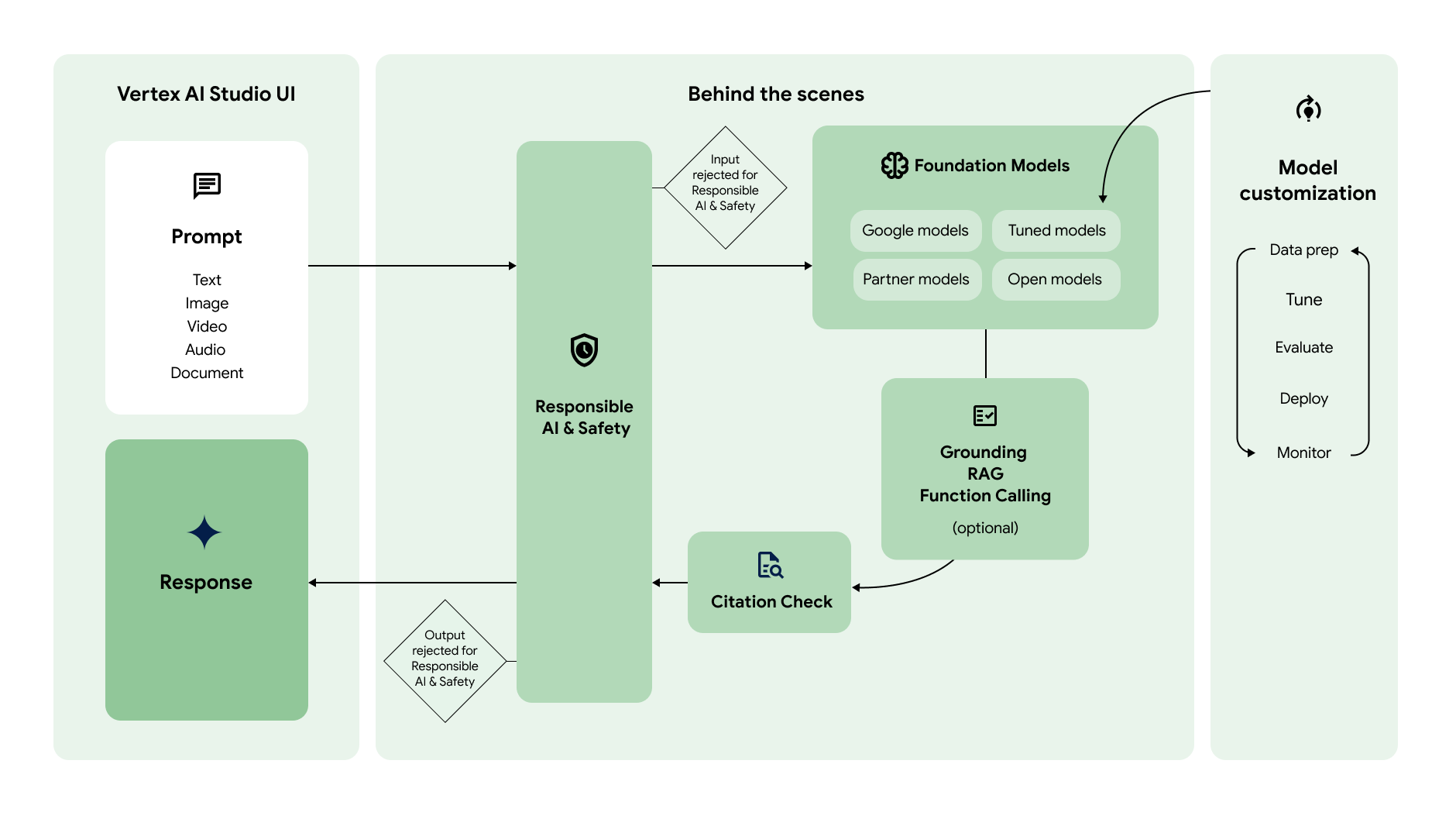

次の図は、これらのさまざまな機能が連携して目的のコンテンツを生成する仕組みを示しています。

プロンプト

|

|

通常、生成 AI ワークフローは、プロンプトから始まります。プロンプトとは、レスポンスを引き出すために生成 AI モデルに送信する自然言語のリクエストを指します。モデルによっては、プロンプトにテキスト、画像、動画、音声、ドキュメントなどのモダリティ、または複数のモダリティ(マルチモーダル)を含めることができます。 モデルから期待するレスポンスを引き出すためのプロンプトを記述する作業は、プロンプト設計と呼ばれています。プロンプト設計は試行錯誤のプロセスですが、プロンプト設計には原則と戦略があり、それを使用して期待通りの動作をするようにモデルを誘導します。Vertex AI Studio には、プロンプトを管理するためのプロンプト管理ツールが用意されています。 |

基盤モデル

|

|

プロンプトは、レスポンスを生成するために生成 AI モデルに送信されます。Vertex AI には、以下のようにさまざまな生成 AI 基盤モデルがあります。これらのモデルには、API を介してアクセスできます。

モデルのサイズ、モダリティ、費用はそれぞれ異なります。Google のモデル、オープンモデル、Google パートナーのモデルについては、Model Garden で調べることができます。 |

モデルのカスタマイズ

|

|

Google の基盤モデルのデフォルトの動作は、複雑なプロンプトを使わなくても常に期待する結果が生成されるようにカスタマイズできます。このカスタマイズ プロセスをモデル チューニングと呼びます。モデル チューニングを行うと、プロンプトを簡素化できるため、リクエストの費用とレイテンシを削減する効果があります。 Vertex AI には、チューニングしたモデルのパフォーマンスの評価に役立つモデル評価ツールも用意されています。チューニングしたモデルをプロダクション レディな状態にした後は、エンドポイントにデプロイして、標準の MLOps ワークフローと同様にパフォーマンスをモニタリングできます。 |

外部情報にアクセスする

|

|

Vertex AI には、モデルが外部 API とリアルタイム情報にアクセスできるようにする方法が複数あります。 |

引用チェック

|

|

レスポンスが生成されると、Vertex AI は引用をレスポンスに含める必要があるかどうかチェックします。レスポンスにあるテキストの大半が特定の情報源に由来する場合は、その情報源がレスポンスの引用メタデータに追加されます。 |

責任ある AI と安全性

|

|

プロンプトとレスポンスが返される前に通過するチェックの最終レイヤは、安全フィルタです。Vertex AI では、プロンプトとレスポンスの両方について、プロンプトやレスポンスがどの程度安全カテゴリに属しているかを確認します。1 つ以上のカテゴリでしきい値を超えると、レスポンスはブロックされ、Vertex AI からフォールバック レスポンスが返されます。 |

レスポンス

|

|

プロンプトとレスポンスが安全フィルタのチェックに合格すると、レスポンスが返されます。通常、レスポンスは一度にすべてが返されます。ただし、Vertex AI では、ストリーミングを有効にして、レスポンスの生成に合わせて徐々に受け取ることもできます。 |

使ってみる

Vertex AI で生成 AI を使ってみるには、次のいずれかのクイックスタートをお試しください。

- Vertex AI Gemini API を使用してテキストを生成する: SDK を使用して、Vertex AI Gemini API にリクエストを送信します。

- Vertex AI Studio プロンプト ギャラリーを使用して Gemini にプロンプトを送信する: 設定なしでプロンプトをテストする

- Imagen を使用して画像を生成し、透かしを確認する: Vertex AI で Imagen を使用してウォーターマーク付きの画像を作成する