ココナラ:Vertex AI Pipelines による MLOps 基盤構築で多くの指標を改善し顧客体験も向上

Google Cloud Japan Team

ビジネスからプライベート利用まで、「知識・スキル・経験」を売り買いできる日本最大級のスキルマーケット「ココナラ」を運営する株式会社ココナラ。同社では、Vertex AI Pipelines を採用することで MLOps 基盤を構築。スキルの出品者と購入者をマッチングするための検索アルゴリズムの改善を自動化しています。このプロジェクトについて、プロダクト開発部 R&Dグループのマネージャー、およびアルゴリズムリードに話を伺いました。

利用しているサービス:

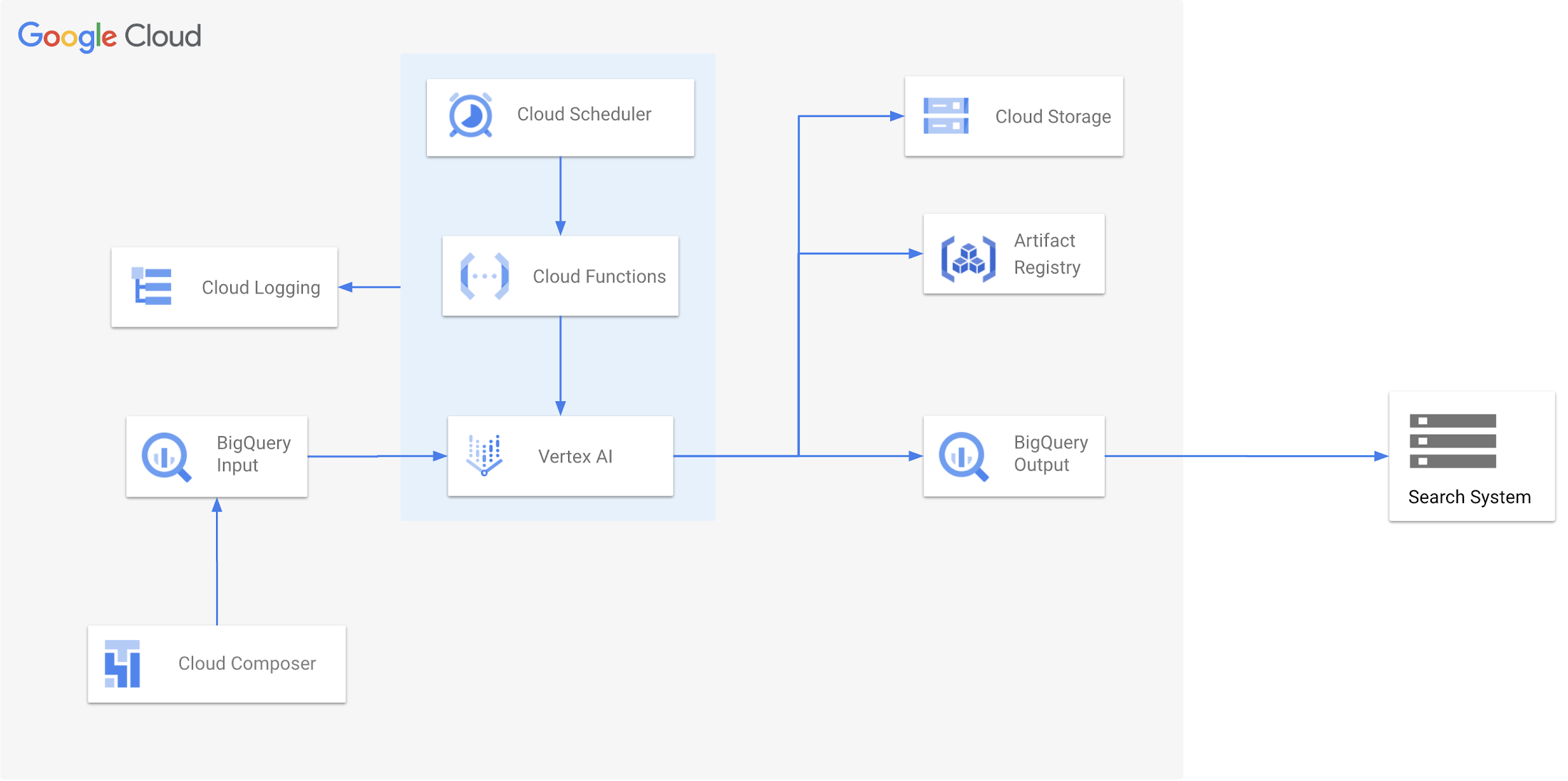

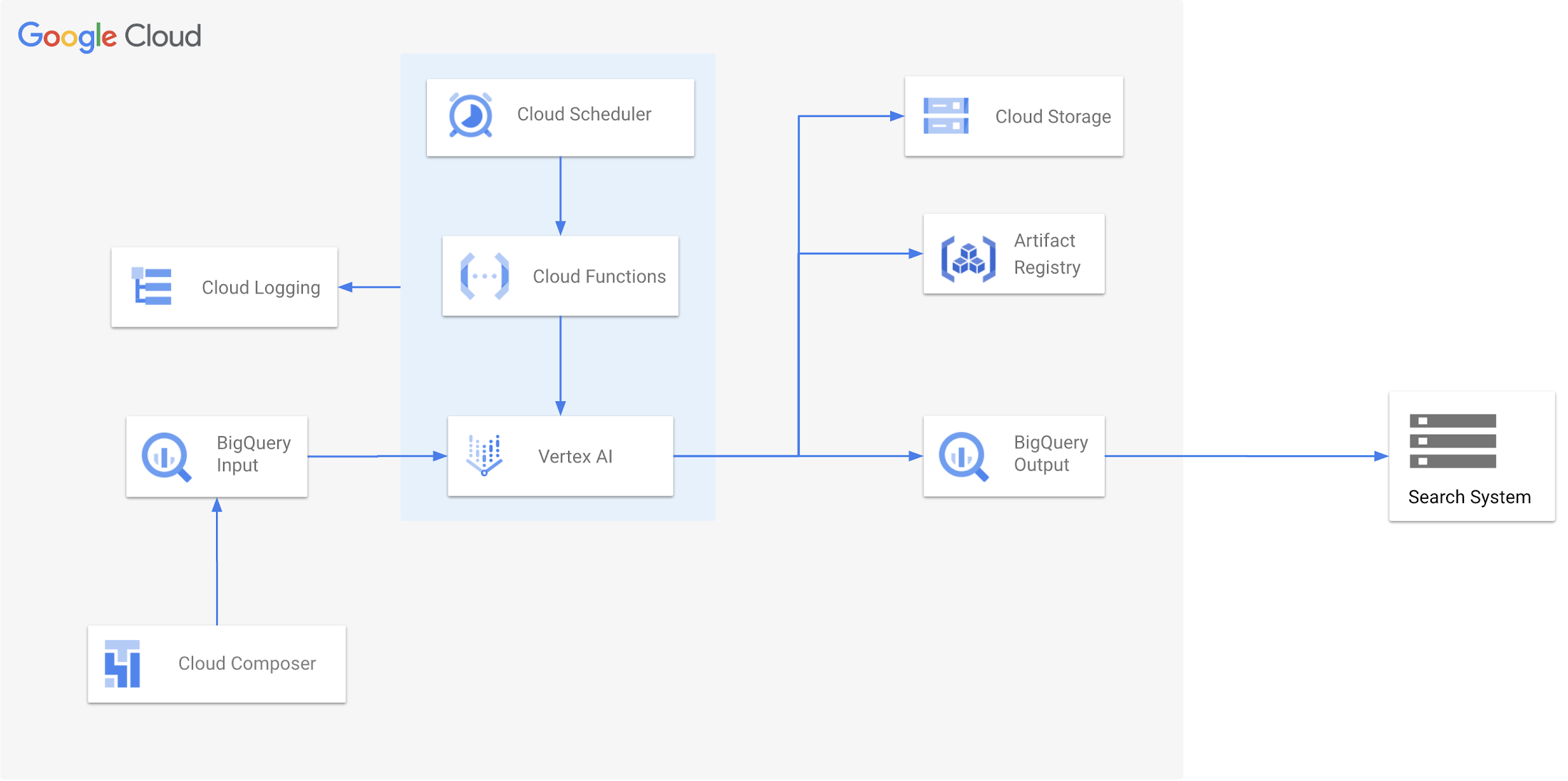

Vertex AI Pipelines、Cloud Scheduler、Cloud Functions、BigQuery、Artifact Registry、Cloud Logging、Cloud Composer

利用しているソリューション:

いま必要な機能はもちろん、高い将来性の Vertex AI Pipelines を採用

ココナラは、デザインやイラスト、ウェブサイト制作などの「制作系」からビジネス マーケティングなどの「サポート・代行」、美容やファッション、キャリアなどの「相談系」まで、知識やスキル、経験を売り買いできるスキルマーケットです。現在、450 種類以上のカテゴリから豊富なサービスを簡単に比較検討することが可能。サービス提供のすべては、オンライン上で完結し、購入・販売もココナラが仲介する安全な決済サービスを利用できます。

プロダクト開発部 R&Dグループ マネージャーの古田 周平氏は、「ココナラのポイントは、スキルの出品者と購入者をいかに高い精度でマッチングするかにあります」と話します。「現在、マッチングのためのレコメンド機能を構築したり、検索アルゴリズムを機械学習で最適化したりすることで、出品者、および購入者によりよい体験を提供することを目指しています。サービスは右肩上がりに成長しており、それに伴ってデータも蓄積されています。このデータをいかに活用するかが最大の課題でした。」

ココナラでは、1 日に 1 回、すべてのデータをバッチ処理で BigQuery に取り込み、Cloud Composer を使って検索エンジンにアップロードするためのデータを集計する ML パイプラインを構築していました。古田氏は、「簡単なルールベースのアルゴリズムを組む程度であれば十分でしたが、データの集計をプロダクト バッチ処理系と同じサーバーで処理していたので、処理時間が日に日に長くなり、サーバーの増強やチューニングが常態化し、管理も煩雑でした」と話します。

より高品質なマッチング環境を実現し、顧客満足度を向上させていくことを目的に、2021 年より新たに MLOps 基盤を構築することを決定します。当初は、Kubernetes を使ったコンテナ ベースの仕組みをフル スクラッチで開発することを検討していました。しかし、そのためには Kubernetes などの高度な知識を持ったエンジニアを採用することが必要であり、システム構築後も運用、メンテナンスを自社で行う必要があるため現実的ではありませんでした。

「ちょうどその頃 Google Cloud の担当者からフルマネージドの MLOps 基盤である Vertex AI Pipelines を紹介されました。そこで 2022 年 2 月より、新技術採用フローで検証を開始し、約 2 か月検討をして、開発、運用、コストなど、あらゆる面でメリットがあると判断して採用を決めました。まずは自社のサンド ボックス環境で検証を開始し、効果が確認できたことから、既存のアルゴリズムの移行や、新たに開発を検討している機能への組み込みなどを進めています。」(古田氏)

Vertex AI Pipelines の採用を決めた理由を、プロダクト開発部 R&Dグループ 検索・推薦グロースチーム アルゴリズムリードの大瀧 貢氏は、「Vertex AI Pipelines は、ココナラでいま必要としている機能が容易に実現できるのはもちろん、将来性も非常に高いと感じました。例えば、エンドポイントの提供やベクトル近傍探索、Auto ML などのツールとのシームレスな連携など、中長期的な視点でも期待しています。従量課金制なので、コスト面でも計画的に利用できます」と話しています。

A/B テストの結果、CTR、CVR、MRRなど、多くの指標が改善

新しい MLOps 基盤は、2022 年 6 月よりココナラのサイトで本格的に運用が開始されています。システム構成は、Cloud Functions から Vertex AI Pipelines に実行構成を投げ、その結果を BigQuery に格納し、さらにプロダクトで利用しているデータベースに転送する仕組みになっています。またビルドのアーティファクト管理に、Artifact Registry を採用。さらに運用面では、ログの監視に Cloud Logging を採用しています。

大瀧氏は、「以前は、さまざまなログを取得して通知する仕組みを独自に作っていたのですが、Cloud Logging を使ってみるとログの収集・通知が本当に快適になりました。Cloud Functions を利用することで、Vertex AI Pipelines のバッチ処理のキック部分を小さく作ることができ、全体として非常に柔軟性の高い構成にできたと思っています」と話します。

Vertex AI Pipelines を採用したことで、検索アルゴリズムが全自動で改善される仕組みを実現しています。具体的には、購入者がサービスを検索した結果から、どのサービスをクリックしたのか、どのサービスを購入したのかなどの行動ログが BigQuery に蓄積されます。BigQuery に蓄積された行動ログに基づいて、モデルが学習され、キーワード検索のアルゴリズムが最適化されます。これにより、行動ログのデータがたまれば、たまるほど検索アルゴリズムの精度が向上し、同時に顧客体験も向上していきます。

Vertex AI Pipelines を導入した効果を古田氏は、「A/B テストの結果では、CTR、CVR、MRR(Mean Reciprocal Rank)など、多くの指標で改善傾向が見られました。こうした改善効果は、経営層も高く評価してくれています。インフラに関する高いスキルを持ったエンジニアを採用しなくても開発、運用ができたこともメリットの 1 つ。UI も含め、ML ライフサイクルを統合管理できるサービスとしては、Vertex AI Pipelines が一番だと思っています」と話します。

また Google Cloud のサポートについて大瀧氏は、「Google Cloud のアカウントチームの担当者から、事前にアーキテクチャのレビューをしてもらい、常に情報提供をしてもらえたので、システム構築において苦労はなく、あっという間に終わりました。不明な点があれば、気軽に問い合わせができたこともスムーズな開発ができた要因の 1 つです。Vertex AI Pipelines を採用したことで、開発工数がかなり削減され、検索アルゴリズムの改善や施策の効果検証などに集中することができました」と話しています。

ココナラの強化ポイントは検索とレコメンド

今後のココナラの強化ポイントには、大きくは検索とレコメンドの 2 点が挙げられます。大瀧氏は、次のように話します。「検索では、アルゴリズムのさらなる改善やヒューリスティックな部分の刷新など、やることは山積みです。特に、属性ベースのリランキングなどアルゴリズムの高度化が急務です。例えば、ひと言に『イラスト』といっても、SNSのアイコンなのか、カタログの製品説明図なのか、購入者が探している『イラスト』はさまざまです。こうしたマッチングの精度をいかに向上していくかが課題です。レコメンドに関しては、現在は簡易的な仕組みで実現していますが、将来的には Vertex AI Matching Engine の利用を含めた改修を検討しています。さらに、学習部分のチューニング、アップデートに関しては、Vertex AI のハイパー パラメータ調整機能を利用することも視野に入れています。」

今後の展望について古田氏は、「Vertex AI Pipelines はフル マネージドのサービスなので、エンジニア 3 名という少ないリソース、および約 2 か月という短期間で MLOps 基盤を構築できました。今回のプロジェクトは、実は当初 2 年越しでの実現を想定していましたが、Vertex AI Pipelines により今期実施できました。今後はパーソナライズもより進化させていきたいと思っているので、Vertex AI Pipelines はますます重要なパーツになります。そのためには Vertex AI Pipelines の機能をフルに活用するための知見やノウハウを蓄積していくことが必要です。また、キーワード検索と同様に、データを活用したマッチングのためのアルゴリズムの改善を必要とするほかの部門に横展開するためのナレッジや、成功事例などの情報提供を Google Cloud には期待しています」と話しています。

2012 年 1 月に設立。「一人ひとりが『自分のストーリー』を生きていく世の中をつくる」というビジョンに基づいて、スキルマーケット「ココナラ」や、一人ひとりにあった弁護士が見つかる検索メディア「ココナラ法律相談」などの運営、開発を事業として展開。「個人の知識・スキル・経験を可視化し、必要とする全ての人に結びつけ、個人をエンパワーメントするプラットフォームを提供する。」というミッションの実現を目指しています。

インタビュイー

・プロダクト開発部 R&Dグループ

マネージャー

古田 周平 氏

・プロダクト開発部 R&Dグループ

検索・推薦グロースチーム

アルゴリズムリード

大瀧 貢 氏

ココナラの導入事例 PDF はこちらをご覧ください。

その他の導入事例はこちらをご覧ください。