Vertex AI Platform

Innova più rapidamente con l'IA di livello enterprise, ottimizzata dai modelli Gemini

Vertex AI è una piattaforma di sviluppo AI unificata e completamente gestita per creare e utilizzare l'AI generativa. Accedi e utilizza Vertex AI Studio, Agent Builder e oltre 200 foundation model.

I nuovi clienti ricevono fino a 300 $ di crediti gratuiti per provare Vertex AI e altri prodotti Google Cloud.

Funzionalità

Gemini, i modelli multimodali più avanzati di Google

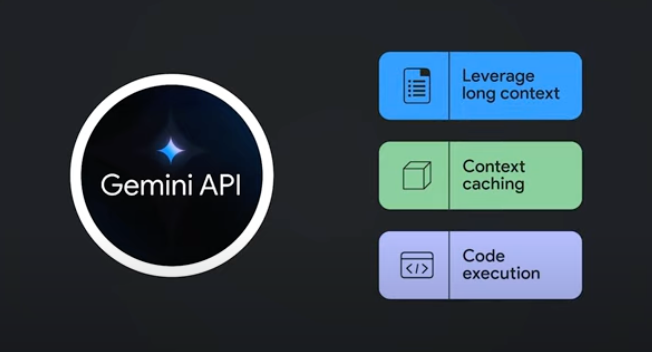

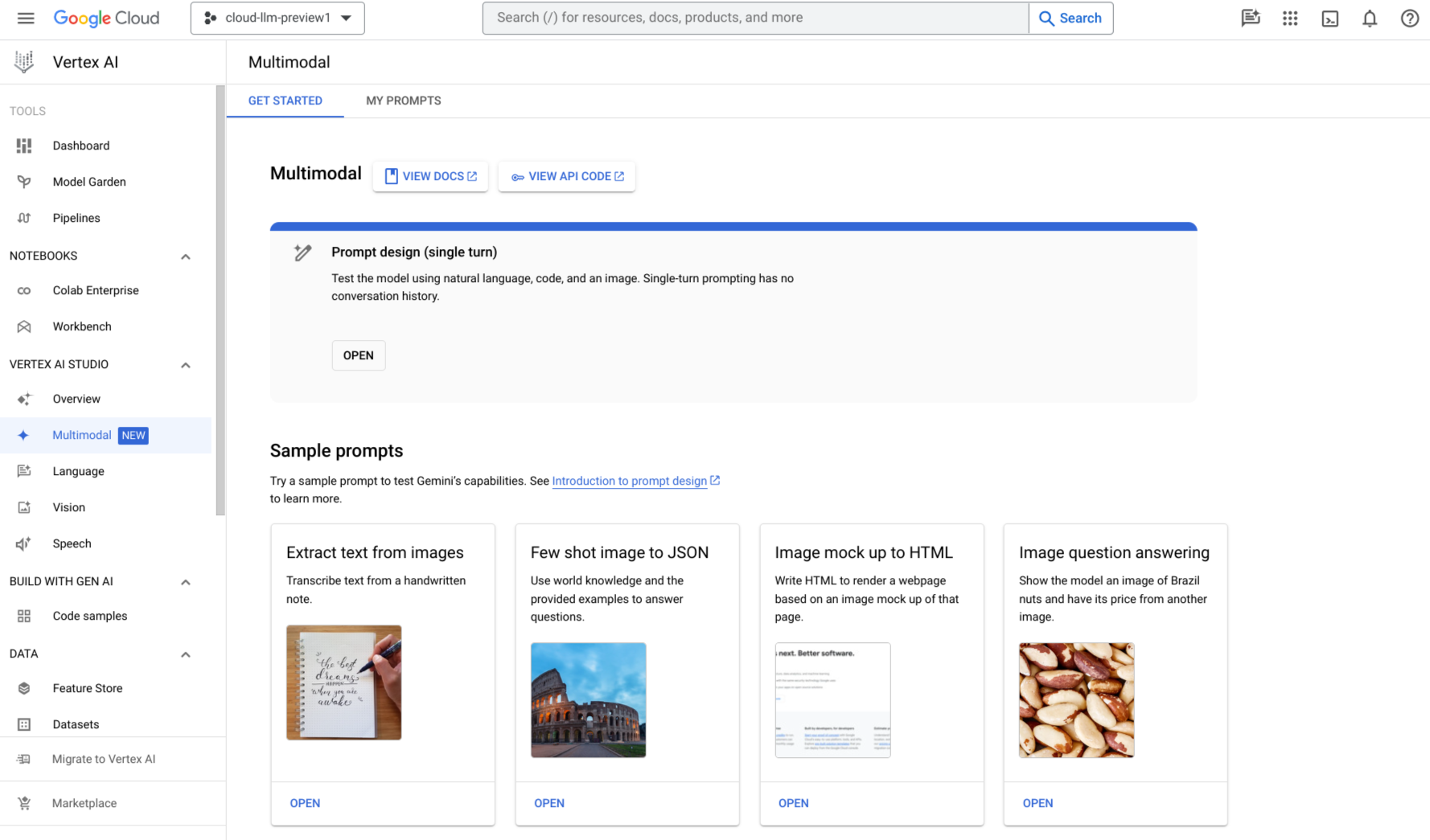

Vertex AI offre l'accesso agli ultimi modelli Gemini di Google, tra cui Gemini 3. Gemini è in grado di comprendere praticamente qualsiasi input, combinare diversi tipi di informazioni e generare qualsiasi output. Esegui prompt e test di Gemini in Vertex AI Studio utilizzando testo, immagini, video o codice. Utilizzando il ragionamento avanzato e le funzionalità di generazione all'avanguardia di Gemini, gli sviluppatori possono provare prompt di esempio per estrarre il testo dalle immagini, convertire il testo delle immagini in formato JSON e persino generare risposte sulle immagini caricate per creare applicazioni IA di nuova generazione.

Più di 200 modelli e strumenti di AI generativa

Scegli tra la vastissima gamma di modelli proprietari (Gemini, Imagen, Chirp, Veo), di terze parti (la famiglia di modelli Claude di Anthropic) e open (Gemma, Llama 3.2) in Model Garden. Utilizza le estensioni per consentire ai modelli di recuperare informazioni in tempo reale e attivare azioni. Puoi anche personalizzare i modelli in base al tuo caso d'uso con una serie di opzioni di ottimizzazione.

Il nostro Gen AI evaluation service fornisce strumenti di livello enterprise per la valutazione oggettiva e basata sui dati dei modelli di AI generativa.

AI Platform open e integrata

I data scientist possono muoversi più velocemente con gli strumenti di Vertex AI Platform per l'addestramento, la regolazione e il deployment di modelli ML.

I notebook Vertex AI, che includono la tua scelta tra Colab Enterprise o Workbench, sono integrati in modo nativo con BigQuery e forniscono un'unica piattaforma per tutti i dati e gli workload AI.

Vertex AI Training e Previsione consentono di ridurre i tempi di addestramento e di eseguire facilmente il deployment dei modelli in produzione grazie alla scelta di framework open source e di infrastruttura AI ottimizzata.

MLOps per l'AI predittiva e generativa

Vertex AI Platform fornisce strumenti MLOps appositamente creati per data scientist e tecnici ML per automatizzare, standardizzare e gestire i progetti ML.

Gli strumenti modulari ti aiutano a collaborare tra i team e a migliorare i modelli durante l'intero ciclo di vita dello sviluppo: identifica il modello migliore per un caso d'uso con Vertex AI Evaluation, orchestra i flussi di lavoro con Vertex AI Pipelines , gestisci qualsiasi modello con Model Registry, gestisci, condividi e riutilizza le funzionalità ML con Feature Store e monitora i modelli per rilevare disallineamenti e deviazioni degli input.

Crea, scala e gestisci agenti enterprise

Vertex AI Agent Builder è la nostra piattaforma aperta e completa che consente alle aziende di creare, scalare e gestire rapidamente agenti di livello enterprise basati sui dati aziendali. Fornisce la base full-stack e l'ampia scelta per gli sviluppatori di cui hai bisogno per trasformare le tue applicazioni e i tuoi workflow in sistemi agentici potenti e affidabili su scala globale.

Come funziona

Vertex AI fornisce varie opzioni per addestrare un modello ed eseguire il deployment:

- L'AI generativa ti dà accesso a modelli di AI generativa di grandi dimensioni, tra cui Gemini 3, in modo da poterli valutare, ottimizzare ed eseguire il deployment per favorirne l'uso nelle tue applicazioni basate sull'AI.

- Model Garden ti consente di scoprire, testare, personalizzare ed eseguire il deployment di Vertex AI e selezionare modelli e asset open source (OSS).

- L'addestramento personalizzato ti fornisce il controllo completo sul processo di addestramento, compresi l'utilizzo del framework ML preferito, la scrittura del codice di addestramento e la scelta delle opzioni di ottimizzazione degli iperparametri.

Vertex AI fornisce varie opzioni per addestrare un modello ed eseguire il deployment:

- L'AI generativa ti dà accesso a modelli di AI generativa di grandi dimensioni, tra cui Gemini 3, in modo da poterli valutare, ottimizzare ed eseguire il deployment per favorirne l'uso nelle tue applicazioni basate sull'AI.

- Model Garden ti consente di scoprire, testare, personalizzare ed eseguire il deployment di Vertex AI e selezionare modelli e asset open source (OSS).

- L'addestramento personalizzato ti fornisce il controllo completo sul processo di addestramento, compresi l'utilizzo del framework ML preferito, la scrittura del codice di addestramento e la scelta delle opzioni di ottimizzazione degli iperparametri.

Crea con i modelli Gemini

Inizia a utilizzare i modelli multimodali di Google

Inizia a utilizzare i modelli multimodali di Google

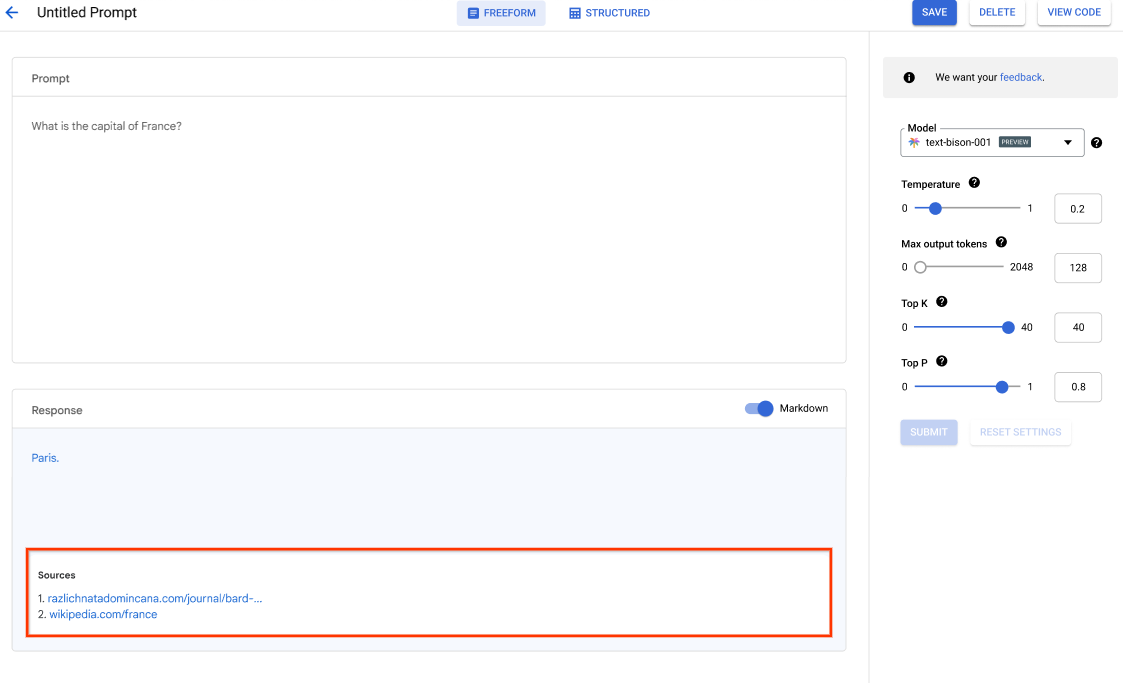

Usa Vertex AI Studio per progettare, testare e gestire prompt per i modelli Gemini mediante linguaggio naturale, codice, immagini o video. Prova i prompt di esempio per estrarre il testo dalle immagini, creare una simulazione dell'immagine in HTML e persino generare risposte sulle immagini o sui video caricati.

Puoi anche iniziare a testare Gemini su Vertex AI con una chiave API.

Accedi ai modelli Gemini tramite l'API Gemini in Google Cloud Vertex AI

- Python

- JavaScript

- Java

- Go

- Curl

Tutorial, guide rapide e lab

Inizia a utilizzare i modelli multimodali di Google

Inizia a utilizzare i modelli multimodali di Google

Usa Vertex AI Studio per progettare, testare e gestire prompt per i modelli Gemini mediante linguaggio naturale, codice, immagini o video. Prova i prompt di esempio per estrarre il testo dalle immagini, creare una simulazione dell'immagine in HTML e persino generare risposte sulle immagini o sui video caricati.

Puoi anche iniziare a testare Gemini su Vertex AI con una chiave API.

Esempio di codice

Accedi ai modelli Gemini tramite l'API Gemini in Google Cloud Vertex AI

- Python

- JavaScript

- Java

- Go

- Curl

Applicazioni e agenti AI

Sblocca funzionalità di AI avanzate con Vertex AI

Sblocca funzionalità di AI avanzate con Vertex AI

Crea agenti e applicazioni di AI generativa pronti per la produzione su una piattaforma che si adatta alle tue esigenze di scalabilità. La nostra piattaforma di sviluppo AI, Vertex AI, fornisce un ambiente sicuro per lo sviluppo e il deployment di modelli e applicazioni di AI.

Per gli sviluppatori, Vertex AI rimane la nostra piattaforma avanzata in cui è possibile creare, personalizzare e ottimizzare agenti sofisticati utilizzando framework come l'Agent Development Kit (ADK).

Inizia con questo codelab e crea la tua prima applicazione di AI oggi stesso

Tutorial, guide rapide e lab

Sblocca funzionalità di AI avanzate con Vertex AI

Sblocca funzionalità di AI avanzate con Vertex AI

Crea agenti e applicazioni di AI generativa pronti per la produzione su una piattaforma che si adatta alle tue esigenze di scalabilità. La nostra piattaforma di sviluppo AI, Vertex AI, fornisce un ambiente sicuro per lo sviluppo e il deployment di modelli e applicazioni di AI.

Per gli sviluppatori, Vertex AI rimane la nostra piattaforma avanzata in cui è possibile creare, personalizzare e ottimizzare agenti sofisticati utilizzando framework come l'Agent Development Kit (ADK).

Inizia con questo codelab e crea la tua prima applicazione di AI oggi stesso

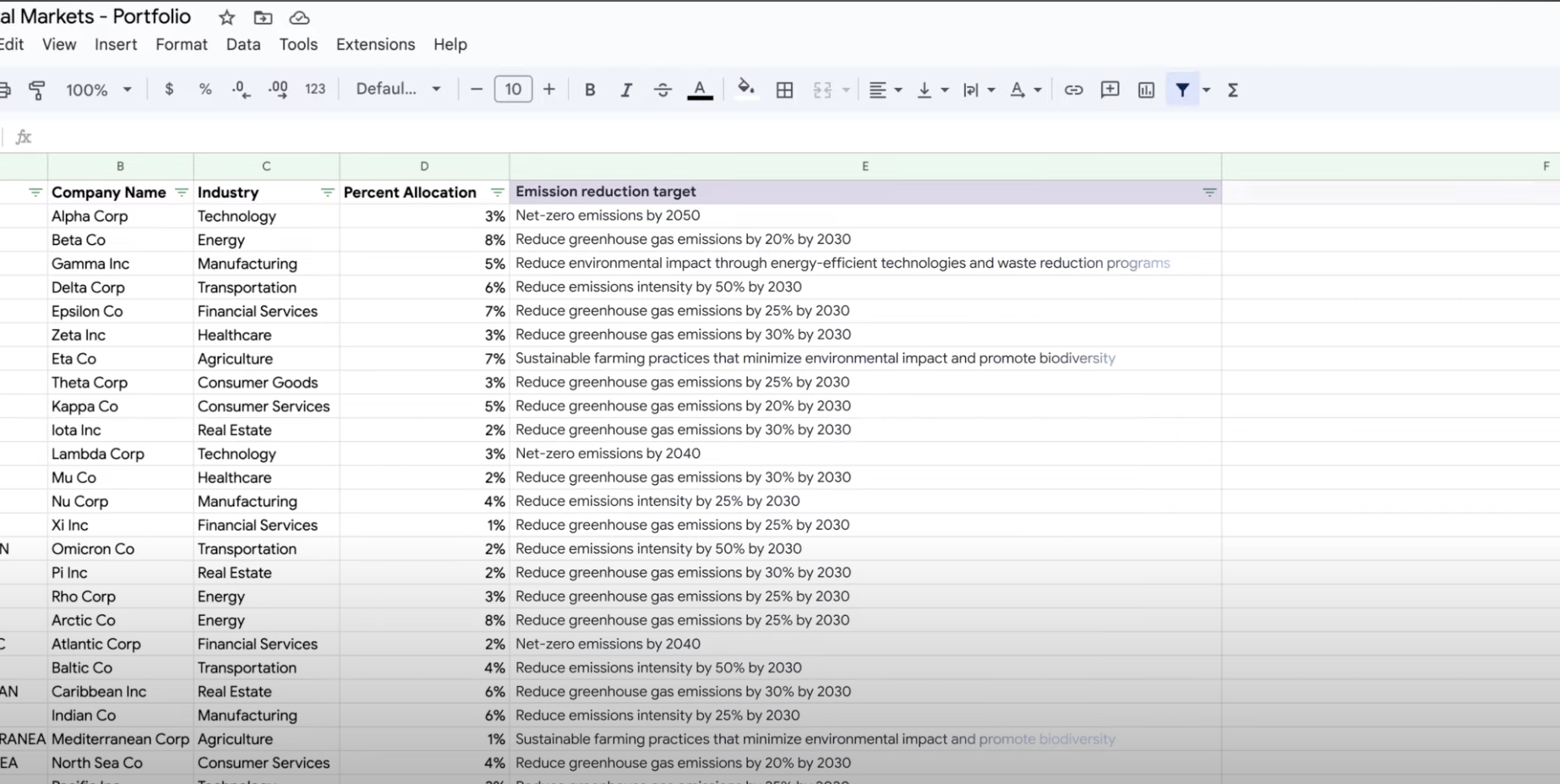

Estrai, riepiloga e classifica i dati

Usa l'AI generativa per il riepilogo, la classificazione e l'estrazione

Usa l'AI generativa per il riepilogo, la classificazione e l'estrazione

Scopri come creare prompt di testo per gestire un numero qualsiasi di attività con il supporto dell'IA generativa di Vertex AI. Alcune delle attività più comuni sono la classificazione, il riepilogo e l'estrazione. Gemini su Vertex AI ti consente di progettare prompt con flessibilità in termini di struttura e formato.

Tutorial, guide rapide e lab

Usa l'AI generativa per il riepilogo, la classificazione e l'estrazione

Usa l'AI generativa per il riepilogo, la classificazione e l'estrazione

Scopri come creare prompt di testo per gestire un numero qualsiasi di attività con il supporto dell'IA generativa di Vertex AI. Alcune delle attività più comuni sono la classificazione, il riepilogo e l'estrazione. Gemini su Vertex AI ti consente di progettare prompt con flessibilità in termini di struttura e formato.

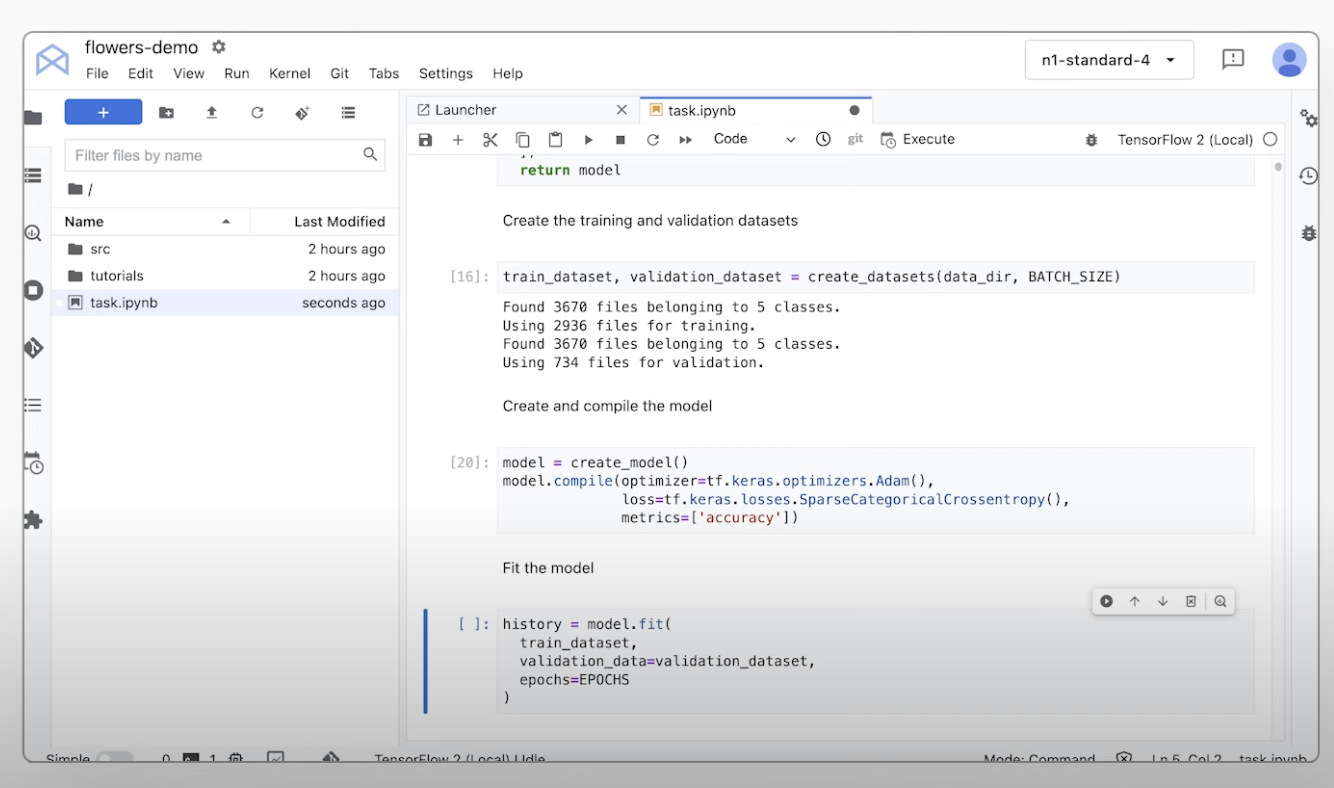

Addestra modelli ML personalizzati

Panoramica e documentazione sull'addestramento ML personalizzato

Panoramica e documentazione sull'addestramento ML personalizzato

Ottieni una panoramica del flusso di lavoro dell'addestramento personalizzato in Vertex AI, dei vantaggi dell'addestramento personalizzato e delle varie opzioni di addestramento disponibili. Questa pagina descrive inoltre ogni passaggio del flusso di lavoro di addestramento ML, dalla preparazione dei dati alle previsioni.

Guarda una procedura dettagliata video sui passaggi necessari per addestrare modelli personalizzati su Vertex AI.

Tutorial, guide rapide e lab

Panoramica e documentazione sull'addestramento ML personalizzato

Panoramica e documentazione sull'addestramento ML personalizzato

Ottieni una panoramica del flusso di lavoro dell'addestramento personalizzato in Vertex AI, dei vantaggi dell'addestramento personalizzato e delle varie opzioni di addestramento disponibili. Questa pagina descrive inoltre ogni passaggio del flusso di lavoro di addestramento ML, dalla preparazione dei dati alle previsioni.

Guarda una procedura dettagliata video sui passaggi necessari per addestrare modelli personalizzati su Vertex AI.

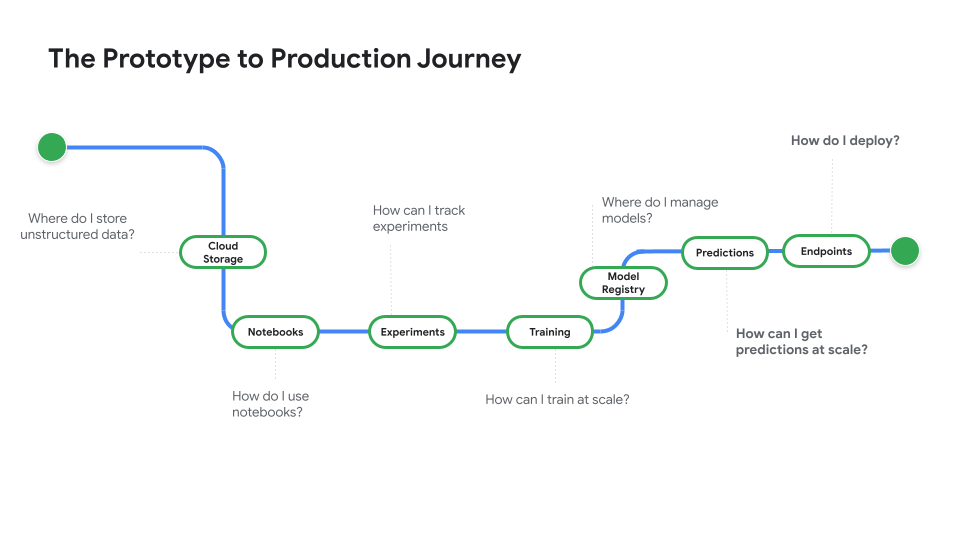

Esegui il deployment di un modello per l'uso in produzione

Deployment per previsioni batch o online

Deployment per previsioni batch o online

Quando è tutto pronto per utilizzare il modello per risolvere un problema reale, registralo in Vertex AI Model Registry e utilizza il servizio di previsione Vertex AI per previsioni batch e online.

Guarda Prototype to Production (Dal prototipo alla produzione), una serie di video che ti guida dal codice del blocco note a un modello di cui è stato eseguito il deployment.

Tutorial, guide rapide e lab

Deployment per previsioni batch o online

Deployment per previsioni batch o online

Quando è tutto pronto per utilizzare il modello per risolvere un problema reale, registralo in Vertex AI Model Registry e utilizza il servizio di previsione Vertex AI per previsioni batch e online.

Guarda Prototype to Production (Dal prototipo alla produzione), una serie di video che ti guida dal codice del blocco note a un modello di cui è stato eseguito il deployment.

Prezzi

| Come funzionano i prezzi di Vertex AI | Paga solo per gli strumenti Vertex AI, lo spazio di archiviazione, il computing e le risorse Google Cloud utilizzate. I nuovi clienti ricevono 300 $ di crediti gratuiti per provare Vertex AI e altri prodotti Google Cloud. | |

|---|---|---|

| Strumenti e utilizzo | Descrizione | Prezzo |

AI generativa | Modello Imagen per la generazione di immagini In base ai prezzi relativi a input di immagini, input di caratteri o addestramento personalizzato. | A partire da $0,0001 |

Generazione di testi, chat e codice In base a ogni 1000 caratteri di input (prompt) e ogni 1000 caratteri di output (risposta). | A partire da $0,0001 per 1.000 caratteri | |

Modelli addestrati personalizzati | Addestramento di modelli personalizzati In base al tipo di macchina utilizzata per ora, alla regione e a eventuali acceleratori utilizzati. Ottieni una stima tramite i team di vendite o il Calcolatore prezzi. | Contatta il team di vendita |

Vertex AI Notebooks | Risorse di calcolo e archiviazione In base alle stesse tariffe di Compute Engine e Cloud Storage. | Fai riferimento ai prodotti |

Commissioni di gestione Oltre all'utilizzo delle risorse sopra indicate, vengono applicate commissioni di gestione in base alla regione, alle istanze, ai blocchi note e ai blocchi note gestiti utilizzati. Mostra dettagli. | Fai riferimento ai dettagli | |

Vertex AI Pipelines | Esecuzione e costi aggiuntivi In base al costo di esecuzione, alle risorse utilizzate e a eventuali commissioni di servizio aggiuntive. | A partire da 0,03 $ per esecuzione di pipeline |

Vertex AI Vector Search | Costi di pubblicazione e creazione In base alle dimensioni dei dati, alla quantità di query al secondo (QPS) che vuoi eseguire e al numero di nodi utilizzati. Vedi esempio | Fai riferimento all'esempio |

Visualizza i dettagli dei prezzi per tutte le funzionalità e i servizi di Vertex AI.

Come funzionano i prezzi di Vertex AI

Paga solo per gli strumenti Vertex AI, lo spazio di archiviazione, il computing e le risorse Google Cloud utilizzate. I nuovi clienti ricevono 300 $ di crediti gratuiti per provare Vertex AI e altri prodotti Google Cloud.

AI generativa

Modello Imagen per la generazione di immagini

In base ai prezzi relativi a input di immagini, input di caratteri o addestramento personalizzato.

Starting at

$0,0001

Generazione di testi, chat e codice

In base a ogni 1000 caratteri di input (prompt) e ogni 1000 caratteri di output (risposta).

Starting at

$0,0001

per 1.000 caratteri

Modelli addestrati personalizzati

Addestramento di modelli personalizzati

In base al tipo di macchina utilizzata per ora, alla regione e a eventuali acceleratori utilizzati. Ottieni una stima tramite i team di vendite o il Calcolatore prezzi.

Contatta il team di vendita

Vertex AI Notebooks

Risorse di calcolo e archiviazione

In base alle stesse tariffe di Compute Engine e Cloud Storage.

Fai riferimento ai prodotti

Commissioni di gestione

Oltre all'utilizzo delle risorse sopra indicate, vengono applicate commissioni di gestione in base alla regione, alle istanze, ai blocchi note e ai blocchi note gestiti utilizzati. Mostra dettagli.

Fai riferimento ai dettagli

Vertex AI Pipelines

Esecuzione e costi aggiuntivi

In base al costo di esecuzione, alle risorse utilizzate e a eventuali commissioni di servizio aggiuntive.

Starting at

0,03 $

per esecuzione di pipeline

Vertex AI Vector Search

Costi di pubblicazione e creazione

In base alle dimensioni dei dati, alla quantità di query al secondo (QPS) che vuoi eseguire e al numero di nodi utilizzati. Vedi esempio

Fai riferimento all'esempio

Visualizza i dettagli dei prezzi per tutte le funzionalità e i servizi di Vertex AI.

Inizia la tua proof of concept

Business case

Sblocca tutto il potenziale dell'AI generativa

"L'accuratezza della soluzione di AI generativa di Google Cloud e la praticità di Vertex AI Platform ci danno la fiducia di cui avevamo bisogno per implementare questa tecnologia all'avanguardia nel cuore della nostra attività e raggiungere il nostro obiettivo a lungo termine di un tempo di risposta di zero minuti."

Abdol Moabery, CEO di GA Telesis

Contenuti correlati

In che modo il grounding dei modelli ti aiuta ad avere un vantaggio competitivo.

Leggi il report

In che modo l'AI generativa porta la ricerca aziendale a un livello completamente nuovo.

Leggi il report

Scopri come i nostri clienti stanno implementando l'AI generativa per trasformare la propria azienda.

Scopri di più

Report degli analisti

Google ha ricevuto il titolo di Leader nell'IDC MarketScape 2025 per il software di modelli di base del ciclo di vita dell'AI generativa a livello mondiale. Scarica il report

Google ha ricevuto il titolo di Leader nel report The Forrester Wave™: AI Foundation Models For Language, Q2 2024 Leggi il report

Google ha ricevuto il titolo di Leader nel report The Forrester Wave™: AI/ML Platforms, Q3 2024. Leggi il report